¡Estamos presenciando una gran revolución de la IA!

Cada día recibimos una nueva aplicación que tiene capacidades asombrosas. Con muchas aplicaciones y programas que usan IA y aprendizaje automático entrando en nuestras vidas; debemos tomar más tiempo para aprender acerca de estos.

En esta publicación, exploraremos máquina de aprendizaje en detalle. Además, nos centraremos específicamente en temas de aprendizaje e inferencia de aprendizaje automático.

Comencemos con los fundamentos.

¿Qué es el Aprendizaje Automático?

Muchas veces vemos que los términos "aprendizaje automático" e "inteligencia artificial" se usan juntos. Entonces, primero aclaremos eso. El aprendizaje automático es una rama de la inteligencia artificial. Implica entrenar algoritmos para producir predicciones o elecciones basadas en datos.

Además, permite que los sistemas mejoren su rendimiento automáticamente en función de experiencias pasadas.

Inteligencia Artificial, por otro lado, es la imitación del intelecto humano. Por lo tanto, las computadoras están destinadas a pensar y actuar como humanos. Comprende varios subcampos, como el aprendizaje automático, la visión artificial y el procesamiento del lenguaje natural.

Desarrollo de Modelos de Machine Learning

Un modelo de aprendizaje automático es un algoritmo. Creamos estos algoritmos para mejorar automáticamente el rendimiento a través del aprendizaje de datos. Los usamos para examinar datos de entrada, anticipar resultados futuros o emitir juicios.

Demos un ejemplo. Para categorizar las fotografías como de una flor o de un gato, se puede entrenar a un modelo para que identifique las imágenes.

Y puede decidir si la imagen es de una flor o de un gato. El principio fundamental del aprendizaje automático es que el rendimiento del modelo debe mejorarse continuamente. Debería estar reaccionando bien a los parámetros cambiantes en los datos.

Principalmente, realizamos esta capacitación de aprendizaje automático en Cuaderno Jupyter, que es una herramienta fantástica para el proyecto relacionado con cualquier dato.

Entrenamiento de un modelo

El proceso de enseñar un algoritmo para generar predicciones o realizar acciones en función de los datos de entrada se denomina "entrenamiento". Durante el entrenamiento, los parámetros del sistema se modifican para permitir que el algoritmo funcione. En última instancia, estamos tratando de producir predicciones precisas sobre datos nuevos.

Supervisado y aprendizaje sin supervisión son las dos categorías principales del aprendizaje automático.

Aprendizaje supervisado

Se utiliza un conjunto de datos etiquetados para entrenar el algoritmo en el aprendizaje supervisado. En este tipo de aprendizaje automático, se especifica el resultado esperado para cada entrada. El algoritmo hace predicciones sobre datos nuevos. Además, aprende las conexiones entre las entradas y salidas utilizando esta información.

Debido a que el modelo recibe supervisión sobre cuáles deberían ser los resultados deseados, este tipo de aprendizaje se denomina "supervisado".

Aplicaciones como reconocimiento de voz, clasificación de imágenes, y el procesamiento del lenguaje natural hacen uso del aprendizaje supervisado. En estas aplicaciones, el algoritmo se entrena en grandes conjuntos de datos etiquetados. Por lo tanto, podemos pronosticar datos nuevos e imprevistos.

Además, las asignaciones de entrada a salida deben aprenderse para que sean lo más precisas posible.

Encontrar el mapeo más preciso entre entradas y salidas es el objetivo del aprendizaje supervisado.

Aprendizaje sin supervisión

El aprendizaje no supervisado es un subconjunto del aprendizaje automático. Entrenamos el algoritmo en un conjunto de datos sin etiquetar. Por lo tanto, los modelos logran detectar patrones o correlaciones en los datos. No necesitamos definir específicamente cuáles deberían ser los resultados. Este tipo de aprendizaje se conoce como "no supervisado". Esto se debe a que el modelo no recibe una guía explícita sobre cuáles deberían ser los resultados.

Las aplicaciones como la detección de anomalías, el agrupamiento y la reducción de dimensionalidad requieren un aprendizaje no supervisado. En estas aplicaciones, el algoritmo debe reconocer patrones o correlaciones en los datos. Y es sin instrucciones explícitas después de haber sido entrenado en una muestra de datos no etiquetados.

El aprendizaje no supervisado tiene como objetivo descubrir patrones o estructuras ocultas. Podemos usarlo en una variedad de tareas, como comprimir datos o agrupar cosas similares.

Optimización de aprendizaje automático

El proceso de optimización es fundamental en la construcción de un modelo de aprendizaje automático. El propósito de la optimización es reducir la diferencia entre las predicciones del modelo y los valores reales en los datos de entrenamiento.

Este proceso ayuda al modelo a aprender los vínculos entre entradas y salidas. Por lo tanto, podemos obtener las predicciones más precisas posibles.

Al reducir el error, el modelo puede generalizarse mejor a datos nuevos y previamente desconocidos. Por lo tanto, puede producir predicciones más sólidas y confiables.

En el aprendizaje automático, el proceso de optimización se logra mediante el uso de algoritmos como el descenso de gradiente. Entonces, nuestro algoritmo ajusta continuamente los parámetros hasta que se minimiza el error. El procedimiento de optimización es necesario para que las predicciones del modelo sean precisas.

Conjunto de datos de entrenamiento de Machine Learning

Un conjunto de datos de entrenamiento es un conjunto de datos que se utiliza para entrenar un modelo de aprendizaje automático. Entrenamos al modelo sobre cómo generar predicciones mostrando ejemplos de entradas y resultados. En base a estos datos de entrenamiento, el modelo modifica su parámetro.

Por lo tanto, la precisión de sus predicciones se evalúa utilizando un conjunto de datos distinto, el conjunto de validación.

El conjunto de datos de entrenamiento debe reflejar el problema que se está resolviendo. Y debe contener suficientes datos para entrenar adecuadamente el modelo. Las predicciones del modelo pueden ser inexactas si el conjunto de datos de entrenamiento es demasiado pequeño.

O puede que no sea muy representativo. Como resultado, un preprocesamiento extenso del conjunto de datos de entrenamiento es un requisito. Por lo tanto, podemos garantizar que el modelo tiene el mayor éxito.

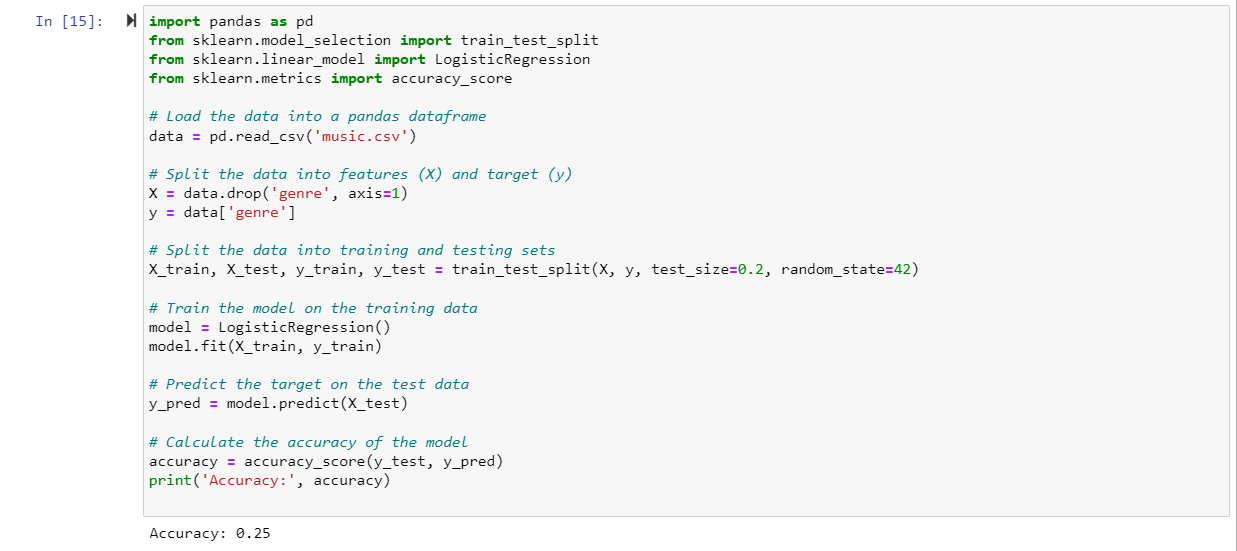

Un ejemplo de entrenamiento:

Pongamos un ejemplo para entender el proceso de entrenamiento.

En este ejemplo, asumimos que tenemos un conjunto de datos llamado "music.csv". Tiene valores de género, edad y género. Por lo tanto, predice qué género de música está escuchando una persona en función de su edad y sexo.

Este es el código Python para un entrenamiento de aprendizaje automático simple usando la biblioteca scikit-learn: El enfoque de regresión logística se usa en este código para entrenar un modelo en los datos y luego evaluar su precisión en los datos de prueba.

Los datos se colocan inicialmente en el marco de datos de pandas antes de dividirse en características (X) y objetivos (Y) (y). Después de eso, los datos se dividen en conjuntos de entrenamiento y prueba, con el 80 % de los datos utilizados para el entrenamiento y el 20 % para la prueba. Luego, el modelo se entrena con los datos de entrenamiento antes de probarse con los datos de prueba.

Inferencia en aprendizaje automático

El proceso de usar un modelo entrenado para hacer predicciones sobre datos nuevos se denomina inferencia.

Dicho de otro modo, es la aplicación de la información obtenida durante el entrenamiento. El modelo recibe datos nuevos y genera una predicción o juicio basado en los patrones que descubrió en los datos de entrenamiento.

Las predicciones del modelo serán precisas según la calidad de los datos de entrenamiento. Además, dependerá de la arquitectura del modelo elegido y de las técnicas utilizadas para entrenar el modelo.

Importancia de la inferencia en las aplicaciones

En la inferencia, permitimos que el modelo proporcione resultados para un objetivo específico. Estos pueden variar, como la clasificación de imágenes, el procesamiento del lenguaje natural o los sistemas de recomendación. La precisión del paso de inferencia tiene un impacto directo en todo el rendimiento del sistema.

Es fundamental para la implementación real de modelos de aprendizaje automático en aplicaciones del mundo real.

La entrada de datos nuevos y desconocidos

El proceso de inferencia en el aprendizaje automático comienza con la adición de datos nuevos al modelo. Estos datos deben procesarse previamente para que coincidan con el formato de entrada utilizado para entrenar el modelo.

Predicciones basadas en patrones aprendidos

Luego, el modelo utiliza los datos de entrada para hacer predicciones basadas en los patrones aprendidos de los datos de entrenamiento. La precisión de las predicciones depende de la calidad de los datos de entrenamiento y de las técnicas utilizadas.

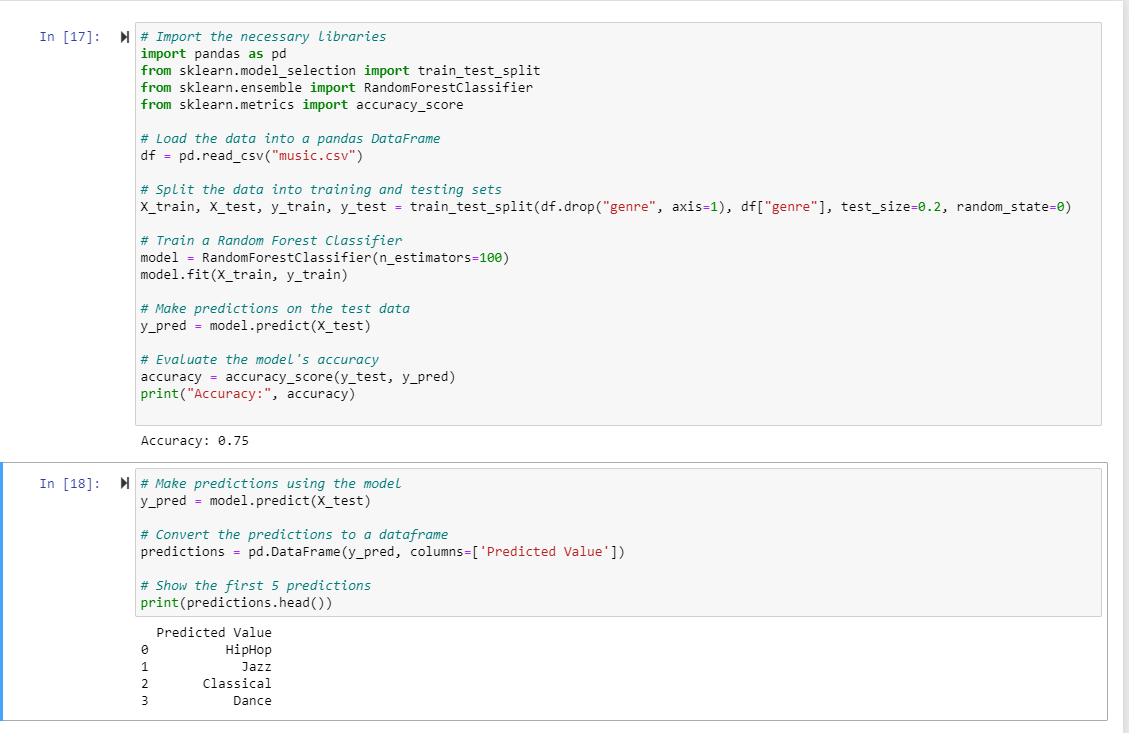

Un ejemplo de inferencia:

Como el ejemplo anterior; primero entrenaremos los datos y luego implementaremos la inferencia. En este caso, hemos utilizado RandomForestClassifier en lugar de LogisticRegression.

Nuevamente estamos produciendo predicciones en Python utilizando el kit de herramientas sci-kit-learn. Supongamos que hemos entrenado un modelo y tenemos un conjunto de datos llamado prueba X sobre el que deseamos hacer predicciones.

Este código predice en la prueba X del conjunto de datos de prueba mediante la función de predicción del modelo entrenado. Luego, las predicciones se guardan en un marco de datos, y se muestran los cinco primeros.

Factores que influyen en el rendimiento de la inferencia

Varios elementos importantes influyen en el rendimiento de la inferencia en el aprendizaje automático.

Velocidad de la etapa de inferencia

La velocidad de inferencia es una preocupación crucial ya que afecta directamente el rendimiento del sistema. Los tiempos de inferencia más rápidos pueden permitir una toma de decisiones o una predicción más rápidas. Además, aumenta la utilidad del modelo.

Precisión de predicción

Otro componente clave es la precisión de las predicciones creadas durante la inferencia. Esto se debe a que el objetivo del modelo es proporcionar resultados que estén lo más cerca posible de los valores genuinos. La precisión de salida del modelo depende de la calidad de los datos de entrenamiento.

Además, está muy relacionado con la arquitectura del modelo.

La importancia de optimizar la etapa de inferencia

Dada la importancia de la velocidad y la precisión de la inferencia, es fundamental optimizar el proceso de inferencia para obtener resultados eficientes. Esto podría incluir estrategias como reducir el tamaño del modelo. O bien, puede aprovechar la aceleración de hardware o mejorar los procesos de procesamiento de datos de entrada.

Conclusión

Finalmente, en el aprendizaje automático, el entrenamiento y la inferencia son procesos críticos. Necesitamos tener los conocimientos y habilidades particulares para implementarlos de manera eficiente. El entrenamiento permite que el modelo haga predicciones, mientras que la inferencia permite que el modelo haga predicciones basadas en datos nuevos.

Ambos juegan un papel fundamental en la determinación del éxito y la precisión de un modelo. ¡Así que tenlos en cuenta en tu próximo proyecto!

Deje un comentario