Índice del contenido[Esconder][Espectáculo]

Uno de los criterios primordiales para cualquier tipo de actividad empresarial es la utilización eficaz de la información. En algún momento, el volumen de datos creado supera la capacidad de procesamiento básico.

Ahí es donde entran en juego los algoritmos de aprendizaje automático. Sin embargo, antes de que algo de esto pueda ocurrir, la información debe ser estudiada e interpretada. En pocas palabras, es para lo que se utiliza el aprendizaje automático no supervisado.

En este artículo, examinaremos en profundidad el aprendizaje automático no supervisado, incluidos sus algoritmos, casos de uso y mucho más.

¿Qué es el aprendizaje automático no supervisado?

Los algoritmos de aprendizaje automático no supervisados identifican patrones en un conjunto de datos que no tienen una consecuencia conocida o etiquetada. supervisado algoritmos de aprendizaje automático tener una salida etiquetada.

Conocer esta distinción lo ayuda a comprender por qué los métodos de aprendizaje automático no supervisados no se pueden usar para resolver problemas de regresión o clasificación, ya que no sabe cuál puede ser el valor o la respuesta para los datos de salida. No puede entrenar un algoritmo normalmente si no conoce el valor/respuesta.

Además, el aprendizaje no supervisado se puede utilizar para identificar la estructura fundamental de los datos. Estos algoritmos detectan patrones ocultos o agrupaciones de datos sin necesidad de interacción humana.

Su capacidad para detectar similitudes y contrastes en la información lo convierte en una excelente opción para el análisis exploratorio de datos, técnicas de venta cruzada, segmentación de consumidores e identificación de imágenes.

Considere el siguiente escenario: está en una tienda de comestibles y ve una fruta no identificada que nunca antes había visto. Puede distinguir fácilmente la fruta desconocida diferente de otras frutas en función de sus observaciones de su forma, tamaño o color.

Algoritmos de aprendizaje automático no supervisados

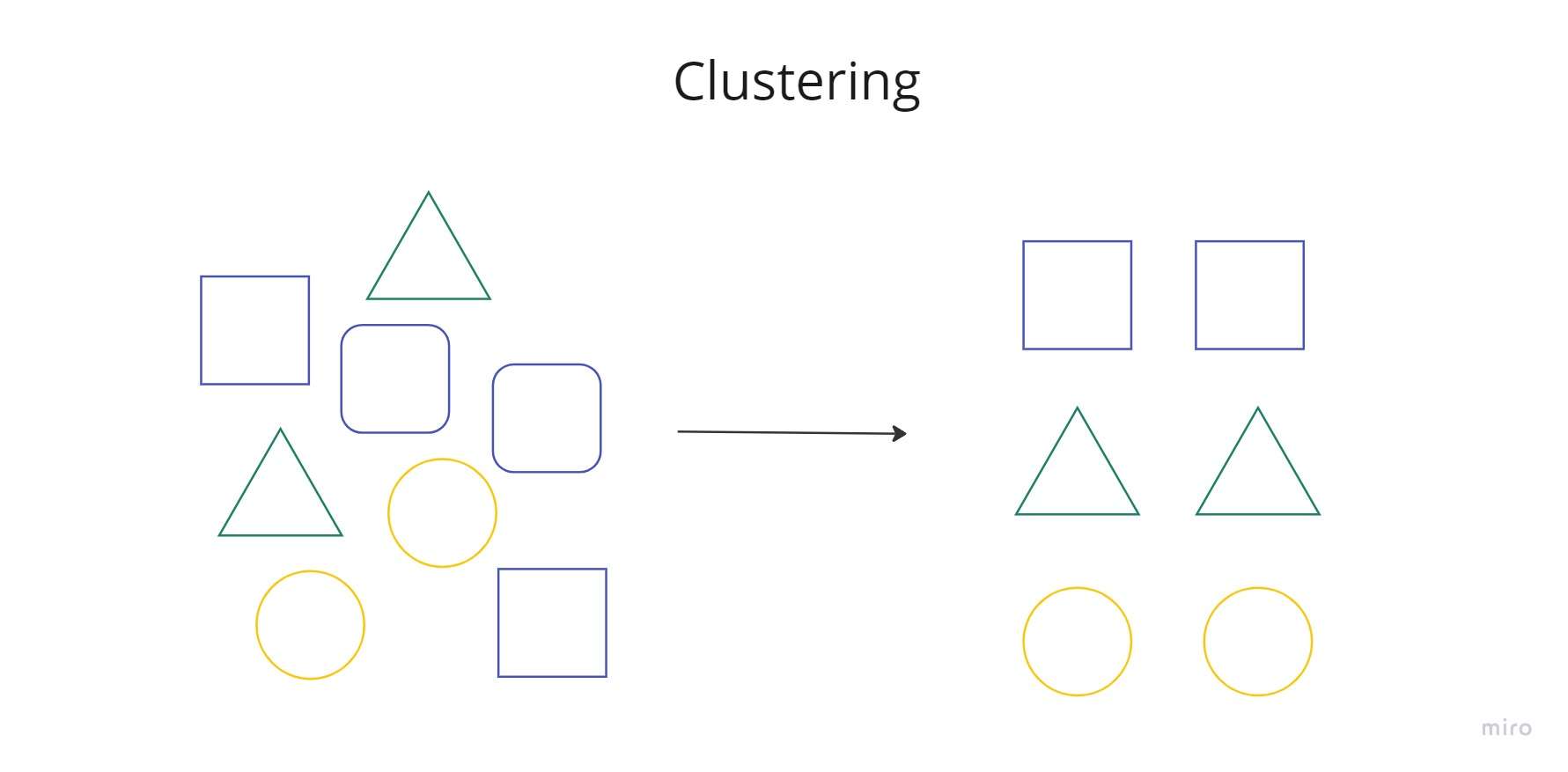

Clustering

El agrupamiento es sin duda el enfoque de aprendizaje no supervisado más utilizado. Este enfoque coloca elementos de datos relacionados en grupos generados aleatoriamente.

Por sí mismo, un modelo de ML descubre cualquier patrón, similitud o diferencia en una estructura de datos sin clasificar. Un modelo podrá descubrir cualquier agrupación o clase natural en los datos.

Tipos

Hay varias formas de agrupamiento que se pueden utilizar. Veamos primero los más importantes.

- El agrupamiento exclusivo, a veces conocido como agrupamiento "duro", es un tipo de agrupación en el que una sola pieza de datos pertenece a un solo grupo.

- La agrupación superpuesta, a menudo conocida como agrupación "suave", permite que los objetos de datos pertenezcan a más de un grupo en diversos grados. Además, el agrupamiento probabilístico se puede utilizar para abordar problemas de estimación de densidad o agrupamiento "suave", así como para evaluar la probabilidad de que los puntos de datos pertenezcan a ciertos grupos.

- La creación de una jerarquía de elementos de datos agrupados es el objetivo de la agrupación jerárquica, como su nombre lo indica. Los elementos de datos se deconstruyen o combinan en función de la jerarquía para generar grupos.

Casos de uso:

- Detección de anomalías:

Cualquier tipo de valor atípico en los datos se puede detectar mediante el agrupamiento. Las empresas de transporte y logística, por ejemplo, pueden utilizar la detección de anomalías para descubrir impedimentos logísticos o revelar piezas mecánicas dañadas (mantenimiento predictivo).

Las instituciones financieras pueden usar la tecnología para detectar transacciones fraudulentas y responder rápidamente, lo que podría ahorrar mucho dinero. Obtenga más información sobre cómo detectar anomalías y fraudes al ver nuestro video.

- Segmentación de clientes y mercados:

Los algoritmos de agrupamiento pueden ayudar a agrupar personas que tienen características similares y crear personajes de consumidores para iniciativas de marketing y dirigidas más efectivas.

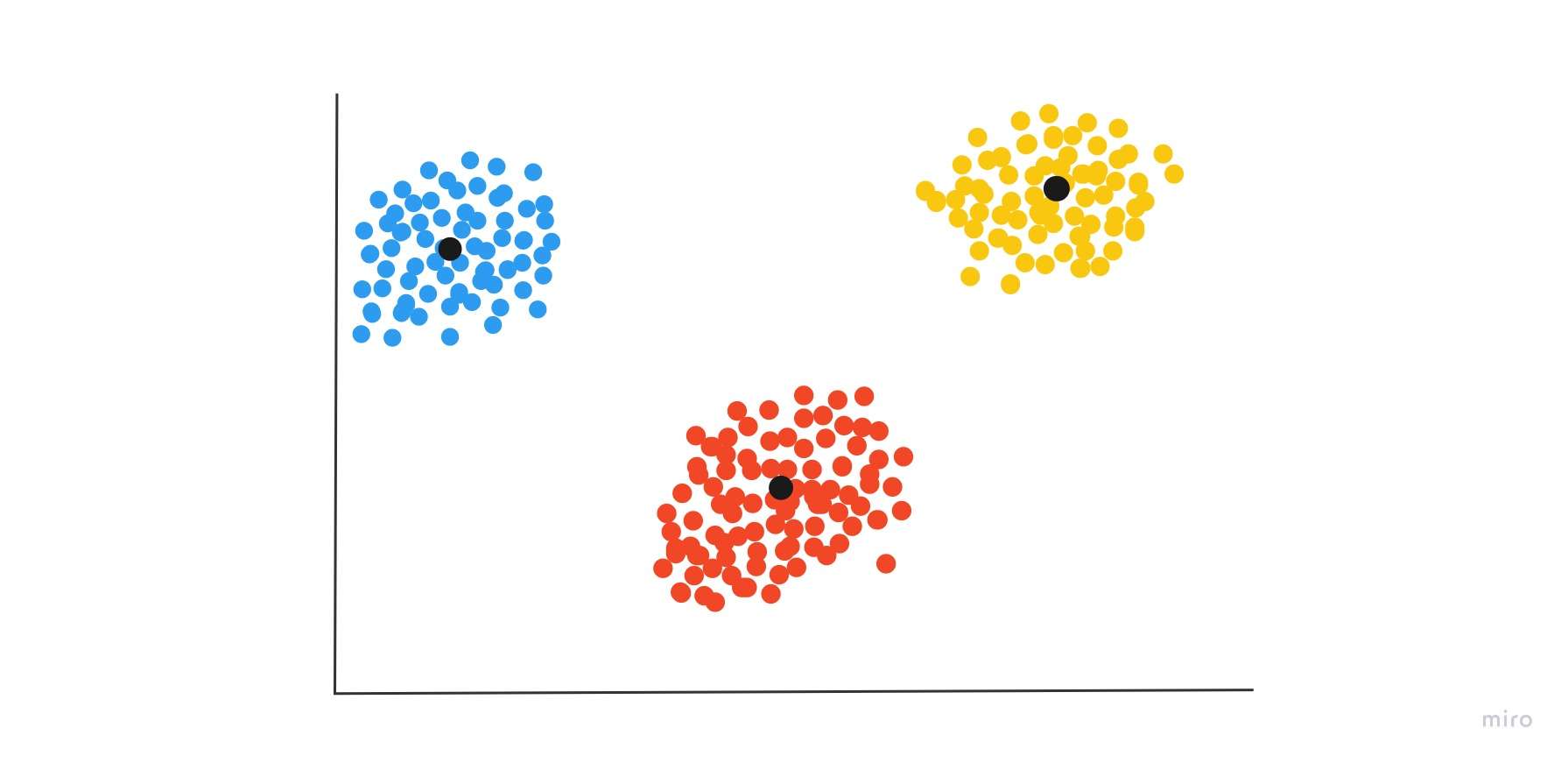

K-medias

K-means es un método de agrupamiento que también se conoce como partición o segmentación. Divide los puntos de datos en un número predeterminado de grupos conocidos como K.

En el método de K-medias, K es la entrada ya que le dice a la computadora cuántos grupos desea identificar en sus datos. Cada elemento de datos se asigna posteriormente al centro del grupo más cercano, conocido como centroide (puntos negros en la imagen).

Estos últimos sirven como espacios de almacenamiento de datos. La técnica de agrupación se puede realizar varias veces hasta que las agrupaciones estén bien definidas.

K-medias difusas

Fuzzy K-means es una extensión de la técnica de K-means, que se utiliza para realizar agrupaciones superpuestas. A diferencia de la técnica de K-medias, las K-medias difusas indican que los puntos de datos pueden pertenecer a muchos grupos con diferentes grados de proximidad a cada uno.

La distancia entre los puntos de datos y el centroide del clúster se usa para calcular la proximidad. Como resultado, puede haber ocasiones en las que varios grupos se superpongan.

Modelos de mezcla gaussiana

Los modelos de mezcla gaussiana (GMM) son un método utilizado en la agrupación probabilística. Debido a que se desconocen la media y la varianza, los modelos asumen que hay un número fijo de distribuciones gaussianas, cada una de las cuales representa un grupo distinto.

Para determinar a qué grupo pertenece un punto de datos específico, se utiliza esencialmente el método.

Agrupación jerárquica

La estrategia de agrupación jerárquica puede comenzar con cada punto de datos asignado a un grupo diferente. Los dos grupos que están más cerca uno del otro se mezclan en un solo grupo. La fusión iterativa continúa hasta que solo queda un clúster en la parte superior.

Este método se conoce como bottom-up o aglomerativo. Si comienza con todos los elementos de datos vinculados al mismo grupo y luego realiza divisiones hasta que cada elemento de datos se asigna como un grupo separado, el método se conoce como agrupación jerárquica descendente o divisiva.

Algoritmo a priori

El análisis de la cesta de la compra popularizó los algoritmos a priori, lo que dio como resultado varios motores de recomendación para plataformas de música y tiendas en línea.

Se utilizan en conjuntos de datos transaccionales para encontrar conjuntos de elementos frecuentes, o agrupaciones de elementos, para predecir la probabilidad de consumir un producto en función del consumo de otro.

Por ejemplo, si empiezo a reproducir la radio de OneRepublic en Spotify con "Counting Stars", una de las otras canciones en este canal seguramente será una canción de Imagine Dragon, como "Bad Liar".

Esto se basa en mis hábitos de escucha anteriores, así como en los patrones de escucha de los demás. Los métodos a priori cuentan conjuntos de elementos utilizando un árbol hash, atravesando el conjunto de datos en anchura.

Reducción de dimensionalidad

La reducción de la dimensionalidad es una especie de aprendizaje no supervisado que utiliza una colección de estrategias para minimizar la cantidad de características, o dimensiones, en un conjunto de datos. Permítanos aclarar.

Puede ser tentador incorporar tantos datos como sea posible al crear su conjunto de datos para el aprendizaje automático. No nos malinterprete: esta estrategia funciona bien ya que más datos generalmente producen resultados más precisos.

Suponga que los datos se almacenan en un espacio N-dimensional, donde cada característica representa una dimensión diferente. Puede haber cientos de dimensiones si hay muchos datos.

Considere las hojas de cálculo de Excel, con columnas que representan características y filas que representan elementos de datos. Cuando hay demasiadas dimensiones, los algoritmos de ML pueden funcionar mal y Visualización de datos puede volverse difícil.

Por lo tanto, es lógico limitar las características o dimensiones y transmitir solo la información pertinente. La reducción de la dimensionalidad es sólo eso. Permite una cantidad manejable de entradas de datos sin comprometer la integridad del conjunto de datos.

Análisis de componentes principales (PCA)

El análisis de componentes principales es un enfoque de reducción de dimensionalidad. Se utiliza para minimizar la cantidad de características en grandes conjuntos de datos, lo que resulta en una mayor simplicidad de los datos sin sacrificar la precisión.

La compresión de conjuntos de datos se logra mediante un método conocido como extracción de características. Indica que los elementos del conjunto original se fusionan en uno nuevo más pequeño. Estos nuevos rasgos se conocen como componentes primarios.

Por supuesto, hay algoritmos adicionales que puede usar en sus aplicaciones de aprendizaje no supervisado. Los enumerados anteriormente son solo los más frecuentes, por lo que se analizan con más detalle.

Aplicación del aprendizaje no supervisado

- Los métodos de aprendizaje no supervisados se utilizan para tareas de percepción visual, como el reconocimiento de objetos.

- El aprendizaje automático no supervisado brinda aspectos críticos a los sistemas de imágenes médicas, como la identificación, clasificación y segmentación de imágenes, que se utilizan en radiología y patología para diagnosticar pacientes de manera rápida y confiable.

- El aprendizaje no supervisado puede ayudar a identificar tendencias de datos que se pueden usar para crear estrategias de venta cruzada más efectivas utilizando datos anteriores sobre el comportamiento del consumidor. Durante el proceso de pago, las empresas en línea lo utilizan para sugerir los complementos correctos a los clientes.

- Los métodos de aprendizaje no supervisados pueden filtrar enormes volúmenes de datos para encontrar valores atípicos. Estas anomalías pueden dar lugar a avisos de mal funcionamiento del equipo, errores humanos o infracciones de seguridad.

Problemas con el aprendizaje no supervisado

El aprendizaje no supervisado es atractivo en una variedad de formas, desde el potencial para encontrar información importante sobre datos para evitar el costoso etiquetado de datos operaciones. Sin embargo, hay varios inconvenientes en el uso de esta estrategia para entrenar modelos de aprendizaje automático que debes tener en cuenta. Aquí hay unos ejemplos.

- Como los datos de entrada carecen de etiquetas que sirvan como claves de respuesta, los resultados de los modelos de aprendizaje no supervisados podrían ser menos precisos.

- El aprendizaje no supervisado suele funcionar con conjuntos de datos masivos, lo que puede aumentar la complejidad computacional.

- El enfoque requiere la confirmación de la salida por parte de humanos, ya sean especialistas internos o externos en el tema de la investigación.

- Los algoritmos deben examinar y calcular todos los escenarios posibles a lo largo de la fase de entrenamiento, que lleva algún tiempo.

Conclusión

La utilización eficaz de los datos es la clave para establecer una ventaja competitiva en un mercado en particular.

Puede segmentar los datos utilizando algoritmos de aprendizaje automático no supervisados para examinar las preferencias de su público objetivo o para determinar cómo responde una determinada infección a un tratamiento en particular.

Hay varias aplicaciones prácticas, y científicos de datos, ingenieros y arquitectos pueden ayudarlo a definir sus objetivos y desarrollar soluciones de aprendizaje automático únicas para su empresa.

Deje un comentario