Os modelos de difusión arrasaron o mundo co lanzamento de Dall-E 2, Imaxe de Google, Difusión establee Media viaxe, provocando innovación e ampliando os límites da aprendizaxe automática.

Estes modelos poden producir un número case ilimitado de imaxes a partir de indicacións de palabras, incluíndo imaxes fotorrealistas, máxicas, futuristas e, por suposto, bonitas.

Estas capacidades reimaxinan o que significa para os humanos interactuar co silicio, dándonos a posibilidade de facer practicamente calquera imaxe que poidamos imaxinar.

A medida que estes modelos se desenvolvan ou o próximo paradigma xenerativo se faga cargo, os humanos poderán producir imaxes, películas e outras experiencias inmersivas cun só pensamento.

Neste post, comentaremos o modelo de difusión, difusión estable, como funciona, e un titorial de pintura de modelos de difusión, entre outras cousas.

Que é o modelo de difusión?

Os modelos de aprendizaxe automática que poden crear novos datos a partir de datos de adestramento denomínanse modelos xerativos. Outros modelos xenerativos inclúen modelos baseados en fluxo, autocodificadores variacionais e redes adversarias xerativas (GAN).

Cada un pode xerar imaxes de excelente calidade. Os modelos de difusión aprenden a recuperar os datos invertendo este proceso de adición de ruído despois de danar os datos de adestramento ao engadir ruído. Dito doutro xeito, os modelos de difusión son capaces de crear imaxes coherentes a partir do ruído.

Os modelos de difusión aprenden introducindo ruído nas imaxes, que despois o modelo domina a eliminación. Para producir imaxes realistas, o modelo aplica esta técnica de eliminación de ruído a sementes aleatorias.

Ao condicionar o proceso de produción de imaxes, estes modelos poden usarse xunto coa orientación de texto a imaxe para xerar un número case ilimitado de imaxes só a partir do texto. As sementes pódense dirixir mediante entradas de incrustacións como CLIP para ofrecer fortes capacidades de texto a imaxe.

Os modelos de difusión poden realizar unha variedade de tarefas, incluíndo a creación de imaxes, a eliminación de ruído, a pintura interna, a pintura exterior e a difusión de bits.

Agora, que é a difusión estable?

Stable Diffusion é un modelo de aprendizaxe automática para a creación de imaxes baseadas en texto proporcionado por Estabilidade.AI. É capaz de xerar imaxes a partir de texto.

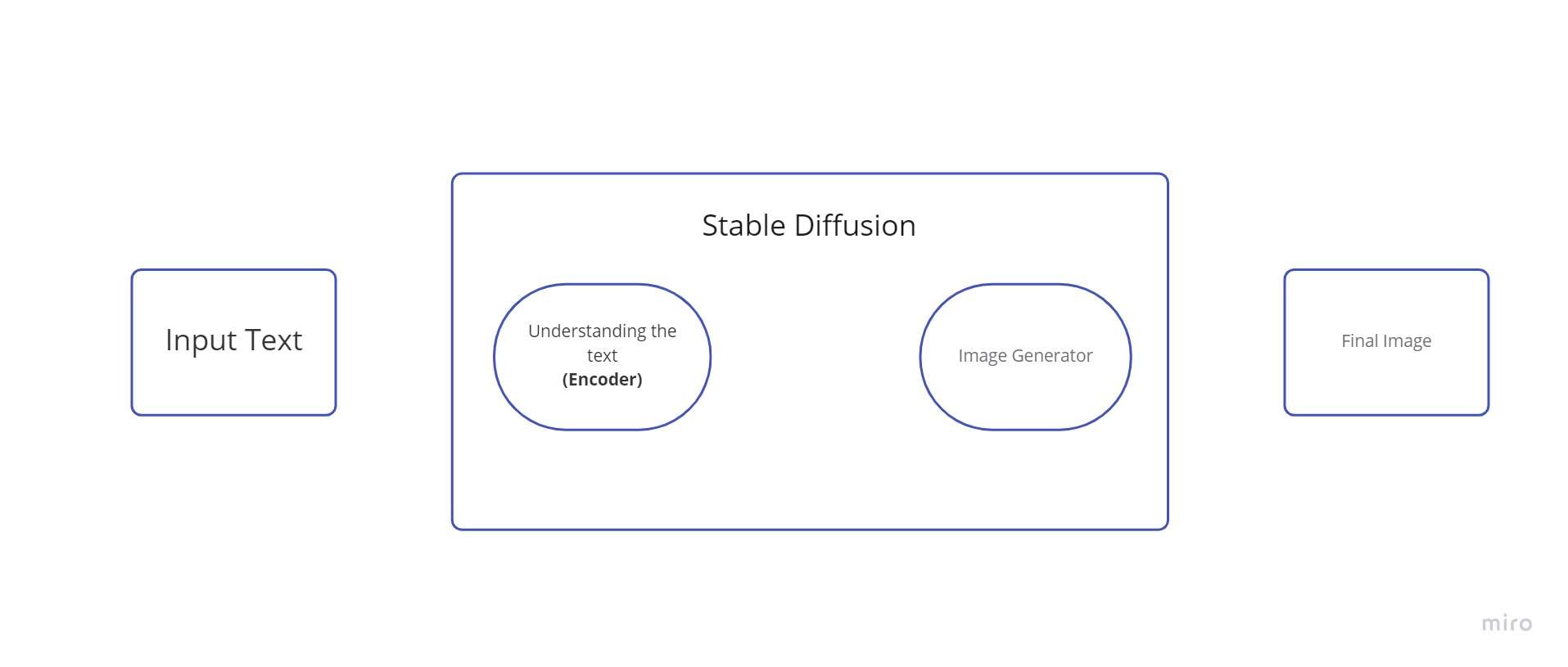

Compoñentes da difusión estable

Difusión estable é un sistema composto por varios compoñentes e conceptos. Non é un modelo único. Cando comprobamos detrás do capó, o primeiro que vemos é que hai un compoñente de comprensión do texto que converte a información do texto nunha representación numérica que recolle os conceptos do texto.

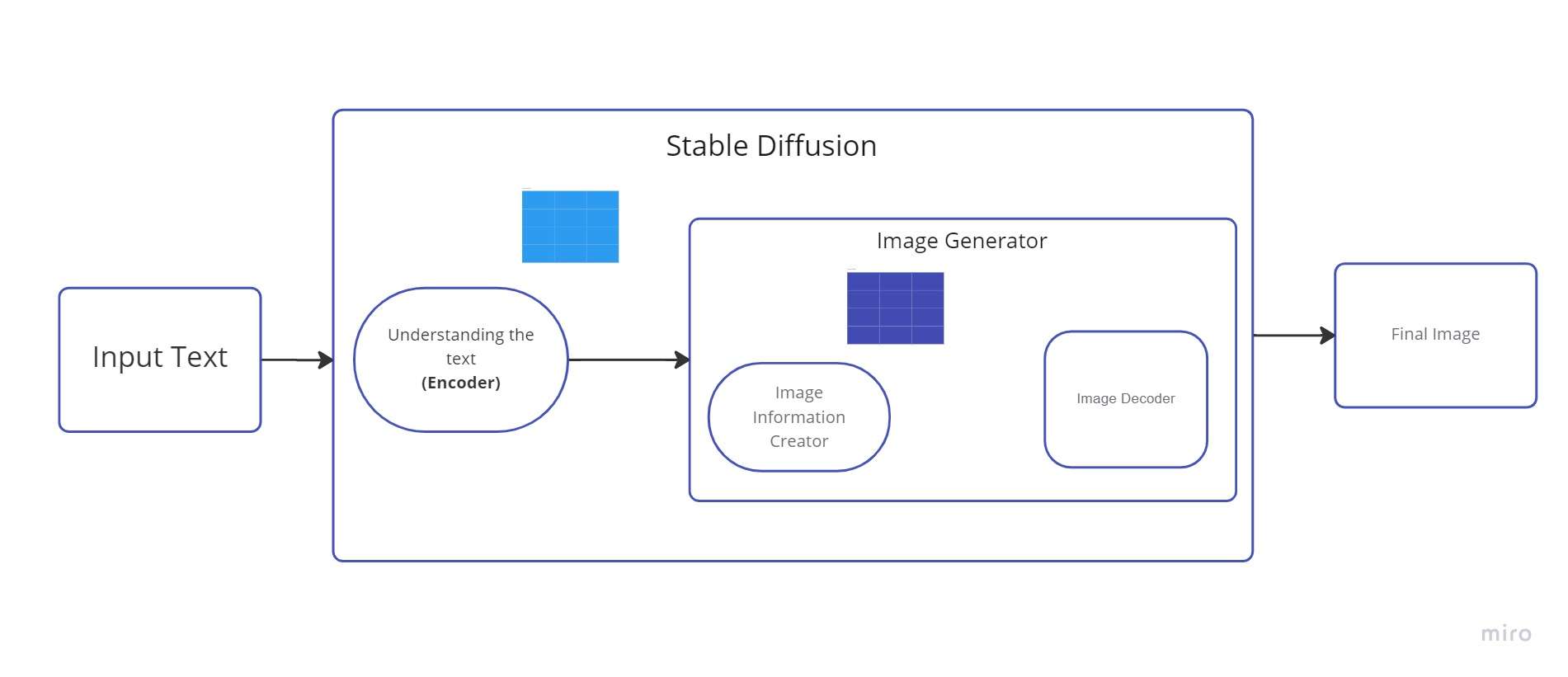

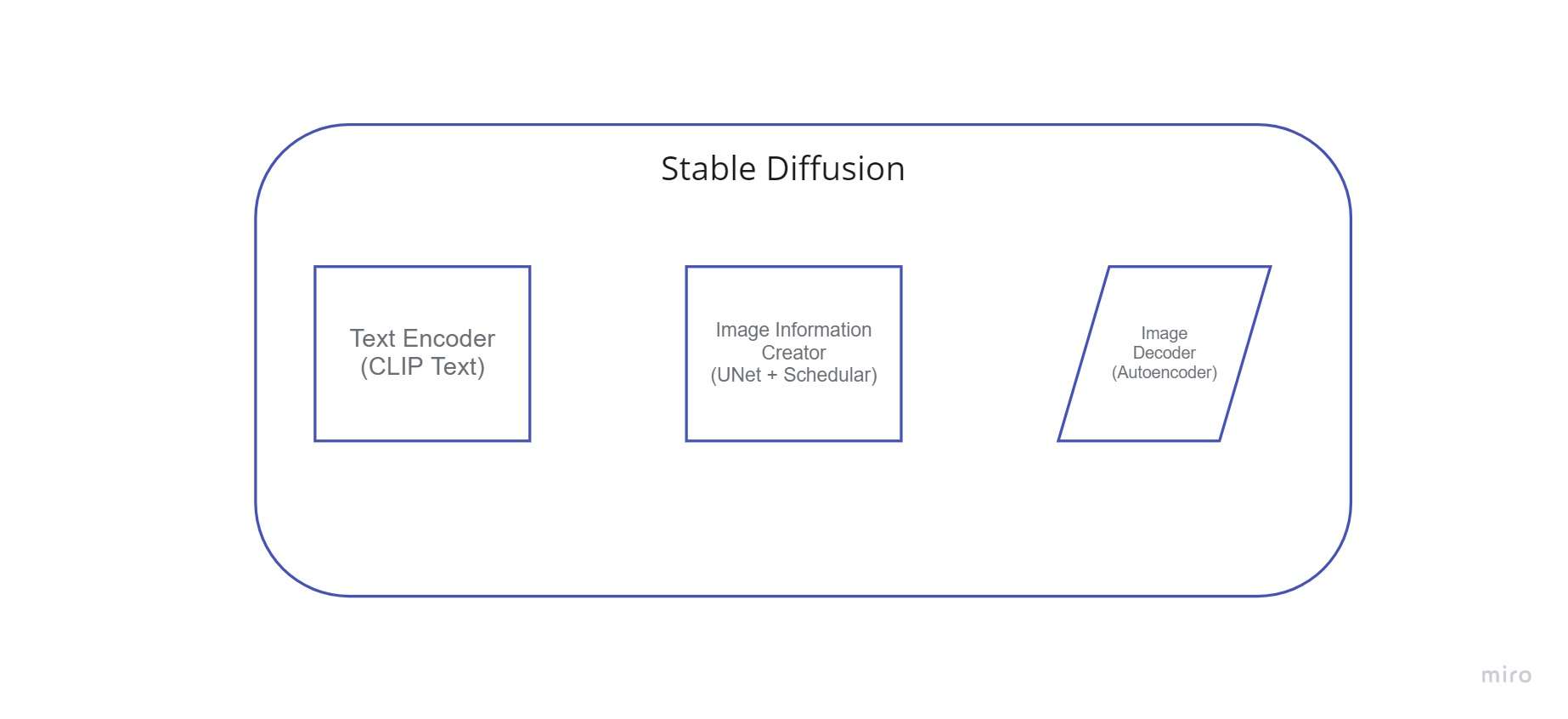

Podemos chamar a este codificador de texto un Transformador modelo lingüístico (tecnicamente: o codificador de texto dun modelo CLIP). Toma o texto de entrada e xera unha lista de números enteiros (un vector) para cada palabra/token do texto. A continuación, eses datos entréganse ao Xerador de imaxes, que está formado por varios compoñentes.

Hai dous pasos no xerador de imaxes:

1. Creador de información de imaxe

O principal compoñente en Stable Diffusion é este elemento. É onde se realiza a maior parte da mellora do rendemento con respecto ás versións anteriores.

Este compoñente pasa por varias etapas para proporcionar datos de imaxe. O creador da información da imaxe só opera dentro do espazo de información da imaxe (ou espazo latente).

É máis rápido que os modelos de difusión anteriores que operaban no espazo de píxeles debido a esta característica. Tecnicamente falando, este compoñente está composto por un algoritmo de programación e unha UNet rede neural.

O proceso que ten lugar neste compoñente denomínase "difusión". Unha imaxe de alta calidade prodúcese finalmente como resultado da información que se procesa por pasos (polo seguinte compoñente, o descodificador de imaxes).

2. Decodificador de imaxes

Usando os datos que recibiu do produtor de información, o descodificador de imaxes crea unha imaxe. Só execútase unha vez para crear a imaxe de píxeles acabada ao final da operación.

Tutorial de Stable Diffusion Imppainting

A pintura de imaxes de difusión estable é a técnica de encher as áreas que faltan ou danadas nunha imaxe. O propósito da pintura na pintura é ocultar o feito de que a imaxe foi restaurada.

Esta técnica úsase con frecuencia para eliminar cousas non desexadas dunha imaxe ou para restaurar áreas danadas de fotografías históricas. Stable Diffusion Inpainting é unha forma relativamente recente de inpainting que está a producir efectos prometedores.

Seguindo as instrucións que aparecen a continuación, comezará a explorar inpainting e modificar as fotos existentes se queres probar a inpainting cunha difusión estable:

- Vai a Huggingface Impintura de difusión estable

- Carga a túa propia imaxe

- Borra a parte da túa imaxe que hai que substituír.

- Introduce o teu aviso aquí (o que queres engadir en lugar do que estás a eliminar)

- Seleccione "executar"

No vídeo de arriba, subimos unha imaxe con tres limóns e trocámolos por mazás. Persoalmente, recoméndoo probalo coas túas propias fotografías e indicacións.

Conclusión

En xeral, a pintura de difusión constante é un método excelente para producir imaxes ou vídeos falsos que parecen ser extremadamente reais. A medida que avanzamos cara ao novo avance tecnolóxico, será cada vez máis difícil distinguir entre auténticos e fraudulentos a medida que avance a tecnoloxía.

A primeira metade non ten nada que ver coa segunda parte. Estaría moi xenial que o autor explicase como funciona inpaint no marco do modelo que explicou anteriormente, podería ter dado unha idea. Pero non! Iso tería requirido unha comprensión real, en lugar de recoller e procesar un texto aleatorio.