Vektordatabaser representerar en betydande förändring i hur vi hanterar och tolkar data, särskilt inom områdena artificiell intelligens och maskininlärning.

Den grundläggande funktionen för dessa databaser är att effektivt hantera högdimensionella vektorer, som är råmaterialet i maskininlärningsmodeller och inkluderar omvandling av text, bild eller ljudinmatning till numeriska representationer i flerdimensionellt rum.

För applikationer som rekommendationssystem, objektigenkänning, bildhämtning och bedrägeriupptäckt är denna transformation mer än bara lagring; det är en dörr till kraftfulla funktioner i likhetssökningar och frågor om närmaste granne.

Mer djupgående ligger kraften hos vektordatabaser i deras förmåga att översätta stora mängder ostrukturerad, komplicerad data till vektorer som fångar sammanhanget och innebörden av det ursprungliga innehållet.

De förbättrade sökfunktionerna som görs möjliga genom att bädda in modeller i denna kodning inkluderar möjligheten att fråga omgivande vektorer för att hitta relaterade bilder eller fraser.

Vektordatabaser är unika genom att de är byggda på avancerade indexeringstekniker som Inverted File Index (IVF) och Hierarchical Navigable Small World (HNSW), som förbättrar deras hastighet och effektivitet samtidigt som de lokaliserar närmaste grannar i N-dimensionella utrymmen.

Det finns en tydlig skillnad mellan vektor- och klassiska databaser. Konventionella databaser är bra på att organisera data i organiserade uppsättningar som är CRUD-optimerade och följer fastställda scheman.

Men när man hanterar den dynamiska och komplicerade naturen hos högdimensionella data, börjar denna stelhet bli ett hinder.

Däremot erbjuder vektordatabaser en grad av flexibilitet och effektivitet som traditionella motsvarigheter inte kan motsvara, särskilt för applikationer som är starkt beroende av maskininlärning och artificiell intelligens. De är inte bara skalbara och skickliga i likhetssökningar.

Vektordatabaser är särskilt användbara för generativa AI-applikationer. För att garantera att det skapade materialet behåller kontextuell integritet, är dessa applikationer – som inkluderar naturlig språkbehandling och bildgenerering – beroende av snabb hämtning och jämförelse av inbäddningar.

Så i det här stycket kommer vi att titta på de bästa vektordatabaserna för ditt nästa projekt.

1. Milvus

Milvus är en banbrytande vektordatabas med öppen källkod designad främst för AI-applikationer, inklusive inbäddade likhetssökningar och kraftfulla MLOps.

Det skiljer sig från konventionella relationsdatabaser, som mestadels hanterar strukturerade data, på grund av denna kapacitet, som gör det möjligt för den att indexera vektorer i en aldrig tidigare skådad biljonskala.

Milvus engagemang för skalbarhet och hög tillgänglighet visas av hur det har utvecklats från sin första version till den fullt distribuerade, molnbaserade Milvus 2.0.

Specifikt uppvisar Milvus 2.0 en helt molnbaserad design som syftar till en häpnadsväckande tillgänglighet på 99.9 % samtidigt som den skalar bortom hundratals noder.

För dem som letar efter en pålitlig vektordatabaslösning rekommenderas den här utgåvan starkt eftersom den inte bara lägger till sofistikerade funktioner som en multimolnanslutning och en administrativ panel, utan den förbättrar också datakonsistensnivåerna för flexibel applikationsutveckling.

En anmärkningsvärd fördel med Milvus är dess community-drivna tillvägagångssätt, som ger stöd på flera språk och en omfattande verktygskedja som är skräddarsydd för utvecklarnas krav.

Inom IT-sektorn gör dess molnskalbarhet och tillförlitlighet, tillsammans med dess högpresterande vektorsökningsmöjligheter på stora datamängder, det till ett populärt alternativ.

Dessutom förbättrar den effektiviteten i sin verksamhet med hjälp av en hybridsökningsfunktion som blandar vektorlikhetssökning med skalär filtrering.

Milvus har en administrativ panel med en tydlig användargränssnitt, en komplett uppsättning API:er och en skalbar och inställbar arkitektur.

Kommunikation med externa applikationer underlättas av åtkomstskiktet, medan lastbalansering och datahantering koordineras av koordinatortjänsten, som fungerar som det centrala kommandot.

Databasens beständighet stöds av objektlagringslagret, medan arbetarnoder utför aktiviteter för att säkerställa skalbarhet.

Priser

Det är gratis att använda för alla.

2. FAISS

Facebooks AI Research-team utvecklade ett banbrytande bibliotek som heter Facebook AI Similarity Search som är utformat för att göra tät vektorklustring och likhetssökning mer effektiv.

Dess skapelse drevs av kravet att förbättra Facebook AI:s likhetssökningsmöjligheter genom att använda banbrytande grundläggande metoder.

Jämfört med CPU-baserade implementeringar kan FAISS:s toppmoderna GPU-implementering påskynda söktiderna med fem till tio gånger, vilket gör den till ett ovärderligt verktyg för en mängd olika applikationer, inklusive rekommendationssystem och identifiering av liknande betydelser i betydande ostrukturerade datauppsättningar som text, ljud och video.

FAISS kan hantera ett brett utbud av likhetsmått, såsom cosinuslikhet, inre produkt och det vanligaste L2-måttet (euklidiskt avstånd).

Dessa mätningar gör det lättare att göra exakta och flexibla likhetssökningar över olika datatyper. Funktioner som batchbearbetning, precisionshastighetsavvägningar och stöd för både exakta och ungefärliga sökningar ökar dess flexibilitet ytterligare.

Dessutom erbjuder FAISS en skalbar metod för att hantera stora datamängder genom att tillåta index att lagras på disk.

Den inverterade filen, produktkvantiseringen (PQ) och den förbättrade PQ är bara några av de innovativa teknikerna som utgör FAISS:s forskningsgrund och bidrar till dess effektivitet när det kommer till indexering och sökning av högdimensionella vektorfält.

Dessa strategier förstärks av banbrytande tillvägagångssätt som GPU-accelererade k-valsalgoritmer och förfiltrering av PQ-avstånd, vilket garanterar FAISS kapacitet att producera snabba och exakta sökresultat även i datauppsättningar i miljardskala.

Priser

Det är gratis att använda för alla.

3. Pinecone

Pinecone är ledande inom vektordatabaser och tillhandahåller en molnbaserad, hanterad tjänst som är särskilt byggd för att förbättra prestandan hos kraftfulla AI-applikationer.

Den är speciellt utformad för att hantera vektorinbäddningar, som är viktiga för generativ AI, semantisk sökning och applikationer som använder massiva språkmodeller.

AI kan nu förstå semantisk information tack vare dessa inbäddningar, som effektivt fungerar som ett långtidsminne för komplicerade uppgifter.

Pinecone är unik genom att den sömlöst integrerar funktionerna hos traditionella databaser med den förbättrade prestandan hos vektorindex, vilket möjliggör effektiv och storskalig lagring och sökning av inbäddningar.

Detta gör det till det perfekta alternativet i situationer där komplexiteten och volymen av inblandade data gör standardskalärbaserade databaser otillräckliga.

Pinecone erbjuder utvecklare en problemfri lösning på grund av dess managed service-metod, som effektiviserar integrationen och realtidsdataintagsprocedurerna.

Många dataoperationer stöds av den, inklusive hämtning, uppdatering, radering, sökning och upphämtning av data.

Pinecone garanterar vidare att förfrågningar som representerar modifieringar i realtid, såsom upserts och borttagningar, ger korrekta svar med låg latens för index med miljarder vektorer.

I dynamiska situationer är den här funktionen viktig för att bevara frågeresultatens relevans och färskhet.

Dessutom ökar Pinecones partnerskap med Airbyte via Pinecone-anslutningen dess mångsidighet och flexibilitet, vilket möjliggör smidig dataintegration från en rad olika källor.

Genom detta förhållande kan kostnader och effektivitet optimeras genom att säkerställa att endast nyinhämtad information hanteras genom inkrementell datasynkronisering.

Kontaktens design betonar enkelhet, kräver bara minimala inställningsparametrar, och den är förlängningsbar, vilket möjliggör framtida förbättringar.

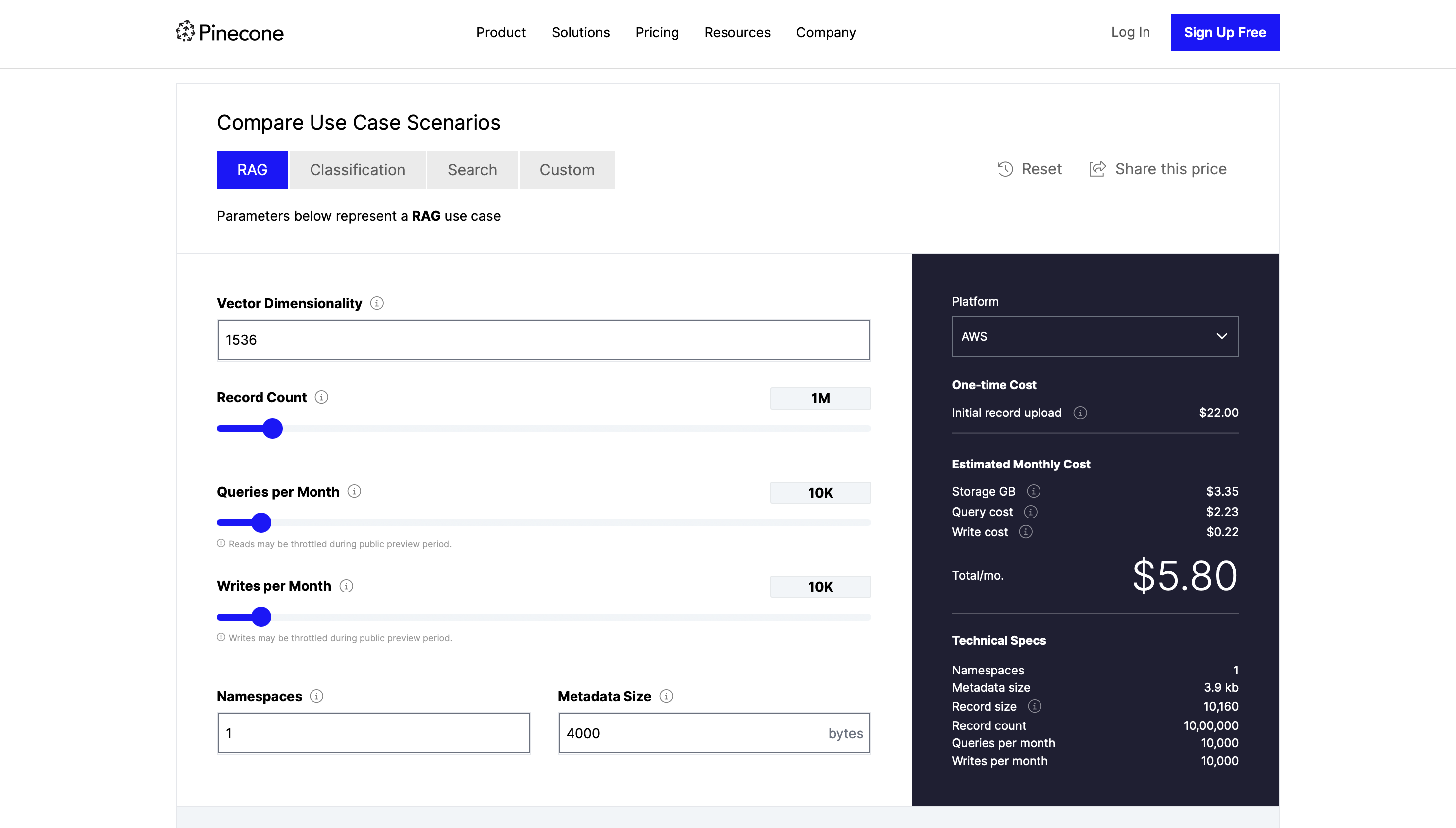

Priser

Premiumprissättningen börjar från $5.80/månad för RAG-användningsfallet.

4. Väv

Weaviate är en innovativ vektordatabas som är tillgänglig som programvara med öppen källkod som förändrar hur vi kommer åt och använder data.

Weaviate använder sig av vektorsökningsfunktioner, som möjliggör sofistikerade, sammanhangsmedvetna sökningar över stora, komplicerade datamängder, i motsats till typiska databaser som är beroende av skalära värden och fördefinierade frågor.

Med den här metoden kan du hitta innehåll baserat på hur likt det är annat innehåll, vilket förbättrar sökningarnas intuitivitet och resultatens relevans.

Dess smidiga integration med maskininlärningsmodeller är en av dess primära egenskaper; detta gör att den kan fungera som mer än bara en datalagringslösning; det tillåter också att data förstås och analyseras med hjälp av artificiell intelligens.

Weaviates arkitektur införlivar denna integration grundligt, vilket gör det möjligt att analysera komplexa data utan användning av ytterligare verktyg.

Dess stöd för grafdatamodeller ger också en annan syn på data som länkade enheter, och exponerar mönster och insikter som kan missas i konventionella databasarkitekturer.

På grund av Weaviates modulära arkitektur kan kunder lägga till funktioner som datavektorisering och skapande av säkerhetskopiering efter behov.

Dess grundläggande version fungerar som en databas för vektordataspecialister, och den kan utökas med andra moduler för att möta olika behov.

Dess skalbarhet förstärks ytterligare av dess modulära design, som garanterar att hastigheten inte kommer att offras som svar på ökande datamängder och frågekrav.

En mångsidig och effektiv metod för att interagera med lagrad data möjliggörs av databasens stöd för både RESTful och GraphQL API:er.

I synnerhet är GraphQL vald på grund av dess förmåga att snabbt utföra intrikata, grafbaserade frågor, vilket gör det möjligt för användare att få exakt den data de vill ha utan att få överdrivna eller otillräckliga mängder data.

Weaviate är mer användarvänligt över en mängd olika klientbibliotek och programmeringsspråk tack vare dess flexibla API.

För dem som vill utforska Weaviate ytterligare finns det en uppsjö av dokumentation och handledningar tillgängliga, från att ställa in och konfigurera din instans till djupdykning i dess funktioner som vektorsökning, maskininlärningsintegration och schemadesign.

Du kan komma åt samma potenta teknik som gör information dynamisk och handlingsbar oavsett om du bestämmer dig för att driva Weaviate lokalt, i en cloud computing miljö, eller genom Weaviates hanterade molntjänst

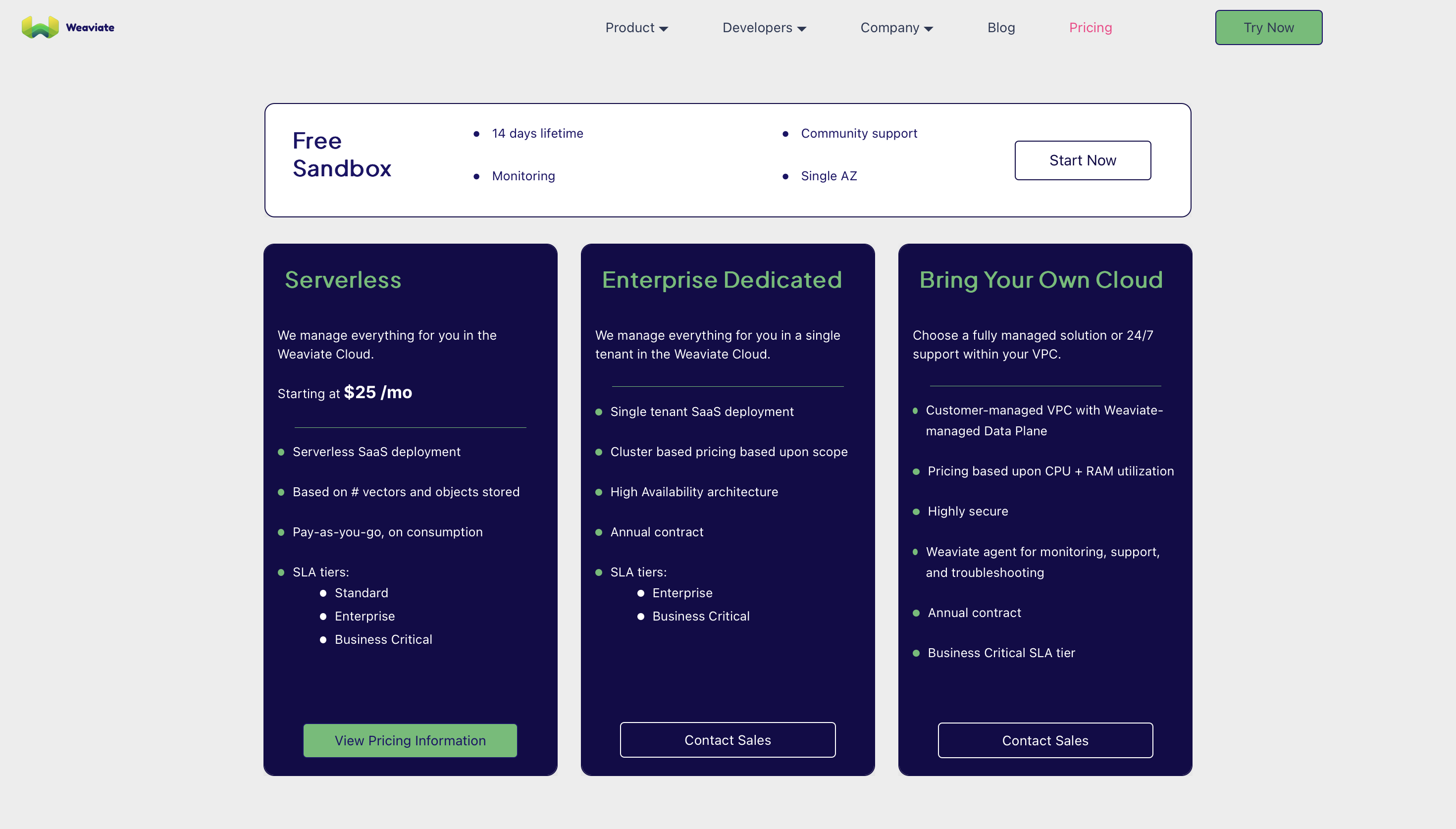

Priser

Premiumprissättningen för plattformen börjar från $25/månad för serverlös.

5. Chroma

Chroma är en banbrytande vektordatabas som syftar till att revolutionera datahämtning och lagring, särskilt för applikationer som involverar maskininlärning och artificiell intelligens.

Eftersom Chroma arbetar med vektorer istället för skalära tal, till skillnad från vanliga databaser, är det väldigt bra på att hantera högdimensionell, komplicerad data.

Detta är ett stort framsteg inom dataåtervinningsteknik eftersom det möjliggör mer sofistikerade sökningar baserat på materialets semantiska likhet snarare än exakta sökordsmatchningar.

En anmärkningsvärd egenskap hos Chroma är dess förmåga att arbeta med flera underliggande lagringslösningar, såsom ClickHouse för skalade inställningar och DuckDB för fristående installationer, vilket garanterar flexibilitet och anpassning till olika användningsfall.

Chroma är gjord med enkelhet, hastighet och analys i åtanke. Det är tillgängligt för ett brett spektrum av utvecklare med SDK:er för Python och JavaScript/TypeScript.

Dessutom lägger Chroma stor tonvikt på användarvänlighet, vilket gör att utvecklare snabbt kan sätta upp en permanent databas med stöd av DuckDB eller en databas i minnet för testning.

Möjligheten att bygga samlingsobjekt som liknar tabeller i konventionella databaser, där textdata kan infogas och automatiskt omvandlas till inbäddningar med hjälp av modeller som all-MiniLM-L6-v2, ökar denna mångsidighet ytterligare.

Text och inbäddningar kan integreras sömlöst, vilket är viktigt för applikationer som behöver förstå datasemantik.

Grunden för Chromas vektorlikhetsmetod är de matematiska begreppen ortogonalitet och densitet, som är väsentliga för att förstå representationen och jämförelsen av data i databaser.

Dessa idéer tillåter Chroma att utföra meningsfulla och effektiva likhetssökningar genom att ta hänsyn till de semantiska kopplingarna mellan dataelement.

Resurser som tutorials och riktlinjer är tillgängliga för individer som vill utforska Chroma ytterligare. De innehåller steg-för-steg-vägledning om hur du ställer in databasen, skapar samlingar och kör likhetssökningar.

Priser

Du kan börja använda det gratis.

6. Wasp

Vespa är en plattform som förändrar onlinehanteringen av AI och stor data.

Det grundläggande syftet med Vespa är att möjliggöra beräkningar med låg latens över stora datamängder, vilket gör att du enkelt kan lagra, indexera och analysera text, vektor och strukturerad data.

Vespa kännetecknas av sin förmåga att ge snabba svar i vilken skala som helst, oavsett vilken typ av frågor, val eller maskininlärda modellslutsatser som hanteras.

Vespas flexibilitet visas i dess fullt fungerande sökmotor och vektordatabas, som möjliggör många sökningar i en enda fråga, allt från vektor (ANN), lexikal och strukturerad data.

Oavsett skala kan du skapa användarvänliga och responsiva sökappar med AI-kapacitet i realtid tack vare denna integrering av maskininlärda modellinferenser med dina data.

Vespa handlar dock om mer än att bara söka; det handlar också om att förstå och anpassa möten.

Förstklassiga anpassnings- och förslagsverktyg ger dynamiska, aktuella rekommendationer för specifika användare eller omständigheter.

Vespa är en spelväxlare för alla som vill komma in i konversations-AI-utrymmet också, eftersom det erbjuder den infrastruktur som behövs för att lagra och utforska text- och vektordata i realtid, vilket möjliggör utveckling av mer avancerade och praktiska AI-agenter.

Med omfattande tokenisering och stemming stöds fulltextsökningar, närmaste grannsökningar och strukturerade datafrågor alla av plattformens omfattande frågemöjligheter.

Den skiljer sig genom att den effektivt kan hantera komplicerade frågor genom att kombinera flera sökdimensioner.

Vespa är ett beräkningskraftverk för AI- och maskininlärningsapplikationer eftersom dess beräkningsmotor kan hantera komplexa matematiska uttryck över skalärer och tensorer.

I drift är Vespa gjord för att vara enkel att använda och utbyggbar.

Det effektiviserar repetitiva processer, allt från systemkonfiguration och applikationsutveckling till data- och nodhantering, vilket möjliggör säker och oavbruten produktionsverksamhet.

Vespas arkitektur ser till att den expanderar med dina data, och behåller dess pålitlighet och prestanda.

Priser

Du kan börja använda det gratis.

7. Quadrant

Qdrant är en flexibel vektordatabasplattform som ger en unik uppsättning funktioner för att möta de växande kraven från AI- och maskininlärningsapplikationer.

I grunden är Qdrant en sökmotor för vektorlikhet som tillhandahåller ett lättanvänt API för att lagra, hitta och underhålla vektorer såväl som nyttolastdata.

Denna funktion är avgörande för flera tillämpningar, såsom semantiska sökningar och rekommendationssystem, som kräver tolkning av komplicerade dataformat.

Plattformen är byggd med effektivitet och skalbarhet i åtanke och kan hantera enorma datamängder med miljarder datapunkter.

Den tillhandahåller flera avståndsmått inklusive Cosine Similarity, Euclidian Distance och Dot Product, vilket gör den anpassningsbar för många användningsscenarier.

Designen erbjuder komplex filtrering, såsom sträng, intervall och geofilter, för att möta olika sökbehov.

Qdrant är tillgängligt för utvecklare på en mängd olika sätt, inklusive en Docker-avbildning för snabba lokala inställningar, en Python-klient för de som är bekväma med språket och en molntjänst för en mer robust miljö i produktionsklass.

Qdrants anpassningsförmåga möjliggör sömlös integration med alla tekniska konfigurationer eller processbehov.

Dessutom förenklar Qdrants användarvänliga gränssnitt vektordatabashantering. Plattformen är tänkt att vara enkel för användare på alla kompetensnivåer, från att skapa kluster till generering av API-nycklar för säker åtkomst.

Dess kapacitet för massuppladdning och asynkrona API förbättrar dess effektivitet, vilket gör det till ett mycket användbart verktyg för utvecklare som hanterar enorma mängder data.

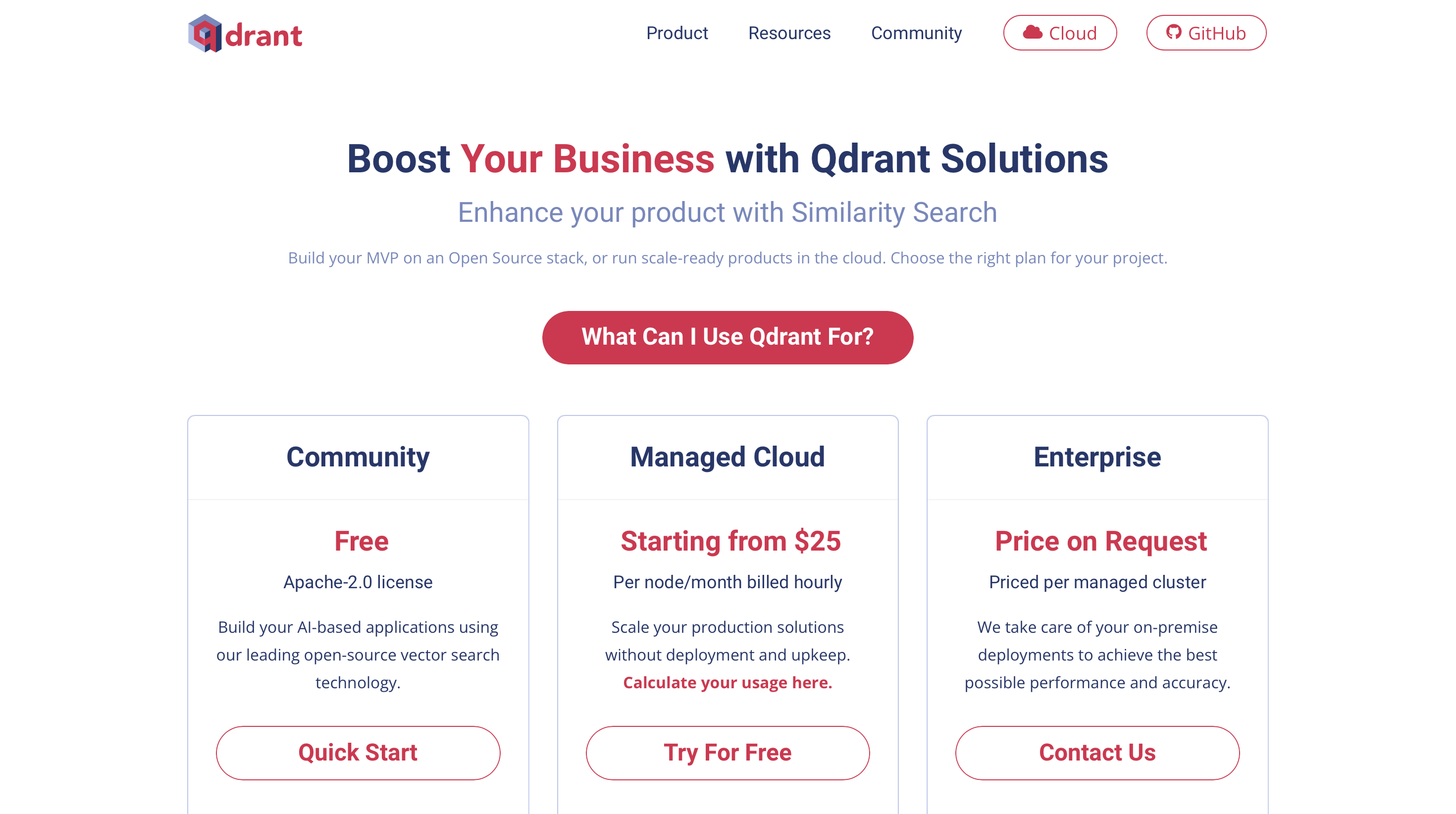

Priser

Du kan börja använda det gratis och premiumprissättning börjar från $25 per nod/månad som faktureras varje timme

8. Astra DB

AstraDB:s överlägsna vektorsökningsmöjligheter och serverlösa arkitektur förändrar generativa AI-applikationer.

AstraDB är ett utmärkt alternativ för att hantera intrikata, sammanhangskänsliga sökningar över en mängd olika datatyper eftersom det bygger på den solida grunden för Apache Cassandra och sömlöst kombinerar skalbarhet, stabilitet och prestanda.

AstraDBs kapacitet att hantera heterogena arbetsbelastningar, inklusive streaming, icke-vektor- och vektordata, samtidigt som den bevarar extremt låg latens för samtidiga frågor och uppdateringar, är en av dess mest anmärkningsvärda fördelar.

Denna anpassningsförmåga är väsentlig för generativa AI-applikationer, som kräver streaming och realtidsdatabehandling för att ge exakta, sammanhangsmedvetna AI-svar.

Den serverlösa lösningen från AstraDB gör utvecklingen ännu enklare och frigör utvecklare att koncentrera sig på att skapa innovativa AI-applikationer snarare än att hantera backend-infrastrukturen.

Från snabbstartsvägledning till djupgående lektioner om att skapa chatbotar och rekommendationssystem, AstraDB gör det möjligt för utvecklare att snabbt förverkliga sina AI-idéer genom tillförlitliga API:er och smidiga gränssnitt med välkända verktyg och plattformar.

Generativa AI-system i företagsklass måste prioritera säkerhet och efterlevnad, och AstraDB levererar på båda fronterna.

Djupa företagssäkerhetsfunktioner och efterlevnadscertifieringar tillhandahålls av den, vilket garanterar att AI-applikationer utvecklade på AstraDB följer de strikta riktlinjerna för integritet och dataskydd.

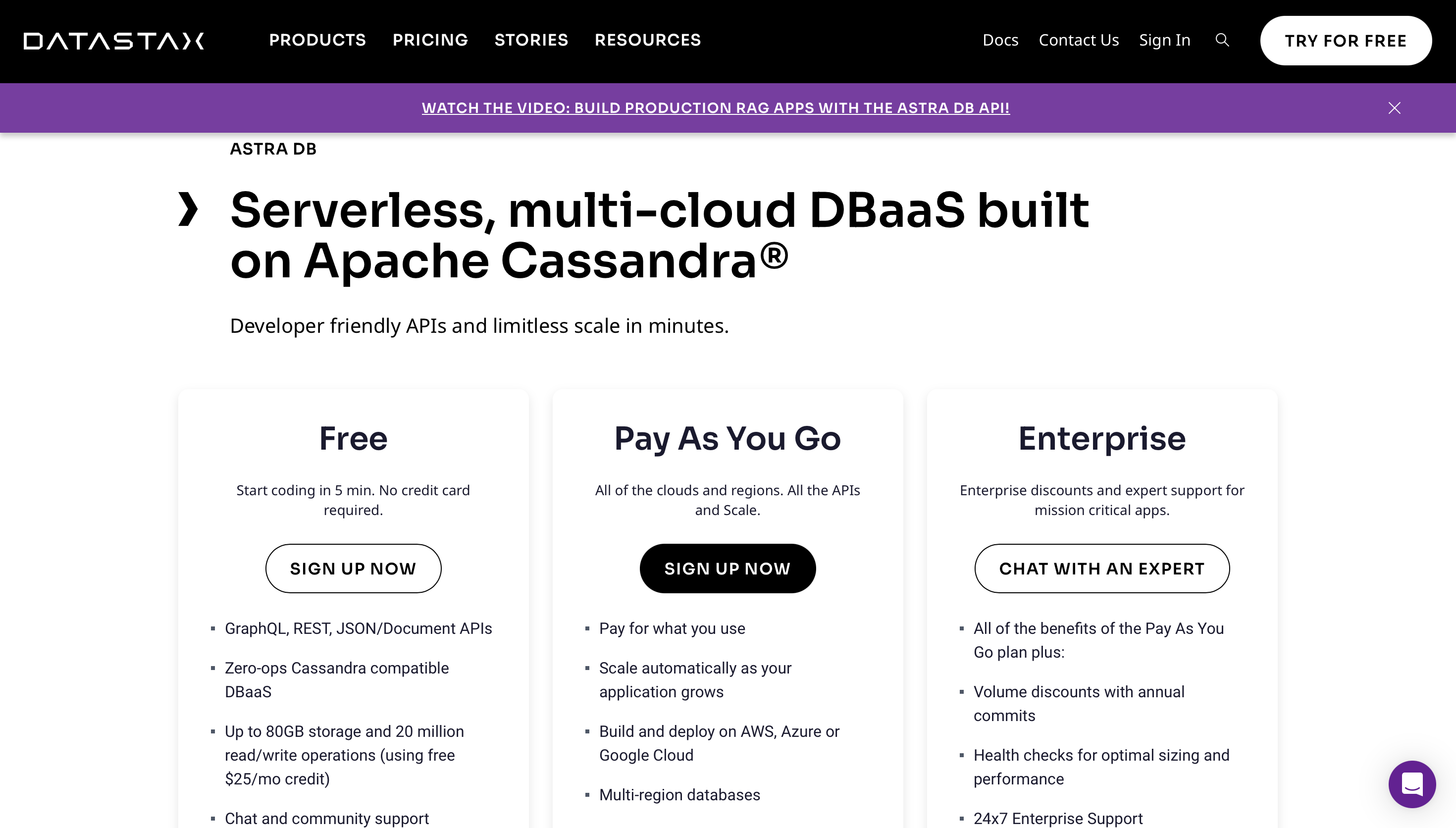

Priser

Du kan börja använda den gratis och den erbjuder en pay-as-you-go-modell.

9. Opensearch

OpenSearch framstår som ett tilltalande alternativ för dem som utforskar vektordatabaser, särskilt för att utveckla anpassningsbara, skalbara och framtidssäkra AI-system.

OpenSearch är en all-inclusive vektordatabas med öppen källkod som kombinerar kraften i analys, sofistikerad vektorsökning och konventionell sökning i ett sammanhållet system.

Genom att använda inbäddningsmodeller för maskininlärning för att koda innebörden och sammanhanget av flera dataformer – dokument, foton och ljud – till vektorer för likhetssökningar, är denna integration särskilt användbar för utvecklare som vill inkludera semantisk förståelse i sina sökappar.

Även om OpenSearch har mycket att erbjuda, är det viktigt att komma ihåg att jämfört med Elasticsearch har det skett mycket färre kodändringar, särskilt i kritiska moduler som skriptspråk och inmatningspipelineprocessorer.

Elasticsearch kan ha mer sofistikerade funktioner på grund av ökad utvecklingsansträngning, vilket leder till skillnader i prestanda, funktionsuppsättning och uppdateringar mellan de två.

OpenSearch kompenserar med en stor gemenskapsföljare och ett engagemang för idéer med öppen källkod, vilket resulterar i en öppen och anpassningsbar plattform.

Den stöder ett brett utbud av applikationer utöver sökning och analys, såsom observerbarhet och säkerhetsanalys, vilket gör det till ett flexibelt verktyg för dataintensiva uppgifter.

Den community-drivna strategin säkerställer kontinuerliga förbättringar och integrationer för att hålla plattformen uppdaterad och unik.

Priser

Du kan börja använda det gratis.

10. Azure AI-sökning

Azure AI Search är en stark plattform som förbättrar sökmöjligheterna inom generativa AI-applikationer.

Det sticker ut eftersom det stöder vektorsökning, en mekanism för att indexera, lagra och hämta vektorinbäddningar i ett sökindex.

Den här funktionen hjälper till att upptäcka jämförbara dokument i vektorrymden, vilket resulterar i mer kontextuellt relevanta sökresultat.

Azure AI Search kännetecknas av sitt stöd för hybridsituationer, där vektor- och nyckelordssökningar utförs samtidigt, vilket resulterar i en enhetlig resultatuppsättning som ofta överträffar effektiviteten för varje teknik som används ensam.

Kombinationen av vektor- och icke-vektormaterial i samma index möjliggör en mer komplett och flexibel sökupplevelse.

Vektorsökfunktionen i Azure AI Search är allmänt tillgänglig och gratis för alla Azure AI Search-nivåer.

Det är extremt flexibelt för en rad användningsfall och utvecklingspreferenser på grund av dess stöd för flera utvecklingsmiljöer, som tillhandahålls via Azure-webbplatsen, REST API: er, och SDK:er för bland annat Python, JavaScript och.NET.

Med sin djupa integration med Azure AI-ekosystemet erbjuder Azure AI Search mer än bara sökning; det förbättrar också ekosystemets potential för generativa AI-tillämpningar.

Azure OpenAI Studio för modellinbäddning och Azure AI Services för bildhämtning är bara två exempel på tjänsterna som ingår i denna integration.

Azure AI Search är en flexibel lösning för utvecklare som vill införliva sofistikerade sökfunktioner i sina applikationer på grund av dess omfattande stöd, som möjliggör ett brett utbud av applikationer, från likhetssökning och multimodal sökning till hybridsökning och flerspråkig sökning.

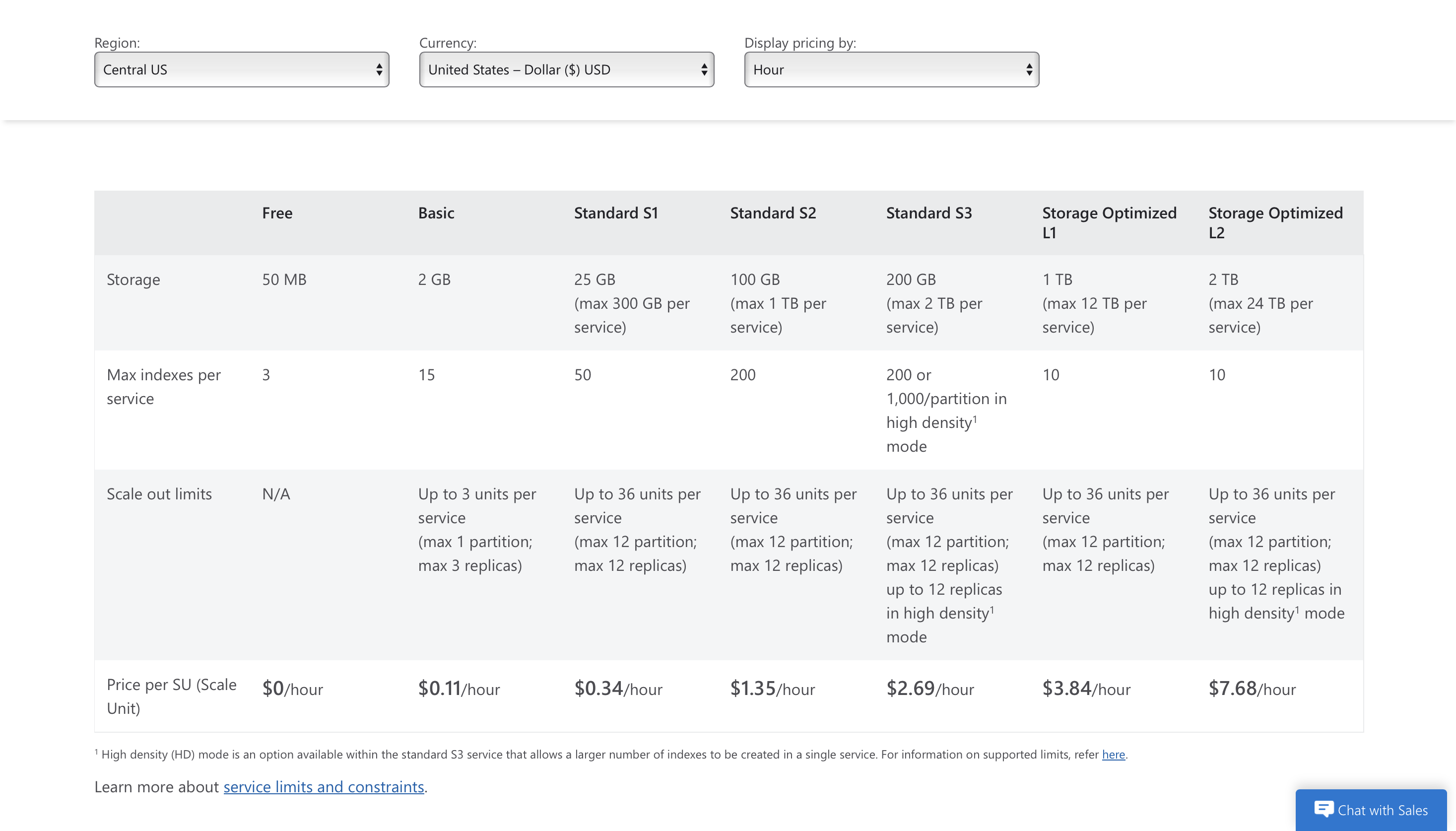

Priser

Du kan börja använda det gratis och premiumpriserna börjar från $0.11/timme.

Slutsats

Vektordatabaser omvandlar datahantering i AI genom att hantera högdimensionella vektorer, vilket möjliggör starka likhetssökningar och snabba frågor om närmaste granne i applikationer som rekommendationssystem och bedrägeriupptäckt.

Med hjälp av sofistikerade indexeringsalgoritmer omvandlar dessa databaser komplicerade ostrukturerade data till meningsfulla vektorer samtidigt som de ger den hastighet och flexibilitet som traditionella databaser inte gör.

Anmärkningsvärda plattformar inkluderar Pinecone, som lyser i generativa AI-applikationer; FAISS, skapad av Facebook AI för tät vektorklustring; och Milvus, som är känt för sin skalbarhet och molnbaserade arkitektur.

Weaviate kombinerar maskininlärning med kontextmedveten sökning, medan Vespa och Chroma är anmärkningsvärda för sina låg latens beräkningskapacitet respektive användarvänlighet.

Vektordatabaser är viktiga verktyg för att utveckla AI och maskininlärningsteknik eftersom plattformar som Qdrant, AstraDB, OpenSearch och Azure AI Search tillhandahåller en mängd olika tjänster från serverlösa arkitekturer till omfattande sök- och analysfunktioner.

Kommentera uppropet