Innehållsförteckning[Dölj][Visa]

För att samla information från webbplatser för analys, forskning eller marknadsföringsmål är webbskrapning en avgörande teknik. Det finns lyckligtvis många verktyg som stöder både huvudlösa och huvudlösa webbläsare, som båda är användbara för webbskrapning.

Headful webbläsare kommer med ett grafiskt användargränssnitt (GUI), medan huvudlösa webbläsare inte gör det. Dessa tekniker kan både manuellt och automatiskt extrahera data från webbsidor, vilket gör dem mycket fördelaktiga.

När du hanterar mycket data är huvudlösa webbläsare det bästa alternativet. För att automatisera din datautvinningsprocess behöver du dessa verktyg, vilket kommer att spara massor av tid och arbete.

Dessutom hjälper de dig att förbättra precisionen och effektiviteten i din dataextraktion, vilket kan resultera i mer givande resultat totalt sett.

Dessa verktyg kan också hjälpa till att minska risken för att fel uppstår vid manuell kopiering och inklistring av data eftersom de har kapacitet att extrahera data på ett organiserat sätt.

Enkelt sagt, det är omöjligt att arbeta utan verktyg som stöder både huvudlösa och huvudlösa webbläsare om du ägnar dig åt webbskrapning.

I den här artikeln kommer vi att titta på de bästa huvudlösa och huvudlösa webbläsarna för webbskrapning.

1. Ljusa data

Bright Data är ett webbskrapningsprogram som ger val för datainsamling för företag och privatpersoner. Till skillnad från tidigare online-skrapningssystem kommer Bright Data förinstallerat med ett antal webbläsare men fungerar som en huvudlös webbläsare.

Även om den körs som en huvudlös webbläsare på backend, pekar detta på det faktum att användare kan interagera med den genom ett grafiskt användargränssnitt (GUI), vilket gör den mer tillgänglig och användarvänlig.

Den här funktionen kommer att vara särskilt användbar för dem som inte kan mycket om kodning eller vill ha ett enklare tillvägagångssätt för webbskrapning. Användare kan snabbt navigera på komplexa webbplatser med mänskliga interaktioner tack vare Bright Datas huvudfulla webbläsare.

För att hålla dig anonym och oupptäckt tillhandahåller den också banbrytande funktioner som IP-rotation, webbläsarfingeravtryck och falska användaragenter. Med användning av AI kommer Scraping Browser att kunna ta sig bortom även de mest avancerade botdetekteringsskydden.

Faktum är att Scraping Browser är så sofistikerad att den till och med kan simulera handlingar från en äkta användares webbläsare, vilket ger dig mer framgångsrika resultat och exakta data.

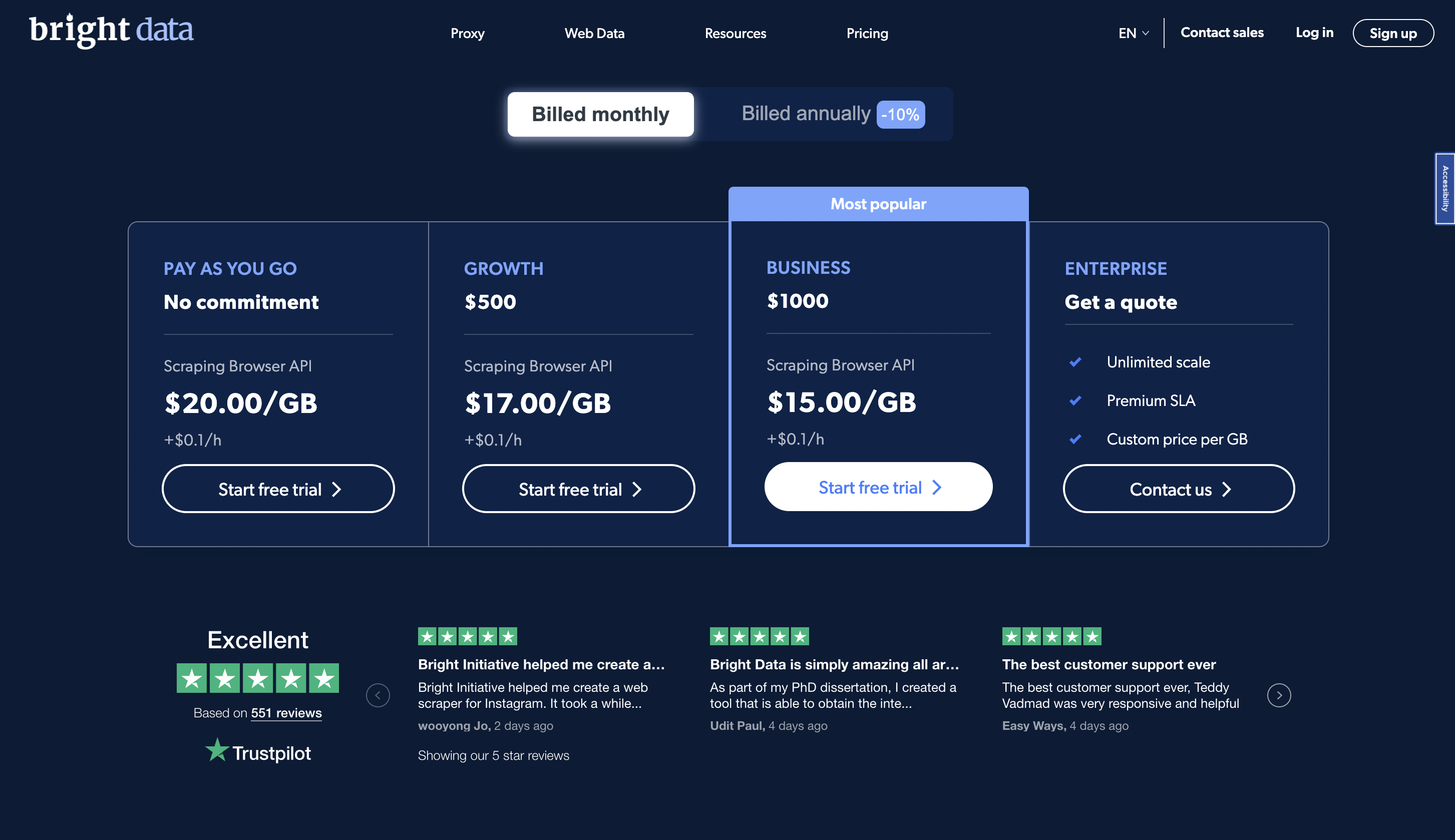

Priser

Du kan prova plattformen gratis och premiumpriserna börjar från $20/GB i en pay-as-you-go-plan.

2. Zyte

Som leverantör av onlineskrapningsverktyg tillåter Zyte – tidigare känt som Scrapinghub – företag att fånga och analysera internetdata i stor skala.

Zytes online-skrapningsplattform är byggd för att hantera även de mest komplicerade och dynamiska webbplatserna, och den innehåller en mängd banbrytande funktioner som automatisk IP-rotation, webbläsarfingeravtryck och user-agent spoofing för att garantera att dina skrapningsoperationer förblir privata och obemärkta.

Det faktum att Zytes webbskrapningsplattform stöder både huvudlösa och huvudlösa surflägen är en av dess utmärkande fördelar. Webbläsaren fungerar i huvudlöst läge i bakgrunden utan ett grafiskt användargränssnitt, vilket ökar dess effektivitet för omfattande skrapningsoperationer.

Men webbläsaren arbetar med ett GUI i headful-läge, vilket kan vara fördelaktigt när du behöver extrahera data från webbplatser med invecklade användargränssnitt.

Dessutom, eftersom Zytes plattform är baserad på den fria och öppen källkod Scrapy foundation, kan den anpassas för att möta dina specifika behov och är extremt konfigurerbar. Du kan snabbt och enkelt hämta den data du vill ha med Zyte, vilket ger dig en konkurrensfördel i din verksamhet.

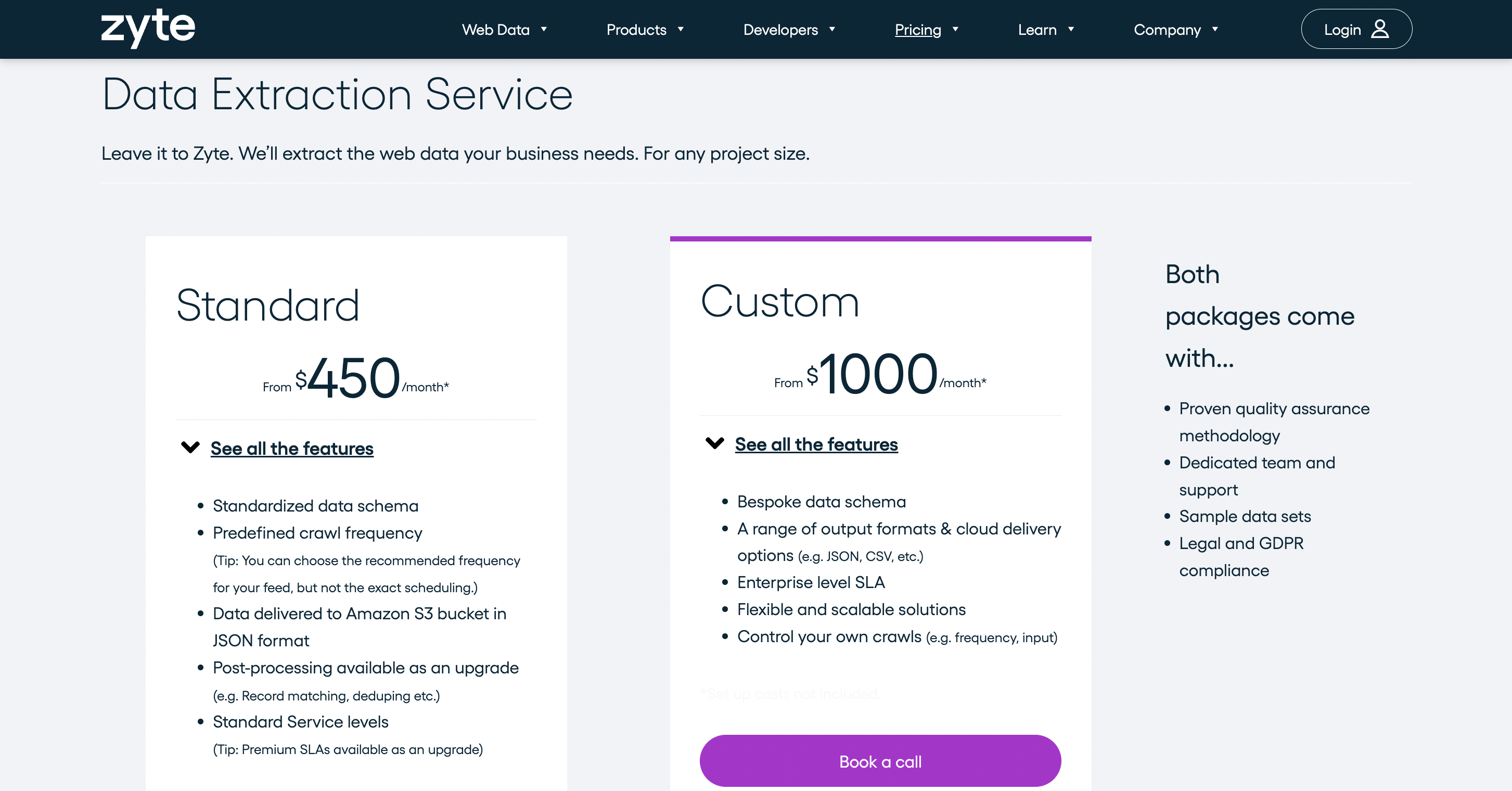

Priser

Den erbjuder flera prisplaner och debiterar $450/månad för datautvinningstjänst.

3. Bläckfisk

Du kan samla in data från webbsidor utan att skriva någon kod med Octoparse, en molnbaserad webbskrapningsapplikation. Alla som vill skrapa text, foton eller videor kan enkelt välja dem tack vare det användarvänliga gränssnittet.

Octoparse är ett flexibelt verktyg som stöder både huvudlös och huvudlös surfning, det är det bästa alternativet för webbskrapningsprojekt av alla storlekar och komplexitet. Att kunna skrapa dynamiska och interaktiva webbsidor, vilket kan vara svårt för många andra webbskrapningsprogram, är en av dess starkaste egenskaper.

Du kan skapa komplexa skrapningsprocesser med många faser, villkorliga uttalanden och loopar, vilket ökar flexibiliteten och anpassningsbarheten för skrapning. Excel, CSV och SQL är bara några av exportformaten som Octoparse tillhandahåller, vilket gör det enkelt att använda extraherade data i andra program.

Dessutom har Octoparse en integrerad proxypool som säkerställer anonym skrapning och hjälper till att undvika IP-förbud.

Priser

Du kan börja använda det gratis och premiumpriserna börjar från $89/månad.

4. Apify

Apify är en allt-i-ett-plattform för webbskrapning och automatisering som erbjuder en mängd kraftfulla funktioner. Den stöder både huvudlösa och huvudlösa webbläsare och har ett intuitivt användargränssnitt som gör det enkelt för även icke-tekniska användare att skapa skrapningsuppgifter.

Apifys förmåga att hantera svåra skrapningsjobb, stöd för flera språk och uppskalning för att hantera storskaliga skrapningsprojekt är några av dess bästa egenskaper.

Dessutom ger Apify tillgång till en stor marknad av färdiga skrapor som snabbt kan anpassas för att möta dina unika krav.

Med sitt stöd för huvudlösa webbläsare kan Apify navigera i utmanande användargränssnitt och skrapa data från dynamiska webbplatser samtidigt som det snabbt och effektivt extraherar information från enorma mängder data.

Apify är ett användbart verktyg för en mängd olika online-skrapningsapplikationer, inklusive leadgenerering, konkurrensanalys, marknadsundersökningar och innehållsaggregation.

Apify ökar noggrannheten och effektiviteten samtidigt som du sparar tid och ansträngning genom att automatisera datautvinningsprocessen. Det är ett starkt verktyg för både tekniska och icke-tekniska användare på grund av dess funktionalitet och användarvänliga design.

Priser

Du kan börja använda det gratis och premiumpriserna börjar från $49/månad.

5. ScrapingBee

Den enastående online-skrapningsapplikationen ScrapingBee gör det enkelt att automatisera datautvinningsprocessen från webbplatser.

Dess möjligheter, såsom de för hantering av JavaScript-rendering, CAPTCHA-upplösning och rotation av användaragenter, gör att webbplatsers anti-skrapningsförsvar kan kringgås. vilket gör det till ett utmärkt alternativ för webbskrapningsuppgifter.

Användare har en stor grad av frihet med detta verktyg eftersom det fungerar med både huvudlösa och huvudlösa webbläsare. Det är viktigt att påpeka att ScrapingBee använder huvudlösa webbläsare som standard, vilket är perfekt för att automatiskt hämta enorma mängder data.

För att interagera med webbplatser som har ett komplext gränssnitt kan användarna byta till webbläsare. För att säkerställa effektiv dataextraktion upprätthåller ScrapingBee också en pool av geolokaliserade proxyservrar som regelbundet kontrolleras och ändras.

Användare kan minska tid och ansträngning under webbskrapning genom att använda ScrapingBee som en huvudlös eller huvudlös webbläsare samtidigt som de garanterar att de hämtade uppgifterna är korrekta och fullständiga. Den har också många användbara funktioner, som dataformatering, proxyrotation och API-anslutning, vilket gör det till ett praktiskt verktyg för både företag och studenter.

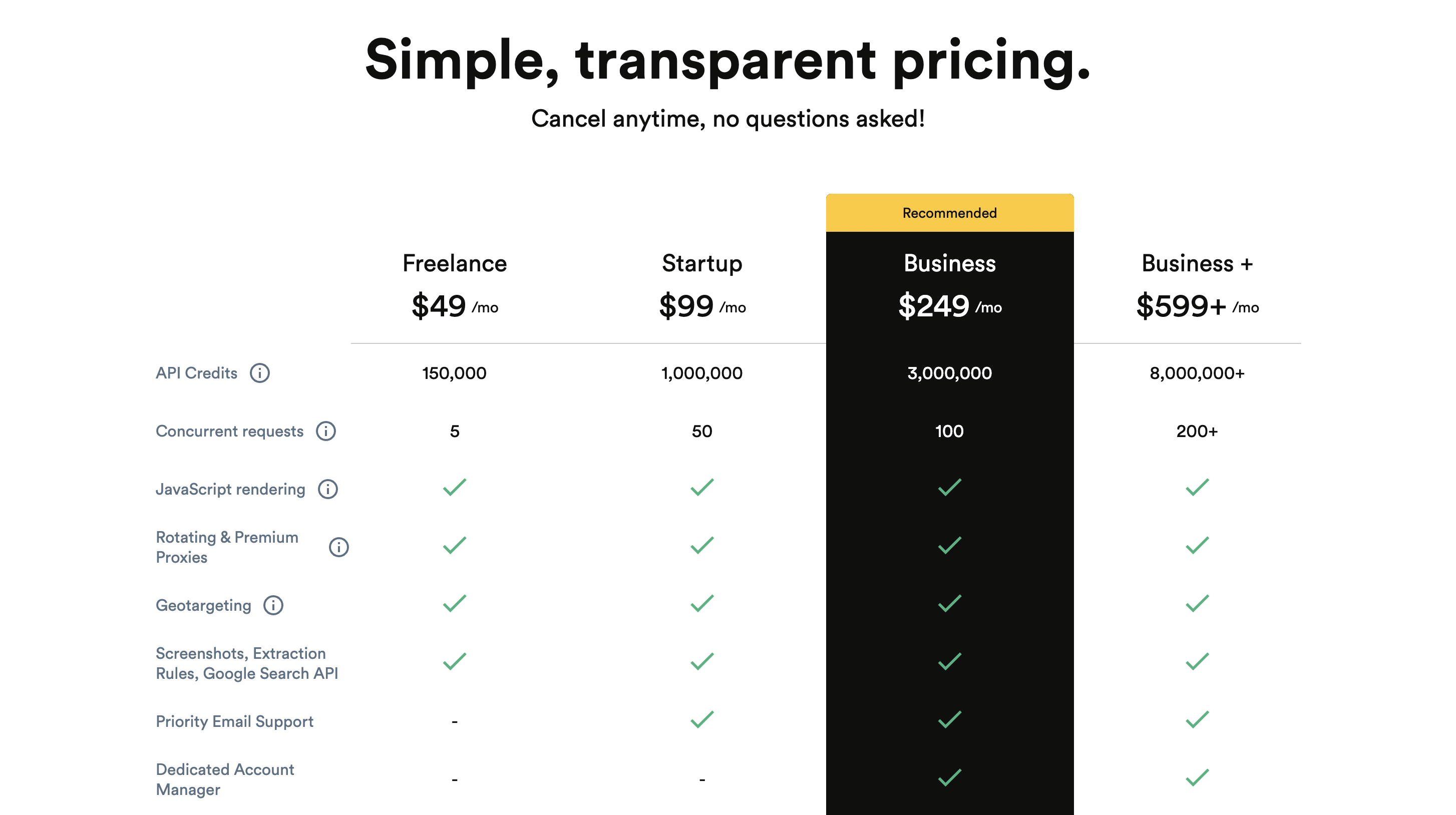

Priser

Premiumprissättningen börjar från $49/månad.

6. ParseHub

Utan behov av teknisk expertis kan användare samla in data från webbplatser med hjälp av webbskrapningsapplikationen ParseHub. En av dess största egenskaper är hur lätt den är att använda; användare kan välja vilken data de vill skrapa genom att bara klicka på objekten.

Den har också förmågan att känna igen sidnumrering automatiskt, vilket gör det enkelt för användare att skrapa information från flera sidor. För att skrapa data från webbplatser med grundläggande eller komplicerade användargränssnitt, stöder ParseHub både huvudlösa och huvudlösa webbläsare.

Dessutom ger det automatisk IP-rotation, vilket gör det svårare för webbplatser att identifiera och förbjuda skrapningsaktivitet. ParseHub garanterar att data extraheras på ett organiserat sätt med hjälp av dess omfattande dataformateringsmöjligheter, vilket gör det enklare för analys och systemintegration.

Dessutom har ParseHub ett smart läge som automatiskt känner igen och samlar in information från liknande webbplatser. ParseHub kan känna igen och samla in data från webbplatser med liknande strukturer, såsom e-handelswebbplatser, med hjälp av artificiell intelligens (AI). Denna funktion ökar noggrannheten och produktiviteten genom att kräva mindre ansträngning och spara tid.

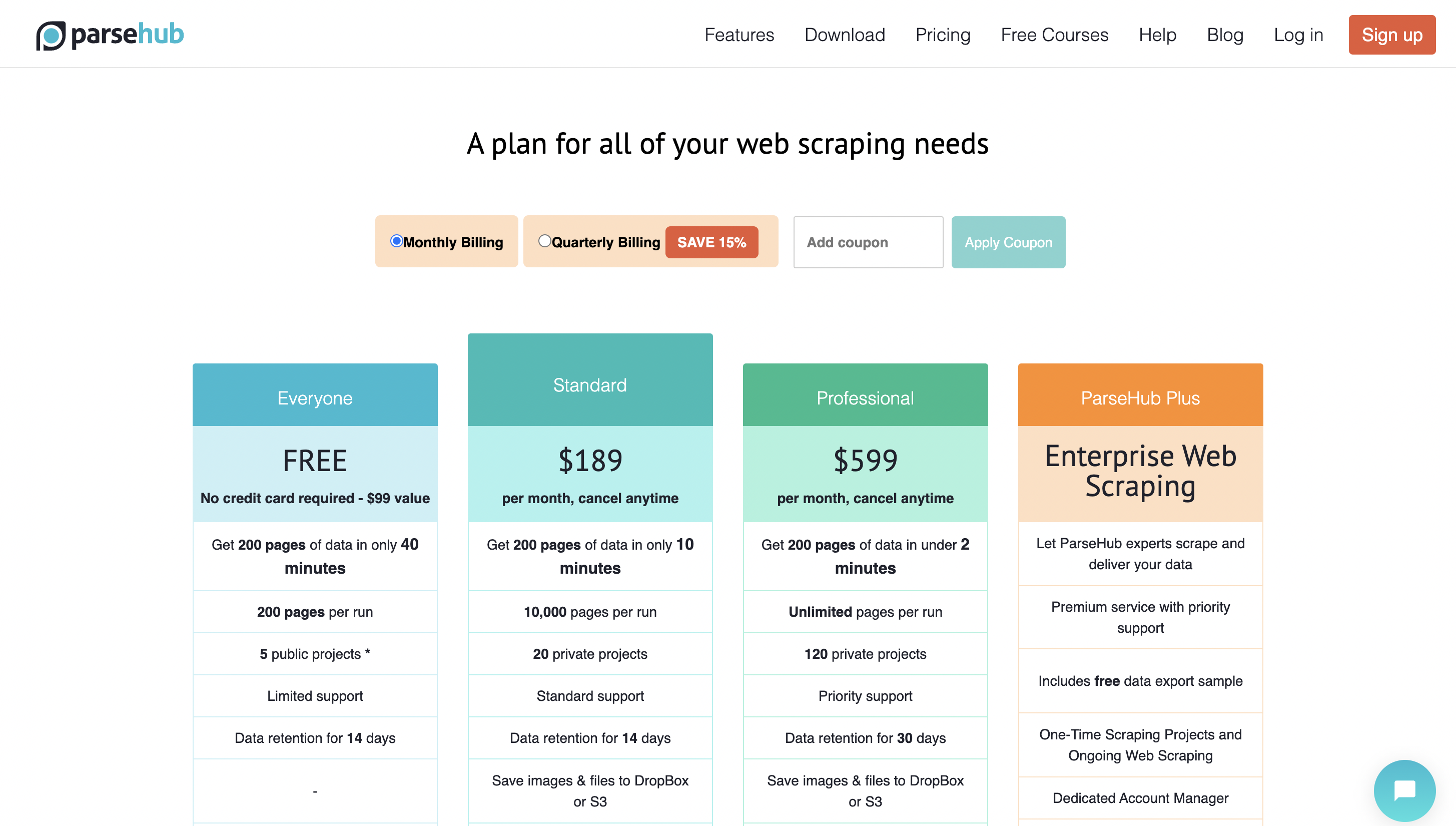

Priser

Du kan börja använda det gratis och premiumpriserna börjar från $189/månad.

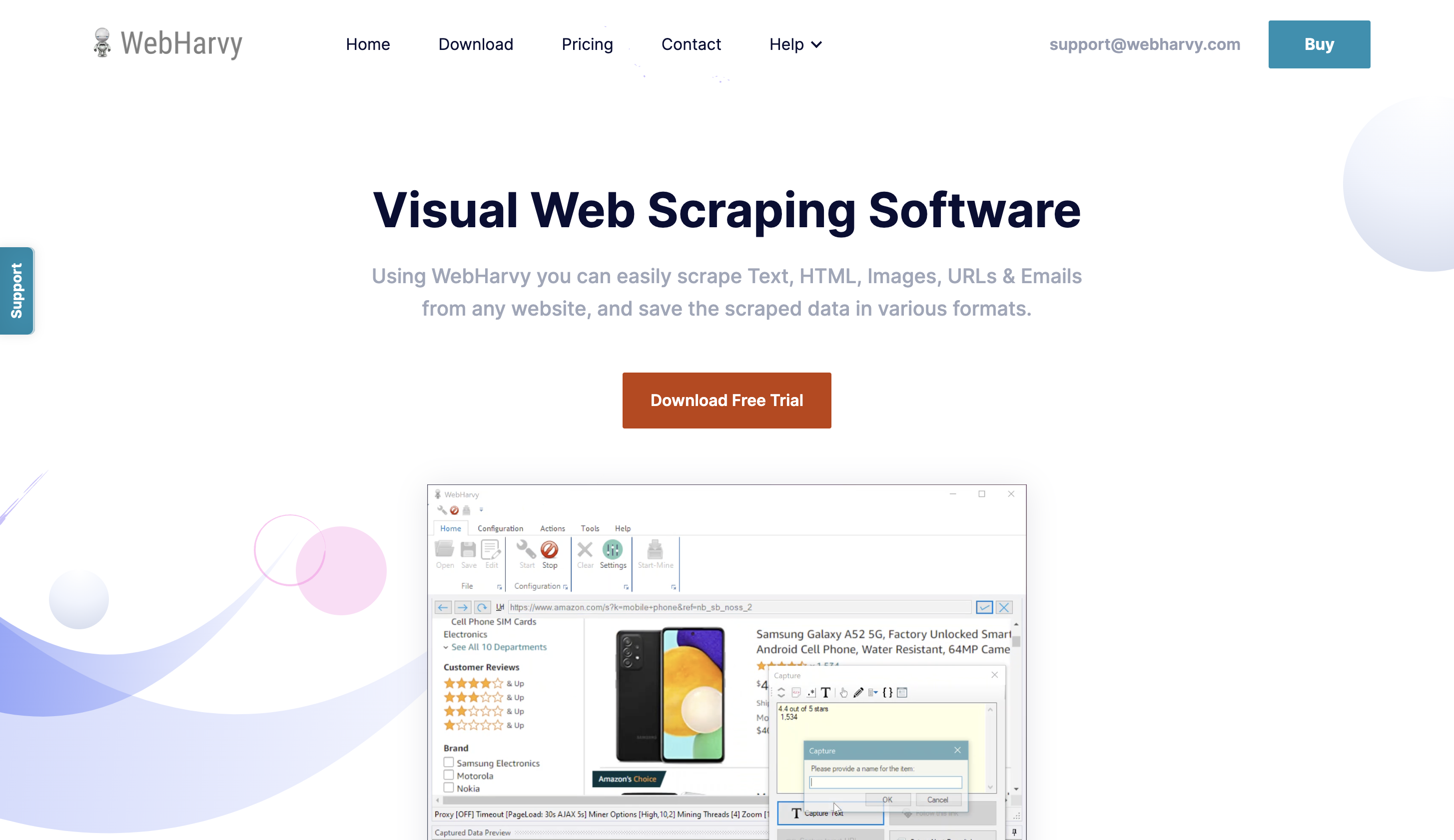

7. WebHarvy

WebHarvy är ett potent onlineskrapningsverktyg som gör det möjligt för organisationer att snabbt, exakt och effektivt skrapa data från webbplatser. Den är gjord för att skrapa information från många webbplatser, inklusive sökmotorer, sociala medier, e-handelssajter och kataloger.

Utan någon tidigare kodningserfarenhet kan användare enkelt utforska och skapa skrapjobb på grund av dess användarvänliga gränssnitt. En av WebHarvys största egenskaper är dess förmåga att hämta data från webbsidor som drivs av JavaScript och AJAX som andra skrapverktyg kanske inte kan komma åt.

Dessutom erbjuder den ett Peka och klicka-gränssnitt som gör det enkelt att välja den information från en webbsida som du vill skrapa. WebHarvy har huvudlösa och huvudlösa surflägen. För snabbare och effektivare dataskrapning kan den arbeta i huvudlöst läge.

Headful-läge är användbart när du arbetar med komplicerade webbplatser som kräver användarinput. Den kan också navigera mellan många sidor och fylla i formulär, vilket är användbart när du extraherar data från webbplatser med flera sidor.

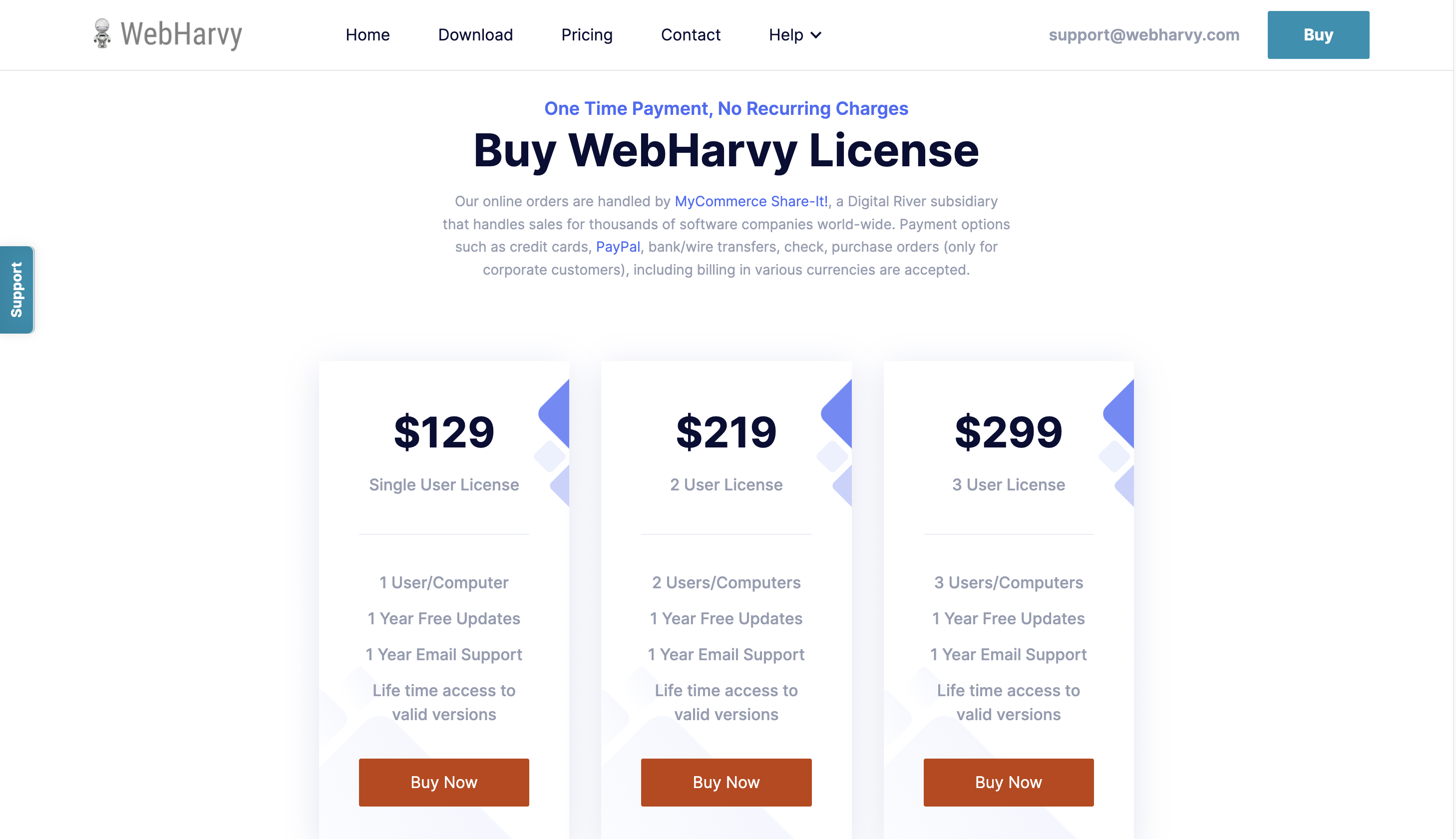

Priser

Premiumprissättningen börjar från $129 för en enanvändarlicens.

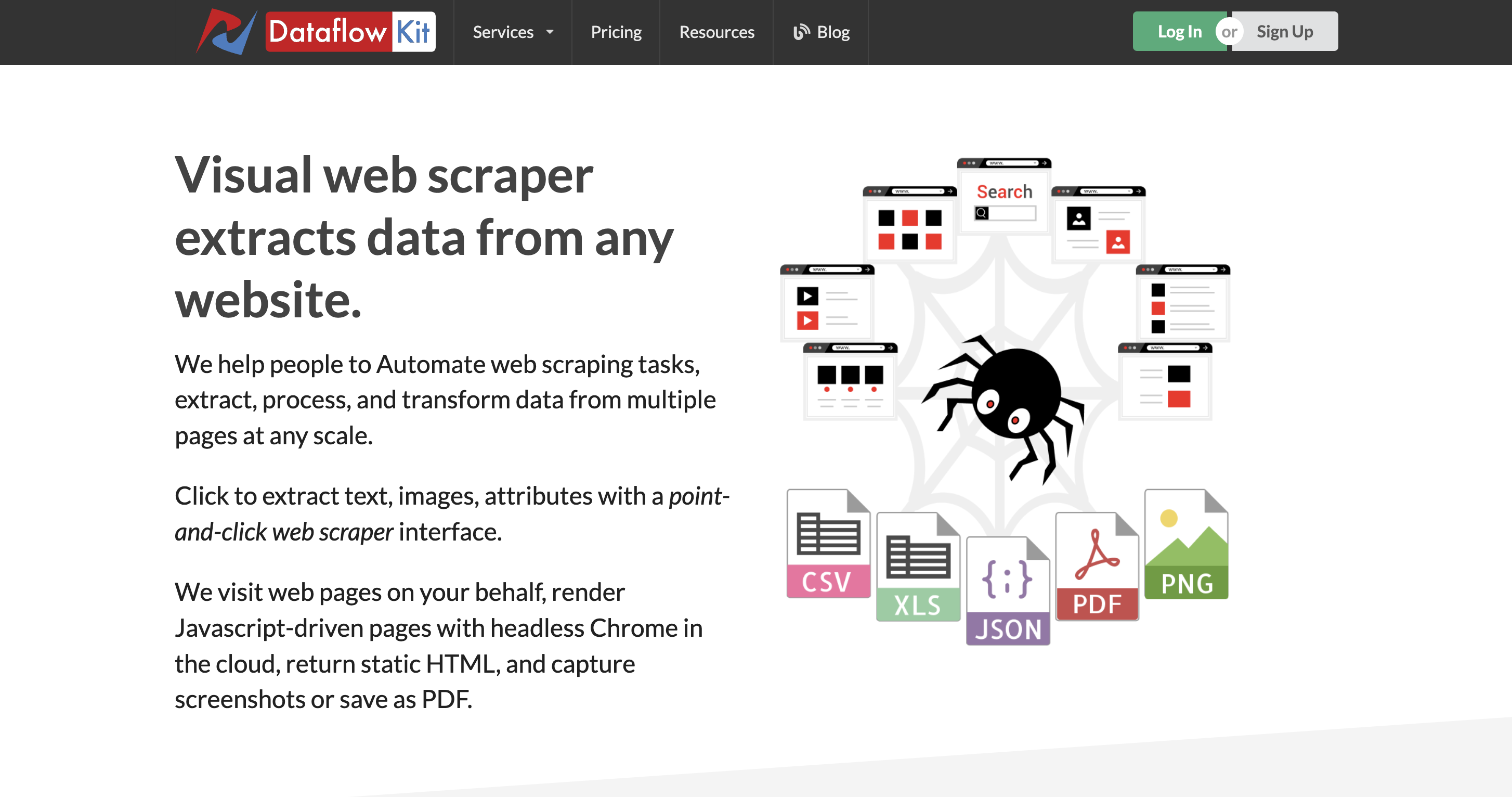

8. Dataflow Kit

Med hjälp av Dataflow Kit, ett robust onlineskrapningsverktyg, kan data samlas in och analyseras från en mängd olika webbplatser, inklusive sociala nätverk webbplatser, sökmotorer, e-handelswebbplatser och nyhetswebbplatser. En av dess bästa egenskaper är dess förmåga att snabbt och effektivt samla in data från komplicerade, dynamiska webbplatser.

Det är idealiskt för att skrapa webbplatser som är utmanande att komma åt med andra metoder eftersom det är så enkelt att använda. En huvudlös webbläsare och en huvudlös webbläsare är båda funktionella med Dataflow Kit. Avancerade funktioner som proxy- och användaragentrotation, undvikande av IP-blockering och antibot-detektering tillhandahålls för att säkerställa effektiv skrapning.

Dessutom erbjuder det ett användarvänligt gränssnitt som gör det möjligt för kunder att skapa, planera och hantera sina skrapningsaktiviteter utan någon programmeringserfarenhet. För storskaliga webbskrapningsapplikationer är dess effektiva skrapmotor en fantastisk lösning eftersom den är optimerad för att hantera data snabbt och effektivt.

Den skrapade informationen kan enkelt exporteras till en mängd olika format, inklusive CSV, JSON och XML, så att du kan analysera och använda den som du vill. Dessutom erbjuder Dataflow Kit en mängd olika gränssnittsalternativ, inklusive API och Zapier, för att hjälpa dig att effektivisera ditt arbetsflöde och automatisera din dataextraktionsprocess.

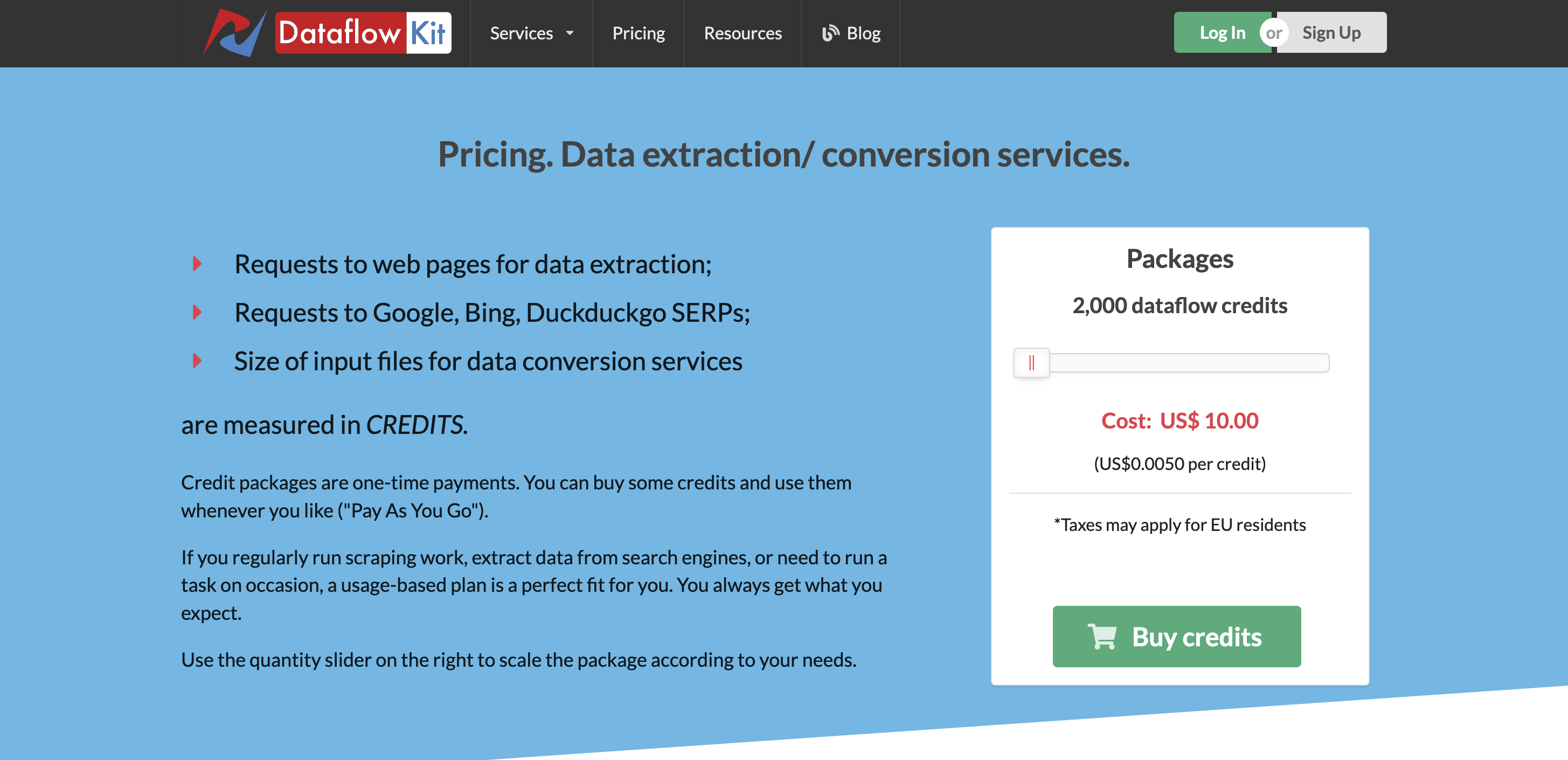

Priser

Premiumprissättningen börjar från $10 för 2000 dataflödeskrediter, som du kan använda enligt dina behov.

9. Import.io

Med hjälp av det molnbaserade webbskrapningsverktyget Import.io kan användare skrapa data från webbplatser utan någon programmeringserfarenhet. Enkel användning är en av Import.ios mest lockande funktioner; allt du behöver göra är att peka och klicka för att hitta de data du vill skrapa.

Användare kan utvärdera extraherade data i realtid på grund av dess kraftfulla visualiseringsfunktioner. Import.io är en huvudlös webbläsare som imiterar en webbläsare och ansluter till webbplatser på samma sätt som en person skulle göra men utan krav på ett grafiskt användargränssnitt.

Detta förbättrar webbskrapningseffektiviteten och tillåter användare att skrapa data från dynamiska webbplatser som kräver användarinblandning för att visa information. Dess AI-drivna Extractor låter användare extrahera data med bara några få klick. Extraktorn kan också identifiera datamönster och extrahera jämförbar data från många källor.

Användare kan automatisera sina skrapningsinsatser och få frekventa uppdateringar om den data de vill ha med dess omfattande schemaläggningsfunktioner. Import.io gör det enkelt att använda extraherade data i andra appar genom att du kan länka till populära verktyg som Google Sheets och Zapier.

Priser

Priser anges inte på webbplatsen, prata med en expert om det.

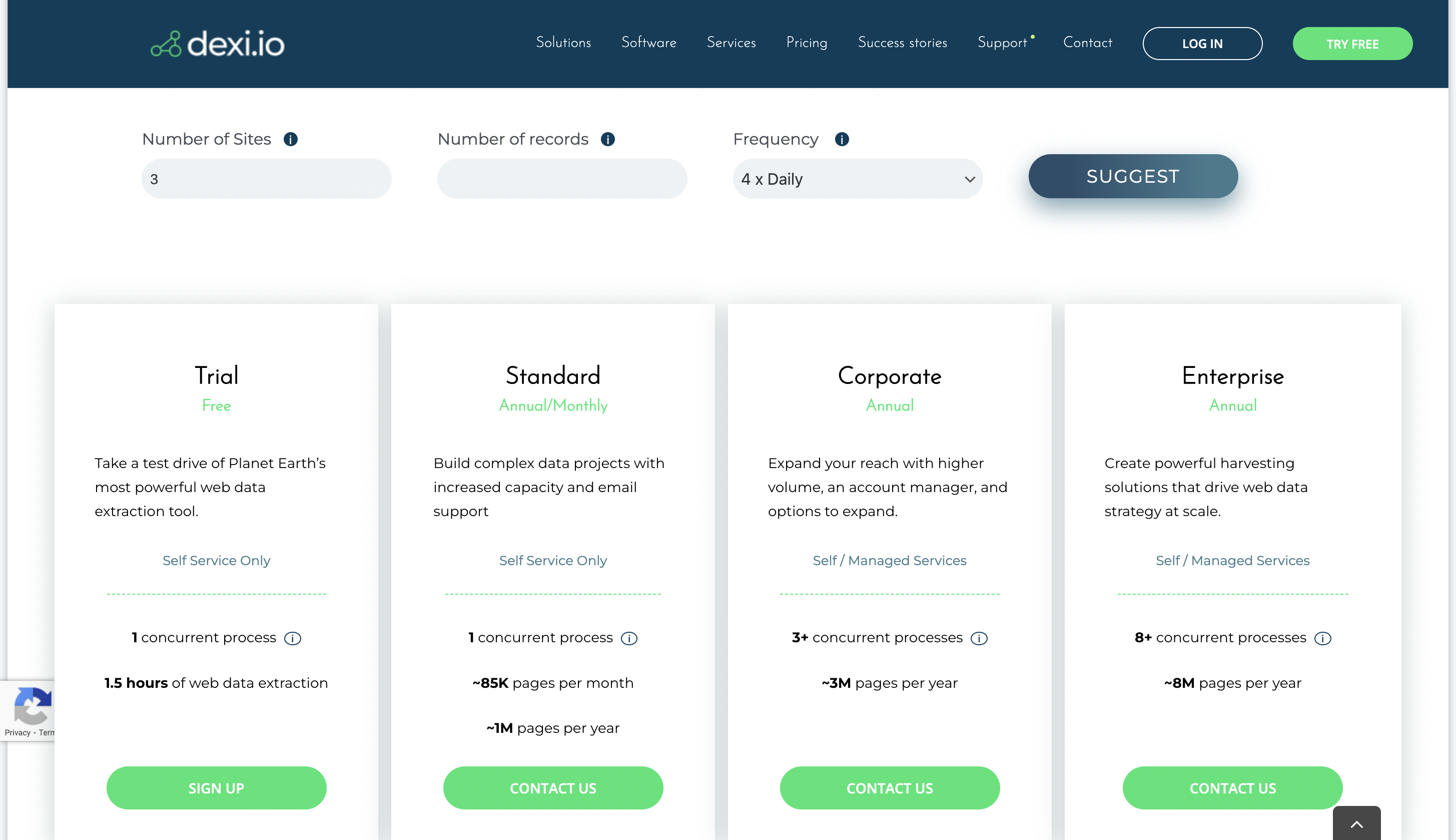

10. Dexi.io

Dataextraktion är enkel med hjälp av det robusta webbskrapningsverktyget Dexi.io. Du kan samla in data från webbplatser med det här verktyget utan någon kodningsupplevelse på grund av dess användarvänliga gränssnitt och automatiserade möjligheter.

En av dess finaste egenskaper är dess förmåga att skrapa och kombinera data från många källor, inklusive webbsidor, API:er och databaser. Tack vare Dexi.ios parallella bearbetningsförmåga kan du snabbt och effektivt skrapa stora mängder data.

Dexi.io erbjuder dig valet att välja det bästa alternativet för dina skrapningsbehov eftersom det fungerar både som en huvudlös webbläsare och en huvudlös webbläsare. Medan alternativet headful webbläsare låter dig se och interagera med webbplatsen som om du använder en vanlig webbläsare, låter alternativet headless webbläsare dig skrapa data utan att visa sidan i en webbläsare.

Detta gör det enkelt att åtgärda eventuella skrapproblem och anpassa skrapningsproceduren efter dina önskemål. Du kan snabbt exportera skrapad data från Dexi.io i en mängd olika format, såsom CSV, JSON och Excel, för ytterligare analys eller interaktion med andra applikationer.

Dessutom tillhandahåller den pålitlig och säker molnvärd för dina skrapade data, vilket garanterar dess säkerhet och tillgänglighet.

Priser

Du kan prova plattformen med dess kostnadsfria testplan och kontakta teamet för prissättning.

Slutsats

Sammanfattningsvis finns det flera webbskrapningslösningar på marknaden, var och en med specifika fördelar och möjligheter. Det finns många dataalternativ att välja mellan, allt från allt-i-ett-lösningar som Bright Data och ScrapingBee till mer specialiserade verktyg som Apify och ParseHub.

Dessa system har ofta funktioner som huvudlös surfning, IP-rotation, user-agent spoofing och webbläsarfingeravtryck för att öka effektiviteten, pålitligheten och sekretessen för onlineskrapning.

Verktyg för webbskrapning kan ge dig snabb och enkel tillgång till en mängd information, oavsett om du är en småföretagare som försöker undersöka dina konkurrenter, en forskare som söker efter data för att stödja ditt arbete eller en dataanalytiker som letar efter insikter i konsumentbeteende .

Risken för misstag och inkonsekvenser kan minskas samtidigt som du potentiellt kan spara tid och pengar genom att automatisera datainsamlingsprocessen.

Kommentera uppropet