Aby zebrać informacje ze stron internetowych do celów analitycznych, badawczych lub marketingowych, kluczową techniką jest skrobanie stron internetowych. Na szczęście istnieje wiele narzędzi obsługujących zarówno przeglądarki bezgłowe, jak i bezgłowe, które są przydatne do skrobania stron internetowych.

Przeglądarki Headful są wyposażone w graficzny interfejs użytkownika (GUI), podczas gdy przeglądarki Headless nie. Technologie te mogą zarówno ręcznie, jak i automatycznie wydobywać dane ze stron internetowych, co czyni je bardzo korzystnymi.

W przypadku przetwarzania dużej ilości danych najlepszym rozwiązaniem są przeglądarki bezobsługowe. Aby zautomatyzować proces ekstrakcji danych, będziesz potrzebować tych narzędzi, które pozwolą Ci zaoszczędzić mnóstwo czasu i pracy.

Ponadto pomagają poprawić precyzję i skuteczność ekstrakcji danych, co może ogólnie skutkować bardziej owocnymi wynikami.

Narzędzia te mogą również pomóc w zmniejszeniu prawdopodobieństwa wystąpienia błędów podczas ręcznego kopiowania i wklejania danych, ponieważ umożliwiają wyodrębnianie danych w zorganizowany sposób.

Mówiąc najprościej, nie można pracować bez narzędzi obsługujących zarówno przeglądarki headless, jak i headful, jeśli zajmujesz się skrobaniem sieci.

W tym artykule przyjrzymy się najlepszym bezgłowym i bezgłowym przeglądarkom do skrobania stron internetowych.

1. Jasne dane

Bright Data to program do skrobania stron internetowych, który zapewnia opcje gromadzenia danych dla firm i osób prywatnych. W przeciwieństwie do wcześniejszych systemów skrobania online, Bright Data jest fabrycznie wyposażony w wiele przeglądarek, ale działa jako przeglądarka bezgłowa.

Mimo że działa jako bezgłowa przeglądarka na zapleczu, wskazuje to na fakt, że użytkownicy mogą z nią wchodzić w interakcje za pośrednictwem graficznego interfejsu użytkownika (GUI), dzięki czemu jest bardziej dostępna i przyjazna dla użytkownika.

Ta funkcjonalność będzie szczególnie przydatna dla tych, którzy nie wiedzą zbyt wiele o kodowaniu lub chcą prostszego podejścia do web scrapingu. Użytkownicy mogą szybko poruszać się po skomplikowanych witrynach internetowych z interakcjami przypominającymi ludzi dzięki zamyślonej przeglądarce Bright Data.

Aby zachować anonimowość i nieodkrycie, zapewnia również najnowocześniejsze funkcje, takie jak rotacja adresów IP, pobieranie odcisków palców przeglądarki i fałszowanie agenta użytkownika. Dzięki wykorzystaniu sztucznej inteligencji, Scraping Browser będzie w stanie wyjść poza nawet najbardziej zaawansowane zabezpieczenia przed wykrywaniem botów.

W rzeczywistości przeglądarka Scraping Browser jest tak wyrafinowana, że może nawet symulować działania przeglądarki prawdziwego użytkownika, zapewniając lepsze wyniki i precyzyjne dane.

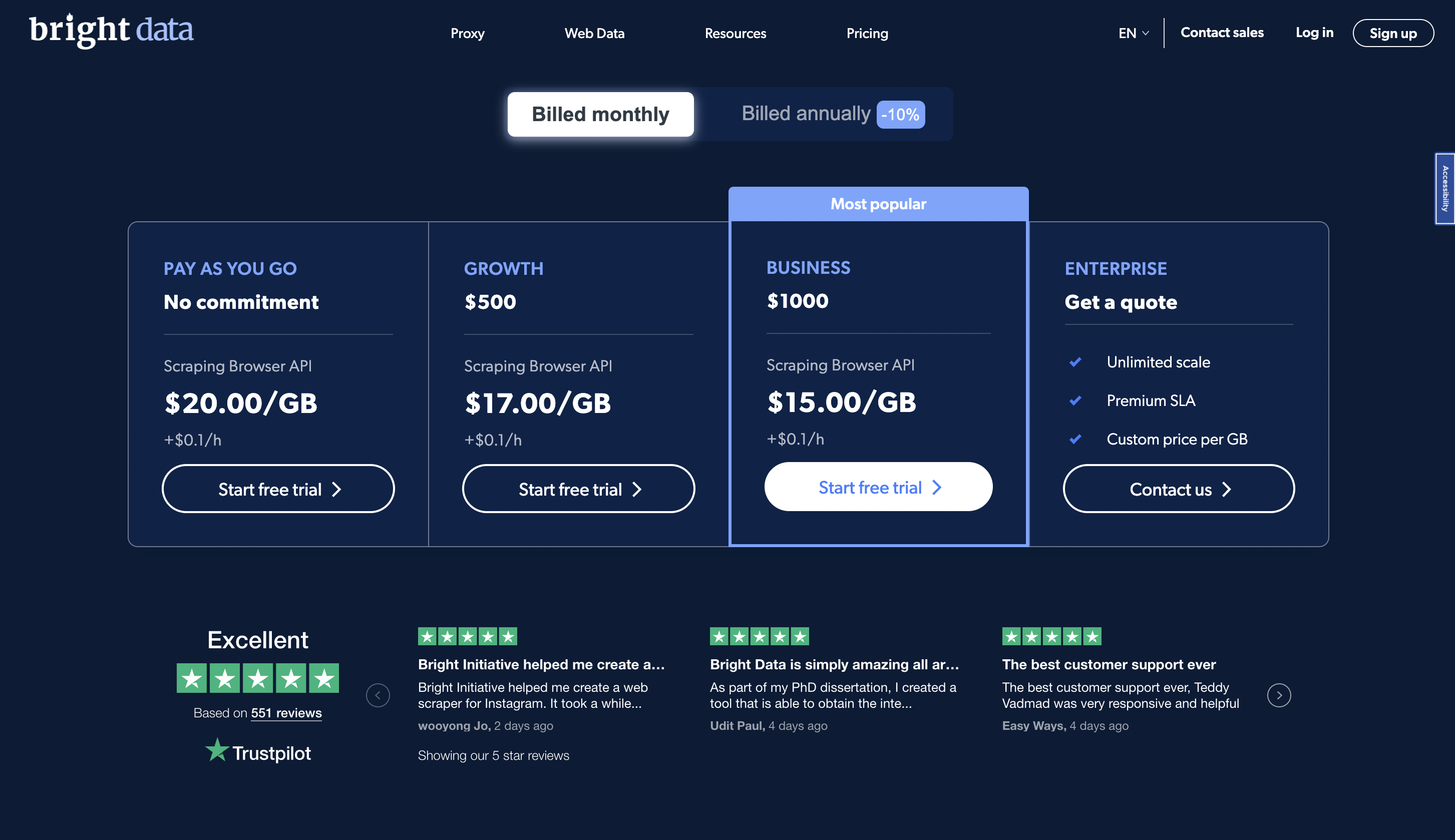

Cennik

Możesz wypróbować platformę za darmo, a ceny premium zaczynają się od 20 USD/GB w planie płatności zgodnie z rzeczywistym użyciem.

2. Zyte

Jako dostawca narzędzi do skrobania online, Zyte — wcześniej znany jako Scrapinghub — umożliwia firmom przechwytywanie i analizowanie danych internetowych na dużą skalę.

Platforma Zyte do scrapingu online została stworzona do obsługi nawet najbardziej skomplikowanych i dynamicznych stron internetowych i zawiera szereg najnowocześniejszych funkcji, takich jak automatyczna rotacja adresów IP, pobieranie odcisków palców przeglądarki i fałszowanie agenta użytkownika, aby zagwarantować, że Twoje operacje scrapingu pozostaną prywatne i niezauważone.

Fakt, że platforma web scrapingu firmy Zyte obsługuje zarówno tryby headless, jak i headful surfing, jest jedną z jej charakterystycznych zalet. Przeglądarka działa w trybie headless w tle bez graficznego interfejsu użytkownika, co zwiększa jej wydajność przy rozbudowanych operacjach scrapingu.

Jednak przeglądarka działa z graficznym interfejsem użytkownika w trybie headful, co może być korzystne, gdy trzeba wyodrębnić dane ze stron internetowych o skomplikowanym interfejsie użytkownika.

Dodatkowo, ponieważ platforma Zyte jest oparta na darmowym i otwartym fundamencie Scrapy, można ją dostosować do konkretnych potrzeb i jest niezwykle konfigurowalna. Możesz szybko i prosto odzyskać potrzebne dane za pomocą Zyte, zapewniając sobie przewagę konkurencyjną w Twojej firmie.

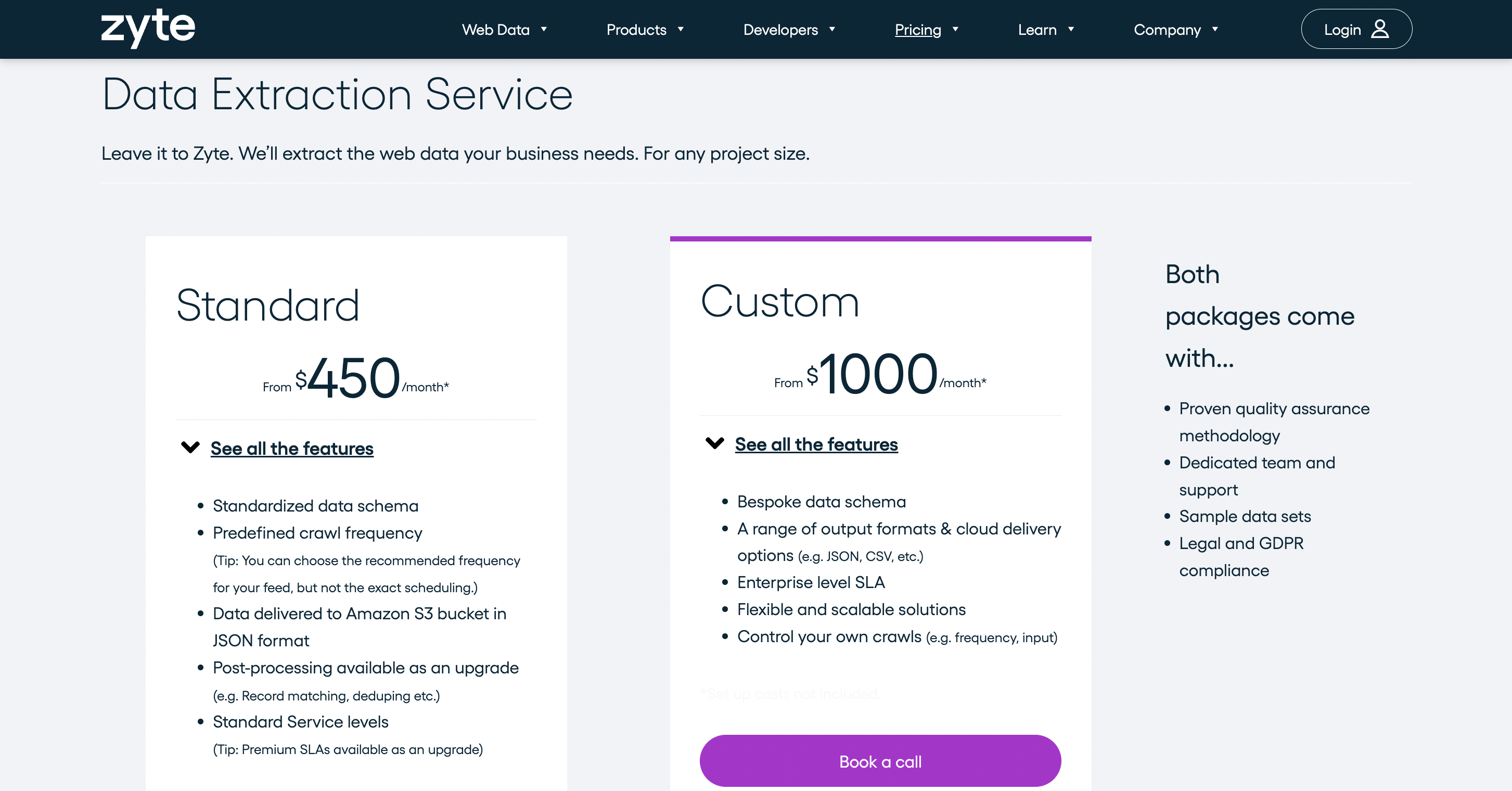

Cennik

Oferuje wiele planów cenowych i pobiera 450 USD miesięcznie za usługę ekstrakcji danych.

3. Ośmiornica

Możesz zbierać dane ze stron internetowych bez pisania kodu za pomocą Octoparse, opartej na chmurze aplikacji do skrobania stron internetowych. Każdy, kto chce zeskrobać tekst, zdjęcia lub filmy, może je łatwo wybrać dzięki przyjaznemu dla użytkownika interfejsowi.

Octoparse to elastyczne narzędzie, które obsługuje zarówno przeglądanie bezgłowe, jak i headful, jest najlepszą opcją dla projektów web scrapingu o dowolnej wielkości i złożoności. Możliwość skrobania dynamicznych i interaktywnych stron internetowych, co może być trudne dla wielu innych programów do skrobania stron internetowych, jest jedną z jego najsilniejszych cech.

Możesz tworzyć złożone procesy zgarniania z licznymi fazami, instrukcjami warunkowymi i pętlami, zwiększając elastyczność i możliwości dostosowywania zgarniania. Excel, CSV i SQL to tylko niektóre z formatów eksportu udostępnianych przez Octoparse, co ułatwia wykorzystanie wyodrębnionych danych w innych programach.

Dodatkowo Octoparse oferuje zintegrowaną pulę proxy, która zapewnia anonimowe skrobanie i pomaga uniknąć blokowania adresu IP.

Cennik

Możesz zacząć używać go za darmo, a ceny premium zaczynają się od 89 USD miesięcznie.

4. Apify

Apify to wszechstronna platforma do skrobania i automatyzacji sieci, która oferuje szereg zaawansowanych funkcji. Obsługuje zarówno przeglądarki headless, jak i headful oraz ma intuicyjny interfejs użytkownika, który ułatwia tworzenie zadań skrobania nawet użytkownikom nietechnicznym.

Zdolność Apify do obsługi trudnych zadań skrobania, obsługa kilku języków i skalowanie w celu obsługi projektów skrobania na dużą skalę to tylko niektóre z jego najlepszych funkcji.

Ponadto Apify zapewnia dostęp do ogromnego rynku gotowych skrobaków, które można szybko dostosować do indywidualnych potrzeb.

Dzięki obsłudze przeglądarek bezobsługowych Apify może poruszać się po wymagających interfejsach użytkownika i pobierać dane z dynamicznych stron internetowych, jednocześnie szybko i wydajnie wydobywając informacje z ogromnych ilości danych.

Apify to przydatne narzędzie do różnych aplikacji do skrobania online, w tym do generowania potencjalnych klientów, analizy konkurencji, badań rynku i agregacji treści.

Apify zwiększa dokładność i wydajność, jednocześnie oszczędzając czas i wysiłek, automatyzując proces ekstrakcji danych. Jest to silne narzędzie zarówno dla użytkowników technicznych, jak i nietechnicznych ze względu na swoją funkcjonalność i przyjazny dla użytkownika design.

Cennik

Możesz zacząć używać go za darmo, a ceny premium zaczynają się od 49 USD miesięcznie.

5. SkrobaniePszczoła

Znakomita aplikacja do skrobania online ScrapingBee ułatwia automatyzację procesu ekstrakcji danych ze stron internetowych.

Jego możliwości, takie jak obsługa renderowania JavaScript, rozpoznawanie CAPTCHA i rotacja agenta użytkownika, umożliwiają ominięcie zabezpieczeń stron internetowych przed skrobaniem. dzięki czemu jest to świetna opcja do zadań związanych ze skrobaniem sieci.

Użytkownicy mają dużą swobodę dzięki temu narzędziu, ponieważ działa ono zarówno z przeglądarkami headless, jak i headful. Należy zauważyć, że ScrapingBee domyślnie korzysta z przeglądarek bezgłowych, które idealnie nadają się do automatycznego pobierania ogromnych ilości danych.

Aby wchodzić w interakcje ze stronami internetowymi, które mają złożony interfejs, użytkownicy mogą przełączyć się na przeglądarki, które działają z głową. Aby zapewnić skuteczną ekstrakcję danych, ScrapingBee utrzymuje również pulę geolokalizowanych serwerów proxy, które są regularnie sprawdzane i zmieniane.

Użytkownicy mogą skrócić czas i wysiłek podczas przeglądania sieci, wykorzystując ScrapingBee jako przeglądarkę bezgłową lub bezgłową, jednocześnie gwarantując poprawność i kompletność pobieranych danych. Posiada również wiele przydatnych funkcji, takich jak formatowanie danych, rotacja proxy i łączność API, dzięki czemu jest przydatnym narzędziem zarówno dla firm, jak i studentów.

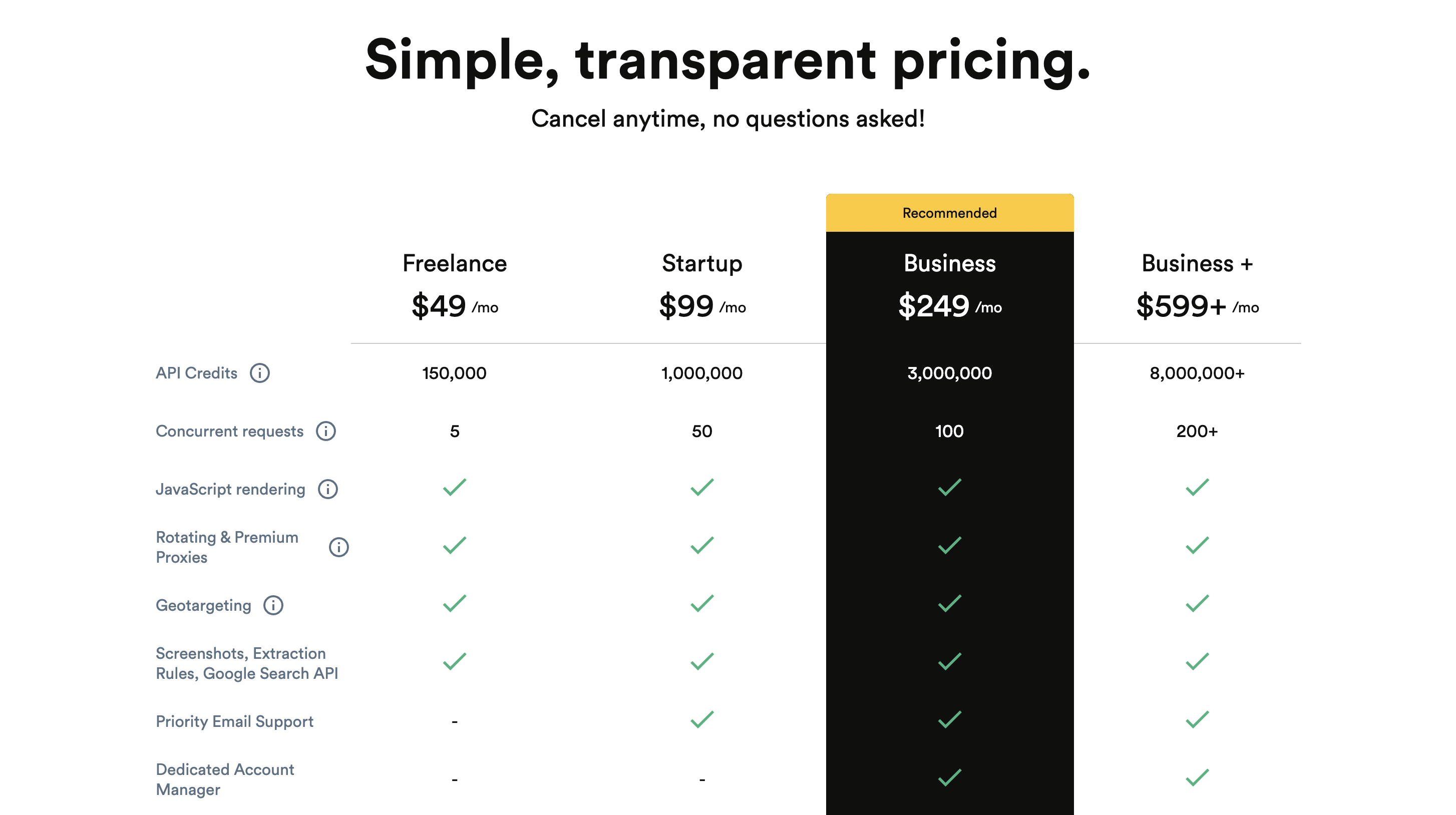

Cennik

Ceny premium zaczynają się od 49 USD miesięcznie.

6. ParseHub

Bez potrzeby posiadania specjalistycznej wiedzy technicznej użytkownicy mogą zbierać dane ze stron internetowych za pomocą aplikacji ParseHub do zbierania danych z sieci. Jedną z jego największych cech jest łatwość użycia; użytkownicy mogą wybrać dane, które chcą zeskrobać, po prostu klikając elementy.

Ma również możliwość automatycznego rozpoznawania paginacji, co ułatwia użytkownikom pobieranie informacji z kilku stron. Aby zeskrobać dane ze stron internetowych z podstawowymi lub skomplikowanymi interfejsami użytkownika, ParseHub obsługuje zarówno przeglądarki headless, jak i headful.

Dodatkowo zapewnia automatyczną rotację adresów IP, co utrudnia stronom internetowym identyfikację i zakazanie działań związanych ze skrobaniem. ParseHub gwarantuje, że dane są wyodrębniane w uporządkowany sposób dzięki rozbudowanym możliwościom formatowania danych, co upraszcza analizę i integrację systemu.

Dodatkowo ParseHub ma inteligentny tryb, który automatycznie rozpoznaje i gromadzi informacje z podobnych stron internetowych. ParseHub może rozpoznawać i gromadzić dane ze stron internetowych o podobnej strukturze, takich jak witryny e-commerce sztuczna inteligencja (AI). Ta funkcja zwiększa dokładność i produktywność, wymagając mniejszego wysiłku i oszczędzając czas.

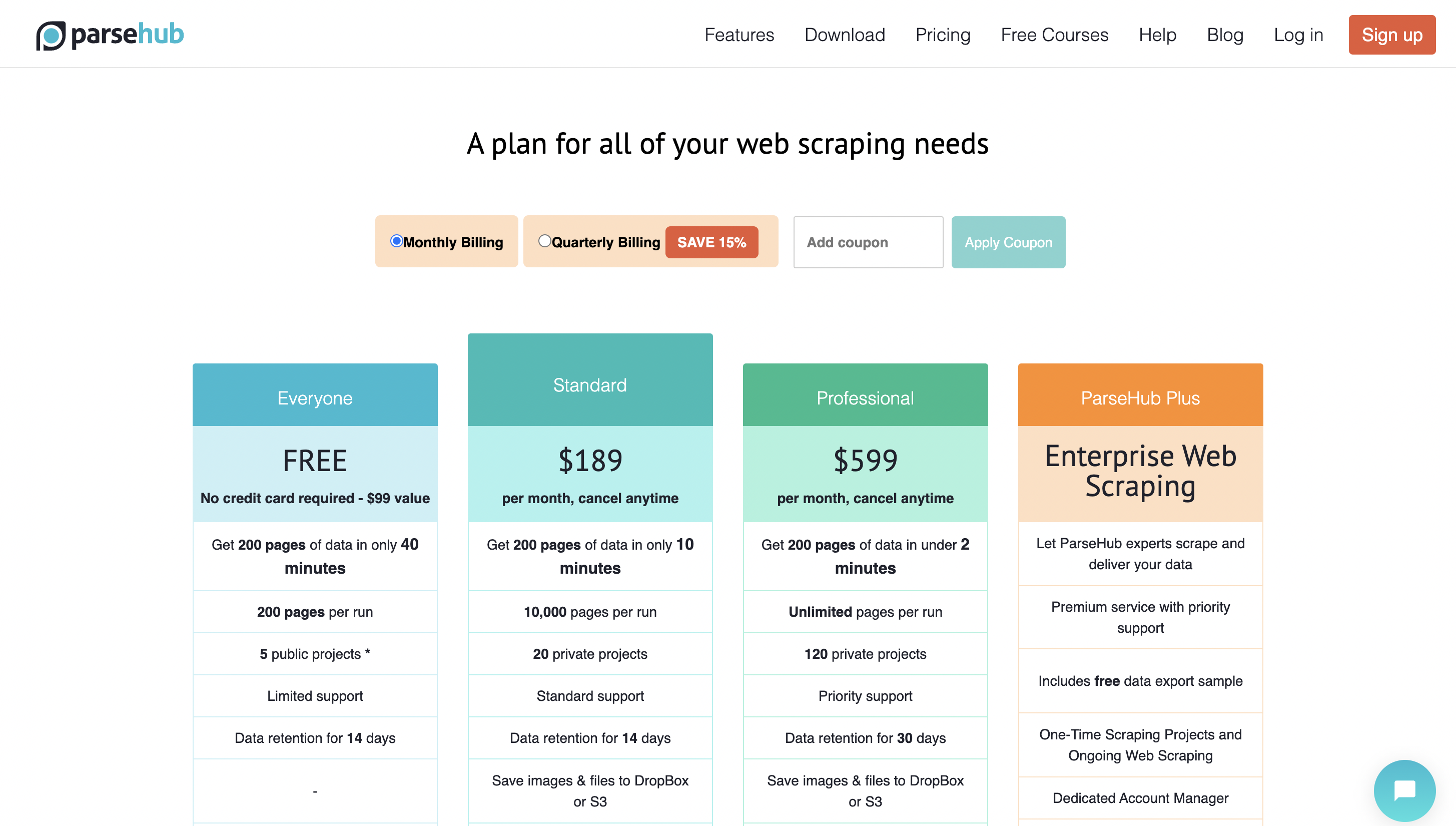

Cennik

Możesz zacząć używać go za darmo, a ceny premium zaczynają się od 189 USD miesięcznie.

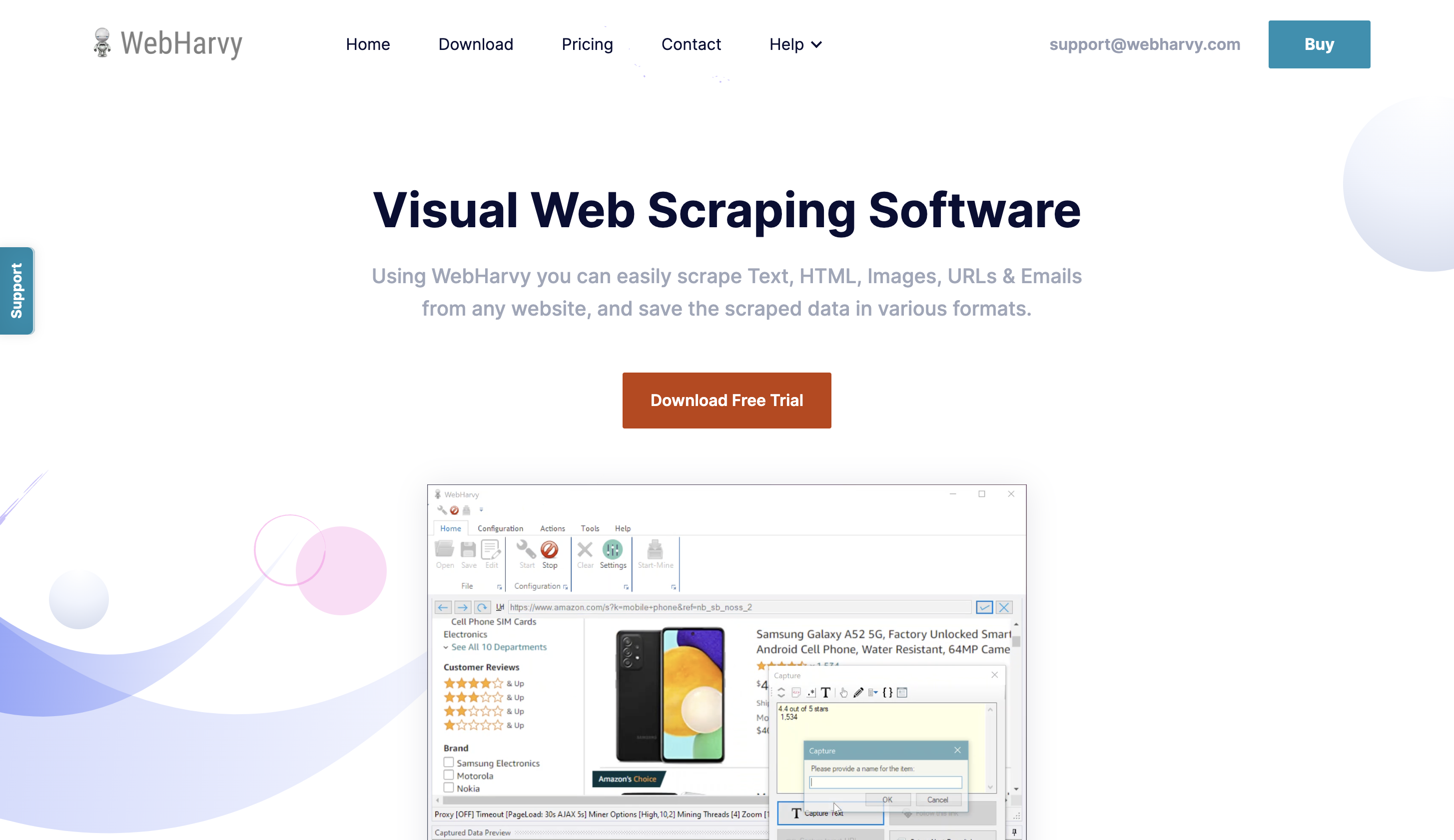

7. WebHarvy

WebHarvy to potężne narzędzie do zbierania danych online, które umożliwia organizacjom szybkie, dokładne i wydajne pobieranie danych ze stron internetowych. Służy do zbierania informacji z wielu stron internetowych, w tym wyszukiwarek, mediów społecznościowych, witryn handlu elektronicznego i katalogów.

Bez wcześniejszego doświadczenia w programowaniu użytkownicy mogą bez wysiłku eksplorować i tworzyć zadania skrobania dzięki przyjaznemu dla użytkownika interfejsowi. Jedną z największych cech WebHarvy jest zdolność do pobierania danych ze stron internetowych obsługiwanych przez JavaScript i AJAX, do których inne narzędzia do skrobania mogą nie mieć dostępu.

Dodatkowo oferuje interfejs Point and Click, który ułatwia wybieranie informacji ze strony internetowej, którą chcesz zeskrobać. WebHarvy ma tryby przeglądania bez głowy i bez głowy. W celu szybszego i skuteczniejszego zbierania danych może działać w trybie bezgłowym.

Tryb Headful jest pomocny podczas pracy ze skomplikowanymi witrynami internetowymi, które wymagają wkładu użytkownika. Może także nawigować między wieloma stronami i wypełniać formularze, co jest przydatne podczas wyodrębniania danych z witryn zawierających wiele stron.

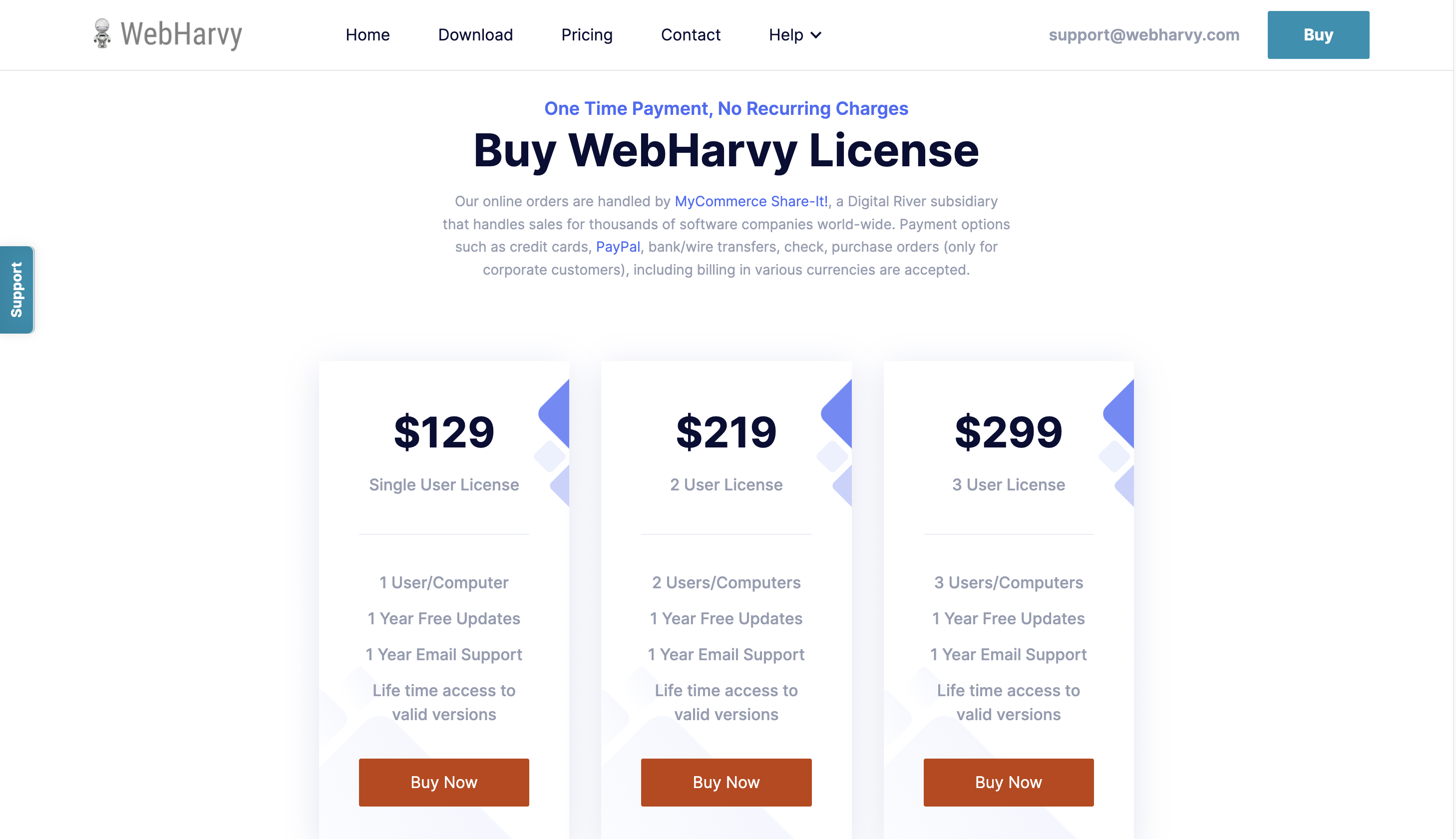

Cennik

Ceny premium zaczynają się od 129 USD za licencję dla jednego użytkownika.

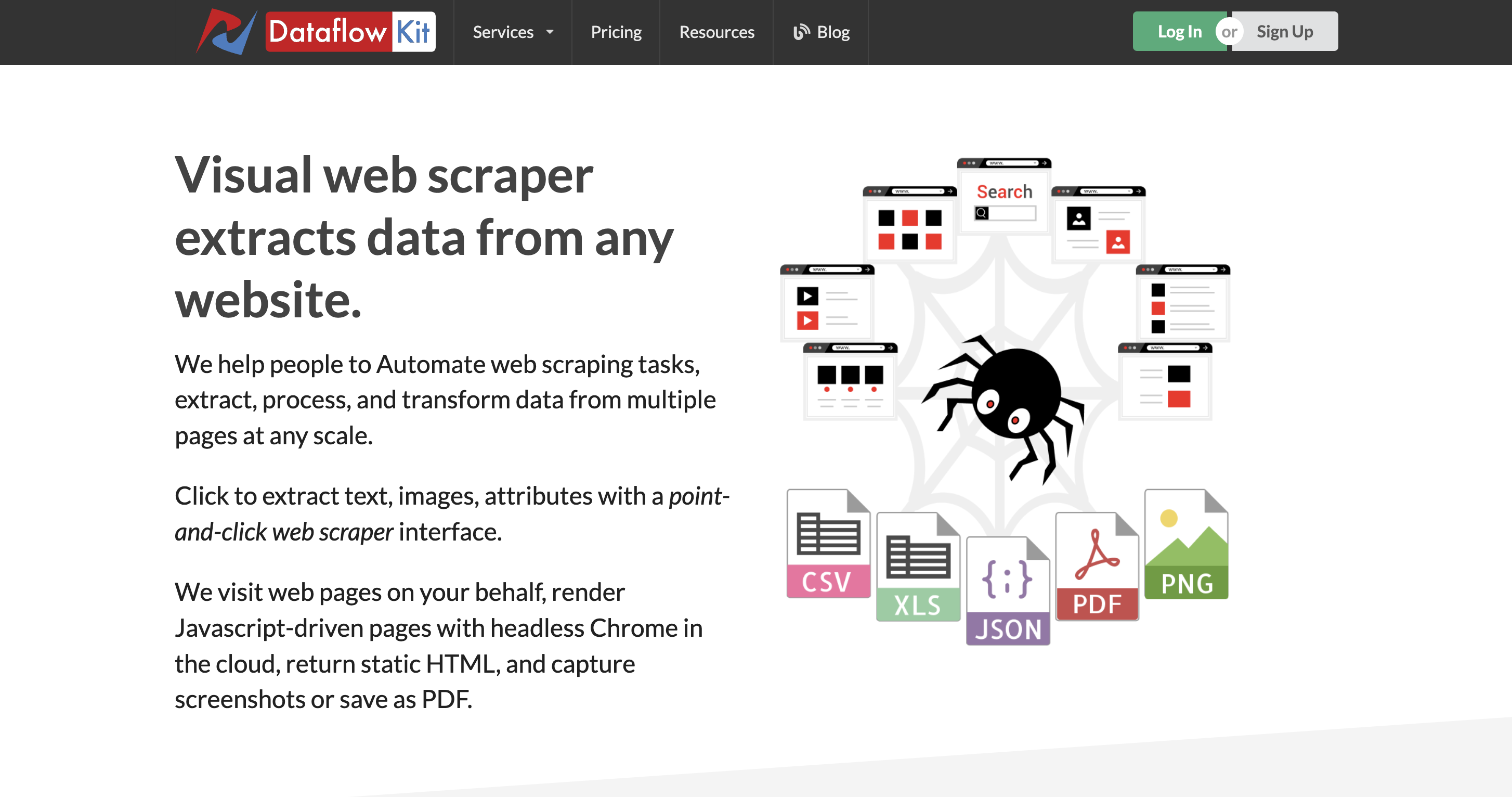

8. Zestaw do przepływu danych

Korzystając z Dataflow Kit, solidnego narzędzia do zbierania danych online, dane można zbierać i analizować z różnych stron internetowych, w tym social networking witryn internetowych, wyszukiwarek, witryn handlu elektronicznego i witryn z wiadomościami. Jedną z jego najlepszych cech jest zdolność do szybkiego i wydajnego zbierania danych ze skomplikowanych, dynamicznych stron internetowych.

Jest idealny do skrobania stron internetowych, do których dostęp przy użyciu innych metod jest trudny, ponieważ jest tak prosty w użyciu. Zarówno przeglądarka headless, jak i headful działają z zestawem Dataflow Kit. Zaawansowane funkcje, takie jak rotacja serwera proxy i agenta użytkownika, unikanie blokowania adresów IP i wykrywanie anty-botów, zapewniają skuteczne skrobanie.

Ponadto oferuje przyjazny dla użytkownika interfejs, który umożliwia klientom tworzenie, planowanie i zarządzanie czynnościami skrobania bez żadnego doświadczenia w programowaniu. W przypadku aplikacji do skrobania stron internetowych na dużą skalę jego efektywny silnik skrobaka jest fantastycznym rozwiązaniem, ponieważ jest zoptymalizowany do szybkiego i efektywnego przetwarzania danych.

Zeskrobane dane można po prostu wyeksportować do różnych formatów, w tym CSV, JSON i XML, co pozwala analizować i wykorzystywać je w dowolny sposób. Co więcej, Dataflow Kit zapewnia różnorodne opcje interfejsów, w tym API i Zapier, które pomagają usprawnić przepływ pracy i zautomatyzować proces ekstrakcji danych.

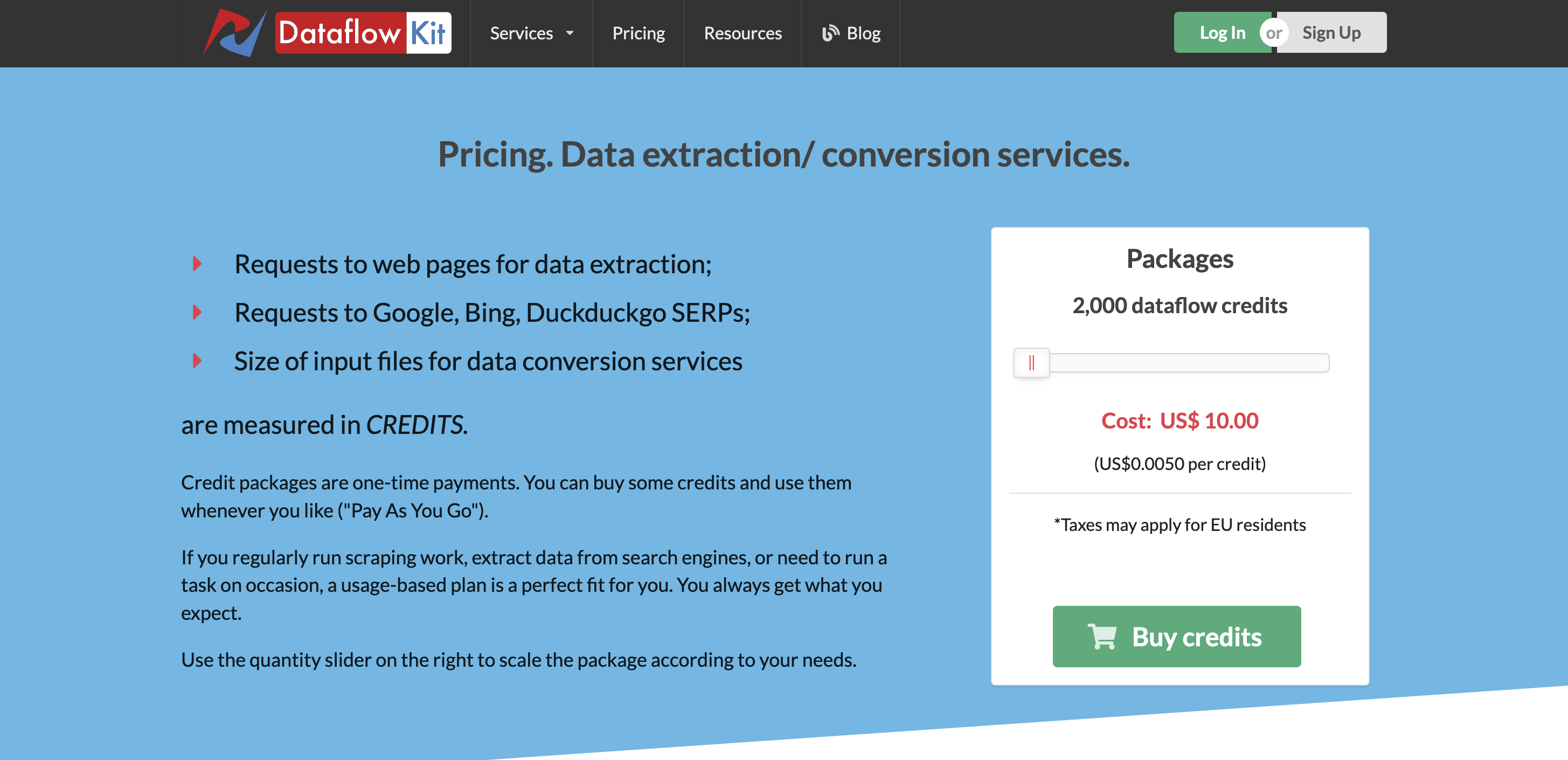

Cennik

Ceny premium zaczynają się od 10 USD za 2000 kredytów na przepływ danych, które możesz wykorzystać zgodnie ze swoimi potrzebami.

9. Import.io

Za pomocą opartego na chmurze narzędzia do skrobania stron internetowych Import.io użytkownicy mogą zbierać dane ze stron internetowych bez żadnego doświadczenia w programowaniu. Prostota użytkowania jest jedną z najbardziej pociągających funkcji Import.io; wszystko, co musisz zrobić, to wskazać i kliknąć, aby znaleźć dane, które chcesz zeskrobać.

Użytkownicy mogą oceniać wyodrębnione dane w czasie rzeczywistym dzięki potężnym funkcjom wizualizacji. Import.io to przeglądarka bezgłowa, która imituje przeglądarkę internetową i łączy się ze stronami internetowymi w taki sam sposób, jak człowiek, ale bez wymogu graficznego interfejsu użytkownika.

Poprawia to efektywność zbierania danych z sieci i umożliwia użytkownikom pobieranie danych z dynamicznych stron internetowych, które wymagają zaangażowania użytkownika w celu wyświetlenia informacji. Jego ekstraktor oparty na sztucznej inteligencji umożliwia użytkownikom wyodrębnianie danych za pomocą zaledwie kilku kliknięć. Ekstraktor może również identyfikować wzorce danych i wyodrębniać porównywalne dane z wielu źródeł.

Użytkownicy mogą zautomatyzować swoje działania związane ze skrobaniem i otrzymywać częste aktualizacje potrzebnych danych dzięki wszechstronnym funkcjom planowania. Import.io ułatwia korzystanie z wyodrębnionych danych w innych aplikacjach, umożliwiając połączenie z popularnymi narzędziami, takimi jak Arkusze Google i Zapier.

Cennik

Ceny nie są podane na stronie internetowej, porozmawiaj o tym z ekspertem.

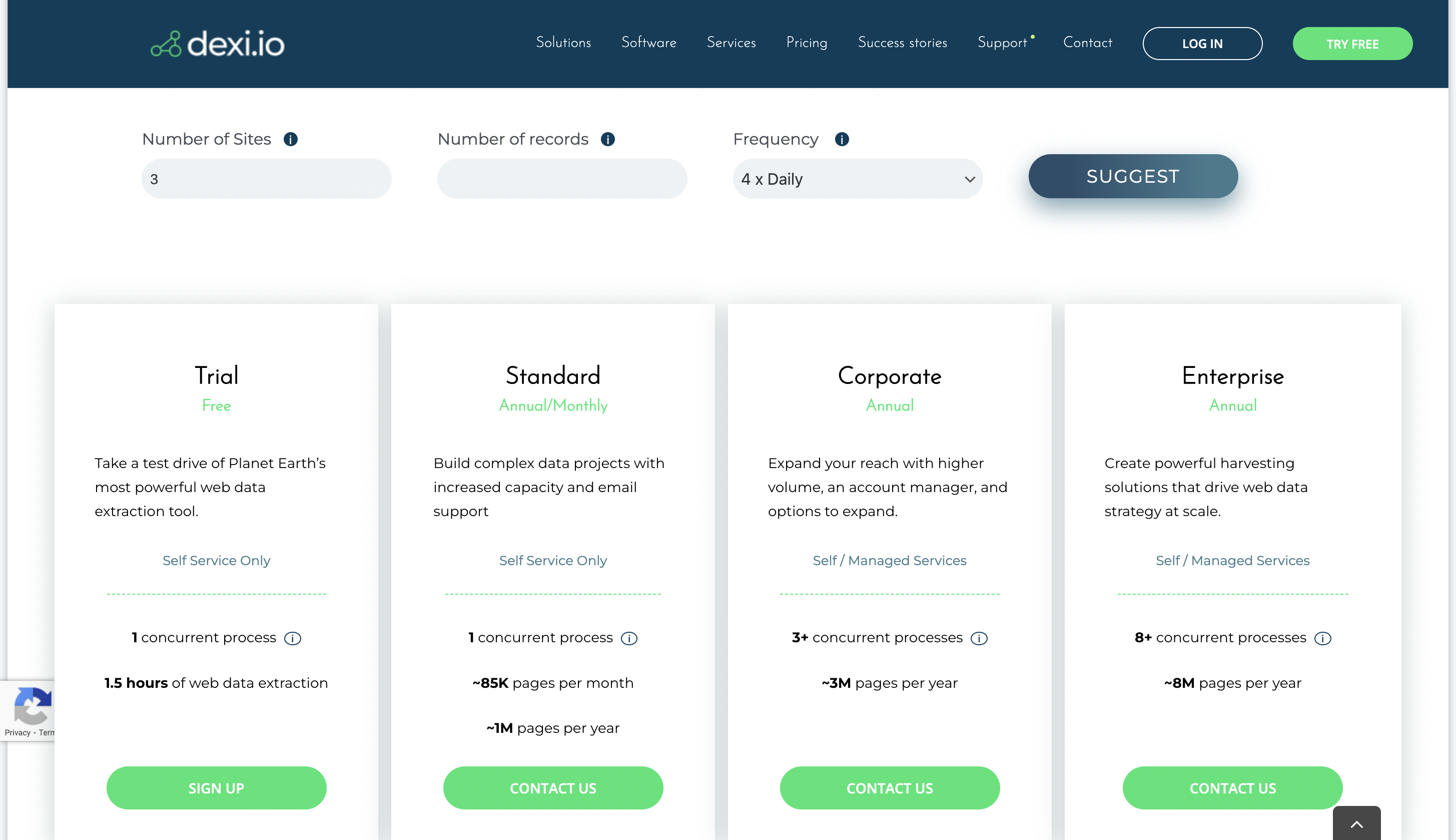

10. Dexi.io

Ekstrakcja danych jest prosta dzięki solidnemu narzędziu do zbierania danych Dexi.io. Możesz zbierać dane ze stron internetowych za pomocą tego narzędzia bez żadnego doświadczenia w programowaniu ze względu na przyjazny dla użytkownika interfejs i zautomatyzowane możliwości.

Jedną z jego najlepszych cech jest zdolność do zbierania i łączenia danych z wielu źródeł, w tym stron internetowych, interfejsów API i baz danych. Dzięki możliwości przetwarzania równoległego Dexi.io możesz szybko i skutecznie usuwać ogromne ilości danych.

Dexi.io oferuje wybór najlepszej alternatywy dla Twoich potrzeb w zakresie skrobania, ponieważ działa zarówno jako przeglądarka bezgłowa, jak i przeglądarka bezgłowa. Podczas gdy opcja przeglądarki headful umożliwia przeglądanie witryny i interakcję z nią tak, jakbyś korzystał z typowej przeglądarki, opcja przeglądarki headless umożliwia pobieranie danych bez wyświetlania strony w przeglądarce.

Ułatwia to rozwiązanie wszelkich problemów ze skrobaniem i dostosowanie procedury skrobania do własnych preferencji. Możesz szybko wyeksportować zebrane dane z Dexi.io w różnych formatach, takich jak CSV, JSON i Excel, w celu dodatkowej analizy lub interakcji z innymi aplikacjami.

Dodatkowo zapewnia niezawodny i bezpieczny hosting w chmurze dla Twoich zeskrobanych danych, gwarantując ich bezpieczeństwo i dostępność.

Cennik

Możesz wypróbować platformę z jej bezpłatnym planem próbnym i skontaktować się z zespołem w celu uzyskania cen.

Wnioski

Podsumowując, na rynku istnieje kilka rozwiązań do skrobania stron internetowych, z których każde ma określone zalety i możliwości. Istnieje wiele alternatyw danych do wyboru, od kompleksowych rozwiązań, takich jak Bright Data i ScrapingBee, po bardziej wyspecjalizowane narzędzia, takie jak Apify i ParseHub.

Systemy te często mają takie możliwości, jak przeglądanie bezgłowe, rotacja adresów IP, fałszowanie agenta użytkownika i pobieranie odcisków palców przeglądarki, aby zwiększyć skuteczność, niezawodność i poufność skrobania online.

Narzędzia Web Scraping zapewniają szybki i prosty dostęp do wielu informacji, niezależnie od tego, czy jesteś właścicielem małej firmy próbującym zbadać swoich konkurentów, badaczem poszukującym danych wspierających Twoją pracę, czy też analitykiem danych szukającym wglądu w zachowania konsumentów .

Prawdopodobieństwo błędów i niespójności można zmniejszyć, a jednocześnie można potencjalnie zaoszczędzić czas i pieniądze, automatyzując proces zbierania danych.

Dodaj komentarz