Spis treści[Ukryć][Pokazać]

Web scraping stał się kluczowym narzędziem w dzisiejszym społeczeństwie opartym na danych, w którym wiedza to potęga. Na pewno słyszałeś o platformach do skrobania stron internetowych opartych na przeglądarce.

Omówmy teraz platformy web scrapingu oparte na przeglądarce. Systemy te oferują łatwy i szybki sposób wydobywania danych ze stron internetowych bez użycia skomplikowanego kodu lub specjalistycznej wiedzy. Zapewniają proste narzędzia i przyjazne dla użytkownika interfejsy, które upraszczają proces skrobania.

Piękno systemów opartych na przeglądarce polega na tym, że tworzą skrobanie sieci dostępne dla każdego, od początkujących po specjalistów. Rozwiązania oparte na przeglądarce sprawiają, że scraping online jest dostępny dla wszystkich, niezależnie od tego, czy są to badacze analizujący wzorce, właściciele firm próbujący obserwować rywali, czy osoby poszukujące informacji.

Istnieje kilka zalet stosowania rozwiązań opartych na przeglądarce do skrobania stron internetowych.

Przede wszystkim eliminują wymóg wiedzy technicznej, ułatwiając każdemu pobieranie danych ze stron internetowych. Systemy te często obejmują funkcję „wskaż i kliknij” oraz grafikę interfejsy użytkownika, umożliwiając użytkownikom łatwą interakcję ze stronami internetowymi i wybór danych, które chcą wyodrębnić.

Proces skrobania jest usprawniony, a cenny czas oszczędzany dzięki dostępności rozwiązań opartych na przeglądarkach, takich jak sprawdzanie poprawności danych, automatyzacja i planowanie. Często dysponują też silnymi sieciami proxy, co gwarantuje niezawodne i bezpieczne wydobywanie danych przy jednoczesnym pokonywaniu ograniczeń lub blokad systemów.

Możesz poradzić sobie z trudnymi zadaniami skrobania za pomocą technologii opartych na przeglądarce, wyodrębniać dane z dynamicznych stron internetowych i przekształcać uzyskane dane w przydatne spostrzeżenia. Uzyskując dostęp do bogactwa danych dostępnych online, umożliwiają organizacjom, naukowcom i ludziom pozostawanie w czołówce świata opartego na danych. W tym artykule przyjrzymy się najlepszym platformom do skrobania stron internetowych opartym na przeglądarce.

1. Jasne dane

Bright Data to jasna gwiazda wśród przeglądarkowych narzędzi do skrobania stron internetowych, oferując pełną odpowiedź na potrzeby klientów w zakresie skrobania sieci. Korzystając z metody opartej na przeglądarce, Bright Data umożliwia przeglądanie stron internetowych z dynamiczną zawartością, renderowaniem JavaScript i skomplikowaną architekturą strony, aby zapewnić gromadzenie wszystkich ważnych danych.

Dzięki przeglądarce Scraping Browser firmy Bright Data możesz bez wysiłku przeglądać i nawigować po docelowych witrynach internetowych, podczas gdy Bright Data zarządza całym serwerem proxy i odblokowuje infrastrukturę w Twoim imieniu. Moc funkcji automatycznego odblokowywania Web Unlocker jest zintegrowana z Scraping Browser, zautomatyzowaną przeglądarką zaprojektowaną do zbierania danych.

Każdy projekt zbierania danych, który wymaga skalowalności, przeglądarek i automatycznej kontroli wszystkich działań związanych z odblokowywaniem witryny, jest idealny do jego wykorzystania. Staje się elastycznym narzędziem do automatyzacji operacji i pobierania danych ze stron internetowych za pomocą Scraping Browser, Puppeteer i Playwright API.

Podczas pracy z ogromnymi ilościami danych ta funkcja jest niezwykle przydatna. Wreszcie, Bright Data wprowadziło metody zapobiegające blokowaniu, które pozwalają ominąć takie rzeczy, jak CAPTCHA i inne rodzaje blokowania witryn.

Jego rozległa sieć proxy, która obejmuje ponad 72 miliony adresów IP użytkowników domowych i 2 miliony adresów IP urządzeń mobilnych z całego świata i oferuje niezrównany zasięg i niezawodność podczas przeglądania stron internetowych, jest jedną z jego najbardziej charakterystycznych cech.

Ponadto jest kompatybilny z wieloma języki programowania, w tym Python, Node.js i Java, a także szeroko stosowane systemy przechowywania i analizy danych, takie jak AWS, Google Cloud i BigQuery. Z Bright Data jako sprzymierzeńcem w zbieraniu danych, możesz bezpiecznie i skutecznie usuwać oraz łatwo uwalniać potencjał danych.

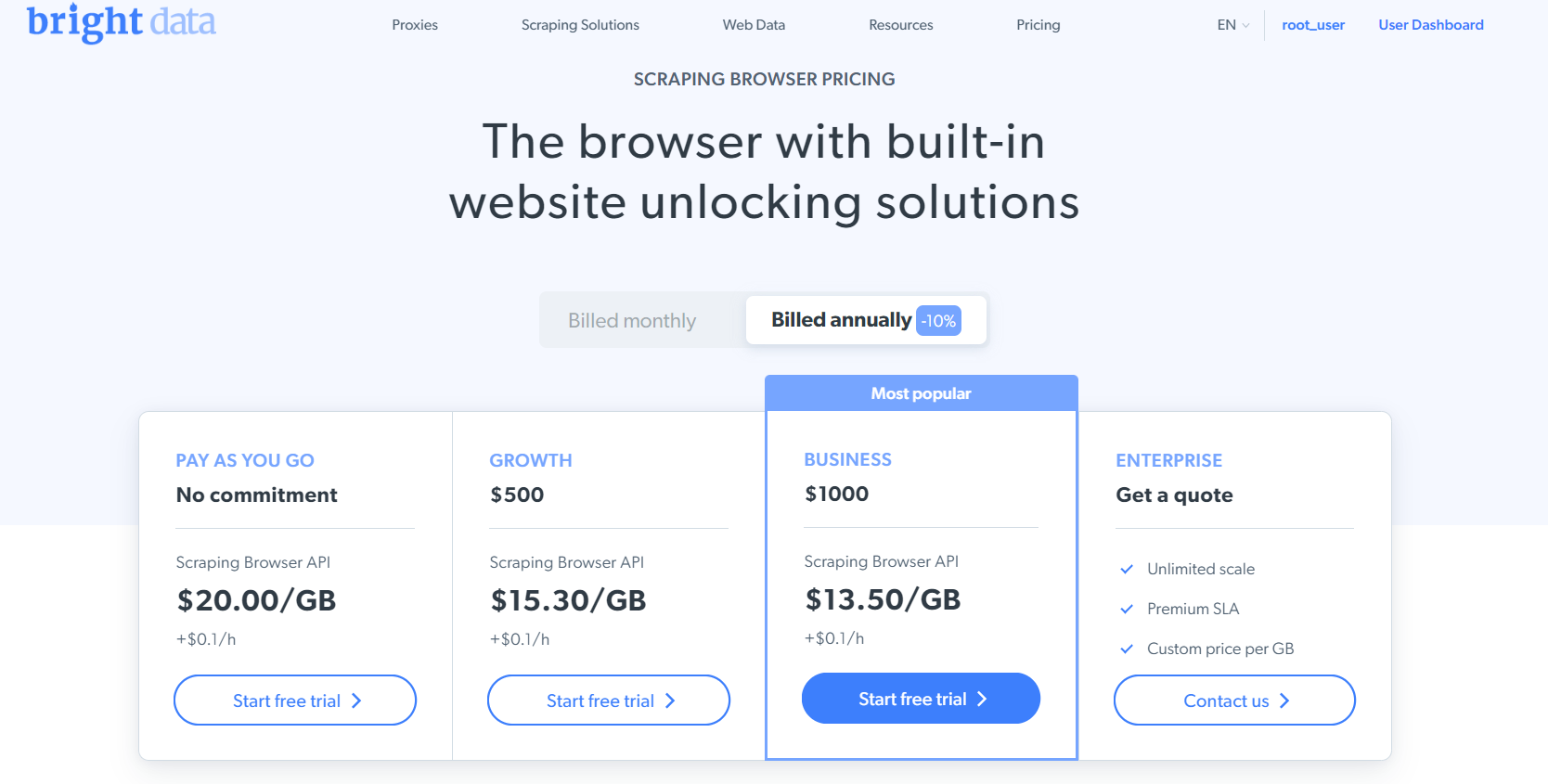

Cennik

Połączenia Ceny zaczynają się od 13.50 USD/GB.

2. Ośmiornica

Octoparse to idealne narzędzie oparte na przeglądarce, które zostało stworzone wyłącznie do skrobania stron internetowych. Nawet osoby bez umiejętności kodowania mogą z nim płynnie skrobać.

Możesz łatwo zbierać dane ze stron internetowych za pomocą przyjaznego dla użytkownika narzędzia do wizualnego skrobania. Nie ma potrzeby uczenia się skomplikowanego programowania ani języków skryptowych. Umożliwiając bezpośrednią interakcję ze stroną internetową i wybór fragmentów danych, które chcesz wyodrębnić, Octoparse usprawnia procedurę.

Jest to podobne do otrzymania wirtualnej dłoni, która pomoże Ci przeszukiwać sieć i znaleźć potrzebne informacje. Jednak Octoparse nie tylko wyodrębnia dane. Wyróżnia się również możliwościami transformacji i czyszczenia danych.

Gdy dane zostaną zeskrobane, Octoparse daje możliwość ich sformatowania i ulepszenia zgodnie z Twoimi unikalnymi potrzebami. Aby uczynić dane bardziej wartościowymi i użytecznymi, możesz oczyścić niejasne dane, wyeliminować duplikaty, a nawet przeprowadzić skomplikowane przekształcenia.

Dzięki Octoparse możesz zarządzać każdym etapem cyklu życia danych, w tym ekstrakcją, czyszczeniem i transformacją, a wszystko to za pomocą prostego interfejsu opartego na przeglądarce. Bez potrzeby posiadania wiedzy technicznej możesz wejść do świata web scrapingu z pomocą Octoparse, odkrywając bezcenne spostrzeżenia i wykorzystując moc danych.

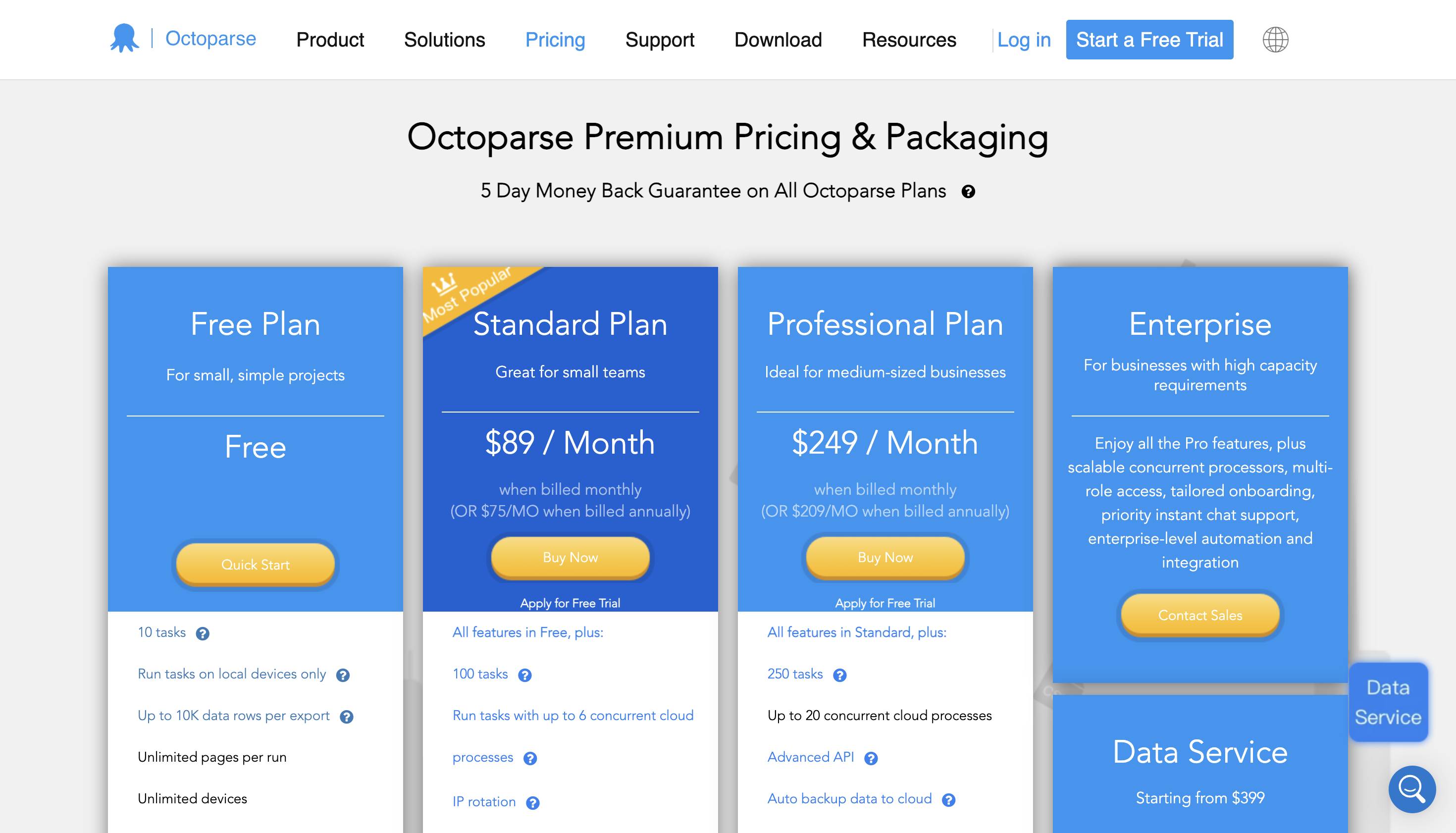

Cennik

Możesz zacząć używać go za darmo, a ceny premium zaczynają się od 89 USD miesięcznie.

3. ParseHub

ParseHub to platforma, która może obsłużyć wszystkie Twoje potrzeby w zakresie skrobania i jest niezwykle elastyczna i przyjazna dla użytkownika. ParseHub zapewni Ci wsparcie, niezależnie od tego, czy jesteś nowicjuszem, czy ekspertem w dziedzinie danych. Unikalną cechą ParseHub jest prosty interfejs typu „wskaż i kliknij”, który znacznie ułatwia proces zbierania danych z dynamicznych stron internetowych.

Złożone strony internetowe można przeglądać bez bycia ekspertem w programowaniu. Aby wyodrębnić dane, po prostu wybierz żądane dane, a ParseHub zajmie się resztą. To tak, jakby mieć własnego osobistego pomocnika do ekstrakcji danych. Ale ParseHub oferuje bardziej wyrafinowane opcje, które przeniosą Twoje skrobanie na wyższy poziom.

Możesz zautomatyzować proces zgarniania, korzystając z zaplanowanego zgarniania, które umożliwia ParseHub pobieranie danych w określonych odstępach czasu, zapewniając zawsze najnowsze informacje.

Ponadto ParseHub oferuje bezproblemową łączność API, ułatwiając włączanie zeskrobanych danych do własnych programów lub systemów. Jest to potężna technika optymalizacji wykorzystania wyodrębnionych danych i usprawnienia przepływu pracy z danymi.

Przeglądanie stron internetowych staje się zabawnym i skutecznym procesem dzięki przyjaznemu dla użytkownika interfejsowi ParseHub i potężnym funkcjom, które łatwo ujawniają przydatne informacje z dynamicznych stron internetowych.

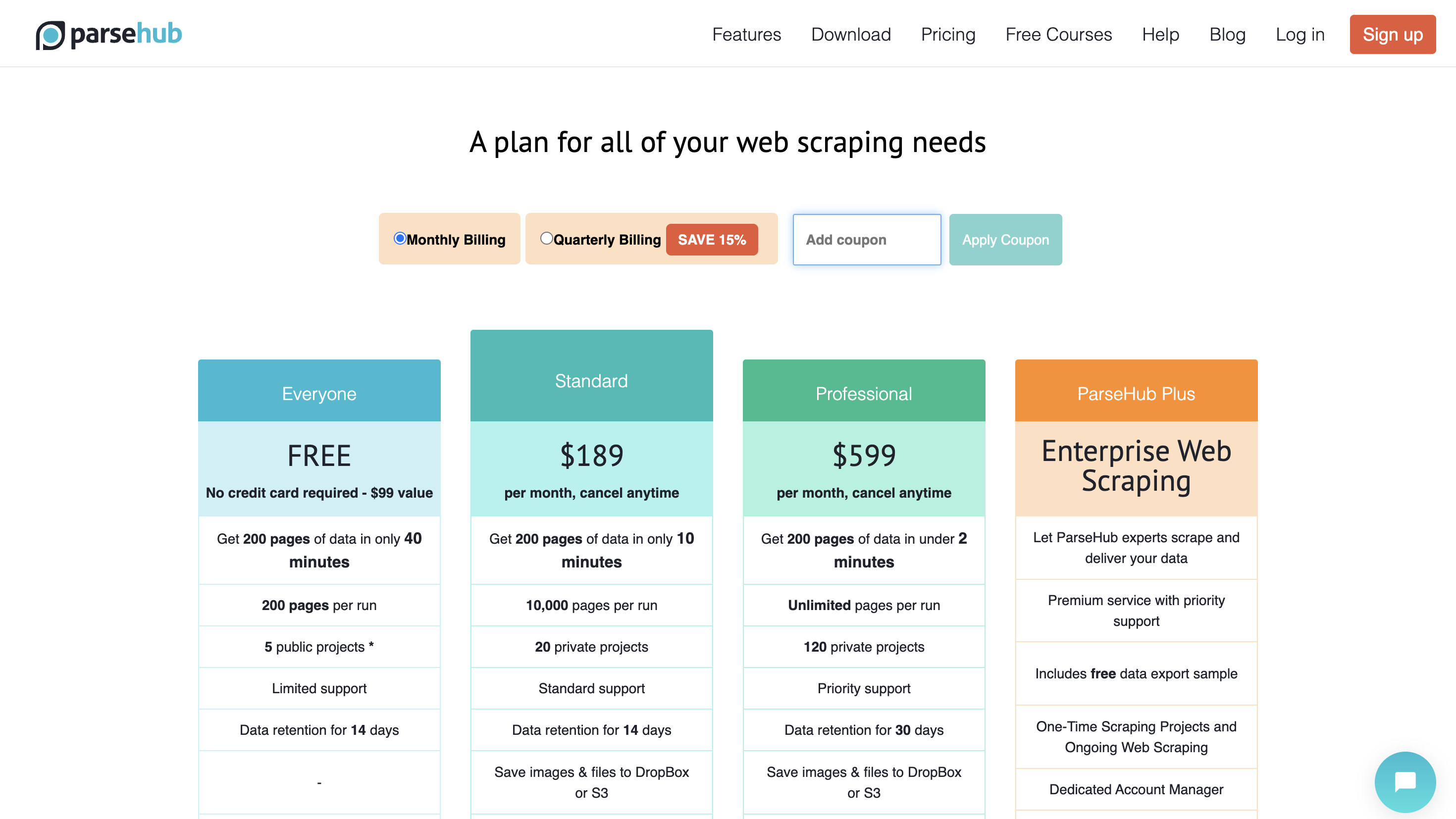

Cennik

Możesz zacząć używać go za darmo, a ceny premium zaczynają się od 189 USD miesięcznie.

4. Webz.io

Webz.io – Big Web Data to niezwykła technologia oparta na przeglądarce, która koncentruje się na wydobywaniu i monitorowaniu danych internetowych. Możesz łatwo uzyskać wnikliwe dane online, korzystając z Webz.io, aby trzymać rękę na pulsie sieci. Ta platforma to informacyjna kopalnia złota, zapewniająca dogłębne relacje z wiadomościami, artykułami na blogach i rozmowami online na różne tematy.

Webz.io zapewnia dostęp do najnowszych i istotnych informacji z całej sieci, niezależnie od Twojej działalności lub wiedzy. Można to porównać do dostępu do ogromnej biblioteki wiedzy. Jednak Webz.io wykracza poza zasięg danych.

Ponadto oferuje płynną łączność API, co ułatwia włączenie wyodrębnionych danych do własnych programów lub systemów. Dzięki tej możliwości istnieją niezliczone możliwości wykorzystania danych w sposób najlepiej odpowiadający Twoim potrzebom.

Połączenie API Webz.io upraszcza proces integracji danych, niezależnie od tego, czy tworzysz niestandardowy pulpit nawigacyjny, przeprowadzasz badania rynku, czy tworzysz rozwiązanie oparte na sztucznej inteligencji.

Webz.io – Przyjazny dla użytkownika interfejs Big online Data oraz zaawansowane możliwości monitorowania i ekstrakcji danych zapewniają możliwość wyprzedzania konkurencji i pełnego wykorzystania danych online do pracy w firmie lub badań.

Cennik

Skontaktuj się ze sprzedawcą, aby uzyskać jego wycenę.

5. Import.io

Import.io to wspaniałe narzędzie oparte na przeglądarce, które dzięki prostemu interfejsowi typu „wskaż i kliknij” eliminuje trudności ze skrobania online. Zgarnianie sieci jest proste dzięki import.io, niezależnie od Twojego poziomu wiedzy na temat danych. Możesz łatwo wyodrębnić dane ze stron internetowych za pomocą zaledwie kilku kliknięć i bez żadnego doświadczenia technicznego.

To tak, jakby mieć magiczną różdżkę do zbierania potrzebnych danych z ogromnej sieci. Ale import.io idzie dalej. Dzięki zaawansowanej technologii indeksowania wykracza poza to.

Import.io może teraz wykrywać struktury danych i wzorców na stronach internetowych, co zwiększa efektywność i precyzję procesu internetowego scrapingu. To tak, jakby mieć detektywa danych, który zna układ strony internetowej i może szybko i łatwo zebrać odpowiednie dane.

Zeskrobane dane można również eksportować do różnych formatów i programów dzięki rozbudowanym możliwościom integracji danych import.io. Import.io może dostarczyć dane w formatach CSV, Excel lub JSON, które chcesz. Pobrane dane można łatwo włączyć do baz danych, programów analitycznych, a nawet aplikacji komercyjnych.

Przeszukiwanie sieci stało się proste dzięki import.io, umożliwiając uzyskanie wnikliwych informacji i optymalizację operacji opartych na danych.

Cennik

Możesz korzystać z platformy z 14-dniowym bezpłatnym okresem próbnym, a ceny premium zaczynają się od 199 USD miesięcznie.

6. Dexi.io

Dexi.io to innowacyjna platforma, której można używać w przeglądarce i która zapewnia pełen zakres opcji web scrapingu. Dzięki prostemu edytorowi wizualnemu i interfejsowi użytkownika typu „wskaż i kliknij”, Dexi.io sprawia, że przeglądanie stron internetowych jest dostępne dla użytkowników na każdym poziomie doświadczenia technicznego. Aby opanować złożoność web scrapingu, nie musisz być geniuszem programowania.

Dexi.io ułatwia tworzenie botów zgarniających, które szybko i precyzyjnie zbierają dane ze stron internetowych. To tak, jakby mieć wirtualnego asystenta, który zajmuje się wszystkimi pracochłonnymi zadaniami.

Dexi.io wykracza poza prostą ekstrakcję danych. Wzbogacanie danych, jedna z bardziej zaawansowanych funkcji, umożliwia ulepszenie pobieranych danych poprzez dodanie większej liczby szczegółów z innych źródeł. W rezultacie Twoja analiza będzie bardziej wnikliwa i kompletna.

Dodatkowo możesz eksportować dane, które zostały zeskrobane za pomocą Dexi.io w różnych formatach, w tym CSV, Excel lub JSON. Dexi.io ułatwia uzyskanie danych potrzebnych do integracji z innymi systemami lub do dalszych dogłębnych badań.

Dexi.io zapewnia ponadto łączność API, umożliwiając szybkie połączenie i włączenie danych, które zostały zeskrobane do własnego oprogramowania lub systemów. Możesz zautomatyzować procedury i zmaksymalizować wykorzystanie odzyskanych danych, ponieważ zapewnia to płynny przepływ pracy.

Cennik

Możesz wypróbować platformę z jej bezpłatnym planem próbnym i skontaktować się ze sprzedawcą w celu uzyskania cen premium.

7. Mozenda

Mozenda to najwyższej klasy narzędzie do skrobania stron internetowych, które zapewnia opcje zautomatyzowanego i opartego na przeglądarce. Przyjazny dla użytkownika interfejs Mozendy i solidne możliwości sprawiają, że proces pobierania danych ze stron internetowych jest prostszy.

Korzystając z interfejsu użytkownika typu „wskaż i kliknij”, Mozenda ułatwia nawigację po stronach internetowych. Nie mając wiedzy na temat kodowania? nie problem. Niezależnie od tego, czy potrzebujesz recenzji klientów, szczegółów produktu, czy jakichkolwiek innych danych, Mozenda daje Ci możliwość szybkiego wybrania elementów danych, które chcesz wyodrębnić.

To tak, jakby mieć wirtualnego asystenta, który jest świadomy twoich wymagań dotyczących skrobania. Mozenda na tym jednak nie poprzestaje. Możesz zautomatyzować proces skrobania i wyodrębniać dane w określonych odstępach czasu dzięki harmonogramowi, jednej z bardziej wyrafinowanych możliwości.

Mozenda zapewnia Ci ochronę, niezależnie od tego, czy potrzebujesz codziennych, tygodniowych czy miesięcznych aktualizacji. Ponadto Mozenda oferuje bezproblemowe opcje eksportu danych, które pozwalają zapisywać zebrane dane w kilku typach plików, w tym Excel, CSV lub XML. Pobrane dane można łatwo włączyć do programów analitycznych lub baz danych.

Zeskrobane dane można dodatkowo połączyć i zintegrować z własnymi aplikacjami lub systemami dzięki usłudze integracji API Mozendy. Oferuje wydajny przepływ pracy, umożliwiając automatyzację procedur i maksymalizację wykorzystania uzyskanych danych.

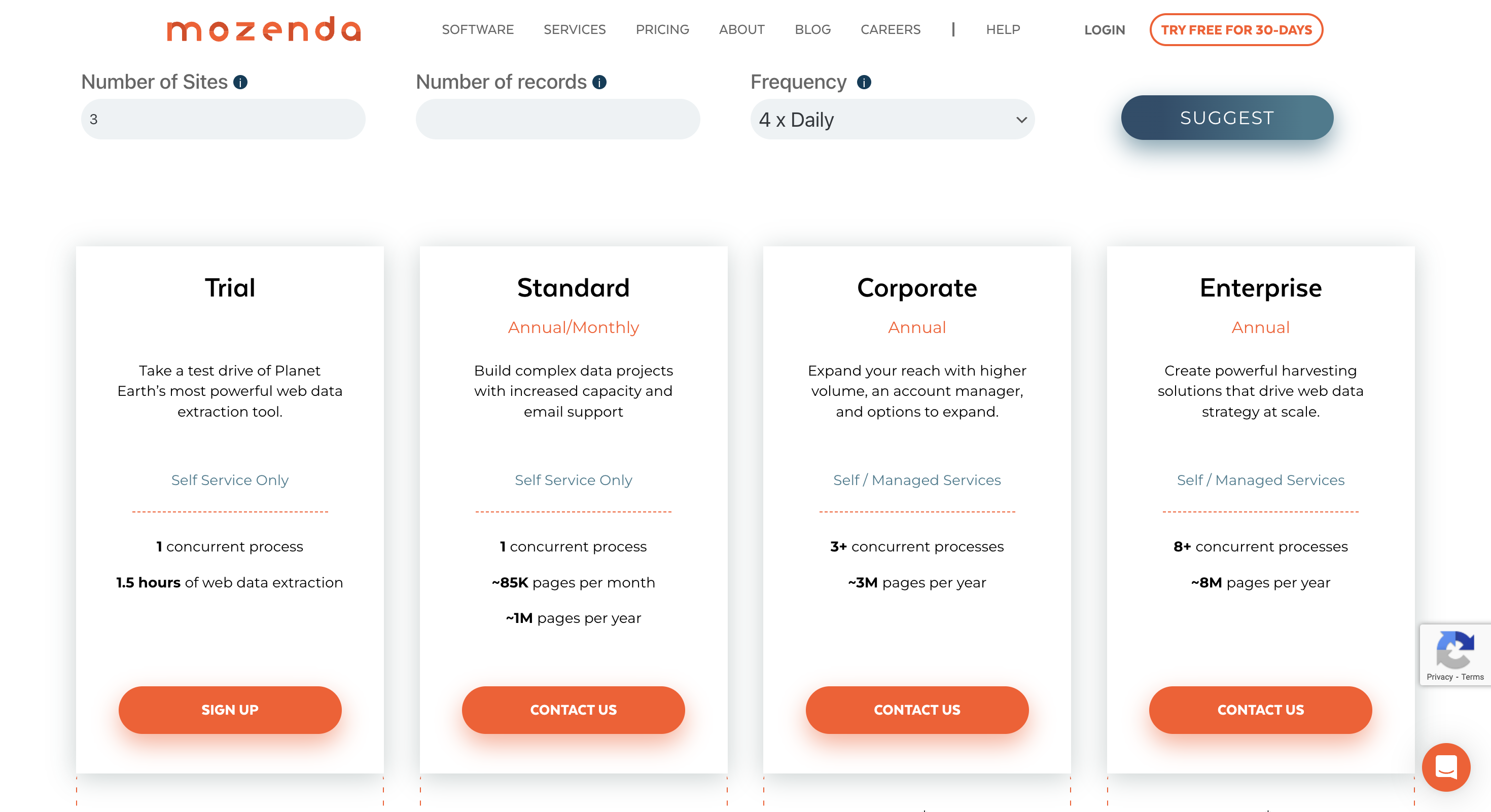

Cennik

Możesz wypróbować platformę z jej bezpłatnym planem próbnym i skontaktować się ze sprzedawcą w celu uzyskania cen premium.

8. Skrobanie pszczół

O wiele łatwiej jest zbierać dane ze stron internetowych za pomocą ScrapingBee, wspaniałej aplikacji do skrobania stron internetowych opartej na przeglądarce. Wykorzystaj moc web scrapingu dzięki ScrapingBee i uniknij obciążenia związanego z zarządzaniem infrastrukturą.

Możesz łatwo przesyłać zapytania i uzyskiwać dane, które zostały zeskrobane dzięki intuicyjnemu interfejsowi API. Interfejs API ScrapingBee ułatwia wyodrębnianie wszelkiego rodzaju danych, w tym informacji o produktach, artykułów z wiadomościami i innych typów.

Niemniej jednak ScrapingBee idzie dalej. Posiada funkcje, które wykraczają poza proste skrobanie sieci. Ma możliwości renderowania JavaScript, które pozwalają zeskrobać informacje ze stron internetowych, które głównie polegają na JavaScript do prezentacji treści. Daje to pewność, że nawet z dynamicznych stron internetowych można wejść i pobrać całą zawartość.

Dodatkowo ScrapingBee zajmuje się kodami CAPTCHA za Ciebie, oszczędzając Ci czasochłonnego zadania związanego z pokonywaniem irytujących przeszkód.

Automatycznie rozpoznaje CAPTCHA, dzięki czemu możesz skoncentrować się na uzyskaniu potrzebnych informacji. Dodatkowo ScrapingBee oferuje rotatory IP, aby Twoje operacje scrapingu były prywatne i niezablokowane przez strony internetowe. Zmienia adresy IP, utrudniając stronom internetowym monitorowanie Cię i nakładanie ograniczeń dostępu.

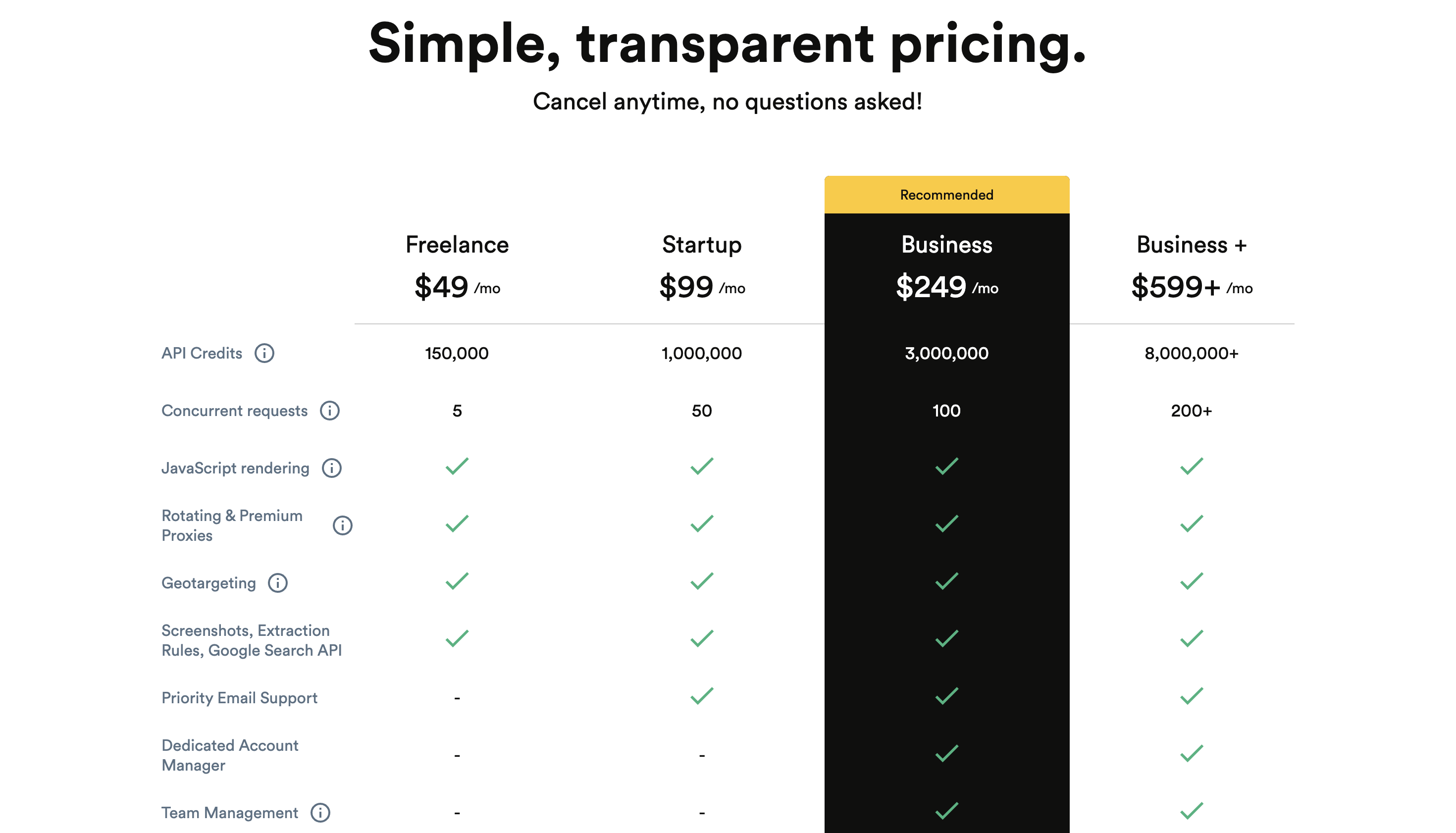

Cennik

Ceny premium zaczynają się od 49 USD miesięcznie.

9. Apify

Apify to solidna platforma oparta na chmurze, która może być używana w przeglądarkach i posiada funkcje skrobania sieci i automatyzacji. Wykorzystanie Apify pozwoli Ci w łatwy sposób zautomatyzować czasochłonne procedury i szybko wyodrębnić dane ze stron internetowych, dając Ci więcej czasu na inne ważne prace.

Bez potrzeby używania jakiegokolwiek kodu, za pomocą edytora wizualnego Apify można szybko tworzyć wyrafinowane sytuacje skrobania. Witryna jest prosta w użyciu i ma interfejs typu „przeciągnij i upuść”, który ułatwia wybieranie danych, które chcesz zeskrobać.

W architekturze Apify zadania skrobania można następnie skonfigurować i wykonywać jako usługi bezserwerowe. Utrzymanie infrastruktury i serwerów nie będzie już dla Ciebie problemem.

Apify zajmie się wszystkim. Ale co, jeśli nie jesteś szczególnie uzdolniony w skrobaniu? Bez wątpienia żaden problem. Gotowe aktory zgarniające, które są zasadniczo skonfigurowanymi i gotowymi do użycia procesami zgarniania, są dostępne do kupienia na rynku Apify.

Dla szeregu stron internetowych i przypadków użycia, takich jak platformy społecznościowe i witryn e-commerce, rynek oferuje setki podmiotów. Dzięki temu możesz skorzystać z gotowych rozwiązań, co pozwoli Ci zaoszczędzić czas i wysiłek.

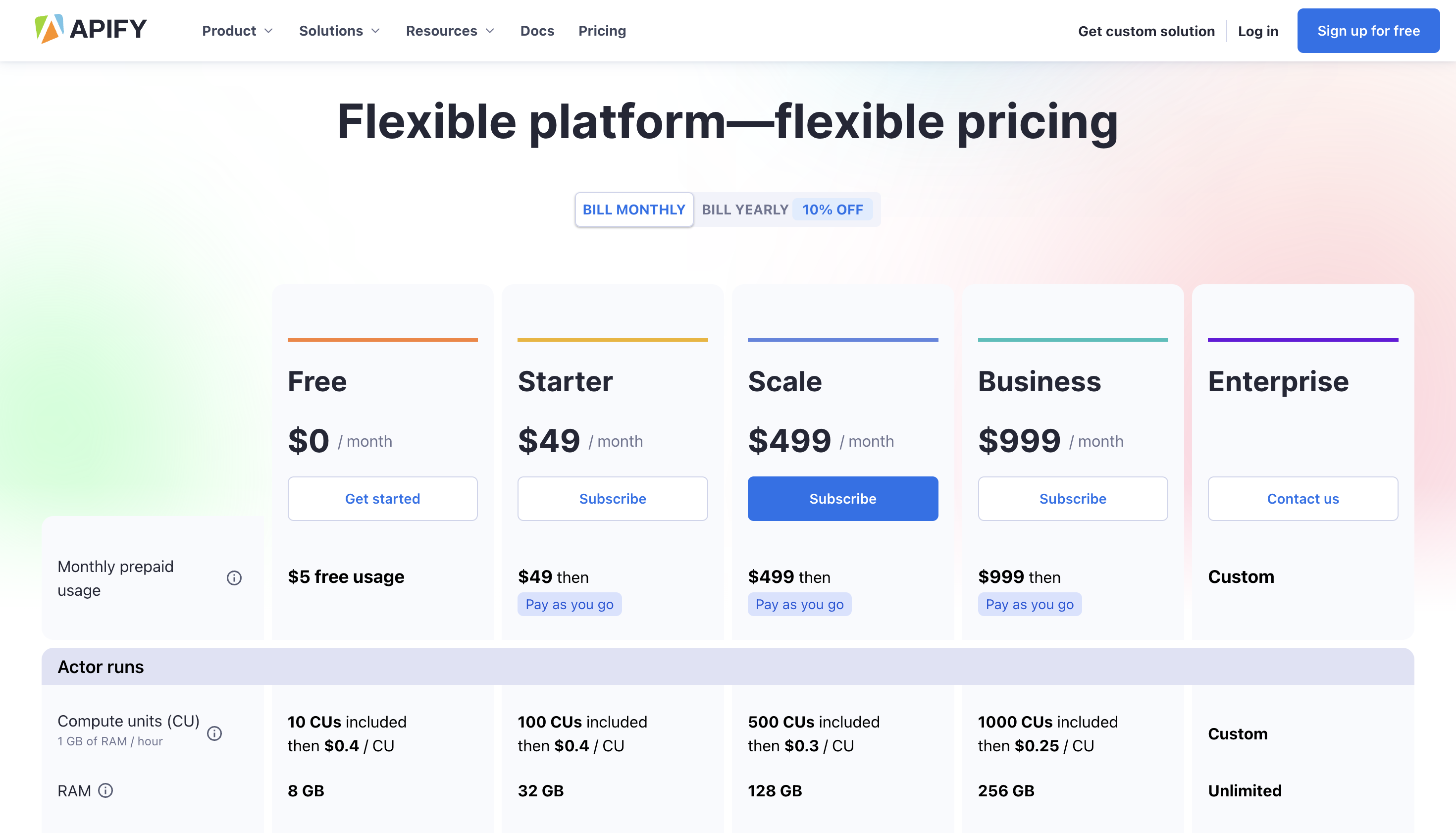

Cennik

Możesz zacząć używać go za darmo, a ceny premium zaczynają się od 49 USD miesięcznie.

10. Skrobanie Pies

Scrapingdog to potężne oprogramowanie do skrobania stron internetowych oparte na przeglądarce. Bez skomplikowanego kodu lub konfiguracji infrastruktury możesz szybko i skutecznie zbierać dane ze stron internetowych za pomocą Scrapingdog. To tak, jakby mieć do dyspozycji potężną skrobaczkę.

Kluczowe funkcje Scrapingdog, które sprawiają, że skrobanie sieci jest proste, odróżniają go od konkurencji. Pierwszą korzyścią jest to, że zapewnia przyjazny dla użytkownika interfejs, który ułatwia przeglądanie stron internetowych i wybieranie danych do wyodrębnienia.

Niezależnie od tego, jakie informacje potrzebujesz zeskrobać — informacje o produktach, wiadomości lub cokolwiek innego — Scrapingdog zapewni Ci to. Po drugie, Scrapingdog oferuje sprytne renderowanie JavaScript, co pozwala na pobieranie informacji ze stron internetowych, które głównie polegają na JavaScript do wyświetlania treści.

Daje to pewność, że nawet z dynamicznych stron internetowych można uzyskać dostęp do całej zawartości i pobrać ją. Dodatkowo Scrapingdog zapewnia obsługę CAPTCHA, dbając o te irytujące przeszkody.

Automatycznie odpowiada na CAPTCHA, oszczędzając czas i wysiłek. Ponadto Scrapingdog wykorzystuje rotację adresów IP, która obejmuje zmianę adresów IP, aby uniknąć blokowania przez strony internetowe operacji skrobania. W rezultacie skrobanie pójdzie gładko.

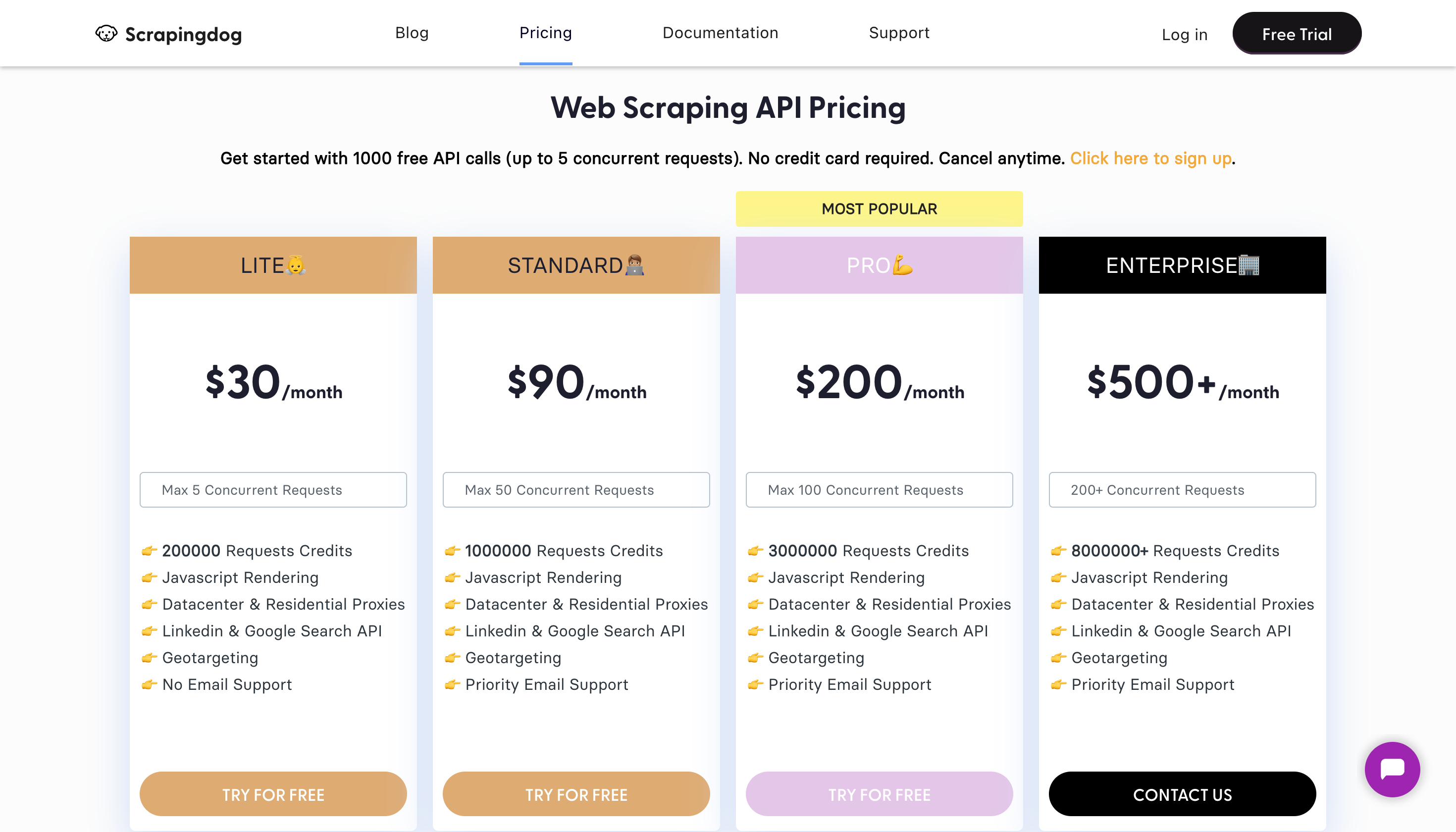

Cennik

Ceny premium zaczynają się od 30 USD miesięcznie.

11. bajt

Byteline to doskonałe narzędzie oparte na przeglądarce, które zostało stworzone wyłącznie do skrobania stron internetowych. Bez długich skryptów lub skomplikowanej konfiguracji możesz szybko i łatwo pobierać dane ze stron internetowych za pomocą Byteline.

Zapewnia przyjazny dla użytkownika interfejs, który ułatwia przeglądanie stron internetowych i wybieranie danych, które chcesz zeskrobać. Byteline może pomóc w uzyskaniu wszelkiego rodzaju danych, w tym szczegółów cenowych, opinii klientów i innych informacji.

Dynamiczne strony internetowe są obsługiwane z łatwością. Możesz wydobywać dane ze stron internetowych, które w dużej mierze opierają się na zawartości dynamicznej, ponieważ obsługują one renderowanie JavaScript za pomocą wyrafinowanych metod. Oznacza to, że możesz uzyskać dostęp do najnowszych dostępnych danych i zeskrobać je.

Co więcej, Byteline ma potężne funkcje proxy i rotacji adresów IP, które pozwalają na szerokie zbieranie danych bez narażania się na jakiekolwiek filtry. Zapewnia to, że operacje scrapingu będą kontynuowane bez przeszkód iw całkowitej anonimowości. Dodatkowo Byteline zapewnia opcje eksportu danych, które pozwalają zapisać pobrane dane w innych formatach, takich jak CSV lub Excel, w celu dodatkowej analizy lub integracji systemu.

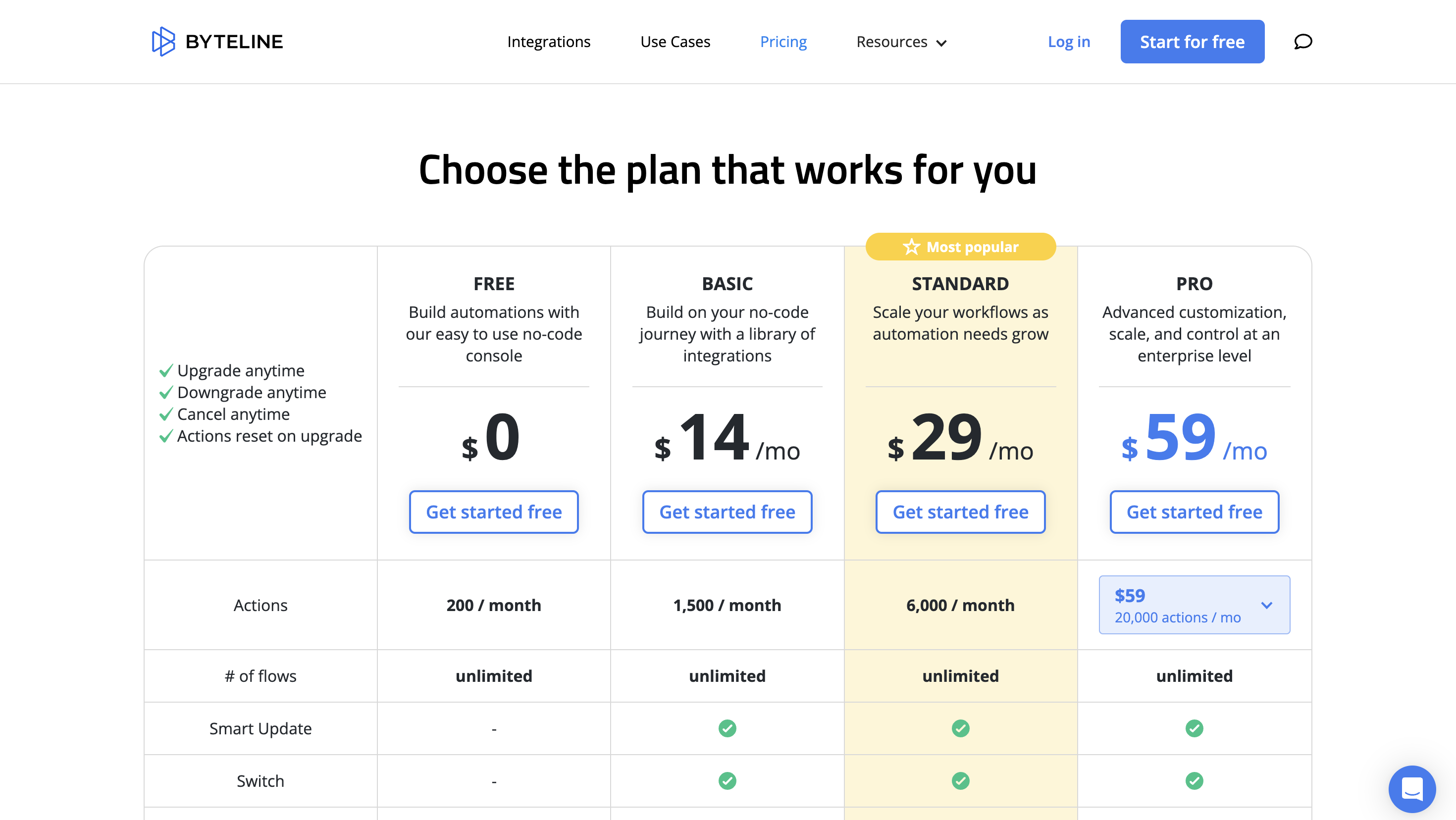

Cennik

Możesz zacząć używać go za darmo, a ceny premium zaczynają się od 14 USD miesięcznie.

12. grepsr

Grepsr to niezwykłe oprogramowanie do skrobania stron internetowych, które działa w przeglądarce. Grepsr to przydatne narzędzie zarówno dla korporacji, jak i badaczy, ponieważ umożliwia wydajne i łatwe wyodrębnianie danych ze stron internetowych.

Podczas korzystania z Grepsr nie musisz się martwić skomplikowanym kodem lub konfiguracją infrastruktury. Możesz uzyskiwać dostęp do swoich projektów skrobania i zarządzać nimi z dowolnego miejsca z połączeniem internetowym, ponieważ ma on projekt oparty na chmurze.

Wykorzystuje zaawansowane technologie zbierania danych online, takie jak sprytne algorytmy rozpoznawania i analizowania danych, aby zagwarantować precyzyjne i niezawodne pozyskiwanie danych. Grepsr ma również możliwości planowania, co pozwala zautomatyzować procedurę skrobania i uzyskiwać zaktualizowane dane w określonych odstępach czasu.

Ponadto obsługiwane są różne formaty eksportu danych, takie jak CSV, Excel, JSON i XML, co pozwala na swobodę pracy z danymi w wybranym formacie.

Możesz zbierać dane nawet z najbardziej dynamicznych stron internetowych, ponieważ są one zbudowane do obsługi skomplikowanych stron internetowych, w tym tych z renderowaniem treści opartym na JavaScript.

Cennik

Skontaktuj się ze sprzedawcą, aby uzyskać jego wycenę.

13. ProWebScraper

ProWebScraper to przyjazna dla użytkownika technologia web scrapingu oparta na przeglądarce, która umożliwia użytkownikom szybkie i proste wyodrębnianie danych ze stron internetowych. Użytkownicy mogą wyodrębniać dane za pomocą interfejsu typu „wskaż i kliknij” bez konieczności pisania kodu.

Dodatkowo platforma posiada inteligentne narzędzie do ekstrakcji danych, które może rozpoznawać i wyodrębniać dane ze skomplikowanych stron internetowych. ProWebScraper oferuje również skrobaki na zamówienie dla stron internetowych, które wymagają zaawansowanej ekstrakcji danych. Ekstrakcja danych ze stron internetowych wymagających logowania to mocna strona ProWebScraper.

Po wprowadzeniu danych logowania osoby fizyczne mogą pobierać dane z dowolnej strony, do której mają dostęp za pomocą platformy. ProWebScraper zapewnia również możliwość planowania i automatyzacji wykrojów, a także różne opcje eksportu, w tym formaty CSV, Excel i JSON.

ProWebScraper używa robota sieciowego do zbierania informacji ze stron internetowych. Robot indeksujący może nawigować po kilku stronach i obsługiwać złożone witryny internetowe. ProWebScraper dodatkowo obsługuje serwery proxy, umożliwiając użytkownikom potajemne zbieranie danych i obejście ograniczeń IP. Oprogramowanie oferuje również automatyczną weryfikację danych w celu zapewnienia dokładności wyodrębnionych danych.

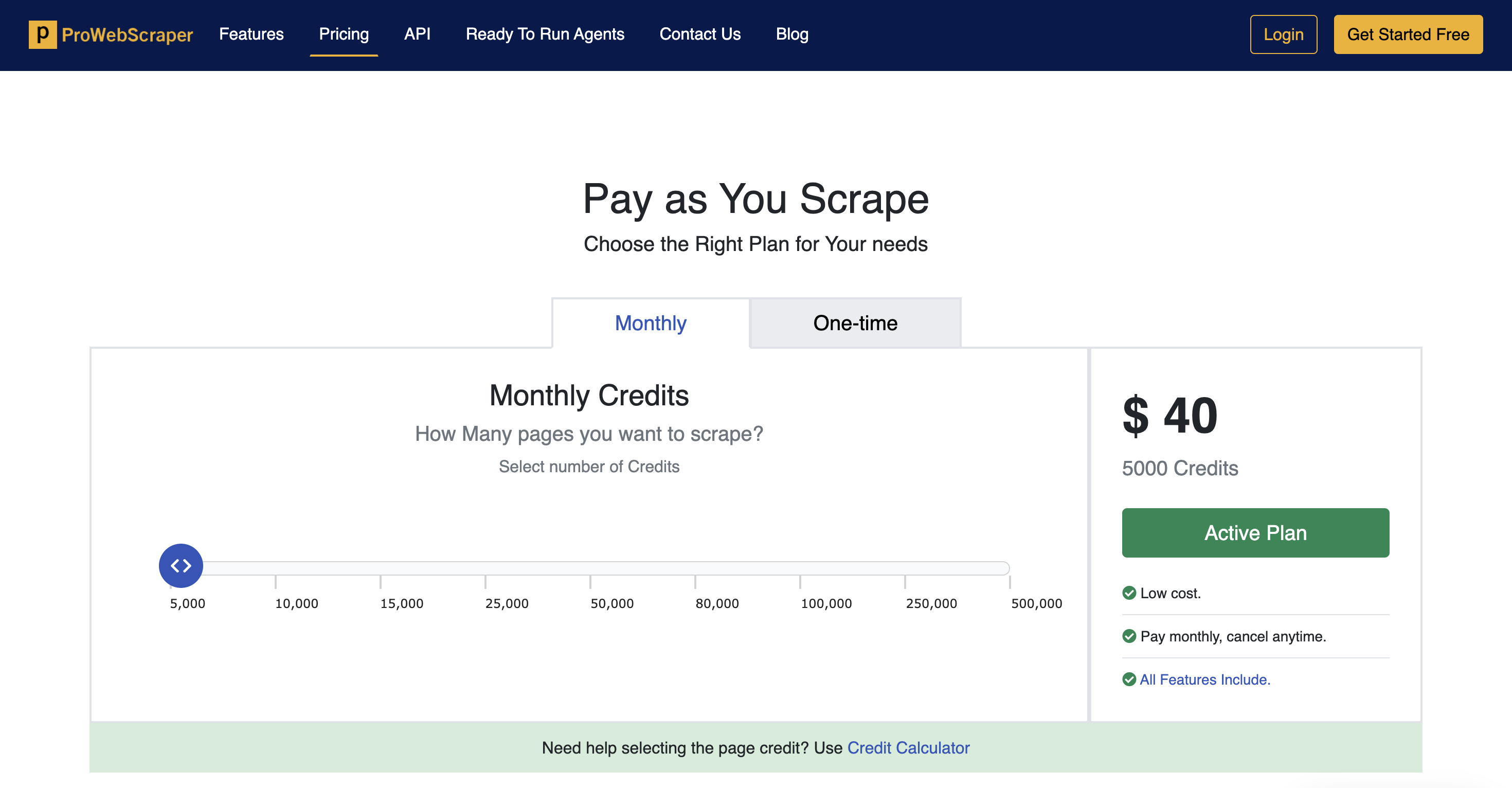

Cennik

Możesz zacząć używać go za darmo, a ceny premium zaczynają się od 40 USD za 5000 kredytów.

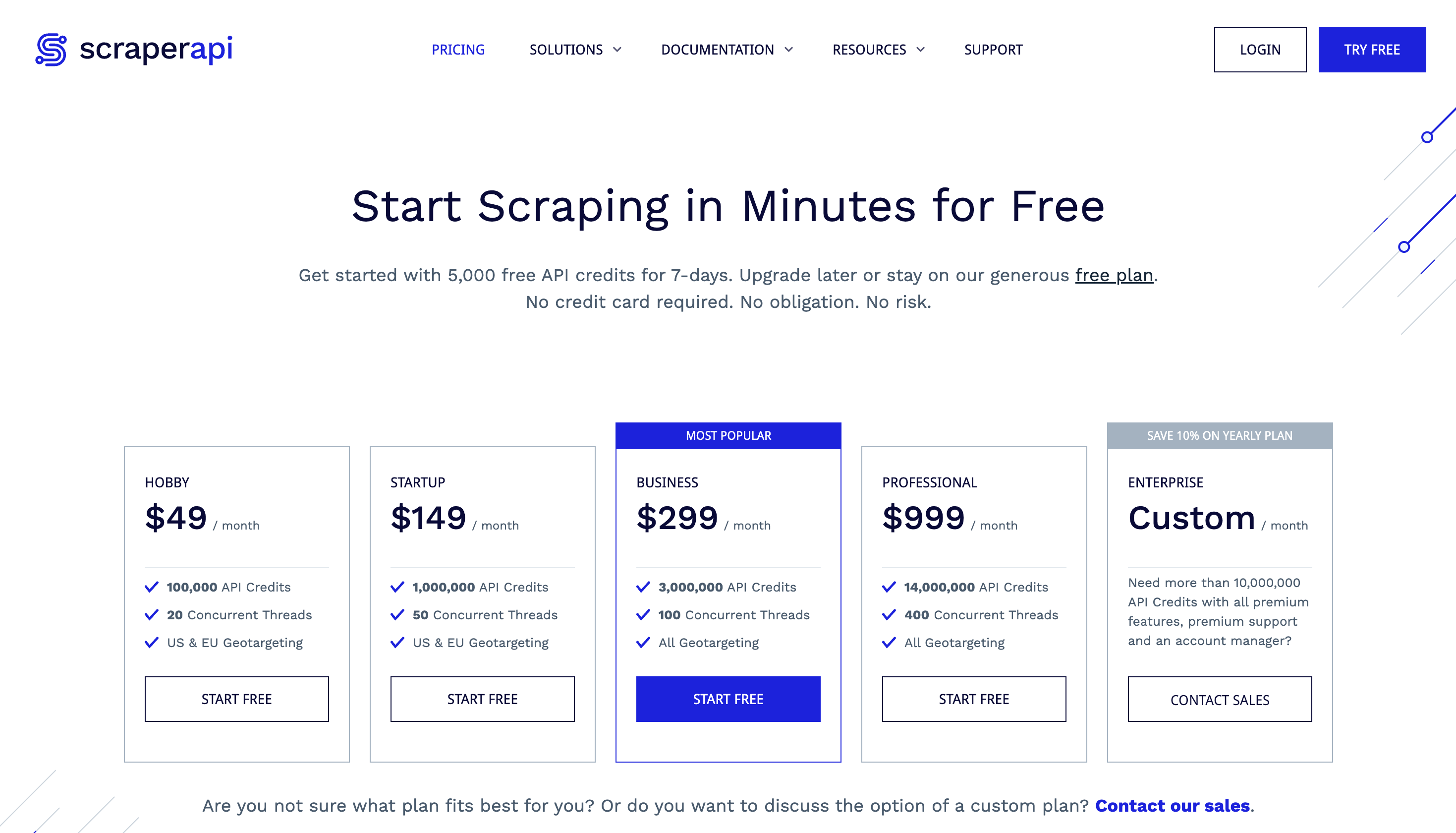

14. Skrobanie API

Platforma Scraping API to fantastyczne rozwiązanie oparte na przeglądarce, zaprojektowane specjalnie na potrzeby skrobania stron internetowych. Możesz szybko i łatwo wyodrębnić dane ze stron internetowych za pomocą Scraping API dzięki przyjaznemu dla użytkownika interfejsowi użytkownika.

Scraping API zapewni Ci wsparcie, niezależnie od tego, czy jesteś nowicjuszem, czy ekspertem od skrobania stron internetowych. Z pomocą współczesnych silników przeglądarek internetowych wykorzystuje technikę przeglądarki bez głowy do renderowania stron internetowych, uruchamiania JavaScript i uzyskiwania potrzebnych danych. W rezultacie nawet na skomplikowanych stronach ze zmieniającymi się materiałami gwarantowane są precyzyjne i niezawodne wyniki skrobania.

Ponadto możesz używać swoich ulubionych umiejętności kodowania za pomocą Scraping API, ponieważ obsługuje on różne języki programowania, takie jak Python, JavaScript i PHP.

Możesz przeglądać strony internetowe i wchodzić w interakcje z nimi dokładnie tak, jak prawdziwy użytkownik, dzięki solidnym funkcjom, które obejmują obsługę paginacji, przesyłanie formularzy i zarządzanie sesjami. Dodatkowo Scraping API oferuje bezproblemową rotację proxy, umożliwiając skrobanie stron internetowych na dużą skalę, jednocześnie ukrywając swój adres IP i unikając wszelkich zakazów.

Aby zagwarantować dokładną ekstrakcję danych, platforma zapewnia również skuteczne zarządzanie błędami i opcje ponawiania prób. Możesz bez wysiłku włączać dane w wielu formach, takich jak HTML, JSON i XML, do swoich aplikacji lub baz danych za pomocą interfejsu API skrobania.

Cennik

Ceny premium zaczynają się od 49 USD miesięcznie.

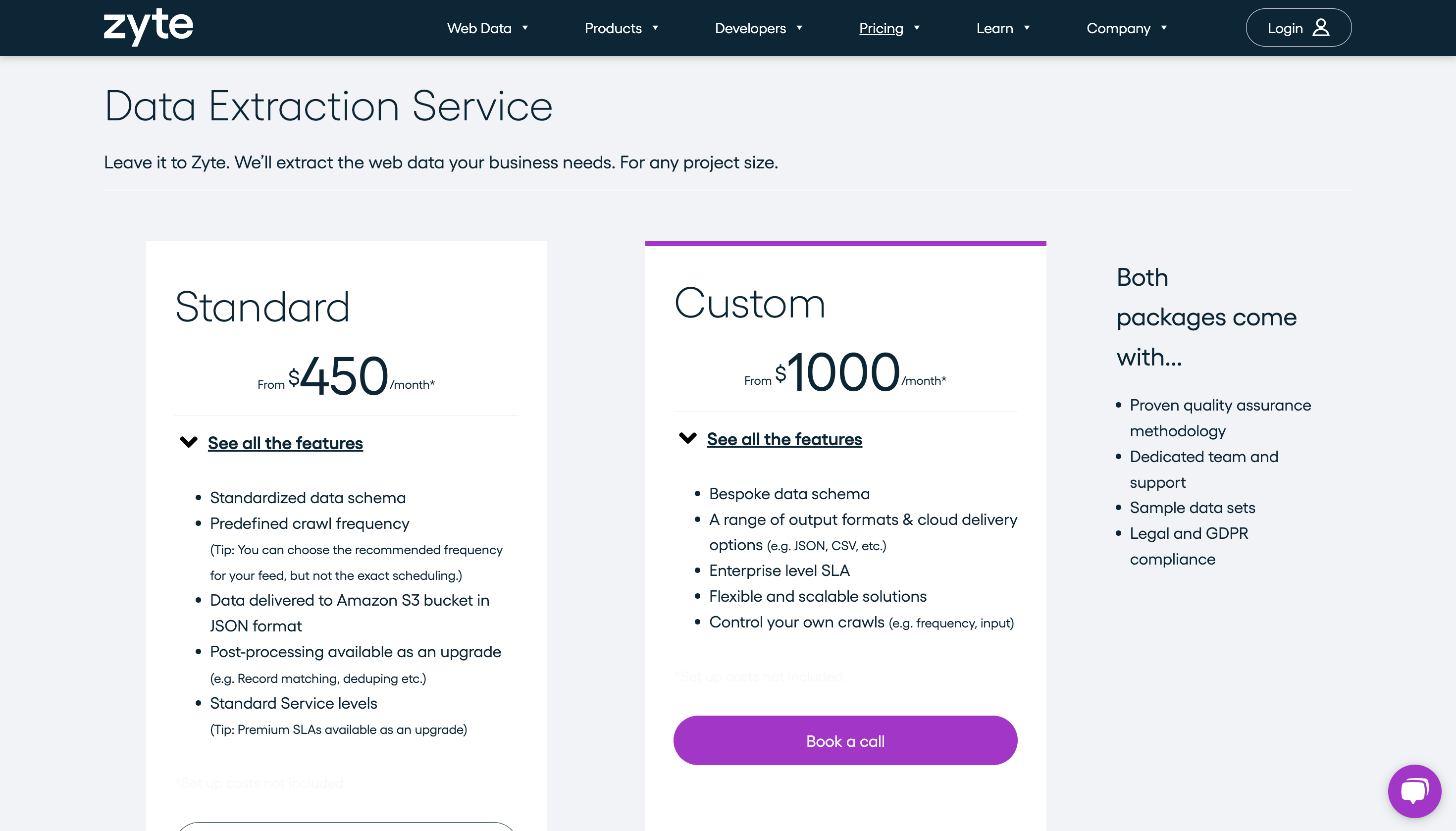

15. Zyte

Zyte to oparta na przeglądarce platforma przeznaczona wyłącznie do skrobania stron internetowych. Użytkownicy mogą szybko przeglądać strony internetowe i pobierać przydatne dane dzięki przyjaznemu dla użytkownika interfejsowi, który eliminuje potrzebę skomplikowanego kodowania lub konfiguracji infrastruktury.

Platforma wykorzystuje strategię przeglądarek bezobsługowych i wykorzystuje obecne silniki przeglądarek internetowych do renderowania stron internetowych, uruchamiania JavaScript i wydobywania danych z treści dynamicznych. Zapewnia to precyzyjne i dokładne wyniki skrobania, nawet ze skomplikowanych stron internetowych.

Ponadto Zyte oferuje różnorodne możliwości, takie jak zaawansowana walidacja danych, inteligentna ekstrakcja danych i skuteczne metody obsługi błędów, aby usprawnić proces skrobania.

Ponadto Zyte obsługuje wiele języków programowania, w tym Python, JavaScript i Ruby, dzięki czemu użytkownicy mogą korzystać ze swoich ulubionych umiejętności programistycznych.

Z Zyte nie będziesz musiał zarządzać serwerami ani martwić się o skalowalność, ponieważ możesz bez wysiłku zarządzać i rozwijać swoje projekty scrapingowe, wykorzystując ich infrastrukturę chmurową.

Ponadto Zyte ma wbudowane zarządzanie proxy, które umożliwia użytkownikom kierowanie żądań przez różne serwery proxy w celu zachowania anonimowości i uniknięcia blokad IP. Oferuje również bezproblemową interakcję z różnymi formatami i systemami przechowywania danych, w tym bazami danych i interfejsami API, ułatwiając przechowywanie i obsługę zebranych danych.

Cennik

Ceny premium zaczynają się od 450 USD miesięcznie.

Wnioski

Podsumowując, odblokowanie potencjału skrobania online i tworzenie spostrzeżeń opartych na danych zależy od wyboru odpowiedniej platformy do skrobania stron internetowych, która odpowiada Twoim unikalnym wymaganiom. Przy tak wielu dostępnych alternatywach kluczowe jest wzięcie pod uwagę aspektów, takich jak użyteczność, możliwość ekstrakcji danych, integracja API i inne.

Bright Data to jedna platforma, która wyróżnia się silną siecią proxy, intuicyjnym interfejsem użytkownika i najnowocześniejszymi możliwościami, w tym automatyczną ekstrakcją danych, sprawdzaniem poprawności danych i metodami zapobiegania blokowaniu. Firmy mogą łatwo uzyskiwać dostęp do ogromnych ilości danych online za pomocą Bright Data i wykorzystywać je, aby zapewnić sobie przewagę konkurencyjną na swoich rynkach.

Więc koniecznie sprawdź Bright Data i odkryj, jak może pomóc Ci osiągnąć cele związane z danymi, jeśli szukasz kompletnego i niezawodnego rozwiązania do zbierania danych z sieci.

Dodaj komentarz