Innholdsfortegnelse[Gjemme seg][Forestilling]

Sensorer og programvare er kombinert i autonome kjøretøy for å navigere, styre og betjene en rekke kjøretøy, inkludert motorsykler, biler, lastebiler og droner.

Avhengig av hvordan de ble utviklet eller designet, trenger de kanskje ikke førerassistanse.

Helt autonome biler kan operere trygt uten menneskelige sjåfører. Noen liker Googles Waymo bil, kunne ikke engang ha ratt.

Et delvis autonomt kjøretøy, for eksempel en Tesla, kan ta fullstendig kontroll over kjøretøyet, men kan trenge en menneskelig sjåfør for å hjelpe hvis systemet kommer i tvil.

Ulike grader av selvautomatisering er inkludert i disse bilene, fra kjørefeltveiledning og bremsehjelp til helt uavhengige, selvkjørende prototyper.

Målet med førerløse biler er å redusere trafikk, utslipp og ulykkesfrekvens.

Dette er mulig fordi autonome kjøretøy er flinkere til å overholde trafikkregler enn mennesker.

For en jevn kjøretur er viss informasjon nødvendig, for eksempel plasseringen av bilen eller andre objekter i nærheten, den korteste og sikreste veien til destinasjonen og kapasiteten til å betjene kjøresystemet.

Det er avgjørende å forstå når og hvordan man skal utføre nødvendige oppgaver.

Denne artikkelen vil dekke mye av området, inkludert system arkitektur for autonome biler, nødvendige komponenter og ad hoc-nettverk for kjøretøy (VANETs).

Nødvendige komponenter som kreves for autonome kjøretøy

Dagens autonome kjøretøy bruker en rekke sensorer, inkludert kameraer, GPS, treghetsmålingsenheter (IMU), ekkolodd, laserbelysningsdeteksjon og rekkevidde (lidar), radiodeteksjon og rekkevidde (radar), lydnavigasjon og avstandsavstand (ekkolodd), og 3D kart.

Sammen analyserer disse sensorene og teknologiene data i sanntid for å kontrollere styring, akselerasjon og bremsing.

Radarsensorene hjelper til med å holde oversikt over hvor omkringliggende biler befinner seg. Kjøretøy blir hjulpet med ultralydsensorer under parkering.

En teknologi kjent som lidar ble laget ved å bruke begge typer sensorer. Ved å reflektere lyspulser fra miljøet rundt bilen, kan lidar-sensorer oppdage kantene på veier og identifisere kjørefeltmarkører.

Disse advarer også sjåfører om tilstøtende hindringer, for eksempel andre kjøretøy, fotgjengere og sykler.

Størrelsen og avstanden til alt rundt bilen måles ved hjelp av lidar-teknologi, som også lager et 3D-kart som lar kjøretøyet se omgivelsene og identifisere eventuelle risikoer.

Uavhengig av tid på døgnet, enten det er lyst eller dystert, gjør den en suveren jobb med å registrere informasjon i forskjellige typer omgivelseslys.

Bilen bruker kameraer, radar og GPS-antenner, sammen med lidar og kameraer, for å oppdage omgivelsene og identifisere plasseringen.

Kameraer sjekker for fotgjengere, syklister, biler og andre hindringer, samtidig som de oppdager trafikksignaler, leser veiskilt og merker og holder styr på andre kjøretøy.

Imidlertid kan de ha det vanskelig i svake eller skyggefulle områder. Et autonomt kjøretøy kan se hvor det går ved å bruke en blanding av lidar, radar, kameraer, GPS-antenner og ultralydsensorer for å kartlegge veien foran den digitalt.

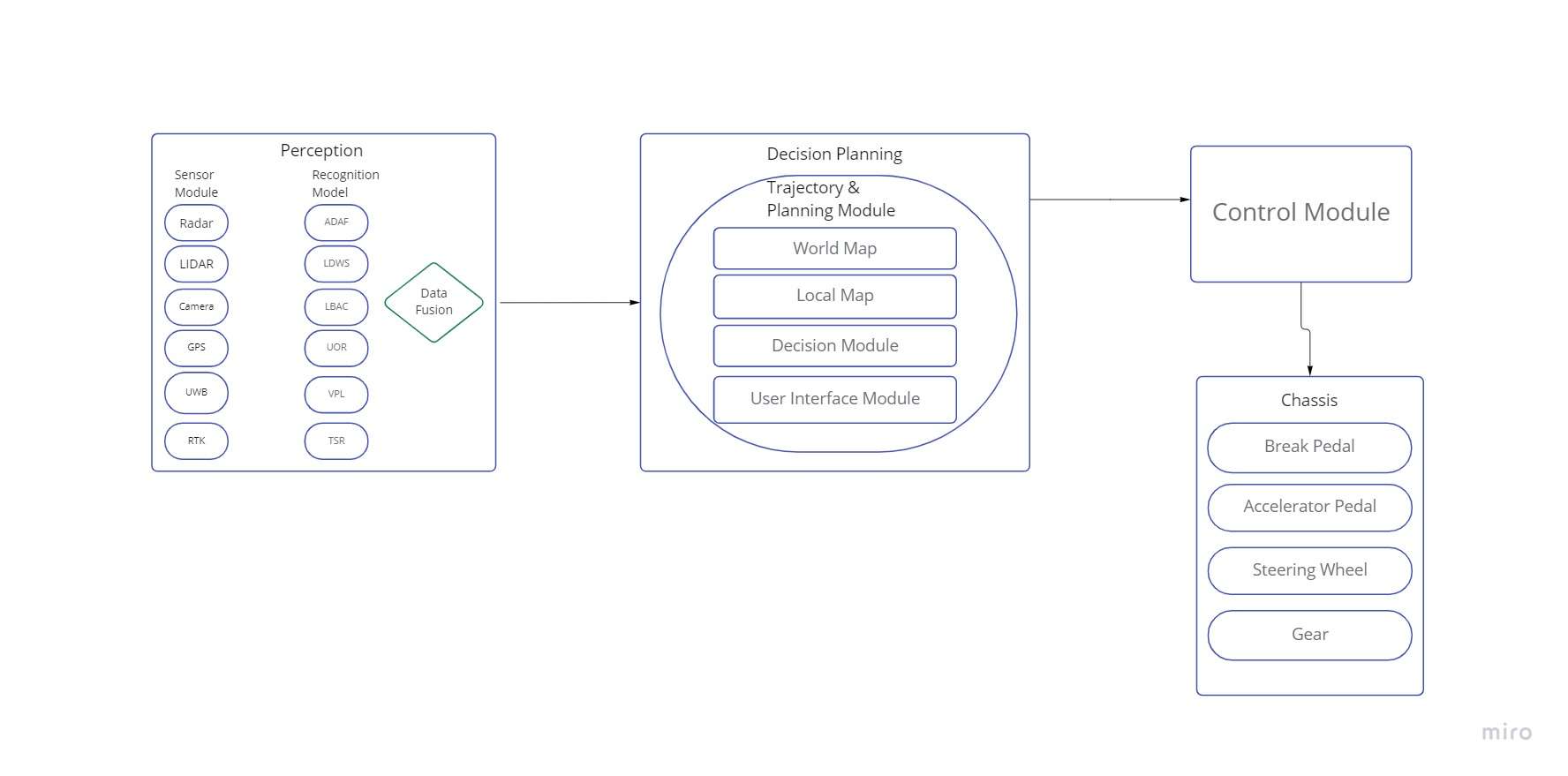

Systemarkitektur på høyt nivå

De essensielle sensorene, aktuatorene, maskinvaren og programvaren er oppført i arkitekturen, som også demonstrerer hele kommunikasjonsmekanismen eller protokollen i AV-er.

Perception

Dette stadiet omfatter å identifisere AV-ens plassering i forhold til miljøet og sanse miljøet rundt AV-en ved hjelp av en rekke sensorer.

AV-en bruker RADAR, LIDAR, kamera, sanntidskinetisk (RTK) og andre sensorer på dette trinnet. Gjenkjenningsmodulene mottar dataene fra disse sensorene og behandler dem etter å ha videreført dem.

Generelt består AV-en av et kontrollsystem, LDWS, TSR, gjenkjenning av ukjente hindringer (UOR), en kjøretøyposisjonerings- og lokaliseringsmodul (VPL), etc.

Den kombinerte informasjonen blir gitt til stadiet av beslutningstaking og planlegging etter å ha blitt behandlet.

Beslutning og planlegging

Bevegelsene og oppførselen til AV bestemmes, planlegges og kontrolleres på dette trinnet ved å bruke informasjonen mottatt under persepsjonsprosessen.

Dette stadiet, som hjernen vil representere, er der valg blir gjort på ting som veiplanlegging, handlingsprediksjon, unngåelse av hindringer, etc.

Valget er basert på informasjonen som er nå og historisk tilgjengelig, inkludert sanntids kartdata, trafikkspesifikasjoner, trender, brukerinformasjon, etc.

Det kan være en dataloggmodul som holder styr på feil og data for senere bruk.

Kontroll

Kontrollmodulen utfører operasjoner/handlinger knyttet til fysisk kontroll av AV-en, som styring, bremsing, akselerasjon osv. etter å ha mottatt informasjon fra beslutnings- og planleggingsmodulen.

chassis

Det siste trinnet involverer samhandling med de mekaniske delene som er festet til chassiset, slik som girmotoren, rattmotoren, bremsepedalmotoren og pedalmotorene for gasspedalen og bremsen.

Kontrollmodulen signaliserer og styrer alle disse komponentene.

Nå skal vi snakke om den generelle kommunikasjonen til en AV før vi snakker om design, drift og bruk av ulike nøkkelsensorer.

RADAR

I AV-er brukes RADAR-er til å skanne miljøet for å finne og lokalisere biler og andre objekter.

RADARer brukes ofte i både militære og sivile formål, for eksempel flyplasser eller meteorologiske systemer, og de opererer i millimeterbølgespekteret (mm-bølge).

Ulike frekvensbånd, inkludert 24, 60, 77 og 79 GHz, brukes i moderne biler og har et måleområde på 5 til 200 m [10].

Ved å beregne ToF mellom det overførte signalet og det returnerte ekkoet, bestemmes avstanden mellom AV og objektet.

I AV-er bruker RADAR-ene en rekke mikroantenner som skaper en samling av lober for å forbedre rekkeviddeoppløsningen og identifisering av flere mål. mm-Wave RADAR kan nøyaktig vurdere nærliggende objekter i alle retninger ved å bruke variansen i Doppler-forskyvning på grunn av dens økte penetreringsevne og større båndbredde.

Siden mm-Wave-radarer har en lengre bølgelengde, har de antiblokkerings- og anti-forurensningsfunksjoner som gjør dem i stand til å fungere i regn, snø, tåke og dårlig lys.

I tillegg kan Doppler-skift brukes til å beregne den relative hastigheten via mm-bølgeradarer. På grunn av sin kapasitet er mm-Wave-radarer godt egnet for et bredt spekter av AV-applikasjoner, inkludert gjenkjenning av hindringer og fotgjenger- og kjøretøygjenkjenning.

Ultralydssensorer

Disse sensorene fungerer i området 20–40 kHz og bruker ultralydbølger. En magneto-resistiv membran som brukes til å måle objektets avstand produserer disse bølgene.

Ved å beregne flytiden (ToF) for den utsendte bølgen til det ekkosignalet, bestemmes avstanden. Den typiske rekkevidden for ultralydsensorer er mindre enn 3 meter.

Sensorutgangen oppdateres hver 20. ms, noe som hindrer den i å samsvare med ITS sine strenge QoS-krav. Disse sensorene har et relativt lite stråledeteksjonsområde og er rettet.

Derfor, for å få et fullfeltsyn, kreves det en rekke sensorer. Imidlertid vil mange sensorer samhandle og kan føre til betydelige unøyaktigheter i rekkevidden.

LiDAR

Spektrene på 905 og 1550 nm brukes i LiDAR. Siden det menneskelige øyet er mottakelig for netthinneskade fra 905 nm-området, opererer den nåværende LiDAR i 1550 nm-båndet for å redusere netthinneskader.

Opp til 200 meter er LiDARs maksimale arbeidsrekkevidde. Solid-state, 2D og 3D LiDAR er de forskjellige underkategoriene til LiDAR.

En enkelt laserstråle spres over et speil som snurrer raskt i en 2D LiDAR. Ved å plassere flere lasere på poden kan en 3D LiDAR få et 3D-bilde av omgivelsene.

Det har blitt demonstrert at et LiDAR-system ved veikanten senker antallet kjøretøy-til-fotgjenger-kollisjoner (V2P) i både kryssende og ikke-kryssende soner.

Den bruker et 16-linjers, sanntids, beregningsmessig effektivt LiDAR-system.

Det er foreslått å bruke en dyp kunstig auto-encoder nevrale nettverket (DA-ANN), som oppnår en nøyaktighet på 95 % over en rekkevidde på 30 m.

I er det demonstrert hvordan en støttevektormaskin (SVM)-basert algoritme kombinert med en 64-linjers 3D LiDAR kan forbedre fotgjengergjenkjenning.

Til tross for at den har bedre målepresisjon og 3D-syn enn en mm-bølgeradar, yter LiDAR dårligere i ugunstig vær, inkludert tåke, snø og regn.

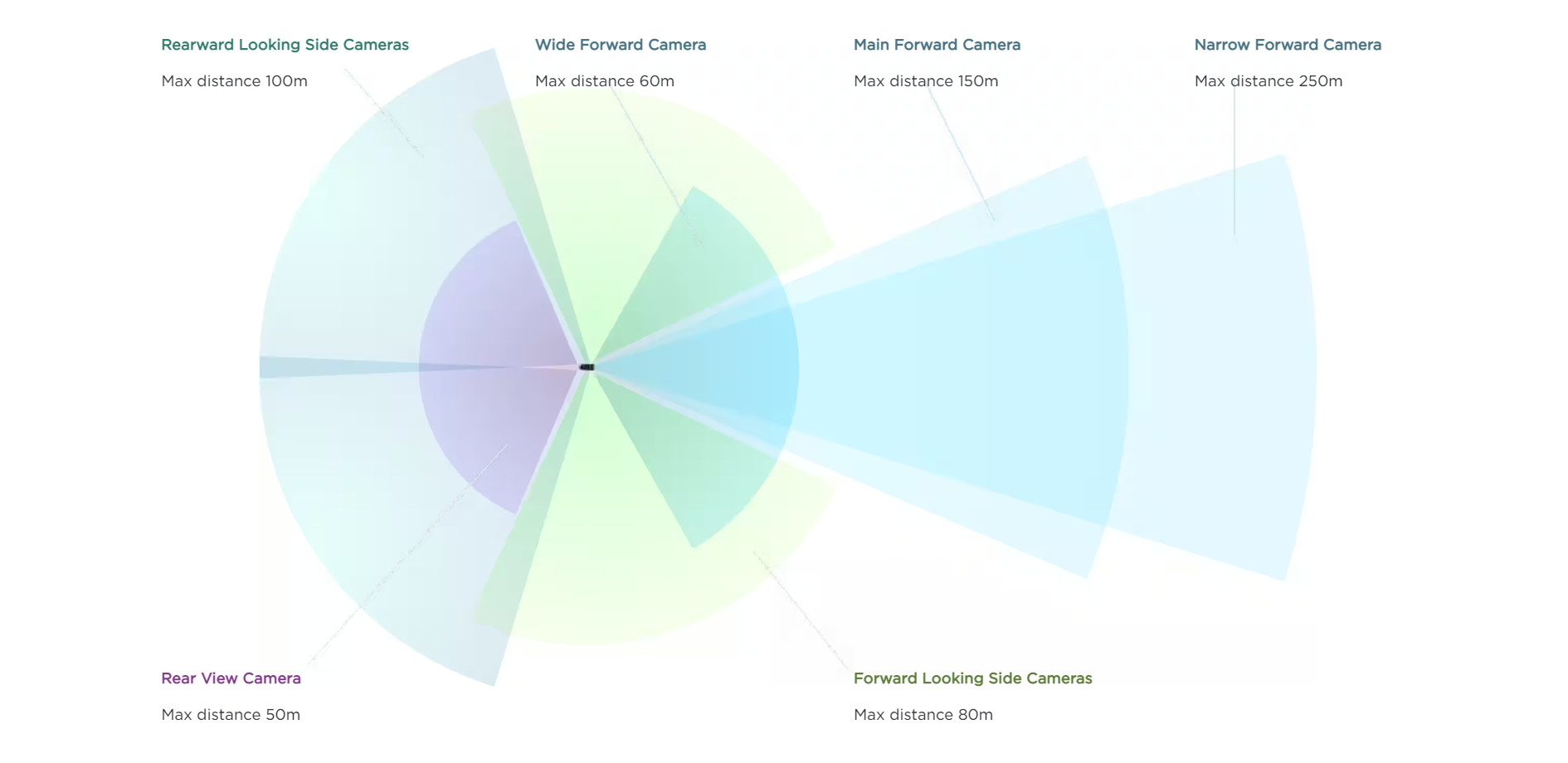

kameraer

Avhengig av enhetens bølgelengde kan kameraet i AV-er enten være infrarødt- eller synlig-lysbasert.

Charge-coupled device (CCD) og komplementære metall-oksid-halvleder (CMOS) bildesensorer brukes i kameraet (CMOS).

Avhengig av objektivkvaliteten er kameraets maksimale rekkevidde rundt 250 m. De tre båndene som brukes av synlige kameraer – rødt, grønt og blått – er atskilt med samme bølgelengde som det menneskelige øyet, eller 400–780 nm (RGB).

To VIS-kameraer er kombinert med etablerte brennvidder for å lage en ny kanal som inneholder dybdeinformasjon (D), noe som gjør det mulig å lage stereoskopisk syn.

En 3D-visning av området rundt kjøretøyet kan oppnås takket være denne muligheten via kameraet (RGB-D).

Passive sensorer med en bølgelengde på mellom 780 nm og 1 mm brukes av det infrarøde (IR) kameraet. Ved toppbelysning tilbyr IR-sensorene i AV-er visuell kontroll.

Dette kameraet hjelper AV-er med objektgjenkjenning, sidevisningskontroll, ulykkesregistrering og BSD. Men i ugunstig vær, som snø, tåke og skiftende lysforhold, endres kameraets ytelse.

Et kameras primære fordeler er dets evne til nøyaktig å samle og registrere tekstur, fargefordeling og form av miljøet.

Globalt navigasjonssatellittsystem og globalt posisjoneringssystem, treghetsmåleenhet

Denne teknologien hjelper AV-en med å navigere ved å finne den nøyaktige plasseringen. En gruppe satellitter i bane rundt planetens overflate brukes av GNSS for å lokalisere.

Systemet lagrer data om AV-ens plassering, hastighet og nøyaktige tid.

Det fungerer ved å finne ut ToF mellom signalet som mottas og satellittens emisjon. GPS-koordinatene (Global Positioning System) brukes ofte for å finne AV-plasseringen.

De GPS-ekstraherte koordinatene er ikke alltid nøyaktige, og de legger typisk til en posisjonsfeil med en middelverdi på 3 m og en standardvariasjon på 1 m.

I storbysituasjoner blir ytelsen ytterligere forverret, med en feil i plasseringen på opptil 20 m, og under visse alvorlige omstendigheter er GPS-posisjonsfeilen omtrent 100 m.

I tillegg kan AV-er bruke RTK-systemet til å nøyaktig bestemme posisjonen til kjøretøyet.

I AV-er kan posisjonen og retningen til kjøretøyet også bestemmes ved hjelp av dødregning (DR) og treghetsposisjonen.

Sensor Fusjon

For riktig kjøretøystyring og sikkerhet må AV-er få nøyaktig sanntidskunnskap om plassering, status og andre kjøretøyfaktorer som vekt, stabilitet, hastighet, etc.

Denne informasjonen må samles inn av AV-ene som bruker en rekke sensorer.

Ved å slå sammen data innhentet fra flere sensorer, blir sensorfusjonsteknikken utnyttet til å produsere sammenhengende informasjon.

Metoden tillater syntese av ubehandlede data innhentet fra komplementære kilder.

Som et resultat gjør sensorfusjon det mulig for AV-en å forstå omgivelsene nøyaktig ved å slå sammen alle nyttige data samlet fra forskjellige sensorer.

Ulike typer algoritmer, inkludert Kalman-filtre og Bayesian-filtre, brukes til å utføre fusjonsprosessen i AV-er.

Fordi det brukes i flere applikasjoner, inkludert RADAR-sporing, satellittnavigasjonssystemer og optisk odometri, blir Kalman-filteret sett på som avgjørende for at et kjøretøy skal fungere autonomt.

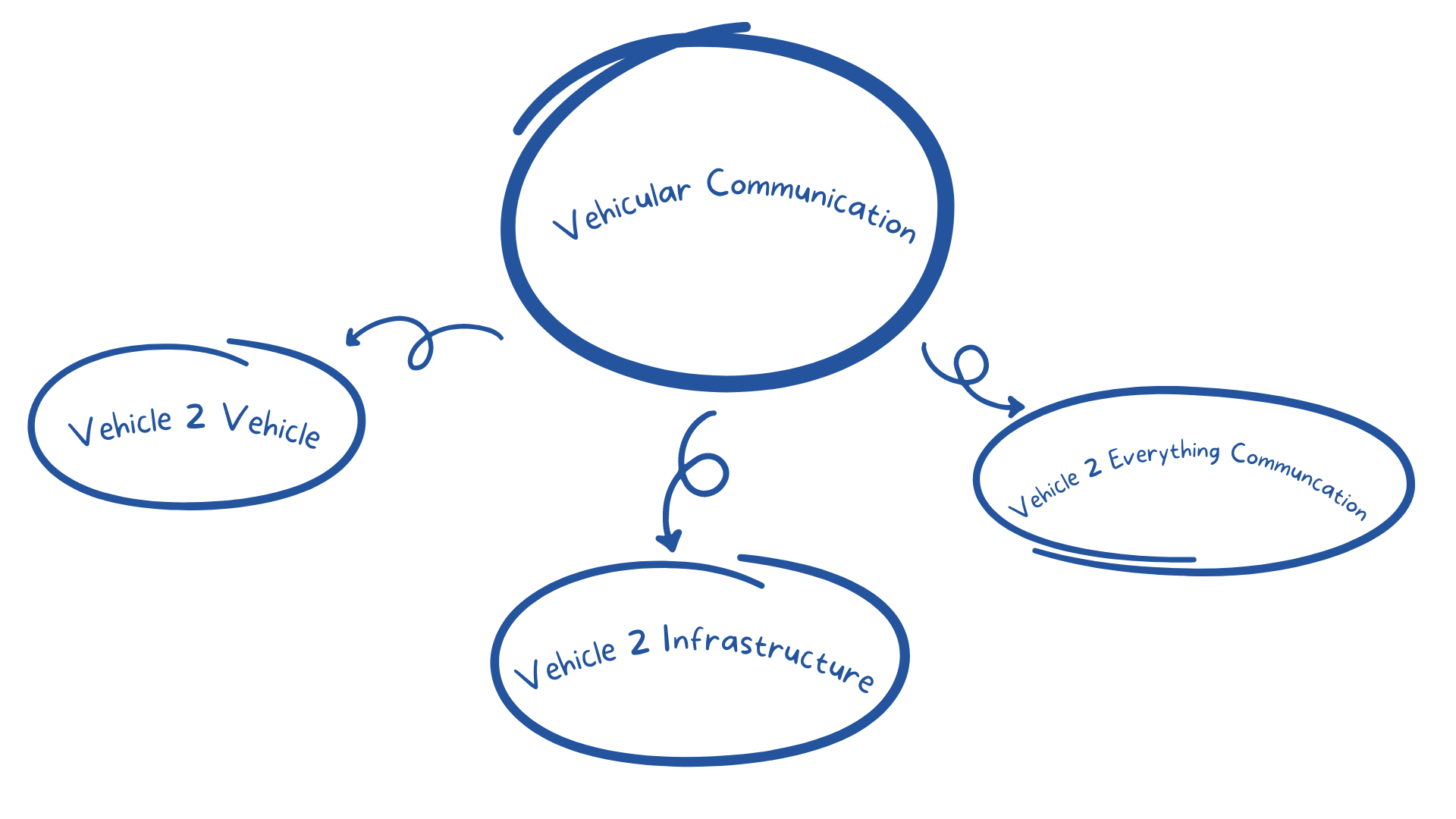

Ad-hoc-nettverk for kjøretøy (VANETs)

VANET-er er en ny underklasse av mobile ad hoc-nettverk som spontant kan skape et nettverk av mobile enheter/kjøretøyer. Kjøretøy-til-kjøretøy (V2V) og kjøretøy-til-infrastruktur (V2I) kommunikasjon er mulig med VANET-er.

Hovedmålet med slik teknologi er å øke trafikksikkerheten; for eksempel i farlige situasjoner som ulykker og trafikkork, kan biler samhandle med hverandre og nettverket for å videresende viktig informasjon.

Følgende er hovedkomponentene i VANET-teknologien:

- OBU (on-board unit): Det er et GPS-basert sporingssystem plassert i hvert kjøretøy som lar dem samhandle med hverandre og med veikantenheter (RSU). OBU er utstyrt med flere elektroniske komponenter, inkludert en ressurskommandoprosessor (RCP), sensorenheter og brukergrensesnitt, for å få viktig informasjon. Dens primære formål er å bruke et trådløst nettverk for å kommunisere mellom flere RSUer og OBUer.

- Roadside Unit (RSU): RSUer er faste dataenheter som er plassert på nøyaktige punkter på gater, parkeringsplasser og veikryss. Hovedmålet er å koble autonome kjøretøy til infrastrukturen, og det hjelper også med kjøretøylokalisering. I tillegg kan den brukes til å koble et kjøretøy til andre RSUer som bruker forskjellige nettverkstopologier. I tillegg har de blitt drevet på omgivende energikilder, inkludert solenergi.

- Trusted Authority (TA): Det er et organ som kontrollerer hvert trinn i VANET-prosessen, og sikrer at bare legitime RSU-er og kjøretøy-OBU-er kan registrere seg og samhandle. Ved å bekrefte OBU-ID og autentisere kjøretøyet gir det sikkerhet. I tillegg finner den skadelig kommunikasjon og merkelig oppførsel.

VANET-er brukes til kjøretøykommunikasjon, som inkluderer V2V-, V2I- og V2X-kommunikasjon.

Kjøretøy 2 Kjøretøyskommunikasjon

Muligheten for biler til å snakke med hverandre og utveksle viktig informasjon om trafikkproblemer, ulykker og hastighetsbegrensninger er kjent som inter-vehicle communication (IVC).

V2V-kommunikasjon kan skape nettverket ved å slå sammen ulike noder (kjøretøyer) ved å bruke en mesh-topologi, enten delvis eller full.

De er kategorisert som single-hop (SIVC) eller multi-hop (MIVC) systemer avhengig av hvor mange hopp som brukes til kommunikasjon mellom kjøretøy.

Mens MIVC kan brukes til langdistansekommunikasjon, for eksempel trafikkovervåking, kan SIVC brukes til kortdistanseapplikasjoner som kjørefeltsammenslåing, ACC, etc.

Tallrike fordeler, inkludert BSD, FCWS, automatisert nødbremsing (AEB) og LDWS, tilbys gjennom V2V-kommunikasjon.

Kjøretøy 2 Infrastrukturkommunikasjon

Bilene kan kommunisere med RSU-ene gjennom en prosess kjent som veikant-til-kjøretøy-kommunikasjon (RVC). Den hjelper til med å oppdage parkeringsmålere, kameraer, kjørefeltmarkører og trafikksignaler.

Ad hoc, trådløs og toveis tilkobling mellom bilene og infrastrukturen.

For administrasjon og tilsyn med trafikk benyttes infrastrukturens data. De brukes til å justere ulike hastighetsparametere som lar bilene maksimere drivstofføkonomien og styre trafikkflyten.

RVC-systemet kan separeres i Sparse RVC (SRVC) og Ubiquitous RVC avhengig av infrastrukturen (URVC).

SRVC-systemet tilbyr kun kommunikasjonstjenester på hotspots, for eksempel å lokalisere åpne parkeringsplasser eller bensinstasjoner, mens URVC-systemet tilbyr dekning langs hele ruten, selv i høye hastigheter.

For å garantere nettverksdekning, krever URVC-systemet en stor investering.

Kjøretøy 2 Alt Kommunikasjon

Bilen kan kobles til andre enheter via V2X, inkludert fotgjengere, veikantobjekter, enheter og rutenettet (V2P, V2R og V2D) (V2G).

Ved å bruke denne typen kommunikasjon kan sjåfører unngå å treffe fotgjengere, syklister og motorsykkelførere i fare.

Pedestrian Collision Warning (PCW)-systemet kan advare føreren av en passasjer ved veien før en katastrofal kollisjon inntreffer takket være V2X-kommunikasjon.

For å sende viktige meldinger til fotgjengeren, kan PCW dra nytte av smarttelefonens Bluetooth eller Near Field Communication (NFC).

konklusjonen

De mange teknologiene som brukes til å konstruere autonome biler kan ha stor innvirkning på hvordan de fungerer.

På det mest grunnleggende utvikler bilen et kart over omgivelsene ved hjelp av en rekke sensorer som gir informasjon om ruten rundt den og andre kjøretøyer i veien.

Disse dataene blir deretter analysert av et komplisert maskinlæringssystem, som genererer et sett med handlinger som bilen skal utføre. Disse atferdene endres og oppdateres jevnlig etter hvert som systemet lærer mer om kjøretøyets omgivelser.

Til tross for min beste innsats for å gi deg en oversikt over arkitekturen for det autonome kjøretøysystemet, skjer det mye mer bak kulissene.

Jeg håper virkelig du vil finne denne kunnskapen verdifull og bruke den.

Legg igjen en kommentar