Innholdsfortegnelse[Gjemme seg][Forestilling]

AI har fullstendig endret miljøet vårt, og en stor bidragsyter til denne endringen er åpen kildekode-fellesskapet.

Se for deg et samfunn der oppfinnelser utveksles fritt, ideer får flyte og inngangshindringer i hovedsak ikke eksisterer.

Det er her åpen kildekode AI finnes.

Utviklere, akademikere og entusiaster jobber sammen i dette dynamiske økosystemet for å skape teknologier som forvandler fremtiden vår. Utforsk dette spennende universet hvor kunstig intelligens er et samarbeid mellom mange i stedet for det eksklusive domenet til noen få utvalgte.

Utviklingen av AI har vært intet mindre enn bemerkelsesverdig. Kunstig intelligens har gått langt fra sine tidlige faser på midten av det 20. århundre til sin nåværende posisjon som en pilar av teknologi.

Denne fremgangen har i stor grad vært drevet av åpen kildekode-fellesskapet.

Prosjekter som Googles TensorFlow er et godt eksempel på dette. Mer enn bare et verktøy, TensorFlow er en katalysator som har muliggjort flere AI-initiativer, fremskyndet forskning og banet vei for innovasjoner.

Dens innflytelse kan observeres i en rekke applikasjoner, for eksempel prediktiv analyse og språkbehandling.

Så, hva er AI som er åpen kildekode?

AI gjorde det tilgjengelig for alle. AI-teknologier kan brukes, endres og deles av alle takket være åpen kildekode-plattformer. Disse plattformene har skapt levende sentre for AI-innovasjon ut fra nettsteder som GitHub.

Alt er tilgjengelig her, fritt delt, alt fra grunnleggende AI-modeller til intrikate algoritmer. Denne strategien fremmer teamarbeid, stimulerer kreativitet og åpner AI for et større publikum.

Fordelene ved å bruke åpen kildekode AI er betydelige. Spesielt startups har mye å vinne. Tenk på et lite teknologiselskap med mange ideer, men ingen finansiering.

De kan lage komplekse løsninger uten å knekke banken takket være åpen kildekode AI. Ved å modifisere AI-teknologier for å møte deres egne krav, kan de fremskynde forskning og produktskaping.

Denne fleksibiliteten og kostnadseffektiviteten er store fordeler for nye virksomheter. Derfor har vi samlet de beste open source-verktøyene og plattformene i dette innlegget slik at du kan bygge noe fantastisk.

1. Underlag

Substratus er en revolusjonerende åpen kildekode-plattform som transformerer utviklingen og opplæringsscenen for maskinlæringsmodeller.

Ved å integrere skreddersydde ressurser som modell, server, datasett og notatbok i Kubernetes API, utvider denne plattformen på en unik måte mulighetene til Kubernetes kontrollplan og orkestrerer hele levetiden til maskinlæringsmodeller.

Modellressursen, som kombinerer kildekode med vekter og skjevheter for å konstruere en maskinlæringsmodellforekomst, er den sentrale komponenten i Substratus.

Denne modellen tilbyr allsidighet og enkelhet i modellkonstruksjon siden den kan utledes fra et Git-depot eller konstrueres ved hjelp av en eksisterende modell og en treningsdatasett.

Dessuten kommer Substratus med serverressursen, som forenkler prosessen med å gjøre AI-modellene dine om til funksjonelle og brukbare ressurser ved å eksponere en modell via en HTTP API for slutninger.

Et annet viktig element som gjør dataimport og transformasjon enklere, er Dataset-ressursen.

Den leder brukere til kildekoden for import av data, som Substratus kjører og containeriserer for å sikre effektiv databehandling.

Notebook-ressursen, som er en Jupyter Notebook forekomst som kjører på høyytelses beregningsressurser inne i en Kubernetes-klynge, er revolusjonerende for utviklere.

Dette gjør det mulig å lage maskinlæringskildekode på pålitelig maskinvare som er brukbar selv på små lokale datamaskiner. Det er flere fordeler ved å inkludere Substratus i prosessen.

Du kan trene og betjene maskinlæringsmodeller på den i en rekke skyinnstillinger fordi den er et substrat på tvers av skyer.

Substratus krever ingen koding og gir innebygde optimaliseringer, noe som gjør det enklere å distribuere og finjustere store språkmodeller med åpen kildekode (LLM). Jupyter bærbare PC-er kan fjernstartes med bare én kommando, noe som resulterer i en jevn utviklingsprosess.

Primært fungerer Substratus i alle miljøer der Kubernetes installerer med små krav, og beskytter dataene dine i nettverket ditt.

Dens nullskaleringstilnærming optimaliserer GPU-kostnadene og bruker containere til å lage scenarier som kan gjentas. I tillegg brukes GitOps naturlig, noe som forbedrer operasjonell effektivitet.

2. AbanteAI (Mentat)

AbanteAIs Mentat markerer et betydelig fremskritt innen AI-drevet kodingshjelp, ved å bruke GPT-4s komplekse muligheter for å revolusjonere hvordan kode produseres og håndteres.

Tenk deg å forsyne Mentat med kommandoene du trenger fra kommandolinjen, og deretter se på mens den genererer kode i nye eller eksisterende kildefiler med letthet.

Du kan strømlinjeforme utviklingsprosessen ved å gjøre unna den tidkrevende kopieringen mellom IDE og en ChatGPT nettleservinduet takket være dette jevne kommandolinjegrensesnittet.

Utover hva verktøy som Copilots innebygde anbefalinger kan gjøre, er Mentat laget for å skrive kode for deg. Mentat tilpasser seg kravene dine og hjelper i begge situasjoner, enten du jobber med eksisterende kode eller begynner på en ny oppgave.

Denne ferdigheten representerer et stort fremskritt innen AI-assistert koding ettersom den genererer nyttig, handlingsbar kode i stedet for bare å gi anbefalinger.

Når utviklere bruker Mentat, øker produktiviteten deres fordi de kan konsentrere seg om mer intrikat og kreativt arbeid mens de overlater den kjedelige og repeterende kodingen til programmet.

Mentats tilpasningsevne vises i bredden av applikasjoner som adresserer mange elementer av koding, som å lage et første utkast for nye prosjekter, feilsøking og rask tilpasning til en ny kodebase.

Feltet AI-assistert koding har massevis av lovende utviklinger foran seg. Programmerere kan nå stole på AI for å utføre oppgaver som kodevurderinger, feilrettinger og syntaktiske korrigeringer.

Dette inkluderer plattformer som Mentat. Selv om teknologi neppe helt vil erstatte programmerere, spiller AI en mer og større rolle i programmering og er klar til å bli en nyttig alliert.

Kodeprosessen kan omdefineres som et resultat av dette partnerskapet mellom menneskelig intelligens og AIs effektivitet, noe som gjør den mindre utsatt for feil og mer effektiv.

3. ChatDev

ChatDev er en revolusjonerende teknikk for programvareutvikling som utnytter store språkmodeller (LLM) for å forbedre og fremskynde programvareutviklingsprosessen.

Dette nye rammeverket, basert på naturlig språkkommunikasjon, forsøker å gjøre opp med nødvendigheten av spesifikke modeller på ulike stadier av programvareutvikling, og revolusjonerer derfor industrien.

Programvareutviklingssyklusen er delt inn i fire hovedstadier av ChatDev, som bruker en organisert fossefallsmodell: design, koding, testing og dokumentasjon.

ChatDev deler disse fasene inn i diskrete underoppgaver ved å tilordne virtuelle agenter, som testere og programmerere, til hvert trinn.

Disse agentene jobber sammen gjennom samtaler. Oppgaveløsning effektiviseres av denne samtalekjedemetoden, som gjør forslag og løsningsvalidering enklere.

ChatDevs evne til å takle kodehallusinasjoner - som uoppdagede defekter eller manglende avhengigheter - som er hyppige i LLM-er, er en av hovedfordelene.

Moderne programvareapplikasjoner kan lages med ChatDevs rammeverk, som også bidrar til å redusere disse mulige risikoene. Utformingen av plattformen er basert på en chat-kjede som legger til rette for oppgaveorientert rollespill og effektiv kommunikasjon mellom virtuelle agenter.

Dette fører til en åpen og samarbeidende utviklingsprosess der sluttbrukere aktivt kan engasjere seg i beslutningsprosessen og oppgaver fullføres gjennom multi-turn, kontekstbevisste samtaler.

I løpet av designstadiet bruker ChatDev tilpassede meldinger og meldinger for å tildele sine agenter stillinger som administrerende direktør, CPO og CTO, basert på det første konseptet gitt av kunden.

Denne fasen inkluderer systemer som Memory Stream, Self-Reflection og Task Assignment, som sørger for at hver agent utfører sin oppgave etter beste evne.

Kodegenerering og GUI-utvikling er brutt ned i mindre ansvarsområder gjennom kodingsfasen, som inkluderer stillinger som CTO, programmerer og kunstdesigner.

Bruker objektorientert programmerings språk, løser rammeverket kodegenereringsproblemer ved å introdusere en "tankeinstruksjoner"-metode som er inspirert av tankekjede-forespørsler.

Ved å spesifikt målrette problemløsningsideer, garanterer denne teknikken korrekt og relevant kodeoppretting.

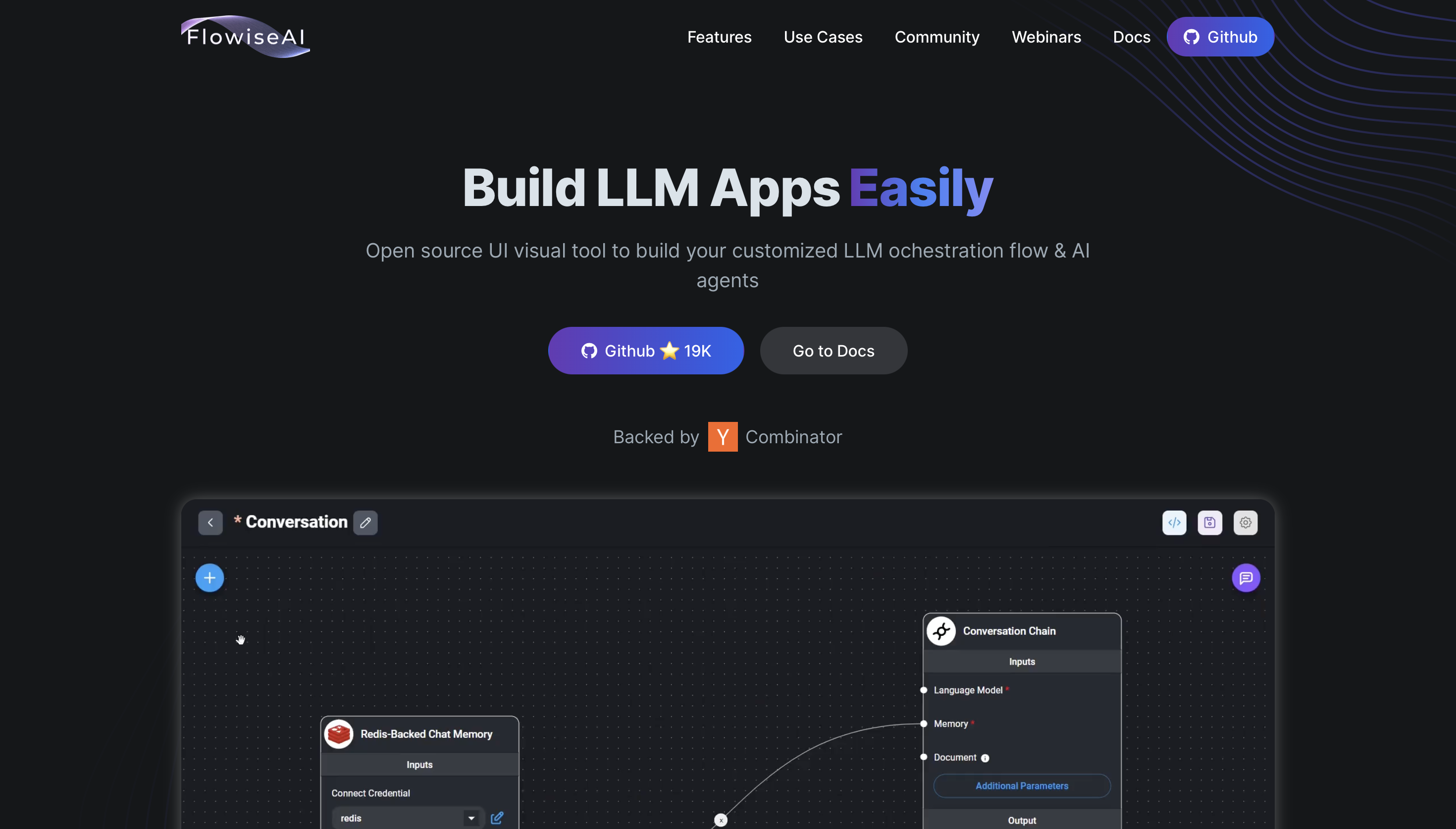

4. Flowise AI

Flowise AI er et revolusjonerende verktøy innen AI-drevet programvare, kjennetegnet ved dra-og-slipp-funksjonen som krever lite eller ingen koding.

Denne nye metoden gjør Large Language Model (LLM) applikasjonsutvikling og visualisering enklere, spesielt for personer uten mye kodingserfaring.

Flowise AI utmerker seg ved å utvikle LLM-apper, og forenkler den intrikate prosedyren til et mer tilgjengelig møte. Flowise AIs kapasitet til å lage nettskraping og det enklere å svare på spørsmål er en av hovedfunksjonene.

For eksempel kan Flowise AI håndtere oppgaven med å skrape alle relaterte lenker fra nettstedet ditt og få en LLM til å svare på henvendelser basert på innholdet på nettstedet ditt.

Plattformen kobles til vektordatabaser som Pinecone for å lagre og hente data, og den utnytter Cheerio Web Scraper-noden for koblingsskraping.

Dette gjør det mulig for data sømløst å overføres fra et nettsted til en database, og en LLM kan bruke denne databasen til å svare på brukerhenvendelser.

Videre er Flowise AI laget for å definere systemmeldinger for ulike bruksscenarier, for eksempel QA Chain for Conversational Retrieval.

Denne funksjonen er viktig for å garantere at AI-en reagerer på et bestemt språk og på en måte som unngår hallusinasjoner, som er et hyppig problem i AI-interaksjoner.

Påliteligheten og nøyaktigheten til AI-interaksjoner forbedres av Flowise AI ved å konfigurere innstillinger som AI-ens navn, svarspråket og bestemte svar i tilfelle det ikke blir oppnådd noe svar.

Å utvikle unike verktøy for å starte webhook-operasjoner er en ekstra spennende brukssak. Flowise AI muliggjør utvikling av verktøy som kan kontakte webhook-endepunkter og gi de nødvendige parameterne i webhook-kroppen.

Det er mulig å utvide denne funksjonen til andre plattformer som Gmail og Google Sheets og kombinere den med en rekke applikasjoner, for eksempel å sende meldinger til Discord.

Denne tilpasningsevnen eksemplifiserer Flowise AIs allsidighet når det gjelder å automatisere og optimalisere digitale operasjoner på mange plattformer og tjenester.

5. Stykke

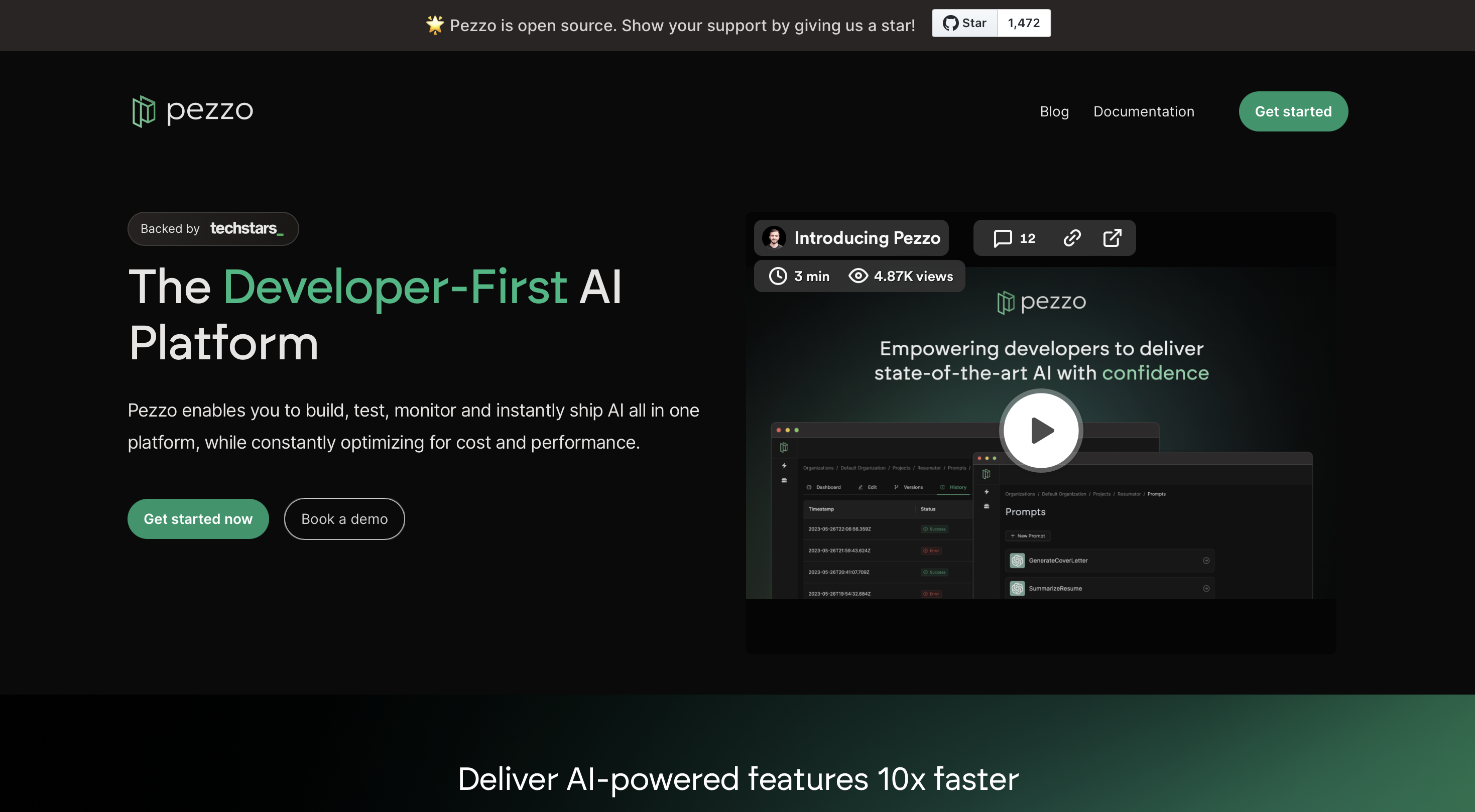

Pezzo utmerker seg som en utvikler-første AI-plattform, som redefinerer hvordan AI-funksjoner utformes, testes, overvåkes og distribueres.

Den er designet for å optimere kostnadene og ytelsen samtidig som den forbedrer AI-utviklingseffektiviteten.

Pezzo lover opptil ti ganger raskere levering takket være sine potente egenskaper, som muliggjør en betydelig akselerasjon i tilførselen av AI-drevne evner.

Det sentraliserte hurtigstyringssystemet ligger i hjertet av Pezzos funksjonalitet.

Denne løsningen, som følger med versjonskontroll og umiddelbare produksjonsdistribusjonsmuligheter, muliggjør effektiv behandling av alle AI-meldinger på ett sted.

For team som prøver å holde konsistens på tvers av prosjekter og optimalisere AI-operasjoner, er denne evnen avgjørende. Pezzo tilbyr også observerbarhetsverktøy for å forstå effektiviteten, kostnadene og kaliberet til AI-aktiviteter.

Utviklere kan lykkes med å optimalisere ressurser med sin dype kunnskap til raske kjøringer. En annen viktig komponent i Pezzos ferdigheter er feilsøking.

Feilsøkingstiden reduseres betraktelig ettersom den muliggjør sanntidsinspeksjon av raske henrettelser. Samarbeidsverktøy er inkludert i denne funksjonen for å hjelpe team til å jobbe jevnt og unisont for å produsere kraftige AI-funksjoner.

Like varierte som Pezzos funksjoner er, er brukssakene. For å gjøre det mulig for utviklere å bruke AI-modeller fullt ut i apper, tilbyr den en åpen kildekode-verktøykasse for fremskyndet AI-utvikling.

Nøkkelfunksjoner inkluderer sentralisert promptadministrasjon, effektiv promptoppretting og versjonering, umiddelbare distribusjoner, grundig observerbarhet, effektiv feilsøking og kostnadstransparens.

Den kan brukes i en rekke utviklingssammenhenger fordi den støtter en rekke klienter, som Python og Node.js. Et eksempel på plattformens effektivitet og brukervennlighet er dens rettidige administrasjonsinstruksjoner.

AI-aktiviteter kan administreres fullt ut av brukere, inkludert versjonskontroll, rask levering, rask generering og overvåking. For å opprette en ledetekst, må den først konstrueres ved hjelp av ledetekstredigereren.

Deretter må den testes i Pezzo, parameterne justeres for best ytelse, så blir den forpliktet og publisert.

Denne forenklede prosedyren garanterer at hver publisert forespørsel vil fungere etter hensikten, med minst mulig kode.

6. MindsDB

MindsDB er en banebrytende virtuell database med åpen kildekode som representerer et betydelig fremskritt innen dataadministrasjon og AI.

Den er unik på grunn av sin kreative måte å smelte sammen AI-algoritmer med sanntidsdata. "Jobs" og "AI Tables", to banebrytende komponenter, muliggjør denne jevne integreringen av data og AI.

Sanntidsdataaktiviteter kan lettere orkestreres ved hjelp av Jobs, og sanntidsdata og AI-modeller kan kobles direkte til AI-tabeller.

En indikasjon på MindsDBs tilpasningsevne er de mer enn 70 teknologiske og datagrensesnittene den har med toppdatabaser og plattformer, som MariaDB, MySQL, PostgreSQL, ClickHouse, Microsoft SQL Server og Snowflake.

Dens allsidighet inkluderer også interoperabilitet med flere BI-verktøy, som Microsoft Power BI, SAS, Qlik Sense, Looker og Domo.

MindsDB utvider funksjonaliteten ved å støtte Lightwood, en dyp læringsramme basert på PyTorch.

Med en forenklet tilnærming som tar imot utviklere, strømlinjeformer MindsDB prosessen med å utvikle AI-applikasjoner.

Det utmerker seg ved å gjøre det mulig for utviklere å kommunisere med AI-modeller ved hjelp av velkjente SQL-uttrykk, noe som reduserer kompleksiteten som ofte er forbundet med maskinlæring.

Dens kompatibilitet med flere AI-rammeverk og modeller, som TensorFlow, PyTorch og OpenAIs GPT-3, utfyller denne tilnærmingens brukervennlighet.

Plattformen gjør det også enklere å lansere AI-applikasjoner uten infrastrukturoppsett ved å automatisere et bredt spekter av AI-aktiviteter, fra dataforbehandling og modelltrening til konklusjon.

Ved å tilby et gjenkjennelig grensesnitt og filtrere ut kompleksiteten til maskinlæring, fremskynder det etableringen av AI-applikasjoner.

Et oppsett uten infrastruktur effektiviserer distribusjonen av AI-applikasjoner, og øker prosesseffektiviteten. Videre er MindsDB skalerbar og i stand til å møte behovene til sofistikerte AI-applikasjoner.

MindsDB tilbyr et bredt spekter av applikasjoner i den virkelige verden. Den kan brukes til å bygge intelligente chatbots som virkelig og vellykket engasjerer folk.

7. Mars

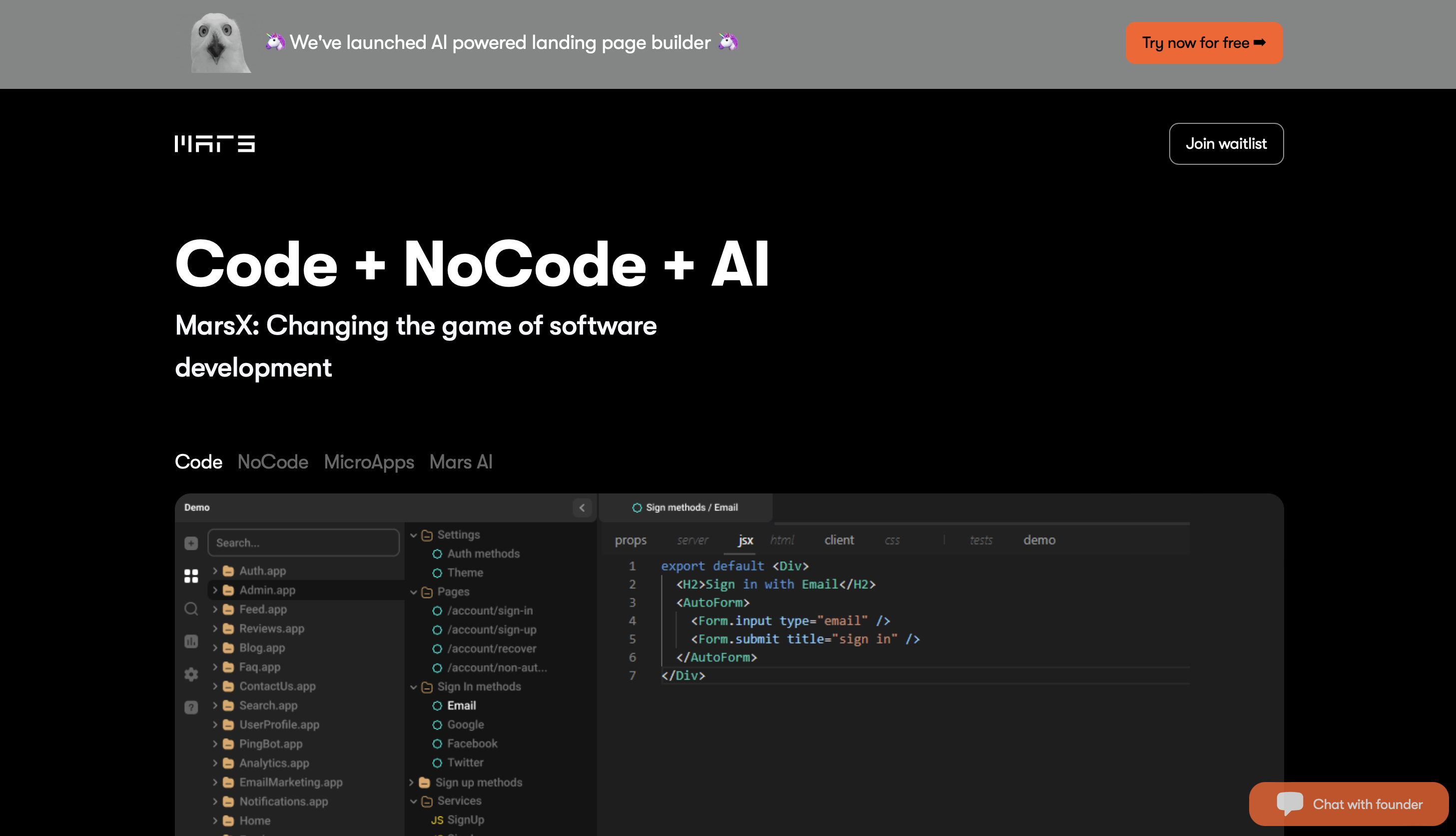

MarsX er en banebrytende plattform for programvareutvikling som transformerer prosessen med å lage mobile og online applikasjoner.

Grunnleggende er nødvendigheten av effektiv kodegjenbruk problemet som MarsX forsøker å løse i programmering.

Til tross for tilgjengeligheten av rammeverk og kodebiter fra nettsteder som Stack Overflow, er en stor prosentandel av prosjektkoden tradisjonelt utviklet fra bunnen av.

Ineffektiviteten i utviklingsprosessen førte til grunnleggelsen av MarsX, et selskap som tilbyr fullstack-biblioteker, eller programvareutviklingssett (SDK) som integrerer frontend- og backend-komponenter.

For enkel bruk og forståelse har MarsX standardisert disse fullstack-bibliotekene, som er avgjørende for omfattende programvareløsninger.

MarsX erkjenner at utviklere er opptatt av å eksperimentere med nye verktøy, men ikke til prisen av en betydelig tidsinvestering, og sørger for at disse bibliotekene raskt kan testes ut.

En rekke mikroapper, eller korte, spesialiserte programmer laget av eksterne utviklere, er tilgjengelig på plattformens markedsplass.

Ved å tilby forhåndslagde, utmerkede løsninger i stedet for å kreve at utviklere skal bygge fra bunnen av, sparer disse mikroappene – for eksempel chatteprogrammer eller kloner av kjente nettsteder som Airbnb eller Instagram – utviklerne for tid.

Blandingen av No Code, Low Code, Custom Code og AI som MarsX tilbyr, skiller den fra hverandre. Denne tilpasningsevnen gjør det mulig for programmerere å designe komplekse nett- og mobilapper på forskjellige nivåer for koding.

Det er ikke lenger nødvendig å bytte mellom mange integrerte utviklingsmiljøer (IDE-er) takket være plattformen, som gjør det enklere å modifisere disse mikroappene ved å tilby et enhetlig miljø.

For å lette sanntidskompilering og oppdatering av mikroapper har plattformen også et eget integrert utviklingsmiljø (IDE).

MarsXs vekt på brukervennlighet gjør den ideell for startups og utviklere som trenger å bygge og oppdatere apper raskt.

8. Vanna AI

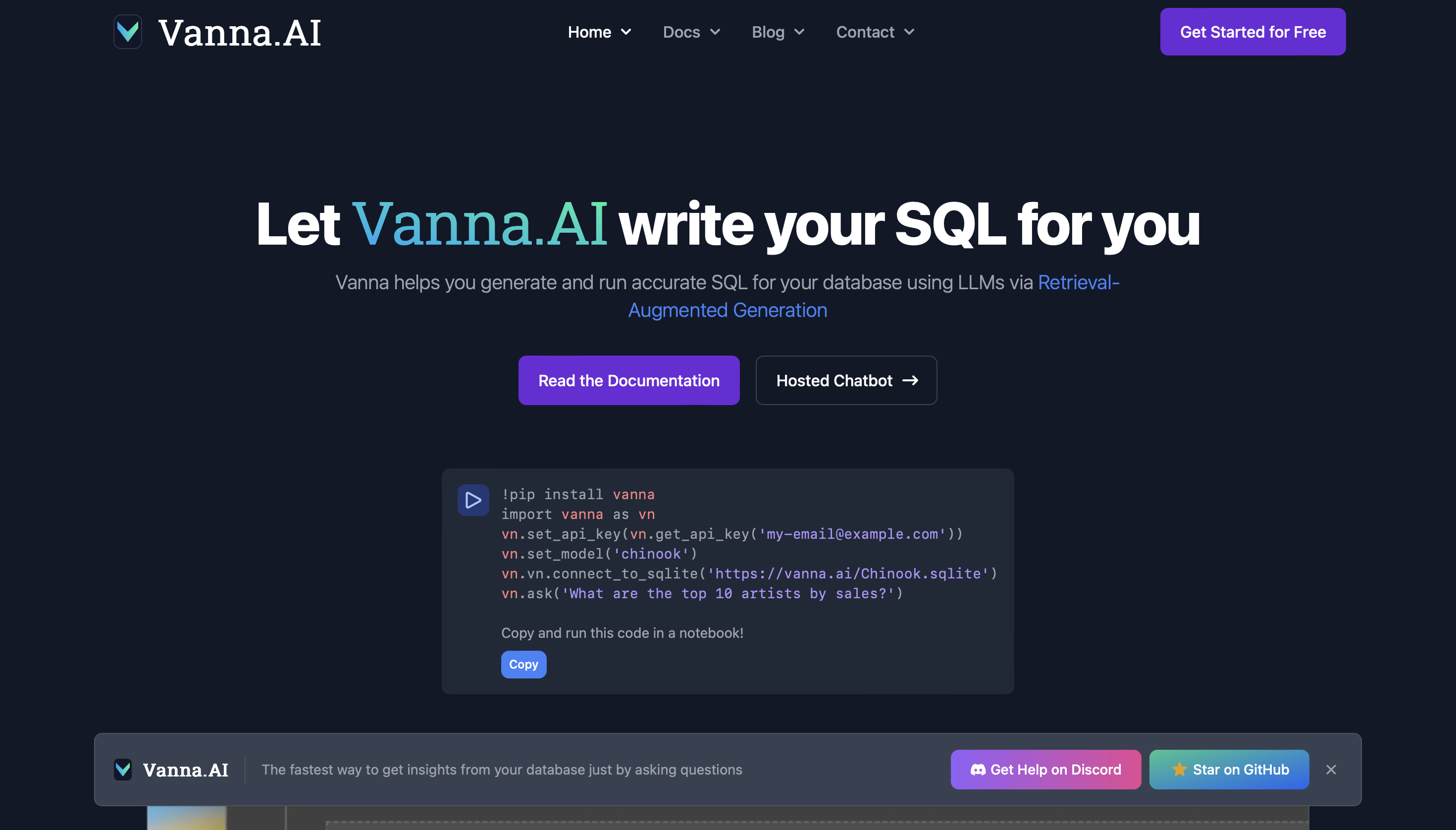

Vanna AI er en kraftig AI-drevet business intelligence-assistent som endrer måten vi samhandler med datasett på.

Denne toppmoderne teknologien bruker store språkmodeller (LLM) for å produsere og kjøre presise SQL-spørringer for databasen din.

Vanna er unik fordi den justerer ytelsen basert på treningsdataene som leveres, noe som gir stor nøyaktighet selv på kompliserte datasett.

Dette innebærer at Vanna er stadig flinkere til å håndtere og forstå kompliserte datastrukturer jo mer data du mater den.

Vanna AI er kjent for å legge vekt på sikkerhet og personvern. Databaseinnholdet ditt holdes privat siden LLM bare fungerer med metadata, som skjemaer, dokumentasjon og spørringer, mens den samhandler med databasen.

I tillegg gir Vanna AI deg friheten til å bygge tilkoblinger for enhver database og kommer med innebygd støtte for kjente databaser som BigQuery, Postgres og Snowflake.

Dette gjør det til et enormt tilpasningsdyktig instrument for et omfattende utvalg av databehandlingskrav. Plattformen har tilsvarende enestående integrasjonsmuligheter.

Vanna kan brukes til å starte i en Jupyter Notebook og deretter utvides til bedriftskunder som bruker forskjellige grensesnitt som f.eks. nettapplikasjoner, Streamlit-apper eller Slackbot.

Det er et flott alternativ for en rekke bedriftsinnstillinger, fra oppstart til store organisasjoner, på grunn av dens allsidighet.

Vanna AI tar sikte på å eliminere behovet for intrikate SQL- eller Python-spørringer ved å gjøre det enkelt å trekke ut innsikt fra databasen ved å stille spørsmål.

9 Gradio

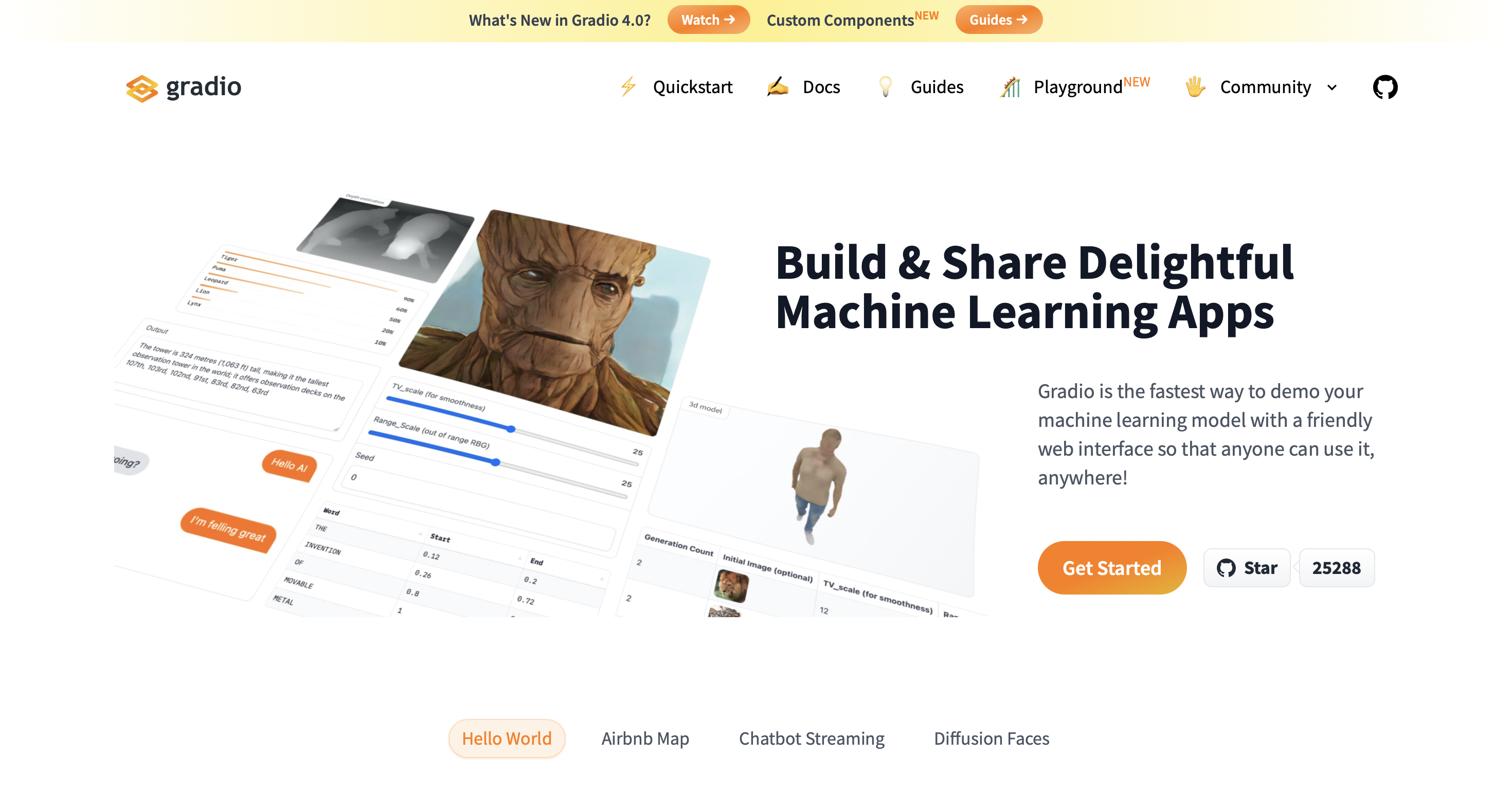

Gradio er et fleksibelt og banebrytende verktøy for datavitenskap og maskinlæring som revolusjonerer måten modeller brukes og presenteres på.

Med mer enn tretti forhåndsbygde komponenter og et stort antall nye, gjør Gradio det enklere å lage interaktive demonstrasjoner for ulike typer data.

Gradio skiller seg ut ved jevnt å bytte komponentene mellom statiske og interaktive moduser avhengig av om de brukes som innganger eller utganger i en demonstrasjon.

Du kan unngå hodepinen ved å måtte identifisere hver komponents natur manuelt takket være dens automatiserte deteksjon.

Gradio yter også eksepsjonelt godt i forberedelse og etterbehandling, og transformerer data mellom formater som er passende for brukerinteraksjon og funksjonsbehov med letthet.

Denne funksjonaliteten er avgjørende for oppgaver som å laste opp bilder eller presentere et bildegalleri i brukerens nettleser.

For kjente apper må det integrerte køsystemet kunne støtte tusenvis av samtidige brukere.

Det finnes måter du kan administrere køen på, for eksempel å begrense hvor mange forespørsler som kan håndteres samtidig. Fordi mange maskinlæringsrutiner bruker mye minne og krever regulert tilgang i tider når brukeraktiviteten er høy, er dette spesielt fordelaktig.

Gradio tillater bruk av generatorfunksjoner i situasjoner der du trenger en rekke utganger, for eksempel i chatbots eller bildegenererende modeller.

Den interaktive opplevelsen kan forbedres ved å bruke denne kapasiteten til å presentere iterative resultater.

Gradio er også i stand til å håndtere strømmeinnganger, for eksempel lydstrømmer i sanntid eller modeller for å generere bilder som svar på kommandoinngang.

Du har også kontroll over hvordan brukeren ser fremdriftsoppdateringer takket være plattformens støtte for konfigurerbare fremdriftslinjer.

Denne funksjonaliteten er svært nyttig for oppgaver som krever mye behandlingstid, inkludert kompliserte beregninger eller dataanalyse.

Gradios evne til å spore fremgang er ytterligere forbedret ved å inkludere tqdm-biblioteket, som gir visuell tilbakemelding på oppgaveprogresjon.

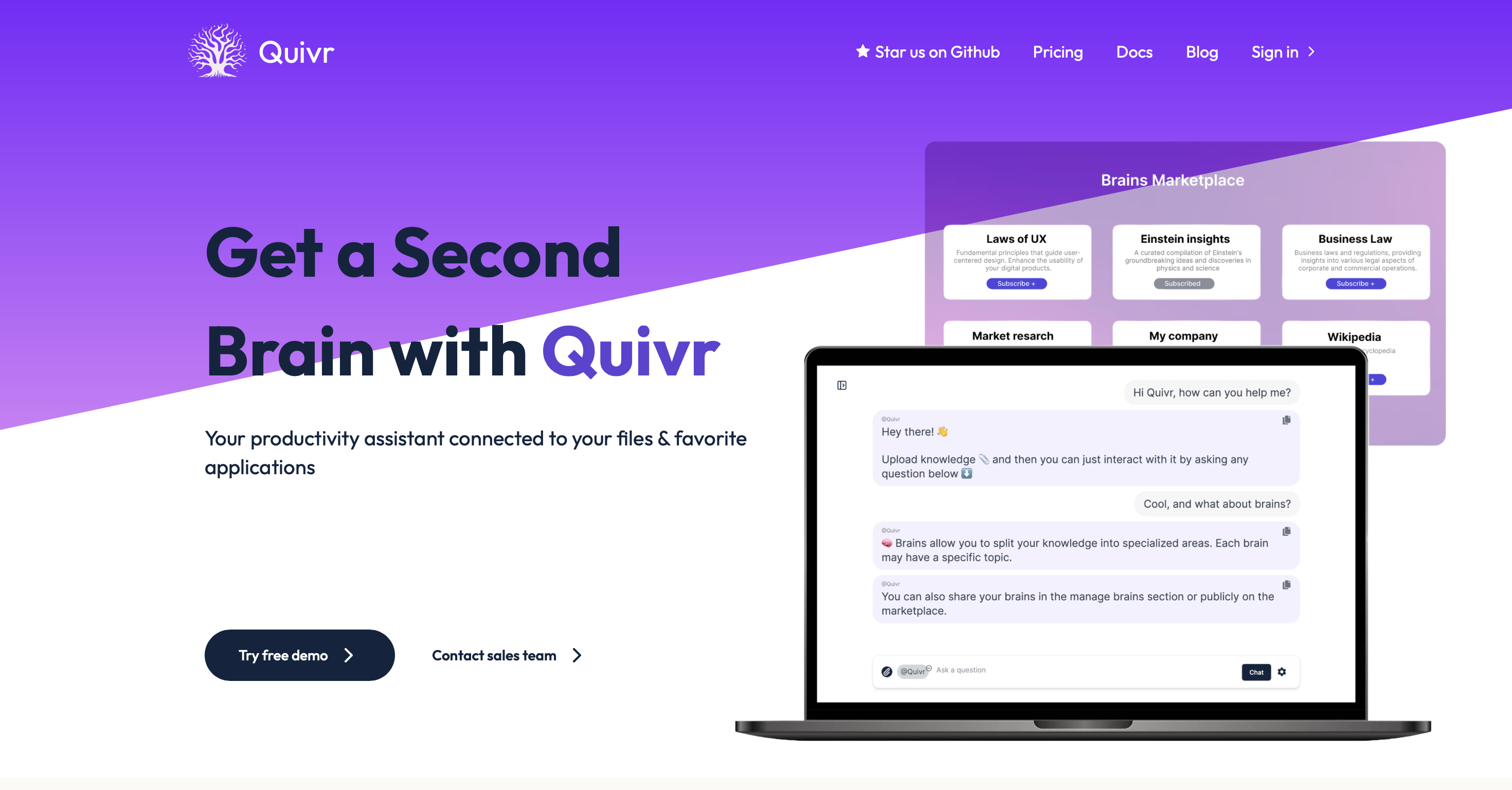

10 Quivr

Quivr fremstår som en spillendrende plattform som posisjonerer seg som din "Second Brain" og personlige assistent, noe som gjør den egnet for samarbeidende programvareutvikling.

Rask oppsett og enkle funksjoner gjør dette åpen kildekodeverktøyet til en stor ressurs for alle som jobber i store utviklingsteam eller åpen kildekodesamfunn.

Quivr er veldig enkelt å bruke; du kan registrere deg med Google-kontoen din på mindre enn fem sekunder. Du kan engasjere deg i dataene dine ved å stille spørsmål om filene dine på plattformen, noe som også gjør filopplasting enklere.

Quivr betjener mer enn 30,000 4,000 mennesker og XNUMX XNUMX virksomheter, og er i forkant av AI-innovasjon ved å bruke Foundation Models og Generative AI.

Blant de 100 beste åpen kildekode-prosjektene betjener denne fellesskapsdrevne plattformen over 26,000 XNUMX utviklere. Quivr gir et stabilt miljø for utvikling av neste generasjons AI-applikasjoner, og utmerker seg ved å gjøre det mulig for organisasjoner å fullt ut bruke AI for innovasjon.

Som en digital assistent som støtter beslutningstaking og automatiserer kjedelige prosesser, fungerer Quivr som mer enn bare en plattform for utvikling. Dette bidrar til å øke bedriftens effektivitet.

Quivrs åpen kildekode-design oppmuntrer fellesskapets deltakelse i funksjonsforespørsler, feilrapporter og dokumentasjon.

Åpenhet og samarbeidsutvikling er garantert av enkel tilgang til kildekoden på GitHub. Denne strategien fremmer konstant innovasjon og plattformforbedring i tillegg til en følelse av fellesskap.

konklusjonen

Åpen kildekode AI og dens effekter på miljøet, med fokus på hvordan den demokratiserer teknologisk utvikling og oppmuntrer til samarbeid mellom fans, forskere og utviklere.

Alle kan bruke, endre og distribuere AI-teknologi ved å bruke åpen kildekode-plattformer, noe som har ført til opprettelsen av blomstrende innovasjonssentre på nettsteder som GitHub.

TensorFlow, et verktøy som setter fart på AI-forskning og innovasjon, er ett eksempel, i likhet med en rekke åpen kildekode-plattformer som Gradio, Quivr, ChatDev, Flowise AI, Pezzo, MarsX, Vanna AI og AbanteAI (Mentat).

Disse systemene letter AI-drevet programvareutvikling for de med liten eller ingen kodekunnskap, forbedrer maskinlæringsmodeller og tilbyr AI-drevet kodingsstøtte.

Spesielt for startups gir de fordeler, inkludert kostnadseffektivitet, fleksibilitet og økt produktivitet.

I tillegg til å akselerere forskning og kommersiell etablering, åpner denne demokratiseringen av AI-teknologi tilgang til et bredere publikum, og endrer AI fra et spesialisert felt for noen utvalgte til et samarbeidsprosjekt.

Legg igjen en kommentar