Inhoudsopgave[Zich verstoppen][Laten zien]

Vectordatabases vertegenwoordigen een aanzienlijke verschuiving in de manier waarop we gegevens beheren en interpreteren, vooral op het gebied van kunstmatige intelligentie en machinaal leren.

De fundamentele functie van deze databases is het effectief omgaan met hoogdimensionale vectoren, die het ruwe materiaal vormen van machine learning-modellen en de conversie van tekst-, beeld- of audio-invoer naar numerieke representaties in een multidimensionale ruimte omvatten.

Voor toepassingen als aanbevelingssystemen, objectherkenning, het ophalen van afbeeldingen en fraudedetectie omvat deze transformatie meer dan alleen opslag; het is een toegangspoort tot krachtige mogelijkheden bij het zoeken naar overeenkomsten en zoekopdrachten naar de dichtstbijzijnde buur.

Sterker nog, de kracht van vectordatabases ligt in hun vermogen om grote hoeveelheden ongestructureerde, gecompliceerde gegevens te vertalen in vectoren die de context en betekenis van de oorspronkelijke inhoud vastleggen.

De verbeterde zoekfuncties die mogelijk worden gemaakt door modellen in deze codering in te sluiten, omvatten de mogelijkheid om omringende vectoren te doorzoeken om gerelateerde afbeeldingen of zinsneden te vinden.

Vectordatabases zijn uniek omdat ze zijn gebouwd op geavanceerde indexeringstechnieken zoals Inverted File Index (IVF) en Hierarchical Navigable Small World (HNSW), wat hun snelheid en efficiëntie verbetert terwijl ze de dichtstbijzijnde buren in N-dimensionale ruimtes lokaliseren.

Er is een duidelijk verschil tussen vector- en klassieke databases. Conventionele databases zijn uitstekend in het organiseren van gegevens in georganiseerde sets die CRUD-geoptimaliseerd zijn en zich houden aan vaste schema's.

Wanneer we echter te maken krijgen met de dynamische en gecompliceerde aard van hoogdimensionale gegevens, begint deze rigiditeit een belemmering te worden.

Vectordatabases bieden daarentegen een mate van flexibiliteit en efficiëntie die traditionele equivalenten niet kunnen evenaren, vooral voor toepassingen die sterk afhankelijk zijn machine learning en kunstmatige intelligentie. Ze zijn niet alleen schaalbaar en bedreven in het zoeken naar overeenkomsten.

Vectordatabases zijn vooral nuttig voor generatieve AI-toepassingen. Om te garanderen dat het gemaakte materiaal de contextuele integriteit behoudt, zijn deze toepassingen – waaronder natuurlijke taalverwerking en het genereren van afbeeldingen – afhankelijk van het snel ophalen en vergelijken van inbedding.

In dit stuk zullen we dus kijken naar de beste vectordatabases voor uw volgende project.

1. Milvus

Milvus is een baanbrekende open-source vectordatabase die voornamelijk is ontworpen voor AI-toepassingen, inclusief ingebedde overeenkomstenzoekopdrachten en krachtige MLOps.

Het verschilt van conventionele relationele databases, die voornamelijk gegevens verwerken gestructureerde gegevens, vanwege deze capaciteit, waardoor het vectoren op een ongekende schaal van biljoenen kan indexeren.

De toewijding van Milvus aan schaalbaarheid en hoge beschikbaarheid blijkt uit de manier waarop het zich heeft ontwikkeld vanaf de eerste versie tot het volledig gedistribueerde, cloud-native Milvus 2.0.

Concreet vertoont Milvus 2.0 een volledig cloud-native ontwerp dat streeft naar een verbazingwekkende beschikbaarheid van 99.9% terwijl het verder kan schalen dan honderden knooppunten.

Voor degenen die op zoek zijn naar een betrouwbare vectordatabaseoplossing, wordt deze editie ten zeerste aanbevolen, omdat deze niet alleen geavanceerde functies toevoegt, zoals een multi-cloudverbinding en een administratief paneel, maar ook de gegevensconsistentieniveaus verbetert voor flexibele applicatieontwikkeling.

Een opmerkelijk voordeel van Milvus is de gemeenschapsgestuurde aanpak, die meertalige ondersteuning biedt en een uitgebreide toolchain die is afgestemd op de eisen van ontwikkelaars.

In de IT-sector maken de schaalbaarheid en betrouwbaarheid van de cloud, samen met de krachtige vectorzoekmogelijkheden op grote datasets, het tot een populaire optie.

Bovendien verbetert het de efficiëntie van zijn activiteiten met behulp van een hybride zoekmogelijkheid die het zoeken naar vectorgelijkenis combineert met scalaire filtering.

Milvus beschikt over een administratief panel met een duidelijke gebruikersinterface, een volledige set API's en een schaalbare en afstembare architectuur.

De communicatie met externe applicaties wordt vergemakkelijkt door de toegangslaag, terwijl de taakverdeling en het gegevensbeheer worden gecoördineerd door de coördinatordienst, die als centraal commando fungeert.

De duurzaamheid van de database wordt ondersteund door de objectopslaglaag, terwijl werkknooppunten activiteiten uitvoeren om schaalbaarheid te garanderen.

Prijzen

Het is voor iedereen gratis te gebruiken.

2. FAISS

Het AI Research-team van Facebook heeft een geavanceerde bibliotheek ontwikkeld met de naam Facebook AI Likenity Search, die is ontworpen om het zoeken naar dichte vectorclusters en gelijkenissen effectiever te maken.

De oprichting ervan werd gedreven door de eis om de zoekmogelijkheden van Facebook AI te verbeteren door gebruik te maken van geavanceerde fundamentele methodologieën.

Vergeleken met CPU-gebaseerde implementaties kan de ultramoderne GPU-implementatie van FAISS de zoektijden vijf tot tien keer versnellen, waardoor het een hulpmiddel van onschatbare waarde is voor een verscheidenheid aan toepassingen, waaronder aanbevelingssystemen en de identificatie van vergelijkbare betekenissen in aanzienlijke hoeveelheden. ongestructureerde datasets zoals tekst, audio en video.

FAISS kan een breed scala aan gelijkenismetrieken verwerken, zoals cosinusgelijkenis, inproduct en de veelgebruikte L2-metriek (Euclidische afstand).

Deze metingen maken het eenvoudiger om nauwkeurig en flexibel naar overeenkomsten te zoeken tussen verschillende soorten gegevens. Functies zoals batchverwerking, compromissen tussen precisie en snelheid en ondersteuning voor zowel nauwkeurige als geschatte zoekopdrachten vergroten de flexibiliteit nog verder.

Bovendien biedt FAISS een schaalbare methode voor het verwerken van enorme datasets door het mogelijk te maken dat indexen op schijf worden opgeslagen.

Het omgekeerde bestand, productkwantisering (PQ) en verbeterde PQ zijn slechts enkele van de innovatieve technieken die de onderzoeksbasis van FAISS vormen en bijdragen aan de effectiviteit ervan als het gaat om het indexeren en doorzoeken van hoogdimensionale vectorvelden.

Deze strategieën worden versterkt door geavanceerde benaderingen zoals GPU-versnelde k-selectie-algoritmen en voorfiltering van PQ-afstanden, waardoor het vermogen van FAISS wordt gegarandeerd om snelle en nauwkeurige zoekresultaten te produceren, zelfs in datasets op miljarden schaal.

Prijzen

Het is voor iedereen gratis te gebruiken.

3. pinecone

Pinecone is toonaangevend op het gebied van vectordatabases en biedt een cloud-native, beheerde service die speciaal is gebouwd om de prestaties van krachtige AI-applicaties te verbeteren.

Het is specifiek ontworpen om vectorinbedding te verwerken, die essentieel zijn voor generatieve AI, semantisch zoeken en toepassingen die gebruik maken van enorme taalmodellen.

AI kan nu semantische informatie begrijpen dankzij deze inbedding, die effectief fungeert als langetermijngeheugen voor gecompliceerde taken.

Pinecone is uniek omdat het de mogelijkheden van traditionele databases naadloos integreert met de verbeterde prestaties van vectorindexen, waardoor de efficiënte en grootschalige opslag en bevraging van inbedding mogelijk wordt.

Dit maakt het de perfecte optie in situaties waarin de complexiteit en het volume van de betrokken gegevens standaard scalaire databases ontoereikend maken.

Pinecone biedt ontwikkelaars een probleemloze oplossing vanwege de managed service-aanpak, die de integratie en realtime gegevensinvoerprocedures stroomlijnt.

Er worden talloze gegevensbewerkingen door ondersteund, waaronder het ophalen, bijwerken, verwijderen, opvragen en bijwerken van gegevens.

Pinecone garandeert verder dat zoekopdrachten die realtime wijzigingen vertegenwoordigen, zoals upserts en verwijderingen, correcte antwoorden met lage latentie opleveren voor indexen met miljarden vectoren.

In dynamische situaties is deze functie essentieel voor het behouden van de relevantie en actualiteit van de zoekopdrachtresultaten.

Bovendien vergroot de samenwerking van Pinecone met Airbyte via de Pinecone-verbinding de veelzijdigheid en flexibiliteit, waardoor een soepele gegevensintegratie uit een reeks bronnen mogelijk wordt.

Door deze relatie kunnen de kosten en efficiëntie worden geoptimaliseerd door ervoor te zorgen dat alleen nieuw verworven informatie wordt verwerkt via incrementele gegevenssynchronisatie.

Het ontwerp van de connector benadrukt eenvoud, er zijn slechts minimale instelparameters nodig, en de connector is uitbreidbaar, waardoor toekomstige verbeteringen mogelijk zijn.

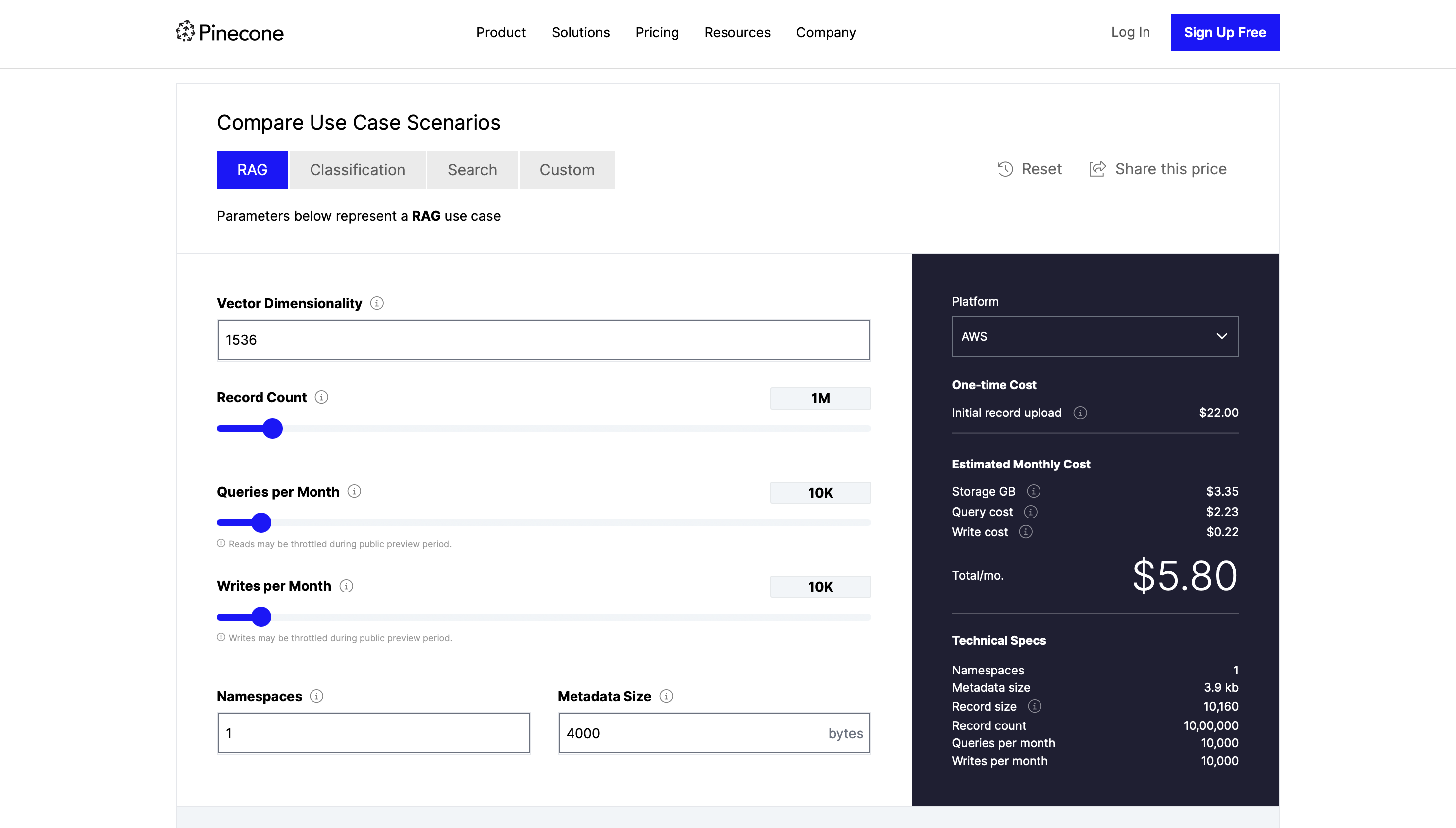

Prijzen

De premiumprijzen beginnen vanaf $ 5.80/maand voor de RAG-gebruikscasus.

4. Weviaten

Weaviate is een innovatieve vectordatabase die beschikbaar is als open-sourcesoftware en die de manier verandert waarop we toegang krijgen tot gegevens en deze gebruiken.

Weaviate maakt gebruik van vectorzoekmogelijkheden, die geavanceerde, contextbewuste zoekopdrachten in grote, gecompliceerde datasets mogelijk maken, in tegenstelling tot typische databases die afhankelijk zijn van scalaire waarden en vooraf gedefinieerde zoekopdrachten.

Met deze methode kunt u inhoud lokaliseren op basis van hoe vergelijkbaar deze is met andere inhoud, waardoor de intuïtiviteit van zoekopdrachten en de relevantie van de resultaten worden verbeterd.

De soepele integratie met machine learning-modellen is een van de belangrijkste kenmerken; hierdoor kan het functioneren als meer dan alleen een oplossing voor gegevensopslag; het maakt het ook mogelijk gegevens te begrijpen en te analyseren met behulp van kunstmatige intelligentie.

De architectuur van Weaviate integreert deze integratie grondig, waardoor het mogelijk wordt om complexe data te analyseren zonder gebruik te maken van aanvullende tools.

De ondersteuning voor grafische datamodellen biedt ook een ander perspectief op data als gekoppelde entiteiten, waardoor patronen en inzichten aan het licht komen die in conventionele database-architecturen gemist zouden kunnen worden.

Dankzij de modulaire architectuur van Weaviate kunnen klanten indien nodig mogelijkheden toevoegen zoals datavectorisatie en het maken van back-ups.

De fundamentele versie functioneert als een database voor vectorgegevensspecialisten en kan worden uitgebreid met andere modules om aan verschillende behoeften te voldoen.

De schaalbaarheid wordt verder verbeterd door het modulaire ontwerp, dat garandeert dat de snelheid niet wordt opgeofferd als reactie op de toenemende gegevenshoeveelheden en vraagvereisten.

Een veelzijdige en effectieve methode voor interactie met de opgeslagen gegevens wordt mogelijk gemaakt door de ondersteuning van de database voor zowel RESTful- als GraphQL-API's.

GraphQL is met name geselecteerd vanwege zijn vermogen om snel ingewikkelde, op grafieken gebaseerde zoekopdrachten uit te voeren, waardoor gebruikers precies de gegevens kunnen verkrijgen die ze willen zonder overmatige of onvoldoende hoeveelheden gegevens te verkrijgen.

Weaviate is gebruiksvriendelijker in een verscheidenheid aan clientbibliotheken en programmeertalen dankzij de flexibele API.

Voor degenen die Weaviate verder willen verkennen, is er een overvloed aan documentatie en tutorials beschikbaar, van het opzetten en configureren van uw instance tot diepe duiken in de mogelijkheden ervan, zoals vectorzoeken, machine learning-integratie en schema-ontwerp.

U heeft toegang tot dezelfde krachtige technologie die informatie dynamisch en bruikbaar maakt, ongeacht of u besluit Weaviate lokaal te exploiteren cloud computing omgeving, of via de door Weaviate beheerde cloudservice.

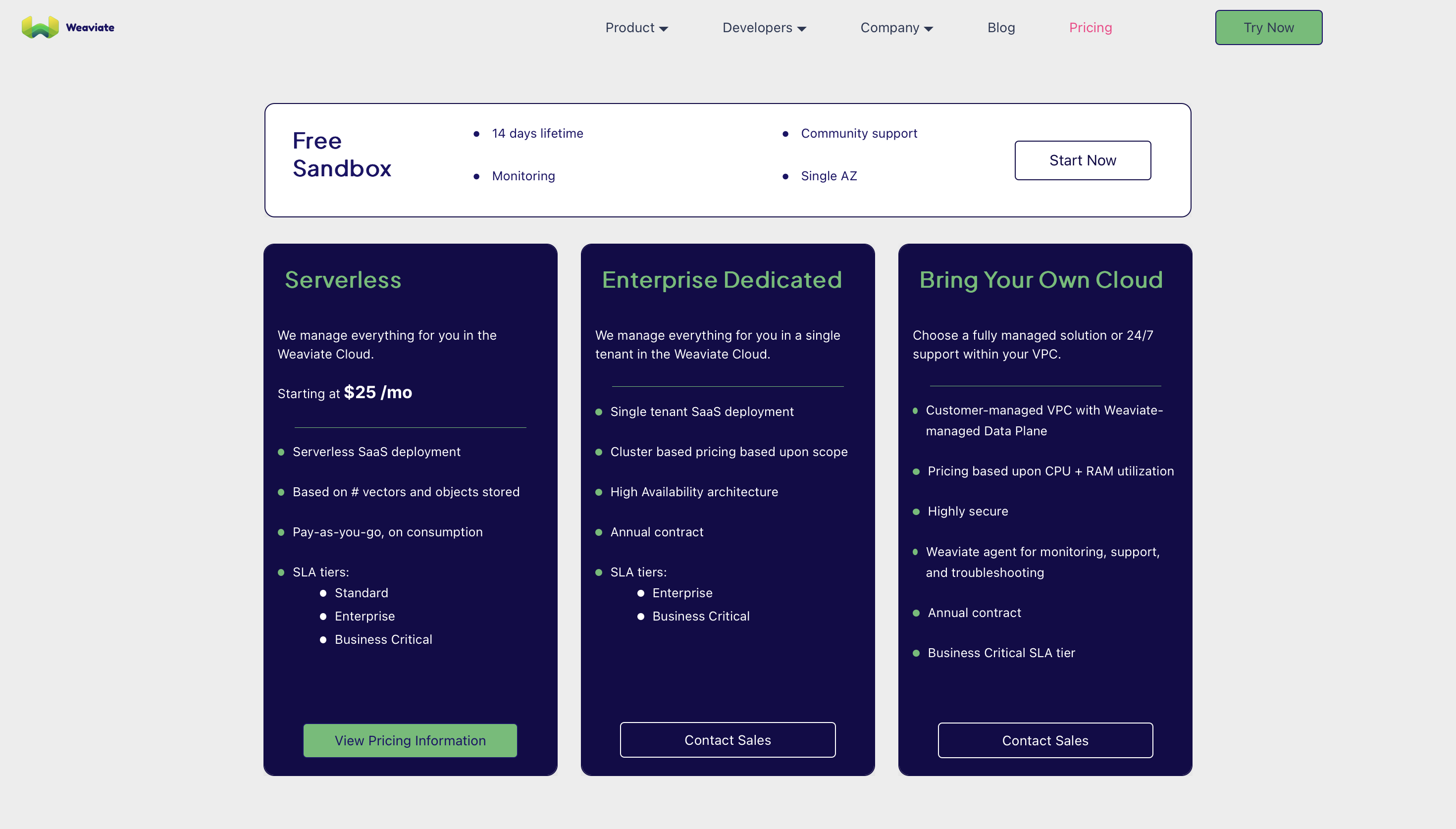

Prijzen

De premiumprijzen van het platform beginnen vanaf $ 25/maand voor serverloos.

5. Chroma

Chroma is een geavanceerde vectordatabase die tot doel heeft het ophalen en opslaan van gegevens radicaal te veranderen, met name voor toepassingen waarbij machine learning en kunstmatige intelligentie betrokken zijn.

Omdat Chroma werkt met vectoren in plaats van scalaire getallen, is het, in tegenstelling tot standaarddatabases, zeer goed in het beheren van hoogdimensionale, gecompliceerde gegevens.

Dit is een belangrijke vooruitgang in de technologie voor het ophalen van gegevens, omdat hiermee geavanceerdere zoekopdrachten mogelijk zijn op basis van de semantische gelijkenis van het materiaal in plaats van op nauwkeurige trefwoordovereenkomsten.

Een opvallend kenmerk van Chroma is de mogelijkheid om met verschillende onderliggende opslagoplossingen te werken, zoals ClickHouse voor geschaalde instellingen en DuckDB voor stand-alone installaties, waardoor flexibiliteit en aanpassing aan verschillende gebruiksscenario's worden gegarandeerd.

Chroma is gemaakt met eenvoud, snelheid en analyse in gedachten. Het is beschikbaar voor een breed spectrum aan ontwikkelaars met SDK's voor Python en JavaScript/TypeScript.

Bovendien legt Chroma sterk de nadruk op gebruiksvriendelijkheid, waardoor ontwikkelaars snel een permanente database kunnen opzetten, ondersteund door DuckDB, of een in-memory database om te testen.

De mogelijkheid om verzamelobjecten te bouwen die lijken op tabellen in conventionele databases, waar tekstgegevens kunnen worden ingevoegd en automatisch kunnen worden omgezet in inbedding met behulp van modellen zoals all-MiniLM-L6-v2, vergroot deze veelzijdigheid nog verder.

Tekst en insluitingen kunnen naadloos worden geïntegreerd, wat essentieel is voor toepassingen die datasemantiek moeten begrijpen.

De basis van Chroma's vectorgelijkenismethode zijn de wiskundige concepten van orthogonaliteit en dichtheid, die essentieel zijn voor het begrijpen van de representatie en vergelijking van gegevens in databases.

Met deze ideeën kan Chroma zinvolle en efficiënte overeenkomstenonderzoeken uitvoeren door rekening te houden met de semantische koppelingen tussen gegevenselementen.

Hulpbronnen zoals tutorials en richtlijnen zijn toegankelijk voor personen die Chroma verder willen verkennen. Ze bevatten stapsgewijze richtlijnen voor het opzetten van de database, het maken van collecties en het uitvoeren van overeenkomstenzoekopdrachten.

Prijzen

Je kunt het gratis gaan gebruiken.

6. Vespa

Vespa is een platform dat de online verwerking van AI en grote data transformeert.

Het fundamentele doel van Vespa is het mogelijk maken van berekeningen met lage latentie voor grote datasets, waardoor u eenvoudig tekst-, vector- en gestructureerde gegevens kunt opslaan, indexeren en analyseren.

Vespa onderscheidt zich door zijn vermogen om op elke schaal snelle antwoorden te geven, ongeacht de aard van de vragen, keuzes of machinaal geleerde modelconclusies die worden afgehandeld.

De flexibiliteit van Vespa komt tot uiting in de volledig functionele zoekmachine en vectordatabase, die veel zoekopdrachten binnen één enkele zoekopdracht mogelijk maken, variërend van vector- (ANN), lexicale en gestructureerde gegevens.

Ongeacht de schaal kunt u gebruiksvriendelijke en responsieve zoek-apps maken met realtime AI-mogelijkheden dankzij deze integratie van machinaal geleerde modelinferentie met uw gegevens.

Vespa gaat echter over meer dan alleen maar zoeken; het gaat ook over het begrijpen en aanpassen van ontmoetingen.

Eersteklas aanpassings- en suggestietools bieden dynamische, actuele aanbevelingen die zijn afgestemd op specifieke gebruikers of omstandigheden.

Vespa is een game-changer voor iedereen die ook de conversatie-AI-ruimte wil betreden, omdat het de infrastructuur biedt die nodig is om tekst- en vectorgegevens in realtime op te slaan en te verkennen, waardoor de ontwikkeling van meer geavanceerde en praktische AI-agents mogelijk wordt.

Met uitgebreide tokenisatie en stammen worden zoekopdrachten in volledige tekst, zoekopdrachten naar de dichtstbijzijnde buur en gestructureerde dataquery's allemaal ondersteund door de uitgebreide querymogelijkheden van het platform.

Het verschil is dat het ingewikkelde zoekopdrachten effectief kan afhandelen door verschillende zoekdimensies te combineren.

Vespa is een rekenkrachtcentrale voor AI- en machine learning-toepassingen, omdat de rekenmachine complexe wiskundige uitdrukkingen over scalaires en tensoren aankan.

In bedrijf is Vespa gemaakt om eenvoudig te gebruiken en uitbreidbaar te zijn.

Het stroomlijnt repetitieve processen, variërend van systeemconfiguratie en applicatieontwikkeling tot data- en knooppuntbeheer, waardoor veilige en ononderbroken productieactiviteiten mogelijk zijn.

De architectuur van Vespa zorgt ervoor dat het apparaat meegroeit met uw gegevens, waardoor de betrouwbaarheid en prestaties behouden blijven.

Prijzen

Je kunt het gratis gaan gebruiken.

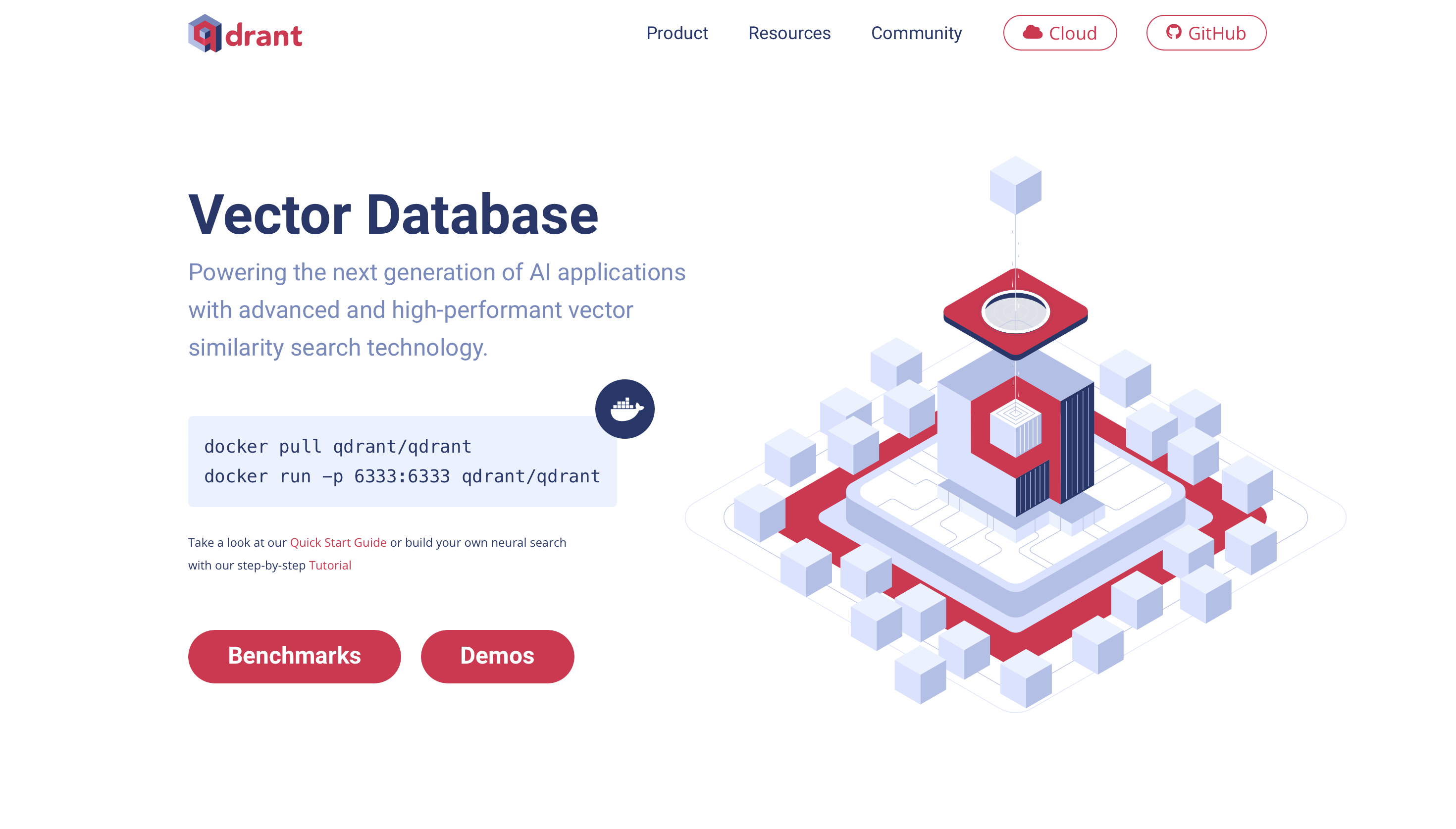

7. kwadrant

Qdrant is een flexibel vectordatabaseplatform dat een unieke reeks mogelijkheden biedt om te voldoen aan de groeiende eisen van AI- en machine learning-toepassingen.

Aan de basis is Qdrant een zoekmachine voor vectorgelijkenis die een eenvoudig te gebruiken API biedt voor het opslaan, vinden en onderhouden van vectoren en payloadgegevens.

Deze functie is cruciaal voor verschillende toepassingen, zoals semantische zoek- en aanbevelingssystemen, waarbij ingewikkelde gegevensformaten moeten worden geïnterpreteerd.

Het platform is gebouwd met het oog op efficiëntie en schaalbaarheid en is in staat enorme datasets met miljarden datapunten te verwerken.

Het biedt verschillende afstandsmetrieken, waaronder cosinus-gelijkenis, euclidische afstand en puntproduct, waardoor het aanpasbaar is in veel gebruiksscenario's.

Het ontwerp biedt complexe filters, zoals tekenreeks-, bereik- en geofilters, om aan diverse zoekbehoeften te voldoen.

Qdrant is op verschillende manieren toegankelijk voor ontwikkelaars, waaronder een Docker-image voor snelle lokale instellingen, een Python-client voor degenen die vertrouwd zijn met de taal, en een cloudservice voor een robuustere productieomgeving.

Het aanpassingsvermogen van Qdrant zorgt voor een naadloze integratie met elke technologische configuratie of procesbehoefte.

Bovendien vereenvoudigt de gebruiksvriendelijke interface van Qdrant het beheer van vectordatabases. Het platform is bedoeld om eenvoudig te zijn voor gebruikers van alle vaardigheidsniveaus, van het maken van clusters tot het genereren van API-sleutels voor veilige toegang.

De mogelijkheid tot bulkupload en de asynchrone API verbeteren de efficiëntie, waardoor het een zeer nuttig hulpmiddel is voor ontwikkelaars die met enorme hoeveelheden gegevens te maken hebben.

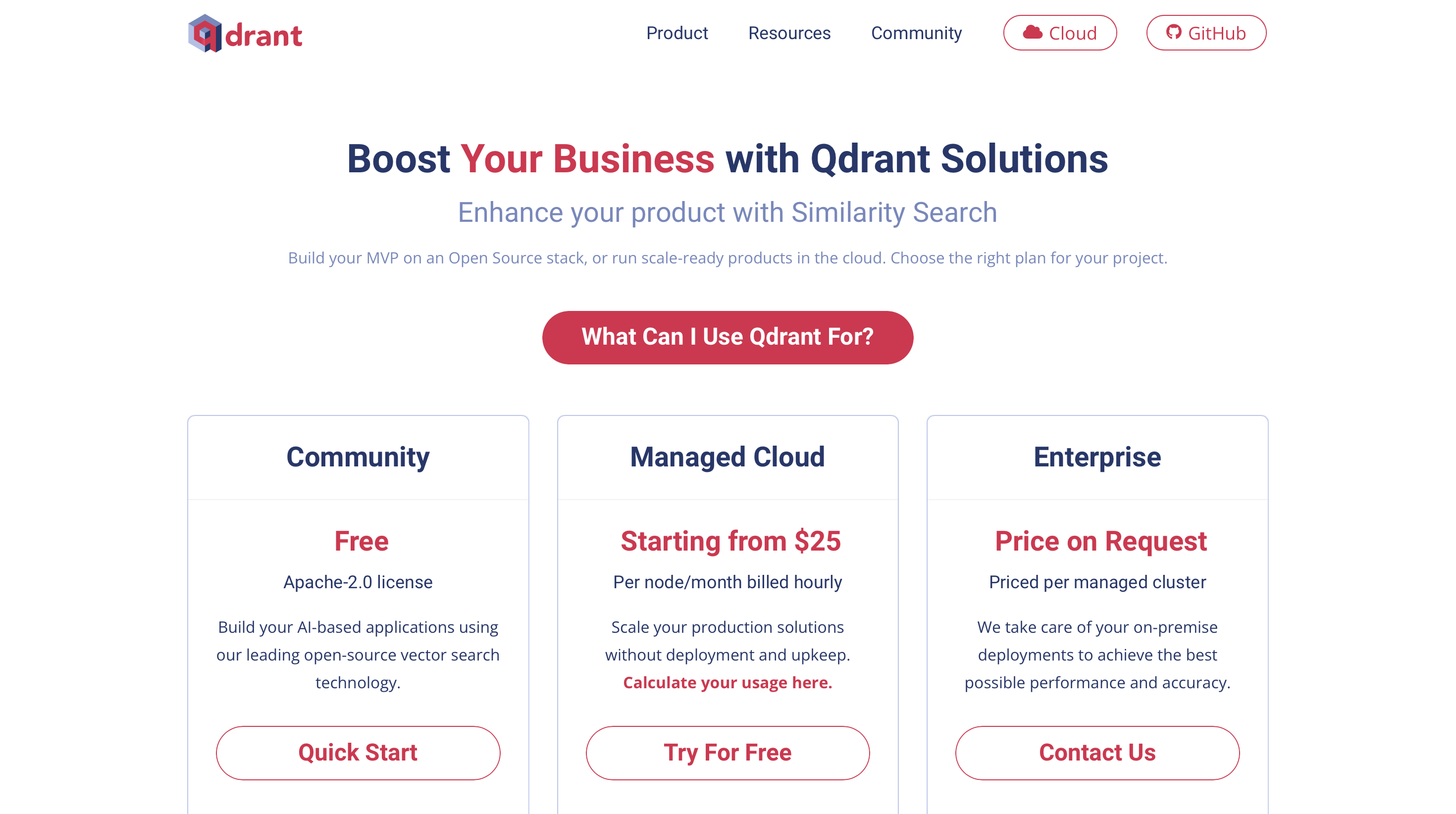

Prijzen

U kunt het gratis gaan gebruiken en de premiumprijzen beginnen vanaf $ 25 per node/maand, per uur gefactureerd

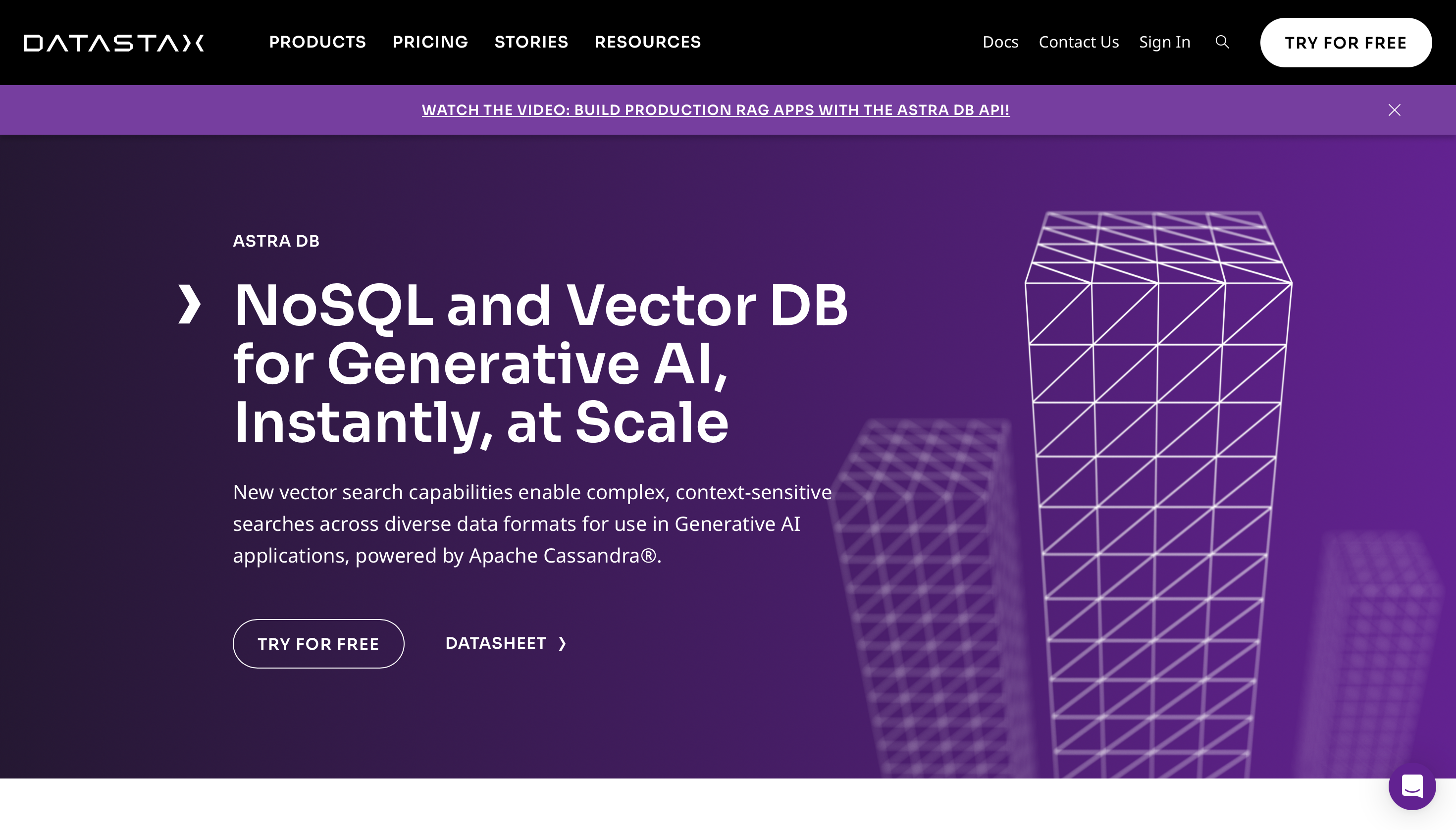

8. Astra

De superieure vectorzoekmogelijkheden en serverloze architectuur van AstraDB transformeren generatieve AI-toepassingen.

AstraDB is een geweldige optie voor het beheren van ingewikkelde, contextgevoelige zoekopdrachten in een verscheidenheid aan gegevenstypen, omdat het is gebouwd op de solide basis van Apache Cassandra en schaalbaarheid, stabiliteit en prestaties naadloos combineert.

De capaciteit van AstraDB om heterogene werkbelastingen te verwerken, inclusief streaming, niet-vector- en vectorgegevens, terwijl de extreem lage latentie voor gelijktijdige query- en updatebewerkingen behouden blijft, is een van de meest opvallende voordelen.

Dit aanpassingsvermogen is essentieel voor generatieve AI-toepassingen, die streaming en realtime gegevensverwerking vereisen om nauwkeurige, contextbewuste AI-reacties te bieden.

De serverloze oplossing van AstraDB maakt ontwikkeling nog eenvoudiger, waardoor ontwikkelaars zich kunnen concentreren op het creëren van innovatieve AI-applicaties in plaats van op het beheren van de backend-infrastructuur.

Van snelstartbegeleiding tot diepgaande lessen over het maken van chatbots en aanbevelingssystemen, AstraDB stelt ontwikkelaars in staat hun AI-ideeën snel te realiseren via betrouwbare API's en soepele interfaces met bekende tools en platforms.

Generatieve AI-systemen op bedrijfsniveau moeten prioriteit geven aan beveiliging en compliance, en AstraDB levert op beide fronten.

Het biedt diepgaande bedrijfsbeveiligingsfuncties en nalevingscertificeringen, die garanderen dat AI-applicaties die op AstraDB zijn ontwikkeld, voldoen aan de strengste richtlijnen voor privacy- en gegevensbescherming.

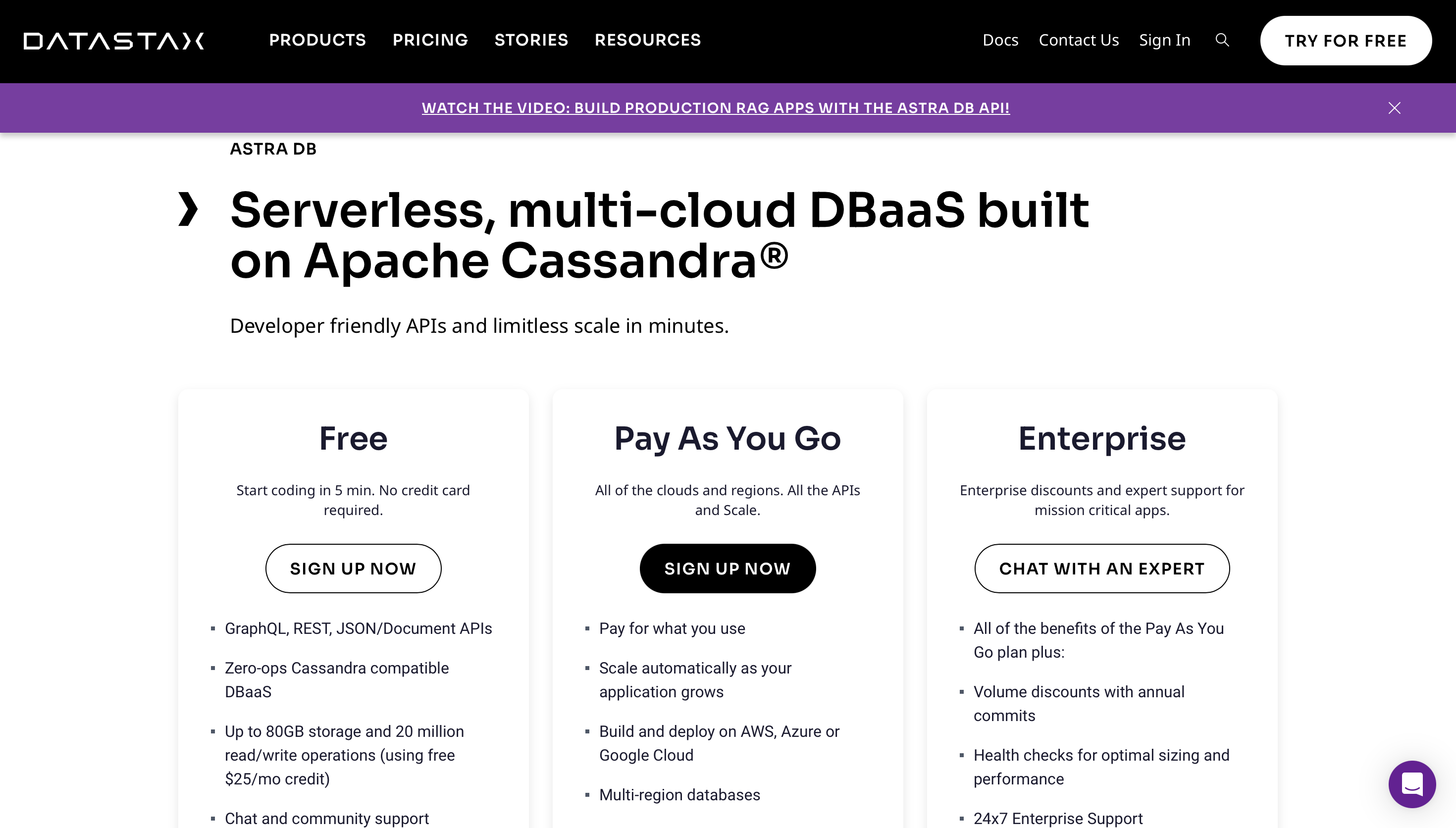

Prijzen

Je kunt het gratis gaan gebruiken en het biedt een pay-as-you-go-model.

9. OpenSearch

OpenSearch lijkt een aantrekkelijke optie voor degenen die vectordatabases verkennen, met name voor het ontwikkelen van aanpasbare, schaalbare en toekomstbestendige AI-systemen.

OpenSearch is een allesomvattende, open-source vectordatabase die de kracht van analyse, geavanceerde vectorzoekopdrachten en conventionele zoekopdrachten combineert in één samenhangend systeem.

Door machine learning-inbeddingsmodellen te gebruiken om de betekenis en context van meerdere gegevensformulieren (documenten, foto's en audio) te coderen in vectoren voor zoeken naar gelijkenissen, is deze integratie vooral nuttig voor ontwikkelaars die semantisch inzicht in hun zoek-apps willen opnemen.

Hoewel OpenSearch veel te bieden heeft, is het essentieel om te onthouden dat er vergeleken met Elasticsearch veel minder codewijzigingen zijn geweest, vooral in kritieke modules zoals scripttalen en opnamepijplijnprocessors.

Elasticsearch kan over meer geavanceerde mogelijkheden beschikken vanwege de toegenomen ontwikkelingsinspanningen, wat leidt tot verschillen in prestaties, functies en updates tussen de twee.

OpenSearch compenseert dit met een grote aanhang van de community en een toewijding aan open source-ideeën, wat resulteert in een open en aanpasbaar platform.

Het ondersteunt een breed scala aan toepassingen die verder gaan dan zoeken en analyses, zoals observatie- en beveiligingsanalyses, waardoor het een flexibel hulpmiddel is voor gegevensintensieve taken.

De gemeenschapsgedreven strategie verzekert voortdurende verbeteringen en integraties om het platform up-to-date en uniek te houden

Prijzen

Je kunt het gratis gaan gebruiken.

10. Azure AI-zoekopdracht

Azure AI Search is een krachtig platform dat de zoekmogelijkheden binnen generatieve AI-applicaties verbetert.

Het valt op omdat het zoeken naar vectoren ondersteunt, een mechanisme voor het indexeren, opslaan en ophalen van vectorinbedding binnen een zoekindex.

Deze functie helpt bij het ontdekken van vergelijkbare documenten in de vectorruimte, wat resulteert in contextueel relevantere zoekresultaten.

Azure AI Search onderscheidt zich door de ondersteuning voor hybride situaties, waarin zoekopdrachten naar vectoren en trefwoorden gelijktijdig worden uitgevoerd, wat resulteert in een uniforme resultatenset die vaak beter presteert dan de effectiviteit van elke techniek die afzonderlijk wordt gebruikt.

De combinatie van vector- en niet-vectormateriaal in dezelfde index zorgt voor een completere en flexibelere zoekervaring.

De vectorzoekfunctie in Azure AI Search is breed toegankelijk en gratis voor alle Azure AI Search-lagen.

Het is uiterst flexibel voor een reeks gebruiksscenario's en ontwikkelingsvoorkeuren vanwege de ondersteuning voor verschillende ontwikkelomgevingen, die wordt aangeboden via de Azure-site. REST API'sen SDK's voor onder meer Python, JavaScript en.NET.

Dankzij de diepgaande integratie met het Azure AI-ecosysteem biedt Azure AI Search meer dan alleen zoeken; het vergroot ook het potentieel van het ecosysteem voor generatieve AI-toepassingen.

Azure OpenAI Studio voor het insluiten van modellen en Azure AI Services voor het ophalen van afbeeldingen zijn slechts twee voorbeelden van de services die bij deze integratie zijn inbegrepen.

Azure AI Search is een flexibele oplossing voor ontwikkelaars die geavanceerde zoekfuncties in hun applicaties willen opnemen vanwege de uitgebreide ondersteuning, die een breed scala aan applicaties mogelijk maakt, van zoeken naar overeenkomsten en multimodaal zoeken tot hybride zoeken en meertalig zoeken.

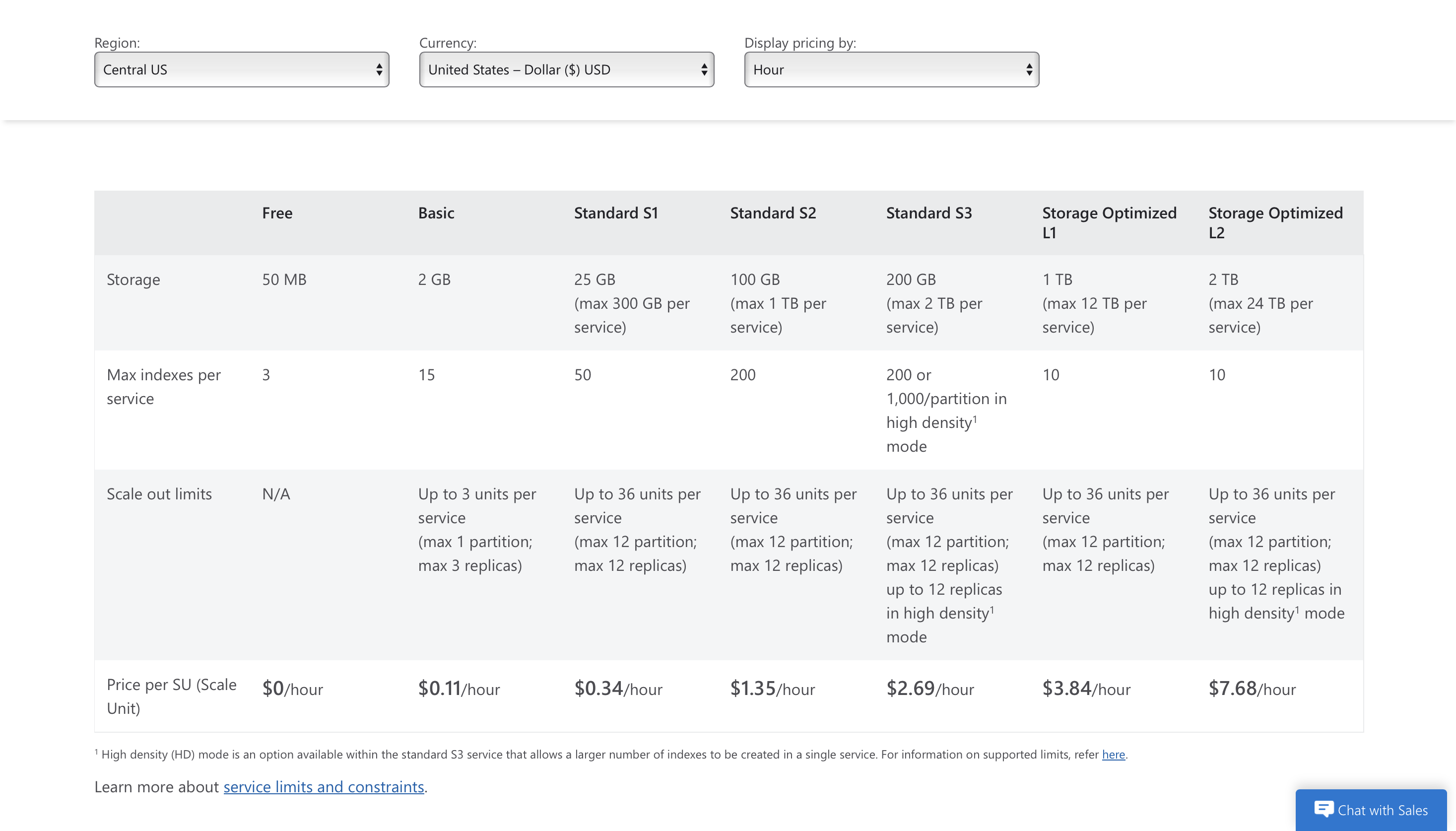

Prijzen

U kunt het gratis gaan gebruiken en de premiumprijzen beginnen vanaf $ 0.11/uur.

Conclusie

Vectordatabases transformeren het gegevensbeheer in AI door hoogdimensionale vectoren te beheren, waardoor sterke overeenkomstenzoekopdrachten en snelle zoekopdrachten naar de dichtstbijzijnde buur mogelijk worden in toepassingen zoals aanbevelingssystemen en fraudedetectie.

Met behulp van geavanceerde indexeringsalgoritmen zetten deze databases ingewikkelde ongestructureerde gegevens om in betekenisvolle vectoren, terwijl ze de snelheid en flexibiliteit bieden die traditionele databases niet bieden.

Bekende platforms zijn onder meer Pinecone, dat uitblinkt in generatieve AI-toepassingen; FAISS, gemaakt door Facebook AI voor dichte vectorclustering; en Milvus, dat bekend staat om zijn schaalbaarheid en cloud-native architectuur.

Weaviate combineert machinaal leren met contextbewust zoeken, terwijl Vespa en Chroma opmerkelijk zijn vanwege respectievelijk hun computermogelijkheden met lage latentie en gebruiksgemak.

Vectordatabases zijn essentiële hulpmiddelen voor de ontwikkeling van AI- en machine learning-technologieën, aangezien platforms als Qdrant, AstraDB, OpenSearch en Azure AI Search een verscheidenheid aan diensten bieden, van serverloze architecturen tot uitgebreide zoek- en analysemogelijkheden.

Laat een reactie achter