Inhoudsopgave[Zich verstoppen][Laten zien]

Elk Machine Learning-project steunt op een goede dataset. Het is deze grote dataset waarmee u uw ML-model kunt trainen en valideren. Een groot deel van het werk in een ML-project bestaat dus uit het vinden van de perfecte dataset voor uw behoeften. Het is echter niet altijd mogelijk om een optie te vinden die past bij uw ambitie, aangezien veel bestanden die er interessant uitzien, dat uiteindelijk niet zijn.

Het kan ontmoedigend zijn om tijd te verspillen aan het downloaden van talloze datasets totdat u bij een ideale set aankomt. Met dat in gedachten hebben we enkele opties verzameld die interessant lijken en die u kunnen helpen bij het ontwikkelen van uw ML-project. Houd er rekening mee dat sommige bedoeld zijn voor persoonlijk in plaats van commercieel gebruik, dus bekijk deze opties als een manier om ervaring op te doen in het ML-universum.

Basisprincipes van gegevenssets

Voordat we de datasets noemen, moeten we enkele termen definiëren. Vooral in projecten op het gebied van kunstmatige intelligentie Machine leren, is een grote hoeveelheid data nodig, die zal worden gebruikt om het algoritme te trainen. Deze hoeveelheid data wordt verzameld in een database, wat uitermate handig is om een algoritme aan te leren.

Met deze data wordt het algoritme getraind – ook getest – en wordt het in staat om patronen te vinden, verbanden te leggen en zo autonoom beslissingen te nemen. Zonder opleiding, Machine leren algoritmen kunnen geen enkele actie uitvoeren. Hoe beter de trainingsgegevens, hoe beter het model presteert. Wil een database nuttig zijn voor het project, dan gaat het niet om kwantiteit: het gaat ook om classificatie.

Idealiter zouden de gegevens goed geëtiketteerd moeten zijn. Denk aan het geval van chatbots: taalinvoeging is belangrijk, maar zorgvuldige syntactische analyse moet worden uitgevoerd, zodat het gemaakte algoritme kan begrijpen wanneer de gesprekspartner straattaal gebruikt. Alleen dan kan de virtuele assistent het antwoord lanceren op basis van wat de gebruiker heeft gevraagd.

Datasets kunnen worden gegenereerd op basis van enquêtes, aankoopgegevens van gebruikers, beoordelingen van services en op vele andere manieren waarmee nuttige informatie kan worden verzameld, georganiseerd in kolommen en rijen in een CSV-bestand.

Voordat u op zoek gaat naar de perfecte dataset, is het belangrijk dat u het doel van uw project kent, vooral als het uit een specifiek gebied komt, zoals weer, financiën, gezondheid, enz. Dit bepaalt de bron waaruit u uw gegevensset.

Gegevenssets voor ML

Chatbot-training

Een effectieve chatbot vereist een enorme hoeveelheid trainingsgegevens om vragen van gebruikers snel op te lossen zonder menselijke tussenkomst. Het belangrijkste knelpunt bij de ontwikkeling van chatbots is echter het verkrijgen van realistische, taakgerichte dialooggegevens om deze op machine learning gebaseerde systemen te trainen.

Een conversatiedataset verzamelt gegevens in een vraag-en-antwoordformaat. Het is ideaal voor het trainen van chatbots die geautomatiseerde antwoorden aan het publiek geven. Zonder deze gegevens zal de chatbot er niet in slagen gebruikersvragen snel op te lossen of vragen van gebruikers te beantwoorden zonder menselijke tussenkomst.

Met behulp van deze datasets kunnen bedrijven een tool maken die klanten 24/7 snel antwoord geeft en aanzienlijk goedkoper is dan een team van mensen die klantenondersteuning doen.

1. Vraag-Antwoord dataset

Deze dataset biedt een reeks Wikipedia-artikelen, vragen en hun respectieve handmatig gegenereerde antwoorden. Het is een dataset verzameld tussen 2008 en 2010 voor gebruik in academisch onderzoek.

2. Taal gegevens

Language Data is een database die wordt beheerd door Yahoo met informatie die is gegenereerd door enkele services van het bedrijf, zoals Yahoo! Answer, dat werkt als een open community waar gebruikers vragen en antwoorden kunnen posten.

3. WikiQA

Het WikiQA-corpus bestaat ook uit een reeks vragen en antwoorden. De bron van de vragen is Bing, terwijl de antwoorden linken naar een Wikipedia-pagina met het potentieel om de initiële vraag op te lossen.

In totaal zijn er meer dan 3,000 vragen en een set van 29,258 zinnen in de dataset, waarvan er ongeveer 1,400 zijn gecategoriseerd als antwoorden op een overeenkomstige vraag.

In totaal zijn er meer dan 3,000 vragen en een set van 29,258 zinnen in de dataset, waarvan er ongeveer 1,400 zijn gecategoriseerd als antwoorden op een overeenkomstige vraag.

overheidsgegevens

Datasets die door overheden zijn gegenereerd, leveren demografische gegevens op, die geweldige input zijn voor projecten die te maken hebben met het begrijpen van sociale trends, het creëren van openbaar beleid en het verbeteren van de samenleving. Dit kan handig zijn voor politieke campagnes, gerichte advertenties of marktanalyses.

Deze datasets bevatten doorgaans geanonimiseerde gegevens, dus hoewel de modellen toegang hebben tot de onbewerkte gegevens, is er geen sprake van schending van de persoonlijke levenssfeer.

4. Data.gov

Data.gov, gelanceerd in 2009, is de Noord-Amerikaanse bron voor gegevens. De catalogus is indrukwekkend: meer dan 218,000 datasets die segmentatie op formaat, tags, typen en onderwerpen mogelijk maken.

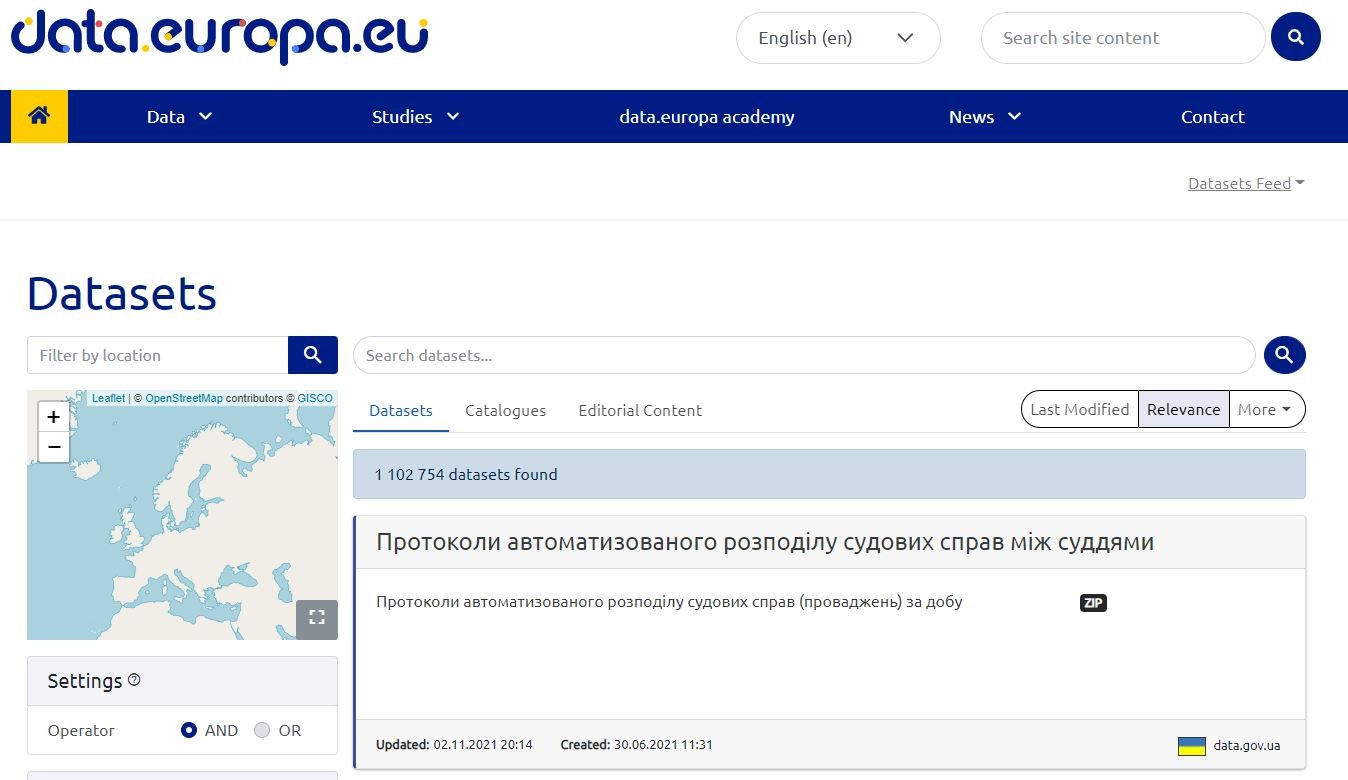

5. EU-opendataportaal

Het EU Open Data Portal biedt toegang tot open data die wordt gedeeld door instellingen van de Europese Unie. Dit zijn gegevens die bestemd kunnen zijn voor commercieel en niet-commercieel gebruik. De gebruiker beschikt over meer dan 15.5 duizend datasets over onderwerpen als gezondheid, energie, milieu, cultuur en onderwijs.

Gezondheidsgegevens

In de nasleep van de aanhoudende wereldwijde gezondheidscrisis zijn door gezondheidsorganisaties gegenereerde datasets essentieel voor het ontwikkelen van effectieve oplossingen om levens te redden. Deze datasets kunnen helpen bij het identificeren van de risicofactoren, het uitwerken van overdrachtspatronen van ziekten en het versnellen van de diagnose.

Deze datasets bestaan uit medische dossiers, demografische gegevens van patiënten, ziekteprevalentie, medicinaal gebruik, voedingswaarden en nog veel meer.

6. Wereldwijd gezondheidsobservatorium

Deze dataset is een initiatief van de Wereldgezondheidsorganisatie (WHO). Het biedt openbare gegevens met betrekking tot verschillende gezondheidsdomeinen, geordend op thema's zoals gezondheidssystemen, tabaksgebruik, moederschap, hiv/aids, enz. Er is ook de mogelijkheid om gegevens over COVID-19 te raadplegen.

7. KOORD-19

CORD-19 is een verzameling academische publicaties over COVID-19 en andere artikelen over het nieuwe coronavirus. Het is een open dataset die bedoeld is om nieuwe inzichten over COVID-19 te genereren.

Economische gegevens

Datasets met betrekking tot de financiële omgeving verzamelen meestal een enorme hoeveelheid informatie, aangezien het gebruikelijk is dat ze al heel lang zijn verzameld. Ze zijn ideaal voor het maken van economische voorspellingen of het vaststellen van investeringstrends.

Met de juiste financiële datasets, Machine Learning-model mogelijk het gedrag van een bepaald activum kunnen voorspellen. Daarom doet de financiële sector er alles aan om een effectief ML-model te creëren, aangezien alles wat zelfs redelijk goed kan voorspellen het potentieel heeft om miljoenen dollars te genereren. Machine Learning voorspelt nu al het gedrag van burgers, wat van invloed is op de manier waarop beleidsmakers hun werk doen.

8. Internationaal Monetair Fonds

De dataset van het IMF bevat een reeks economische en financiële indicatoren, statistieken van de lidstaten en andere gegevens over leningen en wisselkoersen.

9. Wereldbank

De repository van de Wereldbank bevat verschillende datasets met economische informatie uit verschillende landen. Er zijn meer dan 17,000 datasets verdeeld over continenten.

Beoordelingen van producten en diensten

Sentimentanalyse heeft zijn toepassingen gevonden op verschillende gebieden die bedrijven nu helpen om hun klanten of klanten correct in te schatten en ervan te leren. Sentimentanalyse wordt steeds vaker gebruikt voor social media monitoring, brand monitoring, de stem van de klant (VoC), klantenservice en marktonderzoek.

Sentimentanalyse maakt gebruik van NLP (neuro-linguïstisch programmeren) methoden en algoritmen die op regels zijn gebaseerd, hybride zijn of vertrouwen op Machine Learning-technieken om gegevens uit datasets te leren.

De gegevens die nodig zijn voor sentimentanalyse moeten gespecialiseerd zijn en in grote hoeveelheden nodig zijn. Het meest uitdagende deel van het trainingsproces voor sentimentanalyse is niet het vinden van grote hoeveelheden gegevens; in plaats daarvan is het om de relevante datasets te vinden. Deze datasets moeten een breed gebied van toepassingen voor sentimentanalyse en use cases bestrijken.

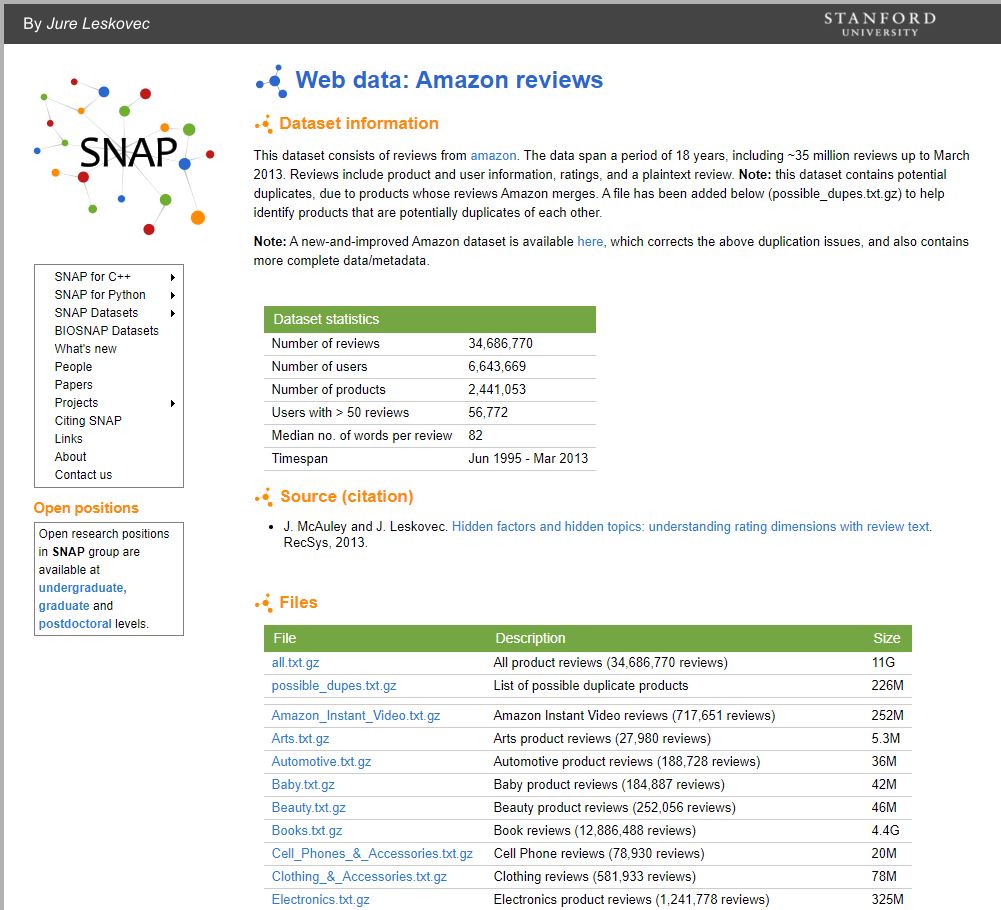

10. Amazon beoordelingen

Deze dataset bevat ongeveer 35 miljoen Amazon-recensies, verspreid over een periode van 18 jaar aan verzamelde informatie. Het is een dataset van product-, gebruikers- en recensie-inhoud.

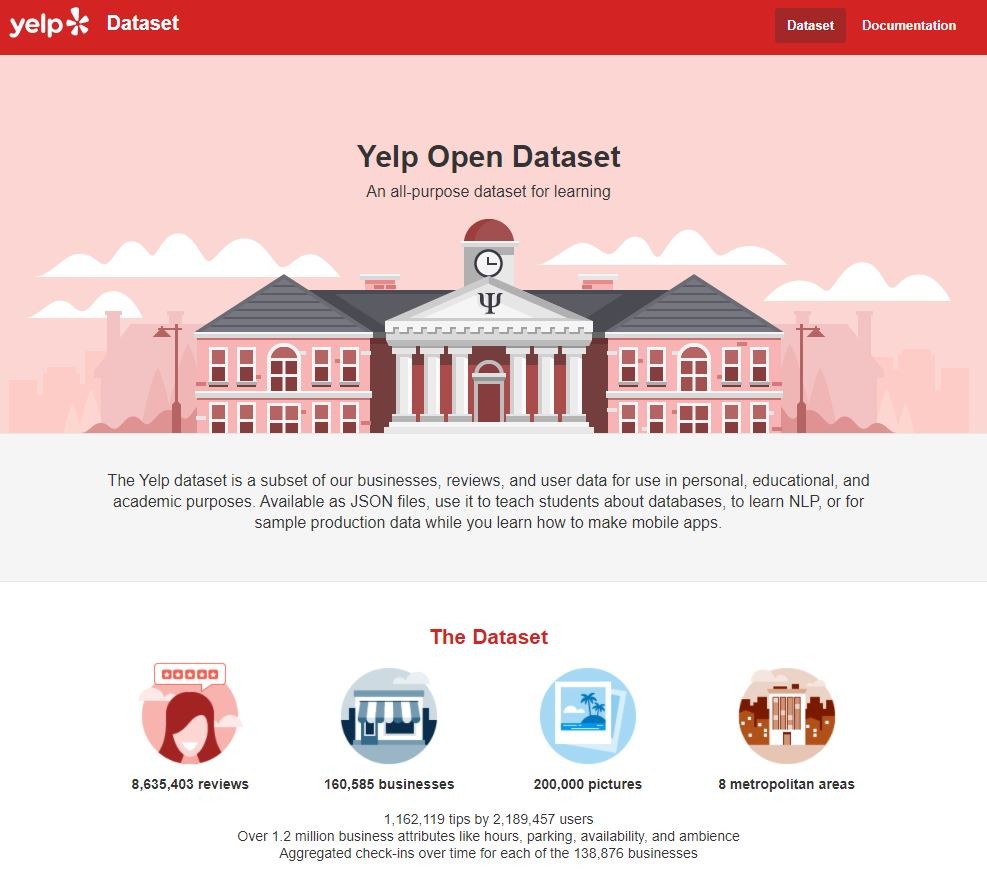

11. Yelp beoordelingen

Yelp biedt ook een dataset aan op basis van informatie die via zijn service is verzameld. Er zijn meer dan 8 miljoen beoordelingen, 1 miljoen tips en bijna 1.5 miljoen attributen met betrekking tot bedrijven, zoals openingstijden en beschikbaarheid.

12. IMDB beoordelingen

Deze database bevat een set van meer dan 25 filmrecensies voor training en nog eens 25 voor tests die informeel zijn afgenomen van de IMDB-pagina, gespecialiseerd in filmbeoordelingen. Het biedt ook niet-gelabelde gegevens als extra.

Datasets voor de eerste stappen in ML

13. Dataset wijnkwaliteit

Deze dataset bevat informatie over wijn, zowel rode als groene, geproduceerd in Noord-Portugal. Het doel is om de wijnkwaliteit te bepalen op basis van fysisch-chemische tests. Interessant voor wie wil oefenen met het maken van een voorspellingssysteem.

14. Titanic-gegevensset

Deze dataset bevat gegevens van 887 echte passagiers van de Titanic, waarbij elke kolom aangeeft of ze het hebben overleefd, hun leeftijd, passagiersklasse, geslacht en het instaptarief dat ze hebben betaald. Deze dataset was onderdeel van een uitdaging gelanceerd door het Kaggle-platform, met als doel een model te maken dat kon voorspellen welke passagiers het zinken van de Titanic zouden overleven.

Platforms voor het vinden van andere datasets

Als u verder wilt gaan en uw eigen dataset wilt vinden, kunt u het beste bladeren door de beroemdste repositories van de Machine leren universum:

Kaggle

Kaggle, een dochteronderneming van Google LLC, is een online community van datawetenschappers en machine learning-professionals. Met Kaggle kunnen gebruikers datasets vinden en publiceren, modellen verkennen en maken in een webgebaseerde datawetenschapsomgeving; werk samen met andere datawetenschappers en Machine Learning-ingenieurs, en neem deel aan wedstrijden om uitdagingen op het gebied van datawetenschap op te lossen.

Kaggle begon in 2010 met het aanbieden van Machine Learning-wedstrijden en biedt nu ook een publiek aan gegevensplatform, een cloudgebaseerde werkbank voor onderwijs in datawetenschap en kunstmatige intelligentie.

Dataset zoeken

Dataset Search is een zoekmachine van Google die onderzoekers helpt online gegevens te vinden die vrij beschikbaar zijn voor gebruik. Op internet zijn er miljoenen datasets over bijna elk onderwerp dat u interesseert.

Als u op zoek bent naar een puppy, kunt u datasets vinden met klachten van puppykopers of studies over puppycognitie. Of als u van skiën houdt, kunt u gegevens vinden over de inkomsten van skigebieden of blessurecijfers en deelnamecijfers. Dataset Search heeft bijna 25 miljoen van deze datasets geïndexeerd, waardoor u op één plek naar datasets kunt zoeken en links kunt vinden naar waar de gegevens zich bevinden.

UCI Machine Learning-opslagplaats

De UCI Machine Learning Repository is een verzameling databases, domeintheorieën en gegevensgeneratoren die door de Machine Learning-gemeenschap worden gebruikt voor de empirische analyse van Machine Learning-algoritmen. Het archief is in 1987 gemaakt als een ftp-archief door David Aha en medestudenten aan UC Irvine.

Sindsdien wordt het op grote schaal gebruikt door studenten, docenten en onderzoekers over de hele wereld als primaire bron van ML-datasets. Als indicatie van de impact van het archief: het is meer dan 1000 keer geciteerd, waardoor het in de top 100 van meest geciteerde "papers" in de informatica staat.

Quandli

Quandl is een platform dat zijn gebruikers voorziet van economische, financiële en alternatieve datasets. Gebruikers kunnen gratis data downloaden, betaalde data kopen of data verkopen aan Quandl. Het kan een handig hulpmiddel zijn bij de ontwikkeling van handelsalgoritmenBijvoorbeeld.

Conclusie

Door deze tools te verkennen, vindt u zeker geweldige input voor uw projecten. Zorg ervoor dat u de dataset kiest die het meest geschikt is voor uw specifieke behoeften en onthoud altijd: het gaat niet alleen om kwantiteit, maar ook om kwaliteit. De dataset is de basis van elke Machine Learning-project en het is essentieel om voort te bouwen op kwaliteitsgegevens om het risico op foutieve conclusies te voorkomen.

Laat een reactie achter