Saturs[Paslēpt][Rādīt]

Nākotne ir klāt. Un šajā nākotnē mašīnas uztver apkārtējo pasauli tāpat kā cilvēki. Datori var vadīt automašīnas, diagnosticēt slimības un precīzi prognozēt nākotni.

Tas var šķist zinātniskā fantastika, taču dziļās mācīšanās modeļi padara to par realitāti.

Šie izsmalcinātie algoritmi atklāj noslēpumus mākslīgais intelekts, ļaujot datoriem pašiem mācīties un attīstīties. Šajā rakstā mēs iedziļināsimies padziļināto mācību modeļu jomā.

Un mēs izpētīsim viņu milzīgo potenciālu, lai mainītu mūsu dzīvi. Sagatavojieties uzzināt par jaunākajām tehnoloģijām, kas maina cilvēces nākotni.

Kas īsti ir dziļās mācīšanās modeļi?

Vai esat kādreiz spēlējis spēli, kurā jums ir jānosaka atšķirības starp diviem attēliem?

Tomēr tas ir jautri, tas var būt arī grūts, vai ne? Iedomājieties, ka varat iemācīt datoram spēlēt šo spēli un uzvarēt katru reizi. Padziļināti mācību modeļi to panāk!

Dziļās mācīšanās modeļi ir līdzīgi īpaši viedām mašīnām, kas var pārbaudīt lielu skaitu attēlu un noteikt, kas tiem ir kopīgs. Viņi to panāk, izjaucot attēlus un pētot katru atsevišķi.

Pēc tam viņi izmanto to, ko viņi ir iemācījušies, lai identificētu modeļus un prognozētu jaunus attēlus, ko viņi nekad nav redzējuši.

Dziļās mācīšanās modeļi ir mākslīgi neironu tīkli, kas var mācīties un iegūt sarežģītus modeļus un raksturlielumus no masveida datu kopām. Šie modeļi sastāv no vairākiem saistītu mezglu vai neironu slāņiem, kas analizē un maina ienākošos datus, lai ģenerētu izvadi.

Dziļās mācīšanās modeļi ir īpaši piemēroti darbiem, kuriem nepieciešama liela precizitāte, piemēram, attēlu identifikācija, runas atpazīšana, dabiskās valodas apstrāde un robotika.

Tie ir izmantoti visās jomās, sākot no pašbraucošām automašīnām līdz medicīniskajai diagnostikai, ieteikumu sistēmām un prognozējošā analīze.

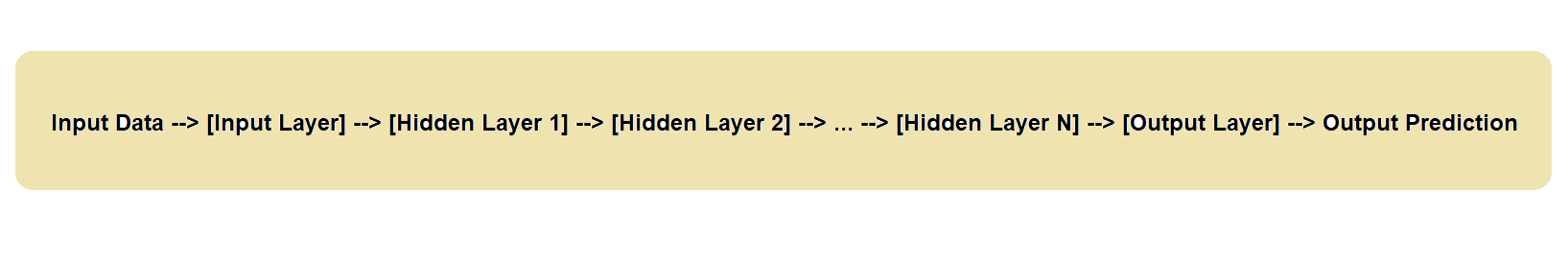

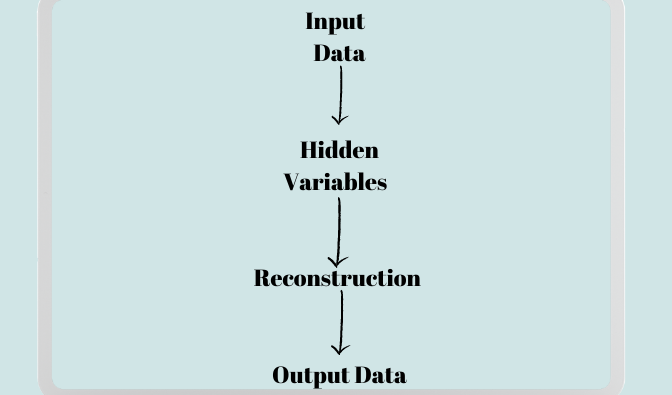

Šeit ir vienkāršota vizualizācijas versija, lai ilustrētu datu plūsmu dziļās mācīšanās modelī.

Ievades dati ieplūst modeļa ievades slānī, kas pēc tam izlaiž datus caur vairākiem slēptiem slāņiem, pirms tiek nodrošināta izvades prognoze.

Katrs slēptais slānis veic virkni matemātisku darbību ar ievades datiem, pirms tos nodod nākamajam slānim, kas nodrošina galīgo prognozi.

Tagad apskatīsim, kas ir dziļās mācīšanās modeļi un kā mēs tos varam izmantot savā dzīvē.

1. Konvolucionālie neironu tīkli (CNN)

CNN ir dziļas mācīšanās modelis, kas ir pārveidojis datora redzes jomu. CNN izmanto attēlu klasificēšanai, objektu atpazīšanai un attēlu segmentēšanai. Cilvēka redzes garozas struktūra un funkcija informēja par CNN dizainu.

Kā tās darbojas?

CNN sastāv no vairākiem konvolucionāliem slāņiem, apvienojošiem slāņiem un pilnībā saistītiem slāņiem. Ievade ir attēls, un izvade ir attēla klases etiķetes prognoze.

CNN konvolucionālie slāņi veido objektu karti, veicot punktu preci starp ievades attēlu un filtru kopu. Apvienošanas slāņi samazina objektu kartes izmēru, samazinot to iztveršanu.

Visbeidzot, objektu karti izmanto pilnībā savienotie slāņi, lai paredzētu attēla klases etiķeti.

Kāpēc CNN ir svarīgi?

CNN ir būtiskas, jo tās var iemācīties atklāt modeļus un raksturlielumus attēlos, kurus cilvēkiem ir grūti pamanīt. CNN var iemācīt atpazīt tādas īpašības kā malas, stūri un faktūras, izmantojot lielas datu kopas. Pēc šo īpašību apguves CNN var tos izmantot, lai identificētu objektus svaigos fotoattēlos. CNN ir demonstrējuši visprogresīvāko veiktspēju dažādās attēlu identifikācijas lietojumprogrammās.

Kur mēs izmantojam CNN

Veselības aprūpe, automobiļu rūpniecība un mazumtirdzniecība ir tikai dažas nozares, kurās tiek nodarbināti CNN. Veselības aprūpes nozarē tie var būt noderīgi slimību diagnosticēšanai, medikamentu izstrādei un medicīniskā attēla analīzei.

Automobiļu nozarē tie palīdz noteikt joslu, objektu noteikšana, un autonoma braukšana. Tie tiek plaši izmantoti arī mazumtirdzniecībā vizuālai meklēšanai, uz attēliem balstītai produktu ieteikumiem un krājumu kontrolei.

Piemēram; Google izmanto CNN dažādās lietojumprogrammās, tostarp Google objektīvs, populārs attēlu identifikācijas rīks. Programma izmanto CNN, lai novērtētu fotogrāfijas un sniegtu lietotājiem informāciju.

Piemēram, Google Lens var atpazīt lietas attēlā un piedāvāt informāciju par tām, piemēram, ziedu veidu.

Tā var arī tulkot no attēla izvilkto tekstu vairākās valodās. Google Lens var sniegt patērētājiem noderīgu informāciju, jo CNN palīdz precīzi identificēt vienumus un iegūt raksturlielumus no fotoattēliem.

2. Long Short-Term Memory (LSTM) tīkli

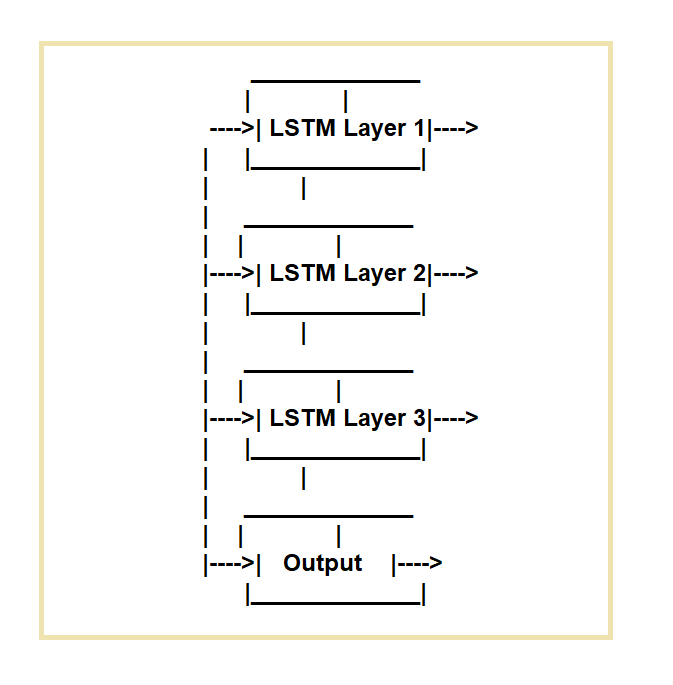

Ilgtermiņa īstermiņa atmiņas (LSTM) tīkli ir izveidoti, lai novērstu regulāru atkārtotu neironu tīklu (RNN) trūkumus. LSTM tīkli ir ideāli piemēroti uzdevumiem, kuriem nepieciešama datu secību apstrāde laika gaitā.

Tie darbojas, izmantojot īpašu atmiņas šūnu un trīs vārtu mehānismus.

Tie regulē informācijas plūsmu šūnā un no tās. Ieejas vārti, aizmirst vārti un izejas vārti ir trīs vārti.

Ievades vārti regulē datu plūsmu atmiņas šūnā, aizmirstības vārti regulē datu dzēšanu no šūnas, un izvades vārti regulē datu plūsmu no šūnas.

Kāda ir to nozīme?

LSTM tīkli ir noderīgi, jo tie var veiksmīgi attēlot un prognozēt datu secības ar ilgtermiņa attiecībām. Viņi var ierakstīt un saglabāt informāciju par iepriekšējiem ievadiem, ļaujot viņiem veikt precīzākas prognozes par turpmākajām ievadēm.

Runas atpazīšana, rokraksta atpazīšana, dabiskās valodas apstrāde un attēlu paraksti ir tikai dažas no lietojumprogrammām, kas izmantojušas LSTM tīklus.

Kur mēs izmantojam LSTM tīklus?

Daudzas programmatūras un tehnoloģiju lietojumprogrammas izmanto LSTM tīklus, tostarp runas atpazīšanas sistēmas, dabisko valodu apstrādes rīkus, piemēram sentimenta analīze, mašīntulkošanas sistēmas un teksta un attēlu ģenerēšanas sistēmas.

Tie ir izmantoti arī pašbraucošu automašīnu un robotu izveidē, kā arī finanšu nozarē, lai atklātu krāpšanu un paredzētu akciju tirgus kustības.

3. Ģeneratīvie pretrunīgie tīkli (GAN)

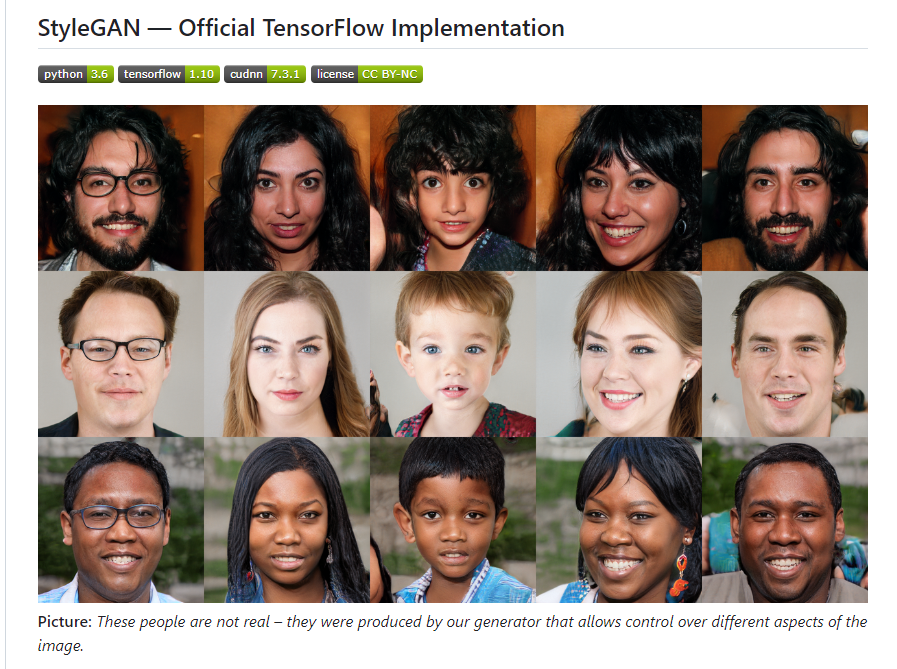

GAN ir a dziļa mācīšanās tehnika, ko izmanto, lai ģenerētu jaunus datu paraugus, kas ir līdzīgi konkrētai datu kopai. GAN sastāv no diviem neironu tīkli: tādu, kas mācās ražot jaunus paraugus, un tādu, kas mācās atšķirt oriģinālos paraugus no ģenerētajiem paraugiem.

Līdzīgā pieejā šie divi tīkli tiek apmācīti kopā, līdz ģenerators var ģenerēt paraugus, kas nav atšķirami no faktiskajiem.

Kāpēc mēs izmantojam GAN

GAN ir nozīmīgi, jo tie spēj ražot augstas kvalitātes sintētiskie dati ko var izmantot dažādām lietojumprogrammām, tostarp attēlu un video veidošanai, teksta ģenerēšanai un pat mūzikas ģenerēšanai.

GAN ir izmantoti arī datu palielināšanai, kas ir datu ģenerēšana sintētiskie dati lai papildinātu reālās pasaules datus un uzlabotu mašīnmācības modeļu veiktspēju.

Turklāt, radot sintētiskus datus, ko var izmantot, lai apmācītu modeļus un imitētu izmēģinājumus, GAN ir potenciāls pārveidot tādas nozares kā medicīna un zāļu izstrāde.

GAN lietojumprogrammas

GAN var papildināt datu kopas, izveidot jaunus attēlus vai filmas un pat ģenerēt sintētiskos datus zinātniskām simulācijām. Turklāt GAN var izmantot dažādās lietojumprogrammās, sākot no izklaides līdz medicīnai.

vecumi un videoklipi. Piemēram, NVIDIA StyleGAN2 ir izmantots, lai izveidotu augstas kvalitātes slavenību un mākslas darbu fotogrāfijas.

4. Deep Belief Networks (DBN)

Deep Belief Networks (DBN) ir mākslīgais intelekts sistēmas, kas var iemācīties pamanīt datu modeļus. Viņi to panāk, segmentējot datus mazākos un mazākos gabalos, iegūstot rūpīgāku izpratni par tiem katrā līmenī.

DBN var mācīties no datiem, nezinot, kas tie ir (to dēvē par “nepārraudzītu mācīšanos”). Tas padara tos ārkārtīgi vērtīgus, lai atklātu datu modeļus, kurus personai būtu grūti vai neiespējami saskatīt.

Kas padara DBN nozīmīgus?

DBN ir nozīmīgi, jo tie spēj apgūt hierarhisku datu attēlojumu. Šos attēlojumus var izmantot dažādiem lietojumiem, piemēram, klasifikācijai, anomāliju noteikšanai un izmēru samazināšanai.

Būtisks ieguvums ir DBN spēja veikt iepriekšēju apmācību bez uzraudzības, kas var palielināt padziļināto mācību modeļu veiktspēju ar minimāliem marķētiem datiem.

Kādi ir DBN pielietojumi?

Viens no nozīmīgākajiem lietojumiem ir objektu noteikšana, kurā DBN tiek izmantoti, lai atpazītu noteikta veida lietas, piemēram, lidmašīnas, putnus un cilvēkus. Tie tiek izmantoti arī attēlu ģenerēšanai un klasifikācijai, kustības noteikšanai filmās un dabiskās valodas izpratnei balss apstrādei.

Turklāt DBN parasti izmanto datu kopās, lai novērtētu cilvēka pozas. DBN ir lielisks rīks dažādām nozarēm, tostarp veselības aprūpei un banku darbībai, kā arī tehnoloģijām.

5. Padziļināti pastiprināšanas mācību tīkli (DRL)

dziļi Pastiprināšanas mācības Tīkli (DRL) integrē dziļos neironu tīklus ar pastiprinošām mācīšanās metodēm, lai aģenti varētu mācīties sarežģītā vidē, izmantojot izmēģinājumus un kļūdas.

DRL izmanto, lai mācītu aģentiem optimizēt atlīdzības signālu, mijiedarbojoties ar apkārtni un mācoties no kļūdām.

Kas padara tos ievērojamus?

Tie ir efektīvi izmantoti dažādās lietojumprogrammās, tostarp spēlēs, robotikā un autonomā braukšanā. DRL ir svarīgi, jo tie var mācīties tieši no neapstrādātas sensorās ievades, ļaujot aģentiem pieņemt lēmumus, pamatojoties uz viņu mijiedarbību ar vidi.

Svarīgas lietojumprogrammas

DRL tiek izmantoti reālos apstākļos, jo tie var tikt galā ar sarežģītām problēmām.

DRL ir iekļauti vairākās ievērojamās programmatūras un tehnoloģiju platformās, tostarp OpenAI's Gym, Vienotības ML-aģentiun Google DeepMind Lab. AlphaGo, ko izveidojis Google Deepmind, piemēram, izmanto DRL, lai spēlētu galda spēli Go pasaules čempiona līmenī.

Vēl viens DRL lietojums ir robotikā, kur to izmanto, lai kontrolētu robotu roku kustības, lai veiktu tādus uzdevumus kā lietu satveršana vai bloku sakraušana. DRL ir daudz lietojumu, un tie ir noderīgs rīks apmācīt aģentus mācīties un pieņemt lēmumus sarežģītos apstākļos.

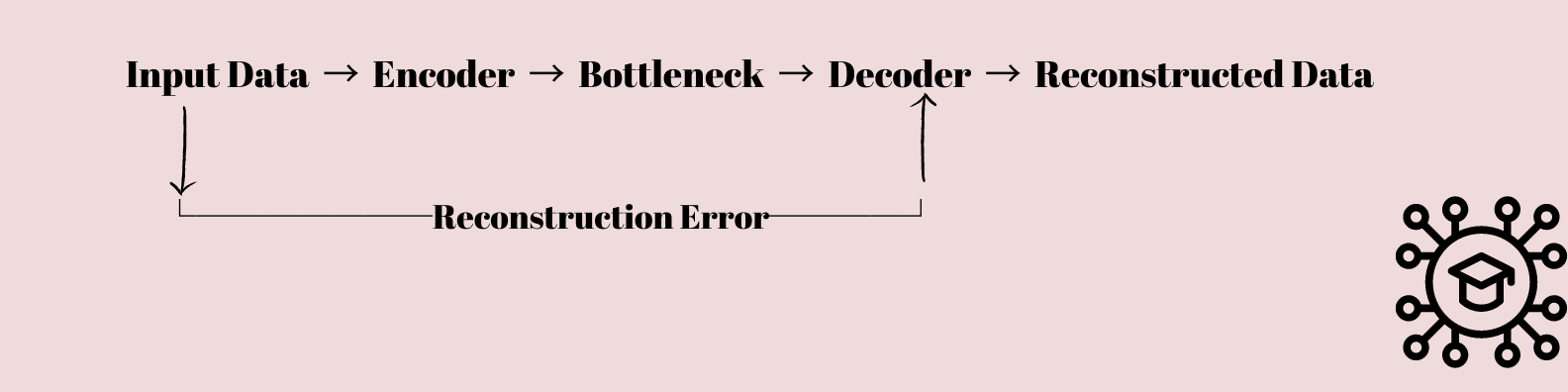

6. Autoenkoderi

Autokodētāji ir interesants veids neironu tīklu kas ir ieinteresējis gan zinātniekus, gan datu zinātniekus. Tie galvenokārt ir paredzēti, lai uzzinātu, kā saspiest un atjaunot datus.

Ievades dati tiek ievadīti, izmantojot virkni slāņu, kas pakāpeniski samazina datu dimensiju, līdz tie tiek saspiesti sašaurinājuma slānī, kurā ir mazāk mezglu nekā ievades un izvades slāņiem.

Pēc tam šo saspiesto attēlojumu izmanto, lai atjaunotu sākotnējos ievades datus, izmantojot slāņu secību, kas pakāpeniski paaugstina datu dimensiju atpakaļ sākotnējā formā.

Kāpēc tas ir svarīgi?

Autokodētāji ir būtiska sastāvdaļa dziļa mācīšanās jo tie padara iespējamu funkciju ieguvi un datu samazināšanu.

Viņi spēj identificēt ienākošo datu galvenos elementus un pārvērst tos saspiestā formā, ko pēc tam var izmantot citiem uzdevumiem, piemēram, klasificēšanai, grupēšanai vai jaunu datu izveidei.

Kur mēs izmantojam automātiskos kodētājus?

Anomāliju noteikšana, dabiskās valodas apstrāde un datora vīzija ir tikai dažas no disciplīnām, kurās izmanto automātiskos kodētājus. Piemēram, automātiskos kodētājus var izmantot attēlu saspiešanai, attēla trokšņa samazināšanai un attēla sintēzei datorredzē.

Mēs varam izmantot automātiskos kodētājus tādos uzdevumos kā teksta izveide, teksta kategorizēšana un teksta apkopošana dabiskās valodas apstrādē. Tas var identificēt anomālu darbību datos, kas novirzās no normas anomālijas identificēšanā.

7. Kapsulas tīkli

Capsule Networks ir jauna dziļas mācīšanās arhitektūra, kas tika izstrādāta kā konvolucionālo neironu tīklu (CNN) aizstājējs.

Kapsulu tīkli ir balstīti uz priekšstatu par smadzeņu vienību, ko sauc par kapsulām, grupēšanu, kas ir atbildīgas par noteikta objekta esamības atpazīšanu attēlā un tā atribūtu, piemēram, orientācijas un pozīcijas, kodēšanu savos izvades vektoros. Tāpēc kapsulu tīkli var labāk pārvaldīt telpisko mijiedarbību un perspektīvas svārstības nekā CNN.

Kāpēc mēs izvēlamies kapsulu tīklus, nevis CNN?

Kapsulas tīkli ir noderīgi, jo tie pārvar CNN grūtības, tverot hierarhiskas attiecības starp attēla vienumiem. CNN var atpazīt dažāda lieluma lietas, bet grūti saprast, kā šie vienumi savienojas viens ar otru.

No otras puses, kapsulu tīkli var iemācīties atpazīt lietas un to daļas, kā arī to, kā tās ir telpiski novietotas attēlā, padarot tās par dzīvotspējīgu sāncensi datora redzes lietojumprogrammām.

Pielietojuma jomas

Kapsulas tīkli jau ir parādījuši daudzsološus rezultātus dažādās lietojumprogrammās, tostarp attēlu klasifikācijā, objektu identificēšanā un attēlu segmentācijā.

Tie ir izmantoti, lai atšķirtu lietas medicīniskajos fotoattēlos, atpazītu cilvēkus filmās un pat izveidotu 3D modeļus no 2D attēliem.

Lai palielinātu veiktspēju, kapsulu tīkli ir apvienoti ar citām dziļās mācīšanās arhitektūrām, piemēram, ģeneratīvajiem pretrunīgiem tīkliem (GAN) un variācijas automātiskajiem kodētājiem (VAE). Tiek prognozēts, ka kapsulu tīkliem būs arvien svarīgāka loma datorredzes tehnoloģiju uzlabošanā, attīstoties dziļās mācīšanās zinātnei.

Piemēram; Nibabels ir labi zināms Python rīks neiroattēlu failu tipu lasīšanai un rakstīšanai. Attēlu segmentēšanai tas izmanto kapsulu tīklus.

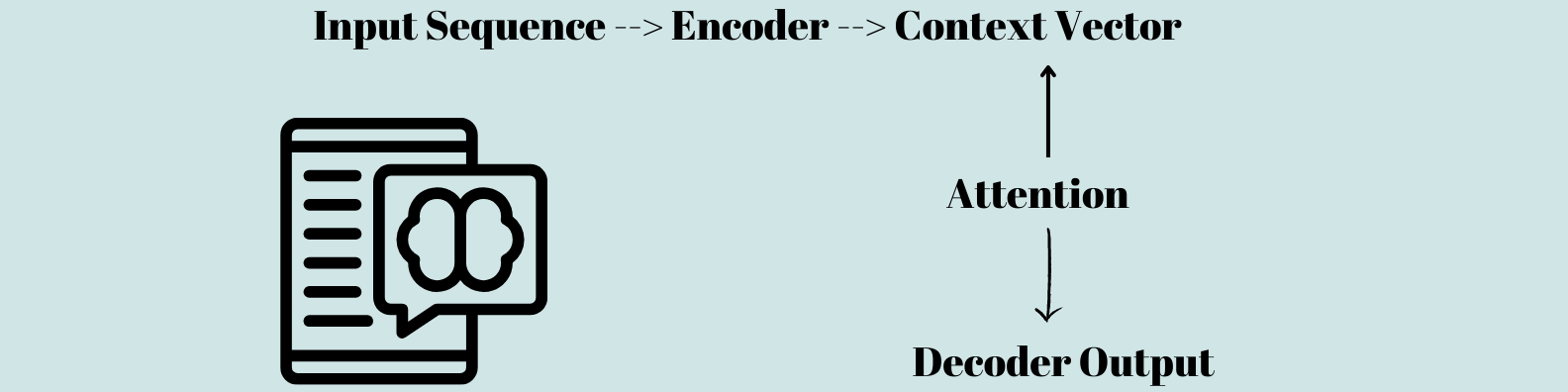

8. Uzmanībā balstīti modeļi

Dziļās mācīšanās modeļi, kas pazīstami kā uz uzmanību balstīti modeļi, kas pazīstami arī kā uzmanības mehānismi, cenšas palielināt informācijas precizitāti. mašīnmācīšanās modeļi. Šie modeļi darbojas, koncentrējoties uz noteiktām ienākošo datu iezīmēm, tādējādi nodrošinot efektīvāku un efektīvāku apstrādi.

Dabiskās valodas apstrādes uzdevumos, piemēram, mašīntulkošanā un sentimenta analīzē, uzmanības metodes ir izrādījušās diezgan veiksmīgas.

Kāda ir viņu nozīme?

Uz uzmanību balstīti modeļi ir noderīgi, jo tie ļauj efektīvāk un efektīvāk apstrādāt sarežģītus datus.

Tradicionālie neironu tīkli novērtēt visus ievades datus kā vienlīdz svarīgus, kā rezultātā apstrāde palēninās un precizitāte samazinās. Uzmanības procesi koncentrējas uz būtiskiem ievades datu aspektiem, kas ļauj ātrāk un precīzāk prognozēt.

Lietošanas jomas

Mākslīgā intelekta jomā uzmanības mehānismiem ir plašs lietojumu klāsts, tostarp dabiskās valodas apstrāde, attēla un audio atpazīšana un pat transportlīdzekļi bez vadītāja.

Piemēram, uzmanības pievēršanas metodes var izmantot, lai uzlabotu mašīntulkošanu dabiskās valodas apstrādē, ļaujot sistēmai koncentrēties uz noteiktiem vārdiem vai frāzēm, kas ir būtiskas kontekstam.

Uzmanības metodes autonomajās automašīnās var izmantot, lai palīdzētu sistēmai koncentrēties uz noteiktiem priekšmetiem vai problēmām tās apkārtnē.

9. Transformatoru tīkli

Transformatoru tīkli ir dziļas mācīšanās modeļi, kas pārbauda un veido datu secības. Tie darbojas, apstrādājot ievades secību pa vienam elementam un veidojot tāda paša vai dažāda garuma izvades secību.

Transformatoru tīkli, atšķirībā no standarta secības-sekvences modeļiem, neapstrādā secības, izmantojot atkārtotus neironu tīklus (RNN). Tā vietā viņi izmanto sevis uzmanības procesus, lai uzzinātu saiknes starp secības daļām.

Kāda ir transformatoru tīklu nozīme?

Transformatoru tīkli pēdējos gados ir kļuvuši populāri, jo tie ir labāk snieguši dabiskās valodas apstrādes darbus.

Tie ir īpaši piemēroti teksta veidošanas uzdevumiem, piemēram, valodas tulkošanai, teksta apkopošanai un sarunu veidošanai.

Transformatoru tīkli ir ievērojami efektīvāki skaitļošanas ziņā nekā modeļi, kuru pamatā ir RNN, tāpēc tie ir ieteicami liela mēroga lietojumiem.

Kur var atrast transformatoru tīklus?

Transformatoru tīkli tiek plaši izmantoti plašā lietojumu klāstā, jo īpaši dabiskās valodas apstrādē.

GPT (ģeneratīvo iepriekš apmācītu transformatoru) sērija ir ievērojams transformatora modelis, kas ir izmantots tādiem uzdevumiem kā valodas tulkošana, teksta apkopošana un tērzēšanas robotu ģenerēšana.

BERT (Bidirectional Encoder Representations from Transformers) ir vēl viens izplatīts uz transformatoriem balstīts modelis, kas ir izmantots dabiskās valodas izpratnes lietojumprogrammām, piemēram, atbildēm uz jautājumiem un sentimenta analīzei.

Abi GPT un BERT tika izveidoti ar PyTorch, atvērtā koda padziļinātas apmācības sistēma, kas ir bijusi populāra uz transformatoriem balstītu modeļu izstrādē.

10. Ierobežotas Boltzmann mašīnas (RBM)

Ierobežotās Boltzmann mašīnas (RBM) ir sava veida neuzraudzīts neironu tīkls, kas mācās ģeneratīvā veidā. Sakarā ar to spēju mācīties un iegūt būtiskas īpašības no augstas dimensijas datiem, tie ir plaši izmantoti mašīnmācības un dziļās mācīšanās jomās.

RBM sastāv no diviem slāņiem, redzamiem un slēptiem, un katrs slānis sastāv no neironu grupas, kas savienotas ar svērtām malām. RBM ir paredzēti, lai uzzinātu varbūtības sadalījumu, kas apraksta ievades datus.

Kas ir ierobežotās Boltzmann mašīnas?

RBM izmanto ģeneratīvu mācīšanās stratēģiju. RBM redzamais slānis atspoguļo ievades datus, bet apraktais slānis kodē ievades datu raksturlielumus. Redzamo un slēpto slāņu svars parāda to saites stiprumu.

GSM pielāgo svarus un novirzes starp slāņiem treniņa laikā, izmantojot paņēmienu, kas pazīstams kā kontrastējošā atšķirība. Kontrastīvā atšķirība ir nepārraudzīta mācīšanās stratēģija, kas palielina modeļa prognozēšanas iespējamību.

Kāda ir ierobežoto Boltzmann mašīnu nozīme?

GSM ir nozīmīgi mašīna mācīšanās un padziļināta mācīšanās, jo viņi var mācīties un iegūt atbilstošus raksturlielumus no liela datu apjoma.

Tie ir ļoti efektīvi attēla un runas atpazīšanai, un tie ir izmantoti dažādās lietojumprogrammās, piemēram, ieteikumu sistēmās, anomāliju noteikšanā un izmēru samazināšanā. RBM var atrast modeļus plašās datu kopās, tādējādi nodrošinot izcilas prognozes un ieskatus.

Kur var izmantot ierobežotās Boltzmann mašīnas?

GSM lietojumprogrammas ietver izmēru samazināšanas, anomāliju noteikšanas un ieteikumu sistēmas. RBM ir īpaši noderīgi noskaņojuma analīzei un tēmu modelēšana dabiskās valodas apstrādes kontekstā.

Dziļās pārliecības tīkli, sava veida neironu tīkls, ko izmanto balss un attēla atpazīšanai, arī izmanto RBM. Deep Belief Network Toolbox, TensorFlow, un Theano ir daži konkrēti programmatūras vai tehnoloģiju piemēri, kas izmanto RBM.

Satīt

Dziļās mācīšanās modeļi kļūst arvien svarīgāki dažādās nozarēs, tostarp runas atpazīšanā, dabiskās valodas apstrādē un datorredzēšanā.

Konvolucionālie neironu tīkli (CNN) un atkārtotie neironu tīkli (RNN) ir izrādījušies visdaudzsološākie un tiek plaši izmantoti daudzās lietojumprogrammās, tomēr visiem dziļās mācīšanās modeļiem ir savas priekšrocības un trūkumi.

Tomēr pētnieki joprojām pēta ierobežotās Boltzmann mašīnas (RBM) un citus dziļās mācīšanās modeļu veidus, jo arī tiem ir īpašas priekšrocības.

Paredzams, ka tiks radīti jauni un radoši modeļi, jo dziļās mācīšanās joma turpina attīstīties, lai risinātu grūtākas problēmas

Atstāj atbildi