ສາລະບານ[ເຊື່ອງ][ສະແດງ]

Cloud GPUs ແມ່ນມີຄວາມຕ້ອງການອັນໃຫຍ່ຫຼວງ ເນື່ອງຈາກເທັກໂນໂລຍີໃໝ່ໆ ເຊັ່ນ: ການຮຽນຮູ້ເລິກເຊິ່ງ, AI, ແລະການຮຽນຮູ້ເຄື່ອງຈັກເກີດຂຶ້ນ.

GPUs (ຫນ່ວຍປະມວນຜົນກາຟິກ) ແມ່ນໂປເຊດເຊີພິເສດທີ່ສ້າງຂຶ້ນເພື່ອຈັດການກັບຊຸດຂໍ້ມູນອັນໃຫຍ່ຫຼວງແລະການຄິດໄລ່ທີ່ສັບສົນທີ່ຈໍາເປັນສໍາລັບກິດຈະກໍາຕ່າງໆເຊັ່ນຮູບພາບຄອມພິວເຕີແລະການຫຼິ້ນເກມ. ພວກເຂົາເຈົ້າໃນປັດຈຸບັນມີຄວາມສໍາຄັນສໍາລັບພາກສະຫນາມຂອງ ປັນຍາປະດິດ (AI) ເຊັ່ນດຽວກັນ, ເຖິງແມ່ນວ່າ, ໃນຕອນທ້າຍ.

CPU ແບບດັ້ງເດີມ (ຫນ່ວຍປະມວນຜົນກາງ) ບໍ່ສາມາດຕອບສະຫນອງຄວາມຕ້ອງການໄດ້ເນື່ອງຈາກຕົວແບບ AI ຕ້ອງການພະລັງງານຄອມພິວເຕີ້ຫຼາຍເພື່ອຝຶກອົບຮົມແລະແລ່ນ.

ໃນທາງກົງກັນຂ້າມ, ຍ້ອນວ່າພວກມັນຖືກສ້າງຂື້ນເພື່ອສະຫນັບສະຫນູນການປຸງແຕ່ງຂະຫນານ, GPUs ມີປະສິດທິພາບຫຼາຍຂຶ້ນໃນການຄຸ້ມຄອງປະລິມານຂະຫນາດໃຫຍ່ຂອງຂໍ້ມູນແລະການຄິດໄລ່ທີ່ສັບສົນທີ່ຈໍາເປັນສໍາລັບການປະຕິບັດງານ AI.

ຖ້າທ່ານຢູ່ໃນເຕັກໂນໂລຢີ, ທ່ານຕ້ອງໄດ້ຍິນກ່ຽວກັບການບໍລິການ cloud GPU. ສໍາລັບຜູ້ທີ່, ຜູ້ທີ່ຈະບໍ່ປະຕິບັດຕາມ.

ການບໍລິການທີ່ອີງໃສ່ຄລາວທີ່ໃຫ້ຜູ້ໃຊ້ອອນໄລນ໌ເຂົ້າເຖິງຊັບພະຍາກອນ GPU ທີ່ມີທ່າແຮງແມ່ນເປັນທີ່ຮູ້ຈັກເປັນບໍລິການ GPU cloud ສໍາລັບ AI. ແທນທີ່ຈະຕ້ອງການຊື້ແລະຮັກສາຮາດແວ GPU ຂອງຕົນເອງ, ການບໍລິການເຫຼົ່ານີ້ເຮັດໃຫ້ລູກຄ້າສາມາດເຊົ່າຊັບພະຍາກອນ GPU ໄດ້ຕາມຄວາມຕ້ອງການ.

ນີ້ເຮັດໃຫ້ມັນເປັນໄປໄດ້ສໍາລັບປະຊາຊົນແລະອົງການຈັດຕັ້ງທີ່ຈະນໍາໃຊ້ຄວາມສາມາດໃນການປະມວນຜົນຂອງ GPUs ໂດຍບໍ່ມີການລົງທຶນເບື້ອງຕົ້ນຂະຫນາດໃຫຍ່ຫຼືຈ່າຍຄ່າທໍານຽມການບໍາລຸງຮັກສາຢ່າງຕໍ່ເນື່ອງ.

ສ່ວນໃຫຍ່ຂອງການບໍລິການ GPU cloud ສໍາລັບ AI ສະຫນອງທາງເລືອກ GPU ຫລາກຫລາຍ, ລວມທັງຫຼາຍແບບແລະການຕັ້ງຄ່າແລະຄວາມຍືດຫຍຸ່ນໃນການຂະຫຍາຍຫຼືຫຼຸດລົງຕາມຄວາມຈໍາເປັນ. ດຽວນີ້ທ່ານສາມາດເລືອກຊັບພະຍາກອນ GPU ທີ່ເໝາະສົມສຳລັບຄວາມຕ້ອງການ ແລະໂຄງການທີ່ເປັນເອກະລັກຂອງເຂົາເຈົ້າໄດ້ໂດຍຂອບໃຈການບໍລິການນີ້.

ນອກຈາກນັ້ນ, ການບໍລິການມັກຈະມາພ້ອມກັບຄວາມສາມາດອື່ນໆລວມທັງເຄືອຂ່າຍ, ການເກັບຮັກສາ, ແລະເຄື່ອງມືຊອບແວເພື່ອຊ່ວຍລູກຄ້າໃນໂຄງການ AI ຂອງພວກເຂົາ. ໃນບົດຂຽນນີ້, ພວກເຮົາຈະເບິ່ງການບໍລິການ GPU ເທິງຄລາວ ສຳ ລັບ AI.

1. Linode

Linode ໃຫ້ GPUs ຕາມຄວາມຕ້ອງການຂອງວຽກເຊັ່ນການປຸງແຕ່ງວິດີໂອ, ຄອມພິວເຕີ້ວິທະຍາສາດ, ການຮຽນຮູ້ເຄື່ອງຈັກ, ປັນຍາປະດິດ, ແລະອື່ນໆ.

ມັນສະຫນອງ GPU-optimized virtual machines (VMs) ທີ່ດໍາເນີນການໃນ NVIDIA Quadro RTX 6000, Tensor, ແລະ RT cores ແລະໃຊ້ຄວາມສາມາດ CUDA ທີ່ຈະເຮັດ. ການຮຽນຮູ້ລຶກລັບ, ray tracing workloads , ແລະການຄິດໄລ່ທີ່ຊັບຊ້ອນ.

ໂດຍການປ່ຽນລາຍຈ່າຍທຶນຂອງທ່ານໃຫ້ເປັນຄ່າໃຊ້ຈ່າຍໃນການດໍາເນີນງານ, ທ່ານສາມາດນໍາໃຊ້ຄວາມສາມາດ GPU ຂອງ Linode GPU ແລະມູນຄ່າທີ່ແທ້ຈິງຂອງຟັງໄດ້.

ນອກຈາກນັ້ນ, Linode ເຮັດໃຫ້ທ່ານບໍ່ຕ້ອງກັງວົນກ່ຽວກັບຮາດແວເພື່ອໃຫ້ທ່ານສາມາດສຸມໃສ່ທັກສະທີ່ເຂັ້ມແຂງທີ່ສຸດຂອງທ່ານ.

ດ້ວຍ Linode GPUs, ດຽວນີ້ສາມາດນຳໃຊ້ພວກມັນໄດ້ສຳລັບແອັບພລິເຄຊັນທີ່ທັນສະໄໝເຊັ່ນ: ການຖ່າຍທອດວິດີໂອ, ປັນຍາປະດິດ ແລະການຮຽນຮູ້ເຄື່ອງຈັກ.

ນອກຈາກນັ້ນ, ອີງຕາມຈໍານວນພະລັງງານການປຸງແຕ່ງທີ່ຕ້ອງການສໍາລັບວຽກງານທີ່ຄາດໄວ້, ທ່ານສາມາດໄດ້ຮັບເຖິງ 4 ບັດສໍາລັບແຕ່ລະຕົວຢ່າງ.

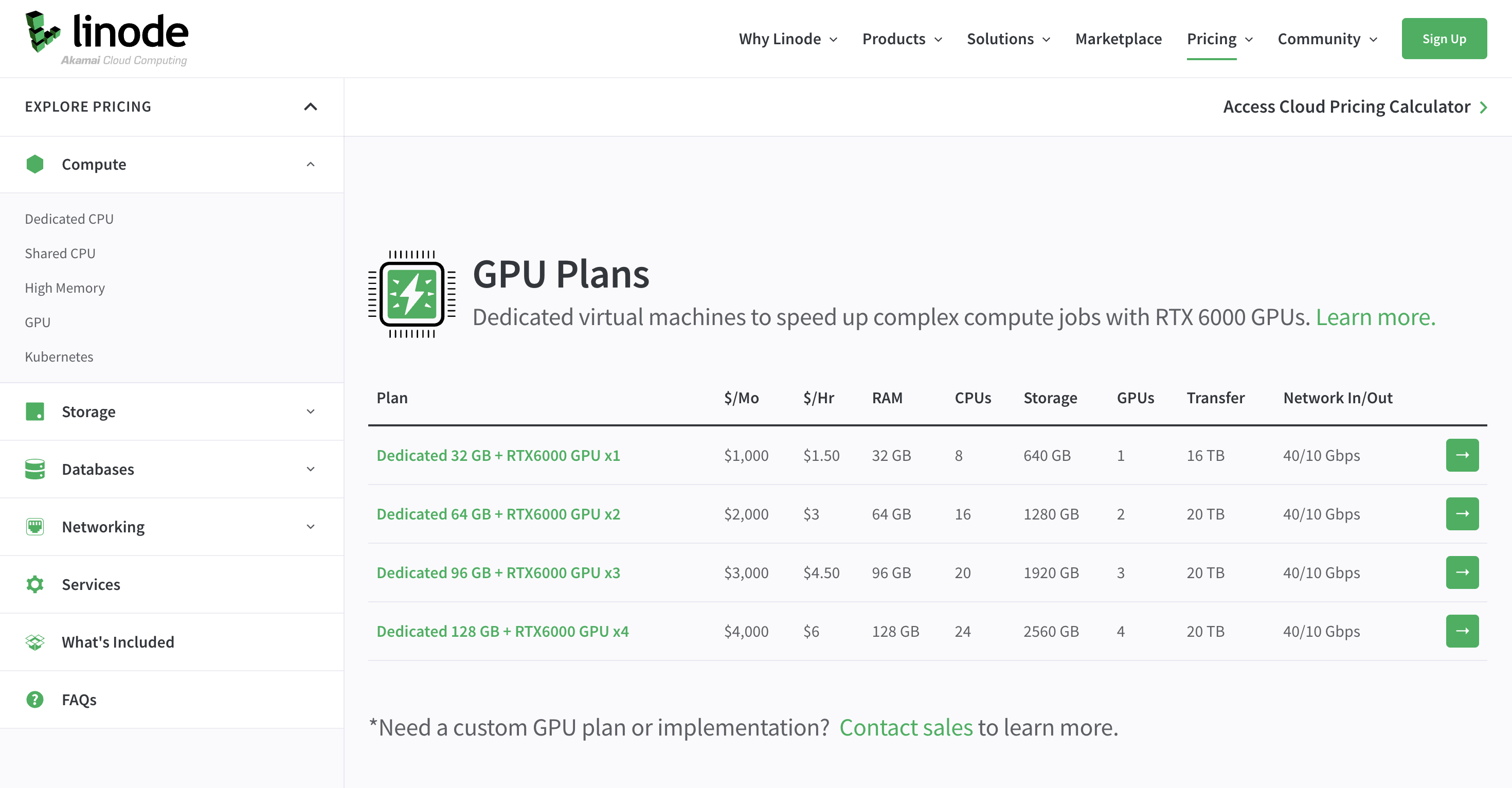

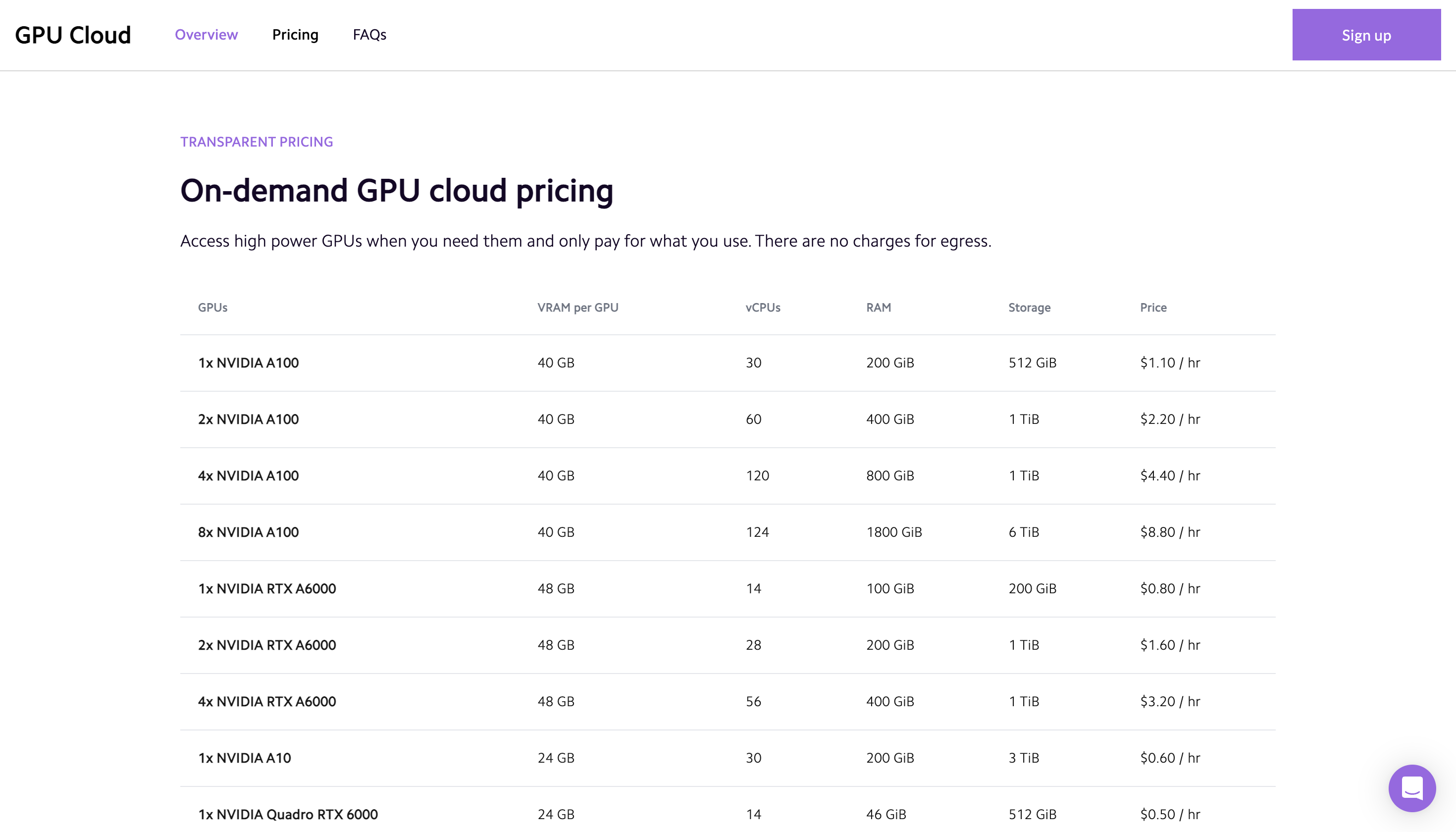

ການຕັ້ງລາຄາ

ລາຄາເລີ່ມຕົ້ນທີ່ $1.5/ຊົ່ວໂມງ ສໍາລັບແຜນ RTX6000 GPU ທີ່ອຸທິດຕົນ. ເລີ່ມຕົ້ນດ້ວຍ Linode ໄດ້ຟຣີ.

2. AI ທີ່ກວ້າງຂວາງ

AI ທີ່ກວ້າງຂວາງແມ່ນຕະຫຼາດທົ່ວໂລກທີ່ຜູ້ໃຊ້ສາມາດເຊົ່າ GPU ທີ່ມີລາຄາຖືກເພື່ອໃຊ້ໃນຄອມພິວເຕີ້ທີ່ມີປະສິດທິພາບສູງ.

ພວກເຂົາຫຼຸດຜ່ອນຄ່າໃຊ້ຈ່າຍຂອງວຽກງານທີ່ຫນັກຫນ່ວງໃນຄອມພິວເຕີ້ໂດຍການເຮັດໃຫ້ເຈົ້າພາບເຊົ່າຮາດແວ GPU ຂອງພວກເຂົາ, ຊ່ວຍໃຫ້ຜູ້ໃຊ້ສາມາດນໍາໃຊ້ເຄື່ອງມືຄົ້ນຫາອອນໄລນ໌ຂອງພວກເຂົາເພື່ອຊອກຫາລາຄາທີ່ຖືກທີ່ສຸດສໍາລັບຄອມພິວເຕີ້ຕາມຄວາມຕ້ອງການຂອງພວກເຂົາແລະປະຕິບັດຄໍາສັ່ງຫຼືເປີດການເຊື່ອມຕໍ່ SSH.

ພວກເຂົາສະຫນອງຕົວຢ່າງ SSH, Jupyter instances ກັບ Jupyter GUI, ຫຼືຕົວຢ່າງຄໍາສັ່ງເທົ່ານັ້ນ, ແລະມີລັກສະນະກົງໄປກົງມາ. user interface.

ຟັງຊັນການປະຕິບັດການຮຽນຮູ້ເລິກ (DLPerf), ເຊິ່ງຄາດຄະເນການປະຕິບັດຫນ້າວຽກການຮຽນຮູ້ເລິກທີ່ຄາດຄະເນ, ແມ່ນສະຫນອງໃຫ້.

ລະບົບທີ່ໃຊ້ໂດຍ Vast AI ແມ່ນໃຊ້ Ubuntu ແລະບໍ່ໄດ້ສະເຫນີ desktop ຫ່າງໄກສອກຫຼີກ. ພວກເຂົາເຈົ້າຍັງດໍາເນີນການຕົວຢ່າງທີ່ມີຢູ່ຕາມຄວາມຕ້ອງການສໍາລັບຄ່າທໍານຽມສະເພາະທີ່ສ້າງຂຶ້ນໂດຍເຈົ້າພາບ.

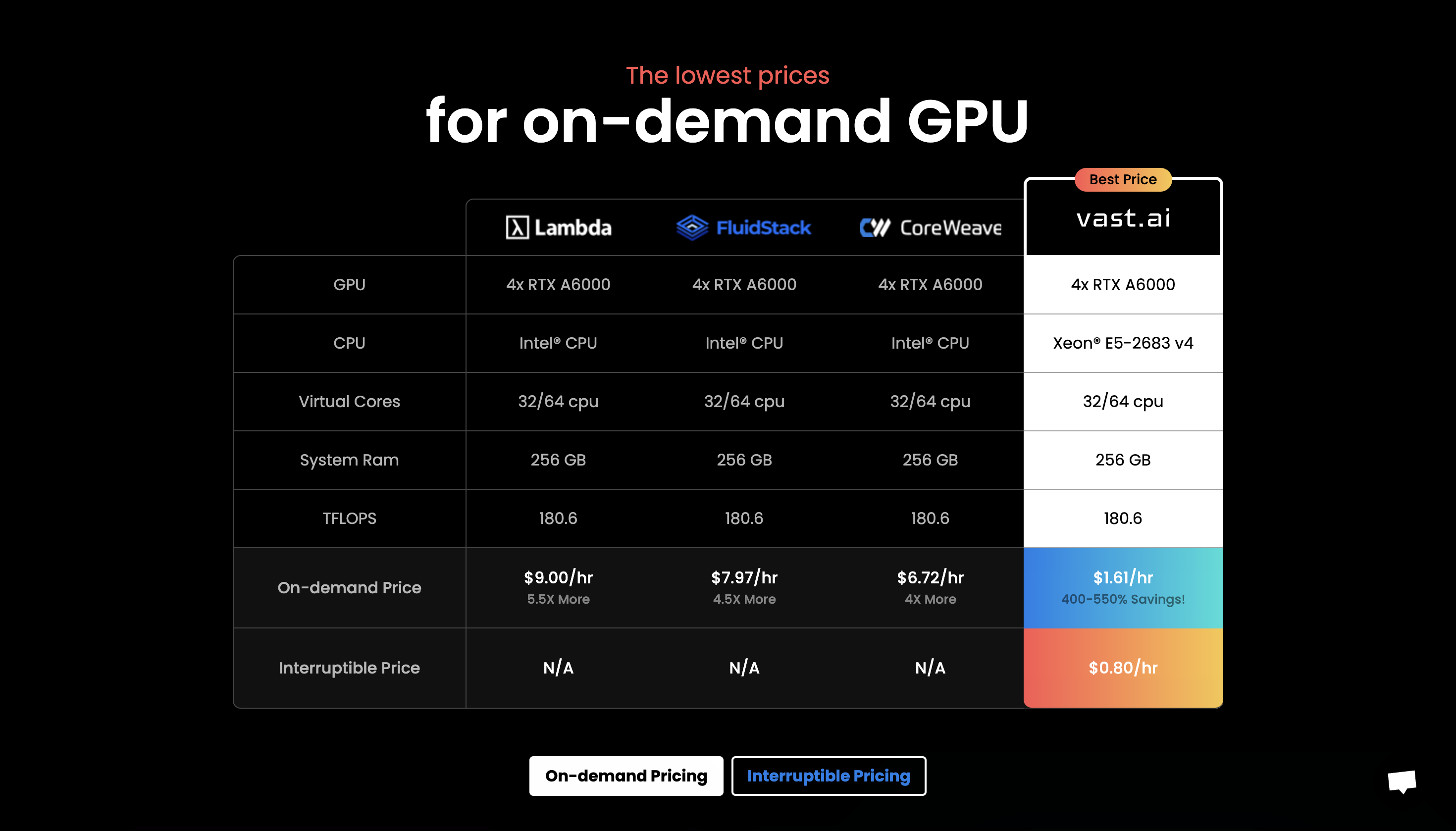

ການຕັ້ງລາຄາ

ລາຄາເລີ່ມຕົ້ນທີ່ $0.80/ຊົ່ວໂມງ ສໍາລັບ 4x RTX A6000.

3. AWS & NVIDIA

ຮ່ວມກັນ, AWS ແລະ NVIDIA ກໍາລັງສະຫນອງການແກ້ໄຂ GPU ທີ່ມີລາຄາບໍ່ແພງ, ສາມາດປັບຕົວໄດ້, ແລະມີປະສິດທິພາບຢ່າງຕໍ່ເນື່ອງ.

ມັນປະກອບມີ NVIDIA GPU-powered Amazon EC2 instances ແລະການບໍລິການເຊັ່ນ AWS IoT Greengrass ທີ່ຕິດຕັ້ງດ້ວຍໂມດູນ NVIDIA Jetson Nano.

ສໍາລັບບ່ອນເຮັດວຽກ virtual, ການຮຽນຮູ້ເຄື່ອງຈັກ (ML), ການບໍລິການອິນເຕີເນັດຂອງສິ່ງຕ່າງໆ (IoT), ແລະຄອມພິວເຕີ້ທີ່ມີປະສິດທິພາບສູງ, ຜູ້ໃຊ້ໃຊ້ AWS ແລະ NVIDIA. ປະສິດທິພາບທີ່ສາມາດຂະຫຍາຍໄດ້ແມ່ນສະໜອງໃຫ້ໂດຍ NVIDIA GPUs ທີ່ໃຫ້ພະລັງງານ Amazon EC2 instances.

ນອກຈາກນັ້ນ, ນໍາໃຊ້ AWS IoT Greengrass ເພື່ອເຊື່ອມຕໍ່ອຸປະກອນຂອບ NVIDIA ກັບການບໍລິການຄລາວຂອງ AWS.

ຕົວຢ່າງ Amazon EC2 P4d ແມ່ນຂັບເຄື່ອນໂດຍ NVIDIA A100 Tensor Core GPUs, ເຊິ່ງສະຫນອງເຄືອຂ່າຍ latency ຕ່ໍາສຸດຂອງອຸດສາຫະກໍາແລະການສົ່ງຜ່ານສູງສຸດ.

ເຊັ່ນດຽວກັນນີ້, ມີຕົວຢ່າງທີ່ແຕກຕ່າງກັນອື່ນໆທີ່ມີຢູ່ສໍາລັບສະຖານະການສະເພາະໃດຫນຶ່ງ, ເຊັ່ນ Amazon EC2 P3, Amazon EC2 G4, ແລະອື່ນໆ.

ການຕັ້ງລາຄາ

ທ່ານສາມາດສະໝັກທົດລອງໃຊ້ໄດ້ຟຣີ ແລະ ກະລຸນາຕິດຕໍ່ຜູ້ຂາຍສຳລັບລາຄາຂອງມັນ.

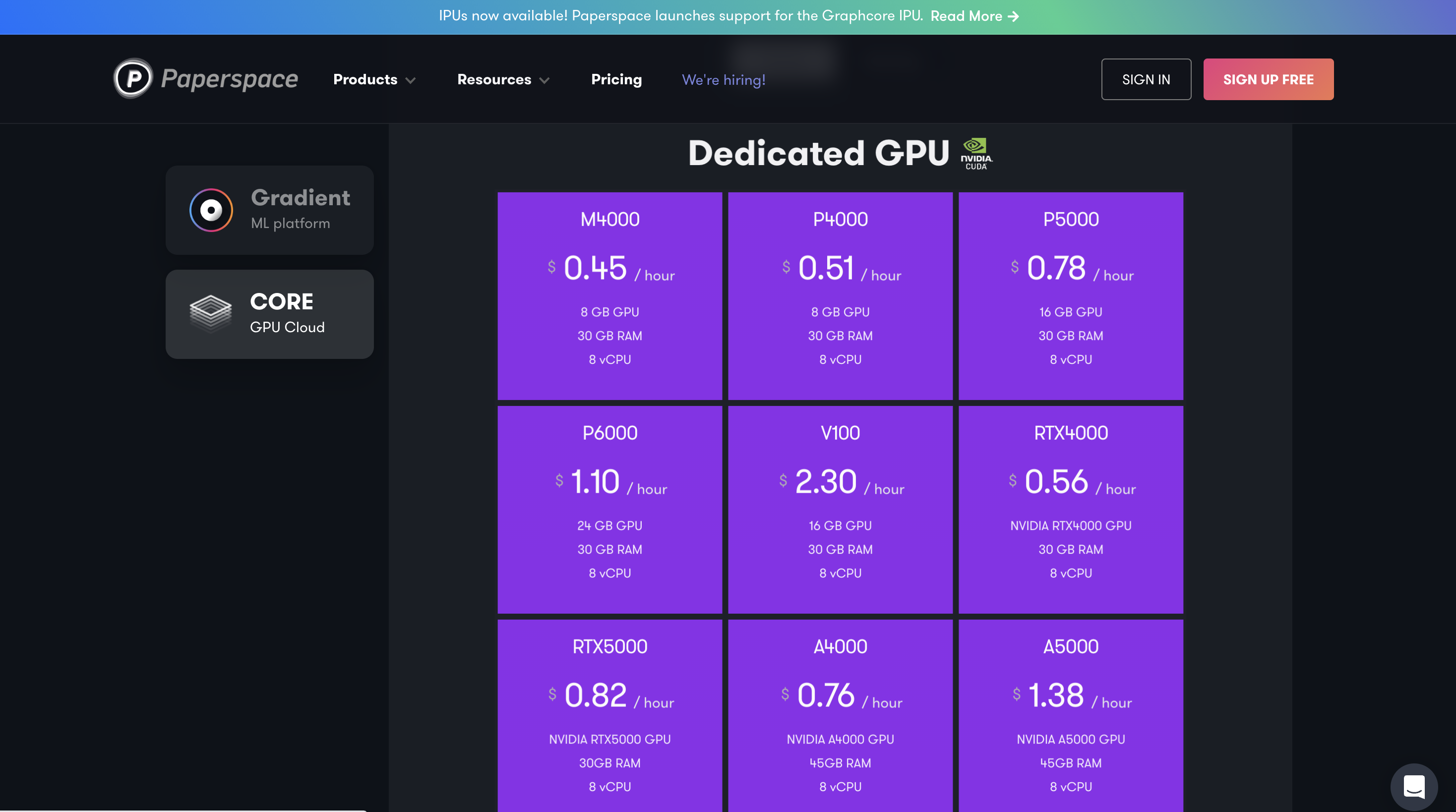

4. Paperspace CORE

A CORE ແມ່ນແພລະຕະຟອມ GPU cloud ທີ່ມີການຈັດການຢ່າງເຕັມທີ່ທີ່ສ້າງຂື້ນໂດຍ Paperspace ທີ່ສະຫນອງຄອມພິວເຕີ້ທີ່ກົງໄປກົງມາ, ປະຫຍັດຄ່າໃຊ້ຈ່າຍ, ແລະເລັ່ງສໍາລັບຄໍາຮ້ອງສະຫມັກທີ່ຫລາກຫລາຍ.

ໃຊ້ພື້ນຖານໂຄງລ່າງຄອມພິວເຕີ້ເລັ່ງລັດທີ່ທັນສະໄໝທີ່ສະໜອງໃຫ້ໂດຍ Paperspace CORE ເພື່ອເລັ່ງຂະບວນການຈັດຕັ້ງ. ສໍາລັບການເລີ່ມຕົ້ນໄວ, ເຄື່ອງມືຮ່ວມມື, ແລະຄໍາຮ້ອງສະຫມັກ desktop ສໍາລັບ Mac, Linux, ແລະ Windows, ມັນສະຫນອງການໂຕ້ຕອບຜູ້ເປັນມິດແລະບໍ່ສັບສົນ.

ໃຊ້ມັນເພື່ອປະຕິບັດໂຄງການທີ່ຕ້ອງການໃນຈໍານວນທີ່ບໍ່ມີຂອບເຂດຂອງພະລັງງານປະມວນຜົນ. CORE ສະໜອງເຄືອຂ່າຍທີ່ໄວສຸດ, ການສະໜອງໄວ, ຮອງຮັບແອັບ 3 ມິຕິ, ແລະ API ທີ່ສົມບູນສຳລັບການເຂົ້າເຖິງແບບໂປຣແກຣມ.

ດ້ວຍ GUI ທີ່ໃຊ້ງ່າຍ ແລະເຂົ້າໃຈງ່າຍ, ໄດ້ຮັບຮູບພາບທີ່ສົມບູນແບບຂອງໂຄງສ້າງພື້ນຖານຂອງທ່ານໃນບ່ອນດຽວ.

ນອກຈາກນັ້ນ, ໄດ້ຮັບການຄວບຄຸມທີ່ດີເລີດຍ້ອນການໂຕ້ຕອບການບໍລິຫານຂອງ CORE, ເຊິ່ງສະຫນອງເຄື່ອງມືທີ່ມີປະສິດທິພາບແລະຊ່ວຍໃຫ້ທ່ານສາມາດກັ່ນຕອງ, ຈັດຮຽງ, ເຊື່ອມຕໍ່, ຫຼືສ້າງເຄື່ອງຈັກ, ເຄືອຂ່າຍ, ແລະຜູ້ໃຊ້.

ການຕັ້ງລາຄາ

ລາຄາເລີ່ມຕົ້ນທີ່ $0.45/ຊົ່ວໂມງ ສໍາລັບ M4000 GPU ທີ່ອຸທິດຕົນ.

5. ບໍລິການ GPU Elastic ຂອງ Alibaba

Alibaba Elastic GPU Service (EGS) ໝູນໃຊ້ເທັກໂນໂລຍີ GPU ເພື່ອສະໜອງຄວາມສາມາດປະມວນຜົນຂະໜານ ແລະ ທີ່ມີປະສິດທິພາບ. ຄໍາຮ້ອງສະຫມັກຈໍານວນຫຼາຍ, ລວມທັງການປະມວນຜົນວິດີໂອ, ການເບິ່ງເຫັນ, ຄອມພິວເຕີທາງວິທະຍາສາດ, ແລະການຮຽນຮູ້ເລິກ, ແມ່ນເຫມາະສົມດີສໍາລັບມັນ.

EGS ເຮັດໃຫ້ການນໍາໃຊ້ GPUs ຈໍານວນຫນຶ່ງ, ລວມທັງ AMD FirePro S7150, NVIDIA Tesla M40, NVIDIA Tesla V100, NVIDIA Tesla P4, ແລະ NVIDIA Tesla P100.

ທ່ານຈະໄດ້ເຂົ້າເຖິງຂໍ້ໄດ້ປຽບລວມທັງອອນໄລນ໌ ການບໍລິການ inference ການຮຽນຮູ້ເລິກແລະການຝຶກອົບຮົມ, ການລະບຸເນື້ອຫາ, ການຮັບຮູ້ຮູບພາບ ແລະສຽງ, ການເຂົ້າລະຫັດສື່ HD, ການປະຊຸມວິດີໂອ, ການຟື້ນຟູຮູບເງົາແຫຼ່ງ, ແລະ 4K/8K HD ສົດ.

ໄດ້ຮັບທາງເລືອກຕ່າງໆເຊັ່ນ: ການສະແດງວິດີໂອ, ການເງິນທາງຄອມພິວເຕີ, ການຄາດເດົາສະພາບອາກາດ, ການຈໍາລອງການປະທະກັນ, ວິສະວະກໍາພັນທຸກໍາ, ການແກ້ໄຂທີ່ບໍ່ແມ່ນເສັ້ນ, ຄໍາຮ້ອງສະຫມັກການສຶກສາຫ່າງໄກ, ແລະການອອກແບບວິສະວະກໍາ, ເຊັ່ນດຽວກັນ.

ການຕັ້ງລາຄາ

ມັນສະຫນອງການທົດລອງຟຣີແລະແຜນການສະຫມັກແບບຈ່າຍຕາມທີ່ທ່ານໄປ, ຊຶ່ງຫມາຍຄວາມວ່າທ່ານພຽງແຕ່ໃຊ້ຕົວຢ່າງໃດຫຼື GPUs ທີ່ທ່ານໃຊ້.

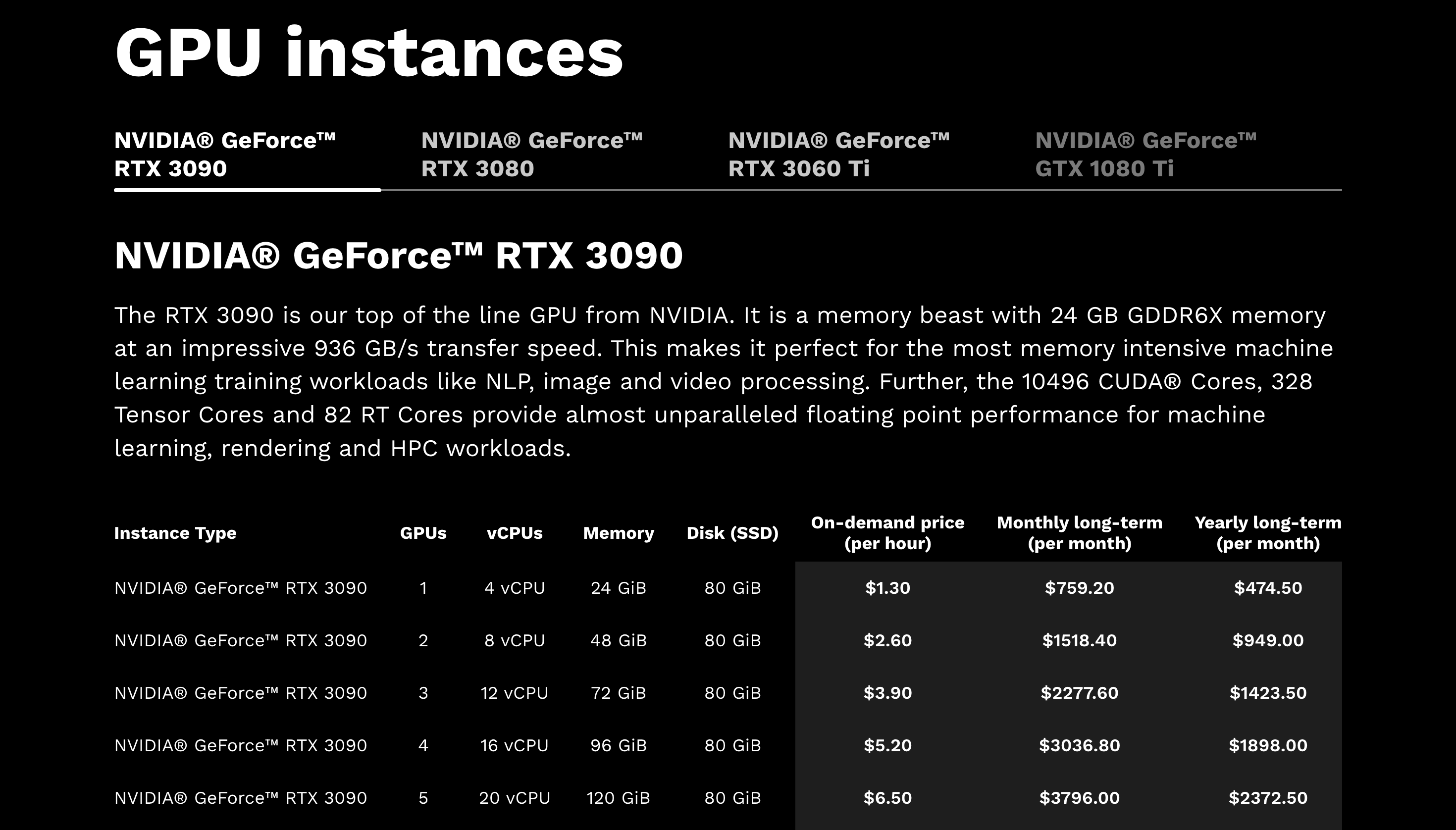

6. Genesis Cloud

Genesis Cloud ສະເຫນີແພລະຕະຟອມ GPU cloud ທີ່ມີຄ່າໃຊ້ຈ່າຍສູງ. ພວກເຂົາເຈົ້າກໍາລັງເຮັດວຽກຮ່ວມມືກັບສູນຂໍ້ມູນທີ່ມີປະສິດທິພາບຫຼາຍແຫ່ງທົ່ວໂລກເພື່ອສະຫນອງຄໍາຮ້ອງສະຫມັກທີ່ຫລາກຫລາຍ.

Genesis Cloud ສະຫນອງຄຸນສົມບັດທີ່ເປັນປະໂຫຍດທີ່ຫຼາກຫຼາຍໂດຍບໍ່ມີຄ່າໃຊ້ຈ່າຍເພີ່ມເຕີມ, ລວມທັງພາບຖ່າຍສໍາລັບການສໍາຮອງຂໍ້ມູນວຽກງານຂອງທ່ານ, ກຸ່ມຄວາມປອດໄພສໍາລັບການຈາລະຈອນເຄືອຂ່າຍ, ປະລິມານການເກັບຮັກສາສໍາລັບຊຸດຂໍ້ມູນຂະຫນາດໃຫຍ່, FastAI, PyTorch, ຮູບພາບທີ່ກໍານົດໄວ້ກ່ອນ, ແລະ TensorFlow API ສາທາລະນະ.

ພວກເຂົາເລັ່ງການຄິດໄລ່ດ້ວຍການຊ່ວຍເຫຼືອຂອງ NVIDIA GeForce RTX 3090, RTX 3080, RTX 3060 Ti, ແລະ GTX 1080 Ti ເທກໂນໂລຍີໃນ cloud GPU ຂອງເຂົາເຈົ້າ.

ທ່ານສາມາດນໍາໃຊ້ພະລັງງານຂອງຄອມພິວເຕີ້ GPU ເພື່ອຜະລິດຮູບເງົາເຄື່ອນໄຫວຫຼືການຝຶກອົບຮົມ ເຄືອຂ່າຍ neural.

ການຕັ້ງລາຄາ

ລາຄາເລີ່ມຕົ້ນທີ່ $1.30/ຊົ່ວໂມງ ສໍາລັບ NVIDIA® GeForce™ RTX 3090.

7. Google Cloud GPU

Google Cloud Platform (GCP) ສະເໜີ GPU ຈໍານວນໜຶ່ງທີ່ສາມາດໃຊ້ເພື່ອເລັ່ງຂະບວນການຕ່າງໆ ເຊັ່ນ: ການຮຽນຮູ້ເຄື່ອງຈັກ, ການຮຽນຮູ້ຢ່າງເລິກເຊິ່ງ ແລະ ຄອມພິວເຕີທີ່ມີປະສິດທິພາບສູງ (HPC).

ຜ່ານຕົວຢ່າງ GPU ເຫຼົ່ານີ້, ເຊິ່ງສະຫນັບສະຫນູນໂດຍ NVIDIA, AMD, ແລະ Intel GPUs, ມັນເປັນໄປໄດ້ທີ່ຈະເຂົ້າເຖິງຫ້ອງສະຫມຸດ CUDA ແລະ cuDNN, ເຊິ່ງຖືກນໍາໃຊ້ເລື້ອຍໆສໍາລັບຄອມພິວເຕີ້ເລັ່ງ GPU.

ເນື່ອງຈາກການດັດແປງເຄື່ອງຈັກ, ລາຄາທີ່ປ່ຽນແປງໄດ້, ແລະຄວາມເປັນໄປໄດ້ຫຼາຍຂອງ GPU, HPC ອາດຈະມີປະສິດທິພາບຫຼາຍຂຶ້ນ.

ນອກຈາກນັ້ນ, ມັນສາມາດຊ່ວຍໃຫ້ທ່ານແບ່ງເບົາວຽກຂອງທ່ານໄດ້. ໃນບັນດາ GPUs ທີ່ພວກເຂົາສະຫນອງແມ່ນ NVIDIA K80, P4, V100, A100, T4, ແລະ P100. ມີພຽງແຕ່ບາງເຂດທີ່ກະແຈກກະຈາຍໄປທົ່ວບ່ອນຕ່າງໆທີ່ມີການເຂົ້າເຖິງ GPUs.

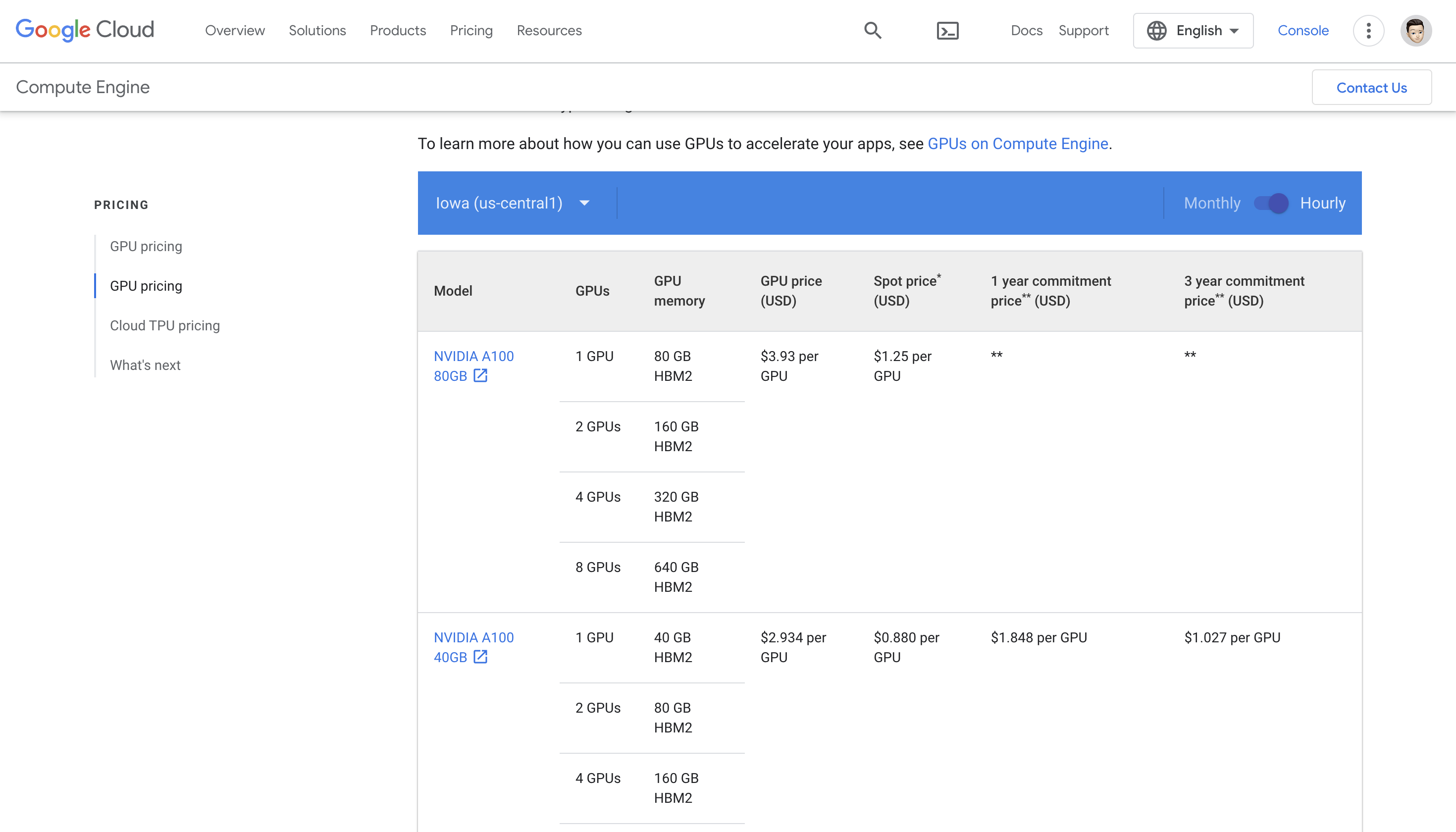

ການຕັ້ງລາຄາ

ຄ່າໃຊ້ຈ່າຍຈະແຕກຕ່າງກັນໄປຕາມພາກພື້ນ, GPU ທີ່ທ່ານເລືອກ, ແລະປະເພດເຄື່ອງ. ສຳລັບ NVIDIA A100, ລາຄາເລີ່ມຕົ້ນທີ່ $3.93 ຕໍ່ GPU.

8. NVIDIA GPU Cloud

NVIDIA GPU Cloud (NGC) ເປັນແພລະຕະຟອມທີ່ອີງໃສ່ຄລາວທີ່ໃຫ້ຜູ້ໃຊ້ເຂົ້າເຖິງຊອບແວທີ່ເລັ່ງ GPU ຕ່າງໆ, ເຊັ່ນ: ເຄື່ອງມືການເບິ່ງເຫັນ, ໂປຣແກຣມ HPC, ແລະ. ການຮຽນຮູ້ລຶກລັບ ກອບວຽກ.

ນັກພັດທະນາ, ນັກວິທະຍາສາດຂໍ້ມູນ, ແລະໃນປັດຈຸບັນນັກຄົ້ນຄວ້າສາມາດນໍາໃຊ້ພະລັງງານຄອມພິວເຕີຂອງ NVIDIA GPUs ຢູ່ໃນຄລາວໄດ້ຢ່າງງ່າຍດາຍໂດຍບໍ່ຈໍາເປັນຕ້ອງກັງວົນກ່ຽວກັບໂຄງສ້າງພື້ນຖານຫຼືການຮັກສາທີ່ຈໍາເປັນເພື່ອປະຕິບັດກິດຂອງເຂົາເຈົ້າຂໍຂອບໃຈກັບ NGC.

ຫ້ອງສະຫມຸດຂອງບັນຈຸຊອຟແວ pre-configured ໄດ້ຖືກລວມເຂົ້າກັບ NGC ແລະສາມາດຖືກນໍາໃຊ້ຢ່າງໄວວາໃນຈໍານວນຂອງ. ຄອມພິວເຕີ້ຟັງ ໂຄງສ້າງພື້ນຖານ, ລວມທັງ Amazon Web Services, Google Cloud Platform, ແລະ Microsoft Azure.

ການເຂົ້າເຖິງ NGC ຍັງໃຫ້ຜູ້ໃຊ້ເຂົ້າເຖິງແພລະຕະຟອມການຮຽນຮູ້ເລິກຂອງ NVIDIA, ເຊິ່ງມາພ້ອມກັບໂຄງການແລະຊັບພະຍາກອນຈໍານວນຫນຶ່ງສໍາລັບການສ້າງແລະປະຕິບັດຮູບແບບການຮຽນຮູ້ເລິກ, ລວມທັງ TensorRT, cuDNN, ແລະ CUDA-X AI.

ການຕັ້ງລາຄາ

ຂຶ້ນກັບການບໍລິການ ແລະຊັບພະຍາກອນສະເພາະທີ່ທ່ານໃຊ້, ລາຄາຂອງ NVIDIA GPU Cloud (NGC) ມີການປ່ຽນແປງ. ໃນຂະນະທີ່ການບໍລິການ NGC ບາງຢ່າງ, ເຊັ່ນ: ຊອບແວການຮຽນຮູ້ເລິກ, ແມ່ນບໍ່ເສຍຄ່າເພື່ອນໍາໃຊ້, ອື່ນໆ, ເຊັ່ນ: ກ່ອງບັນຈຸຄໍາຮ້ອງສະຫມັກ HPC, ອາດຈະຄິດຄ່າບໍລິການ. ກະລຸນາອ້າງອີງໃສ່ລາຍການ NGC.

9. Lambda GPU Cloud

Lambda ສະຫນອງຕົວຢ່າງ GPU cloud ສໍາລັບການຝຶກອົບຮົມແບບຈໍາລອງການຮຽນຮູ້ເລິກແລະການຂະຫຍາຍຂະຫນາດຈາກຄອມພິວເຕີເຄື່ອງດຽວໄປຫາເຄື່ອງຈັກ virtual ຫຼາຍ.

ຈາກ dashboard, ທັນທີທັນໃດເຂົ້າເຖິງເຄື່ອງສະເພາະຂອງແຕ່ລະເຄື່ອງ ປື້ມບັນທຶກ Jupyter ສະພາບແວດລ້ອມການຂຽນໂປລແກລມ. ສໍາລັບການເຂົ້າເຖິງໂດຍກົງ, ໃຫ້ໃຊ້ SSH ໂດຍກົງກັບກະແຈ SSH ອັນນຶ່ງ ຫຼືເຊື່ອມຕໍ່ຜ່ານ Web Terminal ເທິງແຜງໜ້າປັດຄລາວ.

ສູງສຸດ 10 Gbps ຂອງການເຊື່ອມຕໍ່ລະຫວ່າງ node ໄດ້ຮັບການສະຫນັບສະຫນູນໂດຍແຕ່ລະຕົວຢ່າງ, ອະນຸຍາດໃຫ້ສໍາລັບການຝຶກອົບຮົມແຈກຢາຍໂດຍໃຊ້ກອບເຊັ່ນ Horovod.

ການຂະຫຍາຍຈໍານວນ GPUs ໃນຫນຶ່ງຫຼືຫຼາຍຕົວຢ່າງສາມາດຊ່ວຍເລັ່ງການເພີ່ມປະສິດທິພາບຂອງຕົວແບບ. ເວທີສະຫນັບສະຫນູນ GPU instances ຈາກ NVIDIA RTX 6000, Quadro RTX 6000, ແລະ Tesla V100s.

ການຕັ້ງລາຄາ

ລາຄາເລີ່ມຕົ້ນທີ່ $1.10/ຊົ່ວໂມງ ສໍາລັບ NVIDIA A100.

10. IBM Cloud GPU

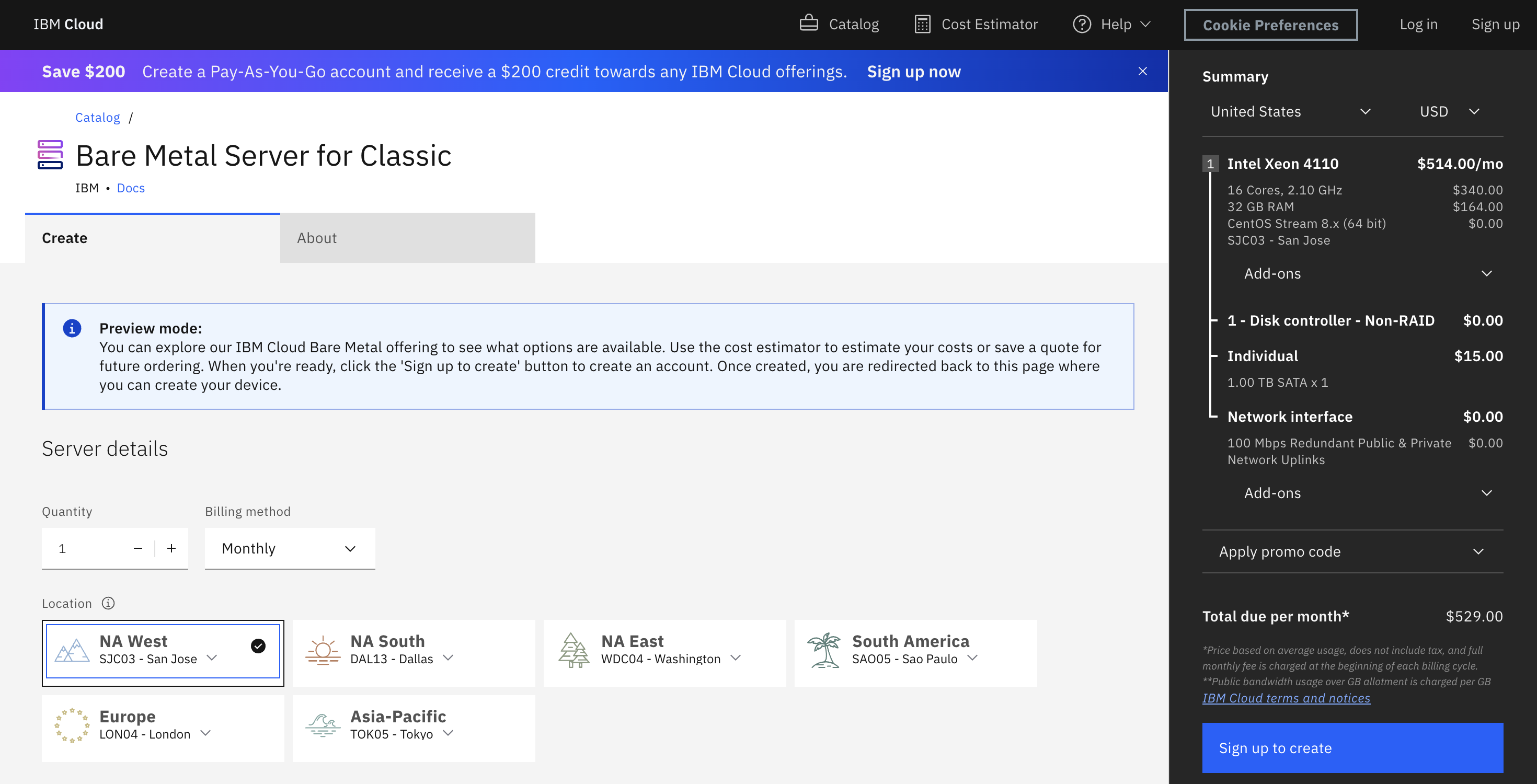

IBM Cloud GPU ໃຊ້ສູນຂໍ້ມູນເຄືອຂ່າຍທີ່ກະແຈກກະຈາຍທົ່ວໂລກເພື່ອສະເໜີຂັ້ນຕອນການເລືອກເຊີບເວີທີ່ມີຄວາມຍືດຫຍຸ່ນ ແລະການເຊື່ອມຕໍ່ທີ່ລຽບງ່າຍກັບສະຖາປັດຕະຍະກຳຄລາວຂອງ IBM, APIs ແລະແອັບພລິເຄຊັນ.

ດ້ວຍ Intel Xeon 4210, Xeon 5218, ແລະ Xeon 6248 GPU instances, ມັນສະຫນອງທາງເລືອກ GPU Server ໂລຫະເປົ່າ.

ທ່ານສາມາດປະຕິບັດການປະຕິບັດສູງປະສິດທິພາບ, latency-sensitive, ພິເສດ, ແລະການປະຕິບັດວຽກງານທໍາມະດາໄດ້ໂດຍກົງກ່ຽວກັບການຮາດແວຂອງເຊີບເວີໂດຍການນໍາໃຊ້ຕົວຢ່າງໂລຫະເປົ່າ, ເຊັ່ນດຽວກັນກັບພວກເຂົາເຈົ້າສາມາດເຮັດໄດ້ກັບ GPUs ໃນສະຖານທີ່.

ສໍາລັບທາງເລືອກເຊີຟເວີໂລຫະເປົ່າຂອງພວກເຂົາ, ພວກເຂົາຍັງສະຫນອງຕົວຢ່າງທີ່ມີ NVIDIA T4 GPUs ແລະໂປເຊດເຊີ Intel Xeon ທີ່ມີເຖິງ 40 cores, ເຊັ່ນດຽວກັນກັບຕົວຢ່າງສໍາລັບທາງເລືອກເຊີຟເວີ virtual ກັບ NVIDIA V100 ແລະ P100 ແບບຈໍາລອງ.

ການຕັ້ງລາຄາ

ລາຄາເລີ່ມຕົ້ນທີ່ $514/ເດືອນ ສໍາລັບ Intel Xeon4110.

ສະຫຼຸບ

ສຸດທ້າຍ, ການບໍລິການ GPU cloud ທີ່ດີທີ່ສຸດສໍາລັບ AI ແມ່ນຜູ້ທີ່ສະຫນອງຊັບພະຍາກອນ GPU ທີ່ເຂັ້ມແຂງ, ທາງເລືອກລາຄາທີ່ສາມາດປັບໄດ້, ແລະການປັບຂະຫນາດງ່າຍດາຍ.

ທຸກໆບໍລິສັດທີ່ສະຫນອງຕົວຢ່າງ GPU ສໍາລັບການເຮັດວຽກຂອງ AI - AWS, NVIDIA, IBM, ແລະ GCP - ມີສາຍຜະລິດຕະພັນທີ່ດີເລີດໃນດ້ານການປະຕິບັດແລະການເຮັດວຽກ.

ທາງເລືອກທີ່ດີທີ່ສຸດແມ່ນກໍານົດໂດຍຄວາມຕ້ອງການທີ່ເປັນເອກະລັກຂອງທ່ານ, ຂໍ້ຈໍາກັດທາງດ້ານການເງິນ, ພື້ນຖານໂຄງລ່າງທີ່ມີຢູ່ແລ້ວ, ແລະຄວາມມັກຂອງຜູ້ຂາຍ.

ອອກຈາກ Reply ເປັນ