Inhaltsverzeechnes[Verstoppen][Show]

D'Zukunft ass hei. An an dëser Zukunft verstinn Maschinnen d'Welt ronderëm si op déiselwecht Manéier wéi d'Leit dat maachen. Computere kënnen Autoen fueren, Krankheeten diagnostizéieren an d'Zukunft präzis viraussoen.

Dëst ka wéi Science Fiction schéngen, awer déif Léiermodeller maachen et eng Realitéit.

Dës sophistikéiert Algorithmen verroden d'Geheimnisser vun Kënschtlech Intelligenz, erlaabt Computeren selwer ze léieren an z'entwéckelen. An dësem Post verdéiwen mir an d'Räich vun Deep Learning Modeller.

An, mir wäerten den enorme Potenzial ënnersichen, deen se hunn fir eist Liewen ze revolutionéieren. Bereet Iech vir iwwer déi modernst Technologie ze léieren déi d'Zukunft vun der Mënschheet ännert.

Wat sinn Deep Learning Modeller genau?

Hutt Dir jeemools e Spill gespillt an deem Dir d'Ënnerscheeder tëscht zwee Biller muss identifizéieren?

Et ass awer Spaass, et kann och schwéier sinn, richteg? Stellt Iech vir, e Computer ze léieren dat Spill ze spillen an all Kéier ze gewannen. Deep Learning Modeller erreechen just dat!

Deep Learning Modeller sinn ähnlech wéi super-smart Maschinnen, déi eng grouss Zuel vu Biller ënnersichen a bestëmmen wat se gemeinsam hunn. Si erreechen dëst andeems se d'Biller ofbauen an all eenzel individuell studéieren.

Si applizéieren dann dat wat se geléiert hunn fir Mustere z'identifizéieren an Prognosen ze maachen iwwer frësch Biller déi se ni virdru gesinn hunn.

Deep Learning Modeller si kënschtlech neural Netzwierker déi komplizéiert Musteren a Charakteristiken aus massiven Datesets kënne léieren an extrahieren. Dës Modeller besteet aus verschiddene Schichten vu verlinkte Wirbelen, oder Neuronen, déi erakommen Daten analyséieren an änneren fir en Output ze generéieren.

Deep Learning Modeller si besonnesch gutt gëeegent fir Aarbechten déi grouss Genauegkeet a Präzisioun erfuerderen, sou wéi Bildidentifikatioun, Riederkennung, natierlech Sproochveraarbechtung a Robotik.

Si goufen an alles benotzt, vu selbstfueren Autoen bis medizinesch Diagnostik, Empfehlersystemer, an prévisibel Analyse.

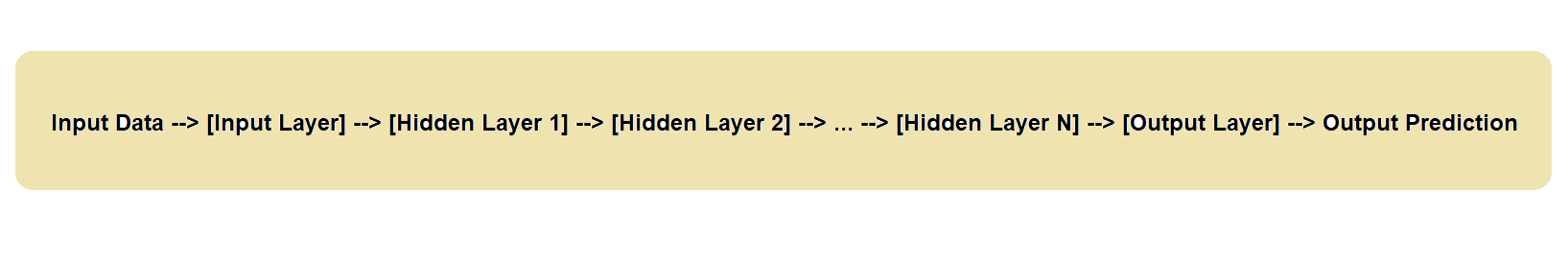

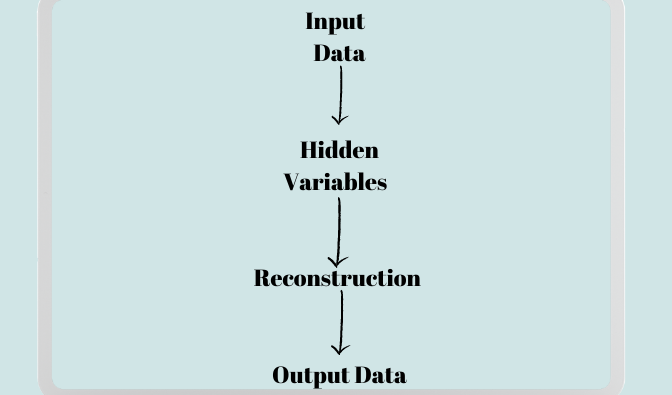

Hei ass eng vereinfacht Versioun vun der Visualiséierung fir den Datefloss an engem Deep Learning Modell ze illustréieren.

D'Inputdaten fléissen an d'Inputschicht vum Modell, déi dann d'Donnéeën duerch eng Zuel vu verstoppte Schichten passéiert ier Dir eng Ausgangsprognose liwwert.

All verstoppte Schicht mécht eng Serie vu mathematesch Operatiounen op den Inputdaten aus, ier se op déi nächst Schicht weiderginn, déi d'Finale Prognose ubitt.

Elo, loosst eis kucken wat déif Léiermodeller sinn a wéi kënne mir se an eisem Liewen benotzen.

1. Convolutional Neural Networks (CNNs)

CNNs sinn en déif Léiermodell deen d'Gebitt vun der Computervisioun transforméiert huet. CNNs gi benotzt fir Biller ze klassifizéieren, Objekter z'erkennen a Biller ze segmentéieren. D'Struktur an d'Funktioun vum mënschleche visuelle Cortex informéiert den Design vun CNNs.

Wéi funktionnéiere se?

E CNN besteet aus enger Zuel vu konvolutionalen Schichten, Poolschichten a voll verlinkte Schichten. Den Input ass e Bild, an den Ausgang ass eng Prognose vum Klasseetikett vum Bild.

D'Konvolutiounsschichten vun engem CNN bauen eng Featurekaart andeems Dir e Punktprodukt tëscht dem Inputbild an engem Set vu Filtere mécht. D'Poolingschichten senken d'Gréisst vun der Featurekaart andeems se se erofsampelen.

Schlussendlech gëtt d'Featurekaart vun de voll verbonne Schichten benotzt fir de Klasseetikett vum Bild virauszesoen.

Firwat sinn CNNs wichteg?

CNNs si wesentlech well se kënne léieren Musteren a Charakteristiken a Biller z'entdecken déi d'Leit schwéier fannen ze bemierken. CNNs kënne geléiert ginn Charakteristiken wéi Kanten, Ecker an Texturen ze erkennen mat grousse Datesätz. Nodeems Dir dës Eegeschafte geléiert hutt, kann en CNN se benotze fir Objeten a frësche Fotoen z'identifizéieren. CNNs hunn opzedeelen Leeschtung op verschiddene Bild Identifikatioun Uwendungen bewisen.

Wou benotze mir CNNs

Gesondheetsariichtung, Autosindustrie, an Handel sinn nëmmen e puer Sekteuren déi CNNs beschäftegen. An der Gesondheetsindustrie kënne se profitabel sinn fir Krankheet Diagnos, Medikamenter Entwécklung, a medizinesch Bildanalyse.

Am Autosektor hëllefe se mat der Spuererkennung, Objet Detektioun, an autonom Fueren. Si ginn och vill am Handel benotzt fir visuell Sich, Bildbaséiert Produktempfehlung, an Inventarkontrolle.

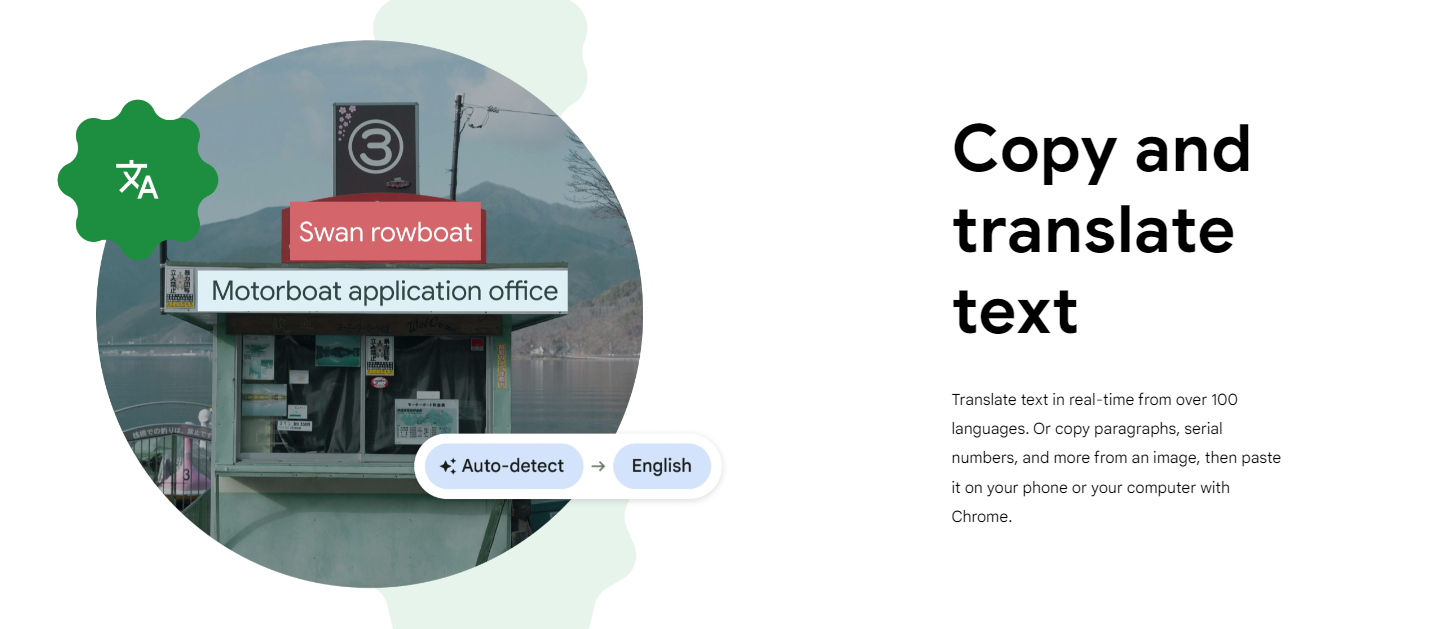

Zum Beispill; Google beschäftegt CNNs a verschiddenen Uwendungen, dorënner Google Lens, e beléifte Bildidentifikatiounsinstrument. De Programm benotzt CNNs fir Fotoen ze evaluéieren an de Benotzer Informatioun ze ginn.

Google Lens, zum Beispill, kann Saachen an engem Bild erkennen an Detailer doriwwer ubidden, wéi d'Blummenart.

Et kann och den Text deen aus engem Bild extrahéiert gëtt a verschidde Sproochen iwwersetzen. Google Lens ass fäeg Konsumenten nëtzlech Informatioun ze ginn wéinst der Hëllef vun CNNs bei der präzis Identifikatioun vun Artikelen an Extraktiounseigenschaften aus Fotoen.

2. Long Short-Term Memory (LSTM) Netzwierker

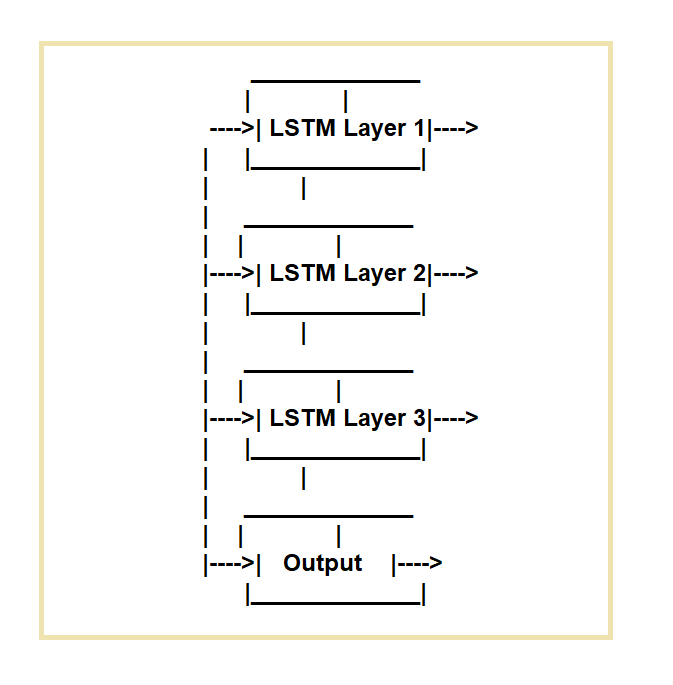

Long Short-Term Memory (LSTM) Netzwierker ginn erstallt fir d'Mängel vu reegelméissege widderhuelende neurale Netzwierker (RNNs) unzegoen. LSTM Netzwierker sinn ideal fir Aufgaben déi d'Veraarbechtung vun Datensequenzen iwwer Zäit verlaangen.

Si funktionnéieren andeems se eng spezifesch Erënnerungszell an dräi Gatemechanismus benotzen.

Si reguléieren de Flux vun Informatioun an an aus der Zell. D'Input Gate, vergiess Gate an Output Gate sinn déi dräi Paarte.

D'Input Gate reguléiert de Flux vun Donnéeën an d'Erënnerung Zell, de vergiessen Paart reguléiert d'Läschen vun Daten aus der Zell, an der Ausgabbehälter reglementéiert de Flux vun Daten aus der Zell.

Wat ass hir Bedeitung?

LSTM Netzwierker sinn nëtzlech well se erfollegräich Datensequenze mat laangfristeg Bezéiungen representéieren a prognostizéiere kënnen. Si kënnen Informatioun iwwer fréier Input ophuelen an behalen, wat hinnen erlaabt méi genee Prognosen iwwer zukünfteg Inputen ze maachen.

Riederkennung, Handschrëfterkennung, natierlech Sproochveraarbechtung, a Bildopschrëft sinn nëmmen e puer vun den Uwendungen déi LSTM Netzwierker benotzt hunn.

Wou benotze mir LSTM Netzwierker?

Vill Software- an Technologieapplikatioune beschäftegen LSTM Netzwierker, dorënner Riederkennungssystemer, natierlech Sprooche Veraarbechtungsinstrumenter wéi sentimentanalyse, Maschinn Iwwersetzung Systemer, an Text a Bild Generéiere Systemer.

Si goufen och an der Schafung vun selbstfahrenden Autoen a Roboteren benotzt, souwéi an der Finanzindustrie fir Bedruch z'entdecken an virzegoen Bourse Bewegungen.

3. Generative Adversarial Networks (GANs)

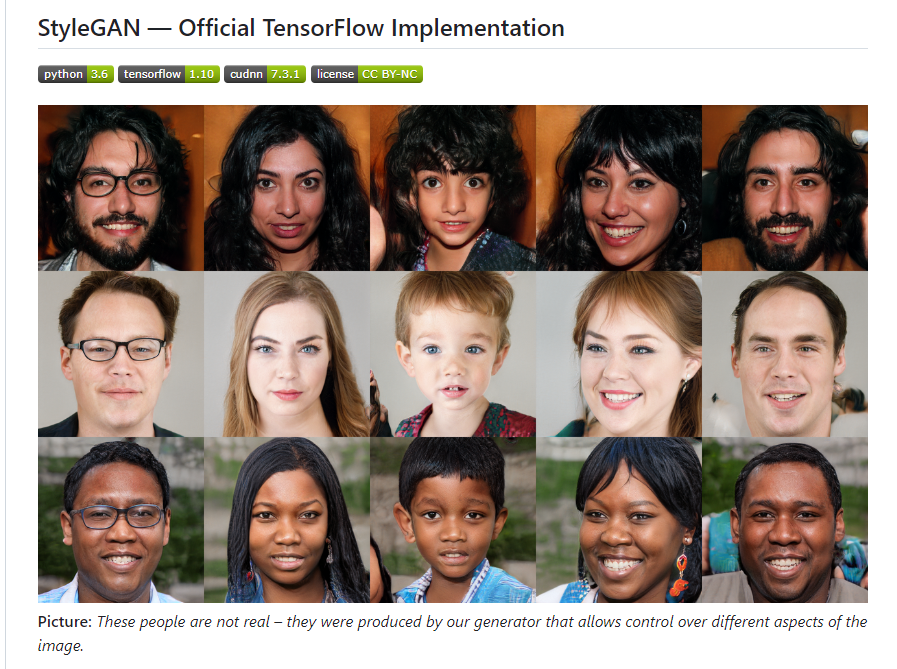

GAN sinn a ze léieren Technik déi benotzt gëtt fir nei Dateproben ze generéieren déi ähnlech wéi e bestëmmten Datesaz sinn. GAN besteet aus zwee neural Netzwierker: een deen léiert nei Proben ze produzéieren an een dee léiert tëscht echten a generéierte Proben z'ënnerscheeden.

An enger ähnlecher Approche ginn dës zwee Netzwierker zesumme trainéiert bis de Generator Proben generéiere kann déi net z'ënnerscheeden vun aktuellen.

Firwat benotzen mir GANs

GANs si bedeitend wéinst hirer Kapazitéit fir héich Qualitéit ze produzéieren syntheteschen Daten dat ka fir eng Vielfalt vun Uwendungen benotzt ginn, dorënner Bild- a Videoproduktioun, Textgeneratioun, a souguer Museksgeneratioun.

GANs goufen och fir Datevergréisserung benotzt, wat d'Generatioun vun ass syntheteschen Daten fir real-Weltdaten z'ergänzen an d'Performance vu Maschinnléiermodeller ze verbesseren.

Ausserdeem, andeems synthetesch Donnéeën erstallt ginn, déi kënne benotzt ginn fir Modeller ze trainéieren an Studien ze imitéieren, hunn GANs d'Potenzial fir Secteuren wéi Medizin an Drogenentwécklung ze transforméieren.

Uwendungen vun GANs

GANs kënnen Datesätz ergänzen, nei Biller oder Filmer erstellen, a souguer synthetesch Daten fir wëssenschaftlech Simulatioune generéieren. Ausserdeem hunn GANs d'Potenzial fir a verschiddenen Uwendungen agestallt ze ginn, rangéiert vun Ënnerhalung bis medizinesch.

Alter a Videoen. NVIDIA's StyleGAN2, zum Beispill, gouf benotzt fir qualitativ héichwäerteg Fotoe vu Promi a Konschtwierker ze kreéieren.

4. Deep Belief Networks (DBNs)

Deep Belief Networks (DBNs) sinn Kënschtlech Intelligenz Systemer déi kënne léieren Musteren an Daten ze gesinn. Si erreechen dëst andeems se d'Donnéeën a méi kleng a méi kleng Stécker segmentéieren, a kréien e méi grëndleche Grëff op all Niveau.

DBNs kënnen aus Daten léieren ouni informéiert ze ginn wat et ass (dëst gëtt als "net iwwerwaacht Léieren bezeechent"). Dëst mécht se extrem wäertvoll fir Musteren an Daten z'entdecken déi eng Persoun schwiereg oder onméiglech wier ze erkennen.

Wat mécht DBNs bedeitend?

DBNs si bedeitend wéinst hirer Kapazitéit fir hierarchesch Daterepresentatioune ze léieren. Dës Representatioune kënne fir eng Vielfalt vun Uwendungen benotzt ginn wéi Klassifikatioun, Anomalie Detektioun, an Dimensiounsreduktioun.

D'Kapazitéit vun DBNs fir onkontrolléiert Pre-Training ze maachen, wat d'Performance vun Deep Learning Modeller mat minimale markéierten Donnéeën erhéijen kann, ass e wesentleche Virdeel.

Wat sinn d'Applikatioune vun DBNs?

Ee vun de bedeitendsten Uwendungen ass Objet Detektioun, an deenen DBNs benotzt gi fir verschidden Zorte vu Saachen wéi Fligeren, Villercher a Mënschen ze erkennen. Si ginn och benotzt fir Bildgeneratioun a Klassifikatioun, Bewegungserkennung a Filmer, an natierlecht Sproochverständnis fir Stëmmveraarbechtung.

Ausserdeem ginn DBNs allgemeng an Datesätz benotzt fir mënschlech Haltungen ze bewäerten. DBNs sinn e super Tool fir eng Vielfalt vun Industrien, dorënner Gesondheetsariichtung a Banken, an Technologie.

5. Deep Reinforcement Learning Networks (DRLs)

Deep Verstäerkung Léieren Netzwierker (DRLs) integréieren déif neural Netzwierker mat Verstäerkungs-Léiertechniken fir Agenten z'erméiglechen an engem komplizéierten Ëmfeld iwwer Versuch a Feeler ze léieren.

DRLs gi benotzt fir Agenten ze léieren wéi een e Belounungssignal optiméiert andeems se mat hirer Ëmgéigend interagéieren an aus hire Feeler léieren.

Wat mécht se bemierkenswäert?

Si goufen effektiv a verschiddenen Uwendungen benotzt, dorënner Gaming, Robotik, an autonom Fuere. DRLs si wichteg well se direkt aus rauem sensoreschen Input léiere kënnen, wat Agenten erlaabt Entscheedungen ze treffen op Basis vun hiren Interaktiounen mat der Ëmwelt.

Wichteg Uwendungen

DRLs ginn an realen Ëmstänn agestallt well se schwiereg Themen këmmeren.

DRLs goufen a verschidde prominent Software an Tech Plattformen abegraff, dorënner OpenAI's Gym, Unity's ML-Agenten, a Google's DeepMind Lab. AlphaGo, gebaut vu Google Deepmind, zum Beispill, beschäftegt DRL fir de Brietspill Go op Weltmeeschterniveau ze spillen.

Eng aner Notzung vun DRL ass an der Robotik, wou et benotzt gëtt fir d'Bewegunge vu robotesche Waffen ze kontrolléieren fir Aufgaben auszeféieren wéi d'Saachen ze gräifen oder d'Blöcke ze stackelen. DRLs hu vill Gebrauch a sinn en nëtzlecht Tool fir Training Agenten ze léieren an Entscheedungen a komplizéierten Astellungen huelen.

6. Autoencoders

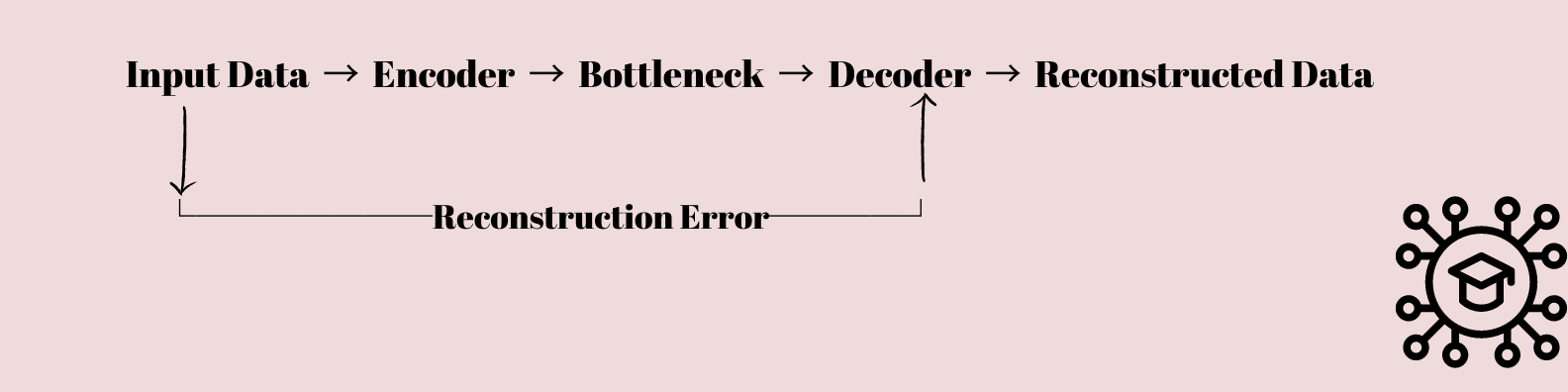

Autoencoders sinn eng interessant Aart vu neural Netz dat huet den Interessi vu béide Geléiert an Datenwëssenschaftler gefaangen. Si sinn grondsätzlech entworf fir ze léieren wéi d'Daten kompriméieren a restauréieren.

D'Inputdaten ginn duerch eng Successioun vu Schichten gefüttert, déi d'Dimensionalitéit vun den Daten graduell senken, bis se an eng Flaschenhalsschicht kompriméiert ginn mat manner Noden wéi d'Input- an Ausgangsschichten.

Dës kompriméiert Representatioun gëtt dann benotzt fir d'ursprénglech Inputdaten nei ze kreéieren mat enger Sequenz vu Schichten, déi d'Dimensionalitéit vun den Daten graduell op hir originell Form erhéijen.

Firwat ass et wichteg?

Autoencoders sinn e wesentleche Bestanddeel vun ze léieren well se Feature Extraktioun an Datereduktioun méiglech maachen.

Si sinn fäeg d'Schlësselelementer vun den erakommen Daten z'identifizéieren an se an eng kompriméiert Form ze iwwersetzen, déi dann op aner Aufgaben wéi Klassifikatioun, Gruppéierung oder d'Schafung vun neien Donnéeën applizéiert kënne ginn.

Wou benotze mir Autoencoders?

Anomalie Detektioun, natierlech Sproochveraarbechtung, an Computer Visioun sinn nëmmen e puer vun den Disziplinnen wou Autoencoder benotzt ginn. Autoencoders, zum Beispill, kënne benotzt ginn fir Bildkompressioun, Bilddenoising a Bildsynthese an der Computervisioun.

Mir kënnen Autoencoders an Aufgaben wéi Textkreatioun, Textkategoriséierung, an Textresumé an der natierlecher Sproochveraarbechtung benotzen. Et kann anomal Aktivitéit an Daten identifizéieren déi vun der Norm an der Anomalie Identifikatioun ofwäichen.

7. Kapsel Netzwierker

Capsule Networks ass eng nei Deep Learning Architektur déi als Ersatz fir Convolutional Neural Networks (CNNs) entwéckelt gouf.

Kapselnetzwierker baséieren op der Notioun fir Gehireenheeten ze gruppéieren genannt Kapselen déi verantwortlech sinn fir d'Existenz vun engem bestëmmten Element an engem Bild z'erkennen a seng Attributer, wéi Orientéierung a Positioun, an hir Ausgangsvektoren ze kodéieren. Capsule Networks kënnen dofir raimlech Interaktiounen a Perspektivschwankungen besser managen wéi CNNs.

Firwat wielen mir Capsule Networks iwwer CNN's?

Capsule Networks sinn nëtzlech well se dem CNN seng Schwieregkeeten iwwerwannen fir hierarchesch Bezéiungen tëscht Elementer an engem Bild z'erreechen. CNNs kënne Saache vu verschiddene Gréissten erkennen, awer kämpfe fir ze verstoen wéi dës Elementer matenee verbannen.

Capsule Networks, op der anerer Säit, kënne léieren Saachen an hir Stécker ze erkennen, wéi och wéi se raimlech an engem Bild plazéiert sinn, wat se e liewensfäeg Konkurrent fir Computervisioun Uwendungen mécht.

Beräicher vun Uwendungen

Capsule Networks hu scho villverspriechend Resultater a ville Applikatiounen bewisen, dorënner Bildklassifikatioun, Objektidentifikatioun a Bildsegmentéierung.

Si goufe benotzt fir Saachen a medizinesche Fotoen z'ënnerscheeden, Leit a Filmer z'erkennen, a souguer 3D Modeller aus 2D Biller ze kreéieren.

Fir hir Leeschtung z'erhéijen, goufen Capsule Networks mat aneren Deep Learning Architekturen kombinéiert wéi Generative Adversarial Networks (GANs) a Variational Autoencoders (VAEs). Capsule Networks ginn virausgesot eng ëmmer méi vital Roll ze spillen fir Computervisiounstechnologien ze verbesseren wéi d'Wëssenschaft vum Deep Learning evoluéiert.

Zum Beispill; Nibabel ass e bekannte Python-Tool fir Neuroimaging Dateitypen ze liesen an ze schreiwen. Fir Bildsegmentéierung benotzt et Capsule Networks.

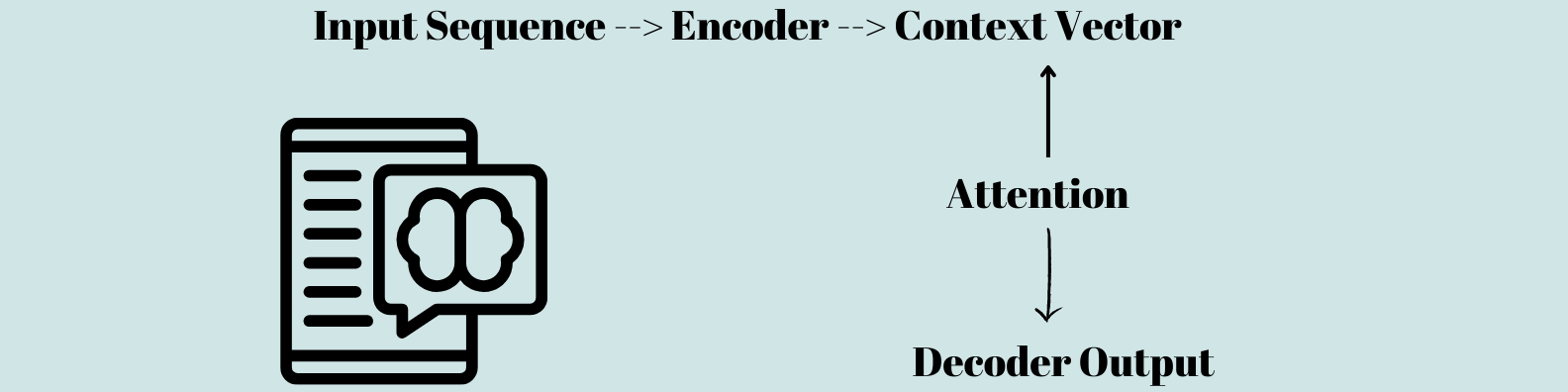

8. Opgepasst-baséiert Modeller

Deep Learning Modeller bekannt als Opmierksamkeet-baséiert Modeller, och bekannt als Opmierksamkeetsmechanismen, striewen d'Genauegkeet vun Maschinn léieren Modeller. Dës Modeller funktionnéieren andeems se op bestëmmte Feature vun erakommen Donnéeën konzentréieren, wat zu méi effizienter an effektiver Veraarbechtung resultéiert.

An natierleche Sproochveraarbechtungsaufgaben wéi Maschinn Iwwersetzung a Gefillsanalyse hunn Opmierksamkeetsmethoden zimmlech erfollegräich gewisen.

Wat ass hir Bedeitung?

Opgepasst Modeller sinn nëtzlech well se méi effektiv an effizient Veraarbechtung vu komplizéierten Donnéeën erméiglechen.

Traditionell neural Netzwierker evaluéiert all Inputdaten als gläich wichteg, wat zu méi luesen Veraarbechtung a reduzéierter Genauegkeet resultéiert. Opgepasst Prozesser konzentréiere sech op entscheedend Aspekter vun Inputdaten, wat méi séier a méi genau Prognosen erlaabt.

Beräicher vun Benotzung

Am Beräich vun der kënschtlecher Intelligenz hunn Opmierksamkeetsmechanismen eng breet Palette vun Uwendungen, dorënner natierlech Sproochveraarbechtung, Bild- an Audioerkennung, a souguer Chaufferlos Gefierer.

Opgepasst Methoden, zum Beispill, kënne benotzt ginn fir d'Maschinn Iwwersetzung an der natierlecher Sproochveraarbechtung ze verbesseren andeems de System erlaabt op verschidde Wierder oder Ausdréck ze fokusséieren déi essentiell fir de Kontext sinn.

Opgepasst Methoden an autonomen Autoen kënne benotzt ginn fir de System ze hëllefen op bestëmmten Elementer oder Erausfuerderungen a senger Ëmgéigend ze fokusséieren.

9. Transformator Netzwierker

Transformer Netzwierker sinn déif Léiermodeller déi Datensequenzen ënnersicht a produzéieren. Si funktionnéieren andeems d'Input Sequenz een Element gläichzäiteg veraarbecht an eng Ausgangssequenz vun der selwechter oder ënnerschiddlecher Längt produzéieren.

Transformator Netzwierker, am Géigesaz zu Standard Sequenz-zu-Sequenz Modeller, veraarbecht keng Sequenzen mat widderhuelend neural Netzwierker (RNNs). Amplaz benotze se SelbstOpmierksamkeetsprozesser fir d'Links tëscht de Stécker vun der Sequenz ze léieren.

Wat ass d'Wichtegkeet vun Transformer Netzwierker?

Transformator Netzwierker sinn an de leschte Joeren a Popularitéit gewuess als Resultat vun hirer besserer Leeschtung an natierleche Sproochveraarbechtungsaarbechten.

Si si besonnesch gutt gëeegent fir Text-Schafung Aufgaben wéi Sprooch Iwwersetzung, Text Zesummefaassung, a Gespréich Produktioun.

Transformator Netzwierker si wesentlech méi effizient berechnend wéi RNN-baséiert Modeller, sou datt se eng léifste Wiel fir grouss Skala Uwendungen maachen.

Wou fannt Dir Transformer Netzwierker?

Transformator Netzwierker gi wäit an enger breeder Palette vun Uwendungen beschäftegt, besonnesch natierlech Sproochveraarbechtung.

D'GPT (Generative Pre-trained Transformer) Serie ass e prominente Transformator-baséiert Modell dee benotzt gouf fir Aufgaben wéi Sprooch Iwwersetzung, Text Zesummefaassung, an Chatbot Generatioun.

BERT (Bidirectional Encoder Representations from Transformers) ass en anere gemeinsame Transformator-baséiert Modell dee fir natierlech Sproochverständnisapplikatioune benotzt gouf wéi Fro Äntwerten a Gefillsanalyse.

souwuel GPT an BERT goufen geschaf mat PyTorch, en Open-Source Deep-Learning Kader dee populär war fir Transformator-baséiert Modeller z'entwéckelen.

10. Restriktéiert Boltzmann Maschinnen (RBMs)

Restriktéiert Boltzmann Maschinnen (RBMs) sinn eng Zort vun net iwwerwaacht neuralt Netzwierk dat op eng generativ Manéier léiert. Wéinst hirer Kapazitéit fir wesentlech Charakteristiken aus héichdimensionalen Daten ze léieren an ze extrahieren, si si wäit an de Felder vum Maschinnléieren an Deep Learning beschäftegt.

RBMs besteet aus zwou Schichten, sichtbar a verstoppt, mat all Schicht besteet aus enger Grupp vun Neuronen, déi duerch gewiichtte Kanten verbonne sinn. RBMs sinn entwéckelt fir eng Wahrscheinlechkeetsverdeelung ze léieren déi d'Inputdaten beschreift.

Wat sinn limitéiert Boltzmann Maschinnen?

RBMs benotzen eng generativ Léierstrategie. A RBMs reflektéiert déi siichtbar Schicht d'Inputdaten, während déi begruewe Schicht d'Charakteristiken vun den Inputdaten codéiert. D'Gewiichter vun de sichtbaren a verstoppte Schichten weisen d'Kraaft vun hirem Link.

RBMs passen d'Gewiichter a Viraussetzungen tëscht de Schichten während der Ausbildung un mat enger Technik bekannt als kontrastive Divergenz. Kontrastiv Divergenz ass eng net iwwerwaacht Léierstrategie déi d'Prognosewahrscheinlechkeet vum Modell maximéiert.

Wat ass d'Bedeitung vu Restriktéierte Boltzmann Maschinnen?

RBMs si bedeitend an Maschinn léieren an déif Léieren well se relevant Charakteristiken aus grouss Quantitéiten vun Daten léieren an Extrait.

Si si ganz effektiv fir Bild- a Riederkennung, a si goufen a verschiddenen Uwendungen benotzt wéi Empfehlersystemer, Anomalierkennung an Dimensiounsreduktioun. RBMs kënne Mustere a grousse Datesätz fannen, wat zu superieure Prognosen an Abléck resultéiert.

Wou kënne limitéiert Boltzmann Maschinnen benotzt ginn?

Uwendungen fir RBMs enthalen Dimensiounsreduktioun, Anomalie Detektioun, a Empfehlungssystemer. RBMs si besonnesch hëllefräich fir Gefillsanalyse an Thema Modeller am Kader vun der natierlecher Sproochveraarbechtung.

Deep Belief Netzwierker, eng Aart neuralt Netzwierk dat fir Stëmm- a Bilderkennung benotzt gëtt, beschäftegt och RBMs. D'Deep Belief Network Toolbox, TensorFlow, an Theano sinn e puer speziell Beispiller vu Software oder Technologie déi RBMs benotzt.

Apaken

Deep Learning Modeller ginn ëmmer méi entscheedend a ville Branchen, dorënner Riederkennung, natierlech Sproochveraarbechtung a Computervisioun.

Convolutional Neural Networks (CNNs) a Recurrent Neural Networks (RNNs) hunn am meeschte Verspriechen gewisen a ginn extensiv a villen Uwendungen benotzt, awer all Deep Learning Modeller hunn hir Virdeeler an Nodeeler.

Wéi och ëmmer, d'Fuerscher kucken nach ëmmer no Restricted Boltzmann Machines (RBMs) an aner Varietéiten vun Deep Learning Modeller well se och speziell Virdeeler hunn.

Nei a kreativ Modeller ginn erwaart erstallt ze ginn well d'Beräich vum Deep Learning weider geet fir méi haart Probleemer ze handhaben

Hannerlooss eng Äntwert