Мазмұны[Жасыру][Көрсету]

Жасанды фотолар мен бейнелер болуы жаңалық емес. Интернет кең тараған кезден бастап, суреттер мен фильмдер пайда болғаннан бері адамдар алдау немесе көңіл көтеру үшін жалғандық жасауда.

Дегенмен, бір күні шындықты фантастикадан ажыратуды қиындатуы мүмкін машинада жасалған жалғандардың жаңа түрі бар.

Бұл жалғандар Photoshop сияқты бағдарламалық жасақтаманы өңдеу арқылы жасалған қарапайым сурет манипуляцияларынан немесе өткендегі ақылды түрде басқарылған фильмдерден ерекшеленеді.

Deepfakes - бұл «синтетикалық медианың» ең танымал мысалы — әдеттегі әдістермен жасалған, бірақ шын мәнінде күрделі бағдарламалық құрал арқылы жасалған кескіндер, дыбыстар және бейнелер.

Deepfakes біраз уақыттан бері пайда болды және олардың ең танымал қолданбасы әлі күнге дейін танымал адамдардың басын порнографиялық фильмдердегі актерлердің денесіне қою болса да, олар кез келген жерде кез келген адамның кез келген нәрсені істеп жатқаны туралы сенімді кадрларды жасай алады.

Бұл постта біз Deepfakes-ті, оның қалай жұмыс істейтінін, оларды өз бетіңізше қалай жасауға болатынын және т.б. қарастырамыз.

Сонымен, DeepFake дегеніміз не?

Deepfake — терең үйрену және жалған сөз тіркестерінің тіркесімі — бір бөлігі синтетикалық орта онда басқа адамның ұқсастығы бұрыннан бар фотосуреттегі немесе бейнедегі адамды ауыстыру үшін қолданылады.

Deepfakes алдау мүмкіндігі жоғары көрнекі және дыбыстық ақпаратты өзгерту және жасау үшін күрделі машиналық оқыту мен жасанды интеллект әдістерін пайдаланады.

Автокодерлер және генеративті қарсылас желілер сияқты терең оқыту әдістері терең фейк өндірісінің (GAN) негізгі механизмі болып табылады.

Бұл модельдер адамның бет-әлпетінің эмоциялары мен қимылдарын талдау және салыстырмалы өрнектер мен қозғалыстарды көрсететін басқа адамдардың бет суреттерін синтездеу үшін қолданылады.

Атақты адамдардың порнографиялық бейнелерінде, жалған жаңалықтарда, жалған ақпараттарда және қаржылық алаяқтықта терең фейктерді пайдалану көпшіліктің назарын аударды. Өнеркәсіп те, үкімет те оларды табуға және пайдалануды шектеуге тырысып жауап берді.

Бірінші ретті қозғалыс үлгісі

Бұрын терең фейктерді жасауға тырысқанда, мәселе бізге осы тәсілдердің жұмыс істеуі үшін қандай да бір қосымша білім немесе предпристер қажет болды.

Мысал ретінде, бас қозғалысын қадағалағымыз келсе, бет маркерлері қажет. Егер біз бүкіл дене қозғалысын картаға түсіргіміз келсе, позаны бағалау қажет болды.

Бұл өткен жылы NeurIPS конференциясында Торонто университетінің зерттеу тобы өз жұмысын ұсынған кезде өзгерді, «Суретті анимациялауға арналған бірінші ретті қозғалыс үлгісі. «

Бұл тәсіл үшін анимация туралы қосымша білім қажет емес. Бұған қоса, бұл модельді оқытқаннан кейін оны трансферттік оқыту үшін пайдалануға және бір санатқа жататын кез келген элементке қолдануға болады.

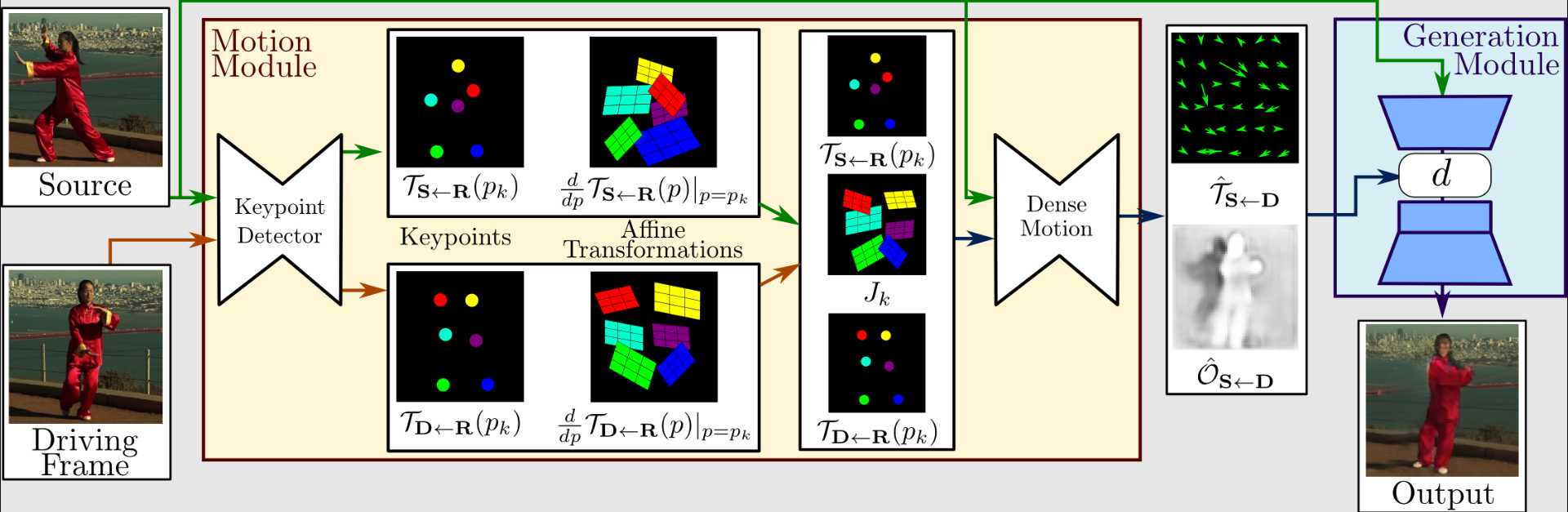

Бұл әдістің әрекетін сәл әрі қарай қарастырайық. Қозғалыс шығару және қалыптастыру бүкіл процестің бірінші жартысын құрайды. Жүргізуші бейне және бастапқы суреттер кіріс ретінде пайдаланылады.

Сирек негізгі нүктелерден және жергілікті аффинді түрлендірулерден тұратын бірінші ретті қозғалыс көрінісін шығару үшін қозғалыс экстракторы негізгі нүктелерді анықтау үшін автокодерді пайдаланады.

Тығыз қозғалыс желісімен тығыз оптикалық ағын мен окклюзия картасын жасау үшін олар бейнені жүргізумен бірге қолданылады. Содан кейін генератор тығыз қозғалыс желісінің және бастапқы кескіннің шығыстарын пайдаланып мақсатты суретті көрсетеді.

Жалпы алғанда, бұл жұмыс қазіргі заманғы жағдайға қарағанда жақсырақ орындалады. Ол сондай-ақ басқа модельдерде жоқ мүмкіндіктерді қамтиды. Ол бірнеше сурет түрлерінде жұмыс істейді, сондықтан оны бет, дене, мультфильмдер және т.б. кескіндерге қолдануға болады, бұл өте керемет.

Осының арқасында көптеген жаңа мүмкіндіктер пайда болады. Стратегиямыздың тағы бір жаңашыл аспектісі мынада: ол енді мақсатты нысанның бір ғана суретін пайдалана отырып, жоғары сапалы Deepfakes жасауға мүмкіндік береді. Нысан үшін YOLO тану.

Deepfake моделін құру процесі

Deepfake жасау үшін үш процесс қажет: шығару, оқыту және жасау. Осы кезеңдердің әрқайсысының негізгі тармақтары және олардың жалпы процеске қатысы осы бөлімде қарастырылады.

Шығару

Deepfakes беттерді өзгерту үшін терең нейрондық желілерді пайдаланады және дұрыс және сенімді жұмыс істеу үшін көптеген деректер (суреттер) қажет. Шығару процесі – бейнеклиптерден барлық кадрлар шығарылатын, беттер танылатын және одан кейін өнімділікті арттыру үшін беттер тураланатын кезең.

оқыту

Жаттығу кезеңінде нейрондық желі бір бетті екіншісіне өзгерте алады. Тәжірибе жинағы мен жаттығу гаджетінің көлеміне байланысты жаттығу бірнеше сағатқа немесе тіпті күндерге созылуы мүмкін.

Жаттығуды басқа нейрондық желі жаттығулары сияқты бір рет аяқтау керек. Жаттығудан кейін модель тұлғаны А адамынан В тұлғасына өзгерте алады.

Жасау

Модель үйретілгеннен кейін терең фейк жасалуы мүмкін. Жақтаулар бейнеден алынады, содан кейін барлық беттерге тураланады. Оқытылған нейрондық желі әр кадрды түрлендіру үшін пайдаланылады.

Трансформацияланған бет соңғы қадам ретінде бастапқы жақтаумен біріктірілуі керек.

Deepfake анықтау моделін құру

GitHub репосын орнату және клондау

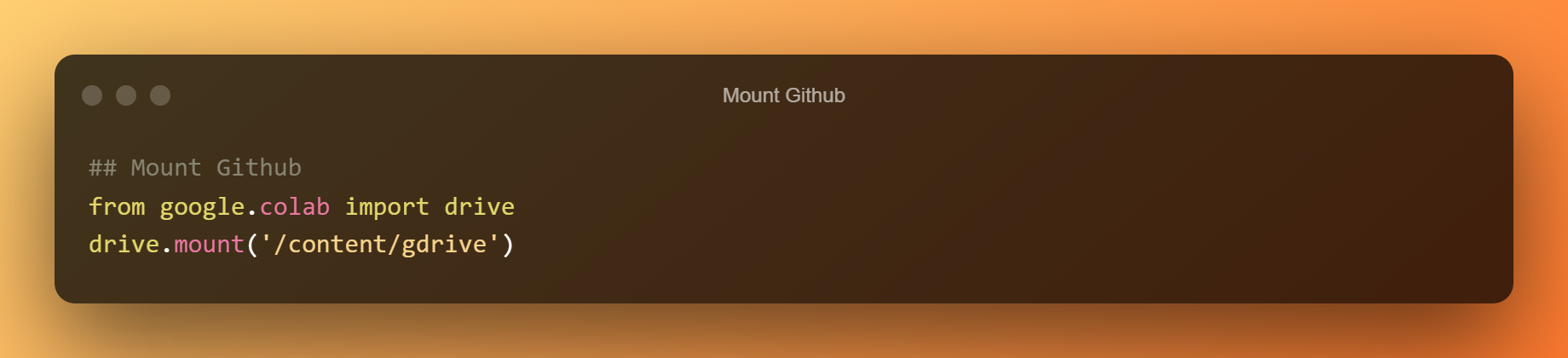

Colab-те жұмыс істеу кезінде Google GPU-ларын тегін пайдалану мүмкіндігі тиімді терең білім алу. Қосымша артықшылығы - бұлт виртуалды машинасына (VM) Google Drive орнату мүмкіндігі.

Оның барлық заттарына оңай қол жеткізу арқылы пайдаланушы қосылады. Google Drive-ты бұлттағы виртуалды машинаға орнату үшін қажет бағдарлама осы бөлімде болады.

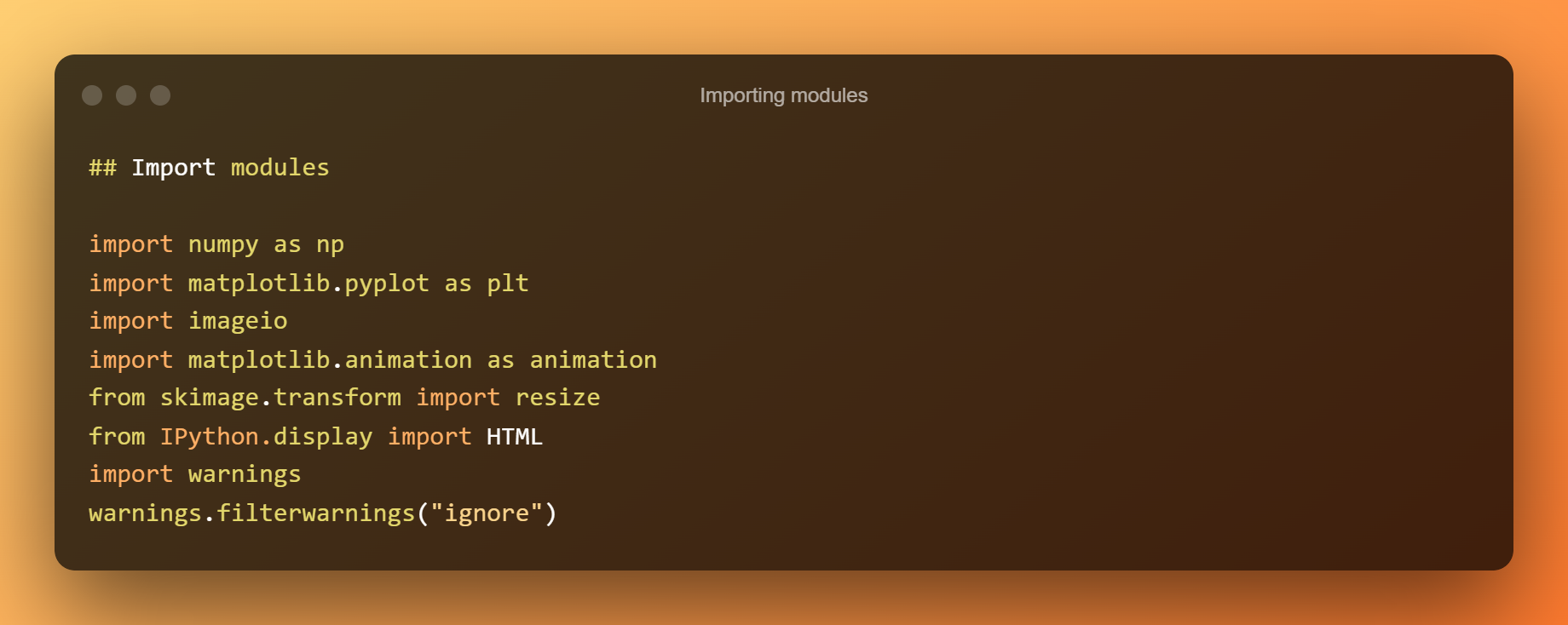

Модульдерді импорттау

Енді біз барлық қажетті модульдерді импорттаймыз.

Модельді орындау

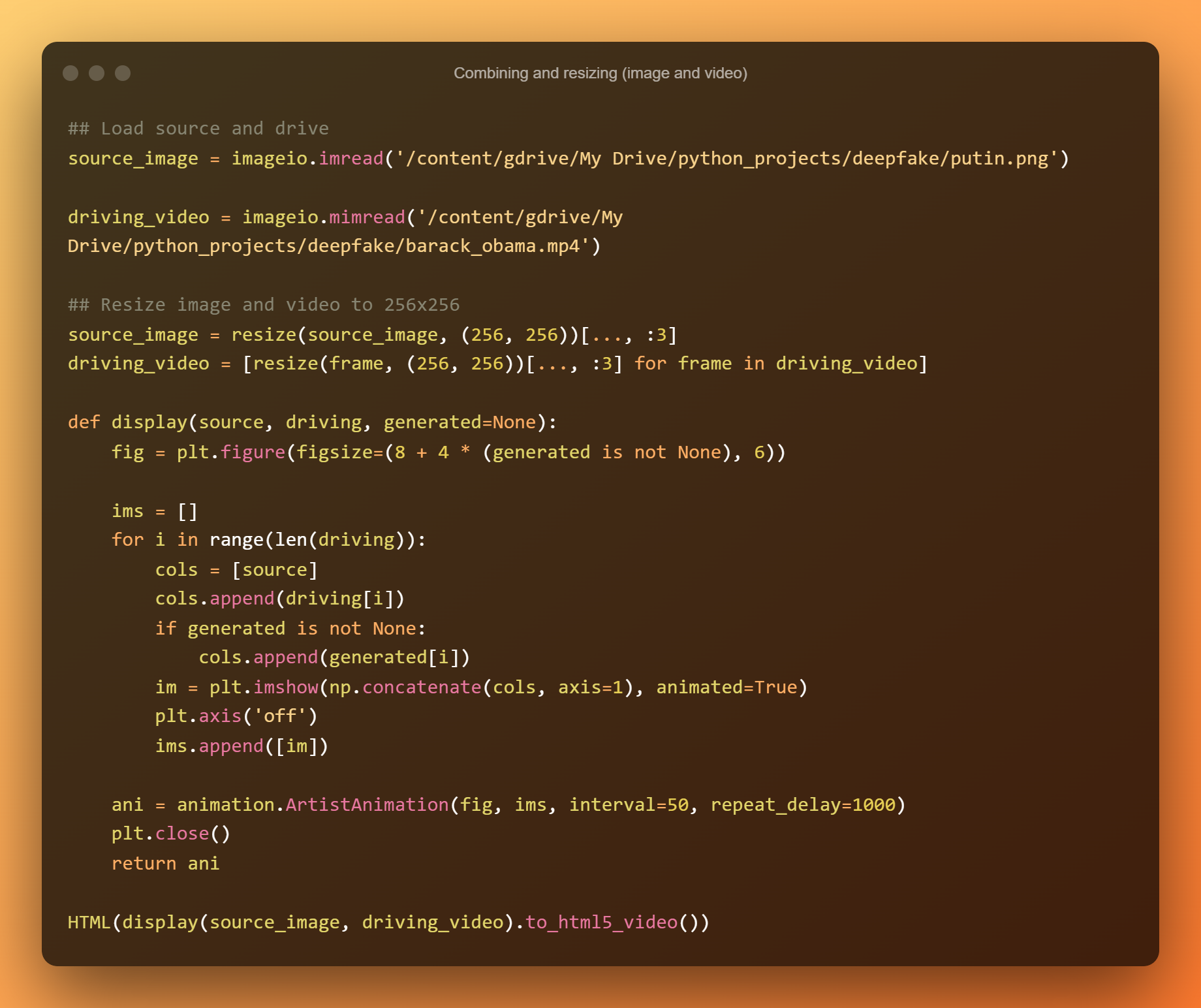

Біз Путиннің фотосуретін (бастапқы сурет) Обаманың бейнесін біріктіретін мысалды қолданамыз. Нәтижеде Путиннің сөйлеп тұрғаны және Обаманың көлік жүргізу кезінде қолданған бет-әлпетімен ым-ишарасы бейнеленген.

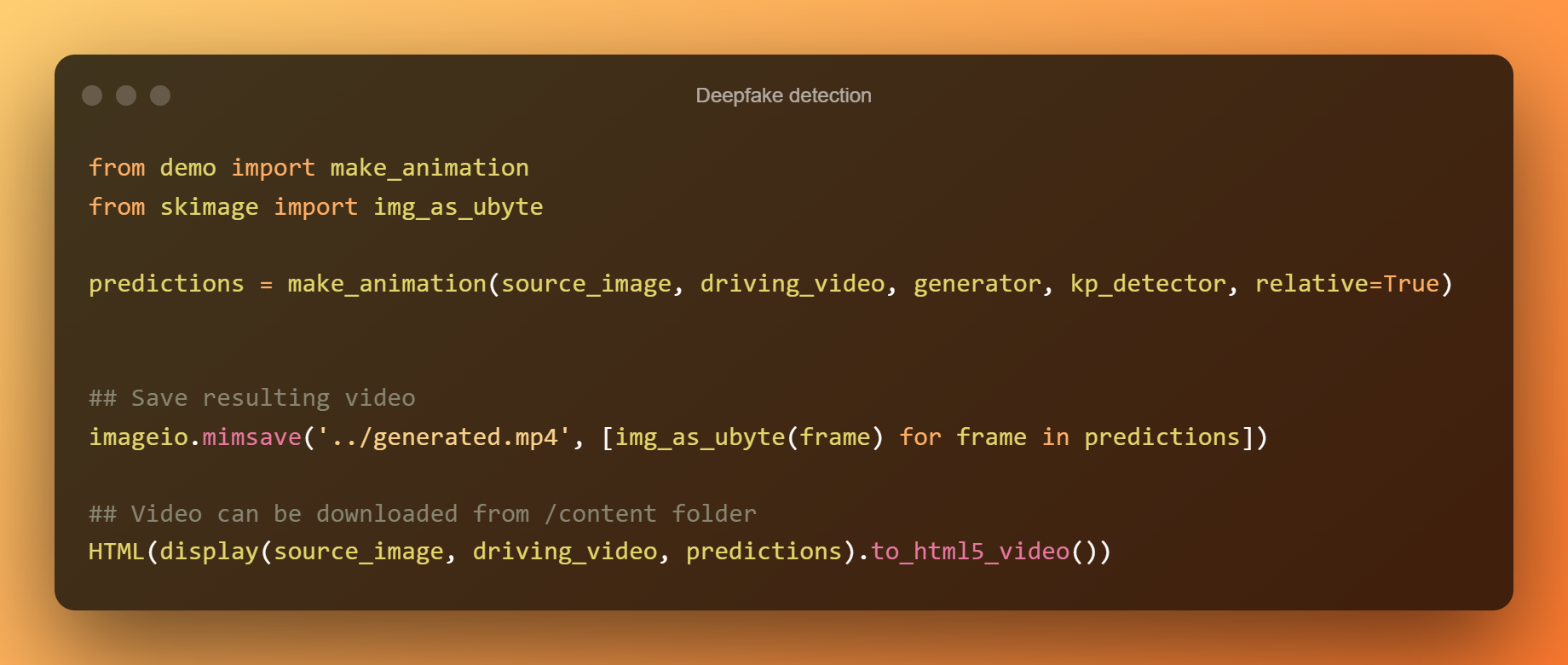

Үлгі нәтижесін көрсету алдында медиа жүктеледі және функциялар жарияланады. Содан кейін бақылау нүктелері жүктеледі және модель құрастырылады. Терең фейк жасағаннан кейін анимацияның екі түрлі стилі көрсетіледі.

Путин Обаманың салыстырмалы негізгі нүктені ауыстыруды пайдаланатын қозғалыстары арқылы жанданды. Обаманың бейнелері кезінде оның бет-әлпеті мен дене тілі Путин үшін әдемі және анық бейнеленгені таң қалдырады.

Кейбір микроскопиялық қателер бар, әсіресе Обама қасын көтеріп, көзін жыпылықтаған кезде. Бұл өрнектер Путиннің кадрларында дәл қайталанбаған.

Терең фейк фонсыз Путин фильмі теледидардан немесе теледидардан қаралса, өте сенімді және шынайы болып көрінеді. әлеуметтік медиа.

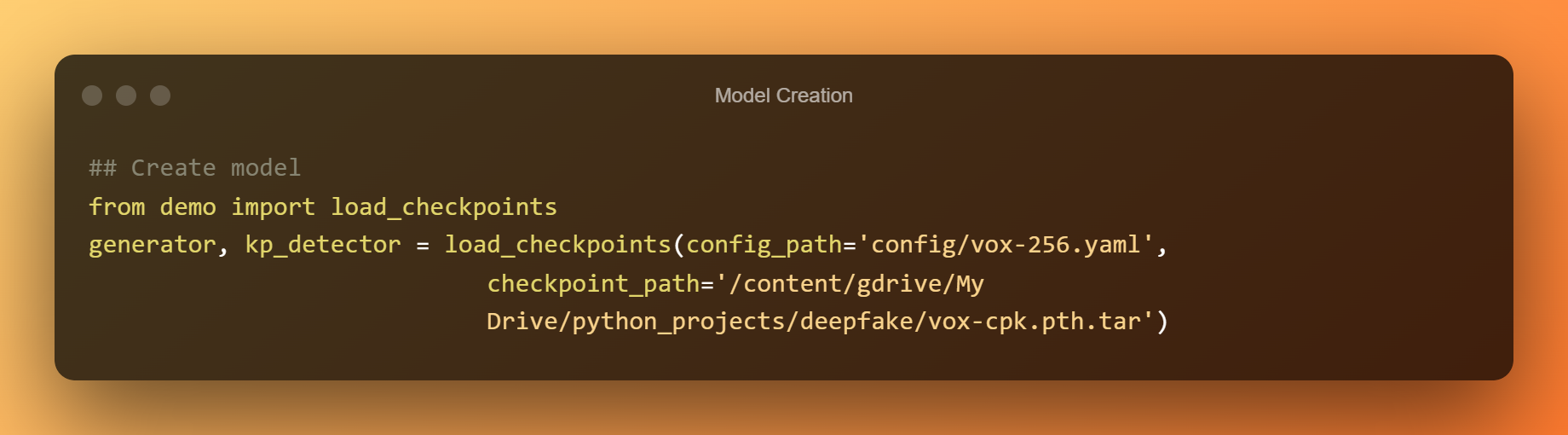

Модель құру

Енді біз толық үлгіні жасау үшін алдын ала дайындалған бақылау нүктелерін қолданамыз.

Deepfake анықтау

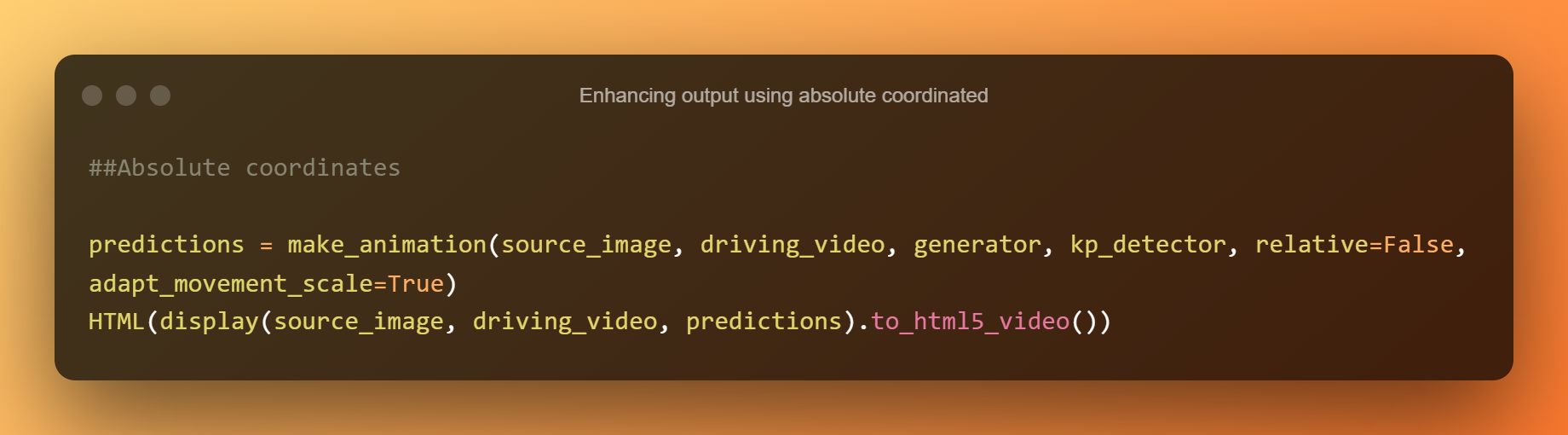

Түйінді нүктенің салыстырмалы орын ауыстыруы төмендегі ұяшықтағы элементтерді жандандыру үшін пайдаланылады. Келесі ұяшық орнына абсолютті координаттарды пайдаланады, бірақ барлық элемент пропорциялары осы жолмен жүргізу бейнесінен алынады.

Абсолюттік координаттарды пайдаланып шығаруды жақсарту

Осылайша сіз терең жалған анықтауды жасай аласыз.

Deepfake технологиясының қауіп-қатері қандай?

Deepfake бейнелері енді жаңашылдығына байланысты қызықты және қызықты. Дегенмен, бұл күлкілі болып көрінетін технологияның астында бақылаудан шығып кету қаупі бар.

Жалған және шынайы бейнелерді ажырату қиын болады терең фейк технологиясы ілгерілеуін жалғастыруда. Атақты тұлғалар мен атақты адамдар үшін бұл ауыр әсер етуі мүмкін. Қасақана зұлымдықпен жасалған Deepfakes мансап пен өмірге толығымен зиян келтіруі мүмкін.

Бұларды біреу басқаларға өту және достарының, туыстарының және әріптестерінің артықшылығын пайдалану үшін пайдаланылуы мүмкін. Олар сондай-ақ шетелдік көшбасшылардың жалған фильмдерін пайдалана отырып, дүниежүзілік қайшылықтарды және тіпті соғыстарды тудыруы мүмкін.

қорытынды

Қорыта айтқанда, біз біртүрлі кезеңде және әдеттен тыс ортада тұрмыз. Жалған жаңалықтар мен фильмдер шығару және оларды тарату бұрынғыдан да оңай. Ненің шындық, ненің жоқ екенін түсіну қиынға соғуда.

Бүгінде біз өз сезімдерімізге сене алмайтын сияқтымыз.

Жалған бейне детекторлары жасалғанына қарамастан, ақпарат алшақтығы соншалықты тар болғандықтан, тіпті ең жақсы жалған детекторлар бейненің шынайы немесе жоқ екенін анықтай алмайды.

пікір қалдыру