ベクトル データベースは、特に人工知能と機械学習の分野において、データの管理と解釈の方法に大きな変化をもたらします。

これらのデータベースの基本的な機能は、機械学習モデルの原材料である高次元ベクトルを効果的に処理することであり、テキスト、画像、音声入力を多次元空間の数値表現に変換することが含まれます。

レコメンデーション システム、オブジェクト認識、画像検索、不正行為検出などのアプリケーションの場合、この変換は単なるストレージではありません。これは、類似性検索と最近傍クエリの強力な機能への入り口です。

さらに深く言えば、ベクトル データベースの力は、大量の非構造化で複雑なデータを、元のコンテンツのコンテキストと意味を捉えたベクトルに変換する能力にあります。

このエンコーディングにモデルを埋め込むことで可能になった強化された検索機能には、周囲のベクトルをクエリして関連する画像やフレーズを見つける機能が含まれます。

ベクトル データベースは、Inverted File Index (IVF) や Hierarchical Navigable Small World (HNSW) などの高度なインデックス作成技術に基づいて構築されているという点で独特であり、N 次元空間で最も近いものを見つけながら速度と効率を向上させます。

ベクター データベースとクラシック データベースの間には明らかな違いがあります。従来のデータベースは、CRUD に最適化され、セット スキーマに準拠した組織化されたセットにデータを編成することに優れています。

ただし、高次元データの動的で複雑な性質を扱う場合、この厳格さが障害になり始めます。

対照的に、ベクトル データベースは、特に依存性の高いアプリケーションに対して、従来の同等のデータベースでは実現できない柔軟性と効率性を提供します。 機械学習 そして人工知能。彼らは拡張性があり、類似性検索に熟練しているだけではありません。

ベクトル データベースは、生成 AI アプリケーションに特に役立ちます。作成されたマテリアルが文脈上の整合性を保持していることを保証するために、自然言語処理や画像生成を含むこれらのアプリケーションは、埋め込みの迅速な検索と比較に依存しています。

そこでこの記事では、次のプロジェクトに向けてトップのベクター データベースを見ていきます。

1. トビ

Milvus は、埋め込み類似性検索や強力な MLOps など、主に AI アプリケーション向けに設計された先駆的なオープンソース ベクトル データベースです。

従来のリレーショナルデータベースとは異なり、主に 構造化データ、この容量により、前例のない兆規模でベクトルのインデックスを作成できるためです。

Milvus のスケーラビリティと高可用性への取り組みは、最初のバージョンから完全に分散されたクラウドネイティブの Milvus 2.0 までの開発方法によって実証されています。

具体的には、Milvus 2.0 は、数百ノードを超えて拡張しながら、99.9% という驚異的な可用性を目指す完全なクラウドネイティブ設計を示しています。

信頼性の高いベクター データベース ソリューションをお探しの方には、このエディションを強くお勧めします。マルチクラウド接続や管理パネルなどの高度な機能が追加されるだけでなく、柔軟なアプリケーション開発のためのデータ整合性レベルも向上します。

Milvus の注目すべき利点は、コミュニティ主導のアプローチであり、多言語サポートと開発者の要求に合わせた広範なツールチェーンを提供します。

IT 部門では、クラウドのスケーラビリティと信頼性、および大規模なデータセットに対する高性能ベクトル検索機能により、クラウドが人気のオプションとなっています。

さらに、ベクトル類似性検索とスカラー フィルタリングを組み合わせたハイブリッド検索機能を使用して、操作の効率を高めます。

Milvus には、明確な情報を備えた管理パネルがあります。 ユーザーインターフェース、API の完全なセット、およびスケーラブルで調整可能なアーキテクチャ。

外部アプリケーションとの通信はアクセス層によって促進され、負荷分散とデータ管理は中央コマンドとして機能するコーディネーター サービスによって調整されます。

データベースの永続性はオブジェクト ストレージ層によってサポートされ、ワーカー ノードはスケーラビリティを確保するためのアクティビティを実行します。

価格(英語)

どなたでも無料でご利用いただけます。

2. フェイス

Facebook の AI 研究チームは、高密度ベクトル クラスタリングと類似性検索をより効果的に行うために設計された、Facebook AI 類似性検索と呼ばれる最先端のライブラリを開発しました。

その作成は、最先端の基本的な方法論を利用して Facebook AI の類似性検索機能を向上させるという要件によって推進されました。

CPU ベースの実装と比較して、FAISS の最先端の GPU 実装は検索時間を 5 ~ 10 倍高速化できるため、推奨システムや大規模な言語での類似した意味の識別など、さまざまなアプリケーションにとって非常に貴重なツールになります。テキスト、オーディオ、ビデオなどの非構造化データセット。

FAISS は、コサイン類似度、内積、一般的に使用される L2 メトリック (ユークリッド距離) など、幅広い類似性メトリックを処理できます。

これらの測定により、さまざまな種類のデータにわたる正確かつ柔軟な類似性検索が容易になります。バッチ処理、精度と速度のトレードオフ、正確な検索と近似的な検索の両方のサポートなどの機能により、柔軟性がさらに向上します。

さらに、FAISS は、インデックスをディスクに保存できるようにすることで、大規模なデータセットを処理するためのスケーラブルな方法を提供します。

反転ファイル、積量子化 (PQ)、および改良された PQ は、FAISS の研究基盤を構成する革新的な技術のほんの一部であり、高次元ベクトル場のインデックス付けと検索に関してその有効性を高めます。

これらの戦略は、GPU で高速化された k 選択アルゴリズムや PQ 距離の事前フィルタリングなどの最先端のアプローチによって強化され、10 億規模のデータセットであっても迅速かつ正確な検索結果を生成する FAISS の能力を保証します。

価格(英語)

どなたでも無料でご利用いただけます。

3. 松毬

Pinecone はベクトル データベースのリーダーであり、特に高性能 AI アプリケーションのパフォーマンスを向上させるために構築されたクラウドネイティブのマネージド サービスを提供しています。

これは、生成 AI、セマンティック検索、および大規模な言語モデルを使用するアプリケーションに不可欠なベクトル埋め込みを処理するために特別に設計されています。

これらの埋め込みのおかげで、AI はセマンティック情報を理解できるようになり、複雑なタスクの長期記憶として効果的に機能します。

Pinecone は、従来のデータベースの機能とベクトル インデックスの強化されたパフォーマンスをシームレスに統合し、効率的かつ大規模なエンベディングの保存とクエリを可能にするという点で独特です。

これは、関連するデータの複雑さと量によって標準のスカラーベースのデータベースが不十分な状況に最適なオプションになります。

Pinecone は、統合とリアルタイムのデータ取り込み手順を合理化するマネージド サービス アプローチにより、開発者に手間のかからないソリューションを提供します。

データのフェッチ、更新、削除、クエリ、更新/挿入など、多数のデータ操作がサポートされています。

さらに、Pinecone は、更新/挿入や削除などのリアルタイムの変更を表すクエリが、数十億のベクトルを含むインデックスに対して正確で低遅延の応答を生成することを保証します。

動的な状況では、この機能はクエリ結果の関連性と最新性を維持するために不可欠です。

さらに、Pinecone 接続を介した Airbyte との提携により、Pinecone の多用途性と柔軟性が向上し、さまざまなソースからのスムーズなデータ統合が可能になります。

この関係により、増分データ同期を通じて新しく取得した情報のみが処理されるようにすることで、コストと効率を最適化できます。

コネクタの設計はシンプルさを重視しており、必要な設定パラメータは最小限で済み、拡張可能であるため、将来の改善も可能です。

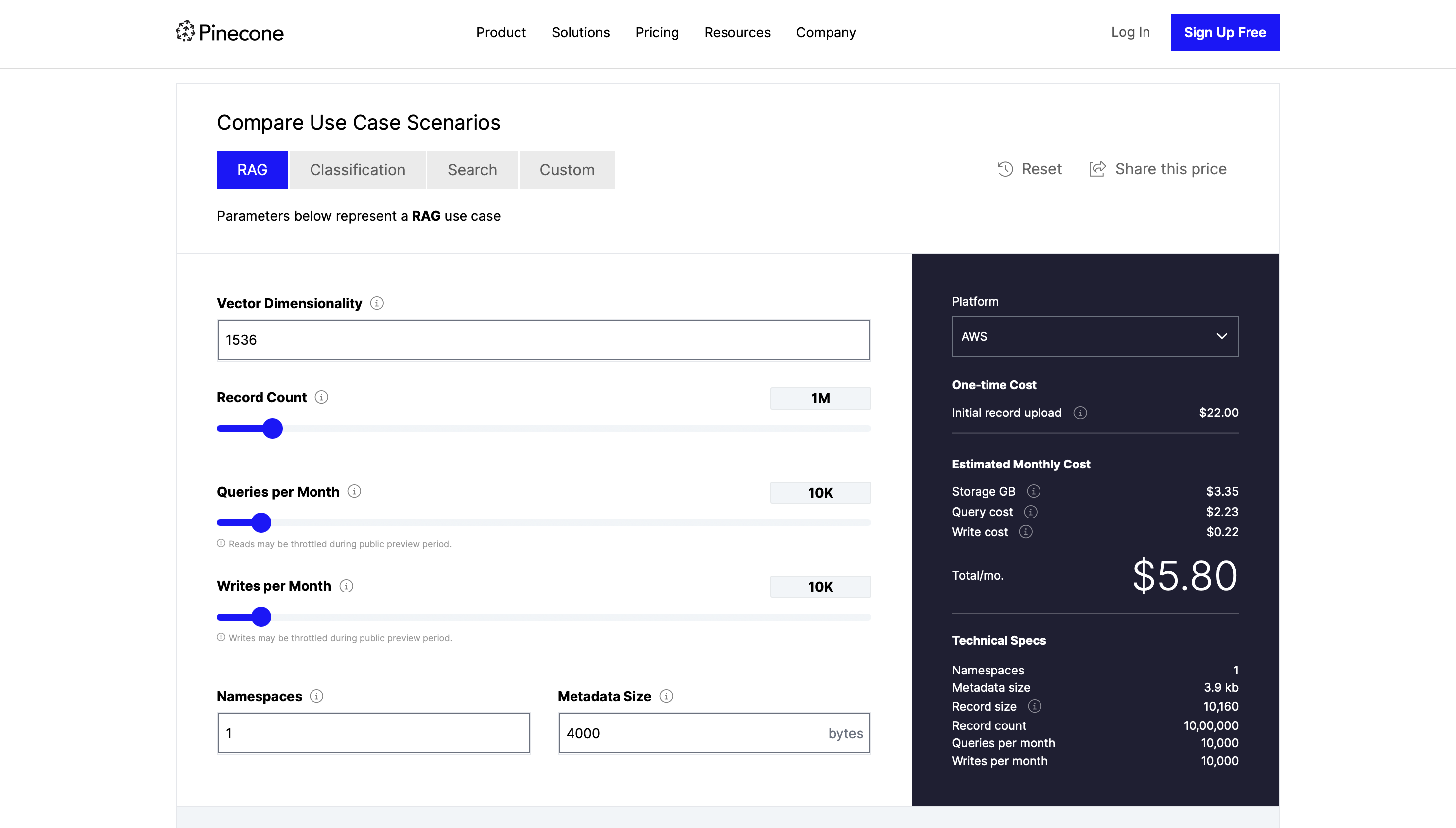

価格(英語)

RAG 使用例の場合、プレミアム価格は月額 5.80 ドルから始まります。

4. 弱める

Weaviate は、データにアクセスして使用する方法を変革するオープンソース ソフトウェアとして利用できる革新的なベクトル データベースです。

Weaviate はベクトル検索機能を利用しており、スカラー値や事前定義されたクエリに依存する一般的なデータベースとは対照的に、大規模で複雑なデータセットにわたる高度なコンテキスト認識型検索を可能にします。

この方法を使用すると、他のコンテンツとの類似性に基づいてコンテンツを見つけることができるため、検索の直観性と結果の関連性が向上します。

機械学習モデルとのスムーズな統合が主な特徴の 1 つです。これにより、単なるデータ ストレージ ソリューション以上の機能が可能になります。また、人工知能を使用してデータを理解および分析することもできます。

Weaviate のアーキテクチャにはこの統合が徹底的に組み込まれており、追加のツールを使用せずに複雑なデータを分析できるようになります。

また、グラフ データ モデルのサポートにより、リンクされたエンティティとしてのデータに対する異なる視点が提供され、従来のデータベース アーキテクチャでは見逃していたパターンや洞察が明らかになります。

Weaviate のモジュラー アーキテクチャにより、顧客は必要に応じてデータのベクトル化やバックアップの作成などの機能を追加できます。

その基本バージョンはベクトル データ専門データベースとして機能し、さまざまなニーズを満たすために他のモジュールを使用して拡張できます。

そのスケーラビリティはモジュラー設計によってさらに強化されており、増加するデータ量やクエリ要求に応じて速度が犠牲にならないことが保証されます。

データベースが RESTful API と GraphQL API の両方をサポートすることにより、保存されたデータを操作するための多用途かつ効果的な方法が可能になります。

特に、GraphQL が選ばれたのは、複雑なグラフベースのクエリを迅速に実行でき、ユーザーが過剰または不十分な量のデータを取得することなく、必要なデータを正確に取得できるためです。

Weaviate は、柔軟な API のおかげで、さまざまなクライアント ライブラリやプログラミング言語でより使いやすくなっています。

Weaviate をさらに詳しく知りたい人のために、インスタンスのセットアップと構成から、ベクトル検索、機械学習の統合、スキーマ設計などの機能の詳細まで、豊富なドキュメントとチュートリアルが用意されています。

Weaviate をローカルで運用する場合でも、ローカルで運用する場合でも、情報を動的かつ実用的なものにする同じ強力なテクノロジーにアクセスできます。 クラウドコンピューティング 環境、または Weaviate マネージド クラウド サービスを通じて。

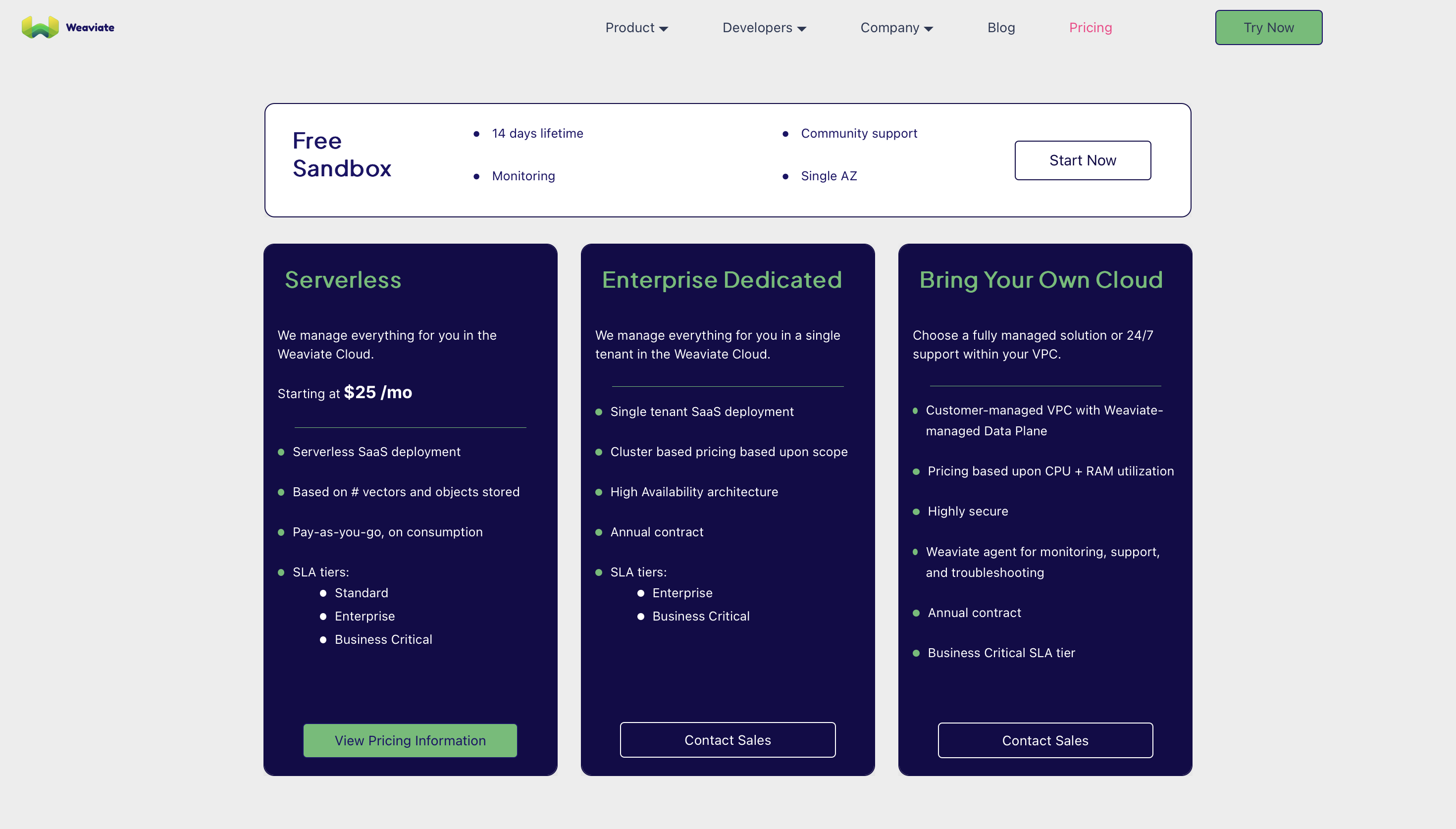

価格(英語)

プラットフォームのプレミアム価格は、サーバーレスの場合、月額 25 ドルから始まります。

5. クロマ

Chroma は、特に機械学習と人工知能を含むアプリケーション向けに、データの検索と保存に革命を起こすことを目的とした最先端のベクトル データベースです。

Chroma は標準のデータベースとは異なり、スカラー数値ではなくベクトルを扱うため、高次元の複雑なデータの管理に非常に優れています。

これは、キーワードの正確な一致ではなく、素材の意味的類似性に基づいたより高度な検索を可能にするため、データ検索テクノロジーの大きな進歩です。

Chroma の注目すべき特徴は、拡張設定用の ClickHouse やスタンドアロン インストール用の DuckDB など、いくつかの基盤となるストレージ ソリューションと連携できることで、さまざまなユースケースへの柔軟性と適応性を保証します。

Chroma は、シンプルさ、スピード、分析を念頭に置いて作成されています。 Python および JavaScript/TypeScript 用の SDK を使用して、幅広い開発者が利用できます。

さらに、Chroma は使いやすさを重視しており、開発者は DuckDB に裏付けされた永続データベースやテスト用のインメモリ データベースを迅速にセットアップできます。

従来のデータベースのテーブルに似たコレクション オブジェクトを構築できる機能により、テキスト データを挿入し、all-MiniLM-L6-v2 などのモデルを使用して埋め込みに自動的に変換できるため、この汎用性がさらに高まります。

テキストと埋め込みはシームレスに統合できます。これは、データ セマンティクスを把握する必要があるアプリケーションにとって不可欠です。

Chroma のベクトル類似性法の基礎は、データベース内のデータの表現と比較を理解するために不可欠な直交性と密度の数学的概念です。

これらのアイデアにより、Chroma はデータ要素間の意味論的なつながりを考慮して、意味のある効率的な類似性検索を実行できます。

Chroma をさらに詳しく知りたい人は、チュートリアルやガイドラインなどのリソースにアクセスできます。これらには、データベースの設定、コレクションの作成、類似性検索の実行方法に関する段階的なガイダンスが含まれています。

価格(英語)

無料で使い始めることができます。

6. ワスプ

Vespa は、AI と大規模データのオンライン処理を変革するプラットフォームです。

Vespa の基本的な目的は、大規模なデータセット全体で低遅延の計算を可能にし、テキスト、ベクトル、構造化データを簡単に保存、インデックス付け、分析できるようにすることです。

Vespa は、処理されるクエリ、選択、機械学習モデルの推論の性質に関係なく、あらゆる規模で迅速な回答を提供できる能力によって際立っています。

Vespa の柔軟性は、完全に機能する検索エンジンとベクトル データベースに表れており、ベクトル (ANN)、語彙、構造化データに至るまで、単一のクエリ内で多くの検索を可能にします。

規模に関係なく、機械学習モデル推論とデータの統合により、リアルタイム AI 機能を備えたユーザーフレンドリーで応答性の高い検索アプリを作成できます。

しかし、Vespa は単に求めるものではありません。それは出会いを理解し、カスタマイズすることでもあります。

一流のカスタマイズおよび提案ツールは、特定のユーザーまたは状況に応じた動的な最新の推奨事項を提供します。

Vespa は、テキストおよびベクター データをリアルタイムで保存および探索するために必要なインフラストラクチャを提供し、より高度で実用的な AI エージェントの開発を可能にするため、会話型 AI 分野への参入を検討している人にとっても革新的な製品です。

包括的なトークン化とステミング、全文検索、最近傍検索、構造化データ クエリはすべて、プラットフォームの広範なクエリ機能によってサポートされています。

複数の検索ディメンションを組み合わせて複雑なクエリを効果的に処理できる点が異なります。

Vespa は、その計算エンジンがスカラーとテンソル上の複雑な数式を処理できるため、AI および機械学習アプリケーションの計算能力を強化します。

Vespa は、操作が簡単で拡張可能であるように作られています。

システム構成やアプリケーション開発からデータやノード管理に至るまでの反復的なプロセスを合理化し、安全で中断のない本番運用を可能にします。

Vespa のアーキテクチャは、データに合わせて拡張し、信頼性とパフォーマンスを維持します。

価格(英語)

無料で使い始めることができます。

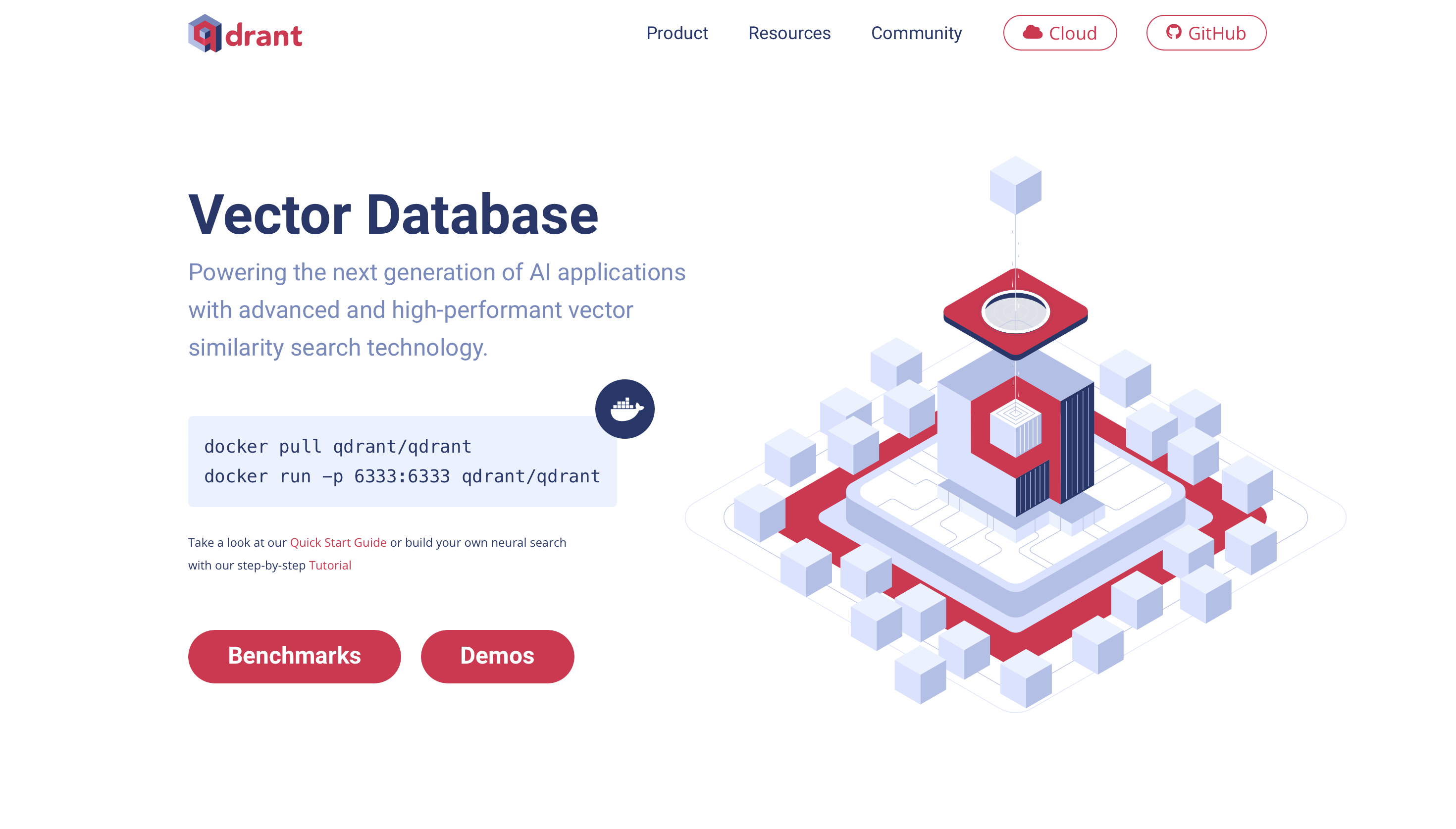

7. クアドラント

Qdrant は、AI および機械学習アプリケーションの増大する需要を満たす独自の機能セットを提供する、柔軟なベクトル データベース プラットフォームです。

Qdrant はその基礎として、ベクトルとペイロード データを保存、検索、維持するための使いやすい API を提供するベクトル類似性検索エンジンです。

この機能は、セマンティック検索や推奨システムなど、複雑なデータ形式の解釈を必要とするいくつかのアプリケーションにとって重要です。

このプラットフォームは効率と拡張性を念頭に置いて構築されており、数十億のデータ ポイントを含む大規模なデータセットを処理できます。

コサイン類似度、ユークリッド距離、ドット積などのいくつかの距離メトリックを提供し、多くの使用シナリオに適応できます。

この設計では、文字列フィルター、範囲フィルター、地域フィルターなどの複雑なフィルター処理を提供し、多様な検索ニーズに対応します。

開発者は Qdrant にさまざまな方法でアクセスできます。たとえば、迅速なローカル セットアップ用の Docker イメージ、言語に慣れている人用の Python クライアント、より堅牢な運用グレードの環境用のクラウド サービスなどです。

Qdrant の適応性により、あらゆる技術構成やプロセスのニーズとシームレスに統合できます。

さらに、Qdrant の使いやすいインターフェイスにより、ベクトル データベースの管理が簡素化されます。このプラットフォームは、クラスターの作成から安全なアクセスのための API キーの生成まで、あらゆるスキル レベルのユーザーにとって簡単に行えるように設計されています。

一括アップロード機能と非同期 API により効率が向上し、膨大な量のデータを扱う開発者にとって非常に便利なツールになります。

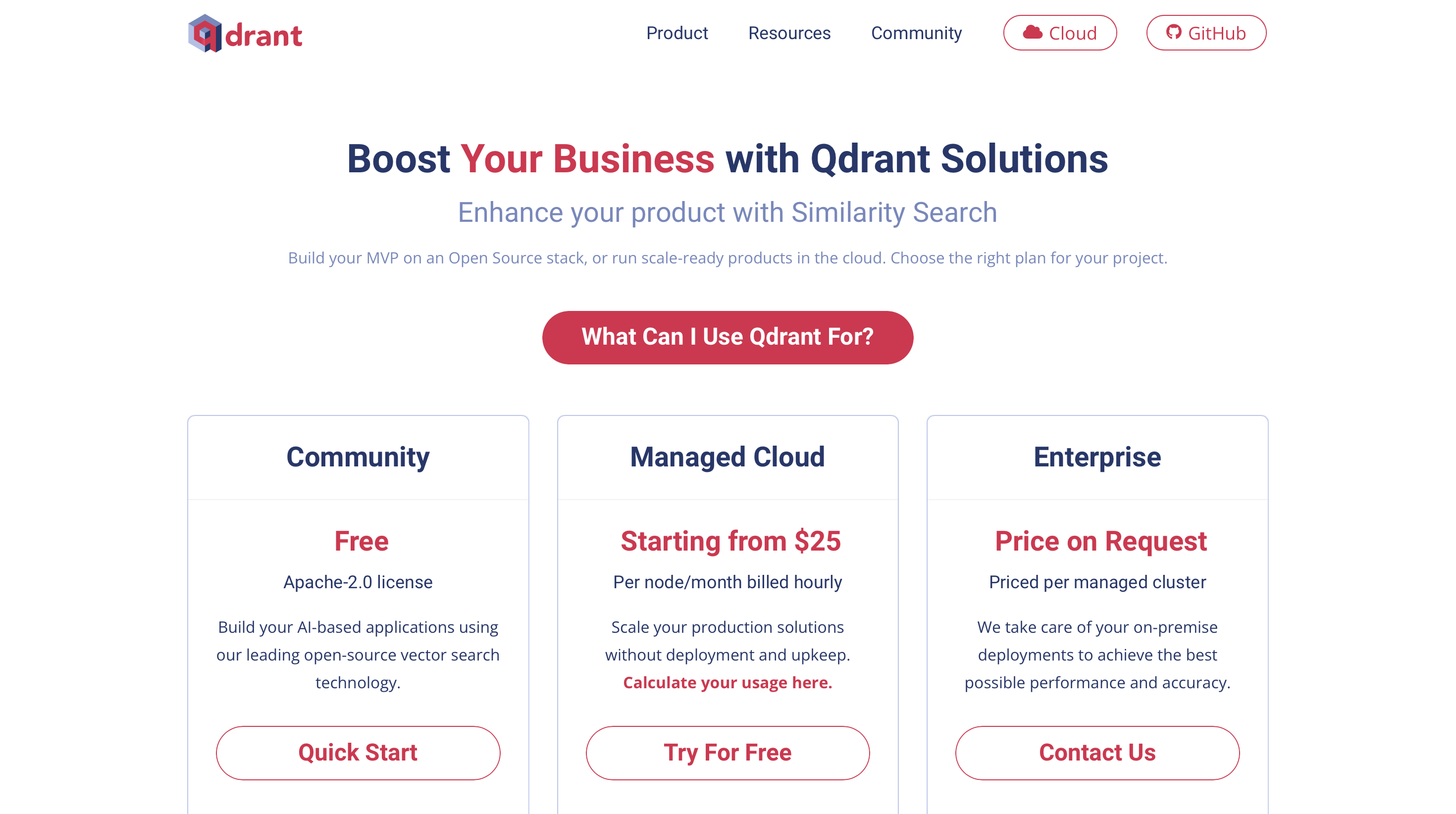

価格(英語)

無料で使用を開始でき、時間単位で請求されるプレミアム料金はノードあたり月額 25 ドルから始まります。

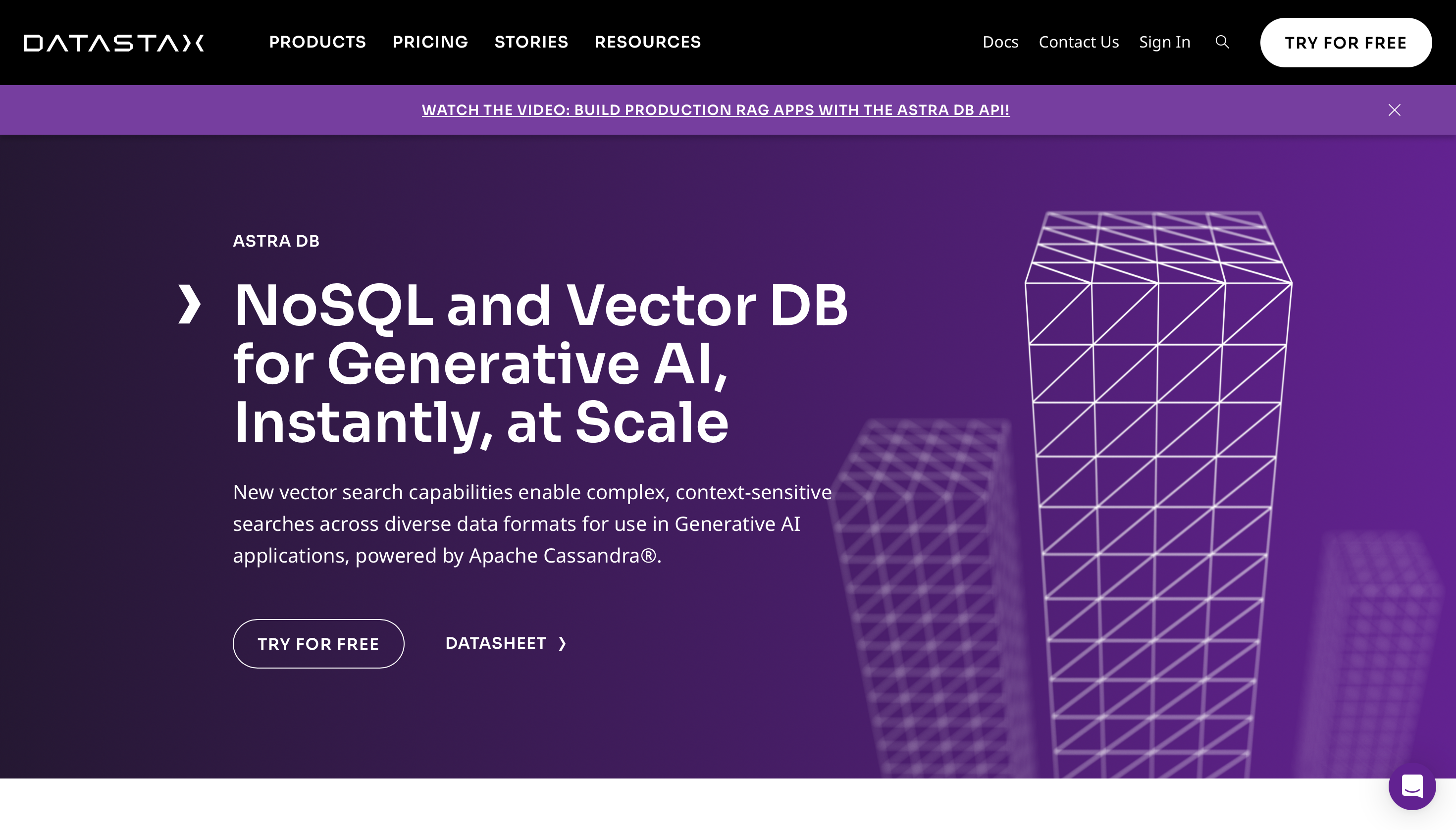

8. アストラDB

AstraDB の優れたベクトル検索機能とサーバーレス アーキテクチャは、生成 AI アプリケーションを変革しています。

AstraDB は、Apache Cassandra の強固な基盤上に構築されており、スケーラビリティ、安定性、パフォーマンスをシームレスに組み合わせているため、さまざまなデータ型にわたる複雑でコンテキスト依存の検索を管理するための優れたオプションです。

AstraDB の最も注目すべき利点の 1 つは、同時クエリと更新操作の非常に低いレイテンシーを維持しながら、ストリーミング データ、非ベクター データ、ベクター データなどの異種ワークロードを処理できる能力です。

この適応性は、正確でコンテキストを認識した AI 応答を提供するためにストリーミングとリアルタイムのデータ処理を必要とする生成 AI アプリケーションにとって不可欠です。

AstraDB のサーバーレス ソリューションにより、開発がさらに容易になり、開発者はバックエンド インフラストラクチャの管理ではなく、革新的な AI アプリケーションの作成に集中できるようになります。

クイックスタート ガイダンスから、チャットボットやレコメンデーション システムの作成に関する詳細なレッスンまで、AstraDB を使用すると、開発者は信頼性の高い API と、よく知られたツールやプラットフォームとのスムーズなインターフェイスを通じて、AI のアイデアを迅速に実現できます。

エンタープライズ グレードの生成 AI システムではセキュリティとコンプライアンスを優先する必要があり、AstraDB は両方の面で機能します。

高度な企業セキュリティ機能とコンプライアンス認証が提供され、AstraDB 上で開発された AI アプリケーションが最も厳格なプライバシーとデータ保護のガイドラインに準拠していることが保証されます。

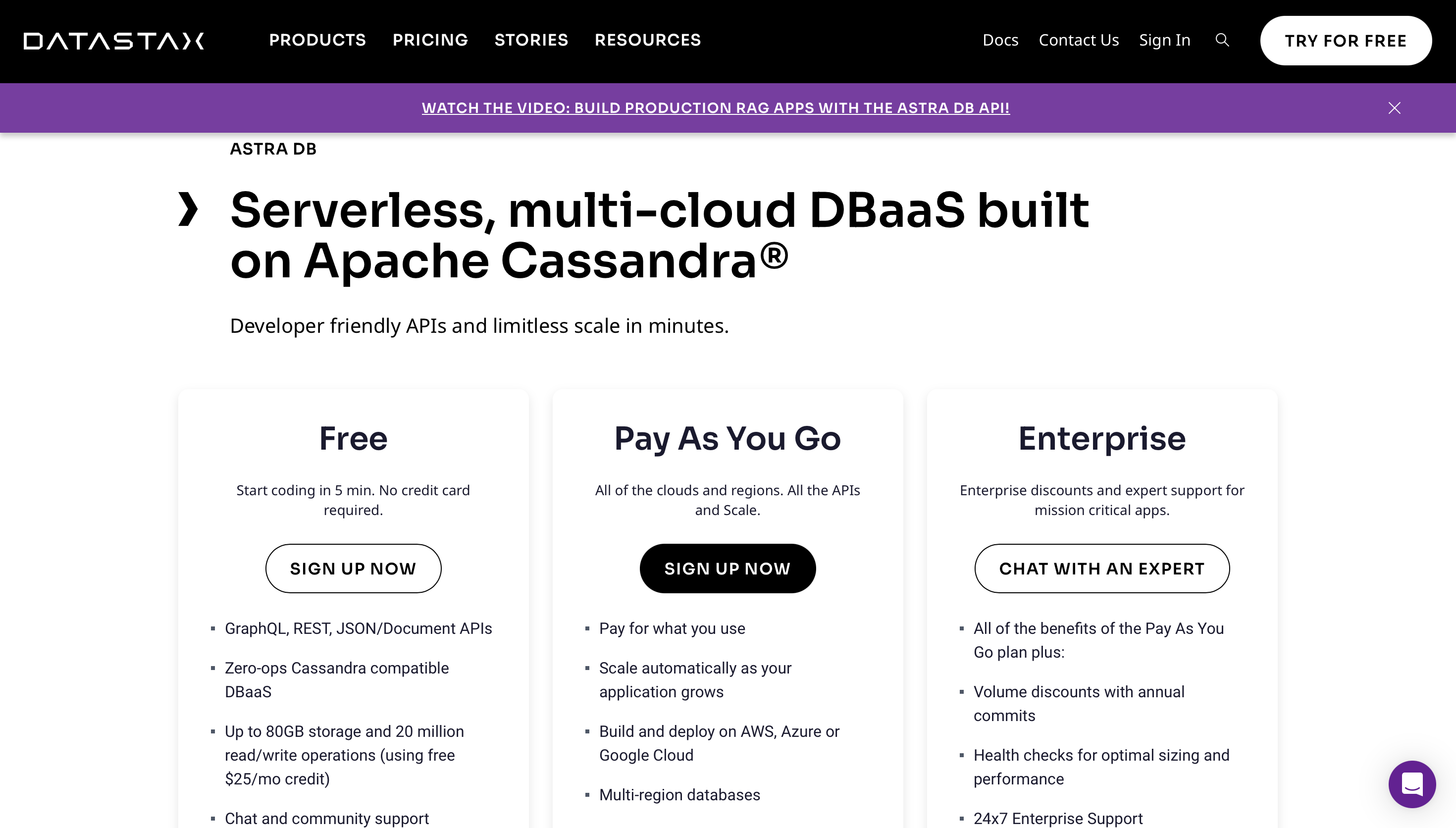

価格(英語)

無料で使い始めることができ、従量課金制モデルも提供されています。

9. Opensearch

OpenSearch は、ベクトル データベース、特に適応性、スケーラブル、将来性のある AI システムの開発を検討している人にとって、魅力的なオプションのように見えます。

OpenSearch は、分析機能、高度なベクトル検索、および従来の検索を 1 つの一貫したシステムに組み合わせた、包括的なオープンソースのベクトル データベースです。

機械学習埋め込みモデルを使用して、文書、写真、音声などの複数のデータ形式の意味とコンテキストを類似性検索用のベクトルにエンコードすることにより、この統合は、検索アプリに意味論的な理解を組み込もうとしている開発者にとって特に役立ちます。

OpenSearch には多くの機能がありますが、Elasticsearch と比較して、特にスクリプト言語や取り込みパイプライン プロセッサなどの重要なモジュールでのコード変更が大幅に少ないことを覚えておくことが重要です。

Elasticsearch は、開発労力の増加により、より高度な機能を備えている可能性があり、両者のパフォーマンス、機能セット、アップデートに違いが生じます。

OpenSearch は、大規模なコミュニティのフォローとオープンソースのアイデアへの献身によって補い、オープンで適応性のあるプラットフォームを実現します。

可観測性やセキュリティ分析など、検索や分析を超えた幅広いアプリケーションをサポートしており、データ集約型タスクのための柔軟なツールとなっています。

コミュニティ主導の戦略により、継続的な機能強化と統合が保証され、プラットフォームを最新かつ独自の状態に保つことができます。

価格(英語)

無料で使い始めることができます。

10. Azure AI 検索

Azure AI Search は、生成 AI アプリケーション内の検索機能を向上させる強力なプラットフォームです。

これは、検索インデックス内のベクトル埋め込みのインデックス作成、保存、取得のメカニズムであるベクトル検索をサポートしているという点で際立っています。

この機能は、ベクトル空間で比較可能なドキュメントを検出するのに役立ち、より文脈的に関連性の高い検索結果が得られます。

Azure AI Search は、ベクトル検索とキーワード検索が同時に実行されるハイブリッド状況のサポートによって際立っており、その結果、単独で使用した各手法の有効性を上回る統合された結果セットが得られることがよくあります。

同じインデックス内でベクター素材と非ベクター素材を組み合わせることで、より完全で柔軟な検索エクスペリエンスが可能になります。

Azure AI Search のベクター検索機能は広くアクセスでき、すべての Azure AI Search 層で無料です。

Azure サイト経由で提供される複数の開発環境をサポートしているため、さまざまなユースケースや開発環境に非常に柔軟です。 REST API、Python、JavaScript、.NET などの SDK が含まれます。

Azure AI エコシステムとの緊密な統合により、Azure AI Search は単なる検索以上のものを提供します。また、生成的な AI アプリケーションに対するエコシステムの可能性も高まります。

モデル埋め込み用の Azure OpenAI Studio と画像取得用の Azure AI Services は、この統合に含まれるサービスの 2 つの例にすぎません。

Azure AI Search は、類似性検索やマルチモーダル検索からハイブリッド検索や多言語検索まで、幅広いアプリケーションを可能にする広範なサポートにより、アプリケーションに高度な検索機能を組み込みたい開発者にとって柔軟なソリューションです。

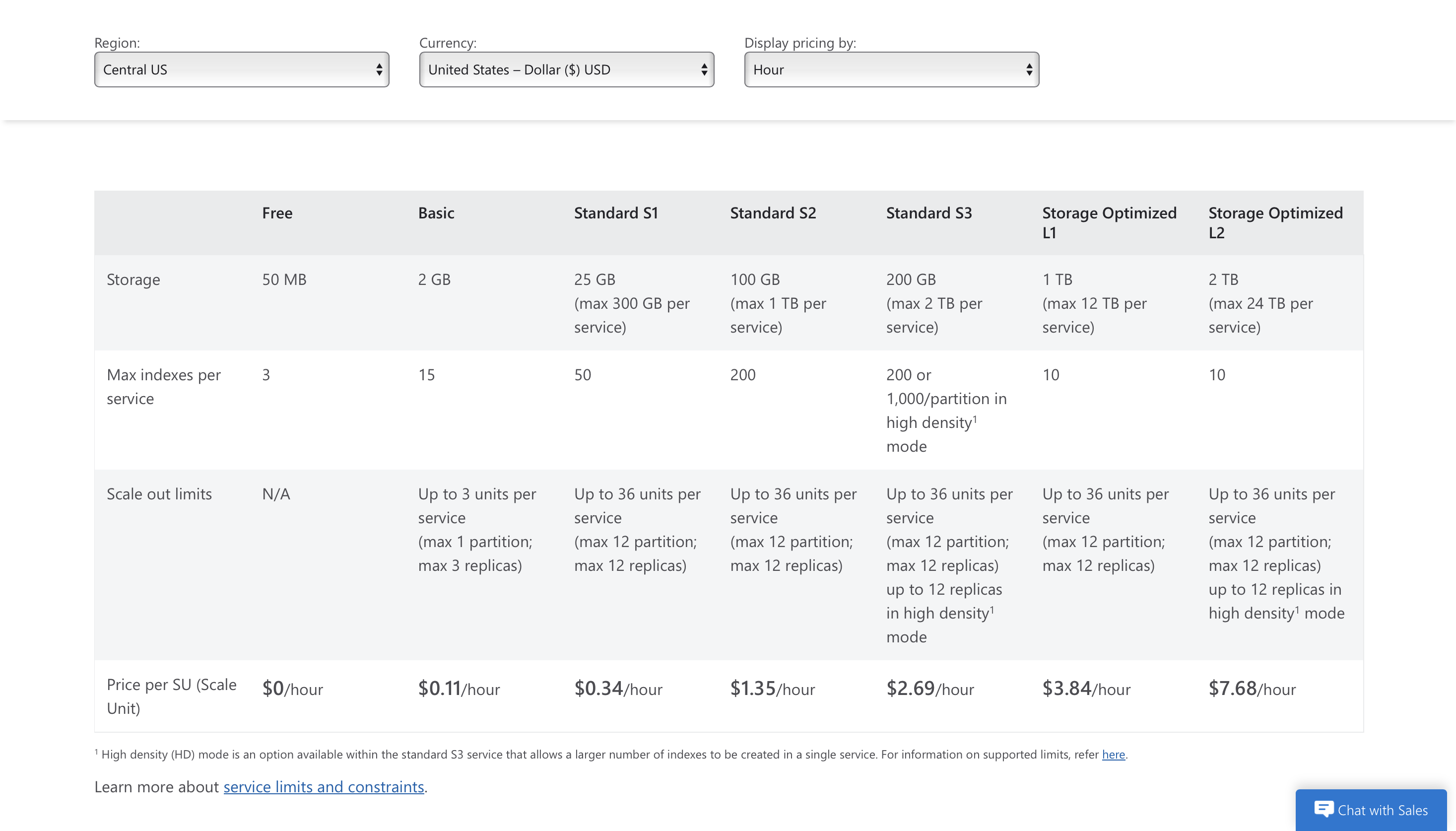

価格(英語)

無料で使い始めることができ、プレミアム料金は 0.11 時間あたり XNUMX ドルから始まります。

まとめ

ベクトル データベースは、高次元ベクトルを管理することで AI のデータ管理を変革し、推奨システムや不正行為検出などのアプリケーションで強力な類似性検索や迅速な最近傍クエリを可能にします。

これらのデータベースは、高度なインデックス付けアルゴリズムを使用して、複雑な非構造化データを意味のあるベクトルに変換すると同時に、従来のデータベースにはない速度と柔軟性を提供します。

注目すべきプラットフォームには、生成 AI アプリケーションに優れた Pinecone が含まれます。 FAISS、高密度ベクトル クラスタリングのために Facebook AI によって作成されました。もう 1 つは、スケーラビリティとクラウドネイティブ アーキテクチャで有名な Milvus です。

Weaviate は機械学習とコンテキスト認識検索を組み合わせていますが、Vespa と Chroma はそれぞれ低遅延のコンピューティング機能と使いやすさで注目に値します。

Qdrant、AstraDB、OpenSearch、Azure AI Search などのプラットフォームは、サーバーレス アーキテクチャから広範な検索および分析機能に至るまで、さまざまなサービスを提供するため、ベクトル データベースは、AI および機械学習テクノロジを開発するための重要なツールです。

コメントを残す