Tartalomjegyzék[Elrejt][Előadás]

A webkaparás kulcsfontosságú eszközzé vált a mai adatvezérelt társadalomban, ahol a tudás hatalom. Biztosan hallott már a böngészőalapú webkaparó platformokról.

Most beszéljük meg a böngészőalapú webkaparási platformokat. Ezek a rendszerek egyszerű és gyors módot kínálnak adatok kinyerésére a webhelyekről bonyolult kód vagy speciális ismeretek használata nélkül. Egyszerű eszközöket és felhasználóbarát felületeket biztosítanak, amelyek leegyszerűsítik a kaparási folyamatot.

A böngésző alapú rendszerek szépsége abban rejlik, hogy készítenek webes kaparás mindenki számára elérhető, a kezdőktől a szakemberekig. A böngésző alapú megoldások mindenki számára elérhetővé teszik az online kaparást, legyen szó mintákat elemző kutatóról, riválisokat figyelni próbáló cégtulajdonosról vagy információt kereső egyénekről.

Számos előnye van annak, ha böngészőalapú megoldásokat alkalmaz a webkaparáshoz.

Először is megszüntetik a műszaki szakértelem követelményét, így bárki számára egyszerűvé válik az adatok lekaparása a webhelyekről. Ezek a rendszerek gyakran tartalmaznak point-and-click képességeket és grafikát felhasználói felületek, amely lehetővé teszi a felhasználók számára, hogy könnyen interakcióba lépjenek a webhelyekkel, és kiválaszthassák a kinyerni kívánt adatokat.

A lekaparási folyamat leegyszerűsödik, és értékes időt takarít meg a böngészőalapú megoldások olyan képességeinek köszönhetően, mint az adatellenőrzés, automatizálás és ütemezés. Gyakran erős proxy hálózatokkal is rendelkeznek, amelyek megbízható és biztonságos adatkinyerést garantálnak, miközben túllépik a korlátozásokat vagy blokkolják a rendszereket.

Böngésző alapú technológiákkal megbirkózik a nehéz lekaparási munkákkal, adatokat nyerhet ki dinamikus webhelyekről, és a megszerzett adatokat hasznos ismeretekké alakíthatja. Azáltal, hogy hozzáférnek az interneten elérhető rengeteg adathoz, lehetővé teszik a szervezetek, kutatók és emberek számára, hogy az adatközpontú világban élen járjanak. Ebben a cikkben a legkiválóbb böngészőalapú webkaparó platformokat fogjuk megvizsgálni.

1. Fényes adatok

A Bright Data fényes csillag a böngészőalapú webkaparó eszközök között, mivel teljes választ kínál az ügyfelek webkaparási igényeire. Böngészőalapú módszer használatával a Bright Data lehetővé teszi dinamikus tartalommal, JavaScript-megjelenítéssel és bonyolult oldalarchitektúrával rendelkező webhelyek összegyűjtését, így biztosítva az összes fontos adat összegyűjtését.

A Bright Data Scraping Browser segítségével könnyedén böngészhet és navigálhat a megcélzott webhelyeken, miközben a Bright Data kezeli a teljes proxyt és a feloldó infrastruktúrát az Ön nevében. A Web Unlocker automatikus feloldási képességeinek ereje a Scraping Browserben van beépítve, egy automatizált böngészőbe, amelyet az adatok lekaparására terveztek.

Bármely adatkaparási projekt, amely méretezhetőséget, böngészőket és az összes webhely-feloldási tevékenység automatikus vezérlését igényli, tökéletes a használatához. A Scraping Browser, Puppeteer és Playwright API használatával adaptálható eszközzé válik a műveletek automatizálására és a webhelyekről származó adatok lekérésére.

Ha nagy mennyiségű adattal dolgozik, ez a képesség rendkívül hasznos. Végül, de nem utolsósorban, a Bright Data olyan blokkolásgátló módszereket vezetett be, amelyek segítségével megkerülheti az olyan dolgokat, mint a CAPTCHA-k és más webhely-blokkolások.

Kiterjedt proxyhálózata, amely több mint 72 millió tartózkodási IP-címet és 2 millió mobil IP-t tartalmaz a világ minden tájáról, és páratlan lefedettséget és megbízhatóságot kínál a webkaparáshoz, az egyik legmeghatározóbb tulajdonsága.

Ezen kívül kompatibilis számos programozási nyelvek, beleértve a Pythont, a Node.js-t és a Java-t, valamint a széles körben használt adattároló és -elemző rendszereket, mint például az AWS, a Google Cloud és a BigQuery. A Bright Data segítségével a webkaparás szövetségeseként biztonsággal és hatékonyan kaparhat, és könnyedén felszabadíthatja az adatokban rejlő lehetőségeket.

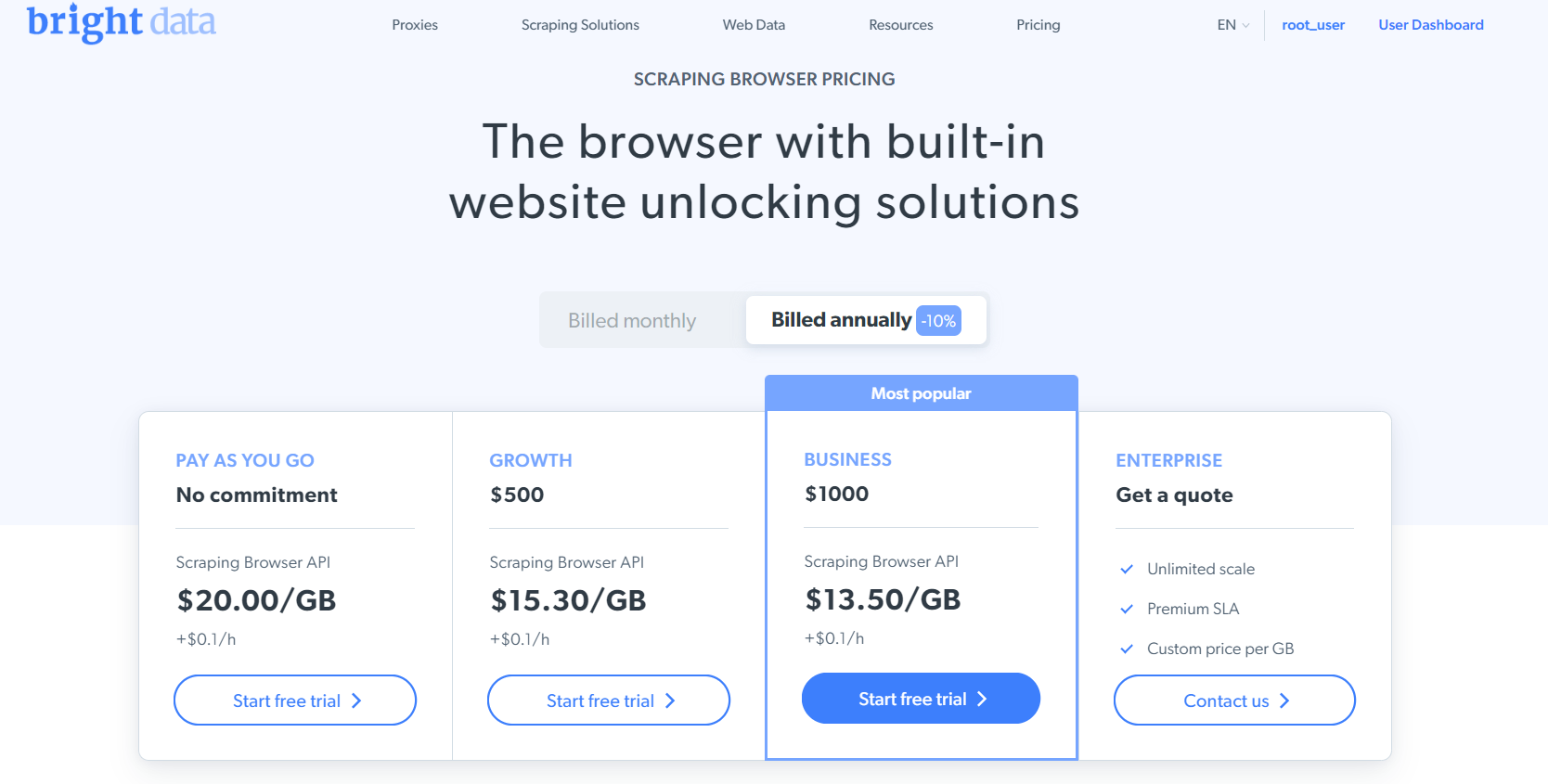

Árazás

A az árak 13.50 USD/GB-tól kezdődnek.

2. Octoparse

Az Octoparse egy ideális böngészőalapú eszköz, amelyet kizárólag webkaparáshoz hoztak létre. Még a kódolási készségekkel nem rendelkező egyének is zökkenőmentesen kaparhatnak vele.

Könnyedén gyűjthet adatokat a webhelyekről a felhasználóbarát vizuális kaparóeszköz segítségével. Nincs szükség bonyolult kódolási vagy szkriptnyelvek tanulására. Az Octoparse leegyszerűsíti az eljárást azáltal, hogy lehetővé teszi, hogy közvetlenül kapcsolatba lépjen a webhellyel, és válassza ki a kinyerni kívánt adatelemeket.

Hasonló ez ahhoz, mintha egy virtuális kezet adnának az interneten való kereséshez és a kívánt információk megtalálásához. Az Octoparse azonban többet tesz, mint csupán adatok kinyerését. Az adatátalakítási és -tisztítási képességekben is kiemelkedő.

Az adatok lekaparását követően az Octoparse lehetővé teszi, hogy egyedi igényei szerint formázza és javítsa azokat. Az adatok értékesebbé és használhatóbbá tétele érdekében megtisztíthatja a zavaró adatokat, megszüntetheti az ismétlődéseket, és még bonyolult átalakításokat is végrehajthat.

Az Octoparse segítségével az adatok életciklusának minden szakaszát kezelheti, beleértve a kinyerést, tisztítást és átalakítást is, mindezt egy egyszerű böngésző alapú felület segítségével. Műszaki ismeretek nélkül léphet be a webkaparás világába az Octoparse segítségével, felbecsülhetetlen értékű ismereteket fedezhet fel, és kihasználhatja az adatok erejét.

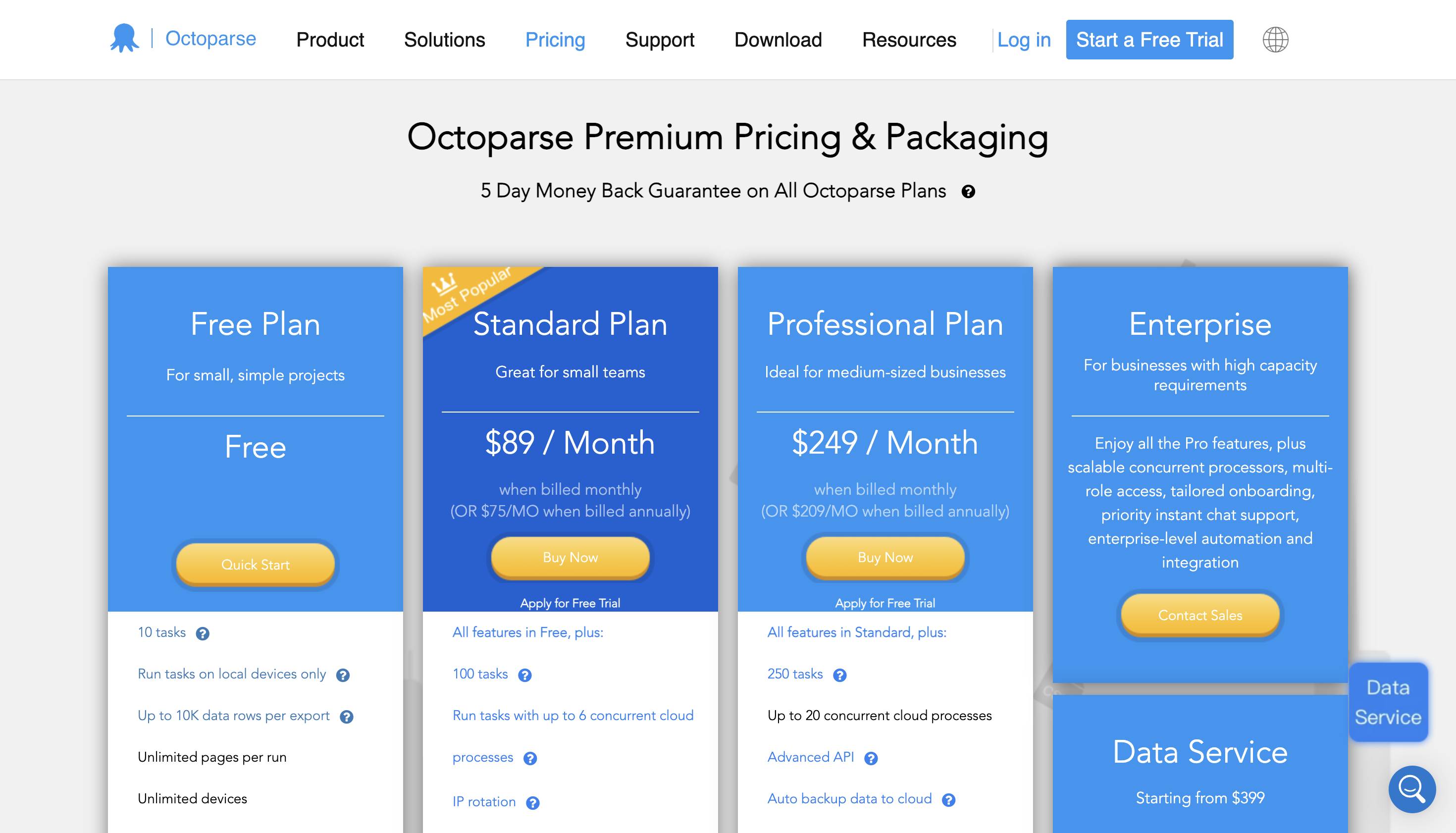

Árazás

Ingyenesen elkezdheti használni, és a prémium ára 89 USD/hónaptól kezdődik.

3. ParseHub

A ParseHub egy olyan platform, amely képes kezelni az összes kaparási igényt, és hihetetlenül rugalmas és felhasználóbarát. A ParseHub gondoskodik arról, hogy Ön kezdő vagy szakértő adatrajongó. A ParseHub egyedülálló tulajdonsága az egyszerű point-and-click felület, amely jelentősen megkönnyíti a dinamikus webhelyekről történő adatgyűjtést.

Az összetett weboldalakon szakértő kódoló nélkül is lehet navigálni. Az adatok kinyeréséhez válassza ki a kívánt adatokat, és a ParseHub kezeli a többit. Olyan, mintha saját személyes segítőd lenne az adatkinyeréshez. A ParseHub azonban kifinomultabb lehetőségeket kínál, hogy a kaparást a következő szintre emelje.

Az ütemezett lekaparással automatizálhatja a lekaparási folyamatot, amely lehetővé teszi a ParseHubnak, hogy előre meghatározott időközönként lekérje az adatokat, így mindig a legfrissebb információkkal rendelkezik.

Ezenkívül a ParseHub zökkenőmentes API-kapcsolatot kínál, így egyszerűvé teszi a kimásolt adatok beépítését saját programjaiba vagy rendszereibe. Ez egy hatékony technika a kinyert adatok felhasználásának optimalizálására és az adatok munkafolyamatának javítására.

A webkaparás szórakoztató és hatékony folyamattá válik a ParseHub felhasználóbarát kezelőfelületével és hatékony funkcióival, amelyek könnyen felfednek hasznos információkat a dinamikus weboldalakról.

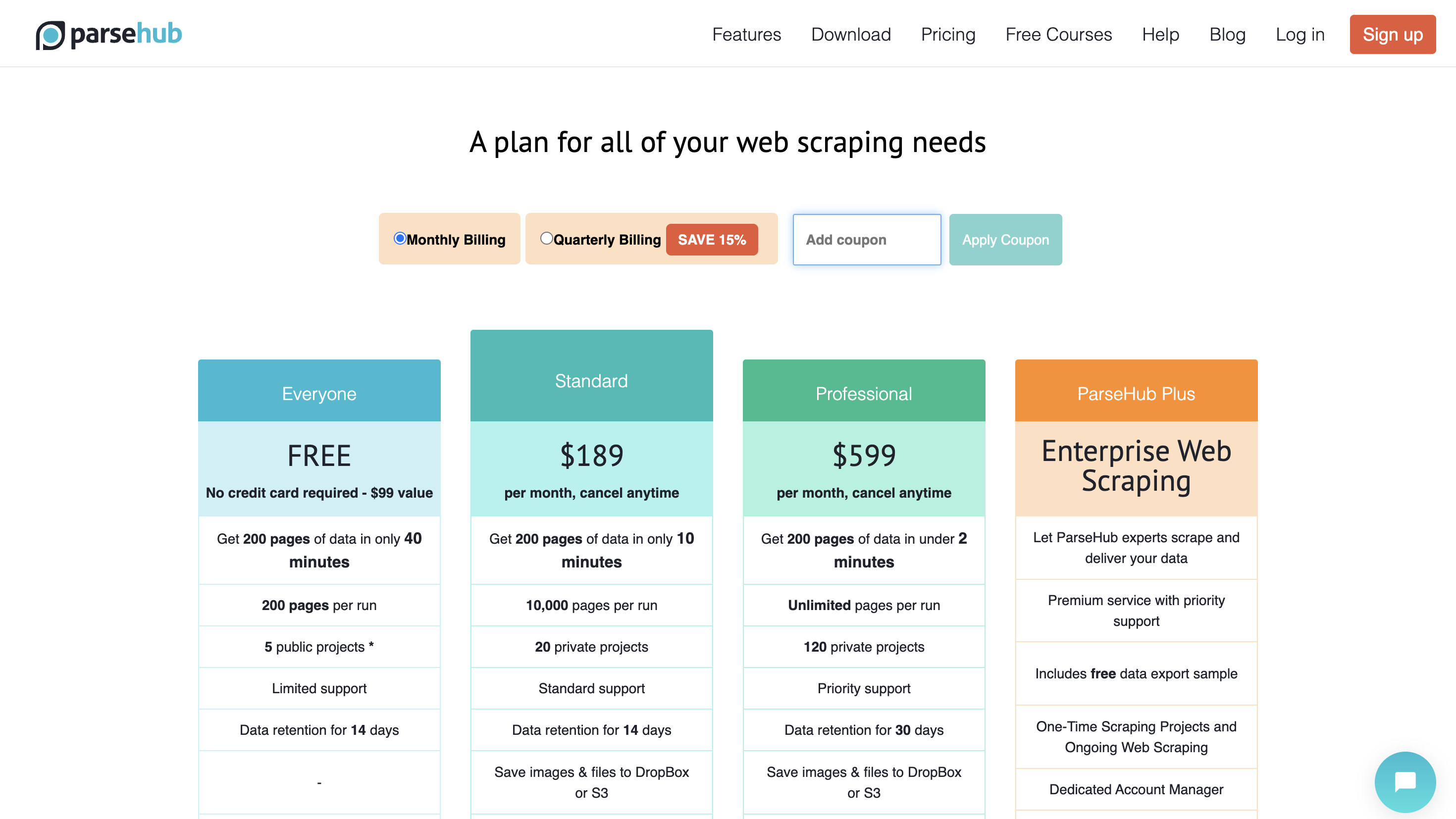

Árazás

Ingyenesen elkezdheti használni, és a prémium ára 189 USD/hónaptól kezdődik.

4. Webz.io

Webz.io – A Big Web Data egy figyelemre méltó böngészőalapú technológia, amely a webes adatok kinyerésére és figyelésére összpontosít. Könnyedén szerezhet betekintést nyújtó adatokat az interneten, ha a Webz.io használatával nyomon követheti az internetet. Ez a platform egy információs aranybánya, amely mélyreható tudósítást nyújt a hírekről, a blogokról és az online beszélgetésekről különféle témákban.

A Webz.io gondoskodik arról, hogy hozzáférjen a legfrissebb és releváns információkhoz az egész internetről, függetlenül az Ön vállalkozásától vagy szakértelmétől. Ez ahhoz hasonlítható, mintha egy nagy tudástárhoz férne hozzá. A Webz.io azonban túlmutat az adatlefedettségen.

Ezenkívül zökkenőmentes API-kapcsolatot kínál, így egyszerűen beépítheti a kinyert adatokat saját programjaiba vagy rendszereibe. Ezzel a képességgel számtalan lehetőség kínálkozik az adatok felhasználására az Ön igényeinek leginkább megfelelő módon.

A Webz.io API kapcsolat leegyszerűsíti az adatintegrációs folyamatot, akár egyéni irányítópultot hoz létre, akár piackutatást végez, akár mesterséges intelligencia-alapú megoldást hoz létre.

Webz.io – A Big online Data felhasználóbarát kezelőfelülete, valamint az erős adatfigyelési és -kinyerési képességek lehetővé teszik, hogy a görbe előtt maradjon, és az online adatokat a lehető legteljesebb mértékben felhasználja egy vállalatnál vagy kutatásnál végzett munkájához.

Árazás

Az árakkal kapcsolatban kérjük, vegye fel a kapcsolatot az eladóval.

5. import.io

Az Import.io egy nagyszerű böngésző alapú eszköz, amely egyszerű point-and-click felületével megoldja az online kaparás nehézségeit. Az import.io segítségével a webes lemásolás egyszerű, függetlenül az Ön adattudásának szintjétől. Könnyedén, néhány kattintással és minden technikai tapasztalat nélkül kinyerhet adatokat a webhelyekről.

Olyan, mintha egy varázspálcával gyűjthetné össze a kívánt adatokat a hatalmas webről. Az import.io azonban ennél tovább megy. Kifinomult kúszó technológiájával mindent felülmúl.

Az Import.io most már felfedezheti adatszerkezetek és minták a weboldalakon, ami növeli az internetes kaparási folyamat hatékonyságát és pontosságát. Olyan ez, mint egy adatnyomozó, aki ismeri a weboldal elrendezését, és gyorsan és egyszerűen össze tudja gyűjteni a megfelelő adatokat.

Az import.io kiterjedt adatintegrációs képességeinek köszönhetően a lekapart adatok különféle formátumokba és programokba exportálhatók. Az Import.io a kívánt CSV, Excel vagy JSON formátumban tudja biztosítani az adatokat. A visszakeresett adatok egyszerűen beépíthetők adatbázisaiba, elemző programokba vagy akár kereskedelmi alkalmazásokba.

Az import.io segítségével egyszerűvé teszi a webes lemásolást, amely lehetővé teszi, hogy áttekinthető információkhoz jusson, és optimalizálja adatvezérelt műveleteit.

Árazás

Használhatja a platformot 14 napos ingyenes próbaverziójával, és a prémium ára 199 USD/hónaptól kezdődik.

6. Dexi.io

A Dexi.io egy innovatív platform, amely böngészőben is használható, és a webkaparási lehetőségek teljes skáláját kínálja. Az egyszerű vizuális szerkesztővel és a point-and-click felhasználói felülettel a Dexi.io elérhetővé teszi a webkaparást a technikai tapasztalat minden szintjén lévő felhasználók számára. A webkaparás bonyolultságának elsajátításához nem kell kódolózseninek lenni.

A Dexi.io egyszerűvé teszi a kaparórobotok létrehozását, amelyek gyorsan és pontosan lekaparják az adatokat a weboldalakról. Ez olyan, mintha egy virtuális asszisztens lenne, aki minden fáradságos feladatot ellát.

A Dexi.io túlmutat az egyszerű adatkinyerésön. Az adatgazdagítás, az egyik kifinomultabb képessége, lehetővé teszi a lekért adatok javítását más forrásokból származó részletek hozzáadásával. Ennek eredményeként elemzése élesebb és teljesebb lesz.

Ezenkívül a Dexi.io használatával lemásolt adatokat számos formátumban exportálhatja, beleértve a CSV-t, az Excelt vagy a JSON-t. A Dexi.io egyszerűvé teszi a más rendszerekbe történő integrációhoz vagy a további mélyreható kutatásokhoz szükséges adatok beszerzését.

A Dexi.io továbbá API-kapcsolatot biztosít, amely lehetővé teszi, hogy gyorsan csatlakozzon a saját szoftveréhez vagy rendszereihez, és beépítse azokat az adatokat. Automatizálhatja az eljárásokat, és maximalizálhatja a visszakeresett adatok felhasználását, mivel ez zökkenőmentes munkafolyamatot biztosít.

Árazás

Kipróbálhatja a platformot ingyenes próbaverziójával, és forduljon a szállítóhoz a prémium áraiért.

7. Mozenda

A Mozenda egy csúcsminőségű webkaparó eszköz, amely automatizált és böngészőalapú lekaparási lehetőségeket biztosít. A Mozenda felhasználóbarát kezelőfelülete és robusztus képességei egyszerűbbé teszik az adatok webhelyekről való lekérését.

A rámutatással és kattintással használható felhasználói felület segítségével a Mozenda egyszerűvé teszi a webhelyek közötti navigálást. Nem ismered a kódolást? nem probléma. Függetlenül attól, hogy vásárlói véleményekre, termékadatokra vagy bármilyen más adatra van szüksége, a Mozenda lehetőséget ad a kinyerni kívánt adatelemek gyors kiválasztására.

Ez olyan, mintha egy virtuális asszisztens lenne, aki tisztában van a kaparási követelményekkel. Mozenda azonban nem áll meg itt. Automatizálhatja a lekaparási folyamatot, és bizonyos időközönként adatokat nyerhet ki az ütemezésnek köszönhetően, amely az egyik kifinomultabb képessége.

A Mozenda gondoskodik arról, hogy napi, heti vagy havi frissítésekre van szüksége. Ezenkívül a Mozenda zökkenőmentes adatexportálási lehetőségeket kínál, amelyek lehetővé teszik a kimásolt adatok több fájltípusba történő mentését, beleértve az Excel, CSV vagy XML fájlokat. A visszakeresett adatok könnyen beilleszthetők az elemző programokba vagy adatbázisokba.

A lekapart adatok a Mozenda API-integrációs szolgáltatásának köszönhetően a saját alkalmazásaihoz vagy rendszereihez is csatlakoztathatók és integrálhatók. Hatékony munkafolyamatot kínál, lehetővé téve az eljárások automatizálását és a visszakeresett adatok maximális felhasználását.

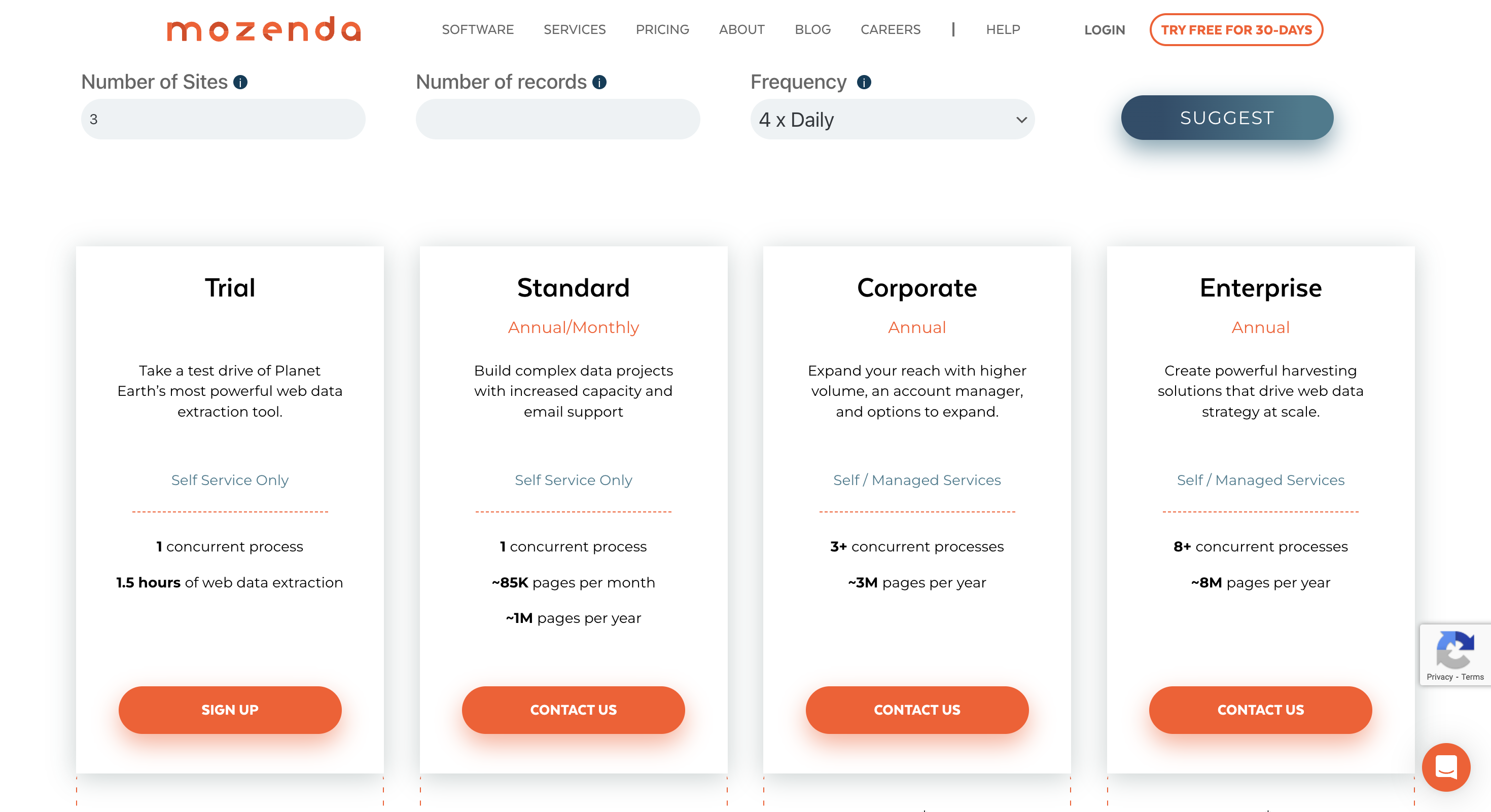

Árazás

Kipróbálhatja a platformot ingyenes próbaverziójával, és forduljon a szállítóhoz a prémium áraiért.

8. Kaparó méh

Sokkal egyszerűbb adatokat gyűjteni a webhelyekről a ScrapingBee segítségével, egy csodálatos böngészőalapú webkaparó alkalmazással. Használja ki a webkaparás erejét a ScrapingBee segítségével, és kerülje el az infrastruktúra kezelésével járó terheket.

Az intuitív API-nak köszönhetően egyszerűen küldhet be lekérdezéseket, és kaphat lekapart adatokat. A ScrapingBee API egyszerűvé teszi bármilyen adat kinyerését, beleértve a termékinformációkat, hírcikkeket és más típusokat.

Ennek ellenére a ScrapingBee tovább megy. Olyan funkciókkal rendelkezik, amelyek túlmutatnak az egyszerű webkaparáson. JavaScript-megjelenítési képességekkel rendelkezik, amelyek segítségével információkat nyerhet ki olyan webhelyekről, amelyek elsősorban JavaScriptre támaszkodnak a tartalom megjelenítéséhez. Ez biztosítja, hogy még a dinamikus weboldalakról is be lehessen lépni és lekérni a teljes tartalmat.

Ezenkívül a ScrapingBee gondoskodik a CAPTCHA-król, megkímélve Önt a bosszantó akadályok leküzdésének időigényes munkájától.

Automatikusan feloldja a CAPTCHA-kat, így Ön a kívánt információk megszerzésére koncentrálhat. Ezenkívül a ScrapingBee IP-rotátorokat is kínál, hogy a kaparási műveleteket privát módon és a webhelyek által feloldottan tartsák. Megváltoztatja az IP-címeket, ami kihívást jelent a webhelyek számára az Ön megfigyelése és hozzáférési korlátozások bevezetése érdekében.

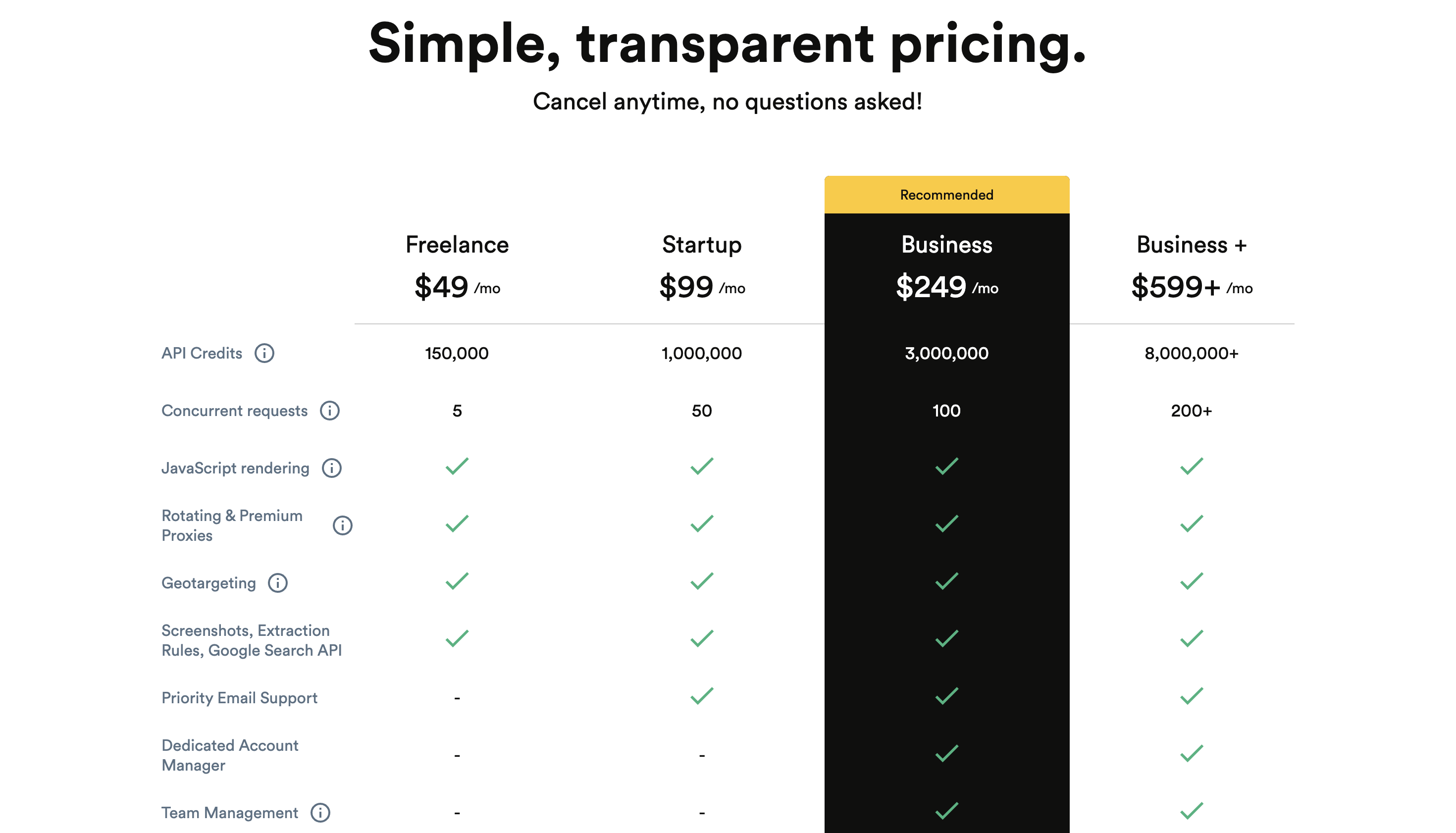

Árazás

A prémium ára 49 USD/hónaptól kezdődik.

9. Apify

Az Apify egy robusztus felhő alapú platform, amely böngészőkben is használható, és webkaparási és automatizálási funkciókkal rendelkezik. Az Apify használatával egyszerűen automatizálhatja az időigényes eljárásokat, és gyorsan kinyerheti az adatokat a webhelyekről, így több ideje marad más fontos munkákra.

Anélkül, hogy bármilyen kódra lenne szükség, kifinomult kaparási helyzetek gyorsan létrehozhatók az Apify vizuális szerkesztőjével. A webhely használata egyszerű, és egy fogd-és-vidd felülettel rendelkezik, amely egyszerűvé teszi a lekaparni kívánt adatok kiválasztását.

Az Apify architektúráján a lekaparási munkákat ezután szerver nélküli szolgáltatásként lehet beállítani és végrehajtani. Az infrastruktúra és a szerver karbantartása többé nem lesz gondja.

Az Apify mindenről gondoskodik. De mi van akkor, ha nem vagy különösebben jártas a kaparásban? Kétségtelenül nincs gond. Az Apify piacterén megvásárolhatók az előre beépített kaparó szereplők, amelyek lényegében konfigurált és használatra kész kaparási folyamatok.

Számos webhelyhez és használati esethez, mint pl közösségi hálózati platformok és az e-kereskedelmi oldalakon a piac több száz szereplőt kínál. Ennek eredményeként kihasználhatja a használatra kész megoldásokat, amelyek időt és erőfeszítést takarítanak meg.

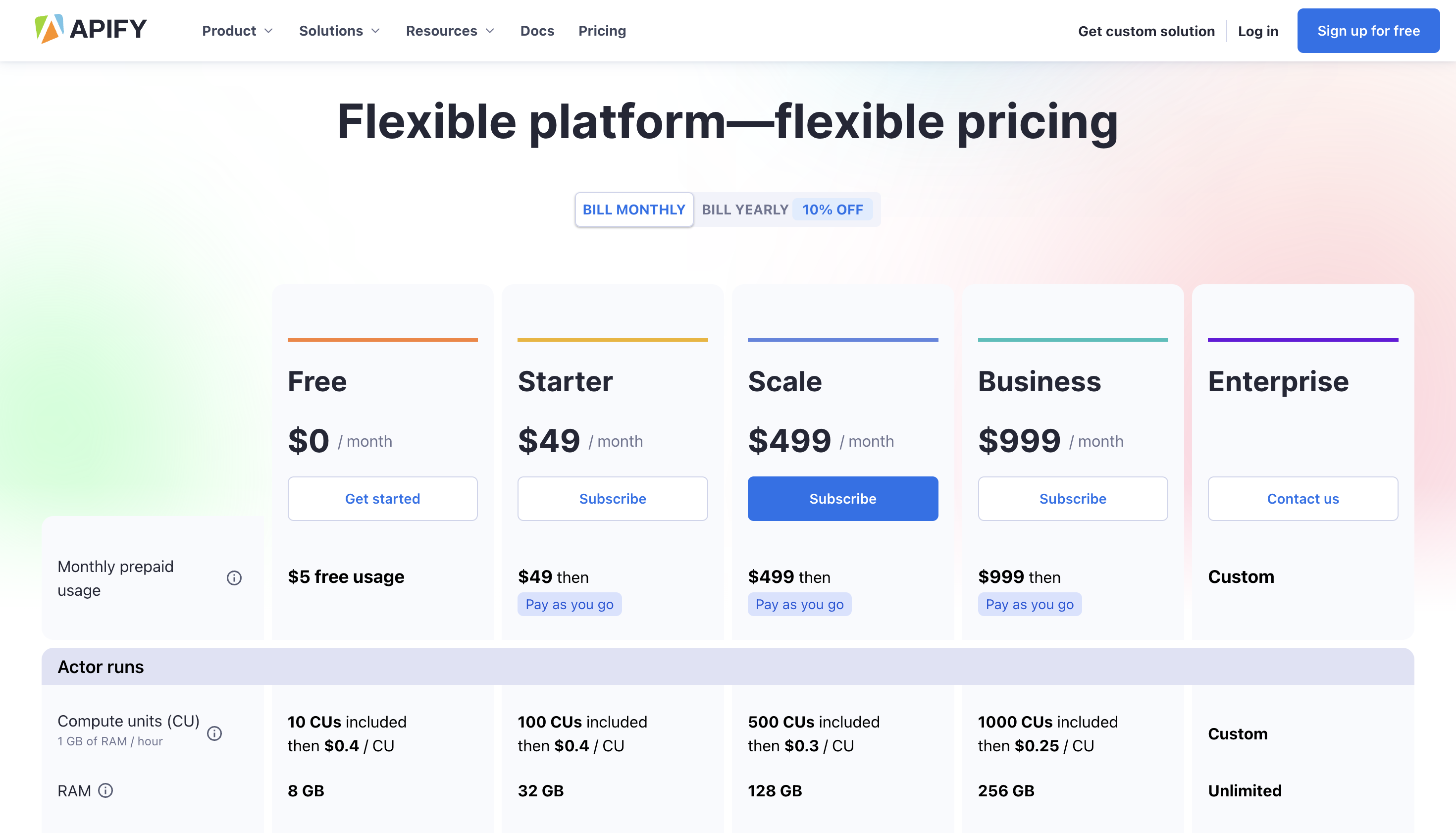

Árazás

Ingyenesen elkezdheti használni, és a prémium ára 49 USD/hónaptól kezdődik.

10. ScrapingDog

A Scrapingdog egy hatékony böngészőalapú webkaparó szoftver. Bonyolult kód vagy infrastruktúra-beállítás nélkül gyorsan és hatékonyan gyűjthet adatokat a webhelyekről a Scrapingdog segítségével. Olyan, mintha egy erős kaparó állna a rendelkezésére.

A Scrapingdog legfontosabb funkciói, amelyek egyszerűvé teszik a webkaparást, megkülönböztetik a versenytársaktól. Az első előny az, hogy felhasználóbarát felületet biztosít, amely megkönnyíti a webhelyek böngészését és a kivonatolni kívánt adatok kiválasztását.

Bármilyen információra van szüksége – termékinformációkat, híreket vagy bármi mást –, a Scrapingdog mindent megtalál. Másodszor, a Scrapingdog okos JavaScript-megjelenítést kínál, lehetővé téve az információk lekaparását olyan webhelyekről, amelyek elsősorban JavaScriptre támaszkodnak a tartalom megjelenítéséhez.

Ez biztosítja, hogy még a dinamikus weboldalakról is elérhesse és visszakereshesse a teljes tartalmat. Ezenkívül a Scrapingdog kezeli a CAPTCHA-kat, és gondoskodik a bosszantó akadályokról.

Automatikusan válaszol a CAPTCHA-ra, így időt és energiát takarít meg. Ezenkívül a Scrapingdog IP-rotációt használ, ami az IP-címek megváltoztatását jelenti, hogy elkerülje a webhelyek blokkolását a lekaparási műveletek során. Következésképpen a kaparás simán megy.

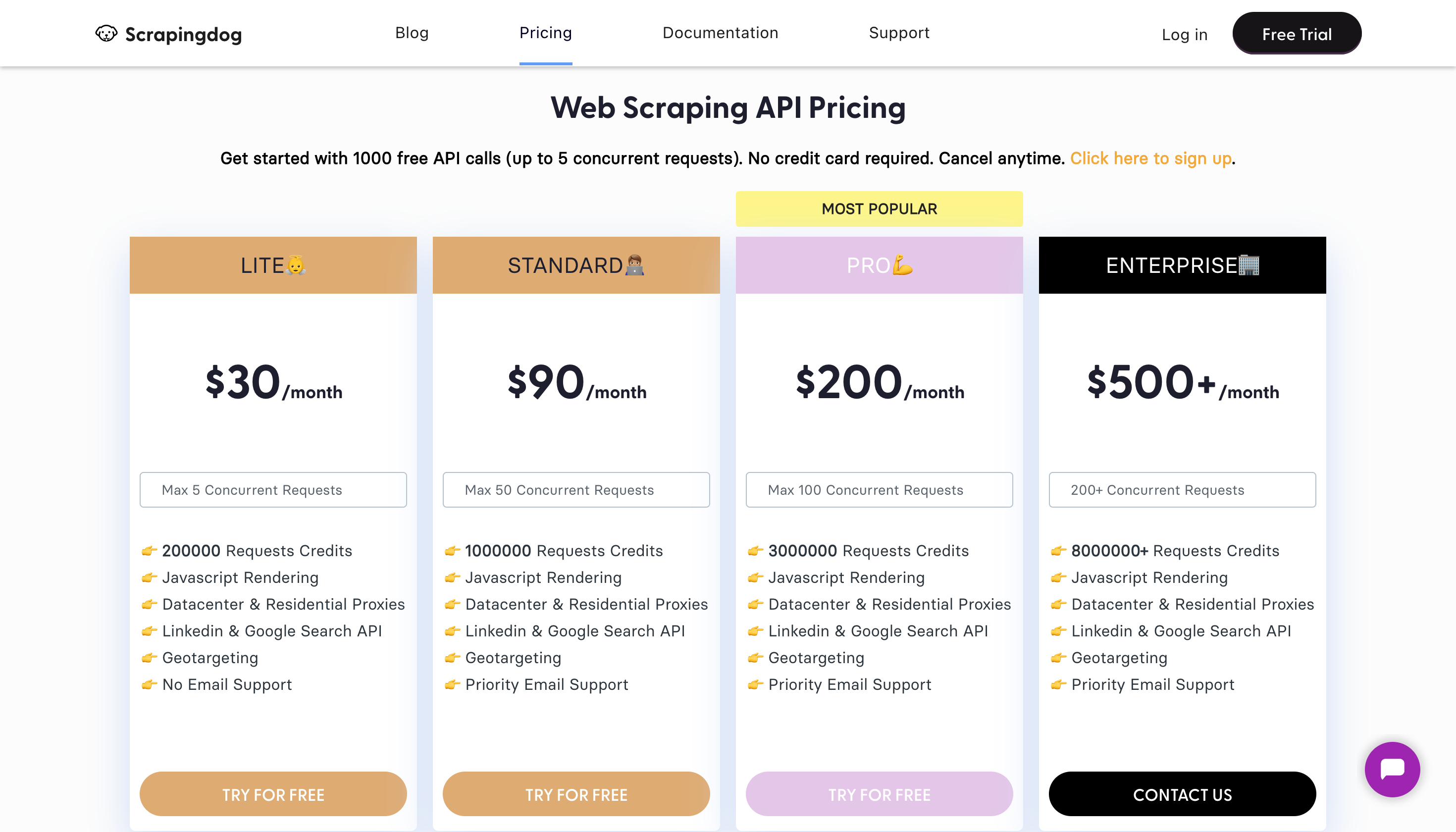

Árazás

A prémium ára 30 USD/hónaptól kezdődik.

11. Byteline

A Byteline egy kiváló böngészőalapú eszköz, amelyet kizárólag webkaparáshoz hoztak létre. Hosszadalmas szkriptelés vagy bonyolult beállítás nélkül gyorsan és egyszerűen lekérheti az adatokat a webhelyekről a Byteline segítségével.

Felhasználóbarát felületet biztosít, amely megkönnyíti a webhelyek bejárását és a lekaparni kívánt adatok kiválasztását. A Byteline segíthet bármilyen adat megszerzésében, beleértve az árakat, az ügyfelek ajánlásait és egyéb információkat.

A dinamikus weboldalak könnyen kezelhetők vele. Adatokat nyerhet ki olyan webhelyekről, amelyek nagyrészt dinamikus tartalomra támaszkodnak, mivel kifinomult megközelítések segítségével kezelik a JavaScript-megjelenítést. Ez azt jelenti, hogy elérheti és lekaparhatja a legfrissebb elérhető adatokat.

Ezenkívül a Byteline hatékony proxy- és IP-rotációs funkciókkal rendelkezik, amelyek lehetővé teszik, hogy széles körben kaparjon anélkül, hogy bármilyen szűrővel ütközne. Gondoskodik arról, hogy a kaparási műveletei akadálytalanul és teljes névtelenségben folytatódjanak. Ezenkívül a Byteline adatexportálási lehetőségeket is biztosít, amelyek lehetővé teszik a visszakeresett adatok más formátumokba, például CSV- vagy Excel-formátumba történő mentését további elemzés vagy rendszerintegráció céljából.

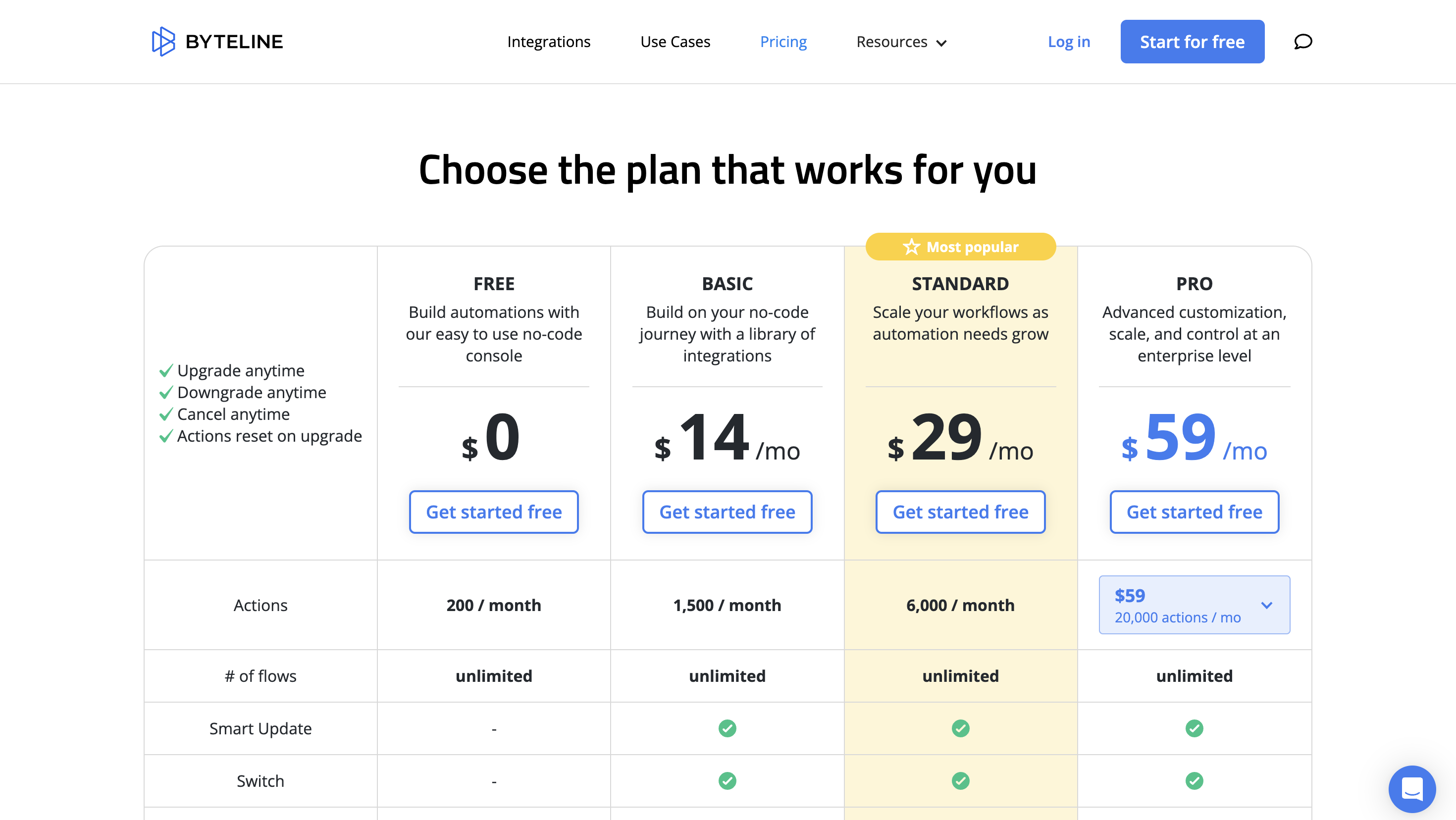

Árazás

Ingyenesen elkezdheti használni, és a prémium ára 14 USD/hónaptól kezdődik.

12. Grepsr

A Grepsr egy figyelemre méltó webkaparó szoftver, amely böngészőben fut. A Grepsr hasznos eszköz mind a vállalatok, mind a kutatók számára, mivel lehetővé teszi az adatok hatékony és egyszerű kinyerését a webhelyekről.

A Grepsr használata során nem kell aggódnia a bonyolult kódok vagy infrastruktúra-beállítások miatt. Felhőalapú kialakításának köszönhetően bárhonnan elérheti és kezelheti kaparási projektjeit internetkapcsolattal.

Kifinomult online lekaparási technológiákat használ, mint például az okos adatfelismerő és -elemző algoritmusok, hogy garantálják a pontos és megbízható adatkinyerést. A Grepsr ütemezési képességekkel is rendelkezik, amelyek lehetővé teszik a lekaparási eljárás automatizálását és a frissített adatok előre meghatározott időközönkénti lekérését.

Ezenkívül számos adatexportálási formátum, például CSV, Excel, JSON és XML támogatott, lehetővé téve a szabad munkavégzést az adatokkal a választott formátumban.

Még a legdinamikusabb webhelyekről is lekaparhatja az adatokat, mivel bonyolult weboldalak kezelésére készült, beleértve a JavaScript-alapú tartalommegjelenítést is.

Árazás

Az árakkal kapcsolatban kérjük, vegye fel a kapcsolatot az eladóval.

13. ProWebScraper

A ProWebScraper egy felhasználóbarát böngészőalapú webkaparási technológia, amely lehetővé teszi a felhasználók számára, hogy gyorsan és egyszerűen kinyerhessenek adatokat a webhelyekről. A felhasználók a point-and-click felület segítségével kinyerhetik ki az adatokat anélkül, hogy kódot kellene írniuk.

Ezenkívül a platform intelligens adatkinyerő eszközzel rendelkezik, amely képes felismerni és kinyerni az adatokat bonyolult webhelyekről. A ProWebScraper testre szabott kaparókat is kínál olyan webhelyek számára, amelyek kifinomult adatkinyerést igényelnek. A bejelentkezést igénylő webhelyekről történő adatkinyerés a ProWebScraper erőssége.

A bejelentkezési adatok megadása után az egyének minden olyan oldalról lekaparhatják az adatokat, amelyekhez hozzáférnek a platform használatával. A ProWebScraper lehetőséget ad a lehúzások tervezésére és automatizálására, valamint számos exportálási lehetőségre, beleértve a CSV, Excel és JSON formátumokat.

A ProWebScraper webrobotot használ a webhelyekről származó információk kaparására. A bejáró több oldalon navigálhat, és összetett webhelyeket is tud kezelni. A ProWebScraper további támogatást nyújt proxy szerverek, amely lehetővé teszi a felhasználók számára, hogy rejtett adatokat gyűjtsenek össze, és megkerüljék az IP-korlátozásokat. A szoftver emellett automatikus adatellenőrzést is kínál a kinyert adatok pontosságának biztosítása érdekében.

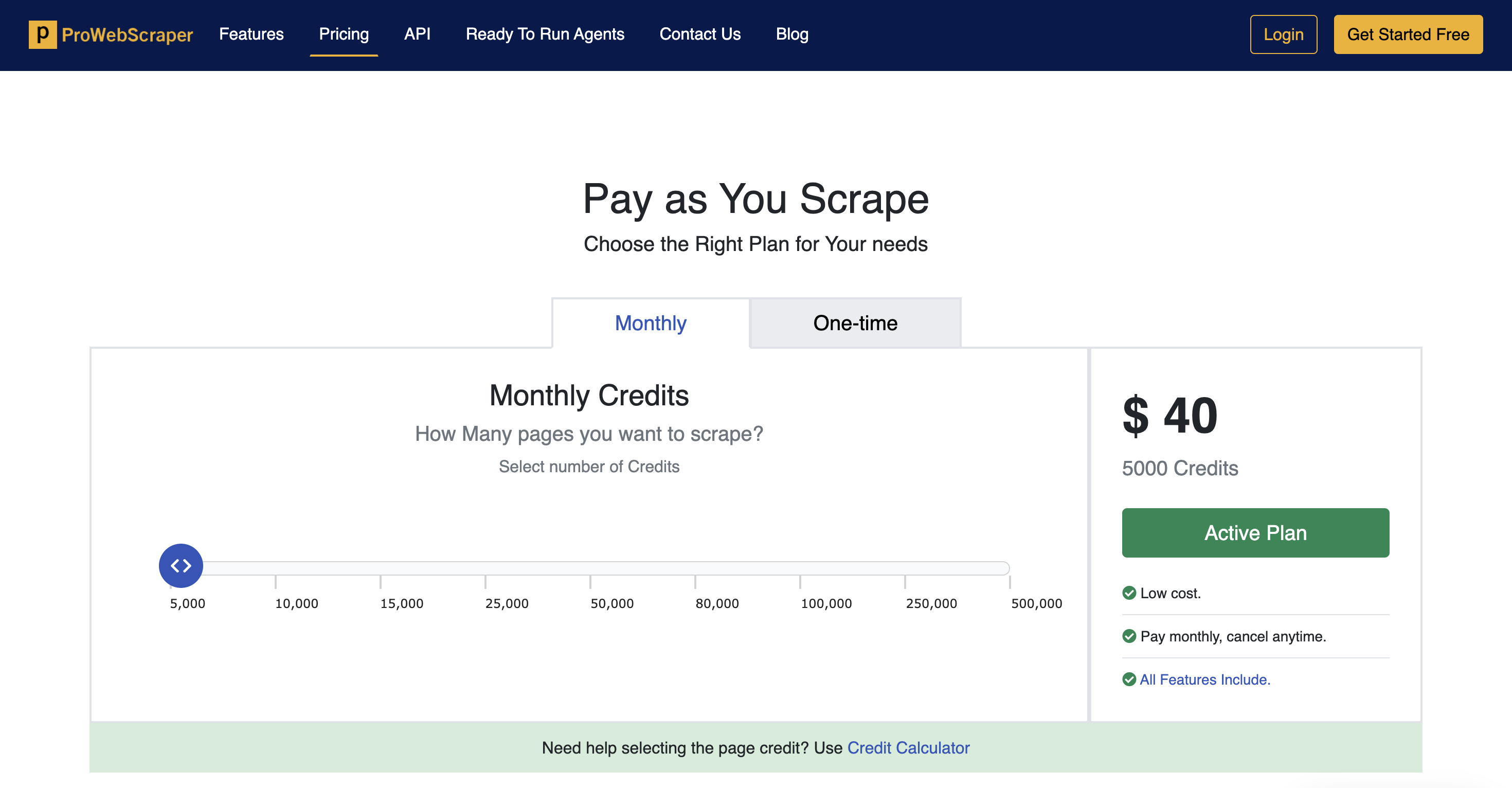

Árazás

Elkezdheti használni ingyenesen, és a prémium ára 40 dollártól kezdődik 5000 kreditért.

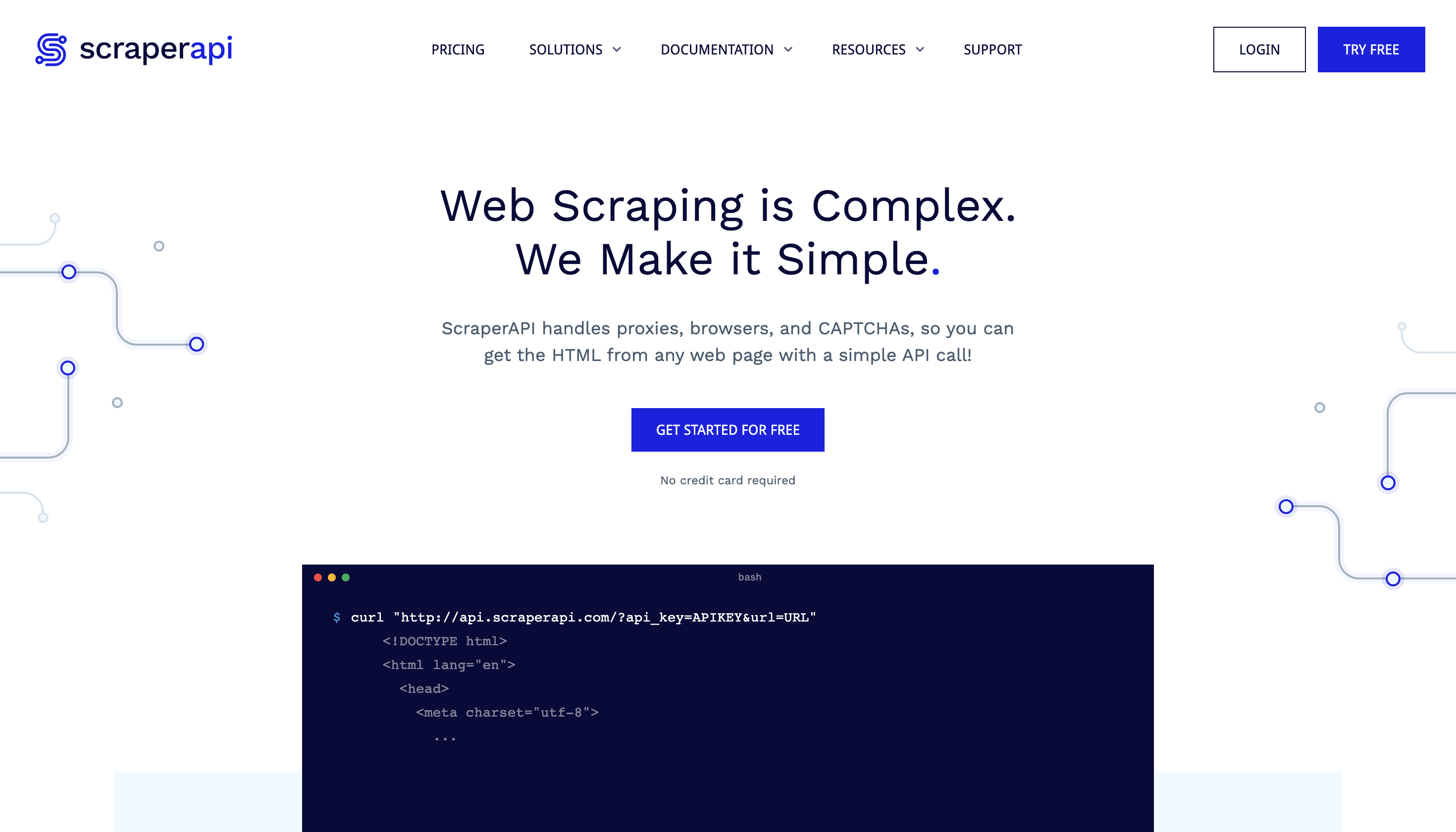

14. Scraping API

A Scraping API platform egy fantasztikus böngésző alapú megoldás, amelyet kifejezetten a webkaparási igényekre terveztek. Gyorsan és egyszerűen kinyerhet adatokat a webhelyekről a Scraping API-val a felhasználóbarát felhasználói felületnek köszönhetően.

A Scraping API gondoskodik arról, hogy Ön kezdő vagy szakértő webkaparó. A kortárs webböngészőmotorok segítségével fej nélküli böngésző technikát használ weboldalak renderelésére, JavaScript futtatására és a szükséges adatok lekérésére. Ennek eredményeként még bonyolult, változó anyagú weboldalakon is garantált a pontos és megbízható kaparási eredmény.

Ezenkívül használhatja kedvenc kódolási készségeit a Scraping API-val, mivel számos programozási nyelvet támogat, például a Python-t, a JavaScriptet és a PHP-t.

A webhelyeket pontosan úgy fedezheti fel és kommunikálhat velük, mint egy valódi felhasználó, köszönhetően robusztus képességeinek, beleértve az oldalszámkezelést, az űrlapok beküldését és a munkamenet-kezelést. Ezenkívül a Scraping API zökkenőmentes proxy rotációt kínál, amely lehetővé teszi a weboldalak nagyarányú lekaparását, miközben eltakarja IP-címét, és elkerüli a tiltásokat.

A pontos adatkinyerés garantálása érdekében a platform erős hibakezelési és újrapróbálkozási lehetőségeket is kínál. A kaparó API használatával könnyedén beépíthet adatokat számos formában, például HTML-, JSON- és XML-formátumban, alkalmazásaiba vagy adatbázisaiba.

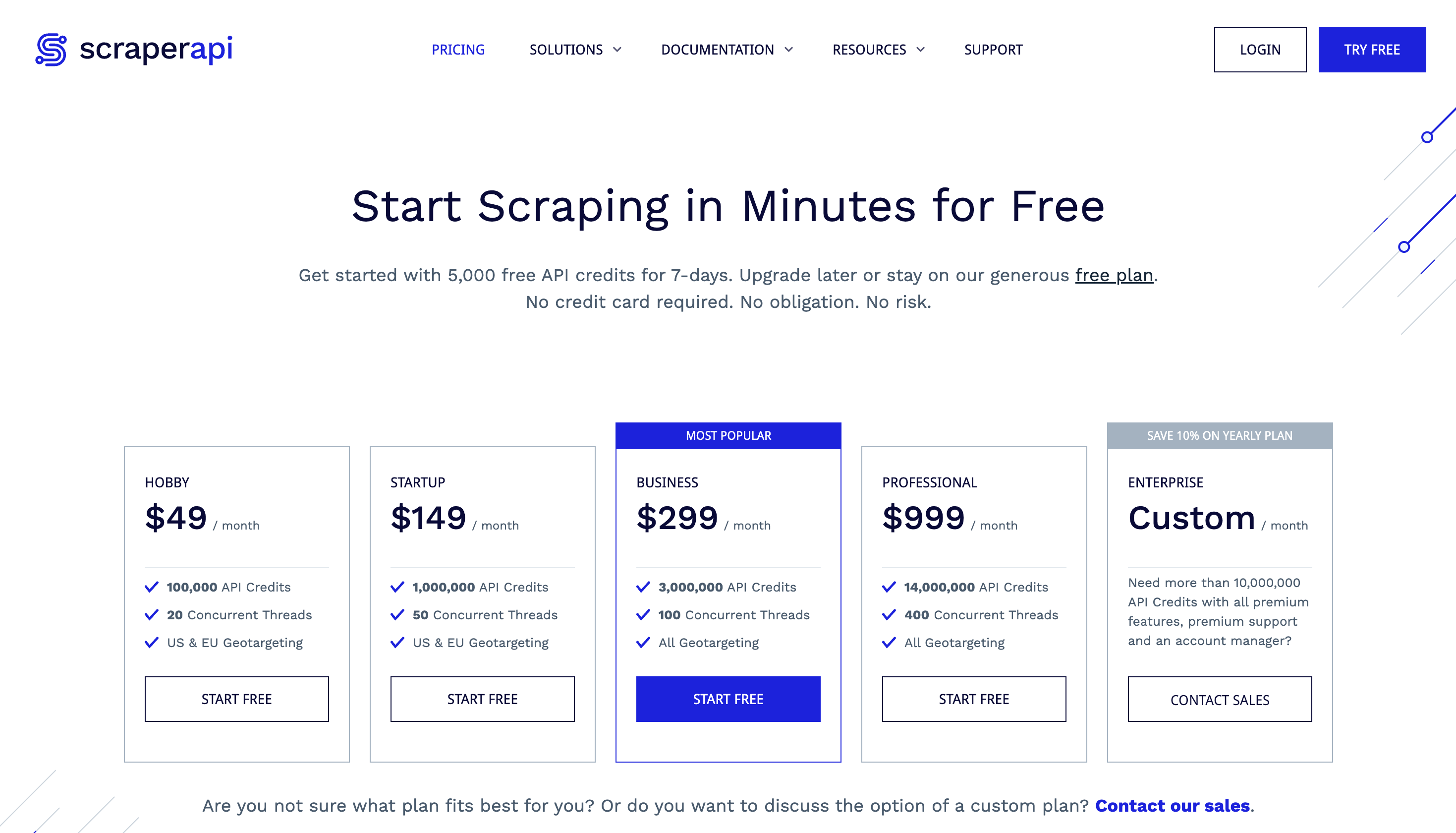

Árazás

A prémium ára 49 USD/hónaptól kezdődik.

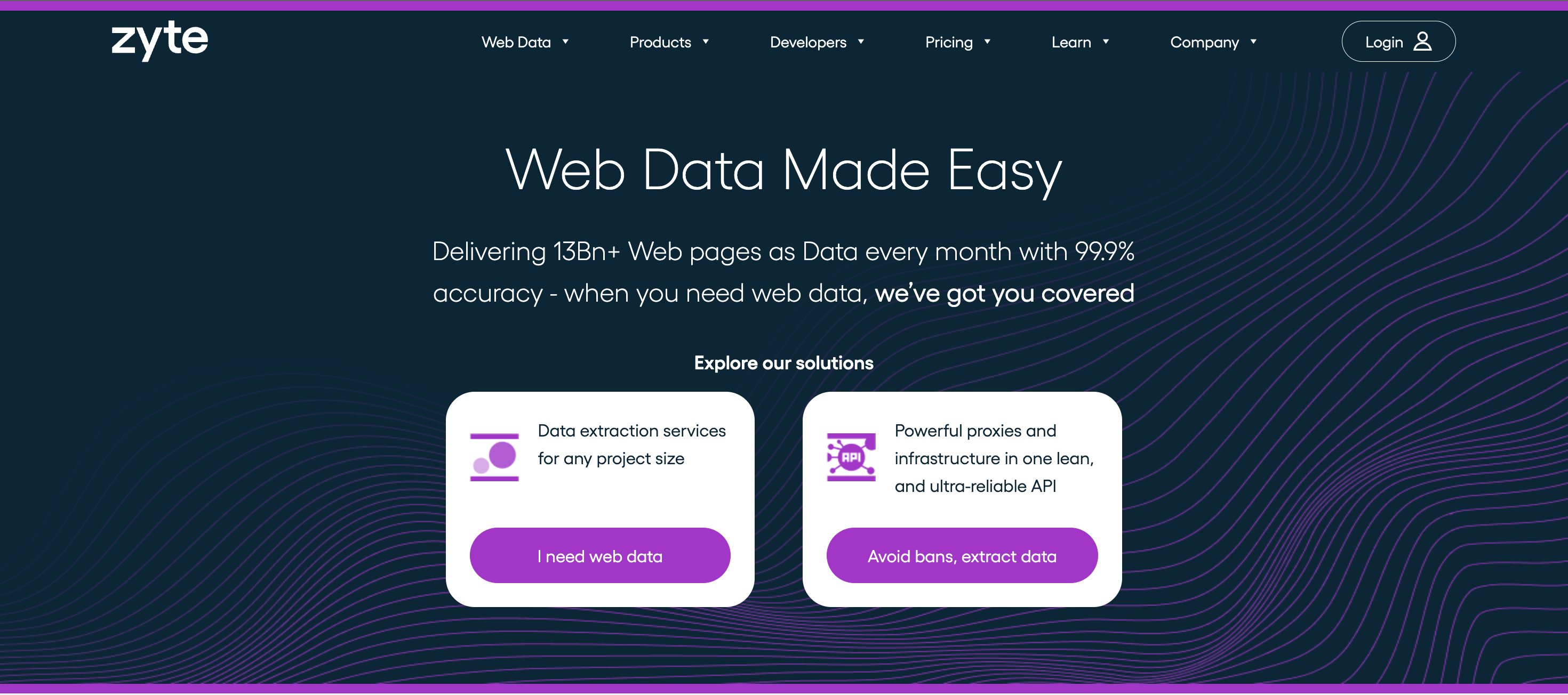

15. Zyte

A Zyte egy böngészőalapú platform, amelyet kizárólag webkaparásra terveztek. A felhasználók gyorsan bejárhatják a webhelyeket, és hasznos adatokat nyerhetnek le a felhasználóbarát felületnek köszönhetően, amely szükségtelenné teszi a bonyolult kódolást vagy az infrastruktúra beállítását.

A platform fej nélküli böngészőstratégiát alkalmaz, és a jelenlegi webböngészőmotorokat használja weboldalak megjelenítésére, JavaScript futtatására és adatok dinamikus tartalomból való kinyerésére. Ez precíz és alapos lekaparási eredményeket biztosít, még bonyolult webhelyekről is.

Ezenkívül a Zyte számos lehetőséget kínál, például kifinomult adatellenőrzést, intelligens adatkinyerést és erős hibakezelési módszereket a lekaparási folyamat javítására.

Ezenkívül a Zyte számos kódnyelvet támogat, beleértve a Pythont, a JavaScriptet és a Rubyt, így a felhasználók kihasználhatják kedvenc programozási készségeiket.

Nem kell kiszolgálókat kezelnie, és nem kell aggódnia a skálázhatóság miatt a Zyte segítségével, mert könnyedén kezelheti és bővítheti a kaparási projektjeit a felhő infrastruktúrájuk segítségével.

Ezenkívül a Zyte beépített proxykezeléssel rendelkezik, amely lehetővé teszi a felhasználók számára, hogy kéréseiket különféle proxykon keresztül irányítsák az anonimitás megőrzése és az IP-tiltások elkerülése érdekében. Ezenkívül zökkenőmentes interakciót biztosít számos adattárolási formátummal és rendszerrel, beleértve az adatbázisokat és az API-kat, így egyszerűvé teszi az összegyűjtött adatok tárolását és kezelését.

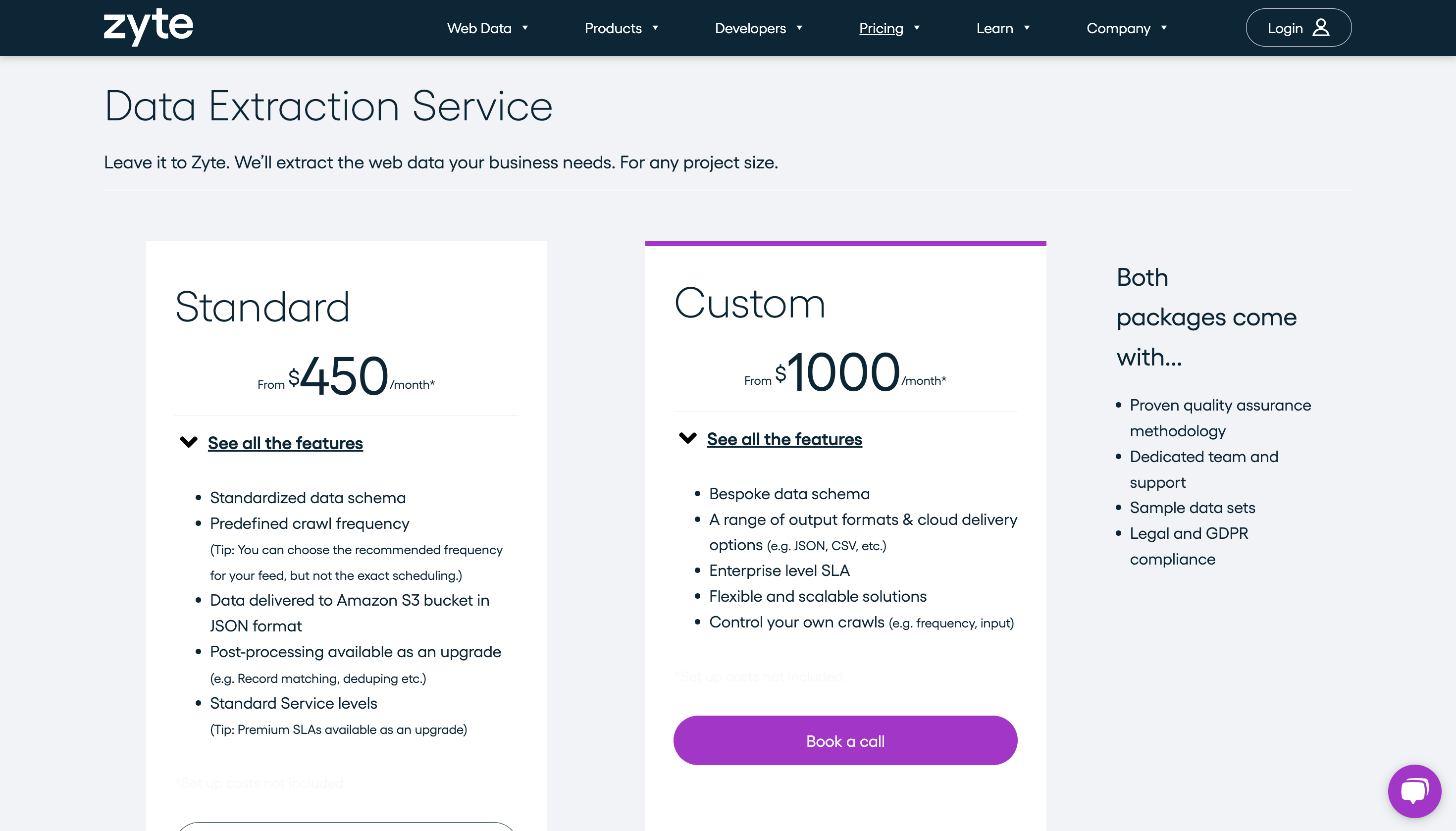

Árazás

A prémium ára 450 USD/hónaptól kezdődik.

Következtetés

Összefoglalva, az online adattárolásban rejlő lehetőségek felszabadítása és az adatvezérelt betekintések előállítása az egyedi igényeknek megfelelő, megfelelő webkaparási platform kiválasztásától függ. Mivel rengeteg alternatíva áll rendelkezésre, kulcsfontosságú olyan szempontok figyelembe vétele, mint a használhatóság, az adatkinyerési képesség, az API-integráció és még sok más.

A Bright Data egy olyan platform, amely kiemelkedik erős proxyhálózatával, intuitív felhasználói felületével és csúcstechnológiás képességeivel, beleértve az automatikus adatkinyerést, az adatérvényesítést és a blokkolás elleni módszereket. A vállalkozások könnyedén hozzáférhetnek hatalmas mennyiségű online adathoz a Bright Data használatával, és ezzel versenyelőnyt szerezhetnek piacaikon.

Ezért feltétlenül nézze meg a Bright Data szolgáltatást, és fedezze fel, hogyan segítheti az adatokkal kapcsolatos céljait elérni, ha teljes és megbízható webkaparási megoldást keres.

Hagy egy Válaszol