AI tute ŝanĝis nian medion, kaj grava kontribuanto al ĉi tiu ŝanĝo estas la malfermfonta komunumo.

Imagu socion en kiu inventoj estas libere interŝanĝitaj, ideoj estas permesitaj flui, kaj enirobstakloj estas esence neekzistantaj.

Ĉi tie troviĝas malfermfonta AI.

Programistoj, akademiuloj kaj entuziasmuloj laboras kune en ĉi tiu dinamika ekosistemo por krei teknologiojn, kiuj transformas nian estontecon. Esploru ĉi tiun ekscitan universon kie artefarita inteligento estas kunlabora penado de multaj prefere ol la ekskluziva domajno de elektitaj malmultaj.

La evoluo de AI estis nenio malpli ol rimarkinda. Artefarita Inteligenteco iris longan vojon de siaj fruaj fazoj en la mezo de la 20-a jarcento ĝis sia nuna starado kiel kolono de teknologio.

Ĉi tiu progreso estis plejparte pelita de la malfermfonta komunumo.

Projektoj kiel TensorFlow de Google estas bonega ekzemplo de tio. Pli ol simple ilo, TensorFlow estas katalizilo, kiu ebligis plurajn AI-iniciatojn, akcelante esploradon kaj pavimante la vojon por novigoj.

Ĝia influo povas esti observita en diversaj aplikoj, kiel ekzemple prognozaj analizoj kaj lingvoprilaborado.

Do, kio ĝuste estas AI, kiu estas malfermfonta?

AI faris ĝin alirebla por ĉiuj. AI-teknologioj povas esti uzataj, ŝanĝitaj kaj dividitaj de ĉiuj danke al malfermfontaj platformoj. Ĉi tiuj platformoj kreis viglajn centrojn de AI-novigado el retejoj kiel GitHub.

Ĉio disponeblas ĉi tie, libere dividita, de bazaj AI-modeloj ĝis komplikaj algoritmoj. Ĉi tiu strategio antaŭenigas teamlaboron, stimulas kreivon kaj malfermas AI al pli granda publiko.

La avantaĝoj de uzado de malfermfonta AI estas grandaj. Precipe noventreprenoj havas multon por gajni. Konsideru malgrandan teknologian kompanion kun multaj ideoj sed neniu financado.

Ili povas krei kompleksajn solvojn sen rompi la bankon danke al malfermfonta AI. Modifante AI-teknologiojn por plenumi siajn proprajn postulojn, ili povas akceli esploradon kaj kreadon de produktoj.

Ĉi tiu fleksebleco kaj kostefikeco estas grandaj avantaĝoj por novaj entreprenoj. Tial ni kompilis la plej bonajn malfermfontajn ilojn kaj platformojn en ĉi tiu afiŝo por ke vi povu konstrui ion mirindan.

1. Substrato

Substratus estas revolucia malfermfonta platformo, kiu transformas la maŝinlernadmodelan disvolviĝon kaj trejnadon.

Integrante laŭmendajn rimedojn kiel Modelo, Servilo, Datumaro kaj Kajero en la Kubernetes API, ĉi tiu platformo unike etendas la kapablojn de la Kubernetes-kontrolaviadilo kaj regas la tutan vivdaŭron de modeloj pri maŝinlernado.

La Model-rimedo, kiu kombinas fontkodon kun pezoj kaj biasoj por konstrui maŝinlernantan modelkazaĵon, estas la centra komponento de Substratus.

Ĉi tiu modelo ofertas ĉiuflankecon kaj simplecon en modelkonstruo ĉar ĝi povas esti derivita de Git-deponejo aŭ konstruita uzante ekzistantan modelon kaj trejna datumaro.

Plie, Substratus venas kun la Servila rimedo, kiu simpligas la procezon transformi viajn AI-modelojn en funkciajn kaj uzeblajn rimedojn elmontrante modelon per HTTP-API por inferenco.

Alia esenca elemento, kiu faciligas importadon kaj transformon de datumoj, estas la rimedo de Dataset.

Ĝi direktas uzantojn al la fontkodo por importi datumojn, kiujn Substratus kuras kaj kontenerigas por certigi efikan datumtraktadon.

La Notebook-rimedo, kiu estas a Kajero Jupyter ekzemplo funkcianta per alt-efikecaj komputilaj rimedoj ene de Kubernetes-areto, estas revolucia por programistoj.

Ĉi tio ebligas krei maŝinlernan fontkodon sur fidinda aparataro uzebla eĉ sur malgrandaj lokaj komputiloj. Estas pluraj avantaĝoj inkluzivi Substratus en via procezo.

Vi povas trejni kaj servi maŝinlernajn modelojn sur ĝi en diversaj nubaj agordoj ĉar ĝi estas transnuba substrato.

Substratus postulas neniun kodigon kaj disponigas enkonstruitajn optimumigojn, faciligante deploji kaj fajnagordi malfermfontajn grandajn lingvomodelojn (LLM). Jupyter-kajeroj povas esti lanĉitaj malproksime per nur unu komando, rezultigante glatan disvolvan procezon.

Ĉefe, Substratus funkcias en ĉiu medio, kie Kubernetes instalas kun malgrandaj postuloj, kaj protektas viajn datumojn ene de via reto.

Ĝia nul-skala aliro optimumigas GPU-kostojn kaj uzas ujojn por krei scenarojn ripeteblajn. Aldone, GitOps estas uzata denaske, plibonigante funkcian efikecon.

2. AbanteAI (Mentato)

Mentat de AbanteAI markas signifan progreson en helpo pri kodigado de AI, uzante la kompleksajn kapablojn de GPT-4 por revolucii kiel kodo estas produktita kaj pritraktata.

Imagu provizi Mentat per la komandoj, kiujn vi bezonas de la komandlinio, kaj poste rigardi kiel ĝi generas kodon en novaj aŭ ekzistantaj fontdosieroj facile.

Vi povas simpligi vian disvolvan procezon forigante la tempopostulan kopi-algluadon inter via IDE kaj Babilado GPT retumila fenestro danke al ĉi tiu glata komandlinia interfaco.

Preter kion iloj kiel la enliniaj rekomendoj de Copilot povas fari, Mentat estas farita por skribi kodon por vi. Mentat ĝustigas al viaj postuloj, helpante en ambaŭ situacioj, ĉu vi laboras kun antaŭekzistanta kodo aŭ komencante freŝan taskon.

Ĉi tiu kapablo reprezentas gravan progreson en AI-helpita kodigo ĉar ĝi generas utilan, ageblan kodon prefere ol nur fari rekomendojn.

Kiam programistoj uzas Mentat, ilia produktiveco pliiĝas ĉar ili povas koncentriĝi pri pli komplika kaj krea laboro lasante la tedan kaj ripeteman kodigon al la programo.

La adaptebleco de Mentat estas montrita en sia amplekso de aplikoj kiuj traktas multajn elementojn de kodigo, kiel ekzemple kreado de unua skizo por novaj projektoj, solvi problemojn kaj rapide alĝustigi al nova kodbazo.

La kampo de AI-helpita kodigo havas multon da promesplenaj evoluoj antaŭ ĝi. Programistoj nun povas dependi de AI por fari taskojn kiel kodrecenzojn, cimojn kaj sintaksajn korektojn.

Ĉi tio inkluzivas platformojn kiel Mentat. Kvankam teknologio verŝajne tute ne anstataŭigos programistojn, AI ludas pli kaj pli grandan rolon en programado kaj pretas iĝi helpema aliancano.

La koda procezo povus esti redifinita kiel rezulto de ĉi tiu partnereco inter homa inteligenteco kaj la efikeco de AI, farante ĝin malpli inklina al eraro kaj pli efika.

3. ChatDev

ChatDev estas revolucia tekniko por programaro, kiu utiligas Grandajn Lingvomodelojn (LLM) por plibonigi kaj akceli la programaran disvolvan procezon.

Ĉi tiu nova kadro, bazita sur naturlingva komunikado, celas forigi la neceson de specifaj modeloj en diversaj stadioj de programaro, tial revoluciante la industrion.

La programaro-evoluociklo estas dividita en kvar ĉefajn stadiojn de ChatDev, kiu uzas fakorganizitan akvofalan modelon: dezajnado, kodigado, testado kaj dokumentado.

ChatDev dividas tiujn fazojn en diskretajn subtaskojn asignante virtualajn agentojn, kiel ekzemple testistoj kaj programistoj, al ĉiu stadio.

Ĉi tiuj agentoj laboras kune per konversacioj. Taska rezolucio fariĝas efika per ĉi tiu konversacia ĉena metodo, kiu faciligas sugestojn kaj solvan validigon.

La kapablo de ChatDev trakti kodalucinojn - kiel ekzemple nerimarkitajn difektojn aŭ mankantajn dependecojn - kiuj estas oftaj en LLM-oj, estas unu el ĝiaj ĉefaj avantaĝoj.

Modernaj programoj povas esti faritaj per la kadro de ChatDev, kiu ankaŭ helpas redukti ĉi tiujn eblajn riskojn. La dezajno de la platformo baziĝas sur babilĉeno, kiu faciligas tasko-orientitan rolludon kaj efikan komunikadon inter virtualaj agentoj.

Ĉi tio kondukas al malferma kaj kunlabora evoluprocezo kie finuzantoj povas aktive okupiĝi pri la decida procezo kaj taskoj estas kompletigitaj per mult-turnaj, kuntekst-konsciaj konversacioj.

Dum la dezajnstadio, ChatDev uzas personecigitajn mesaĝojn kaj instigojn por asigni siajn agentajn poziciojn kiel CEO, CPO kaj CTO, surbaze de la komenca koncepto provizita de la kliento.

Ĉi tiu fazo inkluzivas sistemojn kiel Memory Stream, Self-Reflection kaj Task Assignment, kiuj certigas, ke ĉiu agento plenumas sian taskon laŭ siaj kapabloj.

Kodgenerado kaj GUI-evoluo estas dividitaj en pli malgrandajn respondecojn dum la koda fazo, kiu inkluzivas postenojn kiel CTO, programisto kaj artdizajnisto.

Uzante objektorientitan programlingvoj, la kadro traktas kodgeneradproblemojn lanĉante "pensinstrukciaĵon" metodon kiu estas inspirita per ĉeno-de-pensprogramoj.

Specife celante problemojn pri solvo de ideoj, ĉi tiu tekniko garantias ĝustan kaj trafan kreadon de kodo.

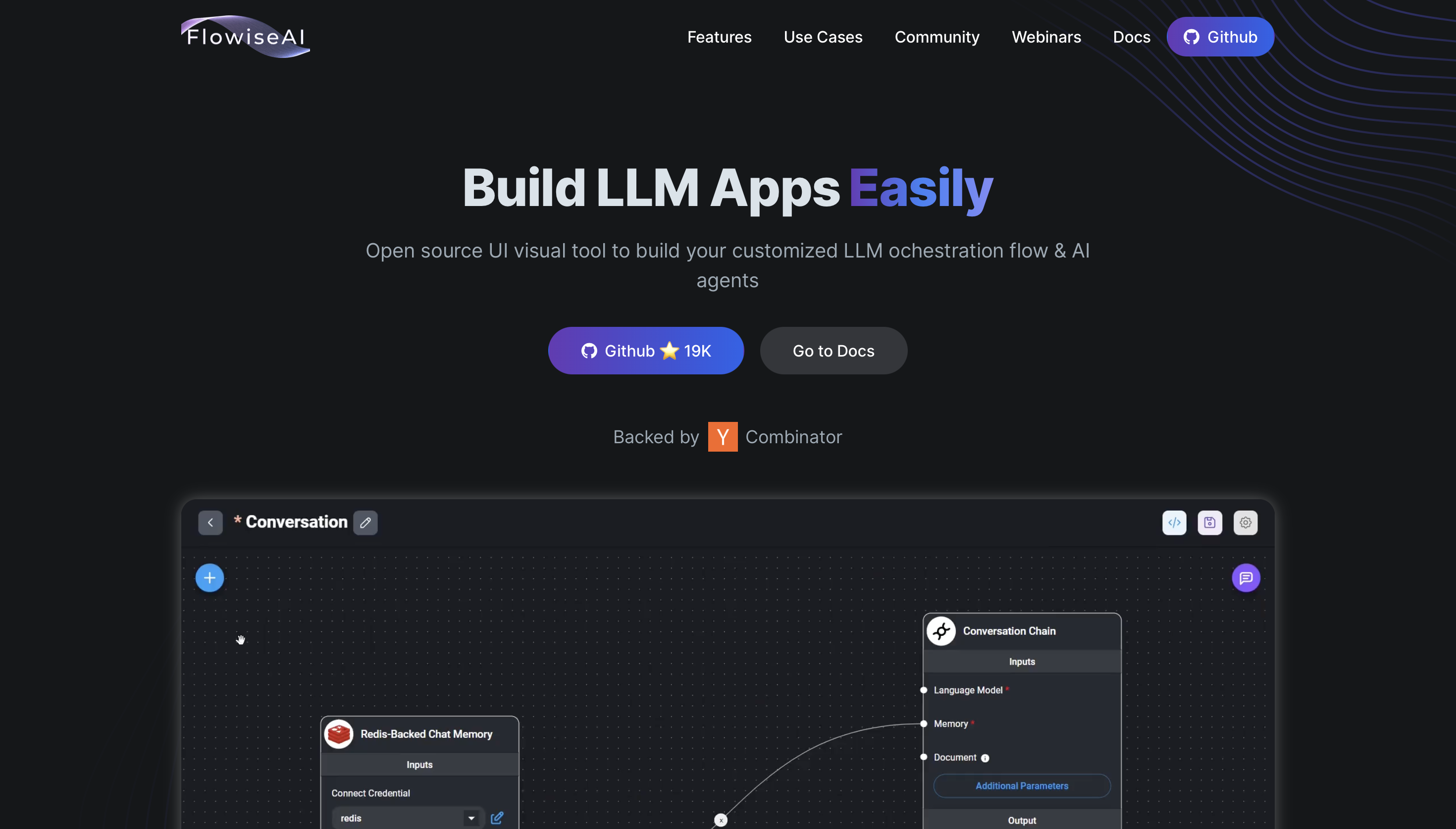

4. Flowise AI

Flowise AI estas revolucia ilo en la kampo de AI-movita programaro, distingita per sia tren-kaj-faligi funkcio kiu postulas malmulte aŭ neniun kodigon.

Ĉi tiu nova metodo faciligas disvolviĝon kaj bildigon de aplikaĵoj de Granda Lingvo-Modelo (LLM), precipe por homoj sen multe da sperto pri kodado.

Flowise AI elstaras je evoluigado de LLM-aplikoj, simpligante la komplikan proceduron en pli alireblan renkonton. La kapablo de Flowise AI fari interreta skrapado kaj demandoj-respondaj taskoj pli facilaj estas unu el ĝiaj ĉefaj trajtoj.

Ekzemple, Flowise AI povas trakti la taskon skrapi ĉiujn rilatajn ligilojn de via retejo kaj havi LLM respondi al demandoj bazitaj sur la enhavo de via retejo.

La platformo konektas kun vektoraj datumbazoj kiel Pinecone por stoki kaj reakiri datumojn, kaj ĝi utiligas la Cheerio Web Scraper-nodon por ligo-skrapado.

Ĉi tio ebligas, ke datumoj estu perfekte ŝargitaj de retejo en datumbazon, kaj LLM povas uzi ĉi tiun datumbazon por respondi al uzantdemandoj.

Krome, Flowise AI estas farita por difini sistemajn mesaĝojn por malsamaj uzscenaroj, kiel la QA-Ĉeno por Konversacia Rehavigo.

Ĉi tiu funkcio estas esenca por garantii ke la AI respondas en certa lingvo kaj en maniero kiu evitas halucinojn, kiuj estas ofta problemo en AI-interagoj.

La fidindeco kaj precizeco de AI-interagoj estas plibonigitaj de Flowise AI per agordo de agordoj kiel la nomo de la AI, la lingvo de respondo kaj apartaj respondoj en la okazo ke neniu respondo estas akirita.

Disvolvi unikajn ilojn por komenci rethok-operaciojn estas plia interesa uzkazo. Flowise AI ebligas la disvolviĝon de iloj kiuj povas kontakti rethook finpunktojn kaj disponigi la postulatajn parametrojn en la korpo de la rethook.

Eblas vastigi ĉi tiun funkcion al aliaj platformoj kiel Gmail kaj Google Sheets kaj kombini ĝin kun diversaj aplikoj, kiel sendi mesaĝojn al Discord.

Ĉi tiu adaptebleco ekzempligas la ĉiuflankecon de Flowise AI por aŭtomatigi kaj optimumigi ciferecajn operaciojn en multaj platformoj kaj servoj.

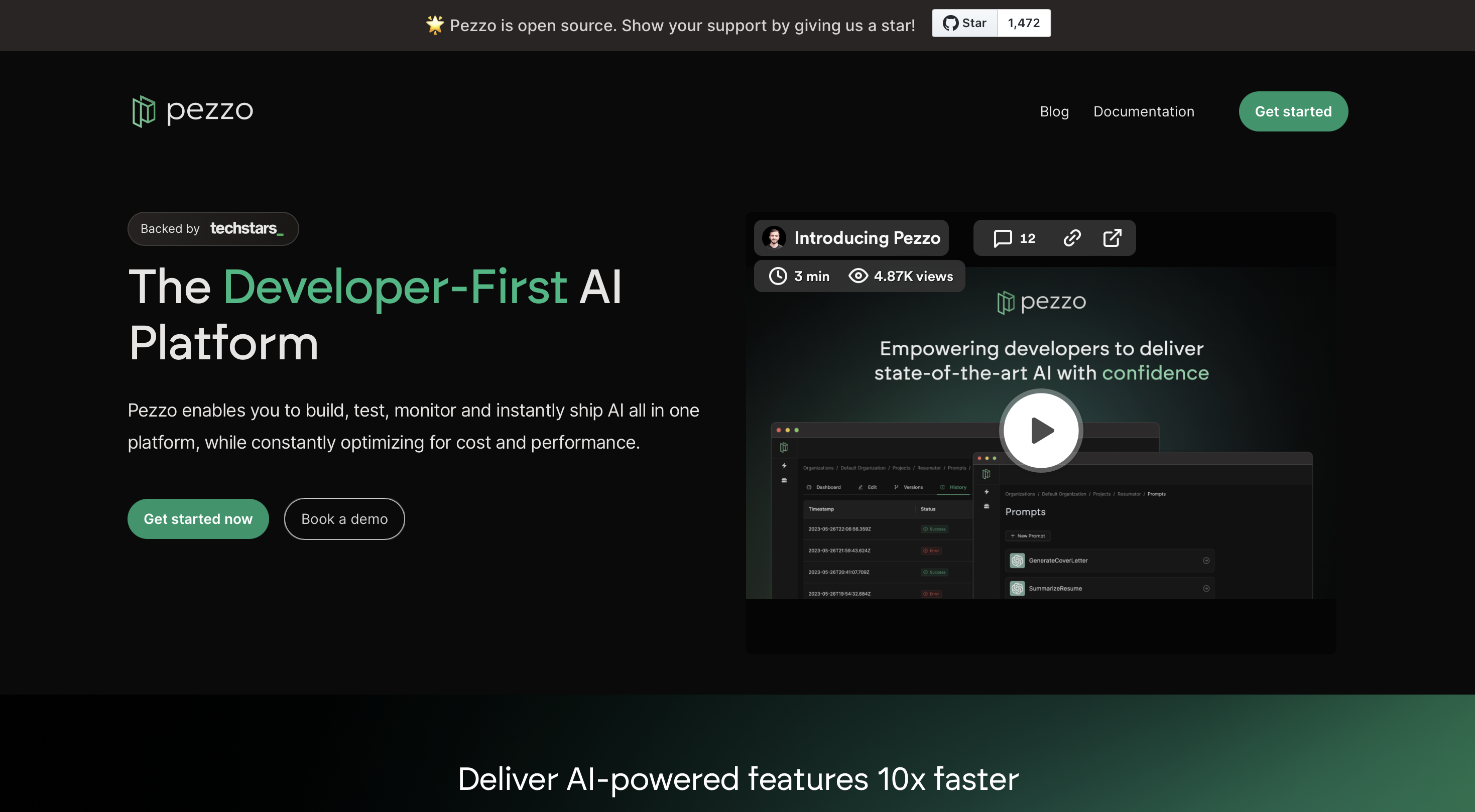

5. Peco

Pezzo distingas sin kiel programisto-unua AI-platformo, redifinante kiel AI-funkcioj estas dizajnitaj, testitaj, monitoritaj kaj deplojitaj.

Ĝi estas desegnita por optimumigi koston kaj rendimenton dum plibonigo de AI-efikeco de disvolviĝo.

Pezzo promesas ĝis dekoble pli rapidan liveraĵon danke al ĝiaj potencaj trajtoj, kiuj ebligas konsiderindan akcelon en la provizo de AI-funkciigitaj kapabloj.

La centralizita prompta administradsistemo situas en la koro de la funkcieco de Pezzo.

Ĉi tiu solvo, kiu venas kun versio kontrolo kaj tujaj produktaddeplojkapabloj, ebligas la efikan prilaboradon de ĉiuj AI-instigoj en unu loko.

Por teamoj, kiuj provas konservi konsistencon tra projektoj kaj optimumigi AI-operaciojn, ĉi tiu kapablo estas esenca. Pezzo ankaŭ disponigas observeblajn ilojn por kompreni la efikecon, koston kaj kalibron de AI-agadoj.

Programistoj povas sukcese optimumigi rimedojn per sia profunda scio en rapidajn ekzekutojn. Alia esenca komponanto de la kapabloj de Pezzo estas problemo-solvado.

Sencimiga tempo estas multe malpliigita ĉar ĝi ebligas realtempan inspektadon de rapidaj ekzekutoj. Kunlaboriloj estas inkluzivitaj kun ĉi tiu funkcio por helpi teamojn labori kune glate kaj unuvoĉe por produkti potencajn AI-funkciojn.

Tiel diversaj kiel la trajtoj de Pezzo estas ĝiaj uzkazoj. Por ebligi al programistoj plene uzi AI-modelojn en aplikaĵoj, ĝi ofertas malfermfontan ilarketon por rapida disvolviĝo de AI.

Ĉefaj trajtoj inkluzivas centralizitan promptan administradon, efikan promptan kreadon kaj versionadon, tujajn deplojojn, ĝisfundan observeblecon, efikan problemojn kaj kosto-travideblecon.

Ĝi povas esti uzata en diversaj evoluaj kuntekstoj ĉar ĝi subtenas multajn klientojn, kiel Python kaj Node.js. Unu ekzemplo de la efikeco kaj oportuno de uzo de la platformo estas ĝia ĝustatempa instrukcio pri administrado.

AI-agadoj povas esti plene administritaj de uzantoj, inkluzive de versio-kontrolo, rapida livero, rapida generacio kaj monitorado. Por krei promptilon, ĝi unue devas esti kreita per la Prompt-Redaktilo.

Ĝi tiam devas esti provita en Pezzo, ĝiaj parametroj alĝustigitaj por plej bona agado, tiam ĝi estas farita kaj publikigita.

Ĉi tiu simpligita proceduro garantias, ke ĉiu publikigita prompto funkcios kiel celite, kun la plej malgranda kvanto da kodo.

6. MindsDB

MindsDB estas pionira malfermfonta virtuala datumbazo, kiu reprezentas grandan progreson en administrado de datumoj kaj AI.

Ĝi estas unika pro sia krea maniero kunfandi AI-algoritmojn kun realtempaj datumoj. "Oblaboroj" kaj "AI-Tabeloj", du avangardaj komponantoj, ebligas ĉi tiun glatan integriĝon de datumoj kaj AI.

Realtempaj datenaktivecoj povas esti pli facile reĝisoritaj per Laborpostenoj, kaj realtempaj datumoj kaj AI-modeloj povas esti rekte ligitaj kun AI-Tabeloj.

Indiko de la adaptebleco de MindsDB estas la pli ol 70 teknologiaj kaj datuminterfacoj kiujn ĝi havas kun ĉefaj datumbazoj kaj platformoj, kiel MariaDB, MySQL, PostgreSQL, ClickHouse, Microsoft SQL Server kaj Snowflake.

Ĝia ĉiuflankeco ankaŭ inkluzivas kunfunkcieblecon kun pluraj BI-iloj, kiel Microsoft Power BI, SAS, Qlik Sense, Looker kaj Domo.

MindsDB etendas sian funkciecon subtenante Lightwood, a kadro de profunda lernado surbaze de PyTorch.

Kun simpligita aliro kiu akomodas programistojn, MindsDB fluliniigas la procezon de evoluigado de AI-aplikoj.

Ĝi distingas sin ebligante programistojn komuniki kun AI-modeloj uzante konatajn SQL-esprimojn, kio malaltigas la kompleksecon ofte ligitan kun maŝina lernado.

Ĝia kongruo kun pluraj kadroj kaj modeloj de AI, kiel TensorFlow, PyTorch, kaj GPT-3 de OpenAI, kompletigas la facilecon de ĉi tiu aliro.

La platformo ankaŭ faciligas lanĉi AI-aplikojn sen infrastruktura agordo aŭtomatigante larĝan gamon de AI-agadoj, de datumpretraktado kaj modela trejnado ĝis inferenco.

Proponante rekoneblan interfacon kaj filtrante la kompleksaĵojn de maŝina lernado, ĝi multe plirapidigas la kreadon de AI-aplikoj.

Nul-infrastruktura aranĝo fluliniigas la disfaldiĝon de AI-aplikoj, pliigante procezefikecon. Krome, MindsDB estas skalebla kaj kapabla renkonti la bezonojn de kompleksaj AI-aplikoj.

MindsDB disponigas larĝan gamon de real-mondaj aplikoj. Ĝi povas esti uzata por konstrui inteligentajn babilrotojn, kiuj vere kaj sukcese engaĝas homojn.

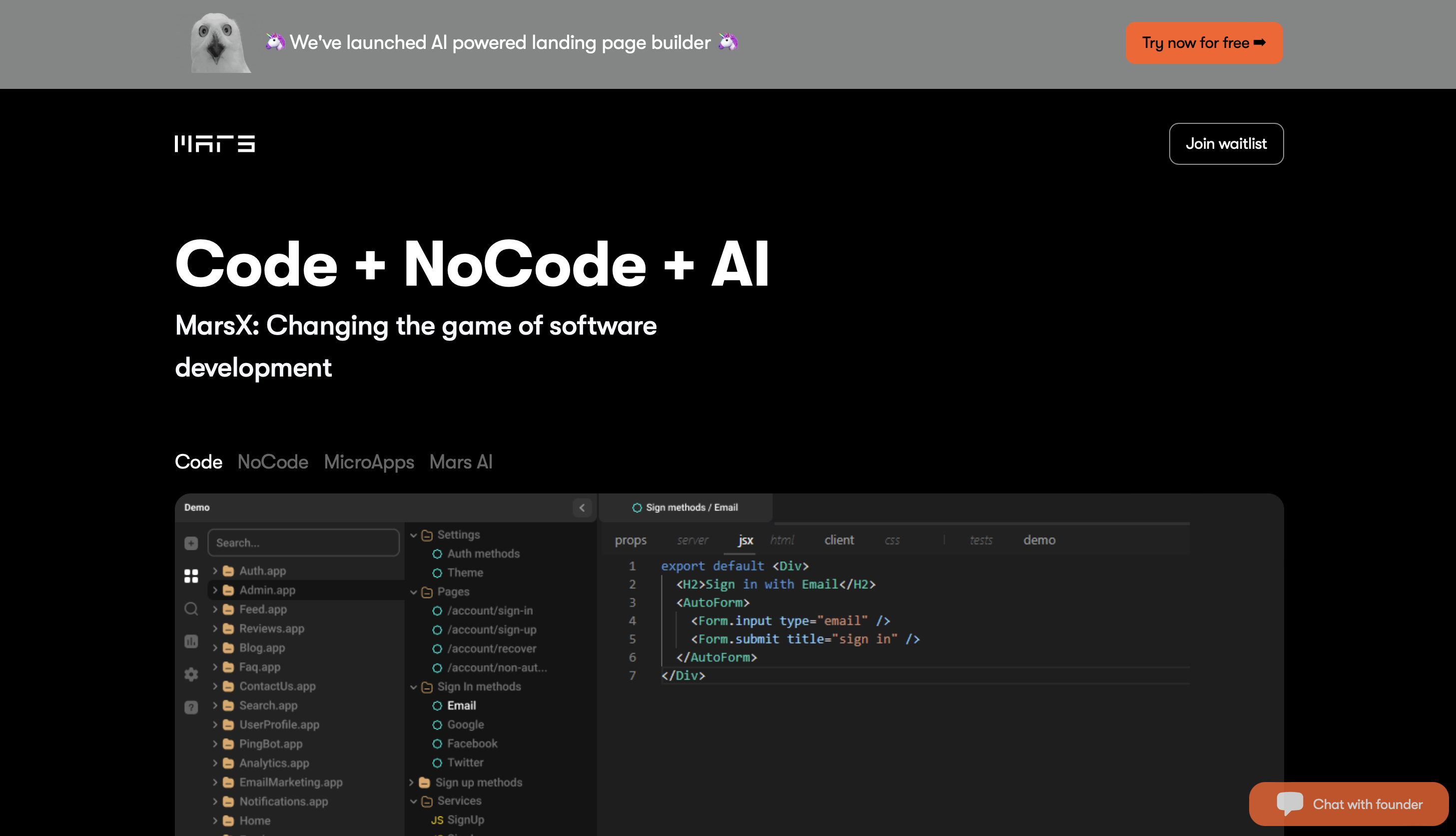

7. marto

MarsX estas avangarda platformo por programaro, kiu transformas la procezon de farado de moveblaj kaj interretaj aplikaĵoj.

Fundamente, la neceso por efika koda reuzo estas la problemo, kiun MarsX provas solvi en programado.

Malgraŭ la havebleco de kadroj kaj kodaj fragmentoj de retejoj kiel Stack Overflow, granda procento de projektkodo estas tradicie evoluigita de nulo.

La neefikecoj en la evoluprocezo kaŭzis la fondon de MarsX, firmao kiu disponigas plenajn stakajn bibliotekojn, aŭ programardisvolvajn ilarojn (SDK) kiuj integras fasadon kaj backend-komponentojn.

Por simpleco de uzo kaj kompreno, MarsX normigis ĉi tiujn plenajn bibliotekojn, kiuj estas esencaj por ampleksaj programaj solvoj.

Rekonante, ke programistoj volas eksperimenti kun novaj iloj sed ne je la prezo de granda tempo-investo, MarsX certigas, ke ĉi tiuj bibliotekoj povas esti rapide elprovitaj.

Diversaj mikro-apoj, aŭ mallongaj, specialigitaj programoj faritaj de eksteraj programistoj, estas haveblaj sur la vendoplaco de la platformo.

Proponante antaŭfaritajn bonegajn solvojn anstataŭ postuli programistojn konstrui de nulo, ĉi tiuj mikro-aplikaĵoj—kiel babilprogramoj aŭ klonoj de konataj retejoj kiel Airbnb aŭ Instagram—ŝparas tempon al programistoj.

La miksaĵo de Neniu Kodo, Malalta Kodo, Propra Kodo kaj AI, kiun MarsX proponas, distingas ĝin. Ĉi tiu adaptebleco ebligas al programistoj desegni kompleksajn retejojn kaj moveblajn programojn sur malsamaj kodaj scipovaj niveloj.

Ne plu necesas ŝanĝi inter multaj Integritaj Disvolvaj Medioj (IDE) danke al la platformo, kiu faciligas modifi ĉi tiujn mikroprogramojn proponante unuforman medion.

Por faciligi la realtempan kompilon kaj ĝisdatigon de mikroprogramoj, la platformo ankaŭ havas sian propran integran evolumedion (IDE).

La emfazo de MarsX pri uzebleco igas ĝin ideala por noventreprenoj kaj programistoj, kiuj bezonas rapide konstrui kaj ĝisdatigi programojn.

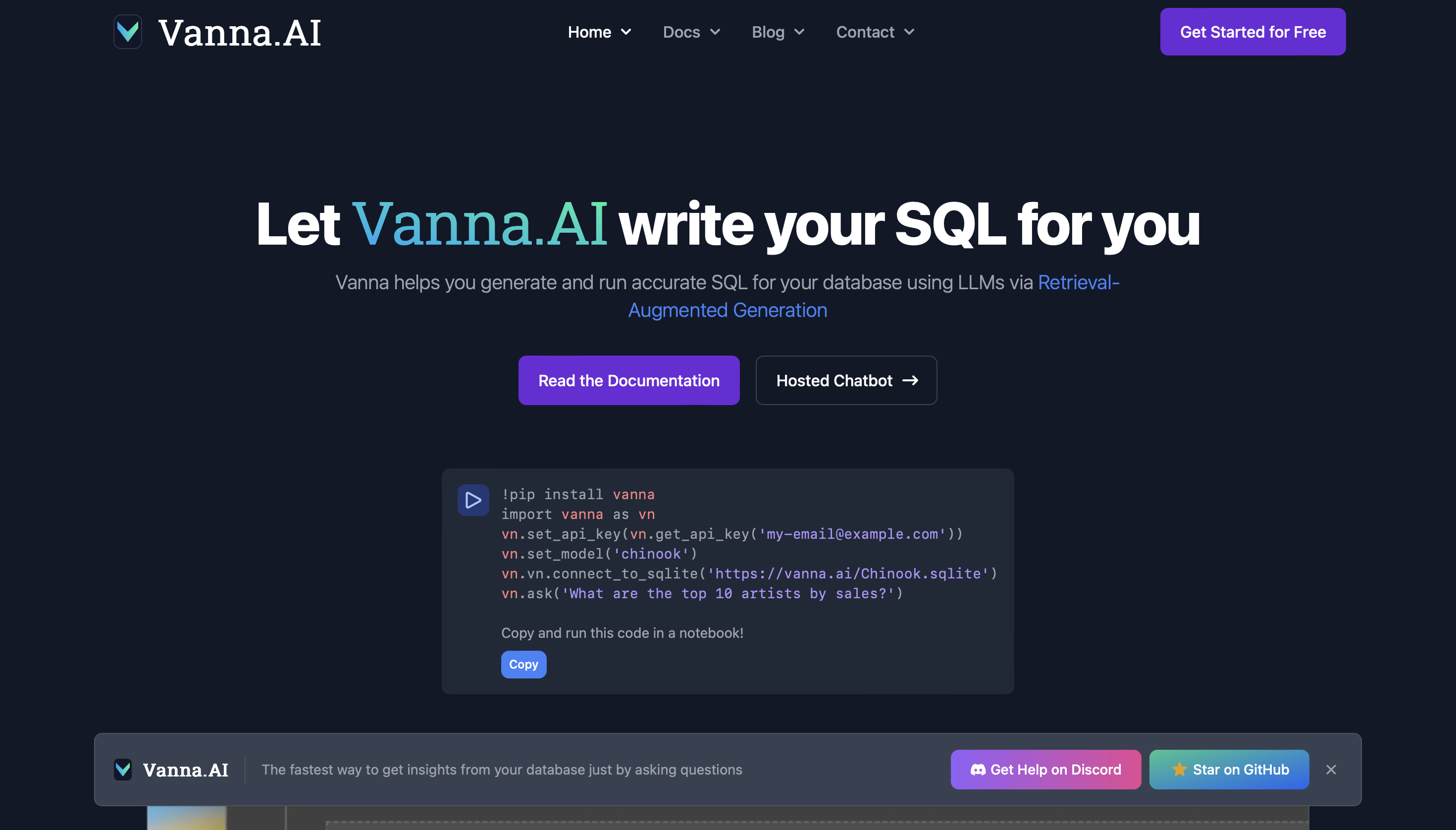

8. Vanna AI

Vanna AI estas potenca AI-funkciigita komerca spiona asistanto, kiu ŝanĝas la manieron kiel ni interagas kun datumaroj.

Ĉi tiu plej altnivela teknologio uzas Grandajn Lingvomodelojn (LLM) por produkti kaj ruli precizajn SQL-demandojn por via datumbazo.

Vanna estas unika ĉar ĝi ĝustigas sian agadon surbaze de la trejnaj datumoj liveritaj, ebligante grandan precizecon eĉ sur komplikaj datumaroj.

Ĉi tio implicas, ke Vanna ĉiam pli kapablas pritrakti kaj kompreni komplikajn datumstrukturojn ju pli da datumoj vi nutras ĝin.

Vanna AI estas rimarkinda pro emfazo de sekureco kaj privateco. Via datumbaza enhavo estas konservita privata ĉar la LLM nur funkcias kun metadatenoj, kiel kiel skemoj, dokumentado kaj demandoj, dum interagado kun via datumbazo.

Aldone, Vanna AI donas al vi la liberecon konstrui ligojn por ajna datumbazo kaj venas kun enkonstruita subteno por konataj datumbazoj kiel BigQuery, Postgres kaj Snowflake.

Ĉi tio faras ĝin ege adaptebla instrumento por ampleksa aro de datumadministradpostuloj. La platformo havas simile elstarajn integrigajn eblecojn.

Vanna povas esti uzata por komenci en Jupyter Notebook kaj poste esti etendita al komercaj klientoj uzante malsamajn fasadon kiel ekzemple retaj programoj, Streamlit-aplikaĵoj aŭ Slackbot.

Ĝi estas bonega opcio por gamo da kompaniaj agordoj, de noventreprenoj ĝis ĉefaj organizoj, pro sia ĉiuflankeco.

Vanna AI celas forigi la bezonon de komplikaj SQL aŭ Python-demandoj simpligante eltiri komprenojn el via datumbazo simple farante demandojn.

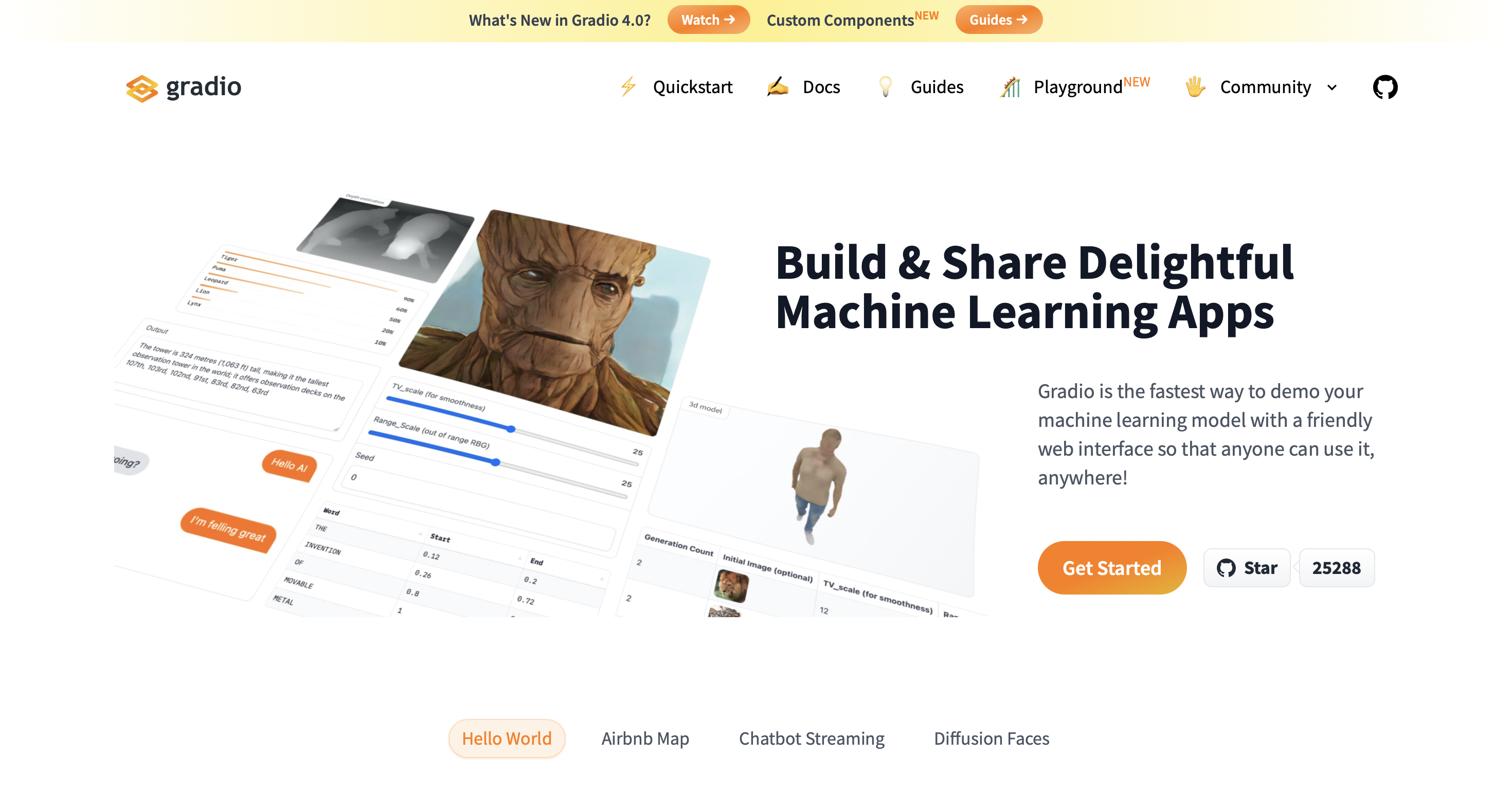

9 Gradio

Gradio estas fleksebla kaj avangarda ilo por datumscienco kaj maŝinlernado, kiu revolucias la manieron kiel modeloj estas uzataj kaj prezentitaj.

Kun pli ol tridek antaŭkonstruitaj komponantoj kaj granda nombro da novaj, Gradio faciligas krei interagajn pruvojn por malsamaj specoj de datumoj.

Gradio distingas sin glate ŝanĝante ĝiajn komponentojn inter statikaj kaj interagaj reĝimoj depende de ĉu ili estas uzataj kiel enigaĵoj aŭ eligoj en manifestacio.

Vi povas eviti la kapdoloron devi mane identigi la naturon de ĉiu komponanto danke al ĝia aŭtomata detekto.

Gradio ankaŭ funkcias escepte bone en preparado kaj posttraktado, transformante datumojn inter formatoj, kiuj taŭgas por uzantinterago kaj funkciobezonoj facile.

Ĉi tiu funkcio estas esenca por taskoj kiel alŝuti fotojn aŭ prezenti bildgalerion en la retumilo de la uzanto.

Por konataj programoj, ĝia integra vicsistemo devas povi subteni milojn da samtempaj uzantoj.

Estas manieroj, ke vi povas administri la atendovicon, kiel limigi kiom da petoj povas esti traktitaj samtempe. Ĉar multaj maŝinlernado rutinoj uzas multan memoron kaj postulas reguligitan aliron dum tempoj kiam uzantagado estas alta, tio estas speciale avantaĝa.

Gradio permesas la uzadon de generatoraj funkcioj en situacioj, kiam vi bezonas serion da eliroj, kiel ekzemple en babilrotoj aŭ bild-generaj modeloj.

La interaga sperto povas esti plibonigita uzante ĉi tiun kapablon prezenti ripetantajn rezultojn.

Gradio ankaŭ kapablas pritrakti fluajn enigaĵojn, kiel realtempaj sonfluoj aŭ modeloj por generi bildojn en respondo al komanda enigo.

Vi ankaŭ havas kontrolon pri kiel la uzanto vidas progresajn ĝisdatigojn danke al la subteno de la platformo por agordeblaj Progresstabloj.

Ĉi tiu funkcio estas tre helpema por taskoj, kiuj bezonas multan pretigan tempon, inkluzive de komplikaj kalkuloj aŭ analizo de datumoj.

La kapablo de Gradio spuri progreson plifortiĝas per ĝia inkludo de la tqdm-biblioteko, kiu ofertas vidajn rimarkojn pri taskoprogresado.

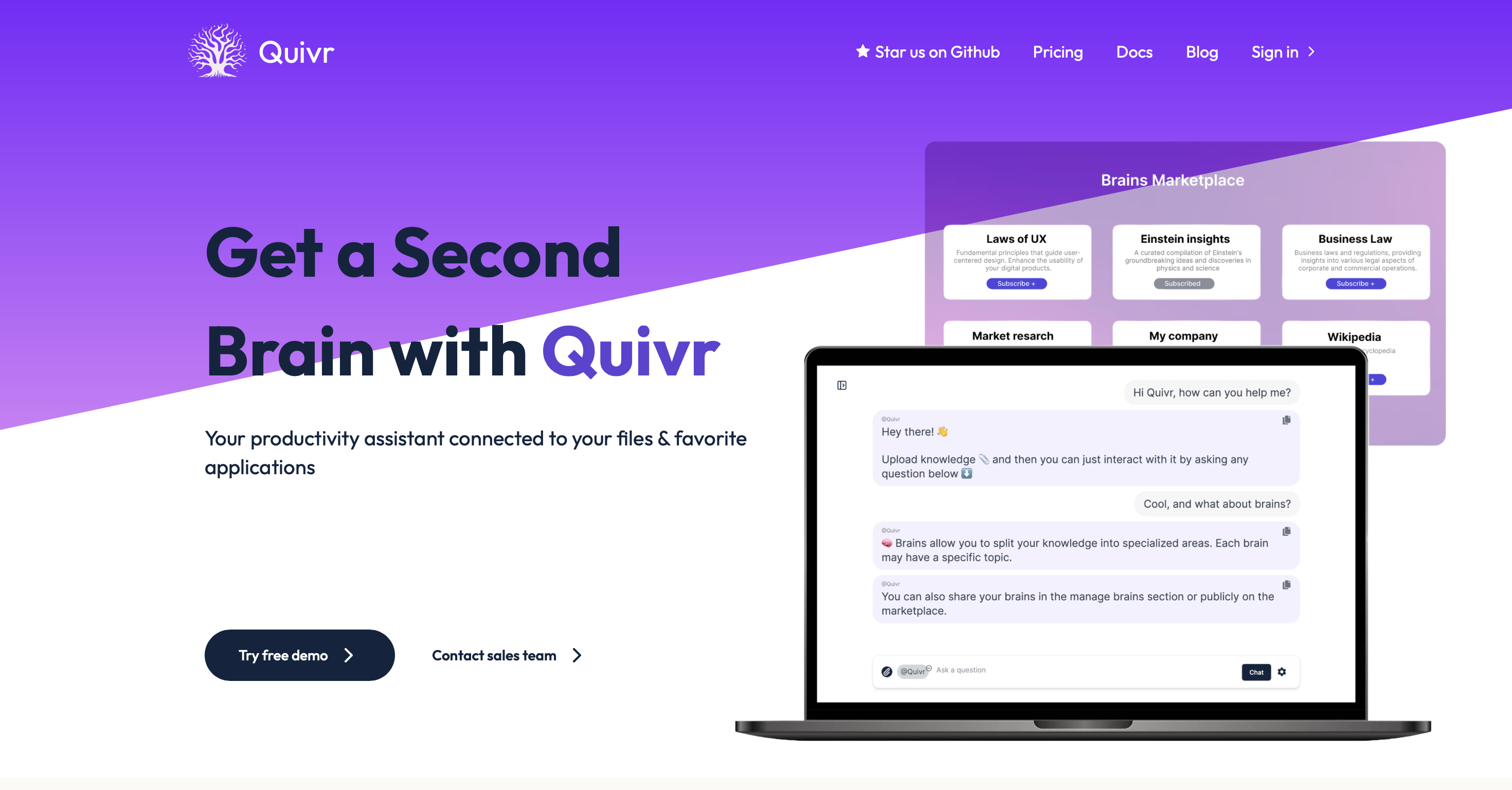

10 Quivr

Quivr aperas kiel ludŝanĝa platformo, kiu poziciiĝas kiel via "Dua Cerbo" kaj persona asistanto, igante ĝin taŭga por kunlabora programaro.

Rapida agordo kaj simplaj funkcioj faras ĉi tiun malfermfontan ilon bonega valoraĵo por iu ajn laboranta en grandaj evoluigaj teamoj aŭ malfermfontaj komunumoj.

Quivr estas vere facile uzebla; vi povas registriĝi uzante vian Google-konton en malpli ol kvin sekundoj. Vi povas okupiĝi pri viaj datumoj demandante demandojn pri viaj dosieroj sur la platformo, kio ankaŭ simpligas la alŝuton de dosieroj.

Servante pli ol 30,000 homojn kaj 4,000 entreprenojn, Quivr estas ĉe la avangardo de AI-novigado uzante Fundamentajn Modelojn kaj Generative AI.

Inter la plej bonaj 100 malfermfontaj projektoj, ĉi tiu komunuma platformo servas pli ol 26,000 programistojn. Provizante stabilan medion por evoluigado de venontgeneraciaj AI-aplikoj, Quivr distingas sin ebligante organizojn plene uzi AI por novigado.

Kiel cifereca asistanto, kiu subtenas decidon kaj aŭtomatigas tedajn procezojn, Quivr funkcias kiel pli ol nur platformo por disvolviĝo. Ĉi tio helpas pliigi kompanian efikecon.

La malfermfonta dezajno de Quivr instigas komunuman partoprenon en funkciopetoj, cimraportoj kaj dokumentado.

Travidebleco kaj kunlabora disvolviĝo estas garantiitaj per facila aliro al la fontkodo en GitHub. Ĉi tiu strategio antaŭenigas konstantan novigon kaj platforman plibonigon krom sento de komunumo.

konkludo

Malfermfonta AI kaj ĝiaj efikoj al la medio, kun fokuso pri kiel ĝi demokratiigas teknologian evoluon kaj instigas kunlaboron inter adorantoj, esploristoj kaj programistoj.

Ĉiu povas uzi, ŝanĝi kaj distribui AI-teknologion uzante malfermfontajn platformojn, kiuj kaŭzis la kreadon de prosperaj novigaj centroj en retejoj kiel GitHub.

TensorFlow, ilo kiu akcelas AI-esploradon kaj novigon, estas unu ekzemplo, same kiel kelkaj malfermfontaj platformoj kiel Gradio, Quivr, ChatDev, Flowise AI, Pezzo, MarsX, Vanna AI kaj AbanteAI (Mentat).

Ĉi tiuj sistemoj faciligas AI-movitan programaron por tiuj kun malmulta al neniu kodigo-scio, plibonigas maŝinlernadmodelkreadon kaj ofertas AI-funkciigitan kodigan subtenon.

Precipe por noventreprenoj, ili disponigas avantaĝojn inkluzive de kostefikeco, fleksebleco kaj pliigita produktiveco.

Krom akceli esploradon kaj komercan kreadon, ĉi tiu demokratiigo de AI-teknologio malfermas aliron al pli larĝa publiko, ŝanĝante AI de specialeca kampo por elektitaj malmultaj al kunlabora klopodo.

Lasi Respondon