Inhaltsverzeichnis[Ausblenden][Zeigen]

Web Scraping ist in der heutigen datengesteuerten Gesellschaft, in der Wissen Macht bedeutet, zu einem entscheidenden Werkzeug geworden. Sie haben sicher schon von browserbasierten Web-Scraping-Plattformen gehört.

Lassen Sie uns nun browserbasierte Web-Scraping-Plattformen besprechen. Diese Systeme bieten eine einfache und schnelle Möglichkeit, Daten von Websites zu extrahieren, ohne dass komplizierter Code oder Spezialkenntnisse erforderlich sind. Sie bieten unkomplizierte Tools und benutzerfreundliche Schnittstellen, die den Scraping-Prozess vereinfachen.

Das Schöne an browserbasierten Systemen ist, dass sie machen Bahnkratzen für jeden zugänglich, vom Anfänger bis zum Spezialisten. Browserbasierte Lösungen machen Online-Scraping für jedermann zugänglich, egal ob es sich um Forscher handelt, die Muster analysieren, Firmeninhaber, die Konkurrenten beobachten wollen, oder Einzelpersonen, die nach Informationen suchen.

Der Einsatz browserbasierter Lösungen für Web Scraping bietet mehrere Vorteile.

Erstens machen sie technisches Fachwissen überflüssig und machen es für jedermann einfacher, Daten von Websites zu extrahieren. Diese Systeme umfassen häufig Point-and-Click-Funktionen und Grafiken BenutzeroberflächenDadurch können Benutzer problemlos mit Websites interagieren und die Daten auswählen, die sie extrahieren möchten.

Durch die Verfügbarkeit von Funktionen wie Datenvalidierung, Automatisierung und Planung wird der Scraping-Prozess rationalisiert und wertvolle Zeit gespart. Sie verfügen häufig auch über starke Proxy-Netzwerke, die eine zuverlässige und sichere Datenextraktion gewährleisten und gleichzeitig Einschränkungen oder blockierende Systeme überwinden.

Mithilfe browserbasierter Technologien können Sie schwierige Scraping-Aufgaben bewältigen, Daten aus dynamischen Websites extrahieren und die erfassten Daten in nützliche Erkenntnisse umwandeln. Durch den Zugriff auf die Fülle an online verfügbaren Daten ermöglichen sie Organisationen, Forschern und Menschen, in der datengesteuerten Welt an der Spitze zu bleiben. In diesem Artikel werden wir uns die besten browserbasierten Web-Scraping-Plattformen ansehen.

1. Helle Daten

Bright Data ist ein strahlender Stern unter den browserbasierten Web-Scraping-Tools, da es eine umfassende Antwort auf die Web-Scraping-Anforderungen der Kunden bietet. Mithilfe einer browserbasierten Methode können Sie mit Bright Data Websites mit dynamischen Inhalten, JavaScript-Rendering und komplexer Seitenarchitektur durchsuchen, um sicherzustellen, dass alle wichtigen Daten erfasst werden.

Mit dem Scraping-Browser von Bright Data können Sie Zielwebsites mühelos durchsuchen und navigieren, während Bright Data in Ihrem Namen die gesamte Proxy- und Entsperrungsinfrastruktur verwaltet. Die Leistungsfähigkeit der automatischen Entsperrfunktionen von Web Unlocker ist in den Scraping Browser integriert, einen automatisierten Browser, der für das Daten-Scraping entwickelt wurde.

Jedes Data-Scraping-Projekt, das Skalierbarkeit, Browser und eine automatisierte Steuerung aller Website-Entsperrungsaktivitäten erfordert, eignet sich perfekt für die Verwendung. Mithilfe der Scraping-Browser-, Puppeteer- und Playwright-API wird es zu einem anpassungsfähigen Tool zur Automatisierung von Vorgängen und zum Abrufen von Daten von Websites.

Bei der Arbeit mit großen Datenmengen ist diese Funktion äußerst praktisch. Zu guter Letzt hat Bright Data Anti-Blocking-Methoden eingeführt, mit denen Sie Dinge wie CAPTCHAs und andere Arten der Website-Blockierung umgehen können.

Eines der hervorstechendsten Merkmale ist das ausgedehnte Proxy-Netzwerk, das mehr als 72 Millionen private IPs und 2 Millionen mobile IPs aus der ganzen Welt umfasst und eine unübertroffene Abdeckung und Zuverlässigkeit für Web Scraping bietet.

Darüber hinaus ist es mit einer Reihe von kompatibel Programmiersprachen, einschließlich Python, Node.js und Java, sowie weit verbreitete Datenspeicher- und Analysesysteme wie AWS, Google Cloud und BigQuery. Mit Bright Data als Ihrem Web-Scraping-Verbündeten können Sie sicher und effektiv scrapen und das Potenzial von Daten ganz einfach erschließen.

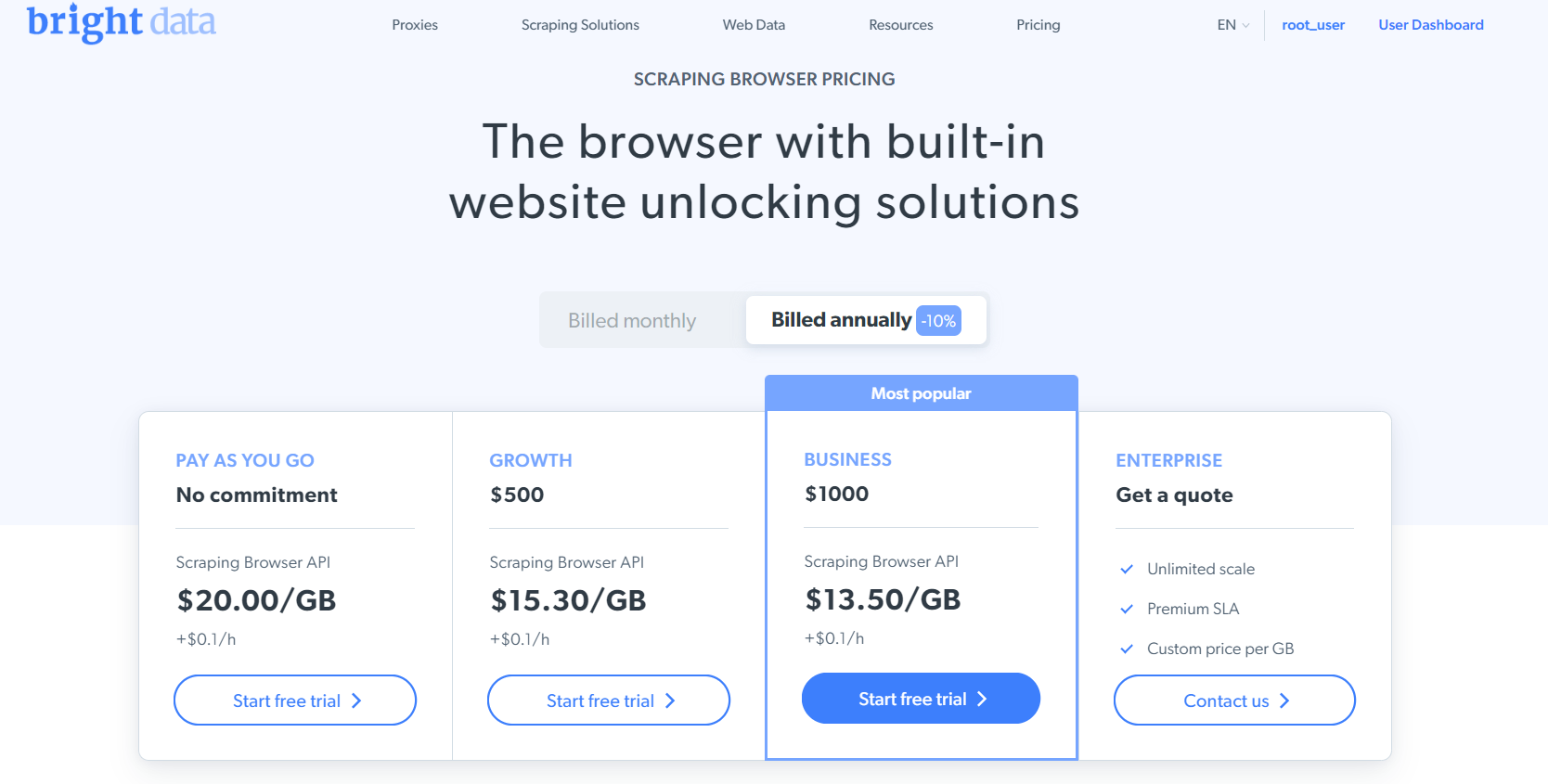

AnzeigenPreise

Das Die Preise beginnen bei 13.50 $/GB.

2. Oktoparese

Octoparse ist ein ideales browserbasiertes Tool, das ausschließlich für Web Scraping entwickelt wurde. Selbst Personen ohne Programmierkenntnisse können damit ein reibungsloses Scraping-Erlebnis haben.

Mit dem benutzerfreundlichen visuellen Scraping-Tool können Sie ganz einfach Daten von Websites sammeln. Es besteht keine Notwendigkeit, komplizierte Codierungs- oder Skriptsprachen zu erlernen. Indem Sie direkt mit der Website interagieren und die Datenelemente auswählen können, die Sie extrahieren möchten, optimiert Octoparse den Vorgang.

Es ist so, als würde man Ihnen eine virtuelle Hand geben, die Ihnen hilft, im Internet zu suchen und die gewünschten Informationen zu finden. Octoparse leistet jedoch mehr als nur das Extrahieren von Daten. Es zeichnet sich auch durch Fähigkeiten zur Datentransformation und -bereinigung aus.

Sobald die Daten gescrapt wurden, gibt Ihnen Octoparse die Möglichkeit, sie gemäß Ihren individuellen Anforderungen zu formatieren und zu verbessern. Um Daten wertvoller und umsetzbarer zu machen, können Sie verwirrende Daten bereinigen, Duplikate entfernen und sogar komplizierte Transformationen durchführen.

Mit Octoparse haben Sie die Möglichkeit, jede Phase des Datenlebenszyklus, einschließlich Extraktion, Bereinigung und Transformation, über eine einfache browserbasierte Oberfläche zu verwalten. Ohne technische Kenntnisse können Sie mit Octoparse an Ihrer Seite in die Welt des Web Scrapings einsteigen, unbezahlbare Erkenntnisse gewinnen und die Leistungsfähigkeit der Daten nutzen.

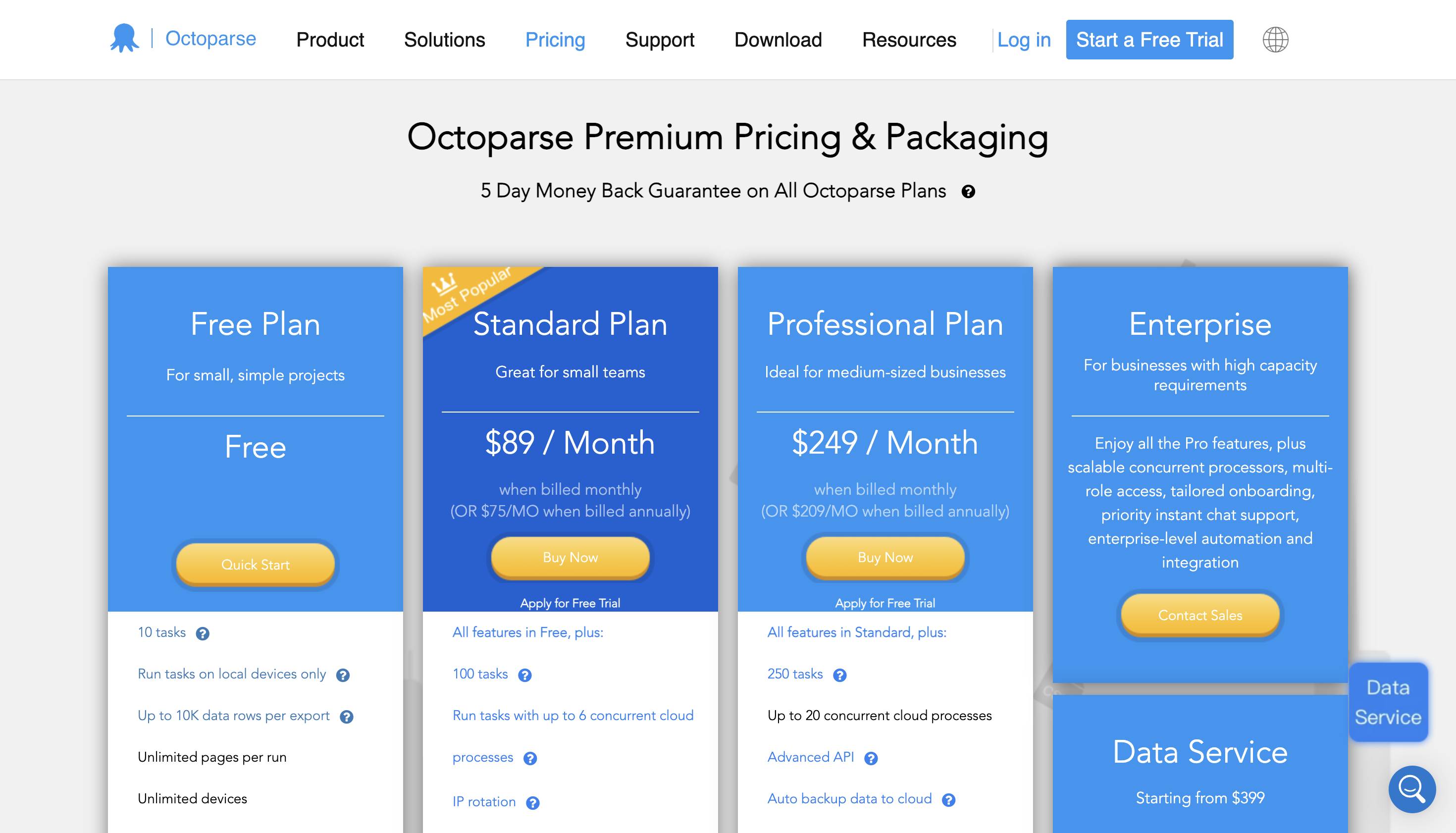

AnzeigenPreise

Sie können es kostenlos nutzen und die Premium-Preise beginnen bei 89 $/Monat.

3. ParseHub

ParseHub ist eine Plattform, die alle Ihre Scraping-Anforderungen erfüllt und unglaublich flexibel und benutzerfreundlich ist. ParseHub bietet Ihnen alles, egal ob Sie ein Anfänger oder ein erfahrener Datenliebhaber sind. Das einzigartige Merkmal von ParseHub ist seine einfache Point-and-Click-Oberfläche, die das Sammeln von Daten von dynamischen Websites erheblich vereinfacht.

Durch komplexe Webseiten kann man navigieren, ohne dass man ein erfahrener Programmierer sein muss. Um Daten zu extrahieren, wählen Sie einfach die gewünschten Daten aus und ParseHub kümmert sich um den Rest. Es ist, als hätten Sie Ihren ganz persönlichen Helfer bei der Datenextraktion. Aber ParseHub bietet ausgefeiltere Optionen, um Ihr Scraping auf die nächste Stufe zu heben.

Sie können den Scraping-Prozess automatisieren, indem Sie geplantes Scraping verwenden, das es ParseHub ermöglicht, Daten in vorgegebenen Intervallen abzurufen und so sicherzustellen, dass Sie immer über die neuesten Informationen verfügen.

Darüber hinaus bietet ParseHub eine nahtlose API-Konnektivität, sodass Sie Scraped-Daten ganz einfach in Ihre eigenen Programme oder Systeme integrieren können. Es handelt sich um eine wirkungsvolle Technik, um die Nutzung Ihrer extrahierten Daten zu optimieren und Ihren Daten-Workflow zu verbessern.

Web Scraping wird mit der benutzerfreundlichen Oberfläche und leistungsstarken Funktionalität von ParseHub zu einem unterhaltsamen und effektiven Prozess, der auf einfache Weise nützliche Erkenntnisse aus dynamischen Webseiten preisgibt.

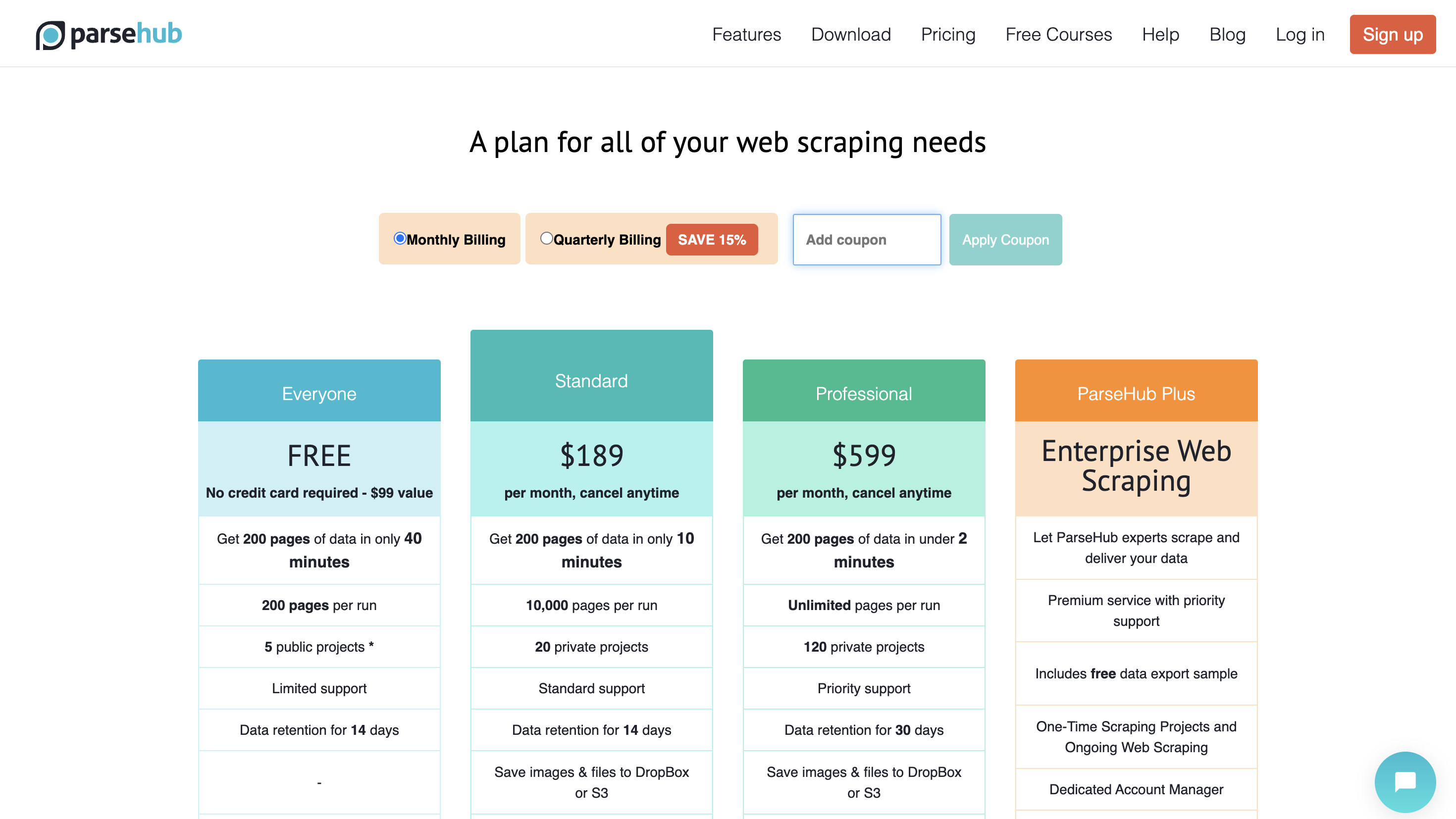

AnzeigenPreise

Sie können es kostenlos nutzen und die Premium-Preise beginnen bei 189 $/Monat.

4. Webz.io

Webz.io – Big Web Data ist eine bemerkenswerte browserbasierte Technologie, die sich auf die Extraktion und Überwachung von Webdaten konzentriert. Mithilfe von Webz.io können Sie ganz einfach online aufschlussreiche Daten gewinnen, um immer am Puls des Webs zu bleiben. Diese Plattform ist eine Goldgrube für Informationen und bietet ausführliche Berichterstattung über Nachrichten, Blogartikel und Online-Gespräche zu verschiedenen Themen.

Webz.io stellt sicher, dass Sie Zugriff auf die aktuellsten und relevantesten Informationen aus dem gesamten Web haben, unabhängig von Ihrem Unternehmen oder Ihrem Fachwissen. Es ist vergleichbar mit dem Zugriff auf eine große Wissensbibliothek. Webz.io geht jedoch über die reine Datenabdeckung hinaus.

Darüber hinaus bietet es eine reibungslose API-Konnektivität, sodass Sie die extrahierten Daten einfach in Ihre eigenen Programme oder Systeme integrieren können. Mit dieser Fähigkeit gibt es unzählige Möglichkeiten, die Daten so zu nutzen, wie es Ihren Anforderungen am besten entspricht.

Die Webz.io-API-Verbindung vereinfacht den Datenintegrationsprozess, unabhängig davon, ob Sie ein benutzerdefiniertes Dashboard erstellen, Marktforschung durchführen oder eine KI-gestützte Lösung erstellen.

Die benutzerfreundliche Oberfläche von Webz.io – Big Online Data und die leistungsstarken Funktionen zur Datenüberwachung und -extraktion geben Ihnen die Möglichkeit, immer einen Schritt voraus zu sein und Online-Daten in vollem Umfang für Ihre Arbeit in einem Unternehmen oder für Ihre Forschung zu nutzen.

AnzeigenPreise

Bitte kontaktieren Sie den Anbieter für die Preisgestaltung.

5. Import.io

Import.io ist ein hervorragendes browserbasiertes Tool, das mit seiner einfachen Point-and-Click-Oberfläche das Online-Scraping vereinfacht. Web Scraping ist mit import.io ganz einfach, unabhängig von Ihrer Datenkompetenz. Mit nur wenigen Klicks und ohne technische Erfahrung können Sie ganz einfach Daten von Websites extrahieren.

Es ist, als hätte man einen Zauberstab, um die gewünschten Daten aus dem riesigen Internet zu sammeln. Aber import.io geht noch weiter. Mit seiner ausgefeilten Crawling-Technologie geht es darüber hinaus.

Import.io kann jetzt entdecken Datenstrukturen und Muster auf Webseiten, was die Effizienz und Präzision des Internet-Scraping-Prozesses erhöht. Es ist wie ein Datendetektiv, der mit dem Aufbau der Website vertraut ist und schnell und einfach die entsprechenden Daten sammeln kann.

Dank der umfangreichen Datenintegrationsfunktionen von import.io können die geschabten Daten auch in verschiedene Formate und Programme exportiert werden. Import.io kann die Daten in den gewünschten CSV-, Excel- oder JSON-Formaten bereitstellen. Die abgerufenen Daten können einfach in Ihre Datenbanken, Analyseprogramme oder sogar kommerzielle Anwendungen integriert werden.

Web Scraping wird mit import.io zum Kinderspiel, sodass Sie aufschlussreiche Informationen gewinnen und Ihre datengesteuerten Abläufe optimieren können.

AnzeigenPreise

Sie können die Plattform mit einer 14-tägigen kostenlosen Testversion nutzen. Die Premium-Preise beginnen bei 199 $/Monat.

6. Dexi.io

Dexi.io ist eine innovative Plattform, die in einem Browser verwendet werden kann und eine umfassende Palette an Web-Scraping-Optionen bietet. Mit seinem einfachen visuellen Editor und der Point-and-Click-Benutzeroberfläche macht Dexi.io Web Scraping für Benutzer aller technischen Erfahrungsstufen zugänglich. Um die Komplexität des Web Scrapings zu meistern, müssen Sie kein Programmiergenie sein.

Dexi.io macht es einfach, Scraping-Bots zu erstellen, die schnell und präzise Daten von Webseiten entfernen. Es ist vergleichbar mit einem virtuellen Assistenten, der alle mühsamen Aufgaben erledigt.

Dexi.io geht über die einfache Datenextraktion hinaus. Die Datenanreicherung, eine der ausgefeilteren Funktionen, ermöglicht es Ihnen, die abgerufenen Daten zu verbessern, indem Sie weitere Details aus anderen Quellen hinzufügen. Dadurch wird Ihre Analyse aufschlussreicher und vollständiger.

Darüber hinaus können Sie die mit Dexi.io erfassten Daten in verschiedene Formate exportieren, darunter CSV, Excel oder JSON. Dexi.io macht es einfach, die Daten zu erhalten, die Sie für die Integration in andere Systeme oder für weitere tiefgreifende Recherchen benötigen.

Dexi.io bietet außerdem API-Konnektivität, sodass Sie schnell eine Verbindung zu den gescrapten Daten herstellen und diese in Ihre eigene Software oder Systeme integrieren können. Sie können Abläufe automatisieren und die Nutzung der abgerufenen Daten maximieren, da dies einen reibungslosen Arbeitsablauf bietet.

AnzeigenPreise

Sie können die Plattform mit ihrem kostenlosen Testplan testen und sich bezüglich der Premium-Preise bitte an den Anbieter wenden.

7. Mozenda

Mozenda ist ein erstklassiges Web-Scraping-Tool, das automatisierte und browserbasierte Scraping-Optionen bietet. Die benutzerfreundliche Oberfläche und die robusten Funktionen von Mozenda vereinfachen das Abrufen von Daten von Websites.

Mithilfe seiner Point-and-Click-Benutzeroberfläche erleichtert Mozenda die Navigation zwischen Websites. Sie haben keine Programmierkenntnisse? kein Problem. Unabhängig davon, ob Sie Kundenrezensionen, Produktdetails oder andere Daten benötigen, Mozenda gibt Ihnen die Möglichkeit, schnell die Datenelemente auszuwählen, die Sie extrahieren möchten.

Es ist, als ob Sie einen virtuellen Assistenten hätten, der Ihre Scraping-Anforderungen kennt. Mozenda hört hier jedoch nicht auf. Dank der Planung, einer der ausgefeilteren Funktionen, können Sie den Scraping-Prozess automatisieren und Daten in bestimmten Intervallen extrahieren.

Mozenda bietet Ihnen alles, egal ob Sie tägliche, wöchentliche oder monatliche Updates benötigen. Darüber hinaus bietet Mozenda nahtlose Datenexportoptionen, mit denen Sie die von Ihnen gescrapten Daten in verschiedenen Dateitypen speichern können, darunter Excel, CSV oder XML. Die abgerufenen Daten können problemlos in Ihre Analyseprogramme oder Datenbanken übernommen werden.

Dank des API-Integrationsdienstes von Mozenda können die gescrapten Daten zusätzlich mit Ihren eigenen Apps oder Systemen verbunden und in diese integriert werden. Es bietet einen effizienten Arbeitsablauf, der es Ihnen ermöglicht, Verfahren zu automatisieren und die Nutzung der abgerufenen Daten zu maximieren.

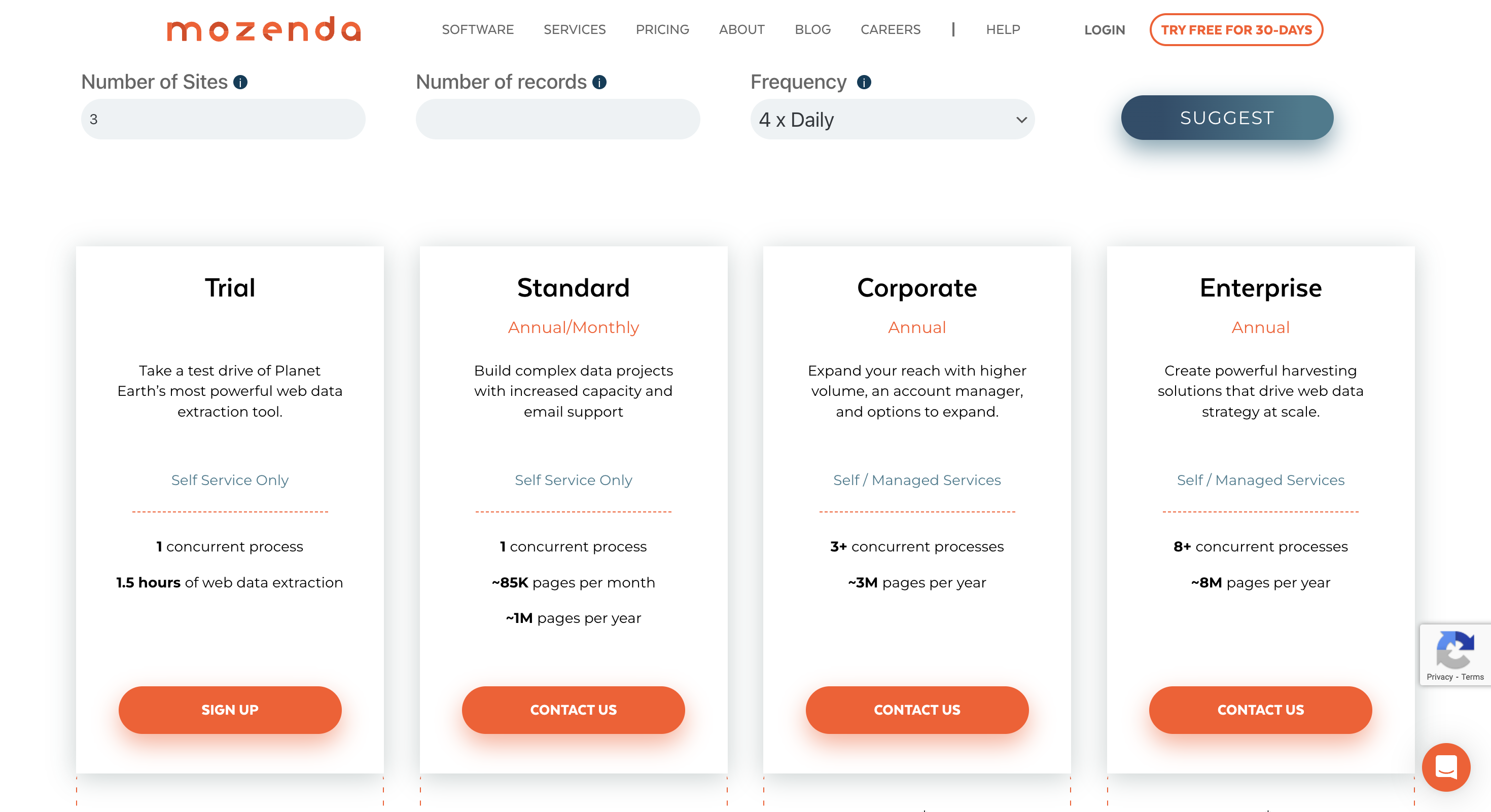

AnzeigenPreise

Sie können die Plattform mit ihrem kostenlosen Testplan testen und sich bezüglich der Premium-Preise bitte an den Anbieter wenden.

8. Kratzbiene

Mit ScrapingBee, einer wunderbaren browserbasierten Web-Scraping-Anwendung, ist es viel einfacher, Daten von Websites zu sammeln. Nutzen Sie die Leistungsfähigkeit des Web Scraping mit ScrapingBee und vermeiden Sie den Aufwand der Infrastrukturverwaltung.

Dank der intuitiven API können Sie problemlos Abfragen senden und erfasste Daten abrufen. Die ScrapingBee-API erleichtert das Extrahieren jeglicher Art von Daten, einschließlich Produktinformationen, Nachrichtenartikeln und anderen Arten.

Dennoch geht ScrapingBee noch weiter. Es verfügt über Funktionen, die über einfaches Web-Scraping hinausgehen. Es verfügt über JavaScript-Rendering-Funktionen, mit denen Sie Informationen von Websites extrahieren können, die für die Inhaltspräsentation hauptsächlich auf JavaScript basieren. Dadurch wird sichergestellt, dass Sie auch bei dynamischen Webseiten den gesamten Inhalt abrufen können.

Darüber hinaus kümmert sich ScrapingBee um CAPTCHAs für Sie und erspart Ihnen so die zeitraubende Arbeit, diese lästigen Hindernisse zu überwinden.

Es löst CAPTCHAs automatisch auf, sodass Sie sich darauf konzentrieren können, die gewünschten Informationen zu erhalten. Darüber hinaus bietet ScrapingBee IP-Rotatoren, um Ihre Scraping-Vorgänge privat und von Websites entsperrt zu halten. Es ändert IP-Adressen, was es für Websites schwierig macht, Sie zu überwachen und Zugriffsbeschränkungen aufzuerlegen.

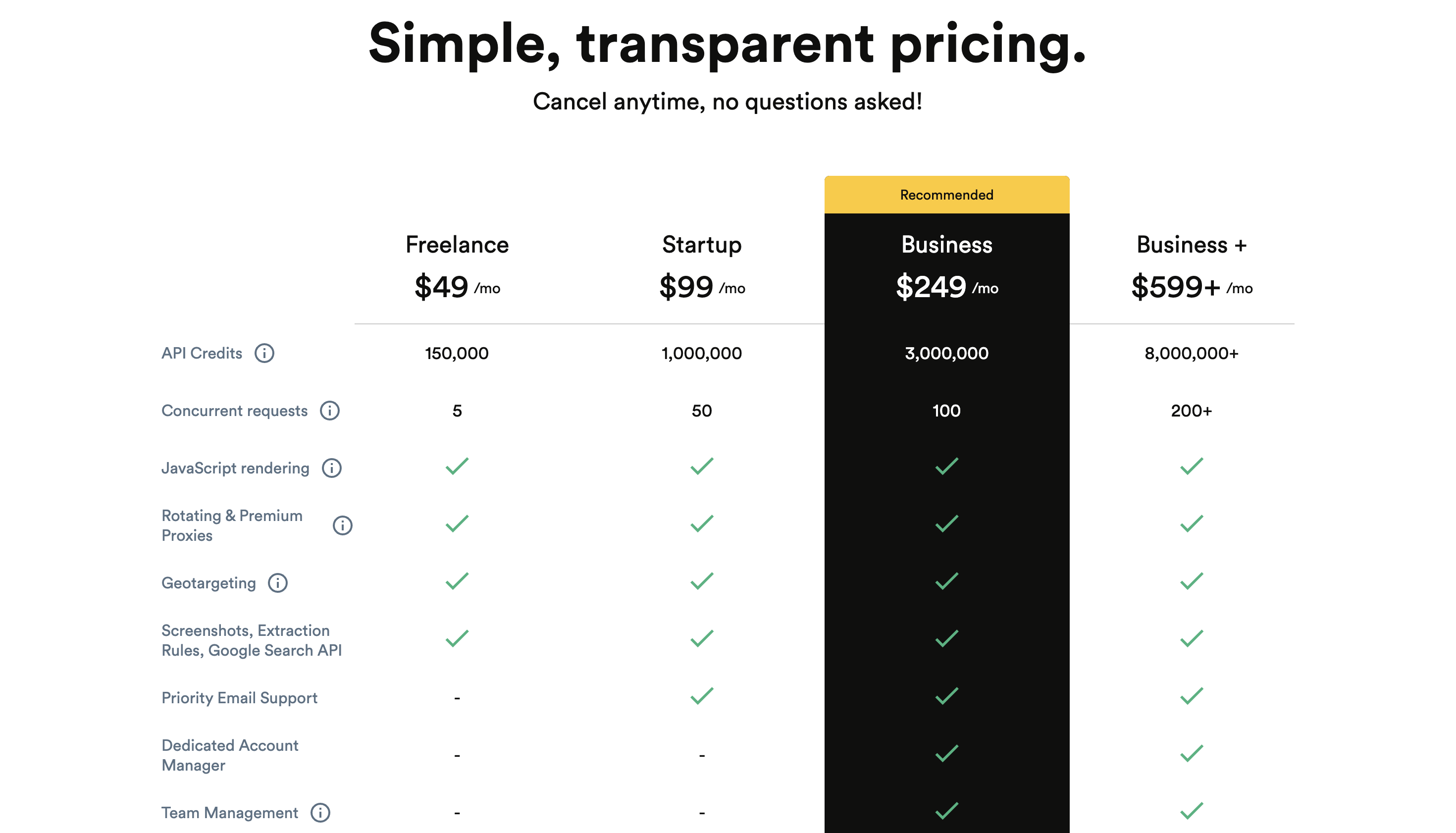

AnzeigenPreise

Die Premium-Preise beginnen bei 49 $/Monat.

9. Apify

Apify ist eine robuste cloudbasierte Plattform, die in Browsern verwendet werden kann und über Web-Scraping- und Automatisierungsfunktionen verfügt. Durch die Verwendung von Apify können Sie zeitaufwändige Vorgänge einfach automatisieren und schnell Daten von Websites extrahieren, sodass Sie mehr Zeit für andere wichtige Arbeiten haben.

Ohne dass Code erforderlich ist, können mit dem visuellen Editor von Apify schnell anspruchsvolle Scraping-Situationen erstellt werden. Die Website ist einfach zu bedienen und verfügt über eine Drag-and-Drop-Oberfläche, mit der Sie die Daten, die Sie durchsuchen möchten, ganz einfach auswählen können.

Auf der Architektur von Apify können Ihre Scraping-Jobs dann als serverlose Dienste eingerichtet und ausgeführt werden. Infrastruktur und Serverwartung sind für Sie kein Problem mehr.

Apify kümmert sich um alles. Aber was ist, wenn Sie nicht besonders geschickt im Schaben sind? Zweifellos kein Problem. Vorgefertigte Scraping-Akteure, bei denen es sich im Wesentlichen um konfigurierte und einsatzbereite Scraping-Prozesse handelt, können auf dem Apify-Marktplatz erworben werden.

Für eine Reihe von Websites und Anwendungsfällen, wie z Social-Networking-Plattformen und E-Commerce-Websites bietet der Markt Hunderte von Akteuren. Dadurch können Sie auf gebrauchsfertige Lösungen zurückgreifen, die Ihnen Zeit und Aufwand sparen.

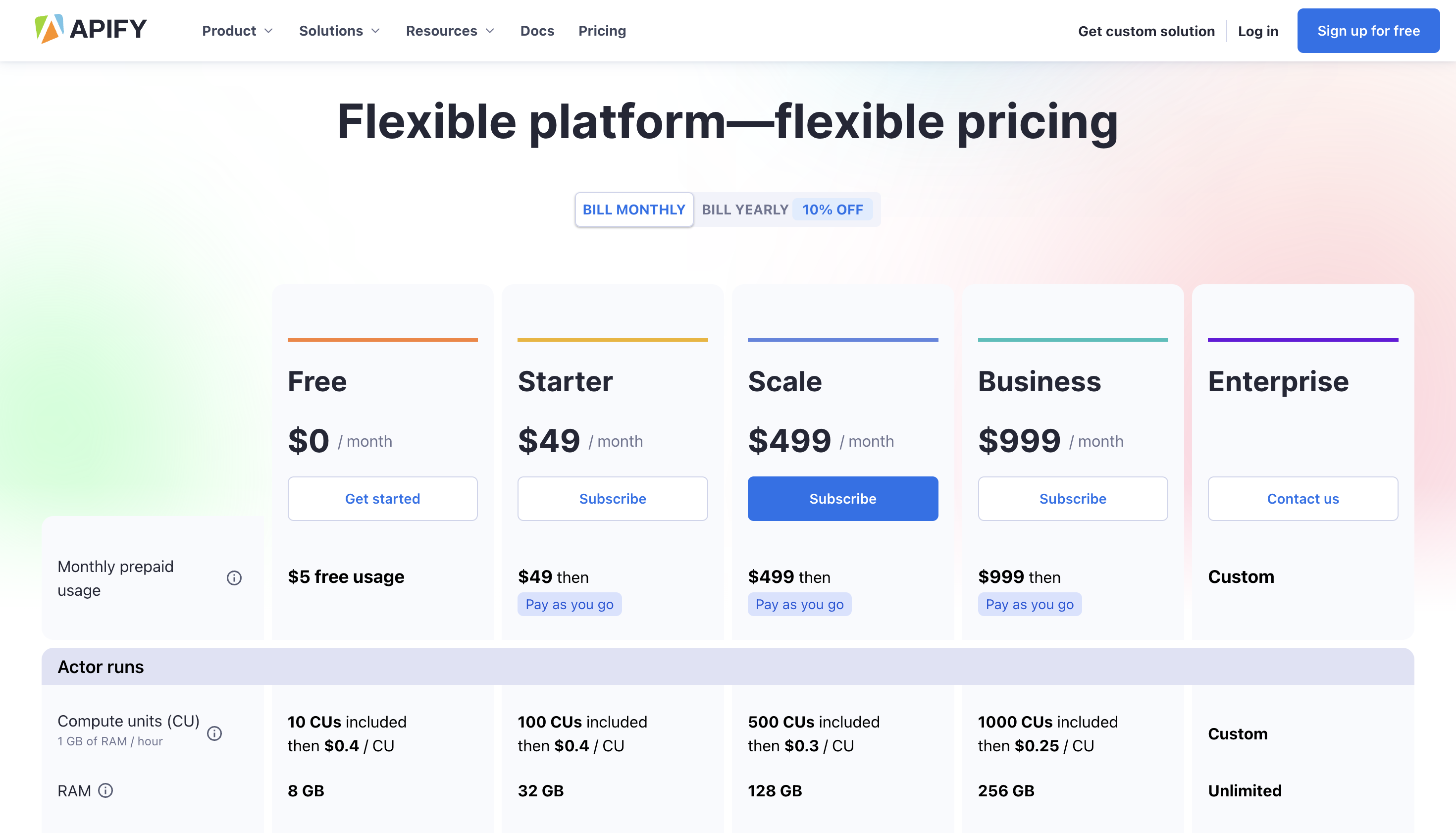

AnzeigenPreise

Sie können es kostenlos nutzen und die Premium-Preise beginnen bei 49 $/Monat.

10 ScrapingDog

Scrapingdog ist eine leistungsstarke browserbasierte Web-Scraping-Software. Ohne komplizierten Code oder die Einrichtung einer Infrastruktur können Sie mit Scrapingdog schnell und effektiv Daten von Websites sammeln. Es ist, als ob Ihnen ein leistungsstarker Schaber zur Verfügung stünde.

Die Schlüsselfunktionen von Scrapingdog, die das Web-Scraping vereinfachen, heben es von der Konkurrenz ab. Der erste Vorteil besteht darin, dass es eine benutzerfreundliche Oberfläche bietet, die das Durchsuchen von Websites und die Auswahl der zu extrahierenden Daten vereinfacht.

Welche Informationen Sie auch immer benötigen – Produktinformationen, Nachrichten oder irgendetwas anderes – Scrapingdog hat alles für Sie. Zweitens bietet Scrapingdog cleveres JavaScript-Rendering, mit dem Sie Informationen von Websites extrahieren können, die hauptsächlich auf JavaScript angewiesen sind, um Inhalte anzuzeigen.

Dadurch wird sichergestellt, dass Sie auch von dynamischen Webseiten aus auf den gesamten Inhalt zugreifen und ihn abrufen können. Darüber hinaus bietet Scrapingdog die Verwaltung von CAPTCHAs und nimmt Ihnen die lästigen Hindernisse ab.

Es beantwortet CAPTCHAs automatisch und spart Ihnen Zeit und Mühe. Darüber hinaus nutzt Scrapingdog die IP-Rotation, bei der IP-Adressen geändert werden, um zu verhindern, dass Websites Ihre Scraping-Vorgänge blockieren. Daher verläuft das Schaben reibungslos.

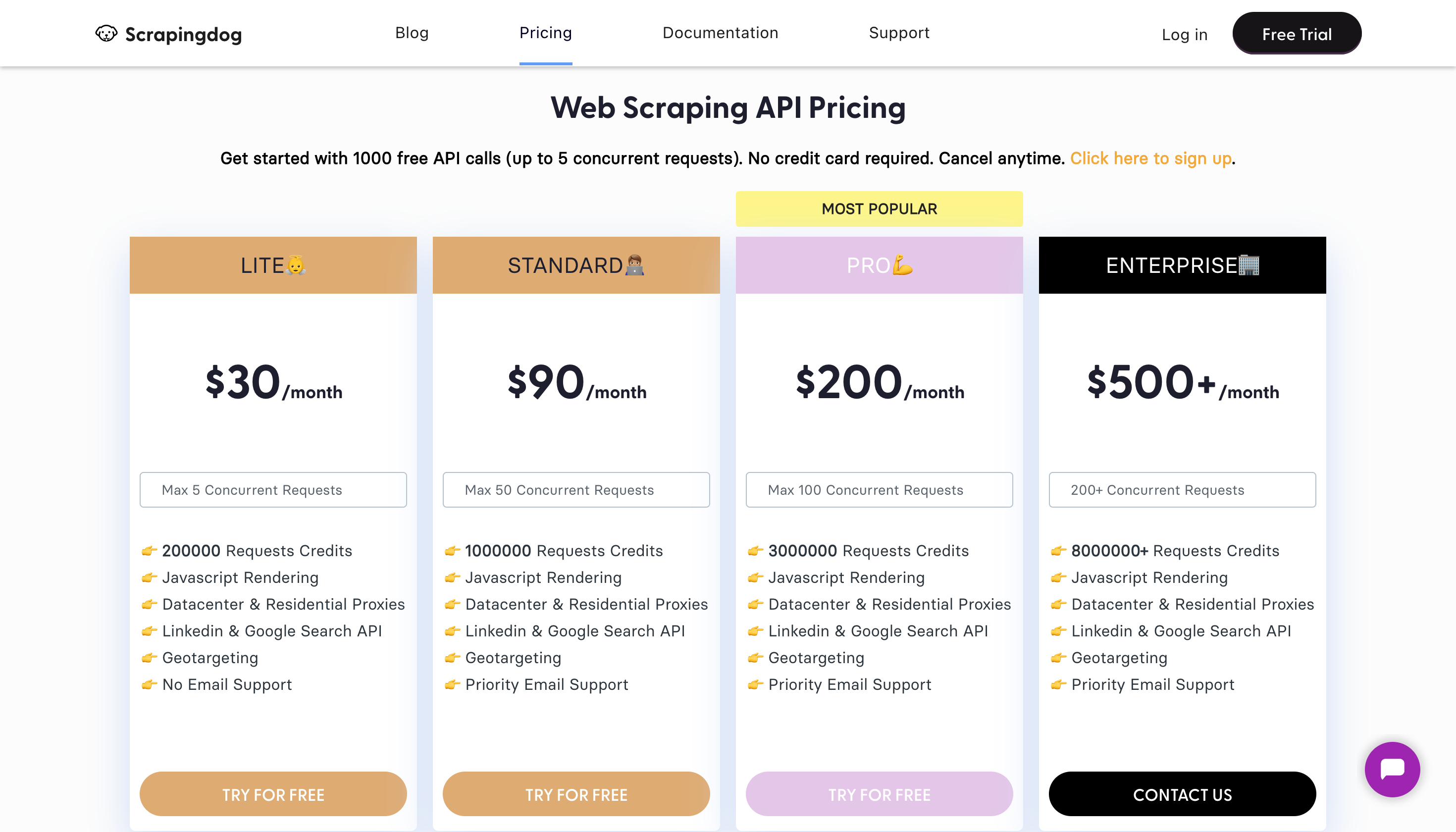

AnzeigenPreise

Die Premium-Preise beginnen bei 30 $/Monat.

11 Byteline

Byteline ist ein hervorragendes browserbasiertes Tool, das ausschließlich für Web-Scraping entwickelt wurde. Ohne langwierige Skripterstellung oder komplizierte Einrichtung können Sie mit Byteline schnell und einfach Daten von Websites abrufen.

Es bietet eine benutzerfreundliche Oberfläche, die es Ihnen erleichtert, Websites zu durchsuchen und die Daten auszuwählen, die Sie durchsuchen möchten. Byteline kann Ihnen bei der Erfassung jeglicher Art von Daten helfen, einschließlich Preisdetails, Kundenstimmen und anderen Informationen.

Dynamische Webseiten werden damit problemlos verwaltet. Sie können Daten von Websites extrahieren, die weitgehend auf dynamischen Inhalten basieren, da das JavaScript-Rendering mithilfe ausgefeilter Ansätze erfolgt. Dies bedeutet, dass Sie auf die aktuellsten verfügbaren Daten zugreifen und diese durchsuchen können.

Darüber hinaus verfügt Byteline über leistungsstarke Proxy- und IP-Rotationsfunktionen, mit denen Sie weitreichende Scraping-Funktionen durchführen können, ohne mit irgendwelchen Filtern in Konflikt zu geraten. Es stellt sicher, dass Ihre Scraping-Vorgänge ungehindert und in völliger Anonymität weiterlaufen. Darüber hinaus bietet Byteline Datenexportoptionen, mit denen Sie die abgerufenen Daten in anderen Formaten wie CSV oder Excel für zusätzliche Analysen oder Systemintegration speichern können.

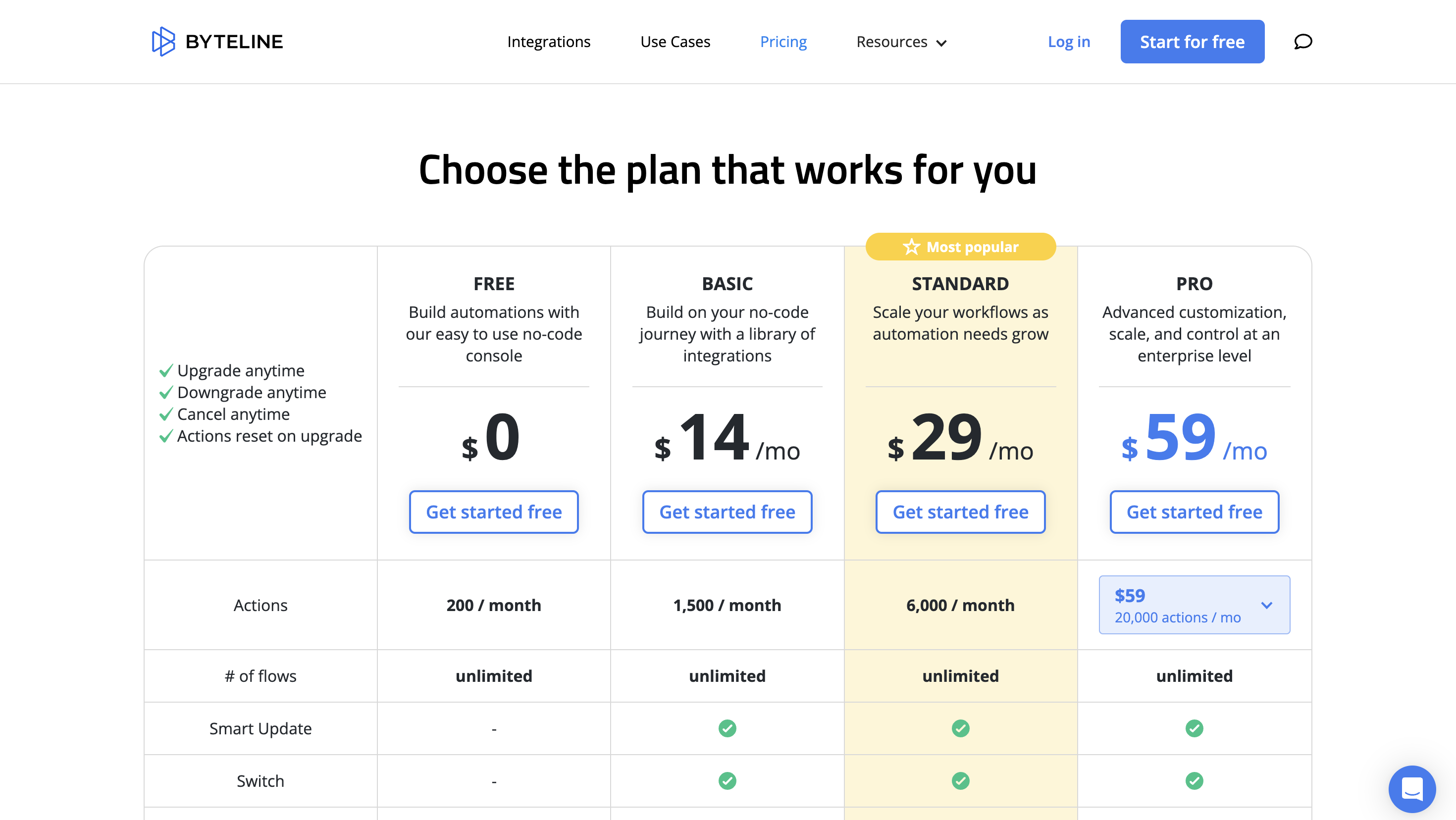

AnzeigenPreise

Sie können es kostenlos nutzen und die Premium-Preise beginnen bei 14 $/Monat.

12 Grepsr

Grepsr ist eine bemerkenswerte Web-Scraping-Software, die in einem Browser ausgeführt wird. Grepsr ist sowohl für Unternehmen als auch für Forscher ein nützliches Tool, da es Ihnen ermöglicht, Daten effizient und einfach von Websites zu extrahieren.

Sie müssen sich bei der Verwendung von Grepsr keine Gedanken über komplizierten Code oder die Einrichtung der Infrastruktur machen. Dank des Cloud-basierten Designs können Sie von jedem Ort mit Internetverbindung aus auf Ihre Scraping-Projekte zugreifen und diese verwalten.

Es nutzt hochentwickelte Online-Scraping-Technologien wie clevere Datenerkennungs- und Parsing-Algorithmen, um eine präzise und zuverlässige Datenextraktion zu gewährleisten. Grepsr verfügt außerdem über Planungsfunktionen, die es Ihnen ermöglichen, den Scraping-Vorgang zu automatisieren und in vorgegebenen Intervallen aktualisierte Daten zu erhalten.

Darüber hinaus werden verschiedene Datenexportformate wie CSV, Excel, JSON und XML unterstützt, sodass Sie die Freiheit haben, mit den Daten in dem von Ihnen gewählten Format zu arbeiten.

Sie können Daten selbst von den dynamischsten Websites extrahieren, da es für die Verarbeitung komplizierter Webseiten ausgelegt ist, einschließlich solcher mit JavaScript-basierter Inhaltswiedergabe.

AnzeigenPreise

Bitte kontaktieren Sie den Anbieter für die Preisgestaltung.

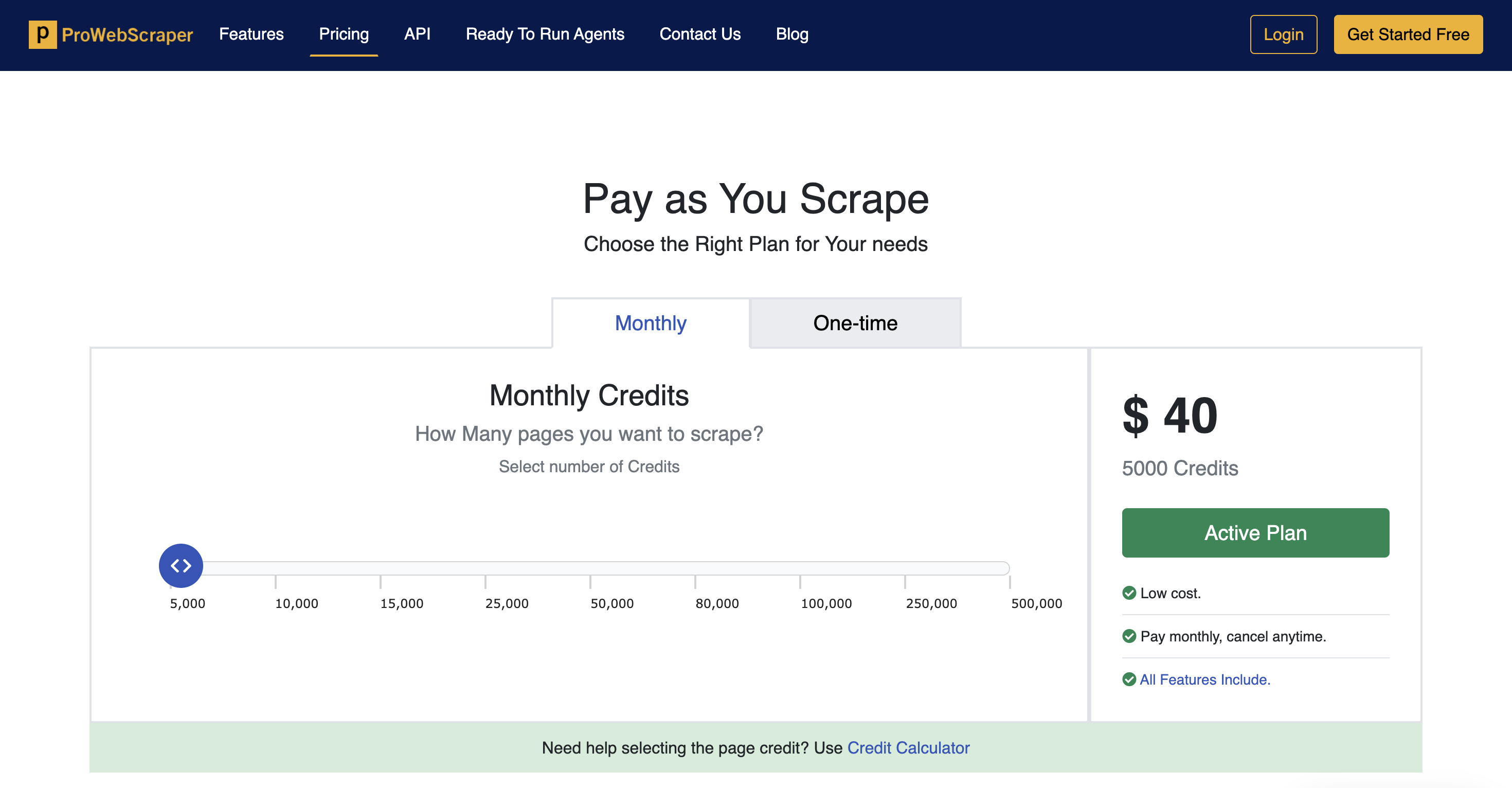

13 ProWebScraper

ProWebScraper ist eine benutzerfreundliche browserbasierte Web-Scraping-Technologie, die es Benutzern ermöglicht, schnell und einfach Daten von Websites zu extrahieren. Benutzer können Daten über die Point-and-Click-Schnittstelle extrahieren, ohne Code schreiben zu müssen.

Darüber hinaus verfügt die Plattform über ein intelligentes Datenextraktionstool, das Daten aus komplexen Websites erkennen und extrahieren kann. ProWebScraper bietet auch maßgeschneiderte Scraper für Websites, die eine anspruchsvolle Datenextraktion benötigen. Die Datenextraktion von Websites, die eine Anmeldung erfordern, ist eine Stärke von ProWebScraper.

Nach Eingabe ihrer Anmeldeinformationen können Einzelpersonen Daten von jeder Seite entfernen, auf die sie über die Plattform Zugriff haben. ProWebScraper bietet außerdem die Möglichkeit, Scrapes zu planen und zu automatisieren, sowie eine Vielzahl von Exportoptionen, einschließlich CSV-, Excel- und JSON-Formate.

ProWebScraper verwendet einen Webcrawler, um Informationen von Websites zu extrahieren. Der Crawler kann über mehrere Seiten hinweg navigieren und auch komplexe Webseiten bewältigen. ProWebScraper unterstützt weiter Proxy-ServerDies ermöglicht es Benutzern, heimlich Daten abzugreifen und IP-Beschränkungen zu umgehen. Die Software bietet außerdem eine automatische Datenvalidierung, um die Genauigkeit der extrahierten Daten sicherzustellen.

AnzeigenPreise

Sie können es kostenlos nutzen und die Premium-Preise beginnen bei 40 $ für 5000 Credits.

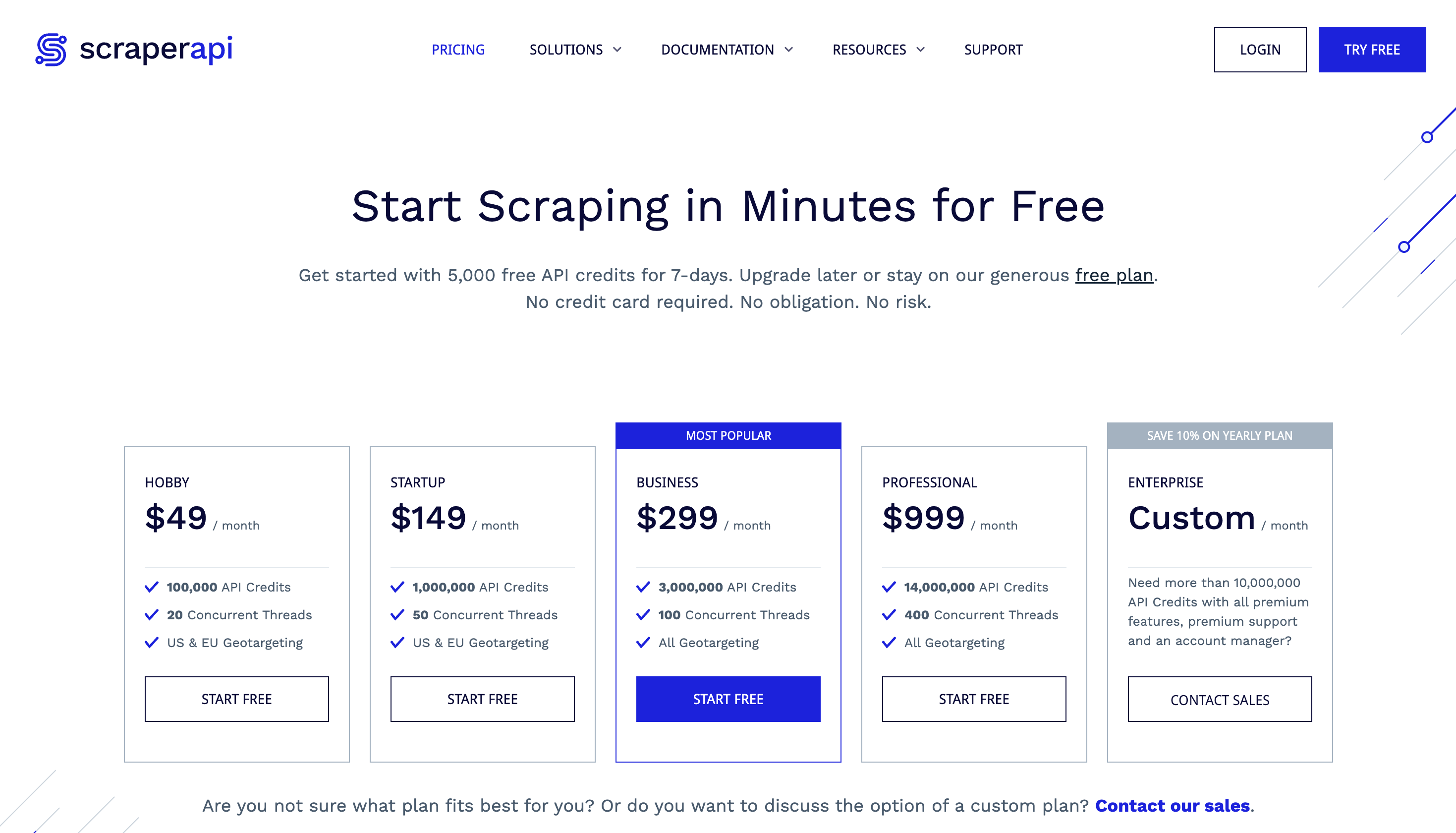

14 Scraping-API

Die Scraping-API-Plattform ist eine fantastische browserbasierte Lösung, die speziell für Web-Scraping-Anforderungen entwickelt wurde. Dank der benutzerfreundlichen Benutzeroberfläche können Sie mithilfe der Scraping-API schnell und einfach Daten von Websites extrahieren.

Die Scraping-API deckt Sie ab, egal ob Sie ein Anfänger oder ein erfahrener Web-Scraper sind. Mit Hilfe moderner Webbrowser-Engines nutzt es eine Headless-Browser-Technik, um Websites zu rendern, JavaScript auszuführen und die benötigten Daten abzurufen. Dadurch sind auch bei komplizierten Webseiten mit wechselndem Material präzise und zuverlässige Scraping-Ergebnisse gewährleistet.

Darüber hinaus können Sie Ihre bevorzugten Programmierkenntnisse mit der Scraping API nutzen, da sie eine Vielzahl von Programmiersprachen wie Python, JavaScript und PHP unterstützt.

Dank der robusten Funktionen, darunter Paginierungsverarbeitung, Formularübermittlung und Sitzungsverwaltung, können Sie Websites genau wie ein echter Benutzer erkunden und mit ihnen interagieren. Darüber hinaus bietet die Scraping-API eine nahtlose Proxy-Rotation, sodass Sie Webseiten in großem Umfang scrapen können, während Ihre IP-Adresse verschleiert und Sperren vermieden werden.

Um eine genaue Datenextraktion zu gewährleisten, bietet die Plattform außerdem leistungsstarke Fehlerverwaltungs- und Wiederholungsoptionen. Mit der Scraping-API können Sie mühelos Daten in verschiedenen Formen wie HTML, JSON und XML in Ihre Apps oder Datenbanken integrieren.

AnzeigenPreise

Die Premium-Preise beginnen bei 49 $/Monat.

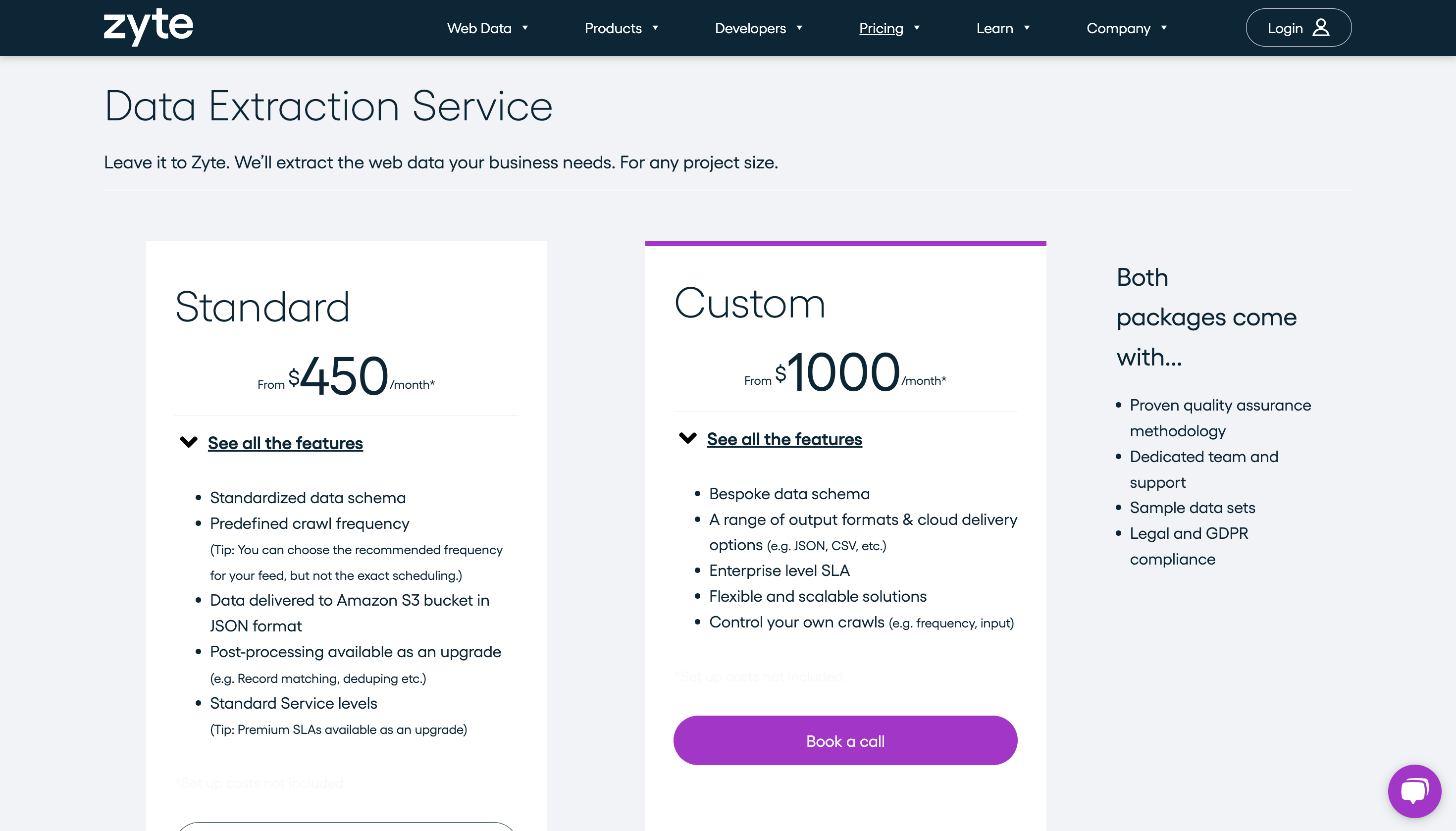

15 Zyte

Zyte ist eine browserbasierte Plattform, die ausschließlich für Web Scraping entwickelt wurde. Dank der benutzerfreundlichen Oberfläche können Benutzer schnell Websites durchsuchen und nützliche Daten abrufen, sodass keine komplizierte Codierung oder Infrastruktureinrichtung erforderlich ist.

Die Plattform nutzt eine Headless-Browser-Strategie und nutzt aktuelle Webbrowser-Engines, um Webseiten zu rendern, JavaScript auszuführen und Daten aus dynamischen Inhalten zu extrahieren. Dies sorgt für präzise und gründliche Scraping-Ergebnisse, selbst bei komplizierten Websites.

Darüber hinaus bietet Zyte eine Vielzahl von Funktionen, wie z. B. ausgefeilte Datenvalidierung, intelligente Datenextraktion und starke Fehlerbehandlungsmethoden, um den Scraping-Prozess zu verbessern.

Darüber hinaus unterstützt Zyte eine Reihe von Codesprachen, darunter Python, JavaScript und Ruby, sodass Benutzer ihre bevorzugten Programmierkenntnisse nutzen können.

Mit Zyte müssen Sie weder Server verwalten noch sich Gedanken über die Skalierbarkeit machen, da Sie Ihre Scraping-Projekte mithilfe der Cloud-Infrastruktur mühelos verwalten und erweitern können.

Darüber hinaus verfügt Zyte über eine integrierte Proxy-Verwaltung, die es Benutzern ermöglicht, ihre Anfragen über eine Vielzahl von Proxys zu leiten, um die Anonymität zu wahren und IP-Verbote zu vermeiden. Darüber hinaus bietet es eine nahtlose Interaktion mit einer Vielzahl von Datenspeicherformaten und -systemen, einschließlich Datenbanken und APIs, wodurch die Speicherung und Verarbeitung der gesammelten Daten vereinfacht wird.

AnzeigenPreise

Die Premium-Preise beginnen bei 450 $/Monat.

Zusammenfassung

Zusammenfassend lässt sich sagen, dass die Erschließung des Potenzials des Online-Scrapings und die Gewinnung datengesteuerter Erkenntnisse von der Auswahl der geeigneten Web-Scraping-Plattform abhängt, die Ihren individuellen Anforderungen entspricht. Da so viele Alternativen zur Verfügung stehen, ist es wichtig, Aspekte wie Benutzerfreundlichkeit, Datenextraktionsfähigkeit, API-Integration und mehr zu berücksichtigen.

Bright Data ist eine Plattform, die sich durch ihr starkes Proxy-Netzwerk, ihre intuitive Benutzeroberfläche und modernste Funktionen wie automatische Datenextraktion, Datenvalidierung und Antiblocking-Methoden auszeichnet. Unternehmen können mit Bright Data problemlos auf riesige Mengen an Online-Daten zugreifen und sich damit einen Wettbewerbsvorteil in ihren Märkten verschaffen.

Schauen Sie sich also unbedingt Bright Data an und entdecken Sie, wie es Ihnen beim Erreichen Ihrer Datenziele helfen kann, wenn Sie nach einer vollständigen und zuverlässigen Web-Scraping-Lösung suchen.

Hinterlassen Sie uns einen Kommentar