Inhaltsverzeichnis[Ausblenden][Zeigen]

Sensoren und Software werden in autonomen Fahrzeugen kombiniert, um eine Vielzahl von Fahrzeugen zu navigieren, zu lenken und zu betreiben, darunter Motorräder, Autos, Lastwagen und Drohnen.

Je nachdem, wie sie entwickelt oder konstruiert wurden, benötigen sie möglicherweise Fahrerassistenz oder nicht.

Vollständig autonome Autos können ohne menschliche Fahrer sicher betrieben werden. Einige wie Googles Waymo Auto, konnte nicht einmal ein Lenkrad haben.

Ein teilautonomes Fahrzeug, wie z Tesla, kann die vollständige Kontrolle über das Fahrzeug übernehmen, benötigt jedoch möglicherweise einen menschlichen Fahrer zur Unterstützung, wenn das System in Zweifel gerät.

In diesen Autos sind verschiedene Grade der Selbstautomatisierung enthalten, von der Spurführung und Bremshilfe bis hin zu völlig unabhängigen, selbstfahrenden Prototypen.

Das Ziel fahrerloser Autos ist es, den Verkehr, die Emissionen und die Unfallraten zu senken.

Das ist möglich, weil autonome Fahrzeuge die Verkehrsregeln besser einhalten als Menschen.

Für eine reibungslose Fahrt sind bestimmte Informationen erforderlich, wie z. B. der Standort des Autos oder von Objekten in der Nähe, der kürzeste und sicherste Weg zum Ziel und die Fähigkeit, das Fahrsystem zu bedienen.

Es ist entscheidend zu verstehen, wann und wie notwendige Aufgaben auszuführen sind.

Dieser Artikel wird viele Bereiche abdecken, einschließlich der Systemarchitektur für autonome Autos, erforderliche Komponenten und Fahrzeug-Ad-hoc-Netzwerke (VANETs).

Notwendige Komponenten, die für autonome Fahrzeuge erforderlich sind

Heutige autonome Fahrzeuge verwenden eine Vielzahl von Sensoren, darunter Kameras, GPS, Trägheitsmesseinheiten (IMUs), Sonar, Laserbeleuchtungserkennung und -reichweite (Lidar), Funkerkennung und -entfernung (Radar), Schallnavigation und Entfernungsmessung (Sonar) und 3D-Karten.

Zusammen analysieren diese Sensoren und Technologien Daten in Echtzeit, um Lenkung, Beschleunigung und Bremsen zu steuern.

Die Radarsensoren helfen dabei, den Aufenthaltsort umstehender Autos zu verfolgen. Fahrzeuge werden mit Ultraschallsensoren beim Einparken unterstützt.

Eine als Lidar bekannte Technologie wurde durch die Verwendung beider Arten von Sensoren entwickelt. Durch Reflektieren von Lichtimpulsen aus der Umgebung des Fahrzeugs können Lidar-Sensoren die Ränder von Fahrbahnen erkennen und Fahrbahnmarkierungen identifizieren.

Diese warnen den Fahrer auch vor benachbarten Hindernissen wie anderen Fahrzeugen, Fußgängern und Fahrrädern.

Die Größe und Entfernung von allem um das Auto herum werden mit Lidar-Technologie gemessen, die auch eine 3D-Karte erstellt, die es dem Fahrzeug ermöglicht, seine Umgebung zu sehen und Risiken zu erkennen.

Unabhängig von der Tageszeit, ob hell oder dunkel, zeichnet es Informationen bei unterschiedlichem Umgebungslicht hervorragend auf.

Das Automobil verwendet Kameras, Radar und GPS-Antennen zusammen mit Lidar und Kameras, um seine Umgebung zu erfassen und seinen Standort zu bestimmen.

Kameras suchen nach Fußgängern, Radfahrern, Autos und anderen Hindernissen, während sie gleichzeitig Verkehrssignale erkennen, Straßenschilder und -markierungen lesen und andere Fahrzeuge im Auge behalten.

In dunklen oder schattigen Bereichen könnten sie es jedoch schwer haben. Ein autonomes Fahrzeug kann sehen, wohin es fährt, indem es eine Mischung aus Lidar, Radar, Kameras, GPS-Antennen und Ultraschallsensoren verwendet, um die Straße vor ihm digital zu kartieren.

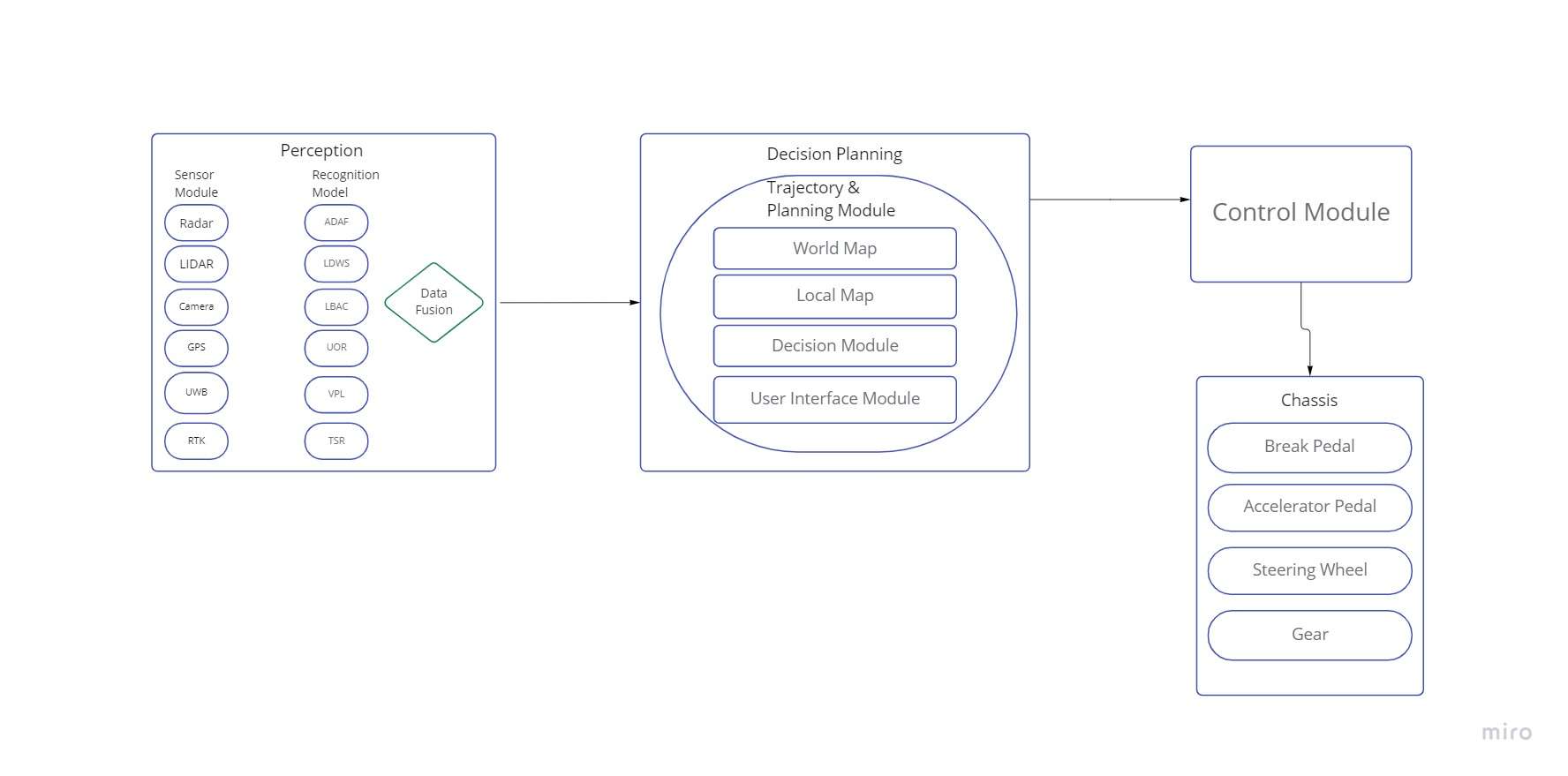

High-Level-Systemarchitektur

Die wesentlichen Sensoren, Aktoren, Hardware und Software sind in der Architektur aufgeführt, die auch den gesamten Kommunikationsmechanismus oder das Protokoll in AVs demonstriert.

Wahrnehmung

Diese Stufe umfasst das Identifizieren der Position des AV in Bezug auf die Umgebung und das Erfassen der Umgebung um das AV herum unter Verwendung einer Vielzahl von Sensoren.

Das AV verwendet in diesem Schritt RADAR, LIDAR, Kamera, Echtzeit-Kinetik (RTK) und andere Sensoren. Die Erkennungsmodule empfangen die Daten dieser Sensoren und verarbeiten sie nach der Weitergabe.

Im Allgemeinen besteht das AV aus einem Steuersystem, LDWS, TSR, Erkennung unbekannter Hindernisse (UOR), einem Modul zur Fahrzeugpositionierung und -lokalisierung (VPL) usw.

Die kombinierten Informationen werden nach der Verarbeitung der Phase der Entscheidungsfindung und Planung zugeführt.

Entscheidung & Planung

Die Bewegungen und das Verhalten des AV werden in diesem Schritt unter Verwendung der während des Wahrnehmungsprozesses erhaltenen Informationen entschieden, geplant und gesteuert.

In dieser Phase, die das Gehirn darstellen würde, werden Entscheidungen über Dinge wie Wegplanung, Aktionsvorhersage, Hindernisvermeidung usw. getroffen.

Die Auswahl basiert auf den Informationen, die jetzt und in der Vergangenheit zugänglich sind, einschließlich Echtzeit-Kartendaten, Verkehrsdaten, Trends, Benutzerinformationen usw.

Es könnte ein Datenprotokollmodul geben, das Fehler und Daten zur späteren Verwendung aufzeichnet.

Control

Das Steuermodul führt Operationen/Aktionen in Bezug auf die physikalische Steuerung des AV aus, wie Lenken, Bremsen, Beschleunigen usw., nachdem es Informationen von dem Entscheidungs- und Planungsmodul empfangen hat.

Chassis

Im letzten Schritt erfolgt die Interaktion mit den am Chassis befestigten mechanischen Teilen wie Getriebemotor, Lenkradmotor, Bremspedalmotor und Pedalmotoren für Gas und Bremse.

Das Steuermodul signalisiert und verwaltet all diese Komponenten.

Jetzt werden wir über die allgemeine Kommunikation eines AV sprechen, bevor wir über das Design, den Betrieb und die Verwendung verschiedener Schlüsselsensoren sprechen.

RADAR

In AVs werden RADARs verwendet, um die Umgebung zu scannen, um Autos und andere Objekte zu finden und zu lokalisieren.

Radargeräte werden häufig sowohl für militärische als auch für zivile Zwecke eingesetzt, wie z. B. Flughäfen oder meteorologische Systeme, und sie arbeiten im Millimeterwellen-(mm-Wellen-)Spektrum.

Verschiedene Frequenzbänder, darunter 24, 60, 77 und 79 GHz, werden in modernen Automobilen verwendet und haben eine Messreichweite von 5 bis 200 m [10].

Durch die Berechnung der ToF zwischen dem gesendeten Signal und dem zurückgesendeten Echo wird die Entfernung zwischen dem AV und dem Objekt bestimmt.

In AVs verwenden die RADARs eine Reihe von Mikroantennen, die eine Sammlung von Keulen erstellen, um die Entfernungsauflösung und die Identifizierung mehrerer Ziele zu verbessern. mm-Wellenradar kann Objekte im Nahbereich in jeder Richtung präzise beurteilen, indem es die Varianz der Dopplerverschiebung aufgrund seiner erhöhten Durchlässigkeit und größeren Bandbreite nutzt.

Da mm-Wellen-Radare eine längere Wellenlänge haben, verfügen sie über Anti-Blockier- und Anti-Verschmutzungs-Fähigkeiten, die es ihnen ermöglichen, bei Regen, Schnee, Nebel und schwachem Licht zu funktionieren.

Zusätzlich kann die Doppler-Verschiebung verwendet werden, um die Relativgeschwindigkeit über mm-Wellen-Radare zu berechnen. Aufgrund ihrer Leistungsfähigkeit eignen sich mm-Wellen-Radare gut für eine Vielzahl von AV-Anwendungen, einschließlich Hinderniserkennung und Fußgänger- und Fahrzeugerkennung.

Ultraschallsensoren

Diese Sensoren arbeiten im Bereich von 20–40 kHz und verwenden Ultraschallwellen. Eine magnetoresistive Membran, mit der die Entfernung des Objekts gemessen wird, erzeugt diese Wellen.

Durch Berechnung der Laufzeit (ToF) der ausgesendeten Welle zum Echosignal wird die Entfernung bestimmt. Die typische Reichweite von Ultraschallsensoren beträgt weniger als 3 Meter.

Die Sensorausgabe wird alle 20 ms aktualisiert, was verhindert, dass sie den strengen QoS-Anforderungen des ITS entspricht. Diese Sensoren haben einen relativ kleinen Strahlerfassungsbereich und sind gerichtet.

Um eine Vollfeldsicht zu erhalten, sind daher zahlreiche Sensoren erforderlich. Viele Sensoren interagieren jedoch und können zu erheblichen Entfernungsungenauigkeiten führen.

LiDAR

Bei LiDAR werden die Spektren von 905 und 1550 nm verwendet. Da das menschliche Auge für Netzhautschäden aus dem 905-nm-Bereich anfällig ist, arbeitet das aktuelle LiDAR im 1550-nm-Band, um Netzhautschäden zu reduzieren.

Bis zu 200 Meter beträgt die maximale Reichweite von LiDAR. Festkörper-, 2D- und 3D-LiDAR sind die verschiedenen Unterkategorien von LiDAR.

In einem 2D-LiDAR wird ein einzelner Laserstrahl über einen Spiegel gestreut, der sich schnell dreht. Durch die Platzierung mehrerer Laser auf dem Pod kann ein 3D-LiDAR ein 3D-Bild der Umgebung erfassen.

Es wurde nachgewiesen, dass ein straßenseitiges LiDAR-System die Anzahl der Fahrzeug-zu-Fußgänger-Kollisionen (V2P) sowohl in kreuzenden als auch in nicht kreuzenden Zonen senkt.

Es verwendet ein recheneffizientes Echtzeit-LiDAR-System mit 16 Zeilen.

Es wird empfohlen, einen tiefen Auto-Encoder künstlich zu verwenden neuronale Netzwerk (DA-ANN), das eine Genauigkeit von 95 % über eine Reichweite von 30 m erreicht.

In wird gezeigt, wie ein auf einer Support-Vektor-Maschine (SVM) basierender Algorithmus in Kombination mit einem 64-zeiligen 3D-LiDAR die Fußgängererkennung verbessern kann.

Obwohl LiDAR eine bessere Messpräzision und 3D-Sicht als ein mm-Wellen-Radar hat, schneidet es bei widrigem Wetter wie Nebel, Schnee und Regen weniger gut ab.

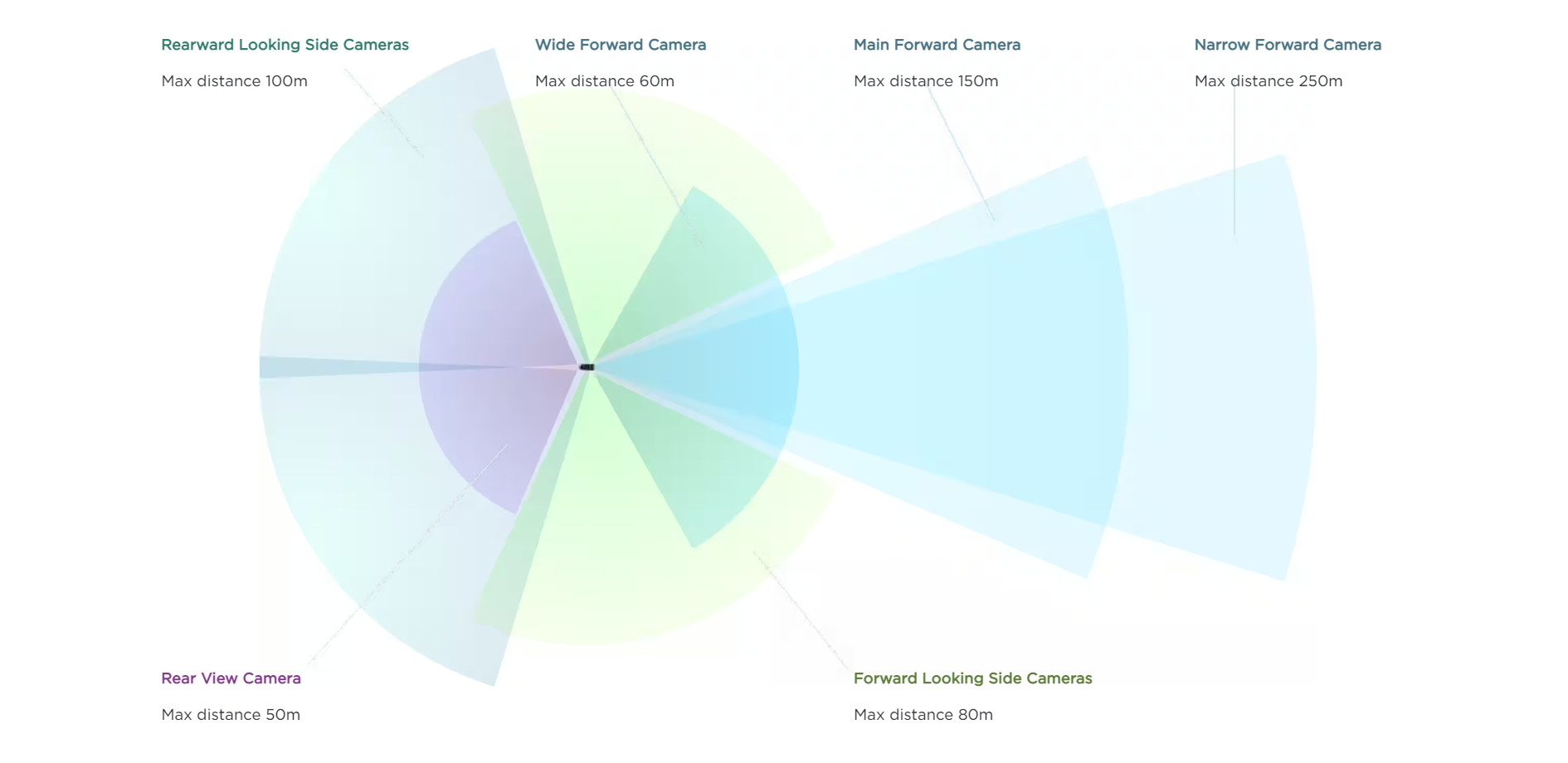

Kameras

Abhängig von der Wellenlänge des Geräts kann die Kamera in AVs entweder auf Infrarot oder auf sichtbarem Licht basieren.

In der Kamera (CMOS) werden Bildsensoren mit ladungsgekoppelten Bauelementen (CCD) und komplementären Metalloxid-Halbleitern (CMOS) verwendet.

Je nach Objektivqualität liegt die maximale Reichweite der Kamera bei etwa 250 m. Die drei Bänder, die von sichtbaren Kameras verwendet werden – Rot, Grün und Blau – sind durch die gleiche Wellenlänge wie das menschliche Auge oder 400–780 nm (RGB) getrennt.

Zwei VIS-Kameras werden mit etablierten Brennweiten gekoppelt, um einen neuen Kanal zu erzeugen, der Tiefeninformationen (D) enthält, was die Erzeugung einer stereoskopischen Sicht ermöglicht.

Dank dieser Fähigkeit kann über die Kamera (RGB-D) eine 3D-Ansicht des Umfelds des Fahrzeugs gewonnen werden.

Von der Infrarot (IR)-Kamera werden passive Sensoren mit einer Wellenlänge zwischen 780 nm und 1 mm verwendet. Bei maximaler Beleuchtung bieten die IR-Sensoren in AVs eine visuelle Kontrolle.

Diese Kamera unterstützt AVs mit Objekterkennung, Seitenansichtskontrolle, Unfallaufzeichnung und BSD. Bei widrigem Wetter wie Schnee, Nebel und wechselnden Lichtverhältnissen ändert sich jedoch die Leistung der Kamera.

Die Hauptvorteile einer Kamera sind ihre Fähigkeit, die Textur, Farbverteilung und Form der Umgebung präzise zu erfassen und aufzuzeichnen.

Globales Navigationssatellitensystem und globales Positionsbestimmungssystem, Trägheitsmesseinheit

Diese Technologie unterstützt das AV bei der Navigation, indem es seinen genauen Standort bestimmt. Eine Gruppe von Satelliten im Orbit um die Oberfläche des Planeten wird von GNSS zur Lokalisierung verwendet.

Das System speichert Daten über den Standort, die Geschwindigkeit und die genaue Zeit des AV.

Es funktioniert, indem es die ToF zwischen dem empfangenen Signal und der Emission des Satelliten ermittelt. Die Koordinaten des Global Positioning System (GPS) werden oft verwendet, um den AV-Standort zu erhalten.

Die aus dem GPS extrahierten Koordinaten sind nicht immer genau und fügen typischerweise einen Positionsfehler mit einem Mittelwert von 3 m und einer Standardabweichung von 1 m hinzu.

In Großstadtsituationen wird die Leistung weiter verschlechtert, mit einem Positionsfehler von bis zu 20 m, und unter bestimmten schwierigen Umständen beträgt der GPS-Positionsfehler ungefähr 100 m.

Darüber hinaus können AVs das RTK-System verwenden, um die Position des Fahrzeugs genau zu bestimmen.

In AVs kann die Position und Richtung des Fahrzeugs auch mithilfe von Koppelnavigation (DR) und der Trägheitsposition bestimmt werden.

Sensorfusion

Für eine ordnungsgemäße Fahrzeugverwaltung und -sicherheit müssen AVs genaue Echtzeitinformationen über den Standort, den Status und andere Fahrzeugfaktoren wie Gewicht, Stabilität, Geschwindigkeit usw. erhalten.

Diese Informationen müssen von den AVs unter Verwendung einer Vielzahl von Sensoren gesammelt werden.

Durch Zusammenführen der von mehreren Sensoren erfassten Daten wird die Sensorfusionstechnik verwendet, um kohärente Informationen zu erzeugen.

Das Verfahren ermöglicht die Synthese von unverarbeiteten Daten, die aus komplementären Quellen stammen.

Infolgedessen ermöglicht die Sensorfusion dem AV, seine Umgebung genau zu verstehen, indem alle nützlichen Daten, die von verschiedenen Sensoren gesammelt wurden, zusammengeführt werden.

Verschiedene Arten von Algorithmen, einschließlich Kalman-Filter und Bayes-Filter, werden verwendet, um den Fusionsprozess in AVs durchzuführen.

Da es in mehreren Anwendungen verwendet wird, darunter Radarverfolgung, Satellitennavigationssysteme und optische Odometrie, wird der Kalman-Filter als entscheidend für den autonomen Betrieb eines Fahrzeugs angesehen.

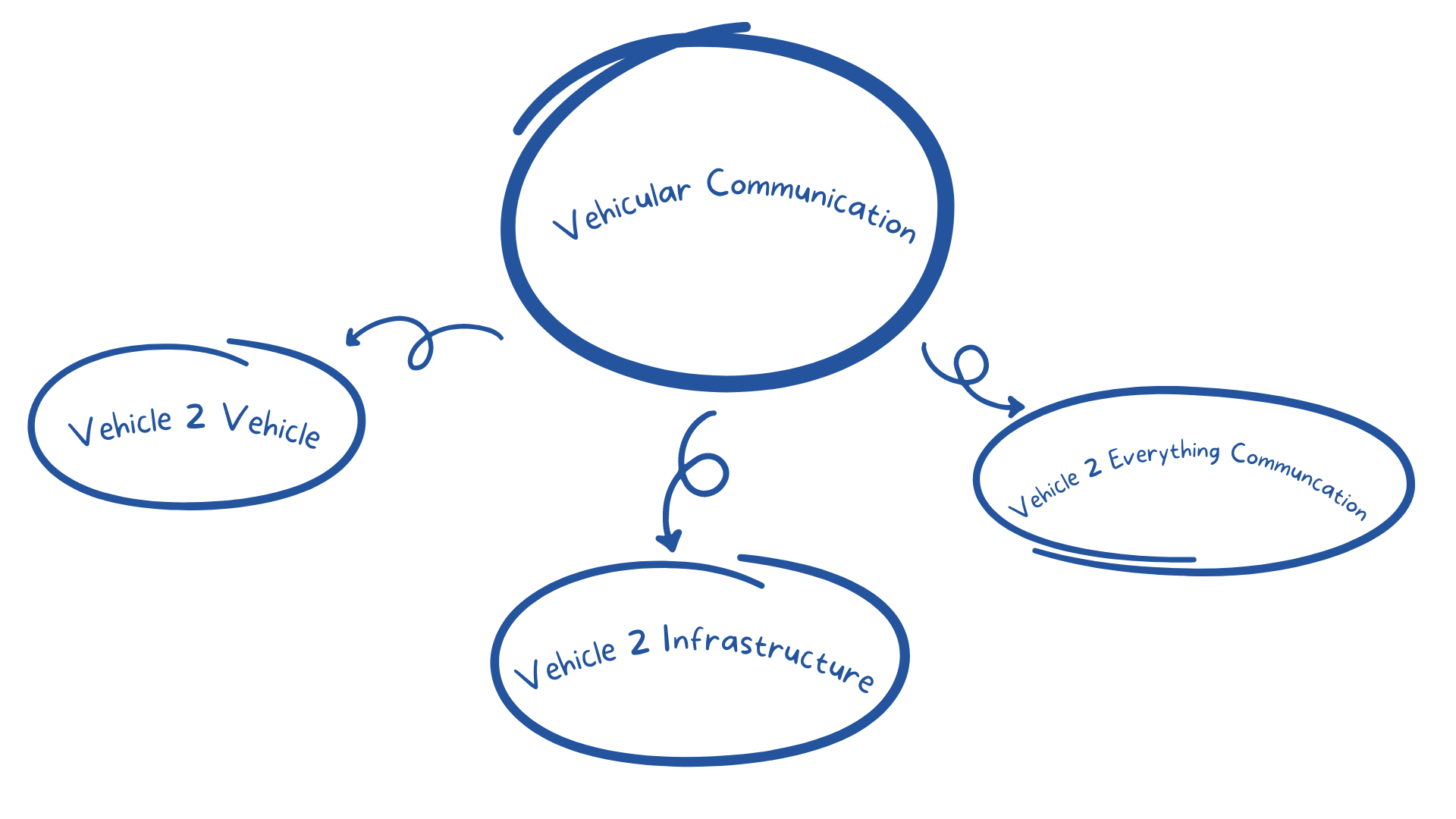

Fahrzeug-Ad-Hoc-Netzwerke (VANETs)

VANETs sind eine neue Unterklasse mobiler Ad-hoc-Netzwerke, die spontan ein Netzwerk mobiler Geräte/Fahrzeuge erstellen können. Fahrzeug-zu-Fahrzeug (V2V)- und Fahrzeug-zu-Infrastruktur (V2I)-Kommunikation sind mit VANETs möglich.

Das primäre Ziel dieser Technologie ist die Erhöhung der Verkehrssicherheit; Beispielsweise können Autos in gefährlichen Situationen wie Unfällen und Staus miteinander und mit dem Netzwerk interagieren, um wichtige Informationen weiterzuleiten.

Die folgenden sind die Hauptkomponenten der VANET-Technologie:

- OBU (On-Board Unit): Es ist ein GPS-basiertes Ortungssystem, das in jedem Fahrzeug platziert ist und es ihnen ermöglicht, miteinander und mit Roadside Units (RSU) zu interagieren. Die OBU ist mit mehreren elektronischen Komponenten ausgestattet, einschließlich eines Ressourcenbefehlsprozessors (RCP), Sensorgeräten und Benutzeroberflächen, um wichtige Informationen zu erhalten. Sein Hauptzweck ist die Verwendung eines drahtlosen Netzwerks zur Kommunikation zwischen mehreren RSUs und OBUs.

- Roadside Unit (RSU): RSUs sind fest installierte Computereinheiten, die an präzisen Punkten auf Straßen, Parkplätzen und Kreuzungen positioniert werden. Sein Hauptziel ist es, autonome Fahrzeuge mit der Infrastruktur zu verbinden, und es hilft auch bei der Fahrzeuglokalisierung. Zusätzlich kann es verwendet werden, um ein Fahrzeug mit anderen RSUs unter Verwendung verschiedener zu verbinden Netzwerktopologien. Darüber hinaus wurden sie mit Umgebungsenergiequellen, einschließlich Solarenergie, betrieben.

- Trusted Authority (TA): Dies ist eine Stelle, die jeden Schritt des VANET-Prozesses kontrolliert und sicherstellt, dass nur legitime RSUs und Fahrzeug-OBUs sich registrieren und interagieren können. Durch Bestätigung der OBU-ID und Authentifizierung des Fahrzeugs bietet es Sicherheit. Darüber hinaus findet es schädliche Kommunikation und seltsames Verhalten.

VANETs werden für die Fahrzeugkommunikation verwendet, die die V2V-, V2I- und V2X-Kommunikation umfasst.

Fahrzeug 2 Fahrzeugkommunikation

Die Fähigkeit von Autos, miteinander zu sprechen und wichtige Informationen über Verkehrsstaus, Unfälle und Geschwindigkeitsbeschränkungen auszutauschen, wird als Inter-Vehicle Communication (IVC) bezeichnet.

Die V2V-Kommunikation kann das Netzwerk erstellen, indem verschiedene Knoten (Fahrzeuge) mithilfe einer entweder teilweisen oder vollständigen Mesh-Topologie miteinander verbunden werden.

Sie werden als Single-Hop- (SIVC) oder Multi-Hop- (MIVC) Systeme kategorisiert, je nachdem, wie viele Hops für die Kommunikation zwischen Fahrzeugen verwendet werden.

Während das MIVC für Langstreckenkommunikation wie Verkehrsüberwachung verwendet werden kann, kann das SIVC für Nahbereichsanwendungen wie Spurverschmelzung, ACC usw. verwendet werden.

Zahlreiche Vorteile, darunter BSD, FCWS, automatisierte Notbremsung (AEB) und LDWS, werden durch die V2V-Kommunikation angeboten.

Fahrzeug 2 Infrastrukturkommunikation

Die Automobile können mit den RSUs über einen Prozess kommunizieren, der als Roadside-to-Vehicle Communication (RVC) bekannt ist. Es hilft bei der Erkennung von Parkuhren, Kameras, Fahrbahnmarkierungen und Ampeln.

Ad-hoc, drahtlose und bidirektionale Verbindung zwischen den Autos und der Infrastruktur.

Zur Verwaltung und Überwachung des Verkehrs werden die Daten der Infrastruktur verwendet. Sie werden verwendet, um verschiedene Geschwindigkeitsparameter anzupassen, die es den Autos ermöglichen, den Kraftstoffverbrauch zu maximieren und den Verkehrsfluss zu steuern.

Das RVC-System kann in das Sparse-RVC (SRVC) und das Ubiquitous-RVC-abhängig von der Infrastruktur (URVC) unterteilt werden.

Das SRVC-System bietet nur an Hotspots Kommunikationsdienste an, um beispielsweise freie Parkplätze oder Tankstellen zu finden, während das URVC-System eine Abdeckung auf der gesamten Strecke auch bei hohen Geschwindigkeiten bietet.

Um die Netzabdeckung zu garantieren, erfordert das URVC-System eine große Investition.

Fahrzeug 2 Alles Kommunikation

Das Auto kann sich über V2X mit anderen Entitäten verbinden, einschließlich Fußgängern, Objekten am Straßenrand, Geräten und dem Grid (V2P, V2R und V2D) (V2G).

Durch diese Art der Kommunikation können Autofahrer vermeiden, gefährdete Fußgänger, Fahrrad- und Motorradfahrer zu treffen.

Das Pedestrian Collision Warning (PCW)-System kann den Fahrer dank V2X-Kommunikation vor einem Straßenpassagier warnen, bevor es zu einer katastrophalen Kollision kommt.

Um dem Fußgänger wichtige Nachrichten zu übermitteln, kann das PCW Bluetooth oder Near Field Communication (NFC) des Smartphones nutzen.

Zusammenfassung

Die vielen Technologien, die zum Bau autonomer Autos verwendet werden, können einen großen Einfluss auf deren Betrieb haben.

Im Grunde entwickelt das Auto mithilfe einer Reihe von Sensoren eine Karte seiner Umgebung, die Informationen über die Route um es herum und andere Fahrzeuge auf seinem Weg liefert.

Diese Daten werden dann von einem komplizierten maschinellen Lernsystem analysiert, das eine Reihe von Aktionen generiert, die das Auto ausführen soll. Diese Verhaltensweisen werden regelmäßig geändert und aktualisiert, wenn das System mehr über die Umgebung des Fahrzeugs erfährt.

Trotz meiner Bemühungen, Ihnen einen Überblick über die Systemarchitektur autonomer Fahrzeuge zu geben, passiert noch viel mehr hinter den Kulissen.

Ich hoffe aufrichtig, dass Sie dieses Wissen wertvoll finden und davon Gebrauch machen.

Hinterlassen Sie uns einen Kommentar