Inhaltsverzeichnis[Ausblenden][Zeigen]

KI hat unsere Umwelt völlig verändert, und die Open-Source-Community hat maßgeblich zu dieser Veränderung beigetragen.

Stellen Sie sich eine Gesellschaft vor, in der Erfindungen frei ausgetauscht werden, Ideen frei fließen können und in der es praktisch keine Eintrittsbarrieren gibt.

Hier ist Open-Source-KI zu finden.

Entwickler, Wissenschaftler und Enthusiasten arbeiten in diesem dynamischen Ökosystem zusammen, um Technologien zu entwickeln, die unsere Zukunft verändern. Entdecken Sie dieses aufregende Universum, wo künstliche Intelligenz ist eine gemeinsame Anstrengung vieler und nicht die ausschließliche Domäne einiger weniger Auserwählter.

Die Entwicklung der KI war geradezu bemerkenswert. Künstliche Intelligenz hat von ihren Anfängen in der Mitte des 20. Jahrhunderts bis zu ihrer heutigen Stellung als Säule der Technologie einen langen Weg zurückgelegt.

Dieser Fortschritt wurde größtenteils von der Open-Source-Community vorangetrieben.

Projekte wie Googles TensorFlow sind ein gutes Beispiel dafür. TensorFlow ist mehr als nur ein Tool, es ist ein Katalysator, der mehrere KI-Initiativen ermöglicht, die Forschung beschleunigt und den Weg für Innovationen ebnet.

Sein Einfluss kann in einer Vielzahl von Anwendungen beobachtet werden, wie z Predictive analytics und Sprachverarbeitung.

Was genau ist also Open-Source-KI?

KI hat es für jedermann zugänglich gemacht. KI-Technologien können dank Open-Source-Plattformen von jedem genutzt, verändert und geteilt werden. Diese Plattformen haben aus Websites wie GitHub lebendige Zentren für KI-Innovation geschaffen.

Hier ist alles verfügbar und kann frei geteilt werden, von einfachen KI-Modellen bis hin zu komplexen Algorithmen. Diese Strategie fördert die Teamarbeit, stimuliert die Kreativität und macht KI einem größeren Publikum zugänglich.

Die Vorteile der Verwendung von Open-Source-KI sind erheblich. Gerade Start-ups haben viel zu gewinnen. Stellen Sie sich ein kleines Technologieunternehmen mit vielen Ideen, aber keiner Finanzierung vor.

Dank Open-Source-KI können sie komplexe Lösungen erstellen, ohne die Bank zu sprengen. Indem sie KI-Technologien an ihre eigenen Anforderungen anpassen, können sie Forschung und Produktentwicklung beschleunigen.

Diese Flexibilität und Kosteneffizienz sind große Vorteile für neue Unternehmen. Deshalb haben wir in diesem Beitrag die besten Open-Source-Tools und -Plattformen zusammengestellt, damit Sie etwas Erstaunliches erstellen können.

1. Substrat

Substratus ist eine revolutionäre Open-Source-Plattform, die die Szene der Modellentwicklung und -schulung für maschinelles Lernen verändert.

Durch die Integration maßgeschneiderter Ressourcen wie Modell, Server, Datensatz und Notebook in die Kubernetes-API erweitert diese Plattform auf einzigartige Weise die Funktionen der Kubernetes-Steuerungsebene und orchestriert deren gesamte Lebensdauer Modelle des maschinellen Lernens.

Die Modellressource, die Quellcode mit Gewichtungen und Verzerrungen kombiniert, um eine Modellinstanz für maschinelles Lernen zu erstellen, ist die zentrale Komponente von Substratus.

Dieses Modell bietet Vielseitigkeit und Einfachheit bei der Modellkonstruktion, da es aus einem Git-Repository abgeleitet oder unter Verwendung eines vorhandenen Modells und eines erstellt werden kann Trainingsdatensatz.

Darüber hinaus verfügt Substratus über die Serverressource, die den Prozess der Umwandlung Ihrer KI-Modelle in funktionale und nutzbare Ressourcen vereinfacht, indem ein Modell über eine HTTP-API zur Inferenz verfügbar gemacht wird.

Ein weiteres wesentliches Element, das den Datenimport und die Datentransformation erleichtert, ist die Dataset-Ressource.

Es leitet Benutzer zum Quellcode zum Importieren von Daten weiter, den Substratus ausführt und containerisiert, um eine effektive Datenverarbeitung sicherzustellen.

Die Notebook-Ressource, bei der es sich um eine handelt Jupyter Notizbuch Instanz, die auf leistungsstarken Rechenressourcen innerhalb eines Kubernetes-Clusters läuft, ist für Entwickler revolutionär.

Dadurch ist es möglich, Quellcode für maschinelles Lernen auf zuverlässiger Hardware zu erstellen, der auch auf kleinen lokalen Computern nutzbar ist. Die Einbeziehung von Substratus in Ihren Prozess bietet mehrere Vorteile.

Sie können darauf Modelle für maschinelles Lernen trainieren und in verschiedenen Cloud-Umgebungen bereitstellen, da es sich um ein cloudübergreifendes Substrat handelt.

Substratus erfordert keine Codierung und bietet integrierte Optimierungen, die die Bereitstellung und Feinabstimmung von Open-Source-LLMs (Large Language Models) erleichtern. Jupyter-Notebooks können mit nur einem Befehl aus der Ferne gestartet werden, was zu einem reibungslosen Entwicklungsprozess führt.

Substratus funktioniert in erster Linie in jeder Umgebung, in der Kubernetes Installationen mit geringen Anforderungen durchführt, und schützt Ihre Daten in Ihrem Netzwerk.

Sein Zero-Scaling-Ansatz optimiert die GPU-Kosten und nutzt Container, um wiederholbare Szenarien zu erstellen. Darüber hinaus wird GitOps nativ verwendet, was die betriebliche Effektivität verbessert.

2. AbanteAI (Mentat)

Mentat von AbanteAI stellt einen bedeutenden Fortschritt in der KI-gestützten Codierungshilfe dar und nutzt die komplexen Funktionen von GPT-4, um die Art und Weise, wie Code erstellt und gehandhabt wird, zu revolutionieren.

Stellen Sie sich vor, Sie versorgen Mentat über die Befehlszeile mit den Befehlen, die Sie benötigen, und beobachten dann, wie es funktioniert generiert Code problemlos in neue oder vorhandene Quelldateien integrieren.

Sie können Ihren Entwicklungsprozess optimieren, indem Sie das zeitaufwändige Kopieren und Einfügen zwischen Ihrer IDE und einem eliminieren ChatGPT Browserfenster dank dieser reibungslosen Befehlszeilenschnittstelle.

Über das hinaus, was Tools wie die Inline-Empfehlungen von Copilot leisten können, ist Mentat darauf ausgelegt, Code für Sie zu schreiben. Mentat passt sich Ihren Anforderungen an und hilft in beiden Situationen, egal ob Sie mit bereits vorhandenem Code arbeiten oder eine neue Aufgabe beginnen.

Diese Fähigkeit stellt einen großen Fortschritt in der KI-gestützten Codierung dar, da sie nützlichen, umsetzbaren Code generiert, anstatt nur Empfehlungen abzugeben.

Wenn Entwickler Mentat verwenden, steigt ihre Produktivität, da sie sich auf komplexere und kreativere Arbeiten konzentrieren können, während sie die mühsame und sich wiederholende Codierung dem Programm überlassen.

Die Anpassungsfähigkeit von Mentat zeigt sich in der Breite der Anwendungen, die viele Elemente der Codierung abdecken, wie z. B. die Erstellung eines ersten Entwurfs für neue Projekte, die Fehlerbehebung und die schnelle Anpassung an eine neue Codebasis.

Der Bereich der KI-gestützten Codierung hat noch viele vielversprechende Entwicklungen vor sich. Programmierer können sich jetzt auf KI verlassen, um Aufgaben wie Codeüberprüfungen, Fehlerkorrekturen und syntaktische Korrekturen zu erledigen.

Dazu gehören Plattformen wie Mentat. Obwohl es unwahrscheinlich ist, dass Technologie Programmierer vollständig ersetzen wird, spielt KI eine immer größere Rolle in der Programmierung und ist auf dem besten Weg, ein hilfreicher Verbündeter zu werden.

Der Codierungsprozess könnte durch diese Partnerschaft zwischen menschlicher Intelligenz und der Effizienz der KI neu definiert werden, wodurch er weniger fehleranfällig und effizienter wird.

3. ChatDev

ChatDev ist eine revolutionäre Technik für die Softwareentwicklung, die Large Language Models (LLMs) nutzt, um den Softwareentwicklungsprozess zu verbessern und zu beschleunigen.

Dieses neuartige Framework, das auf der Kommunikation in natürlicher Sprache basiert, soll die Notwendigkeit spezifischer Modelle in verschiedenen Phasen der Softwareentwicklung beseitigen und so die Branche revolutionieren.

Der Softwareentwicklungszyklus wird von ChatDev in vier Hauptphasen unterteilt, die ein organisiertes Wasserfallmodell verwenden: Design, Codierung, Test und Dokumentation.

ChatDev unterteilt diese Phasen in diskrete Unteraufgaben, indem es jeder Phase virtuelle Agenten wie Tester und Programmierer zuweist.

Diese Agenten arbeiten durch Gespräche zusammen. Die Aufgabenlösung wird durch diese Konversationskettenmethode effizient gestaltet, was Vorschläge und Lösungsvalidierung erleichtert.

Einer der Hauptvorteile von ChatDev ist die Fähigkeit, Code-Halluzinationen – wie unentdeckte Fehler oder fehlende Abhängigkeiten – zu bekämpfen, die in LLMs häufig vorkommen.

Moderne Softwareanwendungen können mit dem ChatDev-Framework erstellt werden, was auch dazu beiträgt, diese möglichen Risiken zu reduzieren. Das Design der Plattform basiert auf einer Chat-Kette, die aufgabenorientiertes Rollenspiel und effiziente Kommunikation zwischen virtuellen Agenten ermöglicht.

Dies führt zu einem offenen und kooperativen Entwicklungsprozess, bei dem Endbenutzer sich aktiv am Entscheidungsprozess beteiligen können und Aufgaben durch kontextbezogene Gespräche in mehreren Runden erledigt werden.

Während der Entwurfsphase verwendet ChatDev benutzerdefinierte Nachrichten und Eingabeaufforderungen, um seinen Agenten Positionen wie CEO, CPO und CTO zuzuweisen, basierend auf dem ursprünglichen Konzept des Kunden.

Diese Phase umfasst Systeme wie Memory Stream, Selbstreflexion und Aufgabenzuweisung, die sicherstellen, dass jeder Agent seine Aufgabe bestmöglich ausführt.

Codegenerierung und GUI-Entwicklung werden in der gesamten Codierungsphase in kleinere Verantwortlichkeiten unterteilt, zu denen Positionen wie CTO, Programmierer und Kunstdesigner gehören.

Objektorientiert verwenden ProgrammiersprachenDas Framework geht Probleme bei der Codegenerierung an, indem es eine „Gedankenanweisungen“-Methode einführt, die von Gedankenketten-Eingabeaufforderungen inspiriert ist.

Durch die gezielte Ausrichtung auf Problemlösungsideen garantiert diese Technik eine korrekte und sachdienliche Codeerstellung.

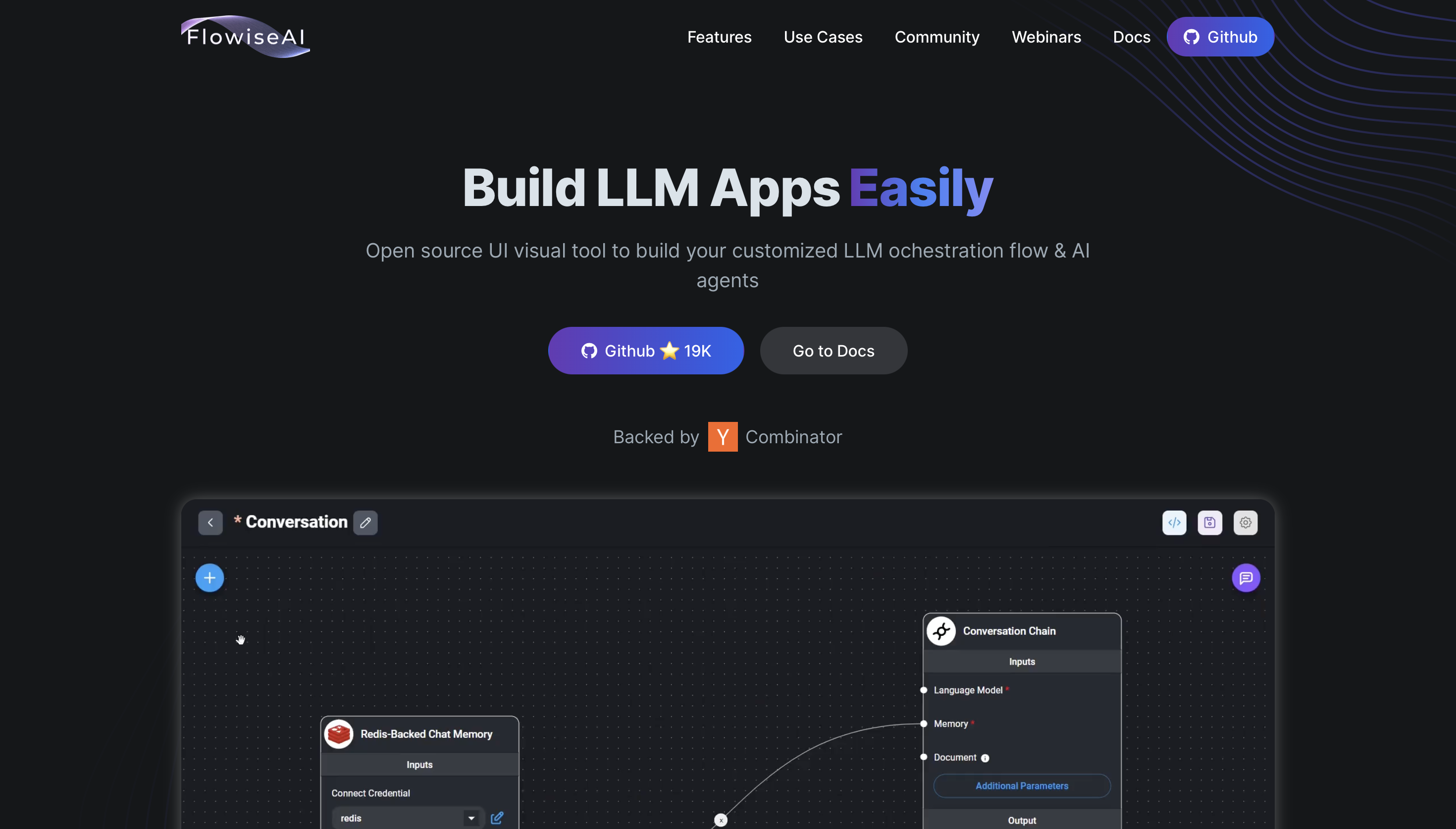

4. Flowise KI

Flowise AI ist ein revolutionäres Tool im Bereich der KI-gesteuerten Software, das sich durch seine Drag-and-Drop-Funktion auszeichnet, die wenig oder gar keine Codierung erfordert.

Diese neuartige Methode erleichtert die Entwicklung und Visualisierung von Large Language Model (LLM)-Anwendungen, insbesondere für Personen ohne große Programmiererfahrung.

Flowise AI zeichnet sich durch die Entwicklung von LLM-Apps aus und vereinfacht den komplizierten Vorgang zu einem zugänglicheren Erlebnis. Die Leistungsfähigkeit von Flowise AI Bahnkratzen und die einfachere Beantwortung von Fragen ist eines seiner Hauptmerkmale.

Flowise AI kann beispielsweise die Aufgabe übernehmen, alle zugehörigen Links von Ihrer Website zu entfernen und einen LLM auf Anfragen basierend auf dem Inhalt Ihrer Website antworten zu lassen.

Die Plattform verbindet sich mit Vektordatenbanken wie Pinecone, um Daten zu speichern und abzurufen, und nutzt den Cheerio Web Scraper-Knoten für das Link-Scraping.

Dadurch können Daten nahtlos von einer Website in eine Datenbank übernommen werden, und ein LLM kann diese Datenbank verwenden, um auf Benutzeranfragen zu antworten.

Darüber hinaus ist Flowise AI darauf ausgelegt, Systemnachrichten für verschiedene Nutzungsszenarien zu definieren, beispielsweise die QA Chain für Conversational Retrieval.

Diese Funktion ist unerlässlich, um sicherzustellen, dass die KI in einer bestimmten Sprache antwortet und Halluzinationen vermeidet, die ein häufiges Problem bei KI-Interaktionen darstellen.

Die Zuverlässigkeit und Genauigkeit von KI-Interaktionen werden durch Flowise AI verbessert, indem Einstellungen wie der Name der KI, die Sprache der Antwort und bestimmte Antworten für den Fall konfiguriert werden, dass keine Antwort eingeht.

Ein weiterer interessanter Anwendungsfall ist die Entwicklung einzigartiger Tools zum Initiieren von Webhook-Vorgängen. Flowise AI ermöglicht die Entwicklung von Tools, die Webhook-Endpunkte kontaktieren und die erforderlichen Parameter im Hauptteil des Webhooks bereitstellen können.

Es ist möglich, diese Funktion auf andere Plattformen wie Gmail und Google Sheets auszuweiten und sie mit einer Vielzahl von Anwendungen zu kombinieren, beispielsweise dem Senden von Nachrichten an Discord.

Diese Anpassungsfähigkeit veranschaulicht die Vielseitigkeit von Flowise AI bei der Automatisierung und Optimierung digitaler Abläufe auf vielen Plattformen und Diensten.

5. Stück

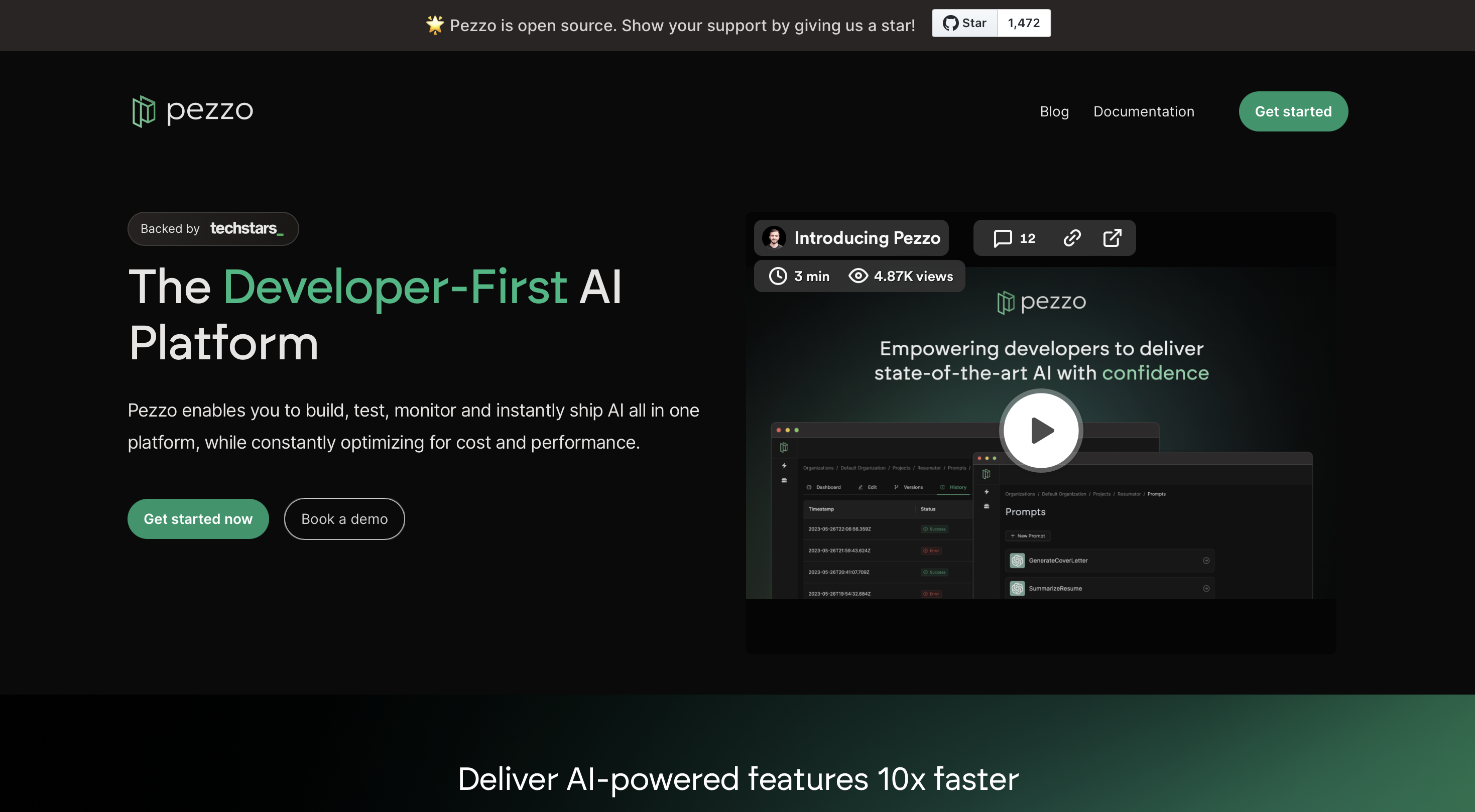

Pezzo zeichnet sich als entwicklerorientierte KI-Plattform aus und definiert die Art und Weise, wie KI-Funktionen entworfen, getestet, überwacht und bereitgestellt werden, neu.

Es ist darauf ausgelegt, Kosten und Leistung zu optimieren und gleichzeitig die Effizienz der KI-Entwicklung zu verbessern.

Pezzo verspricht dank seiner leistungsstarken Eigenschaften eine bis zu zehnmal schnellere Bereitstellung, die eine erhebliche Beschleunigung der Bereitstellung von KI-gestützten Funktionen ermöglicht.

Das zentralisierte Prompt-Management-System ist das Herzstück der Funktionalität von Pezzo.

Diese Lösung, die mit kommt Versionskontrolle und sofortige Produktionsbereitstellungsfunktionen ermöglichen die effektive Verarbeitung aller KI-Eingabeaufforderungen an einem Ort.

Für Teams, die projektübergreifend Konsistenz wahren und KI-Operationen optimieren möchten, ist diese Fähigkeit von entscheidender Bedeutung. Pezzo bietet außerdem Observability-Tools zum Verständnis der Wirksamkeit, Kosten und Qualität von KI-Aktivitäten.

Entwickler können Ressourcen mit ihrem fundierten Wissen erfolgreich in schnelle Ausführungen optimieren. Ein weiterer wesentlicher Bestandteil von Pezzos Fähigkeiten ist die Fehlerbehebung.

Die Debugging-Zeit wird erheblich verkürzt, da schnelle Ausführungen in Echtzeit überprüft werden können. In dieser Funktion sind Tools für die Zusammenarbeit enthalten, mit denen Teams reibungslos und gemeinsam zusammenarbeiten können, um leistungsstarke KI-Funktionen zu entwickeln.

So vielfältig die Funktionen von Pezzo sind, so vielfältig sind auch die Anwendungsfälle. Um Entwicklern die vollständige Nutzung von KI-Modellen in Apps zu ermöglichen, bietet es eine Open-Source-Toolbox für eine beschleunigte KI-Entwicklung.

Zu den Hauptmerkmalen gehören die zentrale Verwaltung von Eingabeaufforderungen, die effiziente Erstellung und Versionierung von Eingabeaufforderungen, sofortige Bereitstellungen, gründliche Beobachtbarkeit, effektive Fehlerbehebung und Kostentransparenz.

Es kann in verschiedenen Entwicklungskontexten verwendet werden, da es zahlreiche Clients wie Python und Node.js unterstützt. Ein Beispiel für die Effektivität und Benutzerfreundlichkeit der Plattform ist die rechtzeitige Anleitung zur Verwaltung.

KI-Aktivitäten können vollständig von Benutzern verwaltet werden, einschließlich Versionskontrolle, schnelle Bereitstellung, schnelle Generierung und Überwachung. Um eine Eingabeaufforderung zu erstellen, muss diese zunächst mit dem Eingabeaufforderungseditor erstellt werden.

Anschließend muss es in Pezzo getestet und seine Parameter für die beste Leistung angepasst werden. Anschließend wird es festgeschrieben und veröffentlicht.

Dieses vereinfachte Verfahren garantiert, dass jede veröffentlichte Eingabeaufforderung wie vorgesehen und mit dem geringsten Codeaufwand funktioniert.

6. MindsDB

MindsDB ist eine bahnbrechende virtuelle Open-Source-Datenbank, die einen erheblichen Fortschritt in der Datenverwaltung und KI darstellt.

Es ist einzigartig aufgrund seiner kreativen Art, KI-Algorithmen mit Echtzeitdaten zu verschmelzen. „Jobs“ und „AI Tables“, zwei hochmoderne Komponenten, ermöglichen diese reibungslose Integration von Daten und KI.

Echtzeitdatenaktivitäten können mithilfe von Jobs einfacher orchestriert werden, und Echtzeitdaten und KI-Modelle können direkt mit KI-Tabellen verknüpft werden.

Ein Hinweis auf die Anpassungsfähigkeit von MindsDB sind die mehr als 70 Technologie- und Datenschnittstellen mit führenden Datenbanken und Plattformen wie MariaDB, MySQL, PostgreSQL, ClickHouse, Microsoft SQL Server und Snowflake.

Zu seiner Vielseitigkeit gehört auch die Interoperabilität mit mehreren BI-Tools wie Microsoft Power BI, SAS, Qlik Sense, Looker und Domo.

MindsDB erweitert seine Funktionalität durch die Unterstützung von Lightwood, a Deep Learning Framework basierend auf PyTorch.

Mit einem vereinfachten Ansatz, der Entwicklern entgegenkommt, optimiert MindsDB den Prozess der Entwicklung von KI-Anwendungen.

Es zeichnet sich dadurch aus, dass Entwickler mithilfe bekannter SQL-Ausdrücke mit KI-Modellen kommunizieren können, was die Komplexität verringert, die häufig mit maschinellem Lernen verbunden ist.

Seine Kompatibilität mit mehreren KI-Frameworks und -Modellen wie TensorFlow, PyTorch und GPA-3 von OpenAI, ergänzt die Benutzerfreundlichkeit dieses Ansatzes.

Die Plattform erleichtert auch den Start von KI-Anwendungen ohne Einrichtung einer Infrastruktur, indem sie eine Vielzahl von KI-Aktivitäten automatisiert, von der Datenvorbehandlung und dem Modelltraining bis hin zu Inferenz.

Durch die Bereitstellung einer erkennbaren Schnittstelle und das Herausfiltern der Komplexität des maschinellen Lernens wird die Erstellung von KI-Anwendungen erheblich beschleunigt.

Ein Null-Infrastruktur-Setup optimiert die Bereitstellung von KI-Anwendungen und erhöht die Prozesseffizienz. Darüber hinaus ist MindsDB skalierbar und in der Lage, die Anforderungen anspruchsvoller KI-Anwendungen zu erfüllen.

MindsDB bietet eine breite Palette realer Anwendungen. Damit lassen sich intelligente Chatbots bauen, die Menschen wirklich und erfolgreich einbeziehen.

7. Mars

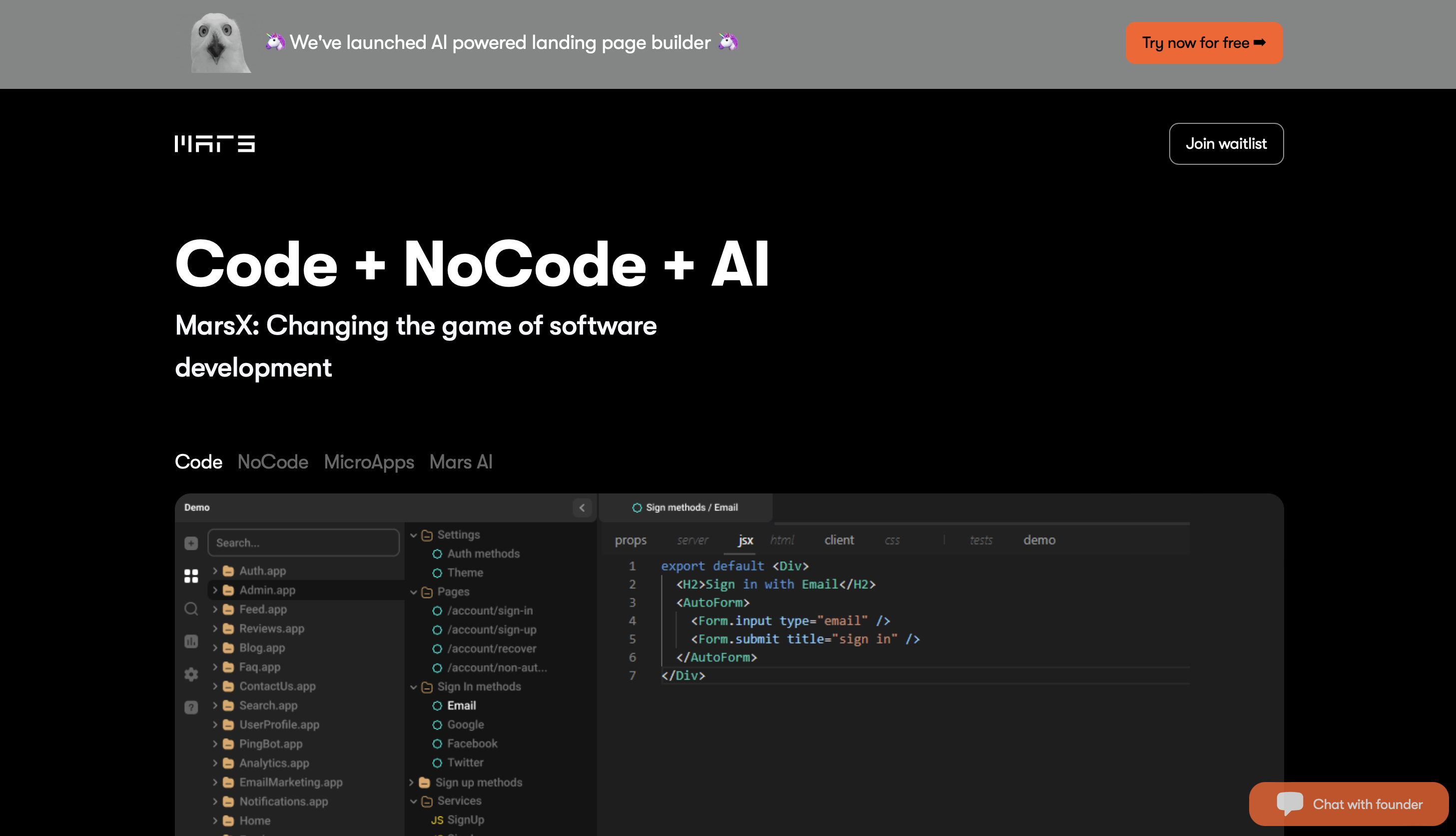

MarsX ist eine hochmoderne Plattform für die Softwareentwicklung, die den Prozess der Erstellung mobiler und Online-Anwendungen verändert.

Grundsätzlich ist die Notwendigkeit einer effizienten Wiederverwendung von Code das Problem, das MarsX in der Programmierung zu lösen versucht.

Trotz der Verfügbarkeit von Frameworks und Codeausschnitten von Websites wie Stack Overflow wird ein großer Prozentsatz des Projektcodes traditionell von Grund auf neu entwickelt.

Die Ineffizienzen im Entwicklungsprozess führten zur Gründung von MarsX, einem Unternehmen, das Full-Stack-Bibliotheken oder Software Development Kits (SDKs) bereitstellt, die Frontend- und Backend-Komponenten integrieren.

Zur Vereinfachung der Nutzung und Verständlichkeit hat MarsX diese Full-Stack-Bibliotheken standardisiert, die für umfassende Softwarelösungen unerlässlich sind.

Da MarsX erkennt, dass Entwickler gerne mit neuen Tools experimentieren, dies jedoch nicht mit einem erheblichen Zeitaufwand verbunden ist, stellt MarsX sicher, dass diese Bibliotheken schnell getestet werden können.

Auf dem Marktplatz der Plattform sind zahlreiche Mikro-Apps oder kurze Spezialprogramme verfügbar, die von externen Entwicklern erstellt wurden.

Indem diese Mikro-Apps – wie Chat-Programme oder Klone bekannter Websites wie Airbnb oder Instagram – vorgefertigte, hervorragende Lösungen bieten, anstatt dass Entwickler sie von Grund auf neu erstellen müssen, sparen sie Entwicklern Zeit.

Der Mix aus No Code, Low Code, Custom Code und AI, den MarsX bietet, zeichnet es aus. Diese Anpassungsfähigkeit ermöglicht es Programmierern, komplexe Web- und mobile Apps auf unterschiedlichen Programmierkenntnissen zu entwerfen.

Dank der Plattform ist es nicht mehr notwendig, zwischen vielen integrierten Entwicklungsumgebungen (IDEs) zu wechseln, was die Änderung dieser Mikroapps erleichtert, indem sie eine einheitliche Umgebung bietet.

Um die Kompilierung und Aktualisierung von Mikroapps in Echtzeit zu erleichtern, verfügt die Plattform außerdem über eine eigene integrierte Entwicklungsumgebung (IDE).

Der Schwerpunkt von MarsX auf Benutzerfreundlichkeit macht es ideal für Start-ups und Entwickler, die Apps schnell erstellen und aktualisieren müssen.

8. Vanna AI

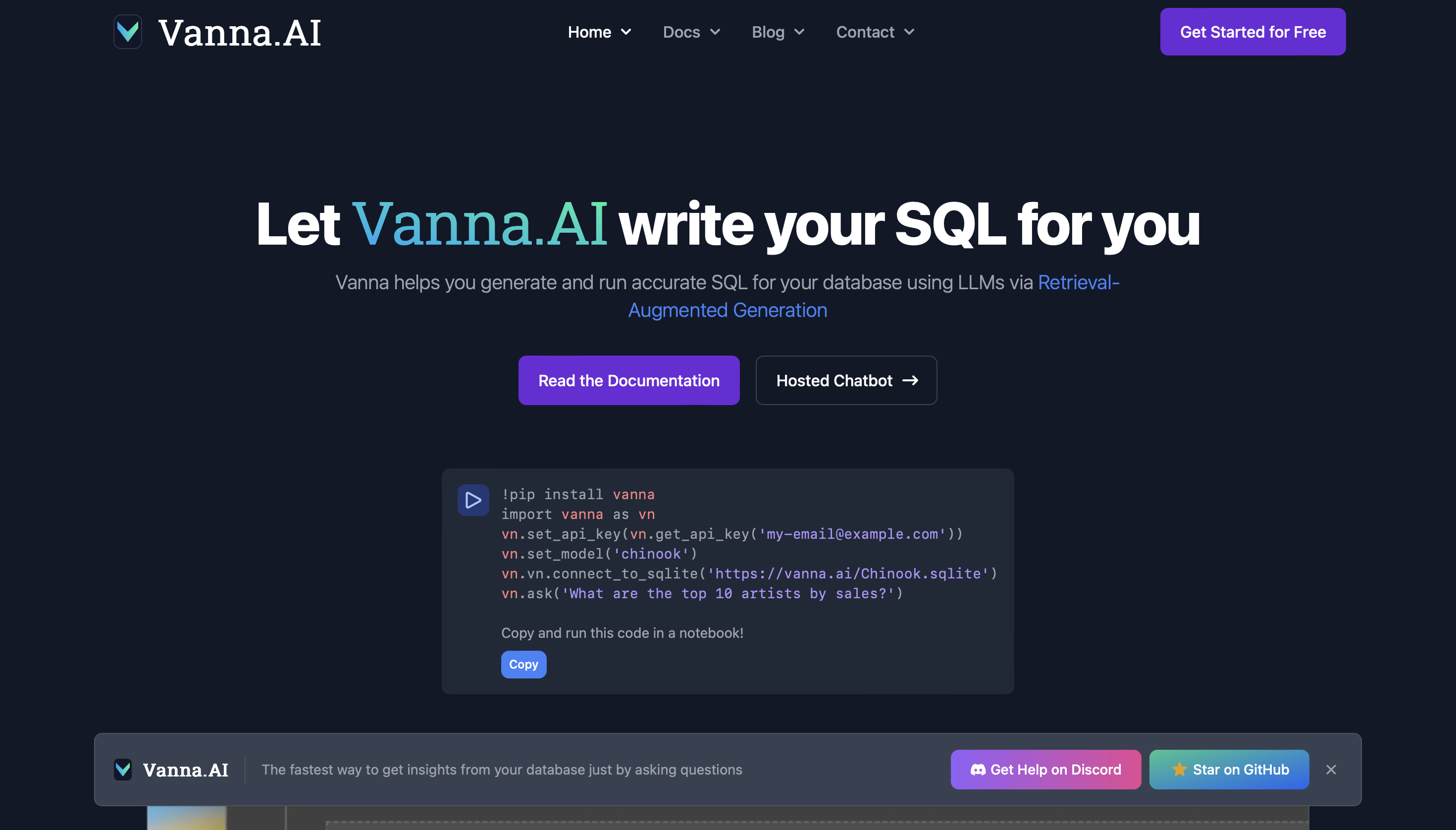

Vanna AI ist ein leistungsstarker KI-gestützter Business-Intelligence-Assistent, der die Art und Weise verändert, wie wir mit Datensätzen interagieren.

Diese hochmoderne Technologie nutzt Large Language Models (LLMs), um präzise SQL-Abfragen für Ihre Datenbank zu erstellen und auszuführen.

Vanna ist einzigartig, weil es seine Leistung basierend auf den bereitgestellten Trainingsdaten anpasst und so selbst bei komplizierten Datensätzen eine hohe Genauigkeit ermöglicht.

Dies bedeutet, dass Vanna umso besser darin ist, mit komplizierten Datenstrukturen umzugehen und diese zu verstehen, je mehr Daten Sie ihr zuführen.

Vanna AI zeichnet sich durch die Betonung von Sicherheit und Datenschutz aus. Ihre Datenbankinhalte bleiben vertraulich, da das LLM bei der Interaktion mit Ihrer Datenbank nur mit Metadaten wie Schemata, Dokumentation und Abfragen arbeitet.

Darüber hinaus bietet Ihnen Vanna AI die Freiheit, Verbindungen für jede beliebige Datenbank aufzubauen, und bietet integrierte Unterstützung für bekannte Datenbanken wie BigQuery, Postgres und Snowflake.

Dies macht es zu einem äußerst anpassungsfähigen Instrument für eine Vielzahl von Datenverwaltungsanforderungen. Die Plattform verfügt über ebenfalls hervorragende Integrationsmöglichkeiten.

Vanna kann zum Start in einem Jupyter-Notebook verwendet werden und dann über verschiedene Frontends wie z. B. auf Geschäftskunden ausgeweitet werden Web Applikationen, Streamlit-Apps oder Slackbot.

Aufgrund seiner Vielseitigkeit ist es eine großartige Option für eine Reihe von Unternehmensumgebungen, von Start-ups bis hin zu großen Organisationen.

Vanna AI zielt darauf ab, komplizierte SQL- oder Python-Abfragen überflüssig zu machen, indem es das Extrahieren von Erkenntnissen aus Ihrer Datenbank vereinfacht, indem Sie einfach Fragen stellen.

9 Gradio

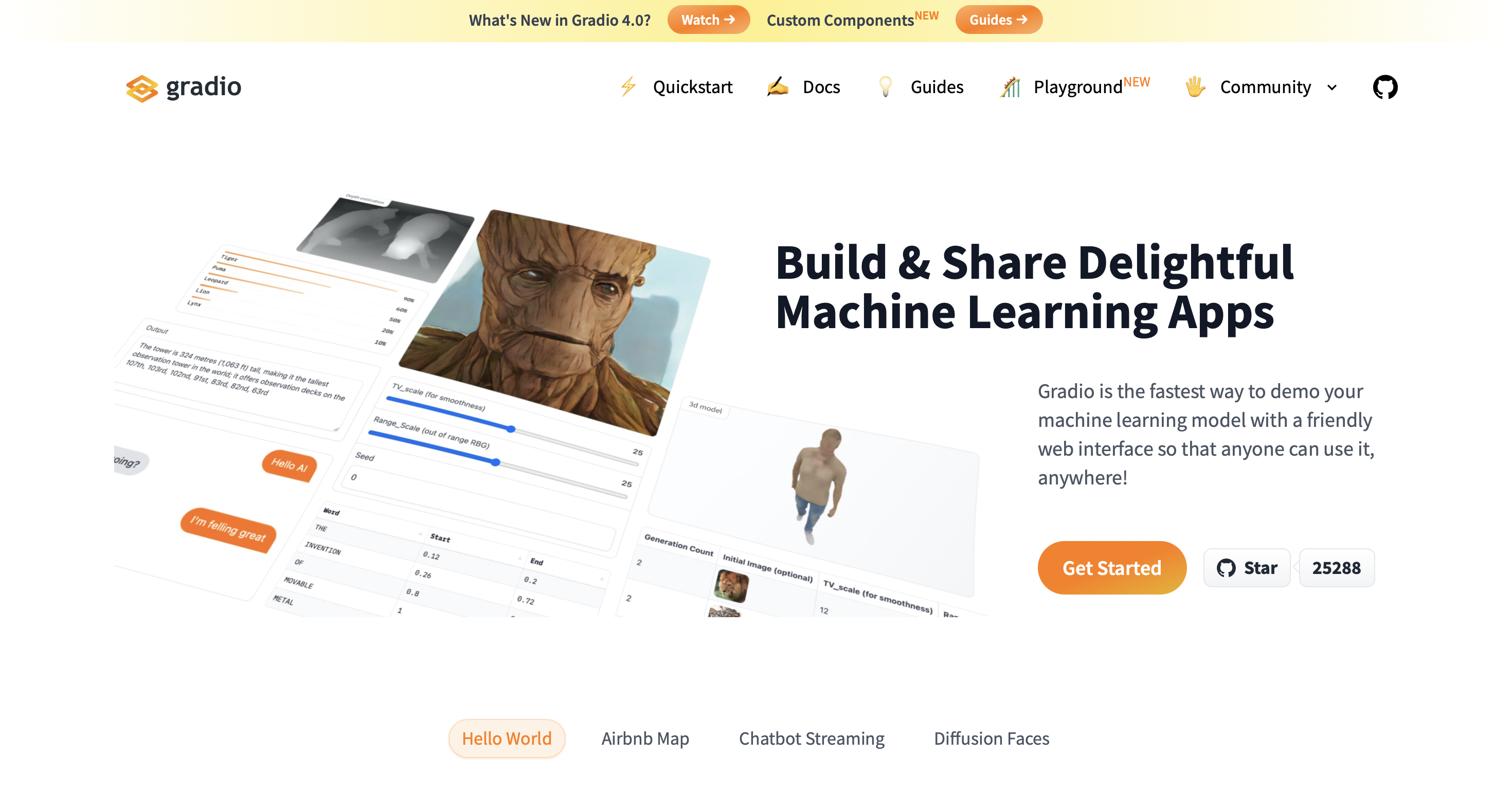

Gradio ist ein flexibles und hochmodernes Tool für Datenwissenschaft und maschinelles Lernen, das die Art und Weise, wie Modelle verwendet und präsentiert werden, revolutioniert.

Mit mehr als dreißig vorgefertigten Komponenten und einer großen Anzahl neuer Komponenten erleichtert Gradio die Erstellung interaktiver Demonstrationen für verschiedene Arten von Daten.

Gradio zeichnet sich dadurch aus, dass seine Komponenten reibungslos zwischen statischen und interaktiven Modi wechseln, je nachdem, ob sie als Eingaben oder Ausgaben in einer Demonstration verwendet werden.

Dank der automatischen Erkennung können Sie sich die Mühe ersparen, die Art jeder Komponente manuell identifizieren zu müssen.

Gradio schneidet auch bei der Vor- und Nachbearbeitung hervorragend ab und wandelt Daten problemlos zwischen Formaten um, die für die Benutzerinteraktion und Funktionsanforderungen geeignet sind.

Diese Funktionalität ist für Aufgaben wie das Hochladen von Fotos oder die Präsentation einer Bildergalerie im Browser des Benutzers unerlässlich.

Bei bekannten Apps muss das integrierte Warteschlangensystem Tausende gleichzeitiger Benutzer unterstützen können.

Es gibt Möglichkeiten, die Warteschlange zu verwalten, z. B. die Anzahl der gleichzeitig zu bearbeitenden Anfragen zu begrenzen. Da viele maschinelle Lernroutinen viel Speicher verbrauchen und in Zeiten hoher Benutzeraktivität einen regulierten Zugriff erfordern, ist dies besonders vorteilhaft.

Gradio ermöglicht die Verwendung von Generatorfunktionen in Situationen, in denen Sie eine Reihe von Ausgaben benötigen, beispielsweise in Chatbots oder bildgenerierenden Modellen.

Das interaktive Erlebnis kann durch die Nutzung dieser Fähigkeit zur Präsentation iterativer Ergebnisse verbessert werden.

Gradio ist auch in der Lage, Streaming-Eingaben wie Echtzeit-Audiostreams oder Modelle zur Generierung von Bildern als Reaktion auf Befehlseingaben zu verarbeiten.

Dank der Plattformunterstützung für konfigurierbare Fortschrittsbalken haben Sie auch die Kontrolle darüber, wie der Benutzer Fortschrittsaktualisierungen sieht.

Diese Funktionalität ist sehr hilfreich für Aufgaben, die viel Verarbeitungszeit erfordern, einschließlich komplizierter Berechnungen oder Datenanalysen.

Die Fähigkeit von Gradio, den Fortschritt zu verfolgen, wird durch die Integration der tqdm-Bibliothek weiter verbessert, die visuelles Feedback zum Aufgabenfortschritt bietet.

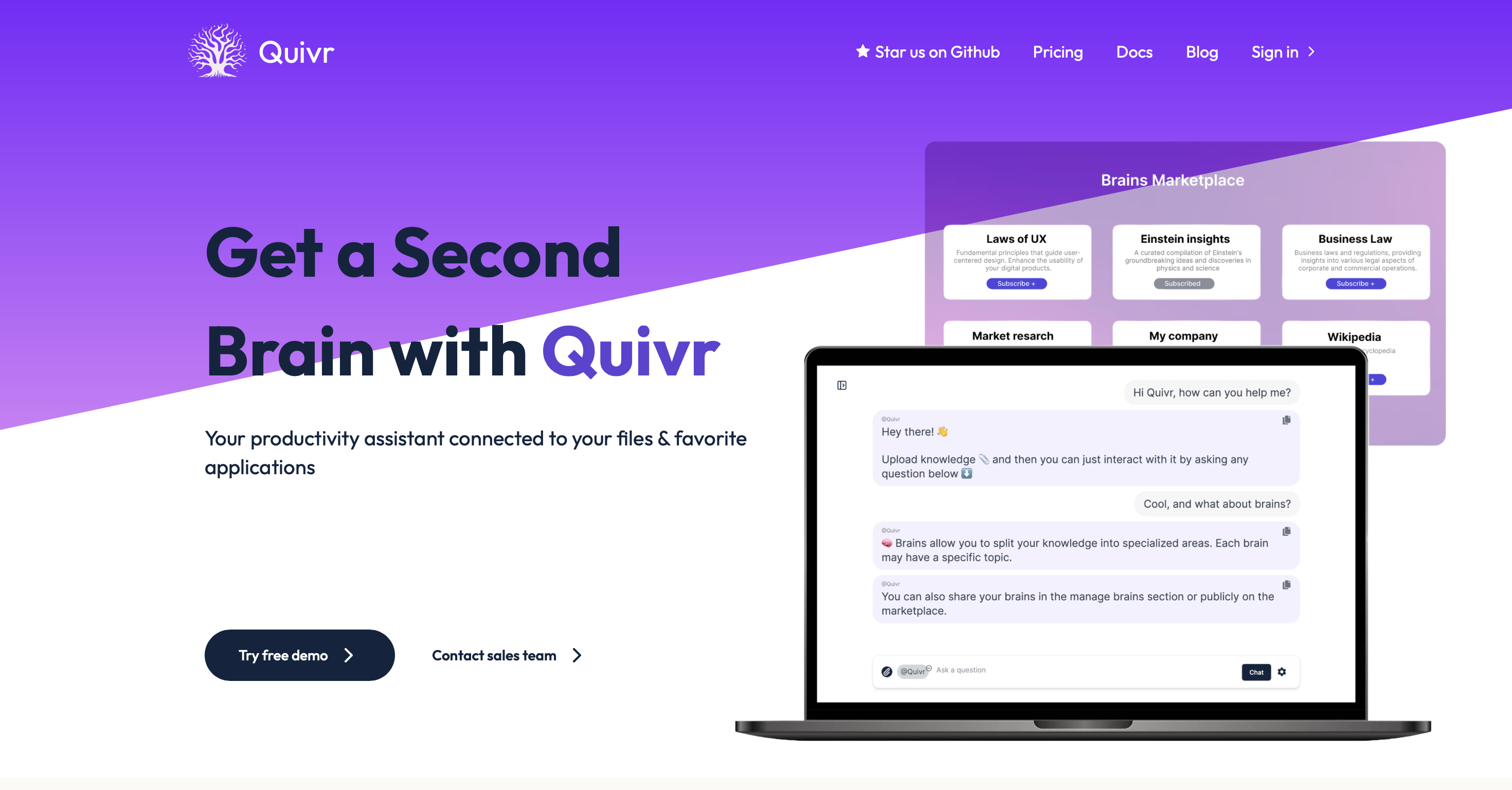

10 Quivr

Quivr entpuppt sich als bahnbrechende Plattform, die sich als Ihr „zweites Gehirn“ und persönlicher Assistent positioniert und sich für die kollaborative Softwareentwicklung eignet.

Die schnelle Einrichtung und die unkomplizierten Funktionen machen dieses Open-Source-Tool zu einer großen Bereicherung für alle, die in großen Entwicklungsteams oder Open-Source-Communitys arbeiten.

Quivr ist wirklich einfach zu bedienen; Sie können sich mit Ihrem Google-Konto in weniger als fünf Sekunden anmelden. Sie können mit Ihren Daten interagieren, indem Sie auf der Plattform Fragen zu Ihren Dateien stellen, was auch das Hochladen von Dateien vereinfacht.

Quivr betreut mehr als 30,000 Menschen und 4,000 Unternehmen und ist durch den Einsatz von Foundation Models und generativer KI führend in der KI-Innovation.

Diese von der Community betriebene Plattform gehört zu den 100 besten Open-Source-Projekten und bedient über 26,000 Entwickler. Quivr bietet eine stabile Umgebung für die Entwicklung von KI-Anwendungen der nächsten Generation und zeichnet sich dadurch aus, dass es Unternehmen ermöglicht, KI vollständig für Innovationen zu nutzen.

Als digitaler Assistent, der die Entscheidungsfindung unterstützt und langwierige Prozesse automatisiert, dient Quivr als mehr als nur eine Entwicklungsplattform. Dies trägt zur Steigerung der Unternehmenseffizienz bei.

Das Open-Source-Design von Quivr fördert die Beteiligung der Community an Funktionsanfragen, Fehlerberichten und Dokumentationen.

Transparenz und kooperative Entwicklung werden durch den einfachen Zugriff auf den Quellcode auf GitHub gewährleistet. Diese Strategie fördert ständige Innovation und Plattformverbesserung sowie ein Gemeinschaftsgefühl.

Zusammenfassung

Open-Source-KI und ihre Auswirkungen auf die Umwelt, mit Schwerpunkt darauf, wie sie die technologische Entwicklung demokratisiert und die Zusammenarbeit zwischen Fans, Forschern und Entwicklern fördert.

Jeder kann KI-Technologie über Open-Source-Plattformen nutzen, verändern und verbreiten, was zur Schaffung florierender Innovationszentren auf Websites wie GitHub geführt hat.

TensorFlow, ein Tool, das KI-Forschung und -Innovation beschleunigt, ist ein Beispiel, ebenso wie eine Reihe von Open-Source-Plattformen wie Gradio, Quivr, ChatDev, Flowise AI, Pezzo, MarsX, Vanna AI und AbanteAI (Mentat).

Diese Systeme erleichtern die KI-gesteuerte Softwareentwicklung für diejenigen mit geringen oder keinen Programmierkenntnissen, verbessern die Erstellung von Modellen für maschinelles Lernen und bieten KI-gestützte Codierungsunterstützung.

Insbesondere für Startups bieten sie Vorteile wie Kosteneffizienz, Flexibilität und höhere Produktivität.

Diese Demokratisierung der KI-Technologie beschleunigt nicht nur die Forschung und das kommerzielle Schaffen, sondern eröffnet auch den Zugang zu einem breiteren Publikum und wandelt KI von einem Spezialgebiet für einige wenige zu einem kooperativen Unterfangen.

Hinterlassen Sie uns einen Kommentar