Змест[Схаваць][Паказаць]

Будучыня тут. І ў гэтай будучыні машыны спасцігаюць навакольны свет гэтак жа, як і людзі. Кампутары могуць кіраваць аўтамабілямі, дыягнаставаць хваробы і дакладна прадказваць будучыню.

Гэта можа здацца навуковай фантастыкай, але мадэлі глыбокага навучання робяць гэта рэальнасцю.

Гэтыя складаныя алгарытмы раскрываюць сакрэты штучны інтэлект, дазваляючы кампутарам саманавучацца і развівацца. У гэтай публікацыі мы паглыбімся ў сферу мадэляў глыбокага навучання.

І мы будзем даследаваць велізарны патэнцыял, які яны маюць для рэвалюцыі ў нашым жыцці. Падрыхтуйцеся даведацца пра перадавыя тэхналогіі, якія мяняюць будучыню чалавецтва.

Што такое мадэлі глыбокага навучання?

Вы калі-небудзь гулялі ў гульню, у якой вам трэба было вызначыць адрозненні паміж двума малюнкамі?

Аднак гэта весела, але можа быць і цяжка, праўда? Уявіце, што вы можаце навучыць кампутар гуляць у гэтую гульню і кожны раз выйграваць. Мадэлі глыбокага навучання дасягаюць менавіта гэтага!

Мадэлі глыбокага навучання падобныя на звышразумныя машыны, якія могуць даследаваць вялікую колькасць малюнкаў і вызначаць, што ў іх агульнага. Яны дасягаюць гэтага, разбіраючы выявы і вывучаючы кожную паасобку.

Затым яны прымяняюць тое, чаму навучыліся, каб вызначаць заканамернасці і рабіць прагнозы адносна свежых малюнкаў, якіх яны ніколі раней не бачылі.

Мадэлі глыбокага навучання - гэта штучныя нейронавыя сеткі, якія могуць вывучаць і здабываць складаныя шаблоны і характарыстыкі з масіўных набораў даных. Гэтыя мадэлі складаюцца з некалькіх слаёў звязаных вузлоў або нейронаў, якія аналізуюць і змяняюць ўваходныя даныя для атрымання вынікаў.

Мадэлі глыбокага навучання асабліва добра падыходзяць для работ, якія патрабуюць высокай дакладнасці і дакладнасці, такіх як ідэнтыфікацыя малюнкаў, распазнаванне маўлення, апрацоўка натуральнай мовы і робататэхніка.

Яны выкарыстоўваліся ва ўсім: ад беспілотных аўтамабіляў да медыцынскай дыягностыкі, рэкамендацыйных сістэм і інш прагнастычная аналітыка.

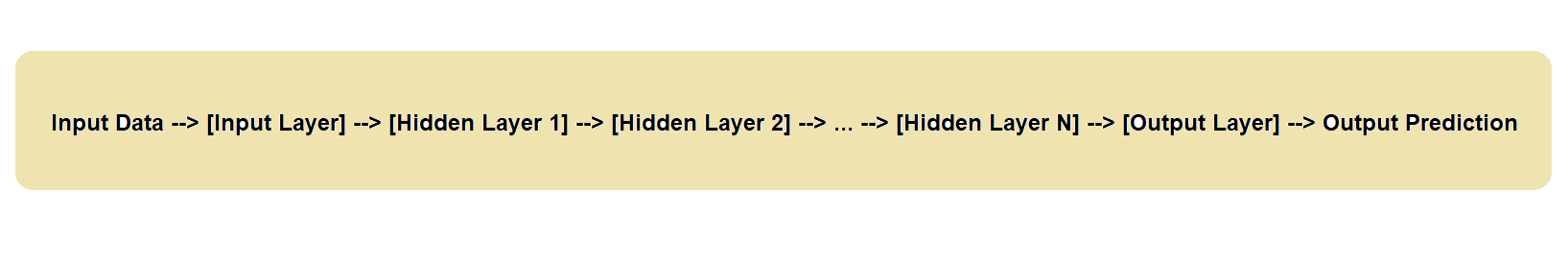

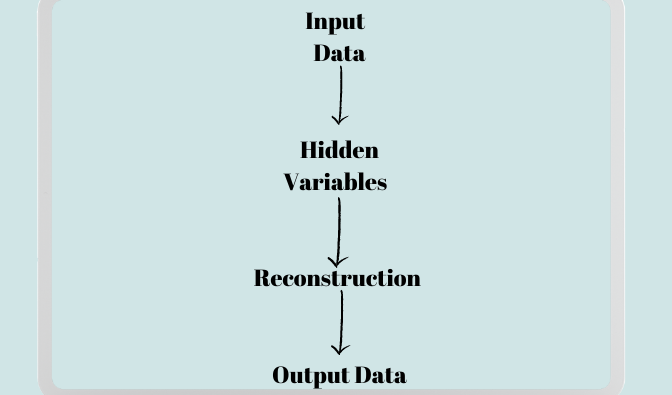

Вось спрошчаная версія візуалізацыі для ілюстрацыі патоку даных у мадэлі глыбокага навучання.

Уваходныя даныя паступаюць на ўваходны ўзровень мадэлі, які затым прапускае даныя праз некалькі схаваных слаёў, перш чым даць выхадны прагноз.

Кожны схаваны ўзровень выконвае серыю матэматычных аперацый над уваходнымі дадзенымі, перш чым перадаць іх наступнаму ўзроўню, які забяспечвае канчатковы прагноз.

Зараз давайце паглядзім, што такое мадэлі глыбокага навучання і як мы можам выкарыстоўваць іх у нашым жыцці.

1. Згорткавыя нейронавыя сеткі (CNN)

CNN - гэта мадэль глыбокага навучання, якая змяніла вобласць камп'ютэрнага зроку. CNN выкарыстоўваюцца для класіфікацыі малюнкаў, распазнавання аб'ектаў і сегментавання малюнкаў. Структура і функцыі глядзельнай кары галаўнога мозгу чалавека абумоўлены дызайнам CNN.

Як яны працуюць?

CNN складаецца з шэрагу свертачных слаёў, слаёў аб'яднання і цалкам звязаных слаёў. Уваход - выява, а выхад - прадказанне меткі класа выявы.

Згорткавыя пласты CNN ствараюць карту функцый, выконваючы кропкавы здабытак паміж уваходным малюнкам і наборам фільтраў. Аб'яднанне слаёў памяншае памер карты аб'ектаў за кошт памяншэння яе выбаркі.

Нарэшце, карта функцый выкарыстоўваецца цалкам звязанымі пластамі для прагназавання меткі класа выявы.

Чаму CNN важныя?

CNN важныя, таму што яны могуць навучыцца выяўляць заканамернасці і характарыстыкі ў малюнках, якія людзям цяжка заўважыць. CNN можна навучыць распазнаваць такія характарыстыкі, як грані, куты і тэкстуры, выкарыстоўваючы вялікія наборы даных. Вывучыўшы гэтыя ўласцівасці, CNN можа выкарыстоўваць іх для ідэнтыфікацыі аб'ектаў на свежых фотаздымках. CNN прадэманстравалі перадавую прадукцыйнасць у розных праграмах ідэнтыфікацыі выяваў.

Дзе мы выкарыстоўваем CNN

Ахова здароўя, аўтамабільная прамысловасць і рознічны гандаль - гэта толькі некалькі сектараў, у якіх працуюць CNN. У сферы аховы здароўя яны могуць быць карыснымі для дыягностыкі захворванняў, распрацоўкі лекаў і аналізу медыцынскіх малюнкаў.

У аўтамабільным сектары яны дапамагаюць з вызначэннем паласы руху, выяўленне аб'ектаў, і аўтаномнае кіраванне. Яны таксама шырока выкарыстоўваюцца ў рознічным гандлі для візуальнага пошуку, рэкамендацыі прадукту на аснове малюнкаў і кантролю запасаў.

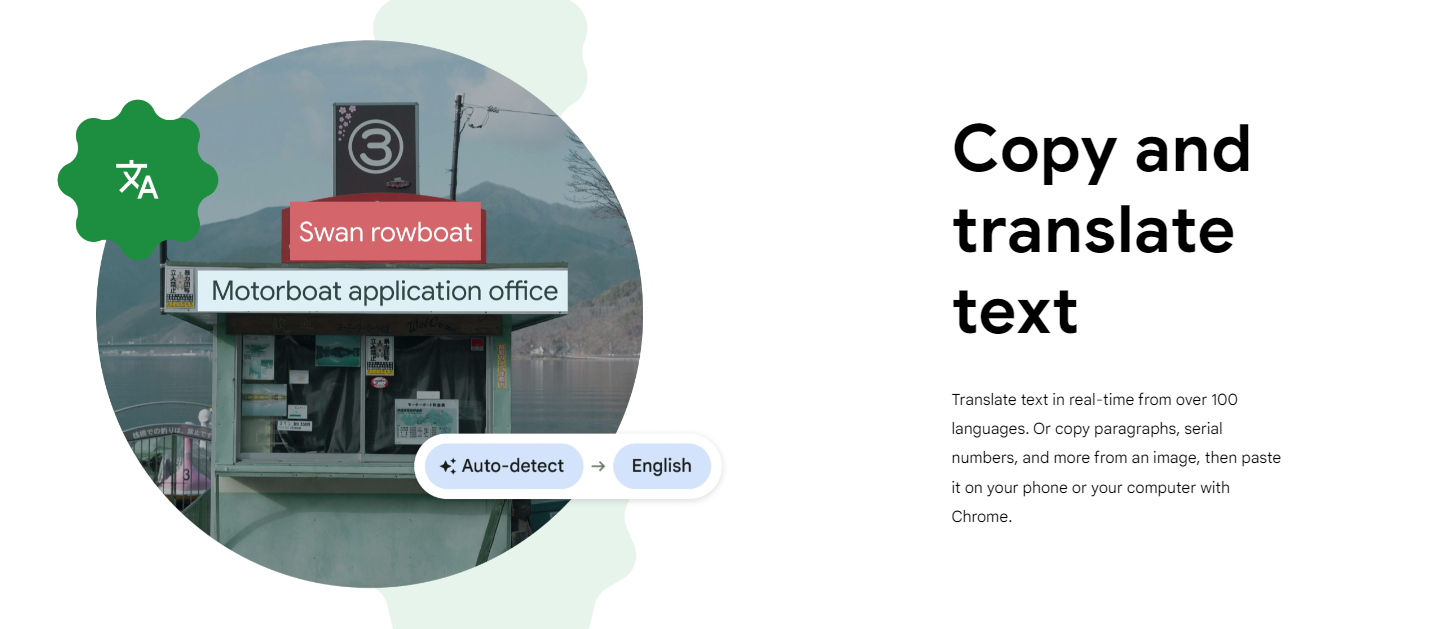

Напрыклад; Google выкарыстоўвае CNN у розных праграмах, у тым ліку Google Lens, папулярны інструмент ідэнтыфікацыі малюнкаў. Праграма выкарыстоўвае CNN для ацэнкі фатаграфій і прадастаўлення інфармацыі карыстальнікам.

Google Lens, напрыклад, можа распазнаваць рэчы на выяве і прапаноўваць падрабязную інфармацыю пра іх, напрыклад, тып кветкі.

Ён таксама можа перакладаць тэкст, выняты з выявы, на некалькі моў. Google Lens можа даць спажыўцам карысную інфармацыю дзякуючы дапамозе CNN у дакладнай ідэнтыфікацыі прадметаў і вылучэнні характарыстык з фатаграфій.

2. Сеткі доўгатэрміновай памяці (LSTM).

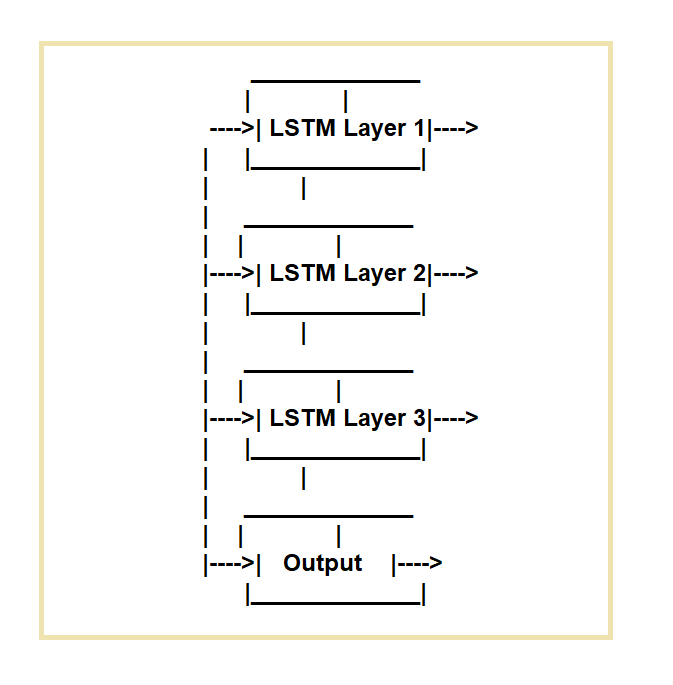

Сеткі доўгай кароткачасовай памяці (LSTM) створаны для ліквідацыі недахопаў рэгулярных рэкурэнтных нейронавых сетак (RNN). Сеткі LSTM ідэальна падыходзяць для задач, якія патрабуюць апрацоўкі паслядоўнасцей даных у часе.

Яны функцыянуюць, выкарыстоўваючы спецыфічную ячэйку памяці і тры механізмы варот.

Яны рэгулююць паток інфармацыі ў клетку і з яе. Уваходныя вароты, забытыя вароты і выхадныя вароты - гэта тры вароты.

Уваходны гейт рэгулюе паток даных у ячэйку памяці, забыты гейт рэгулюе выдаленне даных з ячэйкі, а выхадны гейт рэгулюе паток даных з ячэйкі.

Якое іх значэнне?

Сеткі LSTM карысныя, таму што яны могуць паспяхова прадстаўляць і прагназаваць паслядоўнасці даных з доўгатэрміновымі адносінамі. Яны могуць запісваць і захоўваць інфармацыю аб папярэдніх уводах, што дазваляе ім рабіць больш дакладныя прагнозы адносна будучых уводаў.

Распазнаванне маўлення, распазнаванне рукапіснага ўводу, апрацоўка натуральнай мовы і субцітры да малюнкаў - гэта толькі некаторыя з прыкладанняў, якія выкарыстоўваюць сеткі LSTM.

Дзе мы выкарыстоўваем сеткі LSTM?

Многія праграмныя і тэхналагічныя прыкладанні выкарыстоўваюць сеткі LSTM, у тым ліку сістэмы распазнавання маўлення, інструменты апрацоўкі натуральных моў, такія як аналіз настрояў, сістэмы машыннага перакладу і сістэмы генерацыі тэксту і малюнкаў.

Яны таксама выкарыстоўваліся пры стварэнні самакіравальных аўтамабіляў і робатаў, а таксама ў фінансавай індустрыі для выяўлення махлярства і прадбачэння фондавы рынак рухаў.

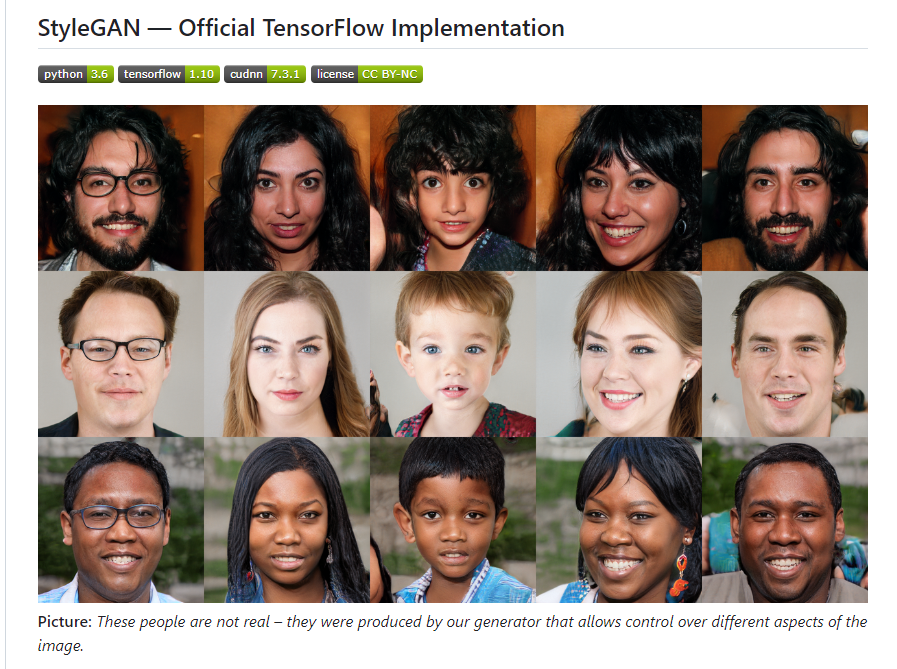

3. Генератыўныя канкурэнтныя сеткі (GAN)

GAN - гэта а глыбокае вывучэнне тэхніка, якая выкарыстоўваецца для стварэння новых узораў даных, падобных да зададзенага набору даных. GAN складаюцца з двух нейронныя сеткі: той, які вучыцца ствараць новыя ўзоры, і той, які вучыцца адрозніваць сапраўдныя ад створаных узораў.

Пры аналагічным падыходзе гэтыя дзве сеткі навучаюцца разам, пакуль генератар не зможа генераваць выбаркі, якія немагчыма адрозніць ад рэальных.

Чаму мы выкарыстоўваем GAN

GAN важныя дзякуючы сваёй здольнасці вырабляць высакаякасную прадукцыю сінтэтычныя дадзеныя якія могуць быць выкарыстаны для розных прыкладанняў, уключаючы вытворчасць малюнкаў і відэа, стварэнне тэксту і нават стварэнне музыкі.

GAN таксама выкарыстоўваліся для павелічэння даных, якія з'яўляюцца генерацыяй сінтэтычныя дадзеныя каб дапоўніць рэальныя дадзеныя і палепшыць прадукцыйнасць мадэляў машыннага навучання.

Акрамя таго, шляхам стварэння сінтэтычных даных, якія можна выкарыстоўваць для навучання мадэляў і імітацыі выпрабаванняў, GAN маюць патэнцыял для трансфармацыі такіх сектараў, як медыцына і распрацоўка лекаў.

Прымяненне GAN

GAN могуць дапаўняць наборы даных, ствараць новыя выявы або фільмы і нават ствараць сінтэтычныя даныя для навуковага мадэлявання. Акрамя таго, GAN маюць патэнцыял для выкарыстання ў розных сферах - ад забаў да медыцыны.

узростаў і відэа. Напрыклад, StyleGAN2 ад NVIDIA выкарыстоўваўся для стварэння высакаякасных фатаграфій знакамітасцяў і твораў мастацтва.

4. Сеткі глыбокай веры (DBN)

Сеткі глыбокіх перакананняў (DBN) з'яўляюцца штучны інтэлект сістэмы, якія могуць навучыцца выяўляць заканамернасці ў дадзеных. Яны дасягаюць гэтага шляхам сегментацыі даных на ўсё меншыя і меншыя кавалкі, атрымліваючы больш поўнае разуменне іх на кожным узроўні.

DBN могуць вывучаць даныя, не будучы праінфармаванымі, што гэта такое (гэта называецца "некантраляванае навучанне"). Гэта робіць іх надзвычай каштоўнымі для выяўлення заканамернасцей у дадзеных, якія чалавеку было б цяжка ці немагчыма распазнаць.

Што робіць DBNs значнымі?

DBN важныя дзякуючы сваёй здольнасці вывучаць іерархічныя прадстаўленні даных. Гэтыя ўяўленні могуць быць выкарыстаны для розных прыкладанняў, такіх як класіфікацыя, выяўленне анамалій і памяншэнне памернасці.

Здольнасць DBN праводзіць папярэдняе навучанне без нагляду, што можа павысіць прадукцыйнасць мадэляў глыбокага навучання з мінімальнымі пазначанымі дадзенымі, з'яўляецца значнай перавагай.

Якія прымянення DBN?

Адным з найбольш значных прыкладанняў з'яўляецца выяўленне аб'ектаў, у якім DBN выкарыстоўваюцца для распазнання пэўных тыпаў рэчаў, такіх як самалёты, птушкі і людзі. Яны таксама выкарыстоўваюцца для стварэння і класіфікацыі малюнкаў, выяўлення руху ў фільмах і разумення натуральнай мовы для апрацоўкі галасы.

Акрамя таго, DBN звычайна выкарыстоўваюцца ў наборах дадзеных для ацэнкі паставы чалавека. DBN з'яўляюцца выдатным інструментам для розных галін, уключаючы ахову здароўя і банкаўскую справу, а таксама тэхналогіі.

5. Сеткі глыбокага падмацавання навучання (DRL)

глыбокая Армаванне навучання Сеткі (DRL) аб'ядноўваюць глыбокія нейронавыя сеткі з метадамі навучання з падмацаваннем, каб дазволіць агентам вучыцца ў складаных умовах метадам спроб і памылак.

DRL выкарыстоўваюцца, каб навучыць агентаў, як аптымізаваць сігнал узнагароджання, узаемадзейнічаючы з навакольным асяроддзем і вучачыся на сваіх памылках.

Што робіць іх выдатнымі?

Яны эфектыўна выкарыстоўваюцца ў розных сферах прымянення, уключаючы гульні, робататэхніку і аўтаномнае кіраванне. DRL важныя, таму што яны могуць вучыцца непасрэдна з неапрацаваных сэнсарных уводаў, што дазваляе агентам прымаць рашэнні на аснове іх узаемадзеяння з навакольным асяроддзем.

Важныя прыкладання

ДХО выкарыстоўваюцца ў рэальных абставінах, таму што яны могуць вырашаць складаныя праблемы.

DRL былі ўключаны ў некалькі вядомых праграмных і тэхнічных платформаў, у тым ліку OpenAI's Gym, ML-агенты Unityі Google DeepMind Lab. AlphaGo, створаны кампаніяй Google Deepmind, напрыклад, выкарыстоўвае DRL, каб гуляць у настольную гульню Go на ўзроўні чэмпіёна свету.

Іншае прымяненне DRL - у робататэхніцы, дзе ён выкарыстоўваецца для кіравання рухамі рук робатаў для выканання такіх задач, як захоп рэчаў або складванне блокаў. ДХО маюць шмат ужыванняў і з'яўляюцца карысным інструментам для навучанне агентаў вучыцца і прымаць рашэнні ў складаных умовах.

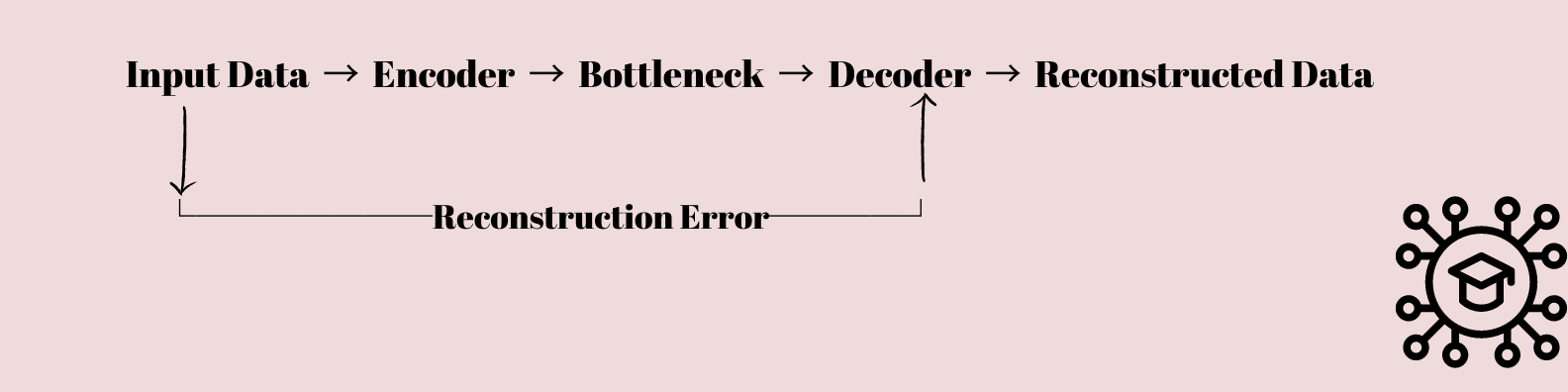

6. Аўтакадавальнікі

Аўтакадавальнікі - цікавы тып нейронных сеткі што зацікавіла як навукоўцаў, так і даследчыкаў дадзеных. Яны прынцыпова распрацаваны, каб навучыцца сціскаць і аднаўляць дадзеныя.

Уваходныя даныя падаюцца праз паслядоўнасць слаёў, якія паступова зніжаюць памернасць даных, пакуль яны не сціскаюцца ў пласт вузкага месца з меншай колькасцю вузлоў, чым на ўваходным і выходным слаях.

Гэта сціснутае прадстаўленне затым выкарыстоўваецца для аднаўлення зыходных уваходных даных з выкарыстаннем паслядоўнасці слаёў, якія паступова павялічваюць памернасць даных да зыходнай формы.

Чаму гэта важна?

Аўтакадавальнікі з'яўляюцца важным кампанентам глыбокае вывучэнне таму што яны робяць магчымым выманне функцый і скарачэнне даных.

Яны здольныя ідэнтыфікаваць ключавыя элементы ўваходных даных і перавесці іх у сціснутую форму, якая затым можа быць ужыта для іншых задач, такіх як класіфікацыя, групоўка або стварэнне новых даных.

Дзе мы выкарыстоўваем автокодеры?

Выяўленне анамалій, апрацоўка натуральнай мовы і машыннае зрок гэта толькі некаторыя дысцыпліны, дзе выкарыстоўваюцца аўтакадавальнікі. Аўтакадавальнікі, напрыклад, можна выкарыстоўваць для сціску выявы, выдалення шуму выявы і сінтэзу выявы ў камп'ютэрным зроку.

Мы можам выкарыстоўваць аўтакадавальнікі ў такіх задачах, як стварэнне тэксту, катэгарызацыі тэксту і абагульненне тэксту пры апрацоўцы натуральнай мовы. Ён можа вызначыць анамальную актыўнасць у дадзеных, якая адхіляецца ад нормы пры ідэнтыфікацыі анамаліі.

7. Капсульныя сеткі

Capsule Networks - гэта новая архітэктура глыбокага навучання, якая была распрацавана ў якасці замены згортачным нейронавым сеткам (CNN).

Капсульныя сеткі заснаваныя на паняцці групоўкі адзінак мозгу, званых капсуламі, якія адказваюць за распазнаванне існавання пэўнага элемента на малюнку і кадзіраванне яго атрыбутаў, такіх як арыентацыя і становішча, у свае выходныя вектары. Капсульныя сеткі могуць лепш кіраваць прасторавымі ўзаемадзеяннямі і перспектыўнымі ваганнямі, чым CNN.

Чаму мы выбіраем капсульныя сеткі перад CNN?

Капсульныя сеткі карысныя, таму што яны пераадольваюць цяжкасці CNN у фіксацыі іерархічных сувязяў паміж элементамі на малюнку. CNN могуць распазнаваць прадметы розных памераў, але цяжка зразумець, як гэтыя прадметы злучаюцца адзін з адным.

Capsule Networks, з іншага боку, могуць навучыцца распазнаваць рэчы і іх часткі, а таксама тое, як яны прасторава размешчаны на малюнку, што робіць іх жыццяздольным канкурэнтам для прыкладанняў камп'ютэрнага зроку.

Вобласці прымянення

Capsule Networks ужо прадэманстравала шматспадзеўныя вынікі ў розных сферах прымянення, уключаючы класіфікацыю малюнкаў, ідэнтыфікацыю аб'ектаў і сегментацыю малюнкаў.

Іх выкарыстоўвалі, каб адрозніваць рэчы на медыцынскіх фотаздымках, распазнаваць людзей на фільмах і нават ствараць 3D-мадэлі з 2D-малюнкаў.

Для павышэння прадукцыйнасці Capsule Networks былі аб'яднаны з іншымі архітэктурамі глыбокага навучання, такімі як Generative Adversarial Networks (GAN) і Variation Autoencoders (VAE). Прагназуецца, што Capsule Networks будуць адыгрываць усё больш важную ролю ва ўдасканаленні тэхналогій камп'ютэрнага зроку па меры развіцця навукі пра глыбокае навучанне.

Напрыклад; Нібабель з'яўляецца добра вядомым інструментам Python для чытання і запісу тыпаў файлаў нейровизуализации. Для сегментацыі малюнкаў ён выкарыстоўвае Capsule Networks.

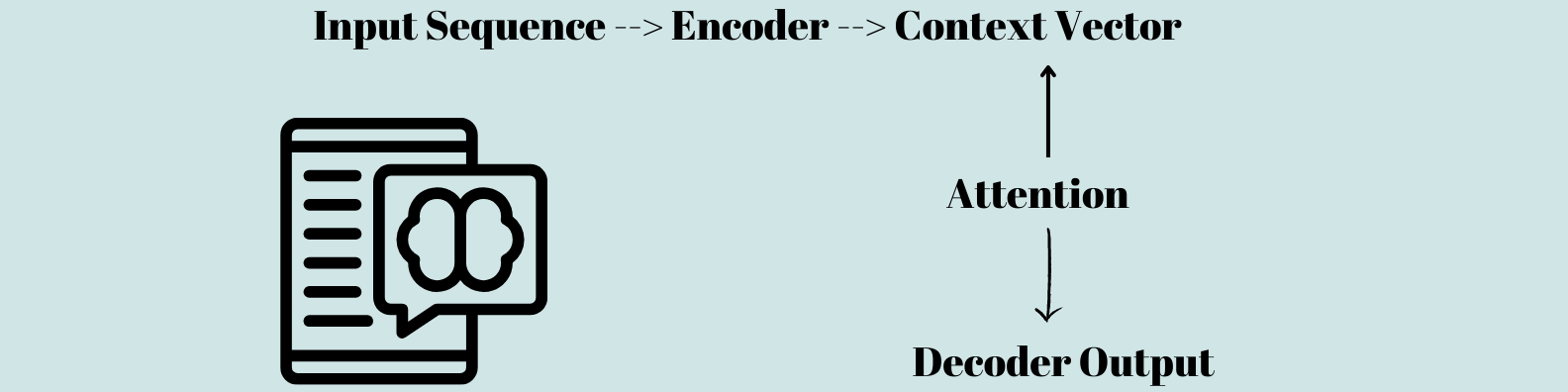

8. Мадэлі, заснаваныя на ўвазе

Мадэлі глыбокага навучання, вядомыя як мадэлі, заснаваныя на ўвазе, таксама вядомыя як механізмы ўвагі, імкнуцца павысіць дакладнасць мадэлі машыннага навучання. Гэтыя мадэлі працуюць, канцэнтруючыся на пэўных асаблівасцях ўваходных даных, што прыводзіць да больш эфектыўнай і дзейснай апрацоўкі.

У задачах апрацоўкі натуральнай мовы, такіх як машынны пераклад і аналіз пачуццяў, метады ўвагі паказалі сябе даволі паспяховымі.

Якое іх значэнне?

Мадэлі, заснаваныя на ўвазе, карысныя, таму што яны дазваляюць больш эфектыўна і эфектыўна апрацоўваць складаныя даныя.

Традыцыйныя нейронныя сеткі ацэньваць усе ўваходныя даныя як аднолькава важныя, што прыводзіць да больш павольнай апрацоўкі і зніжэння дакладнасці. Працэсы ўвагі канцэнтруюцца на найважнейшых аспектах ўваходных даных, што дазваляе рабіць больш хуткія і дакладныя прагнозы.

Вобласці выкарыстання

У галіне штучнага інтэлекту механізмы ўвагі маюць шырокі спектр прымянення, уключаючы апрацоўку натуральнай мовы, распазнаванне малюнкаў і гуку і нават транспартныя сродкі без кіроўцы.

Метады ўвагі, напрыклад, можна выкарыстоўваць для паляпшэння машыннага перакладу пры апрацоўцы натуральнай мовы, дазваляючы сістэме засяродзіцца на пэўных словах або фразах, якія важныя для кантэксту.

Метады прыцягнення ўвагі ў аўтаномных аўтамабілях могуць быць выкарыстаны, каб дапамагчы сістэме засяродзіцца на пэўных прадметах або праблемах вакол яе.

9. Трансфарматарныя сеткі

Трансфарматарныя сеткі - гэта мадэлі глыбокага навучання, якія вывучаюць і ствараюць паслядоўнасці даных. Яны функцыянуюць, апрацоўваючы ўваходную паслядоўнасць па адным элементу і ствараючы выхадную паслядоўнасць аднолькавай або рознай даўжыні.

Трансфарматарныя сеткі, у адрозненне ад стандартных мадэляў паслядоўнасці да паслядоўнасці, не апрацоўваюць паслядоўнасці з дапамогай рэкурэнтных нейронавых сетак (RNN). Замест гэтага яны выкарыстоўваюць працэсы самаканцэнтрацыі, каб даведацца сувязі паміж часткамі паслядоўнасці.

У чым важнасць трансфарматарных сетак?

Папулярнасць трансфарматарных сетак у апошнія гады вырасла ў выніку іх лепшай прадукцыйнасці ў апрацоўцы натуральнай мовы.

Яны асабліва добра падыходзяць для такіх задач па стварэнні тэксту, як пераклад на мову, рэфераванне тэксту і стварэнне размовы.

Трансфарматарныя сеткі значна больш эфектыўныя ў вылічэннях, чым мадэлі на аснове RNN, што робіць іх пераважным выбарам для буйнамаштабных прыкладанняў.

Дзе знайсці трансфарматарныя сеткі?

Трансфарматарныя сеткі шырока выкарыстоўваюцца ў шырокім дыяпазоне прыкладанняў, у першую чаргу апрацоўкі натуральнай мовы.

Серыя GPT (Generative Pre-trained Transformer) - гэта вядомая мадэль на аснове трансфарматара, якая выкарыстоўвалася для такіх задач, як моўны пераклад, абагульненне тэксту і стварэнне чат-бота.

BERT (Bidirectional Encoder Representations from Transformers) - яшчэ адна распаўсюджаная мадэль на аснове трансфарматара, якая выкарыстоўваецца для прыкладанняў разумення натуральнай мовы, такіх як адказы на пытанні і аналіз настрояў.

Абодва GPT і BERT былі створаны з PyTorch, платформа глыбокага навучання з адкрытым зыходным кодам, якая была папулярная для распрацоўкі мадэляў на аснове трансфарматараў.

10. Абмежаваныя машыны Больцмана (RBM)

Абмежаваныя машыны Больцмана (RBM) - гэта свайго роду некантралюемая нейронавая сетка, якая вучыцца генератыўна. З-за іх здольнасці вучыцца і здабываць важныя характарыстыкі з высакамерных даных яны шырока выкарыстоўваюцца ў галіне машыннага і глыбокага навучання.

RBM складаюцца з двух слаёў, бачнага і схаванага, прычым кожны пласт складаецца з групы нейронаў, злучаных узважанымі краямі. RBM прызначаны для вывучэння размеркавання верагоднасцей, якое апісвае ўваходныя даныя.

Што такое абмежаваныя машыны Больцмана?

RBM выкарыстоўваюць стратэгію генератыўнага навучання. У RBM бачны пласт адлюстроўвае ўваходныя даныя, а схаваны пласт кадуе характарыстыкі ўваходных даных. Вага бачнага і схаванага слаёў паказвае сілу іх сувязі.

RBM рэгулююць вагу і зрушэнне паміж пластамі падчас трэніровак з дапамогай метаду, вядомага як кантрасная дывергенцыя. Кантрастыўная дывергенцыя - гэта стратэгія некантраляванага навучання, якая максімальна павялічвае верагоднасць прадказання мадэлі.

Якое значэнне абмежаваных машын Больцмана?

УРК значныя ў навучанне з дапамогай машыны і глыбокае навучанне, таму што яны могуць вывучаць і здабываць адпаведныя характарыстыкі з вялікіх аб'ёмаў даных.

Яны вельмі эфектыўныя для распазнання выявы і маўлення, і яны выкарыстоўваюцца ў розных прыкладаннях, такіх як сістэмы рэкамендацый, выяўленне анамалій і памяншэнне памернасці. RBM могуць знаходзіць заканамернасці ў велізарных наборах даных, што прыводзіць да выдатных прагнозаў і разумення.

Дзе можна выкарыстоўваць абмежаваныя машыны Больцмана?

Прыкладання для RBM ўключаюць памяншэнне памернасці, выяўленне анамалій і сістэмы рэкамендацый. RBM асабліва карысныя для аналізу настрояў і тэматычнае мадэляванне у кантэксце апрацоўкі натуральнай мовы.

Глыбокія сеткі перакананняў, свайго роду нейронныя сеткі, якія выкарыстоўваюцца для распазнавання голасу і малюнкаў, таксама выкарыстоўваюць RBM. Набор інструментаў Deep Belief Network, TensorFlow, і Theano некаторыя канкрэтныя прыклады праграмнага забеспячэння або тэхналогіі, якая выкарыстоўвае RBM.

хутацца

Мадэлі глыбокага навучання становяцца ўсё больш і больш важнымі ў розных галінах, уключаючы распазнаванне маўлення, апрацоўку натуральнай мовы і камп'ютэрнае зрок.

Згорткавыя нейронавыя сеткі (CNN) і рэкурэнтныя нейронавыя сеткі (RNN) паказалі найбольшую перспектыву і шырока выкарыстоўваюцца ў многіх праграмах, аднак усе мадэлі глыбокага навучання маюць свае перавагі і недахопы.

Тым не менш, даследчыкі ўсё яшчэ вывучаюць абмежаваныя машыны Больцмана (RBM) і іншыя разнавіднасці мадэляў глыбокага навучання, таму што яны таксама маюць асаблівыя перавагі.

Чакаецца, што будуць створаны новыя і крэатыўныя мадэлі, паколькі вобласць глыбокага навучання працягвае развівацца, каб вырашаць больш складаныя праблемы

Пакінуць каментар