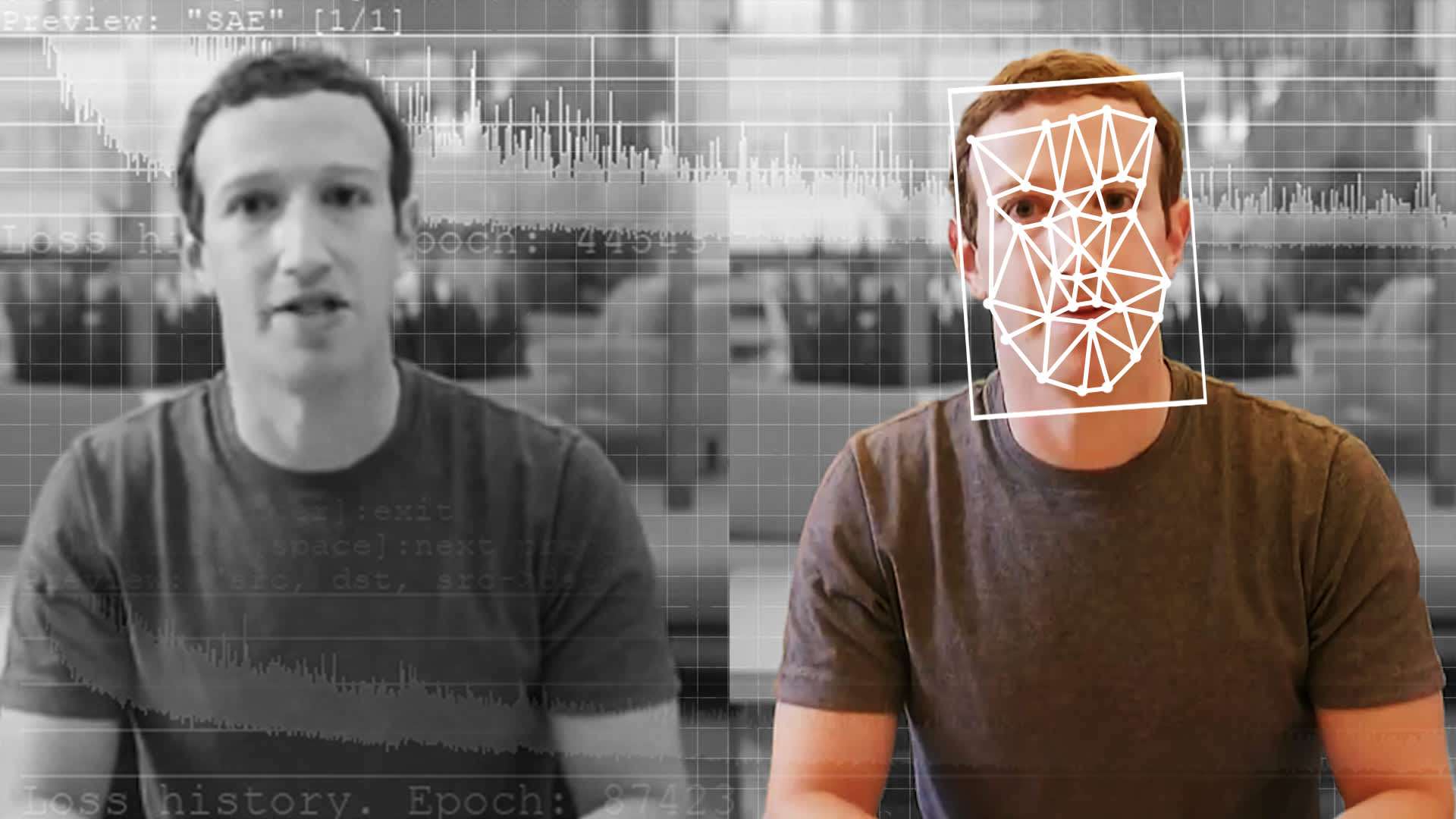

ማርክ ዙከርበርግ የመረጃ መሰረቁን እና ባራክ ኦባማ ዶናልድ ትራምፕን ሲበድሉ የሚያሳየፉ ቪዲዮዎች ኢንተርኔት ለረጅም ጊዜ ሲሰራጭ ቆይቷል?

እነዚህ ቪዲዮዎች Deepfake የሚባል በጣም የላቀ እና የወደፊት የኤአይ ቴክኖሎጂ ውጤቶች ናቸው።

በቀላል አነጋገር ለቪዲዮ የፎቶሾፕ አማራጭ ነው። በአንድ በኩል የኤሌክትሮኒካዊ ሚድያን ለውጥ ሊያመጣ የሚችለው የአንድን ሰው ፍላጎት በማስቀረት ነው።

በሌላ በኩል ማንም ሰው በቪዲዮ ላይ ማንኛውንም ነገር እንዲናገር ስለምትችሉ ማንነትዎን በእጅጉ ያስፈራራል።

Deepfakes ይጠቀማሉ ጥልቀት ያለው ትምህርት የሐሰት ክስተቶች ፎቶዎችን እና ቪዲዮዎችን ለመፍጠር፣ ስለዚህም ጥልቅ ውሸት የሚል ስም ተሰጥቶታል። በነባር ቪዲዮዎች ላይ ፊቶችን መለዋወጥ ብቻ ሳይሆን አዲስ ፍሬሞችን እና ቪዲዮዎችን ከባዶ መፍጠር ይችላል።

የ Deepfakes አመጣጥ

ሰፊ አካዴሚያዊ ምርምር ባለፉት ጥቂት አመታት ውስጥ የፎቶ እና የቪዲዮ ማጭበርበር ድንበሮችን ገፋ. Deepfake የእነዚህ የአካዳሚክ ጥናቶች ውጤት ነው።

በ1997 የመጀመሪያው የቪዲዮ ማጭበርበር ሪፖርት ተደረገ። የአንድ ሰው ቪዲዮ በተለየ የድምጽ ትራክ ውስጥ ያሉትን ቃላት እንዲናገር ተስተካክሏል። ለመጀመሪያ ጊዜ ጥቅም ላይ የሚውለው የፊት ገጽታን እንደገና ማንሳት ነው የማሽን መማር ዘዴዎች.

በ2017 የቀድሞው የአሜሪካ ፕሬዝዳንት ባራክ ኦባማ ቪዲዮ ከተለየ የድምጽ ትራክ ጋር በሚመሳሰል መልኩ የተለያዩ ቃላትን እንዲናገር ሲስተካከል ተጨማሪ ጉልህ እድገት ታይቷል።

እ.ኤ.አ. በ2018 በካሊፎርኒያ ፣ በርክሌይ ዩኒቨርሲቲ ተመራማሪዎች ሀ ሊፈጥር የሚችል መተግበሪያ አስተዋውቀዋል ጥልቅ ትምህርትን በመጠቀም የውሸት ዳንስ ቪዲዮ. ይህም ቀደም ሲል የተሰሩ ስራዎች በፊት ላይ ብቻ የተገደቡ በመሆናቸው ጥልቅ ሀሰቶችን ወደ መላ ሰውነት መስፋፋት አመልክቷል።

ጥልቅ ሐሰተኞች እንዴት ይፈጠራሉ?

በኮምፒዩተር ውስጥ ላሉት እድገቶች ምስጋና ይግባውና አሁን ጥልቅ ሐሰቶችን በአንፃራዊነት በቀላሉ እና በዝቅተኛ ወጪ ማዳበር ይችላሉ። ጥልቅ ሐሰቶችን ለመፍጠር ሁለት ዋና ዘዴዎች ጥቅም ላይ ይውላሉ.

ስልት 1

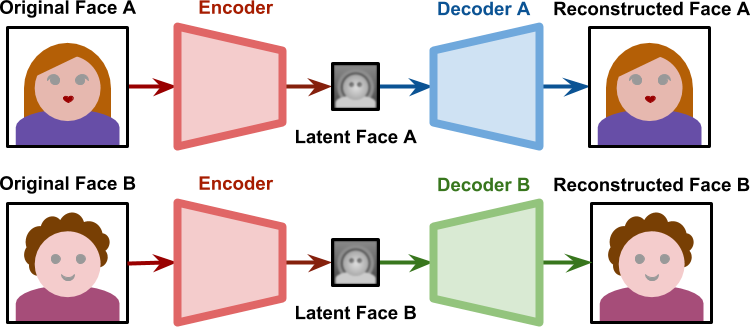

ማሰልጠን ይኖርብዎታል ሀ የነርቭ ኔትወርክ በሰውየው እውነተኛ የቪዲዮ ቀረጻ ላይ። ይህ ይፈቅዳል የነርቭ ኔትወርክ በተለያዩ ማዕዘኖች እና የብርሃን ሁኔታዎች ላይ የትምህርቱን የፊት ገጽታዎች ለመረዳት.

ከዚያ በኋላ የመጀመሪያውን ፊት እና ድብቅ ፊት ኢንኮደር በተባለው በ AI ስልተ-ቀመር በኩል ያስኬዳሉ። በሁለቱ ፊቶች መካከል ያለውን ልዩነት እና ተመሳሳይነት ፈልጎ ይማራል እና ሁለቱም ፊቶች ወደ ተጨመቀ ምስል ተቀንሰዋል የጋራ ባህሪያትን ይጋራሉ።

ከዚያም ሁለተኛው AI አልጎሪዝም ዲኮደር የሚባል ሲሆን ይህም ፊቶችን ከተጨመቁ ምስሎች መልሷል. ሁለቱም ፊቶች በሁለት የተለያዩ ዲኮደሮች ተመልሰዋል።

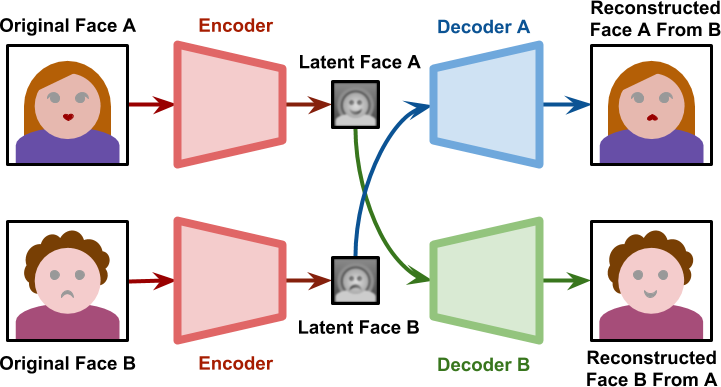

የፊት መለዋወጥን ለማከናወን በቀላሉ የተመሰጠሩትን ምስሎች ወደ ሌላ ዲኮደር ይመገባሉ።

ለምሳሌ፣ የፊት A ኢንኮደር ውፅዓት በፊት B ላይ በሰለጠነ ዲኮደር ውስጥ ይመገባል ከዚያም ፊት B ከፊቱ ገፅታዎች ጋር እንደገና ይገነባል። ይህንን ለአሳማኝ ውጤት በእያንዳንዱ የቪድዮ ፍሬም ላይ ማድረግ ይኖርብዎታል።

ስልት 2

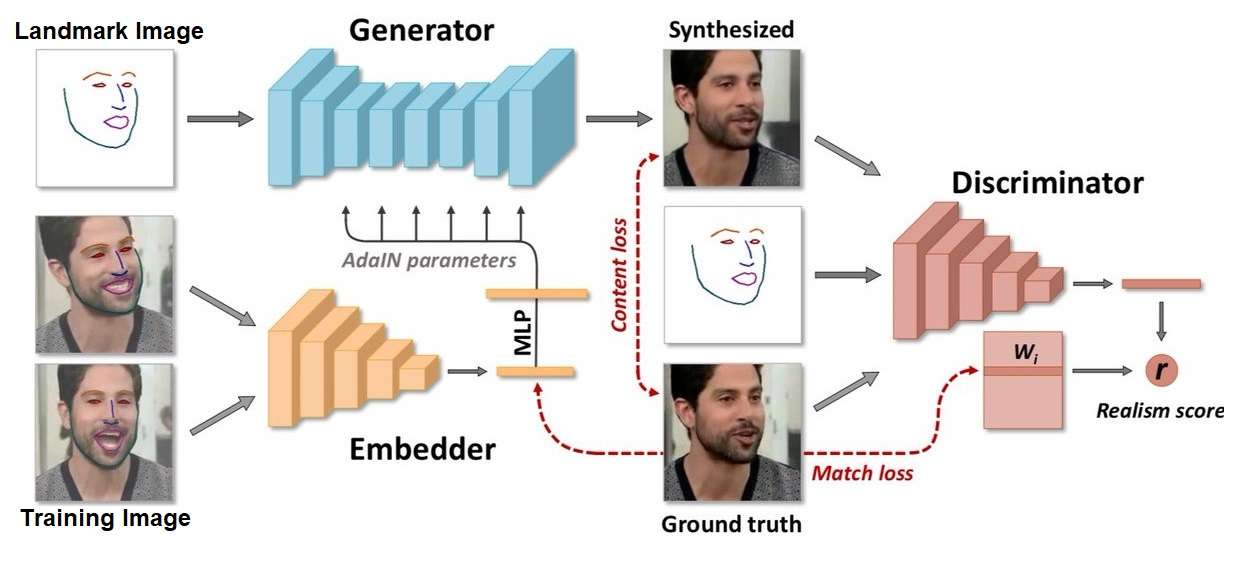

ጥልቅ ሀሰቶችን ለመፍጠር ሌላው ዘዴ Generative Adversarial Network (GAN) ነው።

ጥልቅ ሀሰቶችን ለመፍጠር ሁለት ተፎካካሪ ስልተ ቀመሮችን መጠቀም አለቦት። የመጀመሪያው ምስልን ለመፍጠር የዘፈቀደ ድምጽ ይጠቀማል እና ጄነሬተር ይባላል። ይህ ሰው ሰራሽ ምስል አድልዎ በሚባለው ሁለተኛ ስልተ ቀመር ወደ እውነተኛ ምስሎች ጅረት ይመገባል።

አድልዎ ለጄነሬተር ግብረመልስ ይሰጣል ይህም በአስተያየቱ መሰረት ሌላ ምስል ይፈጥራል. በዚህ መንገድ ሁለቱም ስልተ ቀመሮች በእያንዳንዱ ድግግሞሽ የተሻሻሉ ውጤቶችን ይሰጣሉ. አስፈላጊው ትክክለኛነት እስኪሳካ ድረስ ይህ ሂደት ብዙ ጊዜ ይደጋገማል.

GAN ፍፁም እውነተኛ ውጤቶችን ያቀርባል፣ ግን አብሮ መስራት ከባድ ነው እና እጅግ በጣም ብዙ የስልጠና ውሂብ እና የኮምፒዩተር ሃይል ይፈልጋል። ለዚያም ነው ከቪዲዮ ክሊፖች ይልቅ ምስሎችን ለመፍጠር በአጠቃላይ የሚመረጠው።

የ Deepfakes አንዳንድ አሳማኝ ምሳሌዎች

በበይነመረብ ዙሪያ የሚሽከረከሩ አንዳንድ በጣም አሳማኝ ጥልቅ ሐሰቶች አሉ እና አብዛኛዎቹ ታዋቂ ሰዎች ናቸው።

ለምሳሌ፣ ለቶም ክሩዝ ጥልቅ ሐሰተኛ ጉዳዮች ብቻ የተወሰነ የቲክ ቶክ መለያ አለ። ቪዲዮዎች የክሩዝ ጎልፍ መጫወትን ወይም አስማታዊ ዘዴን ያሳያሉ።

@Deeptomcruise ጉዞ! ????

ሌላ በጣም የተወሳሰበ ጥልቅ ሀሰተኛ ከቶም ክሩዝ፣ ሮበርት ዳውኒ ጁኒየር፣ ጄፍ ጎልድብሎም፣ ጆርጅ ሉካስ እና ኢዋን ማክግሪጎር ጋር በዩቲዩብ ላይ ተሰቅሏል። አንዳንድ ግልጽ ድክመቶች አሉት፣ ግን በአንድ ጊዜ ከ3 እስከ 4 ጥልቅ ሀሰቶችን በቪዲዮ ውስጥ ማካሄድ በራሱ ትልቅ ስራ ነው።

ሌላው ምሳሌ የቀድሞ ፕሬዝዳንት ባራክ ኦባማ ጥልቅ ሀሰተኛ ቪዲዮ ነው።

ይህ የርዕሱን ድምጽ እና ምልክቶችን መኮረጅ የሚችሉ አስመሳዮችን ድምጽ እና ምልክቶች ሲጠቀም በሚያስደንቅ ሁኔታ አሳማኝ ነው።

በዘመናዊው የመዝናኛ ኢንዱስትሪ ውስጥ ጥልቅ ሀሰቶችን እያየን ነው።

የተዋናዩ ያልተጠበቀ ሞት በፈጣን እና ቁጡ 7 ውስጥ የፖል ዎከርን ትዕይንቶች ለመተኮስ ያገለግል ነበር። ጥልቅ ሐሰቱ በሚያስደንቅ ትክክለኛነት በወንድሙ ላይ ጥቅም ላይ ውሏል።

Deepfakes ወደ ጠረጴዛው ምን ያመጣሉ?

Deepfakes በመገናኛ ብዙኃን እና በመዝናኛ ላይ አብዮትን ለማምጣት በጣም አስተማማኝ ቴክኖሎጂ መሆኑን አረጋግጠዋል።

የሄንሪ ካቪል ጢም በሲጂአይ በ “ማን ኦፍ ስቲል” ሲወገድ እና ጥፋት እንደሆነ ያስታውሳሉ?

ከጥቂት ሺህ ዶላር በላይ በሆኑ ኮምፒውተሮች ላይም እንዲሁ አሳማኝ ውጤት ማግኘት ይቻላል።

አሁን የሞቱትን ቅድመ አያቶችዎን እና የሚወዷቸውን ሰዎች ማግኘት ይችላሉ. ከራሱ ከአልበርት አንስታይን የፊዚክስ ትምህርት መከታተል ትችላለህ።

ከዚህ ሁሉ በተጨማሪ ጥልቅ ውሸት ሙሉ በሙሉ ጥቅም ላይ የዋለው በታሰበው መንገድ አይደለም. በበይነመረቡ ላይ ከሚገኙት ጥልቅ ሀሰቶች 96% የሚሆኑት ስምምነት የሌላቸው የብልግና ምስሎች ናቸው።

ለታዋቂ ሰዎች ያለው ከፍተኛ መጠን ያለው የሥልጠና መረጃ ጥልቅ ሐሰት ሰለባዎች እንዲሆኑ አድርጓቸዋል።

ማንንም ሰው በአደገኛ ወይም ሊደራደሩ በሚችሉ ሁኔታዎች ውስጥ እንድናስቀምጥ አስችሎናል እና ስለዚህ ለሁሉም ሰው ትልቅ አደጋን ይፈጥራል።

የድምጽ ጥልቅ ሐሰተኛ ኮርፖሬሽኖችን ለማጭበርበር ጥቅም ላይ እንደሚውል ተዘግቧል። እ.ኤ.አ. በ2019፣ አንድ አስመሳይ በዩናይትድ ኪንግደም የሚገኘውን የድርጅቱ ዋና ስራ አስፈፃሚ የድርጅቱን እናት ኩባንያ ስራ አስፈፃሚ በማስመሰል €220,000 ወደ ሀንጋሪ ባንክ እንዲያስተላልፍ ለማዘዝ ጥልቅ የውሸት ድምጽ ተጠቅሟል።

ተንኮል-አዘል Deepfakesን እንዴት መቋቋም እንደሚቻል?

በተለምዶ፣ ፍሬም በፍሬም በደንብ በመመልከት እና ቅርሶችን እና ጉድለቶችን በመፈለግ ጥልቅ የውሸት ቪዲዮዎችን ማግኘት ይችላሉ።

ነገር ግን፣ ተቃራኒ-የሚታወቅ ሂደት ነው እና ብዙ ኩባንያዎች በአልጎሪዝም እና ሶፍትዌር ላይ እየሰሩ ነው። ጥልቅ ሐሰቶችን መለየት.

ፌስቡክ ከበርክሌይ፣ ኦክስፎርድ እና ሌሎች ተቋማት ተመራማሪዎችን በመመልመል ጥልቅ ሀሰተኛ መርማሪን ለመስራት ችሏል። በተመሳሳይ፣ ዩቲዩብ ከአሜሪካ ምርጫ፣ የድምጽ አሰጣጥ ሂደት እና ከ2020 የአሜሪካ ቆጠራ ጋር የተያያዙ ጥልቅ የውሸት ቪዲዮዎችን እንደማይቀበል አስታውቋል።

እንዲሁም እንደ ፕሮግራሞች መጠቀም ይችላሉ የእውነታ ተከላካይ እና ጥልቅ ሐሰቶችን ለመለየት።

በአጠቃላይ ጥልቅ ሀሰቶችን አጠቃቀም በተመለከተም ሀገራት ህግ ማውጣት ላይ ተጠምደዋል። ዩኤስ ባለፈው አመት ጥልቅ ሀሰቶችን በሚመለከት በርካታ ህጎችን ተግባራዊ አድርጋለች።

መጠቅለል

Deepfake የ AI እድገት ሕያው መገለጫ ነው። የወደፊቱን ወሰን የበለጠ ያደበዝዛል, ነገር ግን በበይነመረብ ላይ ላለው የቪዲዮ-ግራፊክ ይዘት ተዓማኒነት ስጋት ሊሆን ይችላል.

ሰዎች በበይነመረቡ ላይ ያለውን እያንዳንዱን ቪዲዮ መጠራጠር የሚጀምሩበት ጊዜ ይመጣል እና ወደ ተጨማሪ እርግጠኛነት ወደሌለው ዘመን የምንገፋበት ጊዜ ይኖራል።

መልስ ይስጡ