Mundarija[Yashirish][Show]

Soxta fotosuratlar va videolarga ega bo'lish yangilik emas. Internet keng qo'llanilgach, odamlar tasvirlar va filmlar paydo bo'lganidan beri aldash yoki o'yin-kulgi uchun soxta narsalarni yaratmoqdalar.

Biroq, mashinada ishlab chiqarilgan soxta narsalarning yangi turi mavjud bo'lib, ular bir kun kelib haqiqatni fantastikadan ajratishni qiyinlashtirishi mumkin.

Ushbu soxta narsalar Photoshop kabi tahrirlash dasturlari yoki o'tmishdagi mohirlik bilan boshqariladigan filmlar orqali yaratilgan oddiy rasm manipulyatsiyalaridan farq qiladi.

Deepfakes "sintetik media" ning eng mashhur namunasidir - an'anaviy usullardan foydalangan holda yaratilgan, ammo haqiqatan ham murakkab dasturiy ta'minot yordamida yaratilgan tasvirlar, tovushlar va videolar.

Deepfakes bir muncha vaqtdan beri mavjud bo'lib, ularning eng mashhur qo'llanilishi pornografik filmlardagi aktyorlarning tanasiga mashhur odamlarning boshlarini qo'yish bo'lsa-da, ular istalgan joyda, har qanday odamning biror narsa qilayotganini ishonchli tasvirlarni yaratish qobiliyatiga ega.

Ushbu postda biz Deepfakes-ni, uning qanday ishlashini, ularni qanday qilib o'zingiz yaratishingiz mumkinligini va yana ko'p narsalarni ko'rib chiqamiz.

Xo'sh, DeepFake nima?

Deepfake - chuqur o'rganish va soxta iboralarning kombinatsiyasi - bir parcha sintetik vosita unda boshqa shaxsning o'xshashligi allaqachon mavjud bo'lgan fotosurat yoki videodagi shaxsni almashtirish uchun ishlatiladi.

Deepfakes aldash ehtimoli yuqori bo'lgan vizual va audio ma'lumotlarni o'zgartirish va yaratish uchun murakkab mashina o'rganish va sun'iy intellekt usullaridan foydalanadi.

Avtokoderlar va generativ raqib tarmoqlari kabi chuqur o'rganish usullari deepfake ishlab chiqarish (GAN) uchun asosiy mexanizmdir.

Ushbu modellar odamning yuzidagi his-tuyg'ularini va harakatlarini tahlil qilish va taqqoslanadigan ifodalar va harakatlarni aks ettiruvchi boshqa odamlarning yuz rasmlarini sintez qilish uchun ishlatiladi.

Mashhurlarning pornografik videolari, soxta yangiliklar, aldashlar va moliyaviy firibgarliklarda deepfakesdan foydalanish katta e'tiborni tortdi. Sanoat ham, hukumat ham ularni topishga va ulardan foydalanishni cheklashga urinib javob berdi.

Birinchi tartibli harakat modeli

O'tmishda chuqur soxta narsalarni ishlab chiqishga harakat qilganda, muammo shundaki, biz ushbu yondashuvlar ishlashi uchun qandaydir qo'shimcha bilim yoki oldingi narsalarga muhtojmiz.

Misol sifatida, agar biz bosh harakatini kuzatishni xohlasak, yuz belgilari talab qilinadi. Agar biz butun tana harakatining xaritasini yaratmoqchi bo'lsak, pozani baholash kerak edi.

O'tgan yili NeurIPS konferentsiyasida Toronto universiteti tadqiqot guruhi o'z ishlarini taqdim etganida bu o'zgardi, "Tasvir animatsiyasi uchun birinchi tartibli harakat modeli. "

Ushbu yondashuv uchun animatsiya bo'yicha qo'shimcha bilim kerak emas. Bundan tashqari, ushbu model o'qitilgandan so'ng, uni ko'chirishni o'rganish uchun ishlatish va bir xil toifaga kiruvchi har qanday elementga qo'llash mumkin.

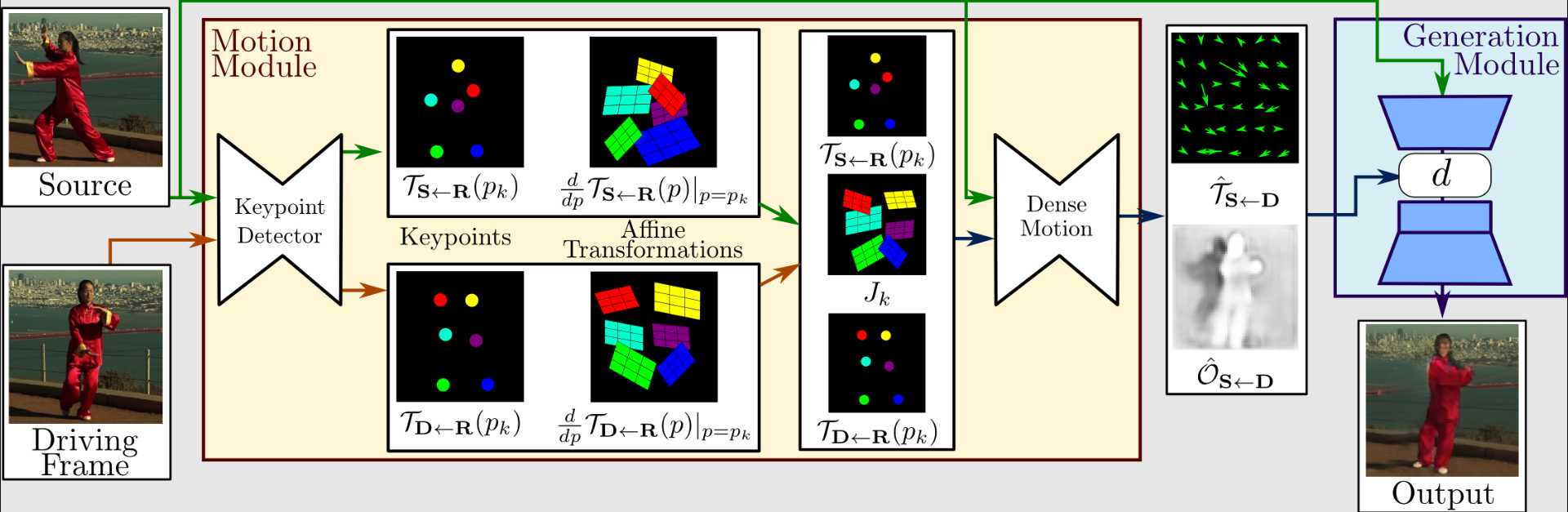

Keling, ushbu usulning ishlashini biroz ko'rib chiqaylik. Motion Extraction va Generation butun jarayonning birinchi yarmini tashkil qiladi. Haydash videosi va manba rasmlari kirish sifatida ishlatiladi.

Noyob asosiy nuqtalar va mahalliy affin o'zgarishlardan iborat birinchi tartibli harakat tasvirini olish uchun harakat ekstraktori asosiy nuqtalarni aniqlash uchun avtokoderdan foydalanadi.

Zich harakatlanish tarmog'i bilan zich optik oqim va okklyuzion xaritani yaratish uchun ular videoni boshqarish bilan birga qo'llaniladi. Keyinchalik, generator zich harakat tarmog'idan va manba tasviridan olingan natijalardan foydalanib, maqsadli tasvirni yaratadi.

Umuman olganda, bu ish san'at darajasidan yaxshiroq ishlaydi. Shuningdek, u boshqa modellarda mavjud bo'lmagan xususiyatlarni ham o'z ichiga oladi. U bir nechta rasm turlarida ishlaydi, shuning uchun uni yuz, tana, multfilmlar va boshqalar tasvirlariga qo'llashingiz mumkin, bu juda ajoyib.

Bu ko'plab yangi imkoniyatlar yaratmoqda. Strategiyamizning yana bir muhim jihati shundaki, u endi maqsadli ob'ektning faqat bitta tasviridan foydalangan holda yuqori sifatli Deepfakes ishlab chiqarish imkonini beradi. Ob'ekt uchun YOLO tan olish.

Deepfake modelini yaratish jarayoni

Deepfake yaratish uchun uchta jarayon zarur: qazib olish, o'qitish va yaratish. Ushbu bosqichlarning har birining asosiy nuqtalari va ularning umumiy jarayon bilan qanday bog'liqligi ushbu bo'limda yoritiladi.

Ekstraksiya

Deepfakes yuzlarni o'zgartirish uchun chuqur neyron tarmoqlardan foydalanadi va to'g'ri va ishonchli ishlashi uchun juda ko'p ma'lumotlar (rasmlar) kerak. Ekstraksiya jarayoni videokliplardan barcha kadrlar olinadigan, yuzlar tanib olinadigan va undan keyin ishlashni maksimal darajada oshirish uchun yuzlar hizalanadigan bosqichdir.

Training

Trening bosqichida, neyron tarmoq bir yuzni boshqasiga o'zgartirishi mumkin. Amaliyot majmuasi va o'quv gadjetining hajmiga qarab, mashg'ulotlar bir necha soat yoki hatto kun davom etishi mumkin.

Trening boshqa neyron tarmoq treninglari singari bir marta tugatilishi kerak. Treningdan so'ng model yuzni A shaxsidan B shaxsiga o'zgartirishi mumkin edi.

Yaratilish

Model o'qitilgandan so'ng, deepfake ishlab chiqarilishi mumkin. Kadrlar videodan olinadi va keyin barcha yuzlarga tekislanadi. Keyin o'qitilgan neyron tarmoq har bir freymni o'zgartirish uchun ishlatiladi.

O'zgartirilgan yuzni oxirgi qadam sifatida asl ramka bilan birlashtirish kerak.

Deepfake aniqlash modelini yaratish

GitHub Repo-ni o'rnatish va klonlash

Colab-da ishlash vaqtida Google GPU-laridan bepul foydalanish imkoniyati mavjud chuqur o'rganish. Qo'shimcha afzallik - bu Google Drive-ni bulutli virtual mashinaga (VM) o'rnatish qobiliyati.

Uning barcha narsalariga oson kirish bilan foydalanuvchi yoqilgan. Google Drive-ni bulutdagi virtual mashinaga o'rnatish uchun zarur bo'lgan dastur ushbu bo'limda topiladi.

Import modullari

Endi biz barcha kerakli modullarni import qilamiz.

Modelni amalga oshirish

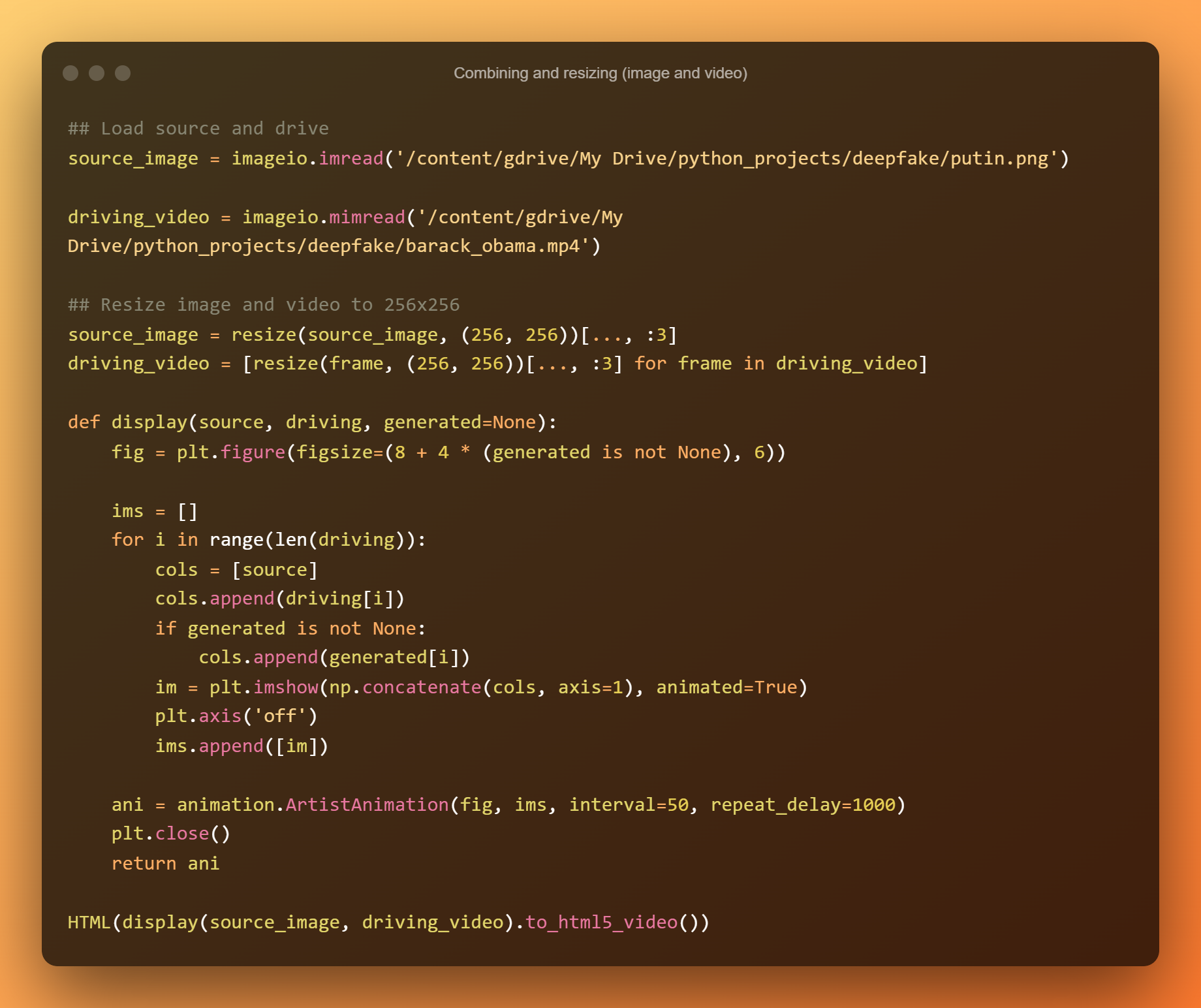

Biz Putinning surati (manba rasmi) bilan Obamaning videosini birlashtirgan misoldan foydalanamiz. Natijada Putinning nutqi va imo-ishoralari Obama haydash paytida ishlatgan yuz ifodalari bilan bir xil bo'lgan video.

Modelning natijasini ko'rsatishdan oldin media yuklanadi va funktsiyalar e'lon qilinadi. Keyin nazorat punktlari yuklanadi va model quriladi. Chuqur soxtalikni yaratgandan so'ng, ikki xil animatsiya uslubi ko'rsatiladi.

Putin Obamaning nisbiy asosiy nuqtani almashtirishdan foydalangan holda harakatlari bilan jonlanadi. Obamaning videolari davomida yuzidagi his-tuyg'ulari va tana tili Putin uchun chiroyli va aniq tasvirlangani hayratlanarli.

Bir nechta mikroskopik xatolar bor, ayniqsa Obama qoshlarini ko'tarib, ko'zlarini pirpiratganda. Bu iboralar Putin kadrlarida aynan takrorlanmagan.

Agar chuqur soxta fon bo'lmasa, Putin filmi televizorda yoki televizorda ko'rilsa, juda ishonchli va haqiqiy bo'lib ko'rinadi. ijtimoiy media.

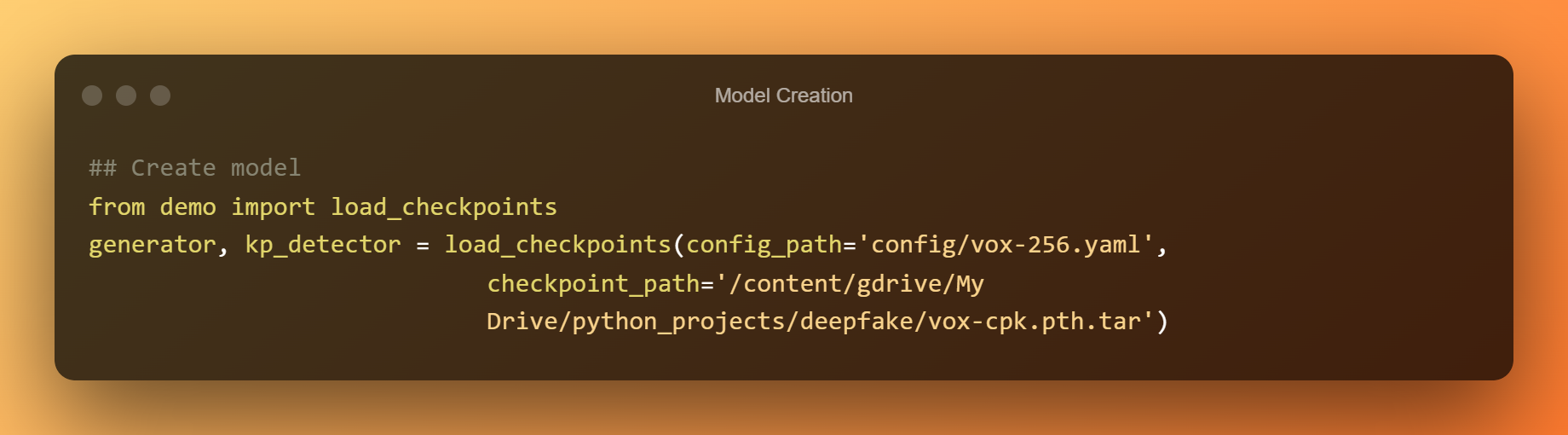

Model yaratish

Endi biz to'liq modelni yaratish uchun oldindan tayyorlangan nazorat punktlaridan foydalanamiz.

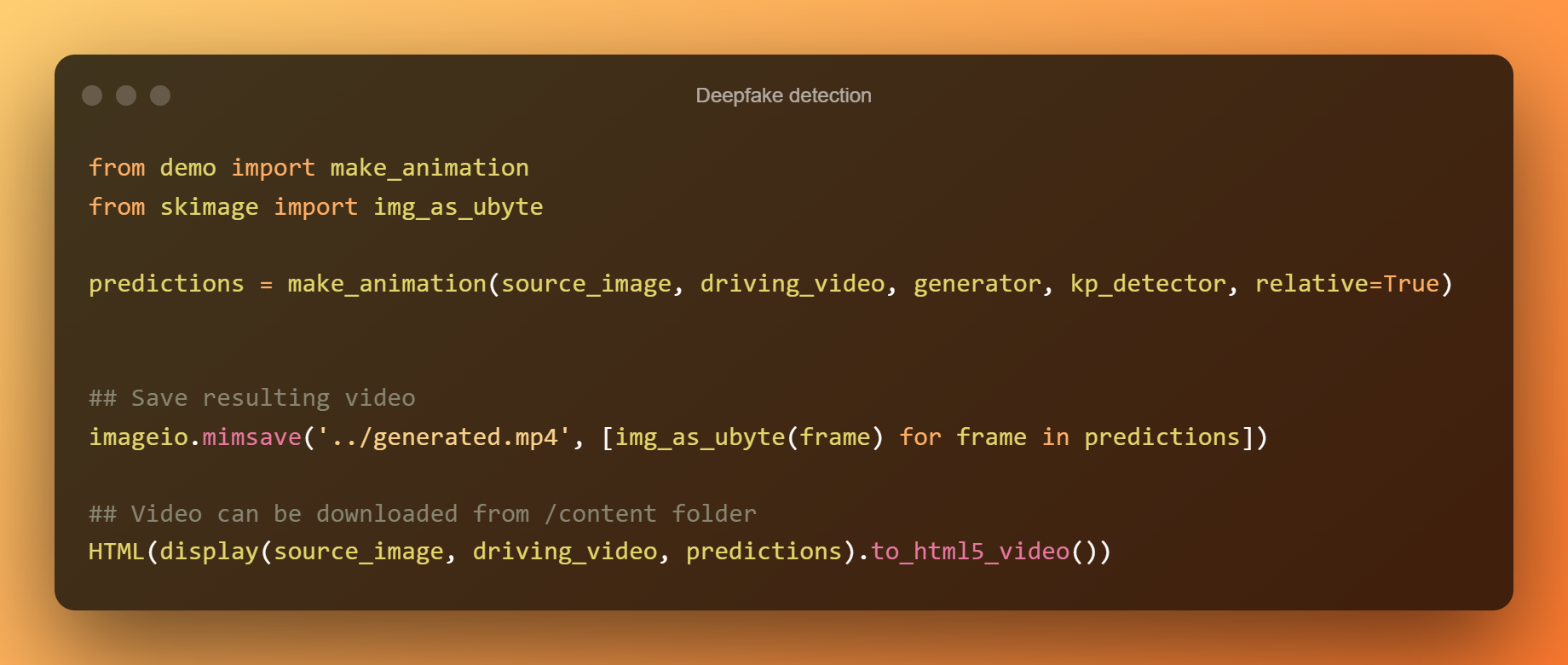

Deepfake aniqlash

Nisbatan kalit nuqtani almashtirish quyidagi katakdagi elementlarni jonlantirish uchun ishlatiladi. Keyingi katak o'rniga mutlaq koordinatalardan foydalanadi, lekin barcha element nisbatlari shu tarzda haydash videosidan olinadi.

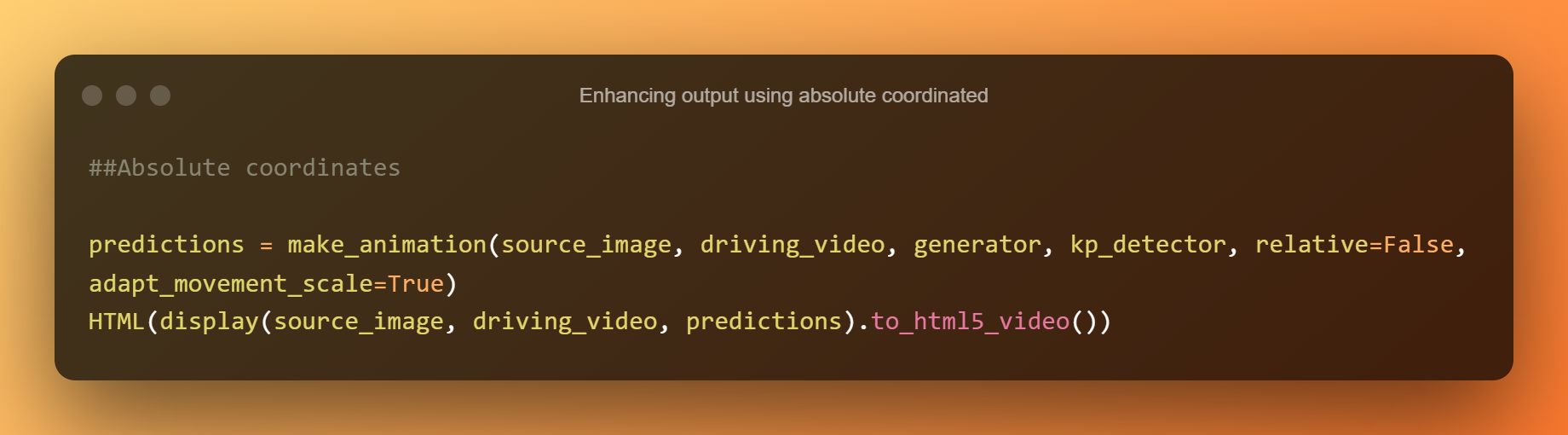

Mutlaq koordinatalar yordamida chiqishni kuchaytirish

Shu tarzda siz chuqur soxta aniqlashni ishlab chiqishingiz mumkin.

Deepfake texnologiyasining xavflari qanday?

Deepfake videolari endi yangiligi tufayli tomosha qilish uchun qiziqarli va qiziqarli. Biroq, bu kulgili tuyuladigan texnologiya ostida nazoratdan chiqib ketish xavfi mavjud.

Soxta va haqiqiy videolarni farqlash, albatta, qiyin bo'ladi deepfake texnologiyasi oldinga siljishda davom etmoqda. Ayniqsa, taniqli shaxslar va taniqli shaxslar uchun bu jiddiy oqibatlarga olib kelishi mumkin. Qasddan g'arazli bo'lgan Deepfakes mansab va hayotga butunlay zarar etkazishi mumkin.

Ulardan boshqalarga o'tish va do'stlari, qarindoshlari va hamkasblaridan foydalanish uchun yomon niyatli kishi foydalanishi mumkin. Ular, shuningdek, xorijiy yetakchilarning soxta filmlaridan foydalanib, dunyo miqyosidagi tortishuvlarni va hatto urushlarni keltirib chiqarishga qodir.

Xulosa

Xulosa qilib aytganda, biz g'alati davr va g'ayrioddiy muhitdamiz. Har doimgidan ham yolg'on xabarlar va filmlar ishlab chiqarish va ularni tarqatish oson. Nima haqiqat va nima noto'g'ri ekanligini tushunish tobora qiyinlashib bormoqda.

Bugun, ko'rinib turibdiki, biz endi o'z his-tuyg'ularimizga tayanolmaymiz.

Soxta video detektorlar ishlab chiqilganiga qaramay, ma'lumotlar bo'shlig'i shunchalik tor bo'lishi vaqt masalasidir, hatto eng yaxshi soxta detektorlar ham videoning haqiqiy yoki yo'qligini aniqlay olmaydi.

Leave a Reply