Щоб збирати інформацію з веб-сайтів для аналізу, дослідження або маркетингових цілей, веб-скрейпінг є надзвичайно важливою технікою. На щастя, є багато інструментів, які підтримують як безголові, так і головні браузери, які обидва корисні для веб-збирання.

Головні браузери мають графічний інтерфейс користувача (GUI), тоді як безголові браузери його не мають. Ці технології можуть як вручну, так і автоматично отримувати дані з веб-сторінок, що робить їх дуже корисними.

Під час роботи з великою кількістю даних безголові браузери є найкращим варіантом. Щоб автоматизувати процес вилучення даних, вам знадобляться ці інструменти, які заощадять вам купу часу та праці.

Крім того, вони допомагають підвищити точність і ефективність вилучення даних, що може призвести до кращих результатів у цілому.

Ці інструменти також можуть допомогти зменшити ймовірність виникнення помилок під час ручного копіювання та вставлення даних, оскільки вони мають здатність витягувати дані в організований спосіб.

Простіше кажучи, неможливо працювати без інструментів, які підтримують як безголові, так і головні браузери, якщо ви займаєтеся веб-збиранням.

У цій статті ми розглянемо найкращі безголові та головні браузери для веб-збирання.

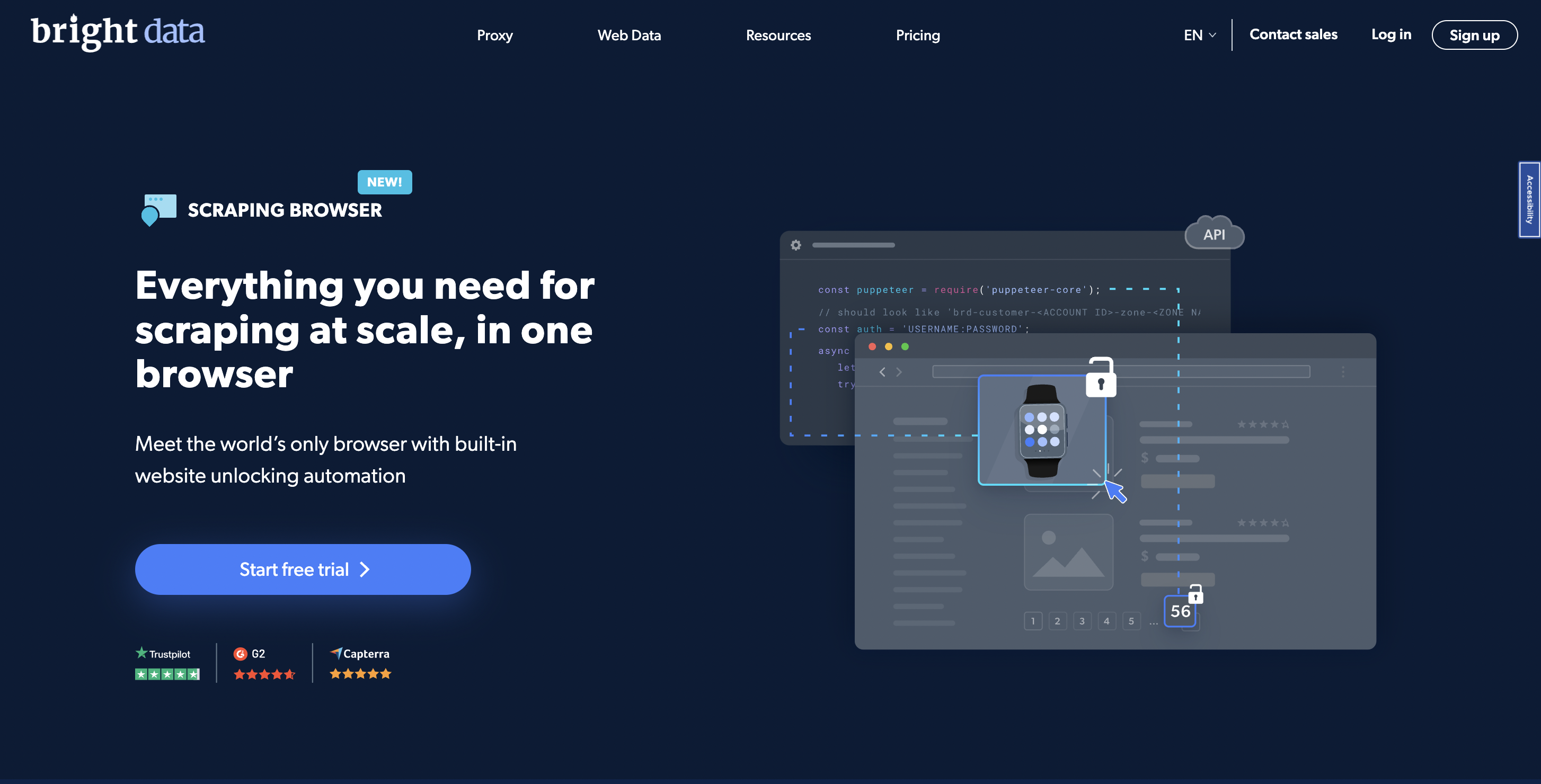

1. Яскраві дані

Bright Data — це програма для збирання веб-сторінок, яка надає вибір для збору даних для компаній і окремих осіб. На відміну від попередніх систем онлайн-збирання, Bright Data поставляється з попередньо завантаженою низкою браузерів, але функціонує як безголовий браузер.

Незважаючи на те, що він працює як безголовий браузер на серверній частині, це вказує на те, що користувачі можуть взаємодіяти з ним через графічний інтерфейс користувача (GUI), що робить його більш доступним і зручним.

Ця функція буде особливо корисною для тих, хто не дуже розбирається в кодуванні або хоче отримати більш простий підхід до веб-збирання. Завдяки потужному браузеру Bright Data користувачі можуть швидко переміщатися по складним веб-сайтам із взаємодією, схожою на людину.

Щоб зберегти вашу анонімність і невідомість, він також надає передові можливості, такі як ротація IP-адреси, сканування відбитків пальців браузера та підробка агента користувача. Завдяки штучному інтелекту браузер Scraping Browser зможе вийти за межі навіть найсучаснішого захисту від виявлення ботів.

Насправді Scraping Browser настільки складний, що він навіть може імітувати дії справжнього браузера користувача, надаючи вам більш успішні результати та точні дані.

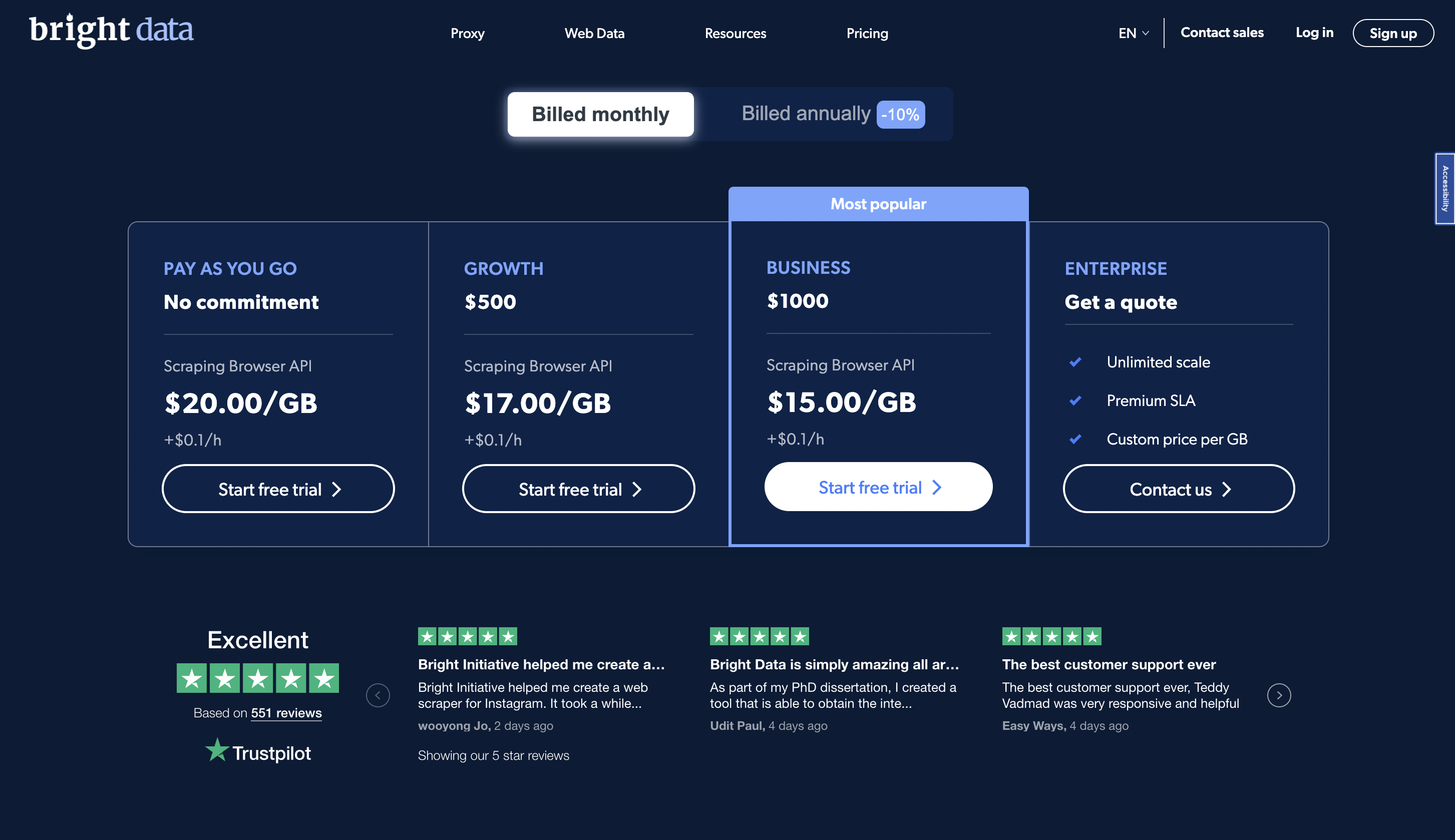

Ціни

Ви можете спробувати платформу безкоштовно, а преміальні ціни починаються від 20 доларів США за ГБ у плані оплати за використання.

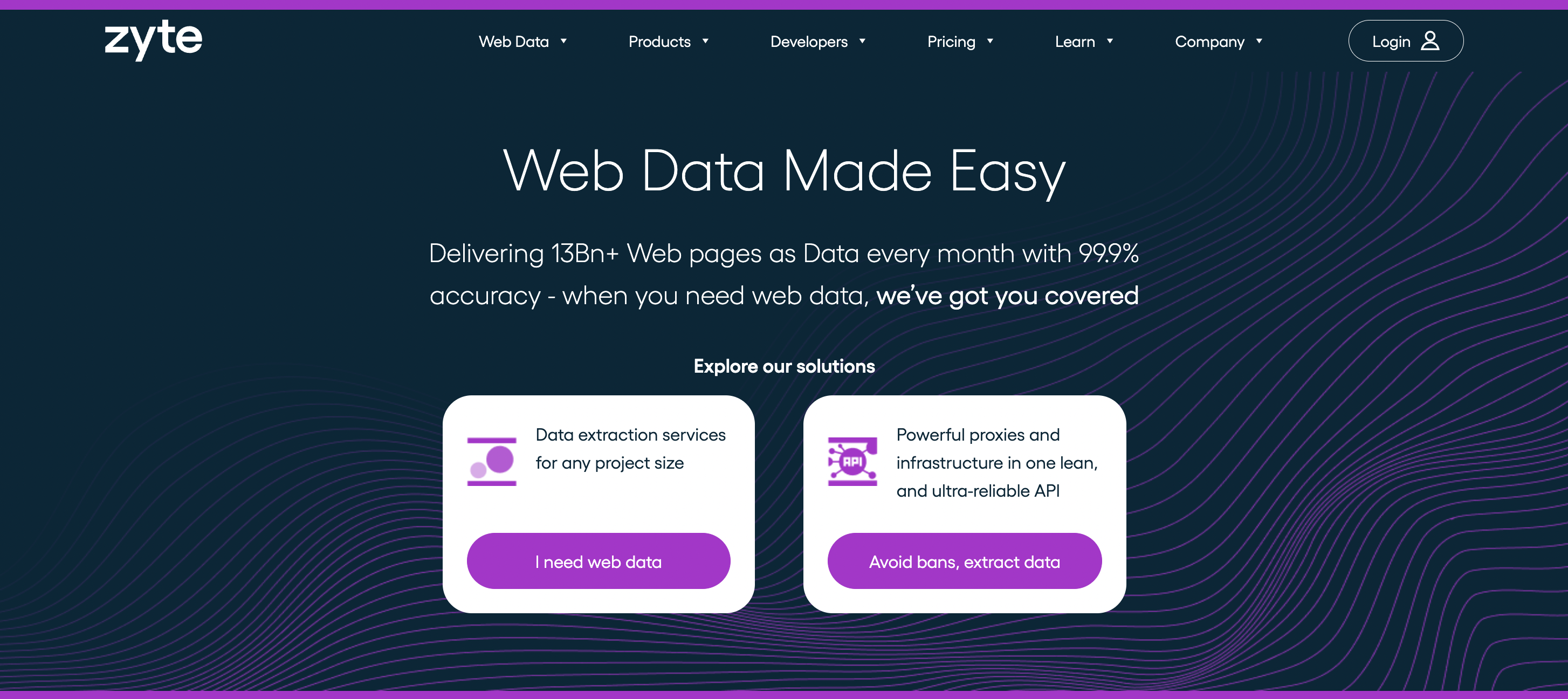

2. Зйте

Будучи постачальником онлайн-інструментів для збирання даних, Zyte, раніше відомий як Scrapinghub, дозволяє компаніям отримувати та аналізувати дані в Інтернеті у великих масштабах.

Платформа онлайн-збирання Zyte створена для роботи навіть із найскладнішими та динамічними веб-сайтами, і вона включає різноманітні передові функції, такі як автоматична ротація IP-адрес, сканування відбитків пальців браузера та підробка агента користувача, щоб гарантувати, що ваші операції збирання залишаться конфіденційними та непоміченими.

Той факт, що платформа веб-збирання Zyte підтримує як безголовий, так і головний режими серфінгу, є однією з її відмінних переваг. Браузер працює в безголовому режимі у фоновому режимі без графічного інтерфейсу користувача, що підвищує його ефективність для масштабних операцій збирання.

Однак браузер працює з графічним інтерфейсом користувача в режимі headful, що може бути корисним, коли вам потрібно отримати дані з веб-сайтів із складним інтерфейсом користувача.

Крім того, оскільки платформа Zyte заснована на безкоштовній основі Scrapy з відкритим вихідним кодом, її можна адаптувати відповідно до ваших конкретних потреб і надзвичайно легко конфігурувати. Ви можете швидко й просто отримувати потрібні дані за допомогою Zyte, забезпечуючи конкурентну перевагу у вашому бізнесі.

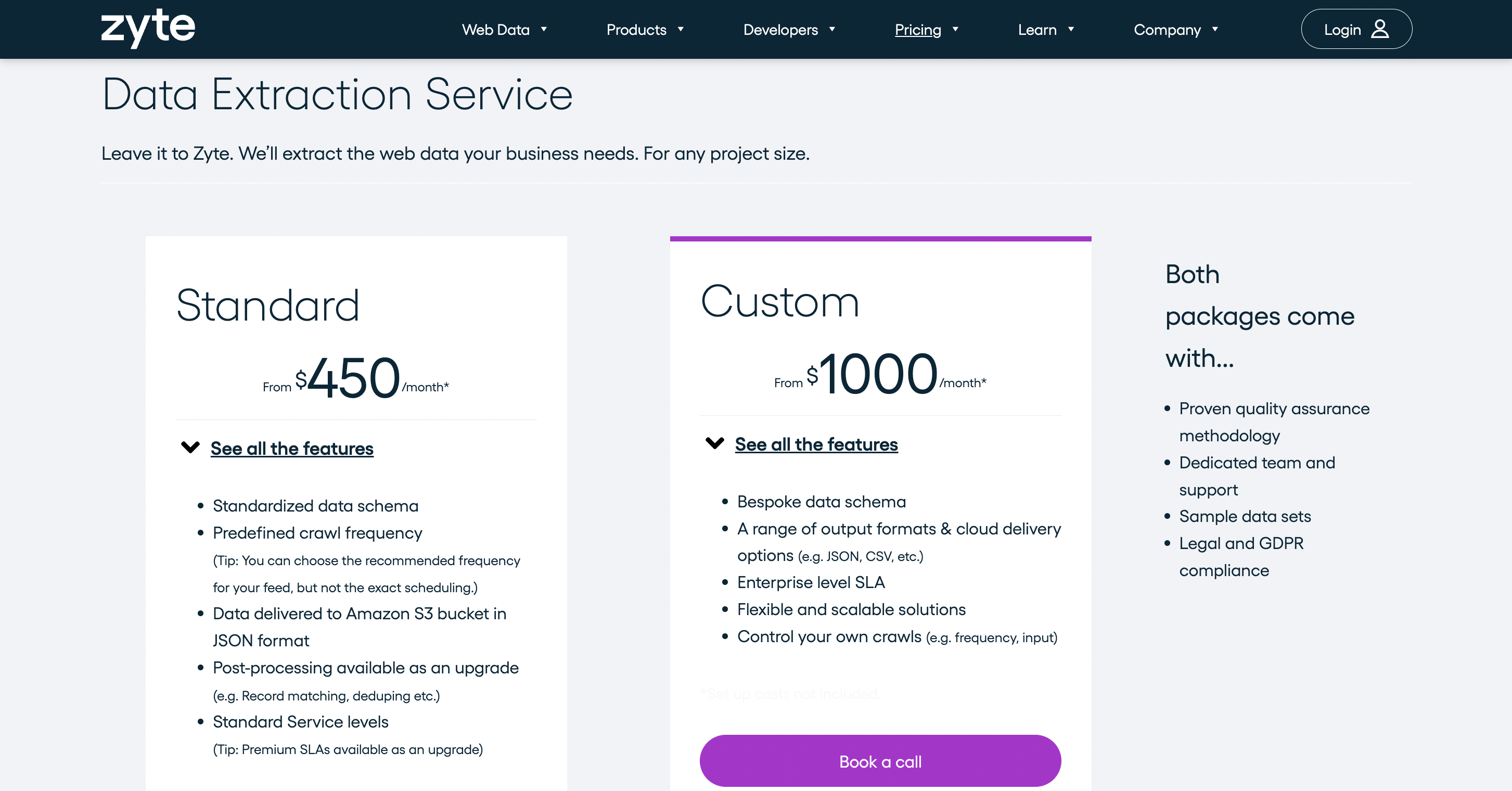

Ціни

Він пропонує кілька тарифних планів і стягує 450 доларів США на місяць за послугу вилучення даних.

3. Восьминога

Ви можете збирати дані з веб-сторінок без написання будь-якого коду за допомогою Octoparse, хмарної програми для збирання веб-сторінок. Будь-хто, хто бажає отримати текст, фотографії чи відео, може легко вибрати їх завдяки зручному інтерфейсу.

Octoparse — це гнучкий інструмент, який підтримує як безголовий, так і головний перегляд, це найкращий варіант для веб-скрапінг-проектів будь-якого розміру та складності. Можливість сканувати динамічні та інтерактивні веб-сторінки, що може бути складно для багатьох інших програм веб-скрапування, є однією з його найсильніших характеристик.

Ви можете створювати складні процеси копіювання з численними етапами, умовними операторами та циклами, підвищуючи гнучкість і настроюваність скрапінгу. Excel, CSV і SQL – це лише деякі формати експорту, які надає Octoparse, що дозволяє легко використовувати витягнуті дані в інших програмах.

Крім того, Octoparse має вбудований пул проксі-серверів, який забезпечує анонімне сканування та допомагає уникнути блокування IP-адрес.

Ціни

Ви можете почати використовувати його безкоштовно, а преміальна ціна починається від 89 доларів США на місяць.

4. Apify

Apify — це комплексна платформа для веб-збирання та автоматизації, яка пропонує різноманітні потужні функції. Він підтримує як безголові, так і головні браузери, а також має інтуїтивно зрозумілий інтерфейс користувача, який спрощує створення завдань зчитування навіть для нетехнічних користувачів.

Здатність Apify вирішувати складні завдання скрапінгу, підтримка кількох мов і масштабування для обробки великомасштабних проектів скрапінгу є одними з його найкращих особливостей.

Крім того, Apify надає доступ до широкого ринку готових скребків, які можна швидко налаштувати відповідно до ваших унікальних вимог.

Завдяки підтримці безголових браузерів Apify може керувати складними користувальницькими інтерфейсами та знімати дані з динамічних веб-сайтів, одночасно швидко й ефективно витягуючи інформацію з величезних обсягів даних.

Apify — це корисний інструмент для різноманітних онлайн-скрейп-додатків, зокрема для створення потенційних клієнтів, аналізу конкуренції, дослідження ринку та агрегування вмісту.

Apify підвищує точність і ефективність, заощаджуючи час і зусилля, автоматизуючи процес вилучення даних. Це потужний інструмент як для технічних, так і для нетехнічних користувачів завдяки своїй функціональності та зручному дизайну.

Ціни

Ви можете почати використовувати його безкоштовно, а преміальна ціна починається від 49 доларів США на місяць.

5. ScrapingBee

Видатний онлайн-додаток ScrapingBee дозволяє легко автоматизувати процес вилучення даних із веб-сайтів.

Його можливості, як-от керування рендерингом JavaScript, розпізнавання CAPTCHA та ротація агента користувача, дозволяють обійти захист веб-сайтів від сканування. отже, це робить його чудовим варіантом для завдань веб-збирання.

Користувачі мають великий ступінь свободи з цим інструментом, оскільки він працює як з безголовими, так і з головними браузерами. Важливо зазначити, що ScrapingBee за замовчуванням використовує безголові браузери, які ідеально підходять для автоматичного отримання величезних обсягів даних.

Щоб взаємодіяти з веб-сайтами зі складним інтерфейсом, користувачі можуть перемикатися на головні браузери. Для забезпечення ефективного вилучення даних ScrapingBee також підтримує пул геолокованих проксі-серверів, які регулярно перевіряються та змінюються.

Користувачі можуть скоротити час і зусилля під час сканування веб-сторінок, використовуючи ScrapingBee як безголовий або головний браузер, гарантуючи при цьому правильність і повноту отриманих даних. Він також має багато корисних функцій, як-от форматування даних, ротація проксі та підключення до API, що робить його зручним інструментом як для компаній, так і для студентів.

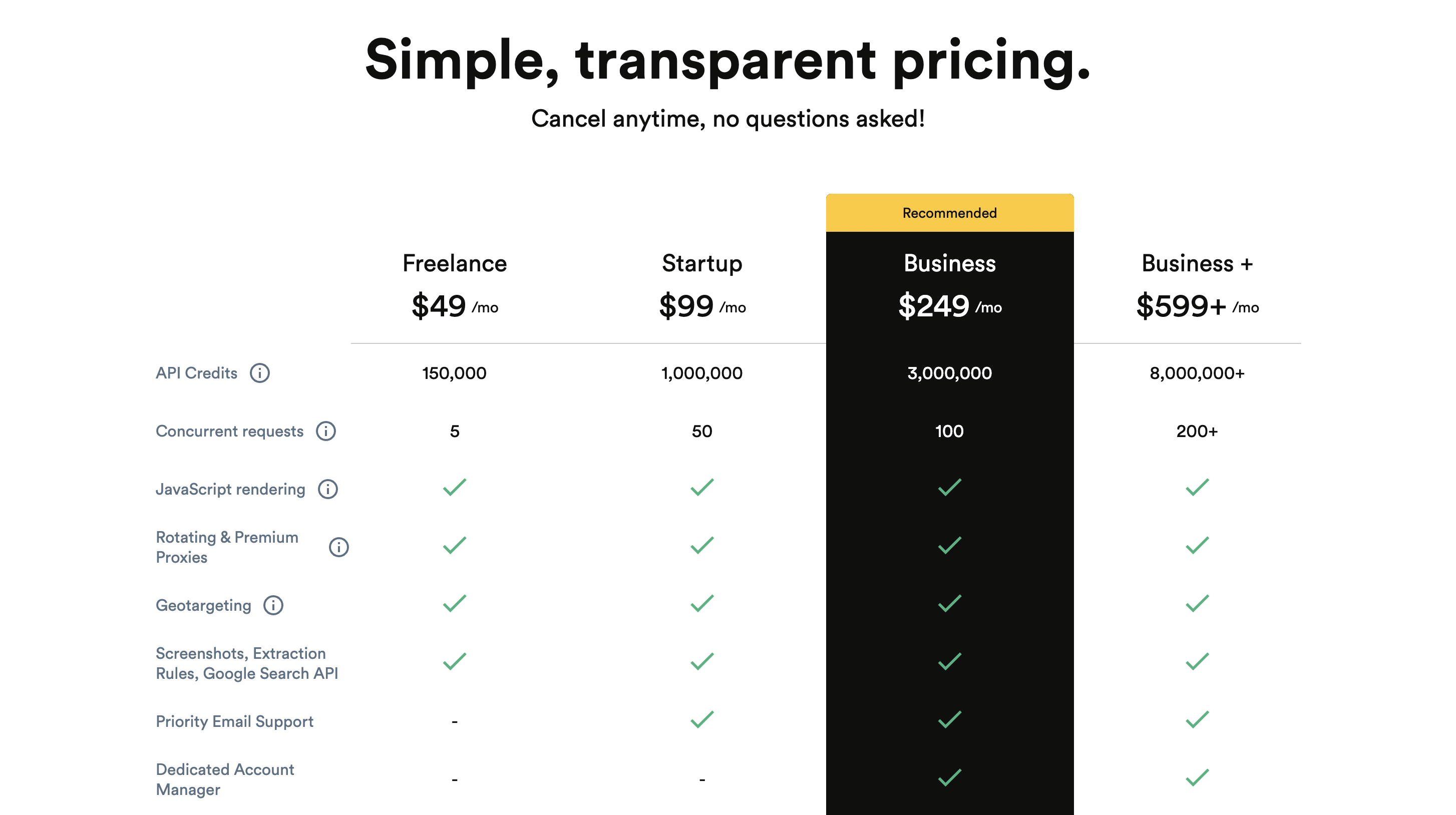

Ціни

Преміальна ціна починається від 49 доларів США на місяць.

6. ParseHub

Не потребуючи технічних знань, користувачі можуть збирати дані з веб-сайтів за допомогою програми для веб-збирання ParseHub. Однією з найбільших його характеристик є те, наскільки легко ним користуватися; користувачі можуть вибрати дані, які вони хочуть отримати, просто натиснувши на елементи.

Крім того, він має здатність автоматично розпізнавати розбивку на сторінки, що полегшує користувачам збирати інформацію з кількох сторінок. Щоб отримати дані з веб-сайтів із простим або складним інтерфейсом користувача, ParseHub підтримує як безголові, так і головні браузери.

Крім того, він забезпечує автоматичну ротацію IP-адрес, що ускладнює для веб-сайтів ідентифікацію та заборону копіювання. ParseHub гарантує, що дані витягуються в організований спосіб за допомогою широких можливостей форматування даних, що спрощує аналіз та системну інтеграцію.

Крім того, ParseHub має розумний режим, який автоматично розпізнає та збирає інформацію з подібних веб-сайтів. ParseHub може розпізнавати та збирати дані з веб-сайтів із подібною структурою, наприклад веб-сайтів електронної комерції, використовуючи штучний інтелект (AI). Ця функція підвищує точність і продуктивність, вимагаючи менше зусиль і економлячи час.

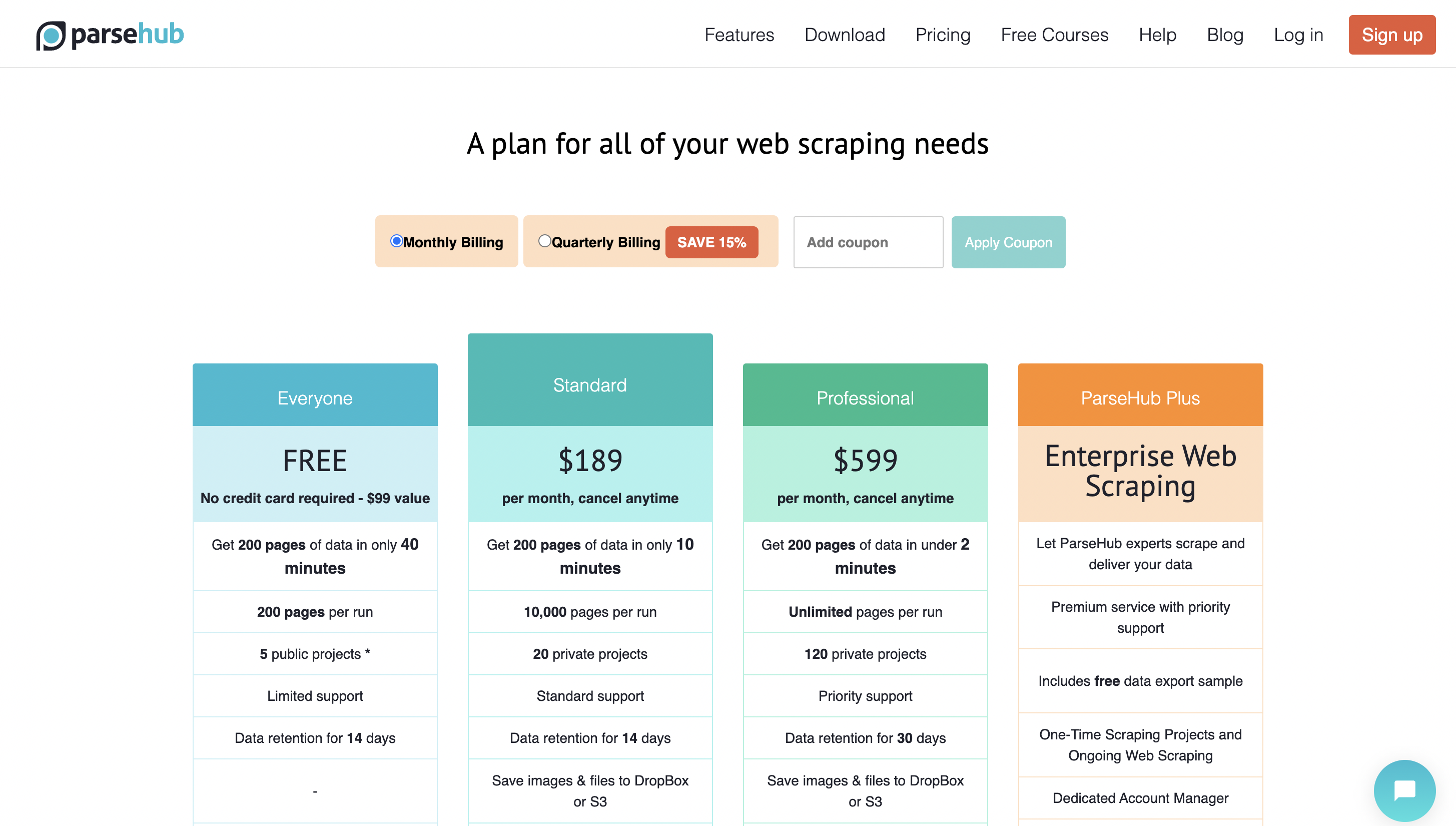

Ціни

Ви можете почати використовувати його безкоштовно, а преміальна ціна починається від 189 доларів США на місяць.

7. WebHarvy

WebHarvy — це потужний онлайн-інструмент збирання даних, який дозволяє організаціям швидко, точно та ефективно знімати дані з веб-сайтів. Він призначений для збору інформації з багатьох веб-сайтів, включаючи пошукові системи, соціальні мережі, сайти електронної комерції та каталоги.

Без будь-якого попереднього досвіду кодування користувачі можуть без особливих зусиль досліджувати та створювати завдання очищення завдяки зручному інтерфейсу. Однією з найбільших характеристик WebHarvy є його здатність отримувати дані з веб-сторінок, які працюють на JavaScript і AJAX, до яких інші інструменти копіювання можуть не мати доступу.

Крім того, він пропонує інтерфейс Point and Click, який спрощує вибір інформації з веб-сторінки, яку ви хочете отримати. WebHarvy має безголовий і головний режими перегляду. Для швидшого й ефективнішого збирання даних він може працювати в безголовому режимі.

Режим Headful корисний під час роботи зі складними веб-сайтами, які вимагають введення даних від користувача. Він також може переміщатися між численними сторінками та заповнювати форми, що корисно під час отримання даних із веб-сайтів із кількома сторінками.

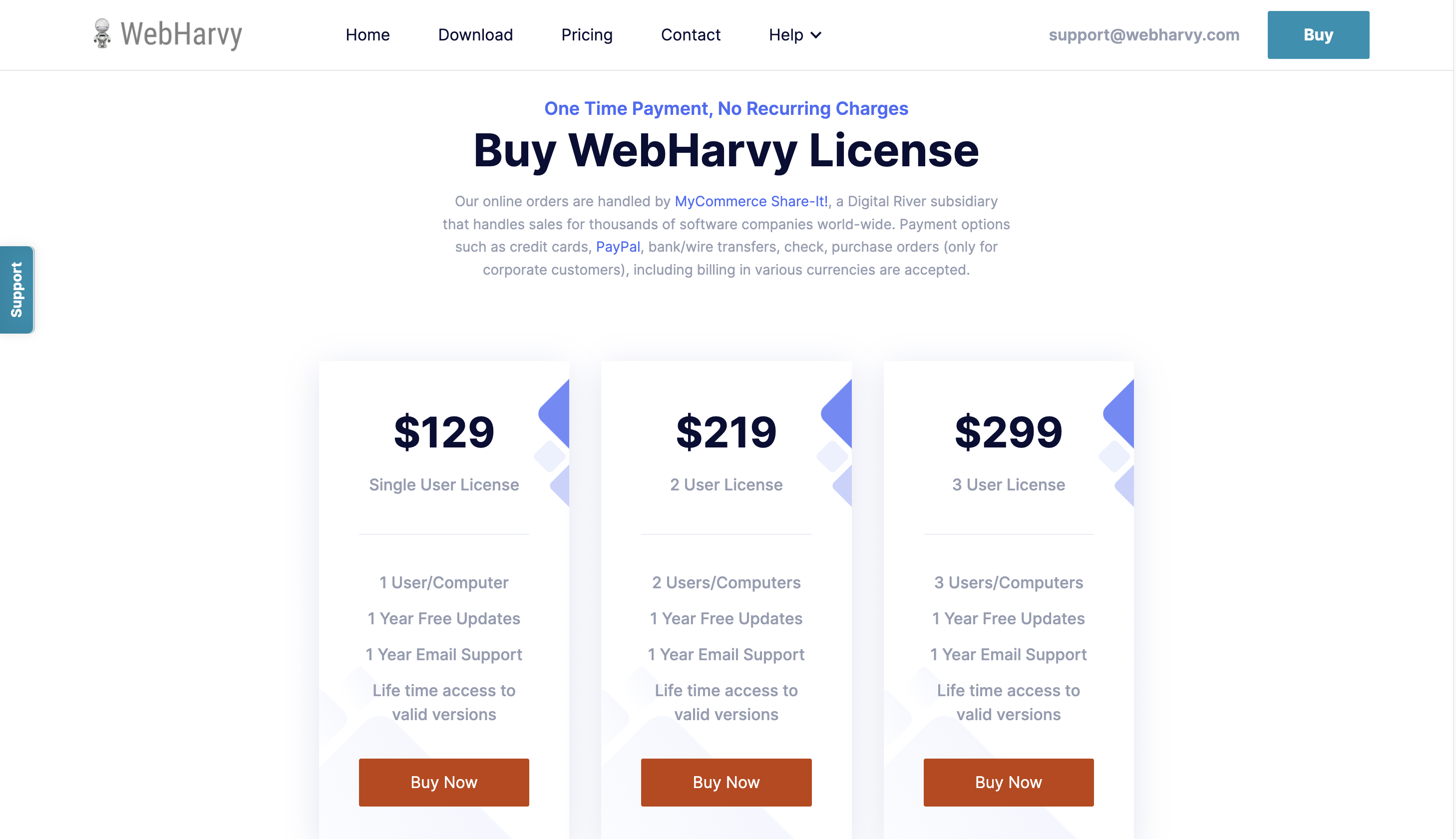

Ціни

Преміальна ціна починається від 129 доларів США за ліцензію на одного користувача.

8. Комплект потоку даних

Використовуючи Dataflow Kit, надійний онлайн-інструмент збирання даних, можна збирати та аналізувати дані з різних веб-сайтів, у тому числі соціальні мережі сайти, пошукові системи, веб-сайти електронної комерції та веб-сайти новин. Однією з його найкращих особливостей є здатність швидко й ефективно збирати дані зі складних динамічних веб-сайтів.

Він ідеально підходить для сканування веб-сайтів, до яких важко отримати доступ за допомогою інших методів, оскільки він дуже простий у використанні. Як безголовий, так і головний браузер функціонують із Dataflow Kit. Розширені функції, як-от ротація проксі-сервера та агента користувача, запобігання блокуванню IP-адрес і виявлення анти-ботів, забезпечують ефективне сканування.

Крім того, він пропонує зручний інтерфейс, який дає змогу клієнтам створювати, планувати та керувати своїми діями зі збирання без будь-якого досвіду програмування. Для великомасштабних веб-збиральних програм його ефективний механізм скребка є фантастичним рішенням, оскільки він оптимізований для швидкої та ефективної обробки даних.

Зібрані дані можна просто експортувати в різноманітні формати, включаючи CSV, JSON і XML, що дає змогу аналізувати та використовувати їх будь-яким способом, який ви вважаєте за потрібне. Крім того, Dataflow Kit надає різноманітні варіанти інтерфейсу, включаючи API та Zapier, щоб допомогти вам оптимізувати робочий процес і автоматизувати процес вилучення даних.

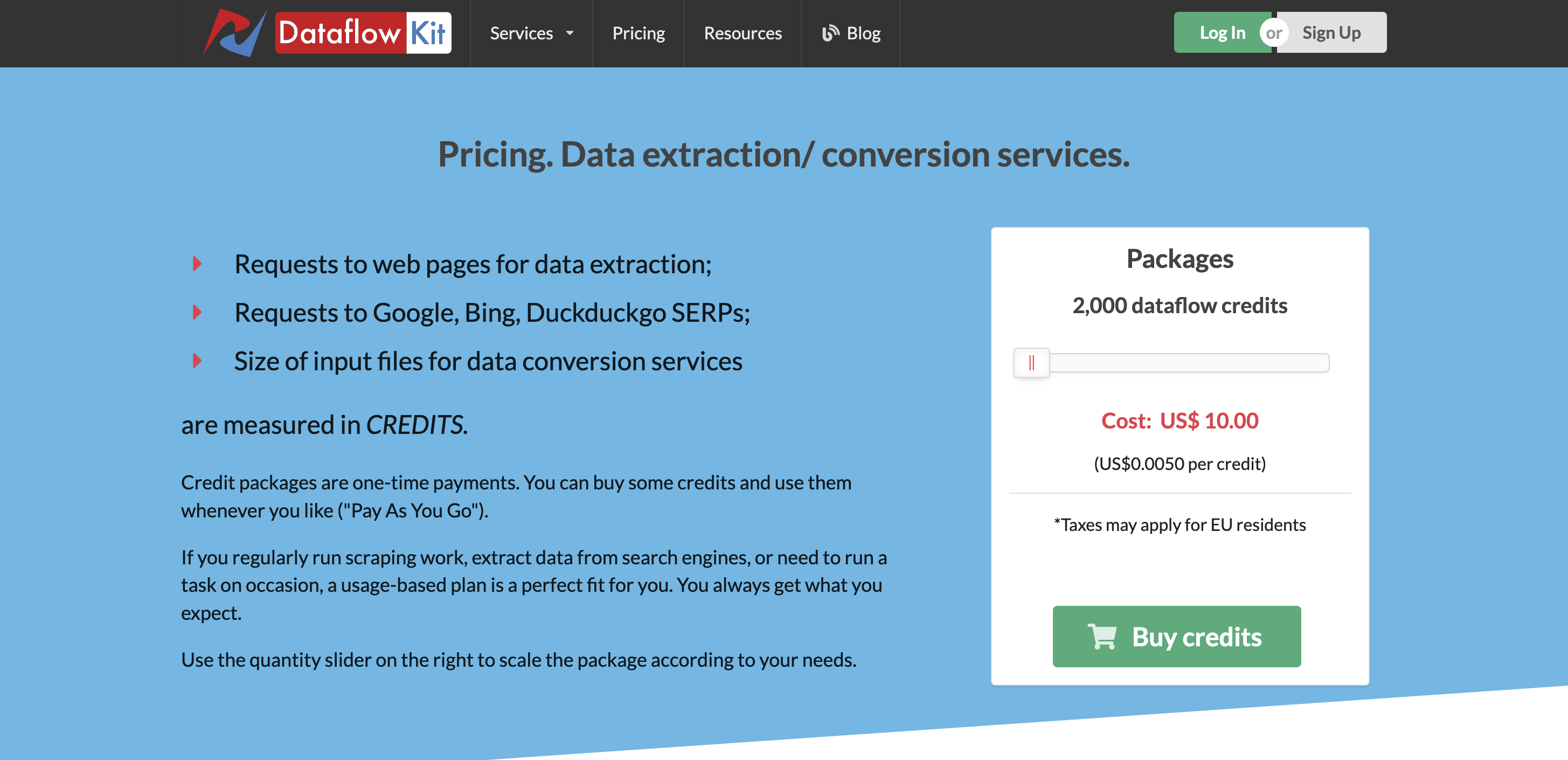

Ціни

Преміальна ціна починається від 10 доларів США за 2000 кредитів потоку даних, які ви можете використовувати відповідно до своїх потреб.

9. Import.io

За допомогою хмарного інструменту для збирання даних Import.io користувачі можуть очищати дані з веб-сайтів без будь-якого досвіду програмування. Простота використання є однією з найбільш привабливих особливостей Import.io; все, що вам потрібно зробити, це навести та клацнути, щоб знайти дані, які ви хочете отримати.

Завдяки потужним функціям візуалізації користувачі можуть оцінювати отримані дані в режимі реального часу. Import.io — це безголовий браузер, який імітує веб-браузер і підключається до веб-сайтів так само, як і людина, але без графічного інтерфейсу користувача.

Це покращує ефективність сканування веб-сайтів і дозволяє користувачам знімати дані з динамічних веб-сайтів, які вимагають участі користувача, щоб показати інформацію. Його Extractor на основі штучного інтелекту дозволяє користувачам видобувати дані лише кількома клацаннями. Extractor також може ідентифікувати шаблони даних і отримувати порівняльні дані з багатьох джерел.

Користувачі можуть автоматизувати свої зусилля зі збирання та отримувати часті оновлення даних, які їм потрібні, завдяки комплексним функціям планування. Import.io спрощує використання отриманих даних в інших програмах, дозволяючи зв’язуватися з такими популярними інструментами, як Google Таблиці та Zapier.

Ціни

Ціна не вказана на веб-сайті, проконсультуйтеся з фахівцем.

10. Dexi.io

Вилучення даних є простим за допомогою надійного інструменту веб-збирання Dexi.io. Ви можете збирати дані з веб-сайтів за допомогою цього інструменту без будь-якого досвіду кодування через його зручний інтерфейс і автоматизовані можливості.

Однією з його найкращих характеристик є його здатність очищати та об’єднувати дані з багатьох джерел, включаючи веб-сторінки, API та бази даних. Завдяки можливостям паралельної обробки Dexi.io ви можете швидко й ефективно очищати величезні обсяги даних.

Dexi.io пропонує вам вибрати найкращу альтернативу для ваших потреб у скануванні, оскільки він функціонує одночасно як безголовий браузер і як головний браузер. У той час як опція головного браузера дозволяє вам переглядати веб-сайт і взаємодіяти з ним так, ніби ви використовуєте звичайний браузер, опція безголового браузера дозволяє очищувати дані, не відображаючи сторінку в браузері.

Це спрощує вирішення будь-яких проблем із збиранням і налаштовує процедуру збирання відповідно до ваших уподобань. Ви можете швидко експортувати зібрані дані з Dexi.io у різні формати, наприклад CSV, JSON і Excel, для додаткового аналізу або взаємодії з іншими програмами.

Крім того, він забезпечує надійний і безпечний хмарний хостинг для ваших зібраних даних, гарантуючи їх безпеку та доступність.

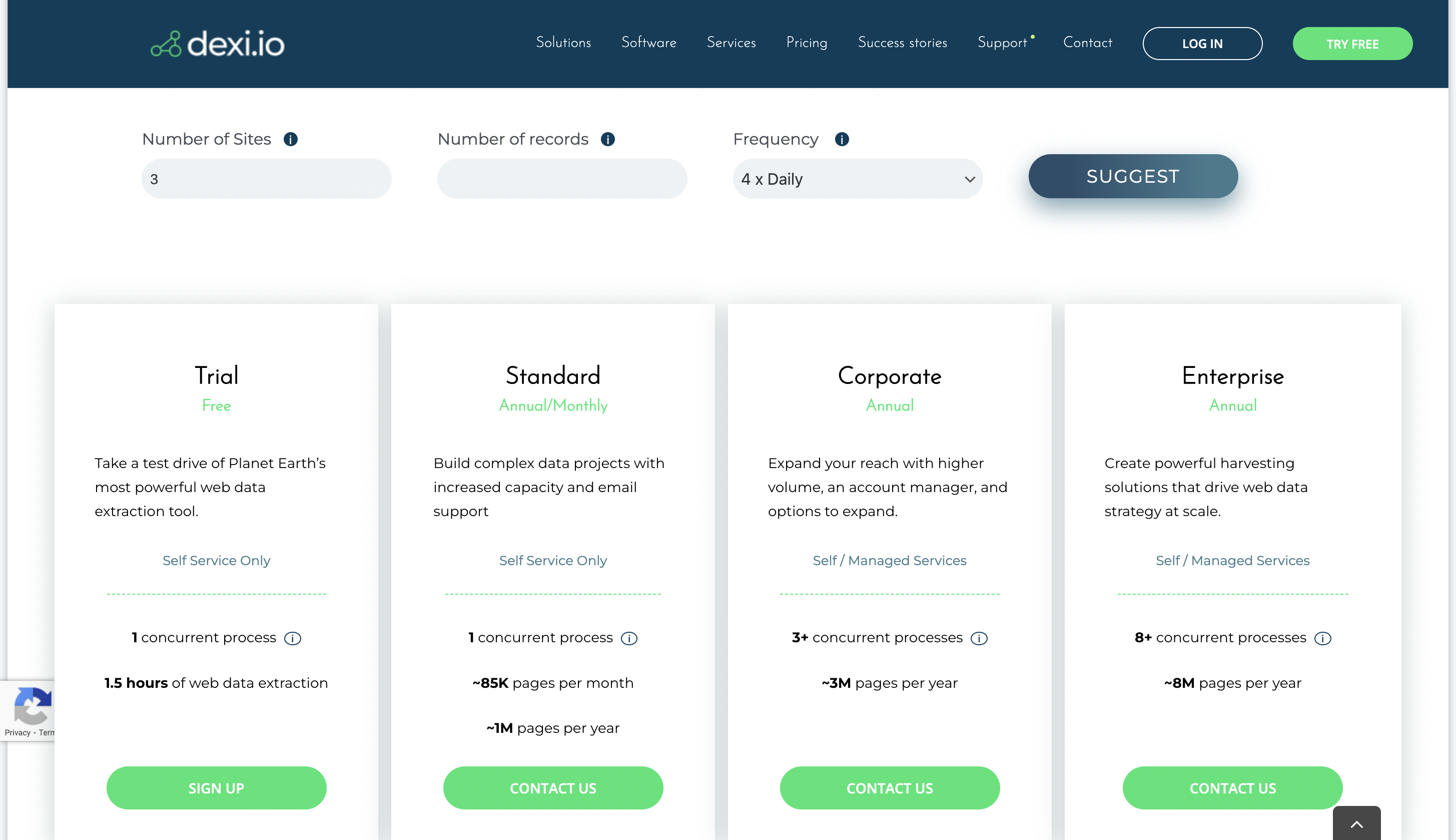

Ціни

Ви можете спробувати платформу з її безкоштовним пробним планом і зв’язатися з командою, щоб дізнатися ціни.

Висновок

Підсумовуючи, на ринку існує кілька рішень для веб-збирання, кожне з яких має певні переваги та можливості. Є багато варіантів даних, які можна вибрати, починаючи від комплексних рішень, таких як Bright Data і ScrapingBee, і закінчуючи більш спеціалізованими інструментами, такими як Apify і ParseHub.

Ці системи часто мають такі можливості, як безголовий перегляд, ротація IP-адреси, підробка агента користувача та сканування відбитків браузера, щоб підвищити ефективність, надійність і секретність онлайн-збирання.

Інструменти веб-скопіювання можуть надати вам швидкий і простий доступ до великої кількості інформації, незалежно від того, чи є ви власником малого бізнесу, який намагається дослідити своїх конкурентів, дослідником, який шукає дані для підтримки своєї роботи, чи аналітиком даних, який шукає розуміння поведінки споживачів .

Можливість помилок і невідповідностей можна зменшити, а ви потенційно можете заощадити час і гроші, автоматизувавши процес збору даних.

залишити коментар