Talaan ng nilalaman[Tago][Ipakita]

Ang hinaharap ay narito. At, sa hinaharap na mauunawaan ng mga makina ang mundo sa kanilang paligid sa parehong paraan na naiintindihan ng mga tao. Ang mga computer ay maaaring magmaneho ng mga sasakyan, mag-diagnose ng mga sakit, at tumpak na hulaan ang hinaharap.

Ito ay maaaring mukhang science fiction, ngunit ang mga modelo ng malalim na pag-aaral ay ginagawa itong isang katotohanan.

Ang mga sopistikadong algorithm na ito ay nagbubunyag ng mga lihim ng artificial intelligence, na nagpapahintulot sa mga computer na matuto at bumuo ng sarili. Sa post na ito, susuriin natin ang larangan ng mga modelo ng malalim na pag-aaral.

At, sisiyasatin natin ang napakalaking potensyal na mayroon sila para sa pagbabago ng ating buhay. Maghanda upang matutunan ang tungkol sa makabagong teknolohiya na nagbabago sa hinaharap ng sangkatauhan.

Ano ang Eksaktong Mga Modelo ng Deep Learning?

Naglaro ka na ba ng laro kung saan kailangan mong tukuyin ang mga pagkakaiba sa pagitan ng dalawang larawan?

Ito ay masaya gayunpaman, maaari din itong maging matigas, tama? Isipin na makapagturo sa isang computer na laruin ang larong iyon at manalo sa bawat pagkakataon. Ang mga modelo ng malalim na pag-aaral ay nagagawa iyon!

Ang mga modelo ng malalim na pag-aaral ay katulad ng mga super-smart na makina na maaaring magsuri ng malaking bilang ng mga larawan at matukoy kung ano ang pagkakatulad ng mga ito. Nagagawa nila ito sa pamamagitan ng pag-disassemble ng mga imahe at pag-aaral ng bawat isa nang paisa-isa.

Pagkatapos ay ilalapat nila ang kanilang natutunan upang matukoy ang mga pattern at gumawa ng mga hula tungkol sa mga sariwang larawang hindi pa nila nakita.

Ang mga deep learning model ay mga artipisyal na neural network na maaaring matuto at kumuha ng mga kumplikadong pattern at katangian mula sa napakalaking dataset. Ang mga modelong ito ay binubuo ng ilang mga layer ng mga naka-link na node, o mga neuron, na nagsusuri at nagbabago ng papasok na data upang makabuo ng isang output.

Ang mga modelo ng malalim na pag-aaral ay partikular na angkop sa mga trabahong nangangailangan ng mahusay na katumpakan at katumpakan, tulad ng pagkakakilanlan ng imahe, pagkilala sa pagsasalita, pagproseso ng natural na wika, at robotics.

Nagamit na ang mga ito sa lahat ng bagay mula sa mga self-driving na kotse hanggang sa mga medikal na diagnostic, mga system ng tagapagrekomenda, at mahuhulain analytics.

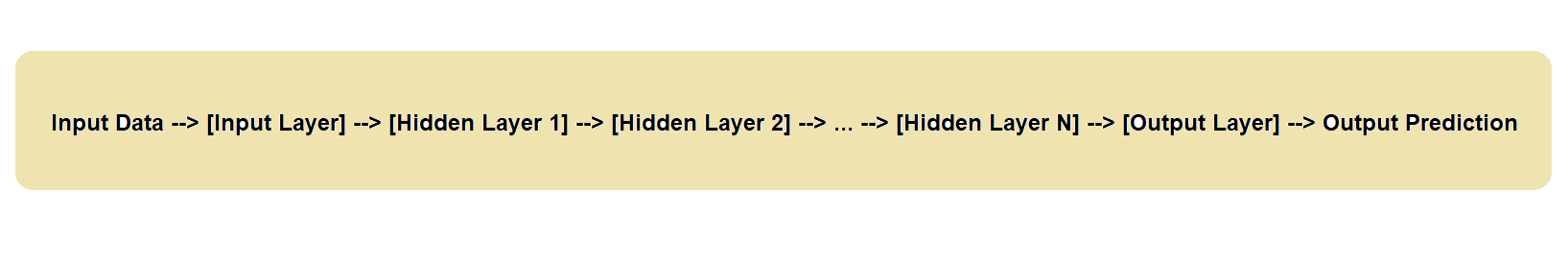

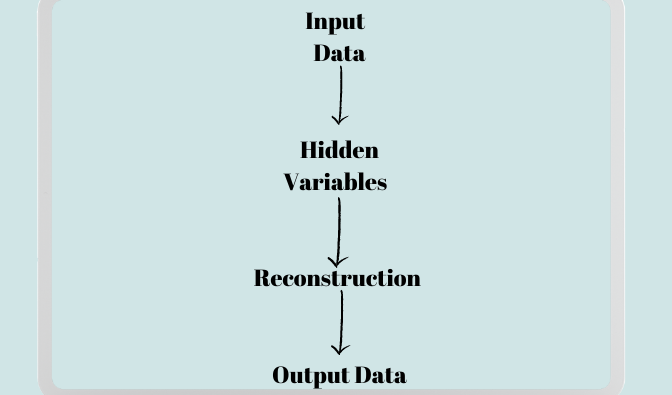

Narito ang isang pinasimpleng bersyon ng visualization upang ilarawan ang daloy ng data sa isang malalim na modelo ng pag-aaral.

Ang data ng input ay dumadaloy sa input layer ng modelo, na pagkatapos ay ipapasa ang data sa isang bilang ng mga nakatagong layer bago magbigay ng isang hula sa output.

Ang bawat nakatagong layer ay nagsasagawa ng isang serye ng mga mathematical na operasyon sa input data bago ito ipasa sa susunod na layer, na nagbibigay ng panghuling hula.

Ngayon, tingnan natin kung ano ang mga modelo ng malalim na pag-aaral at kung paano natin magagamit ang mga ito sa ating buhay.

1. Convolutional Neural Networks (CNNs)

Ang mga CNN ay isang malalim na modelo ng pag-aaral na nagbago sa larangan ng computer vision. Ginagamit ang mga CNN upang pag-uri-uriin ang mga larawan, kilalanin ang mga bagay, at i-segment ang mga larawan. Ang istraktura at pag-andar ng visual cortex ng tao ay nagpapaalam sa disenyo ng mga CNN.

Paano ba nila Work?

Binubuo ang CNN ng ilang convolutional layer, pooling layer, at ganap na naka-link na layer. Ang input ay isang imahe, at ang output ay isang hula ng class label ng imahe.

Ang convolutional layer ng CNN ay bumubuo ng feature map sa pamamagitan ng pagsasagawa ng tuldok na produkto sa pagitan ng input na larawan at isang set ng mga filter. Ang mga pooling layer ay nagpapababa sa laki ng feature map sa pamamagitan ng pag-downsampling nito.

Panghuli, ang tampok na mapa ay ginagamit ng ganap na konektadong mga layer upang mahulaan ang label ng klase ng larawan.

Bakit Mahalaga ang CNN?

Mahalaga ang mga CNN dahil matututo silang tumukoy ng mga pattern at katangian sa mga larawang mahirap mapansin ng mga tao. Maaaring turuan ang mga CNN na kilalanin ang mga katangian tulad ng mga gilid, sulok, at mga texture gamit ang malalaking dataset. Pagkatapos matutunan ang mga katangiang ito, magagamit ng CNN ang mga ito para matukoy ang mga bagay sa mga sariwang larawan. Ang mga CNN ay nagpakita ng napakahusay na pagganap sa iba't ibang mga aplikasyon ng pagkilala sa imahe.

Saan Kami Gumagamit ng Mga CNN

Ang pangangalaga sa kalusugan, industriya ng sasakyan, at retail ay ilan lamang sa mga sektor na gumagamit ng mga CNN. Sa industriya ng pangangalagang pangkalusugan, maaari silang maging kapaki-pakinabang para sa diagnosis ng sakit, pagbuo ng gamot, at pagsusuri ng medikal na imahe.

Sa sektor ng sasakyan, tumutulong sila sa pagtuklas ng lane, pagtuklas ng bagay, at autonomous na pagmamaneho. Ginagamit din ang mga ito sa retail para sa visual na paghahanap, rekomendasyon ng produkto na nakabatay sa imahe, at kontrol sa imbentaryo.

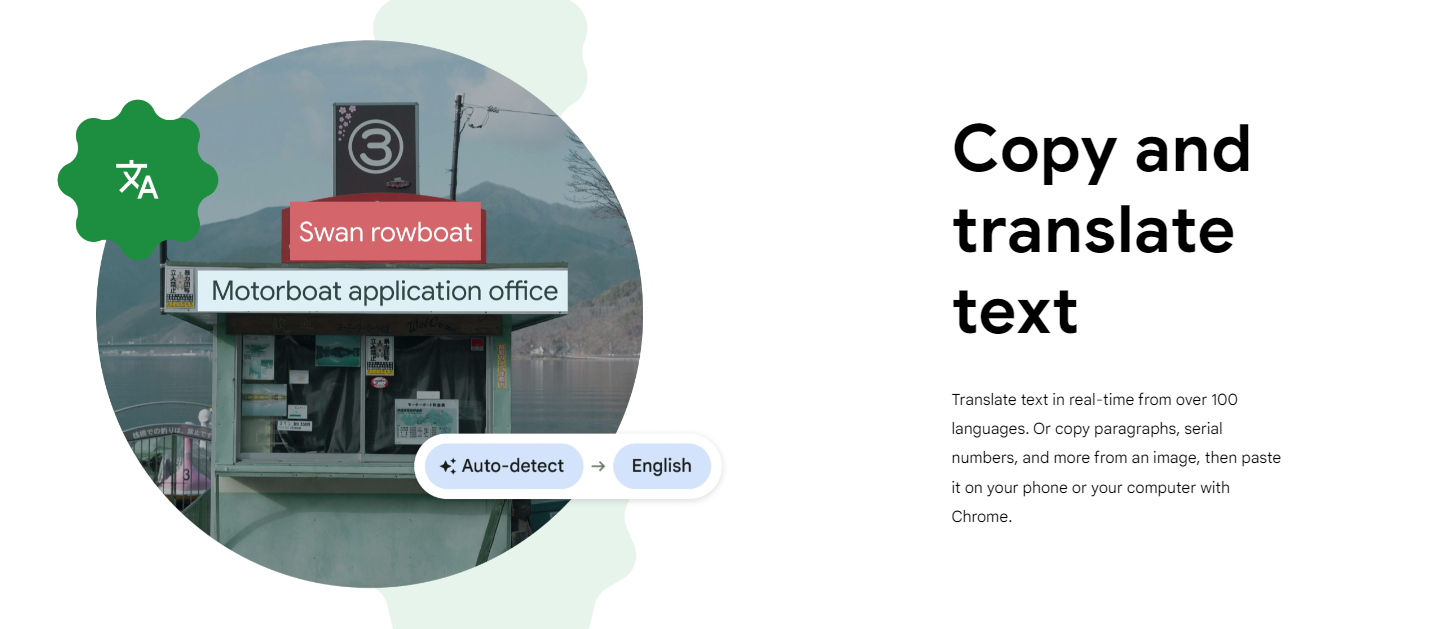

Halimbawa; Gumagamit ang Google ng mga CNN sa iba't ibang mga application, kabilang ang Google Lens, isang kilalang tool sa pagkilala sa larawan. Gumagamit ang programa ng mga CNN upang suriin ang mga litrato at bigyan ang mga gumagamit ng impormasyon.

Ang Google Lens, halimbawa, ay maaaring makilala ang mga bagay sa isang larawan at mag-alok ng mga detalye tungkol sa mga ito, gaya ng uri ng bulaklak.

Maaari rin nitong i-translate ang text na kinuha mula sa isang larawan sa maraming wika. Nagagawa ng Google Lens na magbigay sa mga consumer ng kapaki-pakinabang na impormasyon dahil sa tulong ng mga CNN sa tumpak na pagtukoy ng mga item at pagkuha ng mga katangian mula sa mga larawan.

2. Long Short-Term Memory (LSTM) na mga network

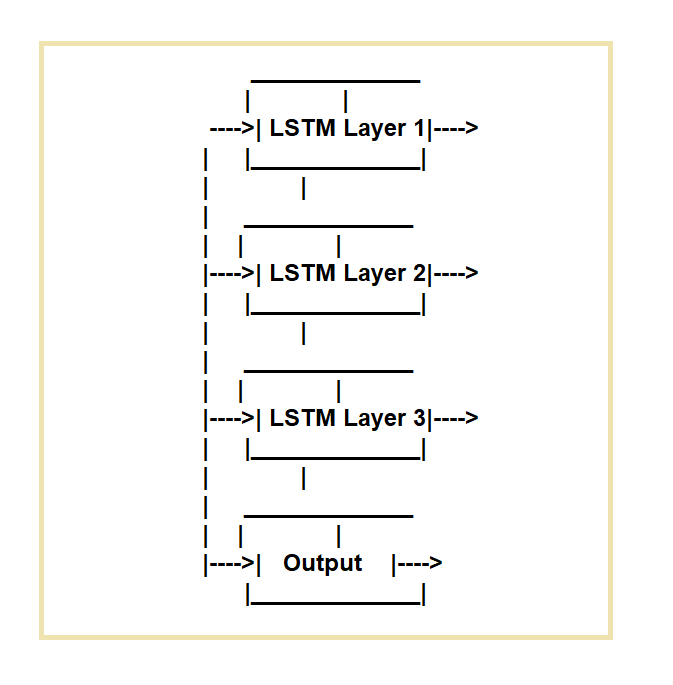

Ang mga Long Short-Term Memory (LSTM) network ay nilikha upang matugunan ang mga pagkukulang ng mga regular na paulit-ulit na neural network (RNN). Ang mga network ng LSTM ay mainam para sa mga gawain na nangangailangan ng pagproseso ng mga pagkakasunud-sunod ng data sa buong panahon.

Gumagana ang mga ito sa pamamagitan ng paggamit ng isang tiyak na memory cell at tatlong mekanismo ng gating.

Kinokontrol nila ang daloy ng impormasyon sa loob at labas ng cell. Ang input gate, forget gate at output gate ay ang tatlong gate.

Kinokontrol ng input gate ang daloy ng data sa memory cell, kinokontrol ng forget gate ang pagtanggal ng data mula sa cell, at kinokontrol ng output gate ang daloy ng data palabas ng cell.

Ano ang kanilang Kahalagahan?

Kapaki-pakinabang ang mga network ng LSTM dahil matagumpay nilang kinakatawan at mahulaan ang mga sequence ng data na may mga pangmatagalang relasyon. Maaari silang mag-record at magpanatili ng impormasyon tungkol sa mga nakaraang input, na nagbibigay-daan sa kanila na gumawa ng mas tumpak na mga hula tungkol sa mga input sa hinaharap.

Ang speech recognition, handwriting recognition, natural na pagpoproseso ng wika, at picture captioning ay ilan lamang sa mga application na gumamit ng mga LSTM network.

Saan Namin Gumagamit ng LSTM Networks?

Maraming mga application ng software at teknolohiya ang gumagamit ng mga LSTM network, kabilang ang mga speech recognition system, mga natural na mga tool sa pagproseso ng mga wika tulad ng damdamin pagsusuri, machine translation system, at text at picture generating system.

Ginamit din ang mga ito sa paggawa ng mga self-driving na kotse at robot, gayundin sa industriya ng pananalapi para maka-detect ng panloloko at mag-anticipate. pamilihan ng sapi paggalaw.

3. Mga Generative Adversarial Network (GAN)

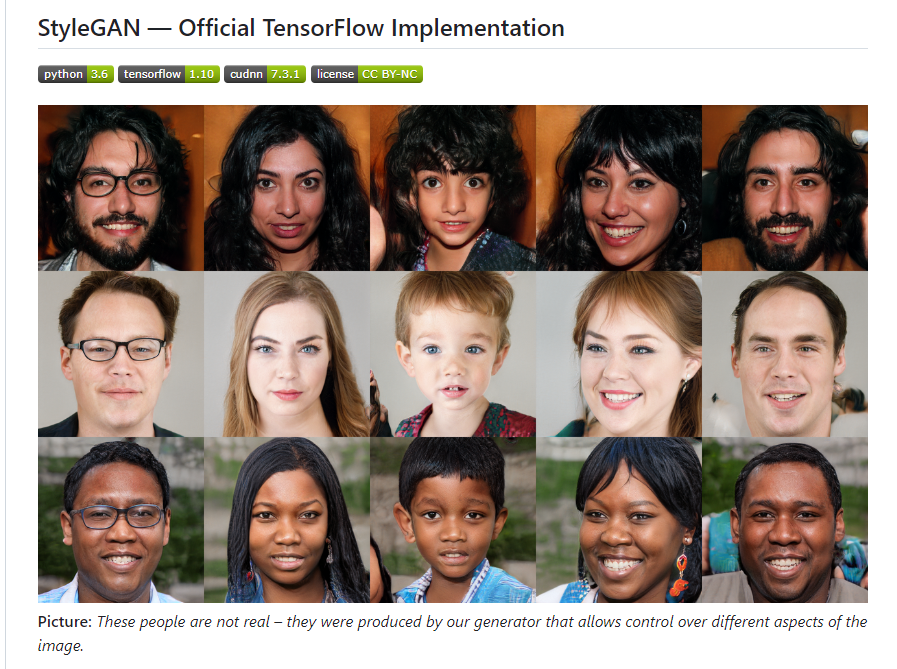

Ang mga GAN ay a malalim na pag-aaral technique na ginagamit upang makabuo ng mga bagong sample ng data na katulad ng isang ibinigay na dataset. Ang mga GAN ay binubuo ng dalawa mga neural network: isa na natututong gumawa ng mga bagong sample at isa na natututong makilala sa pagitan ng tunay at nabuong mga sample.

Sa katulad na paraan, ang dalawang network na ito ay sinasanay nang magkasama hanggang sa ang generator ay makabuo ng mga sample na hindi matukoy ang pagkakaiba sa mga aktwal.

Bakit Kami Gumagamit ng mga GAN

Mahalaga ang mga GAN dahil sa kanilang kapasidad na gumawa ng mataas na kalidad sintetikong data na maaaring magamit para sa iba't ibang mga application, kabilang ang paggawa ng larawan at video, pagbuo ng teksto, at maging ang pagbuo ng musika.

Ginamit din ang mga GAN para sa pagpapalaki ng data, na siyang pagbuo ng sintetikong data upang madagdagan ang totoong data sa mundo at pagbutihin ang pagganap ng mga modelo ng machine-learning.

Higit pa rito, sa pamamagitan ng paglikha ng sintetikong data na maaaring magamit upang sanayin ang mga modelo at gayahin ang mga pagsubok, ang mga GAN ay may potensyal na baguhin ang mga sektor gaya ng gamot at pagpapaunlad ng droga.

Mga aplikasyon ng GAN

Ang mga GAN ay maaaring magdagdag ng mga dataset, gumawa ng mga bagong larawan o pelikula, at kahit na bumuo ng sintetikong data para sa mga siyentipikong simulation. Higit pa rito, ang mga GAN ay may potensyal na magtrabaho sa iba't ibang mga aplikasyon mula sa entertainment hanggang sa medikal.

edad at mga video. Ang StyleGAN2 ng NVIDIA, halimbawa, ay ginamit upang lumikha ng mga de-kalidad na larawan ng mga kilalang tao at likhang sining.

4. Mga Deep Belief Network (DBNs)

Ang Deep Belief Networks (DBNs) ay artificial intelligence mga system na maaaring matutong makakita ng mga pattern sa data. Nagagawa nila ito sa pamamagitan ng pagse-segment ng data sa mas maliliit at maliliit na piraso, na nakakakuha ng mas masusing pag-unawa nito sa bawat antas.

Maaaring matuto ang mga DBN mula sa data nang hindi ipinapaalam kung ano ito (ito ay tinutukoy bilang "hindi pinangangasiwaang pag-aaral"). Ginagawa nitong lubos na mahalaga ang mga ito para sa pag-detect ng mga pattern sa data na mahirap o imposibleng matukoy ng isang tao.

Ano ang Nagpapahalaga sa mga DBN?

Mahalaga ang mga DBN dahil sa kanilang kapasidad na matuto ng mga representasyon ng hierarchical data. Maaaring gamitin ang mga representasyong ito para sa iba't ibang mga application tulad ng pag-uuri, pagtuklas ng anomalya, at pagbabawas ng dimensional.

Ang kapasidad ng mga DBN na magsagawa ng hindi pinangangasiwaang pre-training, na maaaring magpapataas sa pagganap ng mga modelo ng malalim na pag-aaral na may kaunting data na may label, ay isang makabuluhang benepisyo.

Ano ang mga Aplikasyon ng mga DBN?

Ang isa sa mga pinaka makabuluhang application ay pagtuklas ng bagay, kung saan ginagamit ang mga DBN upang makilala ang ilang partikular na uri ng mga bagay gaya ng mga eroplano, ibon, at tao. Ginagamit din ang mga ito para sa pagbuo at pag-uuri ng imahe, pagtukoy ng paggalaw sa mga pelikula, at natural na pag-unawa sa wika para sa pagproseso ng boses.

Higit pa rito, ang mga DBN ay karaniwang ginagamit sa mga dataset upang masuri ang mga postura ng tao. Ang mga DBN ay isang mahusay na tool para sa iba't ibang industriya, kabilang ang pangangalagang pangkalusugan at pagbabangko, at teknolohiya.

5. Deep Reinforcement Learning Networks (DRLs)

malalim Pagpapatibay ng Pagkatuto Pinagsasama ng Networks (DRLs) ang mga malalim na neural network sa mga diskarte sa pag-aaral ng reinforcement upang payagan ang mga ahente na matuto sa isang kumplikadong kapaligiran sa pamamagitan ng pagsubok at error.

Ginagamit ang mga DRL para turuan ang mga ahente kung paano mag-optimize ng reward signal sa pamamagitan ng pakikipag-ugnayan sa kanilang kapaligiran at pag-aaral mula sa kanilang mga pagkakamali.

Ano ang Nagiging Kapansin-pansin sa Kanila?

Mabisang ginamit ang mga ito sa iba't ibang mga application, kabilang ang paglalaro, robotics, at autonomous na pagmamaneho. Mahalaga ang mga DRL dahil maaari silang matuto nang direkta mula sa raw sensory input, na nagpapahintulot sa mga ahente na gumawa ng mga desisyon batay sa kanilang mga pakikipag-ugnayan sa kapaligiran.

Mahahalagang Aplikasyon

Ang mga DRL ay ginagamit sa totoong mundo na mga pangyayari dahil kakayanin nila ang mahihirap na isyu.

Ang mga DRL ay isinama sa ilang kilalang software at tech platform, kabilang ang OpenAI's Gym, Mga ML-Agent ng Unity, at DeepMind Lab ng Google. AlphaGo, na binuo ng Google Deepmind, halimbawa, gumagamit ng DRL para maglaro ng board game na Go sa isang world champion level.

Ang isa pang paggamit ng DRL ay sa robotics, kung saan ito ay ginagamit upang kontrolin ang mga paggalaw ng mga robotic arm upang maisagawa ang mga gawain tulad ng paghawak ng mga bagay o stacking block. Ang mga DRL ay may maraming gamit at isang kapaki-pakinabang na tool para sa pagsasanay sa mga ahente upang matuto at gumawa ng mga desisyon sa mga kumplikadong setting.

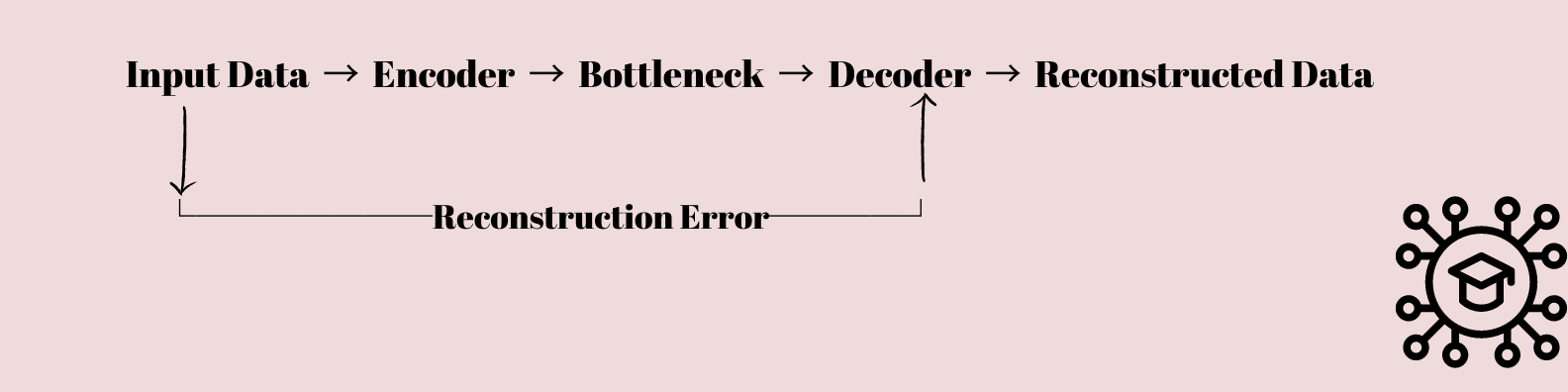

6. Autoencoders

Ang mga autoencoder ay isang kawili-wiling uri ng neural network na nakakuha ng interes ng parehong mga iskolar at data scientist. Ang mga ito ay pangunahing idinisenyo upang matutunan kung paano i-compress at i-restore ang data.

Ang input data ay pinapakain sa pamamagitan ng sunud-sunod na mga layer na unti-unting nagpapababa sa dimensionality ng data hanggang sa ma-compress ito sa isang bottleneck na layer na may mas kaunting mga node kaysa sa input at output layer.

Ang naka-compress na representasyong ito ay pagkatapos ay ginagamit upang muling likhain ang orihinal na data ng pag-input gamit ang isang pagkakasunud-sunod ng mga layer na unti-unting nagpapataas ng dimensionality ng data pabalik sa orihinal nitong hugis.

Bakit Ito Mahalaga?

Ang mga autoencoder ay isang mahalagang bahagi ng malalim na pag-aaral dahil ginagawa nilang posible ang pagkuha ng tampok at pagbabawas ng data.

Nagagawa nilang tukuyin ang mga pangunahing elemento ng papasok na data at isalin ang mga ito sa isang naka-compress na form na maaaring ilapat sa iba pang mga gawain tulad ng pag-uuri, pagpapangkat, o paggawa ng bagong data.

Saan Namin Gumagamit ng Autoencoders?

Ang pagtuklas ng anomalya, pagproseso ng natural na wika, at computer vision ay ilan lamang sa mga disiplina kung saan ginagamit ang mga autoencoder. Ang mga autoencode, halimbawa, ay maaaring gamitin para sa compression ng imahe, pag-denoising ng larawan, at pagbubuo ng larawan sa computer vision.

Magagamit namin ang mga Autoencoder sa mga gawain tulad ng paggawa ng teksto, pagkakategorya ng teksto, at pagbubuod ng teksto sa pagproseso ng natural na wika. Maaari itong matukoy ang maanomalyang aktibidad sa data na lumihis sa pamantayan sa pagkakakilanlan ng anomalya.

7. Mga Capsule Network

Ang Capsule Networks ay isang bagong deep learning architecture na binuo bilang kapalit ng Convolutional Neural Networks (CNNs).

Ang mga Capsule Network ay batay sa ideya ng pagpapangkat ng mga unit ng utak na tinatawag na mga kapsula na responsable sa pagkilala sa pagkakaroon ng isang partikular na item sa isang imahe at pag-encode ng mga katangian nito, tulad ng oryentasyon at posisyon, sa kanilang mga output vector. Samakatuwid, ang mga Capsule Network ay maaaring pamahalaan ang mga spatial na pakikipag-ugnayan at pagbabago ng pananaw nang mas mahusay kaysa sa mga CNN.

Bakit Namin Pinili ang Mga Capsule Network kaysa sa CNN?

Ang mga Capsule Network ay kapaki-pakinabang dahil nalampasan nila ang mga kahirapan ng CNN sa pagkuha ng mga hierarchical na relasyon sa pagitan ng mga item sa isang larawan. Nakikilala ng mga CNN ang mga bagay na may iba't ibang laki ngunit nahihirapang maunawaan kung paano kumonekta ang mga item na ito sa isa't isa.

Ang Capsule Networks, sa kabilang banda, ay matututong kilalanin ang mga bagay at ang kanilang mga piraso, pati na rin kung paano inilalagay ang mga ito nang spatially sa isang imahe, na ginagawa silang isang mabubuhay na kalaban para sa mga application ng computer vision.

Mga Lugar ng Aplikasyon

Ang Capsule Networks ay nagpakita na ng mga magagandang resulta sa iba't ibang mga aplikasyon, kabilang ang pag-uuri ng imahe, pagkakakilanlan ng bagay, at pagse-segment ng larawan.

Nagamit na ang mga ito upang makilala ang mga bagay sa mga medikal na larawan, kilalanin ang mga tao sa mga pelikula, at kahit na gumawa ng mga 3D na modelo mula sa mga 2D na larawan.

Upang pataasin ang kanilang performance, ang Capsule Networks ay pinagsama sa iba pang mga deep learning architecture gaya ng Generative Adversarial Networks (GANs) at Variational Autoencoders (VAEs). Ang Capsule Networks ay hinuhulaan na gaganap ng lalong mahalagang papel sa pagpapahusay ng mga teknolohiya ng computer vision habang umuunlad ang agham ng malalim na pag-aaral.

Halimbawa; Nibabel ay isang kilalang Python tool para sa pagbabasa at pagsulat ng mga uri ng neuroimaging file. Para sa segmentasyon ng imahe, gumagamit ito ng Capsule Networks.

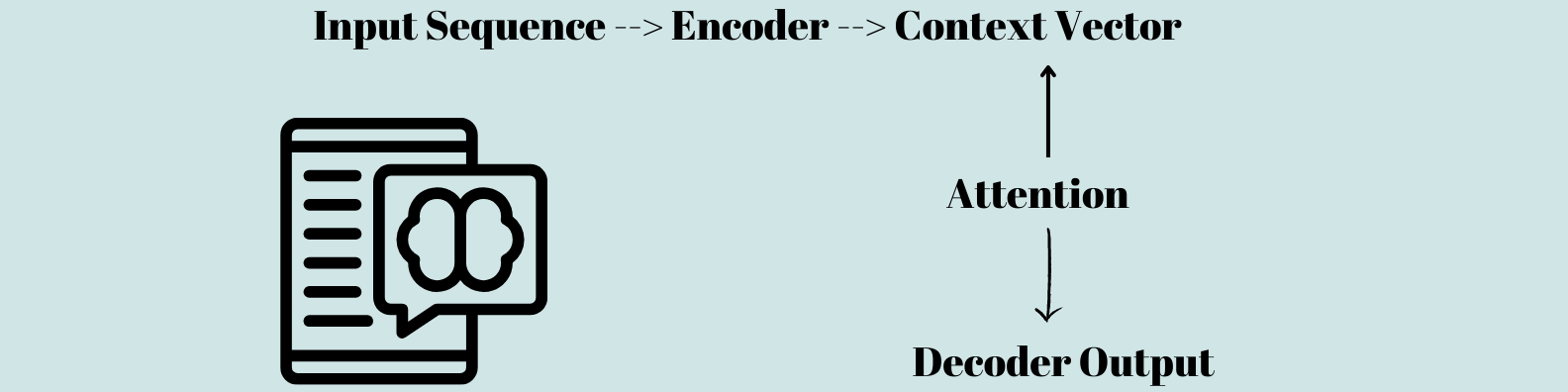

8. Mga modelong nakabatay sa atensyon

Ang mga modelo ng malalim na pag-aaral na kilala bilang mga modelong nakabatay sa pansin, na kilala rin bilang mga mekanismo ng atensyon, ay nagsusumikap na pataasin ang katumpakan ng mga modelo ng pag-aaral ng makina. Gumagana ang mga modelong ito sa pamamagitan ng pagtuon sa ilang partikular na feature ng papasok na data, na nagreresulta sa mas mahusay at epektibong pagproseso.

Sa natural na mga gawain sa pagpoproseso ng wika tulad ng machine translation at sentiment analysis, napatunayang medyo matagumpay ang mga pamamaraan ng atensyon.

Ano ang Kahulugan Nila?

Ang mga modelong nakabatay sa atensyon ay kapaki-pakinabang dahil pinapagana nila ang mas epektibo at mahusay na pagproseso ng kumplikadong data.

Mga tradisyunal na neural network suriin ang lahat ng data ng input bilang pantay na mahalaga, na nagreresulta sa mas mabagal na pagproseso at nabawasan ang katumpakan. Nakatuon ang mga proseso ng atensyon sa mahahalagang aspeto ng data ng pag-input, na nagbibigay-daan para sa mas mabilis at mas tumpak na mga hula.

Mga Lugar ng Paggamit

Sa larangan ng artificial intelligence, ang mga mekanismo ng atensyon ay may malawak na hanay ng mga aplikasyon, kabilang ang natural na pagpoproseso ng wika, pagkilala sa larawan at audio, at maging ang mga sasakyang walang driver.

Halimbawa, ang mga paraan ng atensyon ay maaaring gamitin upang mapabuti ang pagsasalin ng makina sa natural na pagpoproseso ng wika sa pamamagitan ng pagpapahintulot sa system na tumuon sa ilang partikular na salita o parirala na mahalaga sa konteksto.

Maaaring gamitin ang mga paraan ng atensyon sa mga autonomous na sasakyan upang tulungan ang system na tumuon sa ilang partikular na bagay o hamon sa paligid nito.

9. Mga Transformer Network

Ang mga network ng transformer ay mga modelo ng malalim na pag-aaral na sumusuri at gumagawa ng mga pagkakasunud-sunod ng data. Gumagana ang mga ito sa pamamagitan ng pagproseso ng input sequence ng isang elemento sa isang pagkakataon at paggawa ng isang output sequence ng pareho o magkaibang haba.

Ang mga transformer network, hindi tulad ng mga karaniwang sequence-to-sequence na mga modelo, ay hindi nagpoproseso ng mga sequence gamit ang mga paulit-ulit na neural network (RNN). Sa halip, gumagamit sila ng mga proseso ng pagtutuon sa sarili upang matutunan ang mga link sa pagitan ng mga piraso ng pagkakasunud-sunod.

Ano ang Kahalagahan ng Transformer Networks?

Ang mga network ng transformer ay lumago sa katanyagan sa mga nakaraang taon bilang resulta ng kanilang mas mahusay na pagganap sa mga natural na trabaho sa pagproseso ng wika.

Ang mga ito ay partikular na angkop para sa mga gawain sa paglikha ng teksto tulad ng pagsasalin ng wika, pagbubuod ng teksto, at paggawa ng pag-uusap.

Ang mga network ng transformer ay higit na mahusay sa pagkalkula kaysa sa mga modelong nakabatay sa RNN, na ginagawa itong isang ginustong pagpipilian para sa mga malalaking aplikasyon.

Saan Ka Makakahanap ng mga Transformer Network?

Ang mga network ng transformer ay malawakang ginagamit sa malawak na hanay ng mga aplikasyon, lalo na sa natural na pagproseso ng wika.

Ang serye ng GPT (Generative Pre-trained Transformer) ay isang kilalang modelong batay sa transformer na ginamit para sa mga gawain tulad ng pagsasalin ng wika, pagbubuod ng teksto, at pagbuo ng chatbot.

Ang BERT (Bidirectional Encoder Representations mula sa Mga Transformer) ay isa pang karaniwang modelong nakabatay sa transformer na ginamit para sa mga aplikasyon ng natural na pag-unawa sa wika gaya ng pagsagot sa tanong at pagsusuri ng damdamin.

Kapwa GPT at si BERT ay nilikha gamit ang PyTorch, isang open-source na deep-learning framework na naging popular para sa pagbuo ng mga modelong nakabatay sa transformer.

10. Mga Restricted Boltzmann Machines( RBMs)

Ang Restricted Boltzmann Machines (RBMs) ay isang uri ng hindi pinangangasiwaang neural network na natututo sa isang generative na paraan. Dahil sa kanilang kakayahang matuto at mag-extract ng mahahalagang katangian mula sa high-dimensional na data, malawak silang ginamit sa mga larangan ng machine learning at deep learning.

Ang mga RBM ay binubuo ng dalawang layer, nakikita at nakatago, na ang bawat layer ay binubuo ng isang pangkat ng mga neuron na konektado sa pamamagitan ng mga may timbang na gilid. Ang mga RBM ay idinisenyo upang matutunan ang isang probability distribution na naglalarawan sa input data.

Ano ang Mga Restricted Boltzmann Machines?

Gumagamit ang mga RBM ng isang generative na diskarte sa pag-aaral. Sa mga RBM, ang nakikitang layer ay sumasalamin sa input data, habang ang nakabaon na layer ay nag-encode ng mga katangian ng input data. Ang mga bigat ng nakikita at nakatagong mga layer ay nagpapakita ng lakas ng kanilang link.

Inaayos ng mga RBM ang mga timbang at bias sa pagitan ng mga layer habang nagsasanay gamit ang isang pamamaraan na kilala bilang contrastive divergence. Ang contrastive divergence ay isang hindi pinangangasiwaang diskarte sa pag-aaral na nagpapalaki sa posibilidad ng hula ng modelo.

Ano ang kahalagahan ng Restricted Boltzmann Machines?

Ang mga RBM ay makabuluhan sa machine learning at malalim na pag-aaral dahil maaari nilang matutunan at kunin ang mga nauugnay na katangian mula sa malaking halaga ng data.

Napakabisa ng mga ito para sa pagkilala sa larawan at pananalita, at ginamit ang mga ito sa iba't ibang mga application tulad ng mga system ng nagrerekomenda, pagtuklas ng anomalya, at pagbabawas ng dimensional. Ang mga RBM ay makakahanap ng mga pattern sa malawak na mga dataset, na nagreresulta sa mga mahuhusay na hula at insight.

Saan maaaring gamitin ang Restricted Boltzmann Machines?

Kasama sa mga application para sa mga RBM ang pagbabawas ng dimensionality, pagtuklas ng anomalya, at mga sistema ng rekomendasyon. Ang mga RBM ay partikular na nakakatulong para sa pagsusuri ng damdamin at pagmomodelo ng paksa sa konteksto ng natural na pagproseso ng wika.

Ang mga deep faith network, isang uri ng neural network na ginagamit para sa pagkilala ng boses at larawan, ay gumagamit din ng mga RBM. Ang Toolbox ng Deep Belief Network, TensorFlow, at Theano ay ilang partikular na halimbawa ng software o teknolohiya na gumagamit ng mga RBM.

Balutin

Ang mga modelo ng Deep Learning ay nagiging mas mahalaga sa iba't ibang industriya, kabilang ang speech recognition, natural na pagpoproseso ng wika, at computer vision.

Ang Convolutional Neural Networks (CNNs) at Recurrent Neural Networks (RNNs) ay nagpakita ng pinakamaraming pangako at malawakang ginagamit sa maraming application, gayunpaman, lahat ng Deep Learning models ay may mga pakinabang at disadvantages.

Gayunpaman, tinitingnan pa rin ng mga mananaliksik ang Restricted Boltzmann Machines (RBMs) at iba pang uri ng Deep Learning models dahil mayroon din silang mga espesyal na pakinabang.

Ang mga bago at malikhaing modelo ay inaasahang malikha habang ang lugar ng malalim na pag-aaral ay patuloy na sumusulong upang mahawakan ang mas mahirap na mga problema

Mag-iwan ng Sagot