Upang makakuha ng impormasyon mula sa mga website para sa pagsusuri, pananaliksik, o mga layunin sa marketing, ang web scraping ay isang mahalagang pamamaraan. Sa kabutihang palad, maraming mga tool na sumusuporta sa parehong walang ulo at headful na mga browser, na parehong kapaki-pakinabang para sa web scraping.

Ang mga headful browser ay may kasamang graphical user interface (GUI), habang ang mga walang ulo na browser ay wala. Ang mga teknolohiyang ito ay maaaring manu-mano at awtomatikong kumuha ng data mula sa mga web page, na ginagawang lubhang kapaki-pakinabang ang mga ito.

Kapag humahawak ng maraming data, ang mga walang ulo na browser ang pinakamagandang opsyon. Upang i-automate ang iyong proseso ng pagkuha ng data, kakailanganin mo ang mga tool na ito, na makakatipid sa iyo ng isang toneladang oras at trabaho.

Bukod pa rito, tinutulungan ka nitong pagbutihin ang katumpakan at pagiging epektibo ng iyong pagkuha ng data, na maaaring magresulta sa mas mabungang mga resulta sa pangkalahatan.

Ang mga tool na ito ay maaari ding tumulong sa pagpapababa ng posibilidad ng mga error na lumabas habang manu-mano ang pagkopya at pag-paste ng data dahil mayroon silang kapasidad na kumuha ng data sa isang organisadong paraan.

Sa madaling sabi, imposibleng magtrabaho nang walang mga tool na sumusuporta sa parehong walang ulo at headful na mga browser kung ikaw ay nakikibahagi sa web scraping.

Sa artikulong ito, titingnan natin ang mga nangungunang walang ulo at nakakabinging mga browser para sa web scraping.

1. Maliwanag na Data

Ang Bright Data ay isang web scraping program na nagbibigay ng mga pagpipilian para sa pangongolekta ng data para sa mga negosyo at indibidwal. Kabaligtaran sa mga naunang online scraping system, ang Bright Data ay na-pre-load na may ilang mga browser ngunit gumagana bilang isang walang ulo na browser.

Kahit na ito ay tumatakbo bilang isang walang ulo na browser sa backend, ito ay tumutukoy sa katotohanan na ang mga user ay maaaring makipag-ugnayan dito sa pamamagitan ng isang graphical user interface (GUI), na ginagawa itong mas naa-access at user-friendly.

Lalo na magiging kapaki-pakinabang ang functionality na ito para sa mga hindi gaanong alam tungkol sa coding o gusto ng mas simpleng diskarte sa web scraping. Ang mga user ay maaaring mag-navigate sa mga kumplikadong website na may mga pakikipag-ugnayan na tulad ng tao nang mabilis dahil sa maingat na browser ng Bright Data.

Upang mapanatili kang anonymous at hindi natuklasan, nagbibigay din ito ng mga cutting-edge na kakayahan tulad ng pag-ikot ng IP, fingerprinting ng browser, at pag-fake ng user-agent. Sa paggamit ng AI, ang Scraping Browser ay makakalampas sa kahit na ang pinaka-advanced na mga proteksyon sa pag-detect ng bot.

Sa katunayan, ang Scraping Browser ay napaka sopistikado na kaya nitong gayahin ang mga pagkilos ng browser ng isang tunay na user, na nagbibigay sa iyo ng mas matagumpay na mga resulta at tumpak na data.

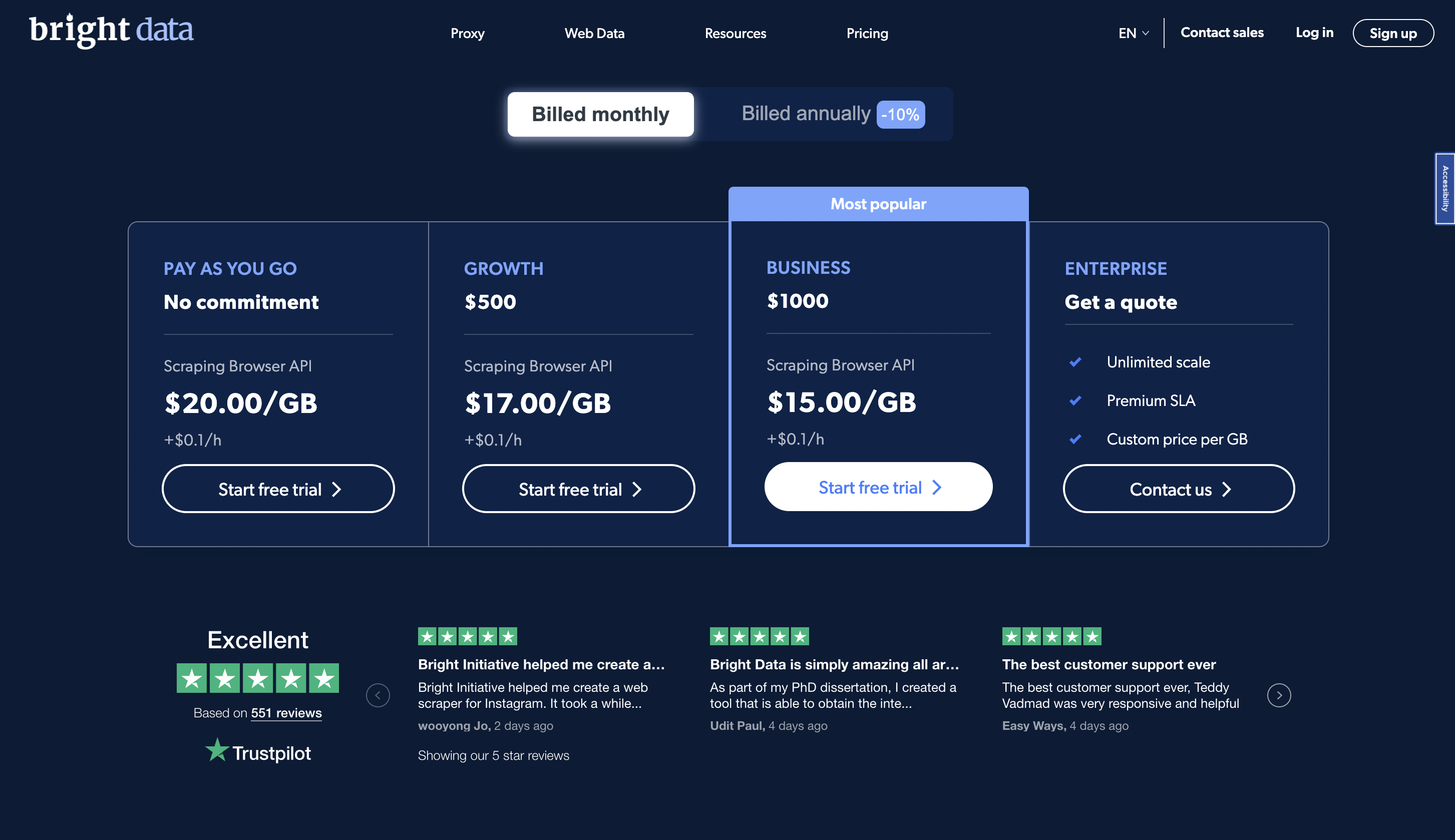

pagpepresyo

Maaari mong subukan ang platform nang libre at ang premium na pagpepresyo ay nagsisimula sa $20/GB sa isang pay-as-you-go plan.

2. Zyte

Bilang tagapagtustos ng mga online na tool sa pag-scrape, binibigyang-daan ng Zyte—na dating kilala bilang Scrapinghub—ang mga kumpanya na kumuha at magsuri ng data sa internet sa sukat.

Ang online scraping platform ng Zyte ay binuo upang pangasiwaan ang kahit na ang pinakakumplikado at dynamic na mga website, at kabilang dito ang iba't ibang mga cutting-edge na feature tulad ng automated IP rotation, browser fingerprinting, at user-agent spoofing upang matiyak na ang iyong mga operasyon sa pag-scrape ay mananatiling pribado at hindi napapansin.

Ang katotohanan na ang web scraping platform ng Zyte ay sumusuporta sa parehong walang ulo at headful surfing mode ay isa sa mga natatanging bentahe nito. Gumagana ang browser sa headless mode sa background nang walang graphical na user interface, na nagpapataas ng kahusayan nito para sa malawak na mga operasyon sa pag-scrape.

Gayunpaman, gumagana ang browser gamit ang isang GUI sa headful mode, na maaaring maging kapaki-pakinabang kapag kailangan mong kumuha ng data mula sa mga website na may masalimuot na mga interface ng gumagamit.

Bukod pa rito, dahil ang platform ng Zyte ay nakabatay sa libre at open-source na Scrapy foundation, maaari itong iakma upang matugunan ang iyong mga partikular na pangangailangan at lubos na mai-configure. Maaari mong mabilis at simpleng kunin ang data na gusto mo gamit ang Zyte, na nagbibigay sa iyo ng competitive na edge sa iyong negosyo.

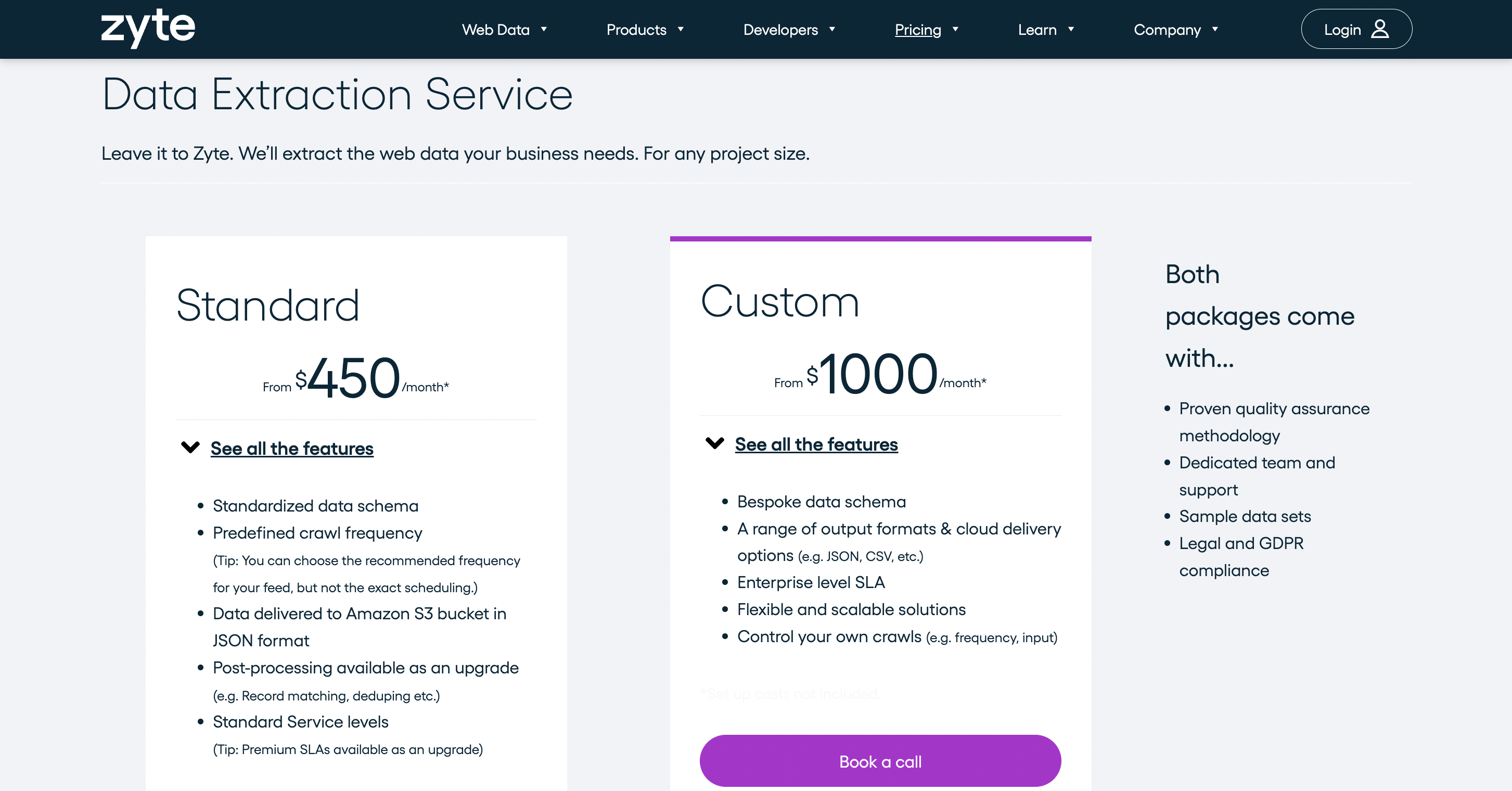

pagpepresyo

Nag-aalok ito ng maramihang mga plano sa pagpepresyo, at naniningil ito ng $450/buwan para sa serbisyo ng pagkuha ng data.

3. Pugita

Maaari kang mangalap ng data mula sa mga webpage nang hindi sumusulat ng anumang code gamit ang Octoparse, isang cloud-based na web scraping application. Ang sinumang gustong mag-scrape ng text, mga larawan, o mga video ay maaaring pumili ng mga ito nang madali salamat sa user-friendly na interface.

Ang Octoparse ay isang flexible na tool na sumusuporta sa parehong walang ulo at ulong pag-browse, ito ang pinakamahusay na opsyon para sa web scraping na mga proyekto sa anumang laki at kumplikado. Ang kakayahang mag-scrape ng dynamic at interactive na mga webpage, na maaaring mahirap para sa maraming iba pang mga web scraping program, ay isa sa pinakamalakas na katangian nito.

Maaari kang lumikha ng mga kumplikadong proseso ng pag-scrape na may maraming phase, conditional statement, at loop, na nagpapataas ng flexibility at customizability ng scraping. Ang Excel, CSV, at SQL ay ilan lamang sa mga format ng pag-export na ibinibigay ng Octoparse, na ginagawang simple ang paggamit ng nakuhang data sa ibang mga programa.

Bukod pa rito, nagtatampok ang Octoparse ng pinagsamang proxy pool na nagsisiguro ng hindi kilalang pag-scrape at tumutulong sa pag-iwas sa pagbabawal ng IP.

pagpepresyo

Maaari mong simulang gamitin ito nang libre at ang premium na pagpepresyo ay magsisimula sa $89/buwan.

4. Apify

Ang Apify ay isang web scraping at automation all-in-one na platform na nag-aalok ng iba't ibang makapangyarihang feature. Sinusuportahan nito ang parehong walang ulo at ulong mga browser at may intuitive na user interface na ginagawang simple para sa kahit na hindi teknikal na mga user na gumawa ng mga gawain sa pag-scrape.

Ang kakayahan ng Apify na pangasiwaan ang mahihirap na trabaho sa pag-scrape, suporta para sa ilang wika, at pag-scale up upang mahawakan ang malalaking proyekto sa pag-scrape ay ilan sa mga pinakamahusay na tampok nito.

Bilang karagdagan, ang Apify ay nagbibigay ng access sa isang malawak na merkado ng mga handang scraper na maaaring mabilis na i-customize upang matugunan ang iyong mga natatanging pangangailangan.

Sa suporta nito para sa mga walang ulo na browser, maaaring mag-navigate ang Apify sa mga mapaghamong user interface at mag-scrape ng data mula sa mga dynamic na website habang mabilis at mahusay na kumukuha ng impormasyon mula sa napakalaking dami ng data.

Ang Apify ay isang kapaki-pakinabang na tool para sa iba't ibang online na aplikasyon sa pag-scrape, kabilang ang pagbuo ng lead, mapagkumpitensyang pagsusuri, pananaliksik sa merkado, at pagsasama-sama ng nilalaman.

Pinapalakas ng Apify ang katumpakan at kahusayan habang nagtitipid ng oras at pagsisikap sa pamamagitan ng pag-automate ng proseso ng pagkuha ng data. Ito ay isang malakas na tool para sa parehong teknikal at hindi teknikal na mga user dahil sa functionality nito at user-friendly na disenyo.

pagpepresyo

Maaari mong simulang gamitin ito nang libre at ang premium na pagpepresyo ay magsisimula sa $49/buwan.

5. ScrapingBee

Ginagawang simple ng pambihirang online na scraping application na ScrapingBee na i-automate ang proseso ng pagkuha ng data mula sa mga website.

Ang mga kakayahan nito, tulad ng mga para sa paghawak ng JavaScript rendering, CAPTCHA resolution, at user-agent rotation, ay nagbibigay-daan sa mga website na anti-scraping defenses na ma-bypass. samakatuwid ginagawa itong isang mahusay na pagpipilian para sa mga gawain sa web scraping.

Ang mga user ay may isang mahusay na antas ng kalayaan sa tool na ito dahil ito ay gumagana sa parehong walang ulo at headful browser. Mahalagang ituro na ang ScrapingBee ay gumagamit ng mga walang ulo na browser bilang default, na perpekto para sa awtomatikong pagkuha ng napakalaking dami ng data.

Upang makipag-ugnayan sa mga website na may kumplikadong interface, maaaring lumipat ang mga user sa mga maingat na browser. Upang matiyak ang epektibong pagkuha ng data, pinapanatili din ng ScrapingBee ang isang pool ng mga geolocated na proxy na regular na sinusuri at binago.

Maaaring bawasan ng mga user ang oras at pagsisikap sa panahon ng web scraping sa pamamagitan ng paggamit ng ScrapingBee bilang walang ulo o headful na browser habang ginagarantiyahan pa rin ang kawastuhan at pagkakumpleto ng nakuhang data. Mayroon din itong maraming kapaki-pakinabang na feature, tulad ng pag-format ng data, pag-ikot ng proxy, at pagkakakonekta ng API, na ginagawa itong isang madaling gamiting tool para sa parehong mga kumpanya at mag-aaral.

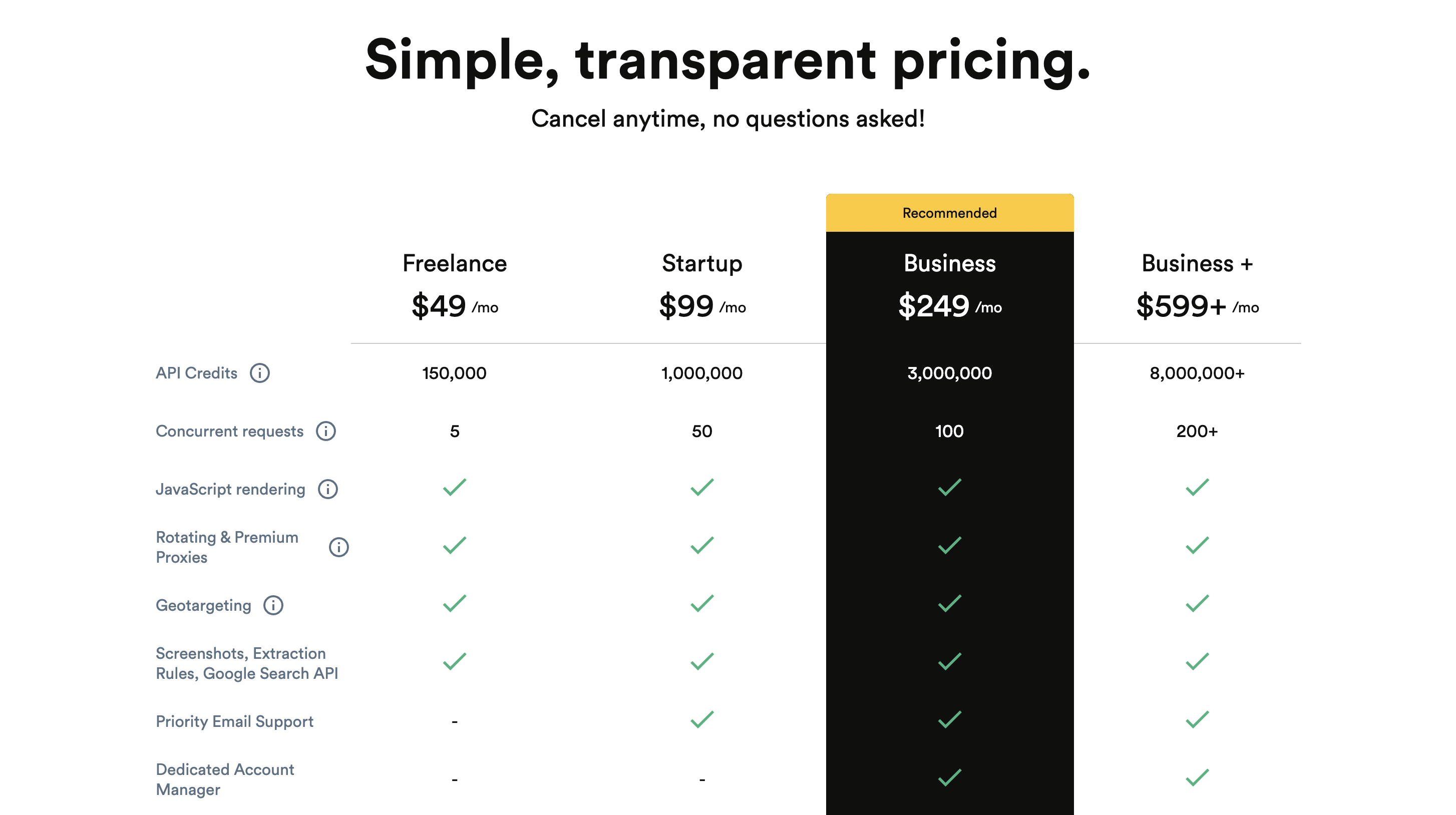

pagpepresyo

Ang premium na pagpepresyo ay nagsisimula sa $49/buwan.

6. ParseHub

Nang hindi nangangailangan ng teknikal na kadalubhasaan, maaaring mangalap ng data ang mga user mula sa mga website gamit ang web scraping application na ParseHub. Isa sa mga pinakamalaking katangian nito ay kung gaano kadali itong gamitin; maaaring piliin ng mga user ang data na gusto nilang i-scrape sa pamamagitan lamang ng pag-click sa mga item.

Gayundin, mayroon itong kakayahang awtomatikong makilala ang pagination, na ginagawang simple para sa mga gumagamit na mag-scrape ng impormasyon mula sa ilang mga pahina. Upang makapag-scrape ng data mula sa mga website na may basic o kumplikadong mga user interface, sinusuportahan ng ParseHub ang parehong walang ulo at ulong mga browser.

Bukod pa rito, nagbibigay ito ng awtomatikong pag-ikot ng IP, na ginagawang mas mahirap para sa mga website na tukuyin at ipagbawal ang aktibidad ng pag-scrape. Ginagarantiya ng ParseHub na kinukuha ang data sa isang organisadong paraan sa tulong ng malawak nitong kakayahan sa pag-format ng data, na ginagawang mas simple para sa pagsusuri at pagsasama ng system.

Bukod pa rito, may smart mode ang ParseHub na awtomatikong kumikilala at kumukuha ng impormasyon mula sa mga katulad na website. Ang ParseHub ay maaaring makilala at mangalap ng data mula sa mga website na may mga katulad na istruktura, gaya ng mga e-commerce na website, gamit artificial intelligence (AI). Ang tampok na ito ay nagpapalakas ng katumpakan at pagiging produktibo sa pamamagitan ng nangangailangan ng mas kaunting pagsisikap at pagtitipid ng oras.

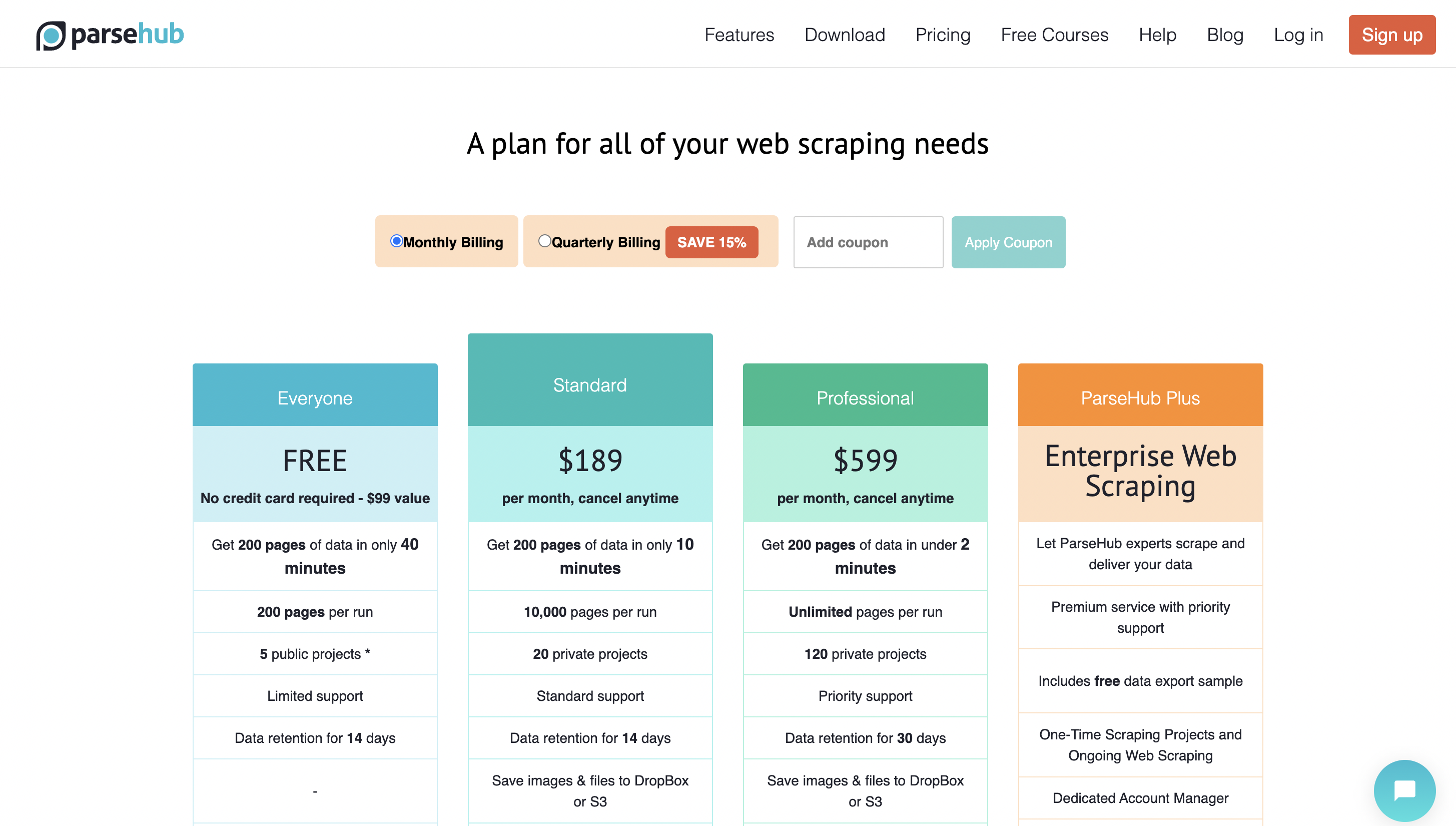

pagpepresyo

Maaari mong simulang gamitin ito nang libre at ang premium na pagpepresyo ay magsisimula sa $189/buwan.

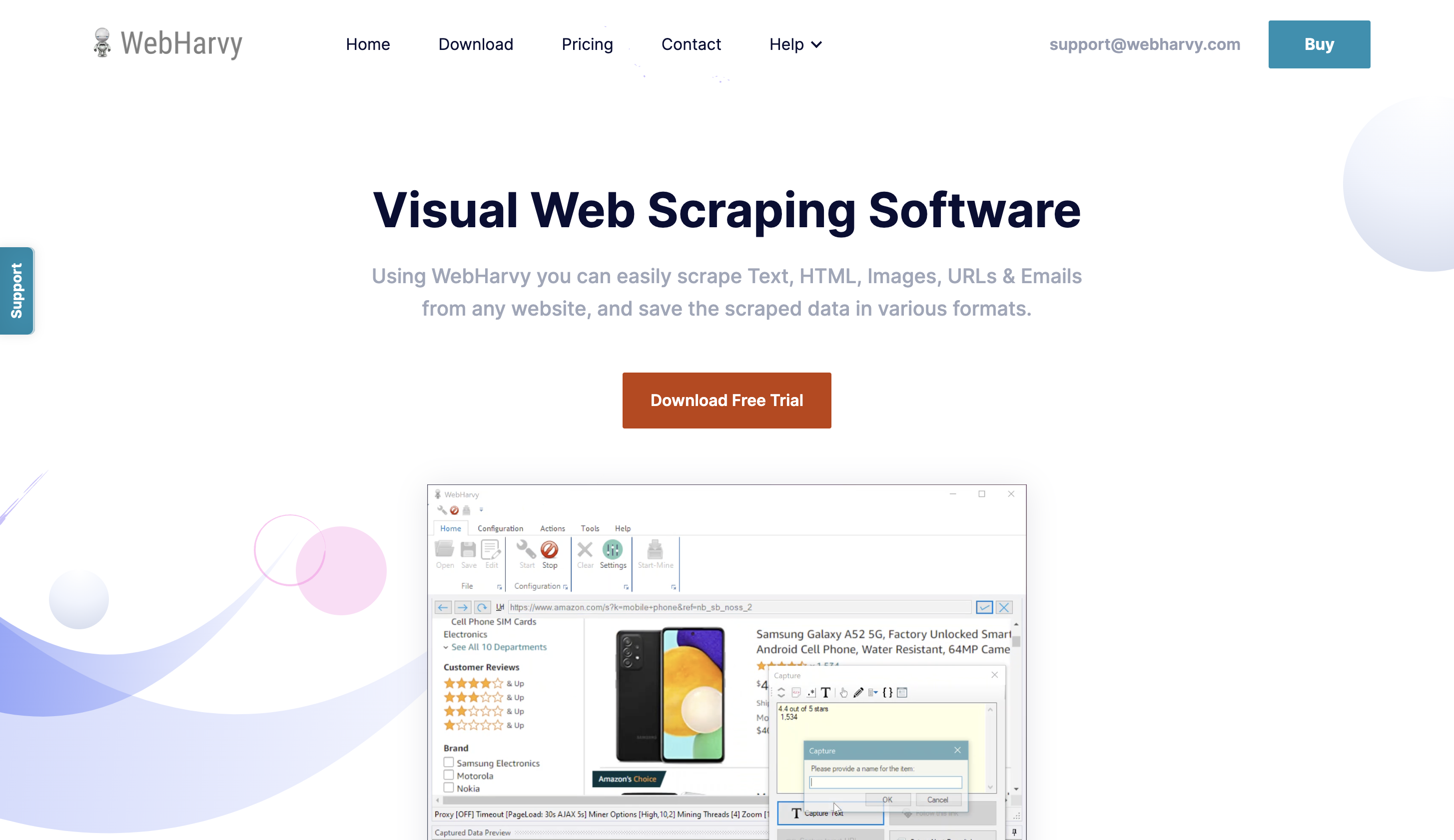

7. WebHarvy

Ang WebHarvy ay isang mabisang online scraping tool na nagbibigay-daan sa mga organisasyon na mabilis, tumpak, at mahusay na mag-scrape ng data mula sa mga website. Ito ay ginawa upang mag-scrape ng impormasyon mula sa maraming mga website, kabilang ang mga search engine, social media, mga site ng e-commerce, at mga direktoryo.

Nang walang anumang naunang karanasan sa pag-coding, ang mga user ay madaling mag-explore at lumikha ng mga trabaho sa pag-scrape dahil sa user-friendly na interface nito. Ang isa sa mga pinakamalaking katangian ng WebHarvy ay ang kakayahang kunin ang data mula sa mga webpage na pinapagana ng JavaScript at AJAX na maaaring hindi ma-access ng ibang mga tool sa pag-scrape.

Bukod pa rito, nag-aalok ito ng Point and Click Interface na ginagawang simple ang pagpili ng impormasyon mula sa isang web page na nais mong i-scrape. Ang WebHarvy ay may mga walang ulo at nakakabinging mga mode sa pagba-browse. Para sa mas mabilis at mas epektibong pag-scrape ng data, maaari itong gumana sa headless mode.

Nakakatulong ang headful mode kapag nagtatrabaho sa mga kumplikadong website na nangangailangan ng input ng user. Maaari din itong mag-navigate sa pagitan ng maraming pahina at punan ang mga form, na kapaki-pakinabang kapag kumukuha ng data mula sa mga website na may maraming pahina.

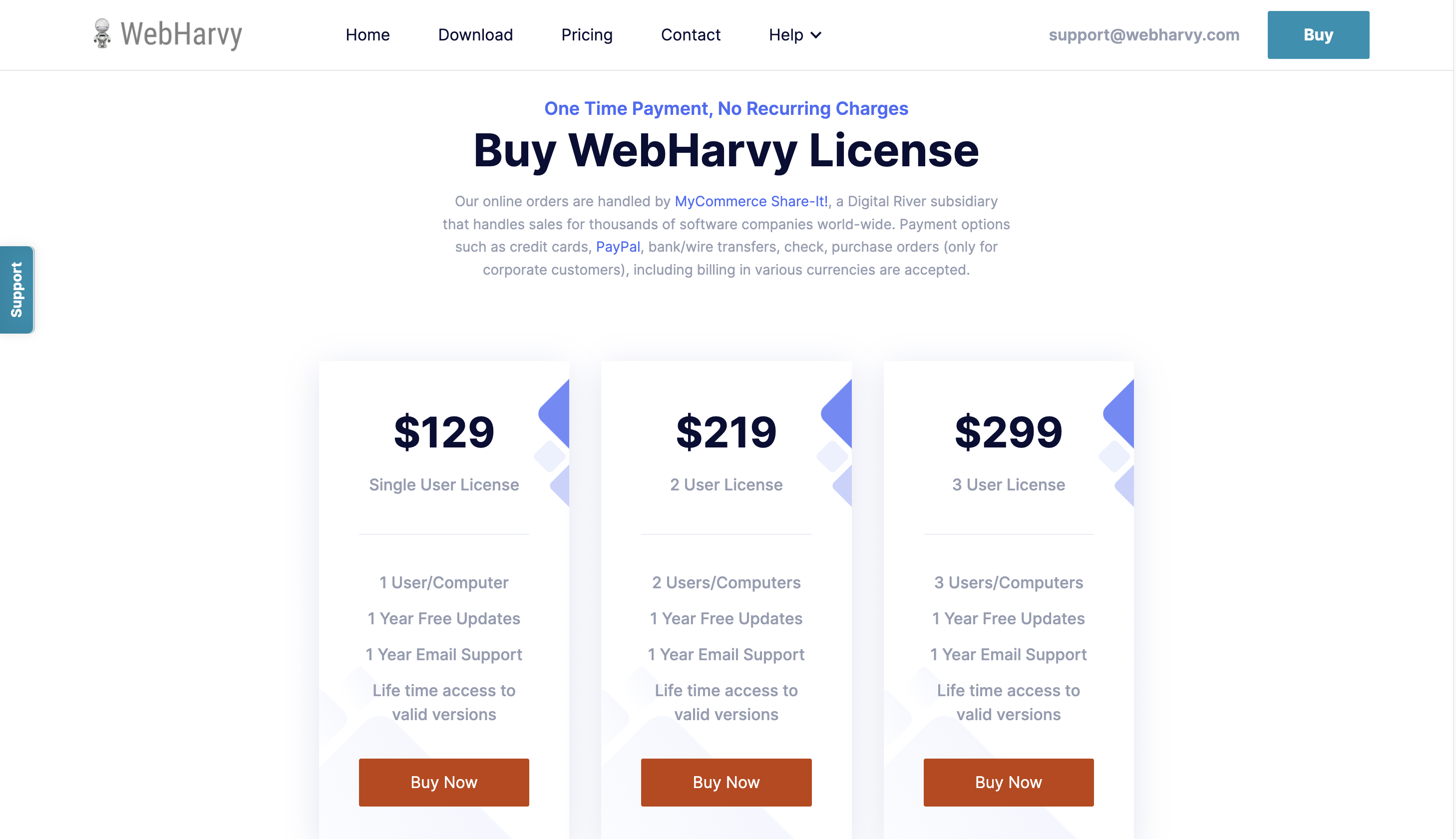

pagpepresyo

Ang premium na pagpepresyo ay nagsisimula mula sa $129 para sa isang single-user na lisensya.

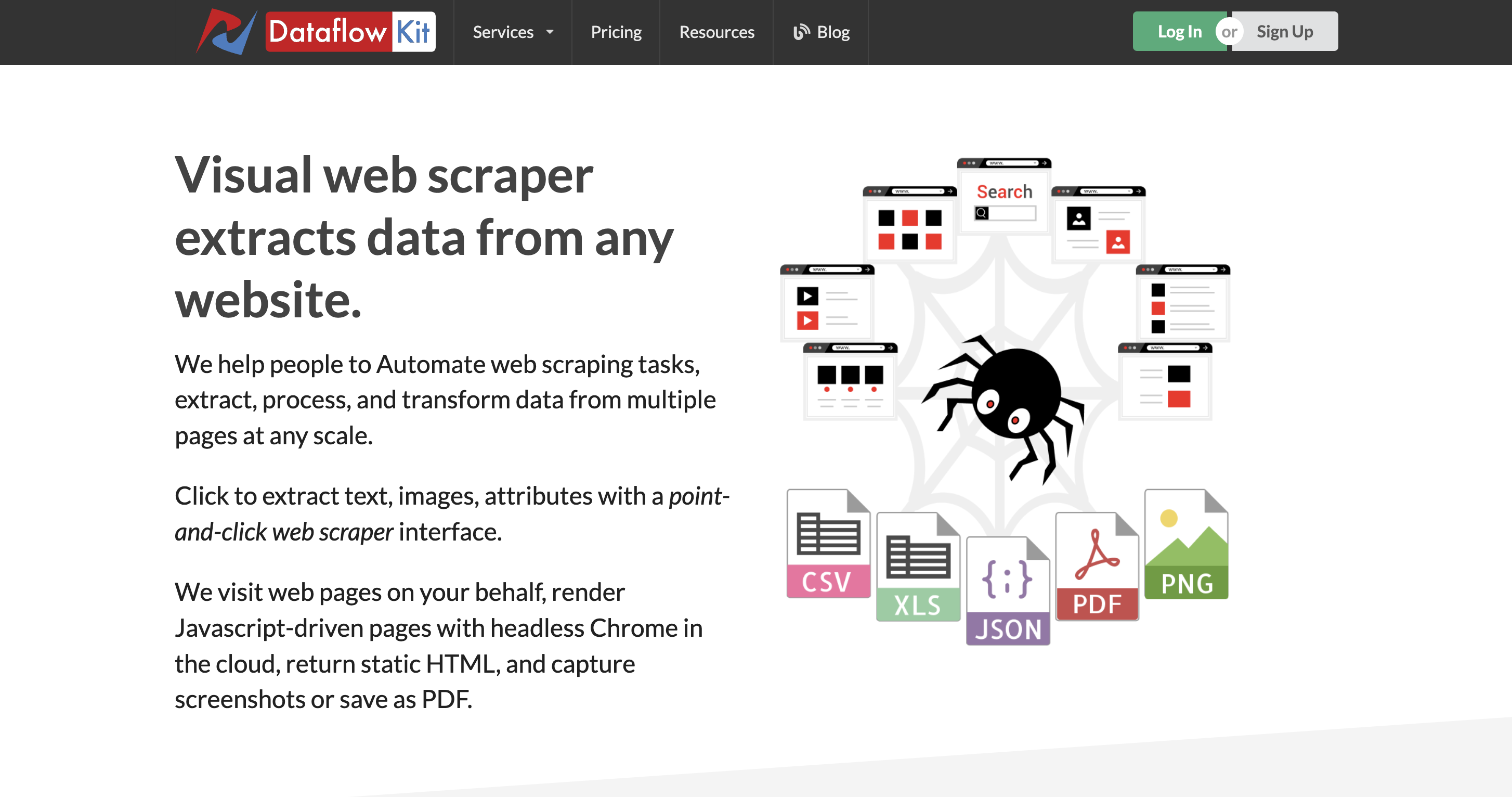

8. Kit ng Dataflow

Gamit ang Dataflow Kit, isang mahusay na tool sa online scraping, maaaring kolektahin at suriin ang data mula sa iba't ibang website, kabilang ang social networking mga site, mga search engine, mga website ng e-commerce, at mga website ng balita. Ang isa sa mga pinakamahusay na tampok nito ay ang kakayahang mabilis at mahusay na mangolekta ng data mula sa kumplikado, dynamic na mga website.

Ito ay perpekto para sa pag-scrape ng mga website na mahirap i-access gamit ang iba pang mga pamamaraan dahil ito ay napakasimpleng gamitin. Ang isang walang ulo na browser at isang maingat na browser ay parehong gumagana sa Dataflow Kit. Ang mga advanced na feature tulad ng pag-ikot ng proxy at user-agent, pag-iwas sa pag-block ng IP, at pag-detect ng anti-bot ay ibinibigay upang matiyak ang epektibong pag-scrape.

Bukod pa rito, nag-aalok ito ng user-friendly na interface na nagbibigay-daan sa mga customer na lumikha, magplano, at pamahalaan ang kanilang mga aktibidad sa pag-scrape nang walang anumang karanasan sa programming. Para sa malakihang web scraping application, ang epektibong makina ng scraper nito ay isang kamangha-manghang solusyon dahil ito ay na-optimize upang mahawakan ang data nang mabilis at epektibo.

Ang na-scrap na data ay maaaring i-export lamang sa iba't ibang mga format, kabilang ang CSV, JSON, at XML, na nagbibigay-daan sa iyong pag-aralan at gamitin ito sa paraang sa tingin mo ay angkop. Higit pa rito, ang Dataflow Kit ay nagbibigay ng iba't ibang opsyon sa interface, kabilang ang API at Zapier, upang tulungan ka sa pag-streamline ng iyong daloy ng trabaho at pag-automate ng iyong proseso ng pagkuha ng data.

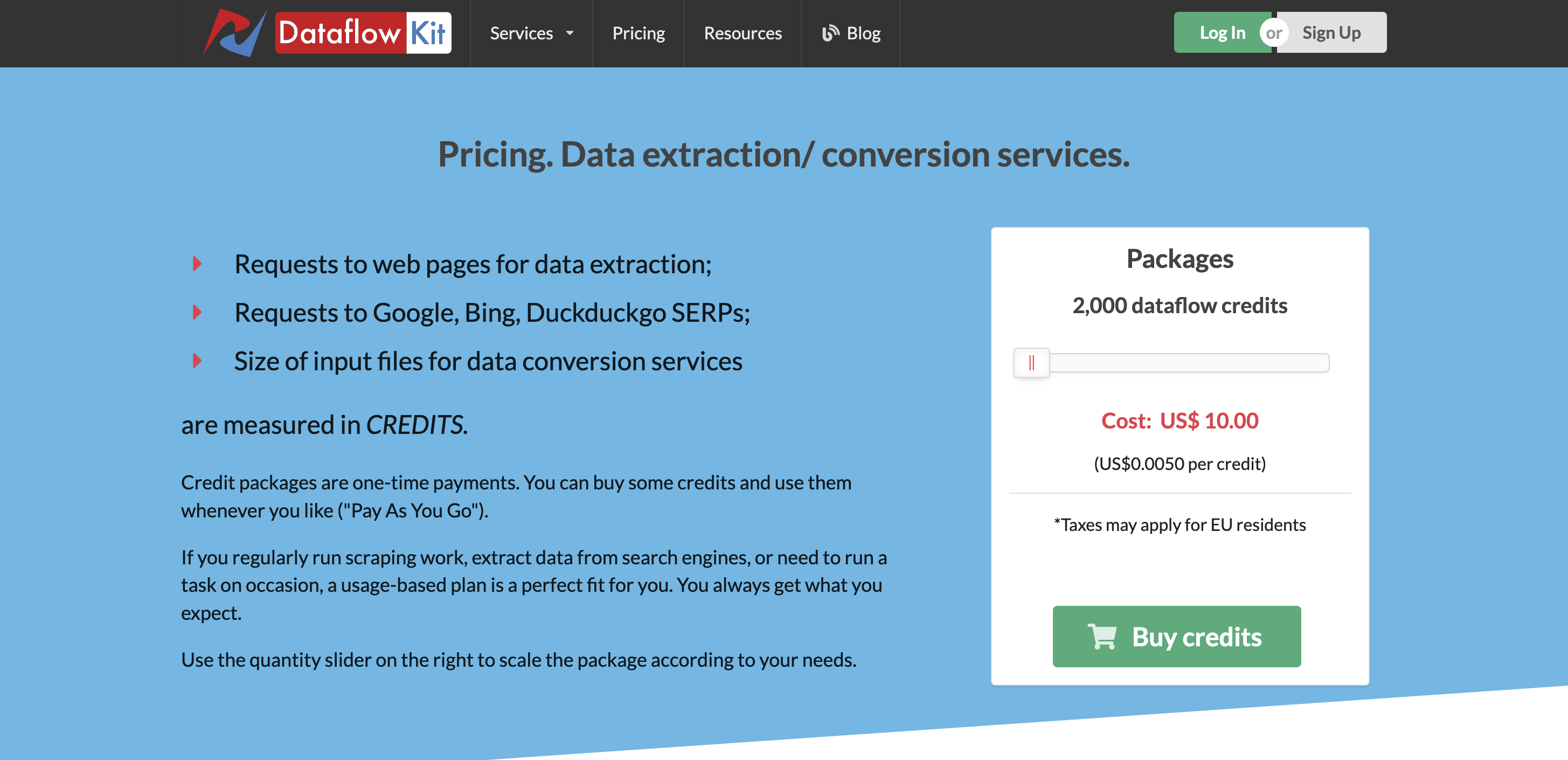

pagpepresyo

Ang premium na pagpepresyo ay nagsisimula sa $10 para sa 2000 dataflow credits, na magagamit mo ayon sa iyong mga pangangailangan.

9. import.io

Sa tulong ng cloud-based na web scraping tool na Import.io, ang mga user ay maaaring mag-scrape ng data mula sa mga website nang walang anumang karanasan sa programming. Ang pagiging simple ng paggamit ay isa sa mga pinakakaakit-akit na feature ng Import.io; ang kailangan mo lang gawin ay ituro at i-click upang mahanap ang data na gusto mong i-scrape.

Maaaring suriin ng mga user ang na-extract na data sa real-time dahil sa mga mahuhusay na feature ng visualization nito. Ang Import.io ay isang walang ulo na browser na ginagaya ang isang web browser at kumokonekta sa mga website sa parehong paraan tulad ng gagawin ng isang tao ngunit walang kinakailangan para sa isang graphical na user interface.

Pinapabuti nito ang kahusayan sa pag-scrape ng web at pinapayagan ang mga user na mag-scrape ng data mula sa mga dynamic na website na nangangailangan ng paglahok ng user upang magpakita ng impormasyon. Ang AI-powered Extractor nito ay nagbibigay-daan sa mga user na mag-extract ng data sa ilang pag-click lang. Ang Extractor ay maaari ding tukuyin ang mga pattern ng data at kunin ang maihahambing na data mula sa maraming mapagkukunan.

Maaaring i-automate ng mga user ang kanilang mga pagsusumikap sa pag-scrape at makatanggap ng mga madalas na update sa data na gusto nila kasama ang mga komprehensibong feature ng pag-iiskedyul nito. Pinapasimple ng Import.io na gamitin ang na-extract na data sa ibang mga app sa pamamagitan ng pagpayag sa iyong mag-link sa mga sikat na tool gaya ng Google Sheets at Zapier.

pagpepresyo

Ang pagpepresyo ay hindi nakalista sa website, mangyaring makipag-usap sa isang eksperto tungkol dito.

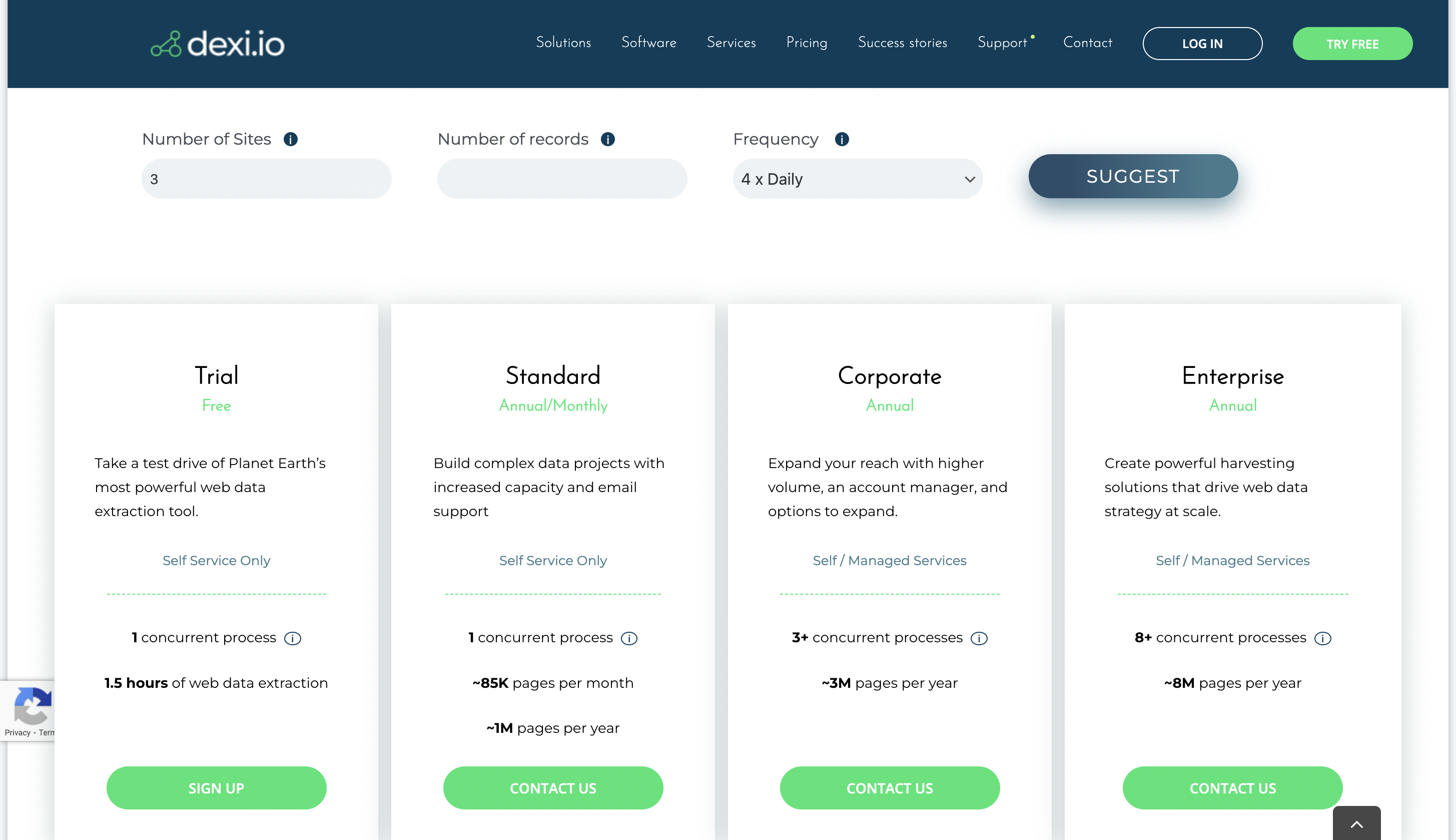

10. Dexi.io

Ang pagkuha ng data ay simple sa tulong ng mahusay na tool sa web scraping na Dexi.io. Maaari kang mangalap ng data mula sa mga website gamit ang tool na ito nang walang anumang karanasan sa coding dahil sa user-friendly na interface at mga awtomatikong posibilidad nito.

Ang isa sa pinakamagagandang katangian nito ay ang kakayahang mag-scrape at pagsama-samahin ang data mula sa maraming source, kabilang ang mga web page, API, at database. Salamat sa parallel processing na kakayahan ng Dexi.io, maaari mong mabilis at epektibong mag-scrape ng napakalaking volume ng data.

Nag-aalok sa iyo ang Dexi.io ng pagpipilian upang piliin ang pinakamahusay na alternatibo para sa iyong mga pangangailangan sa pag-scrape dahil ito ay gumagana bilang parehong walang ulo na browser at isang headful browser. Bagama't binibigyang-daan ka ng opsyon sa headful browser na makita at makipag-ugnayan sa website na parang gumagamit ka ng karaniwang browser, pinapayagan ka ng opsyong walang ulo na browser na mag-scrape ng data nang hindi ipinapakita ang page sa isang browser.

Ginagawa nitong simple upang ayusin ang anumang mga problema sa pag-scrape at ayusin ang pamamaraan ng pag-scrape sa iyong mga kagustuhan. Mabilis kang makakapag-export ng na-scrap na data mula sa Dexi.io sa iba't ibang mga format, gaya ng CSV, JSON, at Excel, para sa karagdagang pagsusuri o pakikipag-ugnayan sa ibang mga application.

Bukod pa rito, nagbibigay ito ng maaasahan at secure na cloud hosting para sa iyong na-scrap na data, na ginagarantiyahan ang seguridad at accessibility nito.

pagpepresyo

Maaari mong subukan ang platform gamit ang libreng trial plan nito at makipag-ugnayan sa team para sa pagpepresyo nito.

Konklusyon

Sa konklusyon, mayroong ilang mga solusyon sa web scraping sa merkado, bawat isa ay may partikular na mga pakinabang at kakayahan. Maraming mga alternatibong data ang pipiliin, mula sa mga all-in-one na solusyon tulad ng Bright Data at ScrapingBee hanggang sa mas espesyal na mga tool tulad ng Apify at ParseHub.

Ang mga system na ito ay kadalasang may mga kakayahan tulad ng walang ulo na pagba-browse, pag-ikot ng IP, panggagaya ng user-agent, at fingerprinting ng browser upang mapataas ang pagiging epektibo, pagiging maaasahan, at pagiging lihim ng online scraping.

Ang mga tool sa pag-scrape sa web ay maaaring magbigay sa iyo ng mabilis at simpleng access sa maraming impormasyon, kung ikaw ay isang maliit na may-ari ng negosyo na sumusubok na imbestigahan ang iyong mga kakumpitensya, isang mananaliksik na naghahanap ng data upang suportahan ang iyong trabaho, o isang data analyst na naghahanap ng mga insight sa gawi ng consumer .

Ang posibilidad ng mga pagkakamali at hindi pagkakapare-pareho ay maaaring mabawasan habang maaari kang makatipid ng oras at pera sa pamamagitan ng pag-automate ng proseso ng pagkolekta ng data.

Mag-iwan ng Sagot