Talaan ng nilalaman[Tago][Ipakita]

Ang pag-scrape sa web ay naging isang mahalagang tool sa lipunang hinihimok ng data ngayon kung saan ang kaalaman ay kapangyarihan. Siguradong narinig mo na ang mga platform sa pag-scrape ng web na nakabatay sa browser.

Talakayin natin ngayon ang mga platform ng web scraping na nakabatay sa browser. Nag-aalok ang mga system na ito ng madali at mabilis na paraan upang kunin ang data mula sa mga website nang hindi gumagamit ng kumplikadong code o espesyal na kaalaman. Nagbibigay ang mga ito ng mga direktang tool at user-friendly na mga interface na nagpapasimple sa proseso ng pag-scrape.

Ang kagandahan ng browser-based system ay ang paggawa nila web scraping naa-access sa lahat, mula sa mga baguhan hanggang sa mga espesyalista. Ginagawang available ng mga solusyong nakabatay sa browser ang online scraping sa lahat, maging mga mananaliksik man sila na nagsusuri ng mga pattern, may-ari ng kumpanyang sumusubok na manood ng mga karibal, o mga indibidwal na naghahanap ng impormasyon.

Mayroong ilang mga pakinabang sa paggamit ng mga solusyon na nakabatay sa browser para sa web scraping.

Sa unang lugar, inaalis nila ang pangangailangan para sa teknikal na kadalubhasaan, na ginagawang simple para sa sinuman na mag-scrape ng data mula sa mga website. Ang mga system na ito ay madalas na may kasamang point-and-click na mga kakayahan at graphic mga interface ng gumagamit, na nagbibigay-daan sa mga user na madaling makipag-ugnayan sa mga website at piliin ang data na gusto nilang kunin.

Ang proseso ng pag-scrape ay na-streamline at ang mahalagang oras ay na-save sa pamamagitan ng kakayahang magamit ng mga solusyong nakabatay sa browser ng mga kakayahan tulad ng data validation, automation, at scheduling. Madalas din silang may malalakas na proxy network, na ginagarantiyahan ang maaasahan at ligtas na pagkuha ng data habang nilalampasan ang mga limitasyon o pagharang ng mga system.

Maaari mong harapin ang mahihirap na trabaho sa pag-scrape gamit ang mga teknolohiyang nakabatay sa browser, kunin ang data mula sa mga dynamic na website, at gawing kapaki-pakinabang na mga insight ang nakuhang data. Sa pamamagitan ng pagkakaroon ng access sa yaman ng data na available online, binibigyang-daan nila ang mga organisasyon, mananaliksik, at tao na manatiling nangunguna sa mundong hinihimok ng data. Sa bahaging ito, titingnan natin ang pinakamahusay na mga platform ng web scraping na nakabatay sa browser.

1. Maliwanag na Data

Ang Bright Data ay isang maliwanag na bituin sa mga tool sa web scraping na nakabatay sa browser sa pamamagitan ng pag-aalok ng kumpletong tugon sa mga kahilingan sa web scraping ng mga customer. Sa pamamagitan ng paggamit ng pamamaraang nakabatay sa browser, binibigyang-daan ka ng Bright Data na mag-scrape ng mga website na may dynamic na nilalaman, pag-render ng JavaScript, at masalimuot na arkitektura ng pahina upang matiyak na ang lahat ng mahalagang data ay nakolekta.

Gamit ang Scraping Browser ng Bright Data, madali kang makakapag-browse at makakapag-navigate sa mga target na website habang pinamamahalaan ng Bright Data ang buong proxy at i-unblock ang imprastraktura sa ngalan mo. Ang kapangyarihan ng mga kakayahan ng awtomatikong pag-unlock ng Web Unlocker ay isinama sa Scraping Browser, isang awtomatikong browser na idinisenyo para sa pag-scrape ng data.

Ang anumang proyekto sa pag-scrape ng data na nangangailangan ng scalability, mga browser, at awtomatikong kontrol sa lahat ng aktibidad sa pag-unblock ng website ay perpekto para sa paggamit nito. Ito ay nagiging isang madaling ibagay na tool para sa pag-automate ng mga operasyon at pagkuha ng data mula sa mga website sa pamamagitan ng paggamit ng Scraping Browser, Puppeteer, at Playwright API.

Kapag nagtatrabaho sa malaking halaga ng data, ang kakayahang ito ay lubhang madaling gamitin. Panghuli ngunit hindi bababa sa, ang Bright Data ay naglagay ng mga paraan ng anti-blocking na nagbibigay-daan sa iyong malampasan ang mga bagay tulad ng mga CAPTCHA at iba pang uri ng pag-block sa website.

Ang malawak nitong proxy network, na binubuo ng higit sa 72+ milyong residence IP at 2 milyong mobile IP mula sa buong mundo at nag-aalok ng walang kaparis na saklaw at pagiging maaasahan para sa web scraping, ay isa sa mga pinakanatatanging katangian nito.

Bilang karagdagan, ito ay katugma sa isang bilang ng programming languages, kabilang ang Python, Node.js, at Java, pati na rin ang malawakang ginagamit na data storage at analysis system, tulad ng AWS, Google Cloud, at BigQuery. Gamit ang Bright Data bilang iyong kaalyado sa pag-scrape ng web, maaari kang mag-scrape nang may katiyakan at pagiging epektibo at madaling i-unlock ang potensyal ng data.

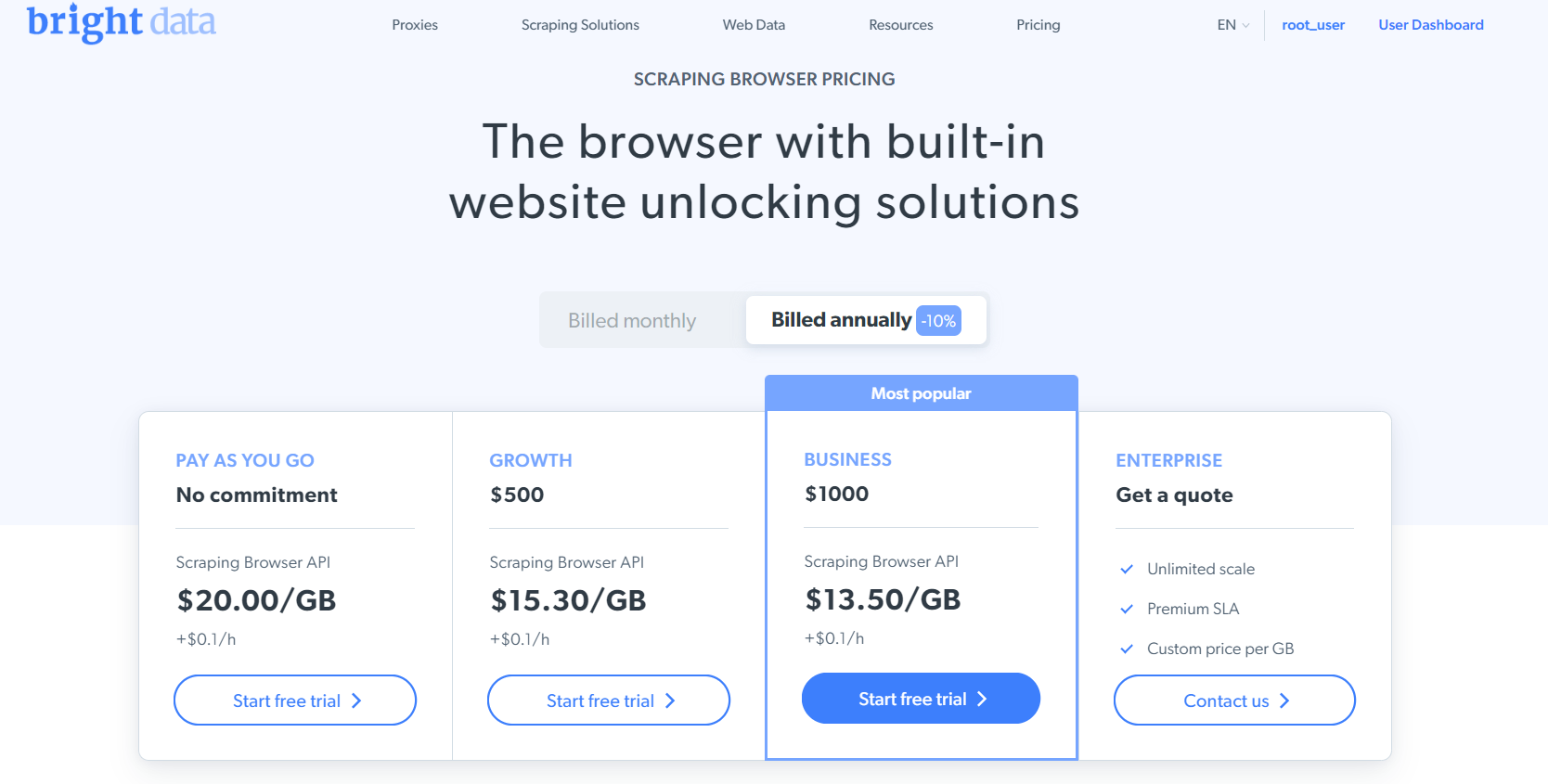

pagpepresyo

Ang ang pagpepresyo ay nagsisimula sa $13.50/GB.

2. Pugita

Ang Octoparse ay isang mainam na tool na nakabatay sa browser na eksklusibong nilikha para sa web scraping. Kahit na ang mga indibidwal na walang kasanayan sa coding ay maaaring magkaroon ng maayos na karanasan sa pag-scrape dito.

Madali kang makakakolekta ng data mula sa mga website gamit ang user-friendly na visual scraping tool nito. Hindi na kailangang matuto ng masalimuot na coding o scripting na mga wika. Sa pamamagitan ng pagpayag sa iyong direktang makipag-ugnayan sa website at piliin ang mga piraso ng data na gusto mong kunin, pinapasimple ng Octoparse ang pamamaraan.

Ito ay katulad ng pagbibigay ng virtual na kamay upang matulungan kang maghanap sa web at mahanap ang impormasyong gusto mo. Gayunpaman, higit pa sa pagkuha ng data ang ginagawa ng Octoparse. Mahusay din ito sa mga kakayahan para sa pagbabago at paglilinis ng data.

Kapag na-scrap na ang data, binibigyan ka ng Octoparse ng kakayahang i-format at pahusayin ito alinsunod sa iyong mga natatanging pangangailangan. Upang gawing mas mahalaga at naaaksyunan ang data, maaari mong linisin ang nakalilitong data, alisin ang mga duplicate, at kahit na magsagawa ng mga kumplikadong pagbabago.

Sa Octoparse, mayroon kang kakayahang pamahalaan ang bawat yugto ng lifecycle ng data, kabilang ang pagkuha, paglilinis, at pagbabago, lahat ay gumagamit ng isang simpleng interface na nakabatay sa browser. Nang hindi nangangailangan ng teknikal na kaalaman, maaari kang pumasok sa mundo ng pag-scrape ng web gamit ang Octoparse sa iyong tabi, tumutuklas ng mga hindi mabibiling insight at magagamit ang kapangyarihan ng data.

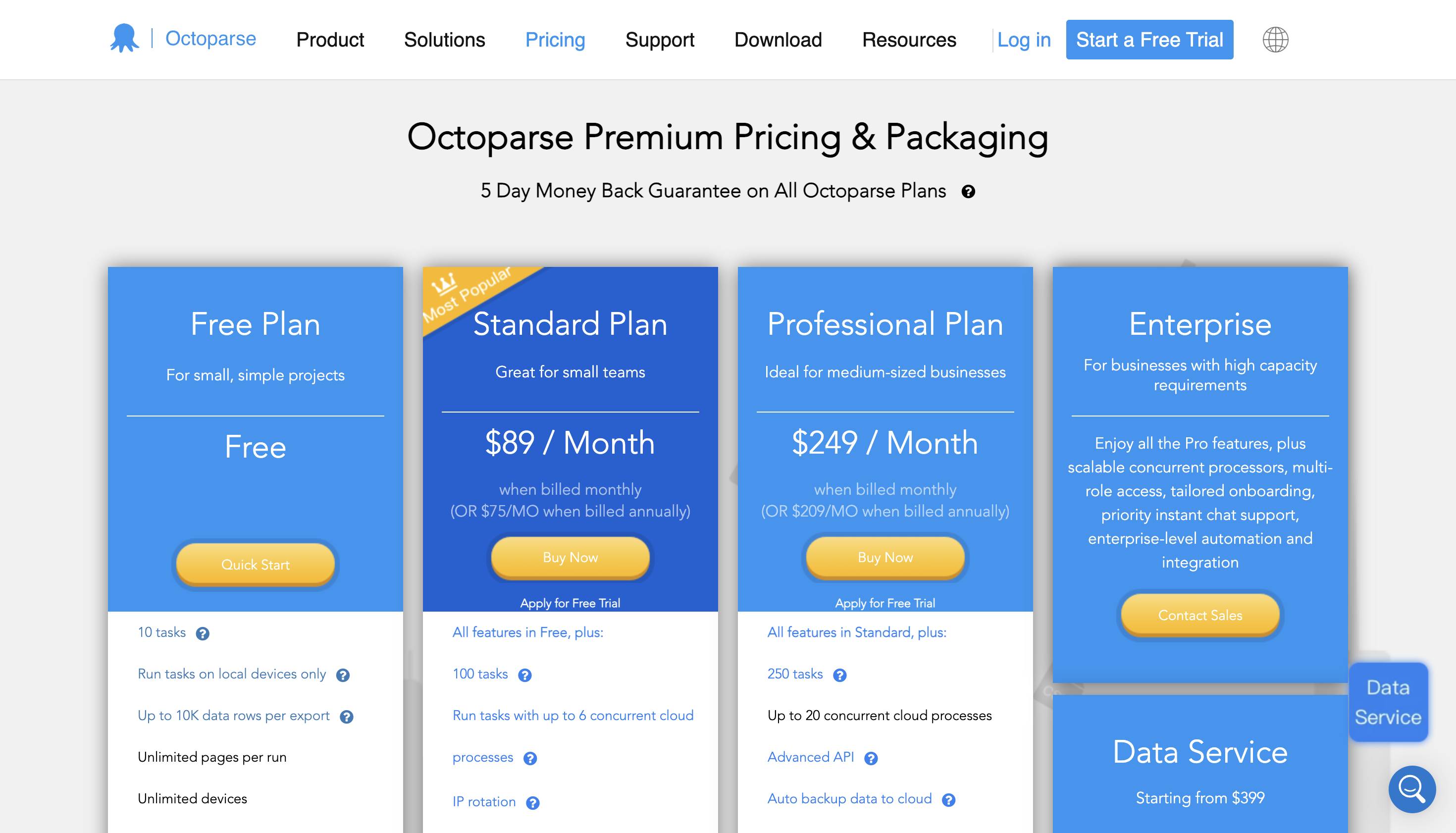

pagpepresyo

Maaari mong simulang gamitin ito nang libre at ang premium na pagpepresyo ay magsisimula sa $89/buwan.

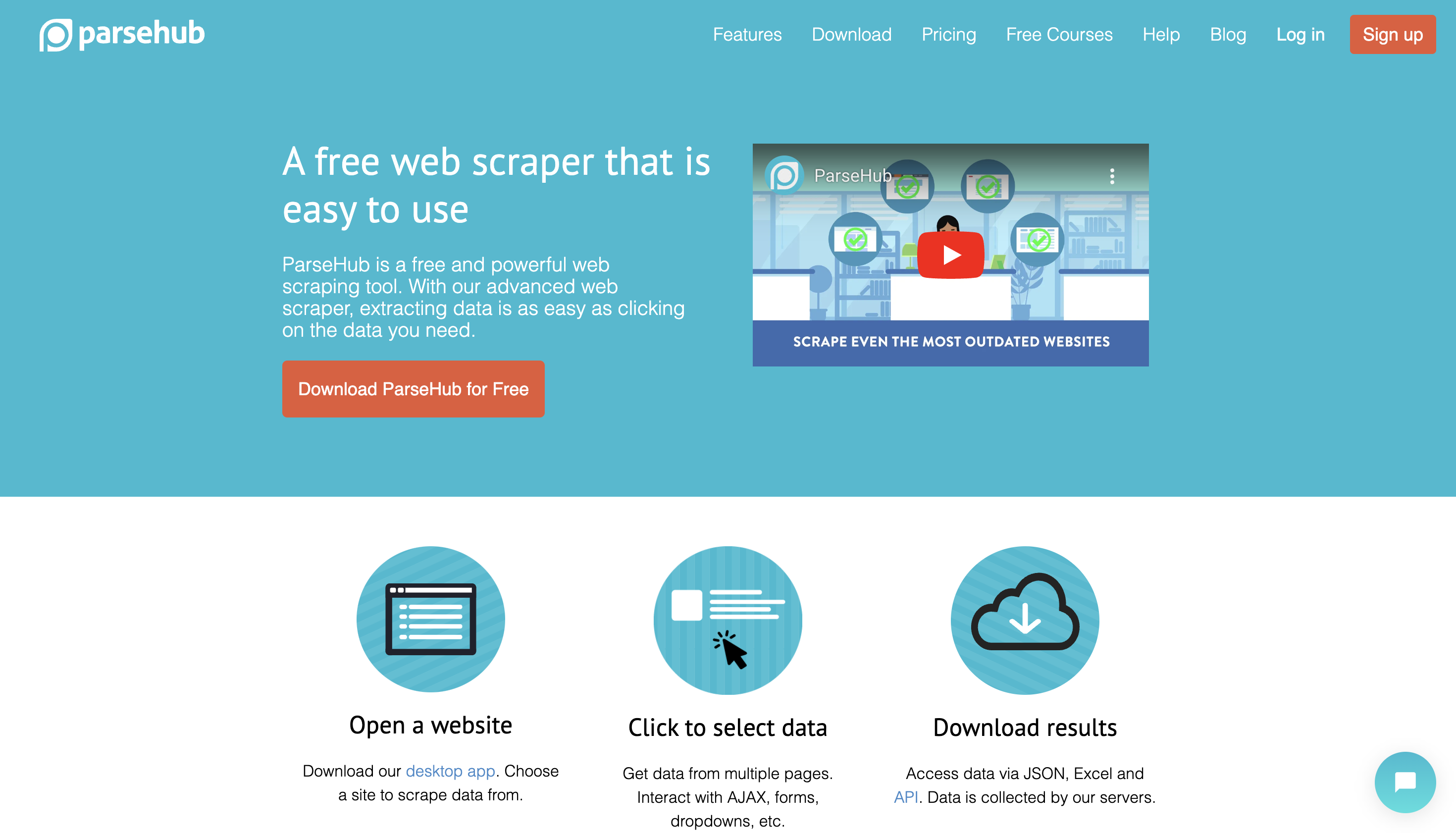

3. ParseHub

Ang ParseHub ay isang platform na makakayanan ang lahat ng iyong mga pangangailangan sa pag-scrape at napaka-flexible at madaling gamitin. Sinasaklaw ka ng ParseHub kung baguhan ka man o ekspertong mahilig sa data. Ang natatanging tampok ng ParseHub ay ang simpleng point-and-click na interface nito, na ginagawang mas madali ang proseso ng pagkolekta ng data mula sa mga dynamic na website.

Ang mga kumplikadong web page ay maaaring i-navigate nang hindi isang ekspertong coder. Para mag-extract ng data, piliin lang ang gustong data, at ang ParseHub ang hahawak sa iba. Ito ay tulad ng pagkakaroon ng iyong sariling personal na katulong para sa pagkuha ng data. Ngunit nag-aalok ang ParseHub ng mas sopistikadong mga opsyon para dalhin ang iyong pag-scrape sa susunod na antas.

Maaari mong i-automate ang proseso ng pag-scrape sa pamamagitan ng paggamit ng naka-iskedyul na pag-scrape, na nagbibigay-daan sa ParseHub na kunin ang data sa mga paunang natukoy na agwat, na tinitiyak na palagi kang mayroong pinakabagong impormasyon.

Higit pa rito, nag-aalok ang ParseHub ng tuluy-tuloy na koneksyon sa API, na ginagawang simple para sa iyo na isama ang na-scrap na data sa sarili mong mga programa o system. Ito ay isang mabisang pamamaraan upang i-optimize ang paggamit ng iyong na-extract na data at pagbutihin ang daloy ng trabaho ng iyong data.

Nagiging masaya at mabisang proseso ang pag-scrape sa web gamit ang user-friendly na interface ng ParseHub at malakas na functionality, na madaling nagpapakita ng mga kapaki-pakinabang na insight mula sa mga dynamic na web page.

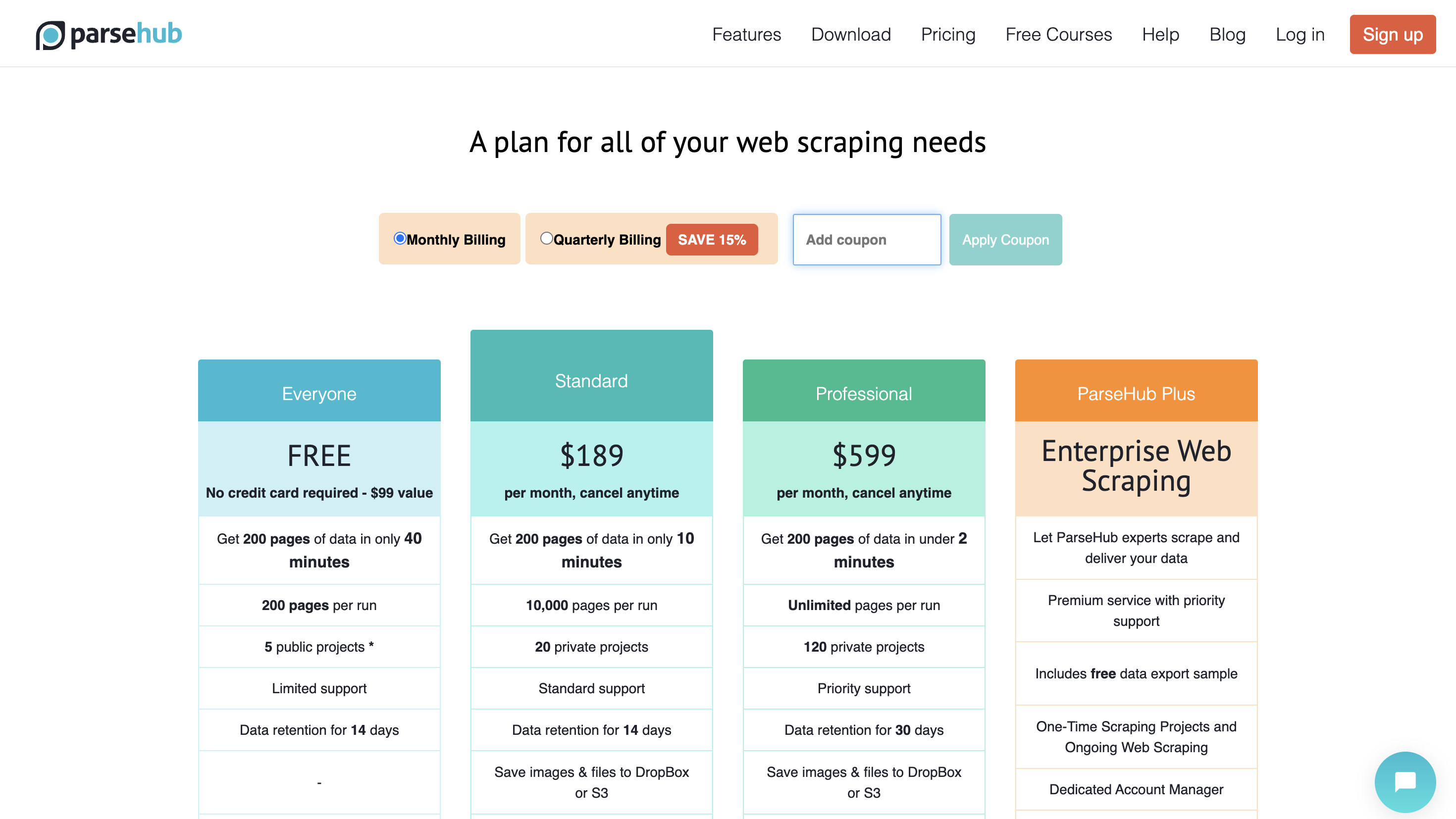

pagpepresyo

Maaari mong simulang gamitin ito nang libre at ang premium na pagpepresyo ay magsisimula sa $189/buwan.

4. Webz.io

Webz.io – Ang Big Web Data ay isang kahanga-hangang teknolohiyang nakabatay sa browser na nakatutok sa pagkuha at pagsubaybay sa web data. Madali kang makakakuha ng insightful data online sa pamamagitan ng paggamit ng Webz.io para panatilihin ang iyong daliri sa pulso ng web. Ang platform na ito ay isang informational na minahan ng ginto, na nagbibigay ng malalim na saklaw ng mga balita, piraso ng blog, at online na pag-uusap sa iba't ibang paksa.

Tinitiyak ng Webz.io na mayroon kang access sa pinakabago at mahalagang impormasyon mula sa buong web, anuman ang iyong negosyo o kadalubhasaan. Ito ay maihahambing sa pagkakaroon ng access sa isang malaking aklatan ng kaalaman. Gayunpaman, ang Webz.io ay higit pa sa saklaw ng data.

Bukod pa rito, nag-aalok ito ng maayos na koneksyon sa API, na ginagawang simple para sa iyo na isama ang nakuhang data sa sarili mong mga programa o system. Sa kakayahang ito, maraming pagkakataon na gamitin ang data sa mga paraan na pinakamahusay na nakakatugon sa iyong mga pangangailangan.

Pinapasimple ng koneksyon sa Webz.io API ang proseso ng pagsasama ng data kung gumagawa ka man ng custom na dashboard, nagsasagawa ng market research, o gumagawa ng solusyon na pinapagana ng AI.

Webz.io – Ang user-friendly na interface ng Big online Data at ang malakas na kakayahan sa pagsubaybay at pagkuha ng data ay nagbibigay sa iyo ng kapasidad na manatiling nangunguna sa curve at gamitin ang online na data sa buong saklaw nito para sa iyong trabaho sa isang kumpanya o pananaliksik.

pagpepresyo

Mangyaring makipag-ugnayan sa vendor para sa pagpepresyo nito.

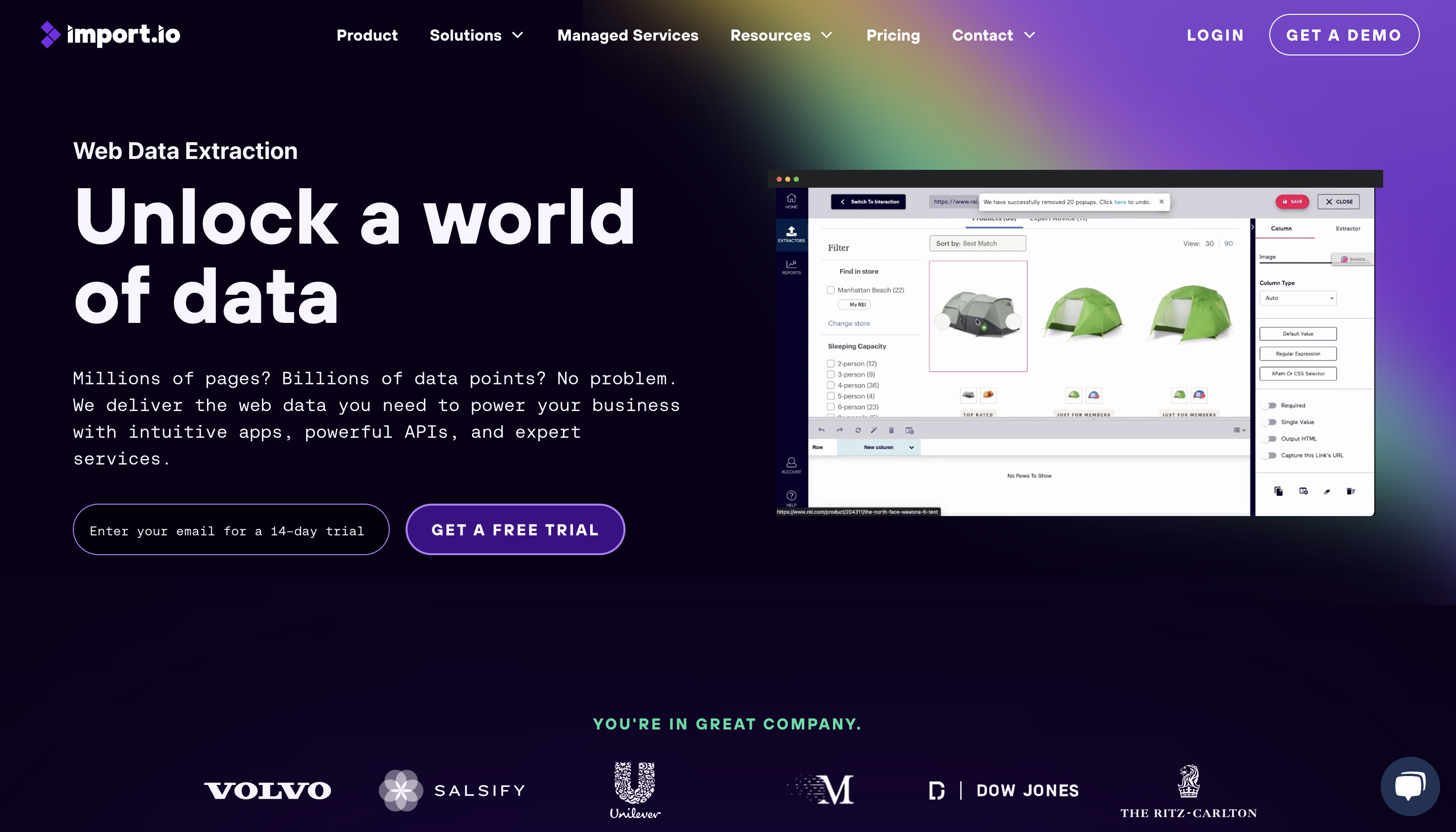

5. import.io

Ang Import.io ay isang kahanga-hangang tool na nakabatay sa browser na, kasama ang simpleng point-and-click na interface nito, ay inaalis ang kahirapan sa online scraping. Ang pag-scrape ng web ay simple sa import.io, anuman ang antas ng iyong kadalubhasaan sa data. Madali kang makakapag-extract ng data mula sa mga website na may kaunting pag-click lamang at walang anumang teknikal na karanasan.

Ito ay tulad ng pagkakaroon ng isang magic wand upang ipunin ang data na gusto mo mula sa malaking web. Ngunit higit pa riyan ang import.io. Sa pamamagitan ng sopistikadong teknolohiya sa pag-crawl, nagpapatuloy ito nang higit pa.

Maaari na ngayong matuklasan ng Import.io mga kaayusan ng data at mga pattern sa mga webpage, na nagpapataas sa kahusayan at katumpakan ng proseso ng pag-scrape sa internet. Ito ay tulad ng pagkakaroon ng data detective na pamilyar sa layout ng website at mabilis at madaling mangolekta ng naaangkop na data.

Ang na-scrap na data ay maaari ding i-export sa iba't ibang mga format at program salamat sa malawak na kakayahan sa pagsasama ng data ng import.io. Maaaring ibigay ng Import.io ang data sa mga format na CSV, Excel, o JSON na gusto mo. Ang nakuhang data ay maaaring isama lamang sa iyong mga database, analytical program, o kahit na mga komersyal na aplikasyon.

Ginagawang simple ang pag-scrape sa web gamit ang import.io, na nagbibigay-daan sa iyong makakuha ng insightful na impormasyon at i-optimize ang iyong mga operasyong batay sa data.

pagpepresyo

Maaari mong gamitin ang platform kasama ang 14 na araw na libreng pagsubok nito at ang premium na pagpepresyo ay nagsisimula sa $199/buwan.

6. Dexi.io

Ang Dexi.io ay isang makabagong platform na maaaring magamit sa isang browser at nagbibigay ng buong hanay ng mga pagpipilian sa pag-scrape ng web. Gamit ang simpleng visual editor at point-and-click na user interface, ginagawang accessible ng Dexi.io ang web scraping sa mga user ng lahat ng antas ng teknikal na karanasan. Upang makabisado ang mga kumplikado ng web scraping, hindi mo kailangang maging isang coding genius.

Pinapasimple ng Dexi.io ang pagbuo ng mga scraping bot na mabilis at tumpak na nag-scrape ng data mula sa mga web page. Ito ay katulad ng pagkakaroon ng virtual assistant na nangangasiwa sa lahat ng matrabahong gawain.

Ang Dexi.io ay higit pa sa simpleng pagkuha ng data. Ang pagpapayaman ng data, isa sa mga mas sopistikadong kakayahan nito, ay nagbibigay-daan sa iyong pagbutihin ang nakuhang data sa pamamagitan ng pagdaragdag ng higit pang mga detalye mula sa iba pang mga mapagkukunan. Bilang resulta, magiging mas insightful at kumpleto ang iyong pagsusuri.

Bukod pa rito, maaari mong i-export ang data na na-scrap gamit ang Dexi.io sa iba't ibang mga format, kabilang ang CSV, Excel, o JSON. Pinapasimple ng Dexi.io na makuha ang data na kailangan mo para sa pagsasama sa ibang mga system o para sa karagdagang malalim na pananaliksik.

Ang Dexi.io ay nagbibigay pa ng API connectivity, na nagbibigay-daan sa iyong mabilis na kumonekta at isama ang data na na-scrap sa sarili mong software o mga system. Maaari mong i-automate ang mga pamamaraan at i-maximize ang paggamit ng nakuhang data dahil nag-aalok ito ng maayos na daloy ng trabaho.

pagpepresyo

Maaari mong subukan ang platform gamit ang libreng trial plan nito at mangyaring makipag-ugnayan sa vendor para sa premium na pagpepresyo nito.

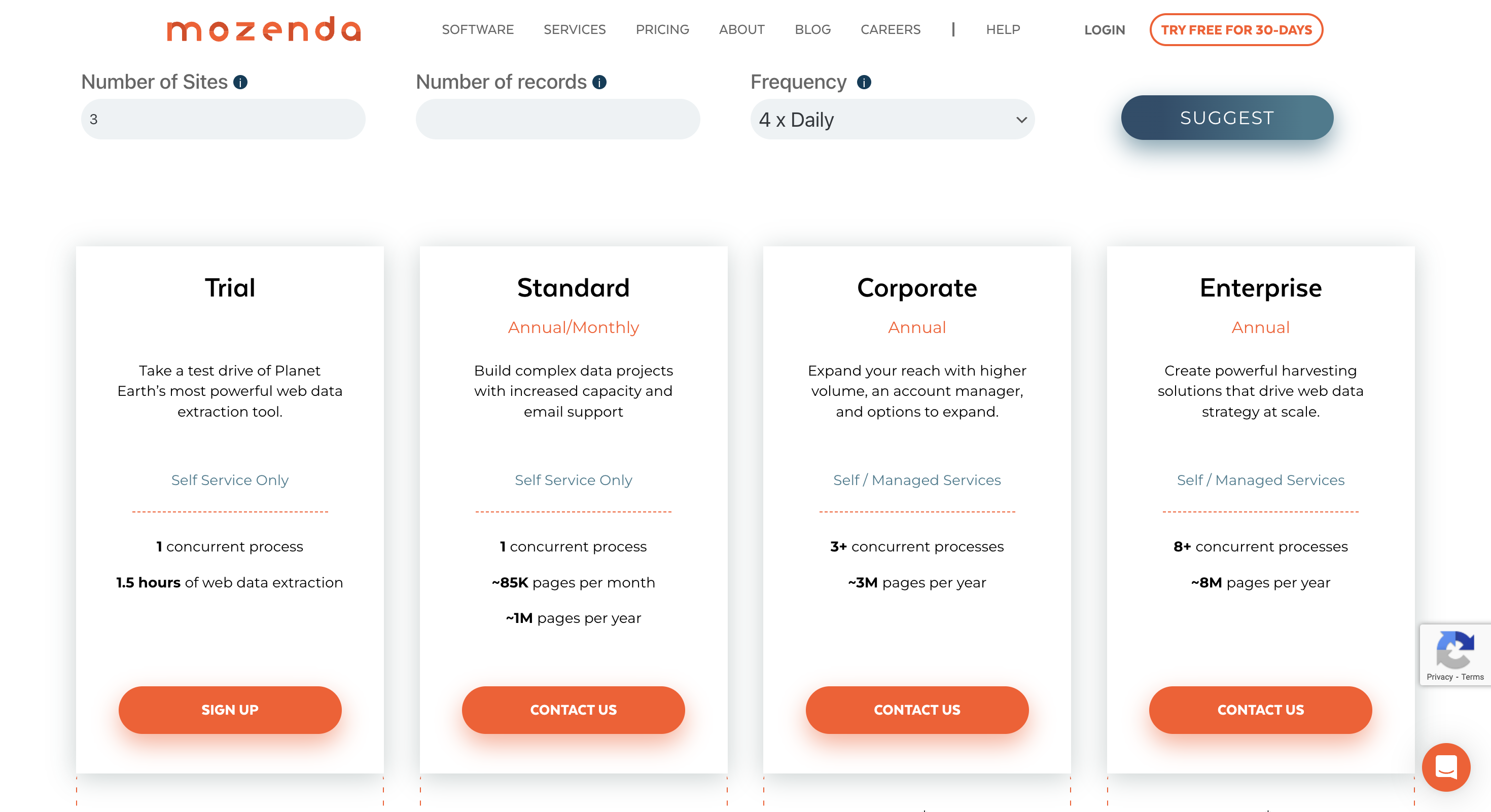

7. Mozenda

Ang Mozenda ay isang top-notch web scraping tool na nagbibigay ng mga automated at browser-based na mga opsyon sa scraping. Ang interface ng user-friendly at matatag na kakayahan ng Mozenda ay ginagawang mas simple ang proseso ng pagkuha ng data mula sa mga website.

Gamit ang point-and-click na user interface nito, ginagawang simple ng Mozenda ang pag-navigate sa mga website. Walang kaalaman sa coding? hindi isyu. Nangangailangan ka man ng mga review ng customer, mga detalye ng produkto, o anumang iba pang data, binibigyan ka ng Mozenda ng kapangyarihan upang mabilis na piliin ang mga item ng data na gusto mong kunin.

Ito ay tulad ng pagkakaroon ng isang virtual na katulong na alam ang iyong mga kinakailangan sa pag-scrape. Ang Mozenda ay hindi tumitigil doon. Maaari mong i-automate ang proseso ng pag-scrape at mag-extract ng data sa ilang partikular na agwat salamat sa pag-iskedyul, isa sa mga mas sopistikadong kakayahan nito.

Sinasaklaw ka ng Mozenda kung kailangan mo ng pang-araw-araw, lingguhan, o buwanang pag-update. Bukod pa rito, nag-aalok ang Mozenda ng tuluy-tuloy na mga opsyon sa pag-export ng data na nagbibigay-daan sa iyong i-save ang data na na-scrap mo sa ilang uri ng file kabilang ang Excel, CSV, o XML. Ang nakuhang data ay madaling maisama sa iyong mga analytical na programa o database.

Ang na-scrap na data ay maaaring dagdag na konektado at maisama sa sarili mong mga app o system salamat sa serbisyo ng pagsasama ng API ng Mozenda. Nag-aalok ito ng mahusay na daloy ng trabaho, na nagbibigay-daan sa iyong i-automate ang mga pamamaraan at i-maximize ang paggamit ng nakuhang data.

pagpepresyo

Maaari mong subukan ang platform gamit ang libreng trial plan nito at mangyaring makipag-ugnayan sa vendor para sa premium na pagpepresyo nito.

8. Pag-scraping Bee

Mas madaling mangalap ng data mula sa mga website gamit ang ScrapingBee, isang kahanga-hangang browser-based web scraping application. Gamitin ang kapangyarihan ng pag-scrape ng web gamit ang ScrapingBee at iwasan ang pasanin ng pamamahala sa imprastraktura.

Madali kang makakapagsumite ng mga query at makakuha ng data na na-scrap salamat sa intuitive na API nito. Pinapasimple ng ScrapingBee API ang pagkuha ng anumang uri ng data, kabilang ang impormasyon ng produkto, mga artikulo ng balita, at iba pang uri.

Gayunpaman, mas nagpapatuloy ang ScrapingBee. Mayroon itong mga tampok na higit pa sa simpleng web scraping. Mayroon itong mga kakayahan sa pag-render ng JavaScript, na nagbibigay-daan sa iyong mag-scrape ng impormasyon mula sa mga website na pangunahing umaasa sa JavaScript para sa presentasyon ng nilalaman. Tinitiyak nito na kahit na mula sa mga dynamic na web page, maaari kang pumasok at makuha ang buong nilalaman.

Bukod pa rito, pinangangalagaan ng ScrapingBee ang mga CAPTCHA para sa iyo, na inililigtas sa iyo ang nakakaubos ng oras na gawain sa paglampas sa mga nakakainis na hadlang na iyon.

Awtomatiko nitong nireresolba ang mga CAPTCHA para makapag-concentrate ka sa pagkuha ng impormasyong gusto mo. Bukod pa rito, nag-aalok ang ScrapingBee ng mga IP rotator upang panatilihing pribado at i-unblock ng mga website ang iyong mga operasyon sa pag-scrape. Binabago nito ang mga IP address, ginagawa itong hamon para sa mga website na subaybayan ka at magpataw ng mga paghihigpit sa pag-access.

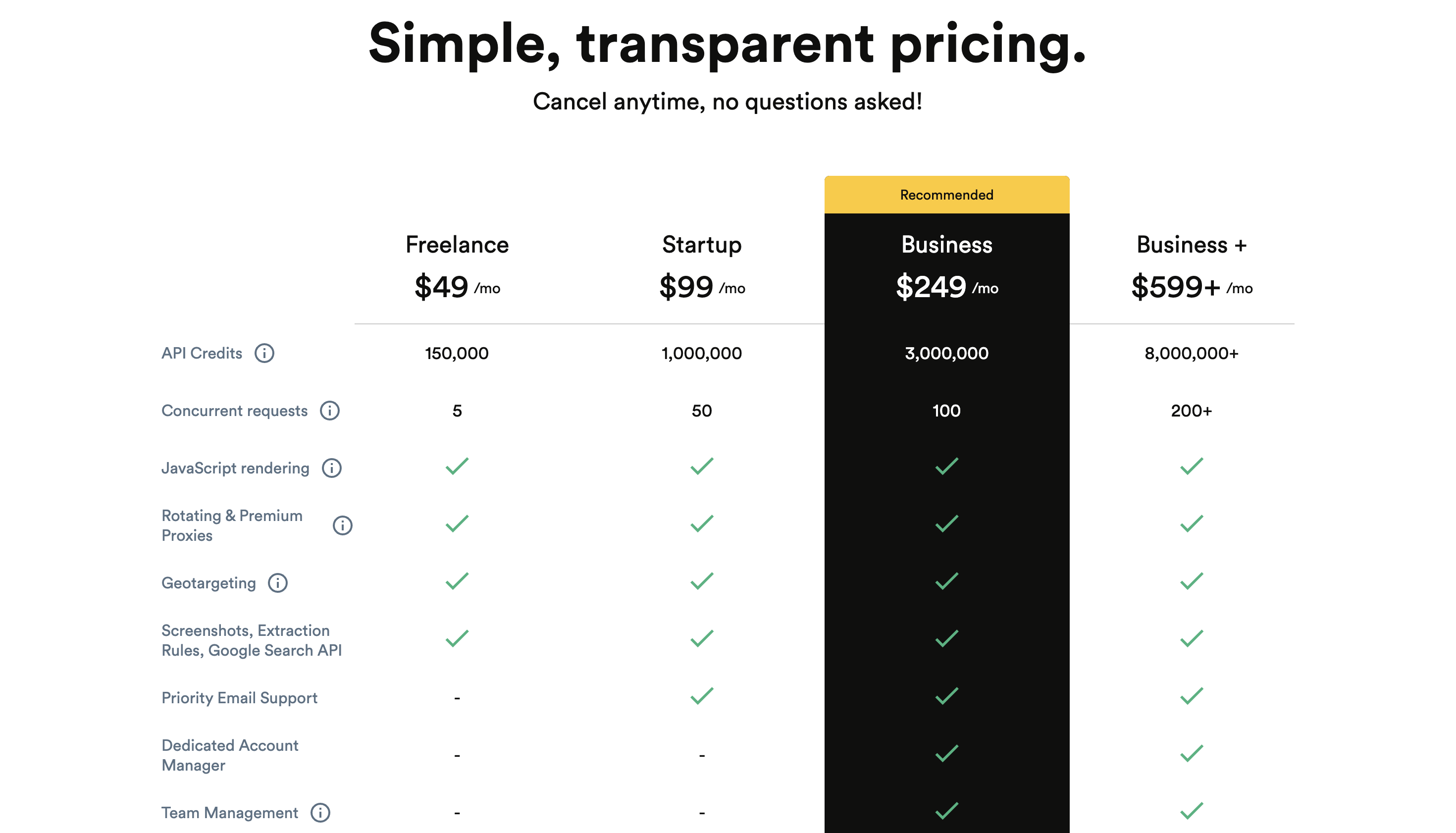

pagpepresyo

Ang premium na pagpepresyo ay nagsisimula sa $49/buwan.

9. Apify

Ang Apify ay isang matatag na cloud-based na platform na maaaring gamitin sa mga browser at may mga web scraping at automation function. Ang paggamit ng Apify ay magbibigay-daan sa iyong madaling i-automate ang mga prosesong nakakaubos ng oras at mabilis na kumuha ng data mula sa mga website, na magbibigay sa iyo ng mas maraming oras para sa iba pang mahahalagang gawain.

Nang hindi nangangailangan ng anumang code, ang mga sopistikadong sitwasyon sa pag-scrape ay maaaring mabilis na magawa gamit ang visual editor ng Apify. Ang website ay simpleng gamitin at may drag-and-drop na interface na ginagawang diretsong piliin ang data na kailangan mong i-scrape.

Sa arkitektura ng Apify, ang iyong mga trabaho sa pag-scrape ay maaaring i-set up at isagawa bilang mga serbisyong walang server. Ang imprastraktura at pagpapanatili ng server ay hindi na magiging alalahanin para sa iyo.

Ang Apify na ang bahala sa lahat. Ngunit paano kung hindi ka partikular na sanay sa pag-scrape? Walang alinlangan na walang isyu. Ang mga pre-built scraping actor, na mahalagang naka-configure at handa nang gamitin na mga proseso ng pag-scrape, ay magagamit para mabili sa Apify marketplace.

Para sa isang hanay ng mga website at mga kaso ng paggamit, gaya ng mga platform sa social networking at mga e-commerce na site, nag-aalok ang merkado ng daan-daang aktor. Bilang resulta, maaari mong gamitin ang mga handa nang gamitin na solusyon, na makakatipid sa iyo ng oras at pagsisikap.

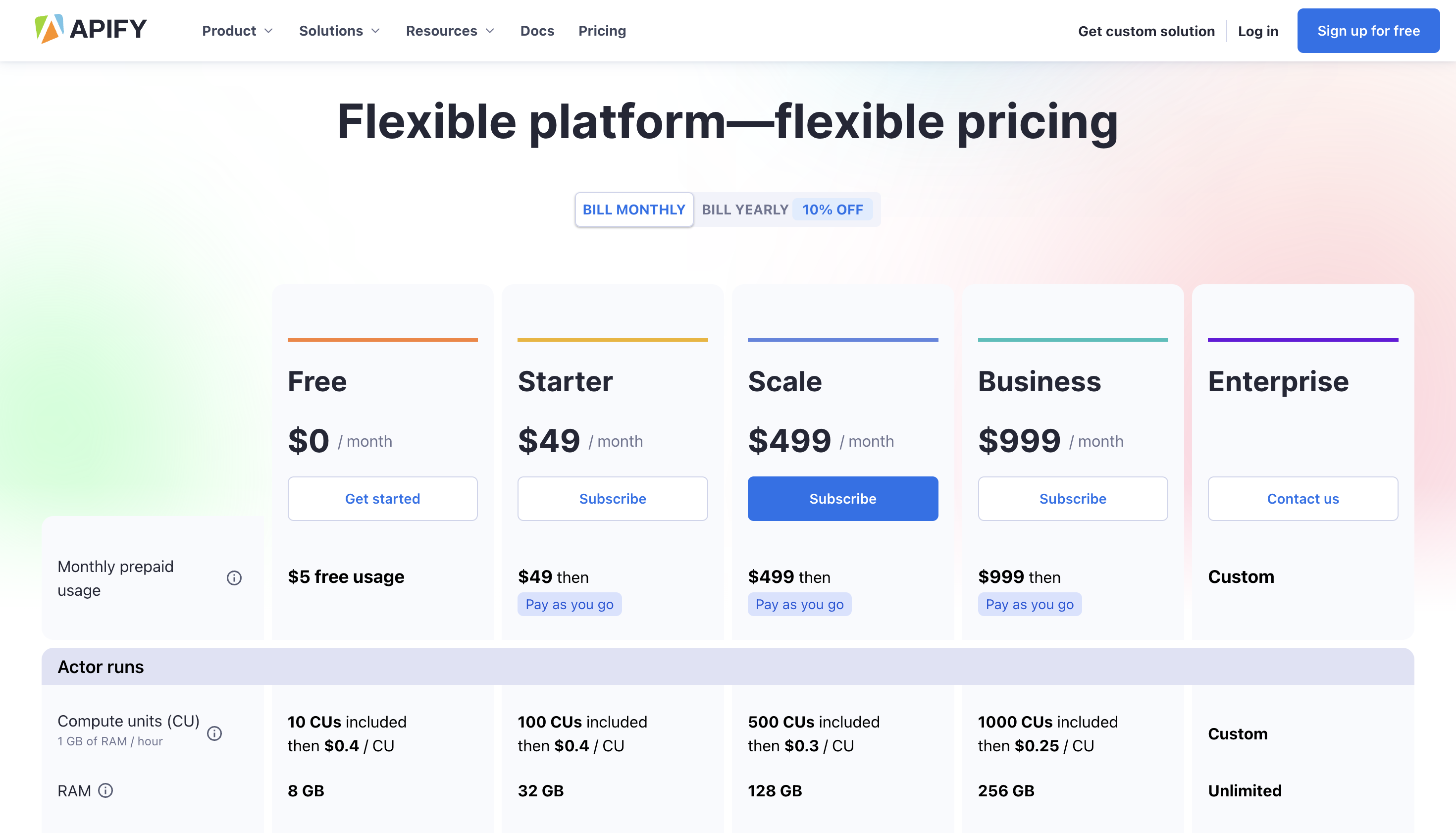

pagpepresyo

Maaari mong simulang gamitin ito nang libre at ang premium na pagpepresyo ay magsisimula sa $49/buwan.

10. ScrapingDog

Ang Scrapingdog ay isang malakas na browser-based na web scraping software. Nang walang kumplikadong code o pag-setup ng imprastraktura, mabilis at epektibong makakakolekta ka ng data mula sa mga website gamit ang Scrapingdog. Ito ay tulad ng pagkakaroon ng isang malakas na scraper sa iyong pagtatapon.

Ang mga pangunahing pag-andar ng Scrapingdog na nagpapasimple sa pag-scrape ng web ay nagtatakda nito na bukod sa mga kakumpitensya. Ang unang benepisyo ay nagbibigay ito ng user-friendly na interface na ginagawang simple ang pag-browse sa mga website at piliin ang data na kailangan mong kunin.

Anumang impormasyon ang kailangan mong i-scrape—impormasyon ng produkto, mga balita, o anumang bagay—nasaklaw mo ang Scrapingdog. Pangalawa, nag-aalok ang Scrapingdog ng matalinong pag-render ng JavaScript, na nagbibigay-daan sa iyong mag-scrape ng impormasyon mula sa mga website na pangunahing umaasa sa JavaScript upang magpakita ng nilalaman.

Tinitiyak nito na kahit na mula sa mga dynamic na web page, maaari mong ma-access at makuha ang buong nilalaman. Bukod pa rito, nagbibigay ang Scrapingdog ng pangangasiwa para sa mga CAPTCHA, na nag-aalaga sa mga nakakainis na hadlang para sa iyo.

Awtomatikong sinasagot nito ang mga CAPTCHA, na nakakatipid sa iyo ng oras at pagsisikap. Bukod pa rito, gumagamit ang Scrapingdog ng IP rotation, na kinabibilangan ng pagpapalit ng mga IP address, upang maiwasan ang mga website sa pagharang sa iyong mga operasyon sa pag-scrape. Dahil dito, ang pag-scrape ay magiging maayos.

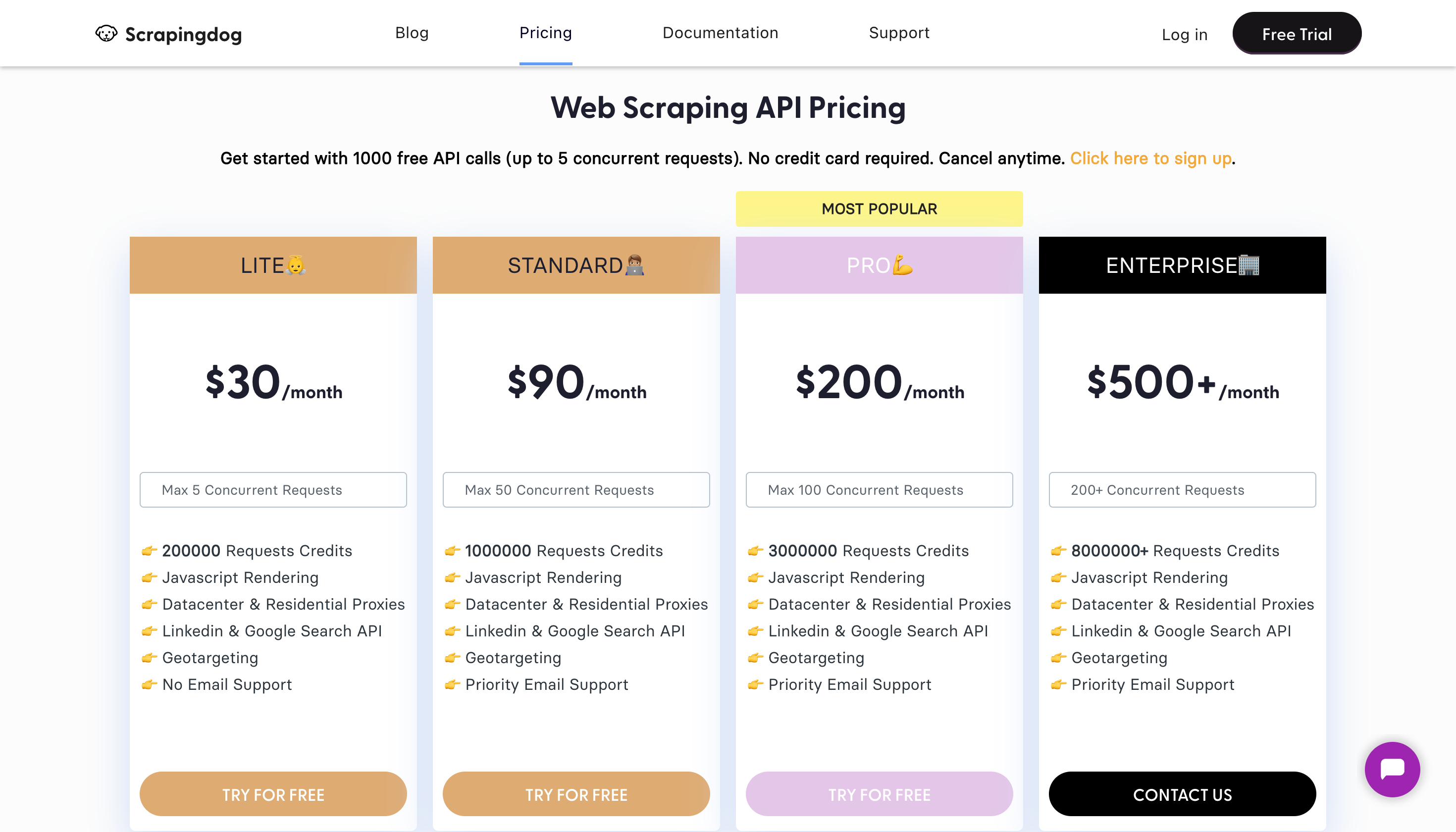

pagpepresyo

Ang premium na pagpepresyo ay nagsisimula sa $30/buwan.

11. Byteline

Ang Byteline ay isang mahusay na tool na nakabatay sa browser na eksklusibong nilikha para sa web scraping. Nang walang mahabang script o kumplikadong pag-setup, mabilis at madali mong makukuha ang data mula sa mga website gamit ang Byteline.

Nagbibigay ito ng user-friendly na interface na ginagawang simple para sa iyo na dumaan sa mga website at piliin ang data na gusto mong i-scrape. Matutulungan ka ng Byteline na makakuha ng anumang uri ng data, kabilang ang mga detalye ng presyo, mga testimonial ng kliyente, at iba pang impormasyon.

Ang mga dinamikong web page ay madaling hinahawakan nito. Maaari kang kumuha ng data mula sa mga website na higit na umaasa sa dynamic na nilalaman dahil pinangangasiwaan nito ang pag-render ng JavaScript sa tulong ng mga sopistikadong diskarte. Ipinahihiwatig nito na maaari mong makuha at i-scrape ang pinakabagong data na naa-access.

Higit pa rito, ang Byteline ay may makapangyarihang proxy at mga tampok na pag-ikot ng IP na hinahayaan kang mag-scrape nang malawakan nang hindi nakakasagabal sa anumang mga filter. Tinitiyak nito na ang iyong mga operasyon sa pag-scrape ay patuloy na walang hadlang at ganap na hindi nagpapakilala. Bukod pa rito, nagbibigay ang Byteline ng mga opsyon sa pag-export ng data na nagbibigay-daan sa iyong i-save ang nakuhang data sa ibang mga format tulad ng CSV o Excel para sa karagdagang pagsusuri o pagsasama ng system.

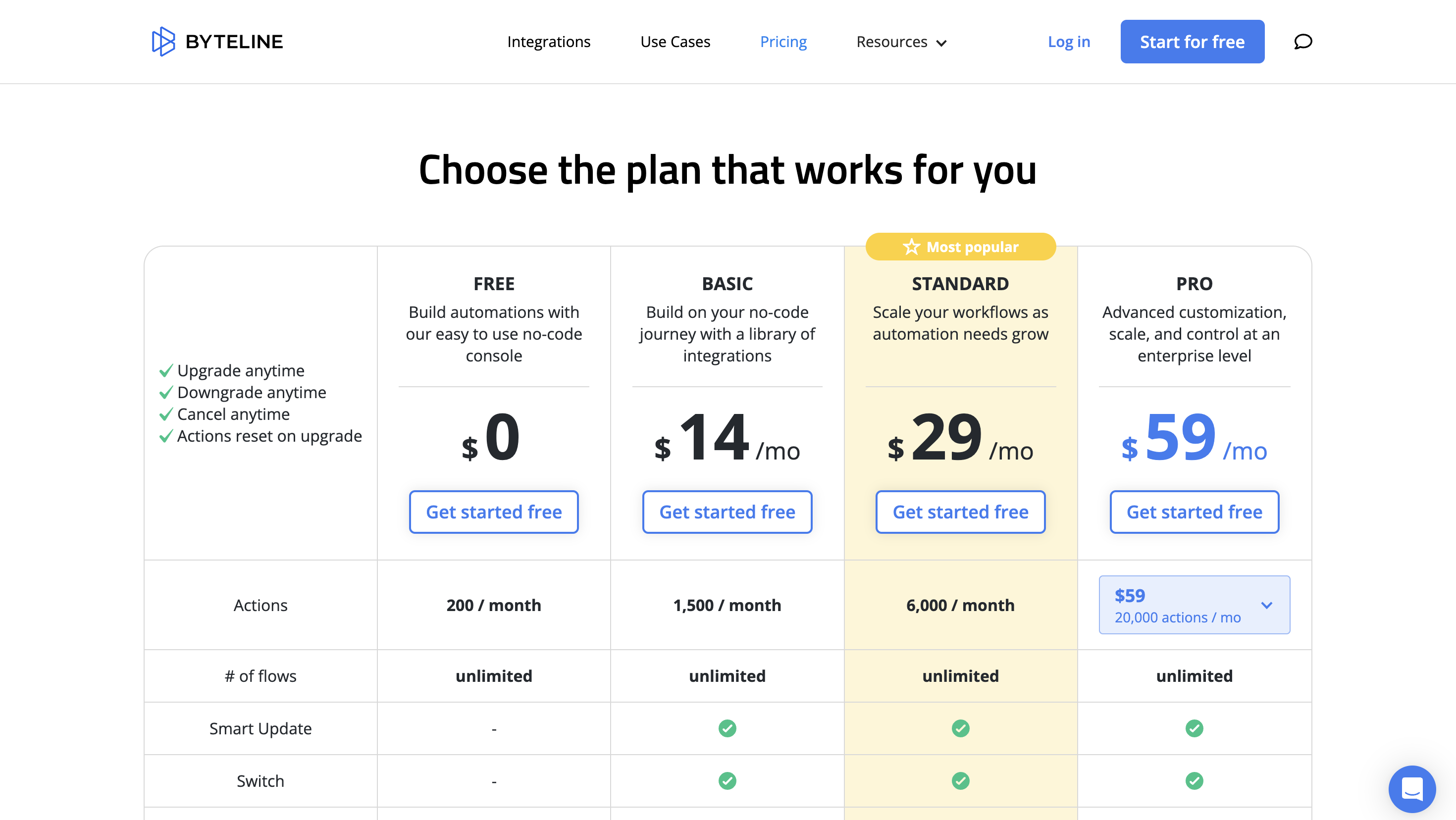

pagpepresyo

Maaari mong simulang gamitin ito nang libre at ang premium na pagpepresyo ay magsisimula sa $14/buwan.

12. Sinabi ni Grepsr

Ang Grepsr ay isang kahanga-hangang web scraping software na tumatakbo sa loob ng isang browser. Ang Grepsr ay isang kapaki-pakinabang na tool para sa parehong mga korporasyon at mananaliksik dahil binibigyang-daan ka nitong mahusay at madaling kumuha ng data mula sa mga website.

Hindi mo kailangang mag-alala tungkol sa masalimuot na code o pag-setup ng imprastraktura habang ginagamit ang Grepsr. Magagawa mong i-access at pamahalaan ang iyong mga proyekto sa pag-scrape mula sa anumang lokasyon na may koneksyon sa internet dahil mayroon itong cloud-based na disenyo.

Gumagamit ito ng mga sopistikadong teknolohiya sa online scraping, tulad ng matalinong pagkilala ng data at mga algorithm ng pag-parse, upang magarantiya ang tumpak at maaasahang pagkuha ng data. Ang Grepsr ay may mga kakayahan din sa pag-iskedyul, na nagbibigay-daan sa iyong i-automate ang pamamaraan ng pag-scrape at makakuha ng na-update na data sa mga paunang natukoy na agwat.

Bukod pa rito, sinusuportahan ang iba't ibang format ng pag-export ng data, gaya ng CSV, Excel, JSON, at XML, na nagbibigay-daan sa iyong kalayaang magtrabaho kasama ang data sa napili mong format.

Maaari kang mag-scrape ng data mula sa kahit na ang pinaka-dynamic na mga website dahil ito ay binuo upang pangasiwaan ang mga kumplikadong web page, kabilang ang mga may JavaScript-based na pag-render ng nilalaman.

pagpepresyo

Mangyaring makipag-ugnayan sa vendor para sa pagpepresyo nito.

13. ProWebScraper

Ang ProWebScraper ay isang user-friendly na browser-based na teknolohiya sa web scraping na nagbibigay-daan sa mga user na mabilis at simpleng kumuha ng data mula sa mga website. Maaaring kunin ng mga user ang data gamit ang point-and-click na interface nito nang hindi kinakailangang sumulat ng anumang code.

Bilang karagdagan, ang platform ay may matalinong tool sa pagkuha ng data na maaaring makilala at kunin ang data mula sa masalimuot na mga website. Nag-aalok din ang ProWebScraper ng mga pasadyang scraper para sa mga website na nangangailangan ng sopistikadong pagkuha ng data. Ang pagkuha ng data mula sa mga website na nangangailangan ng pag-log in ay isang lakas ng ProWebScraper.

Pagkatapos ipasok ang kanilang impormasyon sa pag-log in, ang mga indibidwal ay makakapag-scrape ng data mula sa anumang page na mayroon silang access sa paggamit ng platform. Nagbibigay din ang ProWebScraper ng kakayahang magplano at mag-automate ng mga scrape, pati na rin ang iba't ibang mga pagpipilian sa pag-export, kabilang ang mga CSV, Excel, at JSON na mga format.

Gumagamit ang ProWebScraper ng web crawler upang mag-scrape ng impormasyon mula sa mga website. Ang crawler ay maaaring mag-navigate sa ilang mga pahina at maaaring pangasiwaan ang mga kumplikadong website. Ang ProWebScraper ay higit pang sumusuporta proxy server, na nagbibigay-daan sa mga user na mag-scrape ng data nang patago at lampasan ang mga limitasyon ng IP. Nag-aalok din ang software ng awtomatikong pagpapatunay ng data upang matiyak ang katumpakan ng nakuhang data.

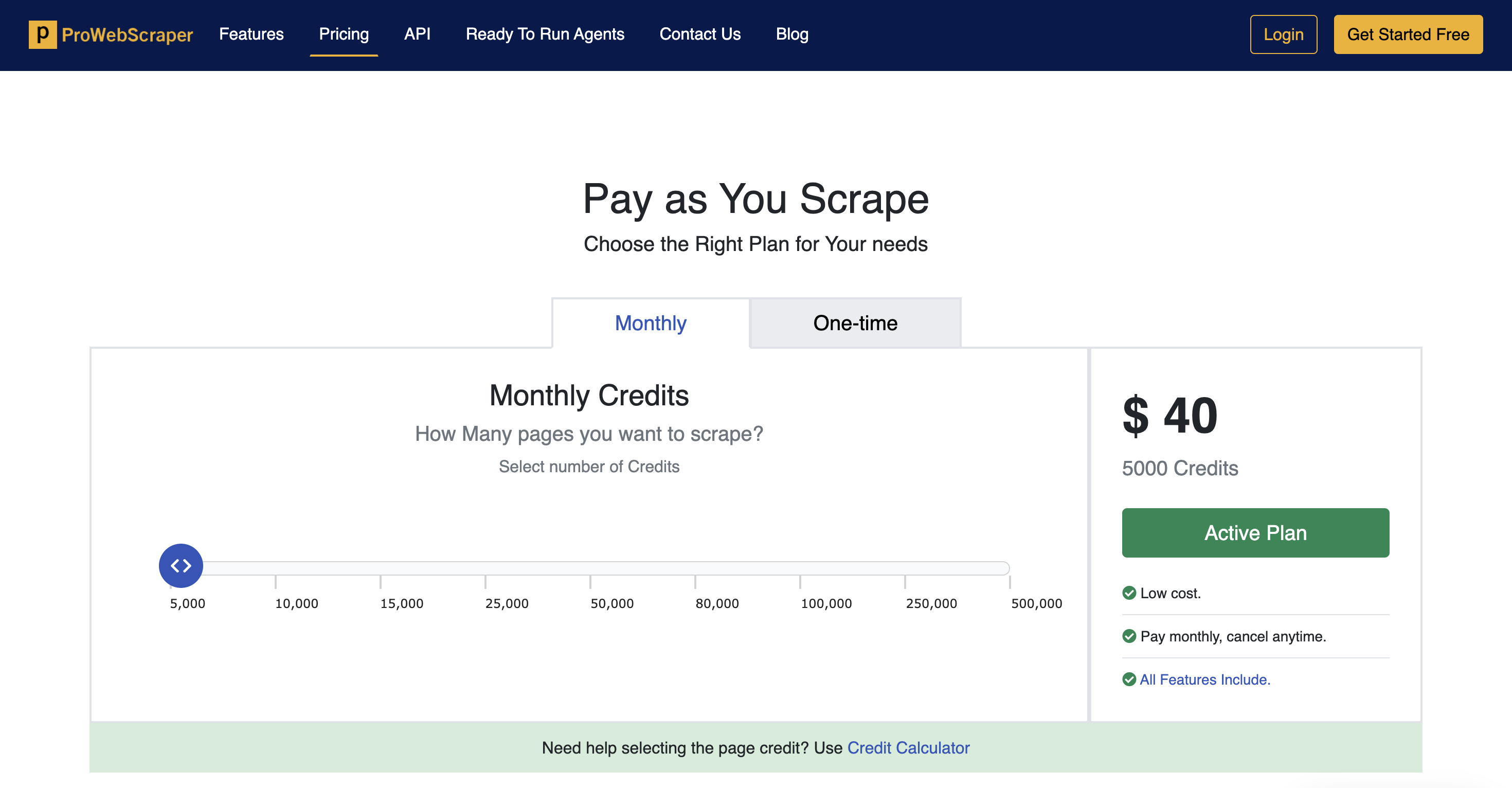

pagpepresyo

Maaari mong simulan ang paggamit nito nang libre at ang premium na pagpepresyo ay magsisimula sa $40 para sa 5000 credits.

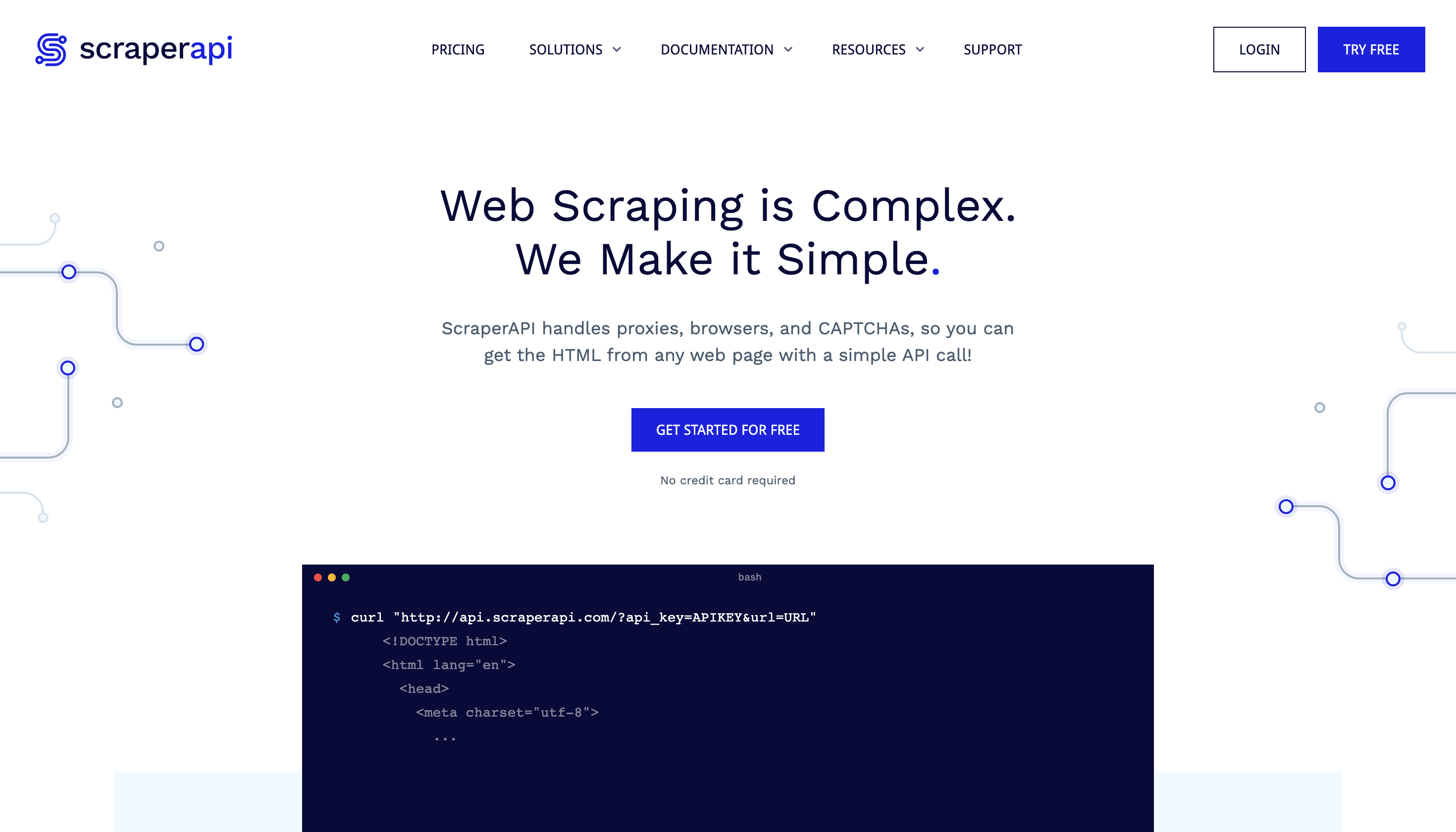

14. Scraping API

Ang platform ng Scraping API ay isang kamangha-manghang solusyon na nakabatay sa browser na partikular na idinisenyo para sa mga pangangailangan sa web scraping. Mabilis at simpleng makakapag-extract ka ng data mula sa mga website gamit ang Scraping API salamat sa user-friendly na UI nito.

Sinasaklaw mo ang Scraping API kung baguhan ka man o ekspertong web scraper. Sa tulong ng mga kontemporaryong engine ng web browser, gumagamit ito ng diskarte sa browser na walang ulo upang mag-render ng mga website, magpatakbo ng JavaScript, at makuha ang kinakailangang data. Bilang kinahinatnan, kahit na sa mga kumplikadong website na may nagbabagong materyal, ang tumpak at maaasahang mga resulta ng pag-scrape ay ginagarantiyahan.

Bilang karagdagan, maaari mong gamitin ang iyong mga paboritong kasanayan sa coding gamit ang Scraping API dahil sinusuportahan nito ang iba't ibang mga programming language, tulad ng Python, JavaScript, at PHP.

Maaari kang mag-explore at makipag-ugnayan sa mga website nang eksakto tulad ng isang tunay na user salamat sa matatag na kakayahan nito, na kinabibilangan ng paghawak ng pagination, pagsusumite ng form, at pamamahala ng session. Bukod pa rito, nag-aalok ang Scraping API ng tuluy-tuloy na pag-ikot ng proxy, na nagbibigay-daan sa iyong mag-scrape ng mga webpage nang malaki habang tinatakpan ang iyong IP address at iniiwasan ang anumang mga pagbabawal.

Upang magarantiya ang tumpak na pagkuha ng data, ang platform ay nagbibigay din ng malakas na pamamahala ng error at muling subukan ang mga opsyon. Madali mong maisama ang data sa ilang mga form, gaya ng HTML, JSON, at XML, sa iyong mga app o database sa pamamagitan ng paggamit ng scraping API.

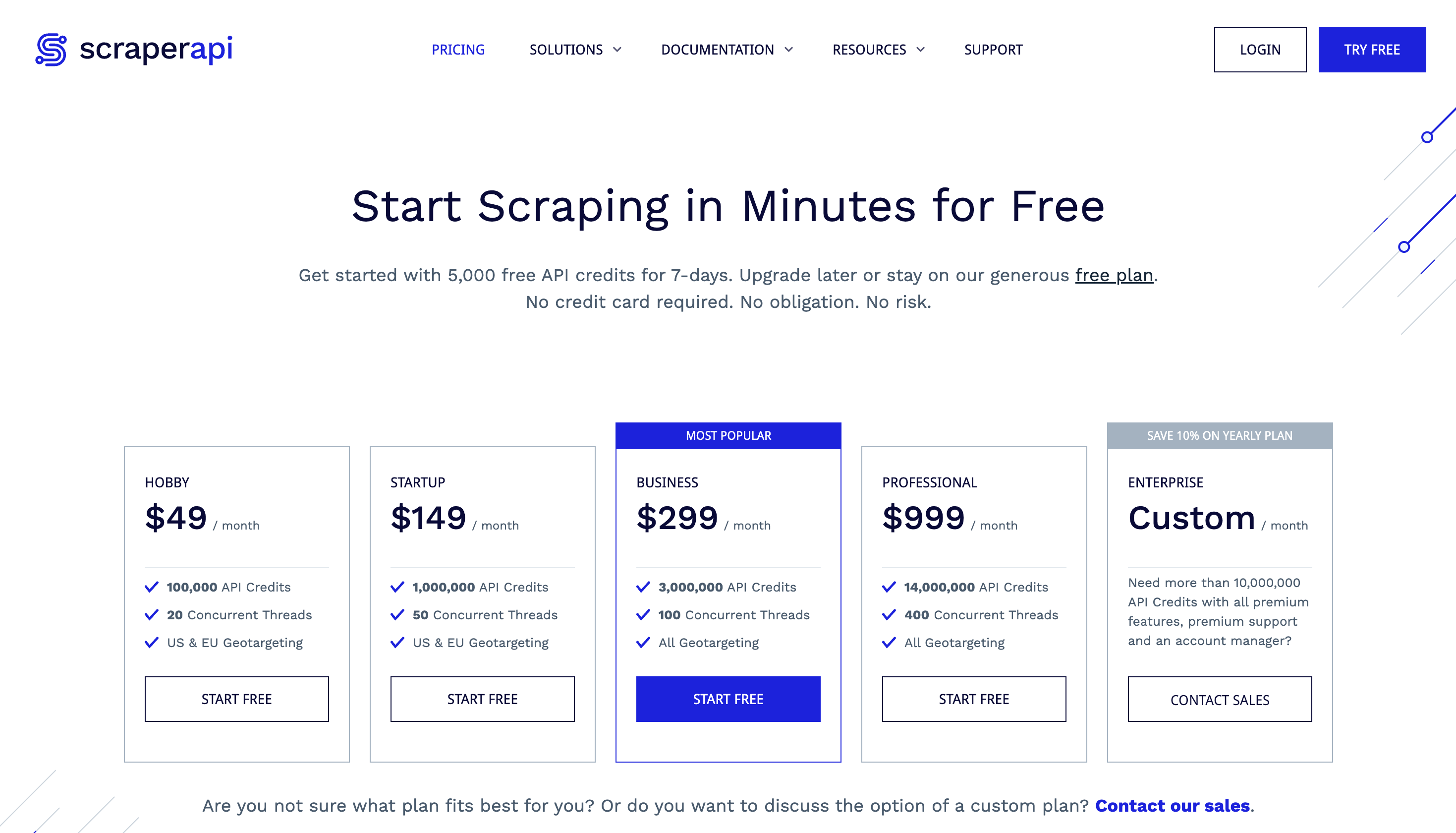

pagpepresyo

Ang premium na pagpepresyo ay nagsisimula sa $49/buwan.

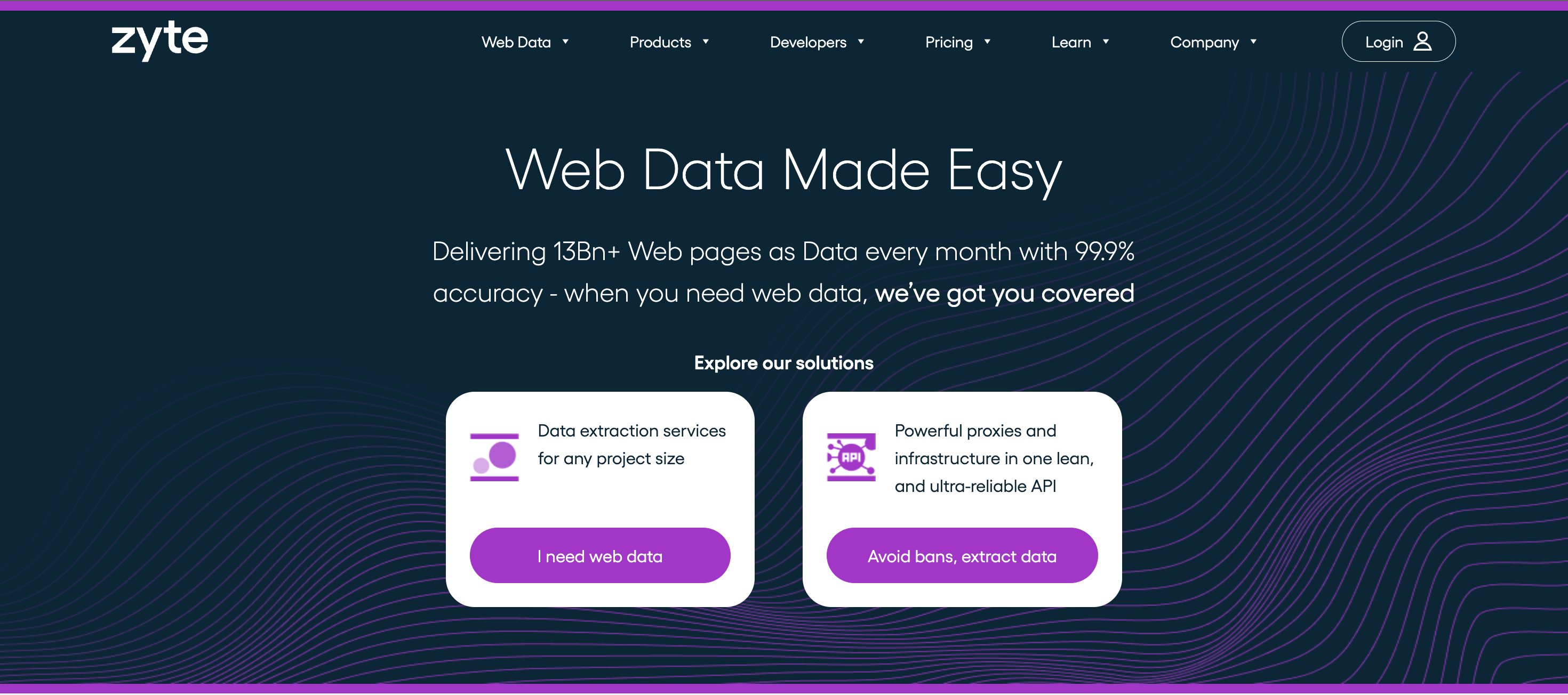

15. Zyte

Ang Zyte ay isang platform na nakabatay sa browser na eksklusibong idinisenyo para sa web scraping. Mabilis na makatawid ang mga user sa mga website at nakakakuha ng kapaki-pakinabang na data dahil sa user-friendly na interface nito, na inaalis ang pangangailangan para sa masalimuot na coding o pag-setup ng imprastraktura.

Gumagamit ang platform ng diskarte sa browser na walang ulo at gumagamit ng kasalukuyang mga web browser engine para mag-render ng mga web page, magpatakbo ng JavaScript, at kumuha ng data mula sa dynamic na content. Nagbibigay ito ng tumpak at masusing mga resulta ng pag-scrape, kahit na mula sa masalimuot na mga website.

Bukod pa rito, nag-aalok ang Zyte ng iba't ibang mga kakayahan, tulad ng sopistikadong pagpapatunay ng data, matalinong pagkuha ng data, at malakas na paraan ng paghawak ng error, upang mapabuti ang proseso ng pag-scrape.

Bilang karagdagan, sinusuportahan ng Zyte ang ilang mga wika ng code, kabilang ang Python, JavaScript, at Ruby, upang magamit ng mga user ang kanilang mga paboritong kasanayan sa programming.

Hindi mo na kakailanganing pamahalaan ang mga server o mag-alala tungkol sa scalability sa Zyte dahil madali mong mapapamahalaan at mapalago ang iyong mga proyekto sa pag-scrape gamit ang kanilang imprastraktura sa cloud.

Bukod pa rito, ang Zyte ay may built-in na pamamahala ng proxy na nagbibigay-daan sa mga user na idirekta ang kanilang mga kahilingan sa pamamagitan ng iba't ibang mga proxy upang mapanatili ang anonymity at maiwasan ang mga IP ban. Nag-aalok din ito ng tuluy-tuloy na pakikipag-ugnayan sa iba't ibang mga format at system ng pag-iimbak ng data, kabilang ang mga database at API, na ginagawang simple ang pag-imbak at paghawak ng mga nakolektang data.

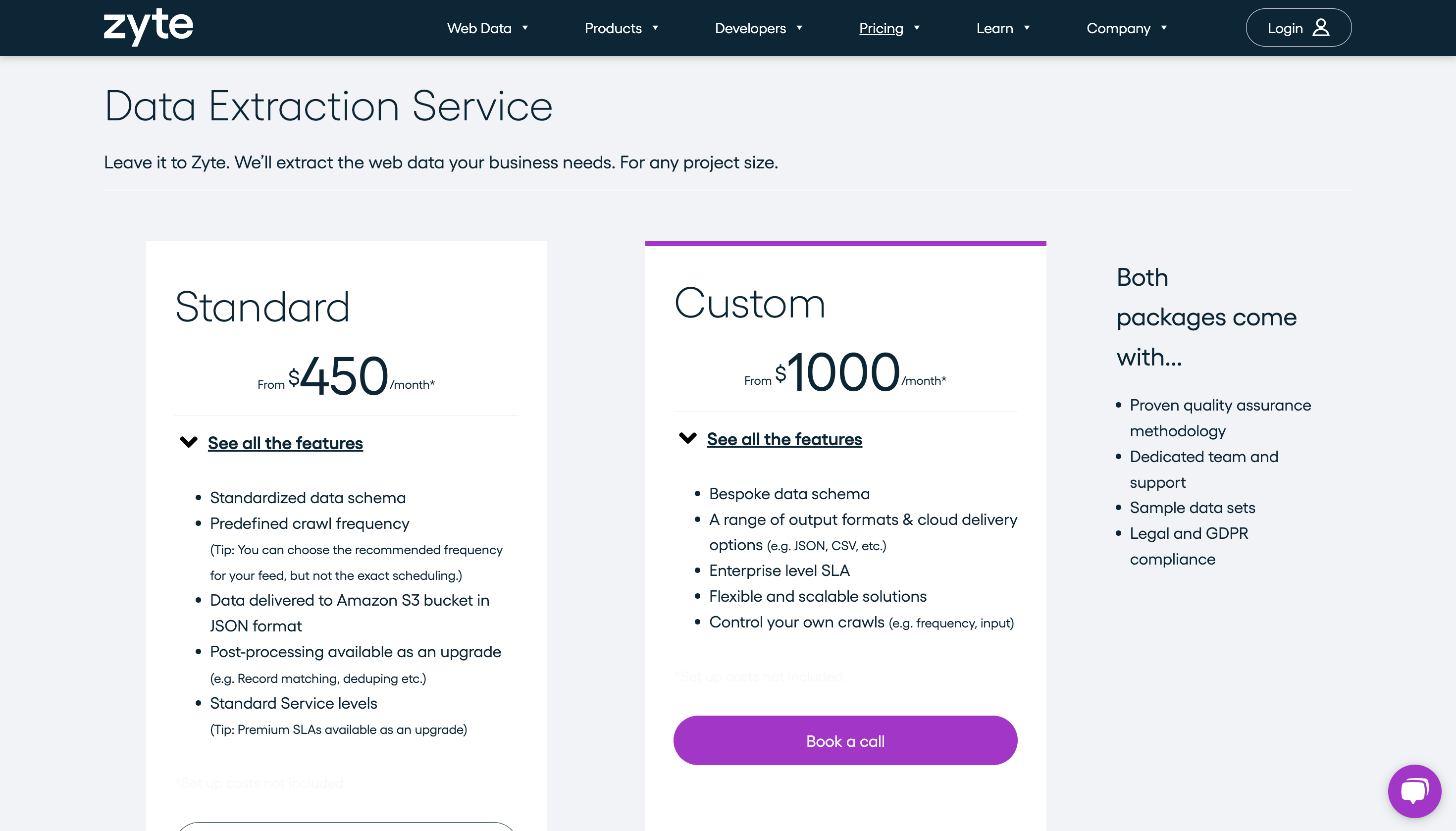

pagpepresyo

Ang premium na pagpepresyo ay nagsisimula sa $450/buwan.

Konklusyon

Sa konklusyon, ang pag-unlock sa potensyal ng online scraping at paggawa ng data-driven na insight ay depende sa pagpili ng naaangkop na web scraping platform na nababagay sa iyong mga natatanging pangangailangan. Sa napakaraming alternatibong naa-access, mahalagang isaalang-alang ang mga aspeto tulad ng kakayahang magamit, kakayahan sa pagkuha ng data, pagsasama ng API, at higit pa.

Ang Bright Data ay isang platform na namumukod-tangi dahil sa malakas nitong proxy network, intuitive user interface, at cutting-edge na mga kakayahan kabilang ang awtomatikong data extraction, data validation, at anti-blocking na pamamaraan. Madaling ma-access ng mga negosyo ang napakalaking dami ng online na data gamit ang Bright Data at gamitin ito para bigyan ang kanilang sarili ng competitive edge sa kanilang mga market.

Kaya siguraduhing tingnan ang Maliwanag na Data at tuklasin kung paano ito makakatulong sa iyong maabot ang iyong mga layunin ng data kung naghahanap ka ng isang kumpleto at maaasahang solusyon sa pag-scrape ng web.

Mag-iwan ng Sagot