Neural rendering är en framväxande teknik inom djupinlärning som syftar till att utöka den klassiska pipelinen av datorgrafik med neurala nätverk.

En neural renderingsalgoritm kräver en uppsättning bilder som representerar olika vinklar av samma scen. Dessa bilder kommer sedan att matas in i ett neuralt nätverk för att skapa en modell som kan mata ut nya vinklar av samma scen.

Briljansen bakom neural rendering ligger i hur den exakt kan återskapa detaljerade fotorealistiska scener utan att behöva förlita sig på klassiska metoder som kan vara mer beräkningskrävande.

Innan vi dyker in i hur neural rendering fungerar, låt oss gå igenom grunderna för klassisk rendering.

Vad är klassisk rendering?

Låt oss först förstå de typiska metoderna som används i klassisk rendering.

Klassisk rendering hänvisar till den uppsättning tekniker som används för att skapa en 2D-bild av en tredimensionell scen. Även känd som bildsyntes, använder klassisk rendering olika algoritmer för att simulera hur ljus interagerar med olika typer av objekt.

Till exempel, att rendera en solid tegelsten kommer att kräva en speciell uppsättning algoritmer för att bestämma skuggans position eller hur väl upplyst vardera sidan av väggen kommer att vara. På samma sätt kommer föremål som reflekterar eller bryter ljus, såsom en spegel, ett glänsande föremål eller en vattenmassa, att kräva sina egna tekniker.

I klassisk rendering representeras varje tillgång med ett polygonnät. Ett skuggningsprogram kommer sedan att använda polygonen som indata för att bestämma hur objektet kommer att se ut givet den angivna belysningen och vinkeln.

Realistisk rendering kommer att kräva mycket mer beräkningskraft eftersom våra tillgångar i slutändan har miljontals polygoner att använda som indata. Den datorgenererade produktionen som är vanlig i storfilmer i Hollywood tar vanligtvis veckor eller till och med månader att rendera och kan kosta miljontals dollar.

Strålspårningsmetoden är särskilt kostsam eftersom varje pixel i den slutliga bilden kräver en beräkning av den väg ljuset tar från ljuskällan till objektet och till kameran.

Framsteg inom hårdvara har gjort grafikåtergivningen mycket mer tillgänglig för användarna. Till exempel många av de senaste videospel tillåt strålspårade effekter som fotorealistiska reflektioner och skuggor så länge deras hårdvara klarar uppgiften.

De senaste GPU:erna (grafiska bearbetningsenheterna) är byggda specifikt för att hjälpa processorn att hantera de mycket komplexa beräkningar som krävs för att göra fotorealistisk grafik.

Uppkomsten av neural rendering

Neural rendering försöker ta itu med renderingsproblemet på ett annat sätt. Istället för att använda algoritmer för att simulera hur ljus interagerar med objekt, tänk om vi skapade en modell som lär sig hur en scen ska se ut från en viss vinkel?

Du kan se det som en genväg till att skapa fotorealistiska scener. Med neural rendering behöver vi inte beräkna hur ljus interagerar med ett objekt, vi behöver bara tillräckligt med träningsdata.

Detta tillvägagångssätt gör det möjligt för forskare att skapa högkvalitativa renderingar av komplexa scener utan att behöva uppträda

Vad är neurala fält?

Som nämnts tidigare använder de flesta 3D-renderingar polygonnät för att lagra data om formen och strukturen för varje objekt.

Men neurala fält blir allt populärare som en alternativ metod för att representera tredimensionella objekt. Till skillnad från polygonnät är neurala fält differentierbara och kontinuerliga.

Vad menar vi när vi säger att neurala fält är differentierbara?

En 2D-utgång från ett neuralt fält kan nu tränas för att bli fotorealistiskt genom att helt enkelt justera vikterna för det neurala nätverket.

Med hjälp av neurala fält behöver vi inte längre simulera ljusets fysik för att återge en scen. Kunskapen om hur den slutliga renderingen kommer att lysas lagras nu implicit i vikterna av vår neurala nätverk.

Detta gör att vi kan skapa nya bilder och videor relativt snabbt från bara en handfull bilder eller videofilmer.

Hur tränar man ett nervfält?

Nu när vi vet grunderna om hur ett neuralt fält fungerar, låt oss ta en titt på hur forskare kan träna ett neuralt strålningsfält eller NeRF.

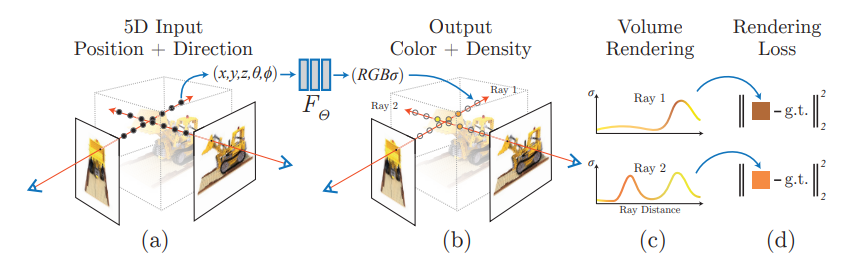

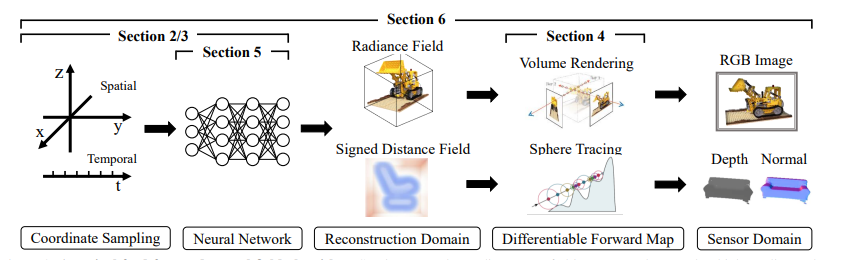

Först måste vi prova de slumpmässiga koordinaterna för en scen och mata in dem i ett neuralt nätverk. Detta nätverk kommer då att kunna producera fältkvantiteter.

De producerade fältmängderna betraktas som prover från den önskade rekonstruktionsdomänen för scenen vi vill skapa.

Vi måste sedan mappa rekonstruktionen till faktiska 2D-bilder. En algoritm kommer sedan att beräkna rekonstruktionsfelet. Detta fel kommer att vägleda det neurala nätverket för att optimera dess förmåga att rekonstruera scenen.

Tillämpningar av neural rendering

Roman View Synthesis

Ny syntessyntes hänvisar till uppgiften att skapa kameraperspektiv från nya vinklar med hjälp av data från ett begränsat antal perspektiv.

Neural renderingstekniker försöker gissa kamerans relativa position för varje bild i datamängden och mata in dessa data till ett neuralt nätverk.

Det neurala nätverket kommer sedan att skapa en 3D-representation av scenen där varje punkt i 3D-utrymmet har en tillhörande färg och densitet.

En ny implementering av NeRFs i Google Street View använder ny vysyntes för att tillåta användare att utforska verkliga platser som om de styrde en kamera som tar en video. Detta gör att turister kan utforska destinationer på ett uppslukande sätt innan de bestämmer sig för att resa till en specifik plats.

Fotorealistiska avatarer

Avancerade tekniker inom neural rendering kan också bana väg för mer realistiska digitala avatarer. Dessa avatarer kan sedan användas för olika roller som virtuella assistenter eller kundtjänst, eller som ett sätt för användare att infoga sin likhet i en videospel eller simulerad rendering.

![]()

Till exempel kan en papper publicerad i mars 2023 föreslår att man använder neurala renderingstekniker för att skapa en fotorealistisk avatar efter några minuters videofilmning.

Slutsats

Neural rendering är ett spännande studieområde som har potential att förändra hela datorgrafikbranschen.

Tekniken kan sänka inträdesbarriären för att skapa 3D-tillgångar. Visuella effekter-team kanske inte längre behöver vänta dagar för att rendera några minuter av fotorealistisk grafik.

Att kombinera tekniken med befintliga VR- och AR-applikationer kan också göra det möjligt för utvecklare att skapa mer uppslukande upplevelser.

Vad tror du är den verkliga potentialen för neural rendering?

Kommentera uppropet