Innehållsförteckning[Dölj][Visa]

Välkommen till detta fängslande blogginlägg om Auto-GPT, ett oavslutat experimentprogram som fungerar som ett fascinerande exempel på hur språkmodell AI (LLM)-system som GPT-4 kan skapa och slutföra ett brett utbud av jobb på egen hand.

Många uppgifter kan automatiseras med hög precision och effektivitet tack vare den underbara tekniken som kallas Auto-GPT. Den använder sig av GPT-4:s kraftfulla naturliga språkbehandlingsfunktioner.

Denna utveckling indikerar hur LLMs, ett stort steg framåt för AI, har potentialen att avsevärt förändra hur vi ser på jobbautomatisering.

Vi kommer att undersöka vad Auto-GPT är, hur det fungerar och vilken typ av uppgifter den kan göra i det här inlägget. Betydelsen av Auto-GPT i förhållande till uppgiftsautomatisering och framtiden för LLM kommer också att tas upp.

Vi kommer också att ta upp farhågor angående de potentiella farorna och negativa effekterna av att använda LLM och Auto-GPT, och lyfta fram betydelsen av ansvarsfull och etisk användning.

Du kommer att ha en bättre kunskap om Auto-GPT och potentialen för LLM:er att revolutionera uppgiftsautomatisering i slutet av den här artikeln.

Så låt oss börja!

Vad är AutoGPT?

Auto-GPT är ett banbrytande program som förändrar världen av uppgiftsautomatisering. Det är ett program med öppen källkod som använder de kraftfulla krafterna hos LLM som GPT-4 för att självständigt skapa och hantera en mängd olika jobb.

Genom att använda Auto-GPT kan organisationer och individer effektivisera processer som rapportförfattande, innehållsskapande och dataanalys för att spara tid och minska antalet misstag.

Den banbrytande tekniken skapar sammanhängande och relevant innehåll genom att lära sig av enorma mängder data. Text som producerades som en konsekvens är i huvudsak mänskligt skriven text.

Auto-GPT är en spelomvandlare inom uppgiftsautomatisering, vilket gör att organisationer och individer kan koncentrera sig på andra viktiga uppgifter samtidigt som repetitiva och snåla jobb lämnas till programmet.

Vi kan förvänta oss att se allt kraftfullare mjukvara som Auto-GPT som kan utföra allt mer komplexa uppgifter när LLM fortsätter att utvecklas.

AutoGPT är ett banbrytande autonomt AI-program som visar hur GPT-4 kan användas för att utföra en mängd olika uppgifter. Användare kan använda AI för att utföra uppgifter som forskning, kodning och kreativt skrivande genom att tilldela roller och mål och använda dess förmåga.

När det gäller hur AI-driven teknik kommer att förändra hur vi arbetar och engagerar oss med AI-system i framtiden, ger AutoGPT en glimt.

Men, hur fungerar det?

Auto-GPT använder den senaste utvecklingen inom LLM, särskilt GPT-4, för att automatiskt producera innehåll som är sammanhängande och relevant. Programmet lär sig av enorma mängder data, vilket gör att det kan känna igen mönster och samband mellan ord och meningar.

Med hjälp av denna information producerar Auto-GPT sedan text som svar på en uppmaning eller inmatning. Denna input kan komma i form av ett direktiv, en uppgift eller en uppsättning riktlinjer.

Auto-GPT skapar innehåll som är kontextuellt lämpligt och logiskt konsekvent med hjälp av dess banbrytande algoritmer och naturliga språkbehandlingsfärdigheter efter tar emot input. Auto-GPT är en viktig resurs för organisationer och människor som vill automatisera processer och spara tid eftersom texten som den producerar är praktiskt taget omöjlig att skilja från mänskligt skrivna språk.

Auto-GPT:s styrka ligger i dess förmåga att lära av enorma mängder data och producera text som är både relevant och logisk, vilket gör den till ett avgörande verktyg inom jobbautomatisering.

Kort sagt, AutoGPT itererar på sina egna uppmaningar, utvärderar dem kritiskt och bygger vidare på dem i varje iteration. Den utnyttjar sedan GPT-4 och GPT-3.5 genom API för att producera hela projekt. Den har förmågan att läsa och skriva filer, komma åt internet och undersöka svaren på sina egna uppmaningar. Den kan också kombinera resultaten med historiken för de relevanta frågorna.

Uppgifter som Auto-GPT kan utföra

Ett flexibelt program, Auto-GPT, kan användas för en mängd olika aktiviteter, inklusive att skapa rapporter och dataanalys. I den här delen ska vi titta på några av de funktioner som Auto-GPT kan utföra och hur den automatiserar dem.

Content Creation

Innehåll för webbplatser, bloggar och inlägg på sociala medier kan skapas med Auto-GPT. Auto-GPT kan producera högkvalitativt, relevant och intressant material om du ger det ett ämne eller en uppsättning riktlinjer.

Översättning

Du kan utföra översättningsaktiviteter med Auto-GPT. Text kan översättas till ett annat språk med Auto-GPT genom att skriva in den på ett språk. Företag som är verksamma i olika länder och kräver en snabb översättning av dokument eller kommunikation kan tycka att denna förmåga är oerhört användbar.

Kundservice

Kundsupportuppgifter som att svara på frekventa förfrågningar och lösa problem kan eventuellt automatiseras med Auto-GPT. Auto-GPT kan förstå kundförfrågningar och leverera relevanta lösningar genom att använda naturlig språkbehandling.

Dataanalys

Dataanalysaktiviteter kan utföras med Auto-GPT. Datainmatning gör att Auto-GPT kan analysera informationen och producera insikter som kan användas för att fatta beslut.

Att skriva rapporter

Företag och forskare kan dra nytta av Auto-GPT eftersom det kan användas för att producera rapporter beroende på datainmatning. Genom att mata in data kan Auto-GPT analysera informationen och producera resultat som är korrekta och lärorika.

Kodning

Auto-GPT kan användas för att generera fullständiga program eller kodavsnitt för kodningsjobb. Auto-GPT kan generera kod som är effektiv och effektiv genom att ta hänsyn till programmeringsparametrar eller behov. Utvecklare som behöver skriva kod exakt och snabbt kommer att finna denna förmåga till stor hjälp.

Jag har just nämnt några uppgifter; trots allt är det bara din fantasi som sätter gränser.

Hur installerar jag AutoGPT på din Mac?

Du kan enkelt använda kraften i GPT-4 genom att använda AutoGPT för att utföra en mängd olika aktiviteter, inklusive forskning, kodning och förbättring av berättelsen.

Det finns några krav du måste installera på din dator innan vi startar installationsprocessen:

- gå

- Python 3.10 eller senare

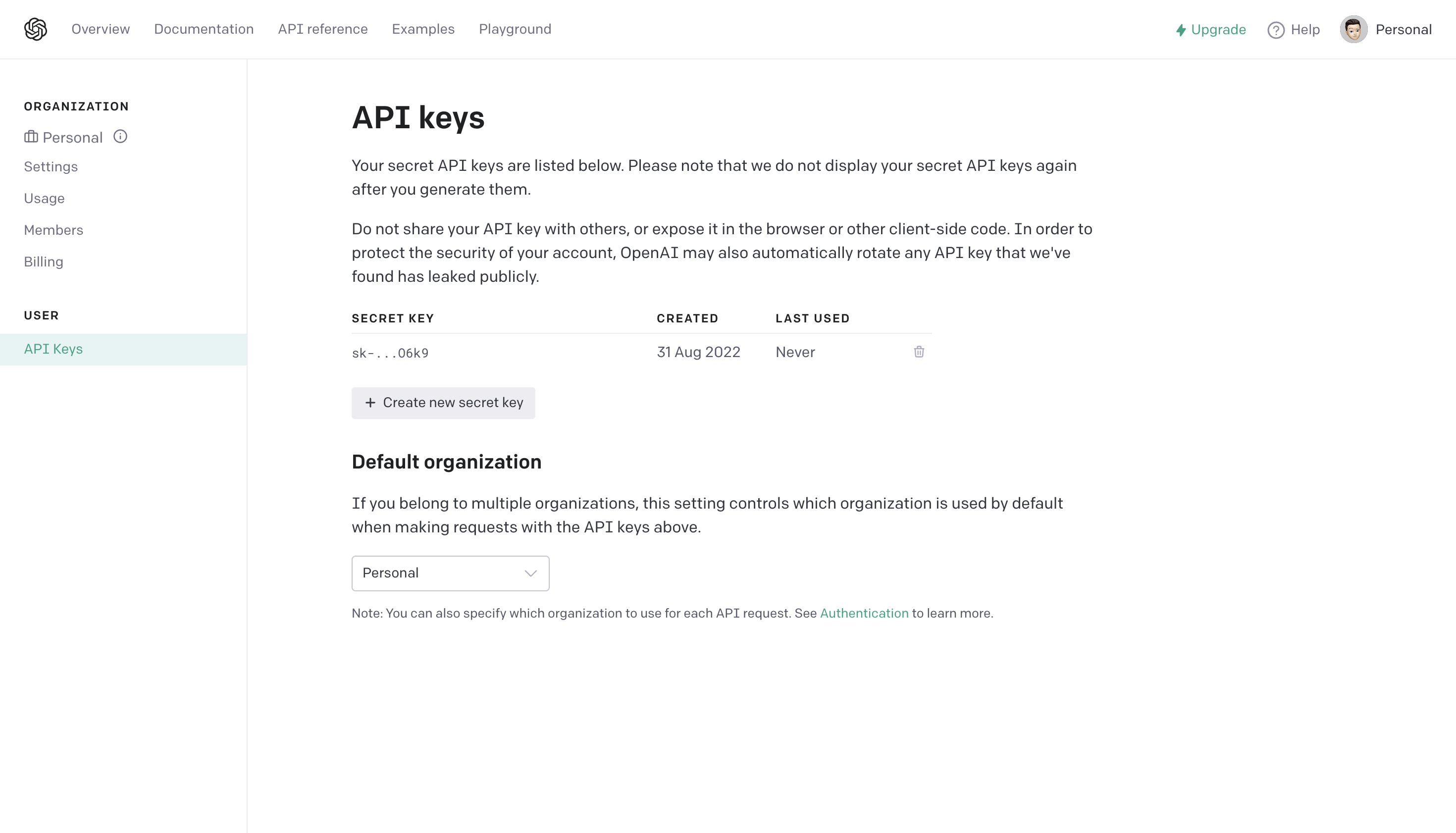

- OpenAI API-nyckel

Observera: Jag använder MacOS med den senaste versionen.

Konfigurera AutoGPT

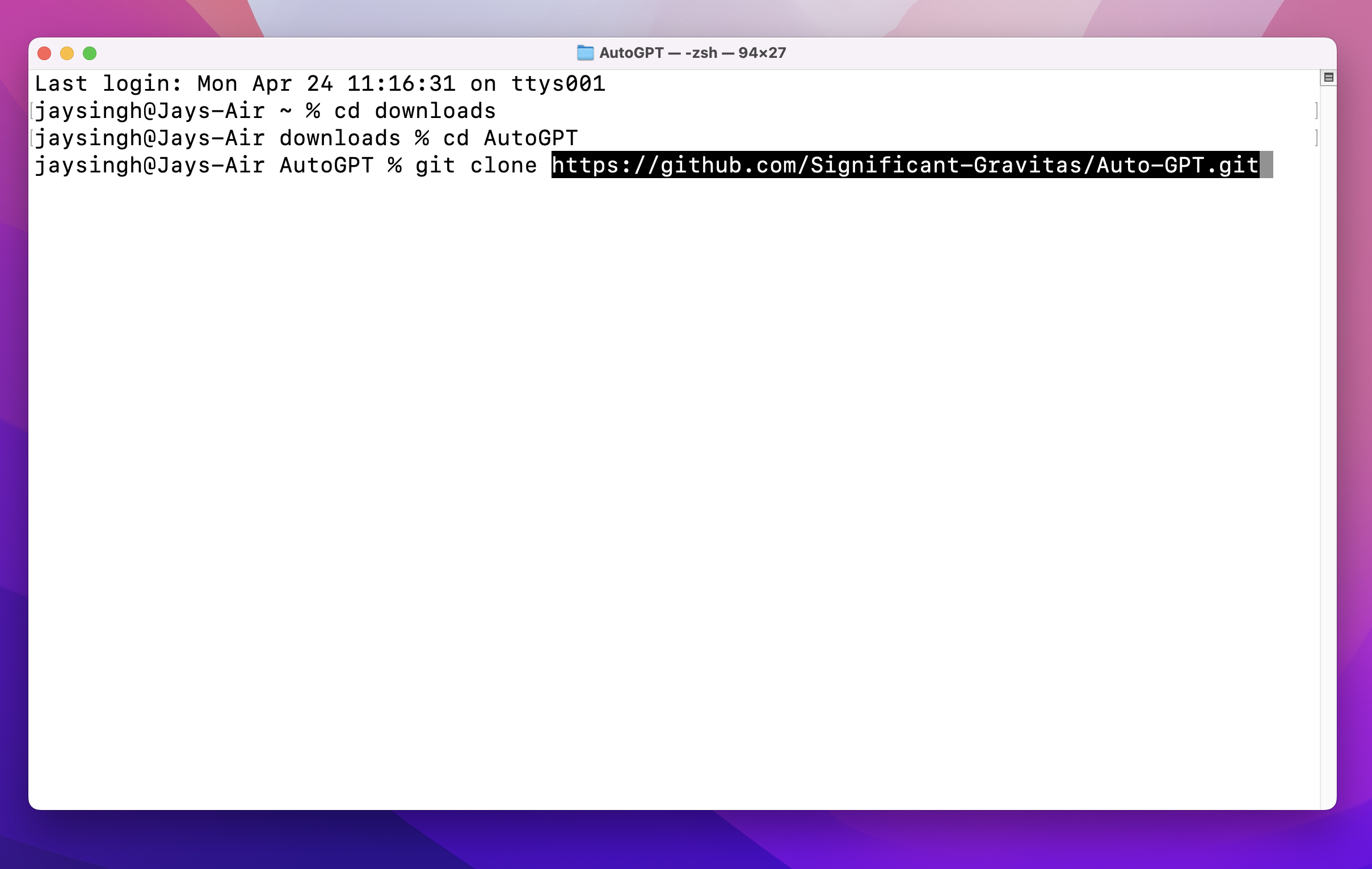

Steg 1: Klona AutoGPT-förråd

Skapa en separat mapp på din Mac som ditt första steg. Använd Git Bash och skriv följande kommando för att klona projektet:

git clone https://github.com/Significant-Gravitas/Auto-GPT.git

Steg 2: Installera beroenden

I det här steget kommer vi att installera alla beroenden som krävs för att köra AutoGPT. Här är kommandot:

pip3 install -r requirements.txt

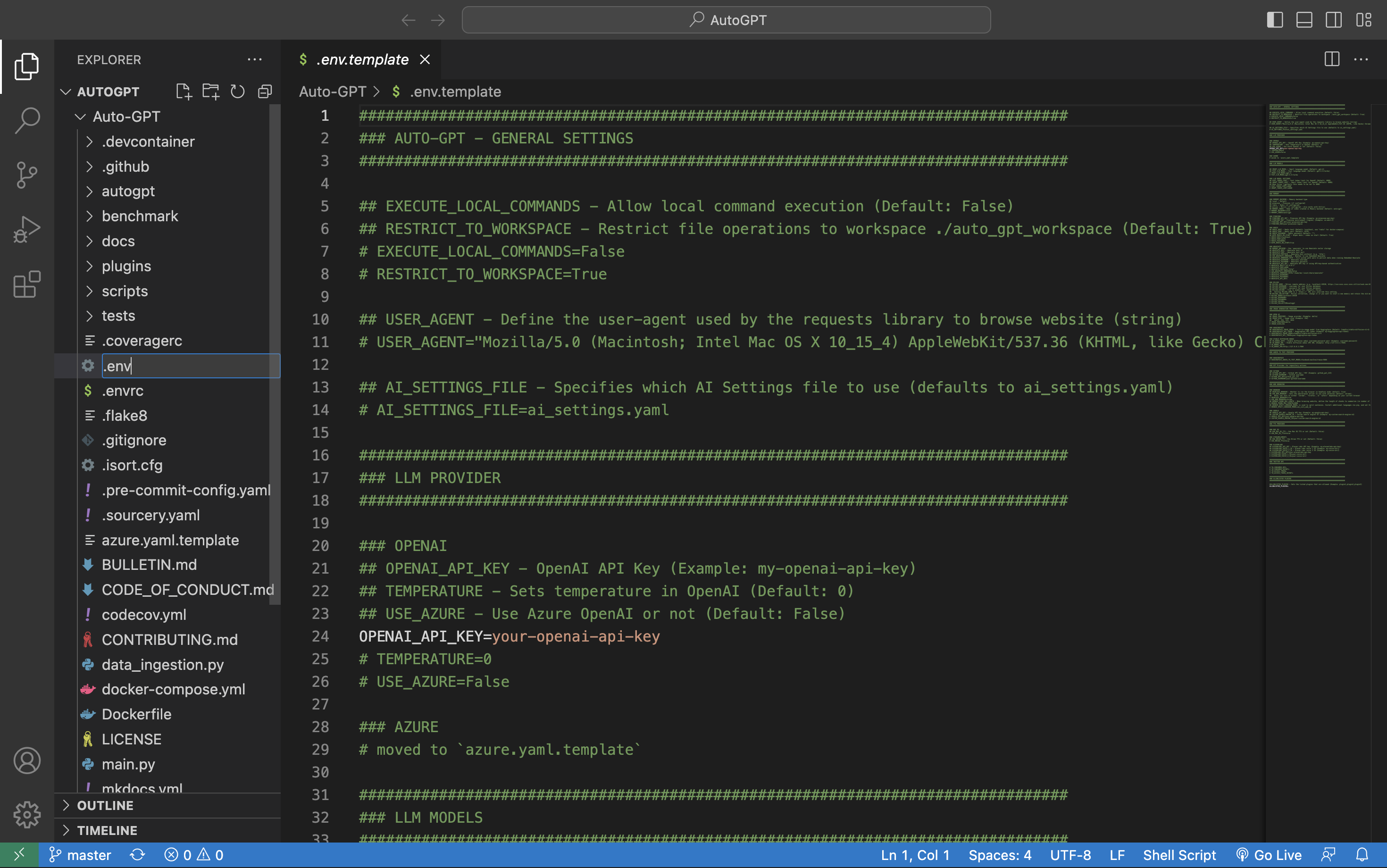

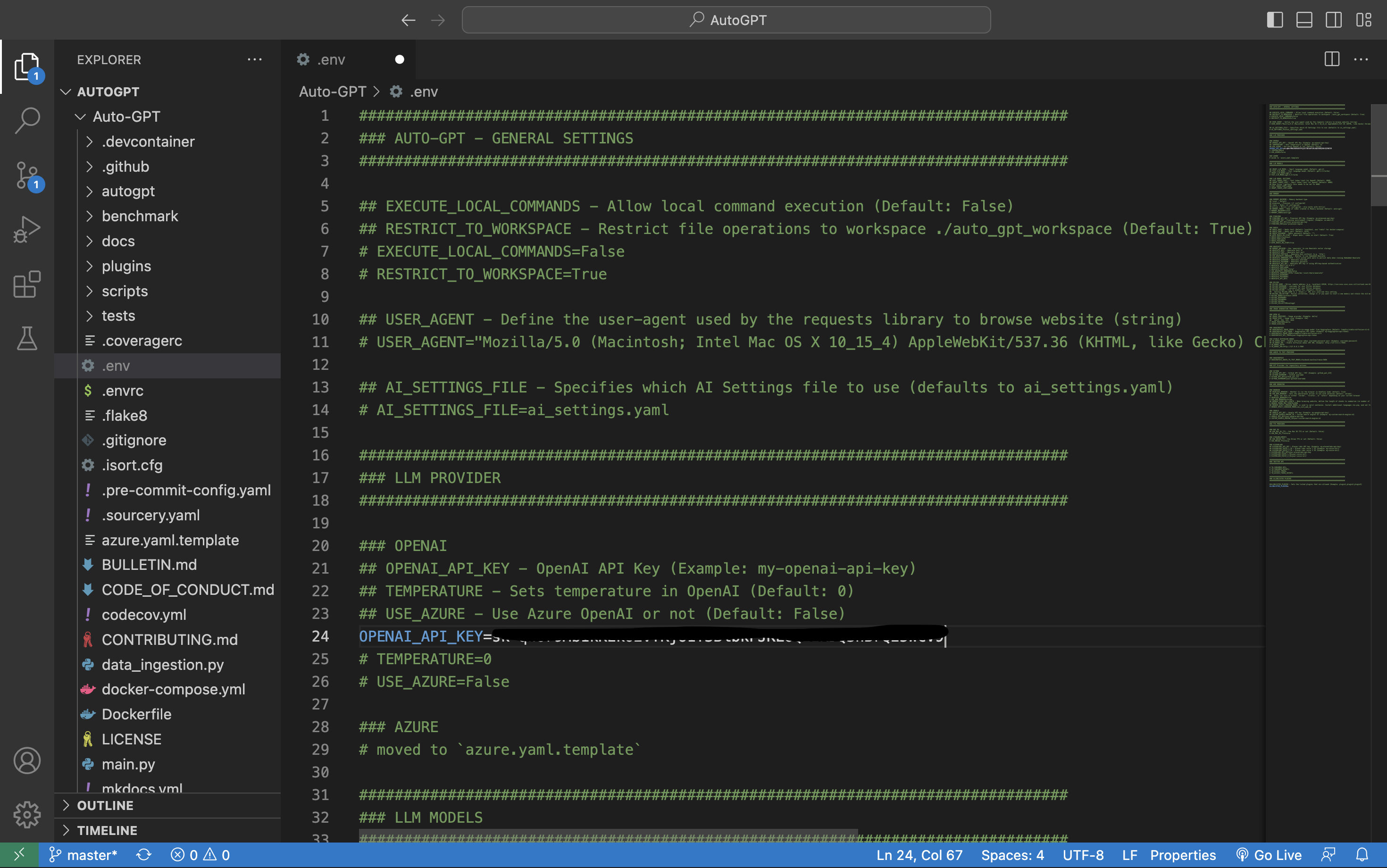

Efter det byter du namn.env.template till.env och fyller i fälten med dina OpenAI- och PineCone API-nycklar.

Din OpenAI API-nyckel kan erhållas här.

Till sist, placera dessa API:er i .env-filen.

Steg 3: Kör huvudfilen

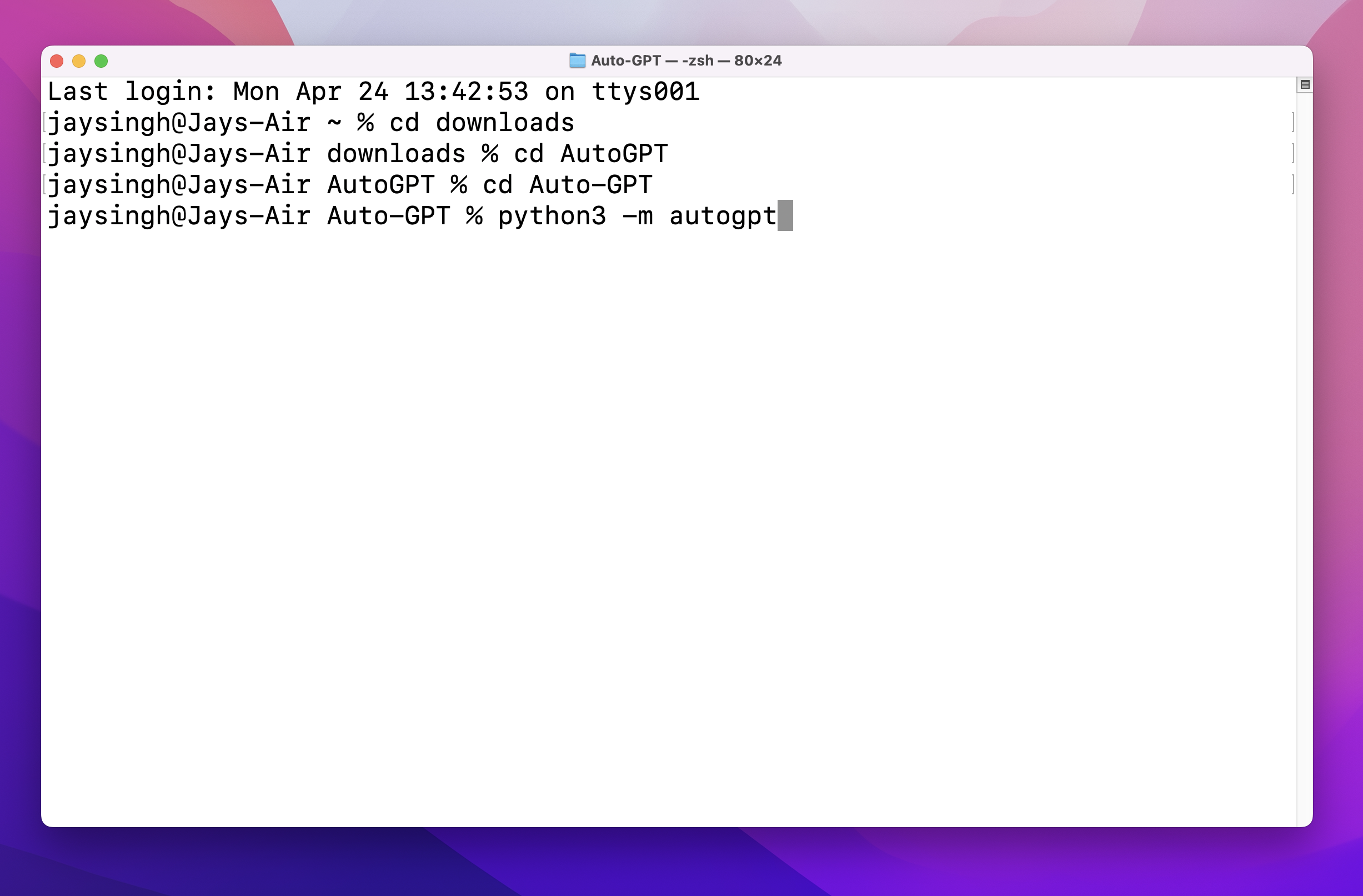

Öppna en terminal för att köra skriptet nedan:

python3 -m autogpt

Grattis, din AutoGPT har installerats på din Mac.

Använder AutoGPT

Definiera AI-roll

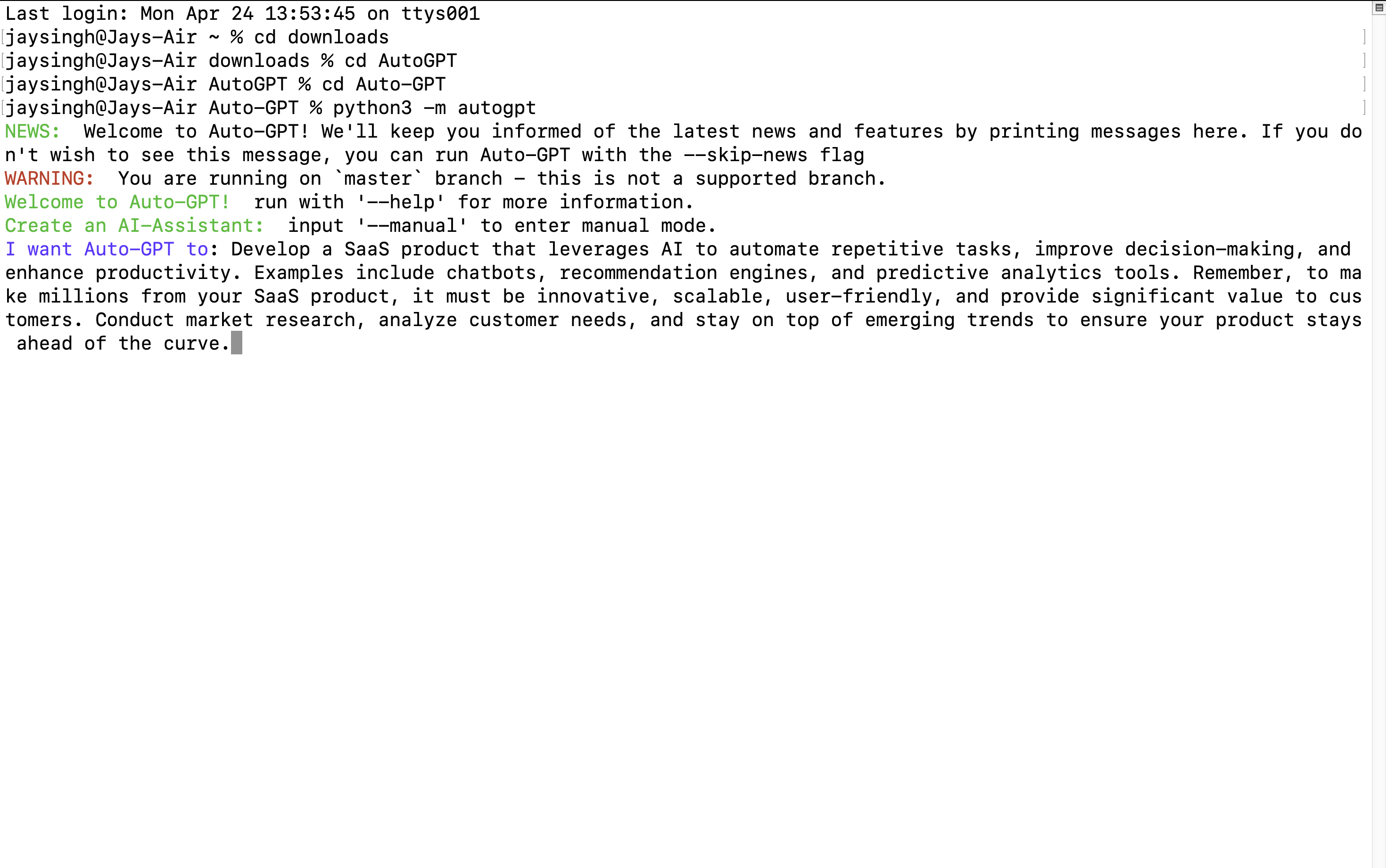

Nu måste vi bara ge rollen till AI, och den sätter automatiskt målet för sig själv och producerar resultat baserat på det.

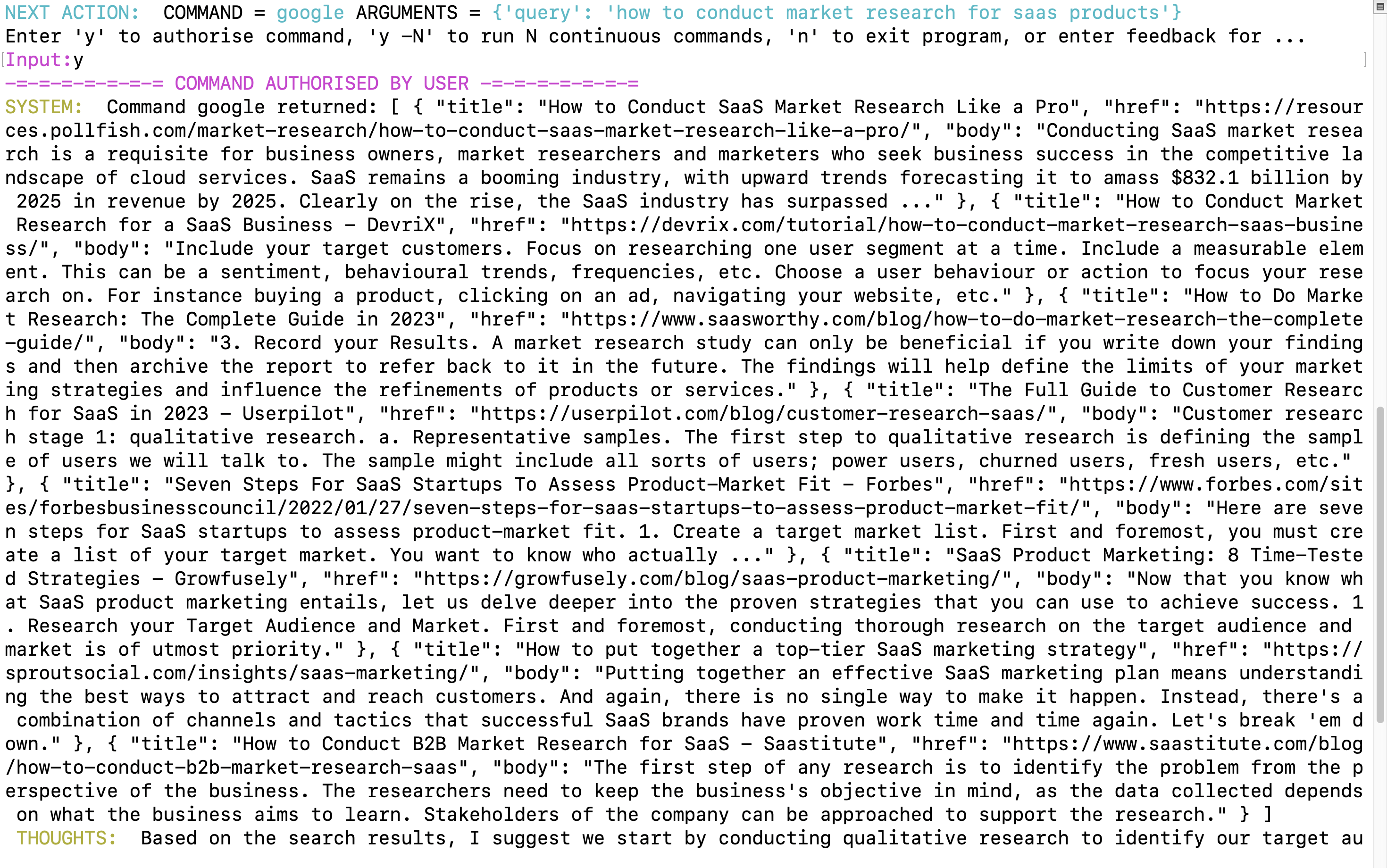

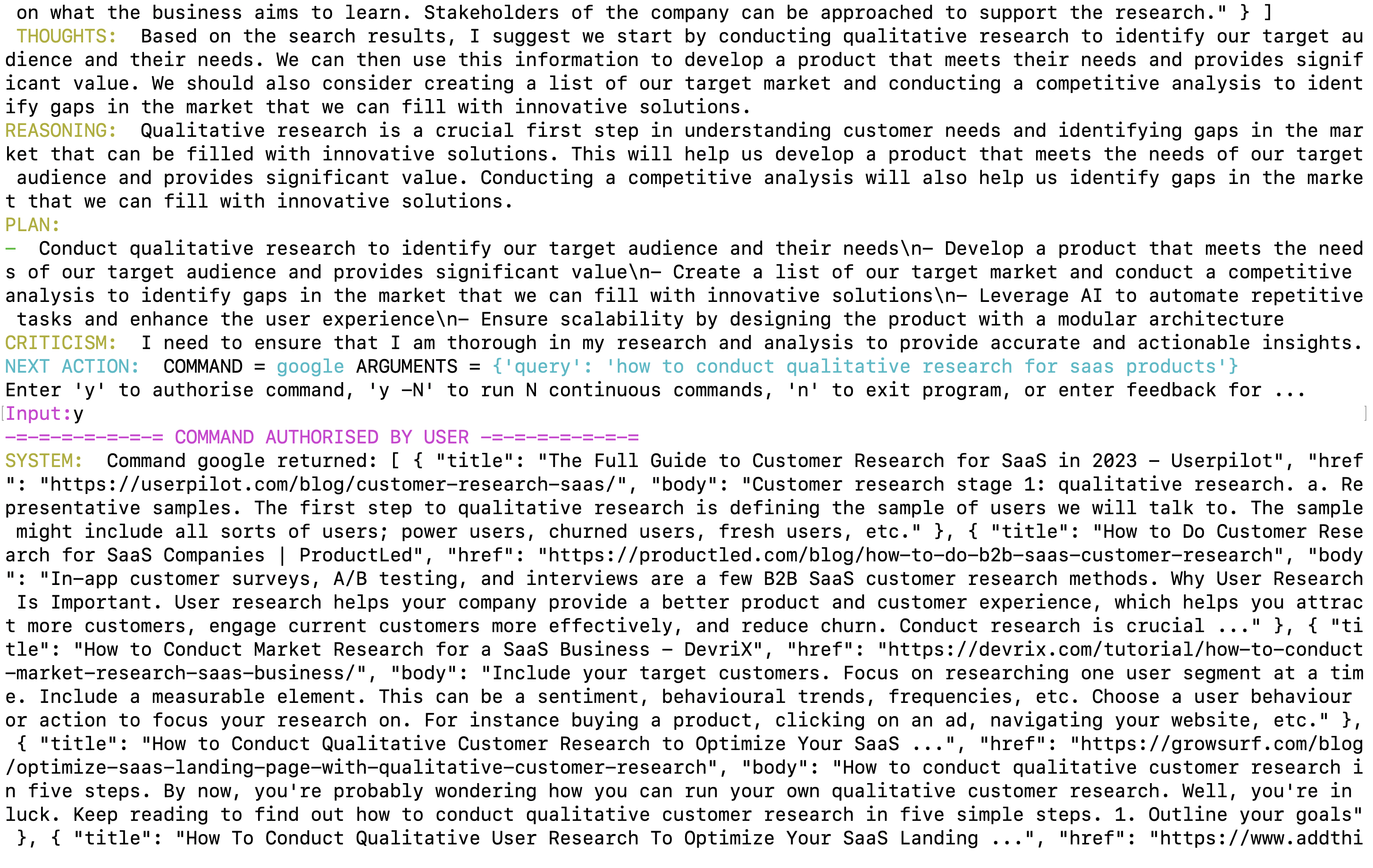

Jag har använt "Utveckla en SaaS-produkt som utnyttjar AI för att automatisera repetitiva uppgifter, förbättra beslutsfattandet och förbättra produktiviteten. Exempel inkluderar chatbots, rekommendationsmotorer och prediktiva analysverktyg. Kom ihåg att för att tjäna miljoner på din SaaS-produkt måste den vara innovativ, skalbar, användarvänlig och ge betydande värde till kunderna. Genomför marknadsundersökningar, analysera kundernas behov och håll koll på nya trender för att säkerställa att din produkt ligger före kurvan."

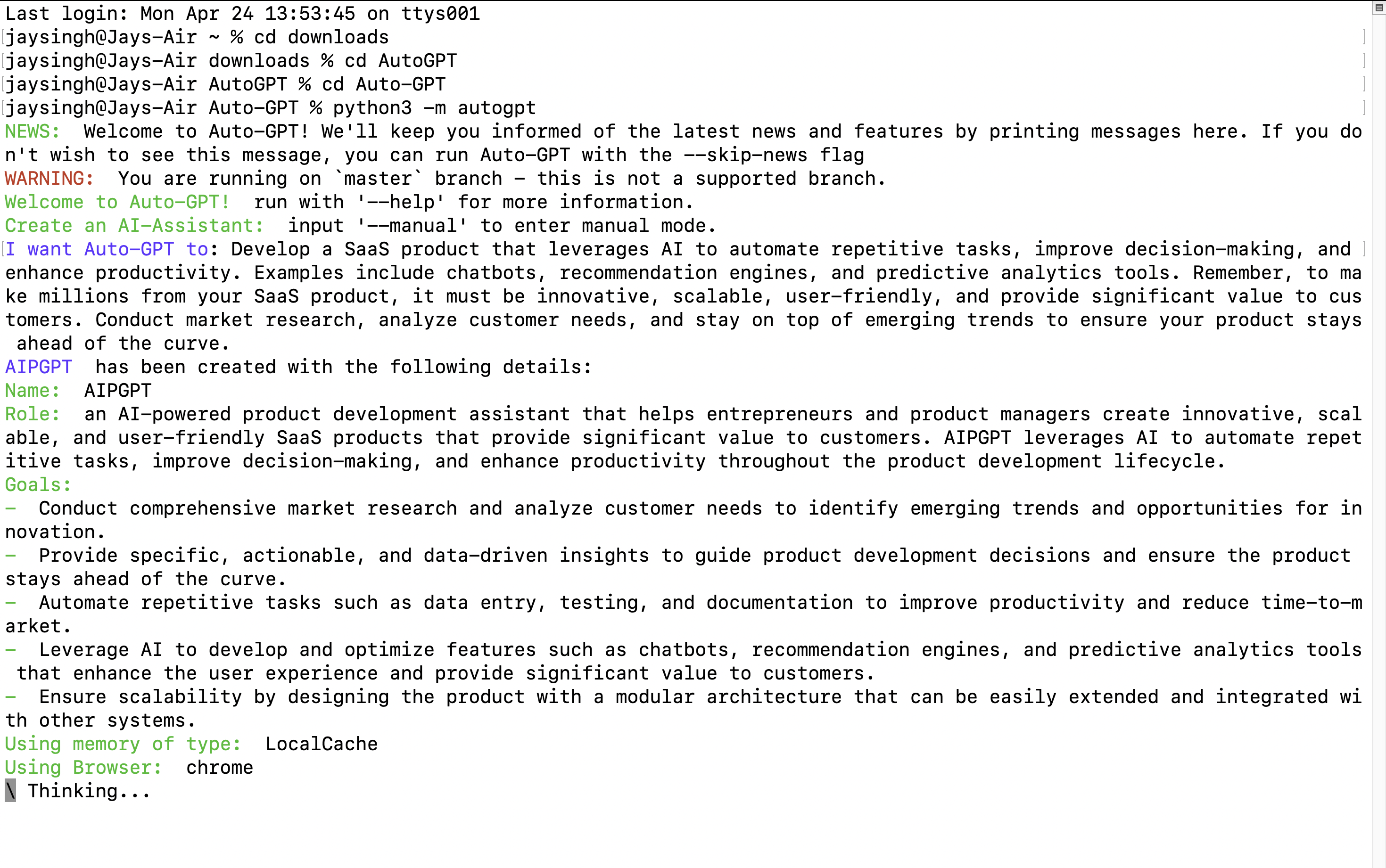

Nu kommer du att se att den automatiskt sätter upp mål för sig själv.

Du kan också se att AI använder en surfläsare för att ge dig bättre och senaste resultat.

Baserat på tidigare resultat föreslår den automatiskt var du ska gå härnäst.

På så sätt kan du använda AutoGPT och anpassa den efter dina behov.

Lade till plugins

Utvecklare släppte nyligen plugins som låter dig anpassa AutoGPT till dina unika krav. Plugins är datorprogram som förbättrar en plattforms eller programvaras kapacitet med en viss funktion.

De kräver inga större ändringar av den primära applikationens kärnkod eftersom de är gjorda för att utöka eller förbättra dess kapacitet.

Tredjeparts- och förstapartsplugins är också alternativ.

Listan över plugins är som följer:

- Twitter plugin

- E-postplugin

- Telegram plugin

- Google Analytics plugin

- Youtube plugin och många fler.

Framtiden för Auto-GPT och LLM

Det är omöjligt att betona hur LLMs, som GPT-4, har potentialen att revolutionera jobbautomatisering.

Som framgår av Auto-GPT och ChatGPT, kan LLM:er läras att lära av enorma mängder data och självständigt utföra ett brett utbud av aktiviteter, från innehållsproduktion till kodning. Förmågan att automatisera verksamheten har kraften att helt förändra branscher och hur vi verkar.

Men för LLM:er är Auto-GPT bara början. LLM:s befogenheter kommer att öka i takt med att tekniken utvecklas ytterligare. Framtida LLM:er kommer att vara mer skickliga på även komplicerade uppgifter och förstå sammanhang och komplexitet.

LLM uppgiftsautomatisering har också potential att öppna upp nya marknader och anställningsmöjligheter. Företag och människor kommer att kunna koncentrera sig på svårare och mer fantasifulla projekt om de kan automatisera många av sina vardagliga sysslor.

Ny sysselsättning inom branscher som dataanalys, mjukvaruutveckling och innehållsskapande kan skapas som ett resultat av denna tyngdpunktsförskjutning. Möjligheterna hos LLM:er går mycket längre än auto-GPT.

LLM:s kapacitet kommer att utvecklas tillsammans med tekniken, vilket resulterar i en arbetsstyrka som är mer effektiv och produktiv. Det finns en enorm potential för LLM:er att revolutionera jobbautomatisering, och under de kommande åren kan vi förutse ännu mer utveckling.

Risker som Auto-GPT och LLMs modeller inkluderar

Även om LLM som GPT-4 erbjuder en hel del löften att revolutionera jobbautomatisering, kan det också finnas faror och nackdelar som måste tas i beaktande. Sannolikheten för partiskhet och fördomar i data som används för att träna modellerna är en av de viktigaste orsakerna till oro. Om träningsdata var partisk, kan orättvisa och diskriminerande resultat uppstå från partiska LLM.

Möjligheten för LLM:er att användas felaktigt, som att sprida falsk information eller fabricera nyheter, är en annan fråga. Att använda LLM för att producera mycket övertygande falsk information kan ha skadliga effekter på både människor och samhället.

Dessutom skapar LLM:ers extrema auktoritet och autonomi frågor om plikt och ansvar. Vem är ansvarig om en LLM gör ett misstag eller har ett negativt resultat? Hur kan vi se till att LLM tillämpas etiskt och ansvarsfullt?

För att kunna använda LLMs som Auto-GPT på ett ansvarsfullt sätt måste dessa problem åtgärdas. Mångfalden och objektiviteten hos utbildningsdata måste garanteras, och LLM får inte användas för att sprida falsk information eller producera stötande material. Dessutom innebär det att skapa exakta regler och föreskrifter för användningen av LLM och göra parterna ansvariga för eventuella ogynnsamma resultat.

Slutsats

Sammanfattningsvis har LLM:er och Auto-GPT en enorm samhällsnyttig potential. De har förmågan att öka effektivitet, produktivitet och innovation inom alla branscher och skapa nya sysselsättningsmöjligheter.

Det är dock viktigt att vi använder LLMs ansvarsfullt och med försiktighet, och ser till att de används moraliskt och till gagn för samhället. Genom att göra detta kan vi använda LLM:er för att hjälpa alla att få en bättre framtid.

Förslag för förstagångsanvändare:

1. Prova pip3 install -r requirements.txt istället för pip install -r requirements.txt

2. För att skapa en ny mapp, gå till Mac Finder, skapa en ny mapp på skrivbordet och dubbelklicka och klicka sedan på "Skapa en ny terminal i mappen".

3. Se till att du har installerat Python 3.4 eller högre, med Git.

4. Skaffa personlig åtkomsttoken från GitHub

5. Använd Sublime Text eller Atom för att öppna mappen där du skapar terminalen för att komma åt filerna som .env

6. Om du får ett felmeddelande på OpenAI API-pull, kanske du vill försöka lägga till ett kort under faktureringsinformationen. Speciellt om du får Error: API Rate Limit Reached. Väntar 10 sekunder..

$ python3 main.py

Spårning (senaste samtalet senast):

Fil "E:\autogpt\Auto-GPT\main.py", rad 1, i

från autogpt import main

ImportError: kan inte importera namnet 'main' från 'autogpt' (E:\autogpt\Auto-GPT\autogpt\__init__.py)

snälla hjälp mig att lösa detta

Du borde springa

python3 scripts/main.pyom filen finns i en katalog som heter skript måste du köra kommandot

python3 scripts/main.pyistället förpython3 main.pyHej

När jag kör kommandot: python -m autogpt svar: /usr/bin/python: Ingen modul med namnet autogpt

Är det nödvändigt att installera en virtuell miljö eller räcker det att flytta en mapp?

TACK

python3 -m autogpt

Vänligen ställ in din OpenAI API-nyckel i .env eller som en miljövariabel.

Du kan få din nyckel från https://platform.openai.com/account/api-keys

Jag vet inte varför det ger mig detta fel, snälla hjälp mig.

de genererade api-nycklarna och placera den i filen

Jag vet inte vad jag ska göra