Daptar eusi[Sumputkeun][Témbongkeun]

Henteu énggal gaduh poto sareng pidéo palsu. Kusabab pamakean internét nyebar, jalma-jalma nyiptakeun pemalsuan anu dimaksud pikeun ngabobodo atanapi ngahibur ti saprak aya gambar sareng pilem.

Sanajan kitu, aya tipe anyar tina mesin-dihasilkeun palsu nu bisa someday nyieun hésé pikeun urang ngabedakeun kanyataanana ti fiksi.

Palsu ieu béda ti manipulasi gambar saderhana anu dihasilkeun ku ngédit parangkat lunak sapertos Photoshop atanapi pilem anu dimanipulasi pinter jaman baheula.

Deepfakes mangrupikeun conto "média sintétik" anu paling kawéntar - gambar, sora, sareng pidéo anu sigana diproduksi nganggo metode konvensional tapi leres-leres dilakukeun nganggo parangkat lunak anu canggih.

Deepfakes parantos lami-lami, sareng nalika aplikasi anu paling populér nyaéta nempatkeun kapala jalma-jalma anu kasohor dina awak aktor dina film porno, aranjeunna gaduh kamampuan pikeun ngahasilkeun gambar anu ngayakinkeun saha waé anu ngalakukeun naon waé, dimana waé.

Dina postingan ieu, urang bakal ningali Deepfakes, kumaha jalanna, kumaha anjeun tiasa ngahasilkeun nyalira, sareng seueur deui.

Janten, naon DeepFake?

A deepfake-kombinasi tina frasa learning deep jeung palsu-mangrupakeun sapotong média sintétik nu kasaruaan jalma séjén dipaké pikeun ngaganti hiji jalma dina poto atawa video nu geus aya.

Deepfakes ngagunakeun pembelajaran mesin canggih sareng téknik intelijen jieunan pikeun ngarobih sareng nyiptakeun inpormasi visual sareng audio anu berpotensi tinggi pikeun tipu daya.

Metode pembelajaran jero sapertos autoencoders sareng jaringan adversarial generatif mangrupikeun mékanisme primér pikeun produksi deepfake (GAN).

Model-model ieu dianggo pikeun nganalisa émosi sareng gerakan raray hiji jalma sareng nyintésis gambar wajah jalma sanés anu nunjukkeun ekspresi sareng gerakan anu sami.

Pamakéan deepfakes dina video porno selebritis, warta palsu, hoaxes, sarta panipuan finansial geus narik perhatian considerable. Boh industri sareng pamaréntahan parantos ngaréspon ku nyobian milarian aranjeunna sareng ngawatesan panggunaanana.

Modél Gerak Urutan Kahiji

Nalika nyobian ngembangkeun palsu anu jero dina jaman baheula, masalahna nyaéta yén urang peryogi sababaraha jinis pangaweruh tambahan, atanapi priors, pikeun pendekatan ieu jalan.

Salaku ilustrasi, spidol beungeut diperlukeun lamun urang hayang ngalacak gerakan sirah. Estimasi pose ieu diperlukeun lamun urang hayang peta gerak sakabeh awak.

Éta robih dina konperénsi NeurIPS taun ka tukang nalika tim peneliti ti Universitas Toronto nampilkeun karyana, "Modél Gerak Urutan Kahiji pikeun Animasi Gambar. "

Taya pangaweruh salajengna ngeunaan animasi diperlukeun pikeun pendekatan ieu. Sajaba ti éta, sanggeus modél ieu geus dilatih, éta bisa dipaké pikeun mindahkeun learning jeung dilarapkeun ka item naon digolongkeun dina kategori sarua.

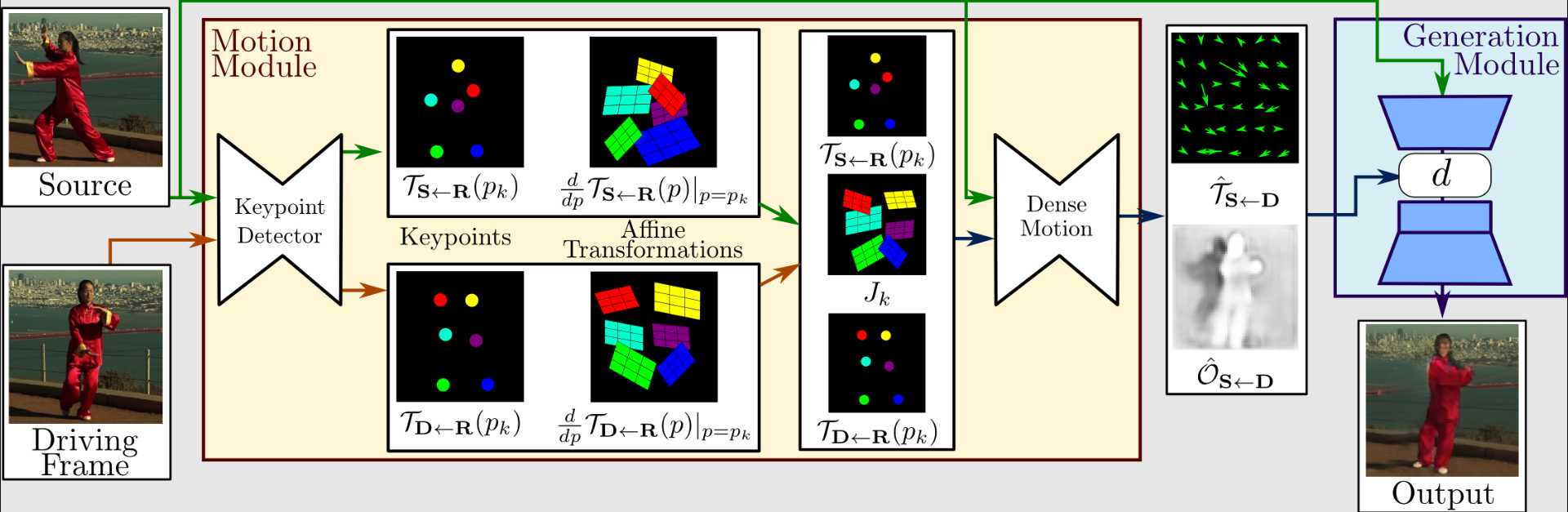

Hayu urang nempo operasi metoda ieu saeutik salajengna. Ékstraksi Gerak sareng Generasi ngadamel satengah munggaran sadaya prosés. Video nyetir sareng gambar sumber dianggo salaku input.

Pikeun ékstraksi répréséntasi gerak urutan kahiji, nu diwangun ku titik konci sparse jeung transformasi affine lokal, hiji extractor gerak ngagunakeun autoencoder pikeun ngaidentipikasi titik konci.

Pikeun nyiptakeun aliran optik anu padet sareng peta occlusion kalayan jaringan gerak anu padet, aranjeunna dianggo sareng video nyetir. Generator teras ngadamel gambar target nganggo kaluaran tina jaringan gerak padet sareng gambar sumber.

Sakuliah dewan, karya ieu ngalakukeun hadé ti kaayaan seni. Ogé ngandung fitur nu model sejen ngan teu boga. Gawéna dina sababaraha jinis gambar, ku kituna anjeun tiasa nerapkeun kana gambar raray, awak, kartun, sareng sajabana, anu saé pisan.

Loba kasempetan anyar dijieun ku ieu. Aspék penting anu sanés tina strategi kami nyaéta ayeuna ngamungkinkeun anjeun ngahasilkeun Deepfakes kualitas luhur nganggo ngan ukur hiji gambar tina obyék target, sami sareng kumaha urang ngalakukeun. YOLO pikeun obyék pangakuan.

Prosés Nyieun modél Deepfake

Tilu prosés dipikabutuh pikeun generasi deepfake: ékstraksi, palatihan, sareng nyiptakeun. Poin utama unggal tahapan ieu sareng kumaha hubunganana sareng prosés sadayana bakal katutupan dina bagian ieu.

Ékstraksi

Deepfakes nganggo jaringan neural jero pikeun ngarobih rupa sareng peryogi seueur data (gambar) pikeun beroperasi leres sareng ngayakinkeun. Prosés ékstraksi nyaéta tahapan dimana sadaya pigura tina klip pidéo diekstrak, raray dikenal, sareng raray teras dijajarkeun pikeun maksimalkeun kinerja.

palatihan

Dina fase latihan, nu jaringan neural bisa ngarobah hiji rupa kana sejen. Gumantung kana ukuran set latihan jeung gadget latihan, latihan bisa nyandak sababaraha jam atawa malah poé.

Pelatihan ngan kedah réngsé sakali, sapertos seueur palatihan jaringan saraf sanés. Sanggeus latihan, modél bakal bisa ngarobah rupa ti jalma A ka jalma B.

ciptaan

Saatos modél dilatih, deepfake tiasa diproduksi. Pigura dicandak tina pidéo teras dijajarkeun ka sadaya rupa. Jaringan saraf anu dilatih teras dianggo pikeun ngarobih unggal pigura.

Beungeut anu dirobih kedah dihijikeun sareng pigura aslina salaku léngkah anu terakhir.

Ngawangun Modél Deteksi Deepfake

Masang sareng Kloning GitHub Repo

Mampuh ngagunakeun GPU Google sacara gratis nalika damel di Colab nguntungkeun pikeun learning jero. Kauntungan tambahan nyaéta kamampuan pikeun masang Google Drive dina mesin virtual awan (VM).

Kalayan aksés gampang kana sadaya barangna, pangguna diaktipkeun. Program anu diperyogikeun pikeun masang Google Drive ka mesin virtual dina méga bakal dipendakan dina bagian ieu.

Impor modul

Ayeuna, urang bakal ngimpor sadaya modul anu diperyogikeun.

Ngalaksanakeun modél

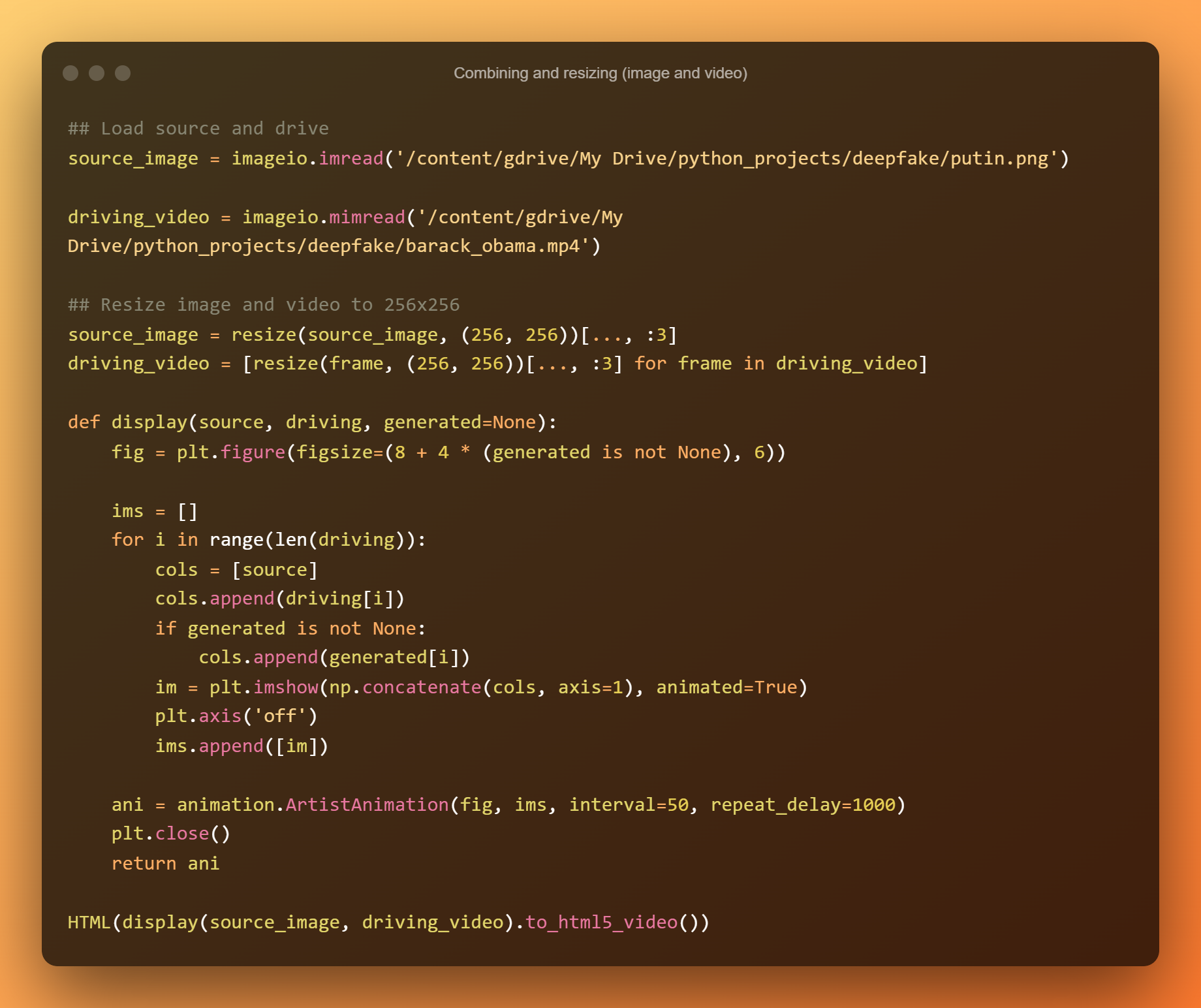

Kami bakal ngagunakeun conto anu ngagabungkeun poto poto Putin (sumber gambar) sareng pidéo Obama. Hasilna nyaéta pidéo Putin nyarios sareng gesticulating kalayan ekspresi wajah anu sami anu dianggo Obama nalika nyetir.

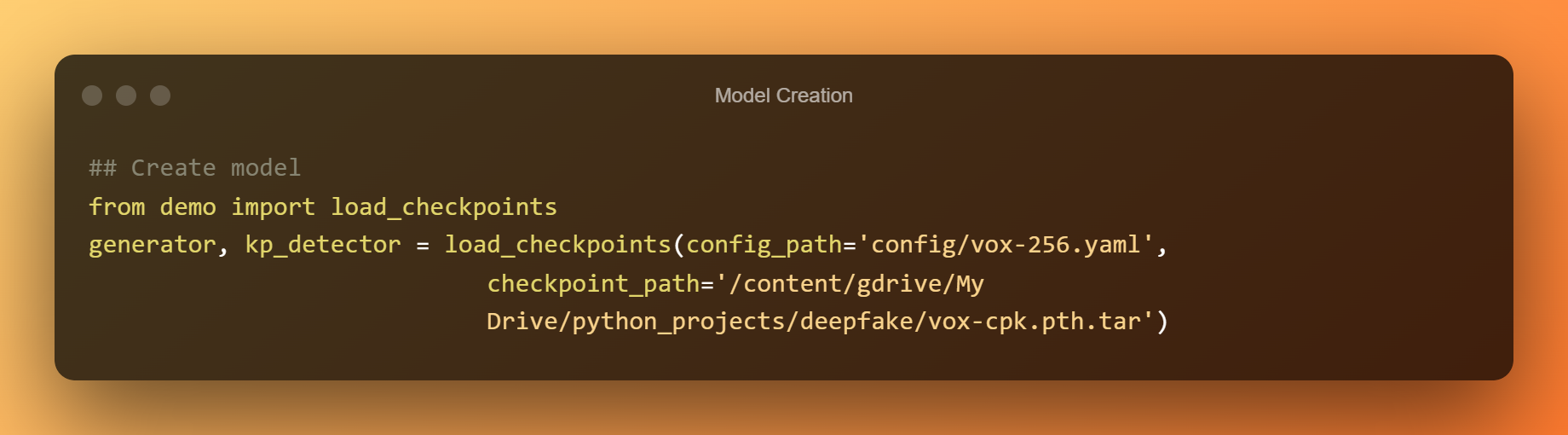

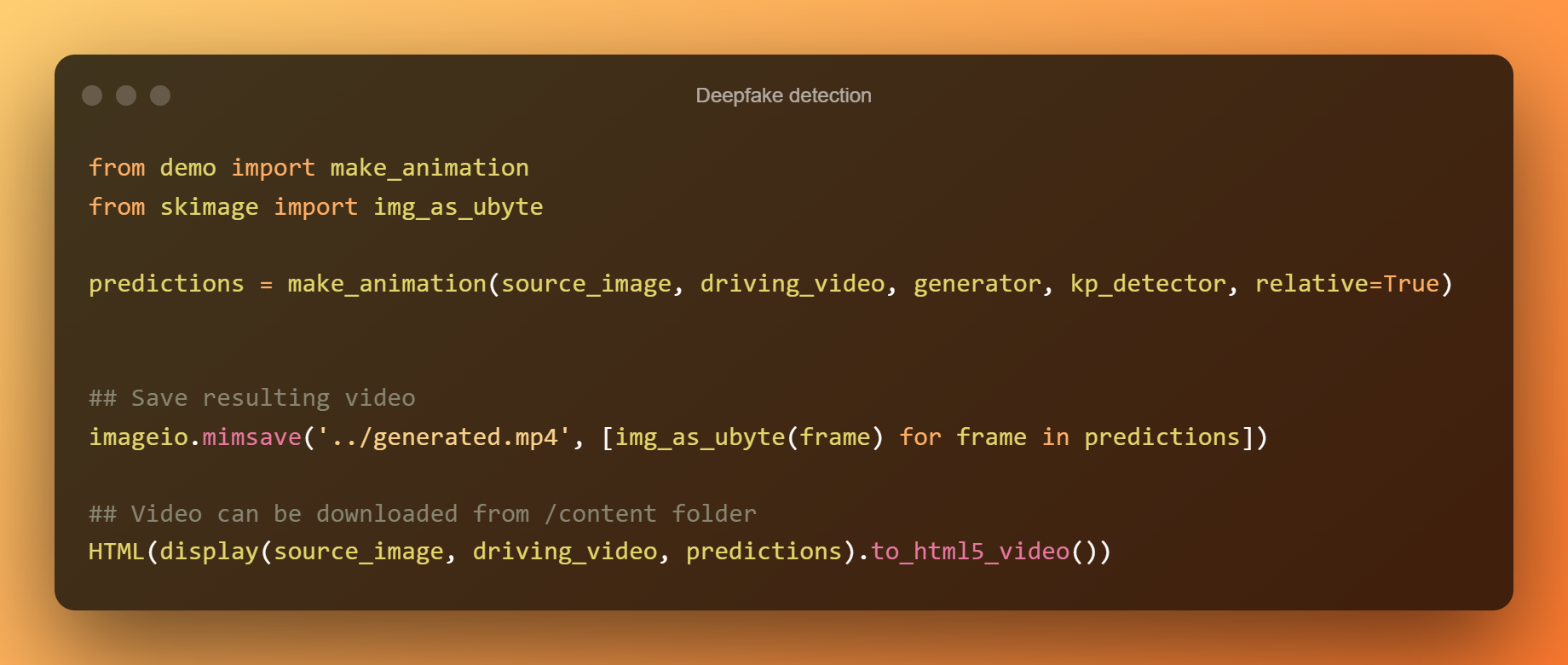

Saacanna mintonkeun hasil model, media bakal dimuat jeung fungsi bakal dinyatakeun. Checkpoints lajeng bakal dimuat tur model bakal diwangun. Saatos nyiptakeun palsu anu jero, dua gaya animasi anu béda bakal ditingalikeun.

Putin dianimasikan ku gerakan Obama ngagunakeun pamindahan titik konci relatif. Cara émosi raray sareng basa awak Obama digambarkeun kalayan saé sareng jelas pikeun Putin salami pidéo na pikaheraneun.

Aya sababaraha kasalahan mikroskopis, khususna nalika Obama ngangkat halisna sareng ngelap panonna. Ungkapan ieu henteu persis ditiru dina pigura Putin.

Tanpa latar tukang palsu, pilem Putin bakal katingalina cukup kredibel sareng otentik upami ditingali dina TV atanapi média sosial.

Nyiptakeun modél

Ayeuna, urang bakal ngagunakeun checkpoints tos dilatih pikeun nyieun model lengkep.

Deteksi Deepfake

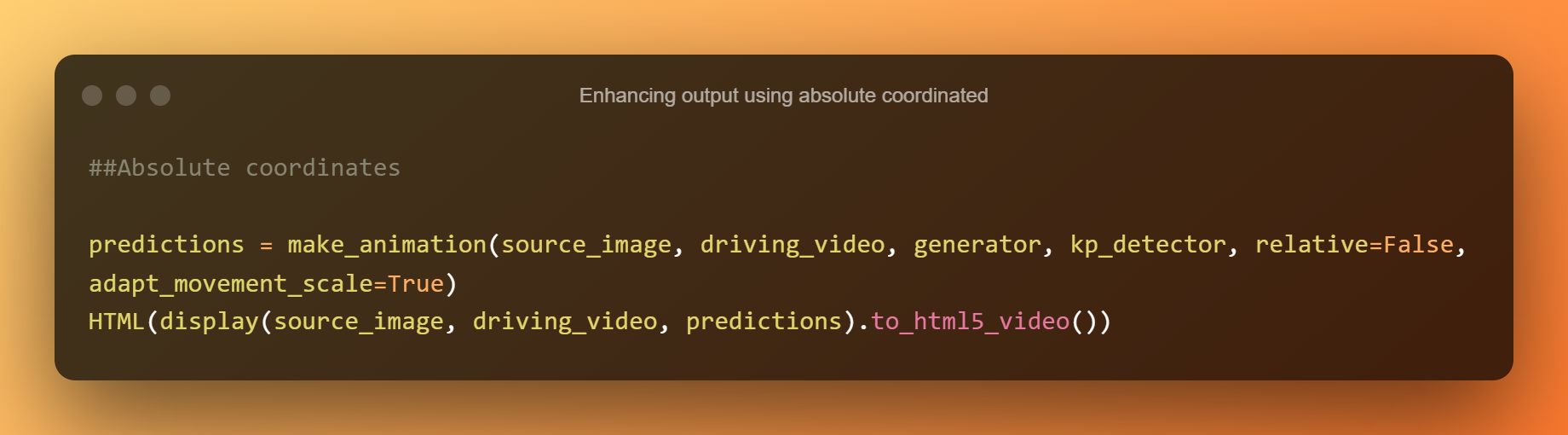

Pamindahan titik konci relatif dipaké pikeun ngahirupkeun item dina sél handap. Sél salajengna ngagunakeun koordinat mutlak gantina, tapi sakabeh babandingan item bakal dicokot tina video nyetir dina fashion ieu.

Ningkatkeun kaluaran nganggo koordinat mutlak

Anjeun bakal tiasa ngembangkeun deteksi deepfake ku cara ieu.

Naon Résiko Téknologi Deepfake?

Pidéo Deepfake ayeuna pikaresepeun sareng ngahibur pikeun ditonton kusabab kabaruanna. Nanging, aya résiko anu tiasa kaluar tina kontrol anu aya dina handapeun permukaan téknologi anu katingalina lucu ieu.

Pasti bakal nangtang ngabedakeun antara video palsu jeung nyata salaku téknologi deepfake terus maju. Pikeun kapribadian anu kasohor sareng selebriti, khususna, ieu tiasa gaduh pangaruh anu parah. Deepfakes anu ngahaja jahat gaduh poténsi pikeun ngarusak karir sareng kahirupan.

Ieu tiasa dianggo ku jalma anu niat jahat pikeun ngaliwat ka batur sareng ngamangpaatkeun babaturan, baraya, sareng batur kerja. Éta ogé sanggup nyababkeun kontrovérsi sadunya bahkan perang nganggo pilem palsu para pamimpin asing.

kacindekan

Kasimpulanana, urang aya dina jaman anu aneh sareng lingkungan anu teu biasa. Langkung ti kantos, saderhana ngahasilkeun warta sareng pilem palsu sareng nyebarkeunana. Ngartos naon anu leres sareng naon anu henteu janten beuki nangtang.

Kiwari, katingalina, urang teu bisa deui ngandelkeun rasa sorangan.

Sanaos kanyataan yén detéktor pidéo palsu parantos dikembangkeun, éta ngan ukur masalah waktos sateuacan celah inpormasi janten sempit bahkan detéktor palsu anu pangsaéna moal tiasa nangtoskeun naha pidéo éta nyata atanapi henteu.

Leave a Reply