Преглед садржаја[Сакрити][Прикажи]

Један од примарних критеријума за било коју врсту корпоративне активности је ефикасно коришћење информација. У неком тренутку обим створених података премашује капацитет основне обраде.

Ту на сцену ступају алгоритми машинског учења. Међутим, пре него што се било шта од овога догоди, информације се морају проучити и протумачити. Укратко, то је оно за шта се користи машинско учење без надзора.

У овом чланку ћемо детаљно испитати машинско учење без надзора, укључујући његове алгоритме, случајеве употребе и још много тога.

Шта је ненадгледано машинско учење?

Алгоритми за машинско учење без надзора идентификују обрасце у скупу података који немају познате или означене последице. Надгледан алгоритми машинског учења имају означени излаз.

Познавање ове разлике помаже вам да разумете зашто се методе машинског учења без надзора не могу користити за решавање проблема регресије или класификације, пошто не знате која може бити вредност/одговор за излазне податке. Не можете нормално да тренирате алгоритам ако не знате вредност/одговор.

Штавише, учење без надзора се може користити за идентификацију основне структуре података. Ови алгоритми откривају скривене обрасце или груписање података без потребе за људском интеракцијом.

Његов капацитет да открије сличности и контрасте у информацијама чини га одличним избором за истраживачку анализу података, технике унакрсне продаје, сегментацију потрошача и идентификацију слика.

Размислите о следећем сценарију: налазите се у продавници и видите неидентификовано воће које никада раније нисте видели. Можете лако да разликујете непознато воће од другог воћа на основу ваших запажања његовог облика, величине или боје.

Алгоритми за машинско учење без надзора

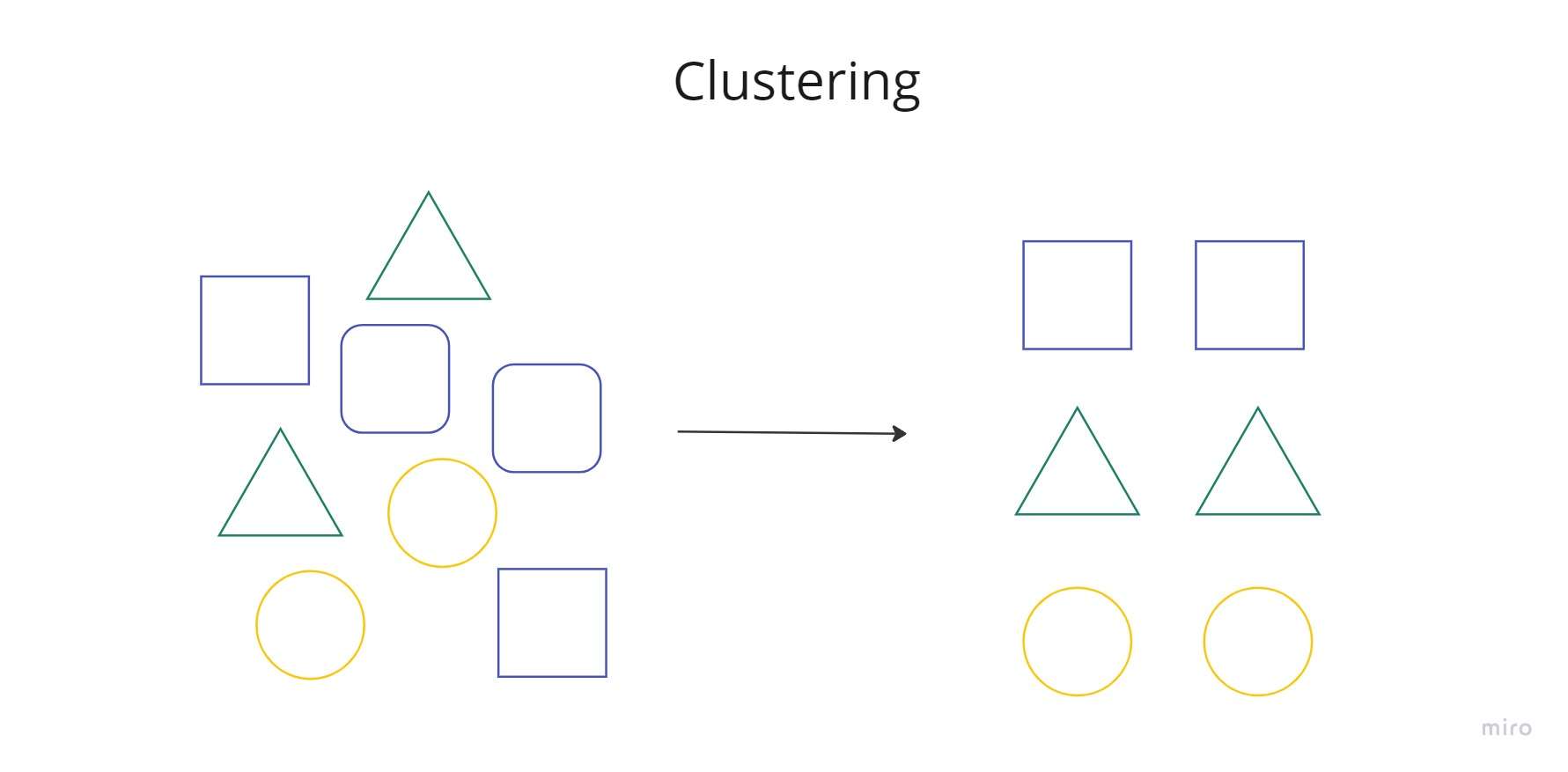

Груписање

Груписање је без сумње најшире коришћени приступ учењу без надзора. Овај приступ ставља повезане ставке података у насумично генерисане кластере.

Сам по себи, МЛ модел открива све обрасце, сличности и/или разлике у некатегорисаној структури података. Модел ће моћи да открије било које природне групе или класе у подацима.

Типови

Постоји неколико облика груписања који се могу користити. Хајде да прво погледамо најважније.

- Ексклузивно груписање, понекад познато као „тврдо” груписање, је врста груписања у којој један податак припада само једном кластеру.

- Груписање које се преклапа, често познато као „меко” груписање, омогућава објектима података да припадају више од једног кластера у различитом степену. Штавише, пробабилистичко груписање може да се користи за решавање проблема са „меким” кластерисањем или проценом густине, као и за процену вероватноће или вероватноће да тачке података припадају одређеним кластерима.

- Стварање хијерархије груписаних ставки података је циљ хијерархијског груписања, као што име каже. Ставке података се деконструишу или комбинују на основу хијерархије за генерисање кластера.

Случајеви употребе:

- Откривање аномалија:

Било која врста одступања у подацима може се открити коришћењем груписања. Компаније у транспорту и логистици, на пример, могу да користе детекцију аномалија да открију логистичке препреке или открију оштећене механичке делове (предвиђено одржавање).

Финансијске институције могу да користе технологију за откривање лажних трансакција и брзо реаговање, потенцијално уштедећи много новца. Сазнајте више о уочавању абнормалности и превара гледајући наш видео.

- Сегментација купаца и тржишта:

Алгоритми груписања могу помоћи у груписању људи који имају сличне карактеристике и стварању личности потрошача за ефикаснији маркетинг и циљане иницијативе.

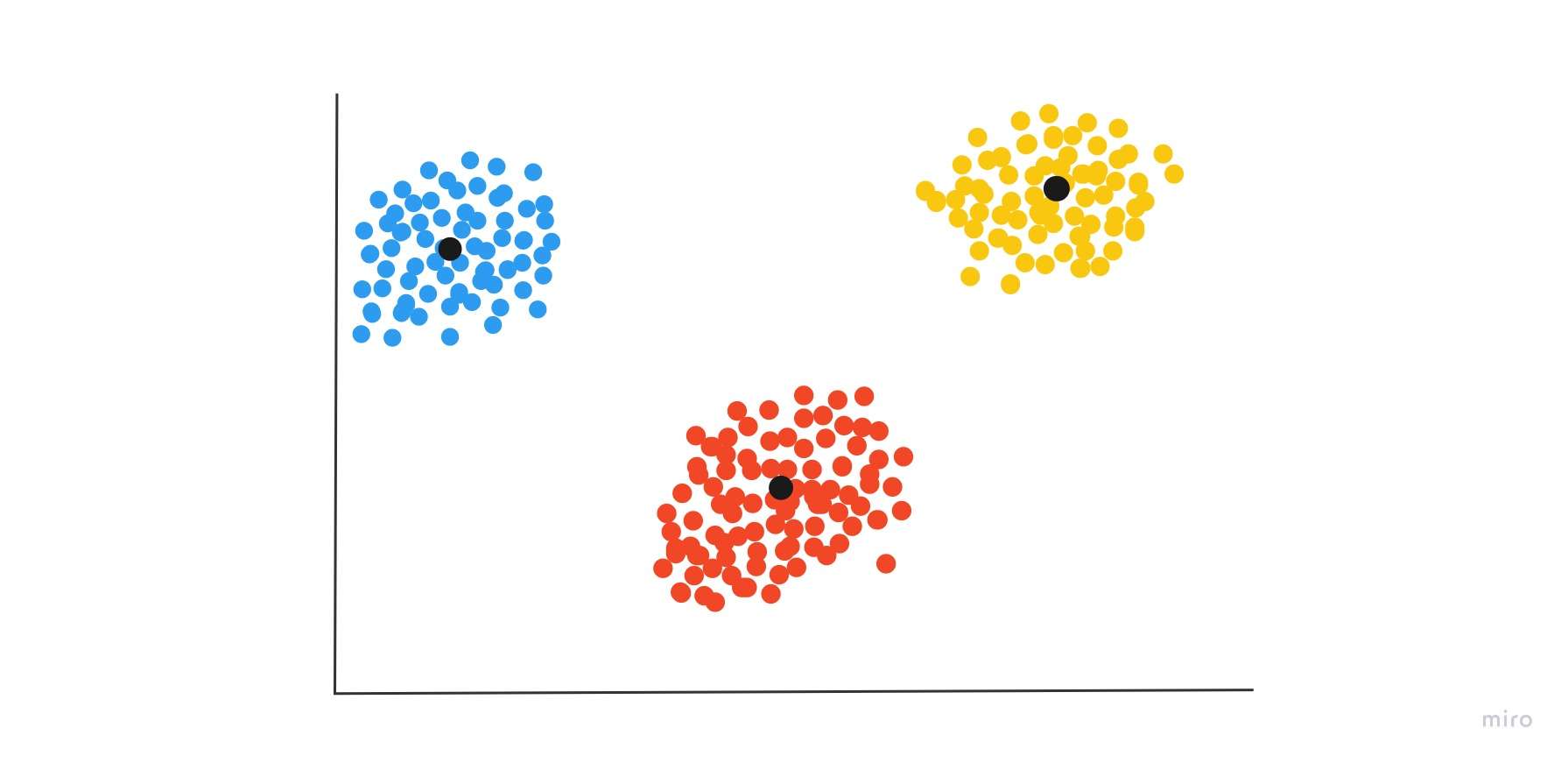

К-Меанс

К-меанс је метода груписања која је такође позната као партиционисање или сегментација. Он дели тачке података у унапред одређени број кластера познатих као К.

У методи К-меанс, К је улаз пошто рачунару говорите колико кластера желите да идентификујете у својим подацима. Свака ставка података се накнадно додељује најближем центру кластера, познатом као центар (црне тачке на слици).

Потоњи служе као простори за складиштење података. Техника груписања се може урадити више пута док се кластери добро не дефинишу.

Фуззи К-значи

Фуззи К-меанс је проширење технике К-меанс, која се користи за преклапање груписања. За разлику од К-меанс технике, фуззи К-меанс указују на то да тачке података могу припадати многим кластерима са различитим степеном близине сваком од њих.

Удаљеност између тачака података и тежишта кластера се користи за израчунавање близине. Као резултат тога, могу постојати случајеви када се различити кластери преклапају.

Гаусови модели мешавине

Модели Гаусове мешавине (ГММ) су метод који се користи у пробабилистичком груписању. Пошто су средња вредност и варијанса непознати, модели претпостављају да постоји фиксни број Гаусових дистрибуција, од којих свака представља посебан кластер.

Да би се утврдило ком кластеру припада одређена тачка података, у суштини се користи метода.

Хијерархијско груписање

Стратегија хијерархијског груписања може почети са сваком тачком података додељеном другом кластеру. Два кластера који су најближи један другом се затим мешају у један кластер. Итеративно спајање се наставља све док само један кластер не остане на врху.

Ова метода је позната као одоздо према горе или агломеративна. Ако почнете са свим ставкама података везаним за исти кластер, а затим вршите поделе све док се свака ставка података не додели као посебан кластер, метод је познат као одозго надоле или хијерархијско груписање подела.

Априори алгоритам

Анализа тржишне корпе је популаризовала априорне алгоритме, што је резултирало различитим машинама за препоруке за музичке платформе и онлајн продавнице.

Користе се у трансакционим скуповима података за проналажење честих скупова ставки или груписања ставки, како би се предвидела вероватноћа потрошње једног производа на основу потрошње другог.

На пример, ако почнем да пуштам радио ОнеРепублиц на Спотифају са „Цоунтинг Старс“, једна од других песама на овом каналу ће сигурно бити песма Имагине Драгон, као што је „Бад Лиар“.

Ово је засновано на мојим претходним навикама слушања, као и на обрасцима слушања других. Априори методе броје скупове ставки користећи хеш стабло, прелазећи скуп података у ширину.

Смањење димензија

Смањење димензионалности је врста учења без надзора које користи колекцију стратегија за минимизирање броја карактеристика – или димензија – у скупу података. Дозволите нам да разјаснимо.

Може бити примамљиво да уградите што више података док креирате свој скуп података за машинско учење. Немојте нас погрешно схватити: ова стратегија добро функционише јер више података обично даје тачније налазе.

Претпоставимо да су подаци ускладиштени у Н-димензионалном простору, при чему свака карактеристика представља другу димензију. Може постојати стотине димензија ако има много података.

Размотрите Екцел табеле, са колонама које представљају карактеристике и редовима који представљају ставке података. Када има превише димензија, МЛ алгоритми могу имати лош учинак и визуелизација података може постати тешко.

Стога је логично ограничити карактеристике или димензије и пренети само релевантне информације. Смањење димензионалности је управо то. Омогућава управљиву количину уноса података без угрожавања интегритета скупа података.

Анализа главне компоненте (ПЦА)

Анализа главне компоненте је приступ смањења димензионалности. Користи се за минимизирање броја функција у огромним скуповима података, што резултира већом једноставношћу података без жртвовања тачности.

Компресија скупа података се постиже методом познатом као екстракција карактеристика. То указује да се елементи из оригиналног скупа мешају у нови, мањи. Ове нове особине су познате као примарне компоненте.

Наравно, постоје додатни алгоритми које можете користити у својим апликацијама за учење без надзора. Горе наведене су само најзаступљеније, због чега се о њима детаљније говори.

Примена ненадгледаног учења

- Методе учења без надзора се користе за задатке визуелне перцепције као што је препознавање објеката.

- Машинско учење без надзора даје критичне аспекте медицинским системима за снимање, као што су идентификација, класификација и сегментација слике, који се користе у радиологији и патологији за брзу и поуздану дијагнозу пацијената.

- Учење без надзора може помоћи да се идентификују трендови података који се могу користити за креирање ефикаснијих стратегија унакрсне продаје користећи раније податке о понашању потрошача. Током процеса плаћања, онлајн предузећа то користе да клијентима предлажу праве додатке.

- Методе учења без надзора могу да пробију огромне количине података да би пронашле одлике. Ове абнормалности могу да изазову обавештење о неисправној опреми, људској грешци или кршењу безбедности.

Проблеми са учењем без надзора

Учење без надзора је привлачно на различите начине, од потенцијала за проналажење важних увида података како би се избегло скупо обележавање података операције. Међутим, постоји неколико недостатака коришћења ове стратегије за обуку модели машинског учења тога треба да будете свесни. Ево неколико примера.

- Како улазним подацима недостају ознаке које служе као кључеви одговора, резултати модела учења без надзора могу бити мање прецизни.

- Учење без надзора често функционише са огромним скуповима података, што може повећати сложеност рачунара.

- Приступ захтева потврду излаза од стране људи, било интерних или екстерних стручњака за предмет истраживања.

- Алгоритми морају да испитају и израчунају сваки могући сценарио током фазе обуке, што траје неко време.

Zakljucak

Ефикасно коришћење података је кључ за успостављање конкурентске предности на одређеном тржишту.

Можете сегментирати податке помоћу алгоритама за машинско учење без надзора да бисте испитали преференције ваше циљне публике или да бисте утврдили како одређена инфекција реагује на одређени третман.

Постоји неколико практичних примена, и научници за податке, инжењери и архитекте могу вам помоћи у дефинисању ваших циљева и развоју јединствених МЛ решења за вашу компанију.

Ostavite komentar