Содержание[Скрывать][Показывать]

Для сбора информации с веб-сайтов для анализа, исследования или маркетинговых целей веб-скрапинг является решающим методом. К счастью, существует множество инструментов, поддерживающих как безголовые, так и головные браузеры, и оба они полезны для парсинга веб-страниц.

Headful-браузеры поставляются с графическим пользовательским интерфейсом (GUI), а headless-браузеры — нет. Эти технологии могут как вручную, так и автоматически извлекать данные с веб-страниц, что делает их очень полезными.

При обработке большого количества данных безголовые браузеры — лучший вариант. Чтобы автоматизировать процесс извлечения данных, вам понадобятся эти инструменты, которые сэкономят вам массу времени и усилий.

Кроме того, они помогают повысить точность и эффективность извлечения данных, что в целом может привести к более полезным результатам.

Эти инструменты также могут помочь снизить вероятность возникновения ошибок при ручном копировании и вставке данных, поскольку они позволяют извлекать данные упорядоченным образом.

Проще говоря, невозможно работать без инструментов, поддерживающих как headless, так и headful браузеры, если вы занимаетесь веб-скрапингом.

В этой статье мы рассмотрим лучшие безголовые и головные браузеры для парсинга веб-страниц.

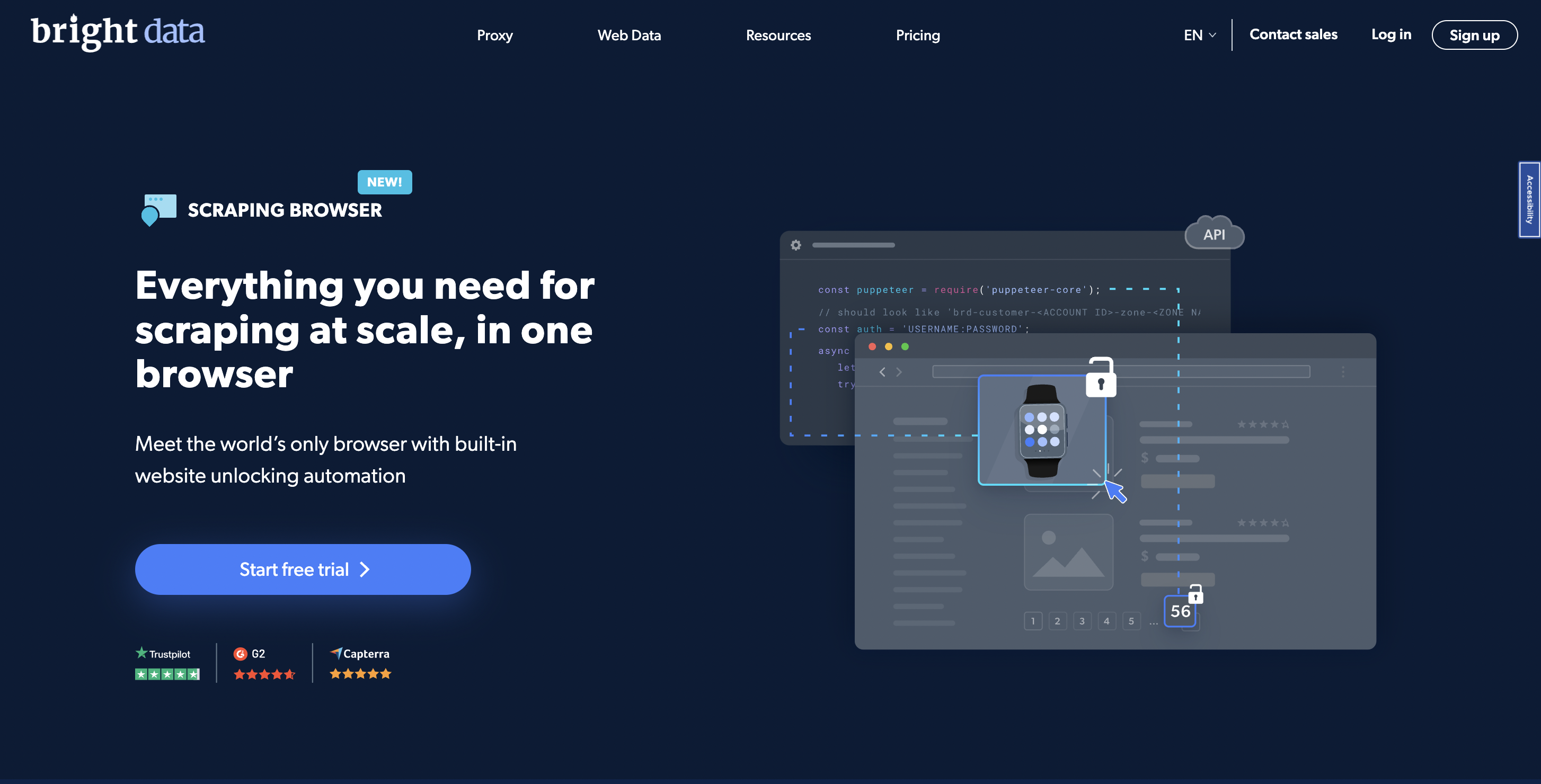

1. .

Bright Data — это программа веб-скрапинга, которая предоставляет выбор для сбора данных для компаний и частных лиц. В отличие от более ранних онлайн-систем парсинга, Bright Data поставляется с предустановленным рядом браузеров, но работает как автономный браузер.

Несмотря на то, что на серверной части он работает как безголовый браузер, это указывает на тот факт, что пользователи могут взаимодействовать с ним через графический интерфейс пользователя (GUI), что делает его более доступным и удобным для пользователя.

Эта функциональность будет особенно полезна для тех, кто мало что знает о кодировании или хочет более простой подход к парсингу веб-страниц. Пользователи могут быстро перемещаться по сложным веб-сайтам с взаимодействием, подобным человеческому, благодаря браузеру Bright Data.

Чтобы вы оставались анонимными и незамеченными, он также предоставляет передовые возможности, такие как ротация IP-адресов, снятие отпечатков пальцев в браузере и подделка пользовательского агента. С помощью ИИ Scraping Browser сможет превзойти даже самые передовые средства защиты от ботов.

Фактически, Scraping Browser настолько сложен, что может даже имитировать действия браузера настоящего пользователя, предоставляя вам более успешные результаты и точные данные.

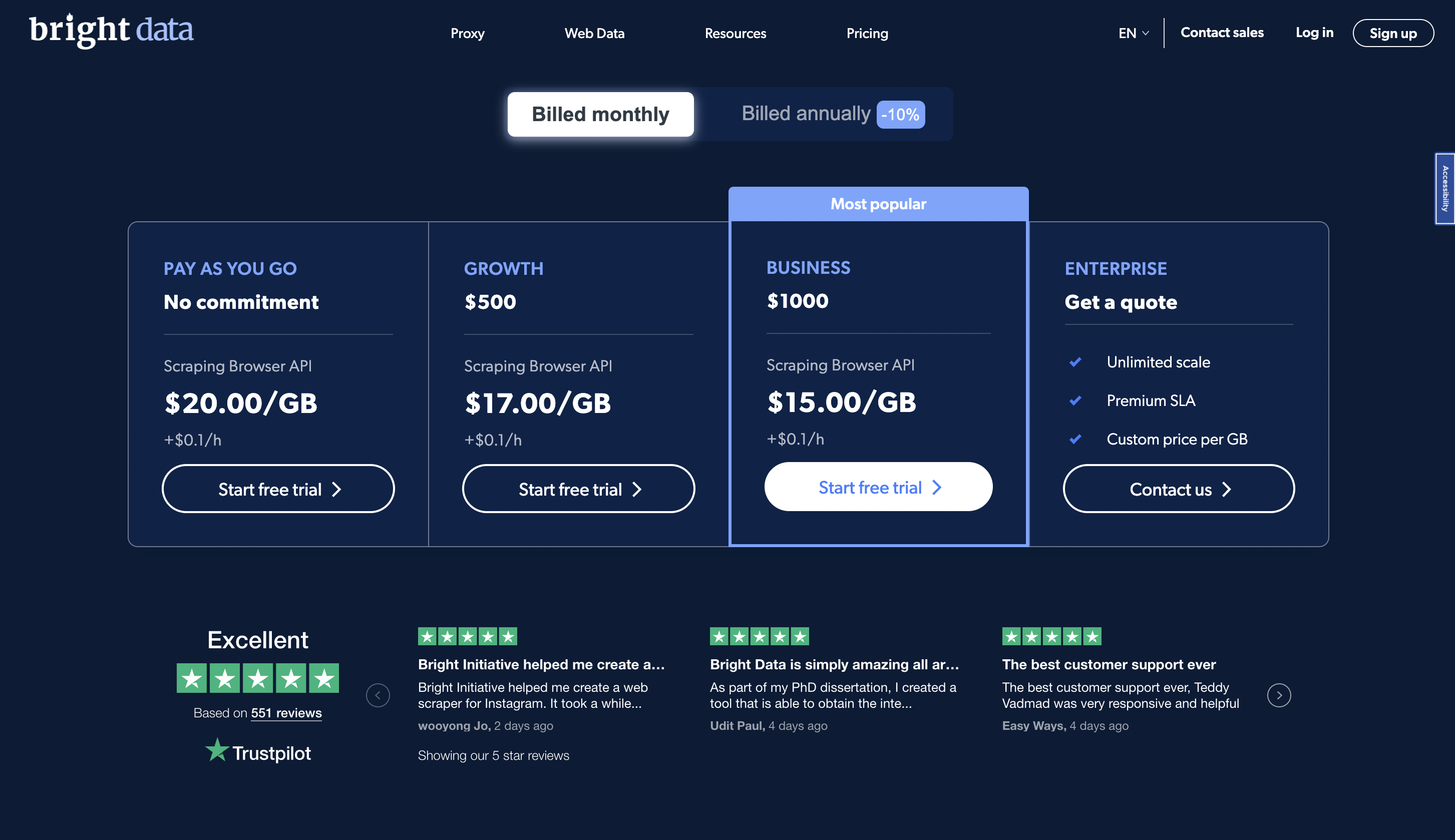

Цены

Вы можете попробовать платформу бесплатно, а премиальные цены начинаются от 20 долларов США за ГБ в плане оплаты по мере использования.

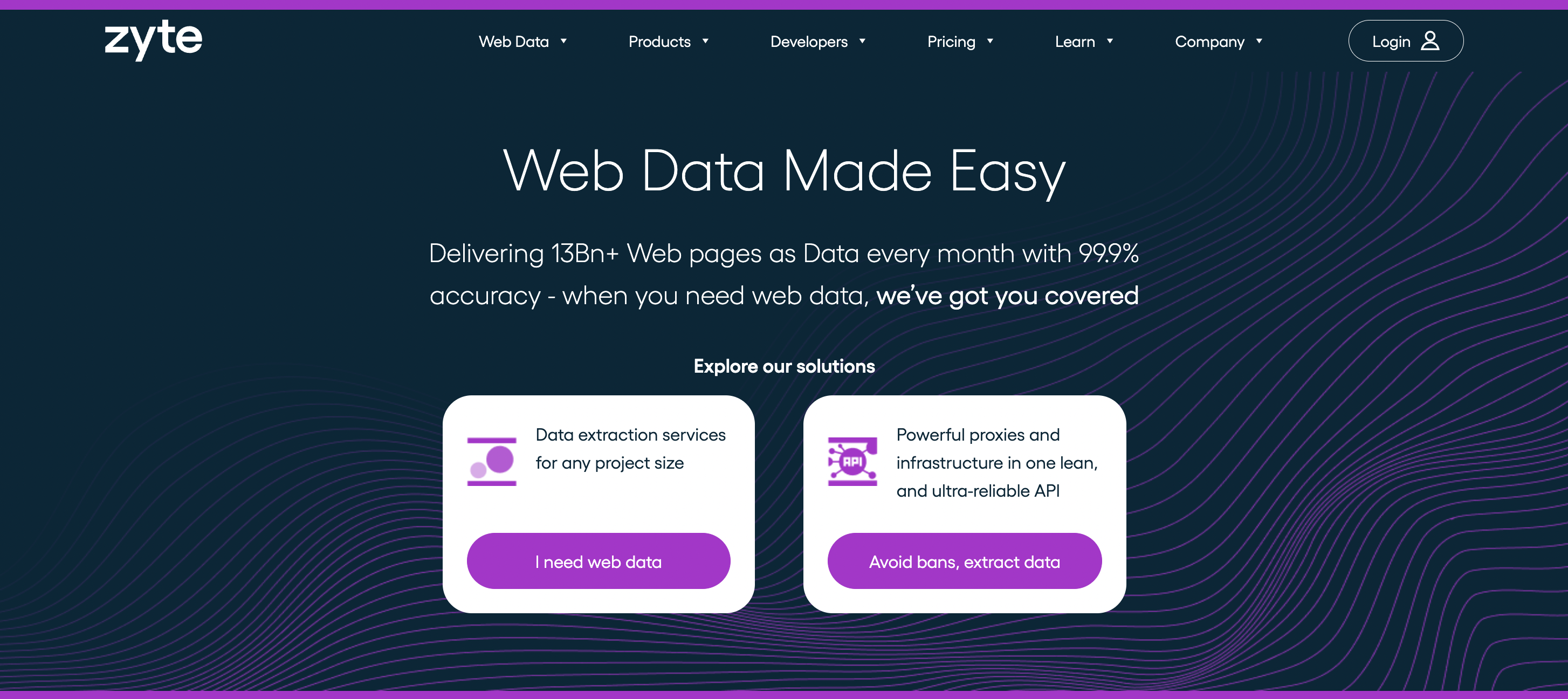

2. Зайт

Являясь поставщиком онлайн-инструментов для парсинга, Zyte, ранее известный как Scrapinghub, позволяет компаниям собирать и анализировать интернет-данные в больших масштабах.

Онлайн-платформа парсинга Zyte создана для обработки даже самых сложных и динамичных веб-сайтов и включает в себя множество передовых функций, таких как автоматическая ротация IP-адресов, снятие отпечатков пальцев браузера и подмена пользовательского агента, чтобы гарантировать, что ваши операции парсинга останутся конфиденциальными и незамеченными.

Тот факт, что платформа парсинга веб-страниц Zyte поддерживает режимы безголового и безголового серфинга, является одним из ее отличительных преимуществ. Браузер работает в автономном режиме в фоновом режиме без графического пользовательского интерфейса, что повышает его эффективность при обширных операциях очистки.

Однако браузер работает с графическим интерфейсом в режиме заголовка, который может быть полезен, когда вам нужно извлекать данные с веб-сайтов со сложными пользовательскими интерфейсами.

Кроме того, поскольку платформа Zyte основана на бесплатной основе Scrapy с открытым исходным кодом, ее можно адаптировать для удовлетворения ваших конкретных потребностей и чрезвычайно гибко настраивать. Вы можете быстро и просто получить нужные данные с помощью Zyte, что обеспечит вам конкурентное преимущество в вашем бизнесе.

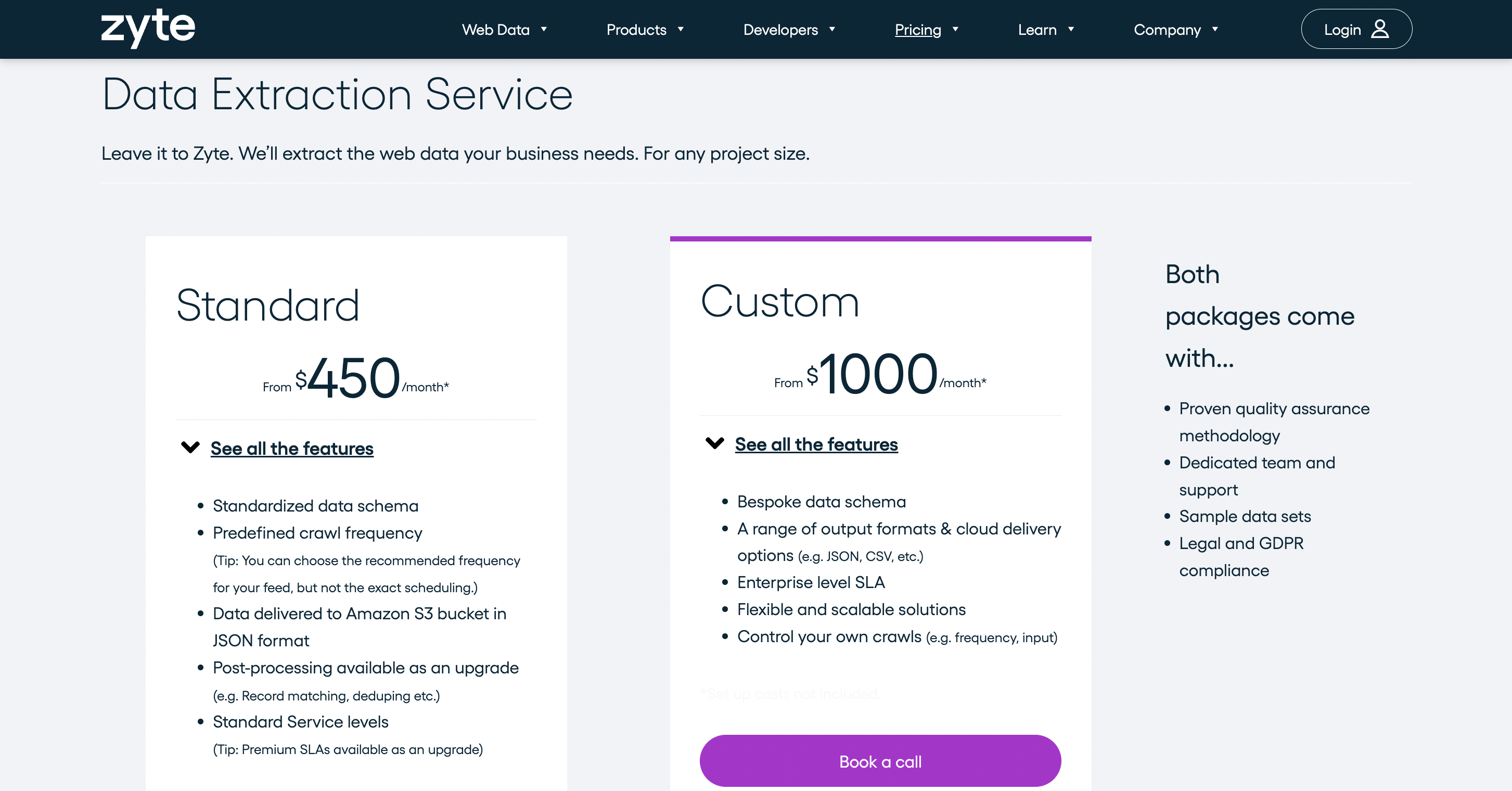

Цены

Он предлагает несколько тарифных планов и взимает 450 долларов в месяц за услугу извлечения данных.

3. Осьминога

Вы можете собирать данные с веб-страниц без написания кода с помощью Octoparse, облачного приложения для парсинга веб-страниц. Любой, кто хочет очистить текст, фотографии или видео, может легко выбрать их благодаря удобному интерфейсу.

Octoparse — это гибкий инструмент, который поддерживает как безголовый, так и головной просмотр, это лучший вариант для парсинга веб-проектов любого размера и сложности. Возможность парсить динамические и интерактивные веб-страницы, что может быть сложно для многих других программ парсинга веб-страниц, является одной из его самых сильных характеристик.

Вы можете создавать сложные процессы очистки с многочисленными фазами, условными операторами и циклами, повышая гибкость и настраиваемость очистки. Excel, CSV и SQL — это лишь некоторые из форматов экспорта, предоставляемых Octoparse, что упрощает использование извлеченных данных в других программах.

Кроме того, Octoparse имеет встроенный пул прокси-серверов, который обеспечивает анонимный сбор данных и помогает избежать блокировки IP-адресов.

Цены

Вы можете начать использовать его бесплатно, а премиум-цена начинается с 89 долларов в месяц.

4. апифай

Apify — это платформа «все-в-одном» для парсинга и автоматизации, которая предлагает множество мощных функций. Он поддерживает как безголовые, так и головные браузеры и имеет интуитивно понятный пользовательский интерфейс, который позволяет даже нетехническим пользователям создавать задачи очистки.

Способность Apify справляться со сложными заданиями по очистке, поддержка нескольких языков и масштабирование для работы с крупномасштабными проектами по очистке являются одними из его лучших функций.

Кроме того, Apify предоставляет доступ к огромному рынку готовых парсеров, которые можно быстро настроить в соответствии с вашими уникальными требованиями.

Благодаря поддержке безголовых браузеров Apify может перемещаться по сложным пользовательским интерфейсам и собирать данные с динамических веб-сайтов, быстро и эффективно извлекая информацию из огромных объемов данных.

Apify — это полезный инструмент для различных онлайн-приложений, включая генерацию потенциальных клиентов, конкурентный анализ, исследование рынка и агрегацию контента.

Apify повышает точность и эффективность, экономя время и усилия за счет автоматизации процесса извлечения данных. Это мощный инструмент как для технических, так и для нетехнических пользователей благодаря своей функциональности и удобному дизайну.

Цены

Вы можете начать использовать его бесплатно, а премиум-цена начинается с 49 долларов в месяц.

5. Соскоб

Выдающееся онлайн-приложение для парсинга ScrapingBee упрощает автоматизацию процесса извлечения данных с веб-сайтов.

Его возможности, такие как обработка рендеринга JavaScript, разрешение CAPTCHA и ротация агентов пользователя, позволяют обойти защиту веб-сайтов от скрейпинга. следовательно, это отличный вариант для задач по очистке веб-страниц.

Пользователи имеют большую степень свободы с этим инструментом, потому что он работает как с автономными, так и с головными браузерами. Важно отметить, что ScrapingBee по умолчанию использует безголовые браузеры, которые идеально подходят для автоматического извлечения огромных объемов данных.

Чтобы взаимодействовать с веб-сайтами со сложным интерфейсом, пользователи могут переключиться на браузеры с головокружением. Чтобы обеспечить эффективное извлечение данных, ScrapingBee также поддерживает пул геолоцированных прокси, которые регулярно проверяются и изменяются.

Пользователи могут сократить время и усилия во время парсинга веб-страниц, используя ScrapingBee в качестве автономного или автономного браузера, при этом гарантируя правильность и полноту извлеченных данных. Он также имеет множество полезных функций, таких как форматирование данных, ротация прокси-серверов и подключение к API, что делает его удобным инструментом как для компаний, так и для студентов.

Цены

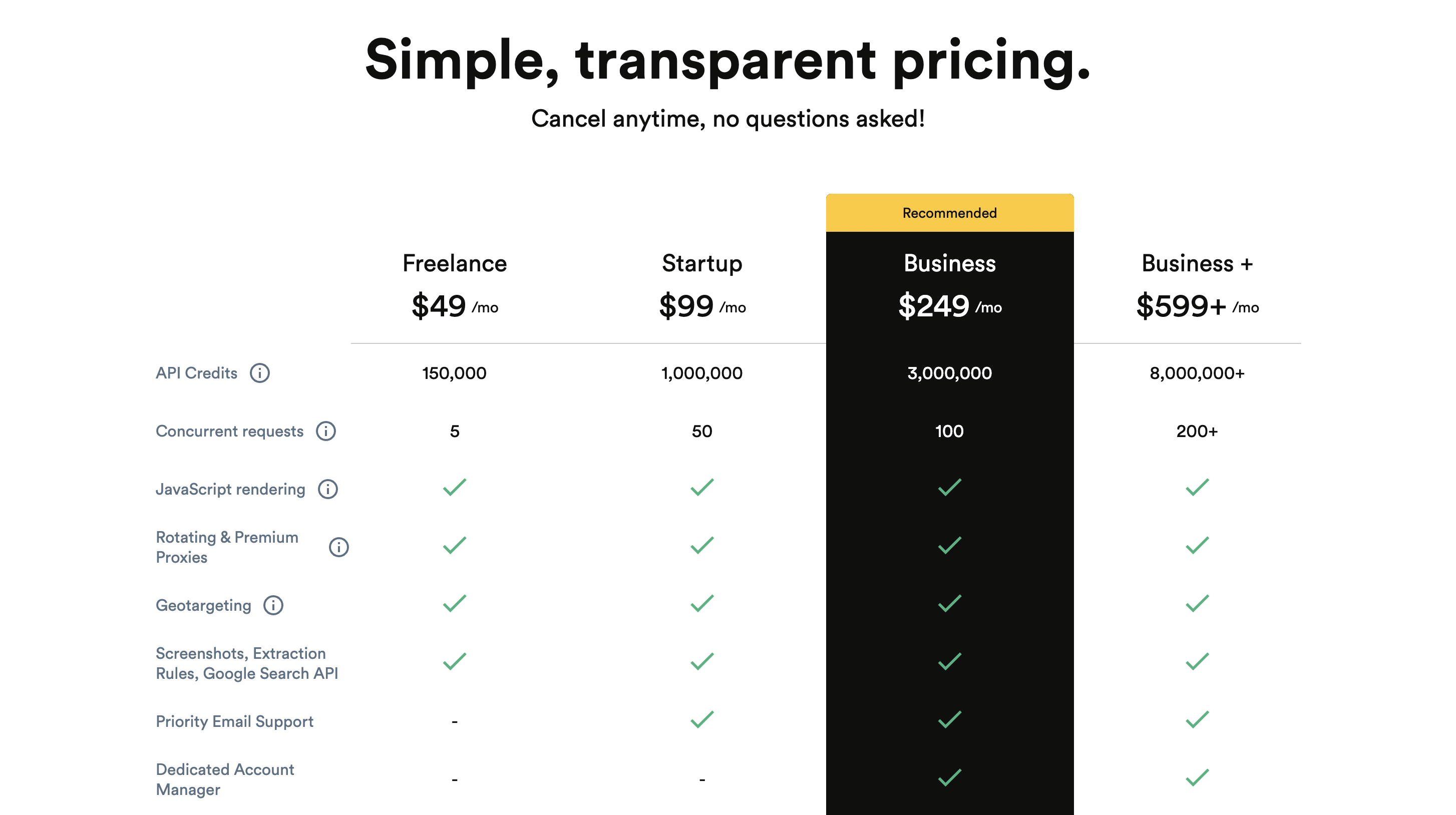

Премиум-цена начинается от 49 долларов в месяц.

6. ParseHub

Не требуя технических знаний, пользователи могут собирать данные с веб-сайтов с помощью приложения для парсинга веб-страниц ParseHub. Одной из его главных характеристик является простота использования; пользователи могут выбирать данные, которые они хотят очистить, просто нажимая на элементы.

Кроме того, он имеет возможность автоматически распознавать нумерацию страниц, что упрощает пользователям сбор информации с нескольких страниц. Чтобы собирать данные с веб-сайтов с простым или сложным пользовательским интерфейсом, ParseHub поддерживает как безголовые, так и головные браузеры.

Кроме того, он обеспечивает автоматическую ротацию IP-адресов, что затрудняет идентификацию веб-сайтов и запрет на скрейпинг. ParseHub гарантирует, что данные извлекаются упорядоченным образом с помощью обширных возможностей форматирования данных, что упрощает анализ и системную интеграцию.

Кроме того, ParseHub имеет интеллектуальный режим, который автоматически распознает и собирает информацию с похожих веб-сайтов. ParseHub может распознавать и собирать данные с веб-сайтов с похожей структурой, таких как веб-сайты электронной коммерции, используя искусственный интеллект (ИИ). Эта функция повышает точность и производительность, требуя меньше усилий и экономя время.

Цены

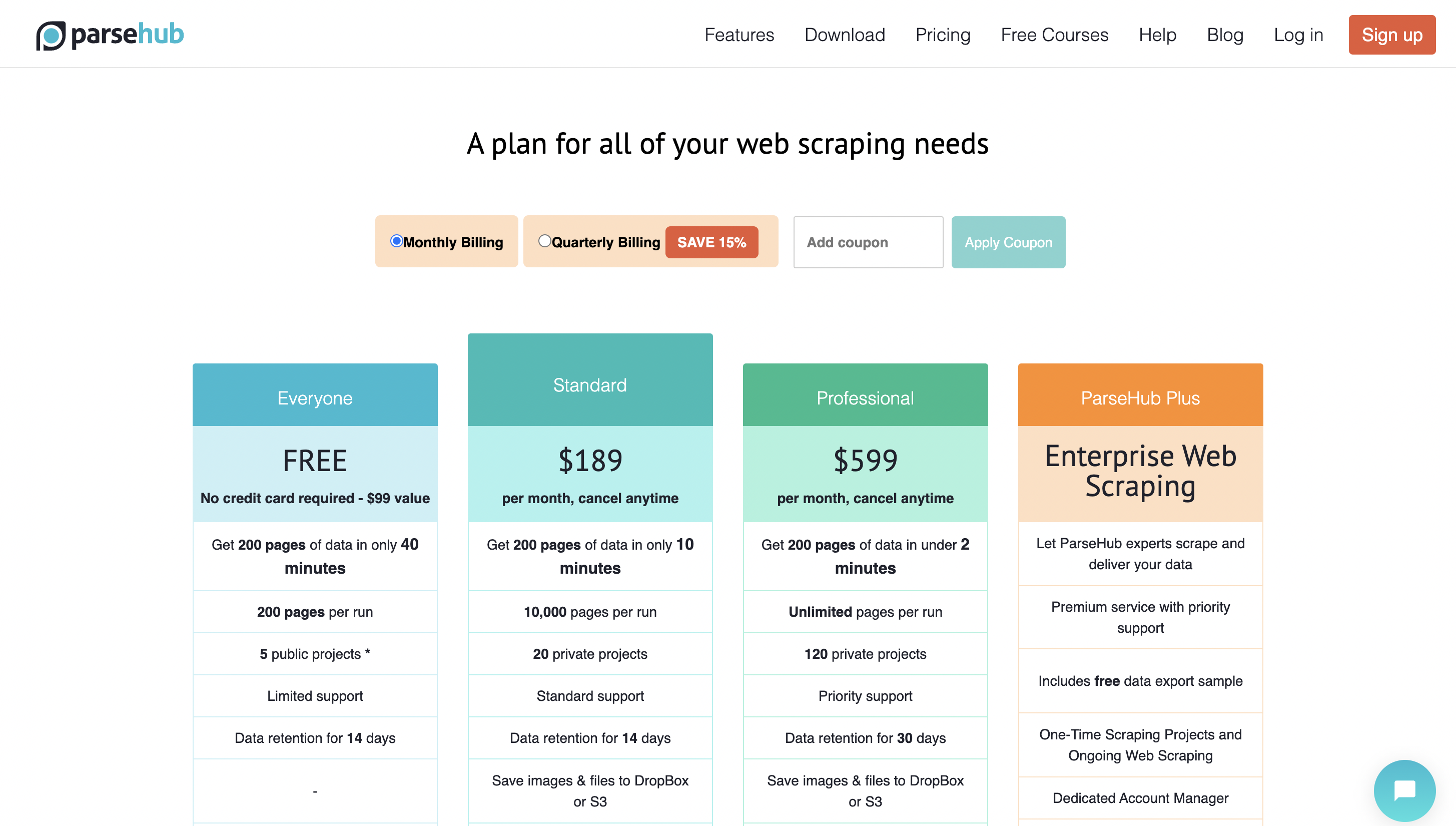

Вы можете начать использовать его бесплатно, а премиум-цена начинается с 189 долларов в месяц.

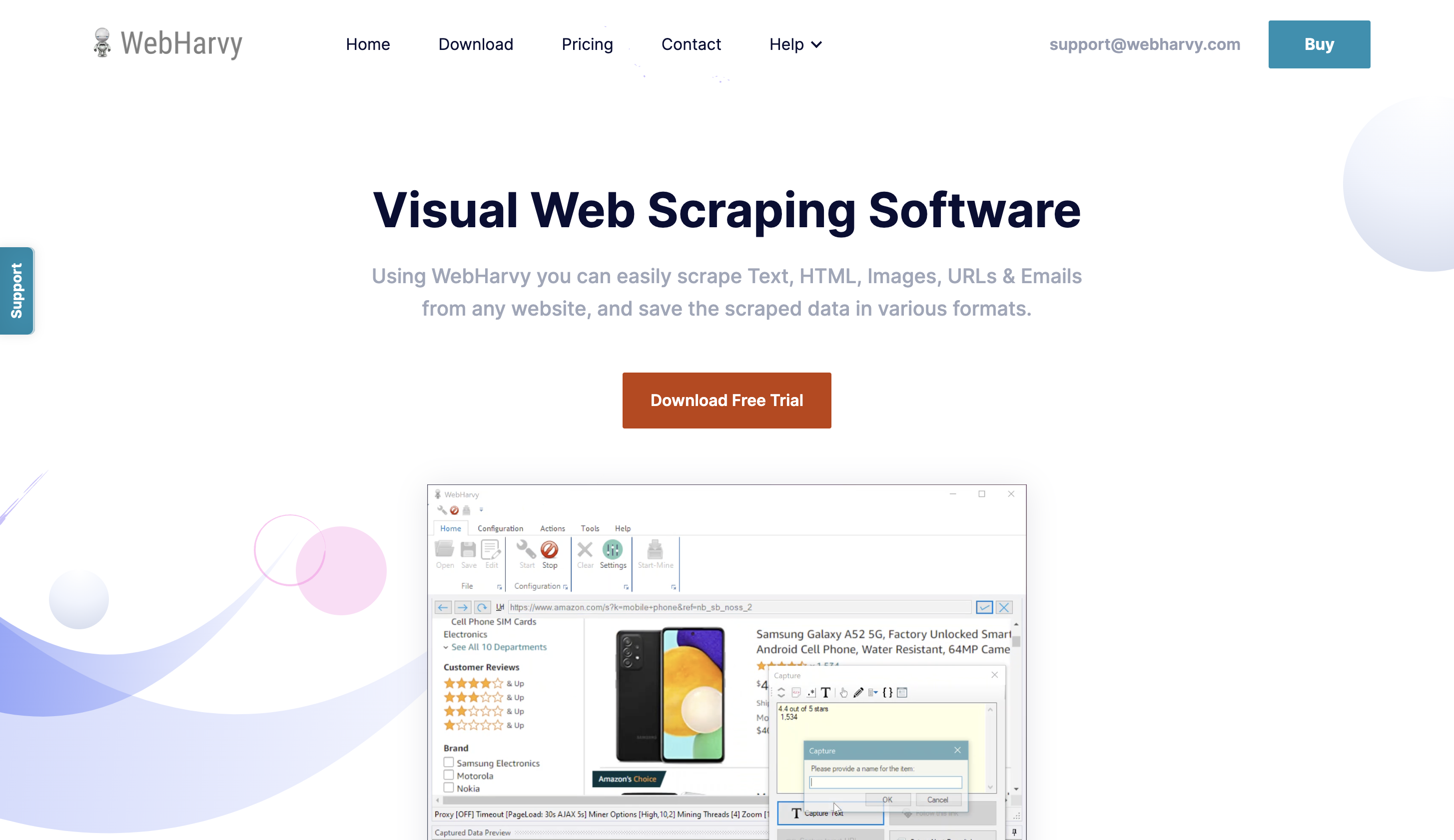

7. ВебХарви

WebHarvy — это мощный онлайн-инструмент для сбора данных, который позволяет организациям быстро, точно и эффективно собирать данные с веб-сайтов. Он предназначен для сбора информации со многих веб-сайтов, включая поисковые системы, социальные сети, сайты электронной коммерции и каталоги.

Без какого-либо предварительного опыта программирования пользователи могут легко исследовать и создавать задания по очистке благодаря удобному интерфейсу. Одной из самых больших характеристик WebHarvy является его способность извлекать данные с веб-страниц на основе JavaScript и AJAX, к которым другие инструменты очистки могут не иметь доступа.

Кроме того, он предлагает интерфейс «укажи и щелкни», который упрощает выбор информации с веб-страницы, которую вы хотите очистить. WebHarvy имеет режимы безголового и безголового просмотра. Для более быстрого и эффективного извлечения данных он может работать в автономном режиме.

Режим Headful полезен при работе со сложными веб-сайтами, требующими ввода данных пользователем. Он также может перемещаться между многочисленными страницами и заполнять формы, что полезно при извлечении данных с веб-сайтов с несколькими страницами.

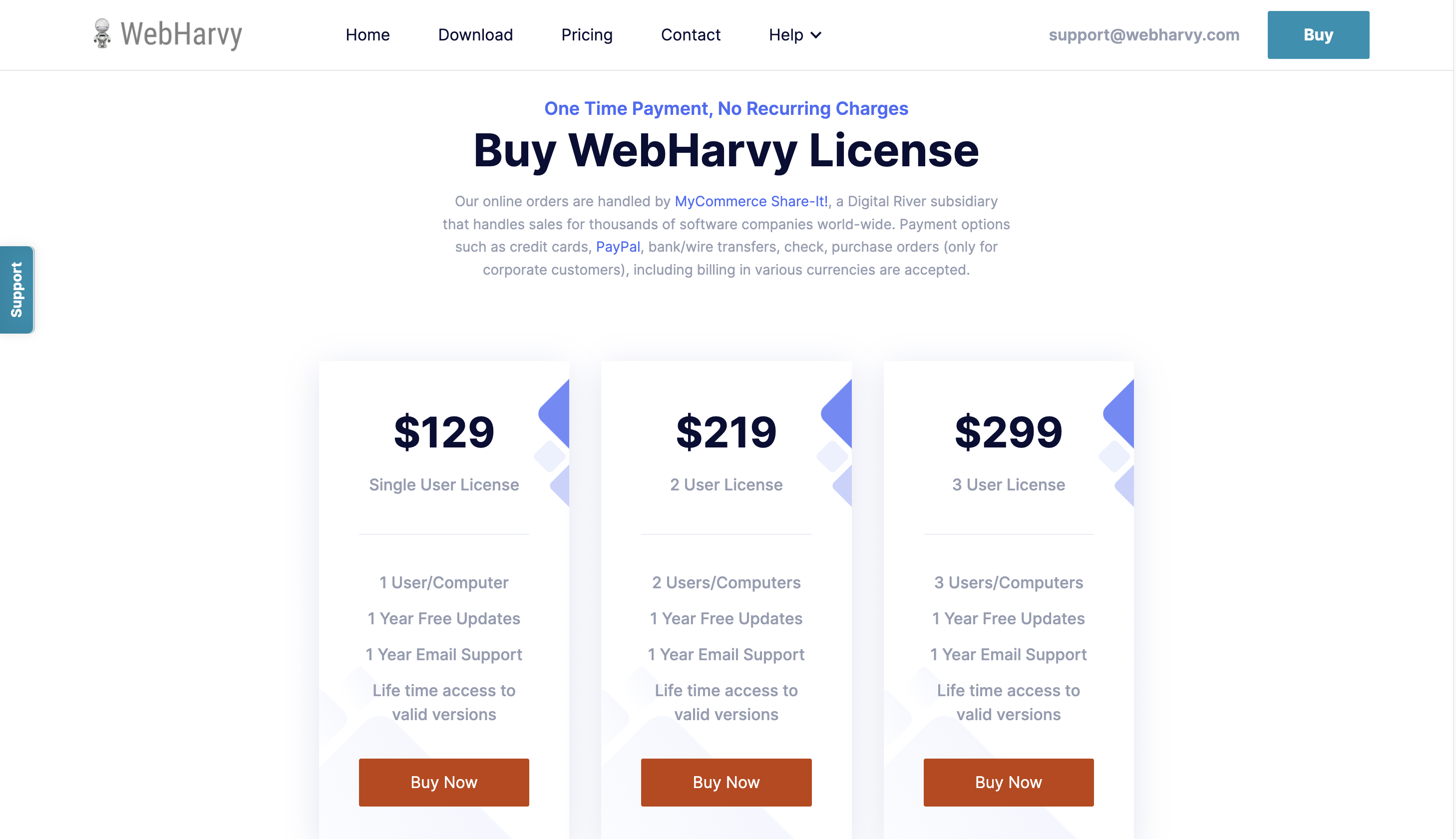

Цены

Премиум-цена начинается от 129 долларов за однопользовательскую лицензию.

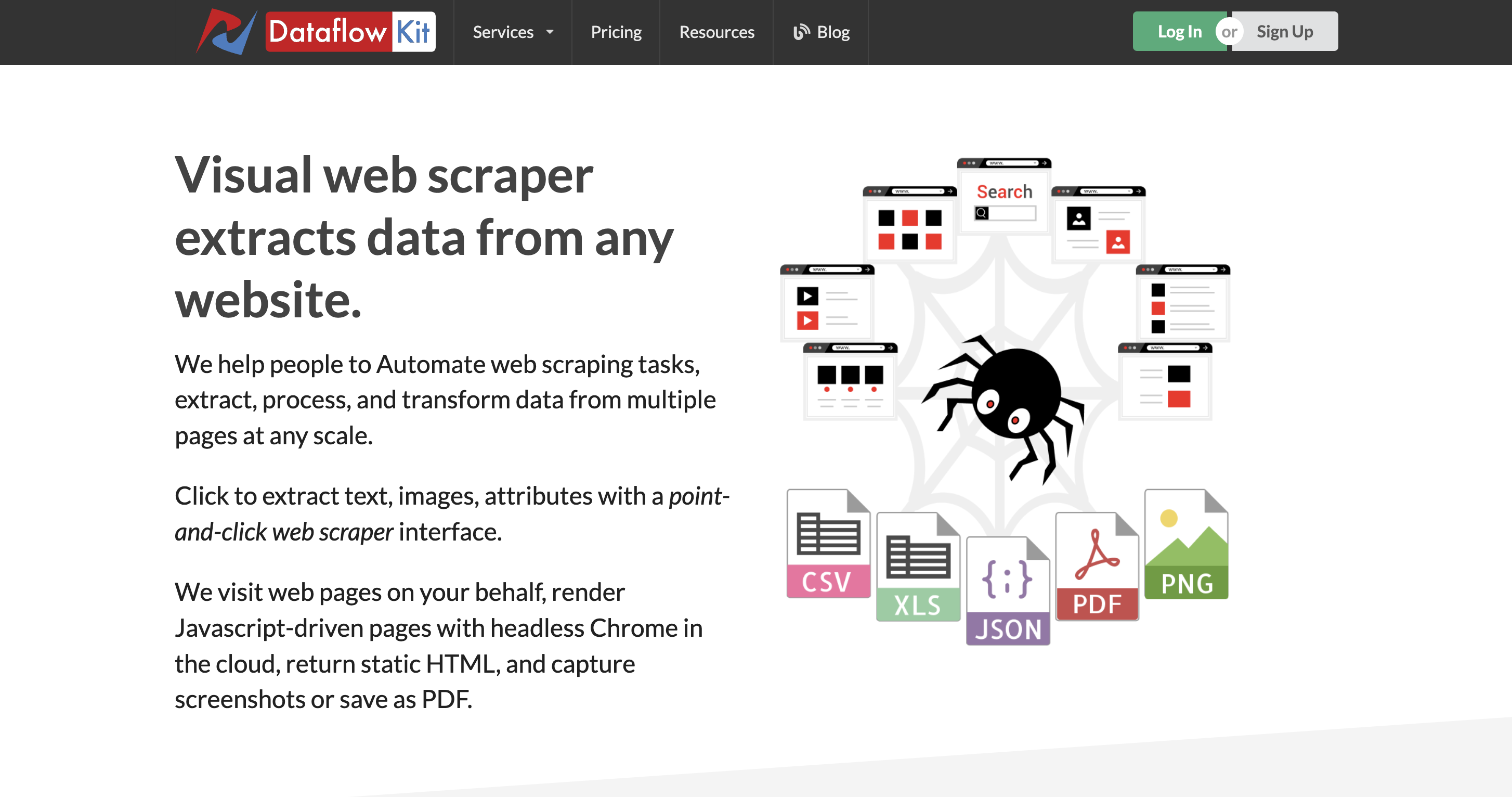

8. Комплект потока данных

Используя Dataflow Kit, надежный онлайн-инструмент для парсинга, можно собирать и анализировать данные с различных веб-сайтов, включая социальные сети сайты, поисковые системы, сайты электронной коммерции и новостные сайты. Одной из его лучших особенностей является способность быстро и эффективно собирать данные со сложных динамических веб-сайтов.

Он идеально подходит для очистки веб-сайтов, к которым сложно получить доступ с помощью других методов, поскольку он очень прост в использовании. Безголовый браузер и головной браузер работают с Dataflow Kit. Расширенные функции, такие как ротация прокси-сервера и пользовательского агента, предотвращение блокировки IP-адресов и обнаружение ботов, обеспечивают эффективную очистку.

Кроме того, он предлагает удобный интерфейс, который позволяет клиентам создавать, планировать и управлять своими действиями по извлечению данных без какого-либо опыта программирования. Для крупномасштабных веб-приложений его эффективный механизм парсинга является фантастическим решением, поскольку он оптимизирован для быстрой и эффективной обработки данных.

Собранные данные можно просто экспортировать в различные форматы, включая CSV, JSON и XML, что позволяет анализировать и использовать их любым удобным для вас способом. Кроме того, Dataflow Kit предоставляет различные варианты интерфейса, включая API и Zapier, которые помогут вам оптимизировать рабочий процесс и автоматизировать процесс извлечения данных.

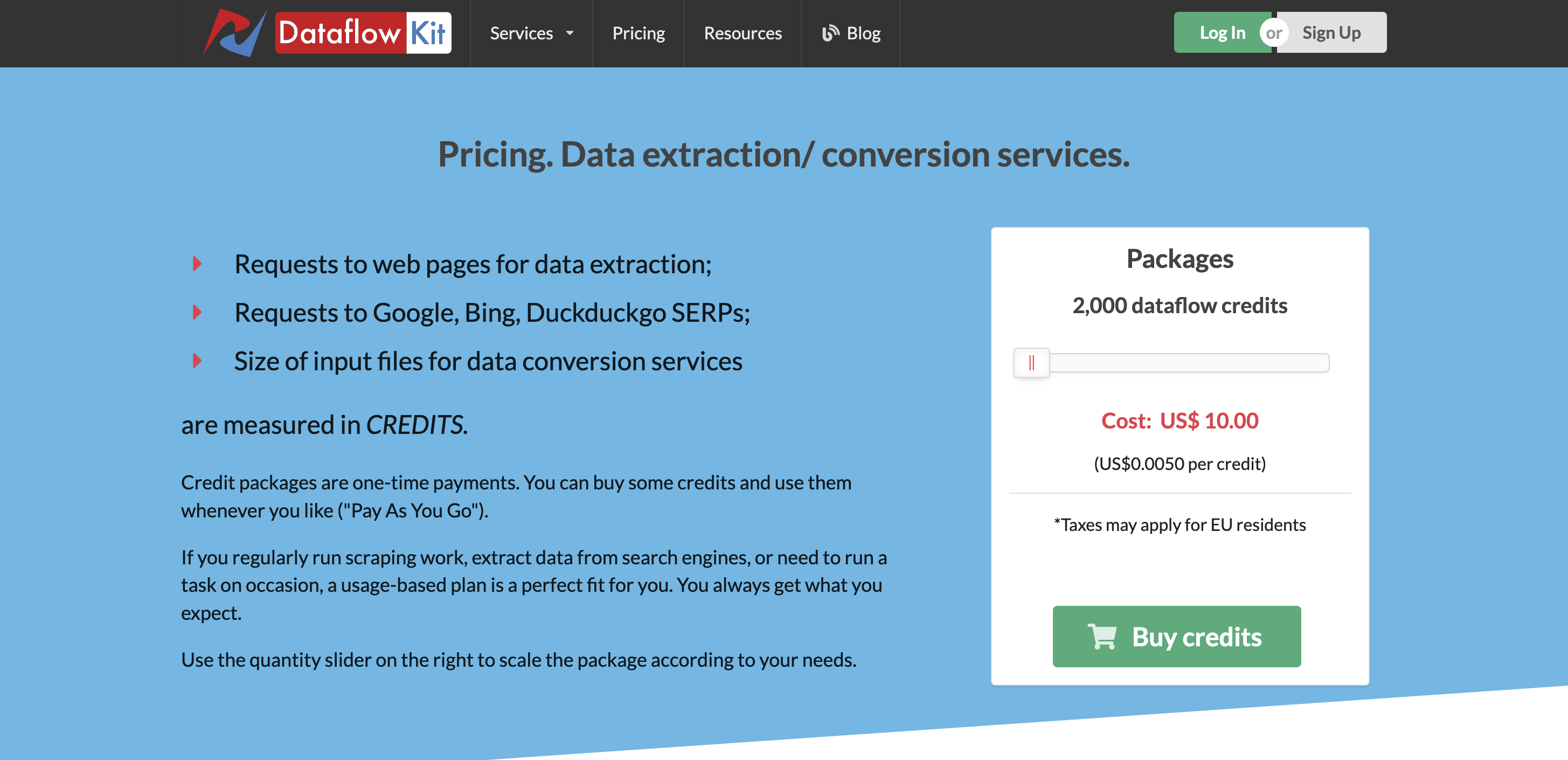

Цены

Премиум-цена начинается с 10 долларов за 2000 кредитов потока данных, которые вы можете использовать в соответствии со своими потребностями.

9. Импорт.ио

С помощью облачного инструмента для веб-скрейпинга Import.io пользователи могут собирать данные с веб-сайтов без какого-либо опыта программирования. Простота использования — одна из самых привлекательных особенностей Import.io; все, что вам нужно сделать, это указать и щелкнуть, чтобы найти данные, которые вы хотите очистить.

Пользователи могут оценивать извлеченные данные в режиме реального времени благодаря мощным функциям визуализации. Import.io — это безголовый браузер, который имитирует веб-браузер и подключается к веб-сайтам так же, как человек, но без графического пользовательского интерфейса.

Это повышает эффективность очистки веб-страниц и позволяет пользователям очищать данные с динамических веб-сайтов, которые требуют участия пользователя для отображения информации. Его экстрактор на базе искусственного интеллекта позволяет пользователям извлекать данные всего за несколько кликов. Экстрактор также может идентифицировать шаблоны данных и извлекать сопоставимые данные из многочисленных источников.

Пользователи могут автоматизировать свои усилия по очистке и получать частые обновления нужных им данных благодаря комплексным функциям планирования. Import.io упрощает использование извлеченных данных в других приложениях, позволяя вам связываться с популярными инструментами, такими как Google Sheets и Zapier.

Цены

Цены на сайте не указаны, уточняйте у специалистов.

10. Декси.ио

Извлечение данных упрощается с помощью надежного инструмента веб-скрейпинга Dexi.io. Вы можете собирать данные с веб-сайтов с помощью этого инструмента, не имея опыта программирования, благодаря его удобному интерфейсу и автоматизированным возможностям.

Одной из его лучших характеристик является способность собирать и объединять данные из многих источников, включая веб-страницы, API-интерфейсы и базы данных. Благодаря возможностям параллельной обработки Dexi.io вы можете быстро и эффективно очищать огромные объемы данных.

Dexi.io предлагает вам выбрать наилучшую альтернативу для ваших нужд парсинга, поскольку он работает как безголовый браузер, так и как головной браузер. В то время как вариант браузера с заголовком позволяет вам просматривать веб-сайт и взаимодействовать с ним, как если бы вы использовали обычный браузер, вариант безголового браузера позволяет очищать данные, не отображая страницу в браузере.

Это упрощает решение любых проблем со скрейпингом и настройку процедуры скрейпинга в соответствии с вашими предпочтениями. Вы можете быстро экспортировать очищенные данные из Dexi.io в различные форматы, такие как CSV, JSON и Excel, для дополнительного анализа или взаимодействия с другими приложениями.

Кроме того, он предоставляет надежный и безопасный облачный хостинг для ваших очищенных данных, гарантируя их безопасность и доступность.

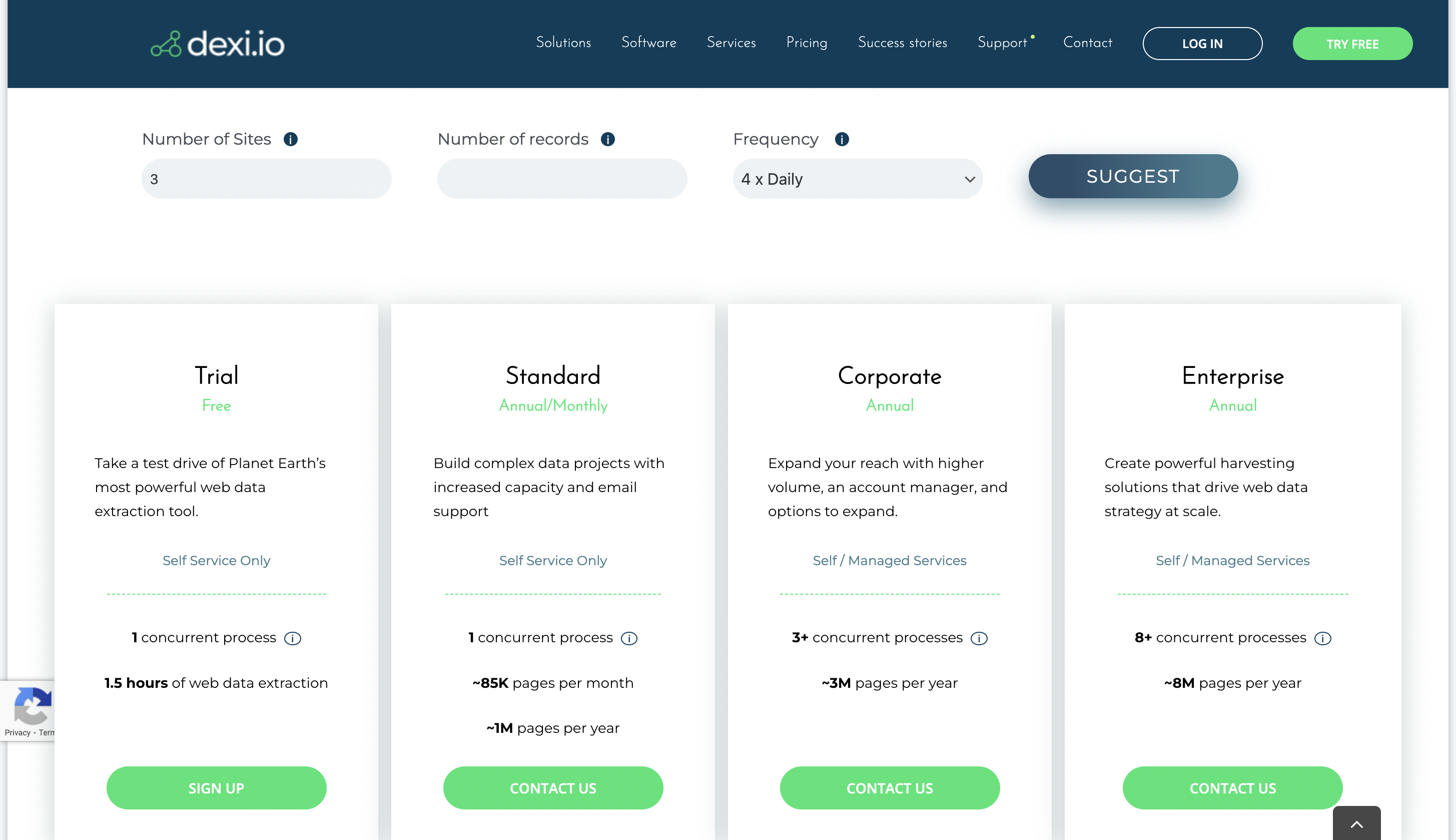

Цены

Вы можете попробовать платформу с ее бесплатным пробным планом и связаться с командой, чтобы узнать цены.

Заключение

В заключение, на рынке существует несколько решений для парсинга веб-страниц, каждое из которых имеет свои преимущества и возможности. Существует множество альтернатив данных, начиная от комплексных решений, таких как Bright Data и ScrapingBee, и заканчивая более специализированными инструментами, такими как Apify и ParseHub.

Эти системы часто имеют такие возможности, как безголовый просмотр, чередование IP-адресов, спуфинг пользовательского агента и снятие отпечатков пальцев браузера, чтобы повысить эффективность, надежность и секретность онлайн-скрапинга.

Инструменты веб-скрапинга могут дать вам быстрый и простой доступ к огромному количеству информации, независимо от того, являетесь ли вы владельцем малого бизнеса, пытающимся исследовать своих конкурентов, исследователем, ищущим данные для поддержки своей работы, или аналитиком данных, ищущим информацию о поведении потребителей. .

Возможность ошибок и несоответствий может быть уменьшена, а вы потенциально можете сэкономить время и деньги, автоматизировав процесс сбора данных.

Оставьте комментарий