Spis treści[Ukryć][Pokazać]

Na pewno słyszałeś o sztucznej inteligencji, a także o słowach takich jak uczenie maszynowe i przetwarzanie języka naturalnego (NLP).

Zwłaszcza jeśli pracujesz dla firmy, która każdego dnia obsługuje setki, jeśli nie tysiące kontaktów z klientami.

Analiza danych postów w mediach społecznościowych, e-maili, czatów, odpowiedzi na otwarte ankiety i innych źródeł nie jest prostym procesem, a staje się jeszcze trudniejsza, gdy zostanie powierzona tylko ludziom.

Dlatego wiele osób jest entuzjastycznie nastawionych do potencjału sztuczna inteligencja za ich codzienną pracę i dla przedsiębiorstw.

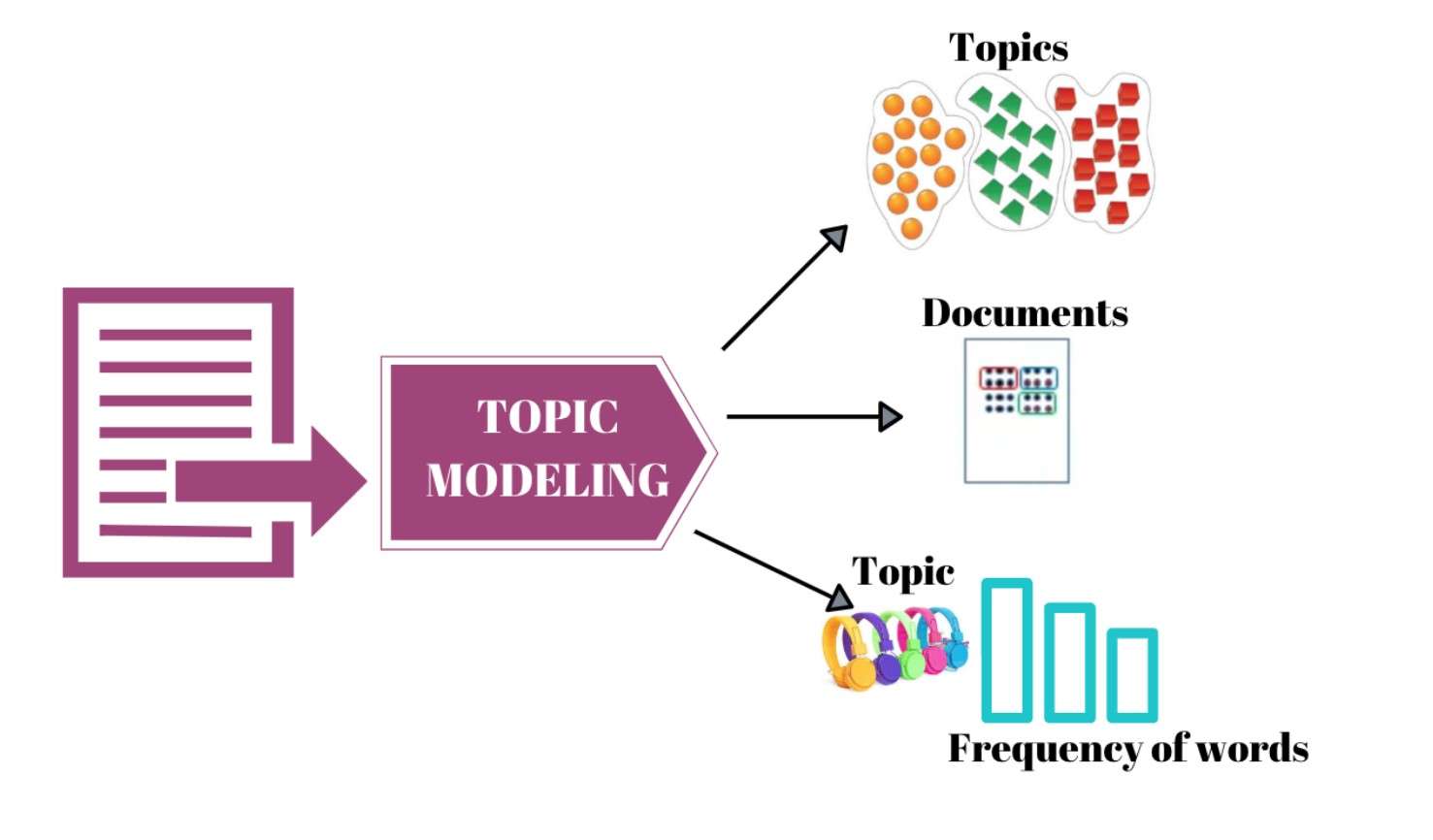

Analiza tekstu oparta na sztucznej inteligencji wykorzystuje szeroki zakres podejść lub algorytmów do organicznej interpretacji języka, z których jednym jest analiza tematyczna, która służy do automatycznego odkrywania tematów z tekstów.

Firmy mogą używać modeli analizy tematu do przenoszenia łatwych zadań na maszyny, zamiast przeciążać pracowników zbyt dużą ilością danych.

Zastanów się, ile czasu Twój zespół mógłby zaoszczędzić i poświęcić na bardziej istotną pracę, gdyby komputer mógł każdego ranka filtrować niekończące się listy ankiet klientów lub problemów z pomocą techniczną.

W tym przewodniku przyjrzymy się modelowaniu tematów, różnym metodom modelowania tematów i zdobędziemy praktyczne doświadczenie z nimi.

Co to jest modelowanie tematyczne?

Modelowanie tematyczne to rodzaj eksploracji tekstu, w którym nienadzorowane i nadzorowane statystyki uczenie maszynowe Techniki służą do wykrywania trendów w korpusie lub znacznej objętości nieustrukturyzowanego tekstu.

Może zająć ogromną kolekcję dokumentów i użyć metody podobieństwa, aby uporządkować słowa w klastry terminów i odkryć tematy.

Wydaje się to trochę skomplikowane i trudne, więc uprośćmy procedurę modelowania przedmiotu!

Załóżmy, że czytasz gazetę z zestawem kolorowych zakreślaczy w dłoni.

Czy to nie jest staromodne?

Zdaję sobie sprawę, że w dzisiejszych czasach niewiele osób czyta gazety drukowane; wszystko jest cyfrowe, a zakreślacze należą już do przeszłości! Udawaj, że jesteś ojcem lub matką!

Tak więc, kiedy czytasz gazetę, podkreślasz ważne terminy.

Jeszcze jedno założenie!

Używasz innego odcienia, aby podkreślić słowa kluczowe różnych tematów. Kategoryzujesz słowa kluczowe w zależności od dostarczonego koloru i tematów.

Każdy zbiór słów oznaczonych określonym kolorem jest listą słów kluczowych dla danego tematu. Ilość wybranych kolorów pokazuje liczbę motywów.

To jest najbardziej podstawowe modelowanie tematu. Pomaga w zrozumieniu, organizacji i podsumowaniu dużych zbiorów tekstów.

Pamiętaj jednak, że automatyczne modele tematyczne, aby były skuteczne, wymagają dużej ilości treści. Jeśli masz krótki artykuł, możesz chcieć przejść do starej szkoły i użyć zakreślaczy!

Warto też poświęcić trochę czasu na zapoznanie się z danymi. To da ci podstawowe pojęcie o tym, co powinien znaleźć model tematu.

Na przykład ten pamiętnik może dotyczyć twoich obecnych i poprzednich związków. Dlatego spodziewałbym się, że mój kolega-robot do eksploracji tekstu wpadnie na podobne pomysły.

Pomoże to lepiej przeanalizować jakość zidentyfikowanych tematów i, jeśli to konieczne, dostosować zestawy słów kluczowych.

Składniki modelowania tematycznego

Model probabilistyczny

Zmienne losowe i rozkłady prawdopodobieństwa są włączone do reprezentacji zdarzenia lub zjawiska w modelach probabilistycznych.

Model deterministyczny zapewnia pojedynczy potencjalny wniosek dla zdarzenia, podczas gdy model probabilistyczny zapewnia rozkład prawdopodobieństwa jako rozwiązanie.

Modele te uwzględniają rzeczywistość, w której rzadko mamy pełną wiedzę o sytuacji. Prawie zawsze należy wziąć pod uwagę element losowości.

Na przykład ubezpieczenie na życie opiera się na rzeczywistości, o której wiemy, że umrzemy, ale nie wiemy kiedy. Modele te mogą być częściowo deterministyczne, częściowo losowe lub całkowicie losowe.

Pobieranie informacji

Odzyskiwanie informacji (IR) to program, który organizuje, przechowuje, pobiera i ocenia informacje z repozytoriów dokumentów, w szczególności informacje tekstowe.

Technologia pomaga użytkownikom odkrywać potrzebne im informacje, ale nie dostarcza jasnych odpowiedzi na ich zapytania. Powiadamia o obecności i lokalizacji dokumentów, które mogą dostarczyć niezbędnych informacji.

Odpowiednie dokumenty to takie, które spełniają potrzeby użytkownika. Bezbłędny system IR zwróci tylko wybrane dokumenty.

Spójność tematu

Spójność tematu ocenia pojedynczy temat, obliczając stopień podobieństwa semantycznego między terminami o najwyższej punktacji w danym temacie. Te metryki pomagają w rozróżnieniu między tematami, które można zinterpretować semantycznie, a tematami będącymi artefaktami wnioskowania statystycznego.

Jeśli grupa twierdzeń lub faktów wspiera się nawzajem, mówi się, że są spójne.

W rezultacie spójny zestaw faktów można rozumieć w kontekście obejmującym wszystkie lub większość faktów. „Gra jest sportem zespołowym”, „gra się z piłką” i „gra wymaga ogromnego wysiłku fizycznego” to przykłady spójnych zestawów faktów.

Różne metody modelowania tematycznego

Tę krytyczną procedurę można przeprowadzić za pomocą różnych algorytmów lub metodologii. Wśród nich są:

- Utajona alokacja Dirichleta (LDA)

- Nieujemna faktoryzacja macierzy (NMF)

- Utajona analiza semantyczna (LSA)

- Probabilistyczna utajona analiza semantyczna (pLSA)

Utajona alokacja Dirichleta (LDA)

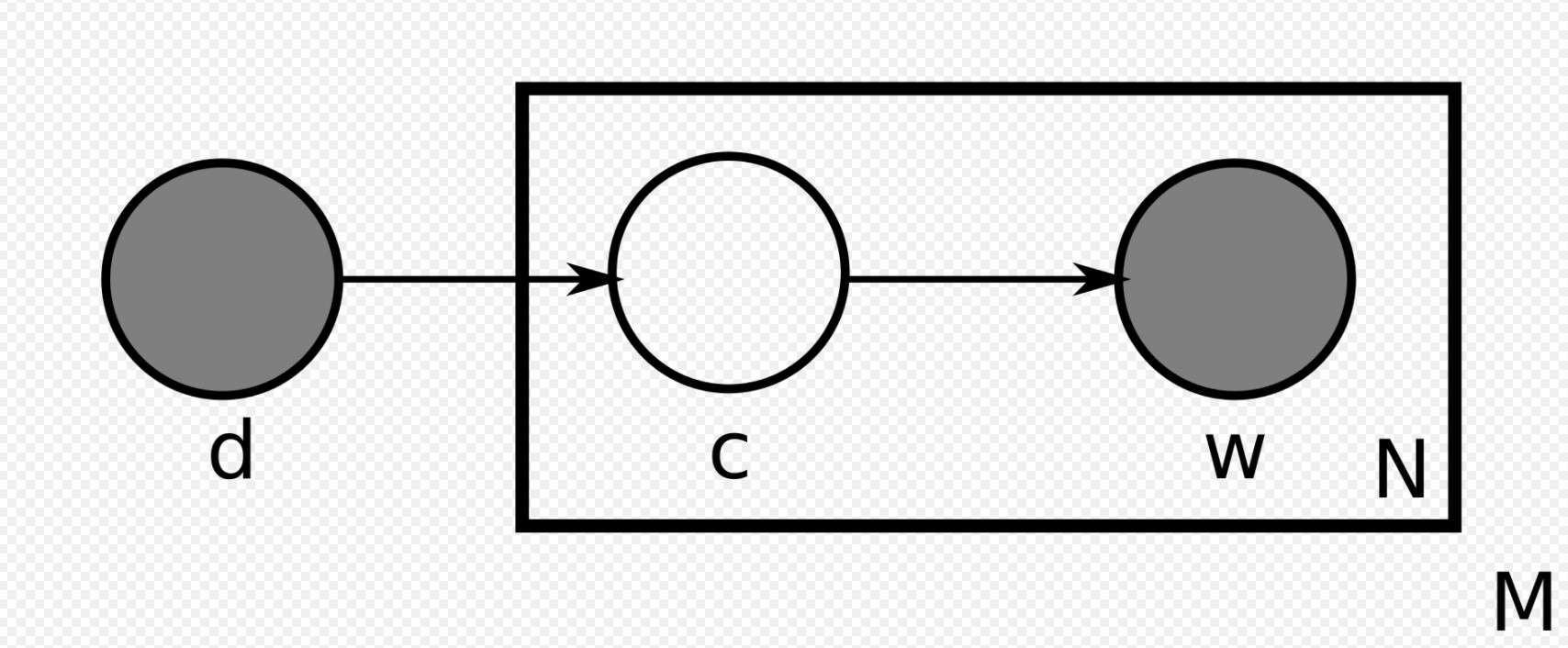

Aby wykryć relacje między wieloma tekstami w korpusie, stosuje się statystyczną i graficzną koncepcję Latent Dirichlet Allocation.

Korzystając z metody maksymalizacji wyjątków wariacyjnych (VEM), uzyskuje się największe oszacowanie prawdopodobieństwa z całego korpusu tekstu.

Tradycyjnie wybiera się kilka pierwszych słów z worka słów.

Jednak zdanie to jest całkowicie pozbawione sensu.

Zgodnie z tą techniką każdy tekst będzie reprezentowany przez probabilistyczny rozkład tematów, a każdy temat przez probabilistyczny rozkład słów.

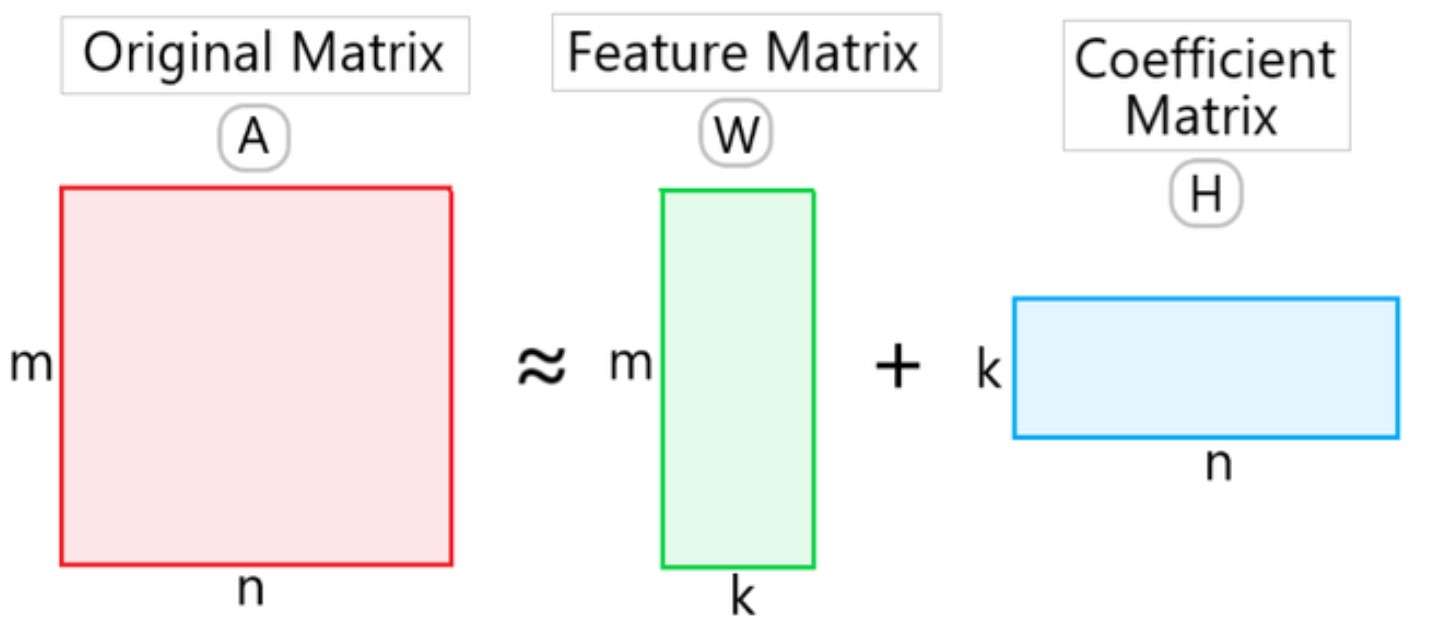

Nieujemna faktoryzacja macierzy (NMF)

Macierz z wartościami nieujemnymi Faktoryzacja to najnowocześniejsze podejście do wyodrębniania cech.

Gdy istnieje wiele cech, a atrybuty są niejasne lub mają słabą przewidywalność, NMF jest korzystny. NMF może generować znaczące wzorce, tematy lub motywy, łącząc cechy.

NMF generuje każdy element jako liniową kombinację oryginalnego zestawu atrybutów.

Każdy obiekt zawiera zestaw współczynników, które reprezentują ważność każdego atrybutu w obiekcie. Każdy atrybut liczbowy i każda wartość każdego atrybutu kategorii ma swój własny współczynnik.

Wszystkie współczynniki są dodatnie.

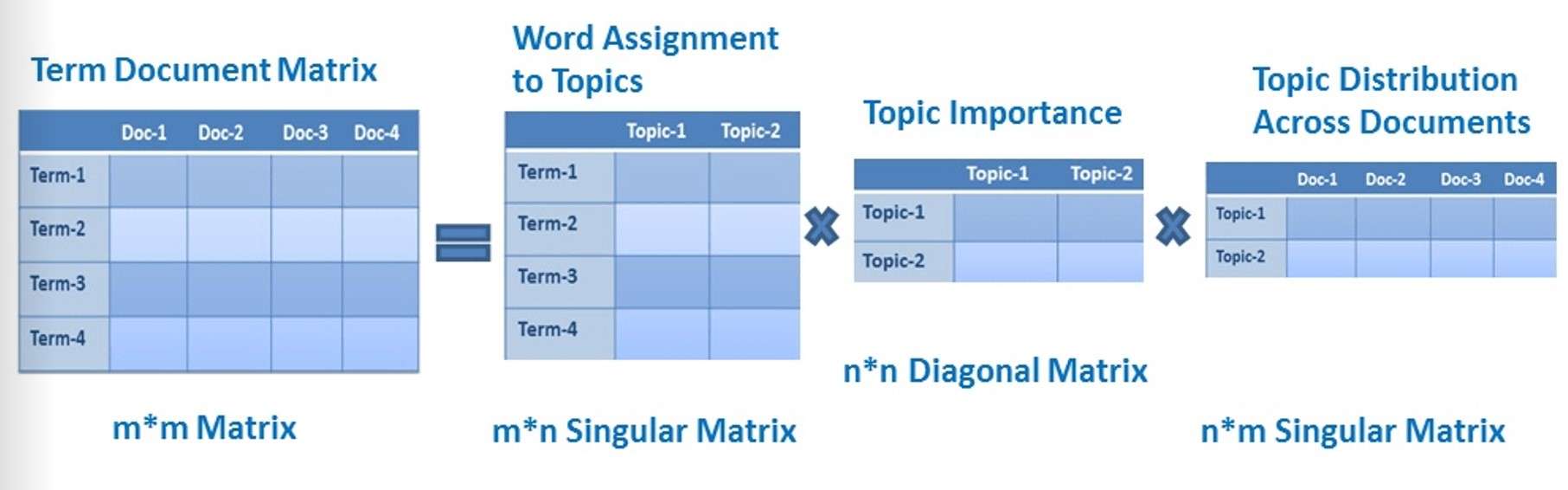

Utajona analiza semantyczna

Inną nienadzorowaną metodą uczenia się stosowaną do wydobywania skojarzeń między słowami w zestawie dokumentów jest ukryta analiza semantyczna.

Pomaga nam to w doborze odpowiednich dokumentów. Jego podstawową funkcją jest zmniejszenie wymiarowości ogromnego korpusu danych tekstowych.

Te niepotrzebne dane służą jako szum tła przy uzyskiwaniu niezbędnych informacji z danych.

Probabilistyczna utajona analiza semantyczna (pLSA)

Probabilistyczna utajona analiza semantyczna (PLSA), czasami znana jako probabilistyczne utajone indeksowanie semantyczne (PLSI, zwłaszcza w kręgach wyszukiwania informacji), to statystyczne podejście do analizy danych dwutrybowych i współwystępowania.

W rzeczywistości, podobnie jak utajona analiza semantyczna, z której wyłonił się PLSA, można wyprowadzić niskowymiarową reprezentację obserwowanych zmiennych pod kątem ich powinowactwa do poszczególnych ukrytych zmiennych.

Praktyczne zajęcia z modelowaniem tematów w Pythonie

Teraz przeprowadzę Cię przez zadanie modelowania przedmiotu za pomocą Pythona język programowania na przykładzie z prawdziwego świata.

Będę modelować artykuły naukowe. Zestaw danych, którego będę tutaj używał, pochodzi z kaggle.com. Możesz łatwo uzyskać wszystkie pliki, których używam w tej pracy, z tego strona.

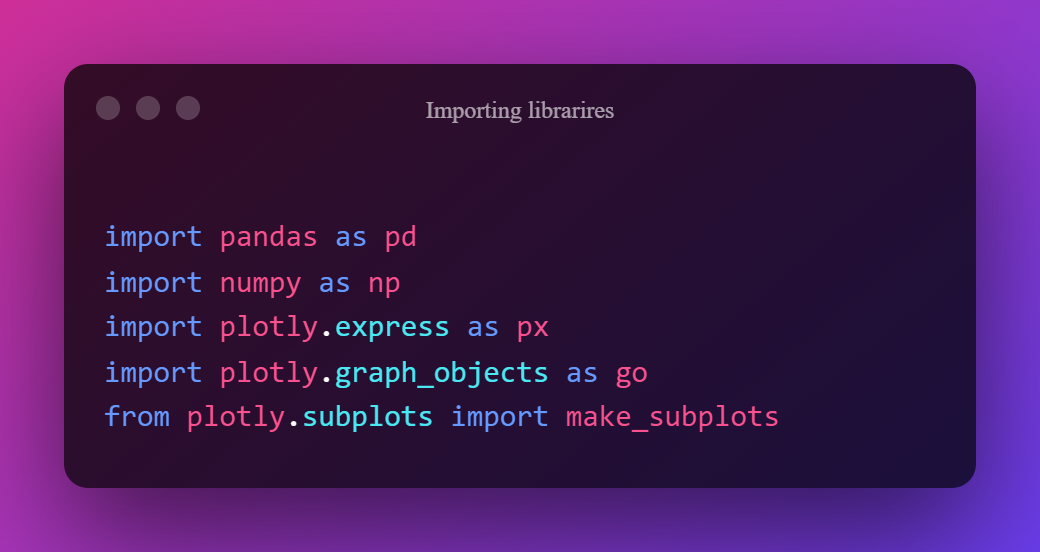

Zacznijmy od modelowania tematów za pomocą Pythona, importując wszystkie niezbędne biblioteki:

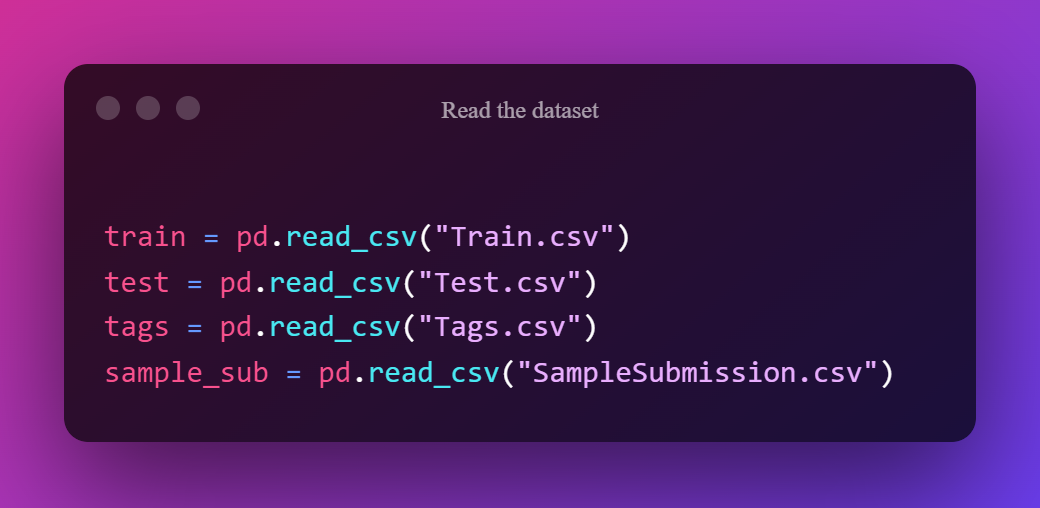

Następnym krokiem jest odczytanie wszystkich zestawów danych, których będę używać w tym zadaniu:

Analiza danych rozpoznawczych

EDA (Exploratory Data Analysis) to metoda statystyczna wykorzystująca elementy wizualne. Wykorzystuje podsumowania statystyczne i reprezentacje graficzne do odkrywania trendów, wzorców i założeń testowych.

Przeprowadzę eksploracyjną analizę danych, zanim zacznę modelowanie tematu, aby sprawdzić, czy istnieją jakieś wzorce lub relacje w danych:

Teraz znajdziemy wartości null testowego zbioru danych:

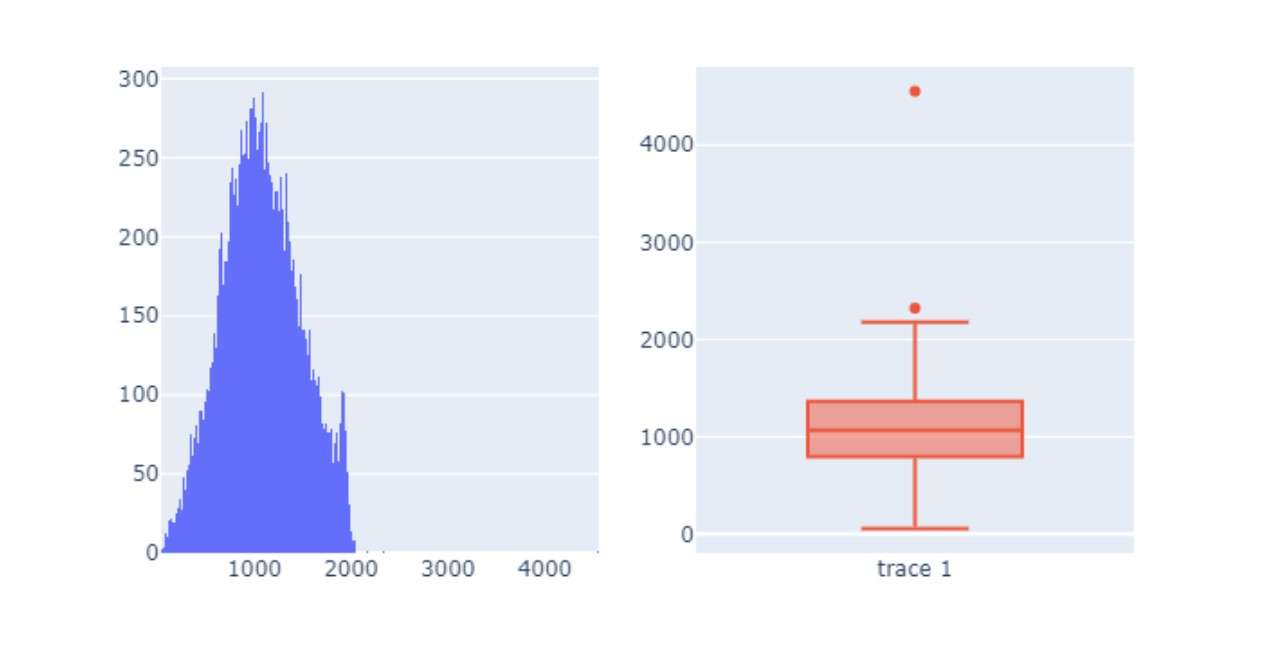

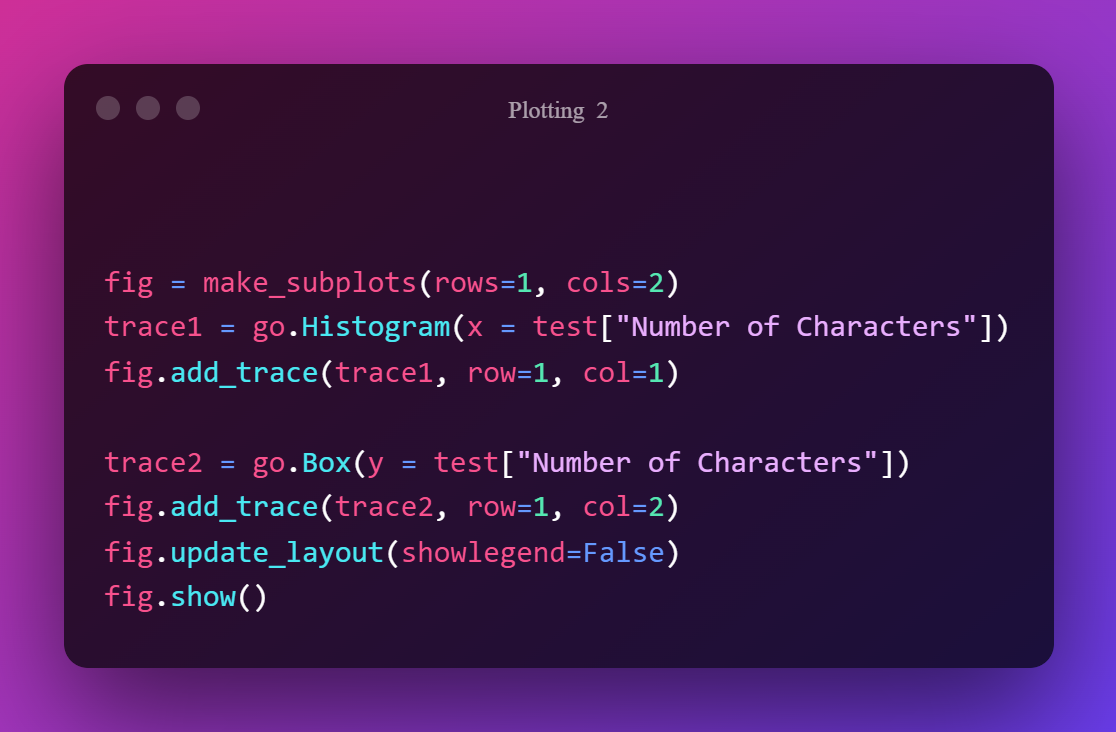

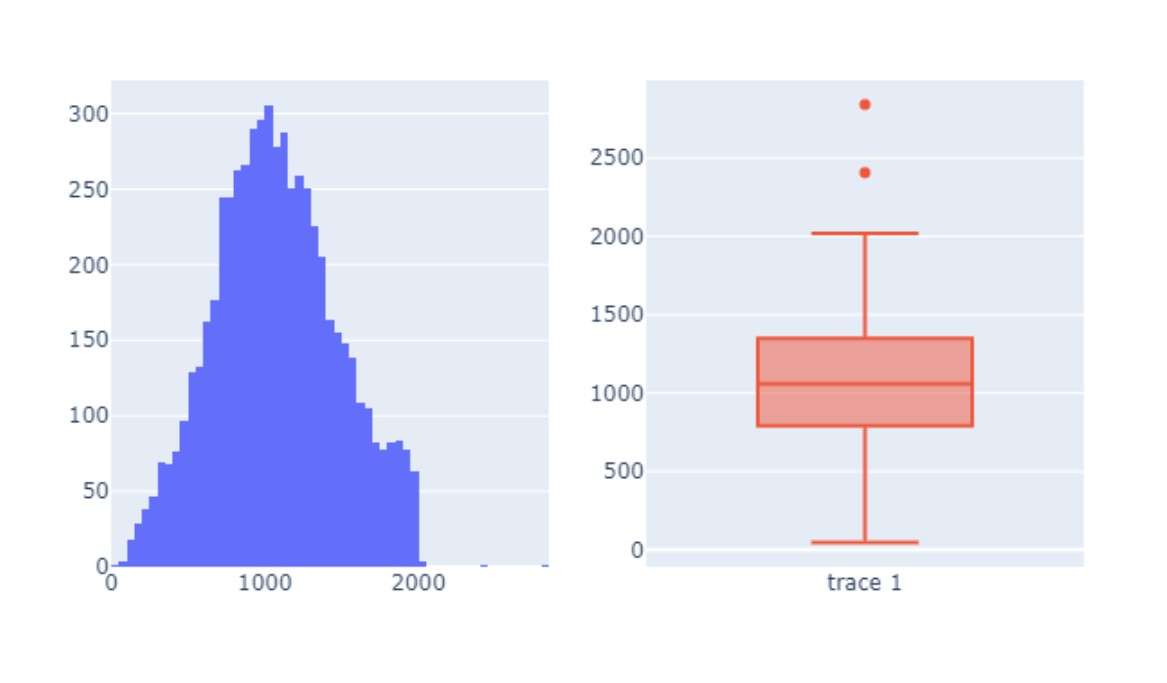

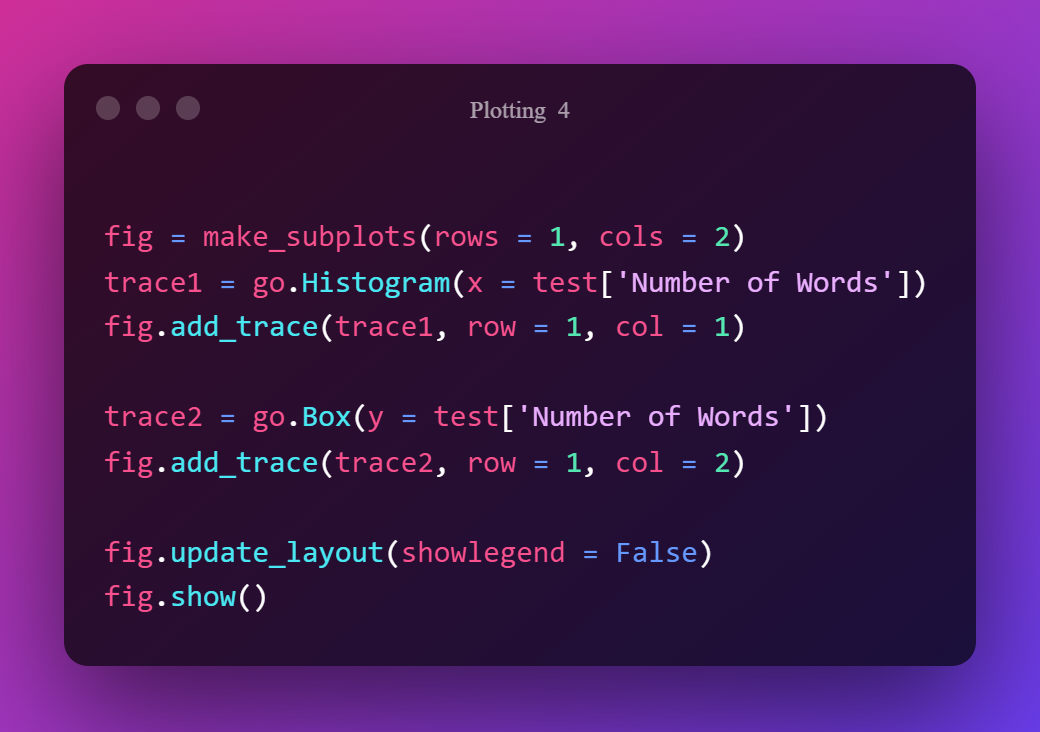

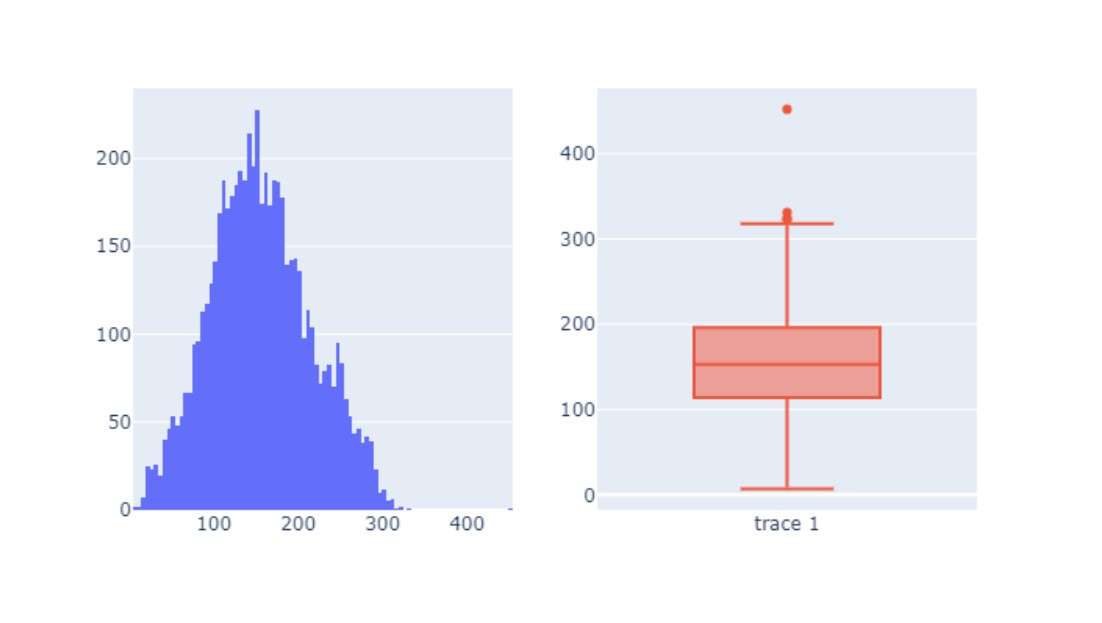

Teraz wykreślę histogram i wykres pudełkowy, aby sprawdzić relacje między zmiennymi.

Liczba znaków w zestawie Abstracts of the Train jest bardzo zróżnicowana.

W pociągu mamy minimum 54 i maksymalnie 4551 znaków. 1065 to średnia ilość znaków.

Zestaw testowy wydaje się być ciekawszy niż zestaw uczący, ponieważ zestaw testowy ma 46 znaków, podczas gdy zestaw uczący ma 2841.

W rezultacie zbiór testowy miał medianę 1058 znaków, co jest zbliżone do zbioru uczącego.

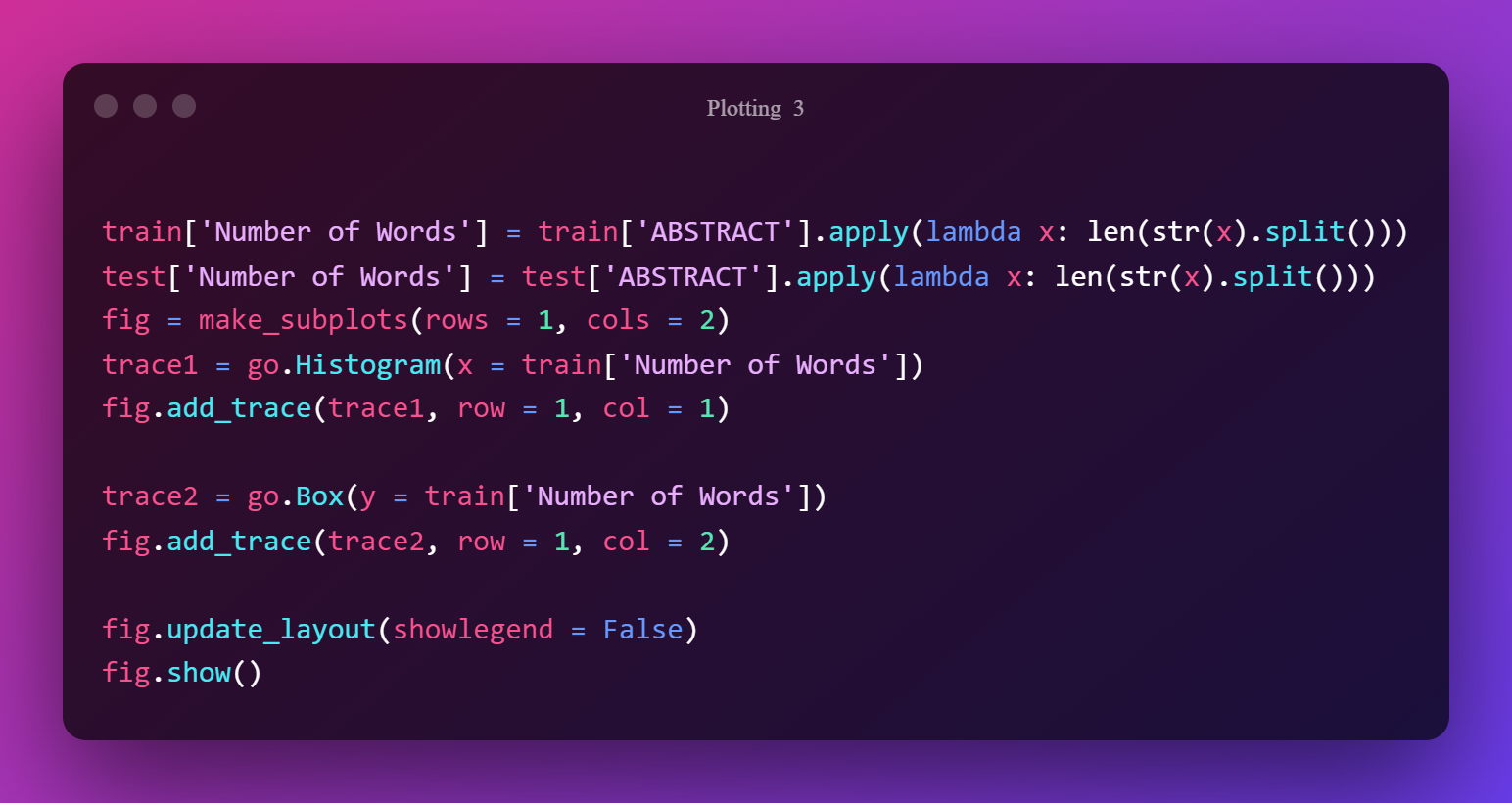

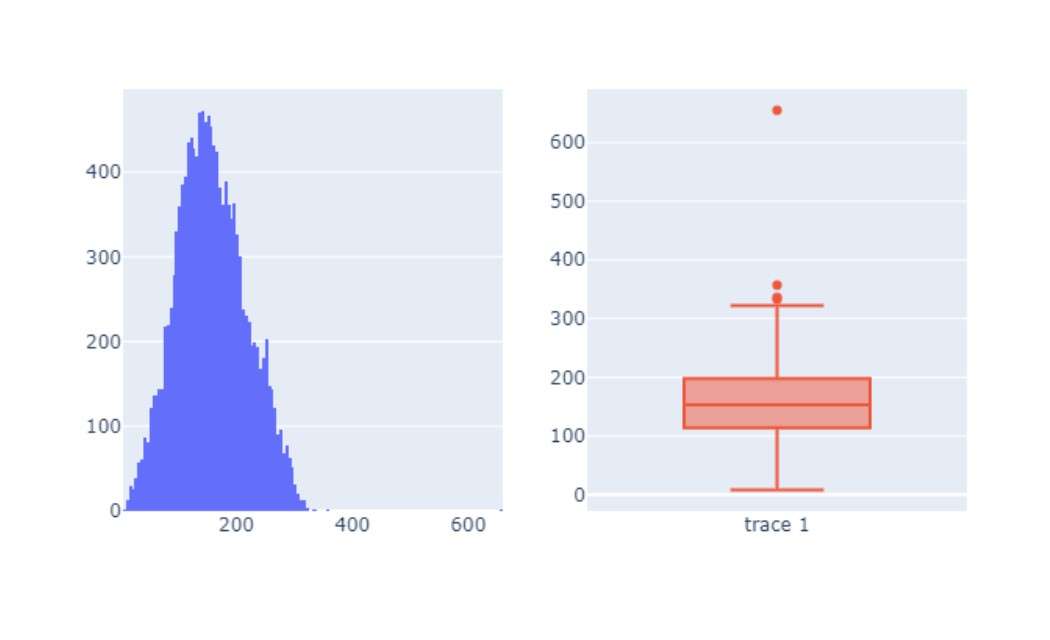

Liczba słów w zbiorze do nauki jest podobna do liczby liter.

Dozwolonych jest co najmniej 8 słów i maksymalnie 665 słów. W rezultacie mediana liczby słów wynosi 153.

Wymagane jest minimum siedem słów w streszczeniu i maksimum 452 słowa w zestawie testowym.

Mediana w tym przypadku wynosi 153, co jest identyczne z medianą w zbiorze uczącym.

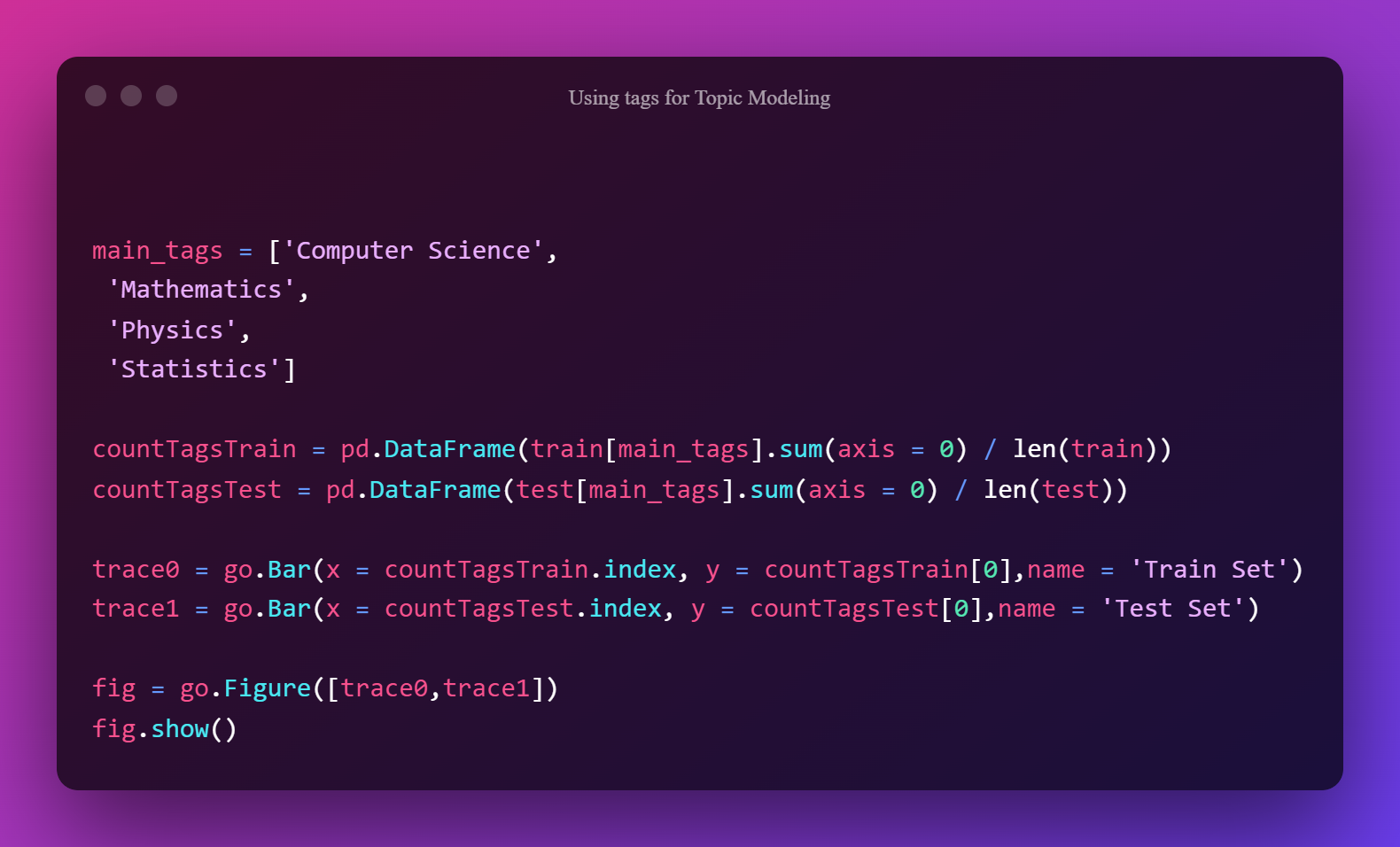

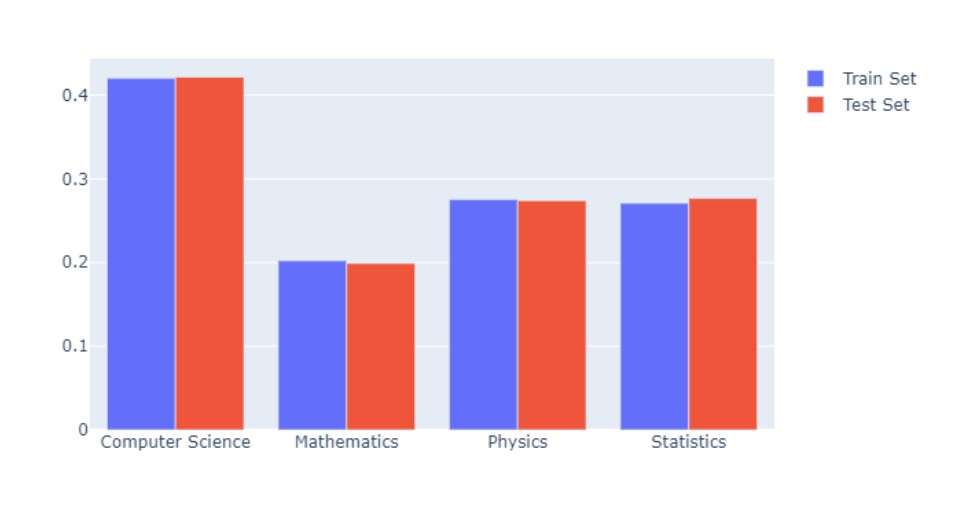

Używanie znaczników do modelowania tematów

Istnieje kilka strategii modelowania tematów. W tym ćwiczeniu użyję tagów; spójrzmy, jak to zrobić, sprawdzając tagi:

Zastosowania modelowania tematycznego

- Streszczenie tekstowe może służyć do rozróżnienia tematu dokumentu lub książki.

- Może być używany do usuwania stronniczości kandydata z punktacji egzaminu.

- Modelowanie tematyczne może być wykorzystywane do budowania relacji semantycznych między słowami w modelach opartych na wykresach.

- Może usprawnić obsługę klienta poprzez wykrywanie i reagowanie na słowa kluczowe w zapytaniu klienta. Klienci będą mieli więcej zaufania do Ciebie, ponieważ zapewniłeś im pomoc, której potrzebują w odpowiednim momencie i bez powodowania kłopotów. W rezultacie lojalność klientów gwałtownie wzrasta, a wartość firmy rośnie.

Wnioski

Modelowanie tematyczne to rodzaj modelowania statystycznego używanego do odkrywania abstrakcyjnych „tematów”, które istnieją w zbiorze tekstów.

Jest to forma modelu statystycznego stosowanego w uczenie maszynowe oraz przetwarzanie języka naturalnego w celu odkrycia abstrakcyjnych pojęć, które istnieją w zbiorze tekstów.

Jest to metoda eksploracji tekstu, która jest szeroko stosowana do wyszukiwania ukrytych wzorców semantycznych w tekście głównym.

Dodaj komentarz