Spis treści[Ukryć][Pokazać]

Jednym z podstawowych kryteriów każdego rodzaju działalności korporacyjnej jest efektywne wykorzystanie informacji. W pewnym momencie ilość tworzonych danych przekracza możliwości podstawowego przetwarzania.

W tym miejscu w grę wchodzą algorytmy uczenia maszynowego. Zanim jednak to nastąpi, informacje muszą zostać przestudiowane i zinterpretowane. Krótko mówiąc, do tego służy nienadzorowane uczenie maszynowe.

W tym artykule dogłębnie przeanalizujemy nienadzorowane uczenie maszynowe, w tym jego algorytmy, przypadki użycia i wiele innych.

Co to jest nienadzorowane uczenie maszynowe?

Nienadzorowane algorytmy uczenia maszynowego identyfikują wzorce w zbiorze danych, które nie mają znanych lub oznaczonych konsekwencji. Nadzorowane algorytmy uczenia maszynowego mają oznaczone wyjście.

Znajomość tego rozróżnienia pomaga zrozumieć, dlaczego nienadzorowane metody uczenia maszynowego nie mogą być używane do rozwiązywania problemów z regresją lub klasyfikacją, ponieważ nie wiesz, jaka może być wartość/odpowiedź dla danych wyjściowych. Nie możesz normalnie trenować algorytmu, jeśli nie znasz wartości/odpowiedzi.

Co więcej, uczenie nienadzorowane może być wykorzystane do identyfikacji podstawowej struktury danych. Algorytmy te wykrywają ukryte wzorce lub grupy danych bez potrzeby interakcji człowieka.

Jego zdolność do wykrywania podobieństw i kontrastów w informacjach czyni go doskonałym wyborem do eksploracyjnej analizy danych, technik sprzedaży krzyżowej, segmentacji konsumentów i identyfikacji obrazu.

Rozważ następujący scenariusz: jesteś w sklepie spożywczym i widzisz niezidentyfikowany owoc, którego nigdy wcześniej nie widziałeś. Możesz łatwo odróżnić nieznany owoc od innych owoców w okolicy na podstawie obserwacji jego kształtu, rozmiaru lub koloru.

Nienadzorowane algorytmy uczenia maszynowego

Klastry

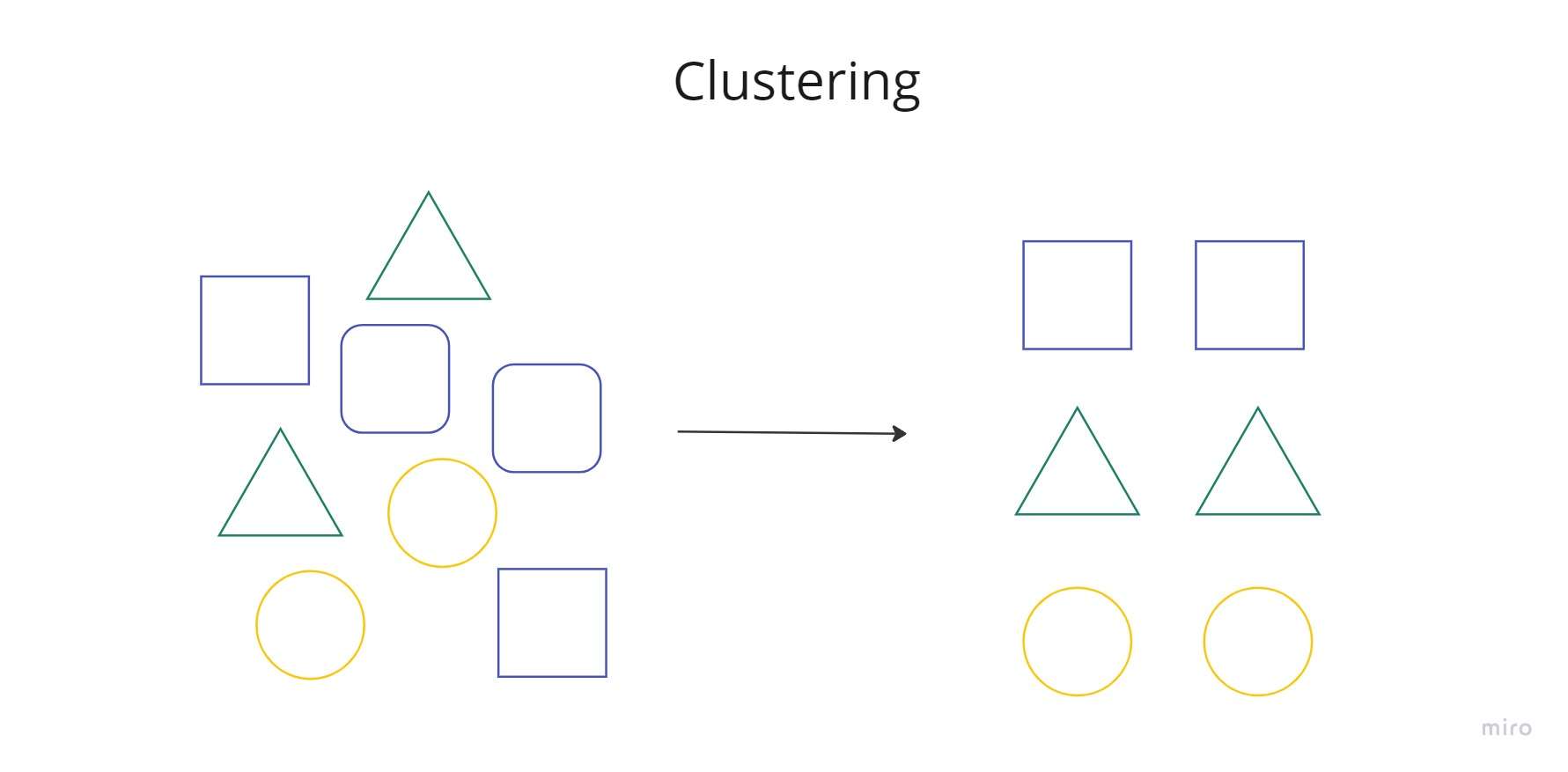

Klastrowanie jest bez wątpienia najszerzej stosowanym podejściem do uczenia się bez nadzoru. Takie podejście umieszcza powiązane elementy danych w losowo generowanych klastrach.

Sam model ML wykrywa wszelkie wzorce, podobieństwa i/lub różnice w nieskategoryzowanej strukturze danych. Model będzie w stanie wykryć w danych dowolne naturalne grupy lub klasy.

rodzaje

Istnieje kilka form grupowania, które można wykorzystać. Przyjrzyjmy się najpierw najważniejszym.

- Wyłączne klastrowanie, czasami nazywane „twardym” klastrowaniem, to rodzaj grupowania, w którym pojedyncza część danych należy do tylko jednego klastra.

- Nakładające się klastry, często nazywane „miękkimi” klastrami, pozwalają obiektom danych w różnym stopniu należeć do więcej niż jednego klastra. Co więcej, probabilistyczne grupowanie może być wykorzystywane do rozwiązywania problemów „miękkiego” grupowania lub szacowania gęstości, a także do oceny prawdopodobieństwa lub prawdopodobieństwa punktów danych należących do niektórych klastrów.

- Jak sama nazwa wskazuje, stworzenie hierarchii zgrupowanych elementów danych jest celem hierarchicznego grupowania. Elementy danych są dekonstruowane lub łączone w oparciu o hierarchię w celu wygenerowania klastrów.

Przypadków użycia:

- Wykrywanie anomalii:

Za pomocą klastrowania można wykryć dowolne wartości odstające w danych. Na przykład firmy transportowe i logistyczne mogą wykorzystywać wykrywanie anomalii do wykrywania przeszkód logistycznych lub ujawniania uszkodzonych części mechanicznych (konserwacja predykcyjna).

Instytucje finansowe mogą wykorzystywać tę technologię do wykrywania nieuczciwych transakcji i szybkiego reagowania, potencjalnie oszczędzając dużo pieniędzy. Dowiedz się więcej o wykrywaniu nieprawidłowości i oszustw, oglądając nasz film.

- Segmentacja klientów i rynków:

Algorytmy klastrowania mogą pomóc w grupowaniu osób o podobnych cechach i tworzeniu person konsumentów w celu bardziej efektywnych działań marketingowych i ukierunkowanych.

K-średnie

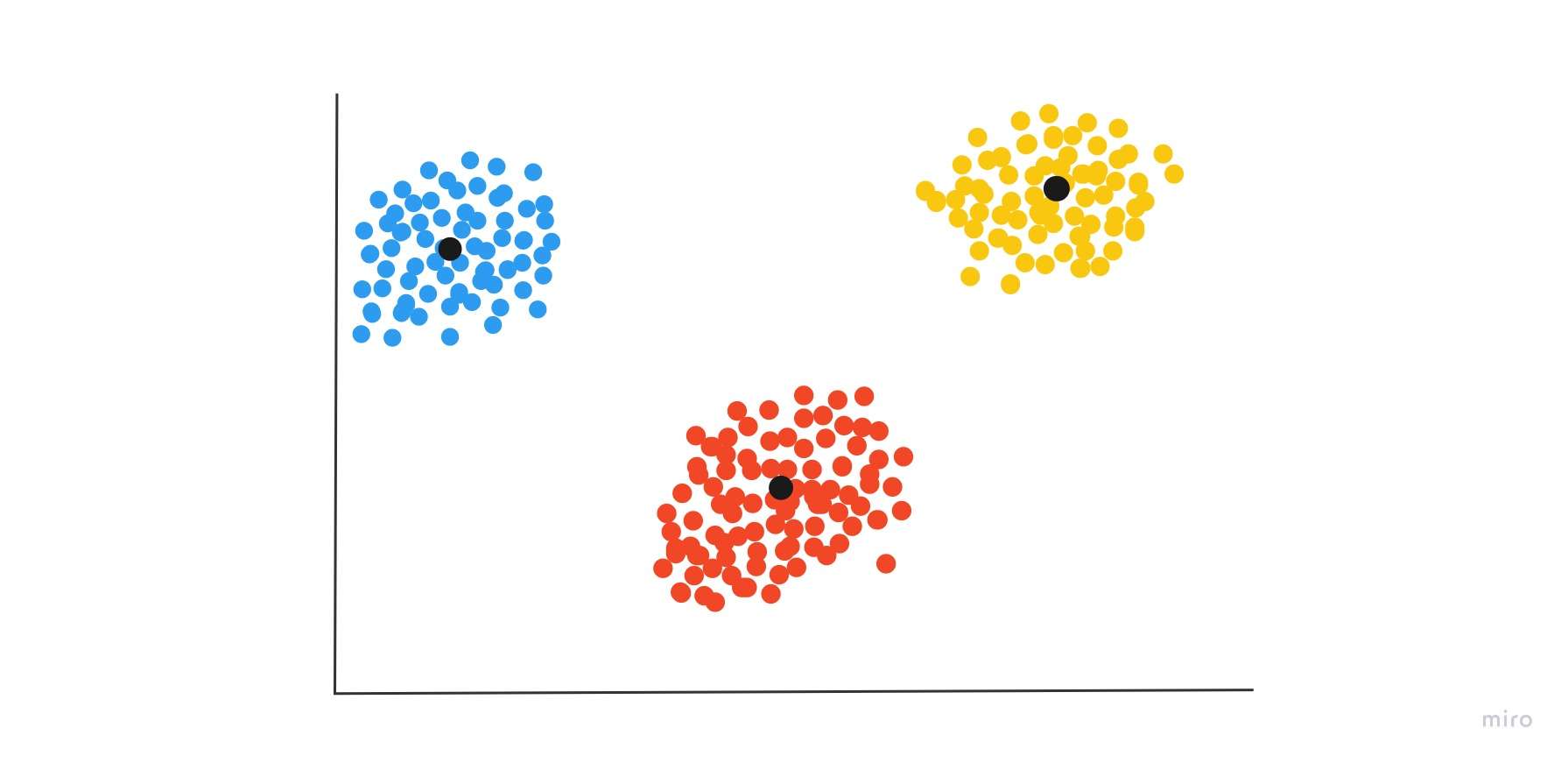

K-średnie to metoda grupowania, znana również jako partycjonowanie lub segmentacja. Dzieli punkty danych na z góry określoną liczbę klastrów znanych jako K.

W metodzie K-średnich K jest danymi wejściowymi, ponieważ mówisz komputerowi, ile klastrów chcesz zidentyfikować w swoich danych. Każdy element danych jest następnie przypisywany do najbliższego centrum skupienia, znanego jako centroid (czarne kropki na rysunku).

Te ostatnie służą jako miejsca do przechowywania danych. Technikę grupowania można wykonywać wiele razy, dopóki klastry nie zostaną dobrze zdefiniowane.

Rozmyte K-średnie

Rozmyte K-średnie to rozszerzenie techniki K-średnich, która jest używana do tworzenia grupowania nakładających się. W przeciwieństwie do techniki K-średnich, rozmyte K-średnie wskazują, że punkty danych mogą należeć do wielu skupień o różnym stopniu bliskości do każdego z nich.

Odległość między punktami danych a centroidem klastra jest używana do obliczania bliskości. W rezultacie mogą wystąpić sytuacje, w których różne klastry nakładają się na siebie.

Modele mieszanek Gaussa

Gaussian Mixture Models (GMM) to metoda stosowana w probabilistycznym grupowaniu. Ponieważ średnia i wariancja są nieznane, modele zakładają, że istnieje stała liczba rozkładów Gaussa, z których każdy reprezentuje odrębne skupienie.

Aby określić, do którego klastra należy określony punkt danych, zasadniczo używana jest metoda.

Klastrowanie hierarchiczne

Strategia hierarchicznego grupowania może rozpocząć się od przypisania każdego punktu danych do innego klastra. Dwa klastry, które są najbliżej siebie, są następnie łączone w jeden klaster. Scalanie iteracyjne trwa, dopóki na górze nie pozostanie tylko jeden klaster.

Ta metoda jest znana jako oddolna lub aglomeracyjna. Jeśli zaczniesz od wszystkich elementów danych powiązanych z tym samym klastrem, a następnie przeprowadzisz podziały, dopóki każdy element danych nie zostanie przypisany jako oddzielny klaster, metoda jest znana jako grupowanie hierarchiczne zstępujące lub dzielące.

Algorytm Apriori

Analiza koszyka rynkowego spopularyzowała algorytmy apriori, dzięki czemu powstały różne silniki rekomendacji dla platform muzycznych i sklepów internetowych.

Są one używane w transakcyjnych zestawach danych do znajdowania częstych zestawów lub grup elementów w celu przewidzenia prawdopodobieństwa konsumpcji jednego produktu na podstawie konsumpcji innego.

Na przykład, jeśli zacznę słuchać radia OneRepublic na Spotify z „Counting Stars”, jedną z pozostałych piosenek na tym kanale z pewnością będzie piosenka Imagine Dragon, taka jak „Bad Liar”.

Opiera się to na moich wcześniejszych nawykach słuchania, a także na wzorcach słuchania innych. Metody Apriori zliczają zestawy elementów przy użyciu drzewa mieszającego, przemierzając zestaw danych w pierwszej kolejności.

Redukcja wymiarowości

Redukcja wymiarowości to rodzaj nienadzorowanej nauki, która wykorzystuje zbiór strategii w celu zminimalizowania liczby cech – lub wymiarów – w zbiorze danych. Pozwól nam wyjaśnić.

Może być kuszące, aby uwzględnić jak najwięcej danych podczas tworzenia zestaw danych do uczenia maszynowego. Nie zrozum nas źle: ta strategia działa dobrze, ponieważ więcej danych zwykle daje dokładniejsze wyniki.

Załóżmy, że dane są przechowywane w przestrzeni N-wymiarowej, a każda cecha reprezentuje inny wymiar. W przypadku dużej ilości danych mogą istnieć setki wymiarów.

Weź pod uwagę arkusze kalkulacyjne Excel, z kolumnami reprezentującymi cechy i wierszami reprezentującymi elementy danych. Gdy istnieje zbyt wiele wymiarów, algorytmy ML mogą działać słabo i Wizualizacja danych może stać się trudne.

Dlatego logiczne jest ograniczenie cech lub wymiarów i przekazanie tylko istotnych informacji. Redukcja wymiarowości jest właśnie taka. Pozwala na kontrolowaną ilość danych wejściowych bez naruszania integralności zestawu danych.

Analiza głównych składników (PCA)

Analiza głównych komponentów to podejście polegające na redukcji wymiarów. Służy do minimalizowania liczby funkcji w ogromnych zestawach danych, co zapewnia większą prostotę danych bez poświęcania dokładności.

Kompresja zestawu danych jest realizowana za pomocą metody znanej jako wyodrębnianie funkcji. Wskazuje, że elementy z oryginalnego zestawu są łączone w nowy, mniejszy. Te nowe cechy są znane jako podstawowe składniki.

Oczywiście istnieją dodatkowe algorytmy, których możesz użyć w swoich aplikacjach do nauki nienadzorowanej. Te wymienione powyżej są tylko najbardziej rozpowszechnione, dlatego są one bardziej szczegółowo omówione.

Zastosowanie uczenia nienadzorowanego

- Nienadzorowane metody uczenia się są wykorzystywane do zadań percepcji wzrokowej, takich jak rozpoznawanie obiektów.

- Uczenie maszynowe bez nadzoru zapewnia krytyczne aspekty systemów obrazowania medycznego, takie jak identyfikacja, klasyfikacja i segmentacja obrazów, które są wykorzystywane w radiologii i patologii do szybkiego i niezawodnego diagnozowania pacjentów.

- Nienadzorowane uczenie się może pomóc w identyfikacji trendów danych, które można wykorzystać do tworzenia skuteczniejszych strategii sprzedaży krzyżowej wykorzystujących dane z przeszłości dotyczące zachowań konsumentów. Podczas procesu płatności jest to wykorzystywane przez firmy internetowe do sugerowania klientom odpowiednich dodatków.

- Nienadzorowane metody uczenia się mogą przeszukiwać ogromne ilości danych, aby znaleźć wartości odstające. Te nieprawidłowości mogą spowodować powiadomienie o wadliwym działaniu sprzętu, pomyłce ludzkiej lub naruszeniu bezpieczeństwa.

Problemy z uczeniem się nienadzorowanym

Nauka nienadzorowana jest atrakcyjna na wiele sposobów, od możliwości znalezienia ważnych informacji po dane w celu uniknięcia kosztownego etykietowania danych operacje. Istnieje jednak kilka wad korzystania z tej strategii do treningu modele uczenia maszynowego o czym powinieneś wiedzieć. Oto kilka przykładów.

- Ponieważ w danych wejściowych brakuje etykiet, które służą jako klucze odpowiedzi, wyniki modeli uczenia się bez nadzoru mogą być mniej precyzyjne.

- Uczenie nienadzorowane często działa z ogromnymi zestawami danych, co może zwiększyć złożoność obliczeniową.

- Podejście to wymaga potwierdzenia wyników przez ludzi, wewnętrznych lub zewnętrznych specjalistów w temacie zapytania.

- Algorytmy muszą badać i obliczać każdy możliwy scenariusz w fazie szkolenia, co zajmuje trochę czasu.

Wnioski

Efektywne wykorzystanie danych jest kluczem do stworzenia przewagi konkurencyjnej na danym rynku.

Możesz segmentować dane za pomocą nienadzorowanych algorytmów uczenia maszynowego, aby zbadać preferencje docelowych odbiorców lub określić, jak dana infekcja reaguje na określone leczenie.

Istnieje kilka praktycznych zastosowań i naukowcy danych, inżynierowie i architekci mogą pomóc w zdefiniowaniu celów i opracowaniu unikalnych rozwiązań ML dla Twojej firmy.

Dodaj komentarz