Wektorowe bazy danych stanowią znaczącą zmianę w sposobie zarządzania danymi i ich interpretacji, szczególnie w obszarach sztucznej inteligencji i uczenia maszynowego.

Podstawową funkcją tych baz danych jest efektywna obsługa wektorów wielowymiarowych, które stanowią surowiec do modeli uczenia maszynowego i obejmują konwersję wejściowego tekstu, obrazu lub dźwięku na reprezentacje numeryczne w przestrzeni wielowymiarowej.

W przypadku zastosowań takich jak systemy rekomendacji, rozpoznawanie obiektów, wyszukiwanie zdjęć i wykrywanie oszustw ta transformacja to coś więcej niż tylko przechowywanie; to drzwi do potężnych możliwości wyszukiwania podobieństw i zapytań o najbliższego sąsiada.

Mówiąc głębiej, siła wektorowych baz danych polega na ich zdolności do tłumaczenia dużych ilości nieustrukturyzowanych, skomplikowanych danych na wektory, które oddają kontekst i znaczenie oryginalnej treści.

Ulepszone funkcje wyszukiwania możliwe dzięki osadzeniu modeli w tym kodowaniu obejmują możliwość przeszukiwania otaczających wektorów w celu znalezienia powiązanych obrazów lub fraz.

Wektorowe bazy danych są wyjątkowe, ponieważ są zbudowane w oparciu o zaawansowane techniki indeksowania, takie jak Inverted File Index (IVF) i Hierarchical Navigable Small World (HNSW), co poprawia ich szybkość i wydajność podczas lokalizowania najbliższych sąsiadów w przestrzeniach N-wymiarowych.

Istnieje wyraźna różnica pomiędzy wektorowymi i klasycznymi bazami danych. Konwencjonalne bazy danych świetnie nadają się do organizowania danych w zorganizowane zbiory, które są zoptymalizowane pod kątem CRUD i przestrzegają ustalonych schematów.

Jednakże w przypadku dynamicznej i skomplikowanej natury danych wielowymiarowych sztywność ta zaczyna być przeszkodą.

Natomiast wektorowe bazy danych oferują stopień elastyczności i wydajności, któremu tradycyjne odpowiedniki nie mogą się równać, szczególnie w przypadku aplikacji, na których w dużym stopniu zależy uczenie maszynowe i sztuczną inteligencję. Są nie tylko skalowalni i biegli w wyszukiwaniu podobieństw.

Wektorowe bazy danych są szczególnie przydatne w generatywnych zastosowaniach AI. Aby zagwarantować, że utworzony materiał zachowa integralność kontekstową, aplikacje te — obejmujące przetwarzanie języka naturalnego i generowanie obrazów — polegają na szybkim wyszukiwaniu i porównywaniu osadzonych elementów.

W tym artykule przyjrzymy się najpopularniejszym wektorowym bazom danych do Twojego następnego projektu.

1. Milvus

Milvus to pionierska wektorowa baza danych o otwartym kodzie źródłowym, zaprojektowana głównie dla aplikacji AI, w tym wbudowane wyszukiwanie podobieństw i zaawansowane MLOps.

Różni się od konwencjonalnych relacyjnych baz danych, które w większości obsługują uporządkowane dane, ze względu na tę pojemność, która umożliwia indeksowanie wektorów na niespotykaną dotychczas skalę bilionową.

Zaangażowanie Milvusa w skalowalność i wysoką dostępność widać w sposobie jego rozwoju od pierwszej wersji do w pełni rozproszonego, natywnego dla chmury Milvusa 2.0.

W szczególności Milvus 2.0 charakteryzuje się projektem w pełni natywnym dla chmury, którego celem jest zdumiewająca dostępność na poziomie 99.9% przy skalowaniu poza setki węzłów.

Dla tych, którzy szukają niezawodnego rozwiązania do baz danych wektorowych, ta edycja jest wysoce zalecana, ponieważ nie tylko dodaje zaawansowane funkcje, takie jak połączenie z wieloma chmurami i panel administracyjny, ale także poprawia poziom spójności danych w celu elastycznego tworzenia aplikacji.

Godną uwagi zaletą Milvusa jest podejście zorientowane na społeczność, które zapewnia obsługę wielu języków i rozbudowany zestaw narzędzi dostosowany do wymagań programistów.

W sektorze IT skalowalność i niezawodność chmury w połączeniu z wydajnymi możliwościami wyszukiwania wektorowego w dużych zbiorach danych sprawiają, że jest to popularna opcja.

Dodatkowo zwiększa efektywność swoich działań, wykorzystując funkcję wyszukiwania hybrydowego, która łączy wyszukiwanie podobieństwa wektorowego z filtrowaniem skalarnym.

Milvus posiada panel administracyjny z przejrzystym interfejsem UI, pełny zestaw interfejsów API oraz skalowalna i przestrajalna architektura.

Komunikację z aplikacjami zewnętrznymi ułatwia warstwa dostępowa, natomiast równoważeniem obciążenia i zarządzaniem danymi koordynuje usługa koordynatora, pełniąca rolę centralnego dowodzenia.

Trwałość bazy danych wspierana jest przez warstwę obiektową, natomiast węzły robocze realizują działania zapewniające skalowalność.

Cennik

Jest darmowy dla każdego.

2. FAISS

Zespół badawczy AI Facebooka opracował najnowocześniejszą bibliotekę o nazwie Facebook AI podobieństwa Search, która ma na celu zwiększenie efektywności gęstego grupowania wektorów i wyszukiwania podobieństw.

Jego utworzenie wynikało z potrzeby ulepszenia możliwości wyszukiwania podobieństw przez sztuczną inteligencję Facebooka poprzez wykorzystanie najnowocześniejszych podstawowych metodologii.

W porównaniu z implementacjami opartymi na procesorach, najnowocześniejsza implementacja GPU firmy FAISS może przyspieszyć czas wyszukiwania od pięciu do dziesięciu razy, co czyni ją nieocenionym narzędziem do różnych zastosowań, w tym do systemów rekomendacji i identyfikacji podobnych znaczeń w dużych nieustrukturyzowane zbiory danych, takie jak tekst, dźwięk i wideo.

FAISS obsługuje szeroki zakres metryk podobieństwa, takich jak podobieństwo cosinus, iloczyn wewnętrzny i powszechnie stosowana metryka L2 (odległość euklidesowa).

Pomiary te ułatwiają dokładne i elastyczne wyszukiwanie podobieństw w różnych rodzajach danych. Funkcje takie jak przetwarzanie wsadowe, kompromisy w zakresie precyzji i szybkości oraz obsługa wyszukiwania precyzyjnego i przybliżonego dodatkowo zwiększają jego elastyczność.

Dodatkowo FAISS oferuje skalowalną metodę obsługi ogromnych zbiorów danych, umożliwiając przechowywanie indeksów na dysku.

Odwrócony plik, kwantyzacja produktu (PQ) i ulepszona PQ to tylko niektóre z innowacyjnych technik, które stanowią podstawę badawczą FAISS i zwiększają jej skuteczność, jeśli chodzi o indeksowanie i przeszukiwanie wielowymiarowych pól wektorowych.

Strategie te są wzmocnione najnowocześniejszymi podejściami, takimi jak przyspieszane przez procesor graficzny algorytmy k-selekcji i wstępne filtrowanie odległości PQ, gwarantujące zdolność FAISS do generowania szybkich i precyzyjnych wyników wyszukiwania nawet w zbiorach danych w skali miliardów.

Cennik

Jest darmowy dla każdego.

3. szyszka

Pinecone jest liderem w dziedzinie wektorowych baz danych, zapewniającym zarządzaną usługę natywną w chmurze, stworzoną specjalnie w celu poprawy wydajności aplikacji AI o dużej mocy.

Został specjalnie zaprojektowany do obsługi osadzania wektorów, które jest niezbędne w przypadku generatywnej sztucznej inteligencji, wyszukiwania semantycznego i aplikacji korzystających z ogromnych modeli językowych.

Sztuczna inteligencja może teraz rozumieć informacje semantyczne dzięki tym osadzeniom, które skutecznie działają jako pamięć długoterminowa dla skomplikowanych zadań.

Pinecone jest wyjątkowy, ponieważ płynnie integruje możliwości tradycyjnych baz danych ze zwiększoną wydajnością indeksów wektorowych, umożliwiając wydajne przechowywanie na dużą skalę i wysyłanie zapytań o osadzenia.

To sprawia, że jest to idealna opcja w sytuacjach, gdy złożoność i ilość danych sprawiają, że standardowe skalarne bazy danych są nieodpowiednie.

Pinecone oferuje programistom bezproblemowe rozwiązanie dzięki podejściu do usług zarządzanych, które usprawnia procedury integracji i gromadzenia danych w czasie rzeczywistym.

Obsługiwane są przez niego liczne operacje na danych, w tym pobieranie, aktualizowanie, usuwanie, wysyłanie zapytań i wstawianie danych.

Pinecone gwarantuje ponadto, że zapytania reprezentujące modyfikacje w czasie rzeczywistym, takie jak wstawki i usunięcia, dają prawidłowe odpowiedzi z niskim opóźnieniem dla indeksów zawierających miliardy wektorów.

W sytuacjach dynamicznych ta funkcja jest niezbędna do zachowania trafności i aktualności wyników zapytań.

Dodatkowo partnerstwo Pinecone z Airbyte za pośrednictwem połączenia Pinecone zwiększa jego wszechstronność i elastyczność, umożliwiając płynną integrację danych z różnych źródeł.

Dzięki tej relacji można zoptymalizować koszty i wydajność, zapewniając, że w drodze przyrostowej synchronizacji danych przetwarzane będą wyłącznie nowo pozyskane informacje.

Konstrukcja złącza kładzie nacisk na prostotę, wymagając jedynie minimalnych parametrów konfiguracyjnych, a ponadto można go rozszerzać, co pozwala na przyszłe ulepszenia.

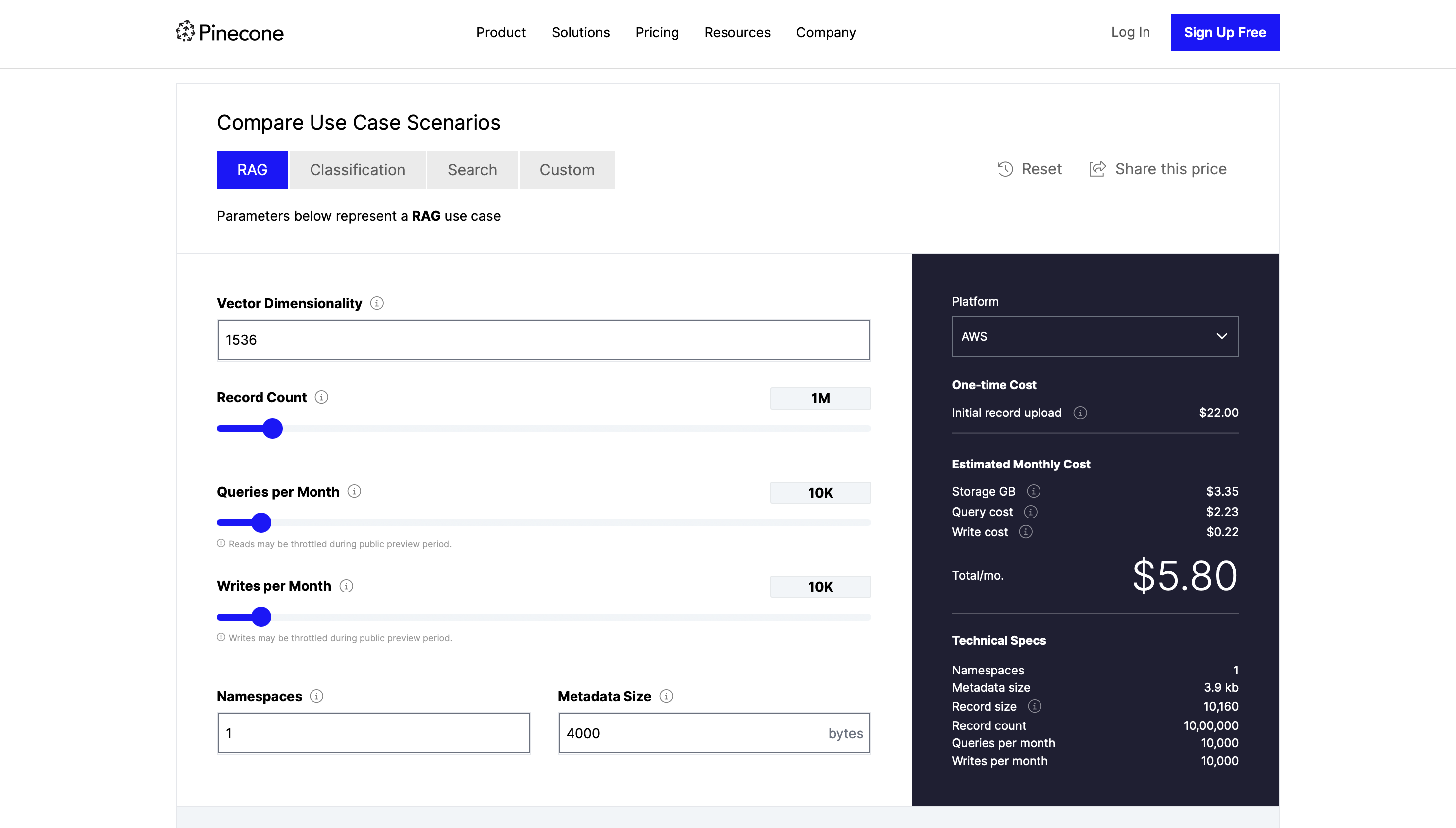

Cennik

Ceny premium zaczynają się od 5.80 USD miesięcznie za przypadek użycia RAG.

4. Tkać

Weaviate to innowacyjna baza danych wektorowych dostępna jako oprogramowanie typu open source, które zmienia sposób, w jaki uzyskujemy dostęp do danych i z nich korzystamy.

Weaviate wykorzystuje możliwości wyszukiwania wektorowego, które umożliwiają zaawansowane, kontekstowe przeszukiwanie dużych, skomplikowanych zbiorów danych, w przeciwieństwie do typowych baz danych, które zależą od wartości skalarnych i predefiniowanych zapytań.

Dzięki tej metodzie można lokalizować treści na podstawie podobieństwa do innych treści, co poprawia intuicyjność wyszukiwania i trafność wyników.

Jedną z jego głównych cech jest płynna integracja z modelami uczenia maszynowego; dzięki temu może pełnić funkcję czegoś więcej niż tylko rozwiązania do przechowywania danych; umożliwia także zrozumienie i analizę danych przy użyciu sztucznej inteligencji.

Architektura Weaviate dokładnie uwzględnia tę integrację, umożliwiając analizę złożonych danych bez użycia dodatkowych narzędzi.

Obsługa grafowych modeli danych zapewnia również inny punkt widzenia na dane jako połączone jednostki, ujawniając wzorce i spostrzeżenia, których można by przeoczyć w konwencjonalnych architekturach baz danych.

Dzięki modułowej architekturze Weaviate klienci mogą w razie potrzeby dodawać funkcje, takie jak wektoryzacja danych i tworzenie kopii zapasowych.

Jej podstawowa wersja pełni funkcję specjalistycznej bazy danych wektorowych i może być rozbudowywana o kolejne moduły w zależności od potrzeb.

Jego skalowalność jest dodatkowo zwiększona dzięki modułowej konstrukcji, która gwarantuje, że prędkość nie zostanie zmniejszona w odpowiedzi na rosnące ilości danych i wymagania dotyczące zapytań.

Wszechstronna i efektywna metoda interakcji z przechowywanymi danymi jest możliwa dzięki obsłudze przez bazę danych zarówno interfejsów API RESTful, jak i GraphQL.

W szczególności wybrano GraphQL ze względu na jego zdolność do szybkiego przeprowadzania skomplikowanych zapytań opartych na grafach, umożliwiając użytkownikom uzyskanie dokładnie takich danych, jakich chcą, bez uzyskiwania nadmiernej lub niewystarczającej ilości danych.

Dzięki elastycznemu interfejsowi API Weaviate jest bardziej przyjazny dla użytkownika w przypadku różnych bibliotek klienckich i języków programowania.

Dla tych, którzy chcą głębiej poznać Weaviate, dostępnych jest mnóstwo dokumentacji i samouczków, od konfigurowania instancji po szczegółowe informacje na temat jej możliwości, takich jak wyszukiwanie wektorów, integracja uczenia maszynowego i projektowanie schematów.

Możesz uzyskać dostęp do tej samej zaawansowanej technologii, która sprawia, że informacje są dynamiczne i przydatne, niezależnie od tego, czy zdecydujesz się obsługiwać Weaviate lokalnie, w cloud computing środowisku lub za pośrednictwem zarządzanej usługi chmury Weaviate

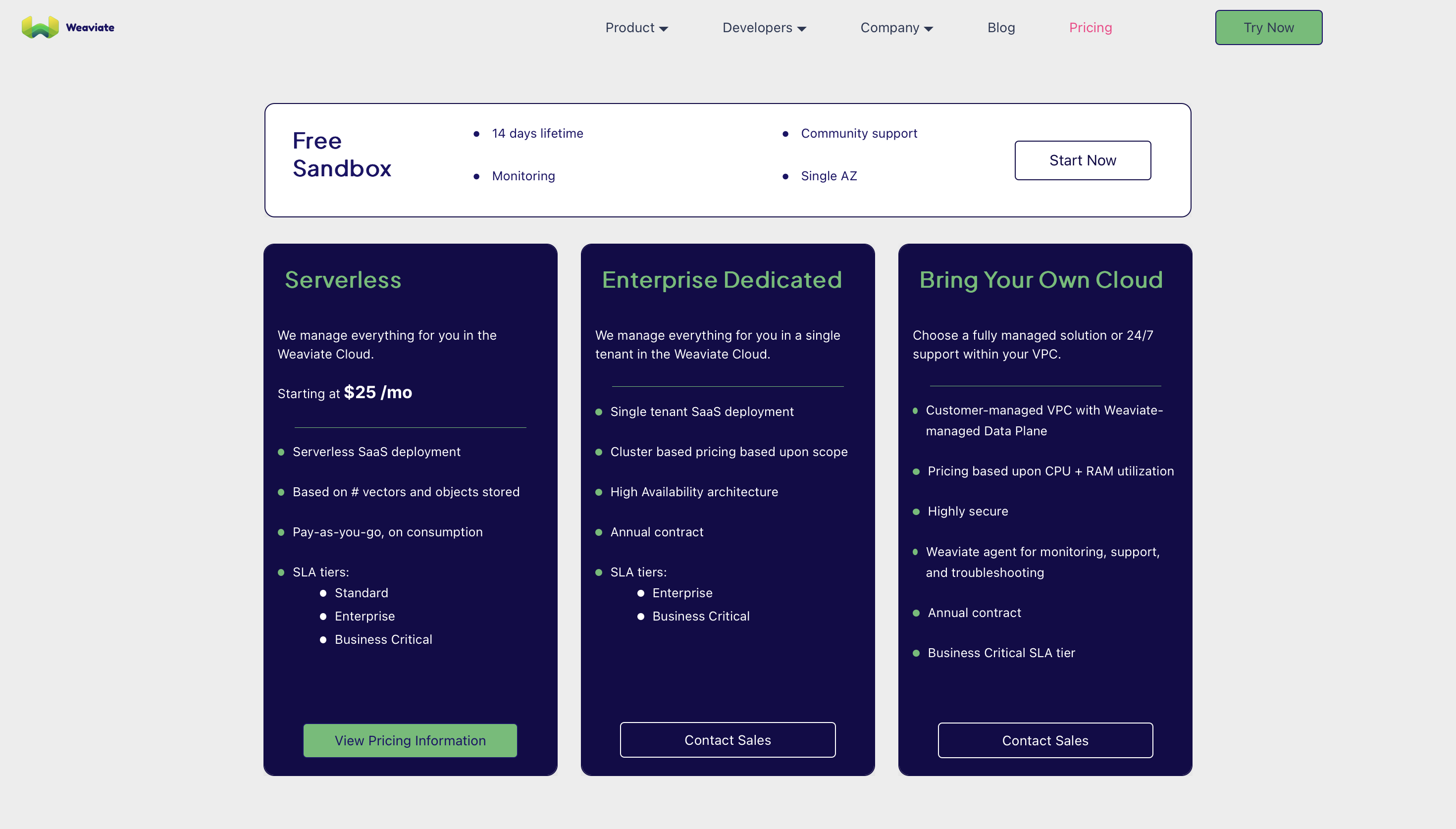

Cennik

Ceny premium platformy zaczynają się od 25 USD miesięcznie za wersję bezserwerową.

5. Chroma

Chroma to najnowocześniejsza wektorowa baza danych, której celem jest zrewolucjonizowanie wyszukiwania i przechowywania danych, szczególnie w zastosowaniach obejmujących uczenie maszynowe i sztuczną inteligencję.

Ponieważ Chroma w przeciwieństwie do standardowych baz danych używa wektorów, a nie liczb skalarnych, bardzo dobrze radzi sobie z zarządzaniem wielowymiarowymi, skomplikowanymi danymi.

Stanowi to poważny postęp w technologii wyszukiwania danych, ponieważ umożliwia bardziej wyrafinowane wyszukiwanie w oparciu o podobieństwo semantyczne materiału, a nie dokładne dopasowanie słów kluczowych.

Godną uwagi cechą Chroma jest jej zdolność do współpracy z kilkoma podstawowymi rozwiązaniami do przechowywania danych, takimi jak ClickHouse dla skalowanych ustawień i DuckDB do samodzielnych instalacji, gwarantując elastyczność i dostosowanie do różnych przypadków użycia.

Chroma została stworzona z myślą o prostocie, szybkości i analizie. Jest dostępny dla szerokiego spektrum programistów z pakietami SDK dla Pythona i JavaScript/TypeScript.

Dodatkowo Chroma kładzie duży nacisk na łatwość obsługi, umożliwiając programistom szybkie skonfigurowanie stałej bazy danych wspieranej przez DuckDB lub bazy danych w pamięci do testów.

Możliwość budowania obiektów kolekcji przypominających tabele w konwencjonalnych bazach danych, w których można wstawiać dane tekstowe i automatycznie przekształcać je w osady przy użyciu modeli takich jak all-MiniLM-L6-v2, jeszcze bardziej zwiększa tę wszechstronność.

Tekst i elementy osadzone można bezproblemowo zintegrować, co jest niezbędne w przypadku aplikacji wymagających zrozumienia semantyki danych.

Podstawą metody podobieństwa wektorów Chroma są matematyczne pojęcia ortogonalności i gęstości, które są niezbędne do zrozumienia reprezentacji i porównania danych w bazach danych.

Pomysły te pozwalają Chromie przeprowadzać znaczące i wydajne wyszukiwanie podobieństw, biorąc pod uwagę powiązania semantyczne między elementami danych.

Zasoby takie jak samouczki i wskazówki są dostępne dla osób, które chcą głębiej poznać Chromę. Zawierają wskazówki krok po kroku dotyczące konfigurowania bazy danych, tworzenia kolekcji i wyszukiwania podobieństw.

Cennik

Możesz zacząć z niego korzystać bezpłatnie.

6. Vespa

Vespa to platforma, która zmienia sposób obsługi sztucznej inteligencji i dużych danych w Internecie.

Podstawowym celem Vespa jest umożliwienie obliczeń o niskim opóźnieniu w dużych zbiorach danych, umożliwiając łatwe przechowywanie, indeksowanie i analizowanie danych tekstowych, wektorowych i strukturalnych.

Vespa wyróżnia się zdolnością do udzielania szybkich odpowiedzi w dowolnej skali, niezależnie od charakteru obsługiwanych zapytań, wyborów lub wniosków z modeli uczących się maszynowo.

Elastyczność Vespy przejawia się w jej w pełni funkcjonalnej wyszukiwarce i wektorowej bazie danych, które umożliwiają wiele wyszukiwań w ramach jednego zapytania, począwszy od danych wektorowych (ANN), leksykalnych i strukturalnych.

Niezależnie od skali możesz tworzyć przyjazne dla użytkownika i responsywne aplikacje do wyszukiwania z funkcjami sztucznej inteligencji w czasie rzeczywistym dzięki integracji wnioskowania o modelach uczących się maszynowo z danymi.

Jednak Vespa to coś więcej niż tylko poszukiwanie; chodzi także o zrozumienie i dostosowanie spotkań.

Najwyższej klasy narzędzia do dostosowywania i sugestii zapewniają dynamiczne, aktualne rekomendacje dostosowane do konkretnych użytkowników lub okoliczności.

Vespa zmienia zasady gry również dla każdego, kto chce wejść do konwersacyjnej przestrzeni sztucznej inteligencji, ponieważ oferuje infrastrukturę niezbędną do przechowywania i eksplorowania danych tekstowych i wektorowych w czasie rzeczywistym, umożliwiając rozwój bardziej zaawansowanych i praktycznych agentów sztucznej inteligencji.

Dzięki kompleksowej tokenizacji i stemplowaniu, wyszukiwania pełnotekstowe, wyszukiwania najbliższych sąsiadów i zapytania dotyczące danych strukturalnych są obsługiwane przez szerokie możliwości zapytań platformy.

Różni się tym, że skutecznie radzi sobie ze skomplikowanymi zapytaniami, łącząc kilka wymiarów wyszukiwania.

Vespa to potęga obliczeniowa do zastosowań w zakresie sztucznej inteligencji i uczenia maszynowego, ponieważ jej silnik obliczeniowy może obsługiwać złożone wyrażenia matematyczne za pomocą skalarów i tensorów.

W działaniu Vespa jest prosta w użyciu i łatwa w rozbudowie.

Usprawnia powtarzalne procesy, od konfiguracji systemu i tworzenia aplikacji po zarządzanie danymi i węzłami, umożliwiając bezpieczne i nieprzerwane działanie produkcyjne.

Architektura Vespy zapewnia jej rozbudowę wraz z danymi, zachowując niezawodność i wydajność.

Cennik

Możesz zacząć z niego korzystać bezpłatnie.

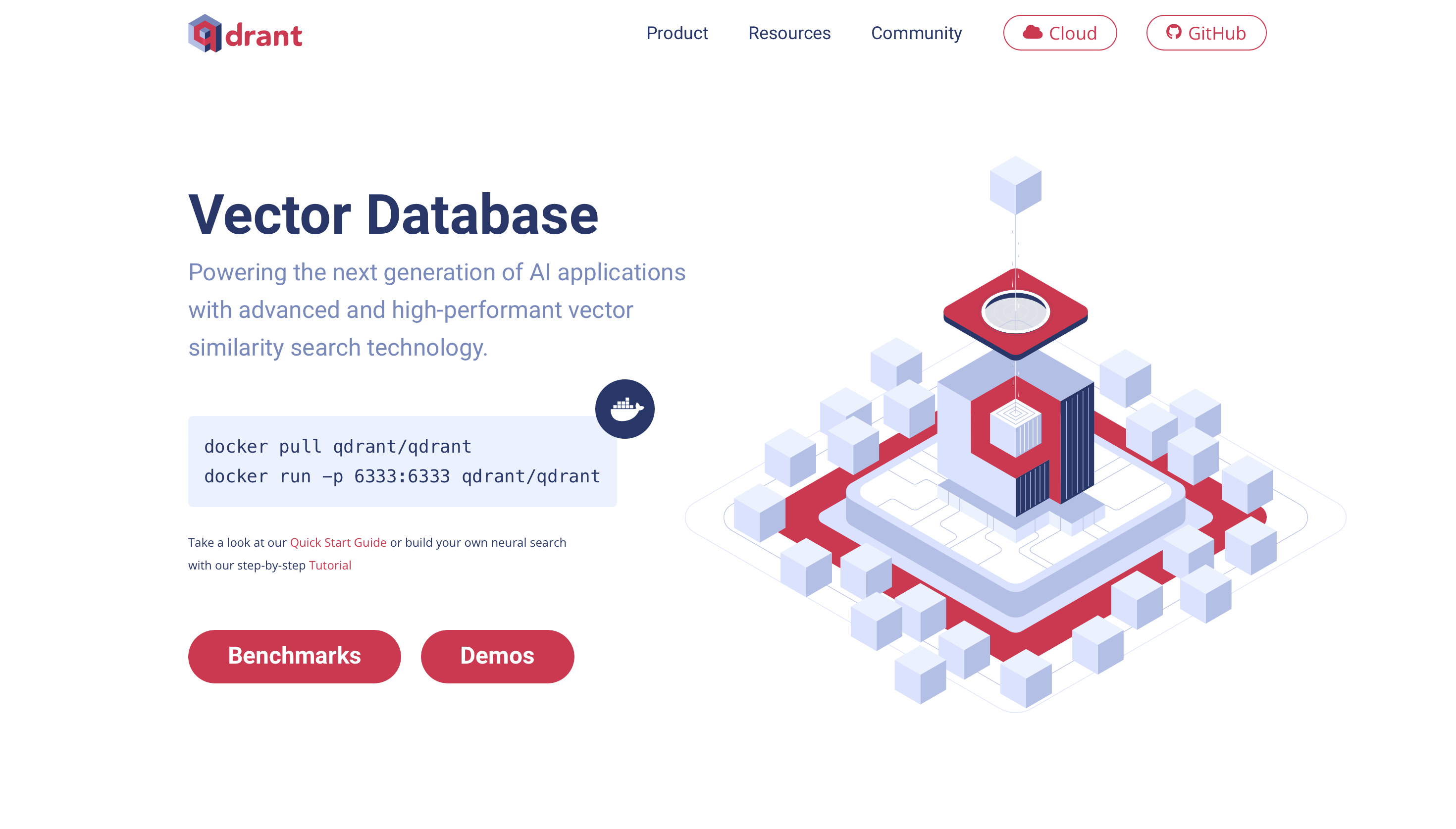

7. kwadrant

Qdrant to elastyczna platforma wektorowych baz danych, która zapewnia unikalny zestaw możliwości, aby sprostać rosnącym wymaganiom aplikacji AI i uczenia maszynowego.

U podstaw Qdrant jest wyszukiwarka podobieństw wektorów, która zapewnia łatwy w użyciu interfejs API do przechowywania, wyszukiwania i utrzymywania wektorów oraz danych ładunku.

Ta funkcja jest kluczowa w przypadku kilku aplikacji, takich jak systemy wyszukiwania semantycznego i rekomendacji, które wymagają interpretacji skomplikowanych formatów danych.

Platforma została zbudowana z myślą o wydajności i skalowalności, jest w stanie obsłużyć ogromne zbiory danych zawierające miliardy punktów danych.

Zapewnia kilka wskaźników odległości, w tym podobieństwo cosinusa, odległość euklidesową i iloczyn skalarny, dzięki czemu można go dostosować do wielu scenariuszy użycia.

Projekt oferuje złożone filtrowanie, takie jak filtry łańcuchowe, zakresowe i geograficzne, aby sprostać różnorodnym potrzebom wyszukiwania.

Qdrant jest dostępny dla programistów na różne sposoby, w tym obraz Dockera do szybkiej konfiguracji lokalnej, klient Python dla osób znających język oraz usługa w chmurze zapewniająca solidniejsze środowisko klasy produkcyjnej.

Możliwość adaptacji Qdrant pozwala na bezproblemową integrację z dowolną konfiguracją technologiczną lub potrzebami procesowymi.

Co więcej, przyjazny dla użytkownika interfejs Qdrant upraszcza zarządzanie wektorową bazą danych. Platforma ma być prosta dla użytkowników na wszystkich poziomach umiejętności, od tworzenia klastrów po generowanie kluczy API w celu zapewnienia bezpiecznego dostępu.

Możliwość przesyłania zbiorczego i asynchroniczny interfejs API zwiększają jego wydajność, co czyni go bardzo przydatnym narzędziem dla programistów zajmujących się ogromnymi ilościami danych.

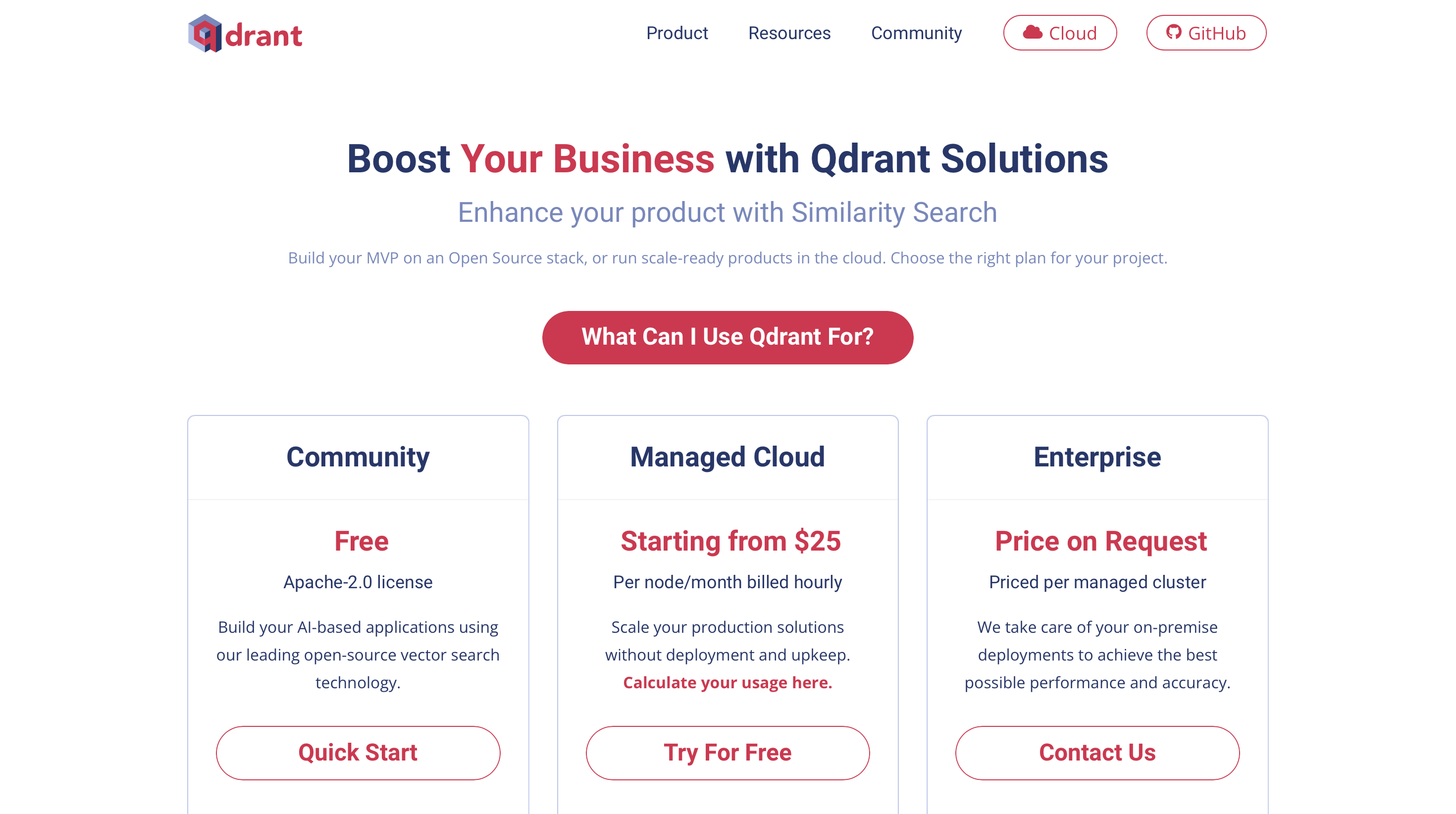

Cennik

Możesz zacząć z niego korzystać za darmo, a ceny premium zaczynają się od 25 USD za węzeł/miesiąc, rozliczane godzinowo

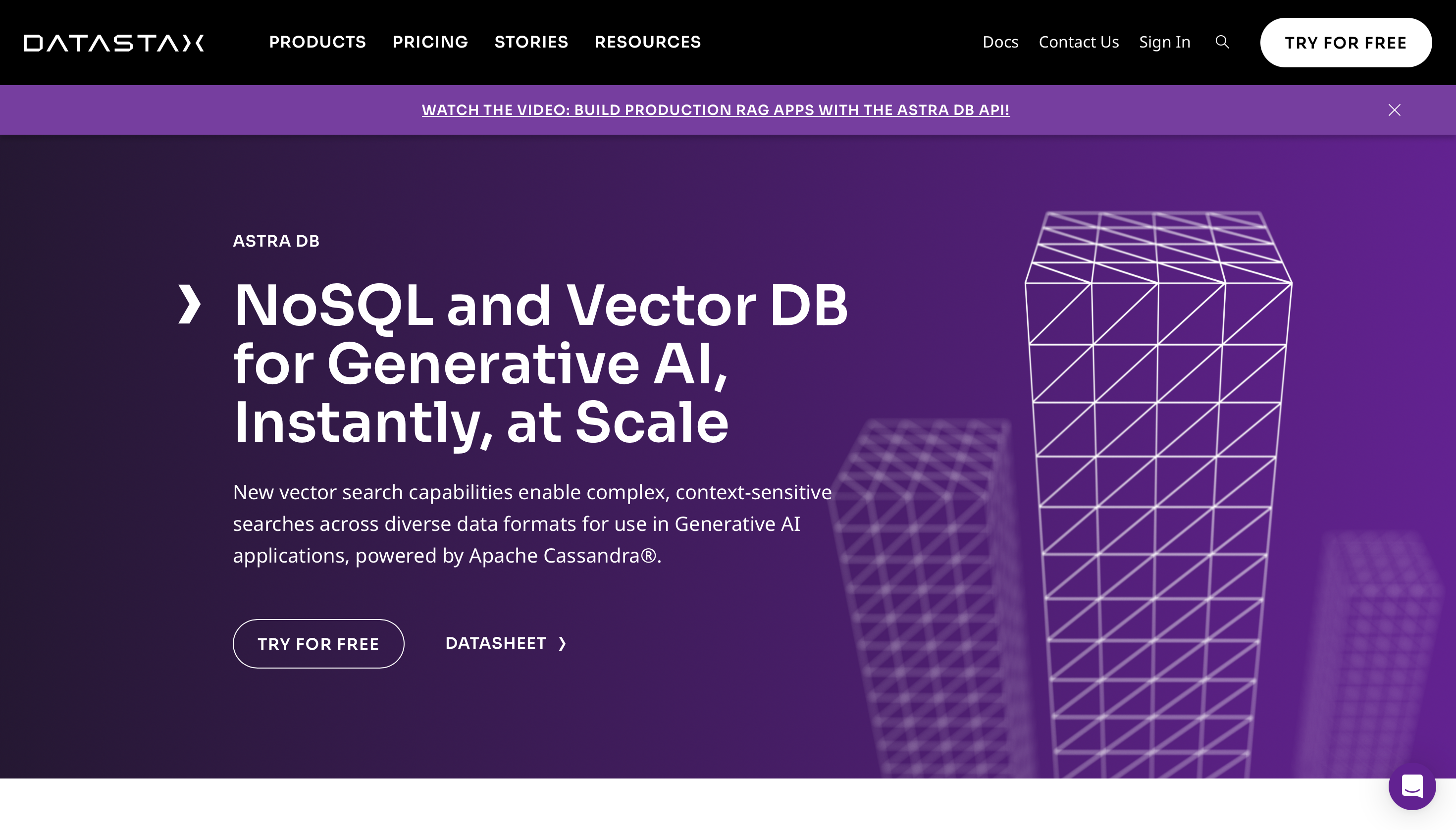

8. Astry DB

Doskonałe możliwości wyszukiwania wektorowego i architektura bezserwerowa AstraDB przekształcają generatywne aplikacje AI.

AstraDB to świetna opcja do zarządzania skomplikowanymi, kontekstowymi wyszukiwaniami różnych typów danych, ponieważ jest zbudowana na solidnym fundamencie Apache Cassandra i płynnie łączy skalowalność, stabilność i wydajność.

Zdolność AstraDB do obsługi heterogenicznych obciążeń, w tym danych przesyłanych strumieniowo, niewektorowych i wektorowych, przy jednoczesnym zachowaniu wyjątkowo niskich opóźnień dla jednoczesnych operacji zapytań i aktualizacji, jest jedną z jej najbardziej zauważalnych zalet.

Ta zdolność adaptacji jest niezbędna w przypadku generatywnych aplikacji AI, które wymagają przesyłania strumieniowego i przetwarzania danych w czasie rzeczywistym, aby zapewnić precyzyjne, kontekstowe odpowiedzi AI.

Bezserwerowe rozwiązanie AstraDB jeszcze bardziej ułatwia programowanie, umożliwiając programistom skoncentrowanie się na tworzeniu innowacyjnych aplikacji AI zamiast na zarządzaniu infrastrukturą zaplecza.

Od wskazówek szybkiego startu po szczegółowe lekcje na temat tworzenia chatbotów i systemów rekomendacji, AstraDB umożliwia programistom szybką realizację pomysłów na sztuczną inteligencję dzięki niezawodnym interfejsom API i płynnym interfejsom z dobrze znanymi narzędziami i platformami.

Generacyjne systemy sztucznej inteligencji klasy korporacyjnej muszą stawiać na pierwszym miejscu bezpieczeństwo i zgodność, a AstraDB zapewnia bezpieczeństwo na obu frontach.

Zapewnia głębokie funkcje bezpieczeństwa korporacyjnego i certyfikaty zgodności, gwarantujące, że aplikacje AI opracowane w AstraDB spełniają najsurowsze wytyczne dotyczące prywatności i ochrony danych.

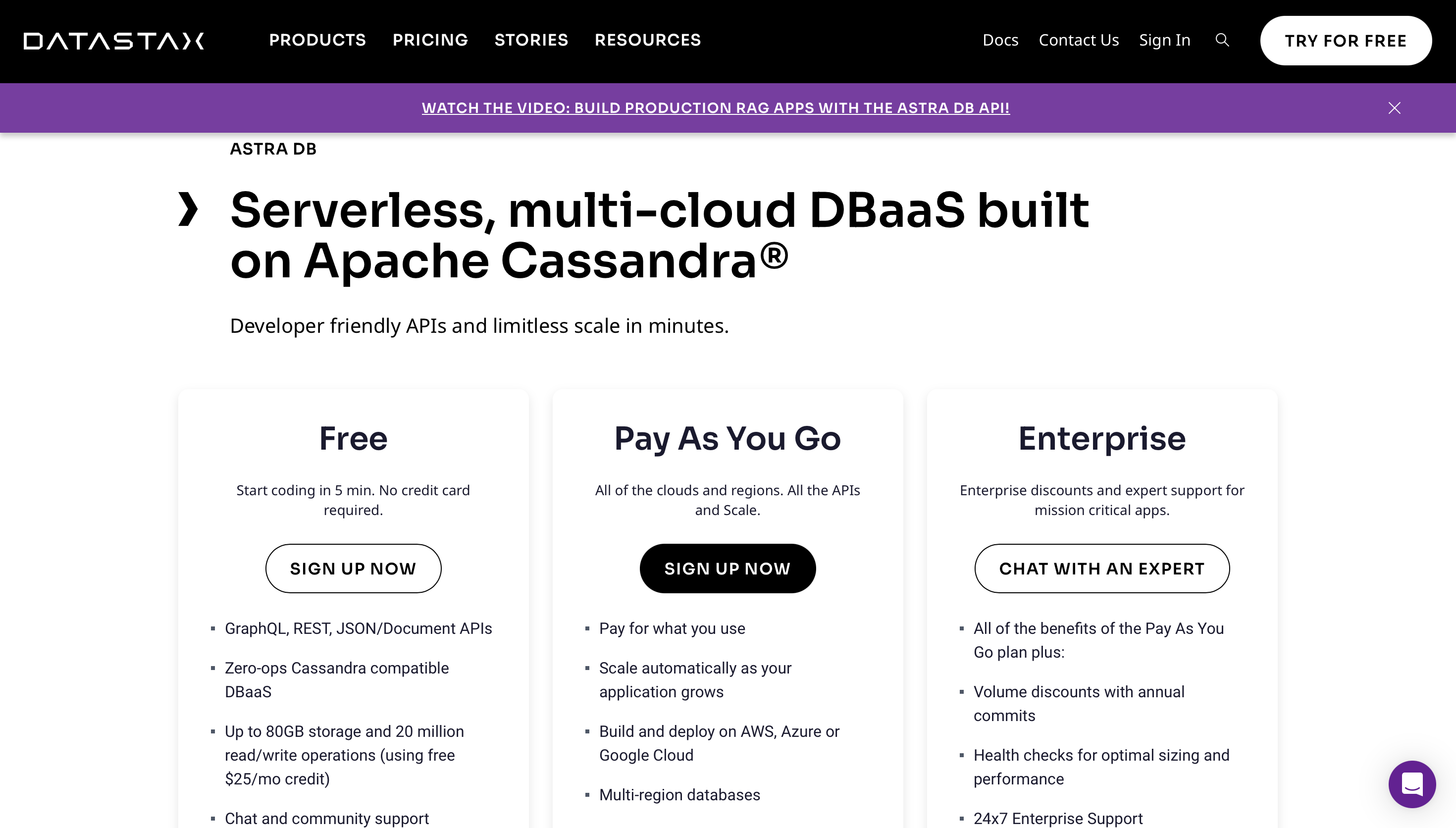

Cennik

Możesz zacząć z niego korzystać za darmo i oferuje model pay-as-you-go.

9. Otwórz wyszukiwanie

OpenSearch wydaje się atrakcyjną opcją dla osób eksplorujących wektorowe bazy danych, szczególnie w przypadku opracowywania adaptowalnych, skalowalnych i przyszłościowych systemów sztucznej inteligencji.

OpenSearch to wszechstronna wektorowa baza danych o otwartym kodzie źródłowym, która łączy w sobie możliwości analityki, zaawansowanego wyszukiwania wektorów i konwencjonalnego wyszukiwania w jeden spójny system.

Dzięki wykorzystaniu modeli osadzania uczenia maszynowego do kodowania znaczenia i kontekstu wielu form danych — dokumentów, zdjęć i plików audio — w wektorach na potrzeby wyszukiwania podobieństw, ta integracja jest szczególnie przydatna dla programistów, którzy chcą uwzględnić semantykę w swoich aplikacjach wyszukujących.

Chociaż OpenSearch ma wiele do zaoferowania, należy pamiętać, że w porównaniu z Elasticsearch wprowadzono znacznie mniej zmian w kodzie, szczególnie w kluczowych modułach, takich jak języki skryptowe i procesory potoków pozyskiwania.

Elasticsearch może mieć bardziej wyrafinowane możliwości ze względu na zwiększony wysiłek programistyczny, co prowadzi do różnic w wydajności, zestawie funkcji i aktualizacjach między nimi.

OpenSearch rekompensuje to dużą liczbą obserwujących społeczność i zaangażowaniem w pomysły open source, co skutkuje otwartą i elastyczną platformą.

Obsługuje szeroką gamę aplikacji wykraczających poza wyszukiwanie i analitykę, takich jak analityka obserwowalności i bezpieczeństwa, dzięki czemu jest elastycznym narzędziem do zadań wymagających dużej ilości danych.

Strategia oparta na społeczności zapewnia ciągłe ulepszenia i integracje, dzięki czemu platforma jest aktualna i wyjątkowa.

Cennik

Możesz zacząć z niego korzystać bezpłatnie.

10. Wyszukiwanie AI na platformie Azure

Azure AI Search to silna platforma, która poprawia możliwości wyszukiwania w generatywnych aplikacjach AI.

Wyróżnia się tym, że obsługuje wyszukiwanie wektorów, mechanizm indeksowania, przechowywania i wyszukiwania osadzonych wektorów w indeksie wyszukiwania.

Ta funkcja pomaga znajdować porównywalne dokumenty w przestrzeni wektorowej, co skutkuje bardziej trafnymi kontekstowo wynikami wyszukiwania.

Usługa Azure AI Search wyróżnia się obsługą sytuacji hybrydowych, w których wyszukiwania wektorów i słów kluczowych są wykonywane jednocześnie, co skutkuje ujednoliconym zestawem wyników, który często przewyższa skuteczność każdej techniki używanej osobno.

Połączenie materiału wektorowego i niewektorowego w tym samym indeksie pozwala na pełniejsze i bardziej elastyczne wyszukiwanie.

Funkcja wyszukiwania wektorowego w usłudze Azure AI Search jest powszechnie dostępna i bezpłatna dla wszystkich warstw usługi Azure AI Search.

Jest niezwykle elastyczny w przypadku różnych przypadków użycia i preferencji programistycznych ze względu na obsługę kilku środowisk programistycznych, która jest dostępna za pośrednictwem witryny Azure, Interfejsy API usług RESTi SDK, między innymi dla Pythona, JavaScript i .NET.

Dzięki głębokiej integracji z ekosystemem Azure AI usługa Azure AI Search oferuje więcej niż tylko wyszukiwanie; zwiększa także potencjał ekosystemu w zakresie generatywnych zastosowań sztucznej inteligencji.

Azure OpenAI Studio do osadzania modeli i usługi Azure AI Services do pobierania obrazów to tylko dwa przykłady usług objętych tą integracją.

Azure AI Search to elastyczne rozwiązanie dla programistów, którzy chcą włączyć zaawansowane funkcje wyszukiwania do swoich aplikacji ze względu na szeroką obsługę, która umożliwia korzystanie z szerokiej gamy aplikacji, od wyszukiwania podobieństw i wyszukiwania multimodalnego po wyszukiwanie hybrydowe i wyszukiwanie wielojęzyczne.

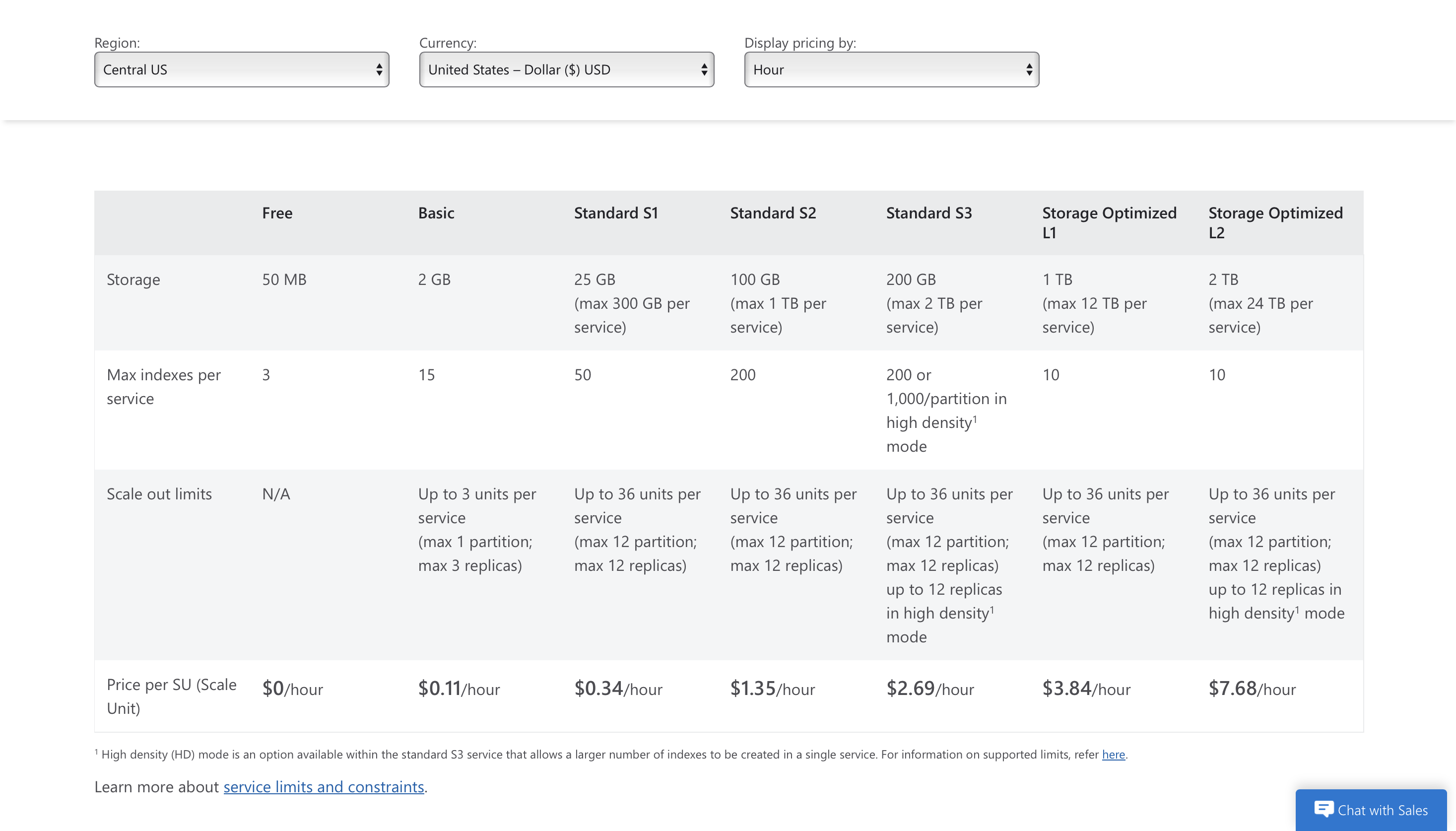

Cennik

Możesz zacząć z niego korzystać za darmo, a ceny premium zaczynają się od 0.11 USD za godzinę.

Wnioski

Wektorowe bazy danych zmieniają zarządzanie danymi w sztucznej inteligencji poprzez zarządzanie wektorami wielowymiarowymi, umożliwiając silne wyszukiwanie podobieństw i szybkie zapytania o najbliższego sąsiada w aplikacjach takich jak systemy rekomendacji i wykrywanie oszustw.

Dzięki zastosowaniu wyrafinowanych algorytmów indeksowania te bazy danych przekształcają skomplikowane, nieustrukturyzowane dane w znaczące wektory, zapewniając jednocześnie szybkość i elastyczność, których nie zapewniają tradycyjne bazy danych.

Godne uwagi platformy obejmują Pinecone, który wyróżnia się w generatywnych aplikacjach AI; FAISS, stworzony przez Facebook AI do gęstego grupowania wektorów; oraz Milvus, który słynie ze skalowalności i architektury natywnej dla chmury.

Weaviate łączy uczenie maszynowe z wyszukiwaniem kontekstowym, podczas gdy Vespa i Chroma wyróżniają się odpowiednio możliwościami obliczeniowymi o niskim opóźnieniu i łatwością obsługi.

Wektorowe bazy danych są niezbędnymi narzędziami do opracowywania technologii sztucznej inteligencji i uczenia maszynowego, ponieważ platformy takie jak Qdrant, AstraDB, OpenSearch i Azure AI Search zapewniają różnorodne usługi, od architektur bezserwerowych po rozbudowane możliwości wyszukiwania i analizy.

Dodaj komentarz