Innholdsfortegnelse[Gjemme seg][Forestilling]

Jeg er sikker på at du har hørt om kunstig intelligens, så vel som ord som maskinlæring og naturlig språkbehandling (NLP).

Spesielt hvis du jobber for et firma som håndterer hundrevis, om ikke tusenvis, av kundekontakter hver dag.

Dataanalyse av innlegg i sosiale medier, e-poster, chatter, åpne spørreundersøkelser og andre kilder er ikke en enkel prosess, og den blir enda vanskeligere når den kun er betrodd til folk.

Det er derfor mange mennesker er entusiastiske over potensialet til kunstig intelligens for deres daglige arbeid og for bedrifter.

AI-drevet tekstanalyse bruker et bredt spekter av tilnærminger eller algoritmer for å tolke språk organisk, hvorav en er emneanalyse, som brukes til automatisk å oppdage emner fra tekster.

Bedrifter kan bruke emneanalysemodeller for å overføre enkle jobber til maskiner i stedet for å overbelaste arbeidere med for mye data.

Vurder hvor mye tid teamet ditt kan spare og bruke til viktigere arbeid hvis en datamaskin kunne filtrere gjennom endeløse lister med kundeundersøkelser eller supportproblemer hver morgen.

I denne veiledningen vil vi se nærmere på emnemodellering, ulike metoder for emnemodellering, og få litt praktisk erfaring med det.

Hva er emnemodellering?

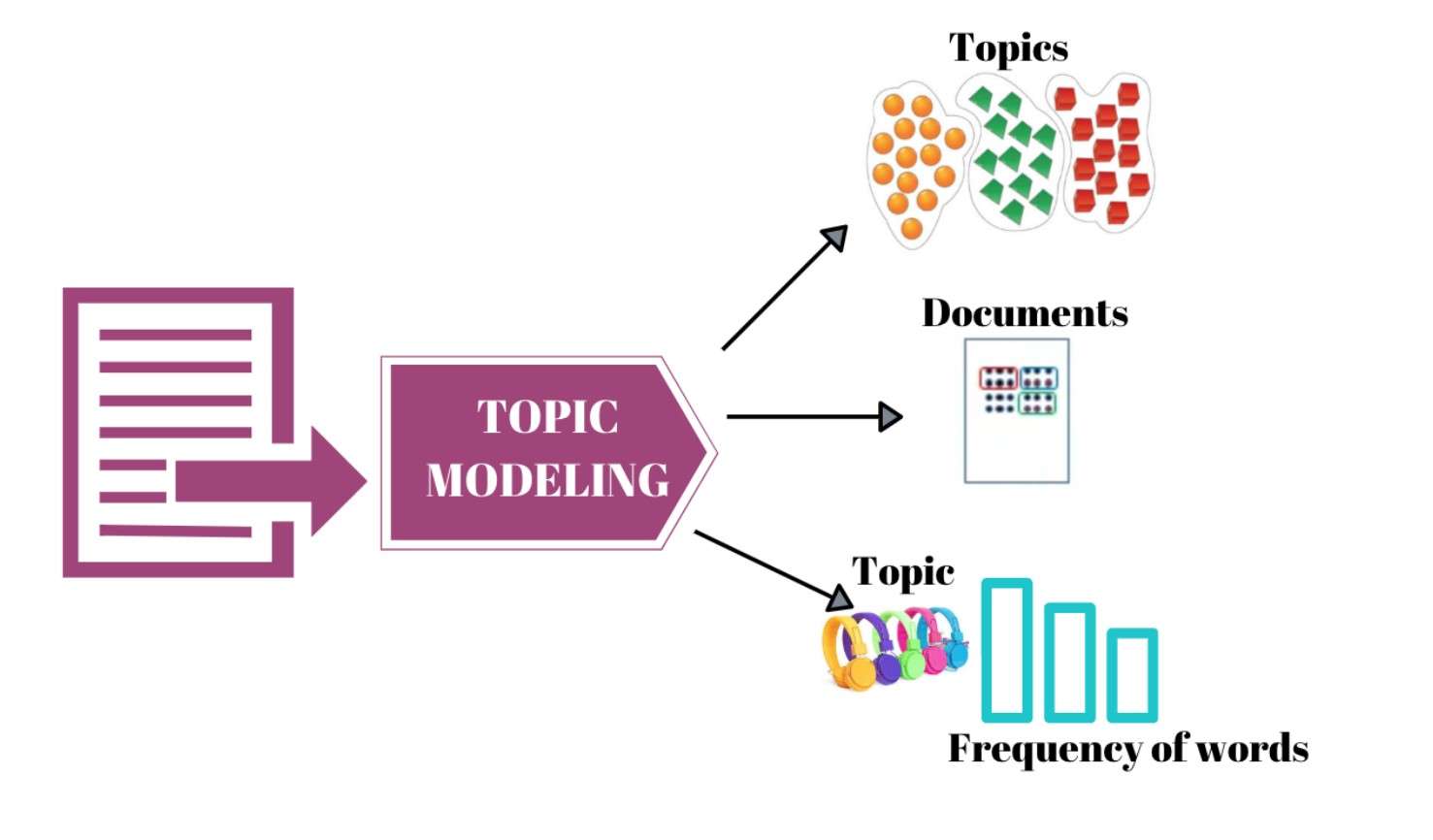

Emnemodellering er en type tekstgruvedrift der uovervåket og overvåket statistisk maskinlæring teknikker brukes til å oppdage trender i et korpus eller et betydelig volum av ustrukturert tekst.

Det kan ta den enorme samlingen av dokumenter og bruke en likhetsmetode for å ordne ordene i klynger av termer og oppdage emner.

Det virker litt komplekst og vanskelig, så la oss forenkle emnemodelleringsprosedyren!

Anta at du leser en avis med et sett med fargede highlighters i hånden.

Er ikke det gammeldags?

Jeg innser at i disse dager er det få som leser aviser på trykk; alt er digitalt, og highlightere hører fortiden til! Lat som om du er din far eller mor!

Så når du leser avisen fremhever du de viktige begrepene.

Enda en antagelse!

Du bruker en annen fargetone for å understreke nøkkelordene for ulike temaer. Du kategoriserer søkeordene avhengig av fargen og emnene som er oppgitt.

Hver samling av ord merket med en bestemt farge er en liste over nøkkelord for et gitt emne. Mengden av forskjellige farger du har valgt viser antall temaer.

Dette er den mest grunnleggende emnemodelleringen. Det hjelper til med forståelse, organisering og oppsummering av store tekstsamlinger.

Vær imidlertid oppmerksom på at automatiserte emnemodeller krever mye innhold for å være effektive. Hvis du har et kort papir, kan det være lurt å gå old school og bruke highlightere!

Det er også en fordel å bruke litt tid på å bli kjent med dataene. Dette vil gi deg en grunnleggende følelse av hva emnemodellen skal finne.

For eksempel kan den dagboken handle om dine nåværende og tidligere forhold. Derfor forventer jeg at min tekstgruverobot-kompis kommer med lignende ideer.

Dette kan hjelpe deg med å analysere kvaliteten på emnene du har identifisert bedre, og om nødvendig justere søkeordsettene.

Komponenter i emnemodellering

Sannsynlighetsmodell

Tilfeldige variabler og sannsynlighetsfordelinger er inkorporert i representasjonen av en hendelse eller et fenomen i sannsynlighetsmodeller.

En deterministisk modell gir en enkelt potensiell konklusjon for en hendelse, mens en sannsynlighetsmodell gir en sannsynlighetsfordeling som en løsning.

Disse modellene tar i betraktning realiteten at vi sjelden har fullstendig kunnskap om en situasjon. Det er nesten alltid et element av tilfeldighet å vurdere.

For eksempel er livsforsikring basert på realiteten at vi vet at vi vil dø, men vi vet ikke når. Disse modellene kan være delvis deterministiske, delvis tilfeldige eller helt tilfeldige.

Informasjonsinnhenting

Informasjonshenting (IR) er et program som organiserer, lagrer, henter og evaluerer informasjon fra dokumentlager, spesielt tekstinformasjon.

Teknologien hjelper brukerne med å finne informasjonen de trenger, men den gir ikke tydelig svar på henvendelsene deres. Den varsler om tilstedeværelse og plassering av papirer som kan gi nødvendig informasjon.

Relevante dokumenter er de som møter brukerens behov. Et feilfritt IR-system vil kun returnere utvalgte dokumenter.

Emne-sammenheng

Emnekoherens skårer et enkelt emne ved å beregne graden av semantisk likhet mellom emnets høye poengsum. Disse beregningene hjelper til med å skille mellom emner som er semantisk tolkbare og emner som er statistiske slutningsartefakter.

Hvis en gruppe påstander eller fakta støtter hverandre, sies de å være sammenhengende.

Som et resultat kan et sammenhengende faktasett forstås i en kontekst som omfatter alle eller de fleste fakta. «Spillet er en lagsport», «spillet spilles med en ball» og «spillet krever enorm fysisk innsats» er alle eksempler på sammenhengende faktasett.

Ulike metoder for emnemodellering

Denne kritiske prosedyren kan utføres ved hjelp av en rekke algoritmer eller metoder. Blant dem er:

- Latent Dirichlet Allocation (LDA)

- Ikke negativ matrisefaktorisering (NMF)

- Latent semantisk analyse (LSA)

- Probabilistisk latent semantisk analyse (pLSA)

Latent Dirichlet Allocation (LDA)

For å oppdage sammenhenger mellom flere tekster i et korpus, brukes det statistiske og grafiske konseptet Latent Dirichlet Allocation.

Ved å bruke Variational Exception Maximization (VEM)-tilnærmingen oppnås det største sannsynlighetsestimatet fra hele tekstkorpuset.

Tradisjonelt velges de øverste ordene fra en pose med ord.

Men setningen er fullstendig meningsløs.

I henhold til denne teknikken vil hver tekst representeres av en sannsynlighetsfordeling av emner, og hvert emne ved en sannsynlighetsfordeling av ord.

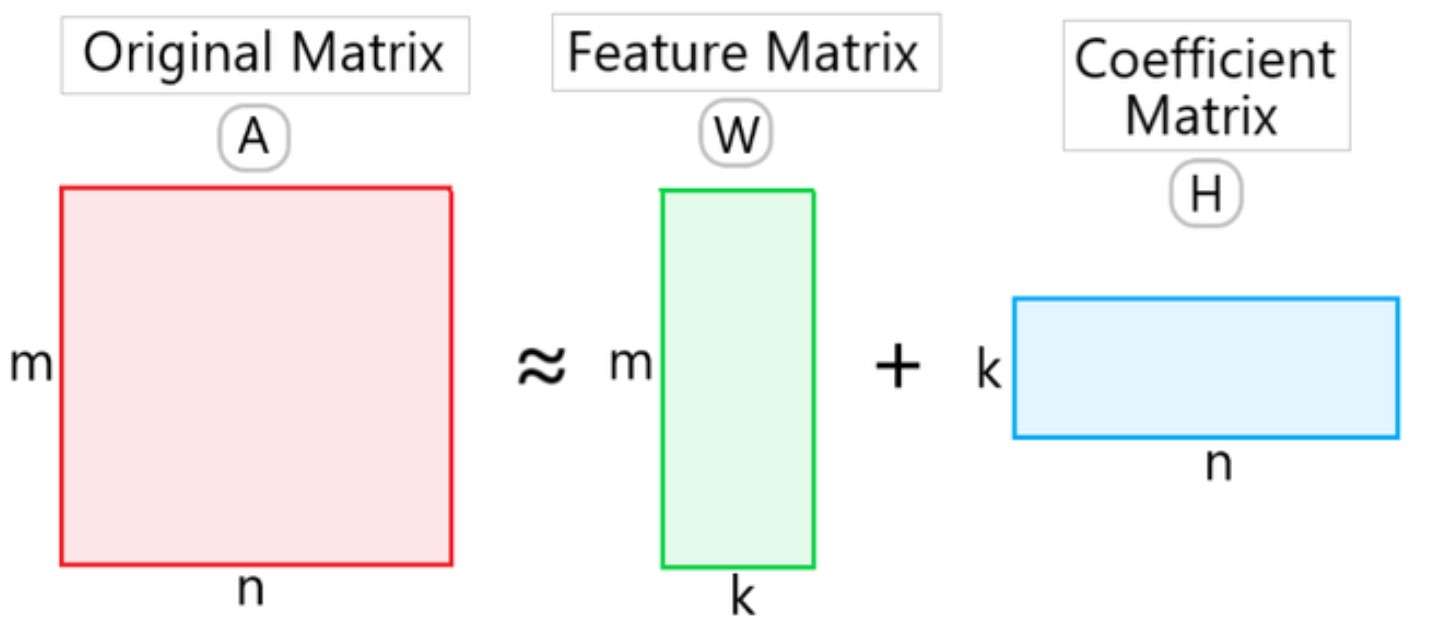

Ikke negativ matrisefaktorisering (NMF)

Matrise med ikke-negative verdier faktorisering er en banebrytende funksjon utvinning tilnærming.

Når det er mange kvaliteter og egenskapene er vage eller har dårlig forutsigbarhet, er NMF fordelaktig. NMF kan generere betydelige mønstre, emner eller temaer ved å kombinere egenskaper.

NMF genererer hver funksjon som en lineær kombinasjon av det opprinnelige attributtsettet.

Hver funksjon inneholder et sett med koeffisienter som representerer viktigheten av hver egenskap på funksjonen. Hvert numerisk attributt og hver verdi av hvert kategoriattributt har sin egen koeffisient.

Alle koeffisientene er positive.

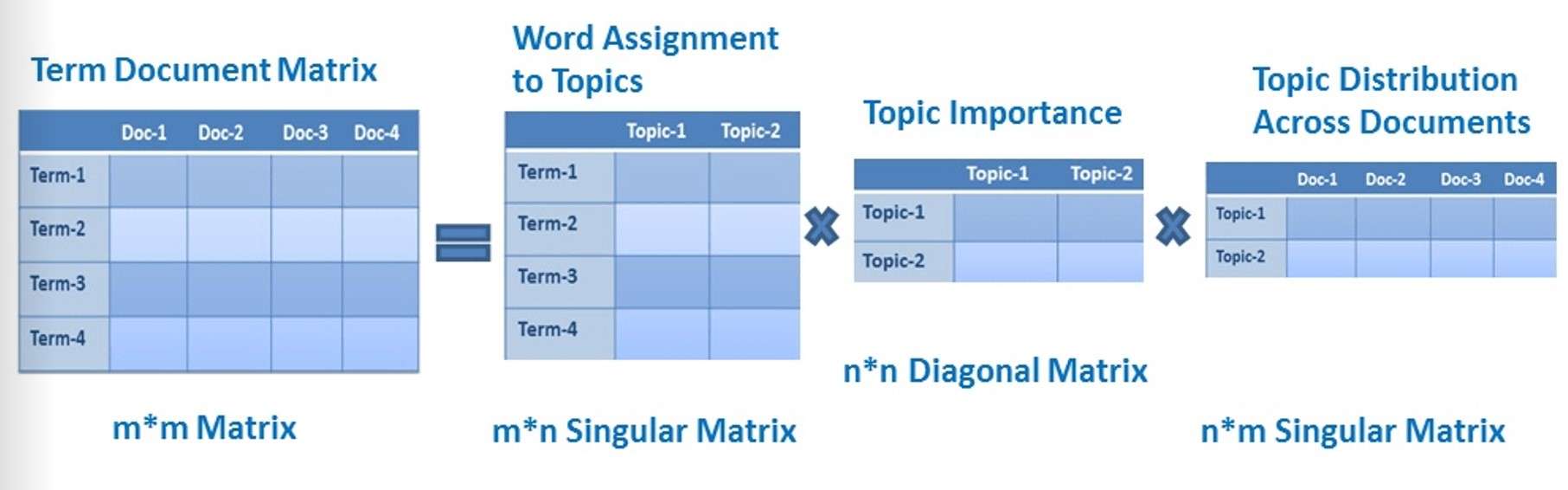

Latent semantisk analyse

Det er en annen uovervåket læringsmetode som brukes til å trekke ut assosiasjoner mellom ord i et sett med dokumenter, er latent semantisk analyse.

Dette hjelper oss å velge riktige dokumenter. Dens primære funksjon er å redusere dimensjonaliteten til det enorme korpuset av tekstdata.

Disse unødvendige dataene tjener som bakgrunnsstøy for å oppnå nødvendig innsikt fra dataene.

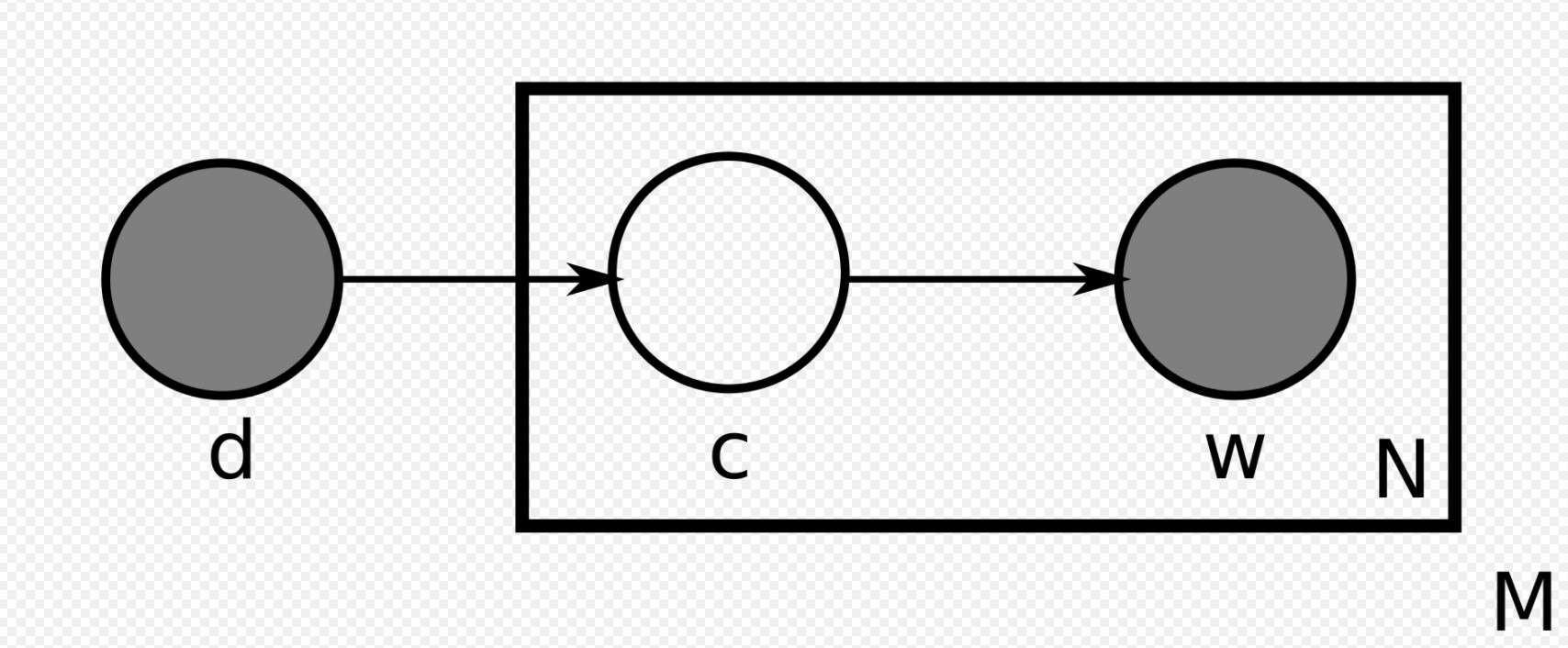

Probabilistisk latent semantisk analyse (pLSA)

Probabilistisk latent semantisk analyse (PLSA), noen ganger kjent som probabilistisk latent semantisk indeksering (PLSI, spesielt i informasjonsinnhentingskretser), er en statistisk tilnærming for å analysere to-modus og samtidig forekomstdata.

Faktisk, i likhet med latent semantisk analyse, som PLSA dukket opp fra, kan en lavdimensjonal representasjon av de observerte variablene utledes når det gjelder deres affinitet til bestemte skjulte variabler.

Praktisk med emnemodellering i Python

Nå skal jeg lede deg gjennom en emnemodelleringsoppgave med Python programmeringsspråk ved å bruke et eksempel fra den virkelige verden.

Jeg skal modellere forskningsartikler. Datasettet jeg skal bruke her kommer fra kaggle.com. Du kan enkelt hente alle filene jeg bruker i dette arbeidet fra dette side.

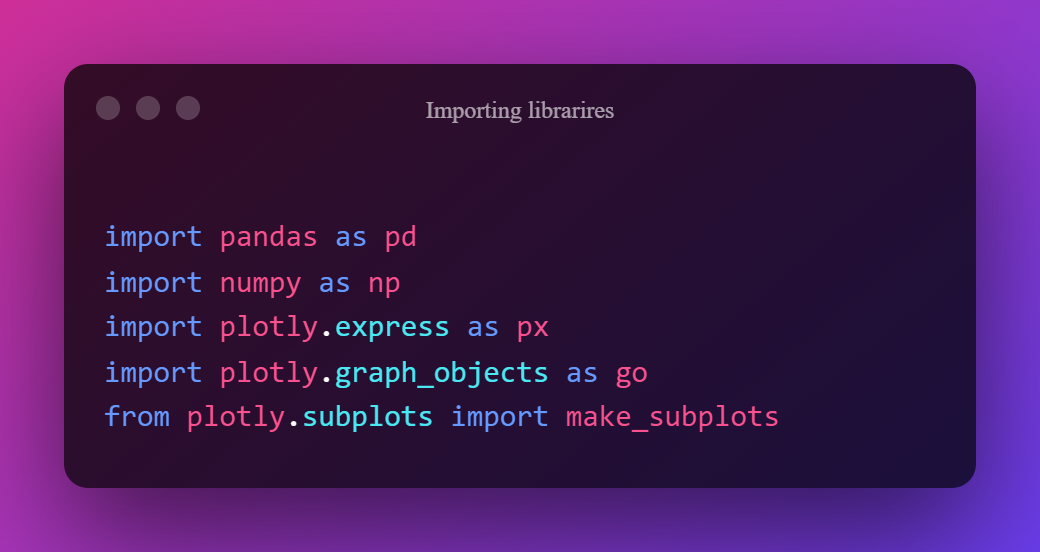

La oss komme i gang med Topic Modeling ved å bruke Python ved å importere alle de essensielle bibliotekene:

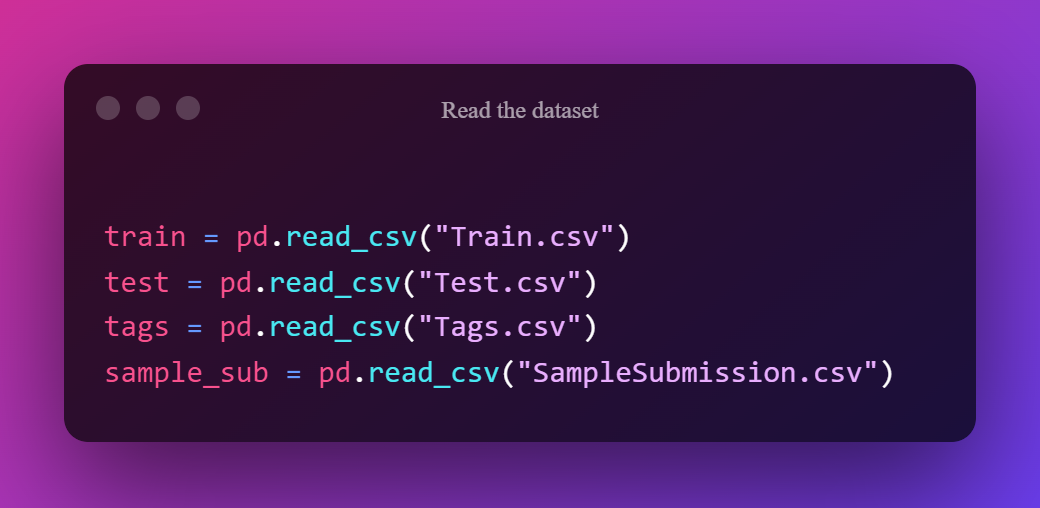

Følgende trinn er å lese alle datasettene jeg skal bruke i denne oppgaven:

Utforskende dataanalyse

EDA (Exploratory Data Analysis) er en statistisk metode som bruker visuelle elementer. Den bruker statistiske sammendrag og grafiske representasjoner for å oppdage trender, mønstre og teste antakelser.

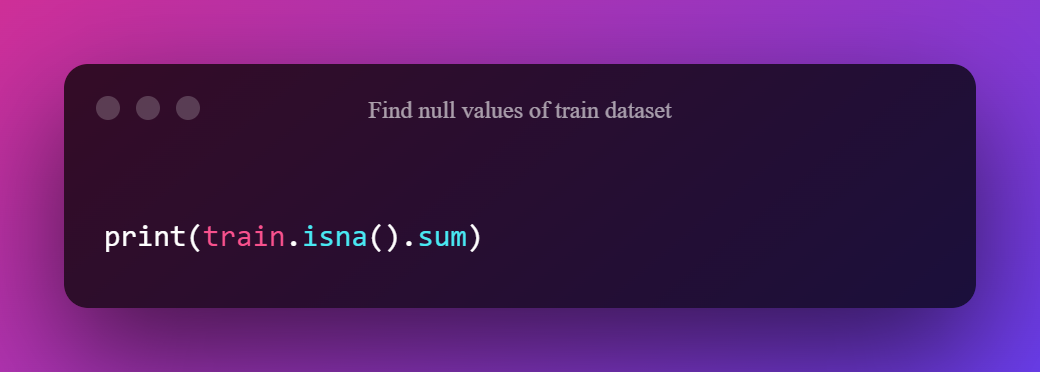

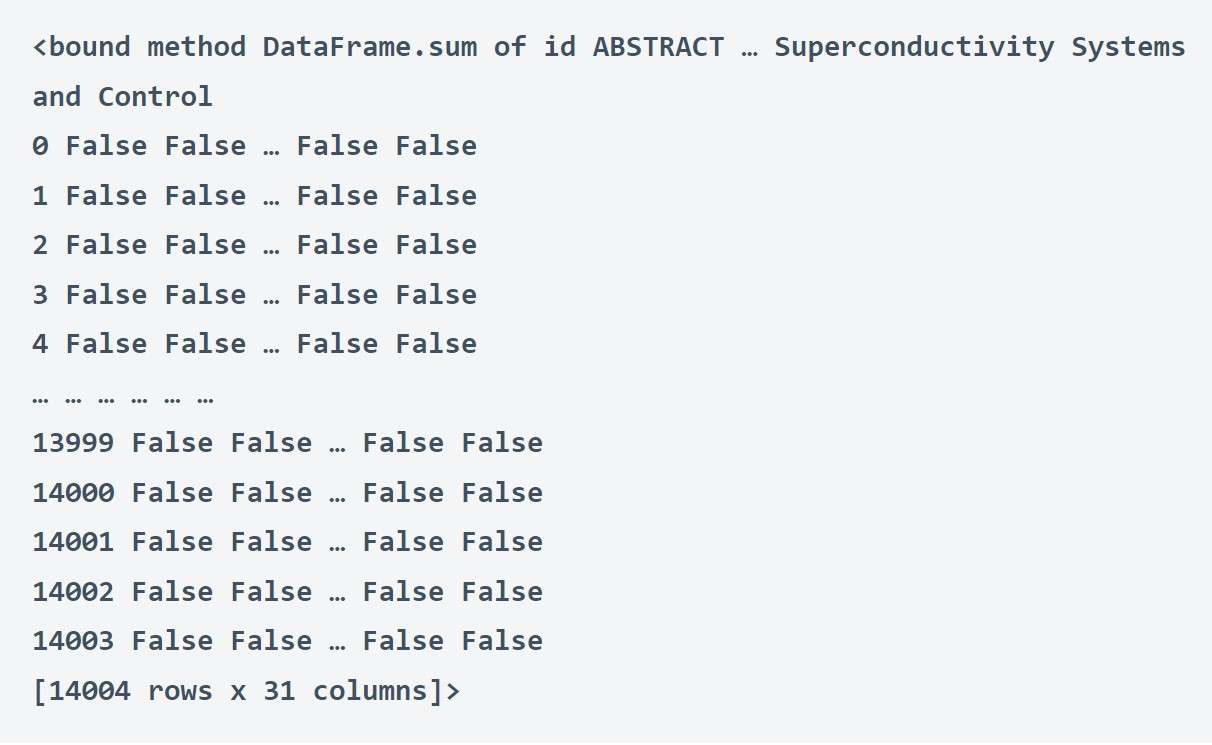

Jeg skal gjøre litt utforskende dataanalyse før jeg starter emnemodellering for å se om det er noen mønstre eller sammenhenger i dataene:

Nå vil vi finne nullverdiene til testdatasettet:

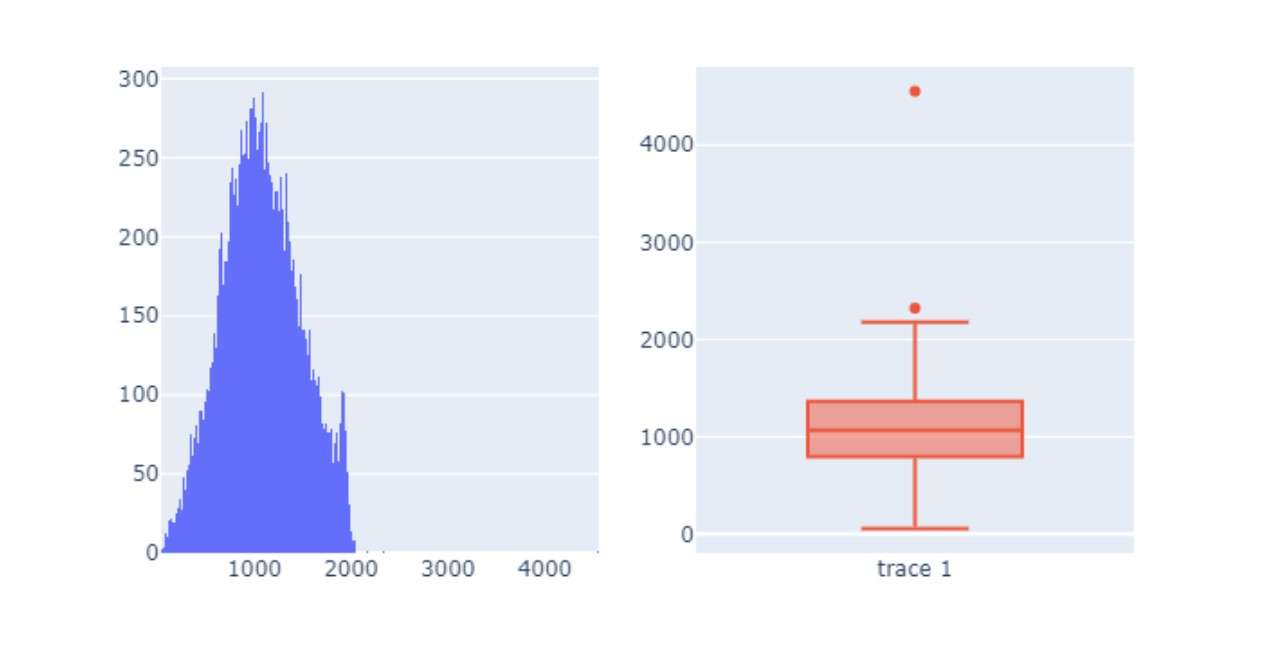

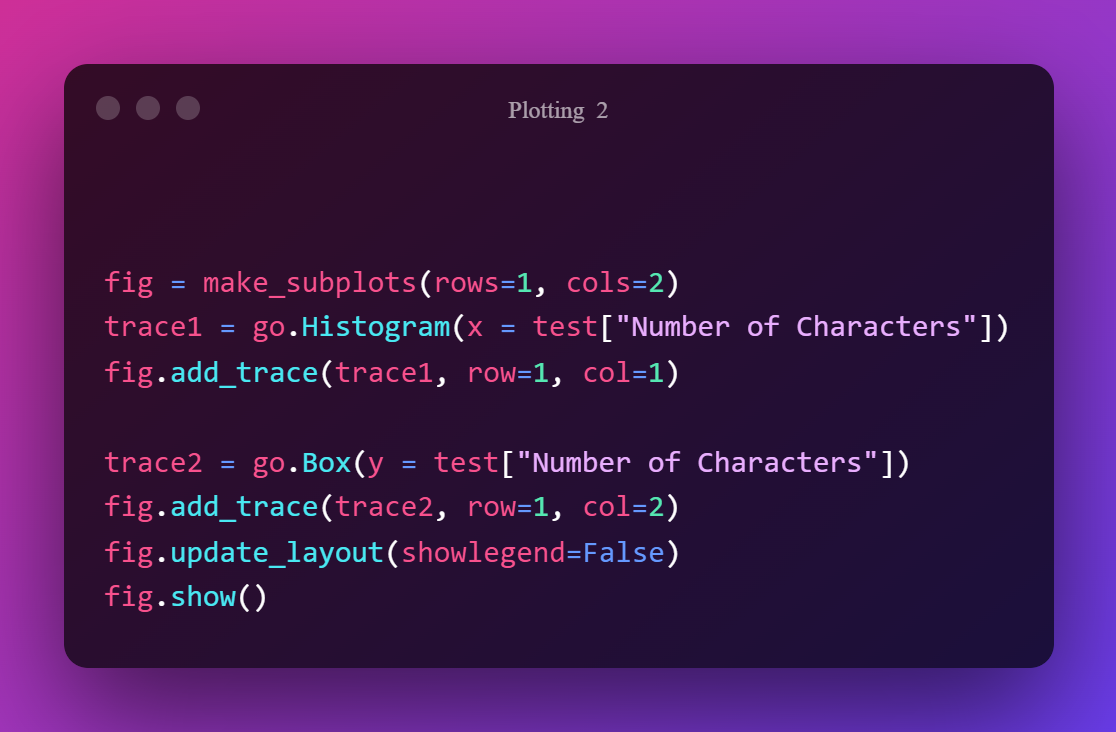

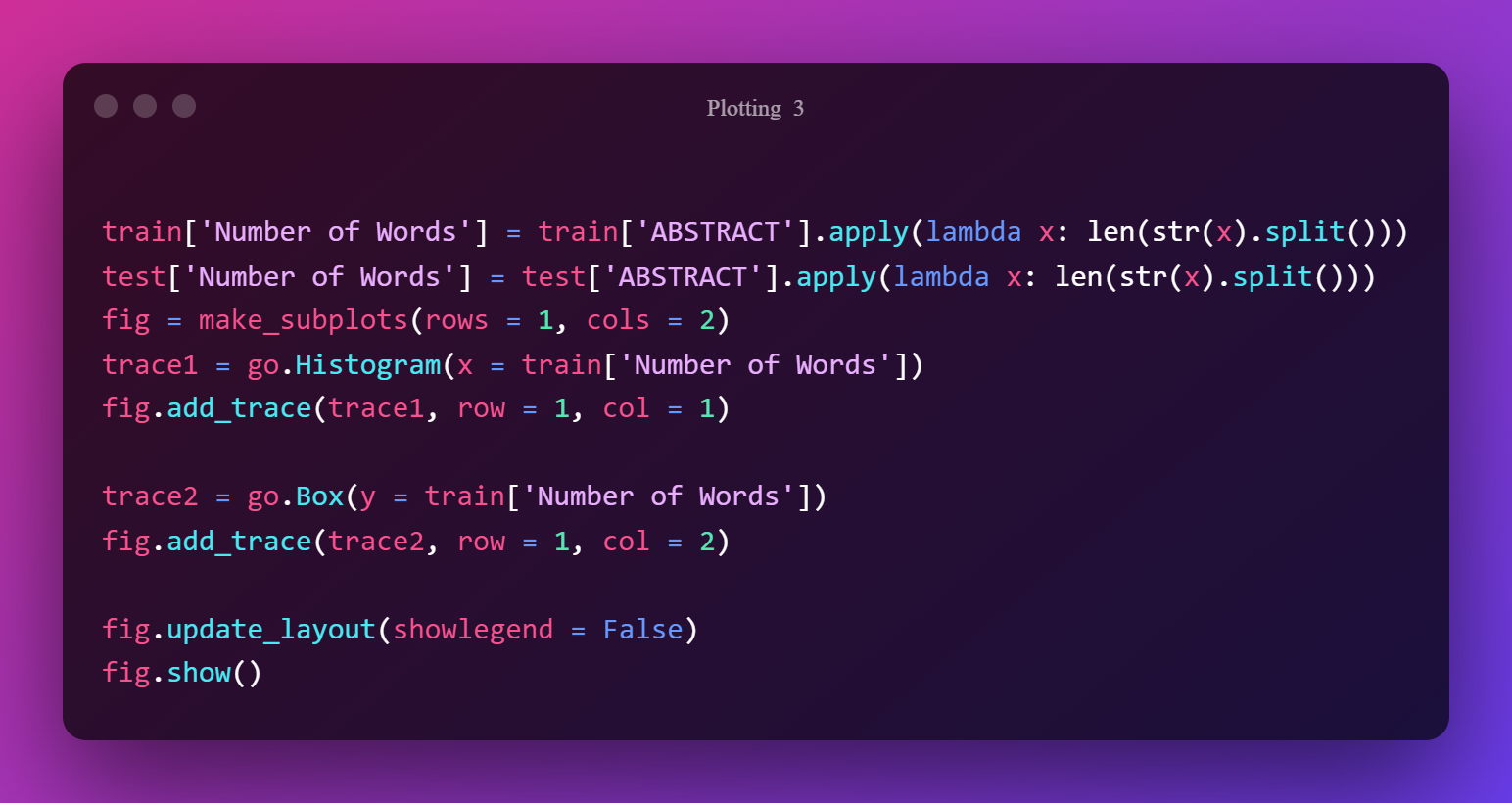

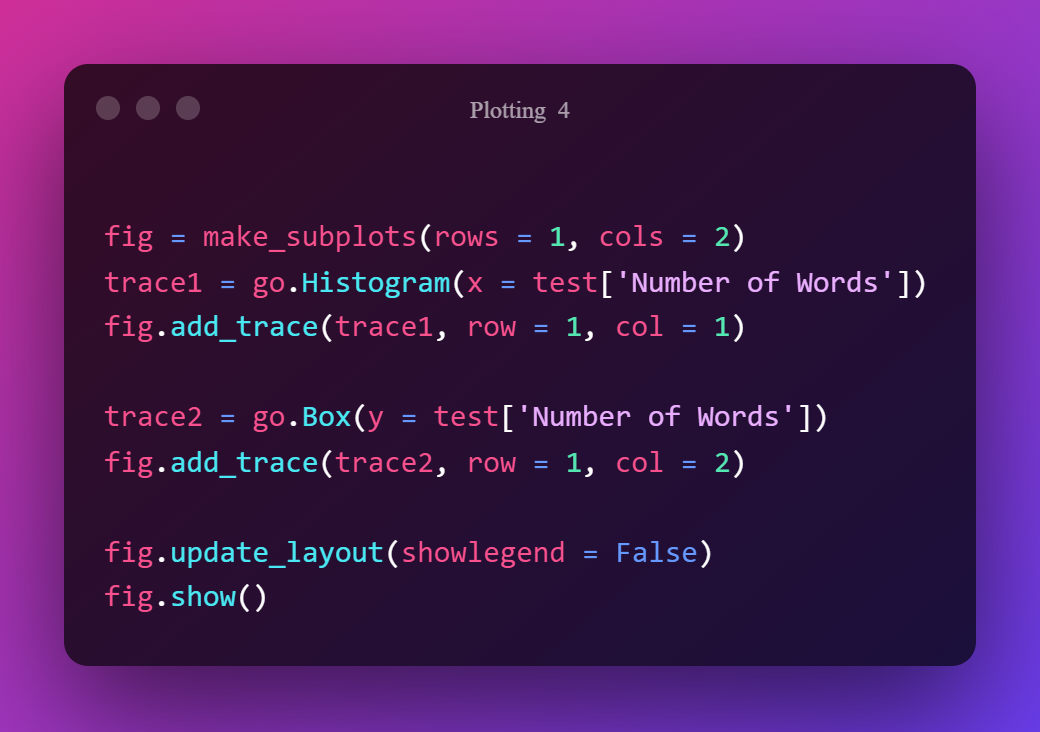

Nå skal jeg plotte et histogram og et boksplott for å sjekke forholdet mellom variablene.

Mengden karakterer i Abstracts of the Train-settet varierer veldig.

På toget har vi minimum 54 og maksimum 4551 tegn. 1065 er gjennomsnittlig antall tegn.

Testsettet ser ut til å være mer interessant enn treningssettet siden testsettet har 46 tegn mens treningssettet har 2841.

Som et resultat hadde testsettet en median på 1058 tegn, som er lik treningssettet.

Antall ord i læringssettet følger et lignende mønster som antall bokstaver.

Minimum 8 ord og maksimum 665 ord er tillatt. Som et resultat er gjennomsnittlig antall ord 153.

Det kreves minimum syv ord i et sammendrag og maksimalt 452 ord i prøvesettet.

Medianen, i dette tilfellet, er 153, som er identisk med medianen i treningssettet.

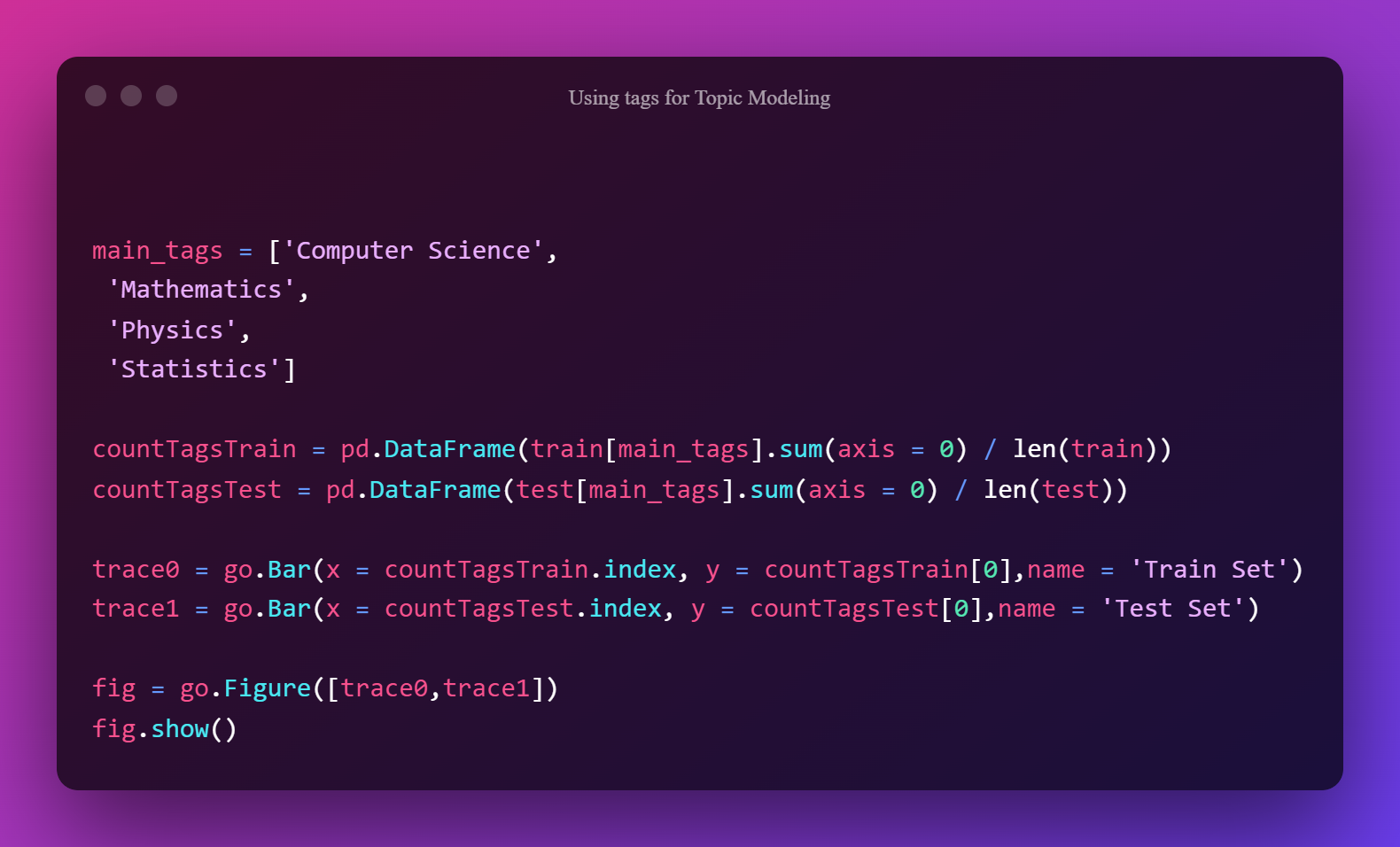

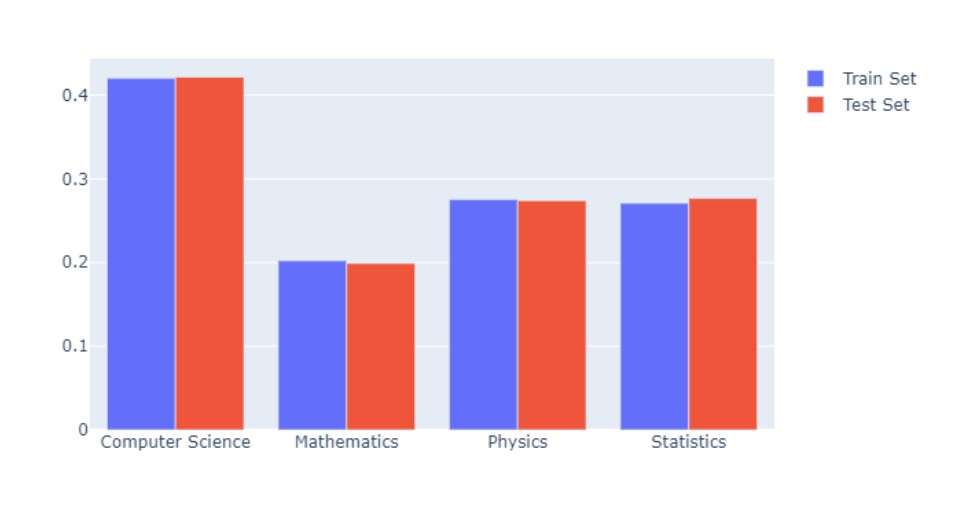

Bruke koder for emnemodellering

Det er flere temamodelleringsstrategier. Jeg skal bruke tagger i denne øvelsen; la oss se på hvordan du gjør det ved å undersøke taggene:

Anvendelser av emnemodellering

- Et tekstsammendrag kan brukes til å skjelne emnet for et dokument eller en bok.

- Den kan brukes til å fjerne kandidatens skjevhet fra eksamenspoeng.

- Emnemodellering kan brukes til å bygge semantiske relasjoner mellom ord i grafbaserte modeller.

- Det kan forbedre kundeservicen ved å oppdage og svare på nøkkelord i kundens forespørsel. Kundene vil ha mer tro på deg siden du har gitt dem den hjelpen de trenger på det rette tidspunktet og uten at det har påført dem problemer. Som et resultat øker kundelojaliteten dramatisk, og selskapets verdi øker.

konklusjonen

Emnemodellering er en slags statistisk modellering som brukes til å avdekke abstrakte "emner" som finnes i en tekstsamling.

Det er en form for den statistiske modellen som brukes i maskinlæring og naturlig språkbehandling for å avdekke abstrakte konsepter som finnes i et sett med tekster.

Det er en tekstgruvemetode som er mye brukt for å finne latente semantiske mønstre i brødtekst.

Legg igjen en kommentar