Innholdsfortegnelse[Gjemme seg][Forestilling]

Velkommen til dette fengslende blogginnlegget om Auto-GPT, et uferdig eksperimentelt program som fungerer som et fascinerende eksempel på hvordan Language Model AI (LLM)-systemer som GPT-4 er i stand til å skape og fullføre et bredt spekter av jobber på egen hånd.

Tallrike oppgaver kan automatiseres med høy presisjon og effektivitet takket være den fantastiske teknologien kjent som Auto-GPT. Den gjør bruk av GPT-4s kraftige prosesseringsfunksjoner for naturlig språk.

Denne utviklingen indikerer hvordan LLM-er, et stort skritt fremover for AI, har potensial til å endre hvordan vi ser jobbautomatisering betydelig.

Vi vil undersøke hva Auto-GPT er, hvordan det fungerer og hva slags oppgaver den kan gjøre i dette innlegget. Betydningen av Auto-GPT i forhold til oppgaveautomatisering og fremtiden til LLM vil også bli dekket.

Vi vil også ta opp bekymringer angående potensielle farer og negative effekter ved å bruke LLM og Auto-GPT, og fremheve betydningen av ansvarlig og etisk bruk.

Du vil ha en bedre kunnskap om Auto-GPT og potensialet for LLM-er til å revolusjonere oppgaveautomatisering ved avslutningen av denne artikkelen.

Så la oss komme i gang!

Hva er AutoGPT?

Auto-GPT er et banebrytende program som forvandler verden av oppgaveautomatisering. Det er et åpen kildekode-program som bruker de kraftige kreftene til LLM-er som GPT-4 for autonomt å skape og håndtere en rekke jobber.

Gjennom bruk av Auto-GPT kan organisasjoner og enkeltpersoner strømlinjeforme prosesser som rapportskriving, innholdsoppretting og dataanalyse for å spare tid og kutte ned på feil.

Den banebrytende teknologien skaper sammenhengende og relevant innhold ved å lære av enorme datamengder. Tekst som ble produsert som en konsekvens er i hovedsak menneskeskrevet tekst.

Auto-GPT er en game-changer innen oppgaveautomatisering, som lar organisasjoner og enkeltpersoner konsentrere seg om andre viktige plikter mens de overlater repeterende og underlige jobber til programmet.

Vi kan forvente å se stadig kraftigere programvare som Auto-GPT som er i stand til å utføre stadig mer komplekse oppgaver ettersom LLM fortsetter å utvikle seg.

AutoGPT er et banebrytende autonomt AI-program som viser hvordan GPT-4 kan brukes til å utføre en rekke oppgaver. Brukere kan bruke AI til å fullføre oppgaver som forskning, koding og kreativ skriving ved å tildele roller og mål og bruke dens evne.

Når det gjelder hvordan AI-drevet teknologi vil endre hvordan vi opererer og engasjerer oss i AI-systemer i fremtiden, gir AutoGPT et glimt.

Men, hvordan fungerer det?

Auto-GPT bruker den nyeste utviklingen innen LLM, spesielt GPT-4, for automatisk å produsere innhold som er sammenhengende og relevant. Programmet lærer av enorme mengder data, noe som gjør det i stand til å gjenkjenne mønstre og sammenhenger mellom ord og setninger.

Ved å bruke denne informasjonen produserer Auto-GPT deretter tekst som svar på en melding eller inndata. Dette innspillet kan komme i form av et direktiv, en oppgave eller et sett med retningslinjer.

Auto-GPT lager innhold som er kontekstuelt hensiktsmessig og logisk konsistent ved å bruke sine banebrytende algoritmer og naturlige språkbehandlingsferdigheter etter mottar input. Auto-GPT er en betydelig ressurs for organisasjoner og personer som ønsker å automatisere prosesser og spare tid fordi teksten den produserer praktisk talt ikke kan skilles fra menneskeskrevne språk.

Auto-GPTs styrke ligger i dens kapasitet til å lære av enorme mengder data og produsere tekst som er både relevant og logisk, noe som gjør den til et avgjørende verktøy innen jobbautomatisering.

Kort sagt, AutoGPT itererer på sine egne spørsmål, evaluerer dem kritisk og bygger på dem i hver iterasjon. Den utnytter deretter GPT-4 og GPT-3.5 gjennom API for å produsere hele prosjekter. Den har muligheten til å lese og skrive filer, få tilgang til internett og undersøke svarene på sine egne spørsmål. Den kan også kombinere funnene med historien til de relevante spørsmålene.

Oppgaver som Auto-GPT kan utføre

Et fleksibelt program, Auto-GPT, kan brukes til en rekke aktiviteter, inkludert å lage rapporter og dataanalyse. I denne delen skal vi se på noen av funksjonene som Auto-GPT kan utføre og hvordan den automatiserer dem.

Content Creation

Innhold for nettsteder, blogger og innlegg på sosiale medier kan opprettes med Auto-GPT. Auto-GPT kan produsere høykvalitets, relevant og interessant materiale hvis du gir det et emne eller et sett med retningslinjer.

Oversettelse

Du kan utføre oversettelsesaktiviteter med Auto-GPT. Tekst kan oversettes til et annet språk ved hjelp av Auto-GPT ved å skrive den inn på ett språk. Bedrifter som opererer i forskjellige land og krever en rask dokument- eller kommunikasjonsoversettelse, kan oppleve at denne muligheten er svært nyttig.

Kundeservice

Kundestøtteoppgaver som å svare på hyppige forespørsler og løse problemer kan potensielt automatiseres med Auto-GPT. Auto-GPT kan forstå kundehenvendelser og levere relevante løsninger ved å bruke naturlig språkbehandling.

Dataanalyse

Dataanalyseaktiviteter kan utføres med Auto-GPT. Datainndata lar Auto-GPT analysere informasjonen og produsere innsikt som kan brukes til å ta beslutninger.

Skrive rapporter

Bedrifter og forskere kan dra nytte av å bruke Auto-GPT siden den kan brukes til å produsere rapporter avhengig av datainndata. Ved å legge inn data kan Auto-GPT analysere informasjonen og produsere resultater som er nøyaktige og lærerike.

Koding

Auto-GPT kan brukes til å generere fullstendige programmer eller kodebiter for kodejobber. Auto-GPT kan generere kode som er effektiv og effektiv ved å ta hensyn til programmeringsparametere eller behov. Utviklere som trenger å skrive kode presist og raskt vil finne denne funksjonen svært nyttig.

Jeg har nettopp nevnt noen få oppgaver; tross alt er det bare fantasien som setter grenser.

Hvordan installerer du AutoGPT på din Mac?

Du kan enkelt bruke kraften til GPT-4 ved å bruke AutoGPT til å utføre en rekke aktiviteter, inkludert forskning, koding og narrativ forbedring.

Det er noen krav du må installere på datamaskinen din før vi starter installasjonsprosessen:

- gå

- Python 3.10 eller nyere

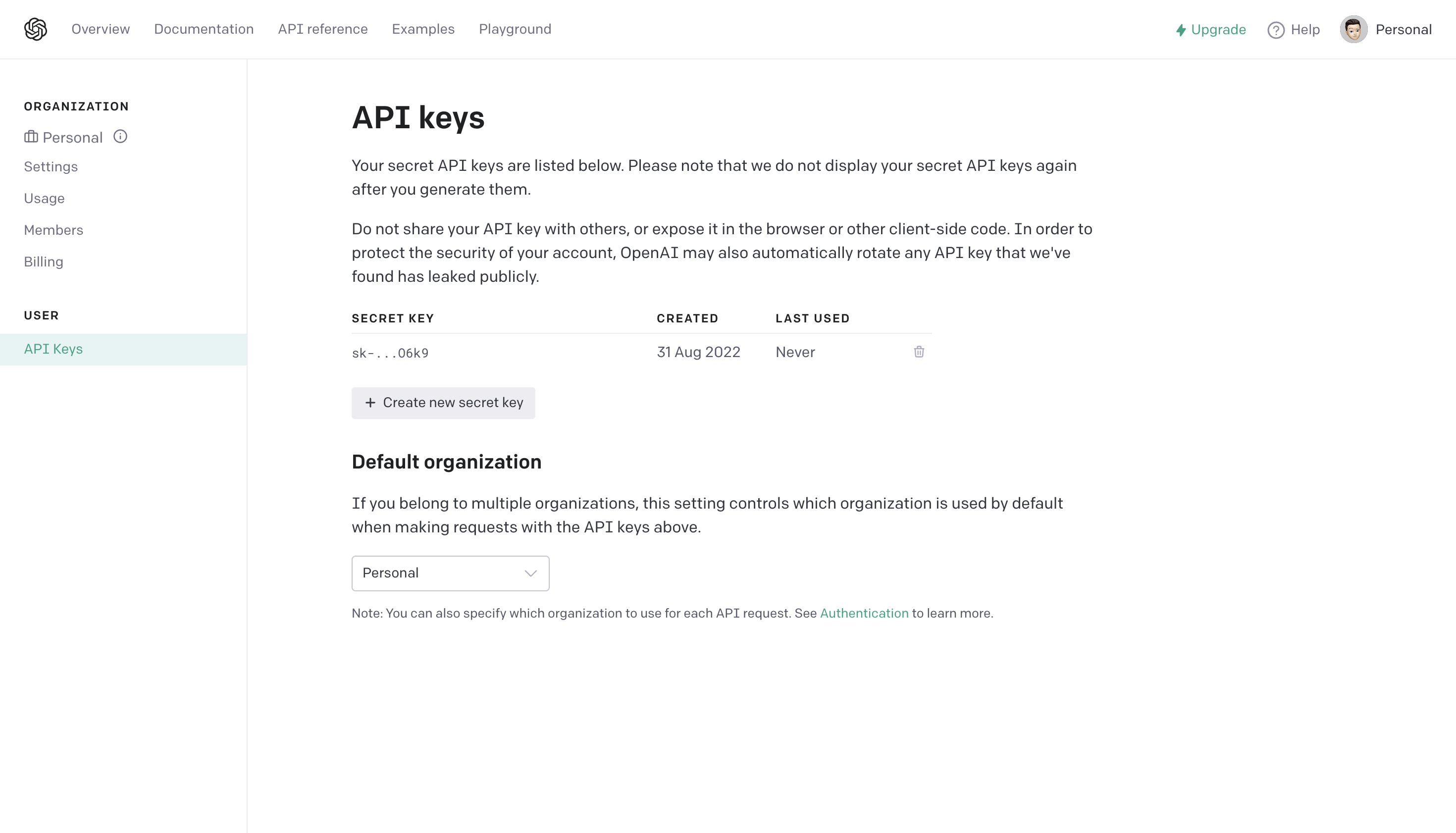

- OpenAI API-nøkkel

Merk: Jeg bruker MacOS med den nyeste versjonen.

Sette opp AutoGPT

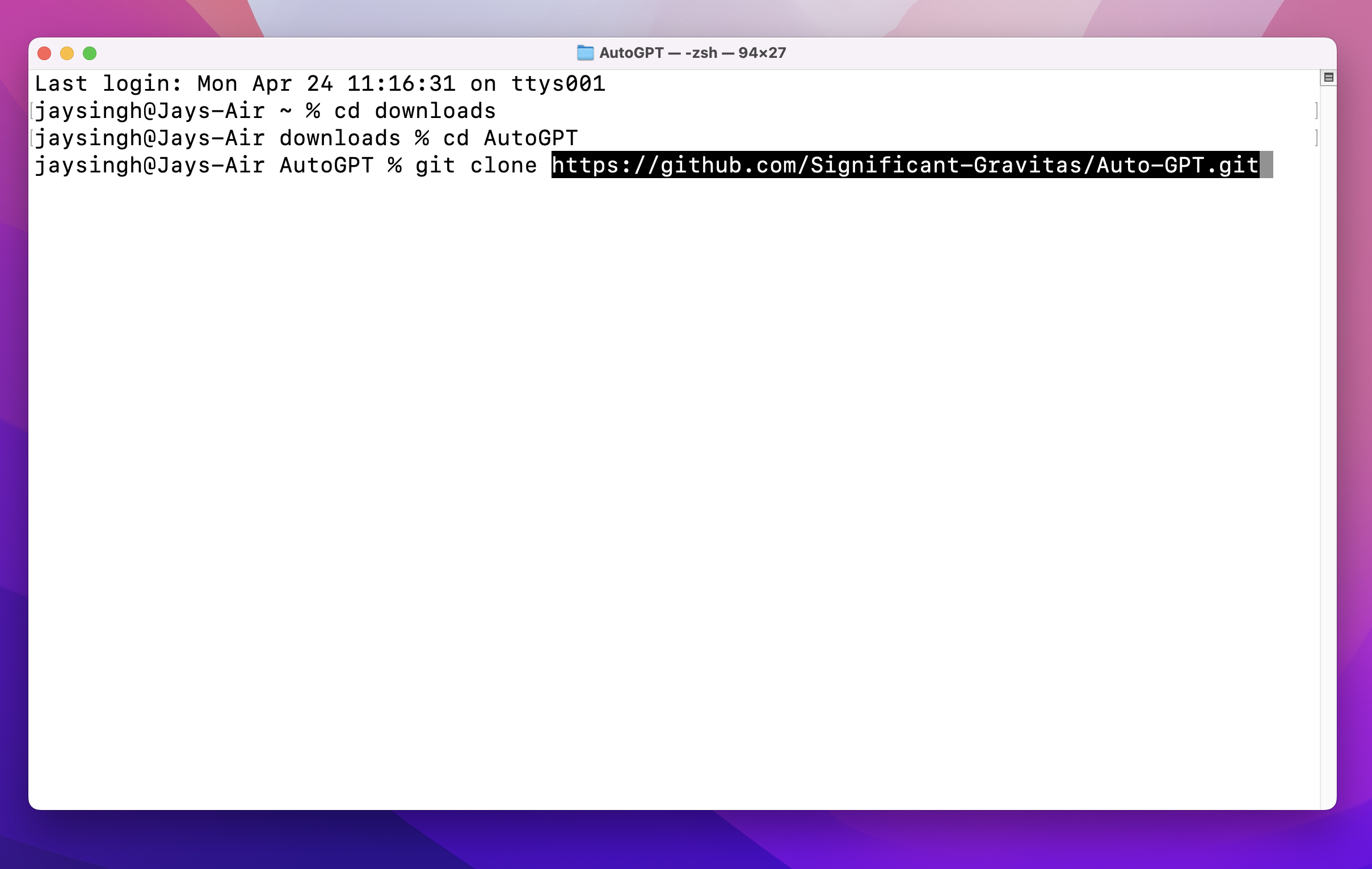

Trinn 1: Klon AutoGPT-depot

Opprett en egen mappe på Mac-en som ditt første trinn. Bruk Git Bash og skriv inn følgende kommando for å klone prosjektet:

git clone https://github.com/Significant-Gravitas/Auto-GPT.git

Trinn 2: Installer avhengigheter

I dette trinnet vil vi installere alle avhengighetene som kreves for å kjøre AutoGPT. Her er kommandoen:

pip3 install -r requirements.txt

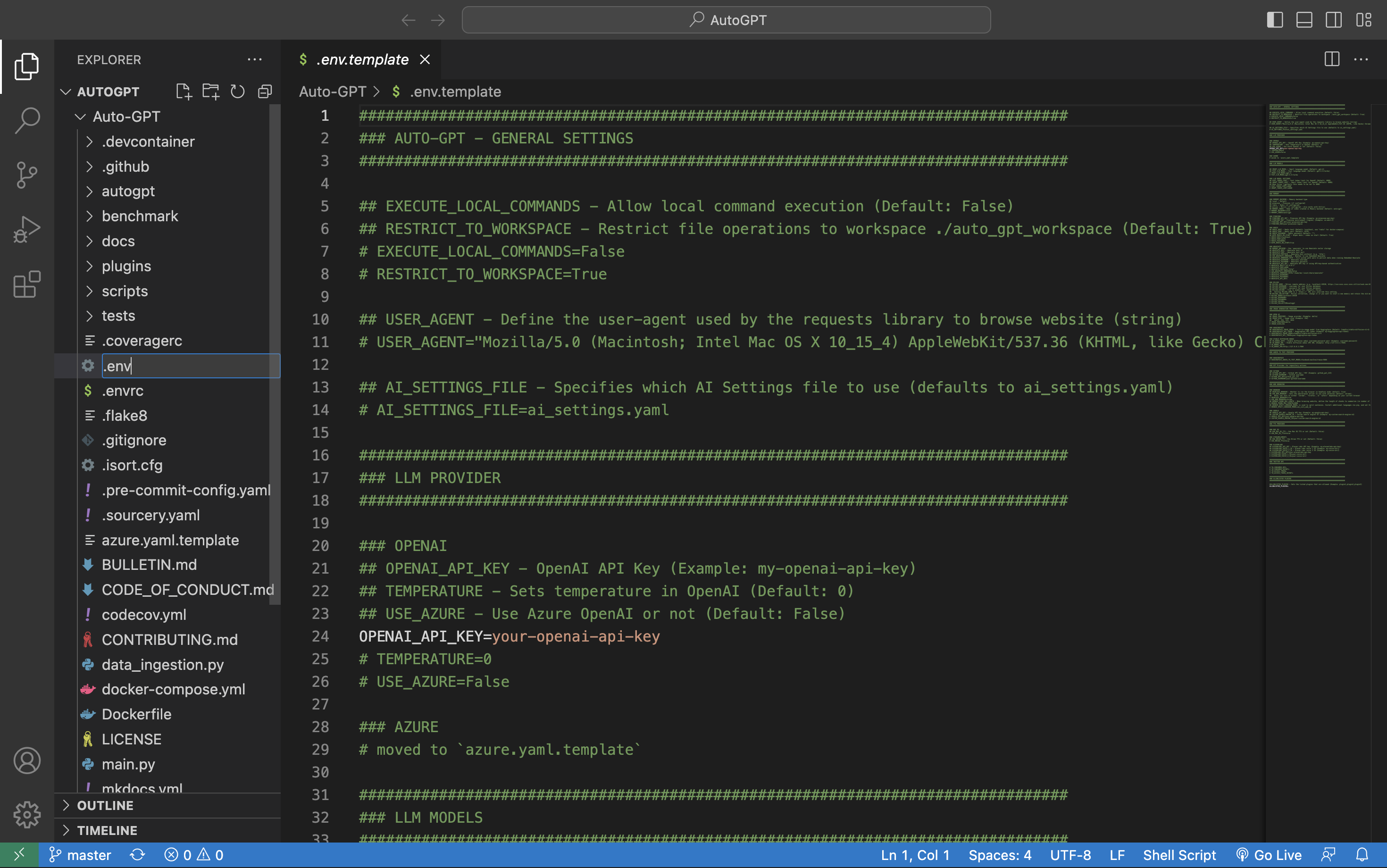

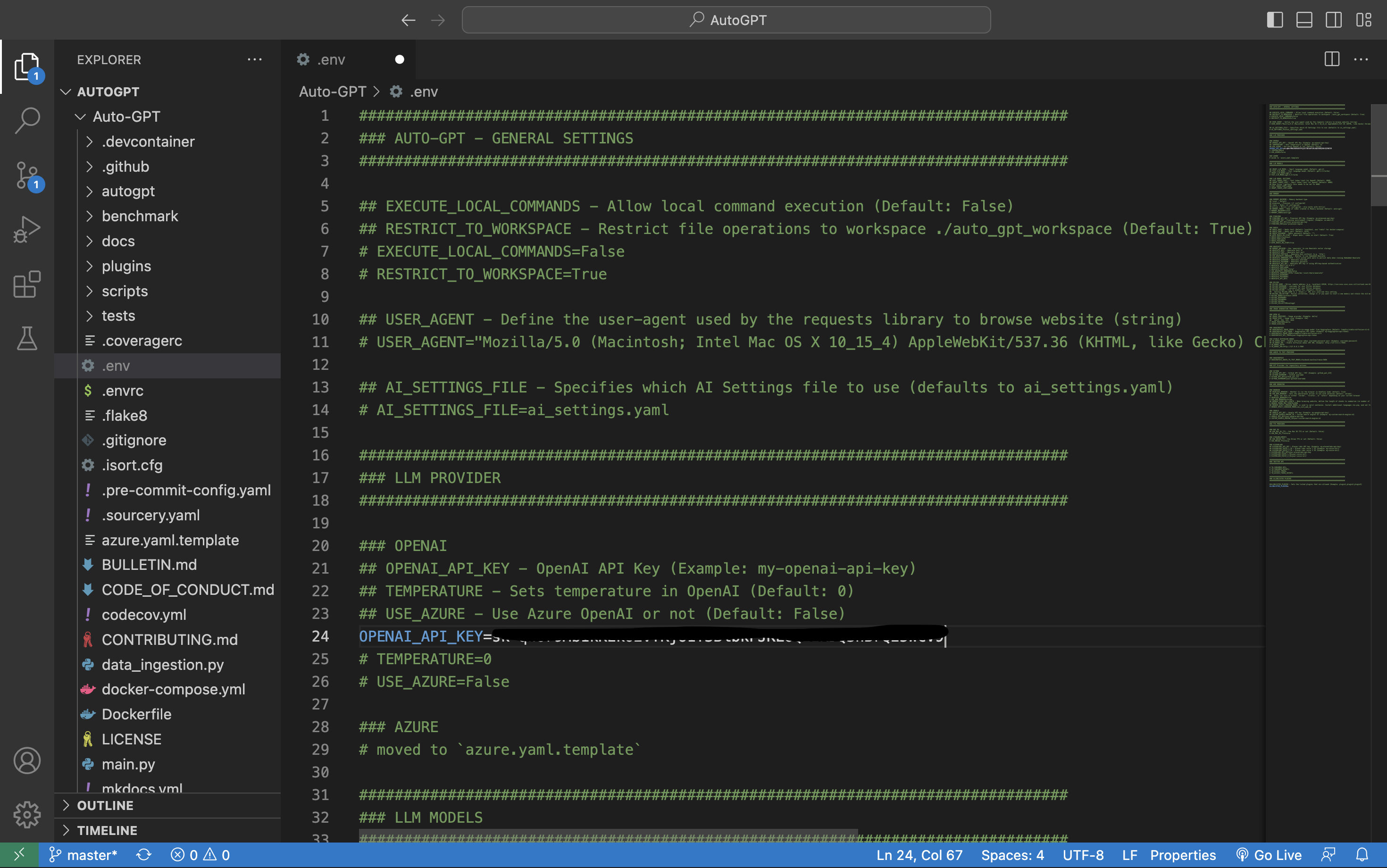

Etter det, gi nytt navn til.env.template til.env og fyll opp feltene med OpenAI og PineCone API-nøkler.

Din OpenAI API-nøkkel kan skaffes her.

Til slutt, plasser disse APIene i .env-filen.

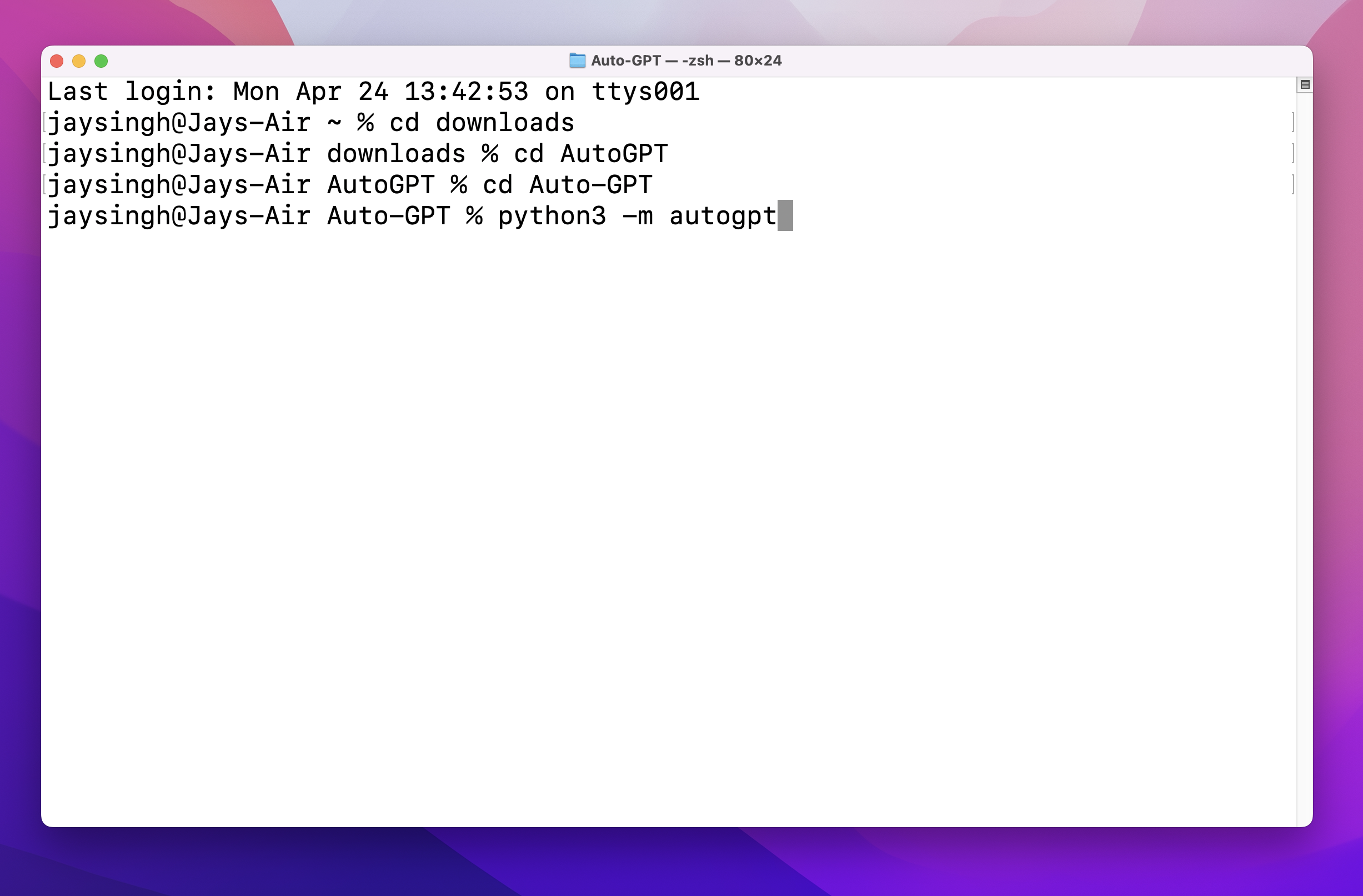

Trinn 3: Kjør hovedfilen

Åpne en terminal for å utføre skriptet gitt nedenfor:

python3 -m autogpt

Gratulerer, AutoGPT er installert på Mac-en.

Bruker AutoGPT

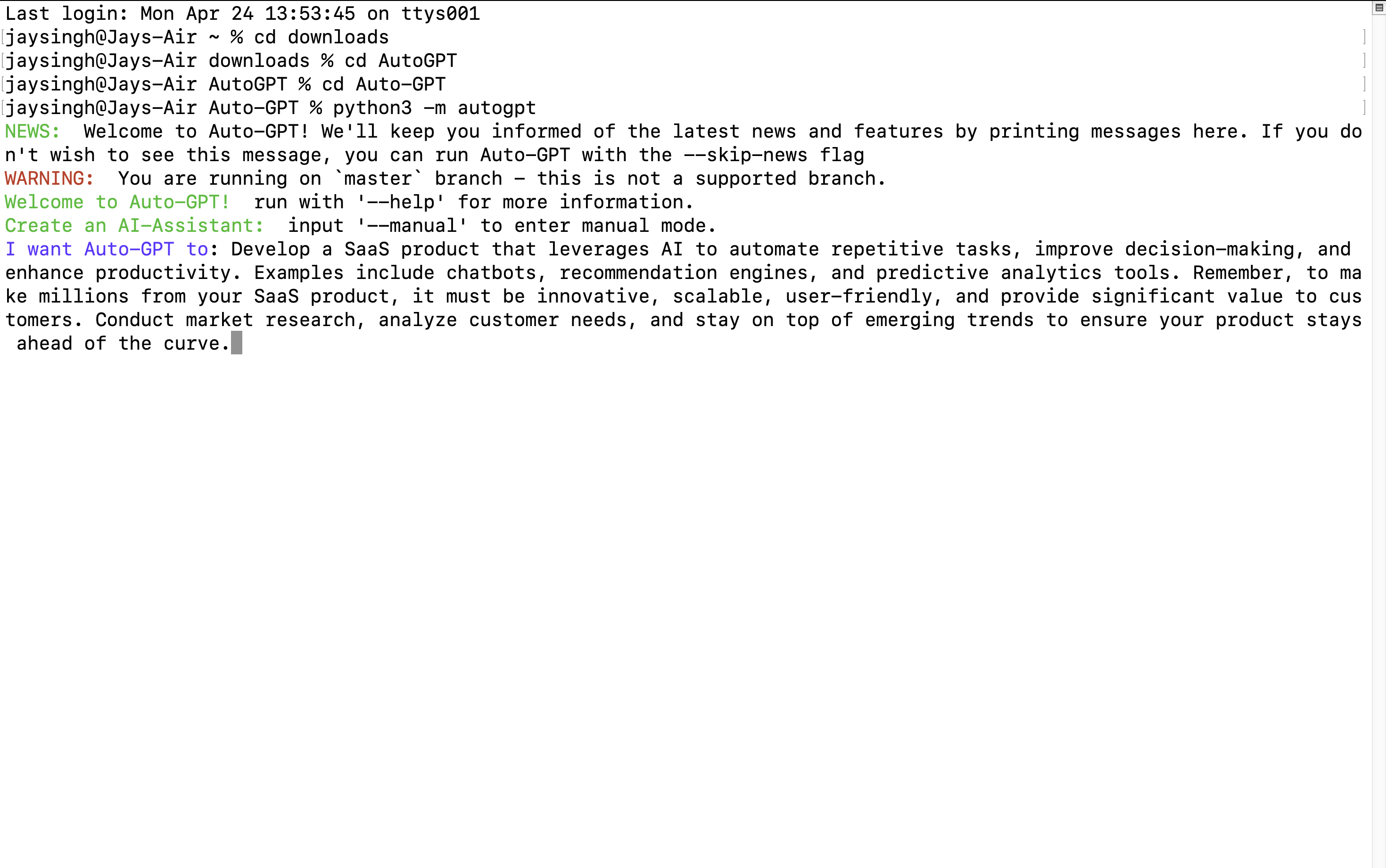

Definere AI-rolle

Nå må vi bare gi rollen til AI, og den setter automatisk målet for seg selv og produserer resultater basert på det.

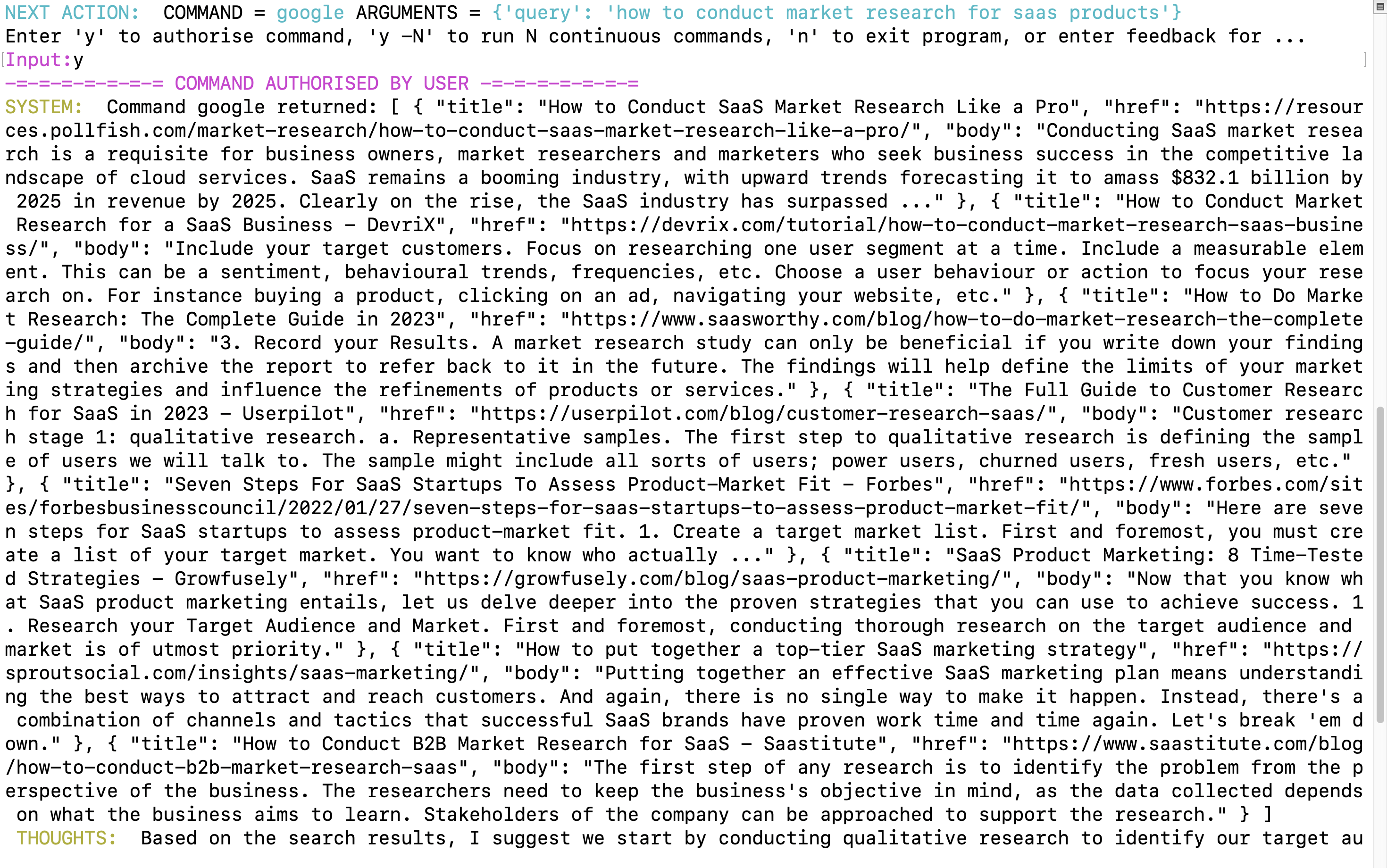

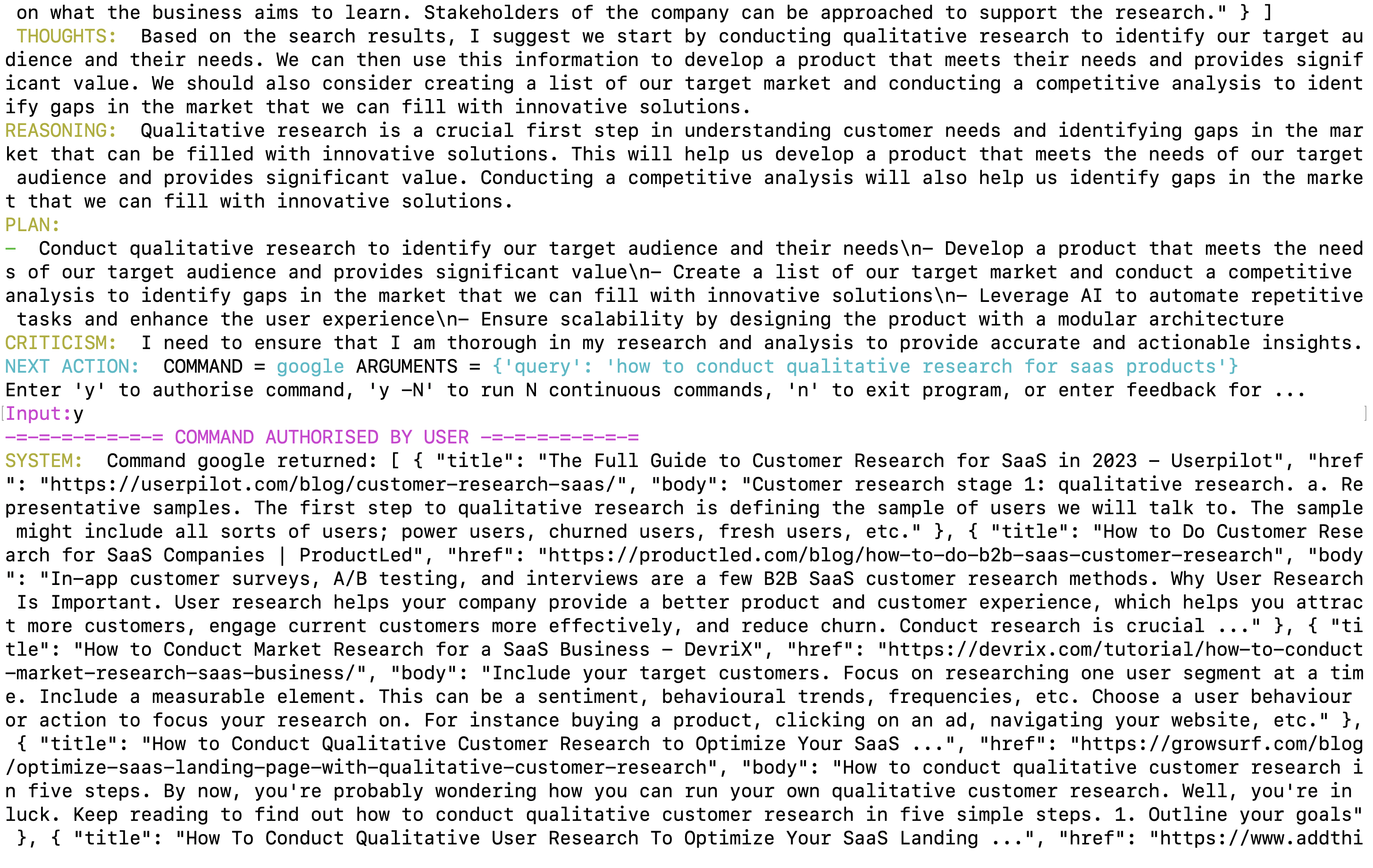

Jeg har brukt "Utvikle et SaaS-produkt som utnytter AI for å automatisere repeterende oppgaver, forbedre beslutningstaking og forbedre produktiviteten. Eksempler inkluderer chatbots, anbefalingsmotorer og verktøy for prediktiv analyse. Husk at for å tjene millioner på SaaS-produktet ditt, må det være innovativt, skalerbart, brukervennlig og gi betydelig verdi til kundene. Gjennomfør markedsundersøkelser, analyser kundebehov og hold deg oppdatert på nye trender for å sikre at produktet ditt holder seg i forkant."

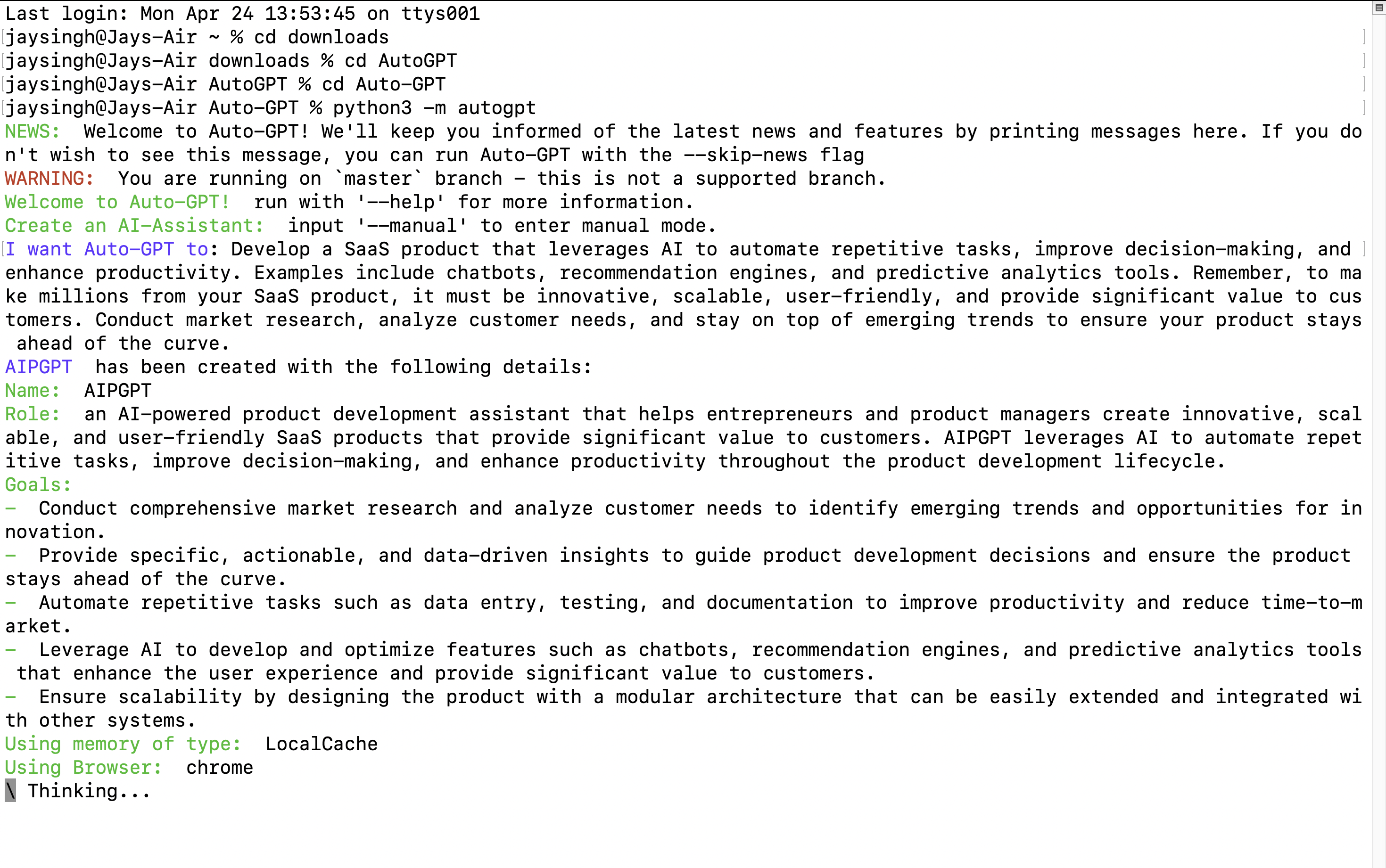

Nå vil du se at den automatisk setter mål for seg selv.

Du kan også se at AI bruker en surfenettleser for å gi deg bedre og siste resultater.

Basert på de tidligere resultatene foreslår den automatisk hvor du skal gå videre.

På denne måten kan du bruke AutoGPT og tilpasse den etter dine behov.

Lagt til plugins

Utviklere har nylig gitt ut plugins, som lar deg tilpasse AutoGPT til dine unike krav. Plugins er dataprogrammer som forbedrer en plattform eller programvares evner med en bestemt funksjon.

De krever ikke store endringer i hovedprogrammets kjernekode fordi de er laget for å utvide eller forbedre funksjonene.

Tredjeparts og førsteparts plugins er også alternativer.

Listen over plugins er som følger:

- Twitter-plugin

- E-postplugin

- Telegram-plugin

- Google Analytics-plugin

- Youtube-plugin, og mange flere.

Fremtiden til Auto-GPT og LLM

Det er umulig å understreke hvordan LLM-er, som GPT-4, har potensialet til å revolusjonere jobbautomatisering.

Som demonstrert av Auto-GPT og ChatGPT, kan LLM-er læres å lære av enorme mengder data og uavhengig utføre et bredt spekter av aktiviteter, fra innholdsproduksjon til koding. Kapasiteten til å automatisere driften har kraften til å endre bransjer fullstendig og hvordan vi opererer.

Men for LLM-er er Auto-GPT bare starten. Kraftene til LLM-er vil øke etter hvert som teknologien utvikler seg videre. Fremtidige LLM-er vil være dyktigere til selv kompliserte oppgaver og forstå kontekst og kompleksitet.

LLM-oppgaveautomatisering har også potensial til å åpne opp nye markeder og sysselsettingsmuligheter. Bedrifter og mennesker vil kunne konsentrere seg om vanskeligere og fantasifulle prosjekter hvis de er i stand til å automatisere mange av sine dagligdagse gjøremål.

Ny sysselsetting i bransjer som dataanalyse, programvareutvikling og innholdsskaping kan bli opprettet som et resultat av dette vektskiftet. Mulighetene til LLM-er går mye utover auto-GPT.

Kapasitetene til LLM-er vil utvikle seg sammen med teknologi, noe som resulterer i en arbeidsstyrke som er mer effektiv og produktiv. Det er et enormt potensial for LLM å revolusjonere jobbautomatisering, og i årene som kommer kan vi forutse enda mer utvikling.

Risikoer som Auto-GPT og LLMs modeller inkluderer

Selv om LLM-er som GPT-4 tilbyr et stort løfte om å revolusjonere jobbautomatisering, kan det også være farer og ulemper som må tas i betraktning. Sannsynligheten for skjevhet og fordommer i dataene som brukes til å trene modellene er en av hovedårsakene til bekymring. Hvis treningsdataene var partiske, kan det oppstå urettferdige og diskriminerende utfall fra partiske LLM-er.

Muligheten for at LLM-er kan brukes feil, for eksempel å spre falsk informasjon eller fabrikkere nyheter, er en annen sak. Å bruke LLM til å produsere svært overbevisende falsk informasjon kan ha skadelige effekter på både mennesker og samfunn.

Videre skaper LLMs ekstreme autoritet og autonomi spørsmål om plikt og ansvarlighet. Hvem er ansvarlig hvis en LLM gjør en feil eller har et negativt resultat? Hvordan kan vi sørge for at LLM-er brukes etisk og ansvarlig?

For å kunne bruke LLM-er som Auto-GPT på en ansvarlig måte, må disse problemene løses. Mangfoldet og objektiviteten til opplæringsdataene må garanteres, og LLM må ikke brukes til å spre falsk informasjon eller produsere støtende materiale. I tillegg innebærer det å lage presise regler og forskrifter for bruk av LLM-er og å gjøre partene ansvarlige for eventuelle ugunstige resultater.

konklusjonen

Avslutningsvis har LLM og Auto-GPT et enormt samfunnsnyttig potensial. De har evnen til å øke effektiviteten, produktiviteten og innovasjonen på tvers av alle bransjer og generere nye sysselsettingsmuligheter.

Det er imidlertid viktig at vi bruker LLMs ansvarlig og med forsiktighet, og sørger for at de brukes moralsk og til fordel for samfunnet. Ved å gjøre dette kan vi bruke LLM-er til å hjelpe alle til å få en bedre fremtid.

Forslag til førstegangsbrukere:

1. Prøv pip3 install -r requirements.txt i stedet for pip install -r requirements.txt

2. For å opprette en ny mappe, gå til Mac Finder, opprett en ny mappe på skrivebordet og dobbeltklikk, klikk deretter på "Opprett en ny terminal i mappen".

3. Sørg for at du har installert Python 3.4 eller høyere, med Git.

4. Få personlig tilgangstoken fra GitHub

5. Bruk Sublime Text eller Atom for å åpne mappen der du oppretter terminalen for å få tilgang til filene som .env

6. Hvis du får en feilmelding på OpenAI API-trekk, kan du prøve å legge til et kort under faktureringsdetaljene. Spesielt hvis du får feilen: API Rate Limit Reached. Venter 10 sekunder..

$ python3 main.py

Sporing (siste samtale sist):

Fil "E:\autogpt\Auto-GPT\main.py", linje 1, i

fra autogpt import main

ImportError: kan ikke importere navnet 'main' fra 'autogpt' (E:\autogpt\Auto-GPT\autogpt\__init__.py)

vennligst hjelp meg med å løse dette

Du burde løpe

python3 scripts/main.pyhvis filen ligger inne i en katalog kalt scripts, må du kjøre kommandoen

python3 scripts/main.pyistedenforpython3 main.pyHallo

Når jeg kjører kommandoen: python -m autogpt respons: /usr/bin/python: Ingen modul kalt autogpt

Er det nødvendig å installere et virtuelt miljø eller er det nok å flytte en mappe?

TAKK

python3 -m autogpt

Angi OpenAI API-nøkkelen i .env eller som en miljøvariabel.

Du kan få nøkkelen fra https://platform.openai.com/account/api-keys

Jeg vet ikke hvorfor det gir meg denne feilen, vennligst hjelp meg.

de genererte api-nøklene og legg den inn i filen

jeg vet ikke hva jeg skal gjøre