Inhoudsopgave[Zich verstoppen][Laten zien]

De toekomst is hier. En in deze toekomst begrijpen machines de wereld om hen heen op dezelfde manier als mensen. Computers kunnen auto's besturen, ziekten diagnosticeren en nauwkeurig de toekomst voorspellen.

Dit lijkt misschien sciencefiction, maar deep learning-modellen maken het werkelijkheid.

Deze geavanceerde algoritmen onthullen de geheimen van kunstmatige intelligentie, waardoor computers zichzelf kunnen leren en ontwikkelen. In dit bericht gaan we in op het domein van deep learning-modellen.

En we zullen het enorme potentieel onderzoeken dat ze hebben om ons leven radicaal te veranderen. Bereid je voor om te leren over geavanceerde technologie die de toekomst van de mensheid verandert.

Wat zijn deep learning-modellen precies?

Heb je ooit een spel gespeeld waarin je de verschillen tussen twee afbeeldingen moet identificeren?

Het is leuk, maar het kan ook zwaar zijn, toch? Stel je voor dat je een computer kunt leren om dat spel te spelen en elke keer te winnen. Deep learning-modellen bereiken precies dat!

Deep learning-modellen zijn vergelijkbaar met superslimme machines die een groot aantal afbeeldingen kunnen onderzoeken en bepalen wat ze gemeen hebben. Ze bereiken dit door de afbeeldingen uit elkaar te halen en ze allemaal afzonderlijk te bestuderen.

Vervolgens passen ze wat ze hebben geleerd toe om patronen te identificeren en voorspellingen te doen over nieuwe beelden die ze nog nooit eerder hebben gezien.

Deep learning-modellen zijn kunstmatige neurale netwerken die ingewikkelde patronen en kenmerken kunnen leren en extraheren uit enorme datasets. Deze modellen zijn opgebouwd uit verschillende lagen van gekoppelde knooppunten, of neuronen, die binnenkomende gegevens analyseren en wijzigen om een uitvoer te genereren.

Deep learning-modellen zijn met name geschikt voor taken die grote nauwkeurigheid en precisie vereisen, zoals beeldidentificatie, spraakherkenning, natuurlijke taalverwerking en robotica.

Ze zijn gebruikt in alles, van zelfrijdende auto's tot medische diagnostiek, aanbevelingssystemen en predictive analytics.

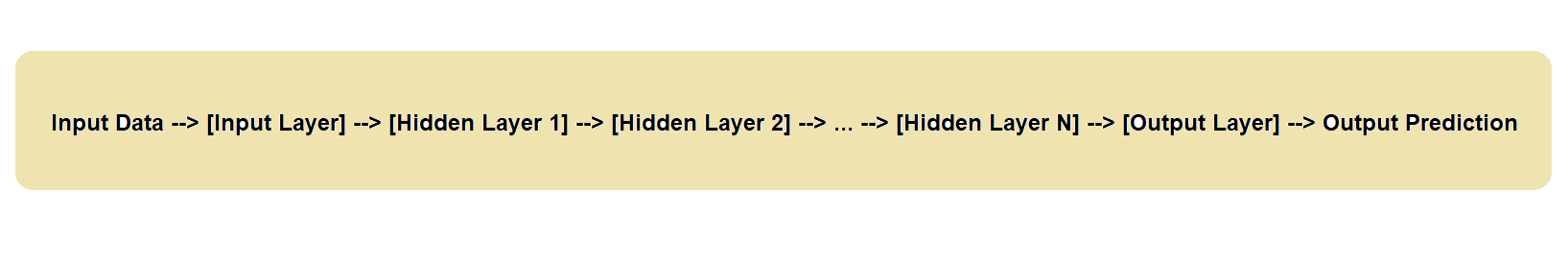

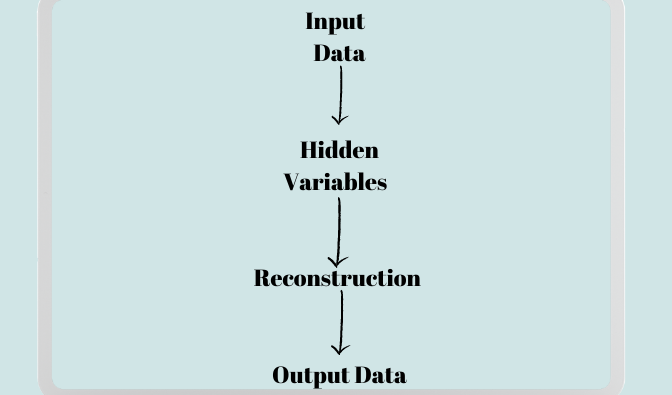

Hier is een vereenvoudigde versie van de visualisatie om de gegevensstroom in een deep learning-model te illustreren.

De invoergegevens stromen naar de invoerlaag van het model, die de gegevens vervolgens door een aantal verborgen lagen laat gaan voordat een uitvoervoorspelling wordt gedaan.

Elke verborgen laag voert een reeks wiskundige bewerkingen uit op de invoergegevens voordat deze wordt doorgegeven aan de volgende laag, die de uiteindelijke voorspelling geeft.

Laten we nu eens kijken wat deep learning-modellen zijn en hoe we ze in ons leven kunnen gebruiken.

1. Convolutionele neurale netwerken (CNN's)

CNN's zijn een deep learning-model dat het gebied van computervisie heeft getransformeerd. CNN's worden gebruikt om afbeeldingen te classificeren, objecten te herkennen en afbeeldingen te segmenteren. De structuur en functie van de menselijke visuele cortex vormden de basis voor het ontwerp van CNN's.

Hoe werken ze?

Een CNN bestaat uit een aantal convolutionele lagen, poollagen en volledig gekoppelde lagen. De invoer is een afbeelding en de uitvoer is een voorspelling van het klasselabel van de afbeelding.

De convolutionele lagen van een CNN bouwen een kenmerkkaart op door een puntproduct uit te voeren tussen het invoerbeeld en een reeks filters. De pooling-lagen verlagen de grootte van de feature map door deze te downsamplen.

Ten slotte wordt de feature map gebruikt door de volledig verbonden lagen om het klasselabel van de afbeelding te voorspellen.

Waarom zijn CNN's belangrijk?

CNN's zijn essentieel omdat ze kunnen leren patronen en kenmerken in afbeeldingen te detecteren die mensen moeilijk kunnen opmerken. CNN's kunnen worden geleerd kenmerken zoals randen, hoeken en texturen te herkennen met behulp van grote datasets. Na het leren van deze eigenschappen kan een CNN ze gebruiken om objecten in nieuwe foto's te identificeren. CNN's hebben bewezen geavanceerde prestaties te leveren op een verscheidenheid aan toepassingen voor beeldidentificatie.

Waar gebruiken we CNN's

De gezondheidszorg, de auto-industrie en de detailhandel zijn slechts enkele sectoren die CNN's in dienst hebben. In de gezondheidszorg kunnen ze nuttig zijn voor ziektediagnose, medicatieontwikkeling en medische beeldanalyse.

In de automobielsector helpen ze bij rijstrookdetectie, object detectieen autonoom rijden. Ze worden ook veel gebruikt in de detailhandel voor visueel zoeken, op afbeeldingen gebaseerde productaanbevelingen en voorraadbeheer.

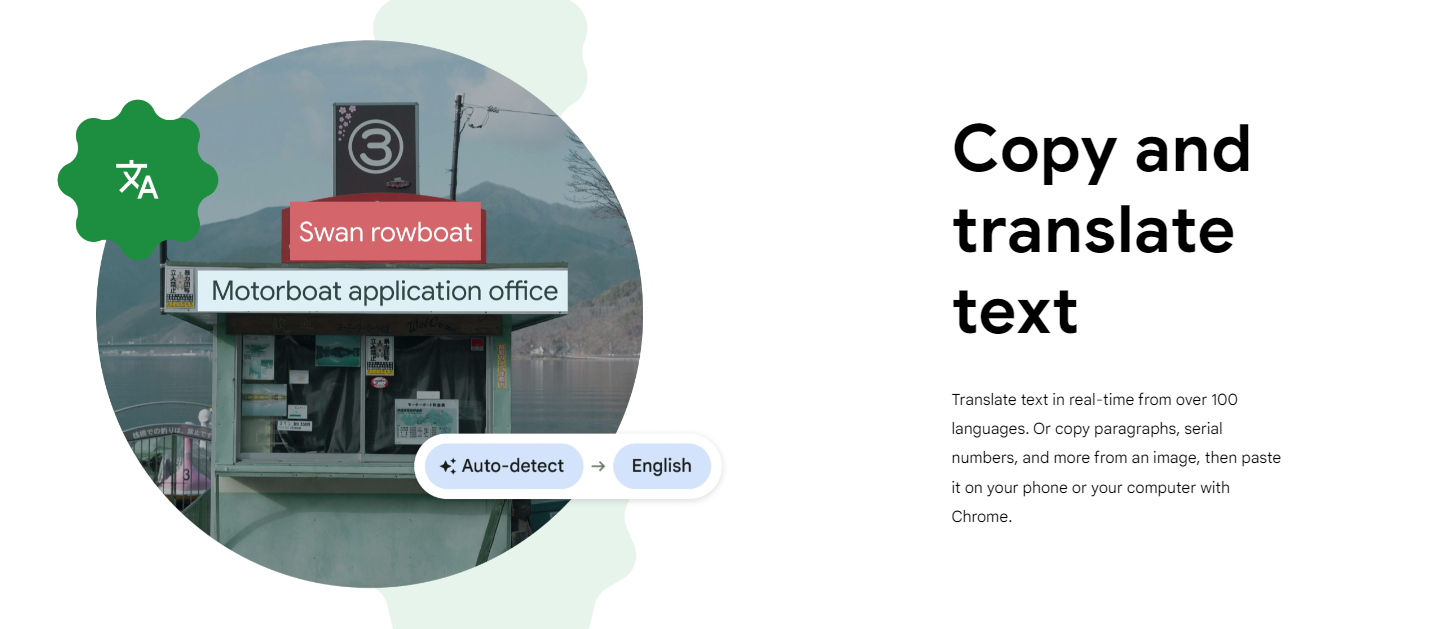

Bijvoorbeeld; Google gebruikt CNN's in verschillende toepassingen, waaronder Google Lens, een populaire tool voor beeldidentificatie. Het programma gebruikt CNN's om foto's te evalueren en gebruikers informatie te geven.

Google Lens kan bijvoorbeeld dingen in een afbeelding herkennen en daar details over geven, zoals het soort bloem.

Het kan ook de tekst die uit een afbeelding is gehaald in meerdere talen vertalen. Google Lens kan consumenten nuttige informatie geven dankzij de hulp van CNN's bij het nauwkeurig identificeren van items en het extraheren van kenmerken uit foto's.

2. Long Short-Term Memory (LSTM)-netwerken

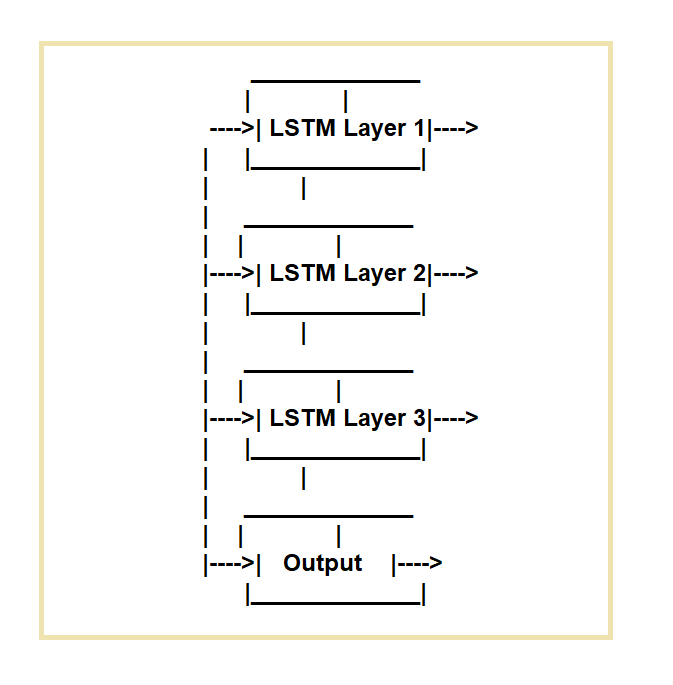

Long Short-Term Memory (LSTM) -netwerken worden gemaakt om de tekortkomingen van reguliere terugkerende neurale netwerken (RNN's) aan te pakken. LSTM-netwerken zijn ideaal voor taken die de verwerking van gegevensreeksen in de loop van de tijd vereisen.

Ze werken door gebruik te maken van een specifieke geheugencel en drie poortmechanismen.

Ze regelen de stroom van informatie in en uit de cel. De ingangspoort, vergeetpoort en uitvoerpoort zijn de drie poorten.

De ingangspoort regelt de gegevensstroom naar de geheugencel, de vergeetpoort regelt het wissen van gegevens uit de cel en de uitvoerpoort regelt de gegevensstroom uit de cel.

Wat is hun betekenis?

LSTM-netwerken zijn nuttig omdat ze met succes gegevensreeksen met langetermijnrelaties kunnen weergeven en voorspellen. Ze kunnen informatie over eerdere invoer vastleggen en bewaren, waardoor ze nauwkeurigere voorspellingen kunnen doen over toekomstige invoer.

Spraakherkenning, handschriftherkenning, natuurlijke taalverwerking en beeldonderschriften zijn slechts enkele van de toepassingen die gebruik hebben gemaakt van LSTM-netwerken.

Waar gebruiken we LSTM-netwerken?

Veel software- en technologietoepassingen maken gebruik van LSTM-netwerken, waaronder spraakherkenningssystemen, natuurlijke taalverwerkingstools zoals sentiment analyse, automatische vertaalsystemen en systemen voor het genereren van tekst en afbeeldingen.

Ze zijn ook gebruikt bij het maken van zelfrijdende auto's en robots, evenals in de financiële sector om fraude op te sporen en te anticiperen beurs bewegingen.

3. Generatieve vijandige netwerken (GAN's)

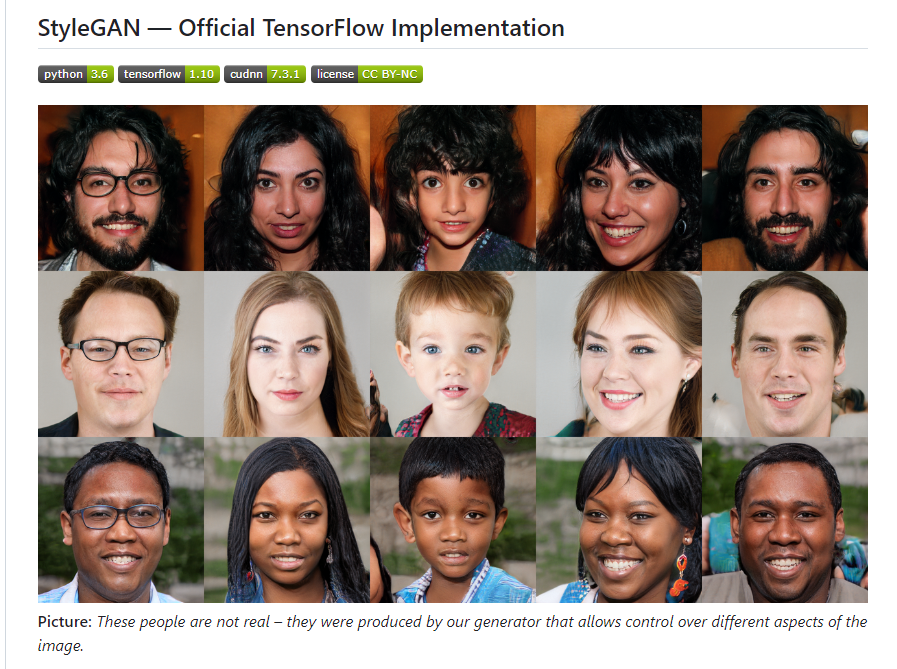

GAN's zijn een diepgaand leren techniek die wordt gebruikt om nieuwe datamonsters te genereren die vergelijkbaar zijn met een bepaalde dataset. GAN's bestaan uit twee neurale netwerken: een die leert nieuwe monsters te produceren en een die leert onderscheid te maken tussen echte en gegenereerde monsters.

Bij een vergelijkbare benadering worden deze twee netwerken samen getraind totdat de generator monsters kan genereren die niet te onderscheiden zijn van de echte.

Waarom gebruiken we GAN's

GAN's zijn belangrijk vanwege hun vermogen om hoogwaardige producten te produceren synthetische gegevens die kan worden gebruikt voor een verscheidenheid aan toepassingen, waaronder de productie van foto's en video's, het genereren van tekst en zelfs het genereren van muziek.

GAN's zijn ook gebruikt voor gegevensvergroting, het genereren van synthetische gegevens om real-world data aan te vullen en de prestaties van machine learning-modellen te verbeteren.

Bovendien hebben GAN's, door synthetische gegevens te creëren die kunnen worden gebruikt om modellen te trainen en proeven te imiteren, het potentieel om sectoren zoals medicijnen en medicijnontwikkeling te transformeren.

Toepassingen van GAN's

GAN's kunnen datasets aanvullen, nieuwe foto's of films maken en zelfs synthetische gegevens genereren voor wetenschappelijke simulaties. Bovendien hebben GAN's het potentieel om te worden gebruikt in een verscheidenheid aan toepassingen, variërend van entertainment tot medisch.

leeftijden en video's. NVIDIA's StyleGAN2 is bijvoorbeeld gebruikt om hoogwaardige foto's van beroemdheden en kunstwerken te maken.

4. Deep Belief Networks (DBN's)

Deep Belief Networks (DBN's) zijn dat wel kunstmatige intelligentie systemen die patronen in data kunnen leren herkennen. Ze bereiken dit door de gegevens in kleinere en kleinere brokken te segmenteren, waardoor ze op elk niveau een grondiger begrip krijgen.

DBN's kunnen leren van gegevens zonder te weten wat het is (dit wordt "unsupervised learning" genoemd). Dit maakt ze uiterst waardevol voor het detecteren van patronen in gegevens die een persoon moeilijk of onmogelijk zou vinden om te onderscheiden.

Wat maakt DBN's significant?

DBN's zijn belangrijk vanwege hun vermogen om hiërarchische gegevensrepresentaties te leren. Deze representaties kunnen worden gebruikt voor een verscheidenheid aan toepassingen, zoals classificatie, anomaliedetectie en dimensionaliteitsreductie.

Het vermogen van DBN's om pre-training zonder toezicht uit te voeren, wat de prestaties van deep learning-modellen met minimale gelabelde gegevens kan verbeteren, is een aanzienlijk voordeel.

Wat zijn de toepassingen van DBN's?

Een van de belangrijkste toepassingen is object detectie, waarin DBN's worden gebruikt om bepaalde soorten dingen te herkennen, zoals vliegtuigen, vogels en mensen. Ze worden ook gebruikt voor het genereren en classificeren van beelden, bewegingsdetectie in films en het begrijpen van natuurlijke taal voor spraakverwerking.

Bovendien worden DBN's vaak gebruikt in datasets om menselijke houdingen te beoordelen. DBN's zijn een geweldig hulpmiddel voor verschillende sectoren, waaronder de gezondheidszorg en het bankwezen, en technologie.

5. Deep Reinforcement Learning Networks (DRL's)

Diep Versterking leren Netwerken (DRL's) integreren diepe neurale netwerken met versterkende leertechnieken, zodat agenten met vallen en opstaan kunnen leren in een gecompliceerde omgeving.

DRL's worden gebruikt om agenten te leren hoe ze een beloningssignaal kunnen optimaliseren door interactie met hun omgeving en te leren van hun fouten.

Wat maakt ze opmerkelijk?

Ze zijn effectief gebruikt in verschillende toepassingen, waaronder gaming, robotica en autonoom rijden. DRL's zijn belangrijk omdat ze direct kunnen leren van onbewerkte sensorische input, waardoor agenten beslissingen kunnen nemen op basis van hun interacties met de omgeving.

Belangrijke toepassingen

DRL's worden in reële omstandigheden gebruikt omdat ze moeilijke problemen aankunnen.

DRL's zijn opgenomen in verschillende prominente software- en technologieplatforms, waaronder OpenAI's Gym, Unity's ML-agenten, en het DeepMind Lab van Google. AlphaGo, gebouwd door Google DeepMindzet bijvoorbeeld DRL in om het bordspel Go op wereldkampioensniveau te spelen.

Een ander gebruik van DRL is in de robotica, waar het wordt gebruikt om de bewegingen van robotarmen te besturen om taken uit te voeren zoals dingen grijpen of blokken stapelen. DRL's hebben veel toepassingen en zijn een handig hulpmiddel voor agenten trainen om te leren en beslissingen nemen in gecompliceerde omgevingen.

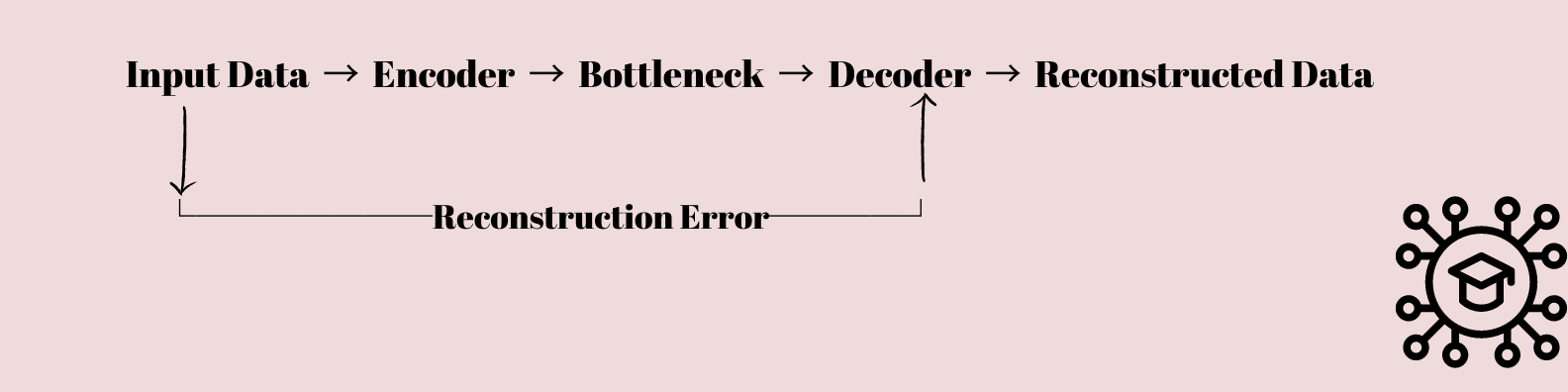

6. Automatische encoders

Autoencoders zijn een interessant type neuraal netwerk dat heeft de interesse gewekt van zowel wetenschappers als datawetenschappers. Ze zijn fundamenteel ontworpen om te leren hoe u gegevens kunt comprimeren en herstellen.

De invoergegevens worden door een opeenvolging van lagen gevoerd die de dimensionaliteit van de gegevens geleidelijk verlagen totdat ze worden gecomprimeerd tot een knelpuntlaag met minder knooppunten dan de invoer- en uitvoerlagen.

Deze gecomprimeerde representatie wordt vervolgens gebruikt om de oorspronkelijke invoergegevens opnieuw te creëren met behulp van een reeks lagen die de dimensionaliteit van de gegevens geleidelijk terugbrengen naar de oorspronkelijke vorm.

Waarom is het belangrijk?

Autoencoders zijn een cruciaal onderdeel van diepgaand leren omdat ze feature-extractie en datareductie mogelijk maken.

Ze zijn in staat om de belangrijkste elementen van de binnenkomende gegevens te identificeren en deze te vertalen naar een gecomprimeerde vorm die vervolgens kan worden toegepast op andere taken, zoals classificatie, groepering of het creëren van nieuwe gegevens.

Waar gebruiken we automatische encoders?

Afwijkingsdetectie, natuurlijke taalverwerking, en computer visie zijn slechts enkele van de disciplines waar auto-encoders worden gebruikt. Auto-encoders kunnen bijvoorbeeld worden gebruikt voor beeldcompressie, beeldruisverwijdering en beeldsynthese in computervisie.

We kunnen automatische coderingsprogramma's gebruiken bij taken zoals het maken van tekst, het categoriseren van tekst en het samenvatten van tekst bij de verwerking van natuurlijke taal. Het kan afwijkende activiteit in gegevens identificeren die afwijkt van de norm bij het identificeren van afwijkingen.

7. Capsule-netwerken

Capsule Networks is een nieuwe deep learning-architectuur die is ontwikkeld als vervanging voor Convolutional Neural Networks (CNN's).

Capsule-netwerken zijn gebaseerd op het idee van het groeperen van herseneenheden, capsules genaamd, die verantwoordelijk zijn voor het herkennen van het bestaan van een bepaald item in een afbeelding en het coderen van de kenmerken ervan, zoals oriëntatie en positie, in hun uitvoervectoren. Capsule Networks kunnen daarom ruimtelijke interacties en perspectieffluctuaties beter beheren dan CNN's.

Waarom kiezen we Capsule Networks boven CNN's?

Capsule-netwerken zijn nuttig omdat ze de problemen van CNN bij het vastleggen van hiërarchische relaties tussen items in een afbeelding overwinnen. CNN's kunnen dingen van verschillende groottes herkennen, maar hebben moeite om te begrijpen hoe deze items met elkaar verbonden zijn.

Capsule Networks, aan de andere kant, kunnen leren dingen en hun stukken te herkennen, evenals hoe ze ruimtelijk in een afbeelding worden geplaatst, waardoor ze een levensvatbare kanshebber worden voor computervisie-toepassingen.

Toepassingsgebieden

Capsule Networks heeft al veelbelovende resultaten laten zien in verschillende toepassingen, waaronder beeldclassificatie, objectidentificatie en beeldsegmentatie.

Ze zijn gebruikt om dingen te onderscheiden in medische foto's, mensen in films te herkennen en zelfs 3D-modellen te maken van 2D-beelden.

Om hun prestaties te verbeteren, zijn Capsule Networks gecombineerd met andere deep learning-architecturen zoals Generative Adversarial Networks (GAN's) en Variational Autoencoders (VAE's). Er wordt voorspeld dat capsulenetwerken een steeds belangrijkere rol gaan spelen bij het verbeteren van computervisietechnologieën naarmate de wetenschap van diep leren evolueert.

Bijvoorbeeld; Nibabel is een bekende Python-tool voor het lezen en schrijven van neuroimaging-bestandstypen. Voor beeldsegmentatie maakt het gebruik van Capsule Networks.

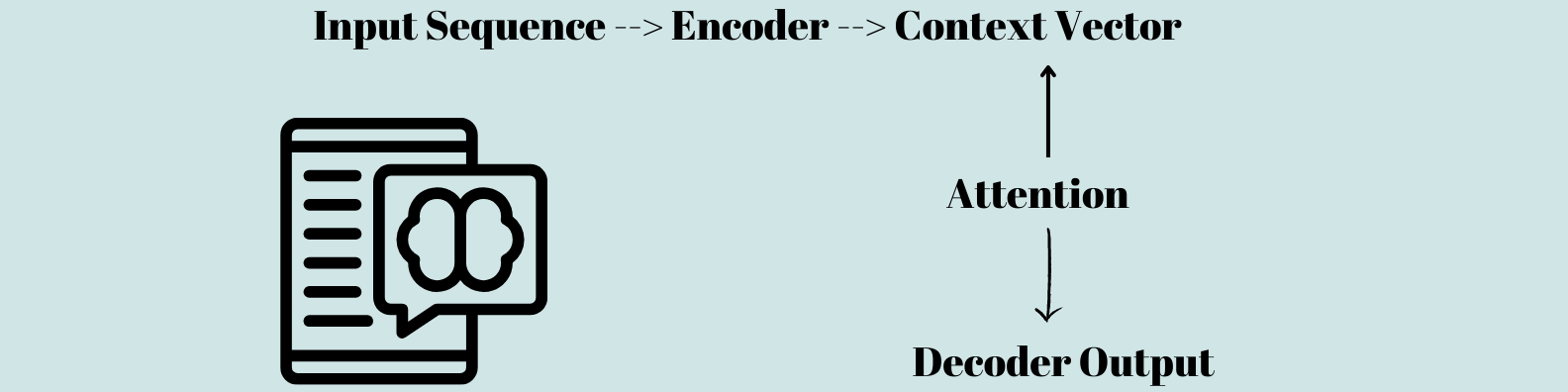

8. Op aandacht gebaseerde modellen

Deep learning-modellen die bekend staan als op aandacht gebaseerde modellen, ook wel bekend als aandachtsmechanismen, streven ernaar om de nauwkeurigheid van machine learning-modellen. Deze modellen werken door zich te concentreren op bepaalde kenmerken van inkomende gegevens, wat resulteert in een efficiëntere en effectievere verwerking.

Bij taken voor natuurlijke taalverwerking, zoals automatische vertaling en sentimentanalyse, is gebleken dat aandachtsmethoden behoorlijk succesvol zijn.

Wat is hun betekenis?

Op aandacht gebaseerde modellen zijn nuttig omdat ze een effectievere en efficiëntere verwerking van gecompliceerde gegevens mogelijk maken.

Traditionele neurale netwerken evalueer alle invoergegevens als even belangrijk, wat resulteert in een langzamere verwerking en verminderde nauwkeurigheid. Aandachtsprocessen concentreren zich op cruciale aspecten van invoergegevens, waardoor snellere en nauwkeurigere voorspellingen mogelijk zijn.

Gebruiksgebieden

Op het gebied van kunstmatige intelligentie hebben aandachtsmechanismen een breed scala aan toepassingen, waaronder natuurlijke taalverwerking, beeld- en audioherkenning en zelfs zelfrijdende voertuigen.

Aandachtsmethoden kunnen bijvoorbeeld worden gebruikt om machinevertaling in natuurlijke taalverwerking te verbeteren door het systeem toe te staan zich te concentreren op bepaalde woorden of zinsdelen die essentieel zijn voor de context.

Aandachtsmethoden in zelfrijdende auto's kunnen worden gebruikt om het systeem te helpen zich te concentreren op bepaalde items of uitdagingen in de omgeving.

9. Transformatornetwerken

Transformatornetwerken zijn deep learning-modellen die gegevensreeksen onderzoeken en produceren. Ze werken door de invoerreeks één voor één te verwerken en een uitvoerreeks van dezelfde of verschillende lengtes te produceren.

Transformatornetwerken verwerken, in tegenstelling tot standaard sequentie-naar-sequentie-modellen, geen sequenties met behulp van terugkerende neurale netwerken (RNN's). In plaats daarvan gebruiken ze processen van zelfaandacht om de verbanden tussen de stukken van de reeks te leren.

Wat is het belang van transformatornetwerken?

Transformatornetwerken zijn de afgelopen jaren in populariteit toegenomen als gevolg van hun betere prestaties bij het verwerken van natuurlijke taal.

Ze zijn met name geschikt voor taken voor het maken van tekst, zoals taalvertaling, tekstsamenvatting en conversatieproductie.

Transformatornetwerken zijn qua rekenkracht aanzienlijk efficiënter dan op RNN gebaseerde modellen, waardoor ze de voorkeur hebben voor grootschalige toepassingen.

Waar vind je Transformer-netwerken?

Transformatornetwerken worden veel gebruikt in een breed scala aan toepassingen, met name natuurlijke taalverwerking.

De GPT-serie (Generative Pre-trained Transformer) is een prominent op transformatoren gebaseerd model dat is gebruikt voor taken als taalvertaling, tekstsamenvatting en het genereren van chatbots.

BERT (Bidirectional Encoder Representations from Transformers) is een ander veelgebruikt op transformatoren gebaseerd model dat is gebruikt voor toepassingen voor het begrijpen van natuurlijke taal, zoals het beantwoorden van vragen en sentimentanalyse.

Te gebruiken zowel GPT en BERT zijn gemaakt met PyTorch, een open-source deep-learning framework dat populair is geweest voor het ontwikkelen van op transformatoren gebaseerde modellen.

10. Beperkte Boltzmann-machines (RBM's)

Beperkte Boltzmann-machines (RBM's) zijn een soort onbewaakt neuraal netwerk dat op een generatieve manier leert. Vanwege hun vermogen om te leren en essentiële kenmerken uit hoogdimensionale gegevens te halen, worden ze veel gebruikt op het gebied van machine learning en deep learning.

RBM's zijn opgebouwd uit twee lagen, zichtbaar en verborgen, waarbij elke laag bestaat uit een groep neuronen die zijn verbonden door verzwaarde randen. RBM's zijn ontworpen om een kansverdeling te leren die de invoergegevens beschrijft.

Wat zijn beperkte Boltzmann-machines?

RBM's maken gebruik van een generatieve leerstrategie. In RBM's weerspiegelt de zichtbare laag de invoergegevens, terwijl de begraven laag de kenmerken van de invoergegevens codeert. De gewichten van de zichtbare en verborgen lagen tonen de sterkte van hun schakel.

RBM's passen de gewichten en vooroordelen tussen de lagen tijdens de training aan met behulp van een techniek die bekend staat als contrastieve divergentie. Contrastieve divergentie is een leerstrategie zonder toezicht die de voorspellingswaarschijnlijkheid van het model maximaliseert.

Wat is de betekenis van beperkte Boltzmann-machines?

RBM's zijn belangrijk in machine learning en deep learning omdat ze relevante kenmerken kunnen leren en extraheren uit grote hoeveelheden data.

Ze zijn zeer effectief voor beeld- en spraakherkenning en ze zijn gebruikt in een verscheidenheid aan toepassingen, zoals aanbevelingssystemen, anomaliedetectie en dimensionaliteitsreductie. RBM's kunnen patronen vinden in enorme datasets, wat resulteert in superieure voorspellingen en inzichten.

Waar mogen beperkte Boltzmann-machines worden gebruikt?

Toepassingen voor RBM's zijn onder meer dimensionaliteitsreductie, afwijkingsdetectie en aanbevelingssystemen. RBM's zijn met name nuttig voor sentimentanalyse en onderwerp modellering in de context van natuurlijke taalverwerking.

Deep believe-netwerken, een soort neuraal netwerk dat wordt gebruikt voor spraak- en beeldherkenning, maken ook gebruik van RBM's. De Deep Belief Network Toolbox, TensorFlow en Theano zijn enkele specifieke voorbeelden van software of technologie die RBM's gebruikt.

verpakken

Deep Learning-modellen worden steeds belangrijker in verschillende sectoren, waaronder spraakherkenning, natuurlijke taalverwerking en computervisie.

Convolutional Neural Networks (CNN's) en Recurrent Neural Networks (RNN's) zijn het meest veelbelovend gebleken en worden uitgebreid gebruikt in veel toepassingen, maar alle Deep Learning-modellen hebben hun voor- en nadelen.

Onderzoekers kijken echter nog steeds naar Restricted Boltzmann Machines (RBM's) en andere varianten van Deep Learning-modellen, omdat ook zij speciale voordelen hebben.

Naar verwachting zullen nieuwe en creatieve modellen worden gecreëerd naarmate het gebied van diep leren zich blijft ontwikkelen om moeilijkere problemen aan te pakken

Laat een reactie achter