विषयसूची[लुकाउनुहोस्][देखाउनु]

नक्कली तस्बिर र भिडियोहरू हुनु नयाँ होइन। इन्टरनेटको व्यापक प्रयोग भएदेखि, व्यक्तिहरूले तस्बिर र चलचित्रहरू भएदेखि नै मूर्ख बनाउन वा मनोरञ्जन गर्नका लागि जालसाजीहरू सिर्जना गर्दै आएका छन्।

जे होस्, त्यहाँ नयाँ प्रकारको मेसिन-उत्पादित नक्कलीहरू छन् जसले हामीलाई कुनै दिन वास्तविकतालाई कथाबाट छुट्याउन गाह्रो बनाउन सक्छ।

यी नक्कलीहरू फोटोशप वा विगतका चलाखीपूर्वक हेरफेर गरिएका चलचित्रहरू जस्तै सम्पादन सफ्टवेयरद्वारा उत्पन्न साधारण तस्वीर हेरफेरहरू भन्दा फरक छन्।

Deepfakes "सिंथेटिक मिडिया" को सबैभन्दा प्रसिद्ध उदाहरण हो - छविहरू, ध्वनिहरू, र भिडियोहरू जुन परम्परागत विधिहरू प्रयोग गरेर उत्पादन गरिएको जस्तो देखिन्छ तर वास्तवमा परिष्कृत सफ्टवेयर प्रयोग गरेर बनाइएको थियो।

Deepfakes केही समयको लागि वरिपरि छन्, र तिनीहरूको सबैभन्दा लोकप्रिय अनुप्रयोग अझै सम्म पोर्नोग्राफिक फिल्महरूमा अभिनेताहरूको शरीरमा प्रसिद्ध व्यक्तिहरूको टाउको राख्ने भएको छ, तिनीहरूसँग जो कोही पनि, कहिँ पनि, कुनै पनि काम गरेको विश्वासयोग्य फुटेज उत्पादन गर्ने क्षमता छ।

यस पोष्टमा, हामी Deepfakes हेर्नेछौं, यसले कसरी काम गर्दछ, कसरी तपाइँ तिनीहरूलाई आफ्नै मा उत्पन्न गर्न सक्नुहुन्छ, र अधिक।

त्यसोभए, DeepFake के हो?

डीपफेक - गहिरो शिक्षा र नक्कली वाक्यांशहरूको संयोजन - एक टुक्रा हो सिंथेटिक मिडिया जसमा अन्य व्यक्तिको समानता पहिले नै अवस्थित फोटो वा भिडियोमा व्यक्तिको प्रतिस्थापन गर्न प्रयोग गरिन्छ।

Deepfakes ले परिष्कृत मेसिन लर्निङ र कृत्रिम बुद्धिमत्ता प्रविधिहरू परिमार्जन गर्न र भिजुअल र अडियो जानकारी सिर्जना गर्न प्रयोग गर्दछ जसमा धोकाको उच्च सम्भावना हुन्छ।

डीपफेक उत्पादन (GAN) को लागि अटोएनकोडरहरू र जेनेरेटिभ एड्भर्सियल नेटवर्कहरू जस्ता गहिरो सिकाइ विधिहरू प्राथमिक संयन्त्र हुन्।

यी मोडेलहरू एक व्यक्तिको अनुहारको भावना र आन्दोलनहरूको विश्लेषण गर्न र तुलनात्मक अभिव्यक्ति र आन्दोलनहरू प्रदर्शन गर्ने अन्य व्यक्तिहरूको अनुहार चित्रहरू संश्लेषण गर्न प्रयोग गरिन्छ।

सेलिब्रेटी पोर्नोग्राफिक भिडियोहरू, नक्कली समाचारहरू, होक्सहरू, र आर्थिक ठगीमा डीपफेकको प्रयोगले धेरै ध्यान खिचेको छ। उद्योग र सरकार दुवैले तिनीहरूलाई खोज्न र तिनीहरूको उपयोग सीमित गर्ने प्रयास गरेर प्रतिक्रिया दिएका छन्।

पहिलो अर्डर मोशन मोडेल

विगतमा गहिरो नक्कलीहरू विकास गर्ने प्रयास गर्दा, मुद्दा यो थियो कि हामीलाई यी दृष्टिकोणहरू काम गर्नका लागि केही प्रकारको अतिरिक्त ज्ञान, वा पूर्वहरू चाहिन्छ।

दृष्टान्तको रूपमा, अनुहार मार्करहरू आवश्यक छ यदि हामी टाउको आन्दोलन ट्रेस गर्न चाहन्छौं। यदि हामी सम्पूर्ण शरीरको गतिलाई नक्सा गर्न चाहान्छौं भने मुद्रा अनुमान आवश्यक थियो।

त्यो गत वर्ष NeurIPS सम्मेलनमा परिवर्तन भयो जब टोरन्टो विश्वविद्यालयको अनुसन्धान टोलीले आफ्नो काम प्रस्तुत गरे, "छवि एनिमेसनको लागि पहिलो अर्डर मोशन मोडेल। "

यस दृष्टिकोणको लागि एनिमेसनको थप ज्ञान आवश्यक छैन। थप रूपमा, यो मोडेल प्रशिक्षित भइसके पछि, यसलाई स्थानान्तरण शिक्षाको लागि प्रयोग गर्न सकिन्छ र एउटै कोटी अन्तर्गत पर्ने कुनै पनि वस्तुमा लागू गर्न सकिन्छ।

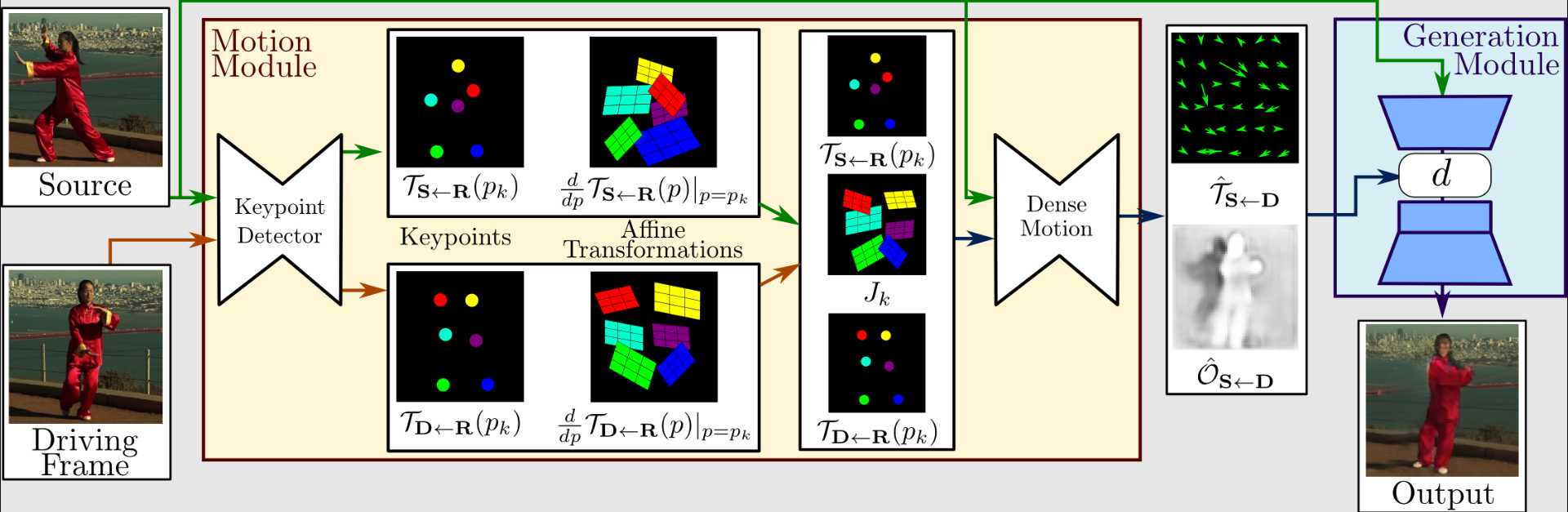

यस विधिको सञ्चालनलाई अलि अगाडि हेरौं। मोशन एक्स्ट्र्याक्सन र जेनेरेसनले सम्पूर्ण प्रक्रियाको पहिलो भाग बनाउँछ। ड्राइभिङ भिडियो र स्रोत चित्रहरू इनपुटको रूपमा प्रयोग गरिन्छ।

फर्स्ट-अर्डर गति प्रतिनिधित्व निकाल्न, जसमा स्प्यार्स कुञ्जी बिन्दुहरू र स्थानीय affine रूपान्तरणहरू समावेश हुन्छन्, एक गति एक्स्ट्रक्टरले मुख्य बिन्दुहरू पहिचान गर्न एक स्वत: एन्कोडर प्रयोग गर्दछ।

घना गति नेटवर्कको साथ घने अप्टिकल प्रवाह र अवरोध नक्सा सिर्जना गर्न, तिनीहरू ड्राइभिङ भिडियोको साथ कार्यरत छन्। त्यसपछि जेनेरेटरले घने गति नेटवर्क र स्रोत छविबाट आउटपुटहरू प्रयोग गरेर लक्ष्य चित्र रेन्डर गर्दछ।

बोर्ड भर, यो काम कला को राज्य भन्दा राम्रो प्रदर्शन गर्दछ। यसमा अन्य मोडेलहरूमा नभएका सुविधाहरू पनि छन्। यसले धेरै तस्विर प्रकारहरूमा काम गर्दछ, त्यसैले तपाइँ यसलाई अनुहार, शरीर, कार्टुन, इत्यादिको छविहरूमा लागू गर्न सक्नुहुन्छ, जुन अत्यन्त उत्कृष्ट छ।

यसबाट धेरै नयाँ अवसरहरू सिर्जना हुन्छन्। हाम्रो रणनीतिको अर्को महत्त्वपूर्ण पक्ष यो हो कि यसले अब तपाइँलाई लक्षित वस्तुको केवल एउटा छवि प्रयोग गरेर उच्च गुणस्तरको डिपफेकहरू उत्पादन गर्न अनुमति दिन्छ, जसरी हामी गर्छौं। वस्तुको लागि YOLO पहिचान।

Deepfake मोडेल सिर्जना गर्ने प्रक्रिया

डिपफेक उत्पादनको लागि तीन प्रक्रियाहरू आवश्यक छन्: निकासी, प्रशिक्षण, र सिर्जना। यी प्रत्येक चरणका मुख्य बुँदाहरू र तिनीहरू समग्र प्रक्रियासँग कसरी सम्बन्धित छन् भन्ने कुरा यस खण्डमा समेटिनेछ।

निष्कर्ष

डीपफेकहरूले अनुहारहरू परिवर्तन गर्न गहिरो न्यूरल नेटवर्कहरू प्रयोग गर्छन् र सही र विश्वस्त रूपमा सञ्चालन गर्न धेरै डाटा (तस्बिरहरू) चाहिन्छ। निकासी प्रक्रिया त्यो चरण हो जसमा भिडियो क्लिपहरूबाट सबै फ्रेमहरू निकालिन्छन्, अनुहारहरू पहिचान गरिन्छन्, र अनुहारहरू प्रदर्शनलाई अधिकतम बनाउन पङ्क्तिबद्ध हुन्छन्।

प्रशिक्षण

तालिम चरणमा द तंत्रिका सञ्जाल एउटा अनुहार अर्कोमा परिवर्तन गर्न सक्छ। अभ्यास सेट र प्रशिक्षण ग्याजेटको आकारमा निर्भर गर्दै, प्रशिक्षणले धेरै घण्टा वा दिन पनि लिन सक्छ।

तालिम एक पटक मात्रै समाप्त हुनुपर्छ, धेरै जसो अन्य न्यूरल नेटवर्क प्रशिक्षण। प्रशिक्षण पछि, मोडेलले व्यक्ति A बाट व्यक्ति B मा अनुहार परिवर्तन गर्न सक्षम हुनेछ।

सिर्जना

मोडेललाई तालिम दिएपछि, एउटा डिपफेक उत्पादन गर्न सकिन्छ। फ्रेमहरू भिडियोबाट लिइन्छ र त्यसपछि सबै अनुहारहरूमा पङ्क्तिबद्ध गरिन्छ। प्रशिक्षित न्यूरल नेटवर्क त्यसपछि प्रत्येक फ्रेम रूपान्तरण गर्न प्रयोग गरिन्छ।

रूपान्तरित अनुहार अन्तिम चरणको रूपमा मूल फ्रेमसँग मर्ज गर्नुपर्छ।

Deepfake पत्ता लगाउने मोडेल निर्माण गर्दै

GitHub Repo माउन्टिंग र क्लोनिङ

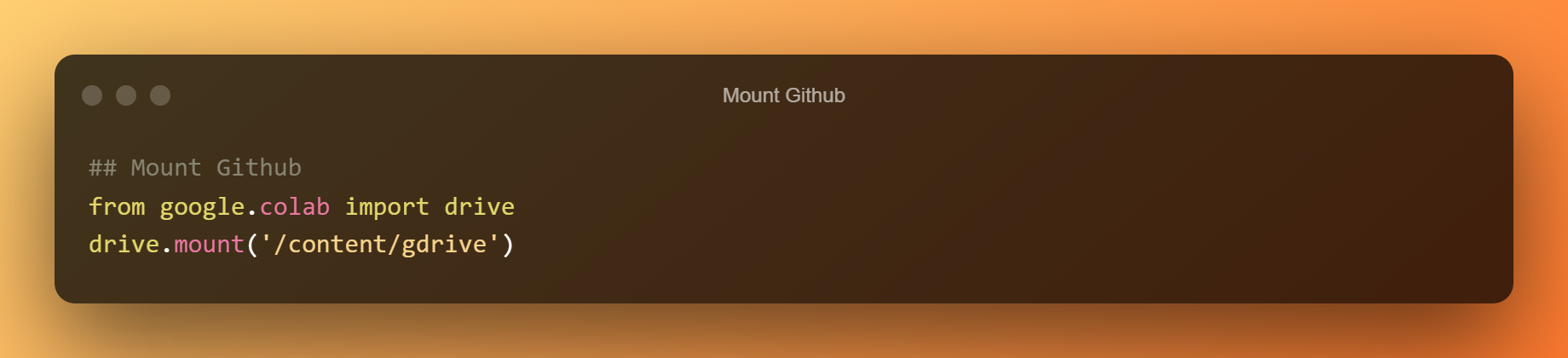

Colab मा काम गर्दा Google को GPU हरू नि:शुल्क प्रयोग गर्न पाउनु फाइदाजनक छ गहिरो शिक्षा। एउटा अतिरिक्त फाइदा क्लाउड भर्चुअल मेसिन (VM) मा गुगल ड्राइभ माउन्ट गर्ने क्षमता हो।

उसको सबै सामानहरूमा सजिलो पहुँचको साथ, प्रयोगकर्ता सक्षम छ। क्लाउडमा भर्चुअल मेसिनमा गुगल ड्राइभ माउन्ट गर्न आवश्यक कार्यक्रम यस खण्डमा फेला पर्नेछ।

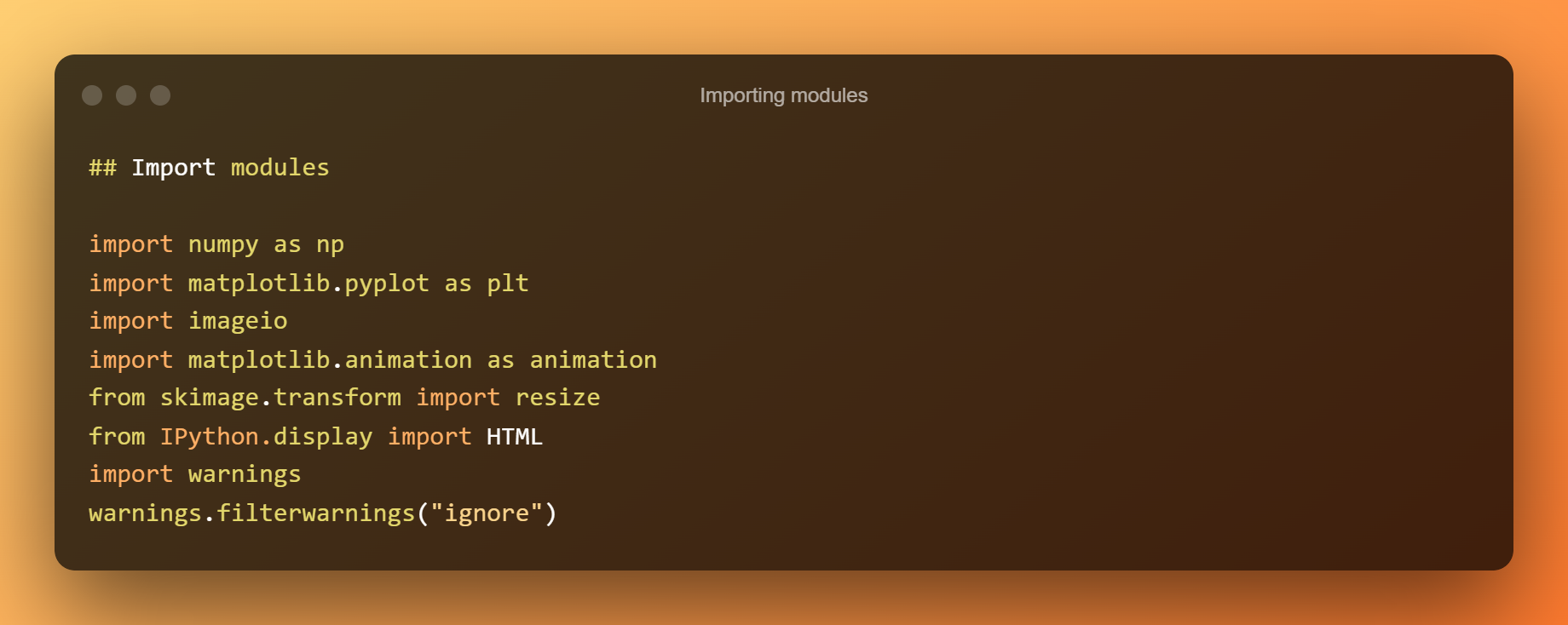

मोड्युल आयात गर्दै

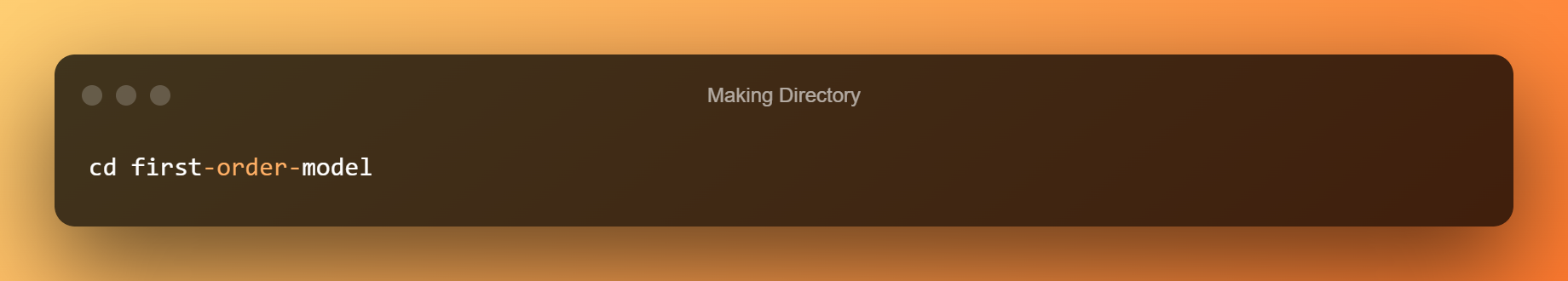

अब, हामी सबै आवश्यक मोड्युलहरू आयात गर्नेछौं।

मोडेल कार्यान्वयन गर्दै

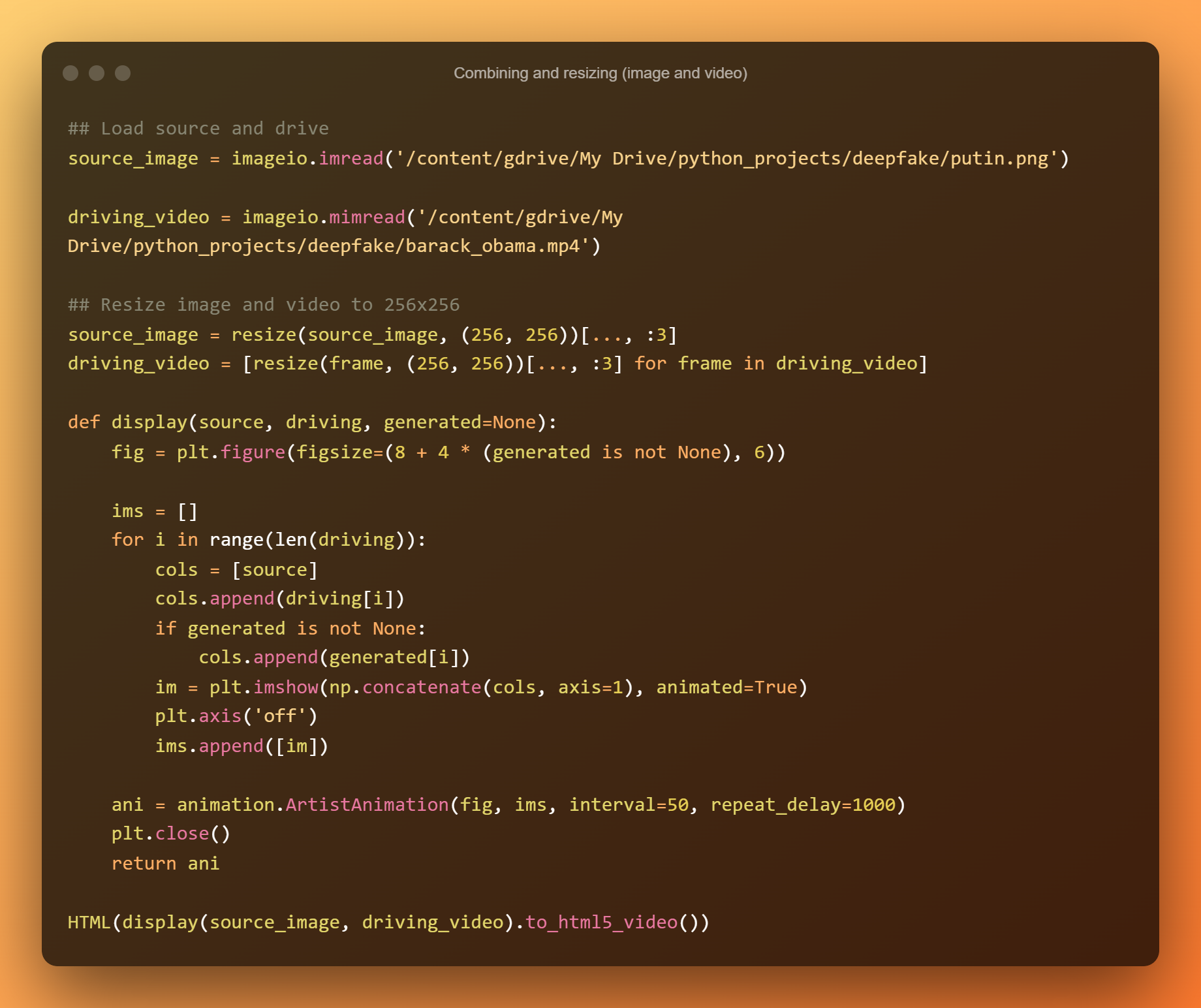

हामी एउटा उदाहरण प्रयोग गर्नेछौं जसले ओबामाको भिडियोसँग पुटिनको स्थिर तस्बिर (स्रोत चित्र) संयोजन गर्दछ। नतिजा ओबामाले ड्राइभिङ गर्दा प्रयोग गरेको ठ्याक्कै उस्तै अनुहारको अभिव्यक्तिको साथ पुटिन बोल्ने र इशारा गरेको भिडियो हो।

मोडेलको नतिजा प्रदर्शन गर्नु अघि, मिडिया लोड गरिनेछ र प्रकार्यहरू घोषणा गरिनेछ। त्यसपछि चेकपोइन्टहरू लोड गरिनेछ र मोडेल निर्माण गरिनेछ। गहिरो नक्कली सिर्जना गरेपछि, एनिमेसनको दुई फरक शैलीहरू प्रदर्शन गरिनेछ।

पुटिन सापेक्ष मुख्य बिन्दु विस्थापन प्रयोग गरी ओबामाको आन्दोलनबाट एनिमेटेड छन्। ओबामाको अनुहारको भावना र शारीरिक भाषालाई उनको भिडियोहरूमा पुटिनको लागि सुन्दर र स्पष्ट रूपमा चित्रण गरिएको छ।

त्यहाँ केही सूक्ष्म गल्तीहरू छन्, विशेष गरी जब ओबामाले आफ्नो भौं उठाउँछन् र आँखा झिम्काउँछन्। यी अभिव्यक्तिहरू पुटिनको फ्रेमहरूमा ठ्याक्कै नक्कल गरिएका छैनन्।

डिपफेक ब्याकड्रप बिना, पुटिनको फिल्म टिभीमा हेर्ने हो भने यो एकदमै विश्वसनीय र प्रामाणिक देखिनेछ। सामाजिक संजाल.

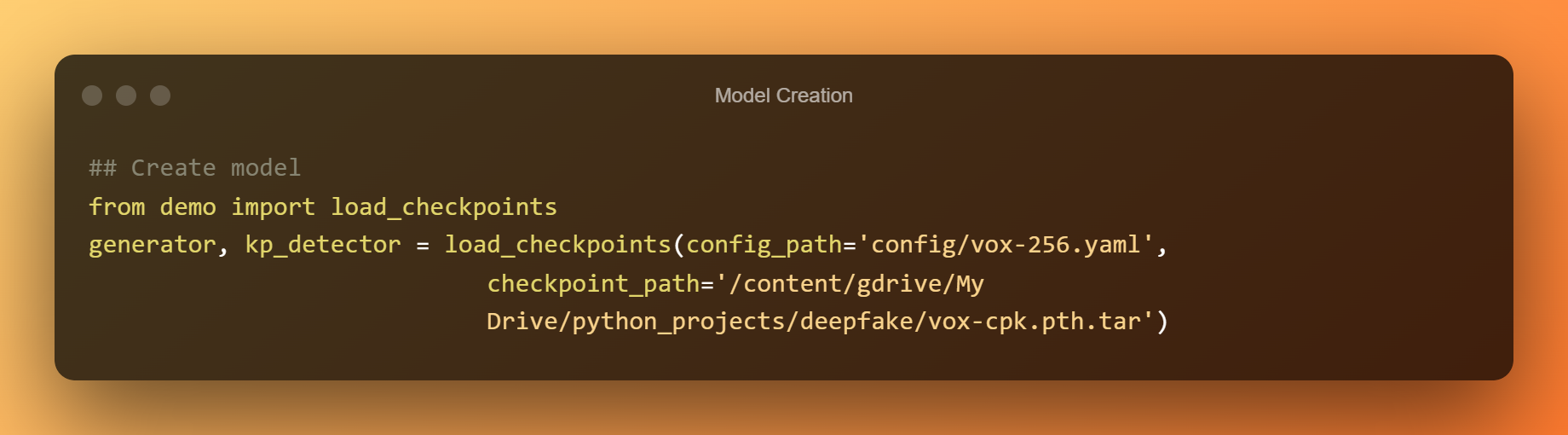

नमुना निर्माण

अब, हामी पूर्ण मोडेल सिर्जना गर्न पूर्व-प्रशिक्षित चेकपोइन्टहरू प्रयोग गर्नेछौं।

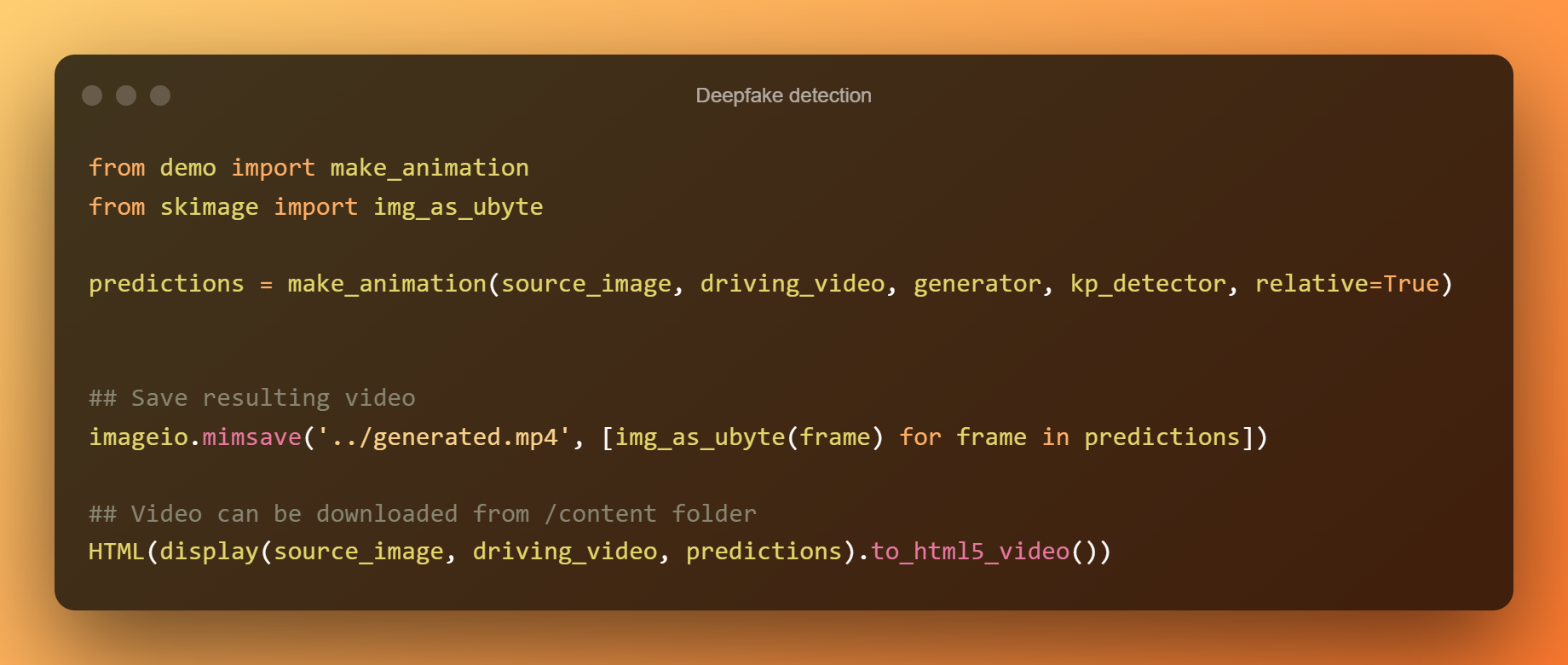

डीपफेक पत्ता लगाउने

सापेक्ष किपोइन्ट विस्थापन तलको कक्षमा वस्तुहरू एनिमेसन गर्न प्रयोग गरिन्छ। अर्को सेलले यसको सट्टा निरपेक्ष निर्देशांकहरू प्रयोग गर्दछ, तर सबै वस्तु अनुपातहरू यस फेसनमा ड्राइभिङ भिडियोबाट लिइनेछ।

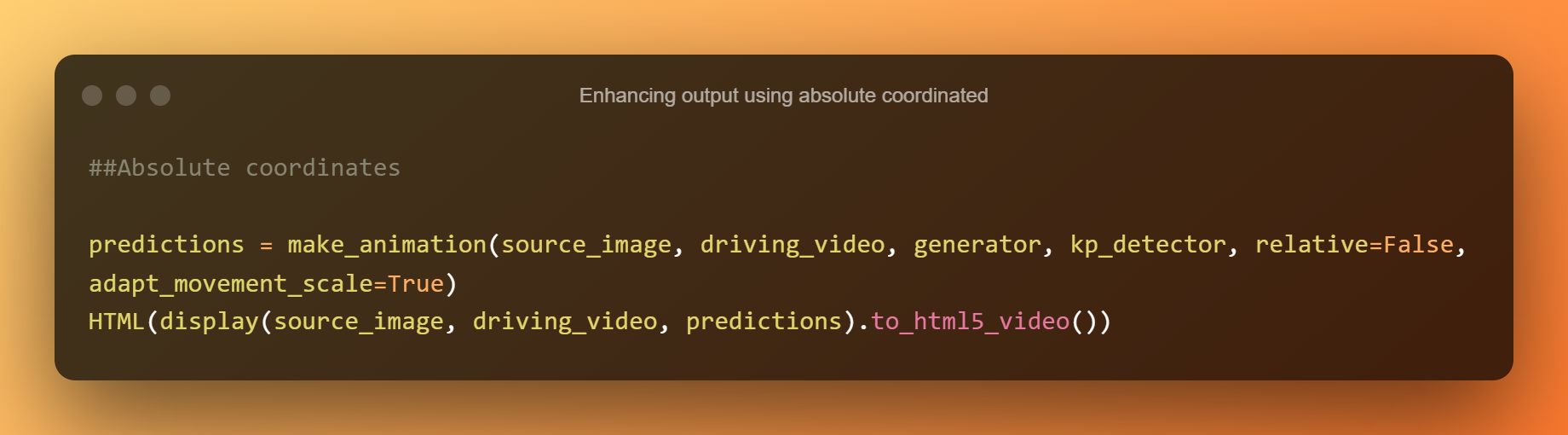

निरपेक्ष निर्देशांकहरू प्रयोग गरेर आउटपुट बढाउँदै

तपाईं यस तरिकामा गहिरो फेक पत्ता लगाउन सक्षम हुनुहुनेछ।

Deepfake टेक्नोलोजी को जोखिम के हो?

Deepfake भिडियोहरू अब तिनीहरूको नवीनताको कारण हेर्नको लागि आकर्षक र मनोरञ्जनात्मक छन्। यद्यपि, त्यहाँ एक जोखिम छ जुन यो प्रतीतित हास्यास्पद प्रविधिको सतह मुनि नियन्त्रण बाहिर जान सक्छ।

यो निश्चित रूपमा नक्कली र वास्तविक भिडियोहरू बीच भेद गर्न चुनौतीपूर्ण हुनेछ डीपफेक टेक्नोलोजी अगाडि बढ्न जारी छ। प्रमुख व्यक्तित्वहरू र सेलिब्रेटीहरूका लागि, विशेष गरी, यसले गम्भीर प्रभाव पार्न सक्छ। जानबूझकर द्वेषपूर्ण डिपफेकहरूले करियर र जीवनलाई पूर्ण रूपमा क्षति पुर्याउने सम्भावना हुन्छ।

अरूको लागि पास गर्न र तिनीहरूका साथीहरू, नातेदारहरू, र सहकर्मीहरूको फाइदा उठाउनको लागि यो खराब उद्देश्यका साथ कसैले प्रयोग गर्न सक्छ। तिनीहरू विदेशी नेताहरूको नकली फिल्महरू प्रयोग गरेर विश्वव्यापी विवादहरू र युद्धहरू पनि फैलाउन सक्षम छन्।

निष्कर्ष

सारांशमा, हामी एक अनौठो अवधि र असामान्य वातावरणमा छौं। झूटा समाचार र फिल्महरू उत्पादन गर्न र तिनीहरूलाई फैलाउन पहिले भन्दा धेरै सरल छ। के साँचो हो र के होइन भन्ने बुझ्नु झनै चुनौतीपूर्ण बन्दै गएको छ ।

आज, यो देखिन्छ, हामी अब आफ्नै इन्द्रियहरूमा भर पर्न सक्दैनौं।

नक्कली भिडियो डिटेक्टरहरू विकास गरिएको तथ्यको बावजुद, यो केवल समयको कुरा हो कि जानकारीको अन्तर यति साँघुरो छ कि उत्कृष्ट नक्कली डिटेक्टरहरूले पनि भिडियो वास्तविक हो वा होइन भनेर निर्धारण गर्न असमर्थ हुनेछ।

जवाफ छाड्नुस्