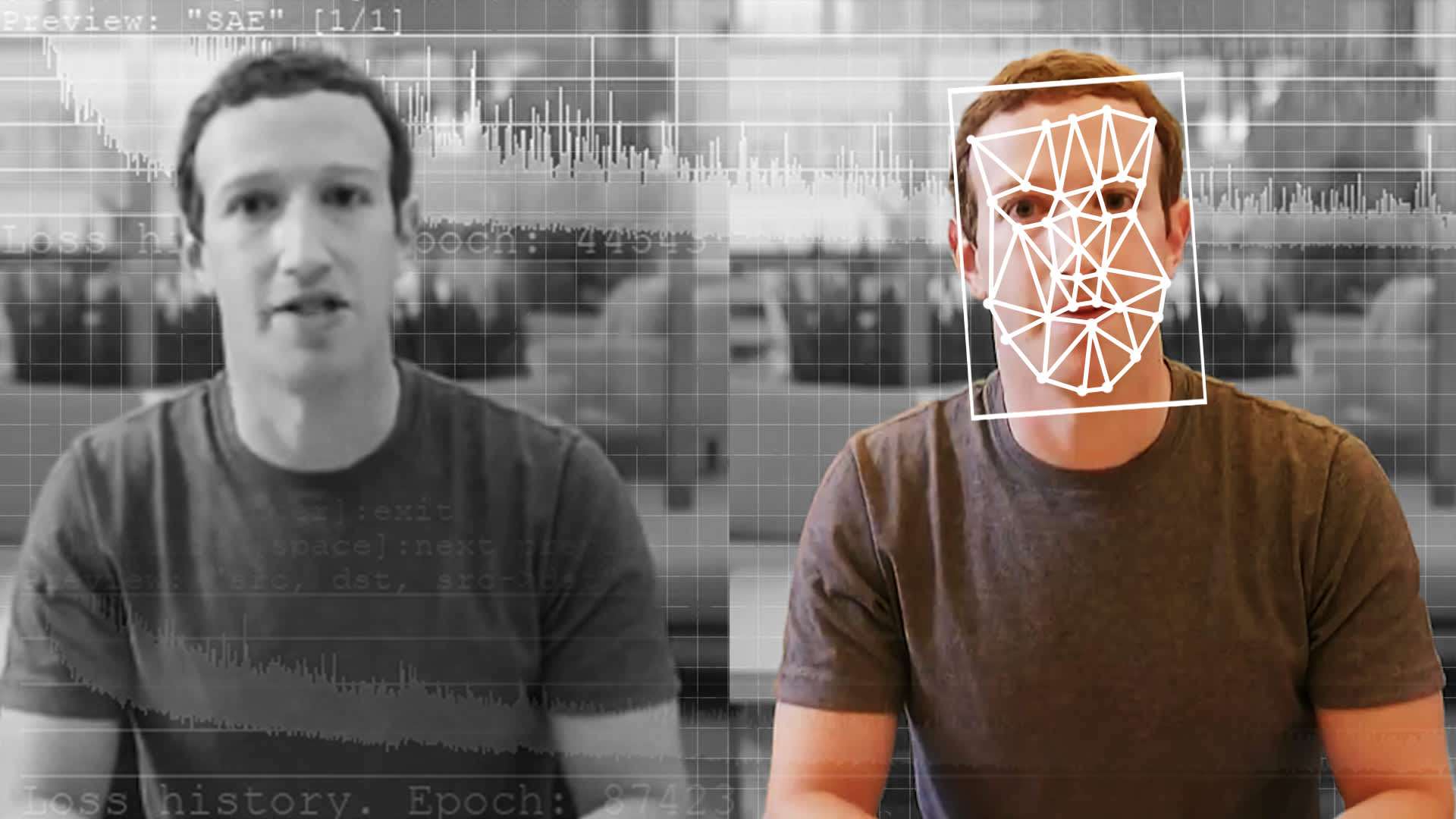

Videoklipi, kuros Marks Cukerbergs atzīst datu zādzību un Baraks Obama ļaunprātīgi izmanto Donaldu Trampu, jau ilgu laiku ir izplatīti internetā?

Šie videoklipi ir ļoti progresīvas un futūristiskas AI tehnoloģijas Deepfake rezultāts.

Vienkārši sakot, tā ir Photoshop alternatīva video. No vienas puses, tas var revolucionizēt elektroniskos plašsaziņas līdzekļus, novēršot vajadzību pēc faktiskas personas.

No otras puses, tas nopietni apdraud personas identitāti, jo videoklipā varat likt ikvienam pateikt jebko.

Deepfakes izmantošana dziļa mācīšanās lai izveidotu viltotu notikumu fotogrāfijas un video, tāpēc arī nosaukums deepfake. Tas var ne tikai apmainīt sejas esošajos videoklipos, bet arī izveidot jaunus kadrus un videoklipus no jauna.

Deepfakes izcelsme

Plaša akadēmiskie pētījumi pēdējos gados ir pārkāpusi foto un video manipulāciju robežas. Deepfake ir arī šo akadēmisko pētījumu rezultāts.

Par pirmo video manipulācijas gadījumu tika ziņots 1997. gadā. Video, kurā redzama kāda persona, tika pārveidots, lai runātu citā audio celiņā ietvertos vārdus. Tas bija pirmais sejas reanimācijas lietošanas gadījums mašīna mācīšanās metodes.

Vēl viens ievērojams progress tika panākts 2017. gadā, kad bijušā ASV prezidenta Baraka Obamas video tika pārveidots, lai runātu dažādus vārdus, kas atbilst citam audio celiņam.

2018. gadā Kalifornijas Universitātes Bērklijā pētnieki ieviesa lietotni, kas varētu izveidot a viltus deju video, izmantojot dziļu mācīšanos. Tas iezīmēja dziļo viltojumu izplešanos visā ķermenī, jo iepriekšējie darbi aprobežojās ar sejām.

Kā tiek izveidoti dziļi viltojumi?

Pateicoties skaitļošanas sasniegumiem, tagad varat salīdzinoši viegli un par zemām izmaksām izstrādāt dziļos viltojumus. Dziļu viltojumu ģenerēšanai tiek izmantotas divas galvenās metodes.

Metode 1

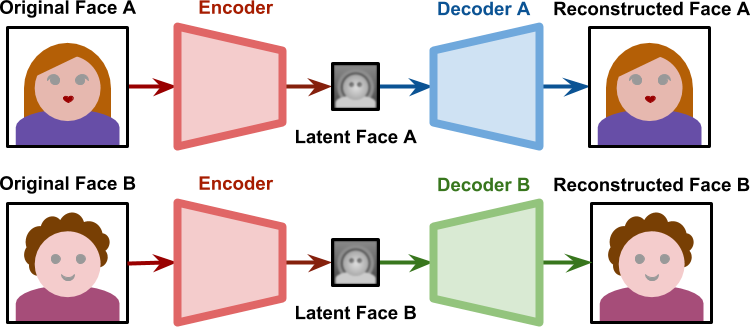

Jums būs jāapmāca a neironu tīklu īstā personas videomateriālā. Tas ļaus neironu tīklu lai izprastu objekta sejas vaibstus dažādos leņķos un apgaismojuma apstākļos.

Pēc tam jūs apstrādāsit gan sākotnējo seju, gan latento seju, izmantojot AI algoritmu, ko sauc par kodētāju. Tā atradīs un apgūs atšķirības un līdzības starp abām sejām, un abas sejas tiks reducētas līdz saspiestam attēlam, kam ir kopīgas iezīmes.

Pēc tam nāk otrais AI algoritms, ko sauc par dekodētāju, kas atgūst sejas no saspiestiem attēliem. Abas sejas tiek atkoptas ar diviem dažādiem dekodētājiem.

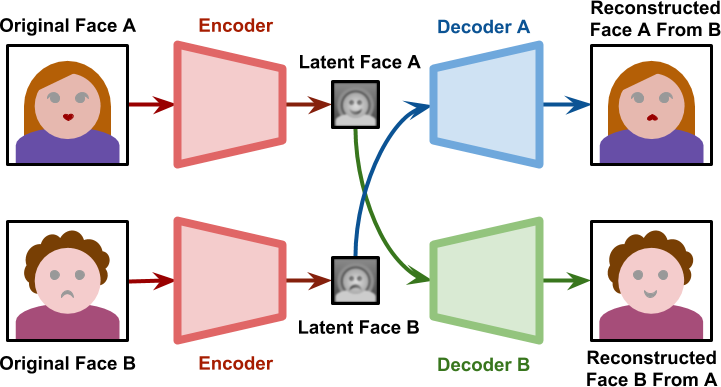

Lai veiktu sejas apmaiņu, vienkārši ievadiet kodētos attēlus citā dekodētājā.

Piemēram, sejas A kodētāja izvade tiek ievadīta dekodētājā, kas ir apmācīts sejai B, kas pēc tam rekonstruē seju B ar sejas A sejas iezīmēm. Lai iegūtu pārliecinošu rezultātu, tas būs jādara katrā video kadrā.

Metode 2

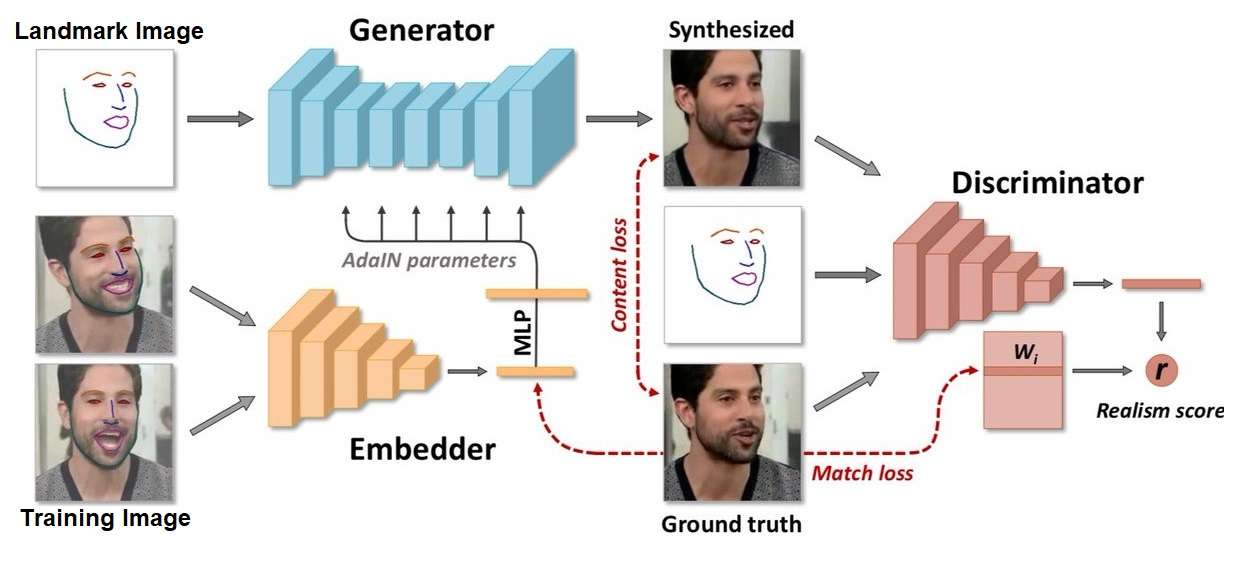

Vēl viena dziļo viltojumu ģenerēšanas metode ir ģeneratīvais pretrunīgais tīkls (GAN).

Lai ģenerētu dziļos viltojumus, jums būs jāizmanto divi konkurējoši algoritmi. Pirmais attēla ģenerēšanai izmantos nejaušu troksni, un tāpēc to sauc par ģeneratoru. Šis sintētiskais attēls tiek ievadīts reālu attēlu straumē, izmantojot otru algoritmu, ko sauc par diskriminatoru.

Diskriminators nodrošina atgriezenisko saiti ģeneratoram, kas ģenerē citu attēlu saskaņā ar atgriezenisko saiti. Tādā veidā abi algoritmi sniedz uzlabotus rezultātus katrā iterācijā. Šo procesu atkārto vairākas reizes, līdz tiek sasniegts nepieciešamais precizitātes līmenis.

GAN nodrošina pilnīgi reālus rezultātus, taču ar to ir grūti strādāt, un tam ir nepieciešams milzīgs apmācības datu un skaitļošanas jaudas apjoms. Tāpēc to parasti dod priekšroka attēlu, nevis videoklipu ģenerēšanai.

Daži pārliecinoši Deepfakes piemēri

Internetā ir daži ļoti pārliecinoši dziļi viltojumi, un lielākā daļa no tiem ir slavenības.

Piemēram, ir TikTok konts, kas veltīts tikai Toma Krūza viltojumiem. Videoklipos redzams, kā Kruīzs spēlē golfu vai demonstrē burvju triku.

@deeptomcruise Ceļot! ????

Vietnē YouTube tika augšupielādēts vēl viens ļoti sarežģīts viltojums ar Tomu Krūzu, Robertu Dauniju jaunāko, Džefu Goldblumu, Džordžu Lūkasu un Jūenu Makgregoru. Tam ir daži acīmredzami trūkumi, taču 3 līdz 4 dziļu viltojumu apstrāde videoklipā vienlaikus ir varoņdarbs.

Vēl viens piemērs ir bijušā prezidenta Baraka Obamas dziļi viltots video.

Šis ir satriecoši pārliecinošs, jo tajā tiek izmantotas atdarinātāju balsis un žesti, kas spēj atdarināt subjekta balsis un žestus.

Mēs tagad redzam dziļus viltojumus mūsdienu galvenajā izklaides industrijā.

To izmantoja, lai uzņemtu Pola Vokera ainas filmā Fast and Furious 7 pēc negaidītās aktiera nāves. Deepfake tika izmantots viņa brālim ar ievērojamu precizitāti.

Ko Deepfakes piedāvā galdā?

Deepfakes ir izrādījušies ļoti uzticama tehnoloģija, kas rada revolūciju plašsaziņas līdzekļos un izklaidē.

Vai varat atcerēties, kad CGI filmā “Man of Steel” noņēma Henrija Kavila ūsas un tā bija katastrofa?

To pašu tagad var izdarīt dažu tūkstošu dolāru datoros ar daudz pārliecinošākiem rezultātiem.

Tagad jūs varat satikt savus mirušos senčus un mīļotos. Jūs pat varat apmeklēt paša Alberta Einšteina fizikas lekciju.

Bez tam, deepfake nav pilnībā izmantots tādā veidā, kā tas bija paredzēts. Aptuveni 96% no dziļajiem viltojumiem internetā ir pornogrāfija bez piekrišanas.

Slavenībām pieejamais lielais apmācības datu daudzums ir padarījis tās par mērķtiecīgākajiem dziļo viltojumu upuriem.

Tas ir ļāvis mums ikvienu ievietot bīstamos vai kompromitējamos scenārijos, un tādējādi tas rada lielu risku ikvienam.

Ir ziņots, ka audio viltojumus izmanto korporāciju izkrāpšanai. 2019. gadā kāds uzdotājs izmantoja dziļu viltus audio, lai liktu Apvienotās Karalistes uzņēmuma izpilddirektoram pārskaitīt 220,000 XNUMX eiro Ungārijas bankai, uzdodoties par uzņēmuma mātesuzņēmuma vadītāju.

Kā cīnīties pret ļaunprātīgiem dziļajiem viltojumiem?

Parasti dziļi viltotus videoklipus var atklāt, uzmanīgi vērojot kadru pēc kadra un meklējot artefaktus un nelīdzenumus.

Tomēr tas ir neintuitīvs process, un daudzi uzņēmumi strādā pie algoritmiem un programmatūras atklāt dziļos viltojumus.

Facebook piesaistīja pētniekus no Bērklijas, Oksfordas un citām iestādēm, lai izveidotu dziļu viltojumu detektoru. Tāpat YouTube paziņoja, ka nepieņems viltotus videoklipus saistībā ar ASV vēlēšanām, balsošanas procedūrām vai 2020. gada tautas skaitīšanu ASV.

Varat arī izmantot tādas programmas kā Realitātes aizstāvis un Deeptrace, lai atklātu dziļos viltojumus.

Valstis ir arī aizņemtas ar likumu izstrādi attiecībā uz dziļo viltojumu izmantošanu kopumā. Pagājušā gada laikā ASV ir ieviesušas vairākus likumus par dziļajām viltojumiem.

Satīt

Deepfake ir dzīvais mākslīgā intelekta attīstības iemiesojums. Tas vēl vairāk izjauc nākotnes robežas, tomēr tas ir potenciāls drauds video grafiskā satura ticamībai internetā.

Pienāks laiks, kad cilvēki sāks šaubīties par katru video internetā, un mēs tiksim iestumti tālākas nenoteiktības laikmetā.

Atstāj atbildi