Diffusioun Modeller hunn de Globus duerch Stuerm mat der Verëffentlechung vun Dall-E 2, Google d'Bild, Stabil Diffusioun, an midjourney, Innovatioun spueren an d'Grenze vum Maschinnléieren ausdehnen.

Dës Modeller kënnen eng bal onlimitéiert Zuel vu Biller aus Wuertprompten produzéieren, dorënner photorealistesch, magesch, futuristesch, an natierlech léif Biller.

Dës Fäegkeeten reimagine wat et fir Mënschen heescht fir mat Silizium ze interfaceéieren, wat eis d'Fäegkeet gëtt praktesch all Bild ze maachen dat mir kënne virstellen.

Wéi dës Modeller entwéckelen oder de nächste generativen Paradigma iwwerhëlt, kënnen d'Mënschen Biller, Filmer an aner immersiv Erfarunge mat nëmmen engem Gedanken produzéieren.

An dësem Post diskutéiere mir de Diffusioun Modell, stabil Diffusioun, wéi et funktionnéiert, an en Diffusiounsmodell Inpainting Tutorial, ënner anerem.

Wat ass den Diffusiounsmodell?

Maschinn Léiermodeller déi nei Daten aus Trainingsdaten erstellen kënnen ginn als generativ Modeller bezeechent. Aner generativ Modeller enthalen Flow-baséiert Modeller, Variatioun Autoencoder, a generativ adversarial Netzwierker (GANs).

Jidderee kann Biller vun exzellenter Qualitéit generéieren. D'Diffusiounsmodeller léiere fir d'Donnéeën ze recuperéieren andeems dëse Kaméidi-Additiounsprozess ëmgedréint gëtt nodeems d'Trainingsdaten beschiedegt ginn duerch Kaméidi bäigefüügt. Fir et anescht ze soen, Diffusiounsmodeller kënnen kohärent Biller aus dem Kaméidi kreéieren.

D'Diffusiounsmodeller léieren duerch Kaméidi a Biller, déi de Modell spéider d'Entfernung beherrscht. Fir realistesch Visuals ze produzéieren, applizéiert de Modell dann dës denoising Technik op zoufälleg Somen.

Andeems Dir de Bildproduktiounsprozess konditionéiert, kënnen dës Modeller a Verbindung mat Text-zu-Bild Leedung benotzt ginn fir eng bal onbegrenzt Zuel vu Biller aus Text eleng ze generéieren. D'Somen kënnen duerch Inputen vun Embeddings wéi CLIP geleet ginn fir staark Text-zu-Bild Fäegkeeten ze ginn.

Diffusiounsmodeller kënnen eng Vielfalt vun Aufgaben ausféieren, dorënner Bildschafung, Bilddenoising, Inpainting, Outpainting a Bitdiffusioun.

Elo, wat ass stabil Diffusioun?

Stable Diffusion ass e Maschinnléiermodell fir Text-baséiert Bildschafung zur Verfügung gestallt vun Stabilitéit.AI. Et ass fäeg Biller aus Text ze generéieren.

Komponente vun stabil Diffusioun

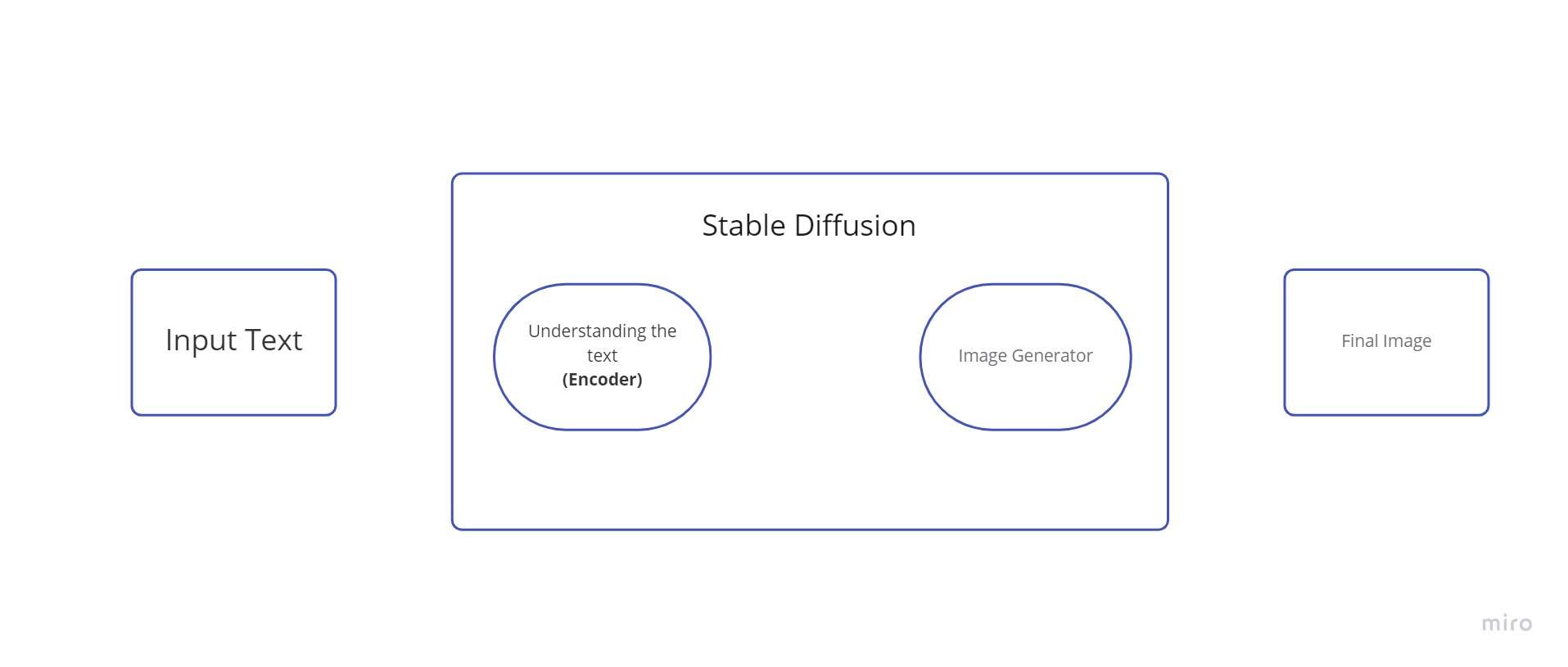

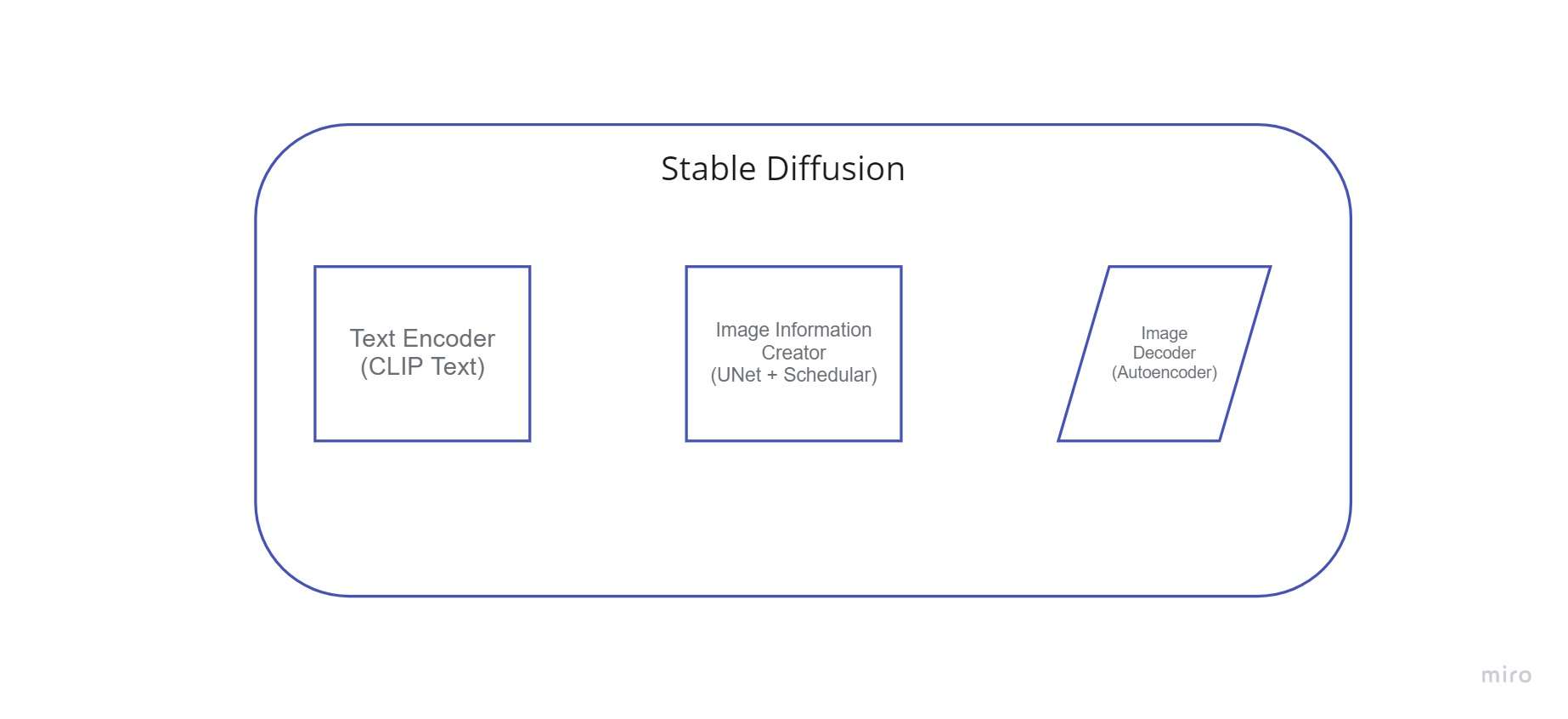

Stabil Diffusioun ass e System aus verschiddene Komponenten a Konzepter. Et ass keen eenzege Modell. Wa mir hannert der Hood kontrolléieren, ass dat éischt wat mir gesinn datt et en Textverständneskomponent gëtt deen Textinformatioun an eng numeresch Representatioun konvertéiert déi d'Konzepter vum Text erfaasst.

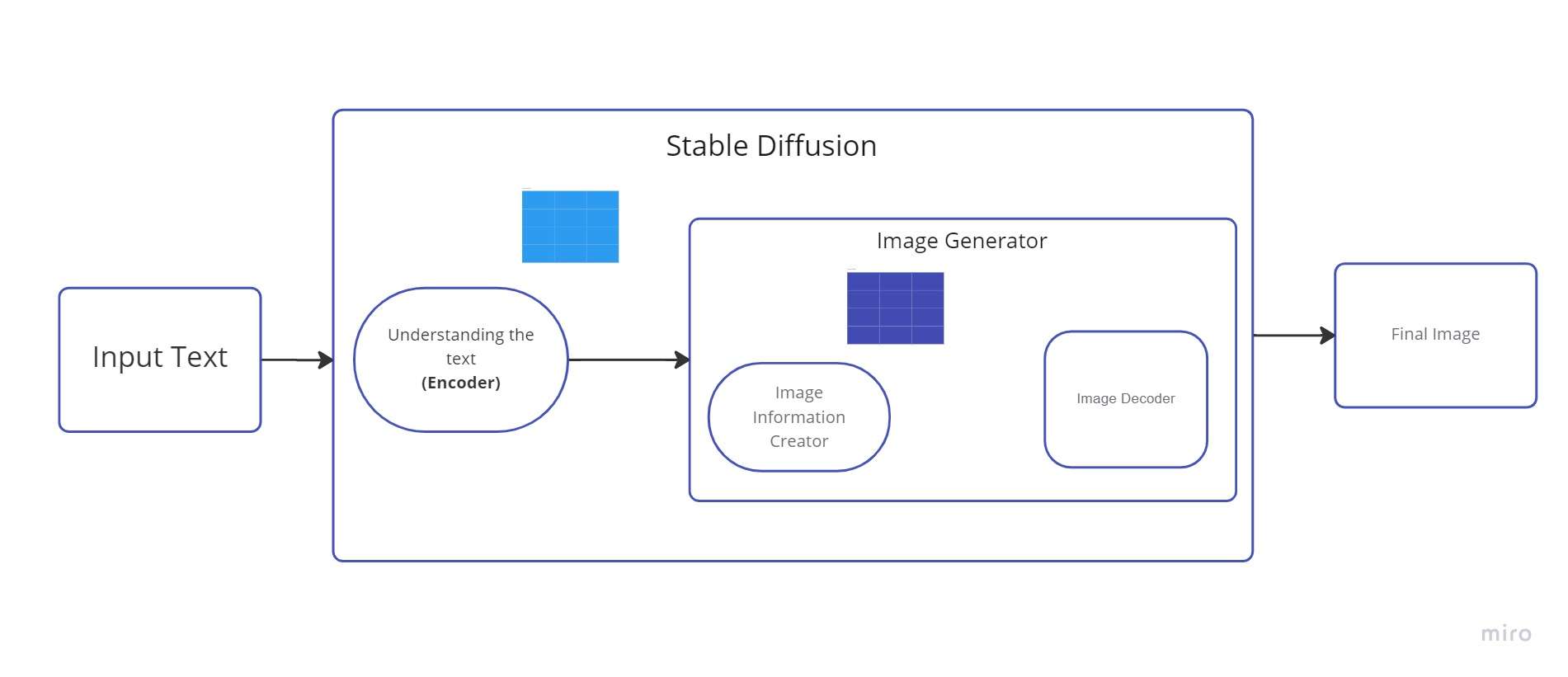

Mir kënnen dësen Text Encoder en Transformer nennen Sproochmodell (technesch: den Text Encoder vun engem CLIP Modell). Et hëlt den Input Text a generéiert eng Lëscht vun ganz Zuelen (e Vektor) fir all Wuert / Token am Text. Dës Donnéeë ginn dann un den Image Generator geliwwert, deen aus verschiddene Komponenten besteet.

Et ginn zwee Schrëtt am Bildgenerator:

1. Bild Informatiounen Schëpfer

Den Haaptkomponent an der stabiler Diffusioun ass dëst Element. Et ass wou d'Majoritéit vun der Verbesserung vun der Leeschtung iwwer fréier Versioune gemaach gëtt.

Dëse Komponent passéiert duerch e puer Etappen fir Bilddaten ze liwweren. Den Ersteller vu Bildinformatioun funktionnéiert nëmmen am Bildinformatiounsraum (oder latente Raum).

Et ass méi séier wéi fréier Diffusiounsmodeller déi am Pixelraum operéiert hunn wéinst dëser Charakteristik. Technesch gesi besteet dës Komponent aus engem Fuerplangalgorithmus an engem UNet. neural Netz.

De Prozess deen an dëser Komponent stattfënnt, gëtt als "Diffusioun" bezeechent. E qualitativ héichwäertegt Bild gëtt schlussendlech produzéiert als Resultat vun der Informatioun déi a Schrëtt veraarbecht gëtt (vum nächste Komponent, dem Bilddecoder).

2. Bild Decoder

Mat Hëllef vun den Donnéeën déi se vum Informatiounsproduzent kritt hunn, erstellt de Bilddecoder e Bild. Et gëtt just eemol ausgefouert fir de fäerdege Pixelbild um Enn vun der Operatioun ze kreéieren.

Stabil Diffusion Impainting Tutorial

Stabil Diffusion Bild Inpainting ass d'Technik fir fehlend oder beschiedegt Gebidder vun engem Bild auszefëllen. Den Zweck vum Bildinpainting ass d'Tatsaach ze verstoppen datt d'Bild restauréiert gouf.

Dës Technik gëtt dacks benotzt fir ongewollt Saachen aus engem Bild ze eliminéieren oder beschiedegt Beräicher vun historesche Fotoen ze restauréieren. Stabil Diffusion Inpainting ass e relativ rezente Wee fir Inpainting déi villverspriechend Effekter gëtt.

Follegt d'Instruktioune hei ënnen fir Iech unzefänken d'Inpainting z'erklären an existéierend Fotoen z'änneren wann Dir wëllt probéieren mat enger stabiler Diffusioun ze molen:

- Gitt op Huggingface Stabil Diffusioun Impainting

- Eroplueden Är eege Bild

- Läschen den Deel vun Ärem Bild deen ersat muss ginn.

- Gitt hei Är Ufro un (wat Dir wëllt addéieren anstatt wat Dir läscht)

- Wielt "Run"

Am Video uewen erop lueden mir e Bild mat dräi Zitrounen erop an ersetzen se fir Äppel. Ech perséinlech recommandéieren et mat Ären eegene Fotoen a Prompts ze probéieren.

Konklusioun

Am Allgemengen ass stänneg Diffusioun Inpainting eng exzellent Method fir gefälscht Biller oder Videoen ze produzéieren déi extrem real schéngen. Wéi mir Richtung neien Tech Fortschrëtter plënneren, wäert et ëmmer méi schwéier ginn tëscht authentesch a betrügeresch z'ënnerscheeden wéi d'Technologie weider geet.

Déi éischt Halschent ass komplett net mat der zweeter Halschent verbonnen. Et wier wierklech cool gewiescht, wann den Auteur erkläert hätt, wéi inpaint funktionéiert am Kader vum Modell, deen hie virdru erkläert huet, Abléck kéint ginn. Awer nee! Dat hätt e richtegt Verständnis erfuerdert, anstatt en zoufälleg Text ze sammelen an ze veraarbecht.