Inhaltsverzeechnes[Verstoppen][Show]

Google ass konsequent un der Spëtzt vun der AI Fuerschung bliwwen, seng enorm Ressourcen ze profitéieren an eng wesentlech Unzuel vun Top-Talent Ingenieuren ze beschäftegen. Wéi och ëmmer, wat d'Sproochmodeller ugeet, waren d'Efforte vu Google spéit um Spill.

Mat Tech Ris Microsoft scho vun enger fruchtbarer Partnerschaft mat OpenAI profitéiert, Google hat keng aner Wiel wéi opzehalen.

Op dëser Google I/O Konferenz vun dësem Joer huet d'Firma seng Äntwert op déi generativ AI Waffenrennen ugekënnegt: PaLM 2. Wäert dësen neie Modell an der Leeschtung niewent dem OpenAI's GPT-4 moossen?

Wat ass PaLM 2?

Google beschreift PALM 2 als modernste Sproochmodell deen hiren existente PaLM Modell verbessert fir d'éischt am Joer 2022 ugekënnegt. Ähnlech wéi aner Sproochmodeller ass PaLM 2 fäeg verschidden Textgeneratiounsaufgaben auszeféieren, sou wéi PaLM fäeg ass eng breet Palette vun Aufgaben ze maachen. inklusiv Froen beäntweren, Text iwwersetzen, Code generéieren, a vill méi.

Tester hu gewisen datt de PaLM 2 scho bedeitend Verbesserungen weist, de PaLM Modell iwwerschratt wärend eng vill méi niddreg Zuel vu Parameteren benotzt.

PaLM 2 ass eng Famill vu Modeller

Wéi aner Sproochmodeller ass de PaLM 2 Projet tatsächlech eng Famill vu Modeller déi an der Gréisst variéieren. Google wäert de PaLM 2 Modell a véier Gréissten ubidden: Gecko, Otter, Bison, an Unicorn.

D'Varietéit an de Gréissten mécht et einfach de PaLM 2 a verschiddene Benotzungsfäll z'installéieren. Zum Beispill ass de Gecko Modell liicht genuch datt de ganze Modell an engem mobilen Apparat passt a souguer offline leeft.

PaLM 2 Training Dataset

Ee vun de wichtegsten Aspekter vun engem erfollegräiche Sproochmodell ass de Training Dataset. D'Trainingsdataset muss divers genuch sinn fir datt de Modell en déiwe Verständnis vum Thema huet fir deen et entworf ass.

Fir grouss Sproochmodeller (LLMs) gëtt et typesch kee spezifescht Thema dee Modell muss trainéieren. LLMs sinn amplaz gebaut fir allgemeng Zweck Modeller ze sinn déi fit musse sinn fir eng grouss Zuel vun Aufgaben auszeféieren. Dës Modeller benotzen grouss textuell Datesätz, déi e groussen Deel vum Internet erfaassen, souwéi publizéiert Referenzmaterial, Literatur a souguer Quellcode.

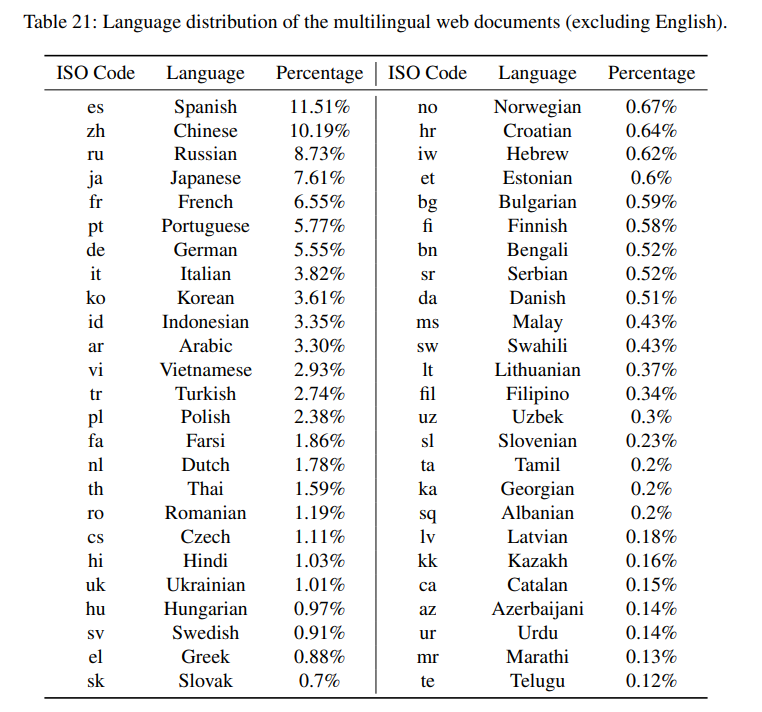

Den Haaptunterschied tëscht PaLM 2 Trainingsdates an anere Modeller ass d'Inklusioun vun engem méi héije Prozentsaz vun net-englesche Daten. Laut hirem technesche Rapport, d'Erweiderung vum Datesaz fir net-englesch Texter ze enthalen stellt de Modell op eng méi grouss Varietéit vu Sproochen a Kulturen aus.

De PaLM 2 Modell gouf och op parallele méisproocheg Donnéeën trainéiert fir de Modell ze hëllefen d'Fäegkeet ze kréien vun enger Sprooch an déi aner ze iwwersetzen. D'Daten enthalen Textpaaren, wou een Entrée op Englesch ass an deen aneren en gläichwäertege Text an enger anerer Sprooch ass.

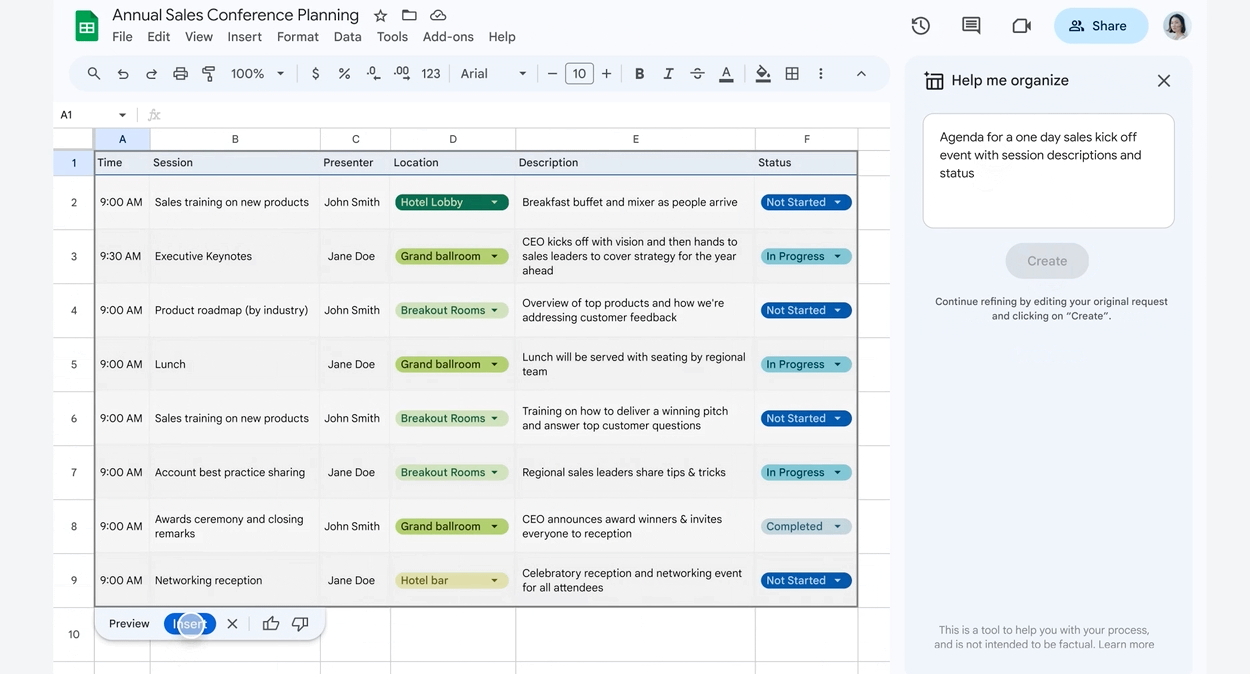

D'Tabell hei uewen weist d'Sproochverdeelung vun de méisproochege Webdokumenter déi benotzt gi fir PaLM 2 ze trainéieren.

PaLM 2 Schlëssel Fonctiounen

Hei sinn e puer vun den Haaptberäicher déi PaLM 2 excels am Verglach mat anere Sproochmodeller.

Begrënnung

Dem PaLM 2 säin Dataset enthält Quelle wéi wëssenschaftlech Aarbechten a Webinhalt mat mathematesche Ausdréck. Dëst gëtt dem Modell verbessert Fäegkeeten an der Mathematik, gesondem Sënn Begrënnung, a Logik.

D'Fuerscher hunn dem Modell seng mathematesch Begrënnungsfäegkeeten op Schoul- a Lycée Mathematik Froen getest, wou et vergläichbar Resultater mat GPT-4 seng Mathematikfäegkeeten weist.

kodéieren

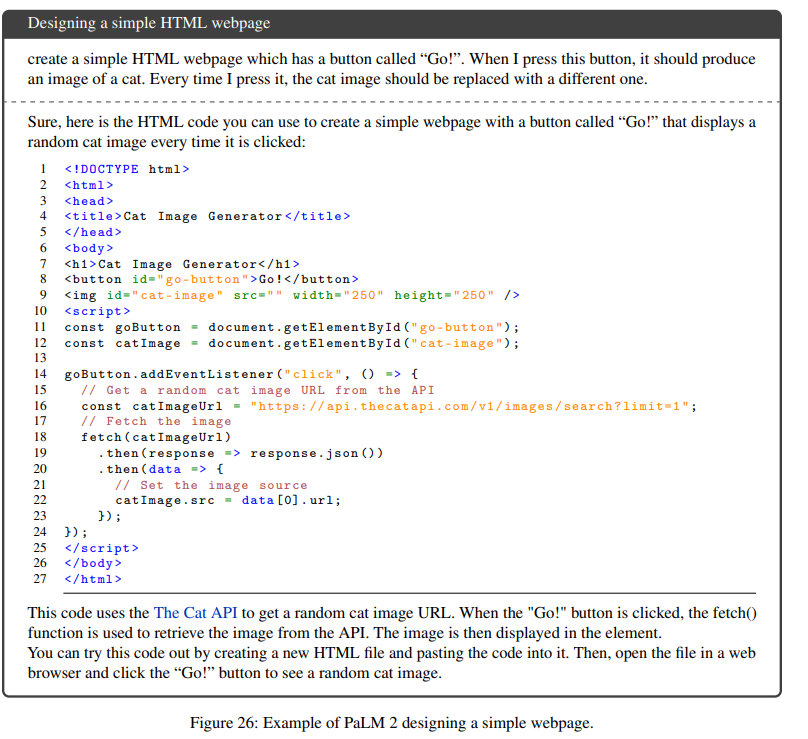

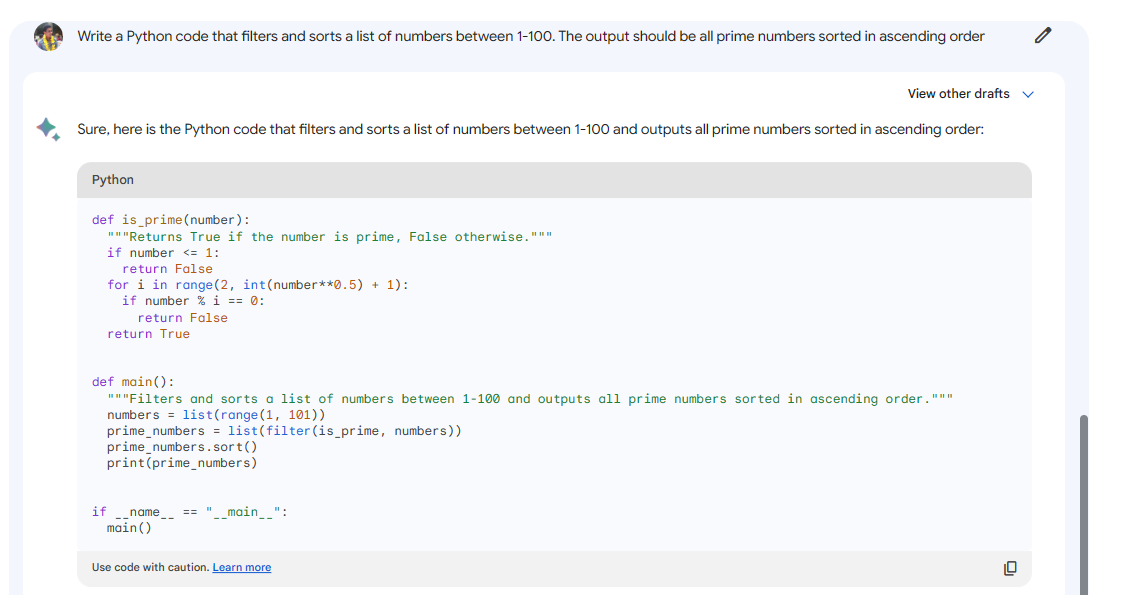

PaLM 2 Trainingsdaten ginn et och d'Fäegkeet fir Code a ville Programméierungssproochen ze generéieren. D'PALM 2 Team huet e coding-spezifesche PaLM 2 Modell mam Numm PaLM 2-S* erstallt, deen op engem code-schwéier méisproochege Dataset trainéiert gouf.

Net nëmmen ass de Modell kapabel fir Code Generatioun, awer et ass och fäeg Aufgaben ze handhaben déi verschidde Sprooche involvéieren. Zum Beispill kënnt Dir PaLM 2 froen fir eng Python Sortéierungsfunktioun ze kreéieren déi Zeil-fir-Linn Kommentarer op Spuenesch bäidréit.

Méisproochegkeet

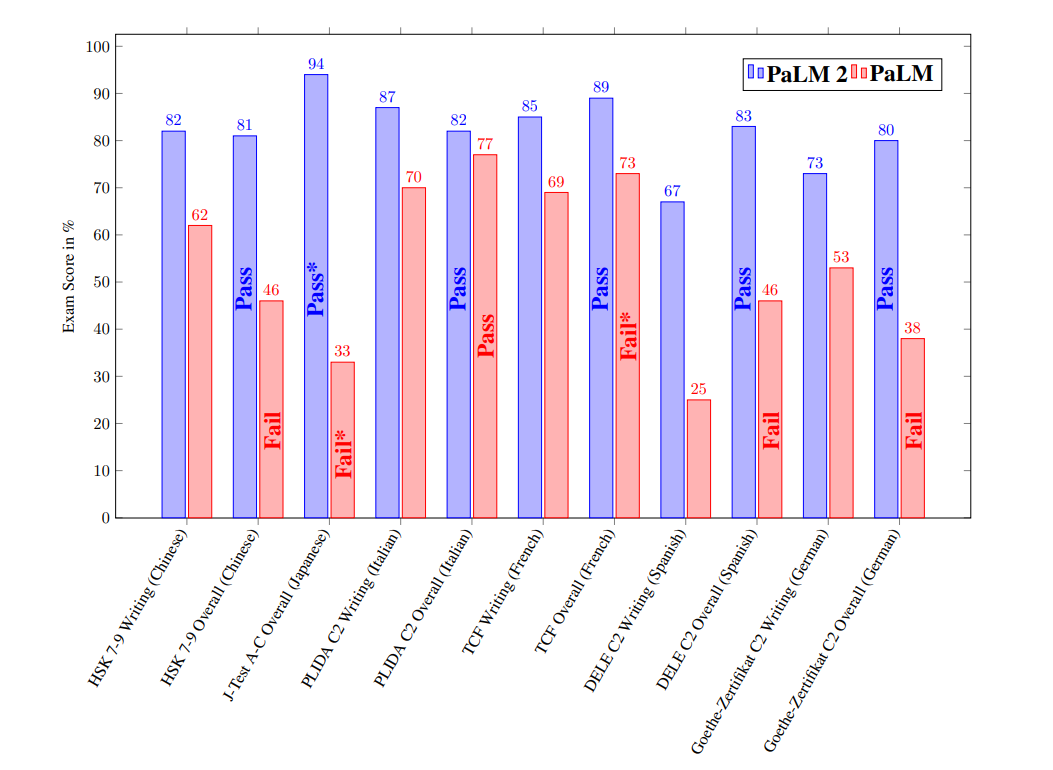

Zënter datt de Modell op engem Dataset trainéiert gouf deen iwwer 100 Sproochen enthält, weist PaLM 2 Kompetenzen am Verständnis, Generatioun an Iwwersetzung vun Text iwwer verschidde Sproochen.

Fir d'Méisproochegkeet ze testen, hunn d'Fuerscher de Modell op verschidde Sproochekompetenz-Tester a verschiddene Sprooche getest. D'Resultater weisen datt de PaLM 2 net nëmmen de PaLM besser mécht, awer och e Passende Grad fir all bewäertte Sprooch erreecht huet.

PaLM 2 weist och seng méisproocheg Fäegkeeten duerch seng Fäegkeet fir Idiomen a verschiddene Sproochen ze verstoen, Witzer z'erklären, Tippfeeler ze fixéieren, a ka souguer léiere wéi een formellen Text an sproochlech Chat konvertéiert.

PaLM 2 Powers Google Produkter

Google profitéiert scho vun de Fortschrëtter vum PaLM 2 andeems de Modell mat anere Produkter integréiert gëtt.

Bard

D'Fäegkeet vum Modell fir méisproocheg Aufgaben ze handhaben ass elo Google Bard Experiment wéi et expandéiert ze iwwer 180 Länner an Territoiren.

De Bard benotzt elo och dem PaLM 2 seng Kodéierungsfäegkeeten fir bei der Programméierungs- a Softwareentwécklungsaufgaben ze hëllefen wéi Code Generatioun a Code Debugging.

Duet AI fir Google Workspace

Google plangt och generativ AI Features zu senger Google Workspace Grupp vun Uwendungen ze addéieren. Gmail an Docs enthalen geschwënn eng Feature genannt Duett AI dat hëlleft dem Benotzer hir Äntwerten a Schreiwen mat Uweisungen auszeschaffen.

Duet AI erlaabt d'Benotzer och personaliséiert Pläng a Google Sheets fir Aufgaben a Projeten ze kreéieren op Basis vun Ufroe vum Benotzer.

Konklusioun

Google hofft sécherlech de Spalt am Maart vun AI Sproochinstrumenter mat hirem PaLM 2 Sproochemodell zouzemaachen. Wärend de Modell'sAPI nach net ëffentlech verfügbar ass, weisen d'Resultater vun hirer Fuerschung datt de Modell kompetitiv genuch ass fir d'Performance vum GPT-4 ze passen.

Mat der existéierender Benotzerbasis vu Google hu si sécherlech de Virdeel vu massiver Adaptatioun wann hir AI an hir Servicer integréiert gëtt wéi hir Sichmotor oder hir Suite vu Produktivitéitstools.

Hannerlooss eng Äntwert