Inhaltsverzeechnes[Verstoppen][Show]

Et ass net nei falsch Fotoen a Videoen ze hunn. Zënter der verbreeter Benotzung vum Internet hunn d'Individuen Fälschungen erstallt fir ze narren oder ze amuséieren zënter datt et Biller a Filmer gouf.

Wéi och ëmmer, et gëtt eng nei Aart vu Maschinn produzéiert Fälschungen, déi et iergendwann et schwéier maache fir d'Realitéit vu Fiktioun z'ënnerscheeden.

Dës Fälschungen ënnerscheeden sech vun den einfache Bildmanipulatiounen, déi duerch Redaktiounssoftware wéi Photoshop oder déi clever manipuléiert Filmer vun der Vergaangenheet generéiert goufen.

Deepfakes sinn dat bekanntst Beispill vu "syntheteschen Medien" - Biller, Kläng a Videoen déi ausgesinn wéi se mat konventionelle Methoden produzéiert goufen, awer wierklech mat sophistikéierter Software gemaach goufen.

Deepfakes sinn zënter enger Zäit ronderëm, a wärend hir populärste Applikatioun bis elo war d'Käpp vu berühmte Leit op de Kierper vun Akteuren a pornographesche Filmer ze setzen, si hunn d'Fäegkeet iwwerzeegend Footage ze produzéieren vun iergendeen wat eppes mécht, iwwerall.

An dësem Post wäerte mir Deepfakes kucken, wéi et funktionnéiert, wéi Dir se op Iech selwer generéiere kënnt, a vill méi.

Also, wat ass DeepFake?

En Deepfake - eng Kombinatioun vun de Sätze déif Léieren a Fake - ass e Stéck syntheteschen Medien an deem d'Ähnlechkeet vun enger anerer Persoun benotzt gëtt fir déi vun enger Persoun an enger scho existéierter Foto oder Video ze ersetzen.

Deepfakes benotzen raffinéiert Maschinnléieren a kënschtlech Intelligenz Techniken fir visuell an Audioinformatioun z'änneren an ze kreéieren déi en héije Potenzial fir Täuschung huet.

Deep Learning Methoden wéi Autoencoders a generativ adversarial Netzwierker sinn de primäre Mechanismus fir Deepfake Produktioun (GAN).

Dës Modeller gi benotzt fir d'Gesiichts Emotiounen a Beweegunge vun enger Persoun ze analyséieren an Gesiichtsbilder vun anere Leit ze synthetiséieren, déi vergläichbar Ausdréck a Beweegunge weisen.

D'Benotzung vun Deepfakes a Promi pornographesche Videoen, Fake News, Hoaxen a finanzielle Bedruch huet bedeitend Opmierksamkeet gezunn. Souwuel d'Industrie wéi d'Regierung hunn geäntwert andeems se probéiert se ze fannen an hir Notzung ze limitéieren.

Éischt Uerdnung Motion Model

Wann Dir probéiert déif Fälschungen an der Vergaangenheet z'entwéckelen, war d'Fro datt mir eng Zort extra Wëssen brauchen, oder Prioritéite fir dës Approche fir ze schaffen.

Als Illustratioun si Gesiichtsmarker erfuerderlech wa mir Kappbewegung wëllen verfollegen. Poseschätzung war noutwendeg wa mir d'ganz Kierperbewegung kartéiere wollten.

Dat huet d'lescht Joer op der NeurIPS Konferenz geännert wéi d'Fuerschungsteam vun der University of Toronto hir Aarbecht presentéiert huet, "Éischt Bestellung Motion Model fir Bild Animatioun. "

Kee weider Wëssen iwwer Animatioun ass fir dës Approche néideg. Zousätzlech, nodeems dëse Modell trainéiert gouf, kann et fir Transfert Léieren benotzt ginn an op all Element applizéiert ginn, deen ënner der selwechter Kategorie falen.

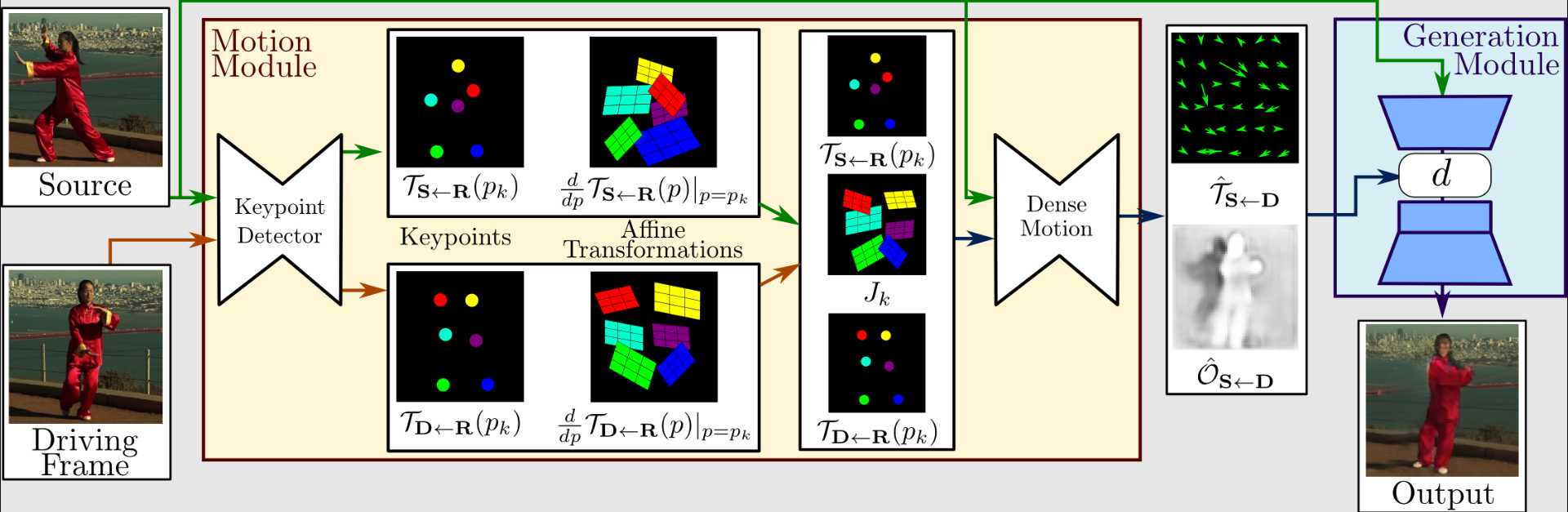

Loosst eis d'Operatioun vun dëser Method e bësse méi wäit kucken. Bewegungsextraktioun a Generatioun maachen déi éischt Halschent vum ganze Prozess aus. Déi dreiwend Video a Quellbiller ginn als Input benotzt.

Fir d'Bewegungsrepresentatioun vun der éischter Uerdnung ze extrahieren, déi aus spatzen Schlësselpunkten a lokalen affinen Transformatiounen besteet, benotzt e Bewegungsextraktor en Autoencoder fir Schlësselpunkten z'identifizéieren.

Fir en dichten opteschen Flow an Okklusiounskaart mam dichte Bewegungsnetz ze kreéieren, gi se zesumme mam Fuerevideo agestallt. De Generator mécht dann d'Zilbild mat den Ausgänge vum dichte Bewegungsnetz an dem Quellbild.

Iwwer de Bord leeft dës Aarbecht besser wéi den Zoustand vun der Konscht. Et enthält och Features déi aner Modeller just net hunn. Et funktionnéiert op verschidde Bildtypen, sou datt Dir et op Biller vum Gesiicht, Kierper, Cartoons, etc.

Vill nei Méiglechkeete ginn duerch dëst geschaf. En aneren banebriechende Aspekt vun eiser Strategie ass datt et Iech elo erlaabt héichqualitativ Deepfakes mat nëmmen engem Bild vum Zilobjekt ze produzéieren, ähnlech wéi mir et maachen YOLO fir Objet Unerkennung.

Prozess fir Deepfake Modell ze kreéieren

Dräi Prozesser sinn néideg fir Deepfake Generatioun: Extraktioun, Training a Kreatioun. D'Haaptpunkte vun all eenzel vun dësen Etappen a wéi se sech mam Gesamtprozess bezéien ginn an dëser Sektioun ofgedeckt.

Extraktioun

Deepfakes benotzen déif neural Netzwierker fir Gesiichter z'änneren a brauche vill Daten (Biller) fir korrekt an iwwerzeegend ze bedreiwen. Den Extraktiounsprozess ass d'Bühn an där all Rummen aus Videoclips extrahéiert ginn, d'Gesiichter unerkannt ginn, an d'Gesiichter ginn dann ausgeriicht fir d'Performance ze maximéieren.

Training

An der Formatioun Phase, der neural Netz kann ee Gesiicht an en anert änneren. Ofhängeg vun der Gréisst vum Praxisset an dem Trainingsgadget kann d'Ausbildung e puer Stonnen oder souguer Deeg daueren.

Den Training muss just eemol ofgeschloss ginn, sou wéi déi meescht aner neural Netzwierk Training. Nom Training kéint de Modell e Gesiicht vu Persoun A op Persoun B änneren.

Schafen

Nodeems de Modell trainéiert gouf, kéint en Deepfake produzéiert ginn. Frames ginn aus engem Video geholl an dann op all Gesiichter ausgeriicht. Dat trainéiert neuralt Netzwierk gëtt dann benotzt fir all Frame ze transforméieren.

D'verwandelt Gesiicht muss mat der Original Kader als leschte Schrëtt fusionéiert ginn.

Bauen Deepfake Detektiounsmodell

Montage a Klonen GitHub Repo

Kënnen Google's GPUs gratis benotze wärend Dir bei Colab schafft ass avantagéis fir ze léieren. En zousätzleche Virdeel ass d'Fäegkeet fir e Google Drive op enger Cloud virtueller Maschinn (VM) ze montéieren.

Mat einfachen Zougang zu all senge Saachen ass de Benotzer aktivéiert. De Programm néideg fir Google Drive op d'virtuell Maschinn an der Wollek ze montéieren gëtt an dëser Rubrik fonnt.

Import Moduler

Elo wäerte mir all déi néideg Moduler importéieren.

Ausféierung vum Modell

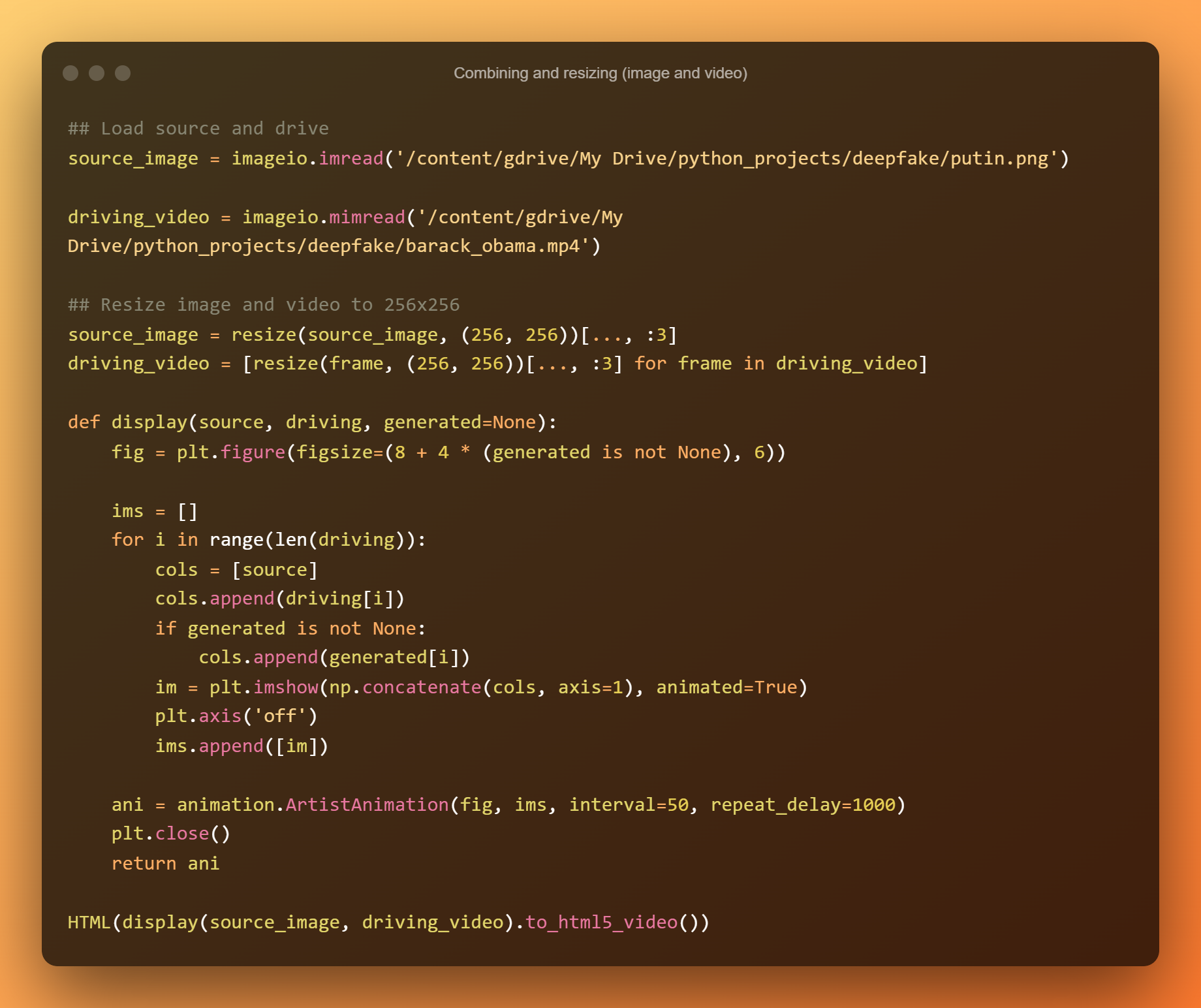

Mir benotzen e Beispill dat eng Stillfoto vum Putin (Quellbild) mat engem Video vum Obama kombinéiert. D'Resultat ass e Video vum Putin schwätzt a gestikuléiert mat deene genee selwechte Gesiichtsausdréck, déi den Obama beim Fuere benotzt huet.

Ier Dir d'Resultat vum Modell weist, ginn d'Medien gelueden an d'Funktioune ginn deklaréiert. Kontrollpunkte ginn dann gelueden an de Modell gëtt gebaut. Nodeems Dir den Deep Fake erstallt huet, ginn zwee verschidde Animatiounsstiler ugewisen.

De Putin ass animéiert vun Obama seng Beweegunge mat enger relativer Schlësselpunktverschiebung. D'Art a Weis wéi dem Obama seng Gesiichts Emotiounen a Kierpersprooch schéin a kloer fir de Putin wärend senge Videoen duergestallt ginn ass erstaunlech.

Et ginn e puer mikroskopesch Feeler, besonnesch wann den Obama seng Wenkbrauwen hieft a seng Ae blénkt. Dës Ausdréck ginn net genee an de Rumm vum Putin replizéiert.

Ouni déi deepfake Kuliss, géif de Putin Film zimlech glafwierdeg an authentesch schéngen, wann en op der Televisioun oder sozial Medien.

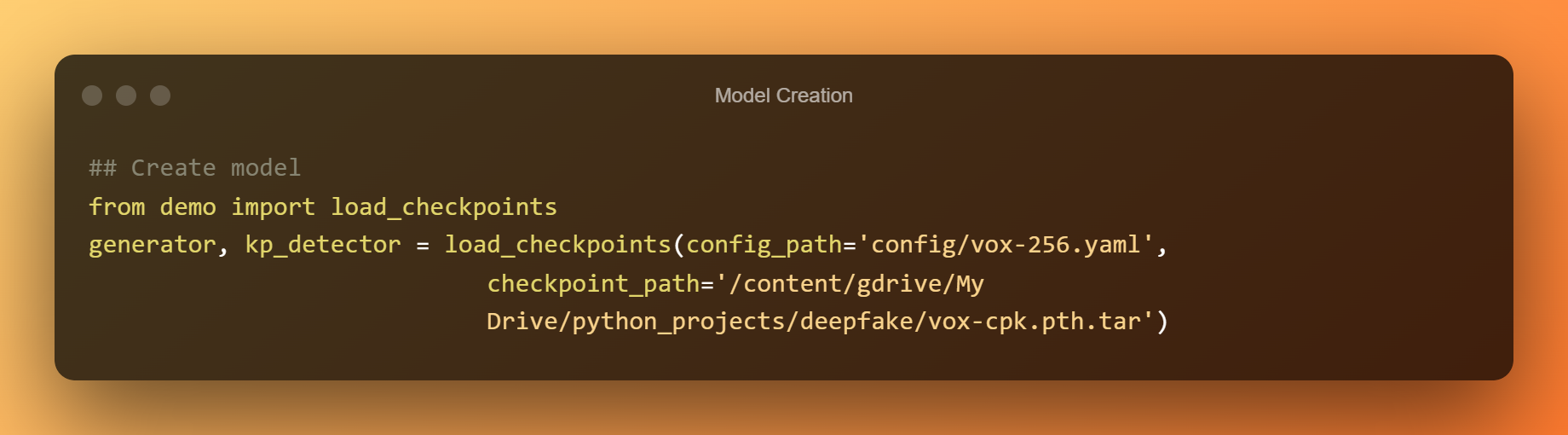

Modell Kreatioun

Elo wäerte mir déi pre-trainéiert Kontrollpunkte benotze fir e komplette Modell ze kreéieren.

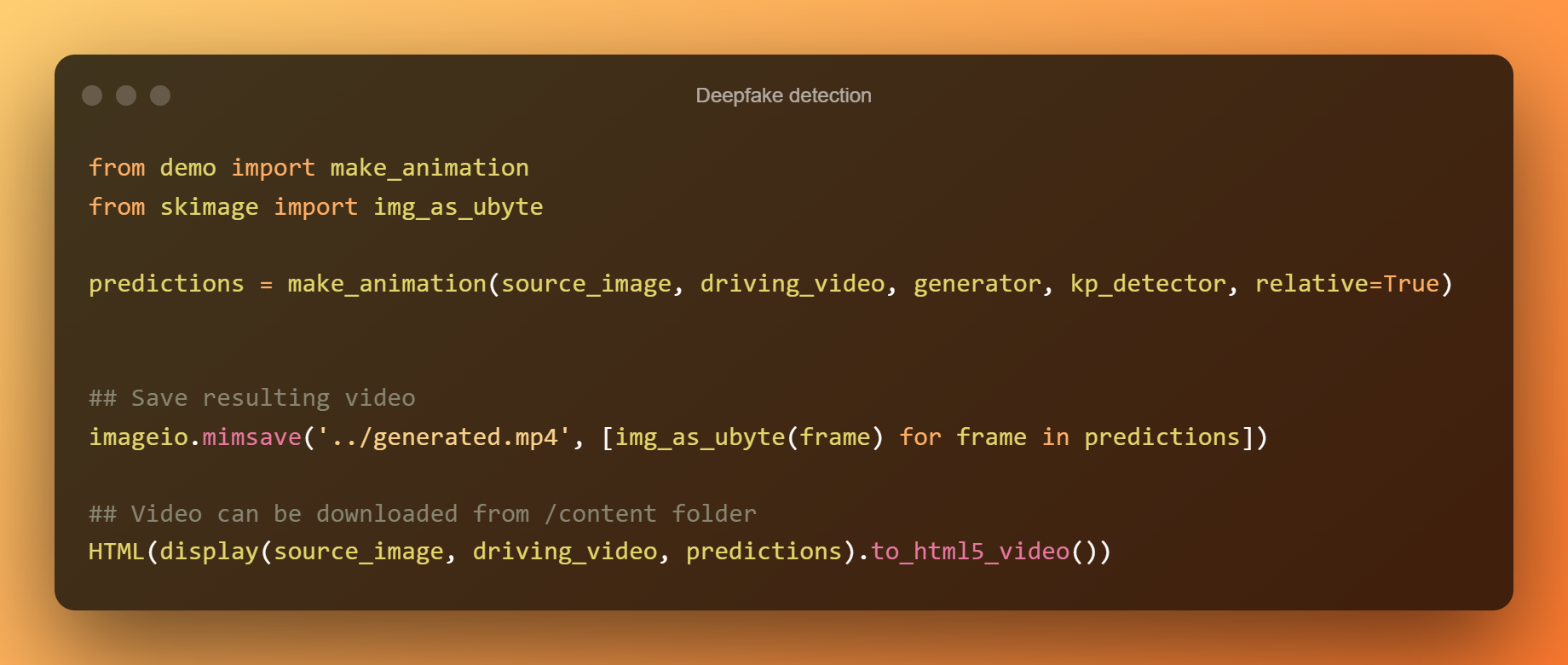

Deepfake Detektioun

Relativ Schlësselpunktverschiebung gëtt benotzt fir d'Elementer an der Zell hei drënner ze animéieren. Déi nächst Zell benotzt absolut Koordinaten amplaz, mee all Element Proportiounen wäert aus dem dreiwend Video an dëser Moud geholl ginn.

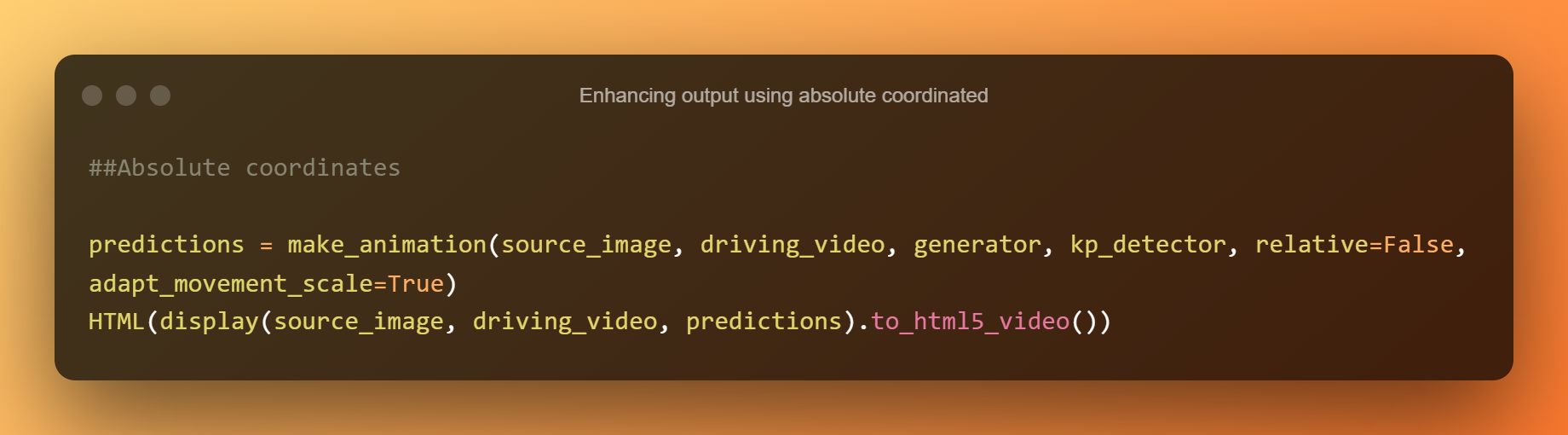

Verbessert d'Ausgab mat absolute Koordinaten

Dir wäert fäeg sinn eng Deepfake Detektioun op dës Manéier z'entwéckelen.

Wat sinn d'Risiken vun Deepfake Technologie?

Deepfake Videoen sinn elo engagéierend an erhuelsam ze kucken wéinst hirer Neiheet. Wéi och ëmmer, et besteet e Risiko, deen aus der Kontroll erauskënnt, ënner der Uewerfläch vun dëser scheinbar witzeger Technologie.

Et wäert sécherlech Erausfuerderung ginn tëscht gefälschte an real Videoen ze z'ënnerscheeden wéi Deepfake Technologie geet weider. Fir prominent Perséinlechkeeten a Promi, besonnesch, kann dëst schwéier Auswierkungen hunn. Deepfakes, déi bewosst béiswëlleg sinn, hunn d'Potenzial fir Karrieren a Liewen komplett ze beschiedegen.

Dës kënne vun engem mat bösartigen Absicht benotzt ginn fir anerer ze passéieren an hir Frënn, Famill a Mataarbechter ze profitéieren. Si sinn och fäeg fir weltwäit Kontroversen a souguer Kricher mat phony Filmer vun auslännesche Leader ze féieren.

Konklusioun

Zesummegefaasst si mir an enger komescher Period an ongewéinlecher Ëmwelt. Méi wéi jee ass et einfach falsch Neiegkeeten a Filmer ze produzéieren an ze verbreeden. Verstoen wat richteg ass a wat net gëtt ëmmer méi Erausfuerderung.

Haut, et schéngt, kënne mir net méi op eis eegen Sënner vertrauen.

Trotz der Tatsaach, datt falsch Video Detektoren entwéckelt goufen, ass et nëmmen eng Fro vun der Zäit ier d'Informatiounslück sou schmuel ass datt souguer déi feinste Fake Detektoren net fäeg sinn ze bestëmmen ob de Video wierklech ass oder net.

Hannerlooss eng Äntwert