ಪರಿವಿಡಿ[ಮರೆಮಾಡಿ][ತೋರಿಸಿ]

ನಕಲಿ ಫೋಟೋಗಳು ಮತ್ತು ವೀಡಿಯೊಗಳನ್ನು ಹೊಂದಿರುವುದು ಹೊಸದಲ್ಲ. ಅಂತರ್ಜಾಲದ ವ್ಯಾಪಕ ಬಳಕೆಯಿಂದ, ಚಿತ್ರಗಳು ಮತ್ತು ಚಲನಚಿತ್ರಗಳು ಇದ್ದಾಗಿನಿಂದ ವ್ಯಕ್ತಿಗಳು ಮೂರ್ಖರಾಗಲು ಅಥವಾ ವಿನೋದಪಡಿಸಲು ನಕಲಿಗಳನ್ನು ರಚಿಸುತ್ತಿದ್ದಾರೆ.

ಆದಾಗ್ಯೂ, ಹೊಸ ರೀತಿಯ ಯಂತ್ರ-ಉತ್ಪಾದಿತ ನಕಲಿಗಳಿವೆ, ಅದು ನಮಗೆ ಒಂದು ದಿನ ಕಾಲ್ಪನಿಕತೆಯಿಂದ ವಾಸ್ತವವನ್ನು ಪ್ರತ್ಯೇಕಿಸಲು ಕಷ್ಟವಾಗಬಹುದು.

ಈ ನಕಲಿಗಳು ಫೋಟೋಶಾಪ್ನಂತಹ ಸಾಫ್ಟ್ವೇರ್ಗಳನ್ನು ಸಂಪಾದಿಸುವ ಮೂಲಕ ಅಥವಾ ಹಿಂದಿನ ಕಾಲದ ಬುದ್ಧಿವಂತಿಕೆಯಿಂದ ಕುಶಲತೆಯಿಂದ ರಚಿಸಲಾದ ಸರಳ ಚಿತ್ರ ಮ್ಯಾನಿಪ್ಯುಲೇಷನ್ಗಳಿಂದ ಭಿನ್ನವಾಗಿವೆ.

ಡೀಪ್ಫೇಕ್ಗಳು "ಸಿಂಥೆಟಿಕ್ ಮೀಡಿಯಾ"-ಚಿತ್ರಗಳು, ಧ್ವನಿಗಳು ಮತ್ತು ವೀಡಿಯೊಗಳ ಅತ್ಯಂತ ಪ್ರಸಿದ್ಧ ಉದಾಹರಣೆಯಾಗಿದೆ, ಇದು ಸಾಂಪ್ರದಾಯಿಕ ವಿಧಾನಗಳನ್ನು ಬಳಸಿ ನಿರ್ಮಿಸಲಾಗಿದೆ ಎಂದು ತೋರುತ್ತಿದೆ ಆದರೆ ನಿಜವಾಗಿಯೂ ಅತ್ಯಾಧುನಿಕ ಸಾಫ್ಟ್ವೇರ್ ಬಳಸಿ ಮಾಡಲಾಗಿದೆ.

ಡೀಪ್ಫೇಕ್ಗಳು ಸ್ವಲ್ಪ ಸಮಯದವರೆಗೆ ಅಸ್ತಿತ್ವದಲ್ಲಿವೆ ಮತ್ತು ಅಶ್ಲೀಲ ಚಲನಚಿತ್ರಗಳಲ್ಲಿನ ನಟರ ದೇಹದ ಮೇಲೆ ಪ್ರಸಿದ್ಧ ವ್ಯಕ್ತಿಗಳ ತಲೆಯನ್ನು ಹಾಕುವುದು ಅವರ ಅತ್ಯಂತ ಜನಪ್ರಿಯ ಅಪ್ಲಿಕೇಶನ್ ಆಗಿದ್ದರೂ, ಯಾರಾದರೂ ಎಲ್ಲಿ ಬೇಕಾದರೂ ಏನು ಮಾಡಿದರೂ ಮನವೊಲಿಸುವ ತುಣುಕನ್ನು ಉತ್ಪಾದಿಸುವ ಸಾಮರ್ಥ್ಯವನ್ನು ಅವರು ಹೊಂದಿದ್ದಾರೆ.

ಈ ಪೋಸ್ಟ್ನಲ್ಲಿ, ನಾವು ಡೀಪ್ಫೇಕ್ಗಳು, ಅದು ಹೇಗೆ ಕಾರ್ಯನಿರ್ವಹಿಸುತ್ತದೆ, ನೀವು ಅವುಗಳನ್ನು ನೀವೇ ಹೇಗೆ ರಚಿಸಬಹುದು ಮತ್ತು ಹೆಚ್ಚಿನದನ್ನು ನೋಡುತ್ತೇವೆ.

ಹಾಗಾದರೆ, ಡೀಪ್ಫೇಕ್ ಎಂದರೇನು?

ಡೀಪ್ಫೇಕ್-ಡೀಪ್ ಲರ್ನಿಂಗ್ ಮತ್ತು ಫೇಕ್ ಎಂಬ ಪದಗುಚ್ಛಗಳ ಸಂಯೋಜನೆಯಾಗಿದೆ ಸಂಶ್ಲೇಷಿತ ಮಾಧ್ಯಮ ಇದರಲ್ಲಿ ಇನ್ನೊಬ್ಬ ವ್ಯಕ್ತಿಯ ಹೋಲಿಕೆಯನ್ನು ಈಗಾಗಲೇ ಅಸ್ತಿತ್ವದಲ್ಲಿರುವ ಛಾಯಾಚಿತ್ರ ಅಥವಾ ವೀಡಿಯೊದಲ್ಲಿ ವ್ಯಕ್ತಿಯ ಬದಲಿಗೆ ಬಳಸಲಾಗುತ್ತದೆ.

ಡೀಪ್ಫೇಕ್ಗಳು ಅತ್ಯಾಧುನಿಕ ಯಂತ್ರ ಕಲಿಕೆ ಮತ್ತು ಕೃತಕ ಬುದ್ಧಿಮತ್ತೆ ತಂತ್ರಗಳನ್ನು ಮಾರ್ಪಡಿಸಲು ಮತ್ತು ವಂಚನೆಗೆ ಹೆಚ್ಚಿನ ಸಾಮರ್ಥ್ಯವನ್ನು ಹೊಂದಿರುವ ದೃಶ್ಯ ಮತ್ತು ಆಡಿಯೊ ಮಾಹಿತಿಯನ್ನು ರಚಿಸಲು ಬಳಸಿಕೊಳ್ಳುತ್ತವೆ.

ಆಟೋಎನ್ಕೋಡರ್ಗಳು ಮತ್ತು ಉತ್ಪಾದಕ ವಿರೋಧಿ ಜಾಲಗಳಂತಹ ಆಳವಾದ ಕಲಿಕೆಯ ವಿಧಾನಗಳು ಡೀಪ್ಫೇಕ್ ಉತ್ಪಾದನೆಗೆ (GAN) ಪ್ರಾಥಮಿಕ ಕಾರ್ಯವಿಧಾನವಾಗಿದೆ.

ವ್ಯಕ್ತಿಯ ಮುಖದ ಭಾವನೆಗಳು ಮತ್ತು ಚಲನೆಗಳನ್ನು ವಿಶ್ಲೇಷಿಸಲು ಮತ್ತು ಹೋಲಿಸಬಹುದಾದ ಅಭಿವ್ಯಕ್ತಿಗಳು ಮತ್ತು ಚಲನೆಗಳನ್ನು ಪ್ರದರ್ಶಿಸುವ ಇತರ ಜನರ ಮುಖದ ಚಿತ್ರಗಳನ್ನು ಸಂಶ್ಲೇಷಿಸಲು ಈ ಮಾದರಿಗಳನ್ನು ಬಳಸಲಾಗುತ್ತದೆ.

ಸೆಲೆಬ್ರಿಟಿಗಳ ಅಶ್ಲೀಲ ವೀಡಿಯೊಗಳು, ನಕಲಿ ಸುದ್ದಿಗಳು, ವಂಚನೆಗಳು ಮತ್ತು ಹಣಕಾಸಿನ ವಂಚನೆಗಳಲ್ಲಿ ಡೀಪ್ಫೇಕ್ಗಳ ಬಳಕೆ ಗಣನೀಯವಾಗಿ ಗಮನ ಸೆಳೆದಿದೆ. ಅವುಗಳನ್ನು ಹುಡುಕಲು ಮತ್ತು ಅವುಗಳ ಬಳಕೆಯನ್ನು ಮಿತಿಗೊಳಿಸಲು ಪ್ರಯತ್ನಿಸುವ ಮೂಲಕ ಉದ್ಯಮ ಮತ್ತು ಸರ್ಕಾರ ಎರಡೂ ಪ್ರತಿಕ್ರಿಯಿಸಿವೆ.

ಮೊದಲ ಆರ್ಡರ್ ಮೋಷನ್ ಮಾದರಿ

ಹಿಂದೆ ಆಳವಾದ ನಕಲಿಗಳನ್ನು ಅಭಿವೃದ್ಧಿಪಡಿಸಲು ಪ್ರಯತ್ನಿಸುವಾಗ, ಈ ವಿಧಾನಗಳು ಕೆಲಸ ಮಾಡಲು ನಮಗೆ ಕೆಲವು ರೀತಿಯ ಹೆಚ್ಚುವರಿ ಜ್ಞಾನ ಅಥವಾ ಪೂರ್ವಜರ ಅಗತ್ಯವಿದೆ ಎಂಬುದು ಸಮಸ್ಯೆಯಾಗಿತ್ತು.

ವಿವರಣೆಯಂತೆ, ನಾವು ತಲೆಯ ಚಲನೆಯನ್ನು ಪತ್ತೆಹಚ್ಚಲು ಬಯಸಿದರೆ ಮುಖದ ಗುರುತುಗಳು ಅಗತ್ಯವಿದೆ. ನಾವು ಸಂಪೂರ್ಣ-ದೇಹದ ಚಲನೆಯನ್ನು ನಕ್ಷೆ ಮಾಡಲು ಬಯಸಿದರೆ ಭಂಗಿ ಅಂದಾಜು ಅಗತ್ಯ.

ಕಳೆದ ವರ್ಷ ಟೊರೊಂಟೊ ವಿಶ್ವವಿದ್ಯಾಲಯದ ಸಂಶೋಧನಾ ತಂಡವು ತಮ್ಮ ಕೆಲಸವನ್ನು ಪ್ರಸ್ತುತಪಡಿಸಿದಾಗ ನ್ಯೂರಿಐಪಿಎಸ್ ಸಮ್ಮೇಳನದಲ್ಲಿ ಅದು ಬದಲಾಯಿತು, "ಚಿತ್ರ ಅನಿಮೇಷನ್ಗಾಗಿ ಮೊದಲ ಆರ್ಡರ್ ಮೋಷನ್ ಮಾದರಿ. "

ಈ ವಿಧಾನಕ್ಕೆ ಅನಿಮೇಷನ್ ಬಗ್ಗೆ ಹೆಚ್ಚಿನ ಜ್ಞಾನದ ಅಗತ್ಯವಿಲ್ಲ. ಹೆಚ್ಚುವರಿಯಾಗಿ, ಈ ಮಾದರಿಯನ್ನು ತರಬೇತಿ ಮಾಡಿದ ನಂತರ, ಅದನ್ನು ವರ್ಗಾವಣೆ ಕಲಿಕೆಗಾಗಿ ಬಳಸಬಹುದು ಮತ್ತು ಅದೇ ವರ್ಗದ ಅಡಿಯಲ್ಲಿ ಬರುವ ಯಾವುದೇ ಐಟಂಗೆ ಅನ್ವಯಿಸಬಹುದು.

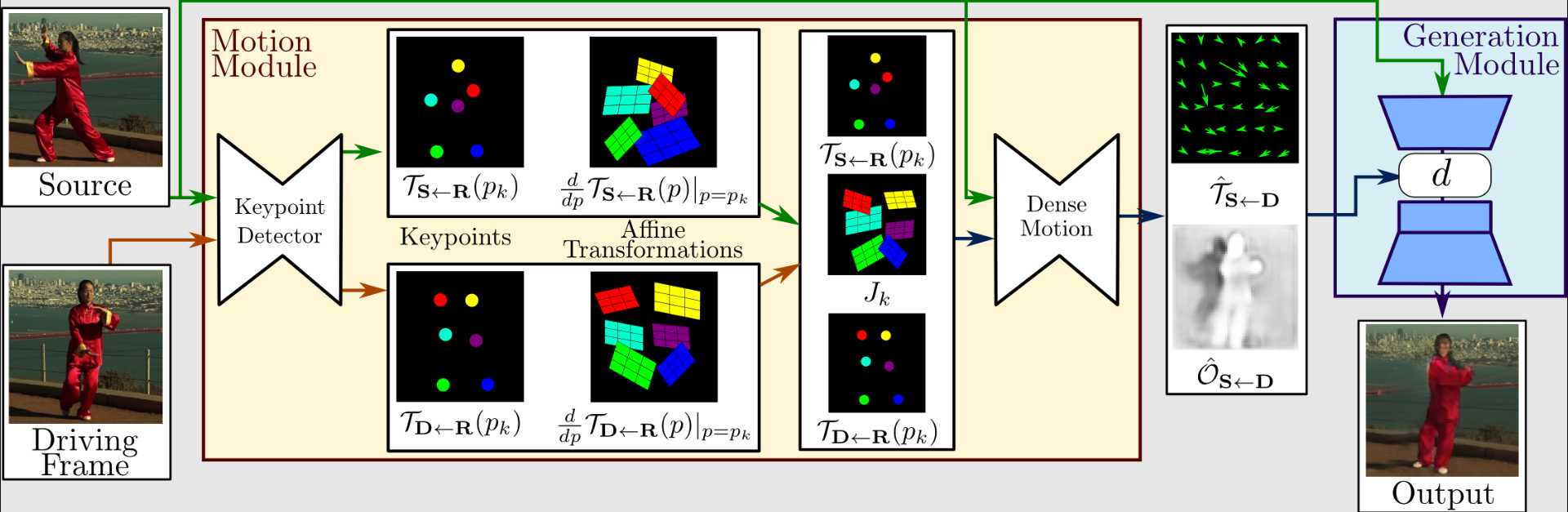

ಈ ವಿಧಾನದ ಕಾರ್ಯಾಚರಣೆಯನ್ನು ಸ್ವಲ್ಪ ಮುಂದೆ ನೋಡೋಣ. ಚಲನೆಯ ಹೊರತೆಗೆಯುವಿಕೆ ಮತ್ತು ಉತ್ಪಾದನೆಯು ಸಂಪೂರ್ಣ ಪ್ರಕ್ರಿಯೆಯ ಮೊದಲಾರ್ಧವನ್ನು ಮಾಡುತ್ತದೆ. ಡ್ರೈವಿಂಗ್ ವೀಡಿಯೊ ಮತ್ತು ಮೂಲ ಚಿತ್ರಗಳನ್ನು ಇನ್ಪುಟ್ಗಳಾಗಿ ಬಳಸಿಕೊಳ್ಳಲಾಗುತ್ತದೆ.

ವಿರಳವಾದ ಪ್ರಮುಖ ಬಿಂದುಗಳು ಮತ್ತು ಸ್ಥಳೀಯ ಅಫೈನ್ ರೂಪಾಂತರಗಳನ್ನು ಒಳಗೊಂಡಿರುವ ಮೊದಲ-ಕ್ರಮದ ಚಲನೆಯ ಪ್ರಾತಿನಿಧ್ಯವನ್ನು ಹೊರತೆಗೆಯಲು, ಚಲನೆಯ ಎಕ್ಸ್ಟ್ರಾಕ್ಟರ್ ಪ್ರಮುಖ ಅಂಶಗಳನ್ನು ಗುರುತಿಸಲು ಸ್ವಯಂಕೋಡರ್ ಅನ್ನು ಬಳಸುತ್ತದೆ.

ದಟ್ಟವಾದ ಚಲನೆಯ ನೆಟ್ವರ್ಕ್ನೊಂದಿಗೆ ದಟ್ಟವಾದ ಆಪ್ಟಿಕಲ್ ಹರಿವು ಮತ್ತು ಮುಚ್ಚುವಿಕೆಯ ನಕ್ಷೆಯನ್ನು ರಚಿಸಲು, ಡ್ರೈವಿಂಗ್ ವೀಡಿಯೊ ಜೊತೆಗೆ ಅವುಗಳನ್ನು ಬಳಸಿಕೊಳ್ಳಲಾಗುತ್ತದೆ. ಜನರೇಟರ್ ನಂತರ ದಟ್ಟವಾದ ಚಲನೆಯ ನೆಟ್ವರ್ಕ್ ಮತ್ತು ಮೂಲ ಚಿತ್ರದಿಂದ ಔಟ್ಪುಟ್ಗಳನ್ನು ಬಳಸಿಕೊಂಡು ಗುರಿ ಚಿತ್ರವನ್ನು ನಿರೂಪಿಸುತ್ತದೆ.

ಮಂಡಳಿಯಾದ್ಯಂತ, ಈ ಕೆಲಸವು ಕಲೆಯ ಸ್ಥಿತಿಗಿಂತ ಉತ್ತಮವಾಗಿ ಕಾರ್ಯನಿರ್ವಹಿಸುತ್ತದೆ. ಇದು ಇತರ ಮಾದರಿಗಳು ಹೊಂದಿಲ್ಲದ ವೈಶಿಷ್ಟ್ಯಗಳನ್ನು ಸಹ ಒಳಗೊಂಡಿದೆ. ಇದು ಹಲವಾರು ಚಿತ್ರ ಪ್ರಕಾರಗಳಲ್ಲಿ ಕಾರ್ಯನಿರ್ವಹಿಸುತ್ತದೆ, ಆದ್ದರಿಂದ ನೀವು ಅದನ್ನು ಮುಖ, ದೇಹ, ಕಾರ್ಟೂನ್ಗಳು ಇತ್ಯಾದಿಗಳ ಚಿತ್ರಗಳಿಗೆ ಅನ್ವಯಿಸಬಹುದು, ಇದು ಅತ್ಯಂತ ಅದ್ಭುತವಾಗಿದೆ.

ಇದರಿಂದ ಅನೇಕ ಹೊಸ ಅವಕಾಶಗಳು ಸೃಷ್ಟಿಯಾಗುತ್ತವೆ. ನಮ್ಮ ಕಾರ್ಯತಂತ್ರದ ಮತ್ತೊಂದು ಪ್ರಮುಖ ಅಂಶವೆಂದರೆ, ನಾವು ಹೇಗೆ ಮಾಡುತ್ತಿದ್ದೇವೆ ಎಂಬುದರಂತೆಯೇ ಗುರಿಯ ವಸ್ತುವಿನ ಕೇವಲ ಒಂದು ಚಿತ್ರವನ್ನು ಬಳಸಿಕೊಂಡು ಉತ್ತಮ-ಗುಣಮಟ್ಟದ ಡೀಪ್ಫೇಕ್ಗಳನ್ನು ಉತ್ಪಾದಿಸಲು ಇದು ನಿಮಗೆ ಅನುಮತಿಸುತ್ತದೆ. ವಸ್ತುವಿಗೆ YOLO ಗುರುತಿಸುವಿಕೆ.

ಡೀಪ್ಫೇಕ್ ಮಾದರಿಯನ್ನು ರಚಿಸುವ ಪ್ರಕ್ರಿಯೆ

ಡೀಪ್ಫೇಕ್ ಉತ್ಪಾದನೆಗೆ ಮೂರು ಪ್ರಕ್ರಿಯೆಗಳು ಅವಶ್ಯಕ: ಹೊರತೆಗೆಯುವಿಕೆ, ತರಬೇತಿ ಮತ್ತು ಸೃಷ್ಟಿ. ಈ ಪ್ರತಿಯೊಂದು ಹಂತಗಳ ಮುಖ್ಯ ಅಂಶಗಳು ಮತ್ತು ಅವು ಒಟ್ಟಾರೆ ಪ್ರಕ್ರಿಯೆಗೆ ಹೇಗೆ ಸಂಬಂಧಿಸಿವೆ ಎಂಬುದನ್ನು ಈ ವಿಭಾಗದಲ್ಲಿ ಚರ್ಚಿಸಲಾಗುವುದು.

ಬೇರ್ಪಡಿಸುವಿಕೆ

ಮುಖಗಳನ್ನು ಬದಲಾಯಿಸಲು ಡೀಪ್ಫೇಕ್ಗಳು ಆಳವಾದ ನರಮಂಡಲವನ್ನು ಬಳಸುತ್ತವೆ ಮತ್ತು ಸರಿಯಾಗಿ ಮತ್ತು ಮನವರಿಕೆಯಾಗುವಂತೆ ಕಾರ್ಯನಿರ್ವಹಿಸಲು ಸಾಕಷ್ಟು ಡೇಟಾ (ಚಿತ್ರಗಳು) ಅಗತ್ಯವಿರುತ್ತದೆ. ಹೊರತೆಗೆಯುವ ಪ್ರಕ್ರಿಯೆಯು ವೀಡಿಯೊ ಕ್ಲಿಪ್ಗಳಿಂದ ಎಲ್ಲಾ ಫ್ರೇಮ್ಗಳನ್ನು ಹೊರತೆಗೆಯುವ ಹಂತವಾಗಿದೆ, ಮುಖಗಳನ್ನು ಗುರುತಿಸಲಾಗುತ್ತದೆ ಮತ್ತು ನಂತರ ಕಾರ್ಯಕ್ಷಮತೆಯನ್ನು ಗರಿಷ್ಠಗೊಳಿಸಲು ಮುಖಗಳನ್ನು ಜೋಡಿಸಲಾಗುತ್ತದೆ.

ತರಬೇತಿ

ತರಬೇತಿ ಹಂತದಲ್ಲಿ, ದಿ ನರಮಂಡಲ ಒಂದು ಮುಖವನ್ನು ಇನ್ನೊಂದಕ್ಕೆ ಬದಲಾಯಿಸಬಹುದು. ಅಭ್ಯಾಸ ಸೆಟ್ ಮತ್ತು ತರಬೇತಿ ಗ್ಯಾಜೆಟ್ನ ಗಾತ್ರವನ್ನು ಅವಲಂಬಿಸಿ, ತರಬೇತಿಯು ಹಲವಾರು ಗಂಟೆಗಳು ಅಥವಾ ದಿನಗಳನ್ನು ತೆಗೆದುಕೊಳ್ಳಬಹುದು.

ಇತರ ನರಗಳ ನೆಟ್ವರ್ಕ್ ತರಬೇತಿಯಂತೆ ತರಬೇತಿಯನ್ನು ಒಮ್ಮೆ ಪೂರ್ಣಗೊಳಿಸಬೇಕು. ತರಬೇತಿಯ ನಂತರ, ಮಾದರಿಯು ವ್ಯಕ್ತಿ A ಯಿಂದ ವ್ಯಕ್ತಿ B ಗೆ ಮುಖವನ್ನು ಬದಲಾಯಿಸಲು ಸಾಧ್ಯವಾಗುತ್ತದೆ.

ಸೃಷ್ಟಿ

ಮಾದರಿಯನ್ನು ತರಬೇತಿ ಮಾಡಿದ ನಂತರ, ಡೀಪ್ಫೇಕ್ ಅನ್ನು ಉತ್ಪಾದಿಸಬಹುದು. ಫ್ರೇಮ್ಗಳನ್ನು ವೀಡಿಯೊದಿಂದ ತೆಗೆದುಕೊಳ್ಳಲಾಗುತ್ತದೆ ಮತ್ತು ನಂತರ ಎಲ್ಲಾ ಮುಖಗಳಿಗೆ ಜೋಡಿಸಲಾಗುತ್ತದೆ. ತರಬೇತಿ ಪಡೆದ ನರಮಂಡಲವನ್ನು ನಂತರ ಪ್ರತಿ ಫ್ರೇಮ್ ಅನ್ನು ಪರಿವರ್ತಿಸಲು ಬಳಸಲಾಗುತ್ತದೆ.

ಕೊನೆಯ ಹಂತವಾಗಿ ರೂಪಾಂತರಗೊಂಡ ಮುಖವನ್ನು ಮೂಲ ಚೌಕಟ್ಟಿನೊಂದಿಗೆ ವಿಲೀನಗೊಳಿಸಬೇಕು.

ಡೀಪ್ಫೇಕ್ ಪತ್ತೆ ಮಾದರಿಯನ್ನು ನಿರ್ಮಿಸುವುದು

GitHub Repo ಅನ್ನು ಆರೋಹಿಸುವುದು ಮತ್ತು ಕ್ಲೋನಿಂಗ್ ಮಾಡುವುದು

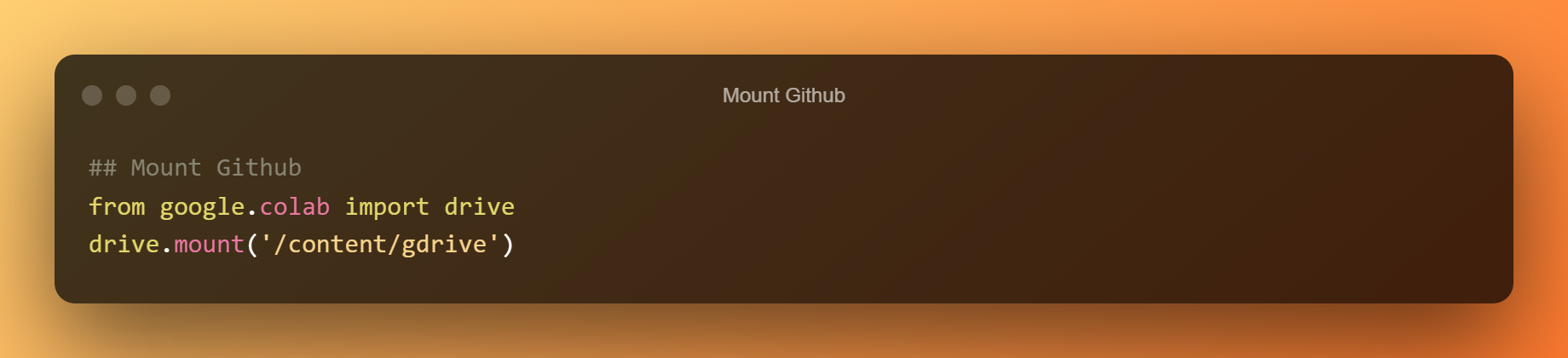

Colab ನಲ್ಲಿ ಕೆಲಸ ಮಾಡುವಾಗ Google ನ GPU ಗಳನ್ನು ಉಚಿತವಾಗಿ ಬಳಸಲು ಸಾಧ್ಯವಾಗುವುದು ಅನುಕೂಲಕರವಾಗಿದೆ ಆಳವಾದ ಕಲಿಕೆ. ಕ್ಲೌಡ್ ವರ್ಚುವಲ್ ಗಣಕದಲ್ಲಿ (VM) Google ಡ್ರೈವ್ ಅನ್ನು ಆರೋಹಿಸುವ ಸಾಮರ್ಥ್ಯವು ಹೆಚ್ಚುವರಿ ಪ್ರಯೋಜನವಾಗಿದೆ.

ಅವರ ಎಲ್ಲಾ ವಿಷಯಗಳಿಗೆ ಸುಲಭ ಪ್ರವೇಶದೊಂದಿಗೆ, ಬಳಕೆದಾರರು ಸಕ್ರಿಯಗೊಳಿಸಿದ್ದಾರೆ. ಕ್ಲೌಡ್ನಲ್ಲಿನ ವರ್ಚುವಲ್ ಯಂತ್ರಕ್ಕೆ Google ಡ್ರೈವ್ ಅನ್ನು ಆರೋಹಿಸಲು ಅಗತ್ಯವಿರುವ ಪ್ರೋಗ್ರಾಂ ಈ ವಿಭಾಗದಲ್ಲಿ ಕಂಡುಬರುತ್ತದೆ.

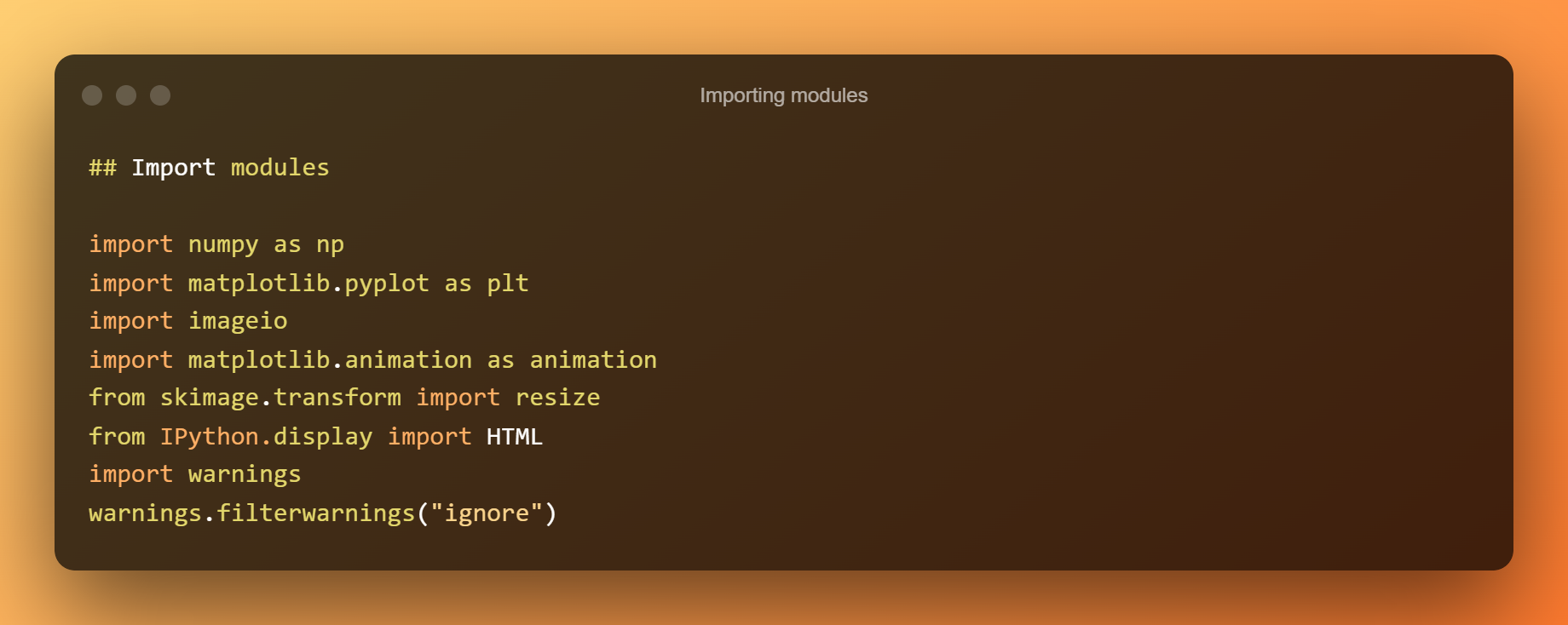

ಮಾಡ್ಯೂಲ್ಗಳನ್ನು ಆಮದು ಮಾಡಿಕೊಳ್ಳಲಾಗುತ್ತಿದೆ

ಈಗ, ನಾವು ಅಗತ್ಯವಿರುವ ಎಲ್ಲಾ ಮಾಡ್ಯೂಲ್ಗಳನ್ನು ಆಮದು ಮಾಡಿಕೊಳ್ಳುತ್ತೇವೆ.

ಮಾದರಿಯನ್ನು ಕಾರ್ಯಗತಗೊಳಿಸುವುದು

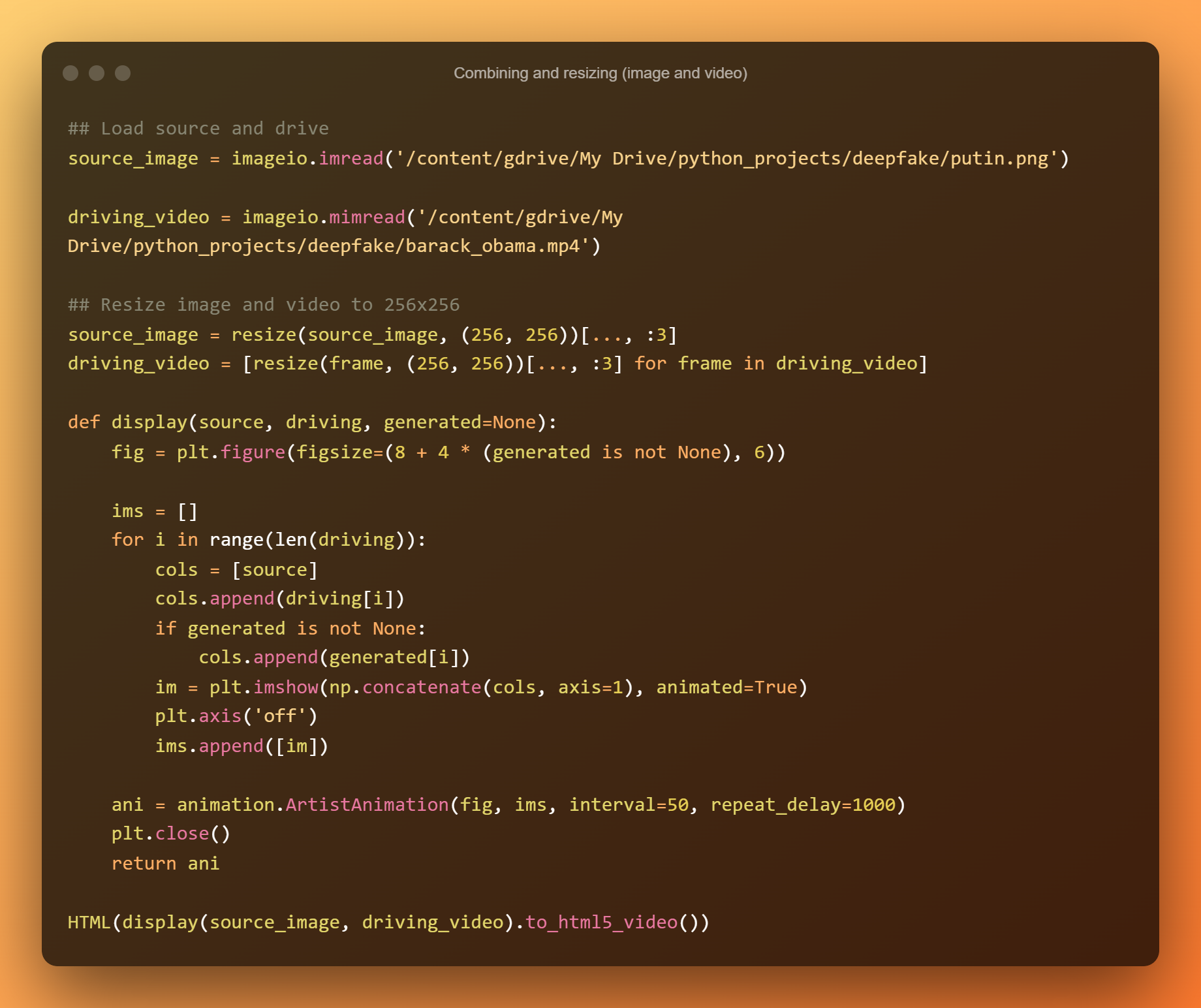

ಪುಟಿನ್ ಅವರ ಸ್ಟಿಲ್ ಫೋಟೋವನ್ನು (ಮೂಲ ಚಿತ್ರ) ಒಬಾಮಾ ಅವರ ವೀಡಿಯೊದೊಂದಿಗೆ ಸಂಯೋಜಿಸುವ ಉದಾಹರಣೆಯನ್ನು ನಾವು ಬಳಸುತ್ತೇವೆ. ಒಬಾಮಾ ಚಾಲನೆ ಮಾಡುವಾಗ ಬಳಸಿದ ಅದೇ ಮುಖದ ಅಭಿವ್ಯಕ್ತಿಗಳೊಂದಿಗೆ ಪುಟಿನ್ ಮಾತನಾಡುವ ಮತ್ತು ಸನ್ನೆ ಮಾಡುವ ವೀಡಿಯೊದ ಫಲಿತಾಂಶವಾಗಿದೆ.

ಮಾದರಿಯ ಫಲಿತಾಂಶವನ್ನು ಪ್ರದರ್ಶಿಸುವ ಮೊದಲು, ಮಾಧ್ಯಮವನ್ನು ಲೋಡ್ ಮಾಡಲಾಗುತ್ತದೆ ಮತ್ತು ಕಾರ್ಯಗಳನ್ನು ಘೋಷಿಸಲಾಗುತ್ತದೆ. ನಂತರ ಚೆಕ್ಪೋಸ್ಟ್ಗಳನ್ನು ಲೋಡ್ ಮಾಡಲಾಗುತ್ತದೆ ಮತ್ತು ಮಾದರಿಯನ್ನು ನಿರ್ಮಿಸಲಾಗುತ್ತದೆ. ಆಳವಾದ ನಕಲಿಯನ್ನು ರಚಿಸಿದ ನಂತರ, ಎರಡು ವಿಭಿನ್ನ ಶೈಲಿಯ ಅನಿಮೇಷನ್ ಅನ್ನು ಪ್ರದರ್ಶಿಸಲಾಗುತ್ತದೆ.

ಸಾಪೇಕ್ಷ ಕೀಪಾಯಿಂಟ್ ಸ್ಥಳಾಂತರವನ್ನು ಬಳಸಿಕೊಂಡು ಒಬಾಮಾ ಅವರ ಚಲನೆಗಳಿಂದ ಪುಟಿನ್ ಅನಿಮೇಟೆಡ್ ಆಗಿದ್ದಾರೆ. ಪುಟಿನ್ ಅವರ ವೀಡಿಯೊಗಳಲ್ಲಿ ಒಬಾಮಾ ಅವರ ಮುಖದ ಭಾವನೆಗಳು ಮತ್ತು ದೇಹ ಭಾಷೆಯನ್ನು ಸುಂದರವಾಗಿ ಮತ್ತು ಸ್ಪಷ್ಟವಾಗಿ ಚಿತ್ರಿಸಿದ ರೀತಿ ಬೆರಗುಗೊಳಿಸುತ್ತದೆ.

ಕೆಲವು ಸೂಕ್ಷ್ಮ ತಪ್ಪುಗಳಿವೆ, ವಿಶೇಷವಾಗಿ ಒಬಾಮಾ ತನ್ನ ಹುಬ್ಬುಗಳನ್ನು ಎತ್ತಿದಾಗ ಮತ್ತು ಅವನ ಕಣ್ಣುಗಳನ್ನು ಮಿಟುಕಿಸಿದಾಗ. ಈ ಅಭಿವ್ಯಕ್ತಿಗಳು ಪುಟಿನ್ ಅವರ ಚೌಕಟ್ಟುಗಳಲ್ಲಿ ನಿಖರವಾಗಿ ಪುನರಾವರ್ತಿಸಲ್ಪಟ್ಟಿಲ್ಲ.

ಡೀಪ್ಫೇಕ್ ಬ್ಯಾಕ್ಡ್ರಾಪ್ ಇಲ್ಲದೆ, ಪುಟಿನ್ ಚಲನಚಿತ್ರವನ್ನು ಟಿವಿಯಲ್ಲಿ ವೀಕ್ಷಿಸಿದರೆ ಸಾಕಷ್ಟು ನಂಬಲರ್ಹ ಮತ್ತು ಅಧಿಕೃತ ಎಂದು ತೋರುತ್ತದೆ. ಸಾಮಾಜಿಕ ಮಾಧ್ಯಮ.

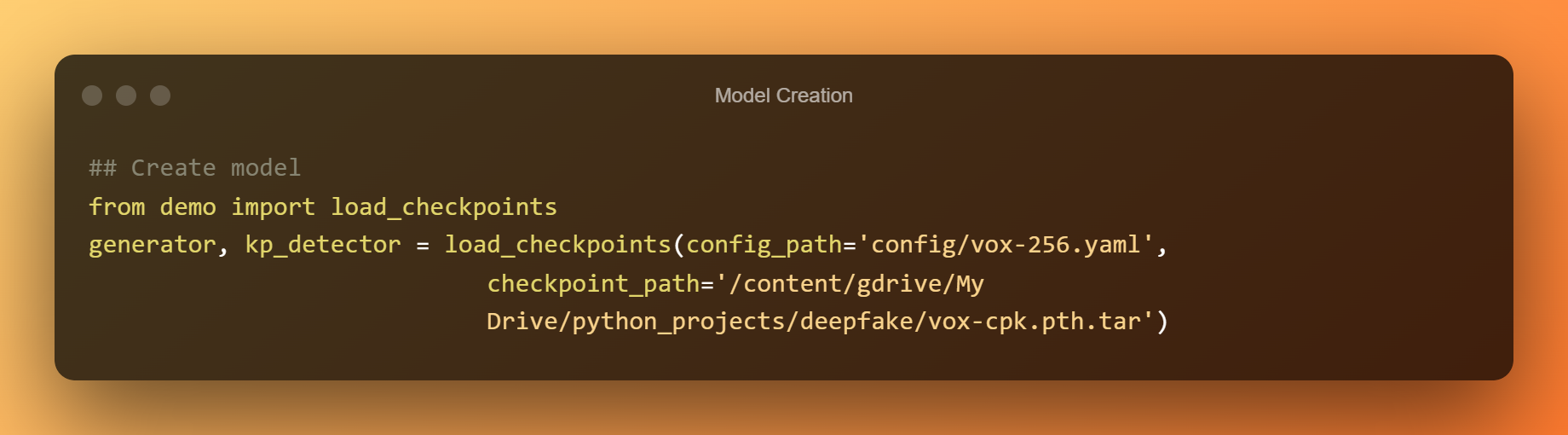

ಮಾದರಿ ಸೃಷ್ಟಿ

ಈಗ, ಸಂಪೂರ್ಣ ಮಾದರಿಯನ್ನು ರಚಿಸಲು ನಾವು ಪೂರ್ವ-ತರಬೇತಿ ಪಡೆದ ಚೆಕ್ಪೋಸ್ಟ್ಗಳನ್ನು ಬಳಸುತ್ತೇವೆ.

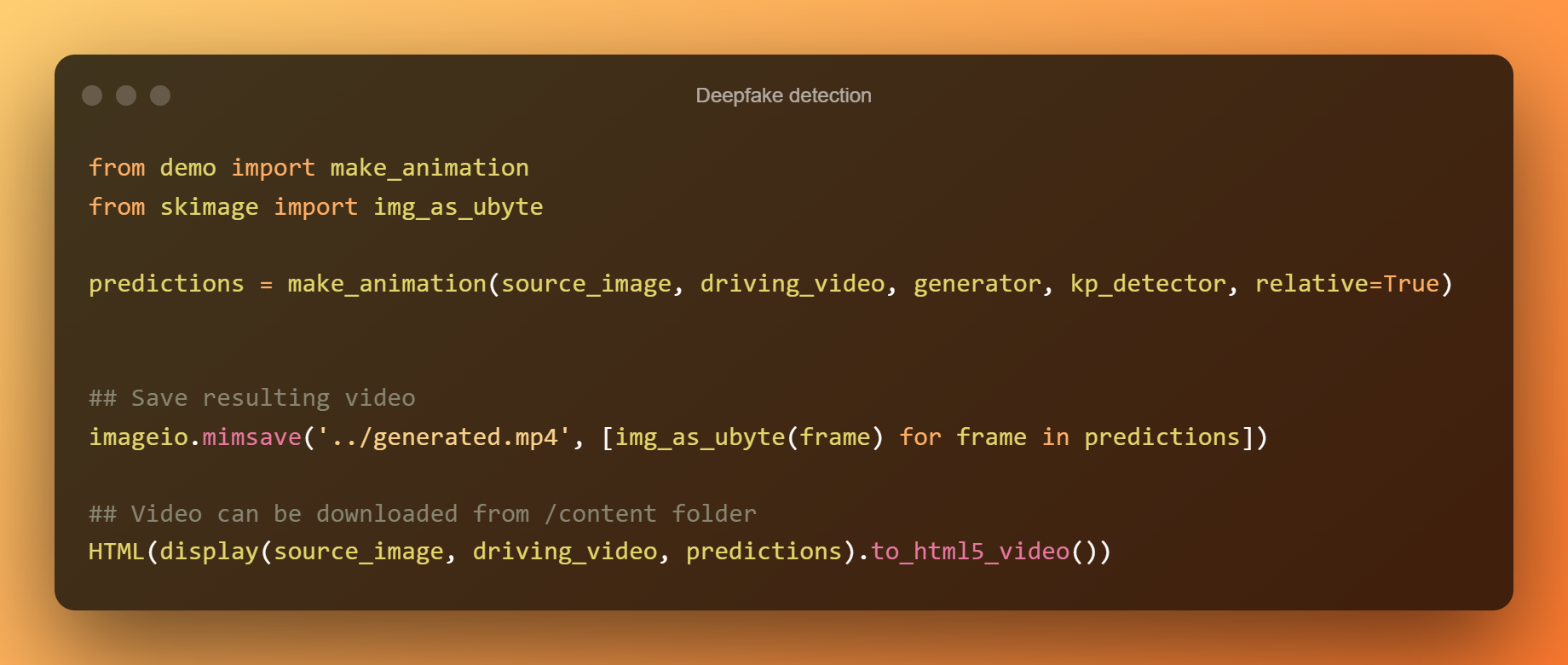

ಡೀಪ್ಫೇಕ್ ಪತ್ತೆ

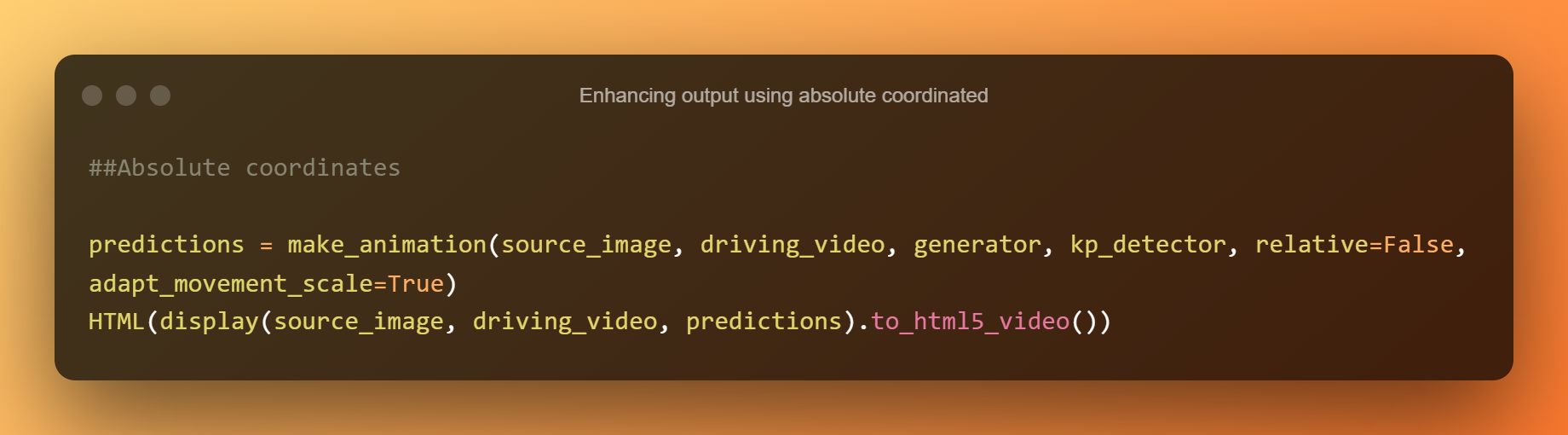

ಕೆಳಗಿನ ಕೋಶದಲ್ಲಿನ ಐಟಂಗಳನ್ನು ಅನಿಮೇಟ್ ಮಾಡಲು ಸಂಬಂಧಿತ ಕೀಪಾಯಿಂಟ್ ಸ್ಥಳಾಂತರವನ್ನು ಬಳಸಲಾಗುತ್ತದೆ. ಮುಂದಿನ ಸೆಲ್ ಬದಲಿಗೆ ಸಂಪೂರ್ಣ ನಿರ್ದೇಶಾಂಕಗಳನ್ನು ಬಳಸುತ್ತದೆ, ಆದರೆ ಎಲ್ಲಾ ಐಟಂ ಅನುಪಾತಗಳನ್ನು ಈ ಶೈಲಿಯಲ್ಲಿ ಡ್ರೈವಿಂಗ್ ವೀಡಿಯೊದಿಂದ ತೆಗೆದುಕೊಳ್ಳಲಾಗುತ್ತದೆ.

ಸಂಪೂರ್ಣ ನಿರ್ದೇಶಾಂಕಗಳನ್ನು ಬಳಸಿಕೊಂಡು ಔಟ್ಪುಟ್ ಅನ್ನು ಹೆಚ್ಚಿಸುವುದು

ಈ ರೀತಿಯಲ್ಲಿ ನೀವು ಡೀಪ್ಫೇಕ್ ಪತ್ತೆಯನ್ನು ಅಭಿವೃದ್ಧಿಪಡಿಸಲು ಸಾಧ್ಯವಾಗುತ್ತದೆ.

ಡೀಪ್ಫೇಕ್ ತಂತ್ರಜ್ಞಾನದ ಅಪಾಯಗಳೇನು?

ಡೀಪ್ಫೇಕ್ ವೀಡಿಯೋಗಳು ಈಗ ತಮ್ಮ ಹೊಸತನದಿಂದಾಗಿ ವೀಕ್ಷಿಸಲು ತೊಡಗಿವೆ ಮತ್ತು ಮನರಂಜನೆ ನೀಡುತ್ತಿವೆ. ಆದಾಗ್ಯೂ, ಈ ತೋರಿಕೆಯಲ್ಲಿ ತಮಾಷೆಯ ತಂತ್ರಜ್ಞಾನದ ಮೇಲ್ಮೈ ಕೆಳಗೆ ಇರುವ ನಿಯಂತ್ರಣದಿಂದ ಹೊರಗುಳಿಯುವ ಅಪಾಯವಿದೆ.

ನಕಲಿ ಮತ್ತು ನೈಜ ವೀಡಿಯೊಗಳ ನಡುವೆ ವ್ಯತ್ಯಾಸವನ್ನು ಕಂಡುಹಿಡಿಯುವುದು ಖಂಡಿತವಾಗಿಯೂ ಸವಾಲಿನ ಸಂಗತಿಯಾಗಿದೆ ಡೀಪ್ಫೇಕ್ ತಂತ್ರಜ್ಞಾನ ಮುನ್ನಡೆಯುತ್ತಲೇ ಇದೆ. ಪ್ರಮುಖ ವ್ಯಕ್ತಿಗಳು ಮತ್ತು ಸೆಲೆಬ್ರಿಟಿಗಳಿಗೆ, ನಿರ್ದಿಷ್ಟವಾಗಿ, ಇದು ತೀವ್ರ ಪರಿಣಾಮಗಳನ್ನು ಉಂಟುಮಾಡಬಹುದು. ಉದ್ದೇಶಪೂರ್ವಕವಾಗಿ ದುರುದ್ದೇಶಪೂರಿತವಾಗಿರುವ ಡೀಪ್ಫೇಕ್ಗಳು ವೃತ್ತಿ ಮತ್ತು ಜೀವನವನ್ನು ಸಂಪೂರ್ಣವಾಗಿ ಹಾನಿ ಮಾಡುವ ಸಾಮರ್ಥ್ಯವನ್ನು ಹೊಂದಿವೆ.

ಇತರರಿಗೆ ರವಾನಿಸಲು ಮತ್ತು ಅವರ ಸ್ನೇಹಿತರು, ಸಂಬಂಧಿಕರು ಮತ್ತು ಸಹೋದ್ಯೋಗಿಗಳ ಲಾಭವನ್ನು ಪಡೆಯಲು ದುರುದ್ದೇಶಪೂರಿತ ಉದ್ದೇಶದಿಂದ ಯಾರಾದರೂ ಇದನ್ನು ಬಳಸಬಹುದು. ಅವರು ವಿಶ್ವಾದ್ಯಂತ ವಿವಾದಗಳನ್ನು ಹುಟ್ಟುಹಾಕಲು ಸಮರ್ಥರಾಗಿದ್ದಾರೆ ಮತ್ತು ವಿದೇಶಿ ನಾಯಕರ ಫೋನಿ ಚಲನಚಿತ್ರಗಳನ್ನು ಬಳಸಿಕೊಂಡು ಯುದ್ಧಗಳನ್ನು ಸಹ ಮಾಡುತ್ತಾರೆ.

ತೀರ್ಮಾನ

ಸಂಕ್ಷಿಪ್ತವಾಗಿ ಹೇಳುವುದಾದರೆ, ನಾವು ವಿಲಕ್ಷಣ ಅವಧಿ ಮತ್ತು ಅಸಾಮಾನ್ಯ ವಾತಾವರಣದಲ್ಲಿದ್ದೇವೆ. ಹಿಂದೆಂದಿಗಿಂತಲೂ, ಸುಳ್ಳು ಸುದ್ದಿ ಮತ್ತು ಚಲನಚಿತ್ರಗಳನ್ನು ನಿರ್ಮಿಸುವುದು ಮತ್ತು ಅವುಗಳನ್ನು ಹರಡುವುದು ಸರಳವಾಗಿದೆ. ಯಾವುದು ಸತ್ಯ ಮತ್ತು ಯಾವುದು ಅಲ್ಲ ಎಂಬುದನ್ನು ಅರ್ಥಮಾಡಿಕೊಳ್ಳುವುದು ಹೆಚ್ಚು ಸವಾಲಾಗುತ್ತಿದೆ.

ಇಂದು, ನಾವು ಇನ್ನು ಮುಂದೆ ನಮ್ಮ ಸ್ವಂತ ಇಂದ್ರಿಯಗಳ ಮೇಲೆ ಅವಲಂಬಿತರಾಗಲು ಸಾಧ್ಯವಿಲ್ಲ ಎಂದು ತೋರುತ್ತದೆ.

ಸುಳ್ಳು ವೀಡಿಯೋ ಡಿಟೆಕ್ಟರ್ಗಳನ್ನು ಅಭಿವೃದ್ಧಿಪಡಿಸಲಾಗಿದೆ ಎಂಬ ವಾಸ್ತವದ ಹೊರತಾಗಿಯೂ, ಮಾಹಿತಿಯ ಅಂತರವು ತುಂಬಾ ಕಿರಿದಾಗುವ ಮೊದಲು ಇದು ಕೇವಲ ಸಮಯದ ವಿಷಯವಾಗಿದೆ, ಉತ್ತಮವಾದ ನಕಲಿ ಡಿಟೆಕ್ಟರ್ಗಳು ಸಹ ವೀಡಿಯೊ ನಿಜವೋ ಅಲ್ಲವೋ ಎಂದು ನಿರ್ಧರಿಸಲು ಸಾಧ್ಯವಾಗುವುದಿಲ್ಲ.

ಪ್ರತ್ಯುತ್ತರ ನೀಡಿ