自動運転車ではセンサーとソフトウェアが組み合わされて、オートバイ、自動車、トラック、ドローンなどのさまざまな車両をナビゲート、操縦、操作します。

それらがどのように開発または設計されたかによって、ドライバーの支援が必要な場合と必要でない場合があります。

完全自動運転車は、人間のドライバーがいなくても安全に運行できます。 いくつかのように Googleのウェイモ 自動車には、ハンドルさえありませんでした。

などの部分的に自動化された車両 テスラ、車両を完全に制御できますが、システムが疑わしい場合は、人間のドライバーが支援する必要がある場合があります。

これらの自動車には、車線誘導やブレーキの補助から、完全に独立した自動運転のプロトタイプまで、さまざまな程度の自動化が組み込まれています。

自動運転車の目標は、交通量、排気ガス、事故率を下げることです。

これが可能なのは、自動運転車が人間よりも交通規制を順守することに長けているからです。

スムーズなドライブには、車や近くにある物体の位置、目的地までの最短かつ安全な経路、駆動システムを操作する能力など、特定の情報が必要です。

必要なタスクをいつ、どのように実行するかを理解することが重要です。

この記事では、 システムアーキテクチャー 自動運転車、必要なコンポーネント、および車両アドホック ネットワーク (VANET) 向け。

自動運転車に必要な必須コンポーネント

今日の自動運転車は、カメラ、GPS、慣性計測装置 (IMU)、ソナー、レーザー照射の検出と範囲 (ライダー)、無線検出と測距 (レーダー)、音声ナビゲーションと測距 (ソナー) など、さまざまなセンサーを採用しています。 3D マップ。

これらのセンサーとテクノロジーを組み合わせてリアルタイムでデータを分析し、ステアリング、アクセル、ブレーキを制御します。

レーダーセンサーは、周囲の車の所在を追跡するのに役立ちます。 駐車中の車両は超音波センサーで支援されます。

ライダーとして知られる技術は、両方のタイプのセンサーを使用して作成されました。 自動車の周囲の環境から光パルスを反射することにより、ライダー センサーは道路の境界を検出し、車線マーカーを識別できます。

これらはまた、他の車両、歩行者、自転車などの隣接する障害物をドライバーに警告します。

車の周囲のすべてのものの大きさと距離は、ライダー技術を使用して測定されます。これにより、車両が周囲を表示してリスクを特定できるようにする 3D マップも作成されます。

XNUMX 日の時間帯に関係なく、明るいか暗いかに関係なく、さまざまな種類の環境光で情報を記録する優れた仕事をします。

自動車は、カメラ、レーダー、GPS アンテナをライダーやカメラと共に使用して、周囲を検出し、位置を特定します。

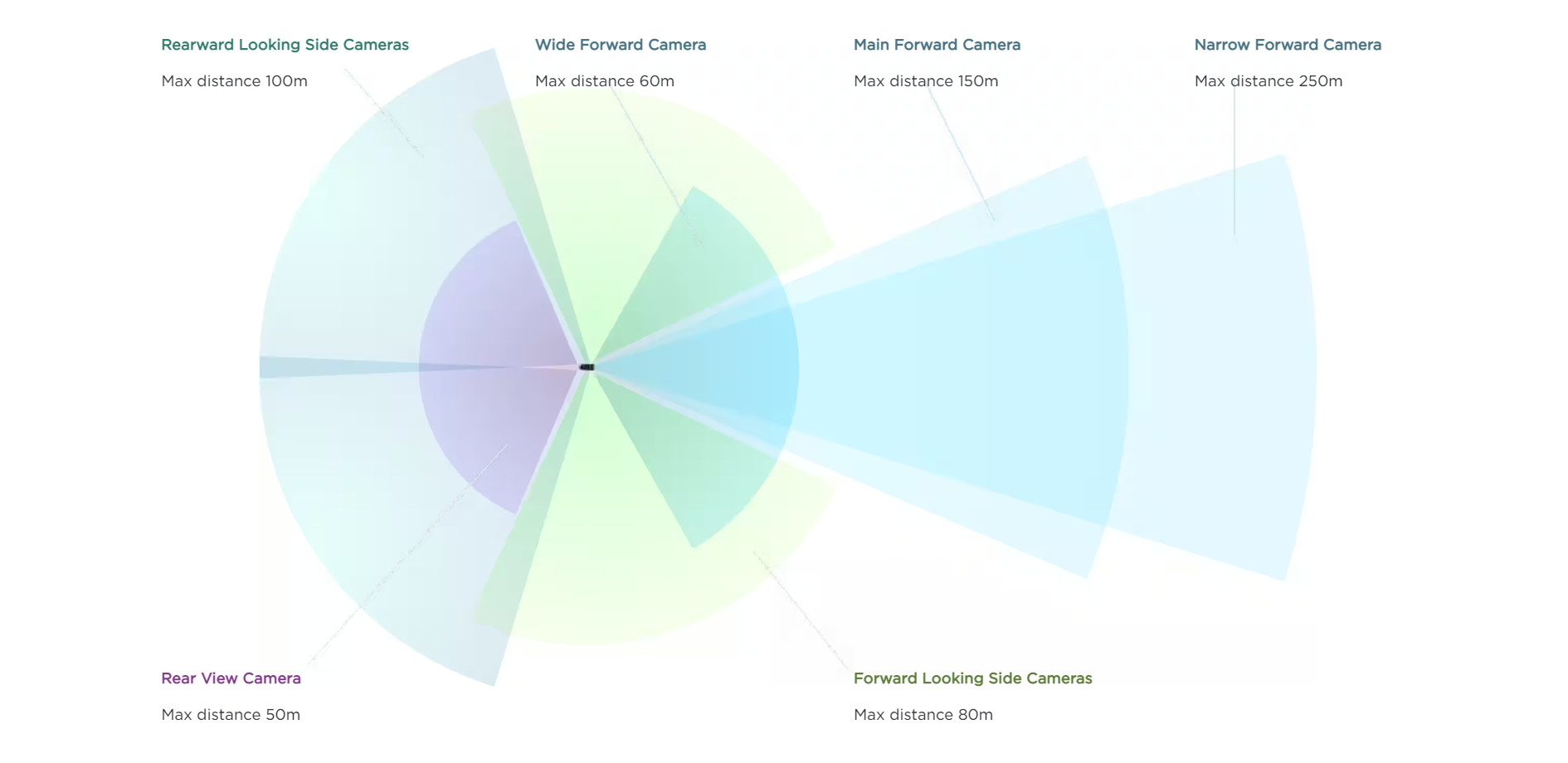

カメラは、歩行者、自転車、自動車、その他の障害物をチェックすると同時に、交通信号を検出し、道路標識やマーキングを読み取り、他の車両を追跡します。

ただし、薄暗い場所や暗い場所では苦労する可能性があります。 自律走行車は、ライダー、レーダー、カメラ、GPS アンテナ、超音波センサーを組み合わせて使用し、前方の道路をデジタルでマッピングすることで、どこに向かっているのかを確認できます。

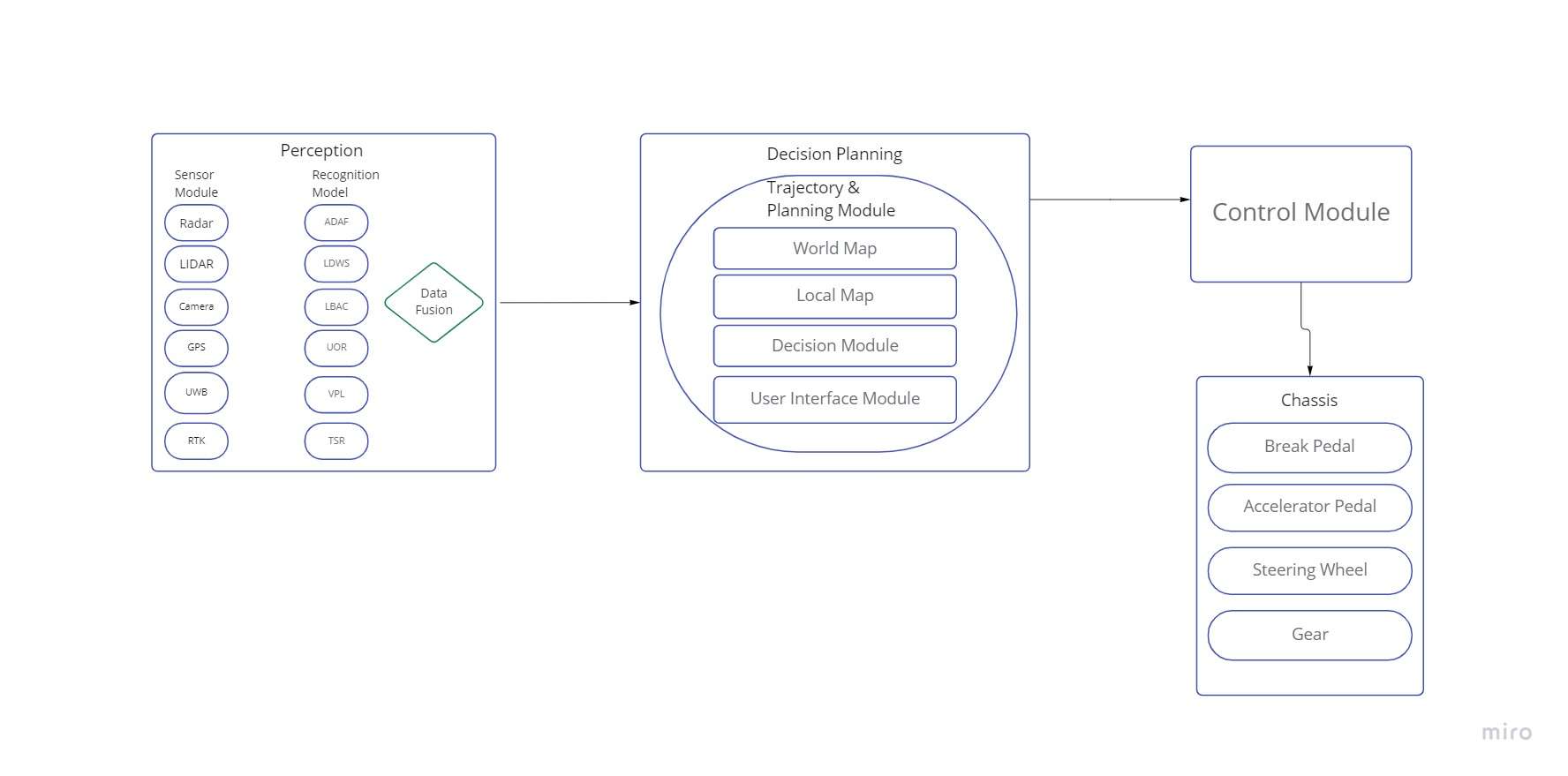

高レベルのシステム アーキテクチャ

必須のセンサー、アクチュエーター、ハードウェア、およびソフトウェアがアーキテクチャーにリストされており、AV の通信メカニズムまたはプロトコル全体も示されています。

知覚

この段階では、環境に対する AV の位置を特定し、さまざまなセンサーを使用して AV の周囲の環境を感知します。

AV は、このステップで RADAR、LIDAR、カメラ、リアルタイム キネティック (RTK)、およびその他のセンサーを使用します。 認識モジュールは、これらのセンサーからデータを受け取り、それを渡した後に処理します。

一般に、AV は、制御システム、LDWS、TSR、未知の障害物認識 (UOR)、車両位置推定 (VPL) モジュールなどで構成されます。

結合された情報は、処理された後、意思決定と計画の段階に渡されます。

意思決定と計画

AV の動きと動作は、知覚プロセス中に受け取った情報を使用して、このステップで決定、計画、および制御されます。

脳が表すこの段階では、経路計画、行動予測、障害物回避などの選択が行われます。

選択は、リアルタイムの地図データ、トラフィックの詳細、傾向、ユーザー情報など、現在および過去にアクセスできる情報に基づいています。

後で使用するために間違いやデータを追跡するデータ ログ モジュールが存在する可能性があります。

管理

制御モジュールは、決定および計画モジュールから情報を受け取った後、ステアリング、ブレーキ、加速など、AV の物理的な制御に関連する操作/アクションを実行します。

シャーシ

最後のステップでは、ギア モーター、ステアリング ホイール モーター、ブレーキ ペダル モーター、アクセルとブレーキ用のペダル モーターなど、シャシーに取り付けられた機械部品とのやり取りが行われます。

制御モジュールは、これらすべてのコンポーネントに信号を送って管理します。

ここでは、さまざまなキー センサーの設計、操作、および使用について説明する前に、AV の一般的な通信について説明します。

レーダー

AV では、レーダーを使用して環境をスキャンし、自動車やその他の物体を見つけて位置を特定します。

レーダーは、空港や気象システムなど、軍事目的と民間目的の両方で使用されることが多く、ミリ波 (mm-Wave) スペクトルで動作します。

現代の自動車では、24、60、77、および 79 GHz を含むさまざまな周波数帯域が使用されており、測定範囲は 5 ~ 200 m [10] です。

送信された信号と戻ってきたエコーとの間の ToF を計算することにより、AV と対象物との間の距離が決定されます。

AV では、レーダーは一連のマイクロ アンテナを使用してローブのコレクションを作成し、距離分解能と複数のターゲットの識別を強化します。 ミリ波レーダーは、透過性が高く帯域幅が広いため、ドップラーシフトの分散を利用して、あらゆる方向の近距離物体を正確に評価できます。

ミリ波レーダーは波長が長いため、雨、雪、霧、暗い場所でも機能するアンチブロッキング機能とアンチポリューション機能を備えています。

さらに、ドップラー シフトを使用して、ミリ波レーダーを介して相対速度を計算できます。 ミリ波レーダーは、その機能により、障害物検出、歩行者および車両認識など、幅広い AV アプリケーションに適しています。

超音波センサー

これらのセンサーは 20 ~ 40 kHz の範囲で動作し、超音波を使用します。 物体の距離を測定するために使用される磁気抵抗膜は、これらの波を生成します。

放出された波からエコー信号までの飛行時間 (ToF) を計算することにより、距離が決定されます。 超音波センサーの一般的な範囲は 3 メートル未満です。

センサー出力は 20 ミリ秒ごとに更新されるため、ITS の厳格な QoS 要件に準拠できません。 これらのセンサーは、ビーム検出範囲が比較的狭く、指向性があります。

したがって、全視野の視野を得るには、多数のセンサーが必要です。 ただし、多くのセンサーが相互に作用し、範囲が大幅に不正確になる可能性があります。

LiDAR

LiDAR では 905 nm と 1550 nm のスペクトルが使用されます。 人間の目は 905 nm の範囲から網膜の損傷を受けやすいため、現在の LiDAR は 1550 nm 帯域で動作し、網膜の損傷を軽減します。

最大 200 メートルが LiDAR の最大動作範囲です。 ソリッドステート、2D、および 3D LiDAR は、LiDAR の異なるサブカテゴリです。

単一のレーザー ビームは、2D LiDAR で急速に回転するミラー上に分散されます。 ポッドに複数のレーザーを配置することで、3D LiDAR は周囲の 3D 画像を取得できます。

道路脇の LiDAR システムは、交差するゾーンと交差しないゾーンの両方で、車両対歩行者 (V2P) の衝突の数を減らすことが実証されています。

16 ライン、リアルタイム、計算効率の高い LiDAR システムを採用しています。

ディープ オート エンコーダー アーティフィシャルを使用することをお勧めします ニューラルネットワーク (DA-ANN)、95 m の範囲で 30% の精度を達成します。

では、サポート ベクター マシン (SVM) ベースのアルゴリズムと 64 ラインの 3D LiDAR を組み合わせて歩行者認識を強化する方法が示されています。

LiDAR は、ミリ波レーダーよりも優れた測定精度と 3D ビジョンを備えていますが、霧、雪、雨などの悪天候ではうまく機能しません。

カメラ

デバイスの波長に応じて、AV のカメラは赤外線ベースまたは可視光ベースのいずれかになります。

カメラ (CMOS) には、電荷結合素子 (CCD) および相補型金属酸化膜半導体 (CMOS) イメージ センサーが使用されています。

レンズの品質にもよりますが、カメラの最大範囲は約 250 m です。 可視カメラで使用される 400 つの帯域 (赤、緑、青) は、人間の目と同じ波長、つまり 780 ~ XNUMX nm (RGB) で区切られています。

XNUMX 台の VIS カメラが確立された焦点距離と結合されて、深度 (D) 情報を含む新しいチャネルが作成され、立体視の作成が可能になります。

この機能により、カメラ (RGB-D) を介して車両周辺の 3D ビューを取得できます。

赤外線 (IR) カメラでは、波長が 780 nm ~ 1 mm のパッシブ センサーが使用されます。 ピーク照度では、AV の IR センサーが視覚的な制御を提供します。

このカメラは、オブジェクト認識、サイド ビュー コントロール、事故記録、および BSD により AV を支援します。 ただし、雪、霧、光の状態の変化などの悪天候では、カメラの性能が変化します。

カメラの主な利点は、環境のテクスチャ、色分布、形状を正確に収集して記録できることです。

全地球航法衛星システムおよび全地球測位システム、慣性計測ユニット

この技術は、正確な位置を特定することで、AV のナビゲートを支援します。 地球の表面を周回する軌道上の衛星群は、GNSS によってローカライズに使用されます。

システムは、AV の位置、速度、正確な時間に関するデータを保存します。

これは、受信した信号と衛星の放射の間の ToF を計算することによって機能します。 全地球測位システム (GPS) 座標は、多くの場合、AV 位置を取得するために使用されます。

GPS で抽出された座標は常に正確であるとは限らず、通常、平均値 3 m、標準偏差 1 m の位置誤差が追加されます。

大都市の状況では、パフォーマンスはさらに低下し、位置の誤差は最大 20 m になり、特定の厳しい状況では、GPS 位置誤差は約 100 m になります。

さらに、AV は RTK システムを使用して車両の位置を正確に特定できます。

AV では、車両の位置と方向は、推測航法 (DR) と慣性位置を使用して決定することもできます。

センサーフュージョン

適切な車両管理と安全のために、AV は位置、状態、および重量、安定性、速度などの他の車両要因に関する正確なリアルタイムの知識を取得する必要があります。

この情報は、さまざまなセンサーを利用して AV によって収集する必要があります。

複数のセンサーから取得したデータを統合することにより、センサーフュージョン技術を利用して一貫した情報を生成します。

この方法により、補完的なソースから取得した未処理のデータを合成することができます。

その結果、センサーフュージョンにより、さまざまなセンサーから収集されたすべての有用なデータを統合することで、AV が周囲を正確に把握できるようになります。

カルマン フィルターやベイジアン フィルターなど、さまざまな種類のアルゴリズムを使用して、AV で融合プロセスを実行します。

レーダー追跡、衛星ナビゲーション システム、光学走行距離測定などのいくつかのアプリケーションで使用されるため、カルマン フィルターは、車両が自律的に動作するために不可欠であると見なされています。

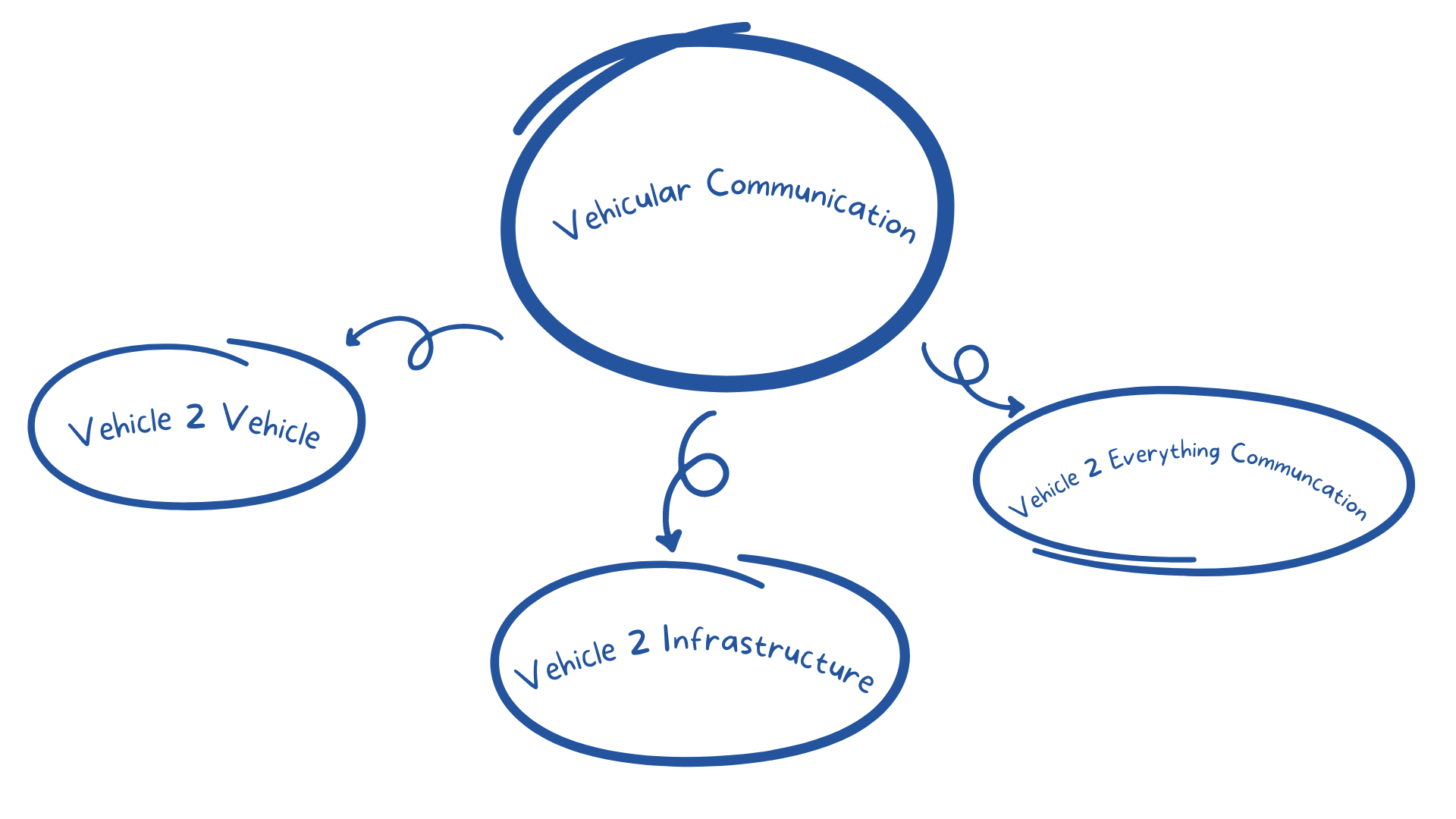

車両アドホック ネットワーク (VANET)

VANET は、モバイル デバイス/車両のネットワークを自発的に作成できるモバイル アドホック ネットワークの新しいサブクラスです。 VANETにより車車間(V2V)、車車間(V2I)通信が可能です。

このような技術の主な目的は、交通安全を高めることです。 たとえば、事故や交通渋滞などの危険な状況では、車同士やネットワークとやり取りして重要な情報を中継できます。

以下は、VANET テクノロジーの主要コンポーネントです。

- OBU (オンボード ユニット): 各車両に配置された GPS ベースの追跡システムであり、車両同士や路側ユニット (RSU) との対話を可能にします。 OBU には、リソース コマンド プロセッサ (RCP)、センサー デバイス、および ユーザーインターフェース、重要な情報を取得します。 その主な目的は、無線ネットワークを使用して複数の RSU と OBU の間で通信することです。

- Roadside Unit (RSU): RSU は、道路、駐車場、ジャンクションの正確な位置に配置された固定コンピューター ユニットです。 その主な目的は、自動運転車をインフラストラクチャにリンクすることであり、車両のローカリゼーションにも役立ちます。 さらに、さまざまな機能を利用して車両を他の RSU にリンクするために利用できます。 ネットワーク トポロジ. さらに、それらは太陽光発電を含む周囲のエネルギー源で実行されています。

- Trusted Authority (TA): VANETs プロセスのすべてのステップを管理する機関であり、正当な RSU と車両 OBU のみが登録および対話できるようにします。 車載器IDを確認し、車両を認証することで安心を提供します。 さらに、有害な通信や異常な動作を検出します。

VANET は、V2V、V2I、および V2X 通信を含む車両通信に使用されます。

車両 2 車両通信

自動車が相互に通信し、交通渋滞、事故、速度制限に関する重要な情報を交換する機能は、車車間通信 (IVC) として知られています。

V2V 通信は、部分的または完全なメッシュ トポロジを使用してさまざまなノード (車両) を結合することにより、ネットワークを作成できます。

それらは、車車間通信に使用されるホップ数に応じて、シングルホップ (SIVC) システムまたはマルチホップ (MIVC) システムに分類されます。

MIVC はトラフィック監視などの長距離通信に利用できますが、SIVC は車線合流、ACC などの短距離アプリケーションに使用できます。

BSD、FCWS、自動緊急ブレーキ (AEB)、および LDWS を含む多くの利点が、V2V 通信によって提供されます。

車両 2 インフラ通信

自動車は、路側車間通信 (RVC) として知られるプロセスを通じて RSU と通信できます。 パーキング メーター、カメラ、レーン マーカー、信号機の検出に役立ちます。

車とインフラストラクチャ間のアドホック、ワイヤレス、および双方向接続。

トラフィックの管理と監視には、インフラストラクチャのデータが使用されます。 それらは、車が燃費を最大化し、交通の流れを管理できるようにするさまざまな速度パラメーターを調整するために利用されます。

RVC システムは、インフラストラクチャに応じてスパース RVC (SRVC) とユビキタス RVC (URVC) に分けることができます。

SRVC システムは、オープン パーキング スペースやガソリン スタンドの検索など、ホットスポットでのみ通信サービスを提供しますが、URVC システムは高速でもルート全体をカバーします。

ネットワークのカバレッジを保証するために、URVC システムには多額の投資が必要です。

車両 2 すべて コミュニケーション

車は、歩行者、路傍の物体、デバイス、グリッド (V2P、V2R、V2D) (V2G) など、V2X を介して他のエンティティと接続できます。

この種のコミュニケーションを使用することで、ドライバーは危険にさらされている歩行者、自転車、オートバイのライダーとの衝突を避けることができます。

歩行者衝突警告 (PCW) システムは、V2X 通信により壊滅的な衝突が発生する前に、道端の乗客のドライバーに警告することができます。

歩行者に重要なメッセージを送信するために、PCW はスマートフォンの Bluetooth または近距離無線通信 (NFC) を利用できます。

まとめ

自動運転車の構築に利用される多くの技術は、その運用方法に大きな影響を与える可能性があります。

最も基本的なことは、車は一連のセンサーを使用して周囲の地図を作成し、車の周りのルートとその経路内の他の車に関する情報を提供します。

このデータは複雑な機械学習システムによって分析され、車が実行する一連のアクションが生成されます。 これらの動作は、システムが車両の周囲についてさらに学習するにつれて、定期的に変更および更新されます。

自動運転車のシステム アーキテクチャの概要を説明するために最善を尽くしましたが、舞台裏ではさらに多くのことが行われています。

皆様がこの知識を有意義に活用してくださることを心から願っています。

コメントを残す