クラウド GPU は、ディープ ラーニング、AI、機械学習などの新しいテクノロジーが出現するにつれて、大きな需要があります。

GPU (グラフィックス プロセッシング ユニット) は、コンピュータ グラフィックスやゲームなどのアクティビティに必要な膨大なデータ セットと複雑な計算を処理するために作られた特殊なプロセッサです。 それらは現在、の分野にとって重要です 人工知能 (AI)も同様ですが、最近では。

従来の CPU (中央処理装置) は、AI モデルをトレーニングして実行するために大量の計算能力を必要とするため、需要を満たすことができません。

一方、GPU は並列処理をサポートするように構築されているため、AI 操作に必要な大量のデータと複雑な計算をより効果的に管理できます。

技術者なら、クラウド GPU サービスについて聞いたことがあるはずです。 フォローしてくれない方へ。

ユーザーに強力な GPU リソースへのオンライン アクセスを提供するクラウドベースのサービスは、AI 用クラウド GPU サービスとして知られています。 これらのサービスにより、お客様は GPU ハードウェアを購入して維持する必要がなくなり、必要に応じて GPU リソースをレンタルできます。

これにより、人々や組織は、多額の初期投資や継続的な維持費を支払うことなく、GPU の処理能力を利用できるようになります。

AI 向けのクラウド GPU サービスの大半は、複数のモデルと構成、および必要に応じてスケールアップまたはスケールダウンできる柔軟性など、さまざまな GPU オプションを提供します。 このサービスのおかげで、独自の要件とプロジェクトに最適な GPU リソースを選択できるようになりました。

さらに、サービスには、顧客の AI プロジェクトを支援するネットワーク、ストレージ、ソフトウェア ツールなどの他の機能が付属していることがよくあります。 この投稿では、AI 向けのトップ クラウド GPU サービスを見ていきます。

1. Linodeの

Linode は、ビデオ処理、科学計算、 機械学習、人工知能など。

NVIDIA Quadro RTX 6000、Tensor、および RT コアで実行される GPU に最適化された仮想マシン (VM) を提供し、CUDA 機能を使用して実行します。 深い学習、レイ トレーシング ワークロード、および複雑な計算。

設備投資を運用費用に変えることで、Linode GPU の GPU 機能とクラウドの真の価値を活用できます。

さらに、Linode を使用すると、ハードウェアについて心配する必要がなくなり、最強のスキルに集中できます。

Linode GPU を使用すると、ビデオ ストリーミング、人工知能、機械学習などの高度なアプリケーションに使用できるようになりました。

さらに、予想されるワークロードに必要な処理能力に応じて、インスタンスごとに最大 4 枚のカードを受け取ることができます。

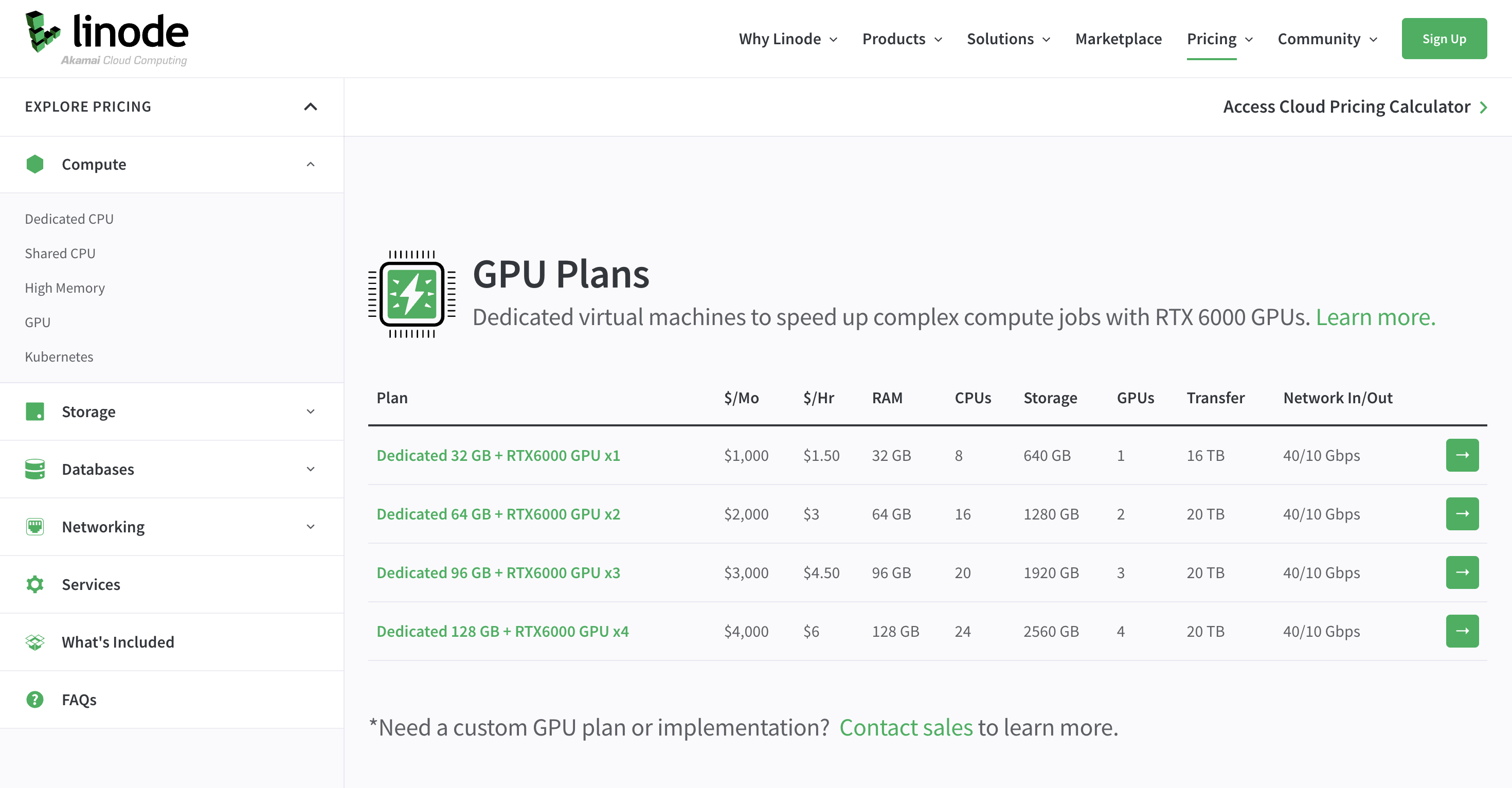

価格(英語)

専用の RTX1.5 GPU プランの料金は、6000 時間あたり XNUMX ドルからです。 Linode を無料で始めましょう。

2. 広大なAI

Vast AI は、高性能コンピューティングで使用する安価な GPU をユーザーがレンタルできるグローバル マーケットプレイスです。

ホストがGPUハードウェアをリースできるようにすることで、計算量の多いタスクのコストを削減し、ユーザーがオンライン検索ツールを利用して、ニーズに応じて計算の最も安い価格を見つけ、コマンドを実行したり、SSH接続を開始したりできるようにします.

SSH インスタンス、Jupyter GUI を備えた Jupyter インスタンス、またはコマンドのみのインスタンスを提供し、簡単な機能を備えています。 ユーザーインターフェース.

推定される深層学習タスクのパフォーマンスを予測する深層学習パフォーマンス関数 (DLPerf) も提供されます。

Vast AI で使用されるシステムは Ubuntu ベースであり、リモート デスクトップは提供されません。 また、ホストが設定した特定の料金でオンデマンドで利用できるインスタンスも運用します。

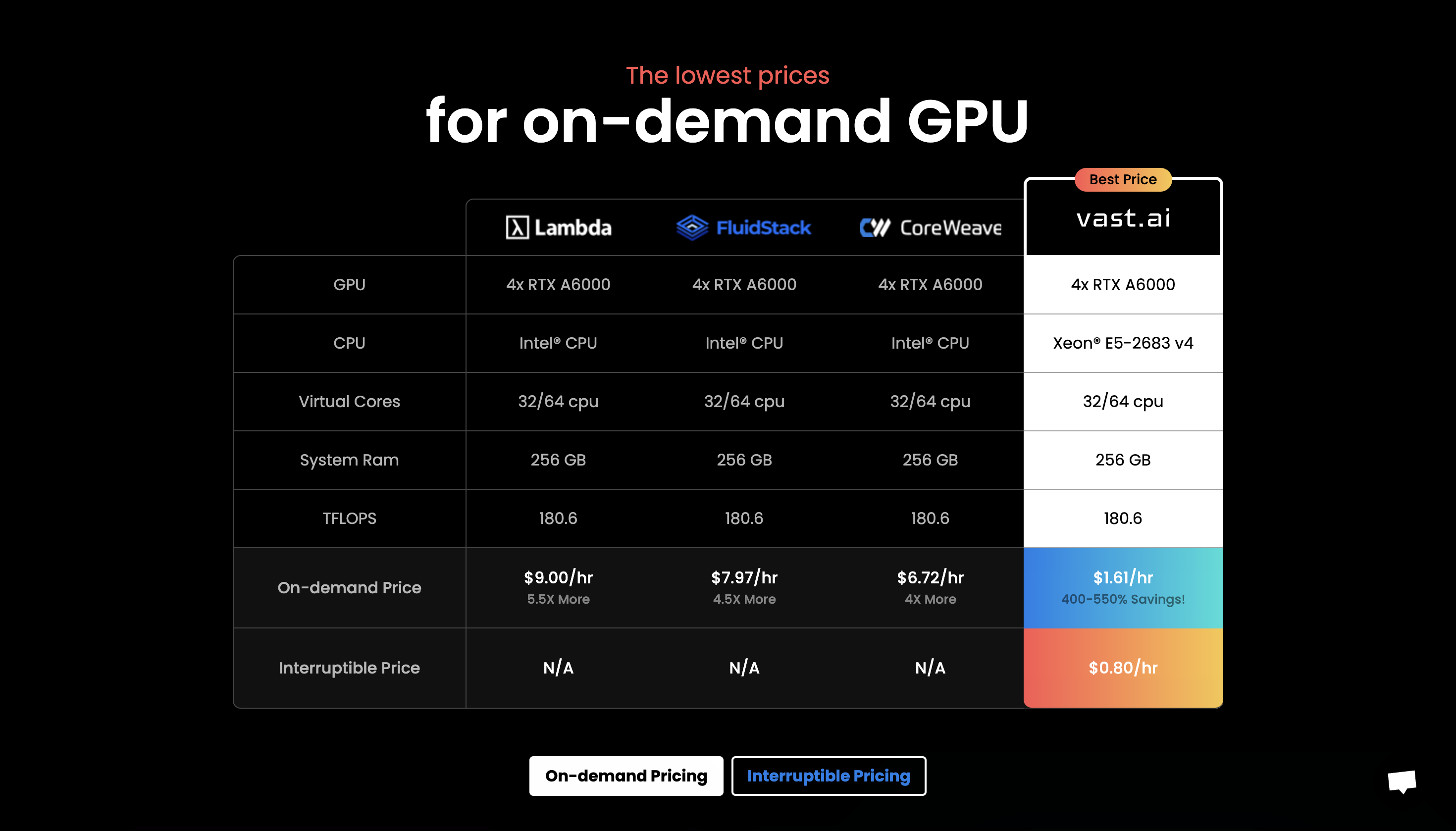

価格(英語)

価格は、0.80x RTX A4 で 6000 時間あたり $XNUMX からです。

3. AWS & NVIDIA

AWS と NVIDIA は協力して、手頃な価格で適応性が高く強力な GPU ベースのソリューションを一貫して提供しています。

これには、NVIDIA GPU を搭載した Amazon EC2 インスタンスと、NVIDIA Jetson Nano モジュールと共にインストールされる AWS IoT Greengrass などのサービスが含まれます。

仮想ワークステーション、機械学習 (ML)、モノのインターネット (IoT) サービス、ハイパフォーマンス コンピューティングの場合、ユーザーは AWS と NVIDIA を使用します。 スケーラブルなパフォーマンスは、Amazon EC2 インスタンスを強化する NVIDIA GPU によって提供されます。

さらに、AWS IoT Greengrass を利用して、NVIDIA ベースのエッジ デバイスを AWS クラウド サービスに接続します。

Amazon EC2 P4d インスタンスは、NVIDIA A100 Tensor コア GPU を搭載しており、業界で最も低いレイテンシーのネットワークと最高のスループットを提供します。

これと同様に、Amazon EC2 P3、Amazon EC2 G4 など、特定の状況で使用できる他の異なるインスタンスがあります。

価格(英語)

無料試用版を申し込むことができます。価格についてはベンダーにお問い合わせください。

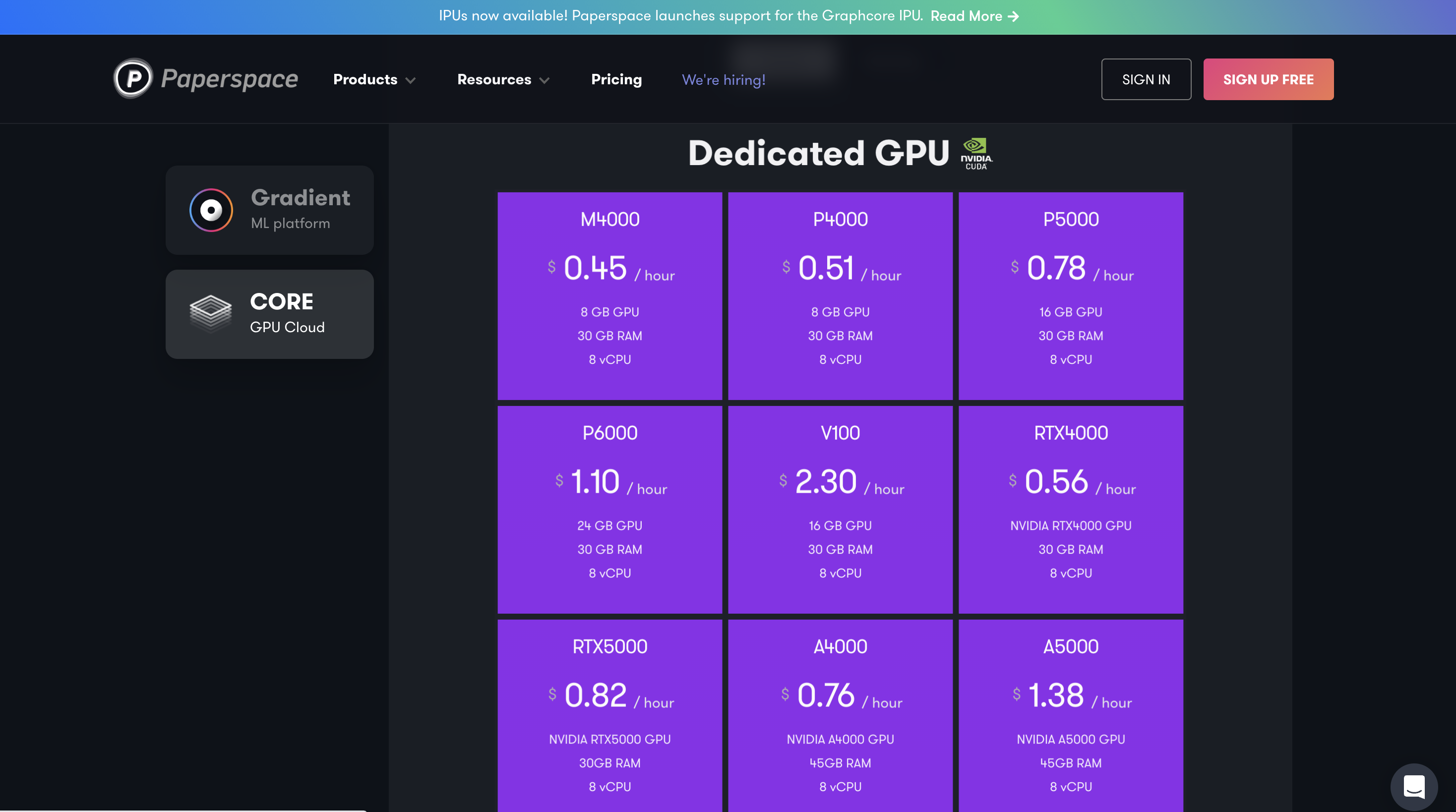

4. ペーパースペース コア

A CORE は、Paperspace によって作成された完全マネージド型のクラウド GPU プラットフォームであり、さまざまなアプリケーションに簡単で費用対効果が高く、高速なコンピューティングを提供します。

Paperspace CORE が提供する最先端のアクセラレーテッド コンピューティング インフラストラクチャを利用して、組織のプロセスを高速化します。 Mac、Linux、および Windows 用の迅速なオンボーディング、コラボレーション ツール、およびデスクトップ アプリケーションのために、ユーザー フレンドリーで複雑でないインターフェイスを提供します。

これを使用して、要求の厳しいプログラムを無限の処理能力で実行します。 CORE は、超高速ネットワーク、迅速なプロビジョニング、3D アプリのサポート、およびプログラムによるアクセスのための完全な API を提供します。

使いやすく直感的な GUI を使用して、インフラストラクチャの全体像を XNUMX か所で把握できます。

さらに、強力なツールを提供し、マシン、ネットワーク、およびユーザーのフィルタリング、並べ替え、接続、または作成を可能にする CORE の管理インターフェイスのおかげで、優れた制御を得ることができます。

価格(英語)

専用の M0.45 GPU の料金は、4000 時間あたり XNUMX ドルからです。

5. アリババ エラスティック GPU サービス

Alibaba Elastic GPU Service (EGS) は、GPU テクノロジを活用して、並列で強力な処理機能を提供します。 ビデオ処理、視覚化、科学計算、深層学習など、多くのアプリケーションがそれに適しています。

EGS は、AMD FirePro S7150、NVIDIA Tesla M40、NVIDIA Tesla V100、NVIDIA Tesla P4、NVIDIA Tesla P100 など、多数の GPU を利用しています。

オンラインを含む利点にアクセスできます ディープ ラーニングの推論サービスとトレーニング、コンテンツ識別、画像および音声認識、HD メディア コーディング、ビデオ会議、ソース フィルムの復元、4K/8K HD ライブ。

ビデオ レンダリング、計算金融、気候予測、衝突シミュレーション、遺伝子工学、非線形編集、遠隔教育アプリケーション、工学設計などの代替手段も入手してください。

価格(英語)

無料試用版と従量課金制のサブスクリプション プランが用意されているため、使用するインスタンスまたは GPU のみを使用できます。

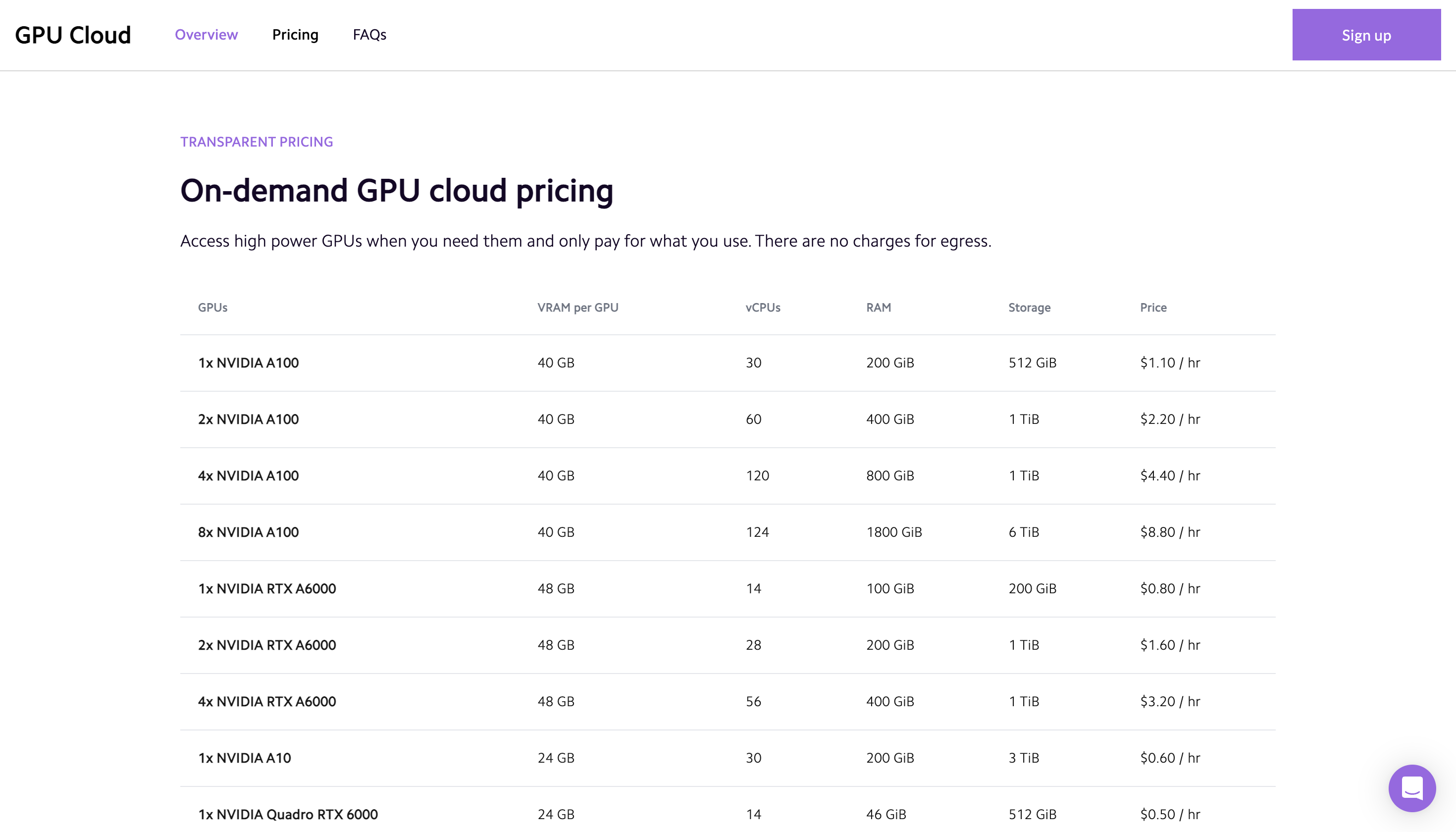

6. ジェネシスクラウド

Genesis Cloud は、費用対効果の高いクラウド GPU プラットフォームを提供します。 彼らは、世界中のいくつかの効果的なデータセンターと協力して、さまざまなアプリケーションを提供しています.

Genesis Cloud は、作業をバックアップするためのスナップショット、ネットワーク トラフィック用のセキュリティ グループ、大規模なデータ セット用のストレージ ボリューム、FastAI、PyTorch、プリセット画像、パブリック TensorFlow API など、幅広い便利な機能を追加料金なしで提供します。

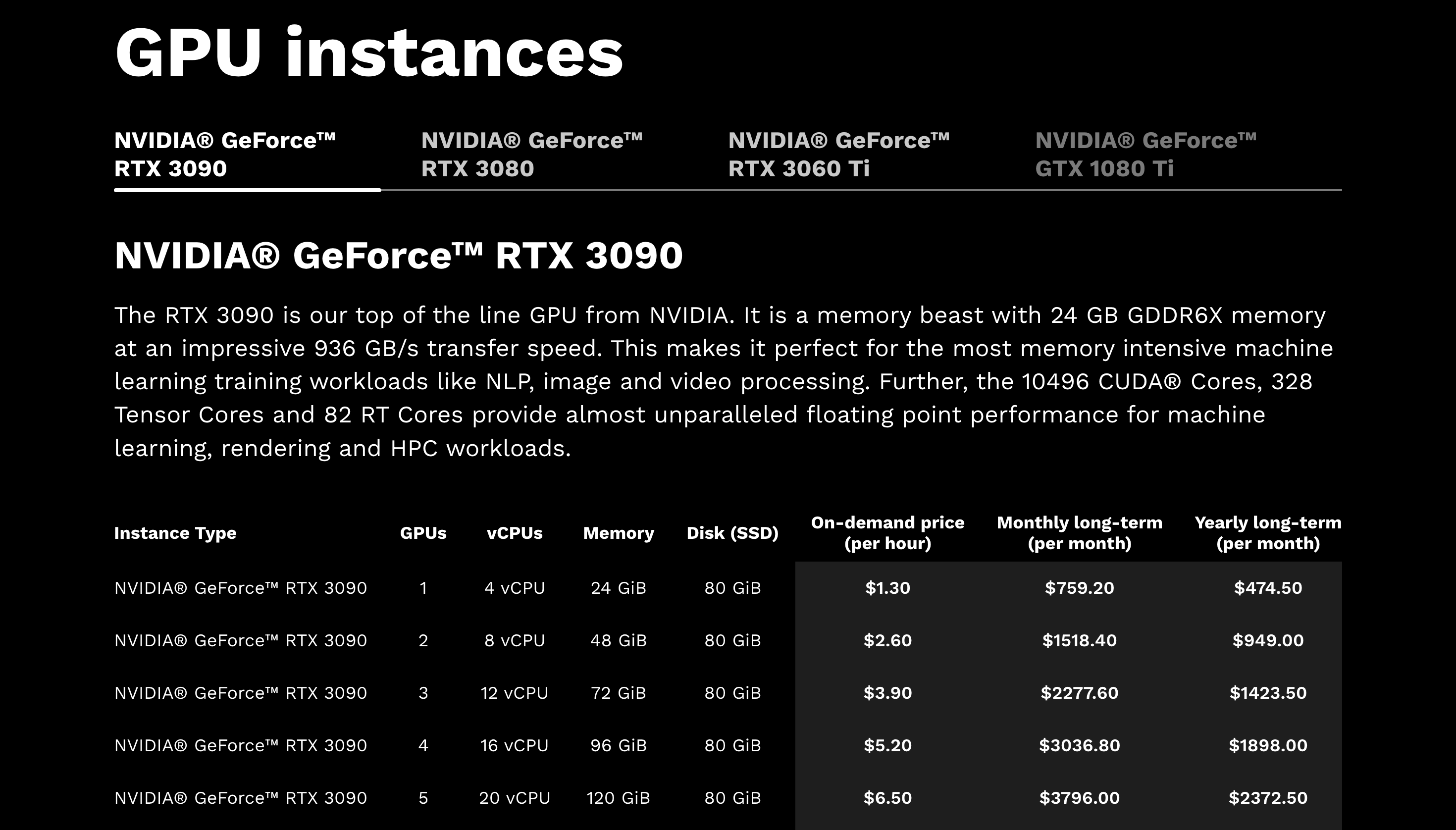

彼らは、クラウド GPU インスタンスで NVIDIA GeForce RTX 3090、RTX 3080、RTX 3060 Ti、および GTX 1080 Ti テクノロジーを利用して計算を高速化しています。

GPU コンピューティングのパワーを利用して、アニメーション映画やトレーニングを作成できます ニューラルネットワーク.

価格(英語)

NVIDIA® GeForce™ RTX 1.30 の価格は、3090 時間あたり XNUMX ドルからです。

7. Google クラウド GPU

Google Cloud Platform (GCP) は、機械学習、ディープ ラーニング、ハイ パフォーマンス コンピューティング (HPC) などのプロセスを高速化するために使用できる多数の GPU インスタンスを提供します。

NVIDIA、AMD、および Intel GPU でサポートされているこれらの GPU インスタンスを通じて、GPU アクセラレーション コンピューティングで頻繁に使用される CUDA および cuDNN ライブラリにアクセスできます。

マシンの変更、柔軟な価格設定、幅広い GPU の可能性により、HPC の生産性が向上する可能性があります。

さらに、作業負荷を軽減するのにも役立ちます。 彼らが提供する GPU の中には、NVIDIA K80、P4、V100、A100、T4、および P100 があります。 GPU にアクセスできるのは、さまざまな場所に分散した少数のゾーンだけです。

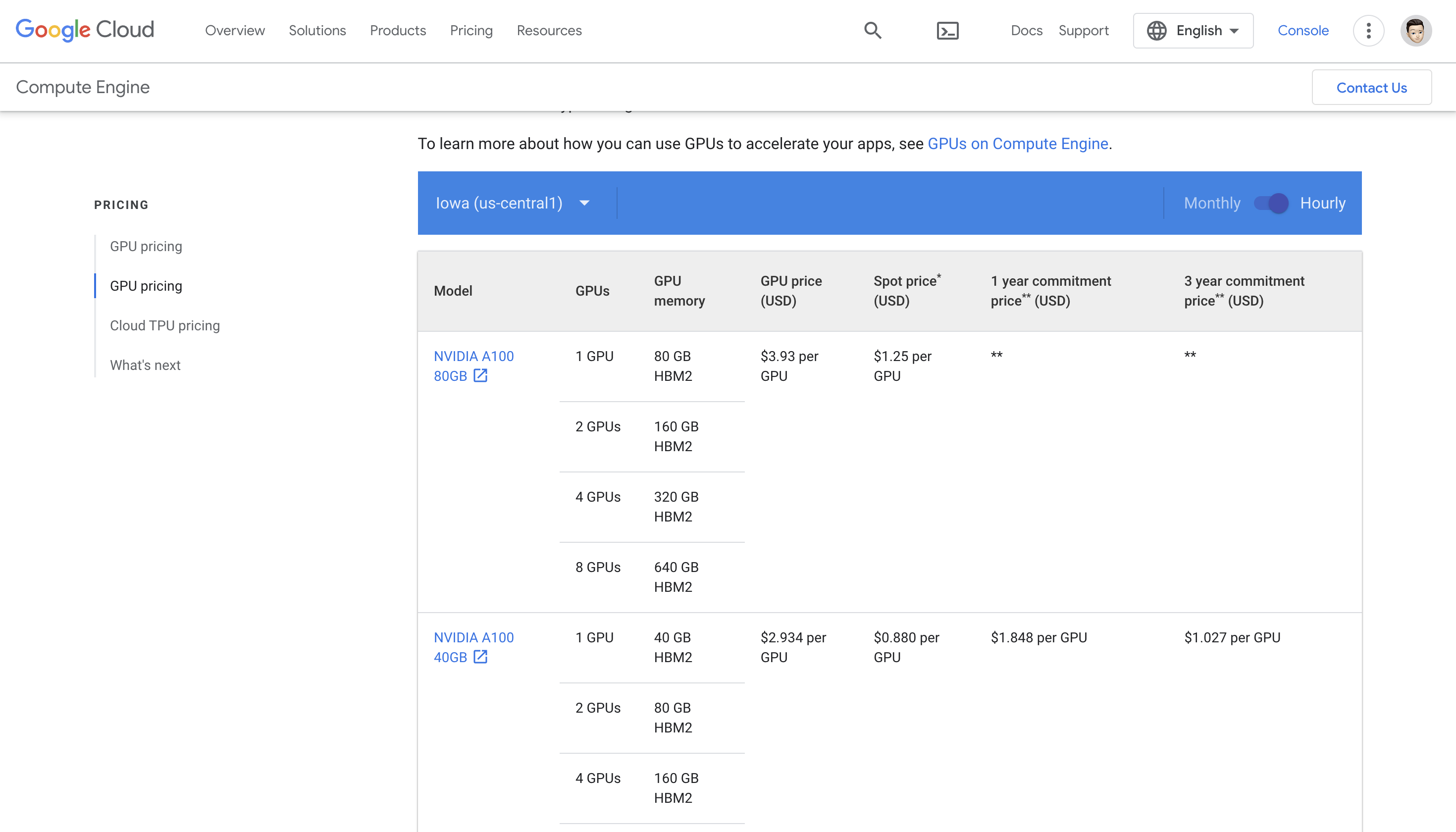

価格(英語)

コストは、リージョン、選択した GPU、マシンタイプによって異なります。 NVIDIA A100 の価格は、GPU あたり 3.93 ドルからです。

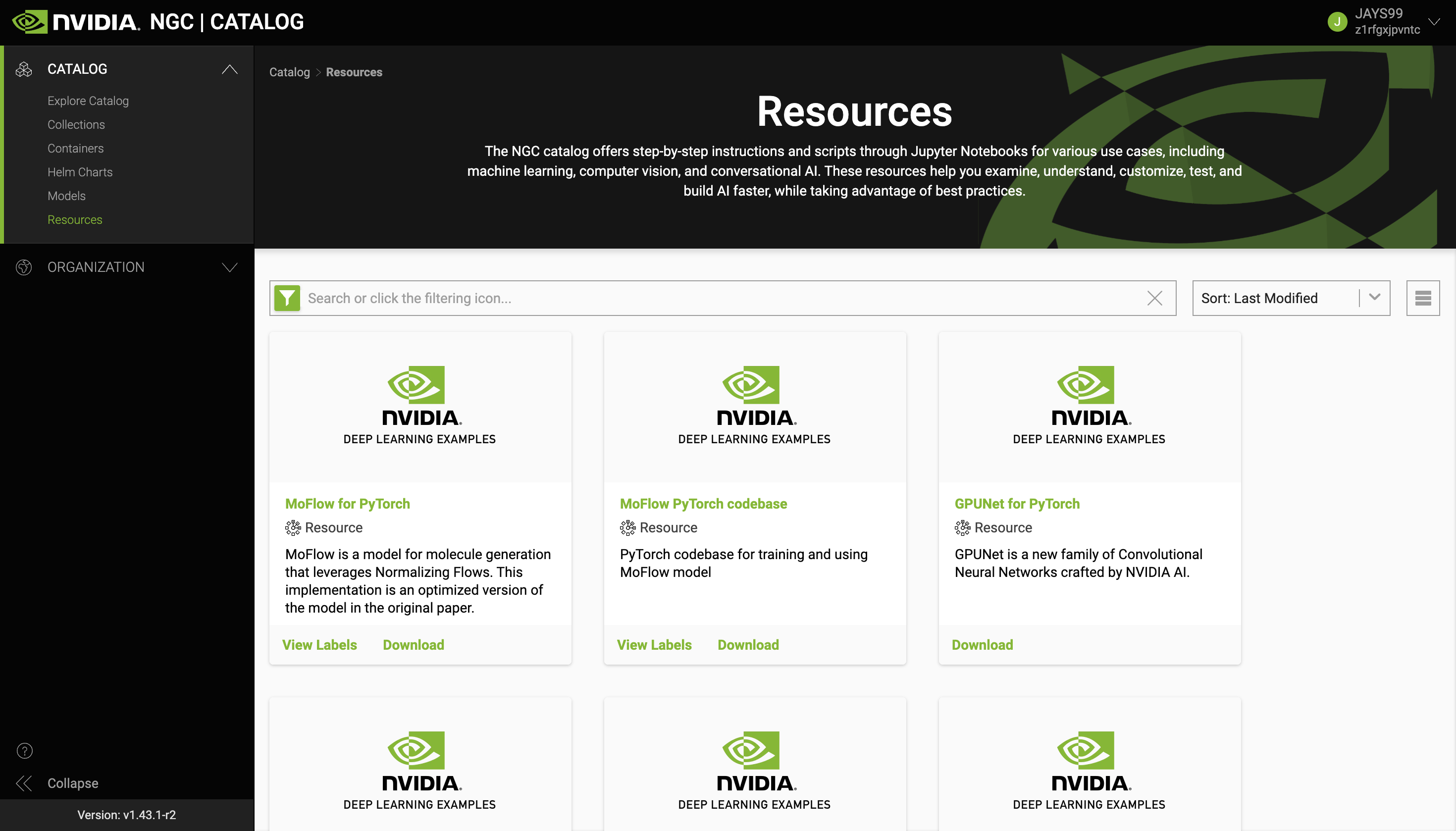

8. NVIDIAGPUクラウド

NVIDIA GPU Cloud (NGC) はクラウドベースのプラットフォームであり、可視化ツール、HPC プログラム、および 深い学習 フレームワーク。

開発者、 データサイエンティスト、および研究者は、NGC のおかげで、アプリケーションを操作するために必要なインフラストラクチャや維持費について心配することなく、クラウドで NVIDIA GPU のコンピューティング パワーを簡単に使用できるようになりました。

構成済みのソフトウェア コンテナーのライブラリが NGC に含まれており、多数のサーバーにすばやくデプロイできます。 クラウドコンピューティング Amazon Web Services、Google Cloud Platform、Microsoft Azure などのインフラストラクチャ。

NGC にアクセスすると、ユーザーは NVIDIA のディープ ラーニング プラットフォームにもアクセスできます。このプラットフォームには、TensorRT、cuDNN、CUDA-X AI など、ディープ ラーニング モデルを作成および実装するための多数のプログラムとリソースが付属しています。

価格(英語)

使用する特定のサービスとリソースに応じて、NVIDIA GPU クラウド (NGC) の価格が変わります。 ディープ ラーニング ソフトウェア スタックなどの特定の NGC サービスは無料で使用できますが、HPC アプリケーション コンテナーなどのその他のサービスは料金がかかる場合があります。 NGCカタログをご参照ください。

9. ラムダGPUクラウド

Lambda は、単一の物理コンピューターから多数の仮想マシンへのディープ ラーニング モデルのトレーニングとスケーラビリティのためのクラウド GPU インスタンスを提供します。

ダッシュボードから、各マシンの専門にすぐにアクセス ジュピターノート プログラミング環境。 直接アクセスするには、SSH キーの XNUMX つを使用して SSH を直接使用するか、クラウド ダッシュボードの Web ターミナル経由で接続します。

各インスタンスで最大 10 Gbps のノード間接続がサポートされているため、Horovod などのフレームワークを使用した分散トレーニングが可能です。

6000 つまたは複数のインスタンスで GPU の数をスケールアップすると、モデルの最適化を高速化できます。 このプラットフォームは、NVIDIA RTX 6000、Quadro RTX 100、Tesla VXNUMX の GPU インスタンスをサポートしています。

価格(英語)

NVIDIA A1.10 の価格は、100 時間あたり XNUMX ドルからです。

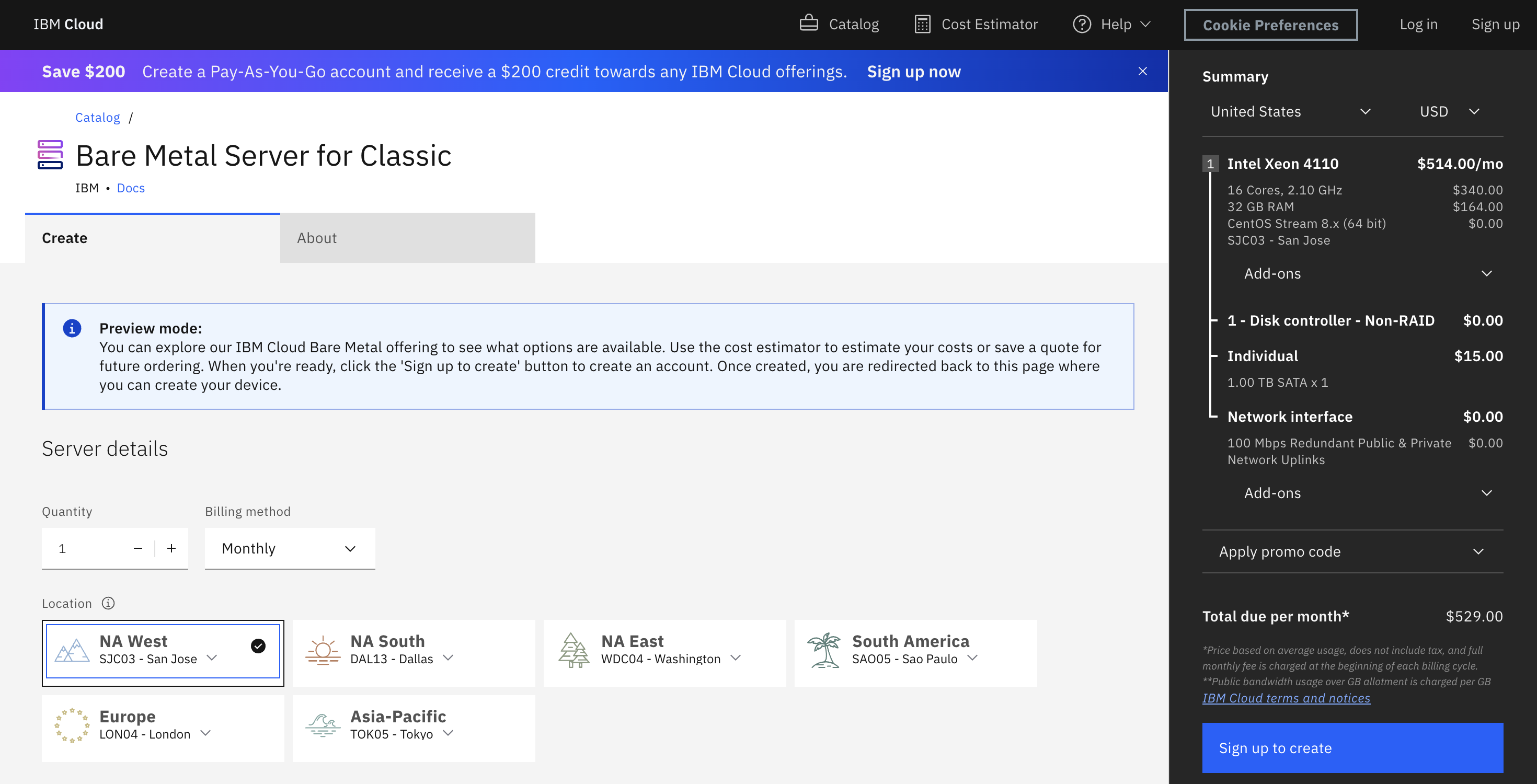

10. IBM クラウド GPU

IBM Cloud GPU は、グローバルに分散したデータ・センターのネットワークを利用して、柔軟なサーバー選択手順と、IBM クラウド・アーキテクチャー、API、およびアプリケーションとのスムーズな接続を提供します。

Intel Xeon 4210、Xeon 5218、および Xeon 6248 GPU インスタンスでは、ベアメタル サーバー GPU オプションが提供されます。

オンプレミスの GPU の場合と同様に、ベアメタル インスタンスを使用して、サーバー ハードウェア上で高パフォーマンス、レイテンシーの影響を受けやすい特殊な従来型のワークロードを直接実行できます。

ベアメタル サーバーのオプションとして、NVIDIA T4 GPU と最大 40 コアの Intel Xeon プロセッサを備えたインスタンス、および NVIDIA V100 と P100 モデルを備えた仮想サーバーの代替用のインスタンスも提供しています。

価格(英語)

Intel Xeon514 の価格は月額 4110 ドルからです。

まとめ

最後に、AI 向けの最高のクラウド GPU サービスは、強力な GPU リソース、適応可能な価格選択、および単純なスケーリングを提供するサービスです。

AI ワークロード用の GPU インスタンスを提供するすべての企業 (AWS、NVIDIA、IBM、および GCP) は、パフォーマンスと機能の点で優れた製品ラインを持っています。

最適なオプションは、最終的には、独自の要件、財務上の制約、既に導入されているインフラストラクチャ、およびベンダーの好みによって決定されます。

コメントを残す