Sommario[Nascondere][Spettacolo]

Uno dei criteri primari per qualsiasi tipo di attività aziendale è l'utilizzo efficace delle informazioni. Ad un certo punto, il volume di dati creato supera la capacità dell'elaborazione di base.

È qui che entrano in gioco gli algoritmi di apprendimento automatico. Tuttavia, prima che ciò possa accadere, le informazioni devono essere studiate e interpretate. In poche parole, è ciò per cui viene utilizzato l'apprendimento automatico non supervisionato.

In questo articolo, esamineremo in modo approfondito l'apprendimento automatico non supervisionato, inclusi i suoi algoritmi, casi d'uso e molto altro.

Che cos'è l'apprendimento automatico non supervisionato?

Gli algoritmi di apprendimento automatico senza supervisione identificano i modelli in un set di dati che non hanno una conseguenza nota o etichettata. Supervisionato algoritmi di apprendimento automatico avere un output etichettato.

Conoscere questa distinzione ti aiuta a capire perché i metodi di apprendimento automatico non supervisionati non possono essere utilizzati per risolvere problemi di regressione o classificazione, poiché non sai quale può essere il valore/risposta per i dati di output. Non puoi addestrare un algoritmo normalmente se non conosci il valore/risposta.

Inoltre, l'apprendimento non supervisionato può essere utilizzato per identificare la struttura fondamentale dei dati. Questi algoritmi rilevano modelli nascosti o raggruppamenti di dati senza la necessità dell'interazione umana.

La sua capacità di rilevare somiglianze e contrasti nelle informazioni lo rende un'ottima scelta per l'analisi esplorativa dei dati, le tecniche di cross-selling, la segmentazione dei consumatori e l'identificazione di immagini.

Considera il seguente scenario: sei in un negozio di alimentari e vedi un frutto non identificato che non hai mai visto prima. Puoi facilmente distinguere il frutto sconosciuto diverso dagli altri frutti intorno in base alle tue osservazioni sulla sua forma, dimensione o colore.

Algoritmi di apprendimento automatico senza supervisione

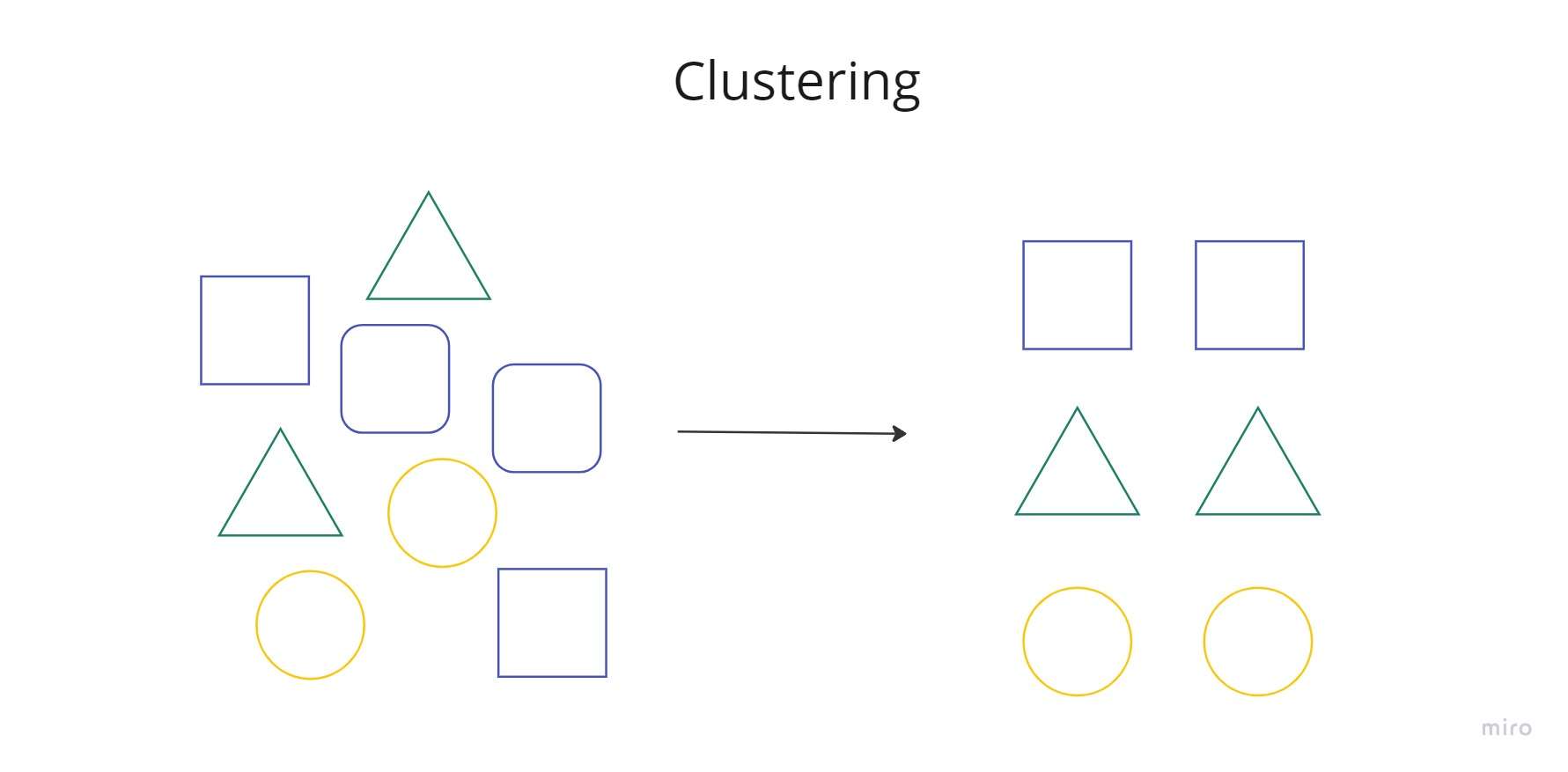

il clustering

Il clustering è senza dubbio l'approccio di apprendimento non supervisionato più utilizzato. Questo approccio inserisce gli elementi di dati correlati in cluster generati casualmente.

Di per sé, un modello ML rileva eventuali schemi, somiglianze e/o differenze in una struttura di dati non categorizzata. Un modello sarà in grado di scoprire eventuali raggruppamenti o classi naturali nei dati.

Tipi

Esistono diverse forme di raggruppamento che possono essere utilizzate. Diamo prima un'occhiata ai più importanti.

- Il clustering esclusivo, noto anche come clustering "hard", è un tipo di raggruppamento in cui un singolo dato appartiene a un solo cluster.

- Il clustering sovrapposto, spesso noto come clustering "soft", consente agli oggetti dati di appartenere a più di un cluster a vari livelli. Inoltre, il clustering probabilistico può essere utilizzato per affrontare problemi di clustering "soft" o di stima della densità, nonché per valutare la probabilità o la verosimiglianza di punti dati appartenenti a determinati cluster.

- La creazione di una gerarchia di elementi di dati raggruppati è l'obiettivo del clustering gerarchico, come indica il nome. Gli elementi di dati vengono decostruiti o combinati in base alla gerarchia per generare cluster.

Casi d'uso:

- Rilevamento di anomalie:

Qualsiasi tipo di outlier nei dati può essere rilevato utilizzando il clustering. Le aziende del settore dei trasporti e della logistica, ad esempio, possono utilizzare il rilevamento delle anomalie per scoprire impedimenti logistici o rivelare parti meccaniche danneggiate (manutenzione predittiva).

Gli istituti finanziari possono utilizzare la tecnologia per rilevare transazioni fraudolente e rispondere rapidamente, risparmiando potenzialmente un sacco di soldi. Scopri di più sull'individuazione di anomalie e frodi guardando il nostro video.

- Segmentazione dei clienti e dei mercati:

Gli algoritmi di clustering possono aiutare a raggruppare persone che hanno caratteristiche simili e creare personaggi dei consumatori per un marketing più efficace e iniziative mirate.

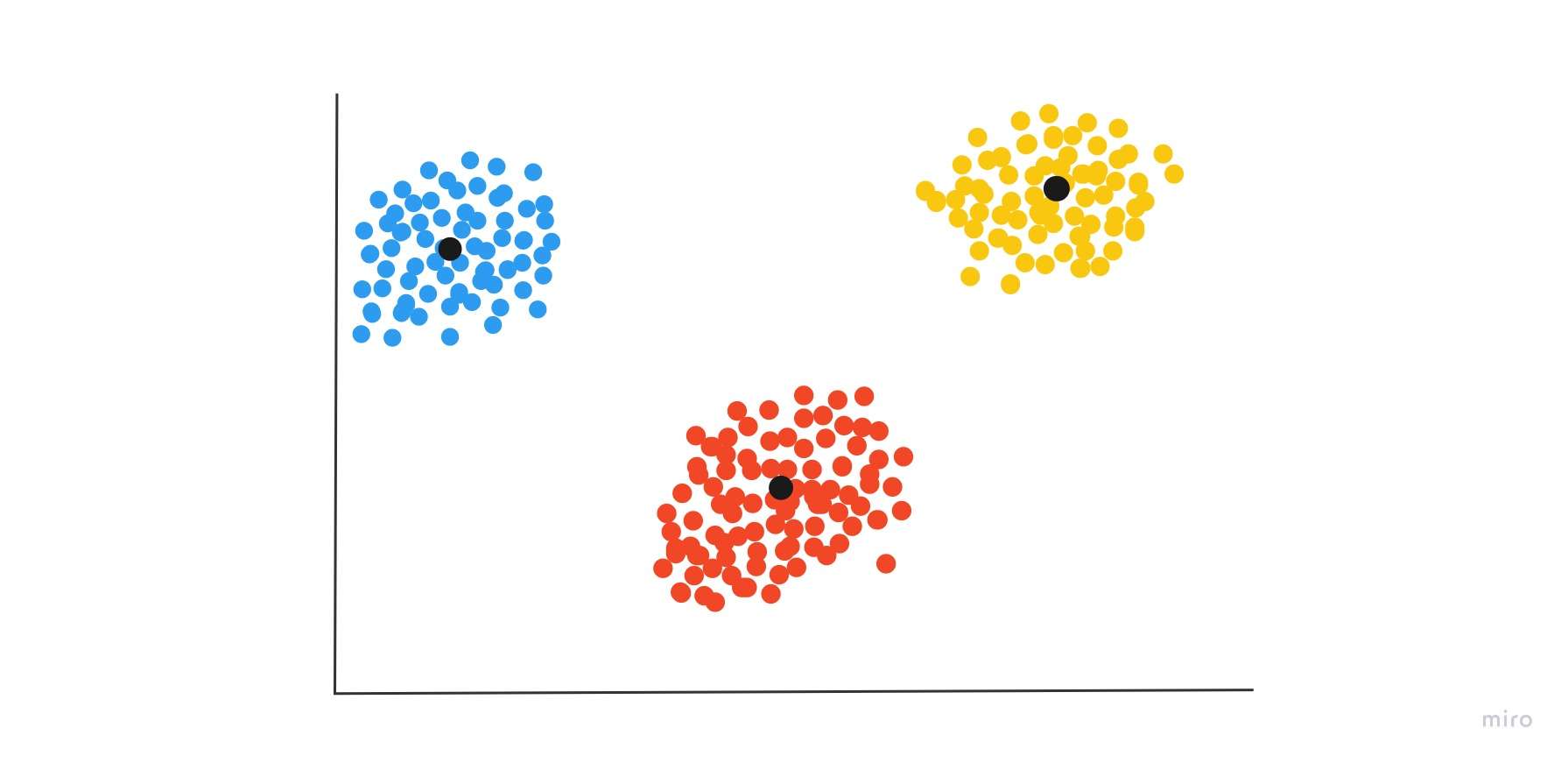

K-Mezzi

K-means è un metodo di clustering noto anche come partizionamento o segmentazione. Divide i punti dati in un numero predeterminato di cluster noti come K.

Nel metodo K-medie, K è l'input poiché dici al computer quanti cluster vuoi identificare nei tuoi dati. Ciascun elemento di dati viene successivamente assegnato al centro del cluster più vicino, noto come centroide (punti neri nell'immagine).

Questi ultimi servono come spazi di archiviazione dati. La tecnica di clustering può essere eseguita numerose volte fino a quando i cluster non sono ben definiti.

Mezzi K sfocati

Fuzzy K-means è un'estensione della tecnica K-means, che viene utilizzata per eseguire il clustering sovrapposto. A differenza della tecnica delle K-medie, le K-medie sfocate indicano che i punti dati potrebbero appartenere a molti cluster con vari gradi di vicinanza a ciascuno.

La distanza tra i punti dati e il baricentro del cluster viene utilizzata per calcolare la prossimità. Di conseguenza, possono esserci occasioni in cui vari cluster si sovrappongono.

Modelli di miscele gaussiane

I modelli di miscele gaussiane (GMM) sono un metodo utilizzato nel clustering probabilistico. Poiché la media e la varianza sono sconosciute, i modelli presuppongono che vi sia un numero fisso di distribuzioni gaussiane, ciascuna rappresentante un cluster distinto.

Per determinare a quale cluster appartiene uno specifico punto dati, viene essenzialmente utilizzato il metodo.

Clustering gerarchico

La strategia di clustering gerarchico può iniziare con ogni punto dati assegnato a un cluster diverso. I due cluster più vicini l'uno all'altro vengono quindi fusi in un unico cluster. L'unione iterativa continua finché un solo cluster rimane nella parte superiore.

Questo metodo è noto come bottom-up o agglomerato. Se inizi con tutti gli elementi di dati legati allo stesso cluster e poi esegui le suddivisioni finché ogni elemento di dati non viene assegnato come un cluster separato, il metodo è noto come clustering gerarchico top-down o divisivo.

Algoritmo Apriori

L'analisi del paniere di mercato ha reso popolari gli algoritmi apriori, risultando in vari motori di raccomandazione per piattaforme musicali e negozi online.

Vengono utilizzati nei set di dati transazionali per trovare set di articoli frequenti o raggruppamenti di articoli al fine di prevedere la probabilità di consumare un prodotto in base al consumo di un altro.

Ad esempio, se inizio a riprodurre la radio di OneRepublic su Spotify con "Counting Stars", uno degli altri brani su questo canale sarà sicuramente un brano di Imagine Dragon, come "Bad Liar".

Questo si basa sulle mie precedenti abitudini di ascolto e sui modelli di ascolto degli altri. I metodi Apriori contano i set di elementi utilizzando un albero hash, attraversando l'ampiezza del set di dati per primo.

Riduzione dimensionale

La riduzione della dimensionalità è una sorta di apprendimento non supervisionato che utilizza una raccolta di strategie per ridurre al minimo il numero di caratteristiche - o dimensioni - in un set di dati. Permettici di chiarire.

Può essere allettante incorporare più dati possibili durante la creazione del tuo set di dati per l'apprendimento automatico. Non fraintenderci: questa strategia funziona bene poiché più dati di solito producono risultati più accurati.

Si supponga che i dati siano archiviati in uno spazio N-dimensionale, con ciascuna caratteristica che rappresenta una dimensione diversa. Potrebbero esserci centinaia di dimensioni se sono presenti molti dati.

Prendi in considerazione i fogli di calcolo di Excel, con colonne che rappresentano caratteristiche e righe che rappresentano elementi di dati. Quando ci sono troppe dimensioni, gli algoritmi ML potrebbero funzionare male e visualizzazione dati può diventare difficile.

Quindi è logico limitare le caratteristiche o le dimensioni e trasmettere solo informazioni pertinenti. La riduzione della dimensionalità è proprio questo. Consente una quantità gestibile di input di dati senza compromettere l'integrità del set di dati.

Analisi dei componenti principali (PCA)

L'analisi delle componenti principali è un approccio di riduzione della dimensionalità. Viene utilizzato per ridurre al minimo il numero di funzionalità in enormi set di dati, con conseguente maggiore semplicità dei dati senza sacrificare l'accuratezza.

La compressione del set di dati viene eseguita con un metodo noto come estrazione di funzionalità. Indica che gli elementi del set originale sono fusi in uno nuovo, più piccolo. Questi nuovi tratti sono conosciuti come componenti primari.

Naturalmente, ci sono algoritmi aggiuntivi che puoi utilizzare nelle tue applicazioni di apprendimento non supervisionato. Quelli sopra elencati sono solo i più diffusi, motivo per cui vengono discussi in modo più dettagliato.

Applicazione dell'apprendimento non supervisionato

- I metodi di apprendimento senza supervisione vengono utilizzati per compiti di percezione visiva come il riconoscimento di oggetti.

- L'apprendimento automatico non supervisionato fornisce aspetti critici ai sistemi di imaging medico, come l'identificazione, la classificazione e la segmentazione delle immagini, che vengono utilizzati in radiologia e patologia per diagnosticare i pazienti in modo rapido e affidabile.

- L'apprendimento non supervisionato può aiutare a identificare le tendenze dei dati che possono essere utilizzate per creare strategie di vendita incrociata più efficaci utilizzando i dati passati sul comportamento dei consumatori. Durante il processo di pagamento, questo viene utilizzato dalle aziende online per suggerire i giusti componenti aggiuntivi ai clienti.

- I metodi di apprendimento senza supervisione possono setacciare enormi volumi di dati per trovare valori anomali. Queste anomalie potrebbero sollevare l'avviso di apparecchiature malfunzionanti, errori umani o violazioni della sicurezza.

Problemi con l'apprendimento non supervisionato

L'apprendimento non supervisionato è attraente in vari modi, dalla possibilità di trovare importanti spunti di riflessione dati per evitare costose etichette dei dati operazioni. Tuttavia, ci sono diversi inconvenienti nell'usare questa strategia per allenarsi modelli di apprendimento automatico di cui dovresti essere consapevole. Ecco alcuni esempi.

- Poiché i dati di input mancano di etichette che fungono da chiavi di risposta, i risultati dei modelli di apprendimento senza supervisione potrebbero essere meno precisi.

- L'apprendimento non supervisionato funziona spesso con enormi set di dati, che possono aumentare la complessità computazionale.

- L'approccio richiede la conferma dell'output da parte degli esseri umani, specialisti interni o esterni nell'argomento dell'indagine.

- Gli algoritmi devono esaminare e calcolare ogni possibile scenario durante la fase di addestramento, che richiede del tempo.

Conclusione

L'utilizzo efficace dei dati è la chiave per stabilire un vantaggio competitivo in un particolare mercato.

Puoi segmentare i dati utilizzando algoritmi di apprendimento automatico non supervisionati per esaminare le preferenze del tuo pubblico di destinazione o per determinare come una determinata infezione risponde a un particolare trattamento.

Ci sono diverse applicazioni pratiche, e data scientist, ingegneri e architetti possono assisterti nella definizione dei tuoi obiettivi e nello sviluppo di soluzioni ML uniche per la tua azienda.

Lascia un Commento