Բառը[Թաքցնել][Ցուցադրում]

Ցանկացած տեսակի կորպորատիվ գործունեության առաջնային չափանիշներից մեկը տեղեկատվության արդյունավետ օգտագործումն է: Ինչ-որ պահի ստեղծված տվյալների ծավալը գերազանցում է հիմնական մշակման հնարավորությունները:

Հենց այստեղ են գործում մեքենայական ուսուցման ալգորիթմները: Այնուամենայնիվ, նախքան դրանցից որևէ մեկը տեղի ունենալը, տեղեկատվությունը պետք է ուսումնասիրվի և մեկնաբանվի: Մի խոսքով, դա այն է, ինչի համար օգտագործվում է չվերահսկվող մեքենայական ուսուցումը:

Այս հոդվածում մենք կուսումնասիրենք չվերահսկվող մեքենայական ուսուցումը, ներառյալ դրա ալգորիթմները, օգտագործման դեպքերը և շատ ավելին:

Ի՞նչ է չվերահսկվող մեքենայական ուսուցումը:

Չվերահսկվող մեքենայական ուսուցման ալգորիթմները բացահայտում են տվյալների հավաքածուի օրինաչափությունները, որոնք չունեն հայտնի կամ պիտակավորված հետևանք: Վերահսկվող մեքենայի ուսուցման ալգորիթմներ ունեն պիտակավորված արդյունք:

Այս տարբերակման իմացությունը կօգնի ձեզ հասկանալ, թե ինչու չվերահսկվող մեքենայական ուսուցման մեթոդները չեն կարող օգտագործվել ռեգրեսիայի կամ դասակարգման խնդիրները լուծելու համար, քանի որ չգիտեք, թե որն է ելքային տվյալների արժեքը/պատասխանը: Դուք չեք կարող նորմալ վարժեցնել ալգորիթմը, եթե չգիտեք արժեքը/պատասխանը:

Ավելին, չվերահսկվող ուսուցումը կարող է օգտագործվել տվյալների հիմնարար կառուցվածքը բացահայտելու համար: Այս ալգորիթմները հայտնաբերում են թաքնված օրինաչափություններ կամ տվյալների խմբավորումներ՝ առանց մարդկային փոխազդեցության անհրաժեշտության:

Տեղեկատվության մեջ նմանություններն ու հակադրությունները հայտնաբերելու կարողությունը այն դարձնում է հիանալի ընտրություն տվյալների հետախուզական վերլուծության, խաչաձև վաճառքի տեխնիկայի, սպառողների սեգմենտավորման և նկարների նույնականացման համար:

Մտածեք հետևյալ սցենարը. դուք մթերային խանութում եք և տեսնում եք անհայտ միրգ, որը նախկինում երբեք չեք տեսել: Դուք կարող եք հեշտությամբ տարբերել անհայտ պտուղը, որը տարբերվում է շրջապատի մյուս մրգերից՝ հիմնվելով դրա ձևի, չափի կամ գույնի ձեր դիտարկումների վրա:

Չվերահսկվող մեքենայական ուսուցման ալգորիթմներ

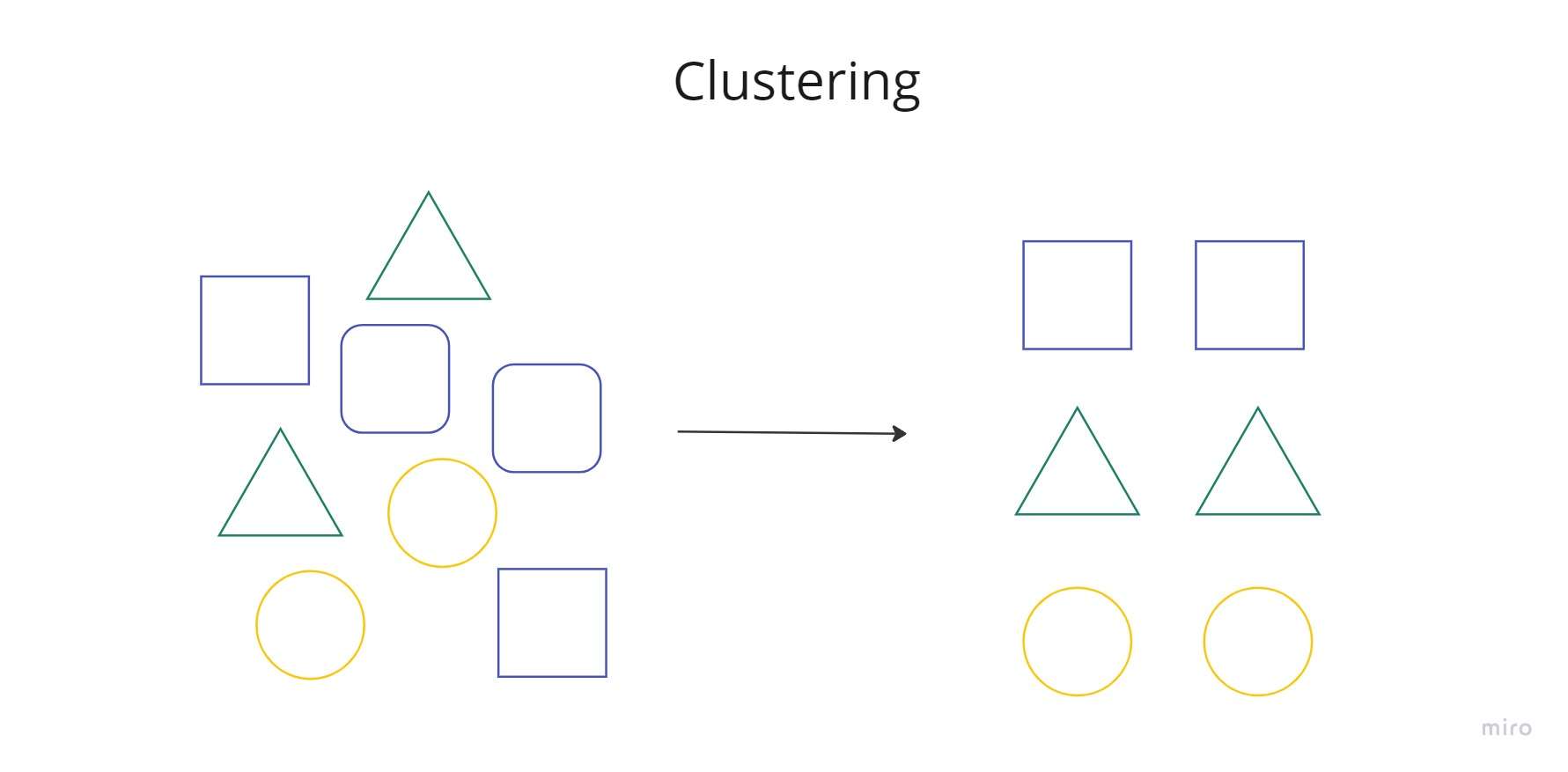

Կլաստերացում

Կլաստերավորումը, անկասկած, ամենաշատ օգտագործվող չվերահսկվող ուսուցման մոտեցումն է: Այս մոտեցումը փոխկապակցված տվյալների տարրերը դնում է պատահականորեն ստեղծված կլաստերների մեջ:

Ինքնին ML մոդելը հայտնաբերում է ցանկացած օրինաչափություն, նմանություն և/կամ տարբերություն չդասակարգված տվյալների կառուցվածքում: Մոդելը կկարողանա հայտնաբերել ցանկացած բնական խմբավորում կամ դասակարգ տվյալների մեջ:

Տեսակներ

Կլաստերավորման մի քանի ձևեր կան, որոնք կարող են օգտագործվել: Եկեք նախ նայենք ամենակարևորներին:

- Բացառիկ կլաստերավորումը, որը երբեմն հայտնի է որպես «կոշտ» կլաստերավորում, խմբավորման մի տեսակ է, որտեղ տվյալների մեկ կտորը պատկանում է ընդամենը մեկ կլաստերի:

- Համընկնող կլաստերավորումը, որը հաճախ հայտնի է որպես «փափուկ» կլաստերավորում, թույլ է տալիս տվյալների օբյեկտներին պատկանել մեկից ավելի կլաստերի՝ տարբեր աստիճաններով: Ավելին, հավանականական կլաստերավորումը կարող է օգտագործվել «փափուկ» կլաստերավորման կամ խտության գնահատման խնդիրների լուծման համար, ինչպես նաև գնահատելու որոշակի կլաստերներին պատկանող տվյալների կետերի հավանականությունը կամ հավանականությունը:

- Խմբավորված տվյալների տարրերի հիերարխիա ստեղծելը հիերարխիկ կլաստերավորման նպատակն է, ինչպես նշում է անունը: Տվյալների տարրերը ապակառուցվում կամ համակցվում են հիերարխիայի հիման վրա՝ կլաստերներ ստեղծելու համար:

Օգտագործման դեպքեր.

- Անոմալիաների հայտնաբերում.

Տվյալների մեջ ցանկացած տիպի արտանետում կարելի է հայտնաբերել կլաստերավորման միջոցով: Տրանսպորտի և լոգիստիկայի ընկերությունները, օրինակ, կարող են օգտագործել անոմալիաների հայտնաբերումը լոգիստիկ խոչընդոտները հայտնաբերելու կամ վնասված մեխանիկական մասերը բացահայտելու համար (կանխատեսելի սպասարկում):

Ֆինանսական հաստատությունները կարող են օգտագործել տեխնոլոգիան խարդախ գործարքները հայտնաբերելու և արագ արձագանքելու համար՝ պոտենցիալ խնայելով մեծ գումար: Իմացեք ավելին աննորմալությունների և խարդախության հայտնաբերման մասին՝ դիտելով մեր տեսանյութը:

- Հաճախորդների և շուկաների սեգմենտավորում.

Կլաստերավորման ալգորիթմները կարող են օգնել խմբավորել մարդկանց, ովքեր ունեն նմանատիպ հատկանիշներ և ստեղծել սպառողների կերպարներ ավելի արդյունավետ մարքեթինգի և նպատակային նախաձեռնությունների համար:

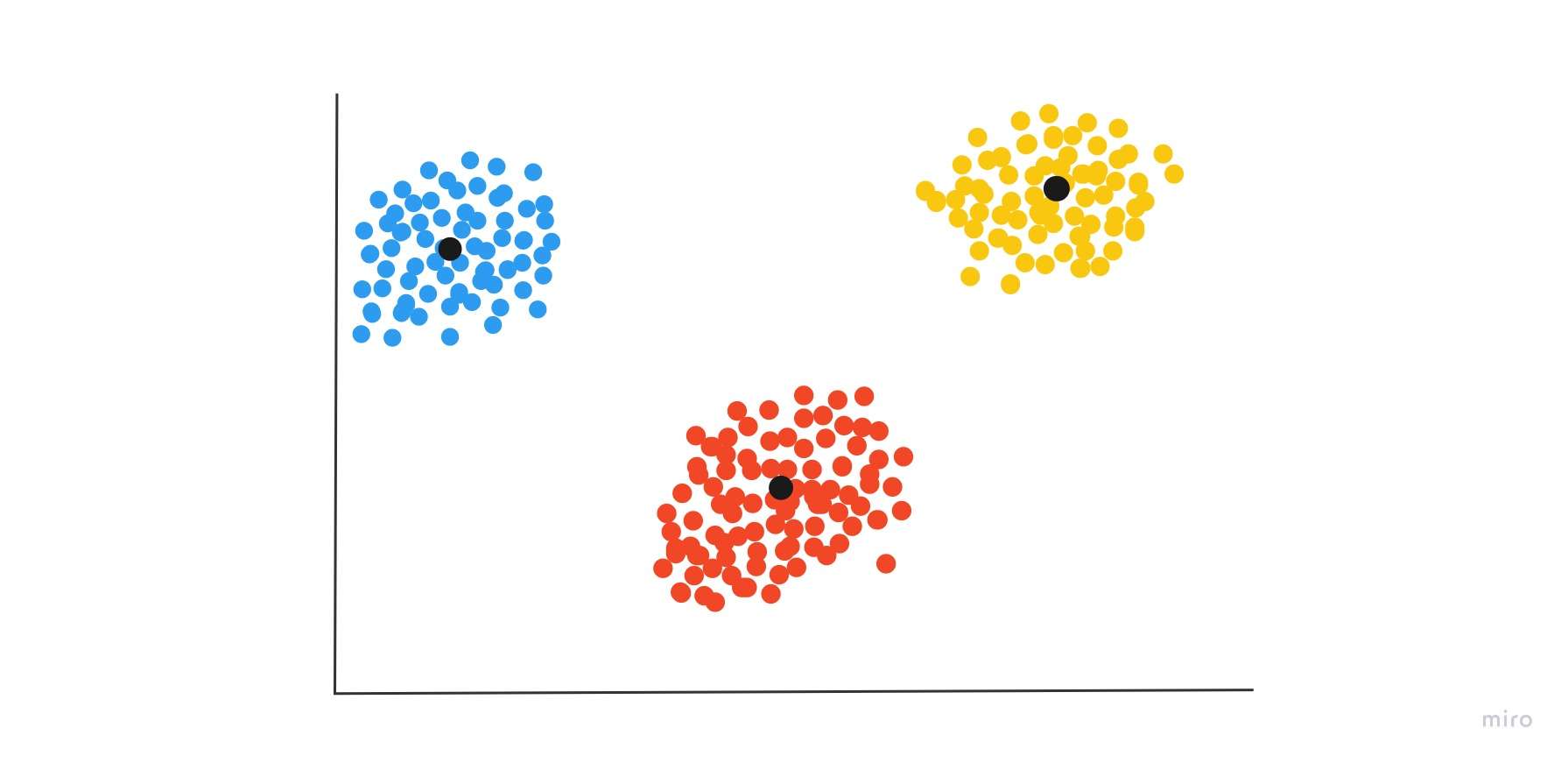

Կ-Միանս

K-means-ը կլաստերավորման մեթոդ է, որը նաև հայտնի է որպես բաժանում կամ հատվածավորում: Այն տվյալների կետերը բաժանում է կանխորոշված թվով կլաստերների, որոնք հայտնի են որպես K:

K-means մեթոդում K-ն մուտքագրումն է, քանի որ դուք համակարգչին ասում եք, թե քանի կլաստեր եք ցանկանում բացահայտել ձեր տվյալների մեջ: Տվյալների յուրաքանչյուր տարր հետագայում վերագրվում է ամենամոտ կլաստերային կենտրոնին, որը հայտնի է որպես ցենտրոիդ (սև կետեր նկարում):

Վերջիններս ծառայում են որպես տվյալների պահպանման տարածք։ Կլաստերավորման տեխնիկան կարող է իրականացվել բազմաթիվ անգամներ, մինչև կլաստերները լավ սահմանված լինեն:

Fuzzy K-նշանակում է

Fuzzy K-means-ը K-means տեխնիկայի ընդլայնումն է, որն օգտագործվում է համընկնող կլաստերավորում կատարելու համար: Ի տարբերություն K-means տեխնիկայի, մշուշոտ K-միջոցները ցույց են տալիս, որ տվյալների կետերը կարող են պատկանել բազմաթիվ կլաստերների՝ յուրաքանչյուրին հարևանությամբ տարբեր աստիճանի:

Տվյալների կետերի և կլաստերի կենտրոնի միջև հեռավորությունը օգտագործվում է մոտիկությունը հաշվարկելու համար: Արդյունքում, կարող են լինել դեպքեր, երբ տարբեր կլաստերներ համընկնում են:

Գաուսի խառնուրդի մոդելներ

Gaussian Mixture Models (GMMs) մեթոդ է, որն օգտագործվում է հավանականական կլաստերավորման մեջ: Քանի որ միջինը և շեղումը անհայտ են, մոդելները ենթադրում են, որ կա Գաուսի բաշխումների ֆիքսված քանակ, որոնցից յուրաքանչյուրը ներկայացնում է առանձին կլաստեր:

Որոշելու համար, թե կոնկրետ տվյալների կետը որ կլաստերին է պատկանում, մեթոդը հիմնականում օգտագործվում է:

Հիերարխիկ կլաստերավորում

Հիերարխիկ կլաստերավորման ռազմավարությունը կարող է սկսվել յուրաքանչյուր տվյալների կետից, որը վերագրված է մեկ այլ կլաստերի: Երկու կլաստերները, որոնք ամենամոտ են միմյանց, այնուհետև միաձուլվում են մեկ կլաստերի մեջ: Կրկնվող միաձուլումը շարունակվում է այնքան ժամանակ, մինչև միայն մեկ կլաստեր մնա վերևում:

Այս մեթոդը հայտնի է որպես ներքևից վեր կամ ագլոմերատիվ: Եթե դուք սկսում եք բոլոր տվյալների տարրերը կապված միևնույն կլաստերի հետ, և այնուհետև կատարում եք բաժանումներ, մինչև յուրաքանչյուր տվյալների տարր նշանակվի որպես առանձին կլաստեր, մեթոդը հայտնի է որպես վերևից ներքև կամ բաժանարար հիերարխիկ կլաստերավորում:

Apriori ալգորիթմ

Շուկայական զամբյուղի վերլուծությունը հանրահռչակեց apriori ալգորիթմները, ինչը հանգեցրեց տարբեր առաջարկությունների շարժիչների երաժշտական հարթակների և առցանց խանութների համար:

Դրանք օգտագործվում են գործարքային տվյալների շտեմարաններում՝ գտնելու հաճախակի տարրերի հավաքածուներ կամ ապրանքների խմբավորումներ, որպեսզի կանխատեսեն մեկ ապրանքի սպառման հավանականությունը՝ հիմնվելով մյուսի սպառման վրա:

Օրինակ, եթե ես սկսեմ նվագարկել OneRepublic-ի ռադիոն Spotify-ով «Counting Stars»-ով, այս ալիքի մյուս երգերից մեկը, անկասկած, կլինի Imagine Dragon երգը, ինչպիսին «Bad Liar»-ն է:

Սա հիմնված է իմ նախկին լսելու սովորությունների վրա, ինչպես նաև ուրիշների լսելու ձևերի վրա: Apriori մեթոդները հաշվում են տարրերի հավաքածուները՝ օգտագործելով հեշ ծառը, առաջին հերթին անցնելով տվյալների բազայի լայնությունը:

Չափերի կրճատում

Չափերի կրճատումը չվերահսկվող ուսուցման մի տեսակ է, որն օգտագործում է ռազմավարությունների հավաքածու՝ տվյալների բազայում հատկանիշների կամ չափերի քանակը նվազագույնի հասցնելու համար: Թույլ տվեք պարզաբանել.

Կարող է գայթակղիչ լինել հնարավորինս շատ տվյալներ ներառել ձեր ստեղծման ժամանակ տվյալների բազա մեքենայական ուսուցման համար. Մեզ սխալ մի հասկացեք. այս ռազմավարությունը լավ է աշխատում, քանի որ ավելի շատ տվյալներ սովորաբար ավելի ճշգրիտ արդյունքներ են տալիս:

Ենթադրենք, որ տվյալները պահվում են N-չափ տարածության մեջ, որտեղ յուրաքանչյուր հատկանիշ ներկայացնում է տարբեր չափսեր: Կարող են լինել հարյուրավոր չափեր, եթե շատ տվյալներ կան:

Դիտարկենք Excel-ի աղյուսակները՝ բնութագրերը ներկայացնող սյունակներով և տվյալների տարրերը ներկայացնող տողերով: Երբ չափերը շատ են, ML ալգորիթմները կարող են վատ աշխատել և տվյալների վիզուալացում կարող է դժվար դառնալ:

Այսպիսով, տրամաբանական է դարձնում բնութագրերը կամ չափերը սահմանափակելը և պարզապես տեղին տեղեկատվություն փոխանցելը: Չափերի կրճատումը հենց դա է: Այն թույլ է տալիս տվյալների մուտքագրման կառավարելի քանակություն՝ առանց խախտելու տվյալների շտեմարանի ամբողջականությունը:

Հիմնական բաղադրիչի վերլուծություն (PCA)

Հիմնական բաղադրիչի վերլուծությունը չափումների կրճատման մոտեցումն է: Այն օգտագործվում է հսկայական տվյալների հավաքածուներում գործառույթների քանակը նվազագույնի հասցնելու համար, ինչը հանգեցնում է տվյալների ավելի մեծ պարզության՝ առանց ճշգրտության զոհաբերելու:

Տվյալների հավաքածուի սեղմումն իրականացվում է մի մեթոդով, որը հայտնի է որպես առանձնահատկությունների արդյունահանում: Այն ցույց է տալիս, որ սկզբնական հավաքածուի տարրերը խառնվում են նոր, ավելի փոքրի: Այս նոր հատկանիշները հայտնի են որպես առաջնային բաղադրիչներ:

Իհարկե, կան լրացուցիչ ալգորիթմներ, որոնք կարող եք օգտագործել ձեր չվերահսկվող ուսումնական հավելվածներում: Վերը թվարկվածներն ընդամենը ամենատարածվածներն են, այդ իսկ պատճառով դրանք ավելի մանրամասն քննարկվում են:

Չվերահսկվող ուսուցման կիրառում

- Չվերահսկվող ուսուցման մեթոդներն օգտագործվում են տեսողական ընկալման առաջադրանքների համար, ինչպիսիք են օբյեկտների ճանաչումը:

- Չվերահսկվող մեքենայական ուսուցումը կրիտիկական ասպեկտներ է տալիս բժշկական պատկերավորման համակարգերին, ինչպիսիք են պատկերի նույնականացումը, դասակարգումը և հատվածավորումը, որոնք օգտագործվում են ռադիոլոգիայում և պաթոլոգիայում՝ հիվանդներին արագ և հուսալի ախտորոշելու համար:

- Չվերահսկվող ուսուցումը կարող է օգնել բացահայտելու տվյալների միտումները, որոնք կարող են օգտագործվել ավելի արդյունավետ խաչաձև վաճառքի ռազմավարություններ ստեղծելու համար՝ օգտագործելով սպառողների վարքագծի վերաբերյալ նախկին տվյալները: Վճարման գործընթացում սա օգտագործվում է առցանց բիզնեսների կողմից՝ հաճախորդներին ճիշտ հավելումներ առաջարկելու համար:

- Չվերահսկվող ուսուցման մեթոդները կարող են մաղել ահռելի ծավալի տվյալներ՝ գտնելու արտանետումները: Այս աննորմալությունները կարող են ահազանգել սարքավորումների անսարքության, մարդկային սխալի կամ անվտանգության խախտման մասին:

Չվերահսկվող ուսուցման հետ կապված խնդիրներ

Չվերահսկվող ուսուցումը գրավիչ է տարբեր ձևերով՝ սկսած կարևոր գաղափարներ գտնելու հնարավորությունից տվյալների թանկարժեք պիտակավորումից խուսափելու համար գործառնություններ. Այնուամենայնիվ, մարզվելու համար այս ռազմավարությունն օգտագործելու մի քանի թերություններ կան մեքենայական ուսուցման մոդելներ որ դուք պետք է տեղյակ լինեք. Ահա մի քանի օրինակներ.

- Քանի որ մուտքային տվյալներին բացակայում են պիտակները, որոնք ծառայում են որպես պատասխան բանալիներ, չվերահսկվող ուսուցման մոդելների արդյունքները կարող են ավելի քիչ ճշգրիտ լինել:

- Չվերահսկվող ուսուցումը հաճախ աշխատում է տվյալների զանգվածային հավաքածուների հետ, ինչը կարող է մեծացնել հաշվողական բարդությունը:

- Մոտեցումը պահանջում է արդյունքների հաստատում մարդկանց կողմից՝ ներքին կամ արտաքին մասնագետների կողմից հարցման առարկայի մեջ:

- Ալգորիթմները պետք է ուսումնասիրեն և հաշվարկեն յուրաքանչյուր հնարավոր սցենար վերապատրաստման փուլի ընթացքում, որը որոշ ժամանակ է պահանջում:

Եզրափակում

Տվյալների արդյունավետ օգտագործումը որոշակի շուկայում մրցակցային առավելություն ստեղծելու բանալին է:

Դուք կարող եք հատվածավորել տվյալները՝ օգտագործելով չվերահսկվող մեքենայական ուսուցման ալգորիթմներ՝ ուսումնասիրելու ձեր թիրախային լսարանի նախասիրությունները կամ որոշելու, թե ինչպես է որոշակի վարակը արձագանքում որոշակի բուժմանը:

Կան մի քանի գործնական կիրառություններ, և տվյալների գիտնականներ, ինժեներները և ճարտարապետները կարող են օգնել ձեզ որոշել ձեր նպատակները և մշակել եզակի ML լուծումներ ձեր ընկերության համար:

Թողնել գրառում