Tartalomjegyzék[Elrejt][Előadás]

Nem újdonság a hamis fotók és videók. Az internet széleskörű elterjedése óta az egyének a képek és filmek megjelenése óta készítenek bolondozásra vagy szórakoztatásra szánt hamisítványokat.

Létezik azonban egy új típusú, géppel előállított hamisítvány, amely egy nap megnehezítheti a valóság és a fikció megkülönböztetését.

Ezek a hamisítványok különböznek az egyszerű képmanipulációktól, amelyeket a Photoshophoz hasonló szerkesztő szoftverek generáltak, vagy a múlt okosan manipulált filmjei.

A mélyhamisítások a „szintetikus médiák” legismertebb példái – olyan képek, hangok és videók, amelyek úgy tűnik, hogy hagyományos módszerekkel készültek, de valójában kifinomult szoftverrel készültek.

A Deepfakes már egy ideje létezik, és bár eddig a legnépszerűbb alkalmazásuk az volt, hogy híres emberek fejét pornográf filmekben szereplő színészek testére helyezik, képesek meggyőző felvételeket készíteni arról, hogy bárki bármit csinál, bárhol.

Ebben a bejegyzésben megvizsgáljuk a Deepfakes-eket, hogyan működik, hogyan hozhatod létre őket önállóan, és még sok mást.

Szóval, mi az a DeepFake?

A deepfake – a deep learning és a fake kifejezések kombinációja – egy darab szintetikus közeg amelyben a már létező fényképen vagy videón egy másik személy hasonlóságát használják fel egy személy hasonlóságának helyettesítésére.

A mélyhamisítások kifinomult gépi tanulási és mesterséges intelligencia technikákat alkalmaznak a megtévesztés lehetőségét rejtő vizuális és audio információk módosítására és létrehozására.

A mélytanulási módszerek, mint például az autoencoderek és a generatív ellenséges hálózatok a mélyhamisítás (GAN) elsődleges mechanizmusai.

Ezeket a modelleket egy személy arcérzelmeinek és mozgásainak elemzésére, valamint más, hasonló arckifejezéseket és mozgásokat mutató emberek arcképeinek szintetizálására használják.

A mélyhamisítások sztárpornográf videókban, álhírekben, álhírekben és pénzügyi csalásokban való felhasználása jelentős figyelmet kapott. Mind az ipar, mind a kormány arra válaszolt, hogy megpróbálta megtalálni őket és korlátozni a használatukat.

Elsőrendű mozgásmodell

Amikor a múltban mély hamisítványokat próbáltunk kifejleszteni, a probléma az volt, hogy szükségünk van valamiféle plusz tudásra vagy előzetesre, hogy ezek a megközelítések működjenek.

Illusztrációként arcjelölőkre van szükség, ha a fej mozgását nyomon akarjuk követni. Pózbecslésre volt szükség, ha az egész test mozgását akartuk feltérképezni.

Ez megváltozott a tavalyi NeurIPS konferencián, amikor a Torontói Egyetem kutatócsoportja bemutatta munkáit.Elsőrendű mozgásmodell képanimációhoz. "

Ehhez a megközelítéshez nincs szükség további animációs ismeretekre. Ezen túlmenően, a modell betanítása után felhasználható transzfertanulásra, és bármely, ugyanabba a kategóriába tartozó elemre alkalmazható.

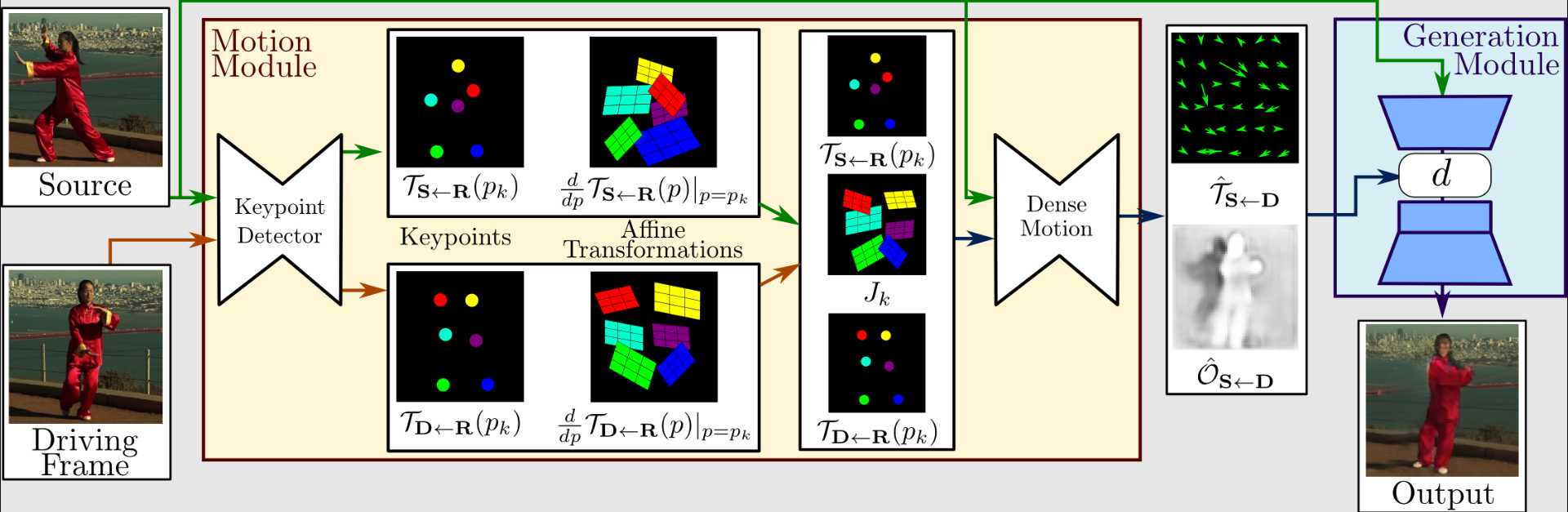

Nézzük egy kicsit tovább ennek a módszernek a működését. A mozgás kivonása és generálása alkotja a teljes folyamat első felét. A vezetési videó és a forrásképek bemenetként kerülnek felhasználásra.

A ritka kulcspontokból és helyi affin transzformációkból álló elsőrendű mozgásábrázolás kinyeréséhez a mozgáskivonó egy autoencodert használ a kulcspontok azonosítására.

Sűrű optikai áramlási és okklúziós térkép létrehozásához a sűrű mozgáshálózattal, ezeket a vezetési videóval együtt alkalmazzák. A generátor ezután a sűrű mozgáshálózatból származó kimenetek és a forráskép felhasználásával rendereli a célképet.

Mindent összevetve, ez a munka jobban teljesít, mint a legmodernebb. Olyan funkciókat is tartalmaz, amelyekkel más modellek egyszerűen nem rendelkeznek. Többféle képtípuson működik, így az arc, test, rajzfilmek stb. képeire is alkalmazható, ami rendkívül nagyszerű.

Ez sok új lehetőséget teremt. Stratégiánk másik úttörő szempontja, hogy most lehetővé teszi, hogy kiváló minőségű mélyhamisításokat készítsen a célobjektum egyetlen képének felhasználásával, hasonlóan ahhoz, ahogyan mi YOLO tárgynak elismerést.

A Deepfake modell létrehozásának folyamata

Három folyamat szükséges a mélyhamisítás generálásához: kivonás, betanítás és létrehozás. Ezen szakaszok főbb pontjairól és az általános folyamathoz való viszonyukról ebben a részben foglalkozunk.

Kivonat

A mélyhamisítások mély neurális hálózatokat használnak az arcok megváltoztatásához, és sok adatra (képre) van szükségük a helyes és meggyőző működéshez. A kivonási folyamat az a szakasz, amelyben a videoklipek összes képkockáját kivonják, felismerik az arcokat, majd az arcokat a teljesítmény maximalizálása érdekében igazítják.

Képzések

A képzési szakaszban a neurális hálózat egyik arcát a másikká változtathatja. A gyakorlati készlet méretétől és az oktatókütyü méretétől függően az edzés több órát vagy akár napot is igénybe vehet.

A képzést csak egyszer be kell fejezni, hasonlóan a legtöbb más neurális hálózati képzéshez. Az edzés után a modell képes lenne egy arcot A személyről B személyre változtatni.

Teremtés

A modell betanítása után mélyhamisítás készülhet. A képkockákat a rendszer egy videóból veszi, majd az összes archoz igazítja. Ezután a betanított neurális hálózatot használják az egyes keretek átalakítására.

Az átalakított lapot utolsó lépésként össze kell vonni az eredeti kerettel.

Mélyhamisítás-észlelési modell építése

A GitHub Repo felszerelése és klónozása

A Google GPU-inak ingyenes használata a Colabnál előnyös mély tanulás. További előny a Google Drive felhőalapú virtuális gépre (VM) való felszerelésének lehetősége.

Az összes cuccához való könnyű hozzáféréssel a felhasználó engedélyezve van. A Google Drive felhőben lévő virtuális géphez való csatlakoztatásához szükséges program ebben a részben található.

Modulok importálása

Most importáljuk az összes szükséges modult.

A modell kivitelezése

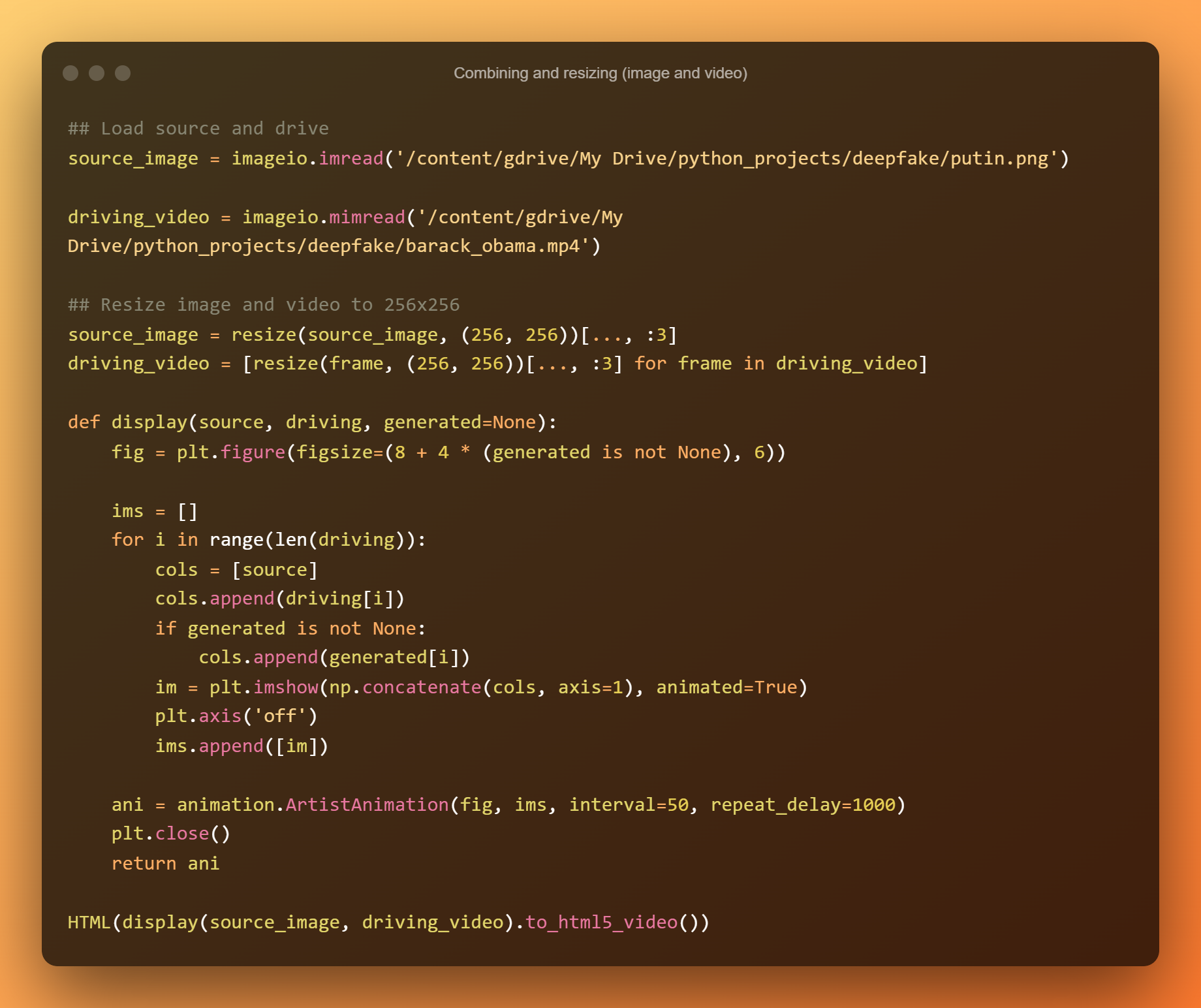

Olyan példát fogunk használni, amely Putyin állóképét (forráskép) és Obama videóját kombinálja. Az eredmény egy videó, amelyben Putyin pontosan ugyanazokkal az arckifejezésekkel beszél és gesztikulál, mint Obama vezetés közben.

A modell eredményének megjelenítése előtt megtörténik az adathordozó betöltése és a funkciók deklarálása. Ezután az ellenőrző pontok betöltődnek és a modell megépül. A mély hamisítvány létrehozása után két különböző stílusú animáció jelenik meg.

Putyint Obama mozgalmai mozgatják a relatív kulcsponteltolódást kihasználva. Elképesztő, ahogyan Putyin videóiban gyönyörűen és világosan ábrázolják Obama arcérzelmeit és testbeszédét.

Van néhány mikroszkopikus hiba, különösen, amikor Obama felvonja a szemöldökét és pislog a szemével. Ezeket a kifejezéseket nem pontosan reprodukálják Putyin keretei.

A mélyhamisított háttér nélkül a Putyin-film meglehetősen hitelesnek és hitelesnek tűnne, ha tévében vagy Közösségi média.

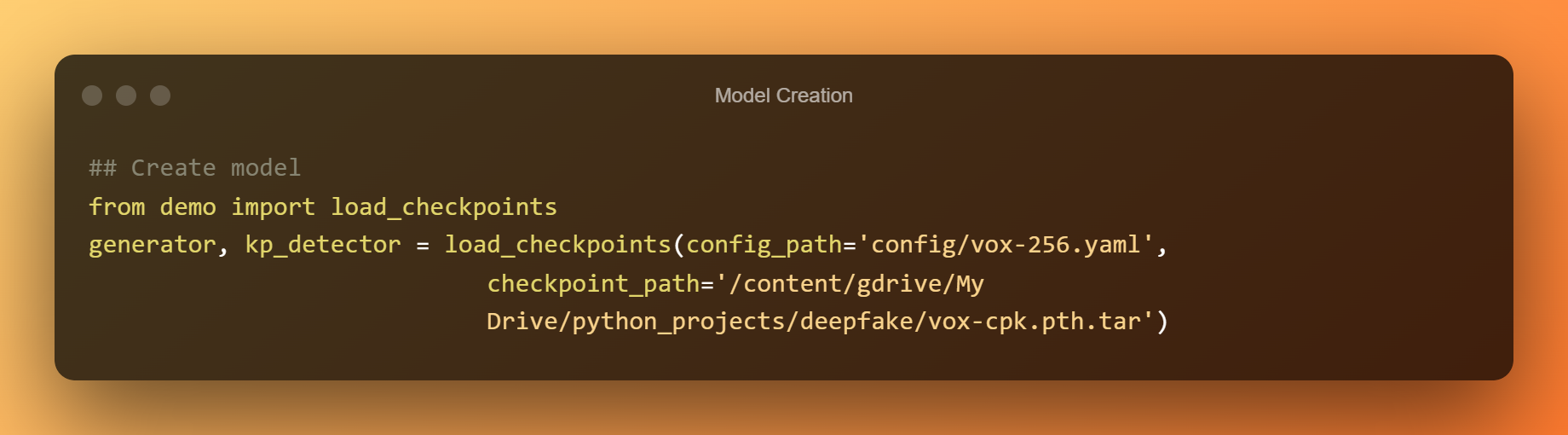

Modellalkotás

Most az előre betanított ellenőrzőpontokat fogjuk használni egy teljes modell létrehozásához.

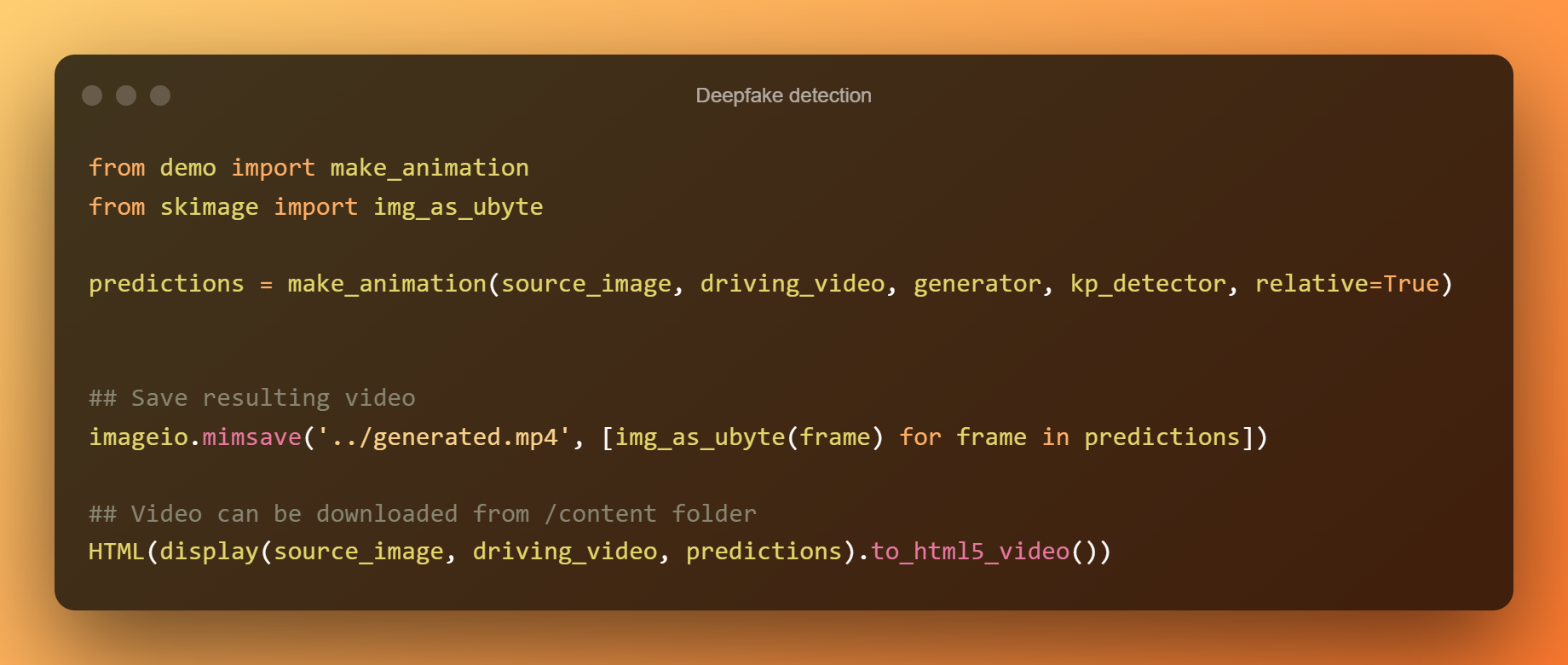

Mélyhamisítás észlelése

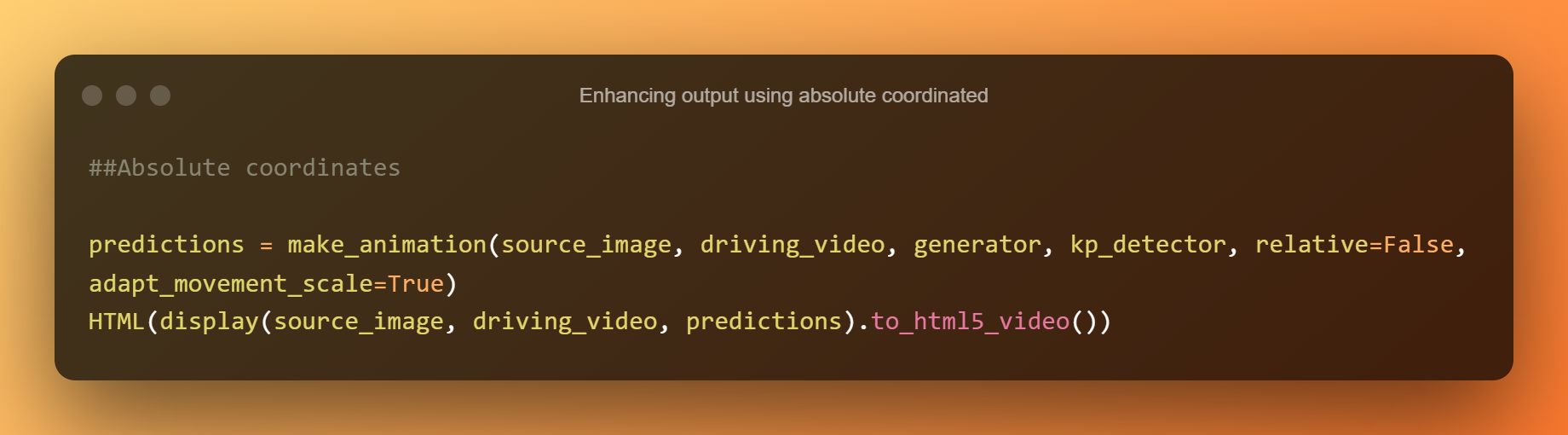

A relatív kulcspont-elmozdulás az alábbi cellában található elemek animálására szolgál. A következő cella ehelyett abszolút koordinátákat használ, de az összes elemarányt a vezetési videóból veszik így.

A kimenet javítása abszolút koordinátákkal

Ezzel a módszerrel mélyhamisítás-észlelést fejleszthet ki.

Milyen kockázatokkal jár a mélyhamisítás?

A Deepfake videók újdonságuk miatt immár megnyerőek és szórakoztatóak. Fennáll azonban annak a kockázata, hogy e látszólag vicces technológia felszíne alatt kicsúszik az irányítás.

Minden bizonnyal nehéz lesz különbséget tenni a hamis és a valódi videók között deepfake technológia tovább halad előre. Ez különösen a prominens személyiségek és hírességek esetében súlyos következményekkel járhat. A szándékosan rosszindulatú mélyhamisítások teljesen tönkretehetik a karriert és az életet.

Ezeket valaki rosszindulatú szándékkal felhasználhatja mások javára, és kihasználhatja barátait, rokonait és munkatársait. Külföldi vezetők hamis filmjeinek felhasználásával világszerte vitákat, sőt háborúkat is képesek kirobbantani.

Következtetés

Összefoglalva: egy furcsa időszakban és szokatlan környezetben élünk. Minden eddiginél egyszerűbb hamis híreket és filmeket készíteni és terjeszteni. Egyre nagyobb kihívást jelent annak megértése, hogy mi igaz és mi nem.

Úgy tűnik, ma már nem hagyatkozhatunk saját érzékszerveinkre.

Annak ellenére, hogy hamis videodetektorokat fejlesztettek ki, csak idő kérdése, mikor lesz olyan szűk az információs rés, hogy még a legkiválóbb hamis detektorok sem tudják megállapítani, hogy a videó valódi-e vagy sem.

Hagy egy Válaszol